2. 武夷学院 认知计算与智能信息处理福建省高校重点实验室,福建 武夷山 354300;

3. 厦门大学 信息与通信工程博士后流动站,福建 厦门 361005;

4. 厦门大学 信息科学与技术学院,福建 厦门 361005

2. The Key Laboratory of Cognitive Computing and Intelligent Information Processing of Fujian Education Institutions, Wuyi University, Wuyishan 354300, China;

3. Post-Doctoral Mobile Station of Information and Communication Engineering, Xiamen University, Xiamen 361005, China;

4. Department of Artificial Intelligence, School of Informatics, Xiamen University, Xiamen 361005, China

武夷岩茶是中国传统名茶,品种资源丰富,史书记载有上千个品种。因此武夷岩茶茶树品种的智能识别技术对研究武夷岩茶茶树的分布情况以及种质资源保护具有重要意义。基于叶片的识别是植物种类识别最直接有效的方法[1]。鉴于武夷岩茶不同茶树品种的叶片在形态、大小和颜色上存在差异,因此,武夷岩茶叶片是识别茶树品种的首要特征。然而不同品种的武夷岩茶鲜茶叶叶片大小、形状、颜色区别细微,在没有丰富经验的情况下,仅凭肉眼不易分辨茶叶所属品种,因此研究自动化的茶叶品种识别方法是必要且有意义的工作。

当前,深度学习已成为解决图像分类问题的一种重要方法[2-5],尤其是基于卷积神经网络(convolutional neural network,CNN)的深度学习。该方法能得到更准确且接近图像高级语义的特征,已在图像分类方面取得了突破性进展[6-8]。目前,有不少研究者尝试将CNN应用于植物分类问题。Yalcin等[9]提出了一种改进的CNN结构,并在植物图像的分类问题上取得了比基于LBP、GIST等特征描述方法更高的分类准确率。Lee等[10]采用基于解卷积网络的方法识别植物叶片特征,展示了植物叶片特征从低层抽象到高层抽象的层次转换。Grinblat等[11]使用深度CNN模型自动提取植物叶脉特征,证明通过增加模型深度可提高植物分类的准确率。Pawara等[12]使用基于CNN的方法在多种植物图像数据集上进行分类实验,结果表明深度CNN方法优于人工特征提取方法。

在武夷岩茶鲜茶叶叶片图像分类问题上,目前还未见到基于CNN的相关研究工作,已有方法仍然采用人工提取特征的技术路线。例如,林丽惠等[13]人工提取武夷岩茶鲜茶叶叶片图像的14种形状和纹理图像特征,然后使用支持向量机进行分类,取得了91%的分类准确率。总体上,基于人工提取特征的鲜茶叶叶片图像分类方法的分类准确率都在90%左右[14-16]。

本研究针对武夷岩茶鲜茶叶叶片图像分类问题,在现有CNN模型的基础上,提出了一个融合整体与局部信息的两分支并行卷积神经网络模型。该模型在武夷岩茶的9个茶叶品种共计7330张鲜茶叶叶片图像数据集上的分类准确率显著超过已有方法。

1 常见的CNN模型2012年,由Alex等提出的AlexNet[17]模型赢得了2012年ImageNet项目的大规模视觉识别挑战(ILSVRC)的第一名,取得Top-5错误率为16.4%的成绩。2014年,牛津大学视觉几何组提出的VGGNet模型[18]在ILSVRC比赛中将Top-5错误率降到7.32%。Google提出的GoogLeNet模型及其后续版本[19]在ILSVRC比赛中将Top-5错误率降低至4.8%。从上述CNN模型发展过程看,采用越来越深的网络结构是发展趋势。因为从AlexNet、VGGNet到GoogLeNet,网络模型的深度越来越深,同时在ILSVRC比赛上取得的成绩也越来越好。

2 ResNet模型 + 迁移学习在CNN模型中,常通过增加网络深度来提升模型的表达能力。但随着网络深度的增加,梯度消失等问题导致网络参数的寻优过程变得愈发困难。为此,何恺明等[20]提出了深度残差网络(residual network,ResNet),并在2015年的ILSVRC比赛中将Top-5错误率降至3.57%。ResNet模型的核心思想是引入输入到输出的捷径连接(图1),以降低数据中信息的冗余度[21]。ResNet模型有不同的网络层数,常用的有18层深度的ResNet18和50层深度的ResNet50。

|

Download:

|

| 图 1 ResNet中的捷径连接 Fig. 1 Shortcut connection in ResNet | |

将深度CNN模型应用于图像分类问题的困难之一是需要庞大的图像数据集,否则其分类准确率不佳。迁移学习[22]是一种把源领域知识迁移到目标领域的方法,适用于源领域数据量充足而目标领域数据量较小的情况。因此在图像数据量较小的情况下,可将CNN模型和迁移学习相结合。这样做有3个益处:1) CNN模型能充分利用源领域的大数据来预训练网络的参数;2) CNN模型在训练过程中性能提升的速率更快;3) CNN模型训练过程能更平稳地收敛到局部最优值。

3 整体与局部信息融合的CNN模型针对武夷岩茶鲜茶叶叶片分类问题,本研究构建了一个如图2所示的整体与局部信息融合的CNN模型(IGL-CNN),并将在ImageNet数据集上预训练的ResNet模型通过微调网络参数的方式迁移到武夷岩茶鲜茶叶叶片分类问题中。

|

Download:

|

| 图 2 整体与局部信息融合的CNN模型 Fig. 2 CNN mode constructed by integrating global and local information | |

IGL-CNN模型包含两个并行分支,分别用于提取鲜茶叶叶片的全局特征和局部特征。两个分支都采用在ImageNet数据集上通过预训练得到的ResNet模型。第一个分支的输入是完整的茶叶叶片图像(整体信息),其输出是叶片的全局特征。第二个分支的输入是局部的茶叶叶片图像(局部信息),其输出是叶片的局部特征。其次,在特征融合层将全局特征和局部特征进行融合,得到叶片图像对应的最终特征向量。最后,通过分类层将融合后的特征向量分类到不同的茶品种类别。

3.2 局部特征提取将叶片图像归一化到224像素×224像素,然后再将叶片图像均匀划分为

|

Download:

|

| 图 3 叶片图像的块划分 Fig. 3 Division of a leaf image into blocks | |

用特征串联操作将IGL-CNN模型提取出的茶叶叶片图像全局特征

考虑到武夷岩茶鲜茶叶叶片图像样本数量的不均匀性,本研究使用交叉熵作为损失函数。假设待分类的武夷岩茶鲜茶叶叶片共有

| ${l_{{\rm{CE}}}} = - \sum\limits_{i = 1}^C {{t_i}} \log ({y_i})$ | (1) |

对所有

| $L = - \sum\limits_{k = 1}^N {\sum\limits_{i = 1}^C {{t_{ki}}} \log ({y_{ki}})} $ | (2) |

当叶片样本

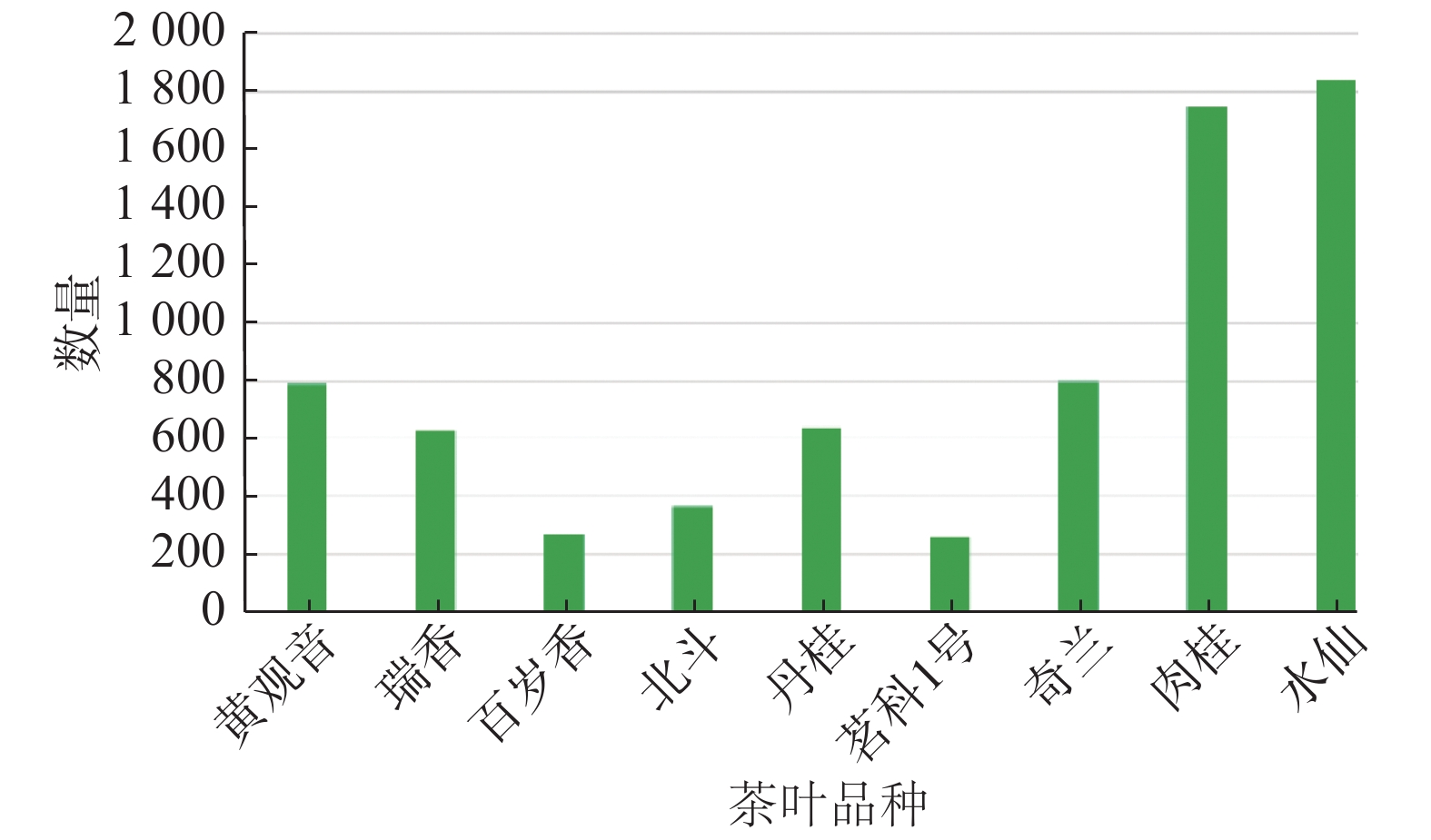

数据集为实地采集武夷岩茶中9个茶叶品种共计7330张鲜茶叶叶片图像。图4列出了9种茶叶品种的鲜茶叶叶片图像数目。

|

Download:

|

| 图 4 9种茶叶品种的鲜茶叶叶片图像数目 Fig. 4 Numbers of fresh tealeaf images of nine kinds of teas | |

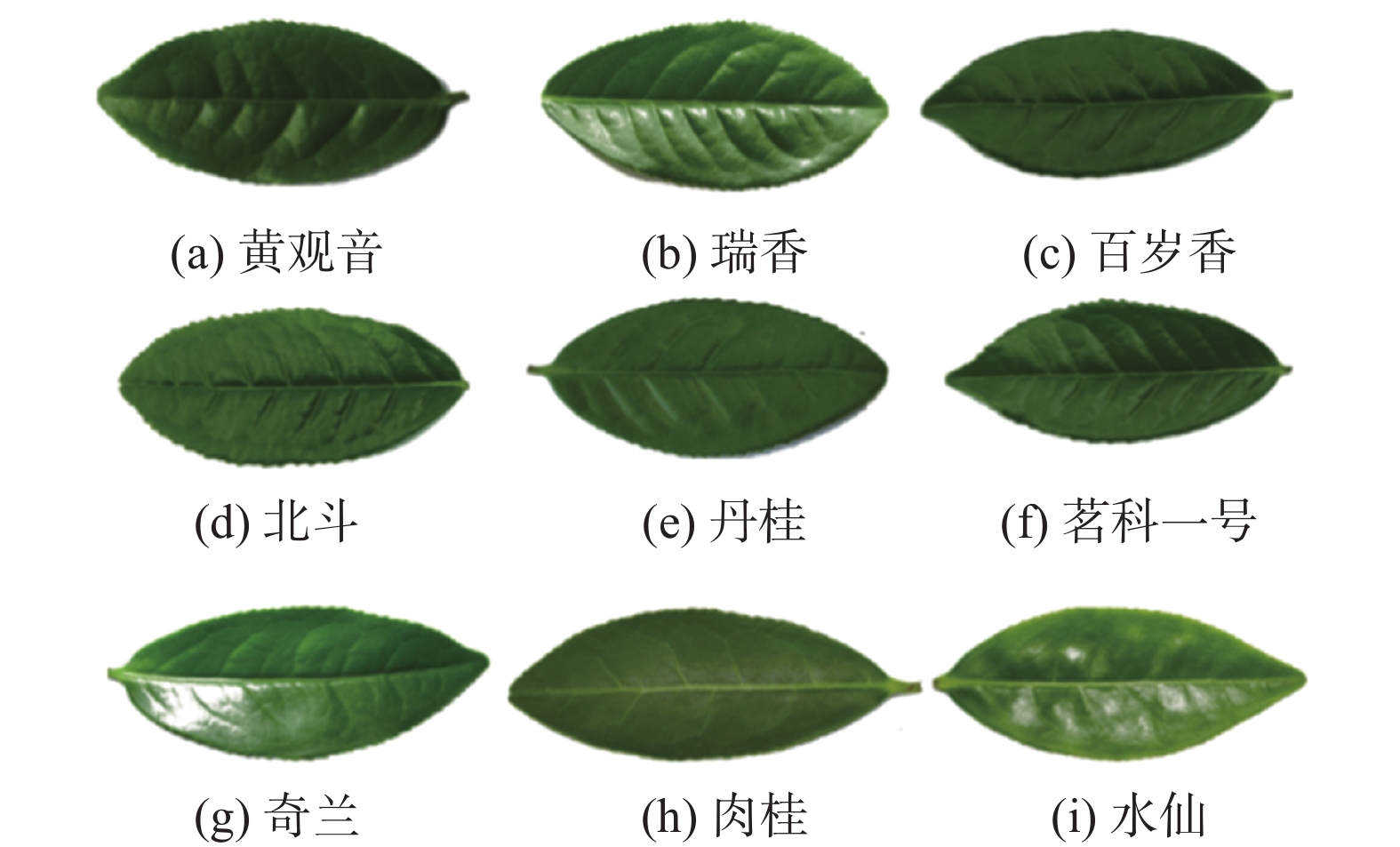

通过基于阈值的图像分割算法对叶片图像进行预处理,提取图像前景区域,然后将背景颜色设置为纯白。图5为武夷岩茶鲜茶叶叶片图像的预处理结果。

|

Download:

|

| 图 5 预处理后的9个品种的鲜茶叶叶片图像 Fig. 5 Images of fresh tealeafs of nine kinds of teas after preprocessing | |

将7330张叶片图像数据按7:3的比例划分为训练集和测试集。在IGL-CNN模型中,第1个ResNet模型的输入为整个叶片图像,用于提取叶片图像的全局特征,第2个ResNet模型的输入为叶片图像块,即图3所示的3组叶片图像块中的一组或者多组,用于提取叶片图像的局部特征。IGL-CNN模型中全连接层的输出设为9维矢量,以适应9类茶叶品种。

使用随机梯度下降方法训练模型。为客观比较网络模型和训练机制对分类准确率的影响,对实验中的超参数进行统一处理,超参数的具体值如表1所示:

| 表 1 超参数值 Tab.1 The values of hyperparameters |

将IGL-CNN模型中的两个分支均设置为ResNet18。局部的茶叶叶片信息分为边缘、中间和前后端3类,实验中选择了7种组合作为第2个分支的输入。表2给出了这7种输入对应的分类准确率,可见全局信息与边缘信息融合的策略取得了96.68%的最高分类准确率。

| 表 2 配置ResNet18的IGL-CNN模型的分类准确率 Tab.2 Classification accuracies of IGL-CNN mode with ResNet18 |

将IGL-CNN模型中的两个分支均设置为ResNet50。为了与配置ResNet18的IGL-CNN模型进行最优分类准确率的对比,将配置ResNet50的IGL-CNN模型的第2个分支的输入设置为图像边缘信息。实验结果表明其分类精度为96.36%,低于对应配置ResNet18的IGL-CNN模型的分类准确率96.68%。这表明对于7330张叶片图像数据集,18层的网络已足够深。如果希望在配置ResNet50的IGL-CNN模型上取得更好的分类准确率,7330张叶片图像数据集小了,需要更大的数据集。

4.4.3 单分支CNN模型为验证两分支并行卷积神经网络相较于单分支卷积神经网络的优越性,对单分支CNN模型进行了实验。第1次实验将单分支设为ResNet18模型,第2次实验将单分支设为ResNet50模型,第3次实验将单分支设为VGG16模型,第4次实验将单分支设为AlexNet模型。

综合以上3类实验结果,可得到以下结论。

1)当IGL-CNN模型的输入是整个叶片图像信息与图像边缘信息时取得96.68%的最高分类准确率;

2)当IGL-CNN模型的输入是整个叶片图像信息与图像中间信息时,分类准确率为96.27%,高于单分支CNN模型的最高分类准确率96.04%;

3)当IGL-CNN模型的输入是整个叶片图像和图像前后端信息时,分类准确率为92.25%,略高于单分支CNN模型的最低分类准确率92.21%。

4)对于武夷岩茶鲜茶叶叶片分类问题,除了全局信息,叶片图像的边缘局部信息和中间局部信息也是区分叶片种类的重要信息。图像的边缘信息反映了叶片的边缘形状特征,图像的中间信息反映了叶片的纹理特征。因此,边缘形状和纹理是分类叶片种类的重要信息。在加入图像的前后端信息后,叶片分类的准确率出现了下降,这说明叶片图像的前后两端信息对区分叶片种类的作用不大。

5)合理选择CNN模型的深度很重要。理论上,模型深度越深,模型的表达能力越好。如表3所示,ResNet50模型的分类准确率要高于ResNet18模型的分类准确率。但对于配置ResNet50的IGL-CNN模型和配置ResNet18的IGL-CNN模型而言,这种情况出现了逆转。考虑到IGL-CNN模型的两分支并行结构包含的参数数目是单分支CNN模型的2倍,这说明7330张叶片图像数据集对于配置ResNet50的IGL-CNN模型是不够的,如果想进一步提高配置ResNet50的IGL-CNN模型的分类准确率,还需增大图像数据集的容量。

| 表 3 4种单分支CNN模型的分类准确率 Tab.3 Classification accuracies of 4 kinds of single-branch CNN models |

针对武夷岩茶鲜茶叶叶片图像分类问题,本研究设计了一个两分支并行结构的CNN模型。该模型融合了叶片图像的整体与局部信息,并在给定的武夷岩茶鲜茶叶叶片图像数据集上取得了很好的分类准确率。此外,实验结果还表明,除了图像的全局信息外,图像的边缘信息和纹理信息也是识别武夷岩茶鲜茶叶叶片的重要特征。以上结论为后续研究工作提供了有益的借鉴。

| [1] |

张宁, 刘文萍. 基于图像分析的植物叶片识别技术综述[J]. 计算机应用研究, 2011, 28(11): 4001-4007. ZHANG Ning, LIU Wenping. Plant leaf recognition technology based on image analysis[J]. Application research of computers, 2011, 28(11): 4001-4007. DOI:10.3969/j.issn.1001-3695.2011.11.001 (  0) 0)

|

| [2] |

卢宏涛, 张秦川. 深度卷积神经网络在计算机视觉中的应用研究综述[J]. 数据采集与处理, 2016, 31(1): 1-17. LU Hongtao, ZHANG Qinchuan. Applications of deep convolutional neural network in computer vision[J]. Journal of data acquisition and processing, 2016, 31(1): 1-17. (  0) 0)

|

| [3] |

王成济, 罗志明, 钟准, 等. 一种多层特征融合的人脸检测方法[J]. 智能系统学报, 2018, 13(1): 138-146. WANG Chengji, LUO Zhiming, ZHONG Zhun, et al. Face detection method fusing multi-layer features[J]. CAAI transactions on intelligent systems, 2018, 13(1): 138-146. (  0) 0)

|

| [4] |

周俊宇, 赵艳明. 卷积神经网络在图像分类和目标检测应用综述[J]. 计算机工程与应用, 2017, 53(13): 34-41. ZHOU Junyu, ZHAO Yanming. Application of convolution neural network in image classification and object detection[J]. Computer engineering and applications, 2017, 53(13): 34-41. DOI:10.3778/j.issn.1002-8331.1703-0362 (  0) 0)

|

| [5] |

刘大伟, 韩玲, 韩晓勇. 基于深度学习的高分辨率遥感影像分类研究[J]. 光学学报, 2016, 36(4): 0428001. LIU Dawei, HAN Ling, HAN Xiaoyong. High spatial resolution remote sensing image classification based on deep learning[J]. Acta optica sinica, 2016, 36(4): 0428001. DOI:10.3788/AOS201636.0428001 (  0) 0)

|

| [6] |

李亚飞, 董红斌. 基于卷积神经网络的遥感图像分类研究[J]. 智能系统学报, 2018, 13(4): 550-556. LI Yafei, DONG Hongbin. Classification of remote-sensing image based on convolutional neural network[J]. CAAI transactions on intelligent systems, 2018, 13(4): 550-556. (  0) 0)

|

| [7] |

刘彪, 黄蓉蓉, 林和, 等. 基于卷积神经网络的盲文音乐识别研究[J]. 智能系统学报, 2019, 14(1): 186-193. LIU Biao, HUANG Rongrong, LIN He, et al. Research on braille music recognition based on convolutional neural networks[J]. CAAI transactions on intelligent systems, 2019, 14(1): 186-193. (  0) 0)

|

| [8] |

周飞燕, 金林鹏, 董军. 卷积神经网络研究综述[J]. 计算机学报, 2017, 40(6): 1229-1251. ZHOU Feiyan, JIN Linpeng, DONG Jun. Review of convolutional neural network[J]. Chinese journal of computers, 2017, 40(6): 1229-1251. (  0) 0)

|

| [9] |

YALCIN H, RAZAVI S. Plant classification using convolutional neural networks[C]//2016 Fifth International Conference on Agro-Geoinformatics. Tianjin, China, 2016: 1−5.

( 0) 0)

|

| [10] |

LEE S H, CHAN C S, MAYO S J, et al. How deep learning extracts and learns leaf features for plant classification[J]. Pattern recognition, 2017, 71: 1-13. DOI:10.1016/j.patcog.2017.05.015 ( 0) 0)

|

| [11] |

GRINBLAT G L, UZAL L C, LARESE M G, et al. Deep learning for plant identification using vein morphological patterns[J]. Computers and electronics in agriculture, 2016, 127: 418-424. DOI:10.1016/j.compag.2016.07.003 ( 0) 0)

|

| [12] |

PAWARA P, OKAFOR E, SURINTA O, et al. Comparing local descriptors and bags of visual words to deep convolutional neural networks for plant recognition[C]//6th International Conference on Pattern recognition Applications and Methods. Porto, Portugal, 2017: 479−486.

( 0) 0)

|

| [13] |

LIN Lihui, LI C, YANG Sheng, et al. Automated classification of Wuyi rock tealeaves based on support vector machine[J]. Concurrency and computation: practice and experience, 2019, 31(23): e4519. ( 0) 0)

|

| [14] |

PANDOLFI C, MUGNAI S, AZZARELLO E, et al. Artificial neural networks as a tool for plant identification: a case study on vietnamese tea accessions[J]. Euphytica, 2009, 166(3): 411-421. DOI:10.1007/s10681-008-9828-9 ( 0) 0)

|

| [15] |

陈怡群, 常春, 肖宏儒, 等. 人工神经网络技术在鲜茶叶分选中的应用[J]. 农业网络信息, 2010(7): 37-40, 43. CHEN Yiqun, CHANG Chun, XIAO Hongru, et al. Artificial neural networks technology in the fresh tea sorting[J]. Agriculture network information, 2010(7): 37-40, 43. DOI:10.3969/j.issn.1672-6251.2010.07.011 (  0) 0)

|

| [16] |

刘自强. 鲜茶叶图像特征提取及在茶树品种识别中的应用研究[D]. 长沙: 湖南农业大学, 2014. LIU Ziqiang. Features extraction of fresh tea images and its application on the recognition of tea varieties[D]. Changsha: Hunan Agricultural University, 2014. (  0) 0)

|

| [17] |

KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[C]//Proceedings of the 25th International Conference on Neural Information Processing Systems. Red Hook, USA, 2012: 1097−1105.

( 0) 0)

|

| [18] |

SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[J]. arXiv preprint arXiv: 1409.1556, 2014.

( 0) 0)

|

| [19] |

SZEGEDY C, LIU Wei, JIA Yangqing, et al. Going deeper with convolutions[C]//Proceedings of 2015 IEEE Conference on Computer Vision and Pattern Recognition. Boston, USA, 2015: 1−9.

( 0) 0)

|

| [20] |

HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas, USA, 2016: 770−778.

( 0) 0)

|

| [21] |

胡越, 罗东阳, 花奎, 等. 关于深度学习的综述与讨论[J]. 智能系统学报, 2019, 14(1): 1-19. HU Yue, LUO Dongyang, HUA Kui, et al. Overview on deep learning[J]. CAAI transactions on intelligent systems, 2019, 14(1): 1-19. (  0) 0)

|

| [22] |

庄福振, 罗平, 何清, 等. 迁移学习研究进展[J]. 软件学报, 2015, 26(1): 26-39. ZHUANG Fuzhen, LUO Ping, HE Qing, et al. Survey on transfer learning research[J]. Journal of software, 2015, 26(1): 26-39. (  0) 0)

|

2020, Vol. 15

2020, Vol. 15