2. 清华四川能源互联网研究院,四川 成都 610000;

3. 清华大学 水沙科学与水利水电工程国家重点实验室,北京 100084

2. Sichuan Energy Internet Research Institute, Tsinghua University, Chengdu 610000, China;

3. State Key Laboratory of Hydroscience and Engineering, Tsinghua University, Beijing 100084, China

系留无人机通过供电线缆连接地面供电系统与无人机端,可长时间留空[1-3]。由于系留无人机能长时间续航,能在巡检测量过程中持续作业,目前系留无人机已被广泛应用于各领域执行复杂任务,为电力巡检、灾后搜救、隧洞勘探等带来了诸多便利[4-7]。系留无人机定位,是系留无人机稳定飞行的关键,目前解决系留无人机在无GPS环境或弱GPS环境下的定位仍是一个难题[8-9]。

系留无人机在空旷的户外可依靠GPS和惯性测量单元(IMU)定位[10-12]。在弱GPS的户外或无GPS的室内,无人机的定位通常借助于激光雷达或视觉辅助定位[13-14]。激光雷达与视觉定位易受距离、天气、雾霾、粉尘等因素影响,且实时构建二维或三维地图的数据量庞大、处理过程相对复杂。惯性测量、激光雷达与视觉定位会随时间的累积造成数据的漂移,导致系留无人机在弱GPS或无GPS环境下的定位存在不可控环境因素干扰[15-16]。利用激光雷达、双目视觉、IMU多传感器融合定位的方式能解决系留无人机在无GPS或弱GPS环境下的定位问题,多个传感器的使用增加了系留无人机的负载,需要极大地增大系留无人机的动力。当系留无人机的功率过大时,系留线缆上的压降不可忽视,绳缆上的能量损耗以及散热会引出新的研究问题[17-19]。文献[20]提出了系留无人机绳缆定位的方法,利用绳缆数据来代替GPS、惯性测量单元、视觉传感器的数据来实现定位,但定位误差为0.367 5 m。因定位精度不高,所用的Fotokite Pro无人机可移植性差,以至于系留无人机绳缆定位方法难以被实际应用[21-22]。

针对上述在系留无人机室内不借助于激光雷达、视觉等定位方式下,仅仅依靠系留绳缆实现系留无人机在室内的定位。本文提出了基于力传感的系留无人机定位方法,建立了系留无人机绳缆定位物理模型,通过借助于系留绳缆与三维力传感器,能有效估计系留无人机所处空间位置。

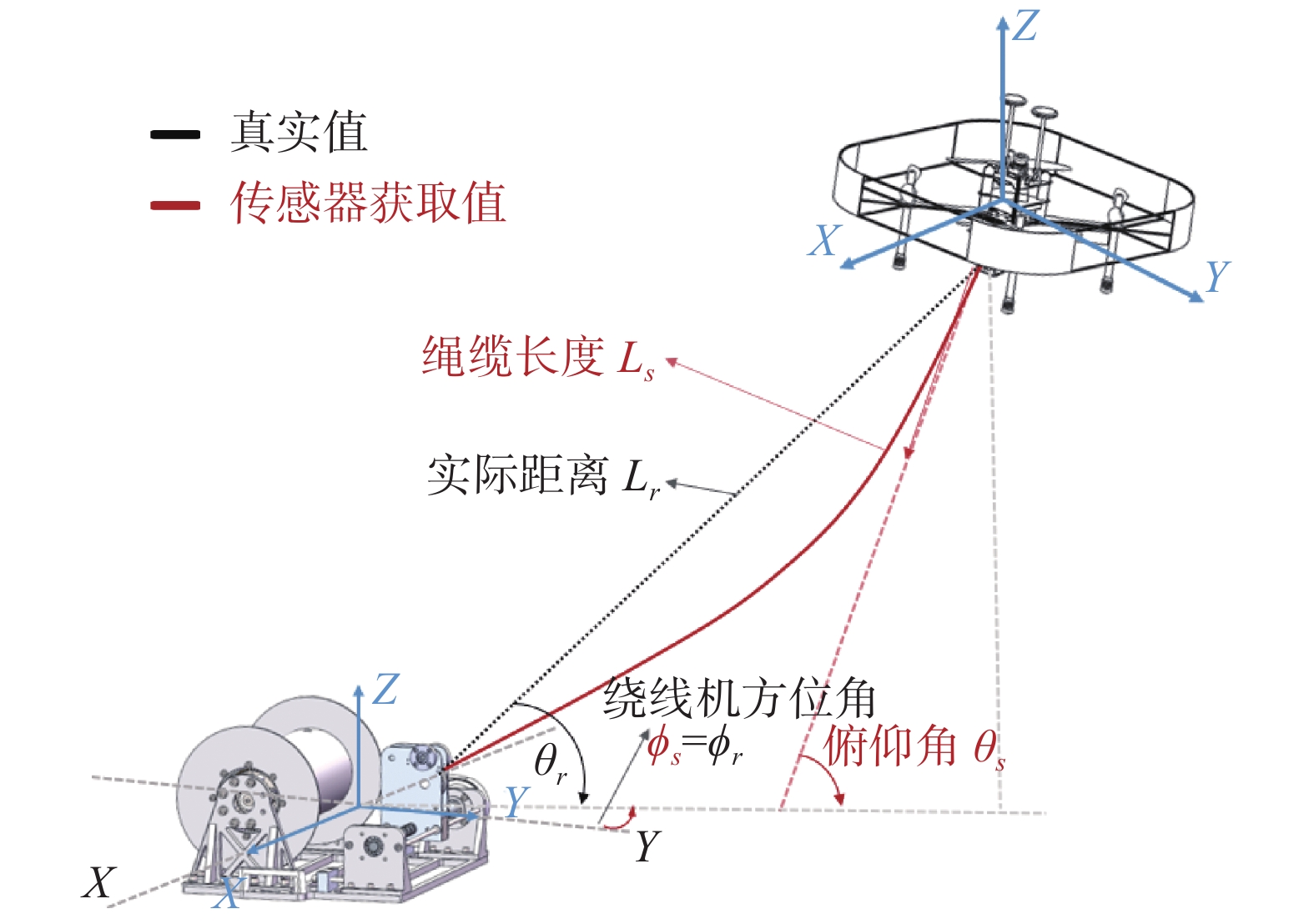

1 绳缆定位模型在系留无人机飞行过程中,随着绳缆长度的增加,系留绳缆对飞行姿态和位置的影响越来越大,有必要研究系留绳缆在空中的重量和模型,不能直接忽略。为了计算简便,通常把模型中绳缆与绕线机的距离当作直线距离而忽略绳缆的实际状态,而在实际测试中绳缆因重力导致绳缆弯曲。尽量还原实际情况可以把系留绳缆弯曲的状态看成悬链曲线,利用系留绳缆建立悬链线模型(如图1所示)。

|

Download:

|

| 图 1 系留无人机绳缆定位模型 Fig. 1 Tethered UAV tether positioning model | |

利用几何方法可以估计无人机与绕线机之间的直线距离[16, 20]。整个系统由搭载三维力传感器的无人机、硅胶线缆、地面绕线机3个部分构成,通过测定绳缆的长度

绕线机的末端带编码器,可测量绳缆长度,因此把绕线机的末端当作空间坐标系的原点。图1模型中系留无人机的空间坐标位置表示为

| $ \left\{ {\begin{array}{*{20}{l}} {x = {L_r}\cos {\theta _r}\sin {\phi _r}}\\ {y = {L_r}\cos {\theta _r}\cos {\phi _r}}\\ {z = {L_r}\sin {\theta _r}} \end{array}} \right. $ |

式中:

系留无人机悬停在空中,受力如图2所示。

|

Download:

|

| 图 2 悬停受力分析 Fig. 2 Hover force analysis | |

无人机满足平衡方程:

| $ \left\{ {\begin{array}{*{20}{l}} {F\cos \beta = T\cos {\theta _s}}\\ {F\sin \beta = T\sin {\theta _s} + G} \end{array}} \right. $ | (1) |

式中:

| $ \left\{ \begin{array}{l} F{\rm{ = }}\dfrac{G}{{\sin \beta {\rm{ - }}\cos \beta \tan {\theta _s}}}\\ T{\rm{ = }}\dfrac{G}{{\cos {\theta _s}\tan \beta - \sin {\theta _s}}} \end{array} \right. $ | (2) |

系留无人机绳缆用悬链线模型表示,绳缆上的受力分析如图3所示。

|

Download:

|

| 图 3 绳缆自然受力图 Fig. 3 Tether natural force diagram | |

B点表示无人机端三维力传感器末端,A点表示绕线机末端。绳缆上力受力平衡方程可表示为

| $ \left\{ \begin{array}{l} {T_1}\cos {\theta _s} = {T_0}\\ {T_1}\sin {\theta _s} = W \end{array} \right. $ |

式中:

|

Download:

|

| 图 4 力的合成 Fig. 4 Force synthesis | |

从三维力传感器上通过力的合成可以间接获得无人机上的拉力和俯仰角。无人机上的拉力大小和系留绳缆上的拉力大小相等方向相反,即

| $ T=T_1 $ |

系留线缆上任意一小段的受力情况可表示为

| $ \left\{ \begin{array}{l} {{{{\rm{d}}}} / {{\rm{d}}y}} \centerdot \left( {T_{{y}} \centerdot {\rm{sin}}\;\theta {{y}}} \right) = {{{{\rm{d}}}} / {{{{\rm{d}}}}y}} \centerdot Wy{\rm{}}\\ {{{\rm{d}}L = }}\sqrt {{{\left( {{{{\rm{d}}}}y} \right)}^2} + {{\left( {{{{\rm{d}}}}{{z}}} \right)}^2}} = \sqrt {1 + \left( {{{{{{\rm{d}}}}z} / {{{{\rm{d}}}}y}}} \right) \centerdot {{{\rm{d}}}}y} \\ {\rm{tan}}\theta {{y}}\;{\rm{ = }}{{{{{\rm{d}}}}{{z}}} / {{{{\rm{d}}}}{{y}}}} \end{array} \right. $ | (3) |

将任意一点拉力

| $T_{{y}} = {{T_0} / {\cos \theta _y}}$ | (4) |

把式(4)代入式(3)简化得

| $ \left\{ \begin{array}{l} \dfrac{{\rm{d}}}{{{\rm{d}}y}}\left( {{T_0}\tan {\theta _y}} \right) = \dfrac{{\rm{d}}}{{{\rm{d}}y}}{W_y} = \gamma \centerdot {\rm{d}}L\\ \gamma = \rho vg \end{array} \right. $ | (5) |

式中:

| ${\rm{d}}L = \sqrt {1 + {{\left( {{\rm{d}}z/{\rm{d}}y} \right)}^{\rm{2}}}} \centerdot {\rm{d}}y$ |

绳缆的长度

| $L_s{\rm{ = }}\int_{\rm{0}}^{L_{{y}}} {\sqrt {1 + {{\left( {\mathop {{\rm{d}}z}\nolimits^{} /\mathop {{\rm{d}}y}\nolimits^{} } \right)}^2}} } $ | (6) |

式(6)代入式(5)中,并做微分处理可得:

| $ \frac{{\rm{d}}}{{{\rm{d}}z}}\left( {\frac{{{\rm{d}}z}}{{{\rm{d}}y}}} \right) = \frac{{\rho g}}{{T_0}}\centerdot \sqrt {1 + {{\left( {{\rm{d}}z/{\rm{d}}y} \right)}^{\rm{2}}}} \centerdot {\rm{d}}y $ | (7) |

式(7)做积分分离,整理后可得到悬链线方程:

| $ \left\{ \begin{array}{l} z = a \centerdot \cosh \left( {{y / a}} \right)\\ a = {{{T_0}} / \gamma }\\ \cosh \left( x \right) = {{\left( {{{\rm{e}}^x} + {{\rm{e}}^{-x}}} \right)} / 2} \end{array} \right. $ | (8) |

式中

| $\frac{{{\rm{d}}z}}{{{\rm{d}}y}} = \tan \theta _y = \sinh \left( {{\kern 1pt} \frac{y}{a}} \right)$ | (9) |

式(9)代入式(6)得到绳缆长度:

| $ {L_s} = \int_0^{{L_y}} {\sqrt {{\rm{1 + }}\left( {\sinh \frac{y}{a}} \right)} } {\rm{d}}y = a\centerdot \sinh \frac{{{L_y}}}{a} $ |

式(9)是通用表示情况,系留无人机连接绳缆端的角度大小为

| $ \left\{ \begin{array}{l} \tan {\theta _s} = \sinh \left( {{{L_{{y}}} / a}} \right)\\ {L_s}{\rm{ = }}a \centerdot \sinh \left( {{{{L_{{y}}}} / a}} \right) - a \centerdot \sinh \left( 0 \right)\\ {L_z}{\rm{ = }}a \centerdot \cosh \left( {{{{L_{{y}}}} / a}} \right) - a \centerdot \cosh \left( 0 \right) \end{array} \right. $ |

三维拉力传感器采用VARIENSE厂商的FSE103,传感器直径39 mm,重量40 g,拉力范围为在0~80 N,最小精度0.01 N。三维力传感器如图5所示,在传感器受力区施加量程范围内的力,可通过上位机读取笛卡尔坐标系下3个坐标轴上力的大小。为了统一坐标系,在安装三维力传感器时应使3个坐标轴与绕线机为原点建立的坐标轴保持一致。三维力传感器精度能达到0.01 N,在实际使用过程中微小的受力变化也能被传感器捕获,同时受力区在没有受到外力时传感器存在噪声数据,如图6所示,为了消除噪声干扰对真实数据的影响,在测量之前需要对噪声数据做预处理。传感器未受力时取1 000个带噪声的数据求取均值,若用n0表示无外力时带噪声数据,传感器受绳缆拉力时的测量数据用N表示,那么测量数据的真实值可用N−n0表示。

|

Download:

|

| 图 5 三维力传感器 Fig. 5 Three-dimensional force sensor | |

|

Download:

|

| 图 6 三维力传感器噪声 Fig. 6 Three-dimensional force sensor noise | |

无人机使用DJI F450机架,三维力传感器悬挂于无人机底部重心位置,系留线缆通过螺纹螺栓与硅胶线缆连接。系留线缆末端与地面绕线机相连接,绕线机可控制绳缆长度变化,使绳缆始终能处于悬链线模型状态。

2.2 绕线机与绳缆绕线机可根据绳缆上张力大小使绳缆保持自动收放。为了使实验效果明显,系留线缆选取了密度较大的硅胶线缆,并且硅胶线缆不是完全均匀,为了减小绳缆密度不均匀产生的误差,这里采用多点测量取平均值的方式获得绳缆密度。绳缆密度计算方式为

| $ \left\{ \begin{array}{l} \rho {\rm{ = }}\dfrac{m}{V}\\ V = {\text{π}} {r^2} \cdot L \end{array} \right. $ |

式中:m表示绳缆的总质量;V表示绳缆的总体积;r表示绳缆半径;L表示绳缆总长,数据测定如表1所示。

| 表 1 系留绳缆参数表 Tab.1 Tethered rope parameter table |

绕线机通过张力测试控制绳缆收放的同时绕线机末端的编码器也能测量绳缆的长度

悬链线模型估计的定位数据需要与系留无人机在室内所处空间位置的真实值对比获得定位精度。系留无人机实验场地由

|

Download:

|

| 图 7 实验测试场地 Fig. 7 Experimental test site | |

由于绕线机不能自由旋转,因此不能实现绕线机与绳缆偏角的测量,在实验过程中做以下约束,以便于实验数据的处理:

1)绕线机的角度固定,不能在任意位置偏转,即不需要考虑绕线机被系留绳缆拖拽的方位角。

2)系留无人机空间位置估计过程中忽略无人机的飞行姿态(横滚、俯仰、偏航),把系留无人机当作质点。

3)坐标系的选取,以绕线机为原点建立笛卡尔坐标系,系留无人机的位置是相对于坐标原点的空间位置。

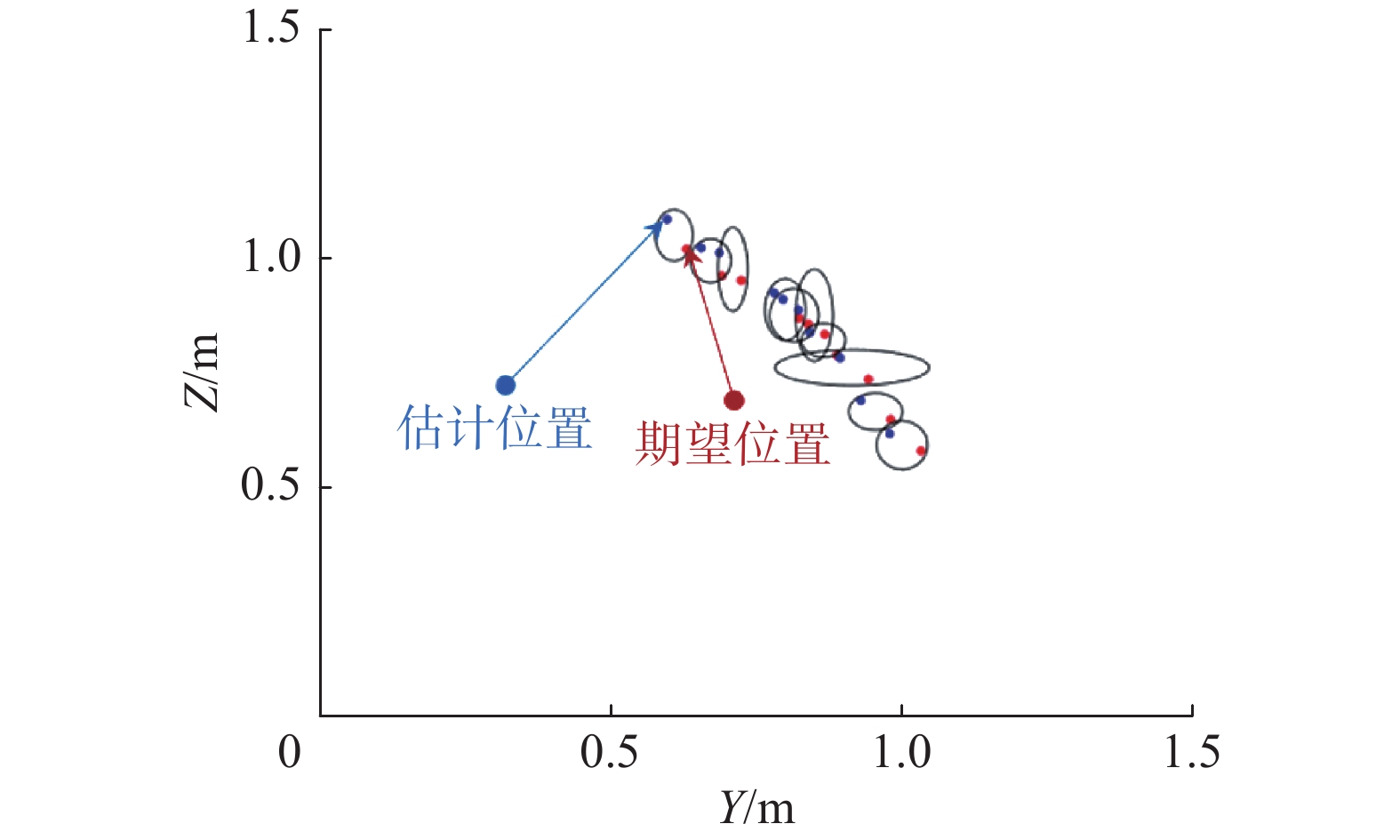

4 数据分析在实验场地中分别测量绳缆长度为1.2、1.8、2.4、3.0 m时的数据。为了验证该定位方法的有效性,将Indoor “GPS”获取的数据表示系留无人机的期望位置,悬链线模型下得到的数据表示估计位置。

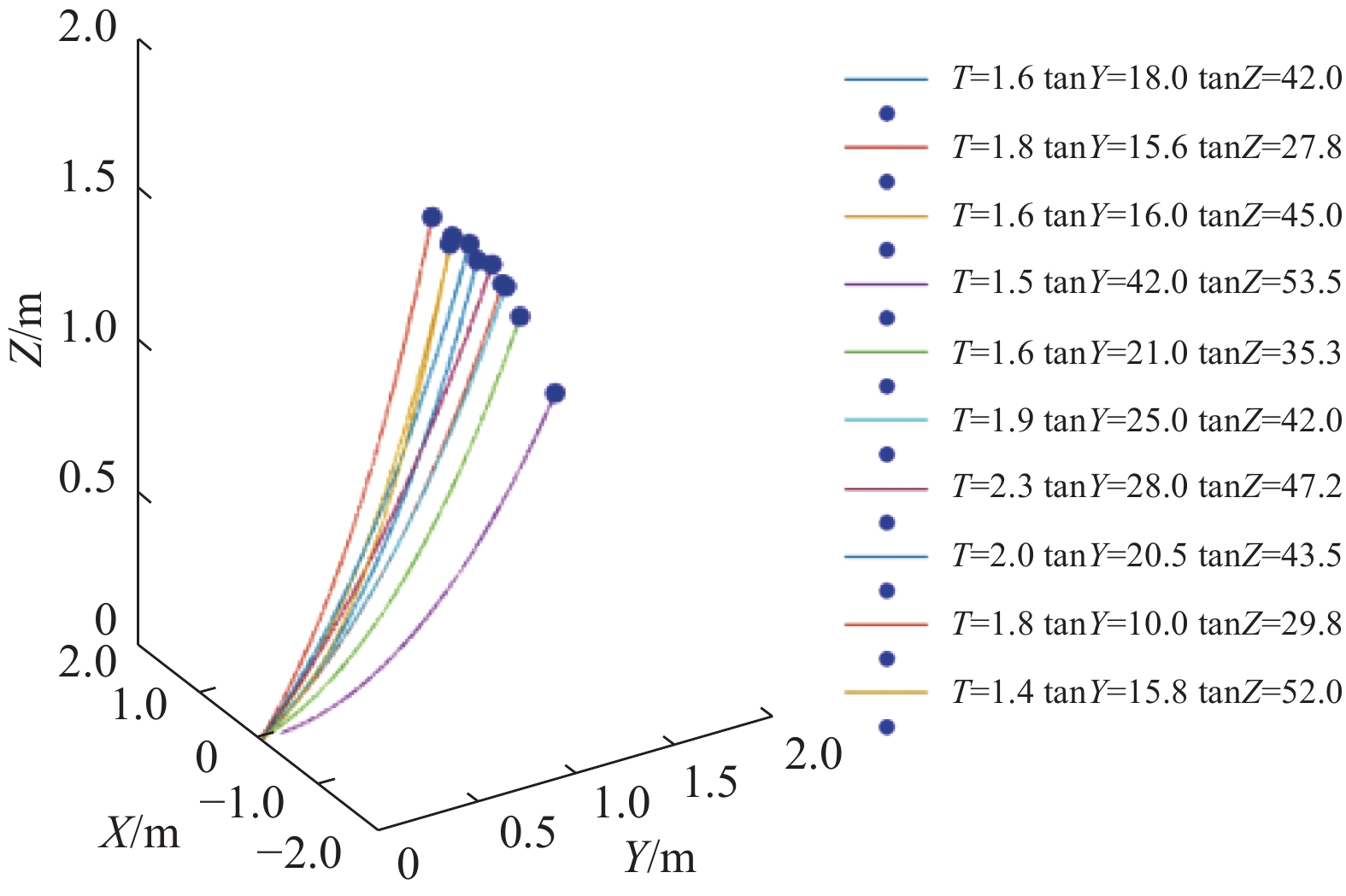

绳长为1.2 m时无人机位置的变化,改变的物理量只有三维力传感器上拉力的大小和方向,图8表示悬链线位置估计下系留无人机在10次测量中位置变化情况。

|

Download:

|

| 图 8 绳长1.2 m位置估计 Fig. 8 Rope length 1.2 m position estimate | |

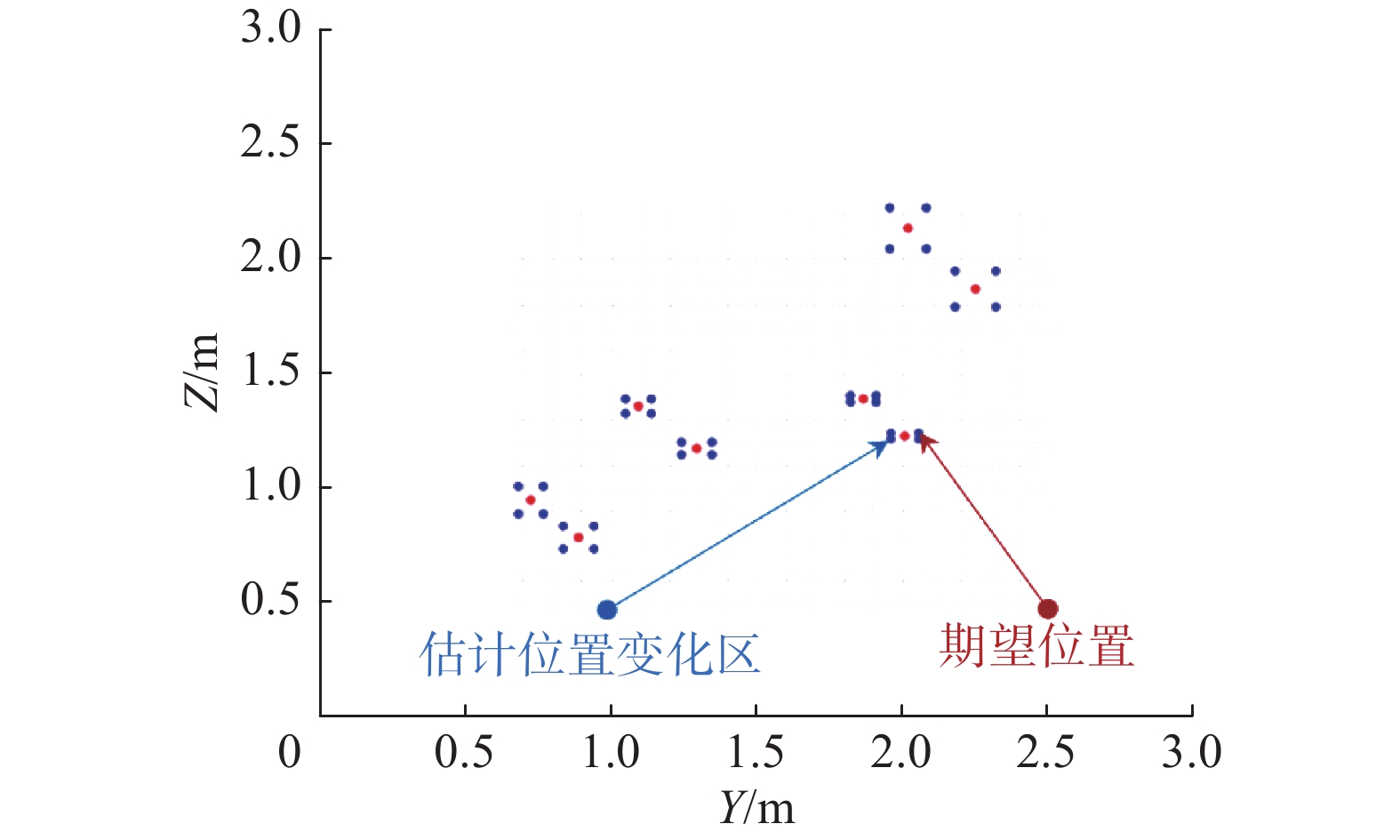

把系留无人机的空间位置在YZ坐标轴的平面上投影,对比期望位置与估计位置的误差如图9所示。红色圆点表示RTK获得的期望位置,蓝色圆点表示悬链线模型估计位置,黑色椭圆表示每一组期望值与估计值的距离范围,椭圆中红色点与蓝色点距离越近误差越小。10次实验中,测量误差取平均值,Y方向的误差为5.193%,Z方向的误差为6.341%。

|

Download:

|

| 图 9 绳长1.2 m误差对比 Fig. 9 Rope length 1.2 m error comparison | |

绳长为1.8 m时,悬链线模型估计位置如图10所示。期望位置与估计位置误差比较如图11所示。

|

Download:

|

| 图 10 绳长1.8 m位置估计 Fig. 10 Rope length 1.8 m position estimate | |

|

Download:

|

| 图 11 绳长1.8 m误差对比 Fig. 11 Rope length 1.8 m error comparison | |

绳长1.8 m的10次实验中,测量误差取平均值,Y方向的误差为4.034%,Z方向的误差为2.326%。该组数据下系留线缆Y方向的跨度在0.8~1.6 m,线缆的弯曲程度在该组数据中跨度较大,这并没有导致该模型下系留无人机估计位置的跳变,这表明悬链线模型对系留无人机空间位置的估计与悬链线的弯曲程度无关。

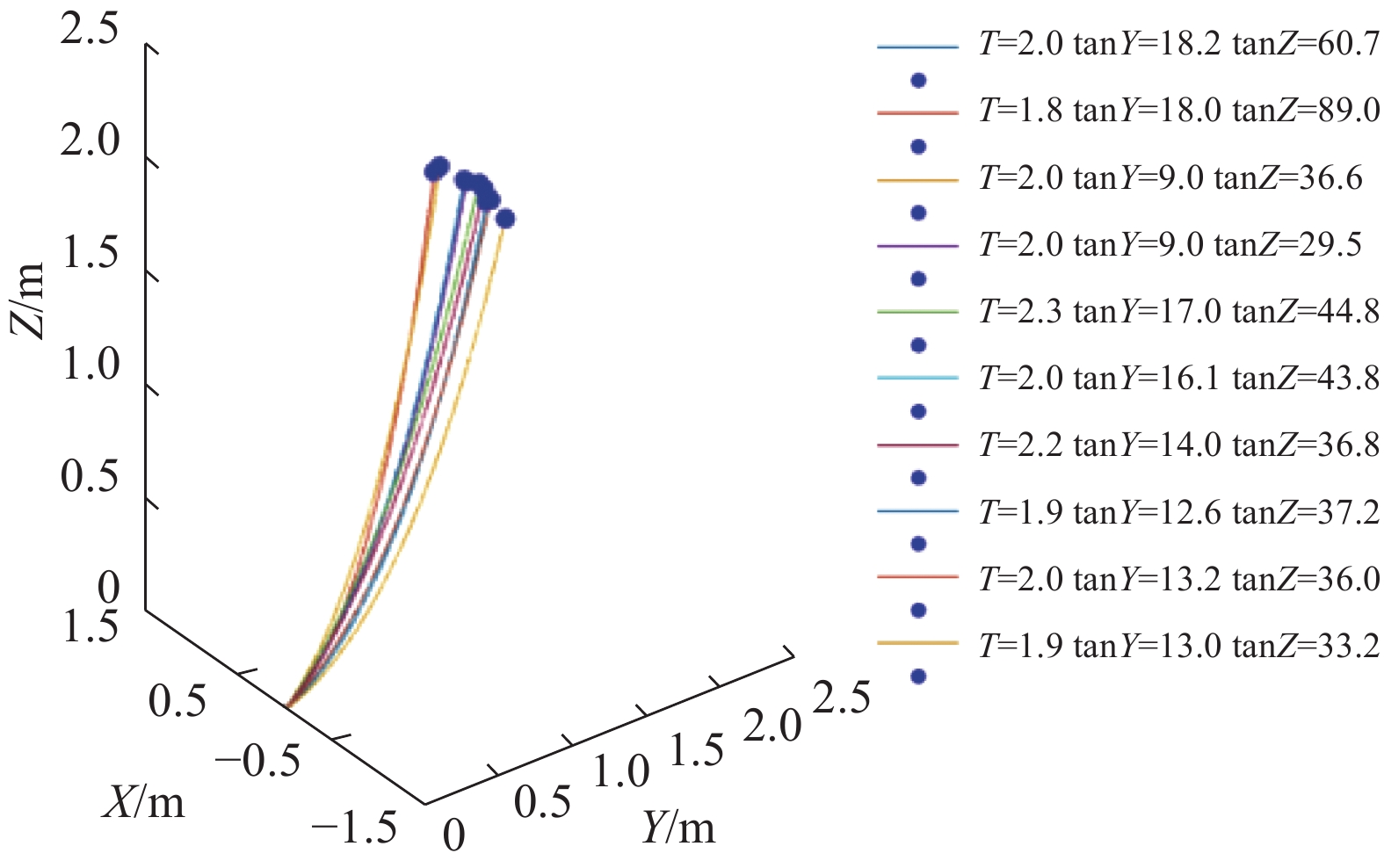

绳长Ls为2.4 m时,悬链线模型估计位置如图12所示。期望位置与估计位置误差比较如图13所示。

|

Download:

|

| 图 12 绳长2.4 m位置估计 Fig. 12 Rope length 2.4 m position estimate | |

|

Download:

|

| 图 13 绳长2.4 m误差对比 Fig. 13 Rope length 2.4 m error comparison | |

绳长2.4 m的10次实验中,测量误差平均值,Y方向误差为2.359%,Z方向误差为1.022%。

绳长Ls为3.0 m时,悬链线模型估计位置如图14所示。期望位置与估计位置误差比较如图15。

|

Download:

|

| 图 14 绳长3.0 m位置估计 Fig. 14 Rope length 3.0 m position estimate | |

|

Download:

|

| 图 15 绳长3.0 m误差对比 Fig. 15 Rope length 3.0 m error comparison | |

绳长3.0 m的10次实验中,测量误差取均值,Y方向误差为3.103%,Z方向误差为4.206%。

在4种不同绳缆长度下测定的数据与Indoor “GPS”对比平均误差为3.573%,误差距离为0.107 1 m。系留无人机在室内的期望位置是确定的,估计位置具有不确定性,不同绳缆长度下的估计位置与真实位置的偏差如图16所示,估计位置是在以期望位置为球的误差半径范围内波动。

|

Download:

|

| 图 16 不同绳长误差对比 Fig. 16 Error comparison of different rope lengths | |

基于力传感的系留无人机绳缆定位实验结果与文献[20]使用的Fotokite Pro无人机绳缆定位相对比将定位误差由0.367 5 m缩减到0.107 1 m,定位精度提升了70.86%。

5 结束语本文建立了系留无人机悬链线模型,仅依靠系留绳缆与三维力传感器实现无人机室内定位,得益于三维力传感器能准确获得绳缆拉力,使系统定位精度达到0.107 1 m。由于三维力传感器与无人机相互独立工作,系统可复制性强,悬链线模型下获得的定位数据,将定位数据传递给飞机控制系统,可使基于力传感的系留无人机适用于更复杂的环境。未来将结合流体力学分析等进一步丰富力学模型以提高定位精度。随着系留线缆长度的增加,系留线缆对无人机飞行姿态和位置影响越来越大,非线性扰动对系留无人机的影响不可忽视,可利用深度强化学习建立系留无人机非线性扰动模型,使无人机能自适应绳缆上的非线性外力造成的影响,从而提高定位精度。

| [1] |

TZOUMANIKAS D, LI W, GRIMM M, et al. Fully autonomous micro air vehicle flight and landing on a moving target using visual-inertial estimation and model-predictive control[J]. Journal of field robotics, 2019, 36(1): 49-77. DOI:10.1002/rob.21821 ( 0) 0)

|

| [2] |

王永全, 李清泉, 汪驰升. 基于系留无人机的应急测绘技术应用[J]. 国土资源遥感, 2020, 32(1): 1-6. WANG Yongquan, LI Qingquan, WANG Chisheng. Application of emergency surveying and mapping technology based on tethered drones[J]. Remote sensing for land and resources, 2020, 32(1): 1-6. DOI:10.6046/gtzyyg.2020.01.01 (  0) 0)

|

| [3] |

高源. 系留无人机自动收放缆控制系统研究[D]. 哈尔滨: 哈尔滨工程大学, 2018. GAO Yuan. Research on automatic control system of tethered unmanned aerial vehicle[D]. Harbin: Harbin Engineering University, 2018. (  0) 0)

|

| [4] |

MIKI T, KHRAPCHENKOV P, HORI K, et al. UAV/UGV autonomous cooperation: UAV assists UGV to climb a cliff by attaching a tether[C]. International Conference on Robotics and Automation. Montreal, Canada. 2019: 8041−8047.

( 0) 0)

|

| [5] |

NAKANISHI H, HASHIMOTO H. AR-marker/IMU hybrid navigation system for tether-powered UAV[J]. Journal of robotics and mechatronics, 2018, 30(1): 76-85. DOI:10.20965/jrm.2018.p0076 ( 0) 0)

|

| [6] |

XIAO X, DUFEK J, WOODBURY T D, et al. UAV assisted USV visual navigation for marine mass casualty incident response[C]// Intelligent Robots and Systems. Vancouver, Canada. 2017: 6105−6110.

( 0) 0)

|

| [7] |

TALKE K, DE OLIVEIRA M C, BEWLEY T, et al. Catenary tether shape analysis for a UAV-USV team[C]// Intelligent Robots and Systems. Madrid, Spain. 2018: 7803−7809.

( 0) 0)

|

| [8] |

胡文超, 孙新柱, 陈孟元. 音频感知哈希闭环检测的无人机仿生声呐SLAM算法研究[J]. 智能系统学报, 2019, 14(2): 338-345. HU Wenchao, SUN Xinzhu, CHEN Mengyuan. Research on UAV bionic sonar SLAM algorithm for audio perceptual hash closed loop detection[J]. CAAI transactions on intelligent systems, 2019, 14(2): 338-345. DOI:10.11992/tis.201708018 (  0) 0)

|

| [9] |

XIAO X, DUFEK J, MURPHY R. Visual servoing for teleoperation using a tethered UAV[C]// International Symposium on Safety, Security, and Rescue Robotics. Shanghai, China. 2017: 147−152.

( 0) 0)

|

| [10] |

王勋, 张代兵, 沈林成. 一种基于虚拟力的无人机路径跟踪控制方法[J]. 机器人, 2016, 38(3): 329-336. WANG Xun, ZHANG Daibing, SHEN Lincheng. A method of UAV path tracking control based on virtual force[J]. Robot, 2016, 38(3): 329-336. (  0) 0)

|

| [11] |

DUFEK J, MURPHY R. Theoretical limitations of visual navigation of lifesaving VSV using small UAS[C]// International Symposium on Safety, Security, and Rescue Robotics. Philadelphia, USA, 2018: 1−7.

( 0) 0)

|

| [12] |

BALSI M, ESPOSITO S, FALLAVOLLITA P, et al. Single-tree detection in high-density LiDAR data from UAV-based survey[J]. European journal of remote sensing, 2018, 51(1): 679-692. DOI:10.1080/22797254.2018.1474722 ( 0) 0)

|

| [13] |

苏贇, 王挺, 姚辰. 基于合作目标的无人机目标跟踪方法[J]. 机器人, 2019, 41(4): 425-432. SU Yun, WANG Ting, YAO Chen. Target tracking method of UAV based on cooperative target[J]. Robot, 2019, 41(4): 425-432. (  0) 0)

|

| [14] |

王怿, 祝小平, 周洲. 三维动态环境下的无人机路径跟踪算法[J]. 机器人, 2014, 36(1): 83-91. WANG Yi, ZHU Xiaoping, ZHOU Zhou. UAV path tracking algorithm in 3D dynamic environment[J]. Robot, 2014, 36(1): 83-91. (  0) 0)

|

| [15] |

TEULIERE C, MARCHAND E, ECK L. 3D Model-based tracking for UAV indoor localization[J]. IEEE transactions on cybernetics, 2015, 45(5): 869-879. DOI:10.1109/TCYB.2014.2337652 ( 0) 0)

|

| [16] |

KOTARU P, WU G, SREENATTH K. Dynamics and control of a quadrotor with a payload suspended through an elastic cable[C]. Advances in computing and communications. Kochi Ernakulam, India. 2017: 3906−3913.

( 0) 0)

|

| [17] |

张毅, 沙建松. 基于图优化的移动机器人视觉SLAM[J]. 智能系统学报, 2018, 13(2): 290-295. ZHANG Yi, SHA Jiansong. Mobile robot vision SLAM based on graph optimization[J]. CAAI transactions on intelligent systems, 2018, 13(2): 290-295. DOI:10.11992/tis.201612004 (  0) 0)

|

| [18] |

TANG L, YANG S, CHENG N, et al. Toward autonomous navigation using an RGB-D camera for flight in unknown indoor environments[C]// Chinese Guidance Navigation and Control Conference. Yantai, China. 2014: 2007−2012.

( 0) 0)

|

| [19] |

JEONG N, HWANG H, MATSON E T, et al. Evaluation of low-cost LiDAR sensor for application in indoor UAV navigation[C]// Static Analysis Symposium, 2018: 1−5.

( 0) 0)

|

| [20] |

XIAO X, FAN Y, DUFEK J, et al. Indoor UAV localization using a tether[C]// International Symposium on Safety, Security, and Rescue Robotics. Philadelphia, USA. 2018: 1−6.

( 0) 0)

|

| [21] |

XIAO X, DUFEK J, SUHAIL M, et al. Motion planning for a UAV with a straight or kinked tether[C]// Intelligent Robots and Systems. Madrid, Spain. 2018: 8486−8492.

( 0) 0)

|

| [22] |

张飞, 白伟, 乔耀华. 基于改进D*算法的无人机室内路径规划[J]. 智能系统学报, 2019, 14(4): 662-669. ZHANG Fei, BAI Wei, QIAO Yaohua. UAV indoor path planning based on improved D* algorithm[J]. CAAI transactions on intelligent systems, 2019, 14(4): 662-669. DOI:10.11992/tis.201803031 (  0) 0)

|

| [23] |

YANG L, FENG X, ZHANG J, et al. Multi-ray modeling of ultrasonic sensors and application for Micro-UAV localization in indoor environments[J]. Sensors, 2019, 19(8): 1770-1777. DOI:10.3390/s19081770 ( 0) 0)

|

| [24] |

WALKER O, VANEGAS F, GONZALEZ F, et al. A deep reinforcement learning framework for UAV navigation in indoor environments[C]// IEEE Aerospace Conference. Montana, USA. 2019:1-14.

( 0) 0)

|

| [25] |

洪洋, 孙秀霞, 王栋. 基于矩形几何特性的小型无人机快速位姿估计方法[J]. 中国激光, 2016, 43(5): 232-244. HONG Yang, SUN Xiuxia, WANG Dong. A fast pose estimation method for small UAV based on rectangular geometric characteristics[J]. Chinese laser, 2016, 43(5): 232-244. (  0) 0)

|

| [26] |

LU Y, XUE Z, XIA G S, et al. A survey on vision-based UAV navigation[J]. Geo-spatial information science, 2018, 21(1): 1-12. ( 0) 0)

|

2020, Vol. 15

2020, Vol. 15