2. 郑州大学 商学院,河南 郑州 450001

2. Business School, Zhengzhou University, Zhengzhou 450001, China

随着LCD生产过程制造工艺的提升,LCD逐渐向大尺寸和高分辨率方向发展,致使人工产品缺陷检测方法难以满足产品质量和生产效率要求。因此,本文研究LCD的机器视觉缺陷检测方法[1]。

现有LCD的机器视觉缺陷检测方法主要采用传统的图像处理与分析算法。例如,Liu等[2]基于支持向量数据描述设计的高速在线薄膜晶体管LCD缺陷检测系统,检测正确率可达95%,对单幅LCD图像的检测时间为7.8 s,但缺少缺陷分类功能。Cen等[3]采用低秩矩阵重构消除LCD图像纹理背景的影响,提出了适合于低分辨率LCD图像的缺陷检测方法。张腾达等[4]提出的利用二维DFT的分解和重构提高LCD表面缺陷检测精度的算法,然而因消除背景纹理的分解重构过程计算复杂度较高,无法满足高分辨率缺陷图像的实时在线检测。本文在前期研究中提出一种基于自适应阈值法的LCD表面缺陷检测算法[5],通过设计自适应阈值法[6]提取候选缺陷,根据blob形状分析进行缺陷分类,使检测性能达到技术指标要求,并已应用到实际工业自动化生产线上,但阈值等参数设置直接影响算法性能,因此有必要研究新一代基于机器视觉的缺陷检测方法。

近年,深度学习[7-9]作为机器学习的代表型方法,在目标检测与识别领域呈现出突出潜力。多项国际重大评测表明,深度学习的目标检测与分类能力均已超过传统机器学习方法[10-12]。其原因在于深度学习采用深层非线性网络结构、端到端的学习,可以提取输入数据的本质特征[13],从而获取较好的目标检测与分类效果。

鉴于此,为了满足高分辨率LCD产品质量在线高速检测需求,本文基于深度学习理论,设计基于小样本学习的LCD表面缺陷检测模型。其特征在于:通过设计自适应浅层特征提取层,并引入稀疏卷积结构,多维度、多尺度地提取深层特征,使用DCGAN生成网络扩增数据集,再结合迁移学习进行强化训练提高模型泛化能力和检测精度。本文模型的有效性通过大量的仿真实验得到验证。

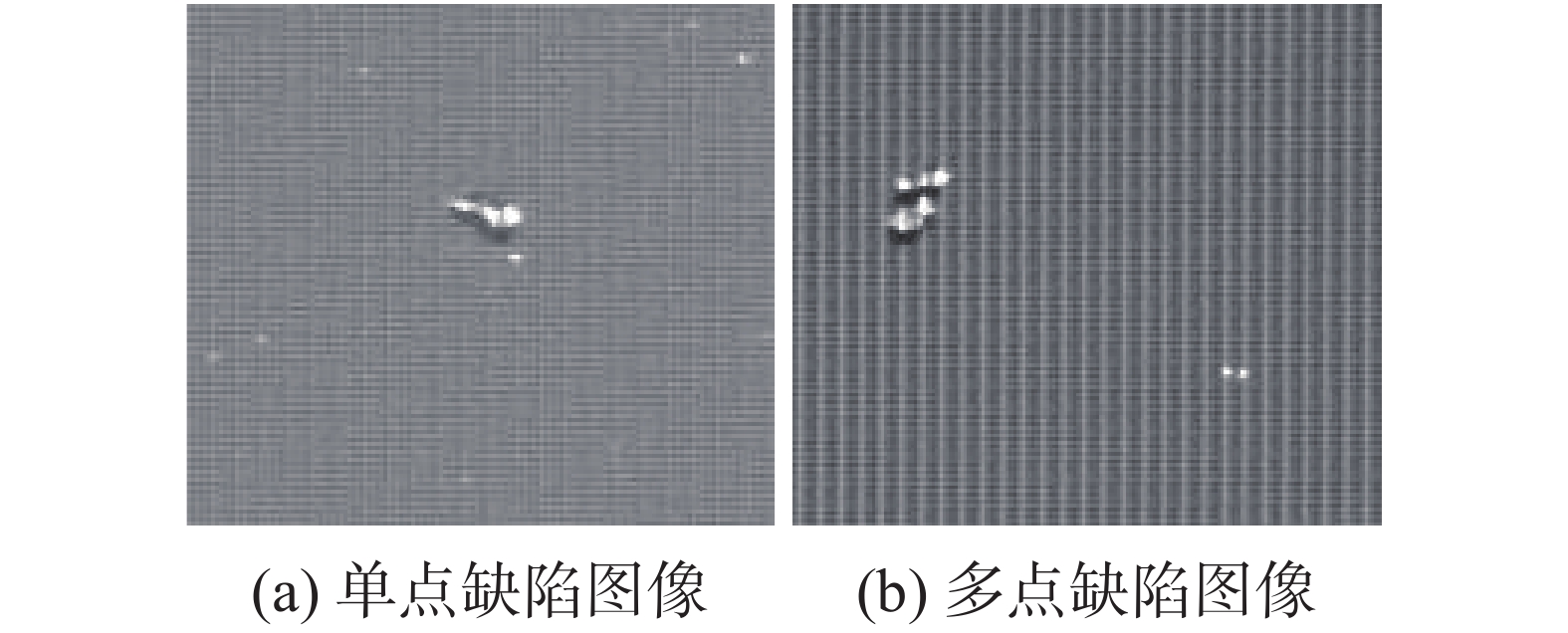

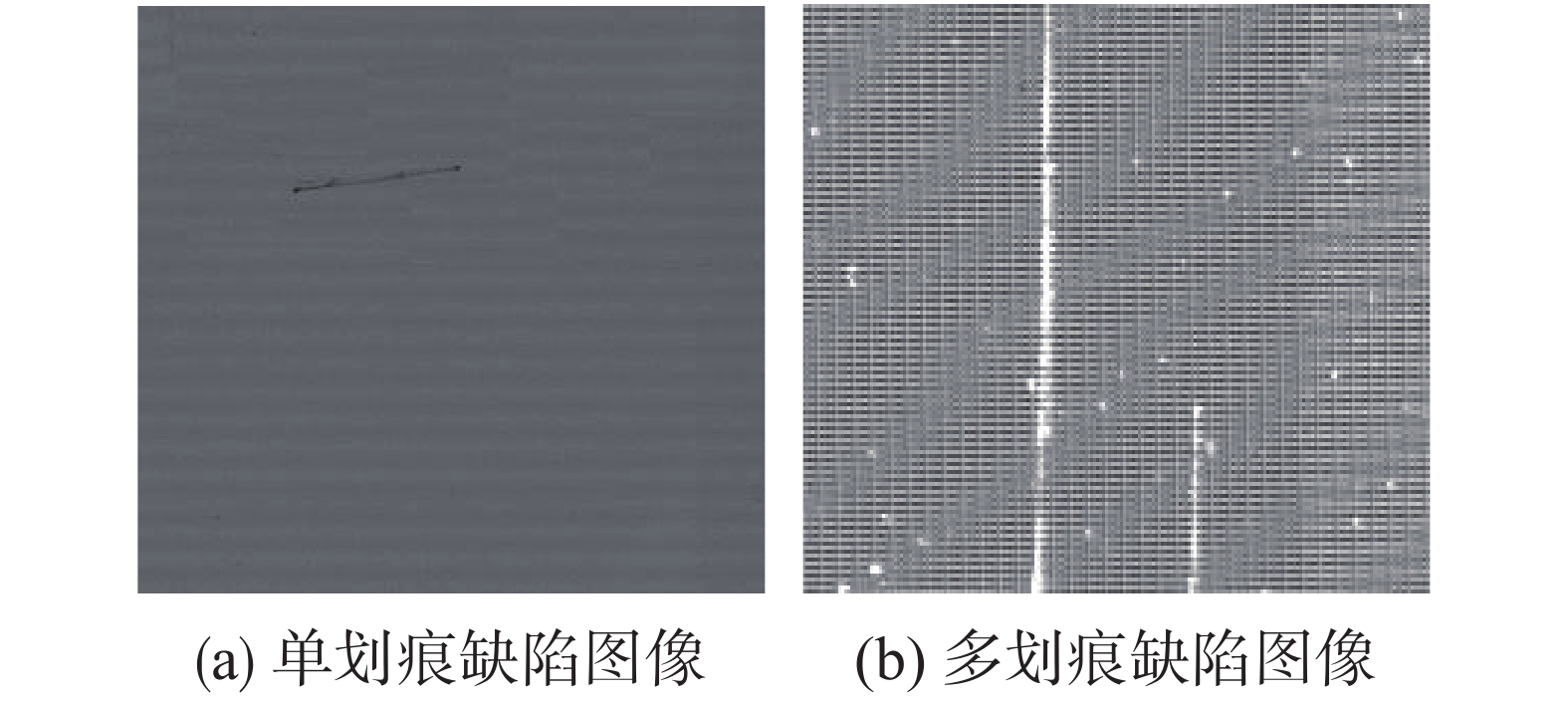

1 LCD表面缺陷图像分析本文待检测LCD表面缺陷图像分别如图1和图2所示,其分别表示凹凸(dimple)点缺陷样本和划痕(scratch)缺陷样本图像示例。如图1所示Dimple是一些随机分布在不同位置的小面积点坑,形状各异,极易与噪声混淆造成误检。图2所示的Scratch缺陷是长短不一的细长型刮痕,因刮痕时断时续,常会出现漏检或过检。特别是,在实际生产线上不仅存在因光照不均而导致待检目标与图像背景之间对比度过低问题,而且待检目标缺陷嵌入在背景纹理中,从而更增加了检测难度。因此,本文利用卷积神经网络的特征自学习能力,研究LCD产品表面缺陷的在线高精度检测方法。

|

Download:

|

| 图 1 凹凸点缺陷 Fig. 1 Dimple defects | |

|

Download:

|

| 图 2 划痕缺陷 Fig. 2 Scratch defects | |

自AlexNet[14]于2012年问世,卷积神经网络(CNN)模型向更深层的方向快速发展。从16层的VGG16的广泛使用到22层GoogleNet[15]在大样本图像数据集ImageNet上获得了更好的分类效果,再到50层ResNet50[16]的进一步性能改善,均证明了CNN在图像分类方面具有突出优势。

但是受大数据驱动的深度学习模型的表现能力随着样本数量的增加而增长。而在实际工业生产线上,随着制造工艺的不断提高,LCD制造过程中产生的缺陷越来越少,从而难以获取大量缺陷样本,因此开展基于小样本学习的LCD表面缺陷检测算法研究显得尤为重要。

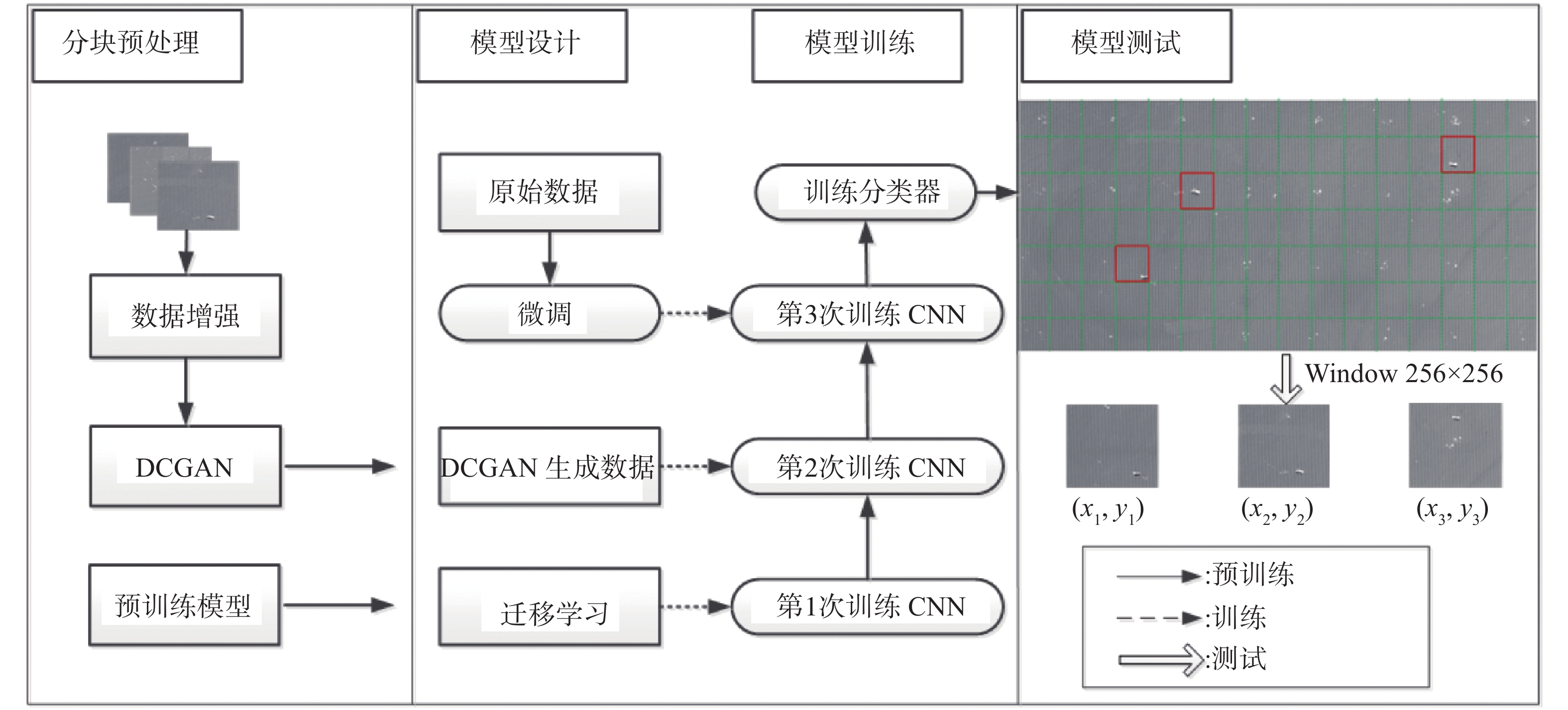

2 LCD缺陷检测模型针对实际生产环境获取到的缺陷样本量较少问题,本文构建一种适合小样本学习的轻量型卷积神经网络模型。算法的整体框架如图3所示,包括分块预处理、模型设计、模型训练和模型测试。

2.1 分块预处理由于从实际工业生产线上获取的LCD图像尺寸为

|

Download:

|

| 图 3 本文缺陷检测算法框图 Fig. 3 Overview of the proposed algorithm for defect detection | |

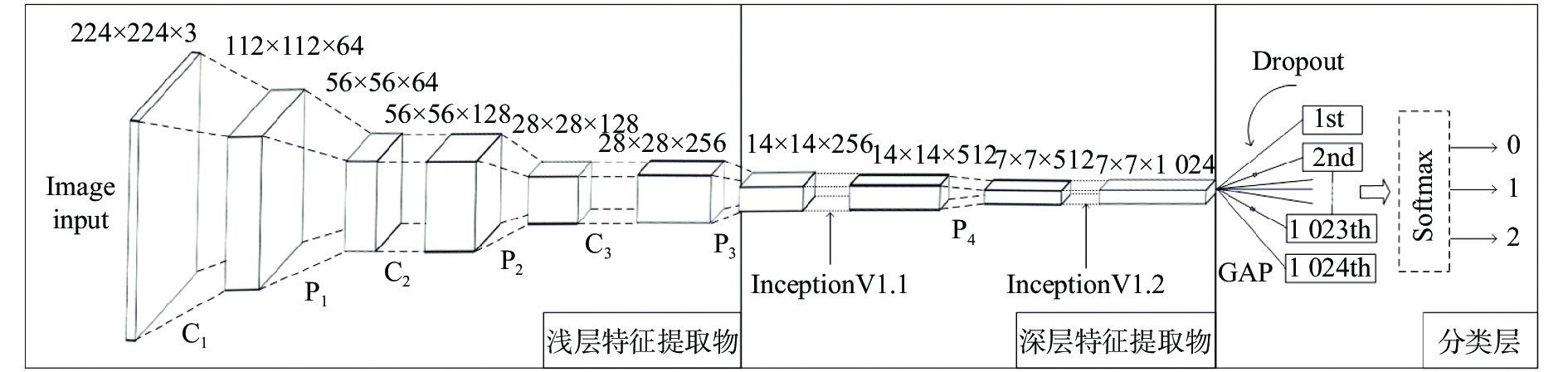

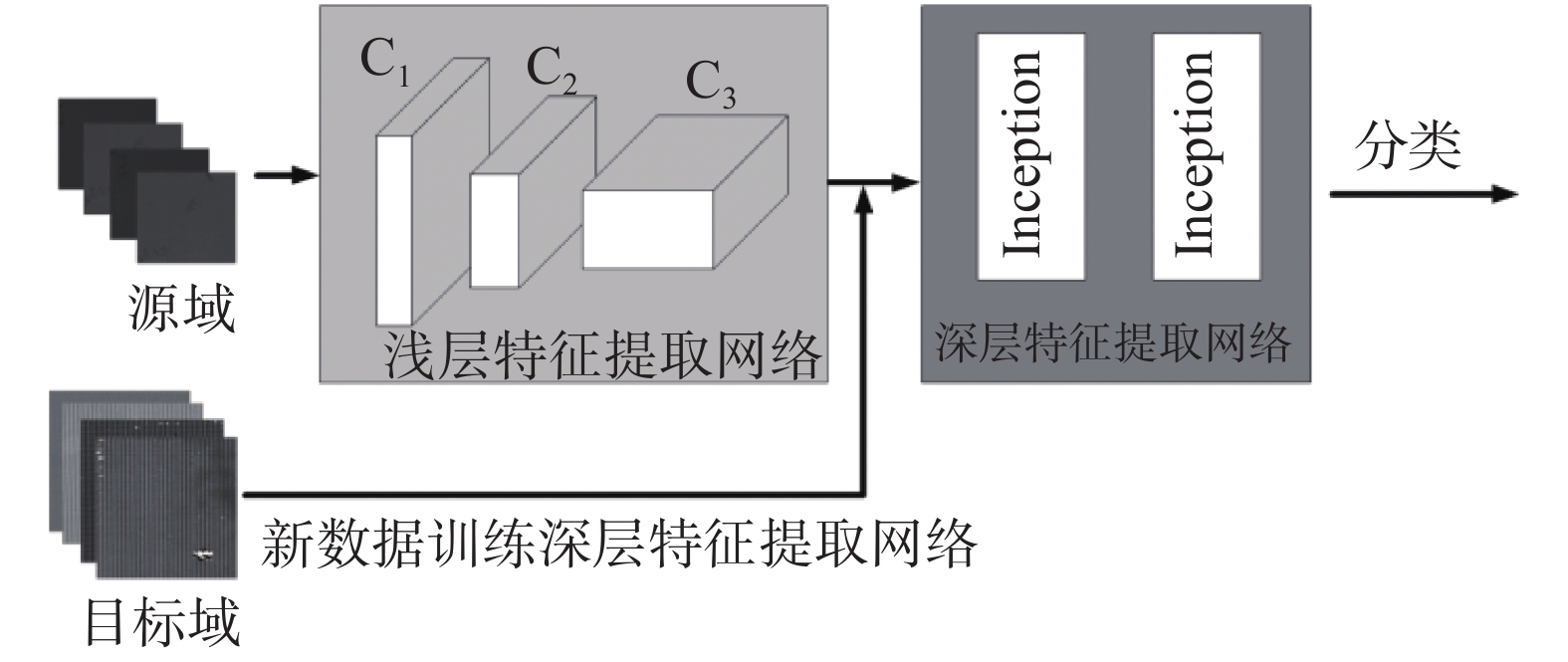

针对LCD缺陷图像特点,本文设计如图4所示的卷积神经网络模型。其包括3个卷积层(C1、C2、C3)、4个池化层(P1~P4)、分别用InceptionV1.1、InceptionV1.2表示两个稀疏卷积结构以及Softmax层。

|

Download:

|

| 图 4 设计的网络结构 Fig. 4 Designed network architecture | |

卷积层被用于提取图像中的缺陷特征,紧跟在卷积层之后的池化层被用于特征降维。通过池化层,不仅可以减少卷积层输出节点个数,而且可以去粗存精优化卷积层提取的缺陷特征。本文第1卷积层的输入是分块预处理后获取的图像子块。其卷积与池化后的输出结果被送入后续卷积层中,卷积核和池化方法的选取是提取缺陷特征的关键性因素。为了同时获取较大的缺陷特征和局部细微特征,本文第1~第3卷积层分别选取

|

Download:

|

| 图 5 稀疏卷积结构 Fig. 5 Sparse convolution structure | |

在设计模型的最后一层利用Softmax分类器输出分类结果。

本文模型使用交叉熵损失函数计算网络偏差,综合利用多次

CNN模型训练过程包括由式(1)所示的网络前向传播和基于式(2)定义的损失函数进行反向传播两部分。前向传播使用激活函数获取特征向量,而反向传播通过逐渐更新优化卷积神经网络中的权重参数取值使CNN模型的损失函数趋于最小值。

| $ C_j^l = f\left( {{z^l}} \right) = f\Bigg(\sum\limits_{i \in {M_j}} {C_j^{l - 1} k_{ij}^l + b_j^l} \Bigg) $ | (1) |

| $ \begin{array}{c} {L_i} = \dfrac{1}{m}\left[ {\displaystyle\sum\limits_{i = 1}^m {\displaystyle\sum\limits_{j = 1}^n 1\left\{ {{y^i} = j} \right\} } \log \dfrac{{\exp \left( {{{w}}_j^{\rm{T}}{x^{\left( i \right)}}} \right)}}{{\displaystyle\sum\limits_{l = 1}^n {\exp \left( {{{w}}_j^{\rm{T}}{x^{\left( j \right)}}} \right)} }}} \right] + \\ \dfrac{\lambda }{2}\displaystyle\sum\limits_{j = 1}^n {W_j^2} \end{array} \!\!\!\!\!\!$ | (2) |

式(3)~(5)表示反向传播的权重参数更新计算方法。

| $ {W_j} \leftarrow {W_j} - \alpha {\nabla _{{W_j}}}L\left( {W;{x^{\left( i \right)}},{y^{\left( i \right)}}} \right) $ | (3) |

| $ v \leftarrow \varepsilon v - \alpha {\nabla _{{W_j}}}L\left( {W;{x^{\left( i \right)}},{y^{\left( i \right)}}} \right) $ | (4) |

| $ {W_j} \leftarrow {W_j} + v $ | (5) |

本文模型的训练参数学习速率

图6展示多组

|

Download:

|

| 图 6 学习速率和冲量单元的确定 Fig. 6 Determination of learning rate and momentum unit | |

从图6所示图形可以观察到,当学习速率

本文模型的训练包括利用迁移学习进行初始训练、DCGAN生成样本的二次训练和基于更新样本集的继续学习3个关键环节。

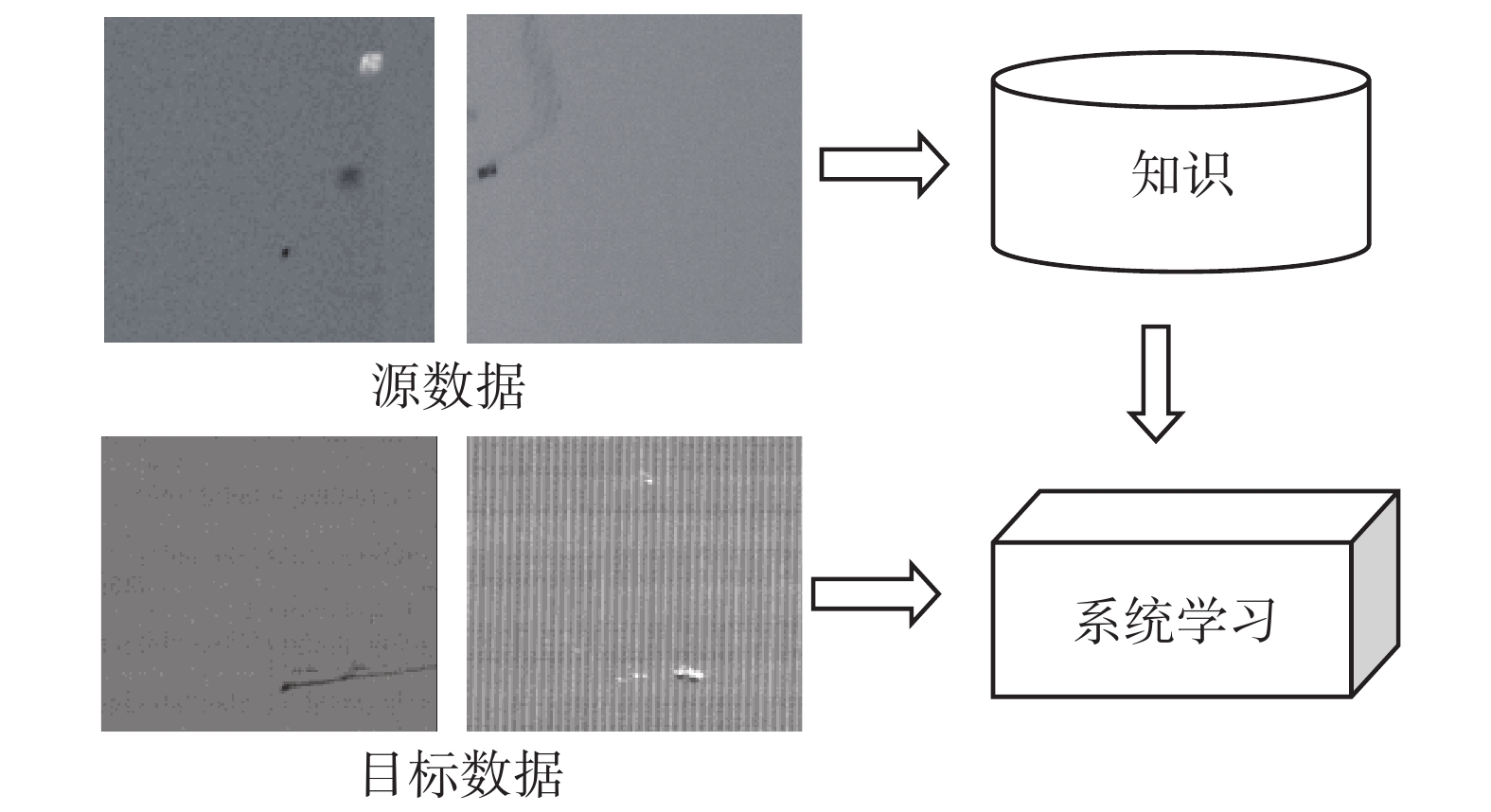

2.3.1 基于迁移学习的模型训练鉴于缺陷样本量不足,会导致CNN模型出现过拟合问题,以及前期我们研究的手机保护屏缺陷与本文研究的LCD表面缺陷极为相似,故采用迁移学习方法解决该问题。

本文基于前期设计并用

|

Download:

|

| 图 7 迁移学习 Fig. 7 Transfer learning | |

针对从实际生产环境中可采集的缺陷样本较少问题,本文利用DCGAN[19](deep convolutional GAN)网络,根据已有的缺陷样本生成新的样本数据。

DCGAN是在生成式对抗网络(generative adversarial network,GANs)[20]基础上,用CNN代替GAN中的多层感知机,并使用全局池化层代替全连接层等改进后的生成模型,其生成器通过输入随机向量并利用反卷积生成图像,判别器利用CNN的分类能力对真实图像和生成图像进行判别和反馈,从而获得高质量样本数据。

将图8(a)、(b)所示的小批量LCD缺陷图像输入DCGAN网络模型,生成如图8(c)、(d)所示的数据集。由图8可以看到,生成图像和原缺陷样本相似度较高。将新生成数据输入经迁移学习训练过的本文模型,进行二次学习,以获取更好的训练效果。

|

Download:

|

| 图 8 DCGAN生成的样本图像 Fig. 8 Generated images by DCGAN | |

工业生产过程中随时会产生新的缺陷样本和类型,因此,本文提出如图9所示的继续学习方法,通过锁定浅层特征提取层,将不断更新的样本数据直接输入深层特征提取层进一步强化训练模型,并更新分类器,以实现小样本下LCD缺陷的高精度检测。

|

Download:

|

| 图 9 继续学习 Fig. 9 Continue learning | |

利用本文自主开发的预处理软件,首先对测试图像进行坐标定位和自动分割,获取图像子块,并记录其序号和左上角坐标;进而通过将图像子块输入到2.3节训练好的CNN模型进行分类;最后,根据CNN模型输出类别和定位坐标计算,同时获取原高分辩率LCD图像的多种类缺陷检测结果。

3 实验分析本文实验环境包括硬件和软件配置两部分。

硬件配置:CPU为Inter Xeon E5-2630v4、显卡为NVIDIA Tesla K80 24 GB x 4、内存为125.8 GB、硬盘为4.1 TB。

软件配置:Ubuntu14.04、CUDA8.0、CUDNN5.1、opencv3.1、python2.7。

3.1 数据集本文采用了132幅尺寸为5 300×7 000的实际工业LCD缺陷图像。通过预处理后,得到18 950幅样本图像子块,将其中十分之一用作验证集,十分之一用作测试集,其余样本用于训练。训练集中的三分之一为无缺陷样本,标识为“0”;三分之一为Dimple缺陷样本,标识为“1”;剩下三分之一为Scratch缺陷样本,标识为“2”。

3.2 训练结果分析训练参数分别设置如下:mini-batch size为

经过大约3 h训练后的结果如图10所示,图中曲线分别表示对应每个轮次训练集和验证集的Loss值。

|

Download:

|

| 图 10 每个轮次的准确度 Fig. 10 Accuracy for each batch | |

由图10可知,本文模型在验证集上呈现出较高的准确度,且可快速趋于稳定。

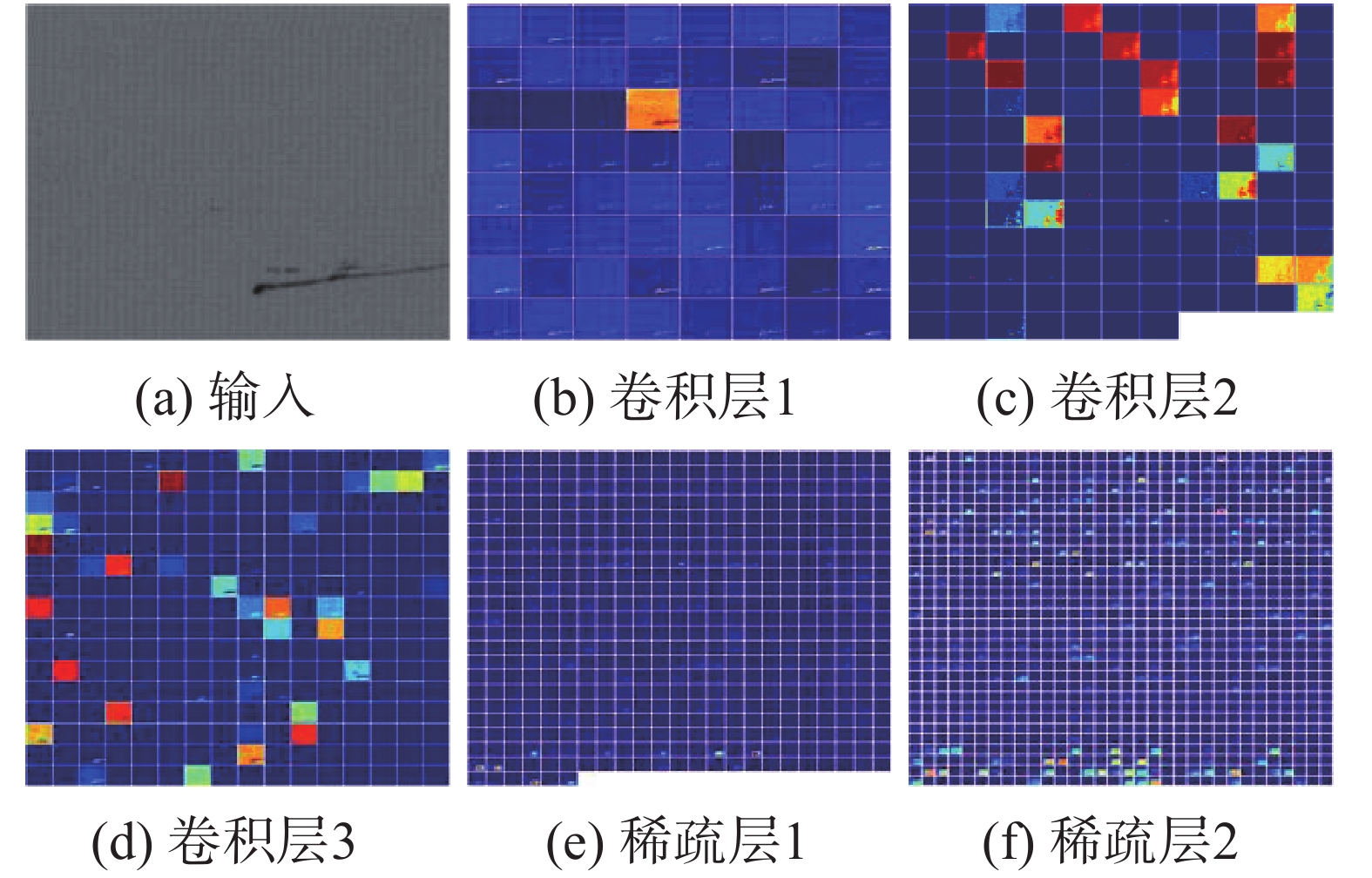

3.3 可视化分析设计模型提取的两类缺陷图像的特征分别如图11和图12所示。图11展示Dimple缺陷输入图像例和本文模型逐层提取并输出的特征图,图12展示Scratch缺陷图像和其第1至第3卷积层提取的图像特征。

|

Download:

|

| 图 11 凹凸点缺陷的特征图 Fig. 11 Feature maps for Dimple defect | |

|

Download:

|

| 图 12 划痕缺陷的特征图 Fig. 12 Feature maps for Scratch defect | |

从图11和图12可以清楚地观察到,卷积层1可以提取到高亮区域所示的一些大的缺陷特征和背景噪声,用卷积层2和卷积层3表示的第二与第三层卷积运算结果可以提取到较多的缺陷细微特征和随机噪声。因此,仅用浅层特征提取方法难以区分并分离缺陷细微特征和噪声。

图11(e)、(f)和图12(e)、(f)分别表示通过稀疏卷积结构运算获取的图像特征,可以清楚地看到,其主要包含缺陷特征。

由此可见,本文设计模型可以有效获取LCD产品的表面缺陷特征。

3.4 实验结果本文用式(6)所示的平均检测正确率和式(7)所示的误检率对设计模型的检测结果进行定量评价,并用单幅图像的检测时间评估其在线实时性。

| $ A = \left( {{N_0} + {N_1} + {N_2}} \right)/{N_t} $ | (6) |

| $ F = \left( {{N_{0 \to 1,2}} + {N_{1,2 \to 0}}} \right)/{N_t} $ | (7) |

式中:

本文随机选取了1 526幅样本图像进行测试,测试结果如表1所示,其中,0表示595幅无缺陷样本集,1表示458幅Dimple缺陷样本集,2表示473幅Scratch缺陷样本集。

| 表 1 测试结果 Tab.1 Test result |

表1所示的实验结果表明无缺陷样本与缺陷样本的分类正确性分别可以达到

表2为本文模型与常用代表性卷积神经网络在同样小样本数据集下训练180轮次的测试结果对比。

| 表 2 模型比较 Tab.2 Models comparison |

表2所示的对比结果表明,以AlexNet、GoogLeNet、ResNet50为代表的CNN模型在小样本数据集下检测正确率有限,存在漏检率较高的问题。迁移学习和DCGAN生成样本强化训练是提升检测性能的有效手段。本文模型相较于改进后的主流模型可以进一步提升检测正确率并降低误检率。

4 结束语本文针对高分辨率LCD图像的在线检测问题,设计了一个参数量少且收敛快的轻量型CNN模型。该模型通过利用迁移学习结合DCGAN生成样本强化训练,克服了基于小样本集的深度学习模型训练易出现过拟合难点,通过设计自动分割与定位预处理软件将高分辨率图像划分成图像子块,并根据对图像子块的判定类别和定位坐标,同时获取多类型缺陷检测结果。相比传统缺陷检测算法,可以减少人工设置过多参数引起的烦琐,并避免因图像分解重构而影响在线检测应用。实验结果表明,提出算法对LCD表面缺陷的平均检测正确率可以达到99.02%,误检率为0.66%,具有高检出率和低漏检率的特点。在下一步的研究中,将在实际生产环境中进一步进行模型验证并优化模型参数,重点解决在线检测实时性问题。

| [1] |

LU Rongsheng, SHI Yanqiong, LI Qi, et al. AOI techniques for surface defect inspection[J]. Applied mechanics and materials, 2010, 36: 297-302. DOI:10.4028/www.scientific.net/AMM.36.297 ( 0) 0)

|

| [2] |

LIU Y H, LIU Yanchen, CHEN Y Z. High-speed inline defect detection for TFT-LCD array process using a novel support vector data description[J]. Expert systems with applications, 2011, 38(5): 6222-6231. DOI:10.1016/j.eswa.2010.11.046 ( 0) 0)

|

| [3] |

CEN Yigang, ZHAO Ruizhen, CEN Lihui, et al. Defect inspection for TFT-LCD images based on the low-rank matrix reconstruction[J]. Neurocomputing, 2015, 149: 1206-1215. DOI:10.1016/j.neucom.2014.09.007 ( 0) 0)

|

| [4] |

张腾达, 卢荣胜, 张书真. 基于二维DFT的TFT-LCD平板表面缺陷检测[J]. 光电工程, 2016, 43(3): 7-15. ZHANG Tengda, LU Rongsheng, ZHANG Shuzhen. Surface defect inspection of TFT-LCD panels based on 2D DFT[J]. Opto-electronic engineering, 2016, 43(3): 7-15. DOI:10.3969/j.issn.1003-501X.2016.03.002 (  0) 0)

|

| [5] |

MA Ling, LIU Wei, LIU Yumin, et al. An automatic detection algorithm for surface defects in TFT-LCD[C]//Proceedings of 2013 Second IAPR Asian Conference on Pattern Recognition. Naha, Japan, 2013: 847−851.

( 0) 0)

|

| [6] |

马岭, 蒋慧琴, 刘玉敏. 基于局部特征的驾驶证自动识别系统[J]. 郑州大学学报(工学版), 2017, 38(5): 13-17, 22. MA Ling, JIANG Huiqin, LIU Yumin. Automatic recognition system of driver’s license based on local features[J]. Journal of Zhengzhou University (engineering science edition), 2017, 38(5): 13-17, 22. (  0) 0)

|

| [7] |

LÄNGKVIST M, KARLSSON L, LOUTFI A. A review of unsupervised feature learning and deep learning for time-series modeling[J]. Pattern recognition letters, 2014, 42: 11-24. DOI:10.1016/j.patrec.2014.01.008 ( 0) 0)

|

| [8] |

KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[C]//Proceedings of the 25th International Conference on Neural Information Processing Systems. Siem Reap, Cambodia, 2012: 1097−1105.

( 0) 0)

|

| [9] |

BENGIO Y, COURVILLE A, VINCENT P. Representation learning: a review and new perspectives[J]. IEEE transactions on pattern analysis and machine intelligence, 2013, 35(8): 1798-1828. DOI:10.1109/TPAMI.2013.50 ( 0) 0)

|

| [10] |

DENG Jia, BERG A, SATHEESH S, et al. Large scale visual recognition challenge[EB/OL]. [2013-11-14]. http://image-net.org/challenges/LSVRC/2013/.

( 0) 0)

|

| [11] |

EVERINGHAM M, ALI ESLAMI S M, VAN GOOL L, et al. The PASCAL visual object classes challenge: a retrospective[J]. International journal of computer vision, 2015, 111(1): 98-136. DOI:10.1007/s11263-014-0733-5 ( 0) 0)

|

| [12] |

TAJBAKHSH N, SUZUKI K. Comparing two classes of end-to-end machine-learning models in lung nodule detection and classification: MTANNs vs. CNNs[J]. Pattern recognition, 2017, 63: 476-486. DOI:10.1016/j.patcog.2016.09.029 ( 0) 0)

|

| [13] |

郑胤, 陈权崎, 章毓晋. 深度学习及其在目标和行为识别中的新进展[J]. 中国图象图形学报, 2014, 19(2): 175-184. ZHENG Yin, CHEN Quanqi, ZHANG Yujin. Deep learning and its new progress in object and behavior recognition[J]. Journal of image and graphics, 2014, 19(2): 175-184. (  0) 0)

|

| [14] |

KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[J]. Communications of the ACM, 2017, 60(6): 84-90. DOI:10.1145/3065386 ( 0) 0)

|

| [15] |

ZHONG Zhuoyao, JIN Lianwen, XIE Zecheng. High performance offline handwritten chinese character recognition using googlenet and directional feature maps[C]//Proceedings of 2015 13th International Conference on Document Analysis and Recognition. Tunis, Tunisia, 2015: 846−850.

( 0) 0)

|

| [16] |

SZEGEDY C, IOFFE S, VANHOUCKE V, et al. Inception-V4, inception-ResNet and the impact of residual connections on learning[C]//Proceedings of the Thirty-First AAAI Conference on Artificial Intelligence. San Francisco, USA, 2017.

( 0) 0)

|

| [17] |

Lin M, Chen Q, Yan S. Network In Network[C]//Proceedings of the 2th International Conference on Learning Representations. Banff, Canada, 2016.

( 0) 0)

|

| [18] |

SZEGEDY C, LIU Wei, JIA Yangqing, et al. Going deeper with convolutions[C]//Proceedings of 2015 IEEE Conference on Computer Vision and Pattern Recognition. Boston, USA, 2015: 1−9.

( 0) 0)

|

| [19] |

Radford A, Metz L, Chintala S. Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks[C]//Proceedings of the 4th International Conference on Learning Representations. San Juan, Puerto Rico, 2016.

( 0) 0)

|

| [20] |

GOODFELLOW I J, POUGET-ABADIE J, MIRZA M, et al. Generative adversarial nets[C]//Proceedings of the 27th International Conference on Neural Information Processing Systems. Montreal, Canada, 2014: 2672–2680.

( 0) 0)

|

2020, Vol. 15

2020, Vol. 15