2. 同济大学 计算机科学与技术系,上海 201804

2. Department of Computer Science and Technology, Tongji University, Shanghai 201804, China

随着大数据与互联网加时代的到来,动态流数据成为了一种主流的数据类型,当前已经被广泛地应用于金融股票交易、天气和环境监测、计算机网络监控等众多领域[1]。在上述应用中,在线计算[2-3]是动态流数据的主要计算形式,其主要特点是实时数据快速地加载入内存,而CPU需要对内存中的实时数据实施快速计算,并且实时反馈计算结果。而传统的离线计算[4]方式需要外部存储器积淀数据后再进行科学计算,对于数据实时性和流动性的要求相对较低,因此传统计算方法不能完全适应在线计算的新要求。研究更加高效的在线计算方法已经成为了当前大数据领域的一项重要课题。

近年来,以SPARK[5]为代表的内存计算平台的推出与发展,较快推动了动态在线计算的发展。不确定性问题是机器学习领域的经典难题,如何在在线计算过程中进行不确定性问题的动态推理及求解也逐渐成为一项具有挑战性的新议题。

三支决策理论[6]是基于粒计算粗糙集理论提出和发展起来的一种处理不确定、不完整信息决策的新方法。其初始目的是为粗糙集理论中的3个分类区域,即正域、负域和边界域,提供合理的决策语义解释。近年来随着该理论的深入研究与发展,三支决策被认为是在信息不足或者获取足够信息的代价较高背景下的合理选择。该理论与人类的认知习惯相似,具有认知方面的优势,近年来,三支决策理论在垃圾邮件过滤[7]、文本挖掘[8]、图像识别[9]、属性约简[10]、聚类[11]等应用领域[12-14]也都取得了广泛的成果。

目前主要代表性的理论成果包括:基于代价敏感度量的决策粗糙集三支决策[15]、模糊集三支决策[16]、区间集三支决策[17]、概率粗糙集三支决策[18]、博弈粗糙集三支决策[19]、信息熵三支决策[20]、GINI系数三支决策[21]等。

同时针对动态数据环境下的动态计算也是另一项主要研究内容。文献[22]首次提出一种离线动态计算方法,其对更新后的数据对象进行重新计算,算法执行效率不高。为了提高动态计算的效率,许多学者研究了粗糙集及三支决策的离线增量学习方法。其主要成果有:Liu等[23]提出了一种基于矩阵的动态不完备信息系统的增量方法;Li等[24]通过分析动态数据库中新数据的不断更新,提出了基于粗糙集理论的增量学习方法;Zhang等[25]等给出了邻域粗糙集模型下多对象增加删除时近似集快速更新的方法;Luo等[26]考虑到信息系统中数据对象动态插入,讨论介绍了概率粗糙集模型中条件概率的动态估计策略,进而给出了概率三支近似的增量更新算法。然而研究表明,上述动态学习研究都是以离线计算为研究背景,而以在线计算为背景的动态三支决策研究较少。

本文以上述三支决策动态计算研究为基础,系统性地研究了在线计算中动态数据变化形式及动态决策的变化规律,提出一种有别于传统经典计算的三支决策在线快速计算学习方法,并进行实验验证。

1 相关工作 1.1 概率粗糙集三支决策模型概率粗糙集是构造三支决策的基础原型,首先我们回顾一下概率粗糙集三支决策的相关基本理论[20]。

信息系统

定义 1 在信息系统

注:

定义 2 设

| $\begin{aligned}& {\rm{PO}}{{\rm{S}}_{(\alpha ,\, \bullet )}}({D_j}) = \{ x \in U|\Pr ({D_j}|[x]) \geqslant \alpha \} \\ &{\rm{NE}}{{\rm{G}}_{( \bullet ,\,\beta )}}({D_j}) = \{ x \in U|\Pr ({D_j}|[x]) \leqslant \beta \} \\ &{\rm{BN}}{{\rm{D}}_{(\alpha ,\,\beta )}}({D_j}) = \{ x \in U|\beta < \Pr ({D_j}|[x]) < \alpha \} \end{aligned}$ |

通过定义2中的(α,β)-正域、负域和边界域,可分别生成相应的接受、拒绝和延迟决策规则。

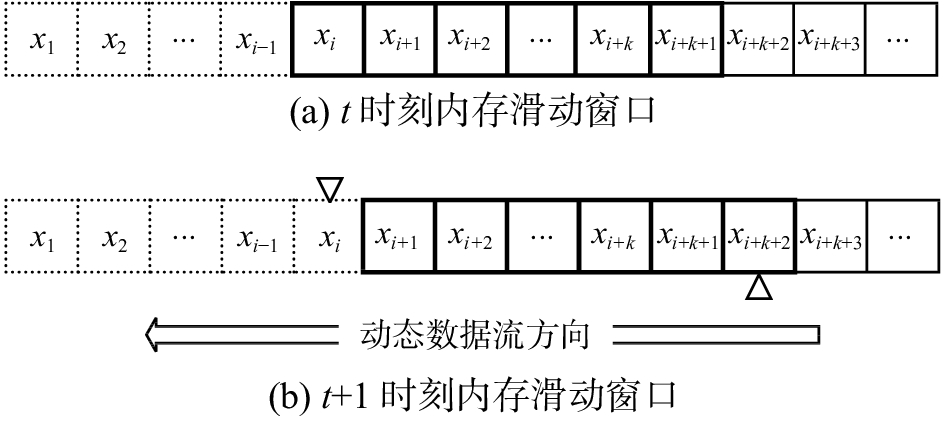

1.2 三支决策在线快速计算模型滑动窗口技术[27-28]可以有效处理动态流数据下的数据挖掘与知识更新问题。在线计算的动态特点是,随着新数据不断进入,同时由于内存空间的限制,旧数据也被不断被删除,内存中包含的计算数据既增又减。由此,三支决策在线计算的数据变化模式可以用滑动窗口的方式进行描述。

给定t时刻的决策信息系统表:

设t时刻内存滑动窗口如图1(a)所示,其中粗实线框(即

|

Download:

|

| 图 1 在线计算内存数据变化机制模型 Fig. 1 Sliding windows online computing model on memory data | |

基于三支决策理论以及上述在线内存数据变化模型,可以获取如下动态单对象三支决策在线内存计算变化模型。

给定t+1时刻决策表

| $\begin{aligned}& R_i^{(t + 1)} = \\ & \left\{{\begin{array}{l}\!\!\! {R_i^{(t)} - \{ \underline x \} ,}\,\, {(x,\underline x ) \in R_i^{(t + 1)},\,\,(x,\overline x ) \notin R_i^{(t + 1)},}\,\, {1 \leqslant i \leqslant m}\\\!\!\! {R_i^{(t)} \cup \{ \overline x \} ,} \,\, {{\rm{ (}}x,\underline x ) \notin R_i^{(t + 1)},\,\,(x,\overline x ) \in R_i^{(t + 1)},}\,\, {1 \leqslant i \leqslant m}\\\!\!\! {R_i^{(t)} \cup \{ \overline x \} - \{ \underline x \} ,} \,\, {(x,\underline x ) \in R_i^{(t + 1)},\,\,(x,\overline x ) \in R_i^{(t + 1)},} \,\,{1 \leqslant i \leqslant m}\\\!\!\! {R_i^{(t)},}\,\, {{\rm{ (}}x,\underline x ) \notin R_i^{(t + 1)},\,\,(x,\overline x ) \notin R_i^{(t + 1)},}\,\, {1 \leqslant i \leqslant m}\end{array}} \right.\end{aligned}$ | (1) |

| $\begin{aligned}& D_j^{(t + 1)} = \\ & \left\{ {\begin{array}{l}\!\!\! {D_j^{(t)} - \{ \underline x \} ,} \,\, {{\rm{ (}}x,\overline x ) \in D_j^{(t + 1)},\,\,(x,\underline x ) \notin D_j^{(t + 1)},}\,\, {1 \leqslant j \leqslant n}\\\!\!\! {{D_j}^{(t)} \cup \{ \overline x \} ,} \,\, {{\rm{ (}}x,\overline x ) \in D_j^{(t + 1)},\,\,(x,\underline x ) \notin D_j^{(t + 1)},} \,\, {1 \leqslant j \leqslant n}\\\!\!\! {{D_j}^{(t)} \cup \{ \bar x\} - \{ \underline x \} ,}\,\, {{\rm{ (}}x,\overline x ) \in D_j^{(t + 1)},\,\,(x,\underline x ) \in D_j^{(t + 1)},}\,\, {1 \leqslant j \leqslant n}\\\!\!\! {{D_j}^{(t)},} \,\,{{\rm{ (}}x,\overline x ) \notin D_j^{(t + 1)},\,\,(x,\underline x ) \notin D_j^{(t + 1)},} \,\, {1 \leqslant j \leqslant n}\end{array} }\right. \end{aligned}$ | (2) |

可见,决策信息系统在动态环境中,伴随着数据对象在内存窗口的移入移出变化,必然会导致相关条件分类与决策分类发生相应变化,其条件概率及三支区域必然也会发生变化。本文首先系统地讨论在线数据的动态变化情况下条件概率及三支区域的变化,并以此为基础提出三支决策在线快速计算算法。

2 三支决策在线快速计算方法上述模型实现了动态流数据在线计算的动态变化机制。在经典计算中,对于信息系统的每一次数据更新,采用等价类的重新划分与计算,开销较大。基于内存滑动窗口的三支决策动态变化情况需要借鉴增量学习的思想,对于移入移出数据进行同步处理,从而能够加快三支决策在线计算状态下条件概率与三支区域的更新速度,保证了动态三支决策更新的实时性与高效性。

2.1 条件概率快速估计方法如何利用已有的决策知识,实现条件概率的动态估计是基于三支决策知识更新的基础。

由定义2可知,计算概率粗糙集三支决策的原理是:首先计算每条决策规则的条件概率,然后将每条决策规则的条件概率与三支决策阈值α、β进行比较,然后才能确定每个条件等价类属于哪个三支决策区域。可见,每条决策规则的条件概率计算,是概率粗糙集三支决策的关键步骤。

定理 1 给定t时刻信息系统

变化模式1:

变化模式2:

变化模式3:

证明 若移入对象

| $\begin{aligned} \Pr ({D_j}^{(t + 1)} &\left| {{R_i}^{(t + 1)}} \right.) = \displaystyle\frac{{\Big|{D_j}^{(t + 1)} \cap {R_i}^{(t + 1)}\Big|}}{{|{R_i}^{(t + 1)}|}} =\displaystyle\frac{{\Big|(D_j^{(t)}) \cap (R_i^{(t)} -{x} \} )\Big|}}{{\Big|R_i^{(t)} - \{ \underline x \} \Big|}} = \\ & \displaystyle\frac{{\Big|(D_j^{(t)}) \cap (R_i^{(t)})\Big|}}{{|R_i^{(t)}| - 1}} > \displaystyle\frac{{\Big|D_j^{(t)} \cap R_i^{(t)}\Big|}}{{|R_i^{(t)}|}} = \Pr ({D_j}^{(t)}\left| {{R_i}^{(t)}} \right.) \end{aligned} $ |

其余变化模式的证明过程与变化模式1类似,在此省略。

定理 2 给定t时刻信息系统

变化模式4:

变化模式5:

变化模式6:

证明 若移入对象

| $\begin{array}{c}\Pr ({D_j}^{(t + 1)}\left| {{R_i}^{(t + 1)}} \right.) = \displaystyle\frac{{\Big|{D_j}^{(t + 1)} \cap {R_i}^{(t + 1)}\Big|}}{{|{R_i}^{(t + 1)}|}} = \\ \displaystyle\frac{{\Big|(D_j^{(t)} - \left\{ {\underline x } \right\}) \cap (R_i^{(t)} - \left\{ {\underline x } \right\})\Big|}}{{\Big|R_i^{(t)} - \left\{ {\underline x } \right\}\Big|}} = \\ \displaystyle\frac{{\Big|D_j^{(t)} \cap R_i^{(t)}\Big| - 1}}{{|R_i^{(t)}| - 1}} < \frac{{\Big|D_j^{(t)} \cap R_i^{(t)}\Big|}}{{|R_i^{(t)}|}} = \Pr ({D_j}^{(t)}\left| {{R_i}^{(t)}} \right.) \end{array} $ |

其余变化模式的证明过程与变化模式4类似,在此省略。

定理3 给定t时刻信息系统

变化模式5:

变化模式6:

变化模式7:

变化模式8:

证明 若移入对象

| $\begin{aligned} \Pr ({D_j}^{(t + 1)} & \left| {{R_i}^{(t + 1)}} \right.) = \frac{{|{D_j}^{(t + 1)} \cap {R_i}^{(t + 1)}|}}{{|{R_i}^{(t + 1)}|}} = \\ & \frac{{|(D_j^{(t)} \cap R_i^{(t)})|}}{{|R_i^{(t)}|}} = \Pr ({D_j}^{(t)}\left| {{R_i}^{(t)}} \right.)\end{aligned}$ |

其余变化模式的证明过程与变化模式5类似,在此省略。通过定理1~3可知,随着决策系统中数据对象同步移入移出的更新,原有决策规则的条件概率的变化趋势可以通过局部更新数据的计算进行快速估计。这样既避免了原有数据对象的重复学习,又利用同步更新大大提高了条件概率的计算效率,实现了三支决策条件概率的在线计算,进而使得三支决策区域的在线更新成为可能。

2.2 三支决策区域在线更新方法三支决策的在线快速计算,即充分利用t时刻信息系统的获取的三支决策知识以及t+1时刻变化数据的动态变化信息,快速且准确地计算三支决策的区域变化。其计算的原理是根据2.1节定理1~3获得的各个决策规则的条件概率变化趋势及特定条件概率取值,推导出三支决策区域在t+1时刻的变化规律。

推论1 给定t时刻信息系统

证明 1)对于

①假设

②假设

③假设

2)对于

①假设

②假设

③假设

3)对于

①假设

②假设

③假设

证毕。

推论2 给定t时刻信息系统

证明 证明过程与推论1类似,此处略。证毕。

推论3 给定t时刻信息系统

| $\begin{aligned} & {\rm{POS}}:R_i^{(t)} \! \subseteq \! {\rm{PO}}{{\rm{S}}_{(\alpha ,\beta )}}(D_j^{(t)}) \! \Rightarrow \! {\rm{PO}}{{\rm{S}}_{(\alpha ,\beta )}}(D_j^{(t + 1)}) \! = \! {\rm{PO}}{{\rm{S}}_{(\alpha ,\beta )}}(D_j^{(t)}); \\ & {\rm{BND}}:R_i^{(t)} \! \subseteq \! {\rm{BN}}{{\rm{D}}_{(\alpha ,\beta )}}(D_j^{(t)}) \! \Rightarrow \! {\rm{BN}}{{\rm{D}}_{(\alpha ,\beta )}}(D_j^{(t + 1)}) \! = \! {\rm{BN}}{{\rm{D}}_{(\alpha ,\beta )}}(D_j^{(t)}); \\ & {\rm{NEG}}:R_i^{(t)} \! \subseteq \! {\rm{NE}}{{\rm{G}}_{(\alpha ,\beta )}}(D_j^{(t)}) \! \Rightarrow \! {\operatorname{NEG} _{(\alpha ,\beta )}}(D_j^{(t + 1)}) \! = \! {\rm{NE}}{{\rm{G}}_{(\alpha ,\beta )}}(D_j^{(t)}){\text{。}} \end{aligned} $ |

证明 根据定理3,条件概率

根据2.1节中的定理1~3推导出的概率粗糙集的条件概率变化趋势,以及2.2节中的三支决策区域的快速计算3种情形展开讨论。

本节设计了三支决策在线快速计算算法(online computing algorithm),并从算法时间复杂度角度与基于三支决策理论的经典计算算法作对比,从理论上分析在线快速计算算法的优势。

算法1 三支决策在线快速计算算法

输入 t时刻信息系统

输出 t+1时刻三支决策区域

1) 通过

2) 根据定理1~3评估t+1时刻条件概率

3) 根据推论1~3更新t+1时刻三支决策区域

4) 更新t+1时刻每个等价类的条件概率值

在线快速计算中,若给定内存部分信息系统IS,包含m个条件等价类和n个决策等价类,其中

为了说明上述在线三支决策算法的特点与优势,本文将根据文献[22]中提出的基于概率粗糙集三支决策理论的经典计算思想,设计三支决策经典计算算法(classical computing algorithm)。

算法2 基于三支决策的经典计算算法

输入 t时刻下信息系统

输出 t+1时刻的三支决策区域及决策规则

/* 根据移入对象

1) 通过

2) 根据定义1重新计算t+1时刻条件概率

3) 根据定义2重新计算t+1时刻三支决策接受域、拒绝域和边界域

经典计算算法中,若给定内存部分信息系统IS,包含m个条件等价类和n个决策等价类,其中

假设原t时刻信息系统为

经典计算算法:

| $O(|{U^{(t)}}/A| \cdot |A| + |D|) + O(2|{U^{(t)}}/A| \cdot |D|)$ |

在线快速计算:

| $O(|{U^{(t)}}/A| \cdot |A| + |D|) + O(|{R_i}| + |{R_j}|)$ |

从时间复杂度分析可知,在线快速计算的效率明显优于经典计算算法。从算法执行过程亦可看出,由于经典计算算法对于决策对象的每一次更新,都进行等价类划分和条件概率的重新计算,其开销甚是庞大;而在线计算利用内存滑动窗口模型,同步处理移入移出数据,对当前实时变化的数据进行局部计算,实现条件概率及三支区域的快速估计与更新,其运算效率明显高于经典计算算法。

综上,从理论分析可知在线快速计算的运行效率明显优于经典计算算法。接下来,我们将从实验的角度评估两算法的实际表现。

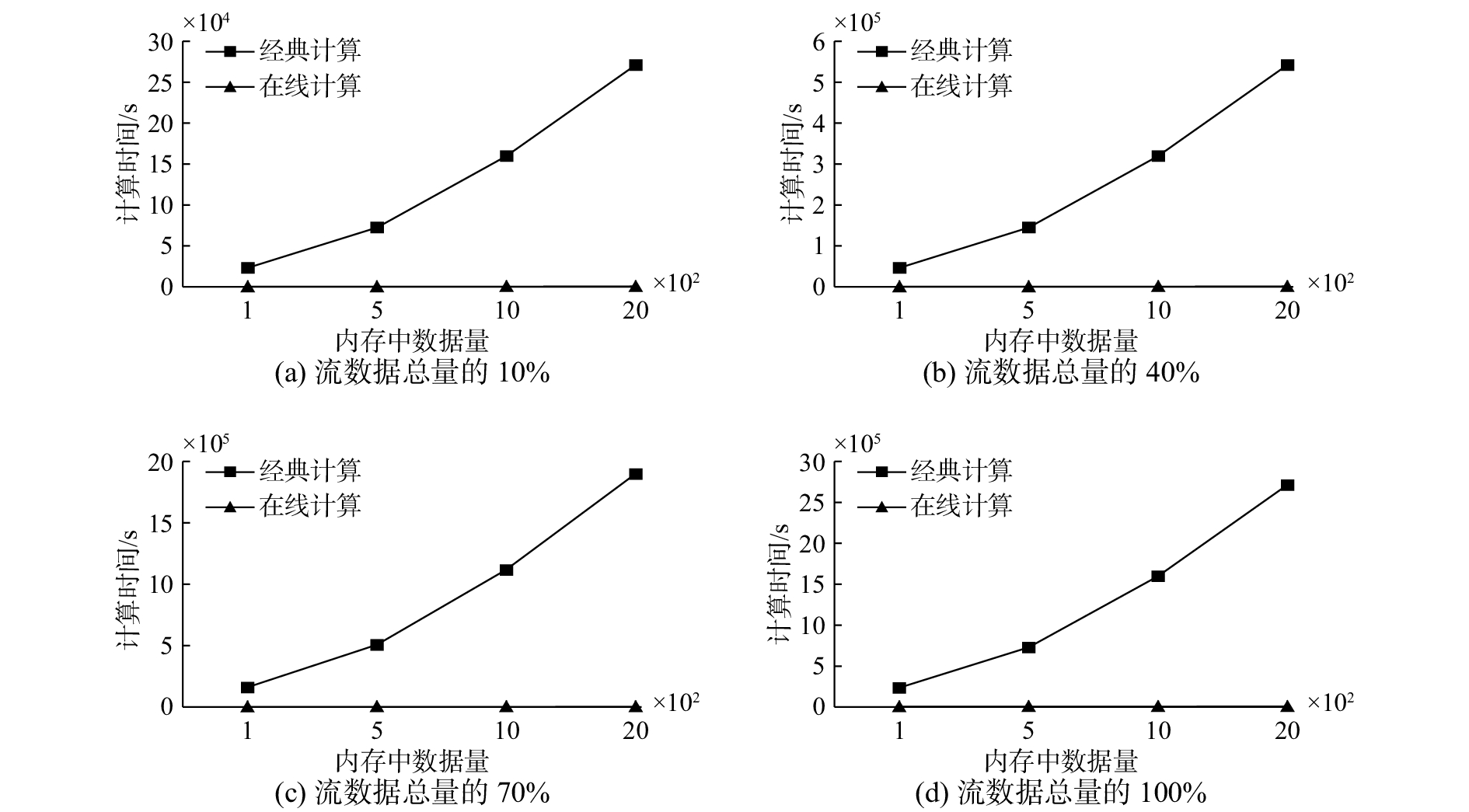

3 实验与结果2.3节通过理论证明了三支决策在线快速计算算法的时间复杂度优于经典计算算法。本章将通过与三支决策经典计算算法的对比实验来验证三支决策在线快速计算算法的时间消耗优势。

本实验环境为:双核、4 GB内存的PC,运行Microsoft Windows 7操作系统,算法程序使用Java编程,Java开发包为JDK1.6版本。

3.1 数据集为了验证在线快速计算的性能,我们从UCI数据库中选择了8个较大数据集,分别为Skin-NoSkin、Shuttle、IRIS、Zoo、Haberman、Breast-cancer、Letter、Magic,所有的数据均为数值型或类别型,表1为数据集的基本信息。

| 表 1 数据集基本信息 Tab.1 The basic information of the eight datasets |

为排除偶然因素的影响,所有实验都进行了10次,最终结果是10次实验的平均值。我们任意设定的三支决策阈值

1)算法执行时间对比实验

假设存储空间保持为100条记录,我们比较在线快速计算、经典计算算法的性能时,逐渐增加上述8个数据集在内存中存储数据的比例。当进入决策信息系统的在线计算数据总量累计达到总数据量的10%~100%时,分别测试不同情况下,两种算法在三支决策区域更新中的平均执行时间。实验结果如图2所示。

|

Download:

|

| 图 2 在线快速计算与经典计算算法的平均时间消耗对比 Fig. 2 Average elapsed times between online computing algorithm and classical computing algorithm | |

由图2显然可以看出,在每个数据集下,随着进入内存中动态数据比例的增大,在线快速计算与经典计算算法的平均执行时间亦逐渐增大,但经典计算算法的增幅明显更大。可见,在线快速计算的平均执行时间相对更少。

此外,为了更加精确地展现在线快速计算的优势及其稳定性,我们将在占数据总量50%的情况下,从t时刻到t+5时刻,测试两类算法的平均执行时间并对比其稳定性。结果见表2,单位为ms。可以观察到,对于同一数据集,对比经典计算算法,在线快速计算可以大大节约算法执行时间。

| 表 2 t~t+5时刻算法执行时间 Tab.2 Experimental results examined from time t to t+5 on UCI datasets |

同时,在不同数据集上,在线快速计算执行时间的均值和方差比经典计算算法更小,显示了其具有更好的效率及稳定性。

2)不同内存容量算法执行时间对比

由于在线计算方法以内存计算为依托,内存空间的容量对于三支决策在线快速计算的执行效果是否有影响,是一个值得研究的问题。因此我们选择以上8个UCI数据集中规模较大且复杂程度较高的Breast-cancer数据集,构造和实验1相似的对比实验,但是将内存容量分别为设定为100、500、1 000、2 000条记录,当上述数据集实施两种算法实验的数据总量累计达到总数据量的10%、40%、70%和100%时,分别记录这两种算法此时的平均执行时间。

由图3可以观察到,在相同实验数据累积量下,随着内存空间的增加,经典计算算法的平均执行时间几乎呈指数级速度增长,而在线快速计算的时间消耗较为平稳。

|

Download:

|

| 图 3 在线快速计算与经典计算算法在不同内存容量下的平均执行时间 Fig. 3 Average elapsed times between online computing algorithm and classical computing algorithm on different memory sizes | |

由算法的时间复杂度可知,随着决策系统的每一次更新,经典计算算法需要进行所有数据等价类的重新划分及条件概率的重新计算,此过程每次都需要执行时间复杂度为

综上可知,在不同内存空间下,在线快速计算的效率均远高于经典计算算法,且这一优势随着内存空间的增加更加明显。

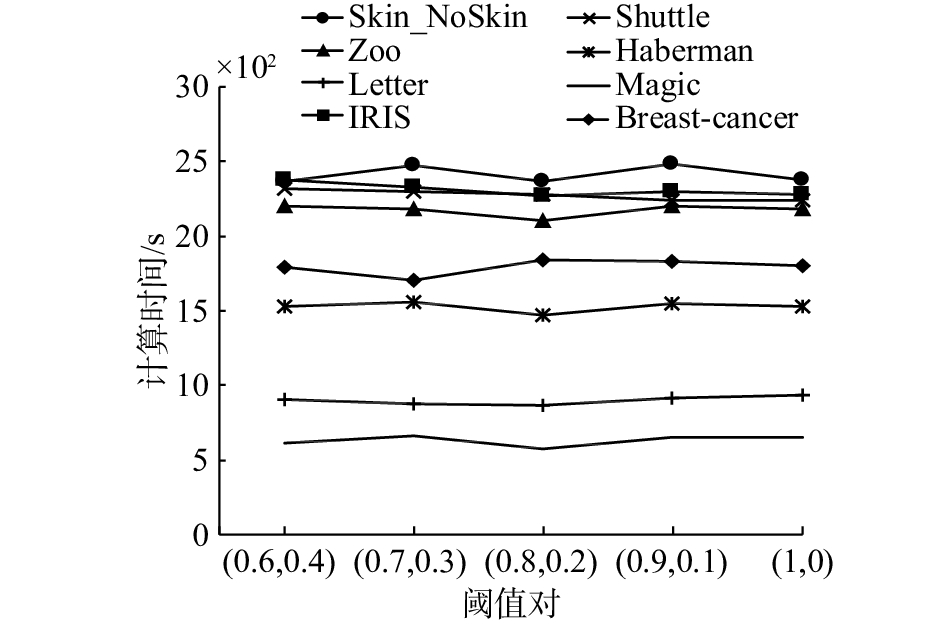

3)不同阈值在线快速计算执行时间对比

由于三支决策是一种典型的概率粗糙集参数化模型,实验结果可能会受参数设置的影响。设置内存空间为100 b,并选取了5对阈值,分别测出在线快速计算在8个数据集下执行完毕平均所需时间,从而验证在线快速计算的性能与选取阈值的关系。图4显示了算法平均执行时间随不同阈值对的变化趋势,不难看出,算法的执行时间随着阈值的改变有轻微的波动,总体来说比较稳定。由此也进一步验证了在线快速计算的时间复杂度主要取决于动态数据的规模及其复杂程度。

|

Download:

|

| 图 4 不同阈值对在线快速计算平均执行时间 Fig. 4 Average elapsed times on online computing algorithm with different threshold pairs | |

动态在线计算是一种常见的数据计算方法,本文提出一种内存滑动窗口机制对在线计算的数据变化模式进行统一建模,并根据上述模型,推导出不同类型数据变化模式下的三支决策条件概率及三支区域的变化规律。最后本研究提出一种新型的动态在线快速计算算法,该算法能够获得与经典三支决策算法相同的决策结果。由于本算法只需要对当前的变化数据进行局部实时计算,有效避免了历史数据的重复学习,大大提高了三支决策更新效率。为验证本文所提出的在线快速计算的优势,与经典计算算法在8个UCI公共数据集上进行实验对比。实验结果表明,在线快速计算比经典计算算法效率更高,稳定性更好。本研究表明,概率粗糙集三支决策领域采用在线计算方法进行快速计算是可行的。我们将在未来的工作中,继续探讨概率粗糙集三支决策的多对象动态在线快速计算以及其在实际在线计算场景中的应用。

| [1] |

FONG S, WONG R, VASILAKOS A V. Accelerated PSO swarm search feature selection for data stream mining big data[J]. IEEE transactions on services computing, 2016, 9(1): 33-45. ( 0) 0)

|

| [2] |

ZHANG Hong, LI Bo, JIANG Hongbo, et al. A framework for truthful online auctions in cloud computing with heterogeneous user demands[C]//Proceedings of 2013 IEEE INFOCOM. Turin, Italy, 2013: 1510–1518.

( 0) 0)

|

| [3] |

ESKANDARI S, JAVIDI M M. Online streaming feature selection using rough sets[J]. International journal of approximate reasoning, 2016, 69: 35-57. DOI:10.1016/j.ijar.2015.11.006 ( 0) 0)

|

| [4] |

CHAZELLE B, ROSENBERG B. The complexity of computing partial sums off-line[J]. International journal of computational geometry and applications, 1991, 1(1): 33-45. DOI:10.1142/S0218195991000049 ( 0) 0)

|

| [5] |

DENG Jie, QU Zhiguo, ZHU Yongxu, et al. Towards efficient and scalable data mining using spark[C]//Proceedings of 2014 International Conference on Information and Communications Technologies. Nanjing, China, 2014: 1–6.

( 0) 0)

|

| [6] |

YAO Yiyu. Three-way decisions and cognitive computing[J]. Cognitive computation, 2016, 8(4): 543-554. DOI:10.1007/s12559-016-9397-5 ( 0) 0)

|

| [7] |

ZHOU Bing, YAO Yiyu, LUO Jigang. Cost-sensitive three-way email spam filtering[J]. Journal of intelligent information systems, 2014, 42(1): 19-45. ( 0) 0)

|

| [8] |

KHAN M T, AZAM N, KHALID S, et al. A three-way approach for learning rules in automatic knowledge-based topic models[J]. International journal of approximate reasoning, 2017, 82: 210-226. DOI:10.1016/j.ijar.2016.12.011 ( 0) 0)

|

| [9] |

LI Huaxiong, ZHANG Libo, ZHOU Xianzhong, et al. Cost-sensitive sequential three-way decision modeling using a deep neural network[J]. International journal of approximate reasoning, 2017, 85: 68-78. DOI:10.1016/j.ijar.2017.03.008 ( 0) 0)

|

| [10] |

QIAN Jin, DANG Chuangyin, YUE Xiaodong, et al. Attribute reduction for sequential three-way decisions under dynamic granulation[J]. International journal of approximate reasoning, 2017, 85: 196-216. DOI:10.1016/j.ijar.2017.03.009 ( 0) 0)

|

| [11] |

YU Hong, ZHANG Cong, WANG Guoyin. A tree-based incremental overlapping clustering method using the three-way decision theory[J]. Knowledge-based systems, 2016, 91: 189-203. DOI:10.1016/j.knosys.2015.05.028 ( 0) 0)

|

| [12] |

LUO Chuan, LI Tianrui, CHEN Hongmei, et al. Efficient updating of probabilistic approximations with incremental objects[J]. Knowledge-based systems, 2016, 109: 71-83. DOI:10.1016/j.knosys.2016.06.025 ( 0) 0)

|

| [13] |

NAUMAN M, AZAM N, YAO Jingtao. A three-way decision making approach to malware analysis using probabilistic rough sets[M]. New York, NY, USA: Elsevier, 2016.

( 0) 0)

|

| [14] |

CHEN Yufei, YUE Xiaodong, FUJITA H, et al. Three-way decision support for diagnosis on focal liver lesions[J]. Knowledge-based systems, 2017, 127: 85-99. DOI:10.1016/j.knosys.2017.04.008 ( 0) 0)

|

| [15] |

CHEN Hongmei, LI Tianrui, LUO Chuan, et al. A decision-theoretic rough set approach for dynamic data mining[J]. IEEE transactions on fuzzy systems, 2015, 23(6): 1958-1970. DOI:10.1109/TFUZZ.2014.2387877 ( 0) 0)

|

| [16] |

LIANG Decui, XU Zeshui, LIU Dun. Three-way decisions based on decision-theoretic rough sets with dual hesitant fuzzy information[J]. Information sciences, 2017, 396: 127-143. DOI:10.1016/j.ins.2017.02.038 ( 0) 0)

|

| [17] |

ZHANG Hongying, YANG Shuyun, MA Jianmin. Ranking interval sets based on inclusion measures and applications to three-way decisions[J]. Knowledge-based systems, 2016, 91: 62-70. DOI:10.1016/j.knosys.2015.07.025 ( 0) 0)

|

| [18] |

ZHAO Xuerong, HU Baoqing. Fuzzy probabilistic rough sets and their corresponding three-way decisions[J]. Knowledge-based systems, 2016, 91: 126-142. DOI:10.1016/j.knosys.2015.09.018 ( 0) 0)

|

| [19] |

AZAM N, ZHANG Yan, YAO Jingtao. Evaluation functions and decision conditions of three-way decisions with game-theoretic rough sets[J]. European journal of operational research, 2017, 261(2): 704-714. DOI:10.1016/j.ejor.2016.12.048 ( 0) 0)

|

| [20] |

DENG Xiaofei, YAO Yiyu. A multifaceted analysis of probabilistic three-way decisions[J]. Fundamenta informaticae, 2014, 132(3): 291-313. ( 0) 0)

|

| [21] |

ZHANG Yan, YAO Jingtao. Gini objective functions for three-way classifications[J]. International journal of approximate reasoning, 2017, 81: 103-114. DOI:10.1016/j.ijar.2016.11.005 ( 0) 0)

|

| [22] |

GRECO S, MATARAZZO B, ROMAN S. Rough sets theory for multicriteria decision analysis[J]. European journal of operational research, 2001, 129(1): 1-47. DOI:10.1016/S0377-2217(00)00167-3 ( 0) 0)

|

| [23] |

LIU Dun, LI Tianrui, ZHANG Junbo. Incremental updating approximations in probabilistic rough sets under the variation of attributes[J]. Knowledge-based systems, 2015, 73: 81-96. DOI:10.1016/j.knosys.2014.09.008 ( 0) 0)

|

| [24] |

LI Shaoyong, LI Tianrui, LIU Dun. Incremental updating approximations in dominance-based rough sets approach under the variation of the attribute set[J]. Knowledge-based systems, 2013, 40: 17-26. DOI:10.1016/j.knosys.2012.11.002 ( 0) 0)

|

| [25] |

ZHANG Junbo, LI Tianrui, RUAN Da, et al. Neighborhood rough sets for dynamic data mining[J]. International journal of intelligent systems, 2012, 27(4): 317-342. DOI:10.1002/int.v27.4 ( 0) 0)

|

| [26] |

LUO Chuan, LI Tianrui, CHEN Hongmei. Dynamic maintenance of three-way decision rules[C]//Proceedings of the 9th International Conference on Rough Sets and Knowledge Technology. Shanghai, China, 2014: 801–811.

( 0) 0)

|

| [27] |

PAPANDREOU G, KOKKINOS I, SAVALLE P A. Modeling local and global deformations in Deep Learning: epitomic convolution, Multiple Instance Learning, and sliding window detection[C]//Proceedings of 2015 IEEE Conference on Computer Vision and Pattern Recognition. Boston, MA, USA, 2015: 390–399.

( 0) 0)

|

| [28] |

YUN U, LEE G. Sliding window based weighted erasable stream pattern mining for stream data applications[J]. Future generation computer systems, 2016, 59: 1-20. DOI:10.1016/j.future.2015.12.012 ( 0) 0)

|

2018, Vol. 13

2018, Vol. 13