2. 江苏省媒体设计与软件技术重点实验室,江苏 无锡 214122;

3. 常熟理工学院 计算机科学与工程学院,江苏 常熟 215500

2. Jiangsu Key Laboratory of Media Design and Software Technology, Wuxi 214122, China;

3. School of Computer Science and Engineering, Changshu Institute of Technology, Changshu 215500, China

近年来,面向复杂非线性数据的模糊聚类问题得到了研究人员的广泛关注[1-6]。在无监督学习环境中为了提高复杂非线性数据的可分性,一个重要的研究思路是使用非线性映射将数据映射到高维空间中。在众多非线性映射方法中,核方法作为经典的隐性映射方法得到了广泛的应用[5-13]。研究表明,核方法通过使用核函数代替内积运算,将待分类数据隐性地映射到高维空间,从而有助于复杂非线性数据的学习。但是,核方法还存在着诸多局限性,尤其是如何针对不同的问题选择合适的核函数和相关参数,这都会影响算法的聚类效果。

模糊系统因其强大的不确定性系统建模能力、优良的可解释性和出色的泛化能力,近年来在复杂非线性数据学习问题中得到了大量的研究。在已有的经典模糊系统中,Takagi-Sugeno-Kang(TSK)[14-17]模糊系统由于其良好的解释性和简洁性得到了广泛应用。在TSK模糊系统中,其规则前件部分通过显性映射方式(本文称之为模糊特征映射),将输入数据映射到高维空间中去。从本质上讲,模糊特征映射可以视为一种特殊的非线性映射方式。基于此,本文将输入数据进行相应的非线性映射。在具体实现过程中我们发现,经模糊特征映射后的特征维数过高,这会增加计算量,同时也导致了数据的冗余。为此,本文通过引入多层递阶融合机制和主成分分析,提出新型的基于多层递阶融合的模糊特征映射新方法。并将之与经典模糊聚类技术相结合,进一步提出基于多层递阶融合模糊特征映射的模糊C均值聚类新方法。经实验验证,本文算法在处理复杂非线性数据时能够取得比传统模糊聚类算法更有效的聚类效果。

1 Takagi-Sugeno-Kang模糊系统及模糊特征映射Takagi-Sugeno-Kang模糊系统模型[18-23]是最重要的用于建模与智能控制的模糊模型之一。对于经典的TSK模糊模型,最常用的模糊推理规则的定义如下:

第k条模糊规则:

IF

| ${{{x}}_1} \;{\rm{is}} \; {{A}}_1^k \wedge {{{x}}_2} \;{\rm{is}} \; {{A}}_2^k \wedge \cdots {{{x}}_d} \wedge \;{\rm{is}} \; {{A}}_d^k$ |

THEN

| ${f^k}\left( {{x}} \right) = {{p}}_0^k + {{p}}_1^k{{{x}}_1} + \cdots + {{p}}_d^k{{{x}}_d},k = 1,2, \cdots ,K $ | (1) |

式中:

| ${y^0} = \sum\limits_{k = 1}^K {\frac{{{\mu ^k}\left( {{X}} \right)}}{{\sum\limits_{{k'} = 1}^K {{\mu ^{{k'}}}\left( {{X}} \right)} }}} {f^k}\left( {{X}} \right) = \sum\limits_{k = 1}^K {{{\tilde \mu }^k}} \left( {{X}} \right){f^k}\left( {{X}} \right)$ | (2) |

式中:

| ${\mu ^k}\left( {{X}} \right) = \prod\limits_{i = 1}^d {{\mu _{{{A}}_i^k}}} \left( {{{{x}}_i}} \right)$ | (3) |

和

| ${\tilde \mu ^k}\left( {{X}} \right) = {{{\mu ^k}\left( {{X}} \right) } / {\sum\limits_{{k'} = 1}^K {{\mu ^{{k'}}}\left( {{X}} \right)} }}{\kern 1pt} $ | (4) |

通常采用高斯函数作为模糊隶属函数,其计算公式为

| ${\mu _{{{A}}_i^k}}\left( {{{{x}}_i}} \right) = \exp \left( {\frac{{ - {{\left( {{{{x}}_i} - {{c}}_i^k} \right)}^2}}}{{2{{\delta }}_i^k}}} \right)$ | (5) |

式中:参数

| ${{c}}_i^k = {{\sum\limits_{j = 1}^N {{{{u}}_{jk}}{{{x}}_{ji}}} } / {\sum\limits_{j = 1}^N {{{{u}}_{jk}}} }}$ | (6) |

| ${{\delta }}_i^k = {{h \cdot \sum\limits_{j = 1}^N {{{{u}}_{jk}}{{\left( {{{{x}}_{ji}} - {{c}}_i^k} \right)}^2}} } / {\sum\limits_{j = 1}^N {{{{u}}_{jk}}} }}$ | (7) |

式中:

| ${{{X}}_e} = {\left[ {1\,\,{{{X}}^{\rm{T}}}} \right]^{\rm{T}}}$ | (8) |

| ${{{\tilde X}}^k} = {\tilde \mu ^k}\left( {{X}} \right){{{X}}_e}{\kern 1pt} $ | (9) |

| ${{{X}}_g} = {\left[ {{{\left( {{{{{\tilde X}}}^1}} \right)}^{\rm{T}}}\,\,{{\left( {{{{{\tilde X}}}^2}} \right)}^{\rm{T}}}\,\, \cdots \,\,{{\left( {{{{{\tilde X}}}^K}} \right)}^{\rm{T}}}} \right]^{\rm{T}}}$ | (10) |

| ${{{P}}^k} = {\left[ {{{p}}_0^k\,\,{{p}}_1^k\,\, \cdots \,\,{{p}}_d^k} \right]^{\rm{T}}}$ | (11) |

| ${{{P}}_g} = {\left[ {{{\left( {{{{P}}^{\rm{1}}}} \right)}^{\rm{T}}}\,\,{{\left( {{{{P}}^2}} \right)}^{\rm{T}}}\,\, \cdots \,\,{{\left( {{{{P}}^K}} \right)}^{\rm{T}}}} \right]^{\rm{T}}}$ | (12) |

TSK模糊模型的训练问题转化为式(13)线性回归模型的参数学习问题[24]:

| ${y^0} = {{P}}_g^{\rm{T}}{{{X}}_g}$ | (13) |

从式(13)中可以观察到,输入向量经式(8)~(10)计算,可以变换为一个

原数据通过模糊特征映射,得到其在高维空间中的新表示。但是作为单层映射结构,会因映射后的特征维数过高使得数据变得混乱和冗余,继而影响算法后续的聚类效果。研究表明[25-26],将单层映射结构改造为多层映射结构,可以有效地提高算法对复杂非线性数据的学习能力。为此,本文引入多层递阶融合的概念来构造新型的映射,提出基于多层递阶融合的模糊特征映射新方法(MLHFFFM)。通过对每层模糊特征映射之后的高维特征表示进行PCA降维,再进行相应的信息补充,形成新的融合层,依次进入下一层的压缩融合过程,其结构如图1所示。

|

Download:

|

| 图 1 MLHFFFM算法结构图 Fig. 1 Structure of MLHFFFM algorithm | |

基于多层递阶融合的模糊特征映射新方法MLHFFFM算法描述如下:

输入 给定一个数据集D={X, Y},设置初始模糊规则数K,分层融合层数S。

输出 经多层递阶融合后的数据矩阵

1) 对原数据进行第一层的模糊特征映射(初始层)

① 通过FCM算法计算出隶属度矩阵

② 经式(6)和式(7)分别计算出对应的

③ 通过高斯隶属度函数(5)和式(3)的计算得到

④ 再经过式(8)~(10)的转化,得到映射后高维空间中的数据矩阵

2) 多层递阶融合

① 利用PCA对

② For i=2:(S-1);

③ 重复步骤1),对原数据进行模糊特征映射,得到数据矩阵

④

⑤ 利用PCA对

⑥ end;

2.2 基于多层递阶融合模糊特征映射的模糊C均值聚类算法MLHFFFM-FCM本节中,将多层递阶融合模糊特征映射与经典模糊聚类算法FCM相结合,提出基于多层递阶融合模糊特征映射的模糊C均值聚类算法。MLHFFFM-FCM算法描述如下:

输入 给定一个数据集D={X, Y},设置初始模糊规则数K,分层融合层数S。

1) 通过基于多层递阶融合的模糊特征映射,将输入数据X转化为

2) 对最终压缩融合获得的数据矩阵

输出 模糊划分矩阵U。

3 实验研究与分析为了验证MLHFFFM-FCM算法在复杂非线性数据分析上的有效性,本节从3个方面进行对比分析:1)各FCM演变算法之间聚类效果的对比实验;2)单层映射结构与多层递阶融合映射结构的聚类效果对比实验;3)关键参数敏感性的对比实验。

3.1 算法性能的评价指标为了对各类算法的聚类性能进行对比,本文采用NMI(normalized mutual information)和RI(rand index)作为实验评价指标。这两个指标的值越接近1,说明算法聚类性能越好。其计算公式如下:

1) NMI

| ${\rm{NMI}}{\rm{ = }}\frac{{\sum\limits_{i = 1}^C {\sum\limits_{j = 1}^C {{N_{i,j}}\log N \times {N_{i,j}}} } /{N_i} \times {N_j}}}{{\sqrt {\sum\limits_{i = 1}^C {{N_i}} \times \log {N_i}/N \times \sum\limits_{j = 1}^C {{N_j}} \times \log {N_j}/N} }}$ | (14) |

式中:

2) RI

| ${\rm{RI}} = \frac{{{f_{00}} + {f_{11}}}}{{{{N(N - 1)} / 2}}}$ | (15) |

式中:

我们采用UCI真实数据集(http://archive.ics.uci.edu/ml/)来评估本文算法。为了测试实验应用数据集的广泛性以及避免选取数据集的偶然性,选择其中7个具有代表性的数据集Ar2、Diabetes、Zoo、Australian、Breast、Heart、Chronic_Kidney_Disease进行测试,其中数据集的相关信息如表1所示。同时本文选取5种经典的聚类算法与MLHFFFM-FCM算法进行对比实验,分别为FCM算法、PCA-FCM算法、ELM-FCM算法、KFCM-K算法以及KFCM-F算法。所有实验运行平台的配置如下:酷睿i3 3.6 GHz CPU,3.42 G RAM,32位 Windows 7操作系统,MATLAB R2012b编程环境。另外各算法相关说明及其参数设置如表2所示,其中各算法涉及的模糊指数m的寻优范围均为{1.2, 1.4, 1.6, 1.8, 2.0, 2.2, 2.4, 2.6, 2.8, 3.0, 3.2, 3.4, 3.6, 3.8, 4.0}。

| 表 1 实验数据集 Tab.1 Experimental data sets |

| 表 2 各算法的说明以及相关参数设置 Tab.2 The description of the algorithm and related parameters |

为了验证MLHFFFM-FCM算法的有效性,本节对算法进行对比实验测试。在本实验中,将初始模糊规则数r设置为30,多层递阶融合层数设置为5层,并根据表2的实验相关参数设置,分别对各算法重复运行10次。最终的实验中各算法的参数取值情况和实验结果如表3和表4所示。

| 表 3 各算法参数取值情况 Tab.3 Parameter values of each algorithm |

| 表 4 各算法的运行结果 Tab.4 Results of each algorithm |

从表4中可以明显地看出,在聚类精度上,文中涉及的对比算法只能在某个或某几个数据集上取得较优的结果,而MLHFFFM-FCM算法不仅在所有的测试数据集上取得满意的结果,并且还有着明显的提高。这说明了MLHFFFM-FCM算法的有效性,也进一步说明了该算法处理复杂非线性数据的强大能力。

3.4 单层映射结构与多层递阶融合映射结构的聚类效果对比实验与分析为了体现本文算法引入的多层递阶融合方法的优越性,本节实验针对多层递阶融合映射结构对FCM算法性能的影响进行实验与分析。实验在模糊规则数设置相同的情况下,分别采用单层映射结构和多层递阶融合映射结构对原输入数据进行非线性映射,将映射后的数据采用FCM进行聚类。实验最终的参数取值情况和结果如表5和表6所示,其中因受篇幅所限,仅在表6中给出RI指标结果,NMI与之有类似的结果,不再列出。

| 表 5 两种算法结构的参数取值情况 Tab.5 Parameter selection of two algorithms |

| 表 6 两种算法结构的RI_mean性能指标 Tab.6 Performance index of two algorithms |

从表5和表6中可以明显地观察出,相比于单层映射结构,基于多层递阶融合映射结构的模糊聚类方法能够取得更好的学习效果。这是由于在单层映射之后的数据存在冗余信息,而在压缩之后又会导致信息缺失。但是多层递阶融合的映射结构是建立在单层映射结构的基础上,采用PCA技术对每一层模糊特征映射得到的高维特征表示进行压缩,再对应地结合每一层数据信息融合形成的。因此通过多层递阶融合的方法,可以有效地精简冗余信息,同时对每一层进行适当的信息弥补。这也充分体现了本文提出的多层递阶融合映射结构的优越。

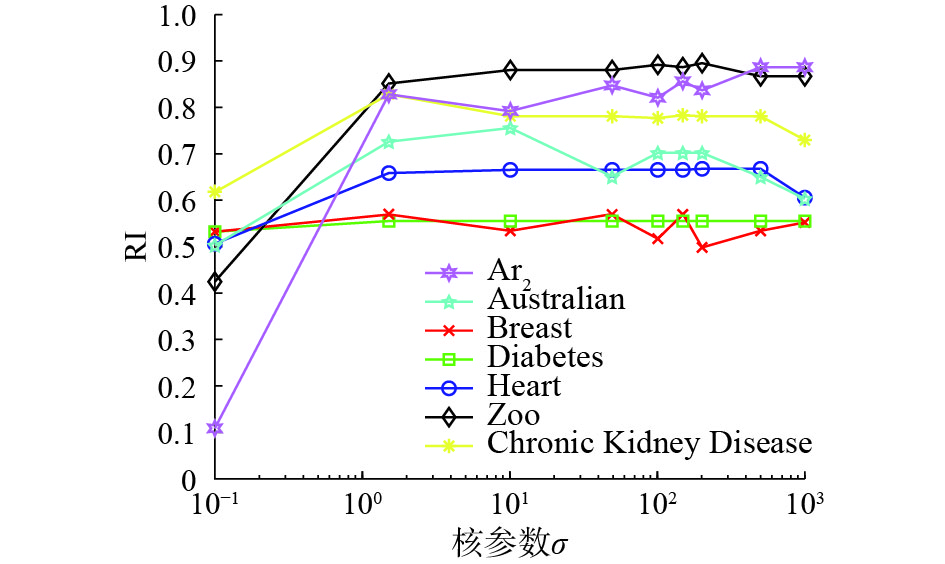

3.5 参数敏感性实验模糊规则数r作为MLHFFFM-FCM算法中的关键参数,本节针对该参数进行参数敏感性实验。这里为了让实验结果能够直观地进行观察与对比,我们同时对KFCM-F算法中的关键参数

|

Download:

|

|

图 2 KFCM-F算法性能随

|

|

|

Download:

|

| 图 3 MLHFFFM-FCM算法性能随模糊规则数r变化的影响 Fig. 3 Effect of fuzzy rules r on the performance of MLHFFFM-FCM | |

从图2中不难看出,KFCM-F算法的性能随核参数

本文提出的MLHFFFM-FCM算法,是一种采用新型的显性映射方式来处理复杂非线性数据的无监督学习方法。相比于现有的核函数映射方法,MLHFFFM-FCM算法在取得良好聚类效果的同时,还对算法中模糊规则数不敏感,这更有利于算法在实际应用中的选用。但是本文提出的MLHFFFM-FCM算法仍然具有一定的缺陷,例如对于高维数据,其时间开销较大。如何有效克服这些问题,将是今后进一步研究的重点。

| [1] |

王骏, 王士同, 邓赵红. 聚类分析研究中的若干问题[J]. 控制与决策, 2012, 27(3): 321-328. WANG Jun, WANG Shitong, DENG Zhaohong. Survey on challenges in clustering analysis research[J]. Control and decision, 2012, 27(3): 321-328. (  0) 0)

|

| [2] |

李宝刚. 基于读者日志分析的模糊聚类研究[J]. 价值工程, 2011, 30(33): 146-147. Li Baogang. The fuzzy clustering on analyzing reader's log[J]. Value engineering, 2011, 30(33): 146-147. DOI:10.3969/j.issn.1006-4311.2011.33.109 (  0) 0)

|

| [3] |

PENG Hong, WANG Jun, PÉREZ-JIMÉNEZ M J, et al. An unsupervised learning algorithm for membrane computing[J]. Information sciences, 2015, 304: 80-91. DOI:10.1016/j.ins.2015.01.019 ( 0) 0)

|

| [4] |

QIN Chen, SONG Shiji, HUANG Gao, et al. Unsupervised neighborhood component analysis for clustering[J]. Neurocomputing, 2015, 168: 609-617. DOI:10.1016/j.neucom.2015.05.064 ( 0) 0)

|

| [5] |

XU Yan, QIU Peng, ROYSAM B. Unsupervised discovery of subspace trends[J]. IEEE transactions on pattern analysis and machine intelligence, 2015, 37(10): 2131-2145. DOI:10.1109/TPAMI.2015.2394475 ( 0) 0)

|

| [6] |

杨玉梅. 基于信息熵改进的K-means动态聚类算法[J]. 重庆邮电大学学报: 自然科学版, 2016, 28(2): 254-259. YANG Yumei. Improved K-means dynamic clustering algorithm based on information entropy[J]. Journal of Chongqing university of posts and telecommunications: natural science edition, 2016, 28(2): 254-259. (  0) 0)

|

| [7] |

阎辉, 张学工, 李衍达. 基于核函数的最大间隔聚类算法[J]. 清华大学学报: 自然科学版, 2002, 42(1): 132-134. YAN Hui, ZHANG Xuegong, LI Yanda. Kernel-based maximal-margin clustring algorithm[J]. Journal of Tsinghua university: science and technology, 2002, 42(1): 132-134. (  0) 0)

|

| [8] |

MA Bo, QU Huiyang, WONG H S. Kernel clustering-based discriminant analysis[J]. Pattern recognition, 2007, 40(1): 324-327. DOI:10.1016/j.patcog.2006.05.033 ( 0) 0)

|

| [9] |

LIAO Li, ZHOU Jianzhong, ZOU Qiang. Weighted fuzzy kernel-clustering algorithm with adaptive differential evolution and its application on flood classification[J]. Natural hazards, 2013, 69(1): 279-293. DOI:10.1007/s11069-013-0707-x ( 0) 0)

|

| [10] |

李侃, 刘玉树. 模糊核聚类的自适应算法[J]. 控制与决策, 2004, 19(5): 595-597. LI Kan, LIU Yushu. Fuzzy kernel clustering self-adaptive algorithm[J]. Control and decision, 2004, 19(5): 595-597. (  0) 0)

|

| [11] |

WANG Jun, DENG Zhaohong, JIANG Yizhang, et al. Multiple-kernel based soft subspace fuzzy clustering[C]//Proceedings of 2014 IEEE International Conference on Fuzzy Systems. Beijing, China, 2014: 186–193.

( 0) 0)

|

| [12] |

WANG Jun, DENG Zhaohong, CHOI K S, et al. Distance metric learning for soft subspace clustering in composite Kernel space[J]. Pattern recognition, 2015, 52: 113-134. ( 0) 0)

|

| [13] |

GIROLAMI M. Mercer kernel-based clustering in feature space[J]. IEEE transactions on neural networks, 2002, 13(3): 780-784. DOI:10.1109/TNN.2002.1000150 ( 0) 0)

|

| [14] |

MÉNDEZ G M, DE LOS ANGELES HERNÁNDEZ M. Hybrid learning mechanism for interval A2-C1 type-2 non-singleton type-2 Takagi-Sugeno-Kang fuzzy logic systems[J]. Information sciences, 2013, 220: 149-169. DOI:10.1016/j.ins.2012.01.024 ( 0) 0)

|

| [15] |

TSAKONAS A, GABRYS B. Evolving Takagi-Sugeno-Kang fuzzy systems using multi[J]. Journal of clinical endocrinology and metabolism, 2011, 96(12): 3603-3608. DOI:10.1210/jc.2011-1443 ( 0) 0)

|

| [16] |

CHUANG C C, SU Shunfeng, CHEN S S. Robust TSK fuzzy modeling for function approximation with outliers[J]. IEEE transactions on fuzzy systems, 2001, 9(6): 810-821. DOI:10.1109/91.971730 ( 0) 0)

|

| [17] |

SUGENO M, KANG G T. Structure identification of fuzzy model[J]. Fuzzy sets and systems, 1988, 28(1): 15-33. DOI:10.1016/0165-0114(88)90113-3 ( 0) 0)

|

| [18] |

PRICE A L, PATTERSON N J, PLENGE R M, et al. Principal components analysis corrects for stratification in genome-wide association studies[J]. Nature genetics, 2006, 38(8): 904-909. DOI:10.1038/ng1847 ( 0) 0)

|

| [19] |

JOLLIFFE I T. Principal component analysis[M]. Berlin: Springer, 2012: 41–64.

( 0) 0)

|

| [20] |

冯斌, 须文波. 基于TSK模糊系统的生化变量预估模型[J]. 计算机与应用化学, 2006, 23(4): 343-346. FENG Bin, XU Wenbo. Biochemical variable estimation model based on TSK fuzzy system[J]. Computers and applied chemistry, 2006, 23(4): 343-346. (  0) 0)

|

| [21] |

WU Dongrui. Approaches for reducing the computational cost of interval type-2 fuzzy logic systems: overview and comparisons[J]. IEEE transactions on fuzzy systems, 2013, 21(1): 80-99. DOI:10.1109/TFUZZ.2012.2201728 ( 0) 0)

|

| [22] |

DENG Zhaohong, CHOI K S, CHUNG F L, et al. Scalable TSK fuzzy modeling for very large datasets using minimal-enclosing-ball approximation[J]. IEEE transactions on fuzzy systems, 2011, 19(2): 210-226. DOI:10.1109/TFUZZ.2010.2091961 ( 0) 0)

|

| [23] |

蒋亦樟, 邓赵红, 王士同. ML型迁移学习模糊系统[J]. 自动化学报, 2012, 38(9): 1393-1409. JIANG Yizhang, DENG Zhaohong, WANG Shitong. Mamdani-larsen type transfer learning fuzzy system[J]. Acta automatica sinica, 2012, 38(9): 1393-1409. (  0) 0)

|

| [24] |

LESKI J M. TSK-fuzzy modeling based on ε-insensitive learning[J]. IEEE transactions on fuzzy systems, 2005, 13(2): 181-193. DOI:10.1109/TFUZZ.2004.840094 ( 0) 0)

|

| [25] |

ZHOU Hongming, HUANG Guangbin, LIN Zhiping, et al. Stacked extreme learning machines[J]. IEEE transactions on cybernetics, 2015, 45(9): 2013-2025. DOI:10.1109/TCYB.2014.2363492 ( 0) 0)

|

| [26] |

LECUN Y, BENGIO Y, HINTON G. Deep learning[J]. Nature, 2015, 521(7553): 436-444. DOI:10.1038/nature14539 ( 0) 0)

|

| [27] |

BEZDEK J C, EHRLICH R, FULL W. FCM: the fuzzy c-means clustering algorithm[J]. Computers and geosciences, 1984, 10(2/3): 191-203. ( 0) 0)

|

| [28] |

HE Qing, JIN Xin, DU Changying, et al. Clustering in extreme learning machine feature space[J]. Neurocomputing, 2014, 128: 88-95. DOI:10.1016/j.neucom.2012.12.063 ( 0) 0)

|

| [29] |

GRAVES D, PEDRYCZ W. Kernel-based fuzzy clustering and fuzzy clustering: a comparative experimental study[J]. Fuzzy sets and systems, 2010, 161(4): 522-543. DOI:10.1016/j.fss.2009.10.021 ( 0) 0)

|

2018, Vol. 13

2018, Vol. 13