2. 哈尔滨工程大学 信息与通信工程学院, 黑龙江 哈尔滨 150001

2. College of Information and Communication Engineering, Harbin Engineering University, Harbin 150001, China

脑科学飞速发展,已经成为生命科学领域最重要的前沿学科之一。研究者在脑机接口技术(brain-computer interface, BCI)和脑疾病检测等方面取得了一系列的成果,但是其提升潜力仍然很大,在此背景下如何能够有效地学习脑信号的鲁棒特征成为了研究的热点[1]。脑研究中存在许多不同的神经影像模式可供选择,主要包括脑电图(electro encephalo gram,EEG)、脑磁图(magneto encephalo gram,MEG)、磁共振成像(magnetic resonance imaging,MRI)等,其中EEG作为一种非入侵式的神经影像学方法,相对于MEG和MRI具有轻便、低成本和易用性强的特点,因此被广泛应用于脑研究中[2]。

目前,深度学习及其相关技术[3]在图像[4]、语音[5]、视频处理[6]、文本[7]等领域取得了广泛的应用。卷积神经网络(convolutional neural network, CNN)具有的强大特征提取能力,在处理图像视频等方面占据着核心的地位[8]。循环神经网络(recurrent neural network, RNN)能有效处理动态时间序列,适用于语音文本等信号[8]。对这两种网络进行组合搭建的深度学习混合模型卷积循环神经网络有效应用于视频处理的任务中[9]。尽管深度学习在以上领域取得巨大成功,但在神经影像领域的应用成果很少。Plis等[10]采用深度置信网络(deep belief networks,DBN)学习到较为深层的脑信号特征。Mirowski[11]和Cecotti等[12]采用改进的卷积神经网络,应用于癫痫检测和脑机接口等领域,相较于机器学习算法取得了更好的效果。Guler等[13]采用循环神经网络(circulatory neural network,RNN)的实现对脑电信号的时序特征的学习。Bashivan等[14]搭建卷积长短时记忆网络(C-LSTM/1D-Conv)在工作记忆脑电分类方面相比于此前的模型取得了更好的效果。Tabar等[15]采用CNN和栈式自动编码器(stac-ked auto encoder, SAE)搭建深度学习混合模型,在运动想象脑电分类中取得了优异的效果。但是这些研究并不能有效地提取更多脑电抽象和深层特征,处理脑电时间序列的前后关联时仍存在不足,因此本文研究的关键问题就是如何对深度学习模型进行改进,使其对脑电信号的空域、时域、频域特征具有强大的鲁棒性和泛化能力。本文对认知工作负载脑电状态进行研究,搭建一种深度学习混合模型,通过对不同工作负载对应的脑电状态完成分类任务对本文所提模型进行评估。

1 深度学习相关网络 1.1 卷积神经网络CNN基本结构包括卷积层和池化层,引入了卷积和采样2个过程,使预处理过程极大简化,连接全连接层,网络连接中的权值共享机制减少了网络自由参数的个数。

在卷积层的卷积核按照设定好的步长在输入图像上滑动,并且在每次滑动之后完成一次卷积操作,得到相应的特征图谱(feature map, FM),卷积层为:

| $x_j^l = f\left( {\sum\limits_{i \in {M_j}} {x_i^{l - 1}} *k_{ij}^l + b_j^l} \right) $ | (1) |

式中:f为激励函数;l为层数;Mj为输入层的感受野;k为卷积核;b为偏置。

池化层通过池化操作实现对特征图的降维,有效地减少整体网络运算量。本文的卷积神经网络将采用最大值池化,池化层为:

| $x_j^l = f\left( {\beta _j^l{\mathop{\rm down}\nolimits} \left( {x_j^{l - 1}} \right) + b_j^l} \right) $ | (2) |

式中:down(·)为池化函数,β为系数。

1.2 循环神经网络及其变体神经图灵机循环神经网络通过引入了定向循环机制,可以有效处理输入信号之间在时间上前后关联的问题。

但是RNN在处理时序问题时存在梯度爆炸和消失的问题,长短时记忆网络(long short-term memory, LSTM)和门控循环单元(gated recurrent unit, GRU)在RNN的基础上增加了存储单元,使其具备了长期记忆能力。这2种变体在语音[4]和文本[6]处理领域取得了巨大的成功,但是它们并不能有效解决长时依赖问题。在此研究背景下,Graves等[16]提出了一种新的RNN变体—神经图灵机(neural turing machine, NTM)。

图 1展示了NTM的一个高层逻辑流程图。控制器通过输入输出向量与外界交互,采用带有选择性读写操作的内存矩阵进行交互,通常将执行读写操作的网络输出称为“读写头”。每个读写头上附有的每一个权值,定义了它的读写头在各个地址的读写比重,既可以精确访问单一地址,也可以弱定位在各个内存位置。

|

Download:

|

| 图 1 神经图灵机(NTM)内部结构 Fig. 1 The internal structures of the NTM | |

在读操作中,令Mt为t时刻的N×M内存矩阵,其中M为每个地址的向量大小,N代表地址数。令Wt为t时刻读写头在N个地址的读写比重,Wt的内部元素wt(i)满足:

| $\sum\limits_i {{w_t}} (i) = 1, 0 \le {w_t}(i) \le 1, \forall i $ | (3) |

t时刻读取到的值rt可以定义为每个地址的向量Mt(i)的加权和:

| ${r_t} \leftarrow \sum\limits_i {{w_t}} (i){M_t}(i) $ | (4) |

写操作中可分为2部分:擦除和添加。令t时刻写头权重为wt,擦除向量为et,则t-1时刻的内存向量在t时刻将按式(7)进行调整:

| ${\tilde M_t}(i) \leftarrow {M_{t - 1}}(i)\left[ {1 - {w_t}(i){\mathit{\boldsymbol{e}}_t}} \right] $ | (5) |

当权重和擦除向量均为1时内存被重置为零,两者有一个为0时内存保持不变。在完成擦除操作后执行式(8)进行添加操作:

| $M_{t}(i) \leftarrow \tilde{M}_{t}(i)+w_{t}(i) a_{t} $ | (6) |

经过擦除和添加操作之后可以得到t时刻的最终内存结果。由于该网络具备的这种与内存交互高度离散的机制,因此该网络非常适用于进行长时记忆,相对于RNN以及LSTM来说,其存储信息受到的干扰非常少,能有效解决长时依赖问题。

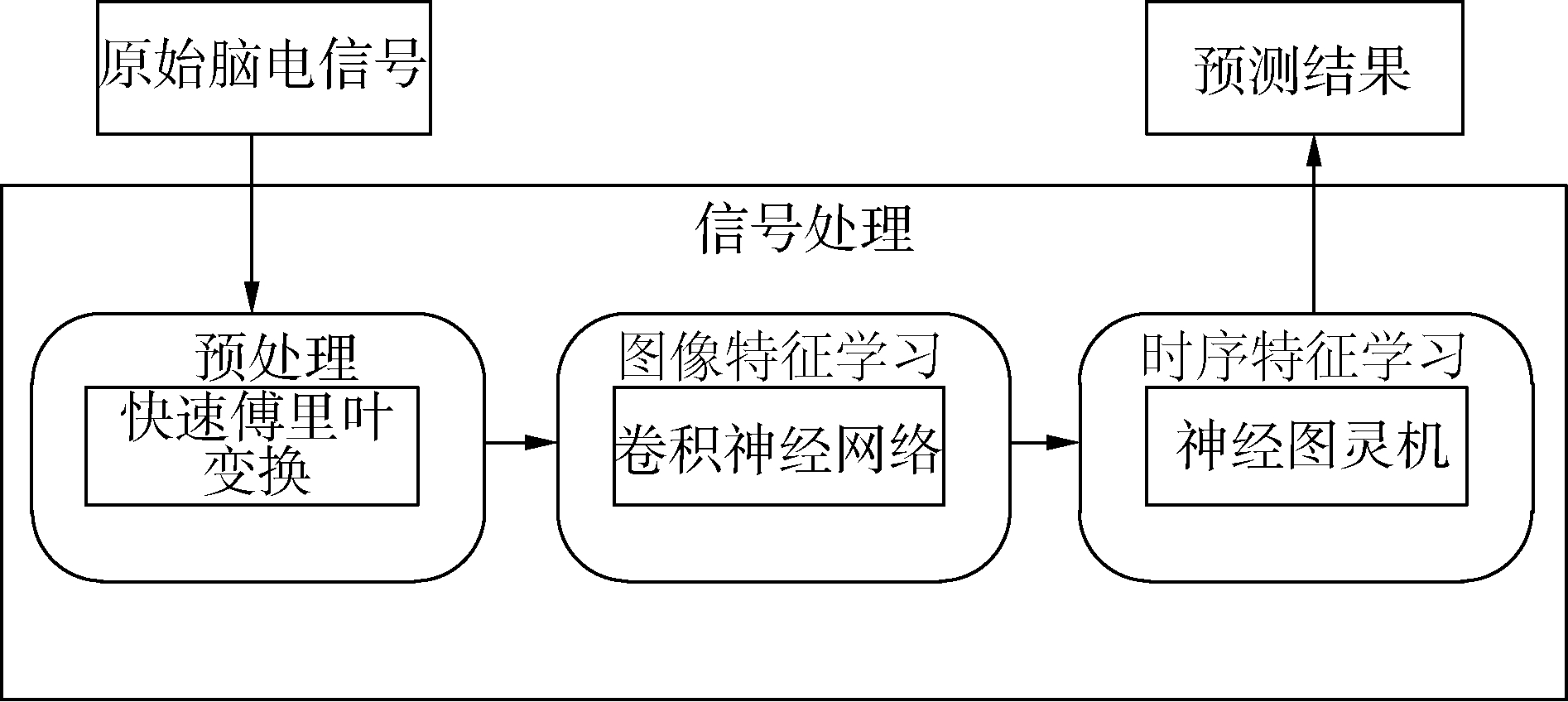

2 基于C-NTM的脑电特征学习脑电信号的处理包括预处理和特征学习2个过程。在预处理方面,本文借鉴一种改进脑电二维图像建模方法,将一维脑电信号转换为二维图谱;在特征学习方面,脑电频谱图不仅具有图像细节特征,而且各帧之间具有前后关联的时序特征,本文所提出的改进的深度学习混合模型由改进的CNN和RNN变体组合搭建而成,其中改进的CNN学习图像细节特征,并采用一种改进RNN变体神经图灵机NTM对各帧图像之间的前后时序特征进行分析处理,从而实现对脑电信号的空域、时域、频域特征的整体学习,根据该研究思路所实现的多通道脑电信号处理过程如图 2所示。

|

Download:

|

| 图 2 整体研究框架 Fig. 2 The framework of overall research | |

脑电信号主要由多通道的时间序列构成,针对原始脑电进行预处理的标准方法是将所有的通道脑电频谱测量值合成对应的特征向量,但是这种方法忽略掉了脑电采集过程中的各电极通道之间的空间关系和数据内在的时频关系。

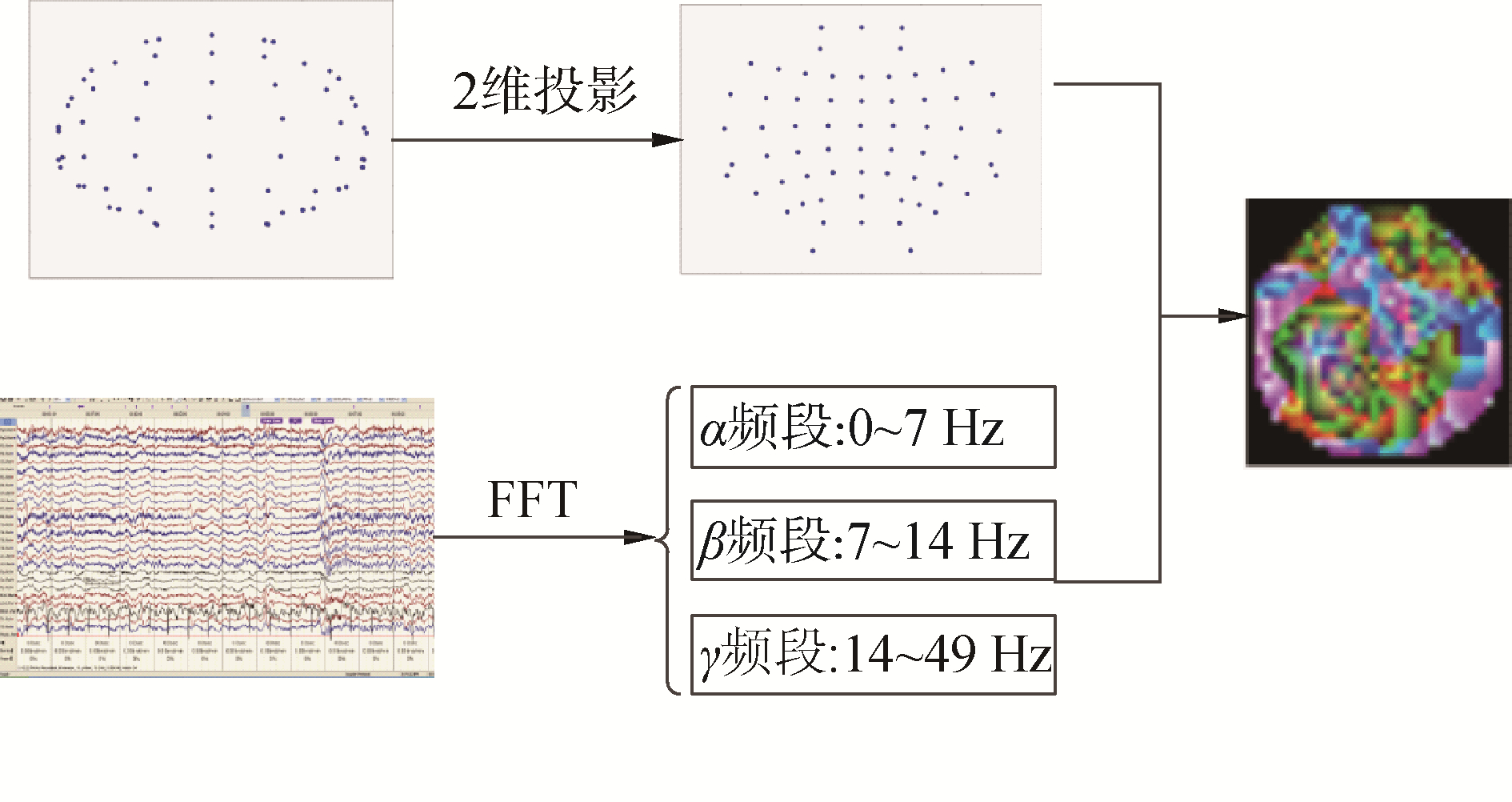

为解决这一问题,本文采用一种改进的脑电预处理方法[14]。首先,为了有效解决脑信号的空间关系问题,通过结合测绘工程中等距方位投影的理论,将三维的电极通道位置坐标转换到二维平面,使映射后的各通道能够保持之前三维空间中的距离;然后,采用快速傅里叶变换(fast Fourier transform, FFT)将相应的多通道脑电时序信号转换为对应频域的频谱图;最后,通过生成连续帧时间窗口的频谱图表征脑活动过程中的时序关系,每张图像具有3个颜色通道,尺寸大小是32×32,预处理过程如图 3所示。

|

Download:

|

| 图 3 预处理过程 Fig. 3 The process of pretreatment | |

Bashivan等[14]设计提出的C-LSTM/1D-Conv网络结构在提取脑电频谱图二维特征和处理脑电前后时序特征时依然能力不足,因此本文提出一种改进的混合深度学习模型C-NTM,在设计中采用改进的CNN网络用以实现对脑电频谱图的空间和频域细节特征的处理,对于经过CNN网络提取得到的空间频谱特征,将其输入到一种改进的RNN模型NTM中,学习其中不同时间窗口对应空间频谱特征之间的时序关联信息。

本文采用的CNN结构参照ImageNet分类挑战赛中提出的VGG网络[17]设计。这种网络结构具有很强的可扩展性,它内部的卷积层为堆栈式分布,其优势在于通过每个堆栈网络中的多个卷积层在高维上实现了有效的局部感知能力,同时也极大地减少了所需的参数。本文提出一种改进的VGG8网络架构,其参数设置如表 1所示。

| 表 1 VGG网络参数设置 Table 1 VGG Configurations |

本文中的CNN网络采用了ReLU激活函数和Dropout机制。其中ReLU相对于常用的Sigmoid和Tanh,它的训练时间更短,更容易学习优化,网络具有稀疏性,可有效缓解过拟合问题。Dropout策略在训练过程中随机使一些神经元不工作,因此可以避免某些特征只在固定组合下才生效,使得网络具有更强的泛化能力,防止过拟合。

由表 1可看出,本文所采用的VGG网络所有的卷积层均采用大小为3×3的卷积核,因为本文所要处理的脑电频谱图大小只有32×32,相比于正常图像较小,采用较小的卷积核能够表达出更多的图像特征,参数数量更少,卷积步长设置为1,在经过多个堆栈式卷积层的卷积操作之后,采用一个池化层以实现降采样。该网络中的池化层采用2×2的窗口,步长为2。此外,网络的卷积层采用填充机制,使卷积前后的图像尺寸保持相同,有效的保持了边界的信息,第1层卷积层的卷积核数量设置为64,随着堆栈网络层数的加深,卷积核的数目在每更深一层时递增为原来的2倍。本文所设计的改进VGG网络结构如图 4所示。

|

Download:

|

| 图 4 本设计采用的VGG结构 Fig. 4 The structure of VGG adopted in this paper | |

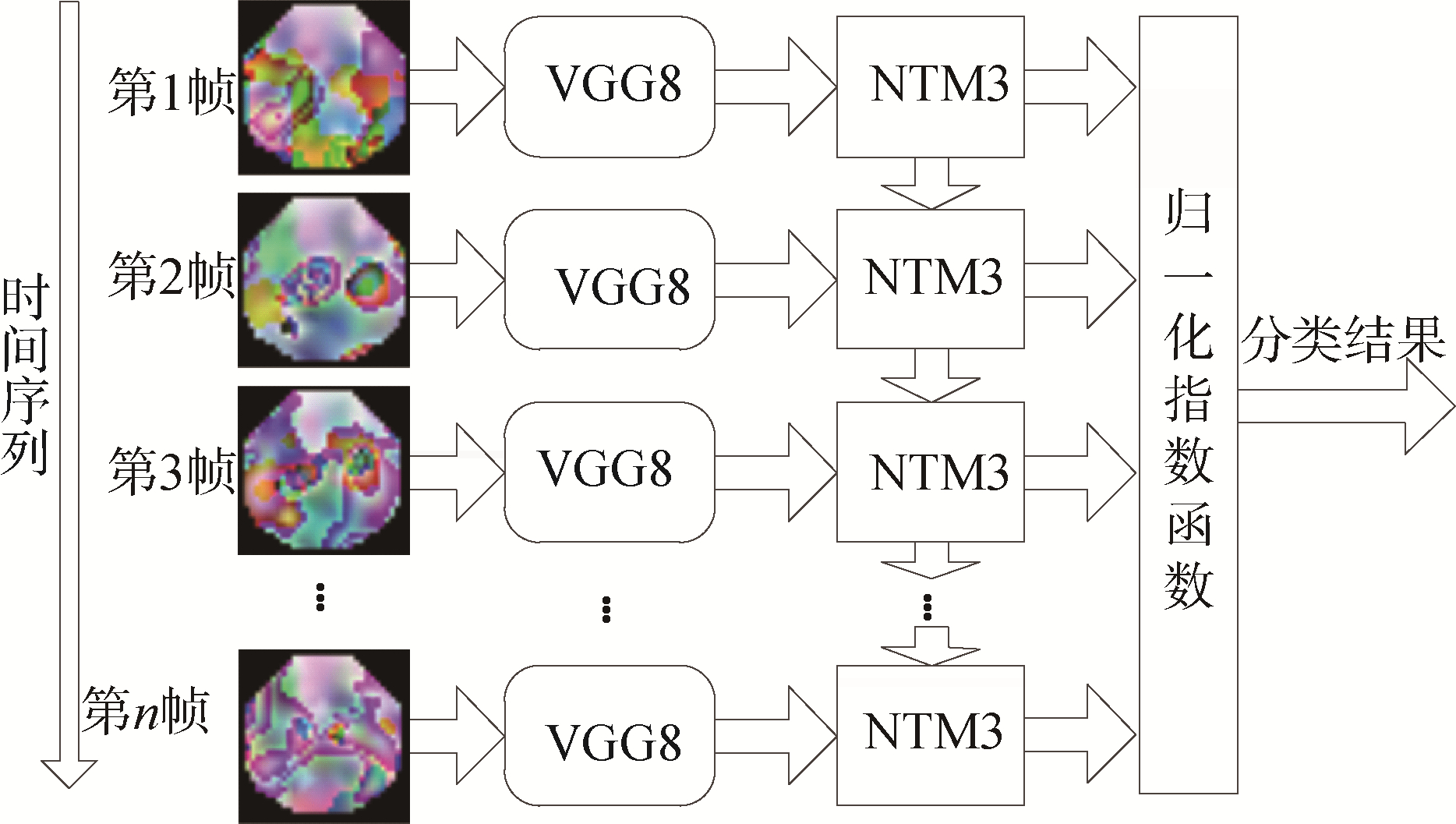

由于脑电信号具有的动态时域特性,各帧之间的脑电频谱图之间包含有时域相关性,之前在采用CNN网络完成对脑电频谱图的特征提取之后,可以得到一系列的一维特征向量,大小为1 024×1,然后再将所得特征向量输入到相应的NTM网络,以实现对脑电信号中前后时序特征的处理和学习。

在设计中采用3层的NTM3网络结构,每一层的神经元个数设置为512,经实验验证可以达到最好的分类结果。NTM网络中也引入dropout训练机制,网络的训练结果将被传递到一个全连接层,并通过归一化指数函数回归模型输出分类预测结果。

综上,本文通过联合VGG7和NTM3完成C-NTM网络的搭建,其结构如图 5所示。对网络整体进行分析,首先将预处理得到的脑电频谱图按照时间的前后顺序逐帧输入到VGG7网络,其中的每一帧原始图像都是由时间窗口为0.25 s的脑电信号转换而成,通过多层卷积池化操作得到相应的图像细节特征,之后将VGG7处理得到一维特征向量输入NTM3网络,对不同帧图像之间的时序关联信息进行处理,从而在高效提取图像细节特征的基础上实现对时序信息的处理。

|

Download:

|

| 图 5 C-NTM网络结构 Fig. 5 C-NTM structure | |

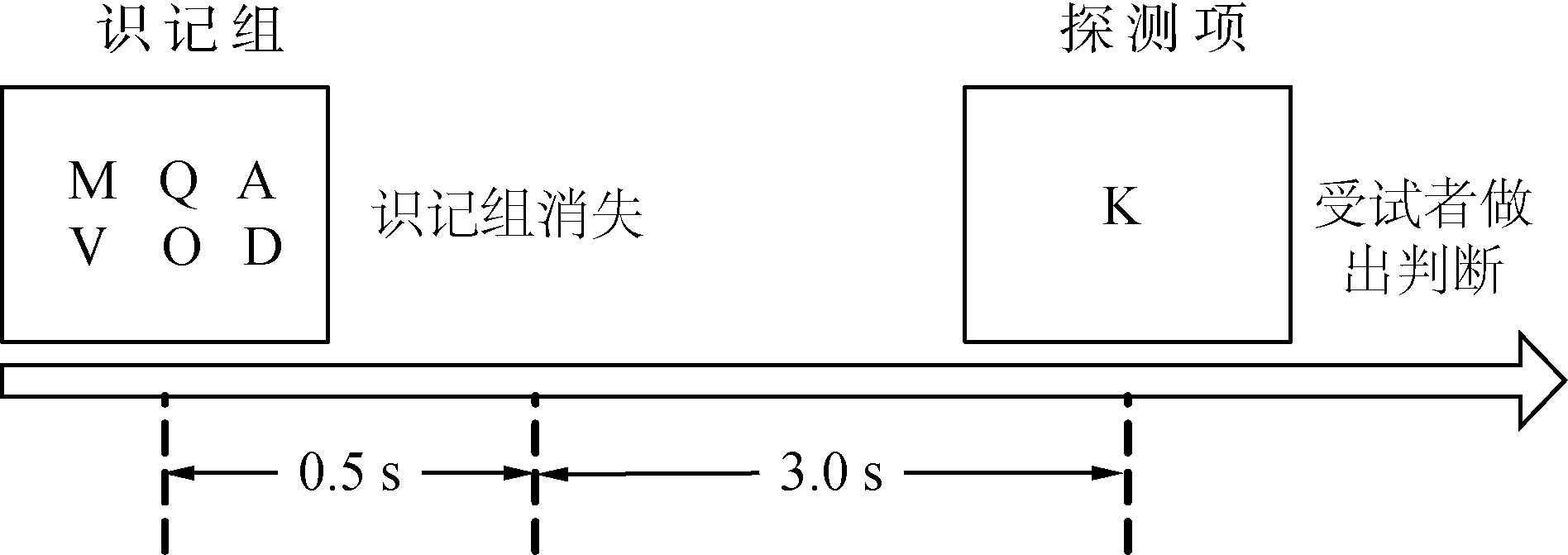

本文选取文献[14]所采用的数据集完成实验,该脑电数据集通过改进的斯滕伯格心理实验采集得到,该开源数据集于2014年采集[18],共有13名受试者(8名女性)完成该工作记忆实验。

在工作记忆实验过程中,脑电信号通过64电极的10-10导联系统完成采集,向被试者逐一呈现分别由2、4、6、8个由英文字母组成的组合(呈现时间为0.5 s),这期间要求被试者进行识记,这几个字母组合被称为“识记组”。这4种不同数量的“识记组”分别代表着4种不同的记忆难度等级。在刺激呈现3.5 s后,再呈现出一个字母(探测项),此时要求被试者对所呈现字母判断是否曾在识记组中呈现过,并作出是或否的反应,实验图解如图 6所示。4个难度等级测试将分别诱发出4种不同认知工作强度等级下的脑电活动,在受试者将信息保存在记忆中的这段时间(3.5 s),被记录下的脑电将被用来完成进一步的状态评估,评估工作将由2节所搭建的C-NTM网络通过脑电分类任务实现。

|

Download:

|

| 图 6 工作记忆实验图解 Fig. 6 Working memory experiment diagram | |

在工作记忆实验中,对每名受试者的4个不同难度等级测试将分别持续50次左右,总共将从13名受试者采集得到2 600个时长为3.5 s的脑电样本。在文献[15]的数据预处理实验中,每一张脑电频谱图是由时间窗口为0.5 s的原始脑电信号通过FFT转换而成,因此文献[14]所采用的数据集总共有18 200张图像。在本文中,鉴于所提出的C-NTM模型网络参数庞大,为了更为有效地进行网络训练和防止过拟合,本文的脑电频谱图由0.1 s时间窗口的脑电信号转换得到,经过预处理可获得91 000张脑电图像,此外选取更窄的时间窗口能够更好地体现脑电信号的时序特性,更有助于NTM网络对前后时序关联特征的学习。

为了验证本文所提出的改进模型在脑电鲁棒性特征学习中的性能,在上述数据集中完成相应的工作脑电分类任务,并同目前最好的几种深度学习方法和主流机器学习方法进行对比。本次实验中采用的硬件环境配置为Intel©CoreTMi7 6700 4.20 GHz、32 G内存、64位处理器,并采用GTX 980Ti GPU进行运算加速,操作系统为64位Ubuntu 16.04,软件开发环境为基于Theano的深度学习库Lasagne,所有的代码采用Python2.7编写完成。为了验证分类器的具体性能,将采用k折交叉验证法完成实验,选取数据集中的20%作为测试集,剩余的80%进行交叉验证,将交叉验证数据集随机分为10个子样本,将其中一个单独的子样本用作验证集,其余子样本用作训练集,重复完成10次交叉验证实验。

3.2 C-NTM网络的训练深度学习的流程分为2部分:模型训练和数据测试。该混合深度学习模型在进行特征提取之前也需要利用训练数据对模型进行训练,调整模型参数。

由于网络结构复杂,参数数量庞大,为了避免过拟合,在本文中采用预训练策略,首先采用单帧时间窗口的脑电频谱图对改进的CNN网络单独进行训练,使其达到最好的效果,然后将此时CNN网络中训练得到的参数作为初始值,采用连续帧的脑电频谱图对整体混合模型C-NTM进行训练。

在对整体网络训练的过程中,采用RMSProp优化算法进行训练,该算法相对于随机梯度下降法(stochastic gradient descent, SGD)更适合于处理非平稳目标,对于RNN及其改进网络效果很好。由于不同卷积层之间的共享权重所产生的梯度差别是巨大的,因此一个适当的学习速率非常重要。Dropout机制应用于CNN网络全连接层和NTM网络当中。整体网络的训练参数设置如下:学习速率为0.001,批尺寸大小为50,Dropout为0.5,训练代数为500代。

3.3 仿真及分析本文所提出的C-NTM模型对于脑电鲁棒特征学习能力的优劣将主要通过采用该模型对不同工作强度脑电的分类任务进行定量分析,评价指标为该分类任务的平均识别率(average precision,AP)和Kappa系数,其中Kappa系数k用于一致性检验:

| $k = \frac{{{p_{\rm{o}}} - {p_{\rm{e}}}}}{{1 - {p_{\rm{e}}}}} $ | (7) |

式中:po为平均识别率;pe为随机分类结果。

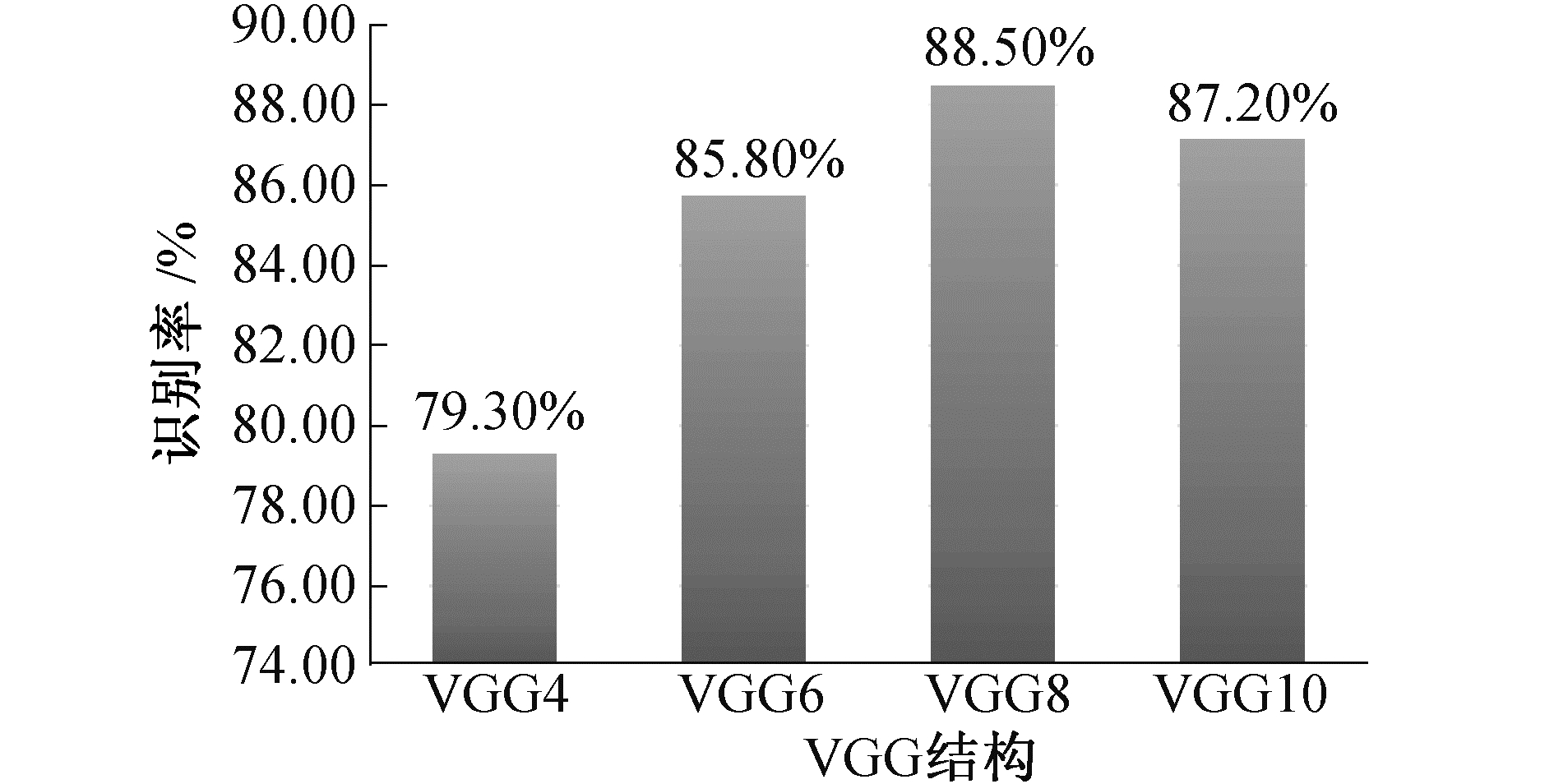

在实验的第1部分,采用平均识别率作为评价指标,对本文所提出C-NTM中的VGG模型进行验证。采用4种结构的VGG网络进行对比验证,对比网络参数配置如表 2所示,其中卷积层的参数表示为Conv(卷积核大小)-(卷积核数目)。针对4种VGG结构分别采用工作记忆脑电数据集进行实验验证,结果如图 7所示,纵坐标代表平均识别率。

| 表 2 不同VGG结构参数设置 Table 2 Configurations of different VGG structures |

|

Download:

|

| 图 7 不同VGG结构平均识别率对比 Fig. 7 Comparison AR of different VGG structures | |

从图 7可以看出,VGG8相比于其他几种VGG网络取得了最好的结果,表明较深的网络层数有利于提取更为精细的图像局部细节特征,相应的分类效果也会更好,但是由于输入图像(大小32×32)尺寸的限制,随着网络层数的进一步加深,提取的过于局部的图像细节特征开始不利于整体特征学习。综上,本文采用VGG8组成混合网络中的CNN模块。

在实验的第2部分,为了验证改进的有效性,采用平均识别率作为评价指标,将所提出的模型C-NTM分别同CNN、NTM以及支持向量机(support vector machine, SVM)进行对比,在相同的脑电数据集上完成实验。对比实验组中的CNN网络采用表 1所示的VGG结构和参数配置,NTM网络采用和C-NTM网络中的NTM结构相同的结构配置,在分类任务中的平均识别率如表 3所示。

| 表 3 CNN、NTM、C-NTM、SVM分类识别率和标准差 Table 3 Classification accuracy and standard deviation for CNN, NTM, C-NTM and SVM |

从表 3可以看出,首先,C-NTM平均识别率优于CNN和NTM,表明混合模型相对于单一深度学习模型能更有效地学习脑电特征;其次,深度学习模型的识别率要优于SVM,表明深度学习在获得大量的训练数据的情况下,其表现能力相对于主流的机器学习算法更强,这是由于深度学习模型的多层神经网络可以提取到更为深层的特征;最后,对同一受试者内部或是不同受试者之间,C-NTM模型的识别率标准差都要优于其他的几种模型,并且该模型在13名受试者的11名中的分类识别率都最好,表明C-NTM学习的脑电特征具有更好的鲁棒性。

在实验的第3部分,为了验证改进的先进性,分别采用平均识别率和Kappa系数作为评价指标,将C-NTM同目前在该数据集上表现效果最好的C-LSTM/1D-Conv网络[14]进行对比,此外分别采用C-SAE[15]、C-RNN、C-GRU这3种改进型深度学习混合模型在该数据集上完成相应的对比实验,其中C-SAE网络采用文献[15]的结构和参数配置,C-RNN和C-GRU为本文设计的对比混合模型,其中的CNN网络采用表 1所示的VGG结构和网络配置,RNN和GRU网络采用和本文所提出的C-NTM网络中的NTM结构相同的层数和结构配置。在工作记忆试验中所有受试者上的整体平均识别率实验结果如表 4所示,在工作记忆试验分类任务中各个对比模型的Kappa系数的实验结果如表 5所示。

| 表 4 整体分类识别率和标准差对比 Table 4 The comparison of Classification accuracy and standard deviation |

| 表 5 工作记忆试验分类任务Kappa系数和标准差 Table 5 Classification accuracy and standard deviation of work memory test |

实验结果表明,本文所提出的C-NTM模型的平均识别率和Kappa系数都要好于目前在该数据集上表现效果最好的C-LSTM/1D-Conv网络结构和3种改进型深度学习混合模型。C-NTM网络在13名受试者的10名中的Kappa系数取得了最好效果,在12名受试者上取得的效果要优于C-LSTM/1D-Conv网络结构,表明C-NTM网络相对于其他几种改进模型在分类任务中能够表现出很高的一致性。在k折交叉验证所获得的Kappa系数标准差和不同受试者之间的Kappa系数标准差这2个指标上,C-NTM模型的表现效果都要明显优于C-LSTM/1D-Conv网络结构和其他3种改进模型,表明在针对不同的受试者之间和同一受试者本身不同状态脑电的差异性十分显著的状况下,本文所提出的改进模型都能获得具有良好区别多、代表性的特征,证明C-NTM网络具有更好的鲁棒性。

分析本文所提出的C-NTM模型,其特征学习能力更强的原因在于:1)相对于C-LSTM/1D-Conv网络,首先本文在预处理过程中缩小了时间窗口,从而获得了更多帧的脑电图像,数据量更充足,缩小时间窗口使每次脑电试验样本的时序性更强,有利于学习时序特征;其次本文在所提出模型基础上,对VGG进行网络结构和参数优化,相较原始VGG网络在处理特定脑电频谱图时具有更强的抽象特征提取能力,采用NTM代替LSTM网络能够实现更为精准的时序特征学习能力,因此本文改进模型表现要优于C-LSTM/1D-Conv网络结构; 2)本文所提出的模型相对于其他3组深度学习对比模型来说,联合了VGG和NTM 2种模型,既具备VGG网络提取二维细节特征的能力,又具备NTM处理长时依赖问题的能力,更能胜任脑电处理的任务。

4 结论1) 该网络在C-LSTM/1D-Conv的基础上,由CNN和NTM搭建而成,对图像特征和时序特征具有强大的学习能力,相较于其他改进的深度学习模型表现出更为强大的优势。

2) 在C-NTM网络模型中,对VGG结构进行优化,极大提高了模型对于脑电频谱图的局部特征的提取能力,采用改进的循环神经网络NTM有效解决了长时依赖问题,能够更为有效地处理脑电时序信号。

3) 从仿真结果可得,针对不同的受试者之间和同一受试者本身不同状态脑电差异性显著的问题,本文所搭建的C-NTM网络相较于目前效果最好的模型在脑电分类任务中具有更高的准确率和Kappa系数,展现出了对脑电信号的空域、时域、频域特征的强大的鲁棒性和泛化能力。

| [1] |

STOBER S, STERNIN A, OWEN A M, et al. Deep feature learning for EEG recordings[J]. arXiv: 1511.04306, 2015.

(  0) 0)

|

| [2] |

戴若梦.基于深度学习的运动想象脑电分类[D].北京: 北京理工大学, 2015. DAI Ruomeng. The motor imagery EEG classification based on deep learning[D]. Beijing: Beijing Institute of Technology, 2015. (  0) 0)

|

| [3] |

胡越, 罗东阳, 花奎, 等. 关于深度学习的综述与讨论[J]. 智能系统学报, 2019, 14(01): 1-19. HU Yue, LUO Dongyang, HUA Kui, et al. Overview on deep learning[J]. CAAI Transactions on Intelligent Systems, 2019, 14(01): 1-19. (  0) 0)

|

| [4] |

KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[C]//Proceedings of the 25th International Conference on Neural Information Processing Systems. Lake Tahoe, Nevada: ACM, 2012: 1097-1105.

(  0) 0)

|

| [5] |

GRAVES A, MOHAMED A R, HINTON G. Speech recognition with deep recurrent neural networks[C]//Proceedings of 2013 IEEE International Conference on Acoustics, Speech and Signal Processing. Vancouver, BC, Canada: IEEE, 2013: 6645-6649.

(  0) 0)

|

| [6] |

KARPATHY A, TODERICI G, SHETTY S, et al. Large-scale video classification with convolutional neural networks[C]//Proceedings of 2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus, OH, USA: IEEE, 2014: 1725-1732.

(  0) 0)

|

| [7] |

HERMANN K M, KOČISKÝ T, GREFENSTETTE E, et al. Teaching machines to read and comprehend[C]//Proceedings of the 28th International Conference on Neural Information Processing Systems. Montreal, Canada: ACM, 2015: 1693-1701.

(  0) 0)

|

| [8] |

莫凌飞, 蒋红亮, 李煊鹏. 基于深度学习的视频预测研究综述[J]. 智能系统学报, 2018, 13(01): 85-96. MO Lingfei, JIANG Hongliang, LI Xuanpeng. Review of deep learning-based video prediction[J]. CAAI Transactions on Intelligent Systems, 2018, 13(01): 85-96. (  0) 0)

|

| [9] |

NG J Y H, HAUSKNECHT M, VIJAYANARASIMHAN S, et al. Beyond short snippets: deep networks for video classification[C]//Proceedings of 2015 IEEE Conference on Computer Vision and Pattern Recognition. Boston, MA, USA: IEEE, 2015: 4694-4702.

(  0) 0)

|

| [10] |

PLIS S M, HJELM D R, SALAKHUTDINOV R, et al. Deep learning for neuroimaging:a validation study[J]. Frontiers in neuroscience, 2014, 8: 229. (  0) 0)

|

| [11] |

MIROWSKI P, MADHAVAN D, LECUN Y, et al. Classification of patterns of EEG synchronization for seizure prediction[J]. Clinical neurophysiology, 2009, 120(11): 1927-1940. DOI:10.1016/j.clinph.2009.09.002 (  0) 0)

|

| [12] |

CECOTTI H, GRASER A. Convolutional neural networks for P300 detection with application to brain-computer interfaces[J]. IEEE transactions on pattern analysis and machine intelligence, 2011, 33(3): 433-445. DOI:10.1109/TPAMI.2010.125 (  0) 0)

|

| [13] |

GÜLER N F, ÜBEYLI E D, GÜLER Í. Recurrent neural networks employing Lyapunov exponents for EEG signals classification[J]. Expert systems with applications, 2005, 29(3): 506-514. DOI:10.1016/j.eswa.2005.04.011 (  0) 0)

|

| [14] |

BASHIVAN P, RISH I, YEASIN M, et al. Learning representations from EEG with deep recurrent-convolutional neural networks[J]. arXiv: 1511.06448, 2016.

(  0) 0)

|

| [15] |

TABAR Y R, HALICI U. A novel deep learning approach for classification of EEG motor imagery signals[J]. Journal of neural engineering, 2017, 14(1): 016003. DOI:10.1088/1741-2560/14/1/016003 (  0) 0)

|

| [16] |

GRAVES A, WAYNE G, DANIHELKA I. Neural Turing machines[J]. arXiv: 1410.5401, 2014.

(  0) 0)

|

| [17] |

SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[J]. arXiv: 1409.1556, 2015.

(  0) 0)

|

| [18] |

BASHIVAN P, BIDELMAN G M, YEASIN M. Spectrotemporal dynamics of the EEG during working memory encoding and maintenance predicts individual behavioral capacity[J]. European journal of neuroscience, 2014, 40(12): 3774-3784. DOI:10.1111/ejn.12749 (  0) 0)

|

2019, Vol. 40

2019, Vol. 40