分辨率是遥感图像的重要特征,高分辨率的遥感图像对后续目标识别的精度有重要影响。受到客观条件和硬件设备的限制,实际获取的遥感图像分辨率受到一定的影响。图像超分辨重建技术基于信号处理和模式识别理论,可以对低分辨率图像进行处理以获取更高分辨率的图像。

图像超分辨重建方法按原理大致可分为3类:基于重建模型的方法、基于插值的方法和基于学习的方法。基于重建模型的方法[1-3]多用于多帧超分辨,多帧低分辨率图像间的运动估计误差会对超分辨效果产生较大影响。基于插值的方法[4-6]可以快速地对单帧图像进行超分辨,缺点是不易加入合适的先验信息。为克服以上缺点,机器学习理论广泛引入到超分辨领域,使基于学习的超分辨方法取得了巨大的进展。该类方法基于神经网络或者冗余字典进行超分辨重建。基于神经网络的学习方法需要按照经验设定较多参数,训练需要较大的运算量,并且存在泛化能力问题[7-9]。基于冗余字典的方法以稀疏表示和压缩感知作为理论基础,为求解图像超分辨重建这类典型的欠定问题提供了新的思路和方法,并且取得了较好的超分辨效果。文献[10-12]通过学习大量图像建立冗余字典,然后稀疏求解得到超分辨重建图像。由于建立的是单一字典,要求训练图像与要超分辨的图像具有一定的纹理相关性和算法的泛化能力。文献[13-14]将训练图像限定在要超分辨的图像本身,虽然一定程度上克服了上述问题,但字典是一次性的,并且低分辨率图像的纹理状况会对超分辨效果有一定的影响,比如过度模糊图像等。

由于图像纹理的复杂多样性,上述利用单一字典表示具有很大局限性。基于多字典学习将会改进超分辨的性能。文献[15-16]对学习的字典对进行聚类,分解成多个子字典,聚类的性能以及低分辨率块搜索所属类别的误差都将影响超分辨的效果。文献[17]按照图像块梯度大小将图像块分类,每类分别建立对应字典。该方法只根据图像块纹理复杂性进行分类而没有考虑图像纹理的方向性。文献[18]对每个图像块提取多个纹理,形成不同的子字典;超分辨重建阶段对每个低分辨率图像块都进行多次稀疏求解,提取纹理数目较多时计算量较大。由于小波变换可以将图像分解为多个频带且具有多分辨特性。但图像在小波域一般只能分解成4个频带,具有一定的局限性和改进空间[19]。Contourlet变换是小波变换在二维图像的推广,相比小波具有更多良好的性能,在Contourlet域可以根据纹理方向建立更多的字典,取得更好的超分辨效果。

本文利用Contourlet变换将具有复杂多样的纹理遥感图像高频部分分解为多个不同的频带,对应建立多个残余字典来表示。基于压缩感知理论在不同频带分别进行稀疏求解,获得超分辨重建遥感图像。

1 压缩感知和Contourlet 变换理论基础 1.1 压缩感知假定信号

Contourlet变换是小波变换在二维图像空间中的扩展,保持了小波变换的多尺度和时频定位功能,同时具有捕捉图像多方向纹理的能力,可以更好地表示图像的二维几何结构[20]。Contourlet变换分2个阶段:子带分解和方向分解。子带分解利用Laplacian金字塔分解成多级频带。方向分解则利用方向滤波器组(the directional filter bank,DFB)将二维图像分解成整数次幂个锲形的方向频带。这2个分解阶段是相互独立的,因此,每个级别可根据需要分解成2的任意整数次幂个方向频带。

2 多尺度压缩感知超分辨重建利用单字典表达复杂纹理图像有很大的局限性,利用多字典表达图像将会获得更好的效果。Contourlet变换可以将图像分解成多个不同纹理方向的频带,并且具有多分辨特性。本文将利用多级Contourlet变换建立多字典,基于压缩感知理论求解面向遥感图像的超分辨重建问题。

2.1 字典学习字典学习即冗余字典的构建。假设

| ${{{X}}_b} = {{D}}{{{\alpha }}_b}$ |

式中:

核奇异值分解(kernel singular value decomposition, K-SVD)算法是一种有效的字典学习方法[21]。该方法借鉴K均值聚类的思想,通过求解式(1)所示的最优化问题同时获得冗余字典

| $ \mathop {\min }\limits_{{{D}},{{{\alpha }}_b}} \left\{ {\left\| {{{{X}}_b} - {{D}}{{{\alpha }}_b}} \right\|_2^2} \right\},\;{\left\| {{{{\alpha }}_b}} \right\|_0} \leqslant {T_0} $ | (1) |

式中

在Contourlet域,假定将图像分解为

| $ \mathop {\min }\limits_{{{{D}}_k},{{{\alpha }}_{b,k}}} \left\{ {\left\| {{{{X}}_{b,k}} - {{{D}}_k}{{{\alpha }}_{b,k}}} \right\|_2^2} \right\},\;{\left\| {{{{\alpha }}_{b,k}}} \right\|_0} \leqslant {T_0} $ | (2) |

式中:

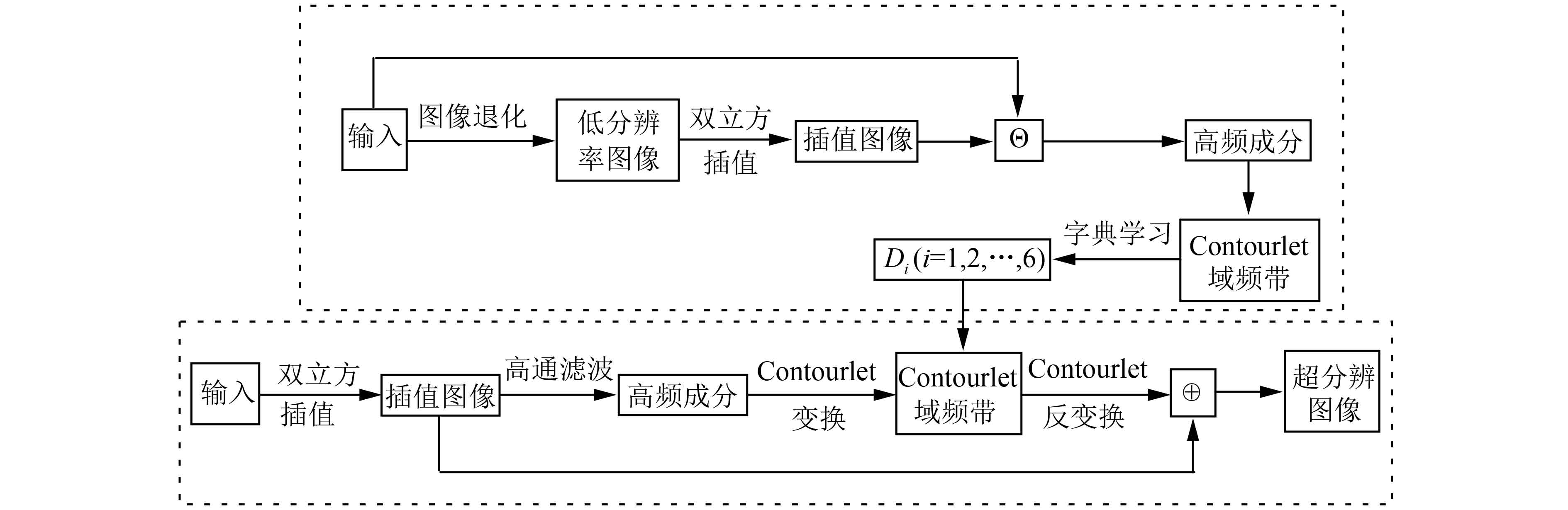

考虑到超分辨主要恢复图像的高频成分,只对高频成分进行分解并学习。字典学习与超分辨重建如图1所示。

|

Download:

|

| 图 1 字典学习与超分辨重建示意 | |

字典学习算法步骤如下:

输入 高分辨率图像(high resolution image, HRI)

输出 方向频带的字典

1) 按照退化模型将输入高分辨率图像

2) 对

3) 将

4) 对

5)在Contourlet域各方向频带利用K-SVD算法分别进行字典训练,获得多个方向频带的字典

利用在Contourlet域建立的

| $ \mathop {\min }\limits_{{{{\alpha }}_{_{b,k}}}} {\left\| {{{{\alpha }}_{b,k}}} \right\|_0},\;\left\| {{{{Y}}_{b,k}} - {{{D}}_k}{{{\alpha }}_{b,k}}} \right\|_2^2 \leqslant \varepsilon $ | (3) |

式中:

在稀疏求解算法中,正交匹配追踪(orthogonal matching pursuit, OMP)算法是对匹配追踪(matching pursuits, MP)算法的改进,在分解的每一步对所选择的全部原子进行正交化处理,收敛速度更快[22-23]。本文利用OMP算法进行求解。超分辨重建算法步骤如下:

输入 低分辨率图像

输出 超分辨重建图像

1) 对输入低分辨率图像

2) 对插值图像

3) 对高频分量

4) 利用训练的多字典,对Contourlet域各方向频带进行稀疏编码,求取稀疏解;

5) 将步骤4)学习所得的各频带稀疏解执行Contourlet反变换,得到重建的高频分量

6) 将

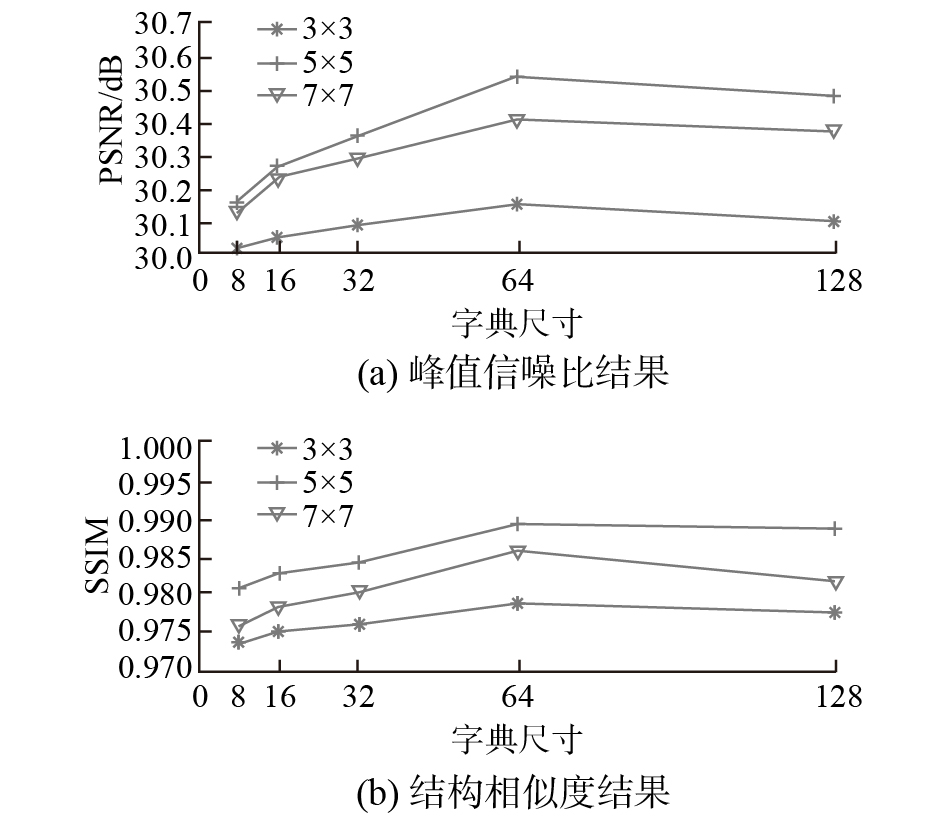

冗余字典中的原子数目和原子的尺寸是2个重要的参数,对超分辨重建的效果有一定的影响。采用实验的方法确定这2个参数。首先选取10帧1024×1024的遥感图像作为训练图像,建立Contourlet域冗余字典。单个字典的原子数目(字典尺寸)分别设置为8、16、32、64和128,而单个原子的尺寸即图像块大小分别设置为3×3、5×5和7×7,共建立15组字典。每组包含6个子字典。选取另外20帧256×256的遥感图像退化成低分辨率图像,对退化图像分别基于上述15组字典执行本文算法。基于每组冗余字典对算法结果图像求PSNR和SSIM值,并对20组参数求平均值。PSNR和SSIM的平均值如图2所示。

|

Download:

|

| 图 2 残余字典参数对结果的影响 | |

不考虑原子尺寸,PSNR和SSIM参数平均值都在字典尺寸为64处达到最大值。在128处反而有轻微的下降,这是由于字典尺寸过度冗余会导致过拟合以及测量矩阵和冗余字典的相干性增强,影响超分辨重建效果。因此,冗余字典的合适尺寸选取为64。另一方面,不考虑字典尺寸,PSNR和SSIM参数平均值都在原子大小为5×5处达到最大值。因此,图像块的合适尺寸应选取为5×5。

3.2 与其他方法对比分析为证明本文算法有效性,基于建立的原子大小为5×5,数目为64的冗余字典进行超分辨重建实验,与双立方插值、文献[10]的单字典算法和文献[17]的多字典算法进行比较。选取训练图像之外的3组高分辨率遥感图像进行实验。首先对高分辨率原始遥感图像进行高斯模糊和1/2倍行列下采样,得到低分辨率图像;对低分辨率图像分别执行相应算法,得到超分辨结果图像。实验结果如图3所示,而图4给出了图3的局部纹理区域的放大结果。

|

Download:

|

| 图 3 不同超分辨方法实验结果比较 | |

|

Download:

|

| 图 4 局部放大图像对比 | |

可以看出,双立方插值图像比较模糊,分辨率较低。文献[10]单字典算法图像分辨率有了明显提高,而文献[17]多字典算法图像分辨率又高于单字典算法。本文算法结果图像取得了更好的超分辨效果,图像更加清晰,一些分辨不清的模糊纹理能够清楚地分辨出来。进一步进行定量分析,分别计算了峰值信噪比PSNR和结构相似度SSIM 2个评估参数,如表1、表2所示。相比文献[10]算法和文献[17]算法,本文算法的PSNR平均值分别提高6 dB、3.4 dB,SSIM平均值分别提高0.05、0.02。

|

|

表 1 实验结果的PSNR比较 |

|

|

表 2 实验结果的SSIM比较 |

1)针对传统冗余字典表达能力有限问题,本文提出了一种基于Contourlet变换和压缩感知理论的多残余字典遥感图像超分辨重建方法。该方法将多尺度变换与压缩感知相结合,并利用残余字典代替冗余字典,在各高频子带建立对应的多个残余字典,圆满解决了遥感图像复杂纹理的训练和描述问题。

2)为获得最好的超分辨效果,通过实验验证了子残余字典和原子的最佳尺寸分别为64和5×5。

3)实验结果表明,与其他相关超分辨方法相比,本文方法取得了良好的超分辨效果,视觉质量明显改善,PSNR和SSIM都有明显提高。进一步考虑图像块之间的相关性以及更深入的理论研究是下一步的研究方向。

| [1] |

SHEN Huanfeng, LI Peng, YUE Linwei, et al. Adaptive norm selection for regularized image restoration and super-resolution[J]. IEEE transactions on cybernetics, 2016, 46(6): 1388-1399. DOI:10.1109/TCYB.2015.2446755 ( 0) 0)

|

| [2] |

ZHANG Tinghua, GAO Kun, NI Guoqiang, et al. Spatio-temporal super-resolution for multi-videos based on belief propagation[J]. Signal processing: image communication, 2018, 68: 1-12. DOI:10.1016/j.image.2018.07.002 ( 0) 0)

|

| [3] |

AMIRI M, AHMADYFARD A, ABOLGHASEMI V. A fast video super resolution for facial image[J]. Signal processing: image communication, 2019, 70: 259-270. DOI:10.1016/j.image.2018.10.008 ( 0) 0)

|

| [4] |

ZHOU Fei, YANG Wenming, LIAO Qingmin. Interpolation-based image super-resolution using multi-surface fitting[J]. IEEE transactions on image processing, 2012, 21(7): 3312-3318. DOI:10.1109/TIP.2012.2189576 ( 0) 0)

|

| [5] |

RASTI P, ORLOVA O, TAMBERG G, et al. Improved interpolation kernels for super resolution algorithms[C]//International Conference on Image Processing Theory Tools and Applications (IPTA), Montreal, Canada, 2017: 1–6.

( 0) 0)

|

| [6] |

WEI Deyun. Image super-resolution reconstruction using the high-order derivative interpolation associated with fractional filter functions[J]. IET signal processing, 2016, 10(9): 1052-1061. DOI:10.1049/iet-spr.2015.0444 ( 0) 0)

|

| [7] |

ZHANG Zhendong, WANG Xinran, JUNG C. DCSR: dilated convolutions for single image super-resolution[J]. IEEE transactions on image processing, 2019, 28(4): 1625-1635. DOI:10.1109/TIP.2018.2877483 ( 0) 0)

|

| [8] |

DONG Chao, CHEN C L, HE Kaiming, et al. Image uper-resolution using deep convolutional networks[J]. IEEE transactions on pattern analysis and machine intelligence, 2016, 38(2): 295-307. DOI:10.1109/TPAMI.2015.2439281 ( 0) 0)

|

| [9] |

LI Yue, LIU Dong, LI Houqiang, et al. Learning a convolutional neural network for image compact-resolution[J]. IEEE transactions on image processing, 2019, 28(3): 1092-1107. DOI:10.1109/TIP.2018.2872876 ( 0) 0)

|

| [10] |

SUN Yicheng, GU Guohua, SUI Xiubao. Single image super-resolution using compressive sensing with a redundant dictionary[J]. IEEE photonics journal, 2015, 7(2): 1-11. ( 0) 0)

|

| [11] |

YANG Shuyuan, SUN Fenghua, WANG Min, et al. Novel super resolution restoration of remote sensing images based on compressive sensing and example patches-aided dictionary learning[C]//2011 International Workshop on Multi-Platform/Multi-Sensor Remote Sensing and Mapping (M2RSM). Xiamen, China, 2011: 1–6.

( 0) 0)

|

| [12] |

魏士俨, 顾征, 马友青, 等. 基于压缩感知的月球探测器着陆图像超分辨重建[J]. 红外与毫米波学报, 2013, 32(6): 555-558. ( 0) 0)

|

| [13] |

潘宗序, 禹晶, 肖创柏, 等. 基于字典学习与结构自相似性的码本映射超分辨率算法[J]. 计算机辅助设计与图形学学报, 2015, 27(6): 1032-1038. ( 0) 0)

|

| [14] |

CHEN Honggang, HE Xiaohai, QING Linbo, et al. Single image super-resolution via adaptive transform-based nonlocal self-similarity modeling and learning-based gradient regularization[J]. IEEE transactions on multimedia, 2017, 19(8): 1702-1717. DOI:10.1109/TMM.2017.2688920 ( 0) 0)

|

| [15] |

ZHANG Kaibing, TAO Dacheng, GAO Xinbo, et al. Learning multiple linear mappings for efficient single image super-resolution[J]. IEEE transactions on image processing, 2015, 24(3): 846-861. DOI:10.1109/TIP.2015.2389629 ( 0) 0)

|

| [16] |

LU Xuan, WANG Dingwen, SHI Wenxuan, et al. Group-based single image super-resolution with online dictionary learning[J]. EURASIP journal on advances in signal processing, 2016(1): 84. ( 0) 0)

|

| [17] |

YEGANLI F, NAZZAL M, OZKARAMANLI H, et al. Image super-resolution via sparse representation over multiple learned dictionaries based on edge sharpness and gradient phase angle[J]. Signal, image and video processing, 2015, 10(3): 535-542. ( 0) 0)

|

| [18] |

WU Wei, YANG Xiaomin, LIU Kai, et al. A new framework for remote sensing image super-resolution: sparse representation-based method by processing dictionaries with multi-type features[J]. Journal of systems architecture, 2016, 64: 63. DOI:10.1016/j.sysarc.2015.11.005 ( 0) 0)

|

| [19] |

SURYANARAYANA G, DHULI R. Image resolution enhancement using wavelet domain transformation and sparse signal representation[C]//The 2nd International Conference on Intelligent Computing, Communication and Convergence. Cairo, Egypt, 2016: 311–316.

( 0) 0)

|

| [20] |

MINH N D, MARTIN V. The contourlet transform: an efficient directional multiresolution image representation[J]. IEEE transactions on image processing, 2005, 14(12): 2091-2106. DOI:10.1109/TIP.2005.859376 ( 0) 0)

|

| [21] |

AHARON M, ELAD M, BRUCKTEIN A. K-SVD: An algorithm for designing of overcomplete dictionaries for sparse representation[J]. IEEE transactions on signal process, 2006, 54(11): 4311-4322. DOI:10.1109/TSP.2006.881199 ( 0) 0)

|

| [22] |

郭凌飞; 张林波. 通过CWLS-DL优化St-OMP算法的盲信号重构[J]. 应用科技, 2019, 46(3): 40-45,50. ( 0) 0)

|

| [23] |

ZHANG Saiwen, WU Jingjing, CHEN Danni, et al. Fast frequency-domain compressed sensing analysis for high-density super-resolution imaging using orthogonal matching pursuit[J]. IEEE photonics journal, 2019, 11(1): 1-8. ( 0) 0)

|

2020, Vol. 47

2020, Vol. 47