2. 同济大学 电子与信息工程学院,上海 201804;

3. 清华大学 计算机科学与技术系 ,北京 100084

2. School of Electronics and Information Engineering, Tongji University, Shanghai 201804, China;

3. Department of Computer Science and Technology, Tsinghua University, Beijing 100084, China

移动机器人行驶在复杂的环境中,如:火星和月球表面、火灾和战争现场等,在这些危险地带或者是遥远的不适合远程控制的时候[1-2],机器人若能够拥有像人类一样不仅和地面进行振动式的接触,而且能够感知到并且有目的选择运动的方式,通过探索性的过程,自主增强感知正在行驶或者即将行驶在正发生着变化的地面类型上,可靠、高效的地貌感知系统能够准确地让移动机器人探索出地面的几何特性和非几何特性[3],这很大程度上决定着移动机器人的自主移动性,甚至是后期的任务是否圆满完成。

当前,许多专家学者已经对多种传感器的地形分类做了研究,研究最多的是基于视觉[4-8]、雷达[9-10]、触觉[11]以及多传感器融合[12-15]的地貌分类方法,视觉最容易受到外部光线的干扰,雷达也会因为天气的影响而失效,小型移动机器人会受到自身体积和空间的限制,搭载太多的设备会存在困难;最早在2002年麻省理工学院的Iagnemma等[16-18]提出利用振动信号的特征对地面进行分类,这相比于传统的基于激光雷达或者是视觉技术镜像的感官方法能够有效地避免几何危害[19],但是很大程度上易受到光照和地面遮盖物的干扰,严重影响到对非几何危害的识别能力[20-22]。尽管基于振动的方法能够感知地面承载层的信息,但一直以来机器人仅仅被动地收集振动传感器反馈得到的信号作为地形识别的依据,再对获取的大量信号采取适当的方法进行特征表达,常用到的是时域分析法和频域分析法[23-24]提取对应地貌特征信息,尽管其中的一些方法可以获得准确的地形环境特征,但是大量的数据处理起来很繁重,需要的训练样本集庞大,此外,移动机器人以不同速度或者不同的运动方式行驶时,对所得到的分类影响也不小[25-26],但是这也反应出移动机器人对于某种地貌下的低水平和高水平识别的运动方式;随着人工智能的不断发展,传统的机器学习分类方法[28]、卷积神经网络(convolutional neural networks, CNN)和无监督学习[29-30]的智能算法更多地被用于地貌识别,这些用于地貌的硬分类机器学习算法是对单个特征样本进行所属地面类型的识别,对于连续观测样本之间的时间相关性是不考虑的。

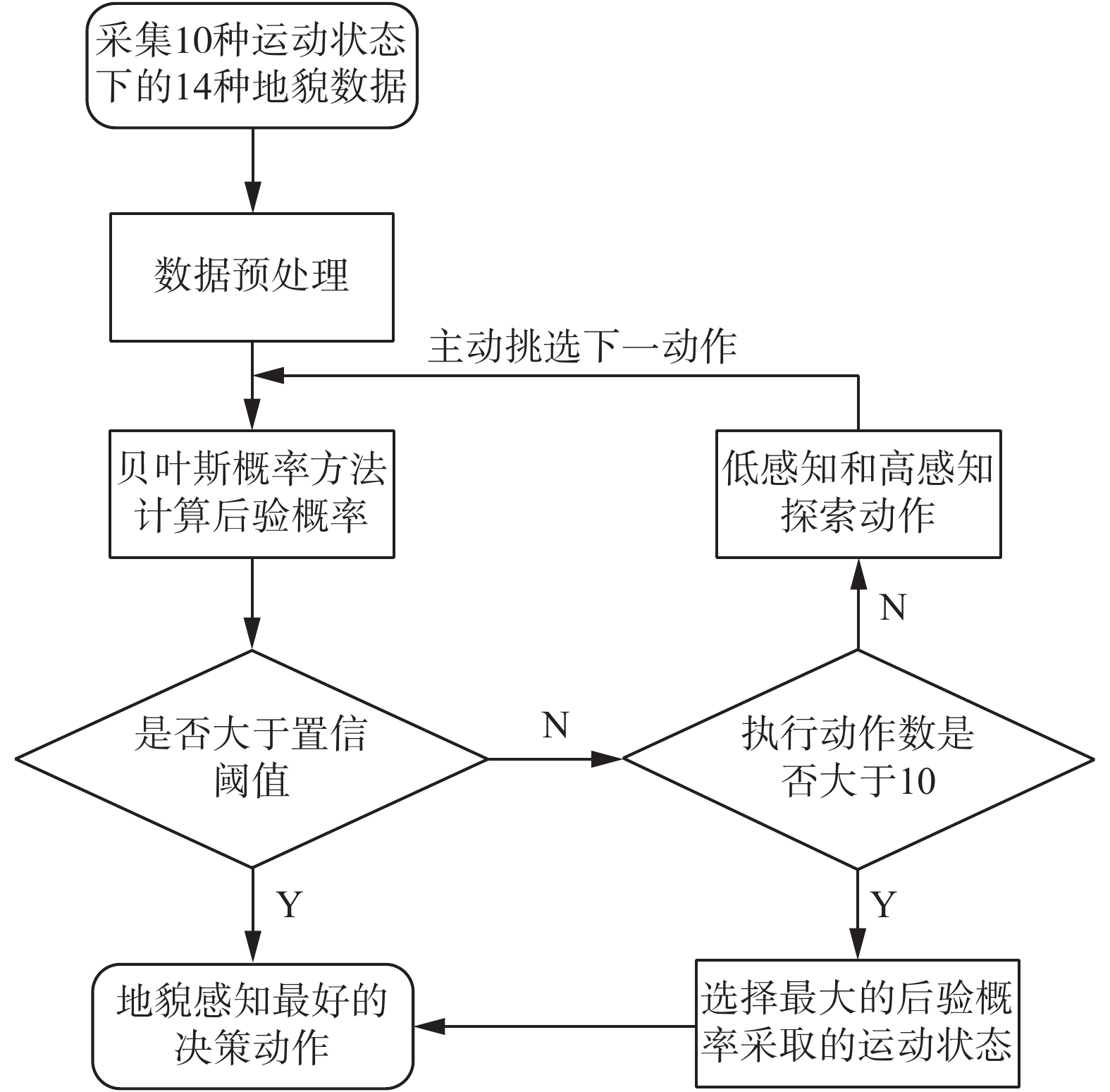

所以在本文中,提出了一种新颖的地貌探测识别方法,它允许移动机器人自主地探索在某种地貌上感兴趣的运动方式,从而可以获得更好的信息改善感知,本文的方法是由一种振动感知的贝叶斯公式和主动的运动探索策略组成,贝叶斯公式和动作顺序分析方法允许机器人自主地积累证据并做出正在探索地貌类别的运动动作决定,这种主动的运动策略有目的的使移动机器人选择低水平或者高水平识别所处地貌的运动方式。

1 移动机器人主动地貌识别问题描述本文以Autolabor Pro 1移动机器人基础平台设计了主动地貌感知方法,整个主动地貌识别系统如图1所示。

|

Download:

|

| 图 1 主动地貌探索感知 Fig. 1 Active landscape exploration perception | |

其中,移动机器人身处未知地形之中,只有一种位于车底盘附近,靠近地面位置的三轴振动传感器负责感知与未知地面交互产生的振动信息,在此情况下,并不能可视周围地貌状况,所以也不会有太大的动作范围感知所处的地形,这样只能通过选择自身的不同运动状态,在一个较小的运动范围快速感知所处的地貌。然而,常规的地貌识别在观测噪声较大、有遮挡、光线条件不足等复杂场景下对于目标跟踪预测表现得并不是很优秀。

本文研究的地面识别方法是在对外界环境不明确的状况下,移动机器人系统选择一套高效的运动状态快速感知所处地貌,将主动感知的方法运用于基于振动信号的移动机器人地貌分类实验中,使得移动机器人可获得更多有利信息,减少地貌识别中的不确定性;贝叶斯方法和主动探索行为相结合应用于14种地貌分类实验中,不需要训练模型,计算量少。

2 主动感知算法描述概率模型在开发机器人的应用中提供了一种有效的方法,例如移动机器人通过与环境的交互来感知和学习。在本文的研究中使用贝叶斯公式并结合序列分析方法,利用移动机器人的运动方式和振动信息,为地貌类别的感知和探索提供了一个精确的框架。贝叶斯主动感知系统如图2所示,主要由3个部分组成:物理层面、感知层面和决策层面。在物理层面包含机−地交互振动数据采集和数据预处理;接下来的感知层是利用贝叶斯公式处理分析,这个过程迭代地积累证据直到超过信念阈值;最终,决策层评估每个探索动作的后验概率,以评估是否需要更多的传感器测量或有足够的信息来作出决定,其中总的探索动作设定为10种,具体运动方式命名如下:左转弯(LT)、右转弯(RT)、0.2 m/s前进(LSF)、0.4 m/s前进(MSF)、0.6 m/s前进(MHSF)、0.8 m/s前进(HSF)、0.2 m/s后退(LSB)、0.4 m/s后退(MSB)、0.6 m/s后退(MHSB)、0.8 m/s后退(HSB)。

2.1 贝叶斯振动感知概率模型为开发机器人领域的鲁棒应用提供了一种灵活的方法,以贝叶斯方法为基础,构建地貌知识库相对于观测特征集的后验概率,并据此建立观测特征集与已编目地貌相似程度的度量。

2.1.1 构建贝叶斯振动感知概率模型贝叶斯概率公式从先验概率和似然的乘积递归地估计后验概率,采用信念阈值交叉分析的序列分析方法,控制地貌识别过程的自动停止,贝叶斯方法为

| $ P\left( {{s_n}|{z_t}} \right){\rm{ = }}\frac{{P\left( {{s_n},{z_t}} \right)}}{{P\left( {{z_t}|{z_{t - 1}}} \right)}} = \frac{{P\left( {{z_t}|{s_n}} \right)P\left( {{s_n}|{z_{t - 1}}} \right)}}{{P\left( {{z_t}|{z_{t - 1}}} \right)}} $ | (1) |

式中:要被评估的对象地貌类别用sn∈n=1,2,…, N(N=14)定义;探索时间t是移动机器人与每种地貌交互时所进行动作的顺序;zt代表着观测值,而对于每一个地貌类别,zt分别是由相应探索时间t收集的交互振动信号组成;

|

Download:

|

| 图 2 贝叶斯主动感知系统 Fig. 2 Bayesian active perception system | |

假设所有被探索的实验对象初始都符合均匀分布的先验概率密度。目标探索过程的初始先验概率定义为

| $ P\left( {{s_n}} \right) = P\left( {{s_n}|{z_0}} \right) = \frac{1}{N} $ | (2) |

式中:sn代表着地貌类别;z0则代表着在t=0初始状态感知的交互振动;N代表着用于探索的测试对象的数量。

2.1.3 测量模型和似然概率评估交互振动信号由安装在移动机器人底盘靠近车轮附近的三轴振动传感器感知得到,利用这些信号建立了基于直方图的非参数测量模型,Martinez-Hernandez等[31]也做过类似的工作,直方图可以清楚地显示在探索时间t处评估每个观察zt的分布情况,并估算感知地貌类别sn的似然概率,测量模型为

| $ {P_v}\left( {b|{s_n}} \right) = \frac{{{h_{v,n}}\left( b \right)}}{{\displaystyle\sum\limits_{b = 1}^{{N_{{\rm{bins}}}}} {h\left( b \right)} }} $ | (3) |

式中:b表示直方图间隔数;

通过上述评估方程对所有训练样本进行评估,探索t时刻交互振动观测值zt的可能性为

| $ \log P\left( {{z_t}|{s_n}} \right) = \sum\limits_{j = 1}^{{N_{{\rm{samples}}}}} {\frac{{\log {P_v}\left( {{d_v}\left( j \right)|{s_n}} \right)}}{{{N_{{\rm{samples}}}}}}} $ | (4) |

式中:

| $ P\left( {{z_t}|{z_{t - 1}}} \right) = \sum\limits_{n = 1}^N {P\left( {{z_t}|{s_n}} \right)P\left( {{s_n}|{z_{t - 1}}} \right)} $ | (5) |

当贝叶斯更新过程的证据积累到超过了设定的置信阈值,主动探索过程就会停止,地貌感知类别是由最大后验估计得到的,表达为当任何

当移动机器人被有目的地引导去探索对地貌识别度高的运动方式以提高感知能力时,这种主动探索行为受启发于人类对于周围环境的探索、互动和操作,能够影响感知精度和反应时间,本文的主动探索行为有别于传统的地貌识别中单一的动作模式下固定的阈值设置区别已知类地貌和未知地貌,考虑了移动机器人每一步的动作都会对下一步识别产生影响的特点,采用下列方式控制机器人的探索动作。

2.2.1 预测误差预测误差即为贝叶斯更新的后验概率和用来作为决策标准的置信阈值之间的差距,贝叶斯更新的后验概率包含在每种地貌类别中探索时间t处计算得到的概率为

| $ {e_I}\left( t \right) = P\left( {{s_n}|{z_t}} \right) - {\beta _{{\rm{threshold}}}} $ | (6) |

| $ I\left( {{\rm{PM}}\left( t \right)} \right) = {e_I}\left( {t - 1} \right) {e_I}\left( t \right) $ | (7) |

式中:

| $ \begin{array}{l} {M_{{\rm{high}}}} = \mathop {\arg \;\max }\limits_{{\rm{PM}}} I\left( {{\rm{PM}}\left( t \right)} \right)\\ {M_{{\rm{low}}}} = \mathop {\arg \;\max }\limits_{{\rm{PM}}} I\left( {{\rm{PM}}\left( t \right)} \right) \end{array} $ | (8) |

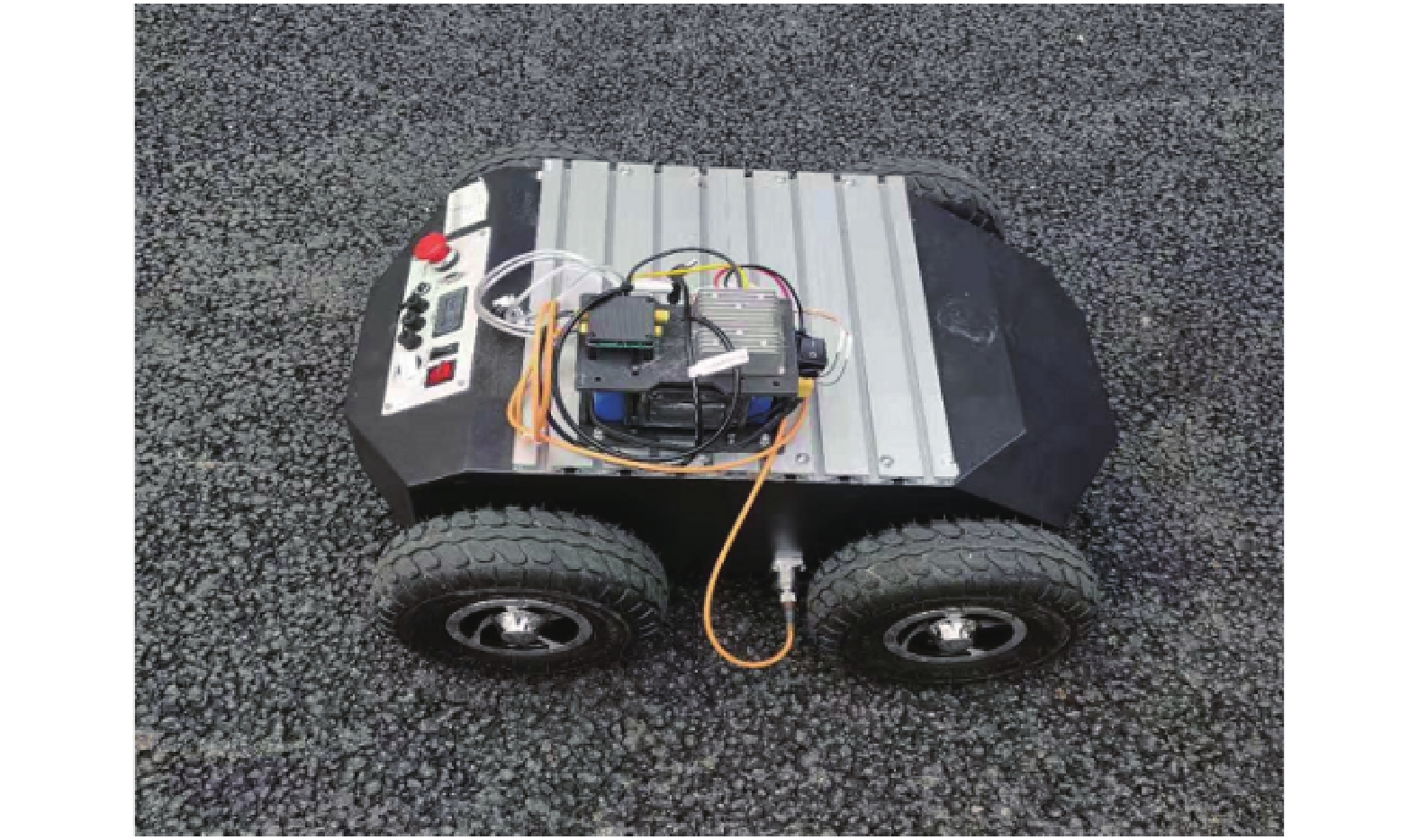

本实验采用型号为Autolabor Pro1(AP1)的移动机器人,平台如图3所示,其在室内外均可实现稳定作业,且适用于全地形,车身尺寸726 mm×617 mm×273 mm,负载能力约50 kg。AP1共具有4种速度档位,分别是0.2 m/s、0.4 m/s、0.6 m/s和0.8 m/s。在移动机器人车身一侧,平行且靠近地面的位置配备一个AKF392B三轴向加速度计,它提供的输出速率范围为5~1 000 Hz,共有8种选择,偏差典型值小于 0.1%,具有输出稳定,环境性能好等优点。加速度计采样频率选择200 Hz采集不同地形的三维振动信号。

|

Download:

|

| 图 3 实验采集平台 Fig. 3 Experimental acquisition platform | |

根据路面材质选取自然界中常见的若干类室外地形,本实验中共涉及14类室外地形,如图4所示,分别是新修沥青路面(new asphalt)、粗糙混凝土(rough concrete)、马赛克砖块路(mosaic road)、废旧水泥砖块路(old cement brick road)、大理石块(marble cubes)、压实碎石子路面(compacted crushed stone road)、木板(wood)、覆盖落叶的土壤(deciduous soil)、茂盛草丛(lush grass)、枯草地(dry grass)、粗石子(coarse stone)、鹅卵石(cobble)、松散沙土(loose sand)以及新修混凝土(new concrete)。其中,松散砂土是起伏不平的路面,马赛克路是岩石材质组成的方格路面,新旧混凝土路面是使用年限不同而造成的路面损伤程度不一,具体地貌类别如图4所示,采集地点均在清华大学校园内,采集时间多集中在夏末秋初时间段。

|

Download:

|

| 图 4 14种地貌类别 Fig. 4 14 geomorphic categories | |

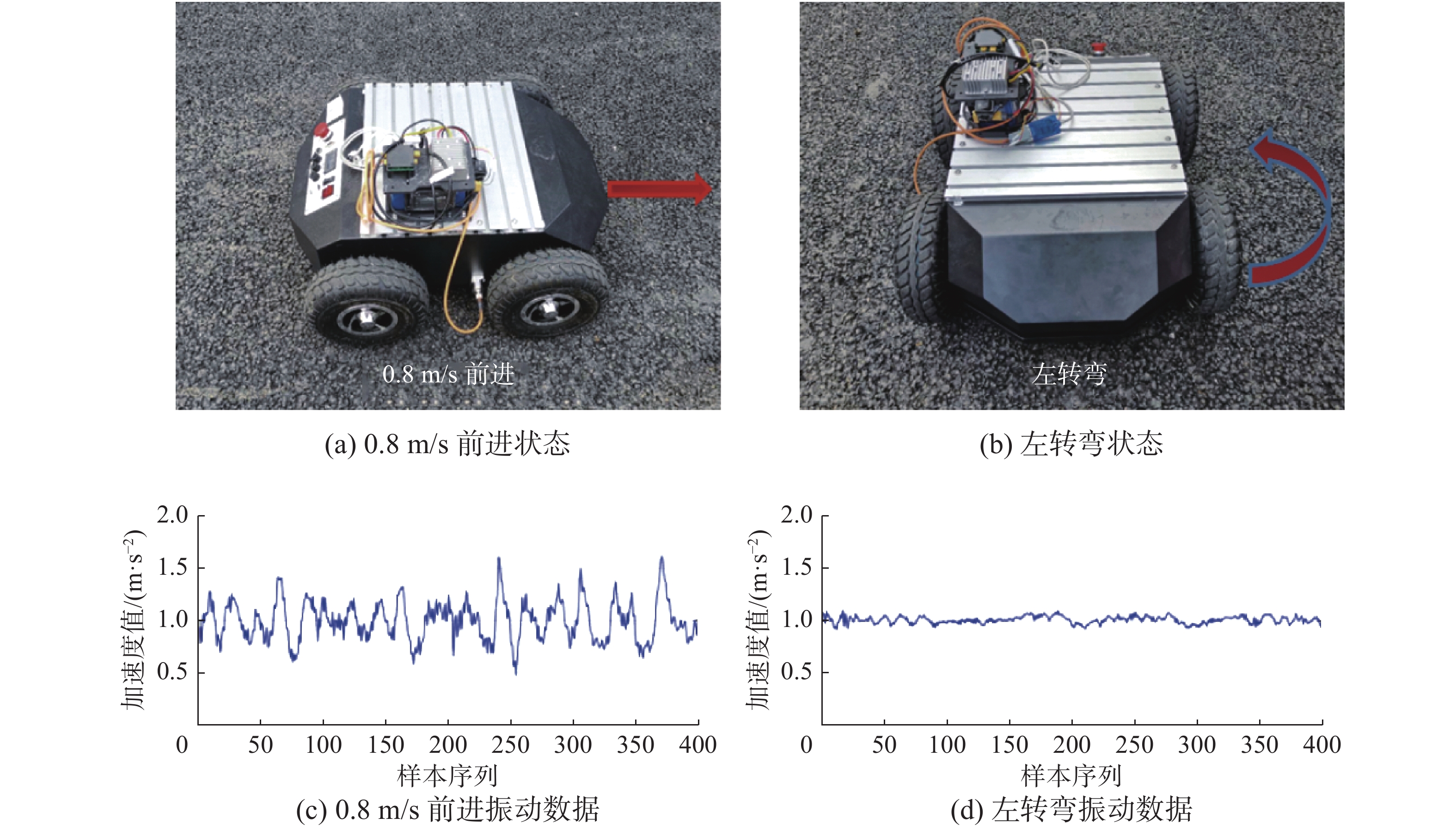

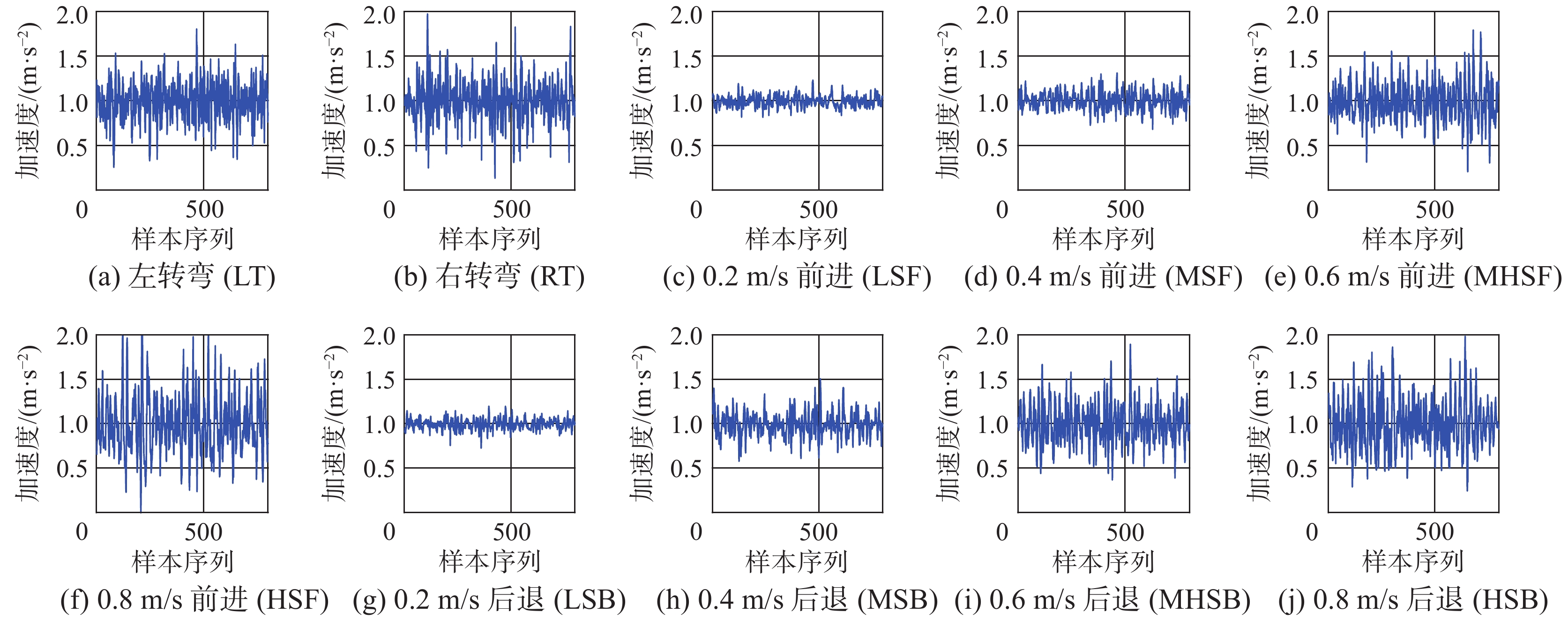

根据移动机器人自身可控的4种速度模式和2种前后运动状态排列组合为8种运动方式,以及左右2种转弯运动状态,由于移动机器人平台自身的重量不同也会对地貌变化产生的敏感度不同[25],在本文的实验中移动机器人质量分布是不均匀的,重心和几何中心是不重合的,所以会选择机器人在前进和倒车2种运动状态下的振动数据,具体运动方式命名如下:左转弯(LT)、右转弯(RT)、0.2 m/s前进(LSF)、0.4 m/s前进(MSF)、0.6 m/s前进(MHSF)、0.8 m/s前进(HSF)、0.2 m/s后退(LSB)、0.4 m/s后退(MSB)、0.6 m/s后退(MHSB)、0.8 m/s后退(HSB),总共设定10种移动机器人的可控运动模式;控制移动机器人以上述10种运动模式在3.2.1选取的各类地貌上行驶,通过移动机器人上搭载的三轴加速度计采集各种场景下的三维振动信号中的Z轴振动信号作为交互振动数据样本,移动机器人采集情景如图5所示。

|

Download:

|

| 图 5 新修沥青路面下的两种运动方式获取的振动信号 Fig. 5 Vibration signals obtained by two kinds of motion modes under the new asphalt pavement | |

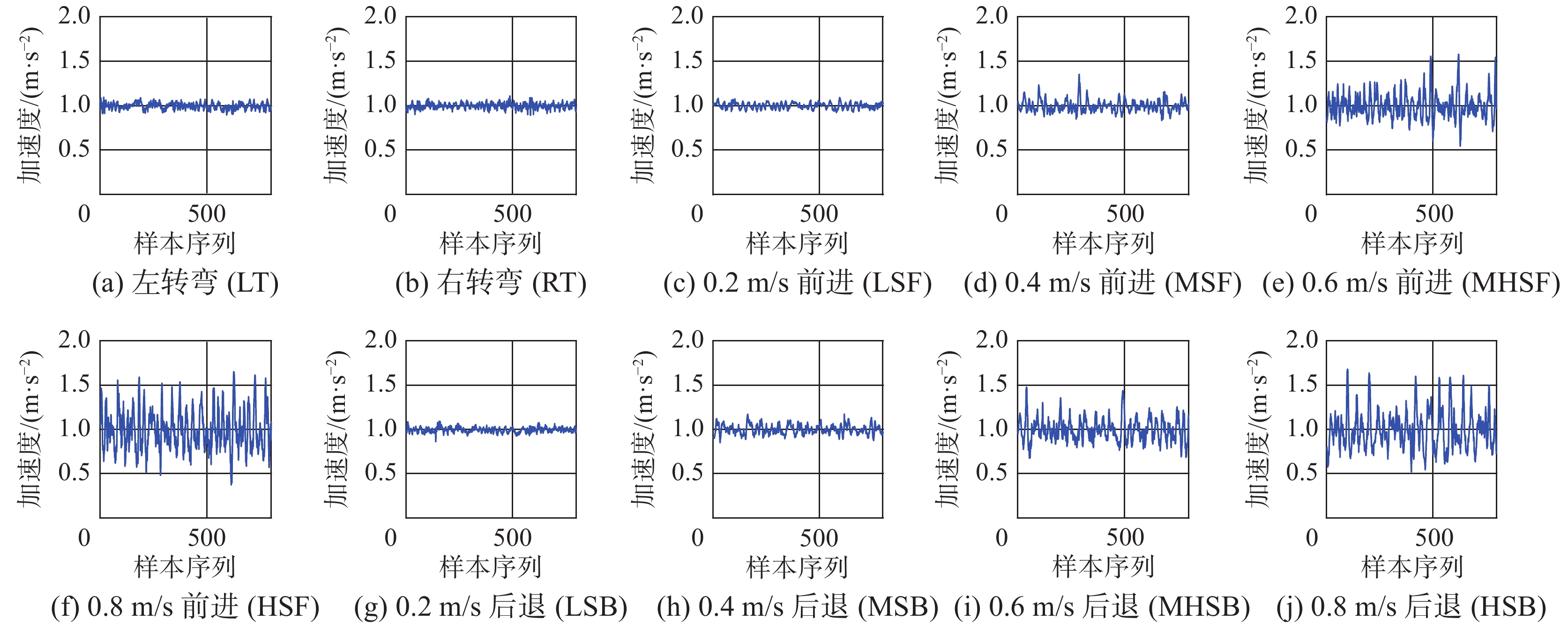

本文中控制AP1机器人在14种地貌上进行10种运动方式,移动机器人在每种地形上分别行驶了10 min,每种运动模式运动近似1 min,在10种运动模式和200 Hz采样频率下采集了近200万个数据点,其中在落叶覆盖的土壤路面分别采集左转弯、右转弯、0.2 m/s前进、0.4 m/s前进、0.6 m/s前进、0.8 m/s前进、0.2 m/s后退、0.4 m/s后退、0.6 m/s后退和0.8 m/s后退10种运动模式下的振动数据,如图6、7所示为10种运动模式下的信号反馈,其他13种地形也分别依次采集。

|

Download:

|

| 图 6 落叶覆盖的土壤中10种运动方式振动信号对比 Fig. 6 Comparison of vibration signals of 10 motion modes in two deciduous soil | |

|

Download:

|

| 图 7 粗石子中10种运动方式振动信号对比 Fig. 7 Comparison of vibration signals of 10 motion modes in two coarse stones | |

对实验中采集的各种场景下的三维振动信号只选取Z轴振动信号进行分段和滤波处理;实验中为了确保数据的可靠稳定,在分类前将移动机器人初始启动以及停止等时间段采集的振动信号去掉,保留了168万个数据点,再将其数据信号分割成段,然后通过截止频率为10 Hz的高通滤波器去除采集的Z轴振动信号中因重力和加速度计漂移导致的干扰噪声,得到14种地貌的样本数据集,如图6、7所示为落叶土壤和粗石子对应的10种运动状况下的振动信号;将上述预处理后的所有运动状态数据和交互振动数据共同构成地貌数据库,每一运动状态分别与一交互振动数据相对应。

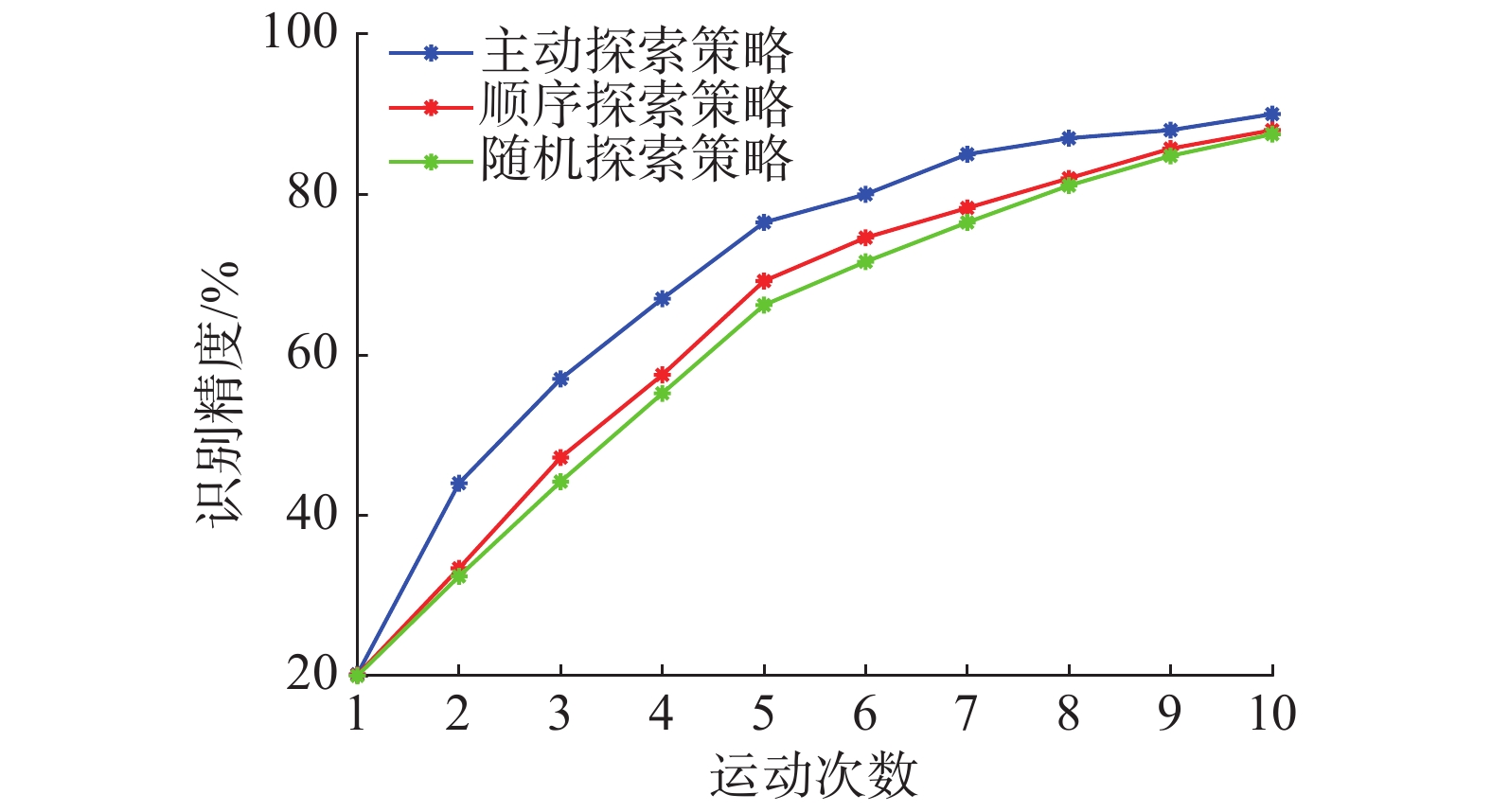

4 实验结果 4.1 识别结果本文将所有的地貌类别采集的数据输入模型中计算得到所有执行动作的表现。在经过每一次实验之后,都替换新的识别目标和初始化动作以进行新目标的实验测试。根据在模型中的每一种类别识别得到的平均表现精度作为最终结果。同时,也使用了顺序策略和随机策略实验与主动探索方法相比较,其中随机策略是在每个识别类别中都使用均匀概率的方式挑选下一个动作得到的振动数据序列,而顺序策略是在每一个类别的实验中均利用相同的顺序规则挑选下一个动作得到的振动数据序列;和被动方法的实验结果相比,本文的主动探索模型能够产生一系列有趣的动作顺序和有效地识别地貌类型。

图8为粗石子识别实验中 3 种不同策略的动作顺序挑选。

|

Download:

|

| 图 8 粗石子识别实验中3种不同策略的动作顺序挑选 Fig. 8 Active sequence selection of three different strategies in coarse stone recognition experiment | |

本节描述了主动振感探索方法和被动方法对应的动作选择序列,如图9所示。

|

Download:

|

| 图 9 3 种策略在测试振动数据中的分类性能比较 Fig. 9 Comparison of classification performance among three strategies | |

对这些动作序列的表现做了分析,实验结果表明,模型系统往往选择大角度转弯或高速行进动作,这是容易产生更明显振动特征的。在各种地貌类别之中机器人的高速度运动会导致更强的振动特征,从而得到更清晰的振动信号,但机器人的伺服电机在运行过程中会产生较大的噪声冲击识别效果。实验结果表明本文的方法对克服这个问题有很好的效果。例如,高速前进在序列的第9个动作中,那么这个相同的操作将不被再次选中,大量的运动确保了训练模型的高泛化性能。此外,用户可以根据一定的精度范围选择适当的步骤停止采集样本,以降低数据收集的成本。

4.3 动作作用比较在本文的实验中,计算出了所有地貌类别在经过每步运动之后的识别性能。上述3种顺序策略的精度比较如图9所示。在所测试的实验集中,主动振感探索方法的三步平均精度可以接近60%,而随机策略的平均精度不到50%,序列策略的性能表现则更差一点。另外,本文的方法可以在5个步骤中快速获得更高的精度,而其他方法则非常不稳定。我们还发现,本文的主动振觉探测方法比被动方法表现出显著的优势,能够以更少的步骤来达到相同的精度,这证明本文的方法提高了识别效率。

4.4 地貌识别精度比较为了进一步分析本文的模型性能,了解每种地貌类别得到的平均识别精度是很必要的。本文特别计算了如图10所示的混淆矩阵,结果表明粗石子是最具特征性的地貌类型,在所有测试中最高达到90%正确率,这种松散的大颗粒碎石振动特征更为明显。压实碎石子路面(72%正确)和粗糙旧混凝土(69%正确)是易混淆的,旧混凝土路面表面裸露出一些碎石子,使得2种地貌的粗糙度和平整度间接的在振动信号中表现得较相似,具体来说,本文的方法对较明显振动特性的地貌类别具有高灵敏度的辨识度,并且对于容易混淆的地貌有较高的识别精度。

|

Download:

|

| 图 10 使用主动感知策略对实验数据集中的所有类别计算混淆矩阵 Fig. 10 Using active perception strategy to calculate confusion matrix for all categories in experimental data set | |

在本文中,提出了在贝叶斯概率感知方法和主动探索行为下,利用移动机器人和地面的交互振动信息探索和识别所处地貌,这一过程是通过主动控制探索运动向识别度高的运动状态转换,以改善对被探索地貌的感知来实现的。结果表明,本文的方法使移动机器人能够通过振感感知和自主决定下一步的动作,以便在勘探和识别任务中快速提取更好的信息;相比较下,本文的系统可经过5次左右的短时动作尝试就能识别出移动机器人所处地面类型,且利用主动感知很好地解决了多种未知地貌类别的识别问题,未来还需要开发出更好的方法提升地貌相似度高的识别精度。

| [1] |

MISHKIN A, LAUBACH S. From prime to extended mission: evolution of the MER tactical uplink process[C]//Proceedings of SpaceOps 2006 Conference. Rome, Italy, 2006.

( 0) 0)

|

| [2] |

BROOKS C A. Learning to visually predict terrain properties for planetary rovers[D]. Cambridge: Massachusetts Institute of Technology, 2009: 15–16.

( 0) 0)

|

| [3] |

WILCOX B H. Non-geometric hazard detection for a Mars microrover[C]//Proceedings of 1994 NASA/AIAA Conference on Intelligent Robotics in Field. Houston, TX, USA, 1994: 675–684.

( 0) 0)

|

| [4] |

OTTE S, LAIBLE S, HANTEN R, et al. Robust visual terrain classification with recurrent neural networks[C]//Proceedings of 2015 European Symposium on Artificial Neural Networks, Computational Intelligence and Machine Learning. Bruges, Belgium, 2015: 22–24.

( 0) 0)

|

| [5] |

ZELTE F. Autonomous terrain classification through unsupervised learning[D]. University of Wurzburg, 2016.

( 0) 0)

|

| [6] |

ROTHROCK B, PAPON J, KENNEDY R, et al. SPOC: deep learning-based terrain classification for mars rover missions[C]//Proceedings of 2016 AIAA Space Forum. Long Beach, CA, USA, 2016.

( 0) 0)

|

| [7] |

HE Chu, LIU Xinlong, FENG Di, et al. Hierarchical terrain classification based on multilayer Bayesian network and conditional random field[J]. Remote sensing, 2017, 9(1): 96. ( 0) 0)

|

| [8] |

WU Hang, LIU Baozhen, SU Weihua, et al. Optimum pipeline for visual terrain classification using improved bag of visual words and fusion methods[J]. Journal of sensors, 2017: 8513949. ( 0) 0)

|

| [9] |

LALONDE J F, VANDAPEL N, HUBER D F, et al. Natural terrain classification using three-dimensional ladar data for ground robot mobility[J]. Journal of field robotics, 2006, 23(10): 839-861. DOI:10.1002/rob.20134 ( 0) 0)

|

| [10] |

SUGER B, STEDER B, BURGARD W. Traversability analysis for mobile robots in outdoor environments: a semi-supervised learning approach based on 3D-lidar data[C]//Proceedings of 2015 IEEE International Conference on Robotics and Automation (ICRA). Seattle, WA, USA, 2015.

( 0) 0)

|

| [11] |

KOLVENBACH H, BÄRTSCHI C, WELLHAUSEN L, et al. Haptic inspection of planetary soils with legged robots[J]. IEEE robotics and automation letters, 2019, 4(2): 1626-1632. DOI:10.1109/LRA.2019.2896732 ( 0) 0)

|

| [12] |

MANDUCHI R, CASTANO A, TALUKDER A, et al. Obstacle detection and terrain classification for autonomous off-road navigation. Auton[J]. Autonomous robots, 2005, 18(1): 81-102. ( 0) 0)

|

| [13] |

SANTAMARIA-NAVARRO À, TENIENTE E H, MORTA M, et al. Terrain classification in complex three-dimensional outdoor environments[J]. Journal of field robotics, 2015, 32(1): 42-60. DOI:10.1002/rob.21521 ( 0) 0)

|

| [14] |

ZHAO Kai, DONG Mingming, GU Liang. A new terrain classification framework using proprioceptive sensors for mobile robots[J]. Mathematical problems in engineering, 2017: 3938502. ( 0) 0)

|

| [15] |

PARK J, MIN K, KIM H, et al. Road surface classification using a deep ensemble network with sensor feature selection[J]. Sensors, 2018, 18(12):4342. ( 0) 0)

|

| [16] |

ROSENFELD R D, RESTREPO M G, GERARD W H, et al. Unsupervised surface classification to enhance the control performance of a UGV[C]//Proceedings of 2018 IEEE Systems and Information Engineering Design Symposium. Charlottesville, VA, USA, 2018.

( 0) 0)

|

| [17] |

IAGNEMMA K D, DUBOWSKY S. Terrain estimation for high-speed rough-terrain autonomous vehicle navigation[C]//Proceedings of SPIE 4715, Unmanned Ground Vehicle Technology IV. Orlando, FL, United States, 2002.

( 0) 0)

|

| [18] |

BROOKS C A, IAGNEMMA K. Vibration-based terrain classification for planetary exploration rovers[J]. IEEE transactions on robotic, 2005, 21(6): 1185-1191. ( 0) 0)

|

| [19] |

BROOKS C A, IAGNEMMA K. Self-supervised terrain classification for planetary surface exploration rovers[J]. Journal of field robotics, 2012, 29(3): 445-468. DOI:10.1002/rob.21408 ( 0) 0)

|

| [20] |

OJEDA L, BORENSTEIN J, WITUS G, et al. Terrain characterization and classification with a mobile robot[J]. Journal of field robot, 2006, 2: 103-122. ( 0) 0)

|

| [21] |

WONG C, YANG Erfu, YAN Xiutian, et al. Adaptive and intelligent navigation of autonomous planetary rovers—a survey[C]//Proceedings of 2017 NASA/ESA Conference on Adaptive Hardware and Systems (AHS). Pasadena, CA, USA, 2017: 237–244.

( 0) 0)

|

| [22] |

ZHANG Shuo, LIU Shaochuang, MA Youqing, et al. Self calibration of the stereo vision system of the Chang’e-3 lunar rover based on the bundle block adjustment[J]. ISPRS journal of photogrammetry and remote sensing, 2017, 128: 287–297. ( 0) 0)

|

| [23] |

WEISS C, FROHLICH H, ZELL A. Vibration-based terrain classification using support vector machines[C]// In Proceedings of the IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). Beijing, China, 2006:4429–4434.

( 0) 0)

|

| [24] |

WEISS C, FROHLICH H, ZELL A. Vibration-based terrain classification using support vector machines[C]//Proceedings of 2006 IEEE/RSJ International Conference on Intelligent Robots and Systems. Beijing, China, 2006: 4429–4434

( 0) 0)

|

| [25] |

VICENTE A, LIU Jindong, YANG Guangzhong. Surface classification based on vibration on omni-wheel mobile base[C]//Proceedings of 2015 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). Hamburg, Germany, 2015: 916–921.

( 0) 0)

|

| [26] |

BAI Chengchao, GUO Jifeng, GUO Linli, et al. Deep multi-layer perception based terrain classification for planetary exploration rovers[J]. Sensors, 2019,19(4):3102. ( 0) 0)

|

| [27] |

LUO Shan, BIMBO J, DAHIYA R, et al. Robotic tactile perception of object properties: a review[J]. Mechatronics, 2017, 48: 54-67. DOI:10.1016/j.mechatronics.2017.11.002 ( 0) 0)

|

| [28] |

KOZLOWSKI P, WALAS K. Deep neural networks for Terrain recognition task[C]//Proceedings of 2018 Baltic URSI Symposium. Poznan, Poland, 2018: 283–286.

( 0) 0)

|

| [29] |

Lomio F, Skenderi E, Mohamadi D, et al. Surface type classification for autonomous robot indoor navigation[J]. arXiv 2019, arXiv: 1905.00252v1.

( 0) 0)

|

| [30] |

MARTINEZ-HERNANDEZ U, DODD T J, PRESCOTT T J. Feeling the shape: active exploration behaviors for object recognition with a robotic hand[J]. IEEE transactions on systems, man, and cybernetics: systems, 2017, 48(12): 2339-2348. ( 0) 0)

|

| [31] |

OUDEYER P Y, KAPLAN F, HAFNER V V. Intrinsic motivation systems for autonomous mental development[J]. IEEE transactions on evolutionary computation, 2007, 11(2): 265-286. DOI:10.1109/TEVC.2006.890271 ( 0) 0)

|

| [32] |

GOTTLIEB J, OUDEYER P Y, LOPES M, et al. Information-seeking, curiosity, and attention: computational and neural mechanisms[J]. Information-seeking, curiosity, and attention: computational and neural mechanisms, 2013, 17(11): 585-593. DOI:10.1016/j.tics.2013.09.001 ( 0) 0)

|

2021, Vol. 16

2021, Vol. 16