2. 清华大学 车辆与运载学院,北京 100084

2. School of Vehicle and Mobility, Tsinghua University, Beijing 100084, China

随着人工智能和机器人相关技术与产业的发展,越来越多的机器人系统与产品深度地融合到各个应用领域,也对传统的机器人技术提出了更高的要求,尤其是在如何与人更好地进行交互和协同方面[1]。这一类需要与人进行交互和协同的机器人系统称为人机智能系统,其通过结合人类和机器人各自的优势从而更好地完成复杂的人机协同任务,其最终目标是实现人类和机器人在应用场景中的自然互融。人机智能技术则是人机智能系统为实现目标的理论与技术支撑,主要通过结合传统机器人技术和人工智能技术,从系统建模、感知与交互、协同控制和人在回路优化等方面提升机器人与人交互和协同的自然性、安全性和鲁棒性。本文将从人机智能系统关键技术和典型应用场景出发,对近年来人机智能系统研究领域的主要进展和部分代表性技术和系统进行介绍,为国内从事人机智能系统研究的科研人员提供参考。

1 人机智能技术与系统概述随着机器人系统的不断发展和在各行业的深度应用,实际应用场景的需求也逐步增加,而人工智能技术的引入从一定层面上提高了机器人的智能程度,但是这一类机器人系统在动态且复杂的人机协同任务中,仍具有非常大的局限性。人机智能系统则是面向复杂人机协同应用场景的智能机器人系统,其核心技术挑战是如何融合人类智能和机器智能以实现自然、安全、鲁棒的人机交互与协同,并解决实际应用场景和任务中人机协同的不确定性、脆弱性和开放性等难题。

人机智能系统的发展大致可以分为4个阶段,如图1所示,包括人机系统阶段、人在回路阶段、人在环上阶段和人在环外阶段,其分别对应机械时代、信息时代、智能时代和无人时代。

|

Download:

|

| 图 1 人机智能系统的4个发展阶段 Fig. 1 Development stages of human-robot intelligent systems | |

如表1所示,在人机智能系统发展初期,电动轮椅和汽车等可人为操控的人机系统是该阶段人机系统的典型案例,这一类人机系统的智能性较差,一般直接通过人机操作接口的方式实现人类对机器的控制[2]。在人在回路发展阶段,人机智能系统的特点是人和机器人能通过物理交互和任务分类的方式,提升人机协同任务执行过程中的精确性和安全性,这类人机智能系统以手术机器人[3]和工业协作机器人[4]为代表。在人在环上阶段,人机智能系统除了需要考虑协同任务的复杂度外,还需要解决操作者/使用者能力缺失或不足而导致的人机交互失效问题。这类人机智能系统通过建立物理和认知双向交互通道,并结合机器人的环境感知和理解能力,实现复杂场景和人机协同任务中的混合决策,这类人机智能系统以外骨骼机器人[5]、人机共驾系统[6]为代表。在人在环外阶段,人机智能系统主要以机器人为主进行感知、决策和控制,这类人机智能系统以无人车[7]为代表。本文主要针对人在回路和人在环上两个阶段,对其中人机智能系统的关键技术和典型应用场景中的人机智能系统进行综述。

| 表 1 人机智能系统发展阶段及特点 Tab.1 Development stages and characteristics of human-robot intelligent systems |

作为一种需要与人类进行交互和协同的智能机器人系统,人机智能系统涉及到的关键技术主要有:1)人机系统建模;2)人机系统运动协作;3)认知人机交互;4)人在回路的人机系统优化。本文将从上述4个方面对人机智能系统关键技术的进展进行介绍。

2.1 人机系统建模与传统的机器人系统相比,人机智能系统模型的最大特点是由于人类的深度介入而导致人机系统的动力学特性发生了改变[8]。因此,在人机系统的建模方法研究中,除了对本身机器人系统进行建模之外,还需要着重研究人机系统中人类与机器人系统产生物理耦合部分的模型[9]。这一类人机智能系统称为紧耦合物理人机智能系统,其中可穿戴机器人和智能假肢中的人机系统建模更具有挑战性,得到了深入广泛的研究[10]。

在对于人机智能系统中机器人系统本身的建模研究中,大部分都是基于传统的机器人建模方法来描述人机系统的运动学[11]和动力学模型[12]。在可穿戴机器人方面,传统的机器人建模方法往往会忽略人机智能系统的紧耦合部分而将人和机器看作一个整体,这导致了其在人机智能系统上控制效果和精度的不理想。为了减小人机智能系统紧耦合部分对其自身运动学和动力学模型的影响,Berkeley[13]采用了系统辨识的方法,通过设计一系列系统辨识实验[14],重新标定了人机智能系统中运动学和动力学模型的系统参数,最终得到了一个比原运动学和动力学模型精度更高的动态模型。与Berkeley所不同的是,Tran等[15]关注的是人机智能系统的控制器参数。他们发现在人机智能系统的运动过程中,传统的机器人建模方法无法明确地描述人与机器人之间的相互作用力,而这一作用力可以通过人与机器之间的运动角度、速度和加速度差进行体现。因此可以根据人机之间运动学信息差值的反馈,通过RFB神经网络[16]和模糊评价[17]等数学方法对人机系统控制器的参数进行在线学习,使得控制器参数根据运动学差值进行自适应变化,以减小人和机器人之间的相互作用力,最终达到提高人机智能系统建模精度的效果。

在智能假肢的人机系统建模中,系统建模的关键在于所建立的动力学模型如何符合人体运动特性,以及基于运动学模型得到的控制器参数是否能够适应外部环境参数的变化,其中较为典型的环境参数变化情况就是穿戴者运动状态和行走地形的变化[18]。Eilenberg等[19]将肌肉运动机理引入到动力学模型中,设计出的人机智能系统可以有效适应穿戴者不同的行走速度以及行走地面坡度的变化。Wen等[20]考虑到难以获得精确的动力学模型,提出了一种无模型自适应动态规划方法(ADP),该方法能够根据环境参数的变化自动调节控制器的参数,并表现出了较好的效果。

2.2 认知人机交互不同于传统的机器人系统,人机智能系统是将机器人视为一个认知主体的人机交互系统。认知人机交互的目标是使得机器具有人类的认知交互特点,可以在与人的交互过程中对环境信息进行自主感知、理解、学习并反馈[21]。在人机系统的认知交互方法研究中,其关键问题在于如何让机器在不确定性条件下理解人的意图,并对人的意图做出反馈。国内外学者对此问题进行了深入研究,其主要研究方向包括:1)基于视觉的人机智能系统信息交互;2)基于生物信号的人机智能系统控制接口研究。

在基于视觉的人机智能系统信息交互研究方面,主要方法原理是通过视觉和图像传感器对人的肢体动作进行捕捉,再将捕捉到的肢体动作与样本集中的动作进行匹配,得到该肢体动作下人的意图,最终让机器做出该意图下的动作反馈。在基于视觉的认知人机交互中,对于手势的研究与应用最为广泛。Wu等[22]提出了一种用户自定义手势的方法,解决了人机智能系统手势认知交互中用户在同一场景下不同手势习惯和表示偏差的问题,将该方法应用在虚拟现实沉浸式购物系统中,结果显示所提出的方法可以有效准确地识别用户的动作意图。Vargas等[23]利用深度学习技术,构建了一个3DCNN神经网络结构来优化视频序列中的连续手势识别性能,该方法能够有效地提取时空特征并进行精确度高达73%的手势识别,可以实现在真实场景中通过视频记录手势来控制机器人系统。

随着人机智能系统所面临任务和场景的复杂化,根据人体简单肢体动作进行意图识别的方法误判率较高,因此很多学者倾向于通过生物信号来进行人机智能系统的认知交互,其主要方法是通过采集人机交互过程中用户的生理电信号来识别其运动意图,之后将用户的运动意图作为一种控制指令来控制人机智能系统。常用的生理电信号有表面肌电信号(sEMG)、脑电信号(EEG)以及眼电信号(EOG)。日本筑波大学的HAL下肢助行外骨骼采用sEMG信号对穿戴者的运动意图进行识别[24],帮助穿戴者完成起坐、行走等日常动作[25]。与HAL下肢外骨骼不同的是,Hamaya等[26]让用户按照自身的运动意图来执行任务,同时将用户的肌电信号作为当前外骨骼系统辅助用户运动的成本,通过模型强化学习框架来尽量减小用户运动的成本,间接的让外骨骼理解人的意图,从而做出对应的反馈动作。中科院深圳研究院也对此进行了深入研究,他们设计了一个脑机接口(BCI)来控制外骨骼机器人系统,通过脑电图信号解码和多模态认知方法来实现整个系统运动模式的切换[27],同时利用sEMG信号来控制外骨骼系统对用户运动的实时跟踪[28]。

除了外骨骼人机智能系统,基于生物信号的人机智能系统控制接口研究还广泛地应用于智能轮椅[29]、智能假肢[30]、智能家居[31]以及远程机器人[32-33]等机智能系统上。雷煜等[34]通过基于脑电信号的视觉信息解读方法,成功地控制无人机完成了飞行任务。

2.3 人机系统运动协作对于人机系统的不同任务,一个挑战性的问题是如何实现人和机器人系统的运动协作。随着人机系统应用领域的逐渐增加,其面对的任务场景需求也逐渐的多元化,因此在不同任务场景需求下采用不同运动模型和控制策略以保证人机之间的自然融合成为了人机智能系统的核心要求。可穿戴机器人和工业机器人作为典型的人机系统,所面对任务场景的多样性使得其迅速成为了人机系统运动协作研究方向的热点对象。

在可穿戴机器人领域,其运动协作的核心问题在于如何让机器人能够自然跟随穿戴者在不同地形下的不同运动步态,因此其关键技术在于不同地形下的步态建模和步态规划。Zou等[35]针对不同斜坡坡度的可穿戴机器人步态轨迹规划问题,提出了一种基于传统捕捉点(CP)理论和动态运动基元(DMP)方法的自适应步态规划方法,该方法可以生成适应于不同坡度的步态轨迹,并能够有效作用于实际的人机智能系统中。类似的,Chen[36-37]等也是在DMP方法的基础上,结合机器学习方法来动态调整DMPs方法中的模型参数,最终生成适应于当前地形和运动情况下的步态轨迹。他们将该方法框架应用于上楼梯[36]和平地行走[37]场景下,实现了人机智能系统在不同地形下的动态平衡和动作协作;Deng等[38]针对可穿戴机器人上楼梯的任务场景,提出了一种新型的人引导外骨骼机器人的运动协作策略,采用自适应控制器解决了动力学模型参数的不确定性问题。该策略最终应用在实际系统中,可以帮助穿戴者在无拐杖的情况下完成可穿戴机器人上楼梯的任务。与上述针对截瘫患者的可穿戴机器人运动协作不同,针对偏瘫患者的人机运动协作实现难度较为轻松,Bortole[39]和Unluhisarcikli[40]等利用穿戴者健侧腿的运动学信息,来对穿戴患者侧腿的步态进行规划,以完成人机智能系统在不同的地形的运动协作。

在工业协作机器人领域,由于其面临的任务场景过于灵活多变,因此其运动协作的核心关键在于人机智能系统的控制方法上。随着人与机械臂的近距离接触,拖动示教方法已被广泛应用于协作机器人中[41],其中部分机器人还集成了视觉系统,可以通过观察用户的运动进行学习和调整[42]。K. Darvish等[43]针对装配任务,提出了一个人机运动协作框架,该框架通过用户手腕上配戴的可穿戴设备捕捉用户的运动轨迹,从而控制机器人系统做出对应的运动。同样的,Darvish等[44]也提出一个名为FlexHRC的工业协作机器人协作框架,该协作框架集传感、理解、规划和控制结构于一体,通过可穿戴传感设备进行用户意图识别以及协作模式的选择,最终根据协作模式对机器人系统的运动轨迹进行规划,完成人机智能系统的运动协作。

2.4 人在回路的人机系统优化随着人机智能系统的不断发展,人机交互过程中机器被赋予的“控制权”也越来越高,然而人机系统所面临的许多问题往往具有复杂性、不确定性和开放性,这些特性导致机器人系统在人机交互过程中始终存在一定风险。为了提高人机智能系统的置信度,必须引入人员监督和参与,构建人在环路的混合增强智能。人在环路的混合增强智能被定义为一种需要人类交互的智能模型[45],在包含这类模型的人机智能系统中,人始终是系统的一部分,对于机器人系统给出的执行结果,人始终会对结果做进一步的判断,即人在环路的人机系统优化。

在人在环路的人机系统优化中,大多数的研究集中于将人的生理信息,例如人体代谢率等作为系统指标,通过建立优化模型干预优化人机智能系统中的控制参数[46]。Zhang等[47]将用户的代谢率作为系统指标,通过代谢模型来估计并优化单踝外骨骼行走过程中的控制律,最终使穿戴者代谢能耗减少了24.2%;类似的,Ding等[48-49]人使用贝叶斯优化方法来优化外骨骼行走过程中髋关节的控制参数[48]和人机系统的步行频率[49],有效地减少了穿戴者的代谢能耗。Thatte等[50]提出了一种适用于下肢外骨骼和智能假肢的基于定性偏好反馈的人在环路的控制策略优化算法,该方法在贝叶斯优化方法的基础上结合了基于用户偏好的学习算法,可以更准确高效的优化人机智能系统。

除了穿戴者的生理信息,另一部分学者将目光关注到了人机智能系统的紧耦合物理部分,以人机之间的交互力作为系统指标,通过增强学习方法来优化并学习人机智能系统控制器的参数,最终达到人在回路的人机系统优化。Huang等[51]利用增强学习来学习灵敏度放大控制方法中的模型参数,有效地减少了人机智能系统之间的人机交互力,并在实际系统平台上进行了验证。为了进一步降低人机交互力,他们还提出了一种层次交互学习策略[52-53]。采用动态运动基元(DMPs)和局部加权回归(LWR)对高阶运动轨迹进行建模和学习,采用强化学习(RL)对基于模型的低阶控制器进行学习,最终在单自由度的系统平台上验证了所提策略的有效性。考虑到系统优化参数的泛化性,Hamaya等[54]定义了一个任务参数化的辅助控制策略,利用机器学习方法对多组不同任务下的人机交互数据进行学习,得到了一组泛化能力强的辅助控制策略参数,有效地减少了人机交互力。

3 典型人机智能系统及其应用基于上述人机智能系统关键技术的不断提升和进步,人机智能系统的应用范围和产业规模正在不断的扩大,本节将针对现阶段3类典型的人机智能系统及其应用场景进行介绍。

3.1 医疗康复机器人人机智能在医疗康复机器人领域的应用,对于传统医学而言,在理念上和技术上都产生了重大影响,成为了现代医学领域必不可少的重要组成部分[55]。医疗康复机器人能够突破现有机器人技术的局限性,将人与机器有机融合,凭借机器人对于生物和环境等信息的强大感知、获取和运算能力,结合人脑对于未知复杂情况所具有的优秀的决策能力,实现人机的优势互补。因此,人机智能系统在医疗康复机器人领域应用的重要特点是人与机器在交互环境中的共同协作。目前人机智能系统在医疗康复机器人领域的研究和应用热点主要包括手术机器人、康复机器人以及智能假肢[56]。

3.1.1 手术机器人手术机器人是一种辅助外科医生进行手术的智能机械设备,它是医疗康复机器人的重要组成部分[57]。以达芬奇手术机器人(见图2)为代表的手术机器人已经将外科手术的精度和可行性提升到一个全新的高度[58],手术机器人正在逐步普及并开创一种全新的手术模式。

|

Download:

|

| 图 2 达芬奇手术机器人系统 Fig. 2 Da Vinci surgical robot system | |

手术机器人的发展势头之所以能够如此猛烈,得益于其自身的3个主要优点[59]:1)手术机器人的高精度视觉系统,可以扩宽医生的手术视野,帮助医生更加准确地确定手术位置;2)自由度高的机械手使手术机器人在执行任务时更加灵活,能够在最佳手术姿态下完成对患者的治疗;3)能够避免手术医生双手的生理震颤,实现精准切除,减少患者出血量。

由外科医生和手术机器人构成的人机智能系统,相较于传统人工手术,其主要优势在于通过将生物智能与机器智能相结合,实现人与机器的优势互补。机器相较于人类,在执行手术操作时动作更加稳定、精准,不会因为长时间高强度的工作而产生疲劳和抖动,而作为手术机器人操作者的外科医生,对于未知的复杂情况具有更优秀的决策能力,能够可靠地处置手术中千变外化的突发情况。所以,只有通过精准、自然的人机协同工作,才能够保证外科手术在安全、稳定、精确的操作下进行。

3.1.2 康复外骨骼机器人随着全球人口老龄化以及残疾人群体的不断扩大,对应的医疗需求也在不断增长。康复外骨骼机器人能够使下肢偏瘫或截瘫患者在直立的状态下进行步态康复训练,这样不但可以提高患者康复训练积极性,加速患者功能恢复,同时对患者消化系统、循环系统以及心理状态的恢复也都有着显著作用[60],这些研究都说明相较于传统的康复设备,康复外骨骼拥有更加全面的康复效果。

早期的康复外骨骼机器人结构简单,功能较为单一,传感系统不够完善,康复机器人穿戴者只能作为被动接受康复训练者的角色,通过控制器按键,触发预先规划的固定运动曲线进行康复训练,穿戴者和机器人之间属于“命令−执行”的关系,人机系统耦合性较弱[61]。国外具有代表性的康复外骨骼产品主要包括:以色列“Rewalk”公司的康复下肢外骨骼[62](图3(a)),它能够通过姿态传感器,检测穿戴者的肢体动作和重心的变化,模仿人类自然行走的步态,并能根据实际情况控制步行速度。美国“Ekso”外骨骼机器人[63](图3(b))创建了3种不同的康复模式,用户可根据自身康复情况选择对应模式进行康复训练。国内康复外骨骼机器人市场主要有大艾外骨骼机器人“AiLegs”[64](见图3(c))以及电子科技大学机器人研究中心研制的“AIDER”系列外骨骼机器人[65](见图3(d))这两款外骨骼产品。这两款外骨骼机器人通过设置在外骨骼机器人上的多种传感器,可实时获取穿戴者姿态信息以及物理人机交互信息,对多维传感信息进行融合和解析,理解穿戴者的运动意图,从而动态规划出适合穿戴者当前状态的个性化仿生运动曲线。由此,穿戴者与康复外骨骼机器人共同形成了“人在环上”的人机智能系统,一方面,穿戴者为外骨骼机器人提供运动意图相关的生理特征;另一方面,穿戴者也是控制系统的一个重要反馈角色,接收环境对其的反馈信息,并做出控制决策,实现人机智能交互和人机物理紧耦合性[37]。这样不仅保证了康复训练的高效性,同时提高了穿戴者的舒适性,大大降低了康复训练中患者的二次伤害[66]。

|

Download:

|

| 图 3 下肢康复外骨骼机器人 Fig. 3 Lower limb rehabilitation exoskeleton | |

国内外许多康复外骨骼机器人研究机构也在致力于探索更先进的人体意图感知方法,例如通过实时监测并采集穿戴者脑电波,通过对脑电波进行采集、信号处理、机器学习、模式识别等多个步骤就能够判断穿戴者的运动意图,从而将人脑控制外骨骼机器人运动变成为现实[67]。另一种前沿的控制方式是采用肌肉发出的电信号[68],通过与脑电波相似的信号处理和分析方法,控制外骨骼机器人。这些前沿的方法将人机系统的协同性提升到了更高的高度,相信随着研究的不断推进,这些技术将会日趋成熟,最终以产品的形式进入康复机器人市场。

3.1.3 智能假肢智能假肢是一类利用多种传感技术,借助信息融合、人机协同控制等方法,根据假肢佩戴者意图执行动作,并具有自动适应外部环境变化的能力的假肢。传统的假肢往往只能够代替佩戴者缺失肢体的部分功能,且动作协调性较差,使用范围受到很大限制,而智能假肢的出现,弥补了上述缺陷,使假肢可以根据佩戴者意念执行较为复杂的动作,具有更好的仿生性,也扩展了使用范围[69-70]。

目前智能假肢领域较为成熟的产品主要有德国“OTTO BOCK”公司推出的肌电手假肢系统[69](见图4(a)),当截肢者佩戴上该智能假肢并通过大脑想象自己想完成的动作时,大脑产生的运动神经信号会使患肢部位肌肉收缩,智能假肢通过获取佩戴患者的肌电信号控制其屈伸、手头的开闭以及关节的旋转等动作,使用户在工作、日常生活以及休闲活动中恢复更多自由的活动能力。英国的“Touch Bionocs”公司推出的“i-Limb”智能上臂假肢(见图4(b))[70]不但能够根据佩戴者的肌电信号控制,而且还可以通过手机应用软件切换24种不同的手势模式,使机器手实现不同的持握动作。另一款具有代表性的智能假肢是由美国国防部先进项目研究局(DARPA)推出的名为“LUKE ARM”的智能上臂假肢(见图4(c))[71]。该假肢通过一套独特的肌电人机协同算法控制,通过肌电传感器获取假肢佩戴者的肌电信号并快速做出相应动作响应,同时假肢末端的传感器将动态触觉信息通过末端肌肉神经刺激传达给佩戴者,使其准确感知到假肢手的抓握强度。这种助力反馈功能能使该智能手臂表现出多达数十种不同力度的抓握动作,使佩戴者可以执行更加精细的操作,表现出更优秀的人机系统协同控制效果。该假肢已于2014年通过了美国FDA认证并于2016年开始正式临床应用和生产销售。

|

Download:

|

| 图 4 智能假肢系统 Fig. 4 Intelligent prosthetic system | |

国内在智能假肢方面的研究起步较晚但是发展迅速,许多高校和科研机构均展开相应研究,比较有代表性的成果是哈尔滨工业大学的智能假肢手“DLR-HIT”(见图4(d))[72-73]创新性地采用两条传感反馈通路,不仅将假肢末端传感器信号转化为神经电刺激传递给佩戴者进行协同控制,同时将传感信号引入智能假肢控制器中进行闭环控制,大幅提高了假肢的控制稳定性和精确度。

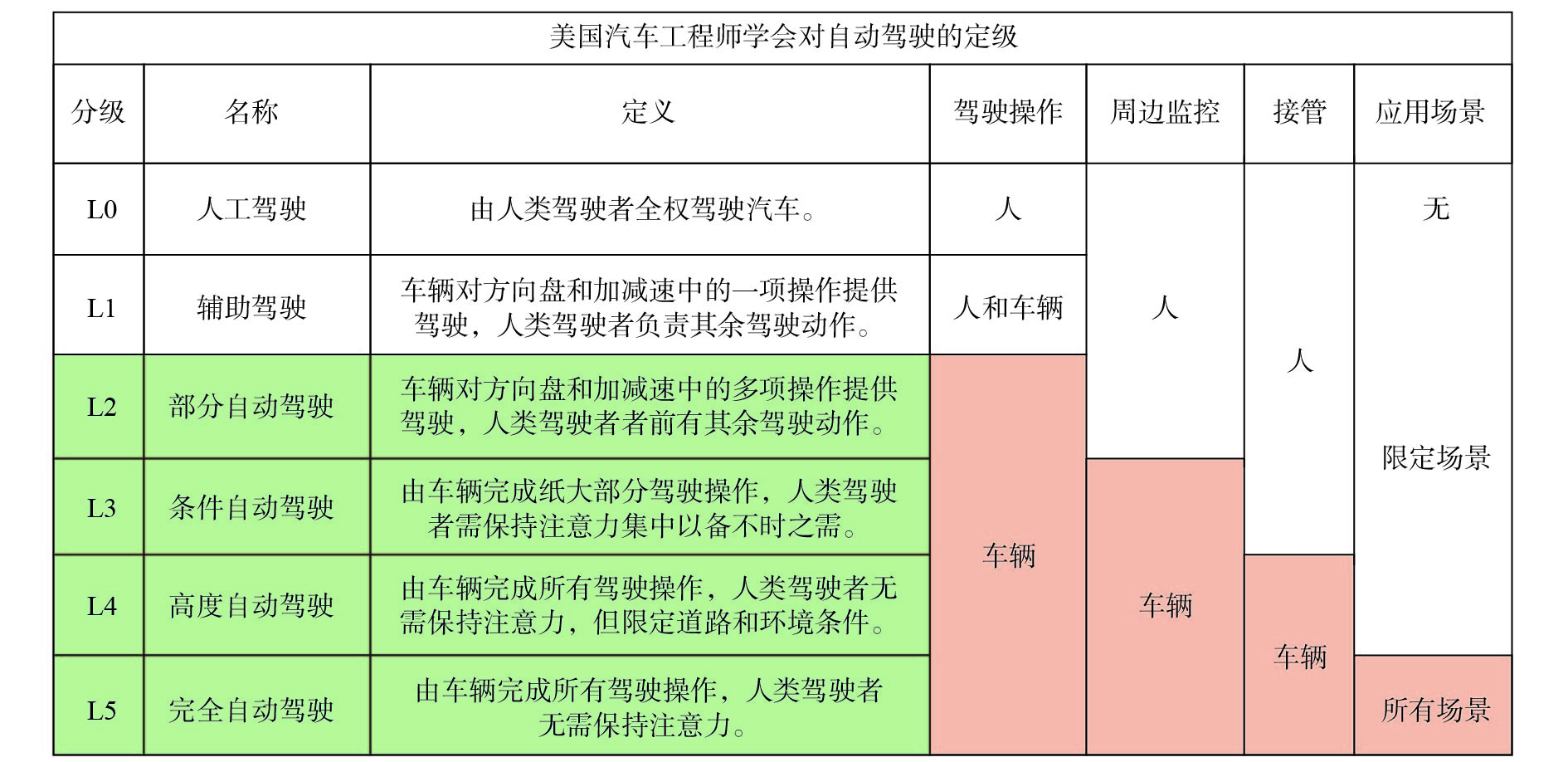

3.2 人机共驾近年来自动驾驶已经也成为汽车工业、自动化等领域炙手可热的研究方向。美国国家公路交通安全管理局将自动化驾驶系统分为5个等级[74-75],如图5所示。1) L0级:无自动驾驶,即驾驶者完全控制刹车、转向、油门、动力等主要的车辆控制设备。2) L1级:特定功能的自动化,即车辆的一项或多项主要控制设备实现自动化,但无法联动运行成为系统。3) L2级:整合功能的自动化,即车辆中至少有两项自动化控制系统能够联动运行。4) L3级:实现有限自主驾驶的自动化,即在某些特定的条件下,驾驶员可以交让与安全相关的功能的控制权,驾驶员可以偶尔接管车辆。5) L4级:实现完全自主驾驶的自动化,即完全意义上的无人驾驶,车辆可以自身全程控制并监控安全相关的驾驶功能应用。

|

Download:

|

| 图 5 自动驾驶分级标准 Fig. 5 Automatic driving classification standard | |

自动驾驶的目标是改变传统车辆的“人−车−路”的闭环控制方式,完全取代人在驾驶场景中的角色从而实现无人驾驶,即上述L5级别的自动驾驶[76]。但由于当前自动驾驶技术仍然不够成熟,并且相关政策法规、社会接受度和保险规则尚未完善,完全的无人自动驾驶还有很长的路要走。因此在当前自动驾驶的研发和应用中,人依然扮演着相当重要的角色,将人移出控制环路还为时尚早,人机共驾[77]是所有自动驾驶研究团队都要面对的课题。

人机共驾的目标是建立有效且可靠的人−车沟通方式,实现人机感知信息实时交互,形成互相信任、深度理解的关系,共同完成驾驶任务。因此人机共驾首先需要做到共享感知[78],Soualmi等[79]提出一种基于汽车转向系统转矩信号的人车共驾沟通模式,当汽车处于自动驾驶模式且传感系统未检测到地障碍时,驾驶员可以通过转动方向盘随时接管驾驶权,汽车辅助转向系统感知到方向盘转矩信号后,可实时响应并帮助驾驶员提供同向的辅助转矩从而完成人车合作转向。该模型将人置于控制系统“感知−决策”闭环的重要位置,机器传感系统能够为人类提供外部环境感知信息,同时人的感知系统也能够弥补机器感知的局限性,通过机器和人类的有效互补,从而实现更加安全的人机共驾。Morris等[80]通过融合车载雷达、车道检测摄像头和驾驶员状态监控摄像头信号,生成车辆变道预测模型。该模型可以通过传感器信号实时监测道路环境情况和驾驶员生理功能特征,包括注意力、疲劳度、情绪状态等,进行多维评估,衡量驾驶员是否适合在当前状态下接管汽车的控制权,并提前3 s预测在可能存在危险的路况下,驾驶员的变道意图,准备随时提供辅助驾驶,避免危险情况的发生,最大程度确保稳定可靠的控制权移交。

3.3 智能交互机器人传统的机器人往往只能够单向服从于人类,接受人类的指令并执行,但在人机智能时代,人和机器的联系是双向的,机器人需要能够感知周围的环境,理解人类的情感、意图和服务需求,自适应地与用户进行人机交互[81]。根据用户的需求以及环境信息的变化来进行更智能的人机交互,已成为新一代智能机器人的发展趋势,我们将这类具有感知、学习、推理以及决策能力的智能化平台称为智能交互机器人。智能交互机器人在现代社会拥有多种多样的应用场景,例如教育、娱乐、公共服务、智能家庭等领域[82-83]。

近年来有关智能交互机器人的研究较多,大多数系统和产品融合了计算机语音视觉识别、自然语言处理、深度学习、知识图谱等多种人工智能技术,旨在增强机器人在人机交互过程中对人类情感和意图的感知能力,使人机交互更加自然,同时更加有效地帮助人类完成特定场景下的任务。例如美国麻省理工学院的 “Nexi” 机器人(见图6(a))[84],它能够理解人的语言,还能够通过转动眼睛、皱眉、张嘴、打手势等丰富的面部表情和肢体动作表达喜怒哀乐等不同的情感,并且“Nexi”还能够通过人的表情和肢体反馈来接受训练,学习新的自主动作。

日本理化研究所研制的护理机器人“RIBA”(见图6(b))[85]能够在护理人员的指引下,抱起、移动和放下被护理者。操作者不仅能够使用语音对“RIBA”下达命令,同时也可以通过它表面的触觉传感器,使用触觉指导的方法更直观地向其提供指令。日本软银集团和法国“Aldebaran Robotics”公司合作研发的智能机器人“PEPPER”(见图6(c))[86]可以通过面部识别技术和声调情绪识别技术,感知人类的情感变化并调整与用户的互动方式。同时这些状态会被上传到云端存储,其他机器人个体可以用它来修改自己的行为方式,不断提升与人类的沟通能力。百度推出的“小度”智能社交机器人(见图6(d))不但能够在家庭中进行日常的情感交流,同时借助于其搭载的深度问答系统,当人类向它提出不确定性问题时,它可以实时从网上的海量知识中自动分析、抽取、统计得到精炼、全面性的答案。

|

Download:

|

| 图 6 智能交互机器人 Fig. 6 Intelligent robots | |

随着人工神经网络和情感计算相关基础理论研究和技术的突破,未来智能交互机器人的研究方向将会向着多模态情感识别方法、人机交互氛围场建模、情感意图理解方法、机器人的多模态情感表达以及人机情感交互系统应用方面不断推进和深化[87-88],大大提升智能交互机器人在感知、认知、分析和决策能力,推进机器人对多层次情景的用户动态感知,增强智能交互机器人的自主性和适应性,最终使机器人具有主动情感认知能力,将人类智能和人工智能紧密耦合,构建人机互补、人机融合、人机协同的人机智能系统。

4 结束语总的来说,近十年人工智能技术和机器人技术都分别得到了长足的进步和发展,但是结合两者优势的人机智能技术以及面向行业领域应用的典型人机智能系统,仍然处于发展的初级阶段,面临诸多的技术挑战,具体有如下4个方面:

1)在人机智能系统的建模方面,基于目前的物理人机交互模型相关研究,需要建立面向不同人机耦合度描述的人机混合模型,形成不同人机协同任务的系统建模理论与方法;

2)在人机智能系统感知构架方面,需要加强对人在环路的感知方法研究,通过情境感知、知识推理和行为理解等方式,从感知交互层面提升人机的互理解能力;

3)在人机智能系统认知和学习方面,基于人在回路的混合智能增强方法,应当融入人类认知、直觉和经验,提升人机系统的认知能力;

4)在人机智能系统决策和控制方面,应当实现基于人机互动的双向交互和协同决策机制,并通过加入物理和认知反馈机制,构建人在回路的人机互动机制,实现真正的人机互融。

总之,机器人在实际应用场景中,要实现真正的“无人时代”还需要相当长的一段时间,其中重要的发展趋势就是人机共融。而人机智能系统作为人机共融的机器人系统,将是未来机器人技术发展的重要方向之一,具有重要的研究价值。

| [1] |

AMOR H B, NEUMANN G, KAMTHE S, et al. Interaction primitives for human-robot cooperation tasks[C]//Proceedings of 2014 IEEE International Conference on Robotics and Automation. Hong Kong, China, 2014: 2831–2837.

( 0) 0)

|

| [2] |

SASAKI K, EGUCHI Y, SUZUKI K. Step-climbing wheelchair with lever propelled rotary legs[C]//Proceedings of 2015 IEEE/RSJ International Conference on Intelligent Robots and Systems. Hamburg, Germany, 2015: 6354–6359.

( 0) 0)

|

| [3] |

SU Hang, YANG Chenguang, FERRIGNO G, et al. Improved human-robot collaborative control of redundant robot for teleoperated minimally invasive surgery[J]. IEEE robotics and automation letters, 2019, 4(2): 1447-1453. DOI:10.1109/LRA.2019.2897145 ( 0) 0)

|

| [4] |

ROZO L, BRUNO D, CALINON S, et al. Learning optimal controllers in human-robot cooperative transportation tasks with position and force constraints[C]//Proceedings of 2015 IEEE/RSJ International Conference on Intelligent Robots and Systems. Hamburg, Germany, 2015: 1024–1030.

( 0) 0)

|

| [5] |

HUANG Rui, CHENG Hong, GUO Hongliang, et al. Learning cooperative primitives with physical human-robot interaction for a human-powered lower exoskeleton[C]//Proceedings of 2016 IEEE/RSJ International Conference on Intelligent Robots and Systems. Daejeon, South Korea, 2016: 5355–5360.

( 0) 0)

|

| [6] |

BENDERIUS O, BERGER C, LUNDGREN V M. The best rated human-machine interface design for autonomous vehicles in the 2016 grand cooperative driving challenge[J]. IEEE transactions on intelligent transportation systems, 2018, 19(4): 1302-1307. DOI:10.1109/TITS.2017.2749970 ( 0) 0)

|

| [7] |

STRICKLAND M, FAINEKOS G, AMOR H B. Deep predictive models for collision risk assessment in autonomous driving[C]//Proceedings of 2018 IEEE International Conference on Robotics and Automation. Brisbane, Australia, 2018: 4685–4692.

( 0) 0)

|

| [8] |

雷永林, 朱一凡, 谭跃进, 等. 模型驱动的复杂人机系统过程建模仿真方法[J]. 系统工程与电子技术, 2016, 38(1): 223-231. LEI Yonglin, ZHU Yifan, TAN Yuejin, et al. Model driven process modeling and simulation of complex man-machine systems[J]. Systems engineering and electronics, 2016, 38(1): 223-231. DOI:10.3969/j.issn.1001-506X.2016.01.34 (  0) 0)

|

| [9] |

TRAN H T, CHENG Hong, LIN Xichuan, et al. The relationship between physical human- exoskeleton interaction and dynamic factors: using a learning approach for control applications[J]. Science China information sciences, 2014, 57(12): 1-13. ( 0) 0)

|

| [10] |

HADDADIN S, CROFT E. Physical human-robot interaction[M]//SICILIANO B, KHATIB O. Springer Handbook of Robotics. Cham: Springer, 2016.

( 0) 0)

|

| [11] |

SHIROTA C, TUCKER M R, LAMBERCY O, et al. Kinematic effects of inertia and friction added by a robotic knee exoskeleton after prolonged walking[C]//Proceedings of 2017 International Conference on Rehabilitation Robotics. London, UK, 2017: 430–434.

( 0) 0)

|

| [12] |

MALLAT R, VINCENT B, HUO Weiguang, et al. Human-exoskeleton system dynamics identification using affordable sensors[C]//Proceedings of 2018 IEEE International Conference on Robotics and Automation. Brisbane, Australia, 2018: 6759–6765.

( 0) 0)

|

| [13] |

GHAN J, KAZEROONI H. System identification for the Berkeley Lower Extremity Exoskeleton (BLEEX)[C]//Proceedings of 2006 IEEE International Conference on Robotics and Automation. Orlando, USA, 2006: 3477–3484.

( 0) 0)

|

| [14] |

GHAN J, STEGER R, KAZEROONI H. Control and system identification for the Berkeley Lower Extremity Exoskeleton (BLEEX)[J]. Advanced robotics, 2006, 20(9): 989-1014. DOI:10.1163/156855306778394012 ( 0) 0)

|

| [15] |

TRAN H J, CHENG Hong, DUONG M K, et al. Fuzzy-based impedance regulation for control of the coupled human-exoskeleton system[C]//Proceedings of 2014 IEEE International Conference on Robotics and Biomimetics. Bali, Indonesia, 2014: 986–992.

( 0) 0)

|

| [16] |

DUONG M K, CHENG Hong, TRAN H T, et al. Minimizing human-exoskeleton interaction force using compensation for dynamic uncertainty error with adaptive RBF network[J]. Journal of intelligent & robotic systems, 2016, 82(3-4): 413-433. ( 0) 0)

|

| [17] |

TRAN H T, CHENG Hong, RUI Huang, et al. Evaluation of a fuzzy-based impedance control strategy on a powered lower exoskeleton[J]. International journal of social robotics, 2016, 8(1): 103-123. DOI:10.1007/s12369-015-0324-9 ( 0) 0)

|

| [18] |

王启宁, 郑恩昊, 陈保君, 等. 面向人机融合的智能动力下肢假肢研究现状与挑战[J]. 自动化学报, 2016, 42(12): 1780-1793. WANG Qining, ZHENG Enhao, CHEN Baojun, et al. Recent progress and challenges of robotic lower-limb prostheses for human-robot integration[J]. Acta automatica sinica, 2016, 42(12): 1780-1793. (  0) 0)

|

| [19] |

EILENBERG M F, GEYER H, HERR H. Control of a powered ankle–foot prosthesis based on a neuromuscular model[J]. IEEE transactions on neural systems and rehabilitation engineering, 2010, 18(2): 164-173. DOI:10.1109/TNSRE.2009.2039620 ( 0) 0)

|

| [20] |

WEN Yue, SI J, GAO Xiang, et al. A new powered lower limb prosthesis control framework based on adaptive dynamic programming[J]. IEEE transactions on neural networks and learning systems, 2017, 28(9): 2215-2220. ( 0) 0)

|

| [21] |

俞凯, 陈露, 陈博, 等. 任务型人机对话系统中的认知技术 – 概念、进展及其未来[J]. 计算机学报, 2015, 38(12): 2333-2348. YU Kai, CHEN Lu, CHEN Bo, et al. Cognitive technology in task-oriented dialogue systems: concepts, advances and future[J]. Chinese journal of computers, 2015, 38(12): 2333-2348. (  0) 0)

|

| [22] |

WU Huiyue, WANG Yu, QIU Jiali, et al. User-defined gesture interaction for immersive VR shopping applications[J]. Behaviour & information technology, 2018, 38(7): 726-741. ( 0) 0)

|

| [23] |

CASTRO-VARGAS J A, ZAPATA-IMPATA B, GIL P, et al. 3DCNN performance in hand gesture recognition applied to robot arm interaction[C]//Proceedings of the 8th International Conference on Pattern Recognition Applications and Methods. Prague, Czech Republic, 2019: 802–806.

( 0) 0)

|

| [24] |

KAWAMOTO H, LEE S, KANBE S, et al. Power assist method for HAL-3 using EMG-based feedback controller[C]//Proceedings of 2003 IEEE International Conference on Systems, Man and Cybernetics. Washington, USA, 2003: 1648–1653.

( 0) 0)

|

| [25] |

LEE S, SANKAI Y. Power assist control for walking aid with HAL-3 based on EMG and impedance adjustment around knee joint[C]//Proceedings of IEEE/RSJ International Conference on Intelligent Robots and Systems. Lausanne, Switzerland, 2002: 1499–1504.

( 0) 0)

|

| [26] |

HAMAYA M, MATSUBARA T, NODA T, et al. Learning assistive strategies for exoskeleton robots from user-robot physical interaction[J]. Pattern recognition letters, 2017, 99: 67-76. DOI:10.1016/j.patrec.2017.04.007 ( 0) 0)

|

| [27] |

WANG Can, WU Xinyu, WANG Zhouyang, et al. Implementation of a brain-computer interface on a lower-limb exoskeleton[J]. IEEE access, 2018, 6: 38524-38534. DOI:10.1109/ACCESS.2018.2853628 ( 0) 0)

|

| [28] |

MA Xunju, LONG Xingguo, YAN Zefeng, et al. Real-time active control of a lower limb exoskeleton based on sEMG[C]//Proceedings of 2019 IEEE/ASME International Conference on Advanced Intelligent Mechatronics. Hong Kong, China, 2019: 589–594.

( 0) 0)

|

| [29] |

张毅, 代凌凌, 罗元. 基于SEMG控制的智能轮椅无障碍人机交互系统[J]. 华中科技大学学报(自然科学版), 2011, 39(S2): 264-267, 282. ZHANG Yi, DAI Lingling, LUO Yuan. Information accessibility human-machine interaction system of intelligent wheelchair based on SEMG[J]. Journal of Huazhong University of Science and Technology (nature science edition), 2011, 39(S2): 264-267, 282. (  0) 0)

|

| [30] |

CIPRIANI C, ZACCONE F, MICERA S, et al. On the shared control of an EMG-controlled prosthetic hand: analysis of user–prosthesis interaction[J]. IEEE transactions on robotics, 2008, 24(1): 170-183. DOI:10.1109/TRO.2007.910708 ( 0) 0)

|

| [31] |

VASYLKIV Y, NESHATI A, SAKAMOTO Y, et al. Smart home interactions for people with reduced hand mobility using subtle EMG-signal gestures[M]//LAU F, BARTLE-CLAR J A, BLISS G, et al. Improving Usability, Safety and Patient Outcomes with Health Information Technology. Amsterdam: IOS Press, 2019: 436–443.

( 0) 0)

|

| [32] |

ZENG Hong, WANG Yanxin, WU Changcheng, et al. Closed-loop hybrid gaze brain-machine interface based robotic arm control with augmented reality feedback[J]. Frontiers in neurorobotics, 2017, 11: 60. DOI:10.3389/fnbot.2017.00060 ( 0) 0)

|

| [33] |

YANG Chenguang, CHANG Sai, LIANG Peidong, et al. Teleoperated robot writing using EMG signals[C]//Proceedings of 2015 IEEE International Conference on Information and Automation. Lijiang, China, 2015: 2264–2269.

( 0) 0)

|

| [34] |

雷煜, 童莉, 李建新, 等. 基于脑功能磁共振影像的视觉信息解读技术[J]. 计算机应用研究, 2013, 30(6): 1611-1616. LEI Yu, TONG Li, LI Jianxin, et al. Functional magnetic resonance imaging “brain reading” of visual information: a review[J]. Application research of computers, 2013, 30(6): 1611-1616. DOI:10.3969/j.issn.1001-3695.2013.06.003 (  0) 0)

|

| [35] |

ZOU Chaobin, HUANG Rui, CHENG Hong, et al. Adaptive gait planning for walking assistance lower limb exoskeletons in slope scenarios[C]//Proceedings of 2019 International Conference on Robotics and Automation. Montreal, Canada, 2019: 5083–5089.

( 0) 0)

|

| [36] |

CHEN Qiming, CHENG Hong, HUANG Rui, et al. Learning and planning of stair ascent for lower-limb exoskeleton systems[J]. Industrial robot, 2019, 46(3): 421-430. DOI:10.1108/IR-03-2018-0054 ( 0) 0)

|

| [37] |

CHEN Qiming, CHENG Hong, YUE Chunfeng, et al. Dynamic balance gait for walking assistance exoskeleton[J]. Applied bionics and biomechanics, 2018, 2018: 7847014. DOI:10.1155/2018/7847014 ( 0) 0)

|

| [38] |

DENG Chuanjie, LI Zhijun. Human-guided robotic exoskeleton cooperative walking for climbing stairs[C]//Proceedings of the 2018 3rd International Conference on Advanced Robotics and Mechatronics. Singapore, Singapore, 2018: 60–65.

( 0) 0)

|

| [39] |

BORTOLE M, DEL AMA A, ROCON E, et al. A robotic exoskeleton for overground gait rehabilitation[C]//Proceedings of 2013 IEEE International Conference on Robotics and Automation. Karlsruhe, Germany, 2013: 3356–3361.

( 0) 0)

|

| [40] |

UNLUHISARCIKLI O, PIETRUSINSKI M, WEINBERG B, et al. Design and control of a robotic lower extremity exoskeleton for gait rehabilitation[C]//Proceedings of 2011 IEEE/RSJ International Conference on Intelligent Robots and Systems. San Francisco, USA, 2011: 4893–4898.

( 0) 0)

|

| [41] |

刘洋, 孙恺. 协作机器人的研究现状与技术发展分析[J]. 北方工业大学学报, 2017, 29(2): 76-85. LIU Yang, SUN Kai. State of the art and future directions of collaborative robot[J]. Journal of North China University of Technology, 2017, 29(2): 76-85. DOI:10.3969/j.issn.1001-5477.2017.02.013 (  0) 0)

|

| [42] |

KIMURA H, HORIUCHI T, IKEUCHI K. Task-model based human robot cooperation using vision[C]//Proceedings of 1999 IEEE/RSJ International Conference on Intelligent Robots and Systems. Kyongju, South Korea, 1999: 701–706.

( 0) 0)

|

| [43] |

DARVISH K, BRUNO B, SIMETTI E, et al. An adaptive human-robot cooperation framework for assembly-like tasks[C]//Proceedings of International Conference of the Italian Association for Artificial Intelligence. Genova, Italy, 2016: 45–50.

( 0) 0)

|

| [44] |

DARWISH K, WANDERLINGH F, BRUNO B, et al. Flexible human-robot cooperation models for assisted shop-floor tasks[EB/OL]. arXiv: 1707.02591, 2017.

( 0) 0)

|

| [45] |

ZHENG Nanning, LIU Ziyi, REN Pengju, et al. Hybrid-augmented intelligence: collaboration and cognition[J]. Frontiers of information technology & electronic engineering, 2017, 18(2): 153-179. ( 0) 0)

|

| [46] |

WANG Wei, LIU Yige, REN Pengqing, et al. The characteristics of human-robot coadaptation during human-in-the-loop optimization of exoskeleton control[C]//Proceedings of 2018 IEEE International Conference on Robotics and Biomimetics. Kuala Lumpur, Malaysia, 2018: 1459–1464.

( 0) 0)

|

| [47] |

ZHANG Juanjuan, FIERS P, WITTE K A, et al. Human-in-the-loop optimization of exoskeleton assistance during walking[J]. Science, 2017, 365(6344): 1280-1284. ( 0) 0)

|

| [48] |

DING Ye, KIM M, KUINDERSMA S, et al. Human-in-the-loop optimization of hip assistance with a soft exosuit during walking[J]. Science robotics, 2018, 3(15): eaar5438. DOI:10.1126/scirobotics.aar5438 ( 0) 0)

|

| [49] |

THATTE N, DUAN Helei, GEYER H. A sample-efficient black-box optimizer to train policies for human-in- the-loop systems with user preferences[J]. IEEE robotics and automation letters, 2017, 2(2): 993-1000. DOI:10.1109/LRA.2017.2656948 ( 0) 0)

|

| [50] |

KIM M, DING Ye, MALCOLM P, et al. Human-in- the-loop Bayesian optimization of wearable device parameters[J]. PLoS one, 2017, 12(9): e0184054. DOI:10.1371/journal.pone.0184054 ( 0) 0)

|

| [51] |

HUANG Rui, CHENG Hong, CHEN Qiming, et al. Interactive learning for sensitivity factors of a human-powered augmentation lower exoskeleton[C]//Proceedings of 2015 IEEE/RSJ International Conference on Intelligent Robots and Systems. Hamburg, Germany, 2015: 6409–6415.

( 0) 0)

|

| [52] |

HUANG Rui, CHENG Hong, GUO Hongliang, et al. Hierarchical interactive learning for a human-powered augmentation lower exoskeleton[C]//Proceedings of 2016 IEEE International Conference on Robotics and Automation. Stockholm, Sweden, 2016: 257–263.

( 0) 0)

|

| [53] |

HUANG Rui, CHENG Hong, GUO Hongliang, et al. Hierarchical learning control with physical human-exoskeleton interaction[J]. Information sciences, 2018, 432: 584-595. DOI:10.1016/j.ins.2017.09.068 ( 0) 0)

|

| [54] |

HAMAYA M, MATSUBARA T, NODA T, et al. Learning task-parametrized assistive strategies for exoskeleton robots by multi-task reinforcement learning[C]//Proceedings of 2017 IEEE International Conference on Robotics and Automation. Singapore, Singapore, 2017: 5907–5912.

( 0) 0)

|

| [55] |

张光华, 潘婧. 人工智能技术在医疗领域中的应用[J]. 电子技术与软件工程, 2019(19): 239-240. ZHANG Guanghua, PAN Jing. Artificial intelligent technology and its applications in medicine[J]. Electronic technology & software engineering, 2019(19): 239-240. (  0) 0)

|

| [56] |

郑悦, 景晓蓓, 李光林. 人机智能协同在医疗康复机器人领域的应用[J]. 仪器仪表学报, 2017, 38(10): 2373-2380. ZHENG Yue, JING Xiaobei, LI Guanglin. Application of human-machine intelligence synergy in the field of medical and rehabilitation robot[J]. Chinese journal of scientific instrument, 2017, 38(10): 2373-2380. DOI:10.3969/j.issn.0254-3087.2017.10.003 (  0) 0)

|

| [57] |

BOGUE R. Robots in healthcare[J]. Industrial robot, 2011, 38(3): 218-223. DOI:10.1108/01439911111122699 ( 0) 0)

|

| [58] |

HANLY E J, TALAMINI M A. Robotic abdominal surgery[J]. The American journal of surgery, 2004, 188(4): 19-26. DOI:10.1016/j.amjsurg.2004.08.020 ( 0) 0)

|

| [59] |

张乔冶. 达芬奇手术机器人系统及其应用[J]. 医疗装备, 2016, 29(9): 197-198. ZHANG Qiaozhi. Da Vinci surgical robot system and applications[J]. Medical equipment, 2016, 29(9): 197-198. DOI:10.3969/j.issn.1002-2376.2016.09.141 (  0) 0)

|

| [60] |

肖勇, 孙平范, 陈罡. 康复机器人发展综述[J]. 信息系统工程, 2017(5): 131-133. XIAO Yong, SUN Pingfan, CHEN Gang. Overview of the rehabilitation robots development[J]. Information technology, 2017(5): 131-133. DOI:10.3969/j.issn.1001-2362.2017.05.092 (  0) 0)

|

| [61] |

DÍAZ I, GIL J J, SÁNCHEZ E. Lower-limb robotic rehabilitation: literature review and challenges[J]. Journal of robotics, 2011, 2011: 759764. ( 0) 0)

|

| [62] |

ZEILIG G, WEINGARDEN H, ZWECKER M, et al. Safety and tolerance of the ReWalkTM exoskeleton suit for ambulation by people with complete spinal cord injury: a pilot study[J]. Journal of spinal cord medicine, 2012, 35(2): 96-101. DOI:10.1179/2045772312Y.0000000003 ( 0) 0)

|

| [63] |

PAN Y T, LAMB Z, MACIEVICH J, et al. A vibrotactile feedback device for balance rehabilitation in the EksoGTTM robotic exoskeleton[C]//Proceedings of the 2018 7th IEEE International Conference on Biomedical Robotics and Biomechatronics. Enschede, Netherlands, 2018: 569-576.

( 0) 0)

|

| [64] |

CHEN S, LI J, SHUAI Mei, et al. First multicenter clinical trial of China's domestically designed powered exoskeleton-assisted walking in patients with paraplegia[J]. Annals of physical and rehabilitation medicine, 2018, 61S: e495. ( 0) 0)

|

| [65] |

HUANG Rui, CHENG Hong, QIU Jing, et al. Learning physical human-robot interaction with coupled cooperative primitives for a lower exoskeleton[J]. IEEE transactions on automation science and engineering, 2019, 16(4): 1566-1574. DOI:10.1109/TASE.2018.2886376 ( 0) 0)

|

| [66] |

HUANG Rui, PENG Zhinan, CHENG Hong, et al. Learning-based walking assistance control strategy for a lower limb exoskeleton with hemiplegia patients[C]//Proceedings of 2018 IEEE/RSJ International Conference on Intelligent Robots and Systems. Madrid, Spain, 2018: 2280–2285.

( 0) 0)

|

| [67] |

NODA T, SUGIMOTO N, FURUKAWA J, et al. Brain- controlled exoskeleton robot for BMI rehabilitation[C]//Proceedings of the 2012 12th IEEE-RAS International Conference on Humanoid Robots. Osaka, Japan, 2012: 21–27.

( 0) 0)

|

| [68] |

FLEISCHER C, REINICKE C, HOMMEL G. Predicting the intended motion with EMG signals for an exoskeleton orthosis controller[C]//Proceedings of 2005 IEEE/RSJ International Conference on Intelligent Robots and Systems. Edmonton, Canada, 2005: 2029–2034.

( 0) 0)

|

| [69] |

CASTELLINI C, VAN DER SMAGT P. Surface EMG in advanced hand prosthetics[J]. Biological cybernetics, 2009, 100(1): 35-47. DOI:10.1007/s00422-008-0278-1 ( 0) 0)

|

| [70] |

VAN DER NIET OTR O, REINDERS-MESSELINK H A, BONGERS R M, et al. The i-LIMB hand and the DMC plus hand compared: a case report[J]. Prosthetics and orthotics international, 2010, 34(2): 216-220. DOI:10.3109/03093641003767207 ( 0) 0)

|

| [71] |

BANDARA D S V, GOPURA R A R C, HEMAPALA K T M U, et al. Upper extremity prosthetics: current status, challenges and future directions[C]//Proceedings of the Seventeenth International Symposium on Artificial Life and Robotics. Beppu, Japan, 2012.

( 0) 0)

|

| [72] |

LIU Hong, YANG Dapeng, LI Jiang, et al. Development of a multi-DOF prosthetic hand with intrinsic actuation, intuitive control and sensory feedback[J]. Industrial robot, 2014, 41(4): 381-392. DOI:10.1108/IR-11-2013–417 ( 0) 0)

|

| [73] |

CHEN Zhaopeng, LII N Y, WIMBÖCK T, et al. Experimental analysis on spatial and cartesian impedance control for the dexterous DLR/HIT Ⅱ hand[J]. International journal of robotics and automation, 2014, 29(1): 1-13. ( 0) 0)

|

| [74] |

BARABÁS I, TODORUŢ A, CORDOŞ N, et al. Current challenges in autonomous driving[J]. Materials science and engineering, 2017, 252(1): 012096. ( 0) 0)

|

| [75] |

吴超仲, 吴浩然, 吕能超. 人机共驾智能汽车的控制权切换与安全性综述[J]. 交通运输工程学报, 2018, 18(6): 131-141. WU Chaozhong, WU Haoran, LYU Nengchao. Review of control switch and safety of human-computer driving intelligent vehicle[J]. Journal of traffic and transportation engineering, 2018, 18(6): 131-141. DOI:10.3969/j.issn.1671-1637.2018.06.014 (  0) 0)

|

| [76] |

YOUNG M S, STANTON N A, HARRIS D. Driving automation: learning from aviation about design philosophies[J]. International journal of vehicle design, 2007, 45(3): 323. DOI:10.1504/IJVD.2007.014908 ( 0) 0)

|

| [77] |

HOC J M, YOUNG M S, BLOSSEVILLE J M. Cooperation between drivers and automation: implications for safety[J]. Theoretical issues in ergonomics science, 2009, 10(2): 135-160. DOI:10.1080/14639220802368856 ( 0) 0)

|

| [78] |

ALONSO-MORA J, GOHL P, WATSON S, et al. Shared control of autonomous vehicles based on velocity space optimization[C]//Proceedings of 2014 IEEE International Conference on Robotics and Automation. Hong Kong, China, 2014: 1639–1645.

( 0) 0)

|

| [79] |

SOUALMI B, SENTOUH C, POPIEUL J C, et al. Automation- driver cooperative driving in presence of undetected obstacles[J]. Control engineering practice, 2014, 24: 106-119. DOI:10.1016/j.conengprac.2013.11.015 ( 0) 0)

|

| [80] |

MORRIS B, DOSHI A, TRIVEDI M. Lane change intent prediction for driver assistance: on-road design and evaluation[C]//Proceedings of 2011 IEEE Intelligent Vehicles Symposium. Baden, Germany, 2011: 895–901.

( 0) 0)

|

| [81] |

崔妍. 人工智能技术在陪护机器人中的应用策略[J]. 数字通信世界, 2019(9): 171. CUI Yan. Application strategy of artificial intelligence technology in escort robot[J]. Digital communication World, 2019(9): 171. DOI:10.3969/J.ISSN.1672-7274.2019.09.140 (  0) 0)

|

| [82] |

张莉. 服务机器人迎来发展黄金期[J]. 中国对外贸易, 2019(9): 68-69. ZHANG Li. Service robot ushered in a golden period of development[J]. China's foreign trade, 2019(9): 68-69. (  0) 0)

|

| [83] |

袁政华, 夏雪. 浅析家庭型服务机器人的发展前景[J]. 信息记录材料, 2019, 20(7): 45-46. YUAN Zhenghua, XIA Xue. A brief analysis of the development prospects of family-oriented service robots[J]. Information recording materials, 2019, 20(7): 45-46. (  0) 0)

|

| [84] |

KNOX W B, STONE P, BREAZEAL C. Training a robot via human feedback: a case study[C]//Proceedings of the 5th International Conference on Social Robotics. Bristol, UK, 2013: 460–470.

( 0) 0)

|

| [85] |

MUKAI T, HIRANO S, NAKASHIMA H, et al. Development of a nursing-care assistant robot RIBA that can lift a human in its arms[C]//Proceedings of 2010 IEEE/RSJ International Conference on Intelligent Robots and Systems. Taiwan, China, 2010: 5996–6001.

( 0) 0)

|

| [86] |

GUIZZO E. How Aldebaran robotics built its friendly humanoid robot, pepper[EB/OL].[2014-12-26]. https://spectrum.ieee.org/robotics/home-robots/how-aldebaran-robotics-built-its-friendly-humanoid-robot-pepper.

( 0) 0)

|

| [87] |

韩晶, 解仑, 刘欣, 等. 基于Gross认知重评的机器人认知情感交互模型[J]. 东南大学学报(自然科学版), 2015, 45(2): 270-274. HAN Jing, XIE Lun, LIU Xin, et al. Cognitive emotion interaction model of robot based on Gross cognitive reappraisal[J]. Journal of Southeast University (Natural Science Edition), 2015, 45(2): 270-274. DOI:10.3969/j.issn.1001-0505.2015.02.014 (  0) 0)

|

| [88] |

黄宏程, 刘宁, 胡敏, 等. 基于博弈的机器人认知情感交互模型[J]. 电子与信息学报, 2019, 41(10): 2471-2478. HUANG Hongcheng, LIU Ning, HU Ming, et al. Cognitive emotion interaction model of robot based on game theory[J]. Journal of electronics & information technology, 2019, 41(10): 2471-2478. (  0) 0)

|

2020, Vol. 15

2020, Vol. 15