船舶行业数据是我国海洋经济、海洋安全和国防现代化发展建设的重要支撑[1 - 4]。近十几年,我国船舶行业跨越式发展,成为专业覆盖面广、产业带动性强的综合性先进产业,产生了海量的高价值专业数据。通过对这些数据进行分析利用,可促进我国船舶行业发展、增强全球竞争力并提高对海洋资源的利用率。但海量的船舶数据也使得我国所依赖的传统数据分析方法暴露出了明显的结构性瓶颈,出现了严重脱节,成为了新桎梏。因此急需研究一种适用于海量船舶数据的新方法,可依照用户需求对数据进行智能化检索分析并生成解决方案,促进我国船舶行业数据价值的深度释放。

另一方面,随着云计算、大模型和人工智能等新一代数字化技术的兴起[5 - 10],船舶行业数字化转型成为摆脱传统桎梏、提高制造效率、抢占产业高地的重要手段,更加适用于船舶行业的数据处理模式应运而生。为此,国家出台《船舶行业绿色发展行动纲要(2024—2030年)》《推进船舶总装建造智能化转型行动计划》和《“十四五”信息化和工业化深度融合发展规划》等相关政策,将“数字化”定位为我国船舶行业的新一代核心引擎,推动船舶产业链的重构。

在新一代数字化技术中,基于大模型的检索增强生成(Retrieval-Augmented Generation,RAG)[11]技术深刻地改变了数据处理的方式。其借助大模型的强大的推理能力理解用户需求、检索数据和生成高质量回答,得到了广泛的应用[6 - 15],受到了造船强国的重点关注。本文将结合船舶行业数据的特点,按“多级式检索、增强式理解、去中心化式存储、安全式传输”的逻辑提出了一种基于大模型DeepSeek R1[16]的去中心化船舶数据多级检索增强系统,可自动理解需求、检索数据并生成解决方案,加速我国船舶行业数字化转型,为我国海洋经济繁荣贡献力量。

1 问题分析DeepSeek R1是我国幻方量化旗下AI公司深度求索(DeepSeek)推出的开源推理优化大语言模型,擅长复杂的语言理解推理、数学、代码等。DeepSeek R1采用混合专家架构、强化学习驱动和蒸馏技术[4],以比国外AI巨头(如OpenAI等)更低的成本达到了更高的性能,成为国产大模型的重要里程碑,为教育、金融和工业等领域提供了可落地的解决方案。

虽然DeepSeek R1取得了令人瞩目的成就,但由于DeepSeek R1也存在过于泛化,不够专业化和大模型幻觉等问题。在这些问题中,较为严重的是大模型幻觉[17]。其背后的原因是如果大模型中不存在与用户提问相关的专业知识,或者在训练过程中对该专业领域理解的不够深刻,则大模型在回答这类问题时往往不够准确,或直接胡编乱造。对此,当今主流的解决方法是RAG技术。

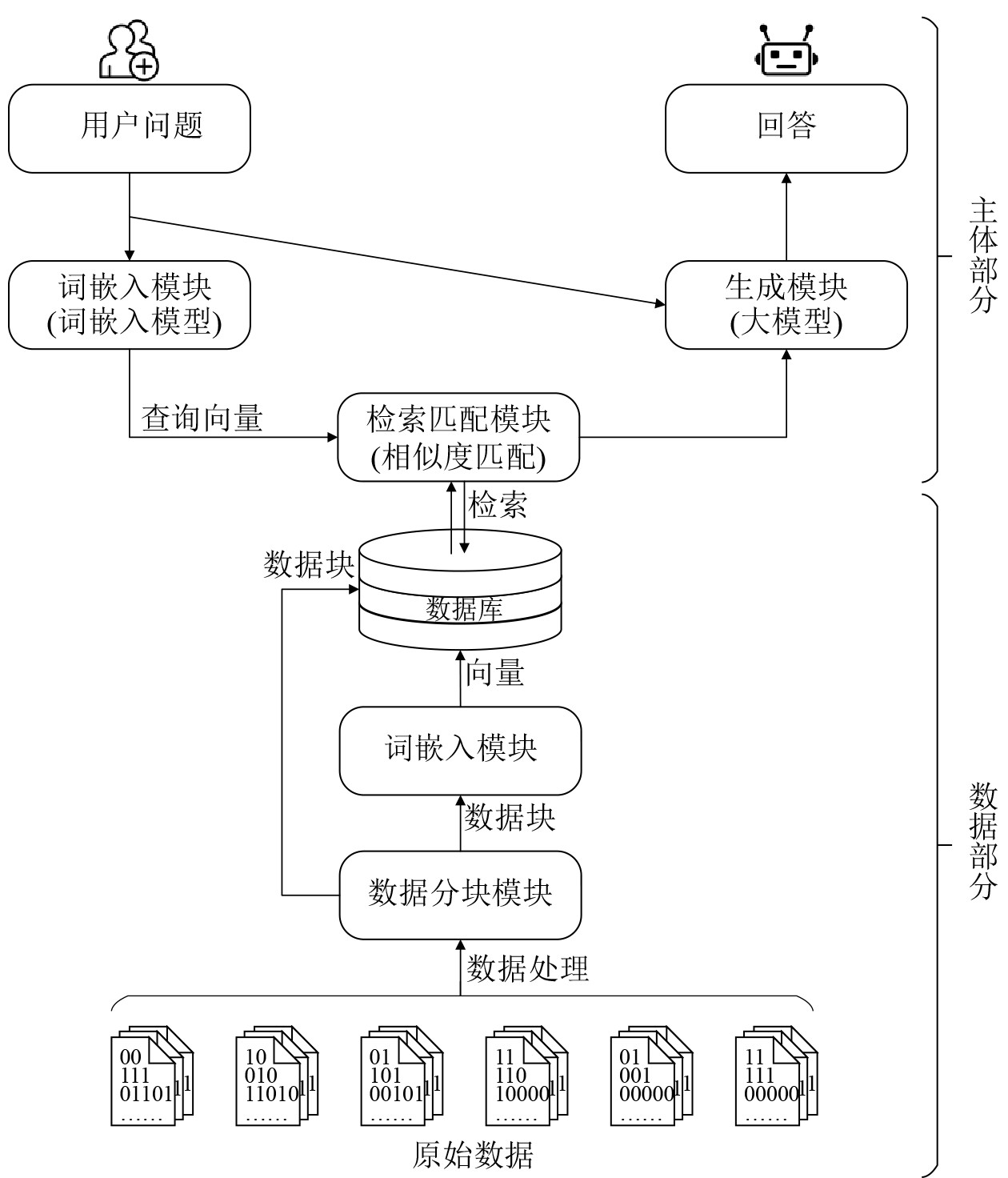

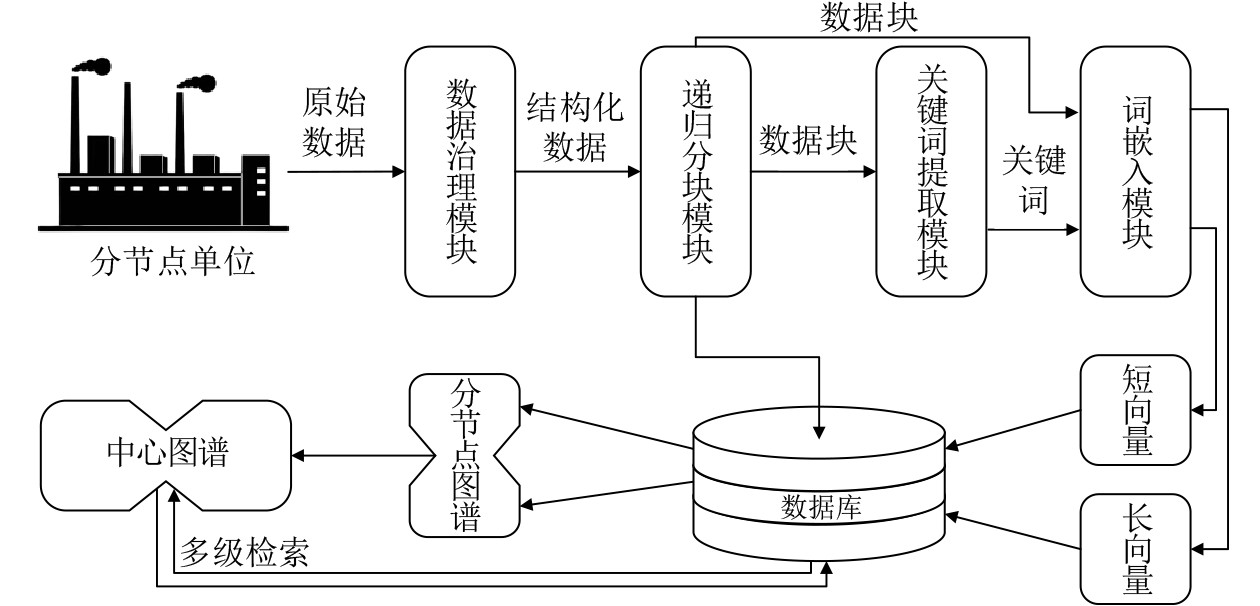

RAG[11]是一种将大模型与外部数据源联通的方法,允许大模型使用外部数据库来生成其输出,如图1所示。该技术先构建一个包含专业知识的数据库,之后让大模型检索该数据库,以数据库中的知识为引导生成最终结果。该技术可增强大模型在专业知识方面理解,缓解大模型幻觉现象。为方便说明,在本文中将其分成数据部分和主体部分。

|

图 1 检索增强生成模型(RAG)示意图 Fig. 1 Schematic diagram of retrieval-augmented generation (RAG) |

对于数据部分,原始数据经数据处理后按照指定长度被切割成为数据块(类似于一个个句子、段落);词嵌入模型会将这些数据块转换成为向量,以方便和主体部分的检索;之后将转换好的向量和与之对应的数据块建立索引联系后存入数据库。

对于主体部分,词嵌入模块会将用户问题转换为查询向量,然后通过检索匹配模块从数据库中检索向量和之前的查询向量做相似匹配排序,选取出相似度高于阈值的向量,并将这些向量所对应的数据块和用户问题一起送入大模型中,大模型便可以数据库的数据为引导生成更为准确的答案。

虽然RAG可缓解大模型幻觉,让大模型变得更加专业和准确,但弊病也很明显,主要为:

1)检索退化。当面对海量的数据时,RAG的检索效果会变差。海量的数据中会包含大量的冗杂数据,会显著阻碍RAG中查询向量与数据库向量的匹配,导致向量中即使包含用户感兴趣的部分,也会匹配失败,造成漏检,成生低质量的回答。而船舶行业数据就是海量的,对RAG是个考验;

2)理解不足。RAG采用的词嵌入模块算法(比如BERT等)虽能够理解用户问题中基本语义关系和上下文依赖,但在处理具有复杂逻辑的用户需求(复杂语义和长距离上下文)时效果欠佳,无法正确地理解复杂的用户需求;

3)存储瓶颈。传统的RAG会对所有的数据进行集中式存储以便管理。但这种方法在面对海量的数据时会显著地增加存储成本,严重地限制了系统升级和扩展;

4)数据泄露。若集中式存储的数据库遭受攻击,则其数据会被恶意窃取,损失无法估量。

为此,本文提出了一种基于DeepSeek R1的去中心化多级检索增强生成系统,以解决上述问题。

2 相关工作在检索方面,传统RAG在检索海量数据时会发生检索退化现象,导致检索质量底下。这是因为RAG仅进行一次的检索操作无法有效区分信息的语义相似性与实际相关性,易受到噪声干扰。对此,已有学者展开了相关研究,发现通过对数据进行多级检索可有效的缓解该现象。Parth等[18]提出RAPTOR,通过基于高斯混合模型的软聚类算法和摘要提取算法构建针对数据的多层级树,并对树进行逐层级检索匹配实现多级检索,增强模型的检索能力;Pezeshkpour等[19]提出Insight-RAG,先通过大模型提取用户潜在的深层需求,再用预训练过的大模型检索并整合满足上一步需求的数据的方式实现多级检索,在精准度等指标上显著优于传统RAG;Wu等[20]对于输入的数据文本利用递归摘要生成模型生成局部摘要,再将其融合形成全局摘要,最后对这两者检索来实现多级检索;Wang等[21]提出先将数据切分成片段来提取局部信息,再用多级语义聚合将局部信息整合为文档级别的语义表示,最后对两者进行多级层次化检索来平衡效率和精度;Zhang等[22]提出SiReRAG,通过构建针对摘要的相似性树和针对命题和实体的相关性树实现多级检索,在多跳问答任务中更好的平衡召回率和精准率;Zou等[23]提出Graph-Table-RAG,利用由粗到细的多阶段检索过程以提取典型和查询相关的表格实体,提高检索准确率和召回率;Chen等[24]提出了KG-Retriever,通过构建两层结构的索引图,捕捉文档内和文档间的逻辑连接,实现更全面的跨文档检索;网易团队研发了用于工程部署的RAG系统Qanything,通过对检索的数据进行两次匹配排序实现了多级检索,缓解了检索退化,提高检索性能。

在问题理解方面,传统RAG能够理解用户问题中基本语义关系和上下文依赖,但在理解具有复杂语义的长难问题时效果欠佳。对此,已有学者展开了相关研究,发现利用Deepseek系列模型强大的理解能力可帮助RAG来处理复杂问题。Feng等[25]提出Hyper-RAG,利用超图捕捉原始数据中的低阶和高阶关联信息,最大限度地减少知识结构化带来的信息丢失,之后利用Deepseek系列模型结合超图捕捉的信息生成高质量的回答;Pezeshkpour等[19]提出了的Insight-RAG中则采用DeepSeek-R1来处理“深层隐藏信息”和“多源信息整合”,效果明显优于采用其他大模型的RAG;Jadon等[26]采用Deepseek-R1的蒸馏变体增强RAG理解复杂语义和生成高质量回答的能力,比采用其他的模型的RAG更擅长捕捉文档中的信息;Tran等[27]采用DeepSeek-R1的蒸馏变体使得增强了RAG处理复杂任务的能力;Lecu等[28] 采用DeepSeek-R1作为RAG生成模块,并与知识图谱和向量数据库深度整合,生成了更真实的回答。

在数据存储方面,传统的集中式存储和管理数据的模式简单、便于操作。但一旦发生单点故障或是遭受恶意攻击,与之关联服务便会受到严重影响,造成严重损失。对此,已有学者展开了相关研究,发现采用去中心化的数据存储的方式可有效避免上述情况,增强系统的安全性。王焕杰等[1]提出了一种海洋装备数据安全共享方案,通过去中心化存储规避了单点故障风险,并通过知识图谱实现了“中心节点-分节点”的全域数据访问;Yu等[29]提出DeRAG,通过内容可寻址存储和分布式哈希表实现RAG数据库中数据的去中心化存储,解决了数据篡改风险、隐私泄露和单点故障的问题;Chong等[30]提出LLM-Net,通过分布式专家网络和区块链实现去中心化框架,提高性能;Helmi[31]提出一种名为语义分层内存索引的去中心化架构,使RAG能够在分布式环境中实现精准语义检索和可扩展推理。

在安全传输方面,传统的RAG在该方面考虑的较少,有数据安全隐患。而对于船舶行业的数据而言,有些数据比较敏感,需要考虑传输安全问题。对此,已有学者展开了相关研究,提出多种数据加密算法以保障数据传输安全。王焕杰等[1]提出了一种海洋装备数据安全共享方案,通过椭圆形曲线加密技术实现安全传输;周乐鸿[32]利用可搜索加密的实现通信网络数据安全检索;孙僖泽等[33]提出了一种融合可搜索加密技术的数据库加密方案,构建安全索引以再支持密文下对数据的高效检索;刘欢等[34]提出一种支持动态用户管理、抗密钥泄露的多用户可搜索加密方案,实现了安全高效的数据传输共享。

综上所述,虽然多级检索技术、DeepSeek R1技术、去中心化式存储技术、安全传输已经在RAG等领域得到了较为广泛应用,但在船舶行业中却较为缺乏能够集成这四大技术的RAG系统,故本文开展了下面的研究。

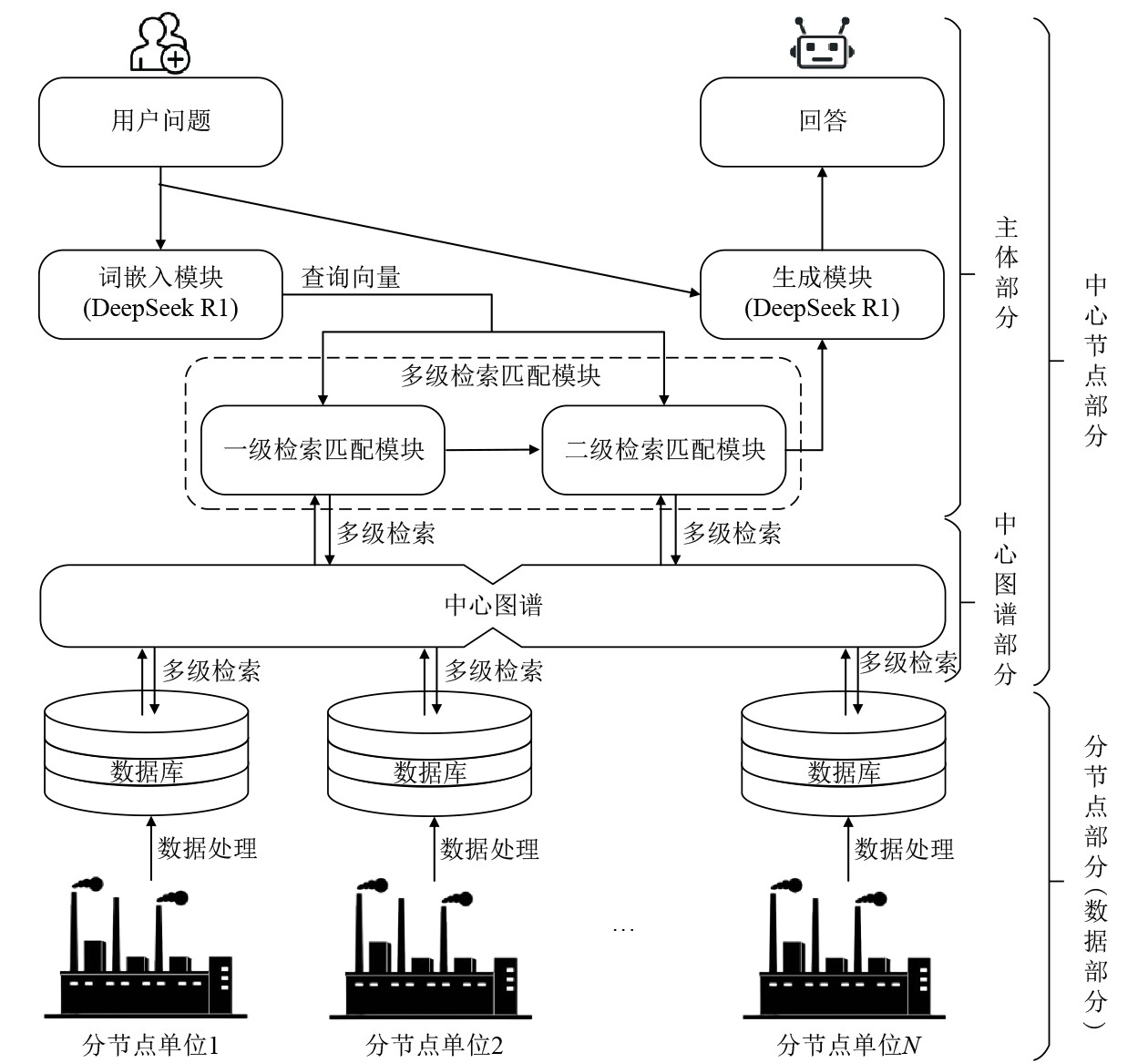

3 总体设计 3.1 整体架构针对上述问题,结合相关工作,本文按 “多级式检索、增强式理解、去中心化式存储、安全式传输”的逻辑构建了基于DeepSeek R1的去中心化多级检索增强生成系统(Multi-Stage Matching Retrieval-Augmented Generation System,MSM-RAGS),如图2所示,可概括为:

|

图 2 系统整体架构 Fig. 2 Overall architecture of system |

1)多级式检索。利用提出的多级检索匹配模块对数据进行两级检索匹配,缓解检索退化现象;

2)增强式理解。利用善于理解复杂语义的DeepSeek R1增强系统对复杂问题的理解和高质量回答的生成;

3)去中心化式存储。利用提出的中心节点知识图谱(中心图谱)访问各分节点数据,构建去中心化存储的全域数据库,同时利用联邦学习对图谱进行训练优化,以避免防止单点故障或因中心节点受到攻击导致的数据泄露;

4)安全式传输。利用对称可搜索加密技术保证数据传输安全,并允许系统在加密数据上检索。

本系统分成分节点部分和中心节点部分,中心节点部分则分为主体部分和中心图谱部分。对于分节点部分,船舶产业链涉及的相关单位可作为分节点单位,负责生成和存储数据。对于主体部分,其由词嵌入模块、多级检索匹配模块和生成模块构成。词嵌入模块和生成模块均采用DeepSeek R1来增强系统理解用户复杂问题和生成高质量回答,多级检索匹配模块通过中心图谱对数据进行多级检索匹配。中心图谱部分负责记录各分节点的数据关联和索引,形成专业的全域数据联系,并通过对称可搜索加密技术来实现安全传输。

3.2 多级检索增强生成 3.2.1 工作流程针对传统RAG方法中的理解不足和检索退化,实现在海量数据中进行高效检索,本文提出MSM-RAGS,如图3(a)所示。与传统RAG不同,本系统分节点的原始数据经过处理后除了生成数据块以外,还生成对应的短数据文本向量(短向量)、长数据文本向量(长向量)、长向量和数据块的映射关系和长、短向量的知识图谱。短向量是指从数据块中提取出关键词向量,其语义丰富度低但冗杂度低;长向量是将数据块转换得到的向量,其语义丰富度高但冗杂度高。中心节点汇总各分节点图谱为中心图谱,支撑MSM-RAGS通过其访问各分节点的本地数据。中心节点不存储数据,其数据通过中心图谱访问得到。

|

图 3 多级检索增强生成系统(MSM-RAGS)架构 Fig. 3 The architecture of multi-stage retrieval-augmented generation system (MSM-RAGS) |

当用户输入问题时,词嵌入模块会对用户问题进行上下文感知与语义特征解析,生成查询向量。之后多级检索匹配模块以查询向量为依据,通过中心图谱访问各分节点数据库进行向量的多级检索(一级检索和二级检索),得到与查询向量相似度匹配较高的长向量所对应的数据块,并和查询向量一起送到生成模块中,指导生成模块生成更专业的回答。

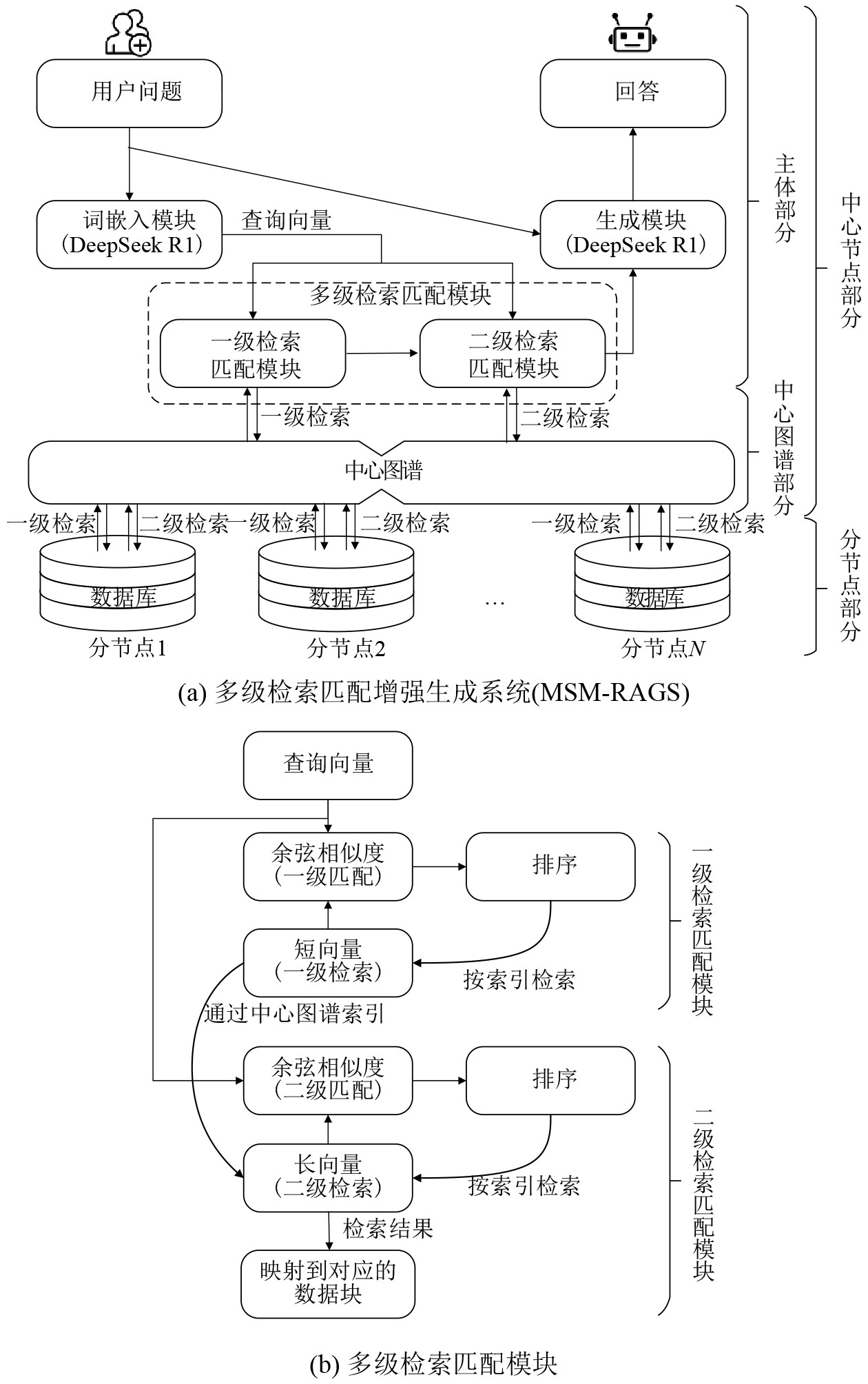

3.2.2 多级检索匹配模块本文提出的多级检索匹配模块如图3(b)所示,具体为:

1)一级检索模块。负责通过中心图谱索引各分节点数据库中的短向量,并计算短向量和查询向量的余弦相似度做匹配。之后按照相似度排序进行初次筛选,索引出相似度较高的短向量。然后通过中心图谱确定与这些短向量关联的长向量的索引并去重;

2)二级检索模块。负责按照一级检索模块的结果通过中心图谱从各分数据库中索引长向量,并计算长向量和查询向量的余弦相似度做匹配。之后按照相似度排序二次筛选,将相似度较高的长向量所映射的数据块送入生成模块,引导大模型做出更专业且准确的回答。

一、二级检索模块共同构成的“短向量→长向量→数据块”的检索机制,可缓解检索退化现象。由于长向量是由与查询向量相似度较高的短向量映射而来,即便长向量中包含较多冗余信息,但其对应的短向量不会一样冗杂,可正常匹配,故此长向量不会相似度分数过低而被过滤掉。相比于全量长向量匹配,该机制可快速定位所需数据,减少信息干扰,提高检索效率。

3.3 基于联邦学习的去中心化存储传统数据管理系统大多对数据进行集中存储和管理[35],RAG也遵循了同样的模式。这种模式虽然简单易操作,但一旦数据库发生故障,与之关联的RAG服务便会受到严重影响。而且船舶行业数据是海量的,若采用集中式管理则会消耗的巨大的计算和存储资源,会严重限制系统的升级和扩展。此外,船舶行业数据也包含敏感数据,若遭到攻击而发生泄露,其损失难以估量。

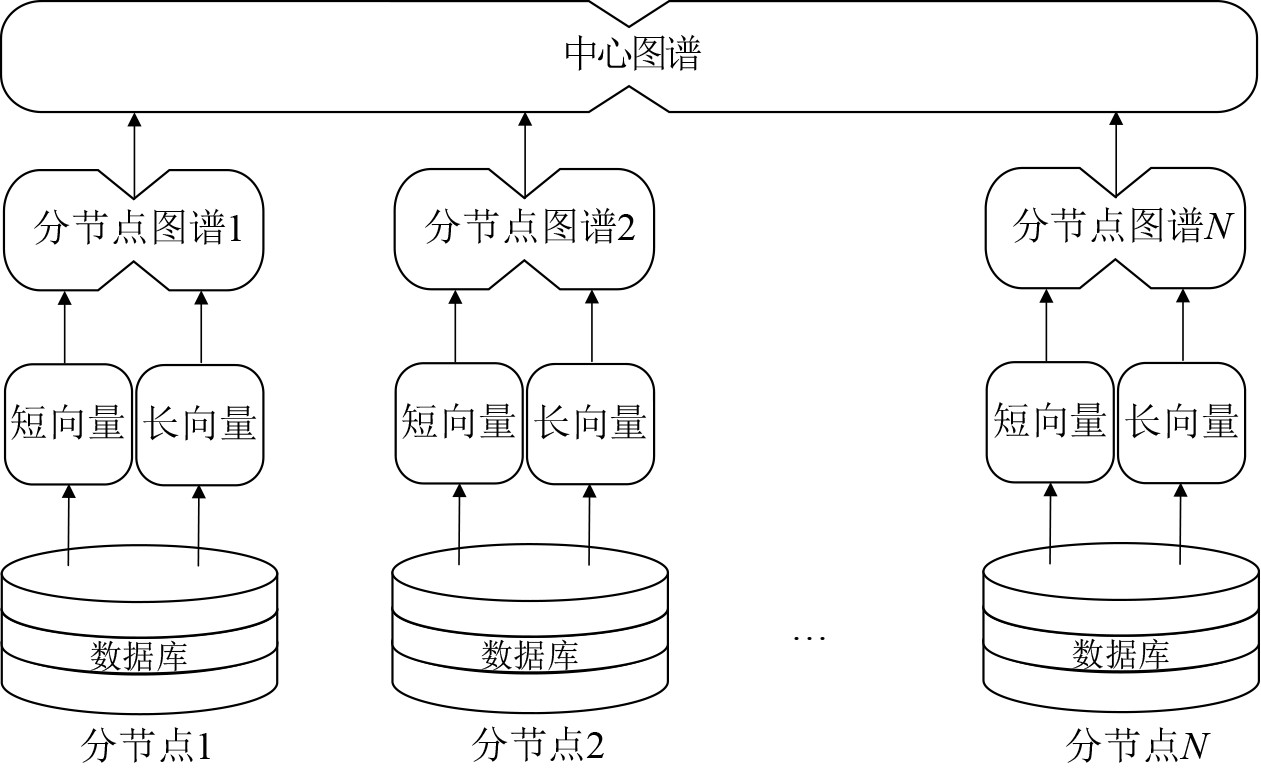

针对上述问题,本文提出了一种基于联邦学习的去中心化存储模式,如图4所示。该模式要求中心节点仅存储分节点短向量和长向量之间的联系(即知识图谱),而向量则存储在各分节点本地。遇到需使用分节点数据库的向量时,则通过知识图谱索引分节点向量。

|

图 4 中心图谱示意图 Fig. 4 Schematic diagram of center graph |

构建中心图谱较为有效的方式将所有数据上传到中心节点训练,但这与去中心化存储的理念相违背。并且船舶数据包含一些敏感数据,将来自各节点的敏感数据进行集中存储比较困难。故本文提出采用联邦学习的方法进行中心图谱模型的构建和训练。该方式可实现在数据保留在各分节点本地的情况下,通过上传模型参数等非敏感数据的方式在中心节点完成图谱模型的搭建和训练,使得模型和数据脱离,保护数据隐私。这要求各分节点要构建一个属于自身的知识图谱,其应遵循:

1)数据有效。获取数据后,需进行数据清洗以确保数据有效。数据清洗的方法包括去噪声、数据规范化、缺失值处理等。

2)规则合法。定义有关实体和关系合法性的规则。

3)统一标准。确保各分节点的知识图谱生成按照统一的标准来。

4)确定实体、关系和属性。为方便索引,分节点先将长、短向量和其对应的文本捆绑在一起,之后先用文本做实体,等确立属性后将实体由文本替换成为向量。

5)分配索引。为每个实体分配唯一索引。

将其确定之后,便可执行通过联邦学习构建中心图谱,具体为:

步骤1 初始化。中心节点初始化全局模型,并发送到各分节点。

步骤2 分节点模型训练。当分节点接收到中心节点下发的模型后,每个分节点在本地使用自己的三元组数据对实体和关系进行模型训练。

步骤3 分节点模型上传。分节点将训练后的模型参数和梯度上传到中心节点。这里仅上传模型,数据仍保留在分节点本地。

步骤4 中心节点模型聚合。中心节点对各分节点上传的参数进行聚合,将节点图谱融合到中心图谱中,通过对图谱的合并、冲突解决等操作对全局模型进行更新。

步骤5 中心节点模型下发。中心节点将新的全局模型重新分发给各分节点。

步骤6 重复步骤2~步骤5,进行多轮训练,得到最优模型,将其保存在中心节点。

进行完上述的操作后,会在中心节点形成一个全域的短向量-长向量知识图谱,MSM-RAGS可按用户需求通过中心图谱对各分节点数据库进行访问。

3.4 分节点数据处理与存储各分节点在本系统中负责存储数据,并向生成模块提供数据,如图5所示。

|

图 5 分节点数据处理与存储示意图 Fig. 5 Schematic diagram of sub-node data processing and storage |

1)数据治理模块。负责对原始数据进行清洗、标注和组织,以确保数据真实有效。在该阶段可通过多种手段进行处理,比如去重、填补缺失以及剔除错误数据等。之后进行分类和标签化,确保每条数据都有明确的语义归属。最后转化成结构化数据,方便后续环节的进行。

2)递归分块模块。负责将经过处理后的数据分块,方便词嵌入模型调用。词嵌入模型一般基于Transformer[36],在处理文本有长度限制,无法处理过长数据文本(数据文本简称文本)。在此本文采用递归分块的方式,按类似“章节符号→段落符号→句子符号”的语义递归顺序进行分割,在最大程度上确保数据块的语义连贯性并符合长度限制。经过此操作后,数据已按照语义段落和句子分块,可被视做长文本,即长向量和数据块是一一对应的。

3)关键词提取模块。负责从输出的长文本中取出能够该代表该长文本的关键词(短文本)。此操作可去除长文本中的冗杂信息,保留关键部分,可更好的在向量空间中和用户的问题做匹配,但信息丰富度低于长文本。不过后面的词嵌入模块会将输出长文本和短文本转换成为向量,实现互补。该模块可选择TextRank[37]等。

4)词嵌入模块。负责提取长文本和短文本中的语义信息,并生成高质量的长向量和短向量,以便和查询向量做相似度匹配。考虑到分节点算力资源并不丰富,词嵌入模块可选择低算力消耗的轻量级模型,比如ALBERT[38]等。

5)数据库。负责存储上述环节产生的数据块、长向量、短向量和长向量与数据块之间的映射关系,并支持来自主体部分的查询和检索操作。其采用分层设计:底层存储向量,中间层管理长向量和其对应的数据块的映射,顶层提供查询接口,实现对数据的快速检索和高效管理。

6)分节点图谱。负责构建一个连接短、长向量的知识图谱。虽然长、短向量来自同一数据块,但不同数据块之间的长、短向量也存在语义联系。分节点图谱会将短长、短向量组成图结构,实现彼此关联。分节点先用文本做实体,等确立属性后再将实体由文本替换成其对应的长、短向量,实现以向量为实体的图谱。此方法在保留可解释性的同时让系统更好地理解文本语义,并且可利用向量检索技术快速定位与查询相关的数据,提高检索效率。

3.5 安全传输因为船舶行业数据包含一些相对敏感的数据,故在数据传输中应防止被恶意窃取和利用。这要求本系统在传输数据时(比如中心节点和分节点间的数据传输)要对数据进行加密以保证安全。本系统提出采用对称可搜索加密[32 - 34],可确保数据在不离开分节点的情况下进行加密访问,并允许在加密数据上搜索,具体为:

1)数据加密。分节点单位使用对称密钥对向量进行加密,并将加密后的向量存储到数据库中。同时还会生成一个加密的索引,该索引包含向量的特征信息,用于后续的搜索操作。

2)令牌生成。当中心节点搜索特定信息时,其使用相同的对称密钥生成搜索令牌。在这里搜索令牌是一个加密的向量特征,用于在加密数据上进行搜索。

3)搜索操作。中心节点使用搜索令牌在数据库中执行搜索操作,并返回与搜索条件匹配的加密数据。采用这种“加密搜索加密”的操作是为了保证在无法解密数据或搜索令牌的情况下,除了原分节点外的所有人无法获取任何关于数据内容的信息,保证不外泄。

4)数据解密。如有需求,在保证数据安全和遵守相关法律法规的前提下,中心节点可使用对称密钥对返回的加密数据进行解密,以获取原始数据。

由于船舶行业数据十分庞大,比如船体三维建模数据、传感器监测数据和全生命周期运维等数据会对支撑本系统训练和推理的算力平台提出较高要求,需要高性能计算集群支撑复杂运算。对此,我们将在未来寻求与高算力厂商共建船舶专属算力平台,构建“数据-算法-算力”闭环验证体系,以实验的方式对本系统的多级检索匹配模块、词嵌入模块、生成模块和去中心化存储技术进行实际测试,得到较为客观的结果,支撑我国船舶在设计、建造及运营中海量数据检索分析和问题解决方案生成,推进我国船舶产业升级。

4 结 语本文按照“多级式检索、增强式理解、去中心化式存储、安全式传输”的逻辑提出了一种基于DeepSeek R1的去中心化多级检索匹配增强生成系统(MSM-RAGS),利用提出的多级检索匹配模块、基于DeepSeek R1的词嵌入模块和生成模块、基于联邦学习的去中心化存储和分节点数据处理、对称可搜索加密等技术建立起一个适用于船舶全链路数据的去中心化多级检索增强生成系统。首先,本系统主体部分利用DeepSeek R1和多级检索匹配模块分别解决了理解能力不足和检索退化的问题,增强系统对复杂用户问题的处理能力;其次,利用知识图谱搭建了“中心节点-分节点”的数据通路,实现去中心化存储,然后,设计了分节点的数据处理与存储环节,确保数据向量正确有效,以供大模型检索以生成更专业且准确的回答;最后,使用对称可搜索加密技术增强系统安全性。未来,我们将针对船舶行业特定领域的数据难点,结合本系统构建一套更为智能和专业的船舶数据检索增强生成系统,推动我国船舶行业数字化转型和智能化发展。

| [1] |

王焕杰, 魏铨, 刘祺, 等. 海洋装备数据安全共享方案[J]. 舰船科学技术, 2024, 46(22): 170-173. WANG H J, WEI Q, LIU Q, et al. Marine equipment data security sharing solution[J]. Ship Science and Technology, 2024, 46(22): 170-173. |

| [2] |

司聿宣. 基于电子知识库的船舶故障诊断技术及应用[J]. 舰船科学技术, 2024, 46(16): 153-157. SI J X. Maritime fault diagnosis technology and application based on electronic knowledge[J]. Ship Science and Technology, 2024, 46(16): 153-157. DOI:10.3404/j.issn.1672-7649.2024.16.025 |

| [3] |

张山山. 基于区块链的舰船航行大数据共享安全认证研究[J]. 舰船科学技术, 2021, 43(18): 82-84. DOI:10.3404/j.issn.1672-7649.2021.9A.028 |

| [4] |

陈家宾, 杨洪杰, 殷涛, 等. 船舶领域标准数字化应用实践[J]. 信息技术与标准化, 2024(8): 62-66. CHEN J B, YANG H J, YIN T et al. Standard digitlization application practices in the shipbuilding industry[J]. Information Technology & Standardization, 2024(8): 62-66. |

| [5] |

王兆杰, 于雷, 熊进辉, 等. 关于AI大模型技术赋能船舶领域的认识[J]. 智能科学与技术学报, 2024, 6(1): 33-40. WANG Z J, YU L, XIONG J H, et al. A study on the empowerment effect of ai large model technology in the maritime domain[J]. Chinese Journal of Intelligent Science and Technology, 2024, 6(1): 33-40. |

| [6] |

姚元杰, 龚毅光, 刘佳, 等. 基于深度学习的智能问答系统综述[J]. 计算机系统应用, 2023, 4(4): 1-15. YAO Y J, GONG Y G, LIU J, et al. Survey on intelligent question answering system based on deep learning[J]. Computer Systems & Applications, 2023, 4(4): 1-15. |

| [7] |

任海玉, 刘建平, 王健, 等. 基于大语言模型的智能问答系统研究综述[J/OL]. 计算机工程与应用, 1−24 [2025-02-19]. REN H Y, LIU J P, WANG J, et al. Research on intelligent question answering system based on large language model [J/OL]. Computer Engineering and Applications, 1−24[2025-02-19]. |

| [8] |

杨建行. 基于外部知识的船舶航行智能问答技术研究[D]. 哈尔滨: 哈尔滨工程大学, 2022 .

|

| [9] |

杜佳伟. 基于自然语言理解的船舶靠离泊知识问答系统设计与实现[D]. 哈尔滨: 哈尔滨工程大学, 2022.

|

| [10] |

唐晓晟, 程琳雅, 张春红, 等. 大语言模型在学科知识图谱自动化构建上的应用[J]. 北京邮电大学学报, 2024, 1(1): 125-136. TANG X S, CHENG L Y, ZHANG C H, et al. Application of large language models in automated construction of knowledge graphs for university subject domains[J]. Journal of Beijing University of Posts and Telecommunication, 2024, 1(1): 125-136. |

| [11] |

赵静, 汤文玉, 霍钰, 等. 大模型检索增强生成(RAG)技术浅析[J]. 中国信息化, 2024(10): 71-72. ZHAO J, TANG W Y, HUO Y, et al. A brief analysis of retrieval-augmented generation technology for large models[J]. China Informatization, 2024(10): 71-72. DOI:10.3969/j.issn.1672-5158.2024.10.020 |

| [12] |

LEWIS, P, PEREZ, E, PIKTUS, A, et al. Retrieval-augmented generation for knowledge-intensive NLP tasks [EB/OL]. (2021-04-12)[2025-02-01].

|

| [13] |

赵雪琴. 基于RAG的科技奖励知识库构建与应用研究[J]. 情报探索, 2024(11): 75-81. ZHAO X Q. Research on construction and application of RAG-based technology awards knowledge base[J]. Information Research, 2024(11): 75-81. DOI:10.3969/j.issn.1005-8095.2024.11.010 |

| [14] |

高雅奇. 基于大语言模型和RAG技术的高校知识库智能问答系统构建与评价[J]. 电脑知识与技术, 2024, 20(29): 18-20. GAO Y Q. Construction and evaluation of intelligent question answering system for university knowledge base based on large language models and RAG technology[J]. Computer Knowledge and Technology, 2024, 20(29): 18-20. DOI:10.14004/j.cnki.ckt.2024.1449 |

| [15] |

Deepseek-AI, Guo D, Yang D J, et al. DeepSeek-R1: Incentivizing reasoning capability in LLMs via reinforcement learning[EB/OL]. (2025-01-22)[2025-04-28].

|

| [16] |

XU K, ZHANG K, LI J, et al. CRP-RAG: A retrieval-augmented generation framework for supporting complex logical reasoning and knowledge planning[J]. Electronics, 2024, 14(1): 47-47. DOI:10.3390/electronics14010047 |

| [17] |

YEHUDA Y, MALKIEL I, BARKAN O, et al. InterrogateLLM: zero-resource hallucination detection in LLM-generated answears [EB/OL]. (2024-08-19)[2025-02-19].

|

| [18] |

PARTH S, SALMAN A, ADITI T, et al. RAPTOR: recursive abstractive processing for tree-organized retrieval [EB/OL]. (2024-01-31)[2025-04-28]. https://arxiv.org/abs/2401.18059.

|

| [19] |

PEZESHKPOUR P, HRUSCHKA E. Insight-RAG: enhancing LLMs with insight-driven augmentation[EB/OL]. (2025-03-31)[2025-04-28]. https://arxiv.org/abs/2504.00187.

|

| [20] |

WU J, OUYANG L, LOWE R, et al. Recursively summarizing books with human feedback[EB/OL]. (2021-09-27)[2025-04-28]. https://arxiv.org/abs/2109.10862.

|

| [21] |

WANG J, ZHAO W, TU X, et al. A novel dense retrieval framework for long document retrieval[J]. Frontiers of Computer Science, 2023, 17(4): 174609. DOI:10.1007/s11704-022-2041-5 |

| [22] |

ZHANG N, CHOUBEY P K, FABBRI A, et al. SIRERAG: indexing similar and related information for multihop reasoning[C]//International Conference on Learning Representations (ICLR), 2025.

|

| [23] |

ZOU J R, FU D Q, CHEN S R, et al. GTR: Graph-table-RAG for cross-table question answering[EB/OL]. (2025-04-02)[2025-04-28]. https://arxiv.org/abs/2504.01346.

|

| [24] |

CHEN W J, BAI T, SU J B, et al. KG-Retriever: efficient knowledge indexing for retrieval-augmented large language models[EB/OL]. (2024-12-07)[2025-04-28]. https://arxiv.org/pdf/2412.05547.

|

| [25] |

FENG Y F, HU H, HOU X L, et al. Hyper-RAG: combating LLM hallucinations using hypergraph-driven retrieval-augmented generation[EB/OL]. (2025-03-30)[2025-04-28]. https://arxiv.org/abs/2504.08758.

|

| [26] |

JADON A, PATIL A, KUMAR S. Enhancing domain-specific retrieval-augmented generation: synthetic data generation and evaluation using reasoning models[EB/OL]. (2025-02-21)[2025-04-28]. https://arxiv.org/pdf/2502.15854.

|

| [27] |

TRAN H, YAO Z H, WANG J, et al. RARE: retrieval-augmented reasoning enhancement for large language models[EB/OL]. (2024-12-03)[2025-04-28]. https://arxiv.org/abs/2412.02830.

|

| [28] |

LECU A, GROZA A, HAWIZY L, et al. Knowledge graph-driven retrieval-augmented generation: integrating Deepseek-R1 with weaviate for advanced chatbot applications[EB/OL]. (2025-02-16)[2025-04-28]. https://arxiv.org/pdf/2502.11108.

|

| [29] |

YU J W, SATO H. DeRAG: Decentralized multi-source RAG system with optimized pyth network [C]//2024 IEEE International Symposium on Parallel and Distributed Processing with Applications (ISPA), 2024.

|

| [30] |

CHONG Z K, OSAKI H, NG B. LLM-Net: Democratizing LLMs-as-a-service through blockchain-based expert networks[EB/OL]. (2025-01-13)[2025-04-28]. https://arxiv.org/abs/2501.07288.

|

| [31] |

HELMI T. Decentralizing AI memory: SHIMI, a semantic hierarchical memory index for scalable agent reasoning[EB/OL]. (2025-04-08)[2025-04-28]. https://arxiv.org/abs/2504.06135.

|

| [32] |

周乐鸿. 基于可搜索加密的通信网络数据安全检索[J]. 长江信息通信, 2025, 38(2): 146-148. ZHOU L H. Communication network data security retrieval based on searchable encryption[J]. Changjiang Information & Communications, 2025, 38(2): 146-148. DOI:10.20153/j.issn.2096-9759.2025.02.043 |

| [33] |

孙僖泽, 周福才, 李宇溪, 等. 基于可搜索加密机制的数据库加密方案[J]. 计算机学报, 2021, 44(4): 708-918. SUN X Z, ZHOU F C, LI Y X, et al. A database encryption scheme based on searchable encryption[J]. Chinese Journal of Computers, 2021, 44(4): 708-918. |

| [34] |

刘欢, 邓伦治, 李滨瀚. 基于区块链的动态多用户可搜索加密方案[J]. 计算机应用研究, 2025, 43(3): 693-699. LIU H, ZHENG L Z, LI H H, et al. Blockchain-based dynamic multi-user searchable encryption scheme[J]. Application Research of Computers, 2025, 43(3): 693-699. |

| [35] |

杜小勇, 卢卫, 张峰. 大数据管理系统的历史、现状与未来[J]. 软件学报, 2019, 30(1): 127-141. |

| [36] |

VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need[J]. Advances in Neural Information Processing Systems, 2017, 30.

|

| [37] |

丁海兰, 祁坤钰. 基于TextRank算法和相似度的中文文本主题句自动提取[J/OL]. 吉林大学学报(工学版), 1−9[2025-02-19] DING H L, QI Y K. Automatic extraction of Chinese text topic sentences based on TextRank algorithm and similarity[J]. Journal of Jilin University, 1−9[2025-02-19]. |

| [38] |

LAN Z, CHEN M, GOODMAN S, et al. ALBERT: A Lite BERT for Self-supervised Learning of Language Representations [EB/OL]. (2019-09-26)[2025-02-19].

|

2026, Vol. 48

2026, Vol. 48