2. 武汉工程大学 电气信息学院,湖北 武汉 430205

2. School of Electrical and Information Engineering, Wuhan Institute of Technology, Wuhan 430205, China

船舶作为海上运输的核心载体,其结构区域的高精度分割对海事安全监管、海洋环境监测和智能导航系统具有重要意义[1]。近年来,随着深度学习的发展,面向船舶分割的研究持续推进,但多数聚焦于遥感图像[2]和合成孔径雷达(SAR)图像[3]及红外图像[4]等非可见光场景。在复杂水域环境中,可见光图像具有更直观的细节信息和更高的感知分辨率,因此在船舶结构级别的视觉分割中具有不可替代的价值。然而,由于水面环境复杂、可见光船舶区域目标特征弱化和尺度差异性显著导致分割精度降低。本文针对复杂背景中船舶区域分割精度低,模型计算资源开销大等问题,提出改进YOLO11n-seg船舶区域分割方法。当前基于深度学习的图像实例分割方法主要分为两阶段和单阶段两大类[5]。两阶段方法以检测-分割流程为主,例如,Hariharan等[6]提出的SDS算法是早期的实例分割方法,但分割精度较粗糙。He等[7]在Faster R-CNN基础上提出的Mask R-CNN[8]成为经典代表,兼具检测和分割效果。然而,两阶段方法计算复杂度高、推理速度慢,难以部署在资源受限场景。单阶段目标检测算法[9]的兴起进而衍生出一系列单阶段实例分割算法。Wang等[10]在FCN基础上提出SOLO算法,将检测与分割统一建模,后续改进为并行结构的SOLOv2[11],显著提升处理速度。Bolya等[12]结合ResNet和FPN提出YOLACT和YOLACT++[13]。针对船舶等场景,已有研究尝试提升多尺度感知能力,如Ke等[14]为应对SAR图像中小目标分割难题,提出尺度感知注意力网络。Tan 等[15]在YOLOv5中引入多尺度检测层,改善遥感图像小目标检测精度。孙雨鑫等[16]空间注意力机制嵌入SOLO,缓解背景干扰问题,但硬件资源需求较高。王磊等[17]基于YOLOv8利用结构重参数与可切换空洞卷积提升多尺度SAR舰船整体分割能力。Huang等[18]融合ViT与YOLO11构建 NST-YOLO11,实现近岸SAR场景中的检测,但计算成本显著增加。Gan等[19]基于YOLO11构建轻量检测网络,兼顾部署效率和检测精度,仍存在复杂背景下多目标分割能力不足的问题。

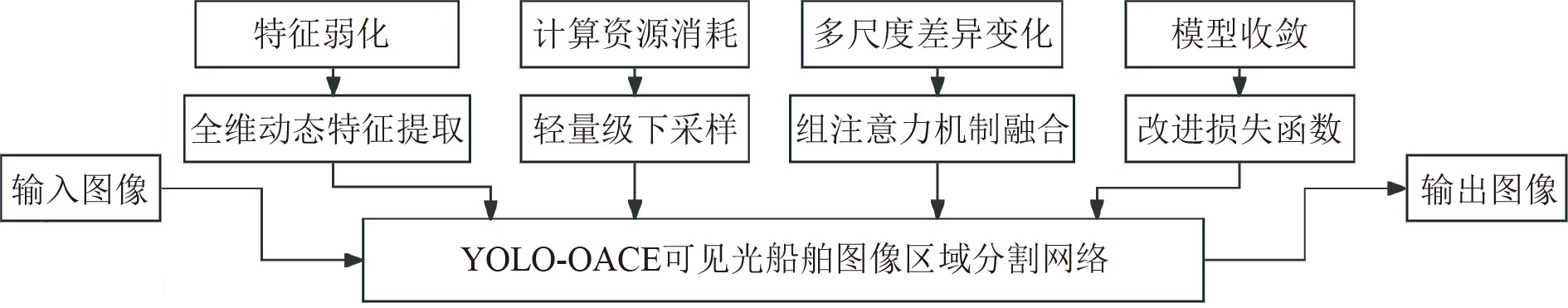

综上,现有方法在可见光船舶结构区域分割中仍面临复杂背景干扰、多尺度差异影响及模型参数过大等挑战,导致分割精度较低及嵌入式部署受限。针对上述问题,本文基于YOLO11n-seg框架,提出一种新型改进的船舶区域分割方法 YOLO-OACE,其主体结构示意图如图1所示。构建全维动态特征提取模块来提升复杂背景下目标区域表征能力;利用轻量化ADown下采样策略保留小目标关键特征,压缩冗余来降低计算资源消耗;融合组注意力机制提升多尺度目标的动态聚焦与分割适应性。EIOU通过加强宽高约束,优化边界框回归精度,加速模型收敛,本文构建了可见光船舶区域分割数据集,并在该数据集上对所提方法进行了充分实验。结果表明,YOLO-OACE在精度和计算资源消耗方面均优于现有方法,可为船舶视觉感知与水上智能导航提供有效技术支持。

|

图 1 YOLO-OACE改进网络结构示意图 Fig. 1 Schematic diagram of YOLO-OACE improved network structure |

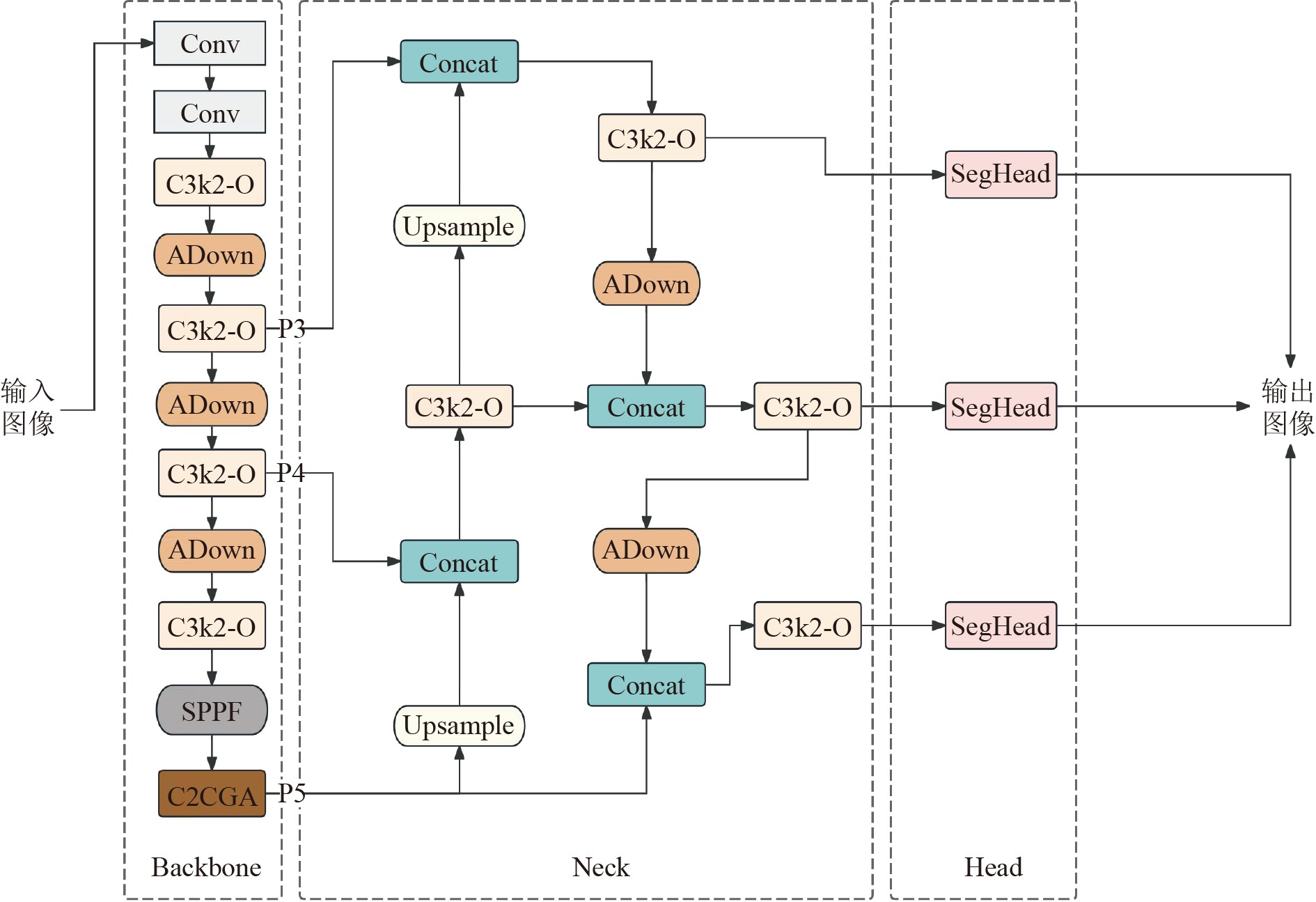

YOLO11是Ultralytics公司继YOLOv8后发布的最新改进版本,其不仅在目标检测领域应用广泛同时还支持实例分割、姿态估计等多种图像处理任务,并且具有不同规模的模型来满足场景需求。YOLO11的网络结构可分为骨干网络、颈部网络和头部网络三部分。本文提出的基于YOLO11n-seg的改进分割网络即YOLO-OACE网络结构如图2所示。

|

图 2 YOLO-OACE网络框架图 Fig. 2 YOLO-OACE network framework diagram |

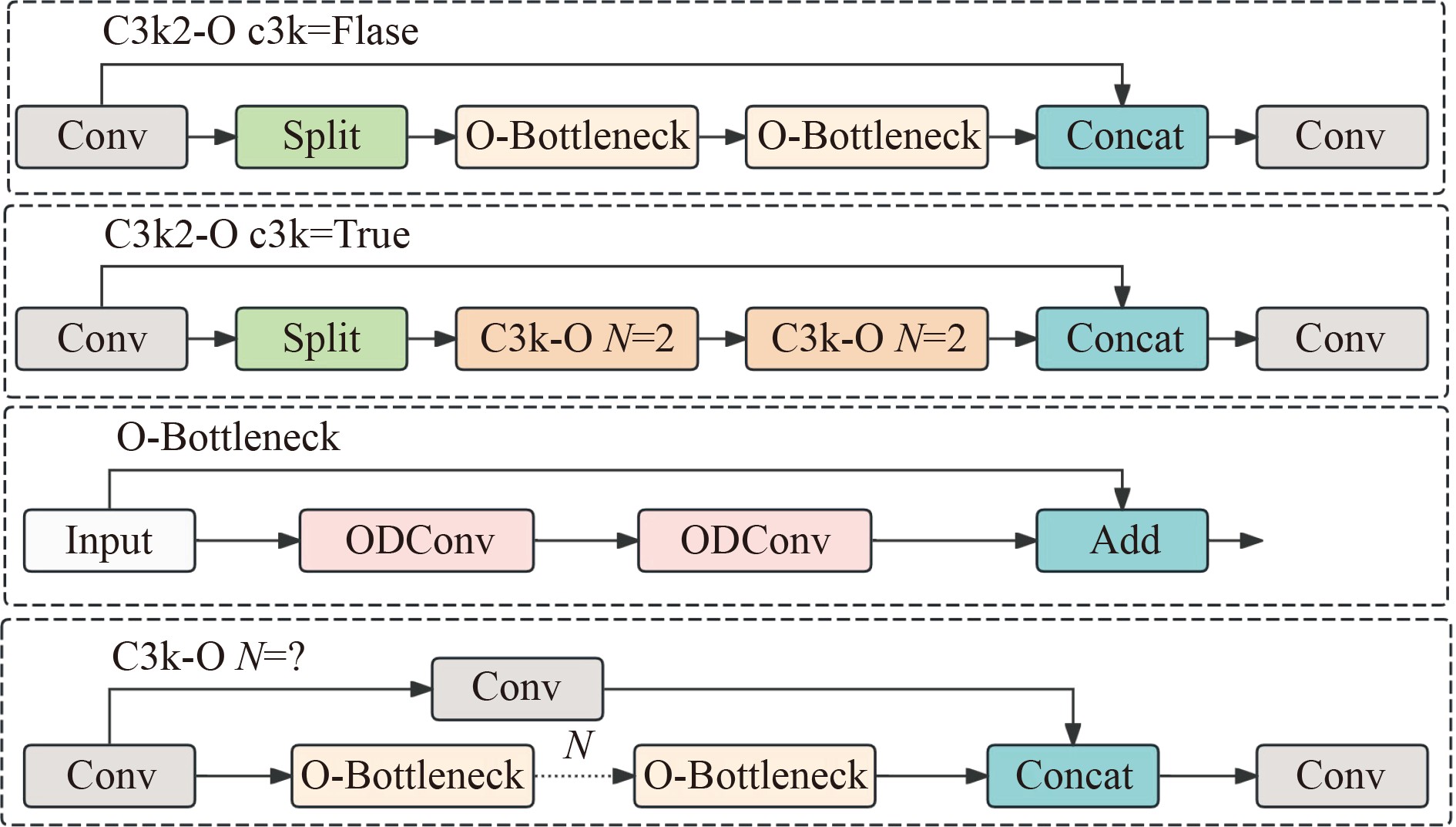

YOLO11使用动态卷积相对于YOLOv8的C2f模块在提取特征性能上有所改良,但在面对船舶区域小目标分割和复杂背景干扰时处理能力略显不足,难以捕获到更深层次的语义信息。为解决这些问题,本文将ODConv[20]引入特征提取模块,构建出全新的特征提取模块即C3k2-O模块,如图3所示。C3k2-O模块利用ODConv高效的并行策略和计算方式,能够有效识别细节和边界特征,更精准地建模多尺度目标之间的关系。此设计也可以扩展感受野结合通道分离策略,使模型能够获取船舶部件图像之间更加丰富的上下文细节信息,提供了更强大的特征提取能力,尤其适合复杂水域背景中船舶区域小目标的分割场景。

|

图 3 C3k2-O模块结构图 Fig. 3 Structure of C3k2-O module |

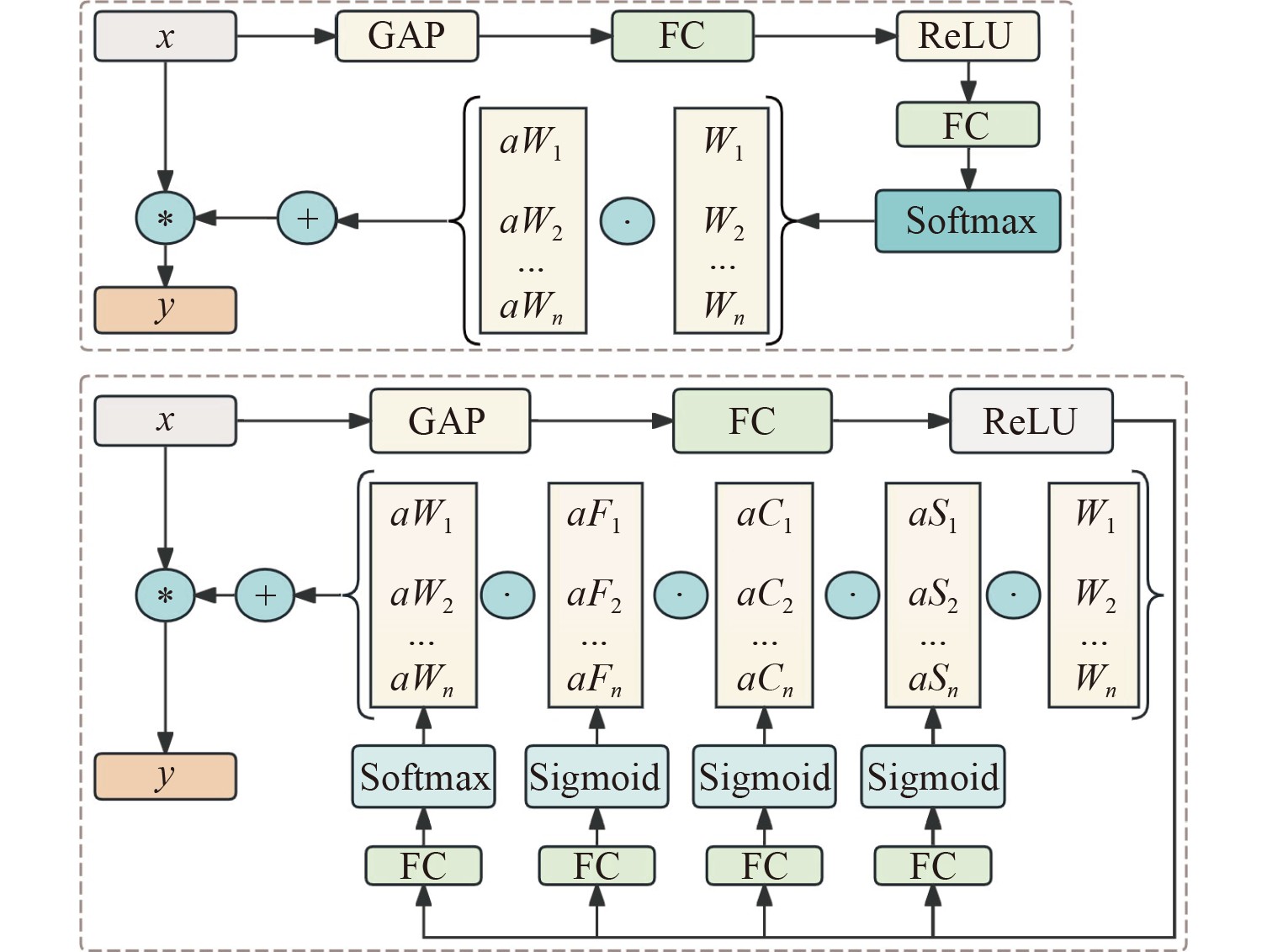

传统动态卷积仅利用卷积核数量的动态性,而ODConv同时关注卷积核数量、空间大小、输入通道、输出通道4个维度上的动态性。如图4所示,将输入特征图首先通过全局平均池化压缩到具有输入通道长度的特征向量中,随后,完全连接层(FC层)将压缩特征向量映射到具有缩减比为r的低维空间,ReLU函数位于FC层之后,对于4个头部分支,每个分支都有一个输出为

|

图 4 传统动态卷积(上)和ODConv卷积(下) Fig. 4 Conventional dynamic convolution (top) and ODConv convolution (bottom) |

| $ y = \left( {{a_{\omega 1}}{W_1} + \cdot \cdot \cdot + {a_{\omega n}}{W_n}} \right) * x 。$ | (1) |

式中:

| $ \begin{split} y = &{a_{\omega 1}} \otimes {a_{f1}} \otimes {a_{c1}} \otimes {a_{s1}} \otimes {W_1}*x + \\ &\cdot \cdot \cdot + {a_{\omega n}} \otimes {a_{fn}} \otimes {a_{cn}} \otimes {a_{sn}} \otimes {W_n}*x 。\\ \end{split} $ | (2) |

式中:

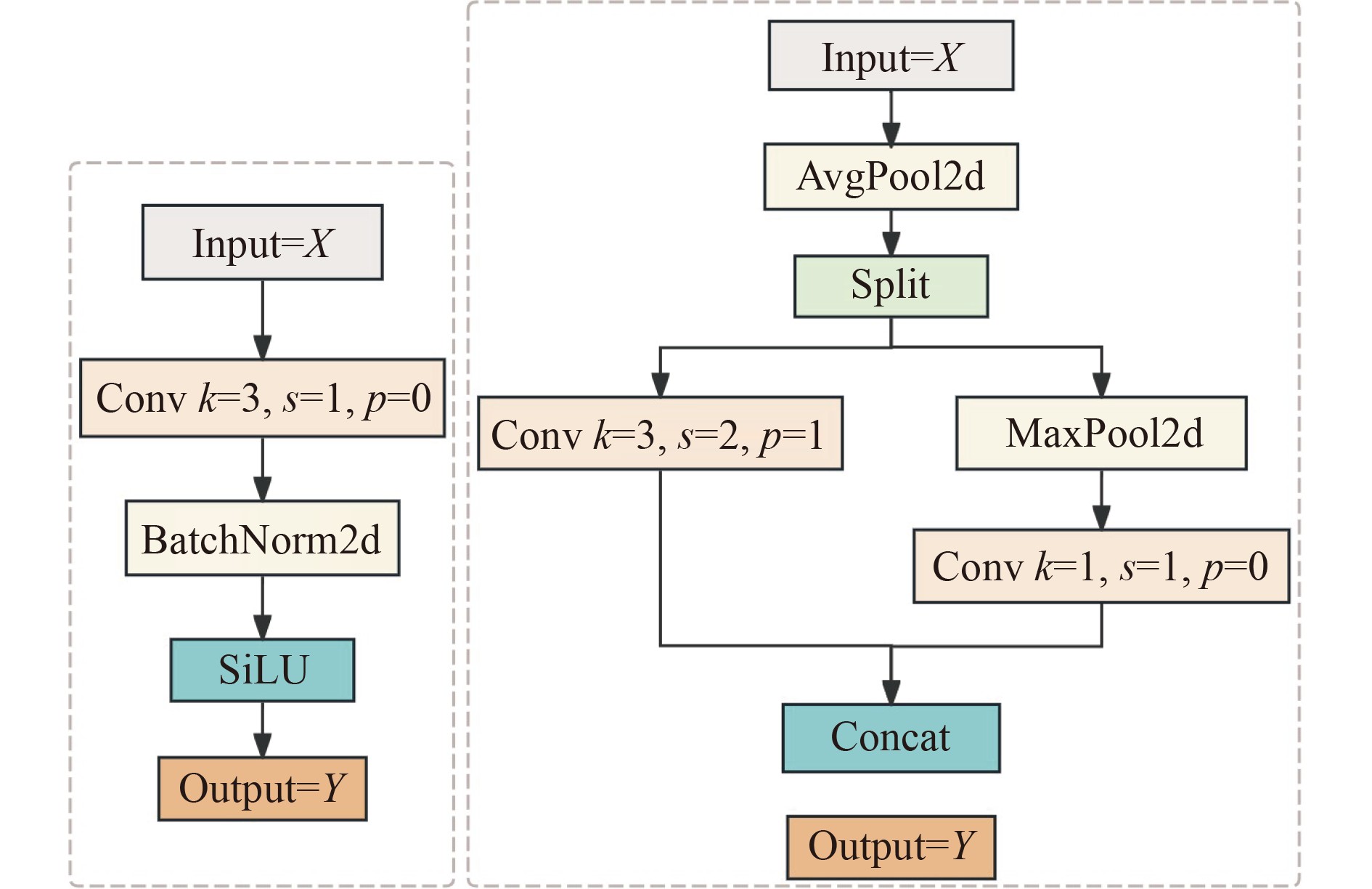

网络在提取船舶区域特征信息的过程中,传统卷积下采样由于固定的卷积核大小和步长容易导致区域特征信息丢失,尤其是在船舶目标较小或特征不明显时,标准卷积以较大步长下采样可能会直接忽略这些信息。为解决传统下采样操作带来的负面影响,采用 ADown[21]下采样,通过使用平均池化和最大池化2种方式来助力模型捕获船舶区域结构部件的局部重要特征并保留全局信息。2种下采样过程如图5所示。

|

图 5 传统下采样(左)和ADown下采样(右) Fig. 5 Conventional downsampling (left) and ADown downsampling (right) |

左侧为传统下采样过程,即输入经过卷积操作、批量归一化和SiLU激活函数实现下采样过程。右侧为ADown下采样过程,输入经过平均池化后分为2个分支,其中一个经过卷积操作与另一个经过最大池化、卷积后拼接。2个并行分支可以加快处理速度,还能提供更多的特征组合和信息交互,防止船舶小区域目标特征信息丢失过多。

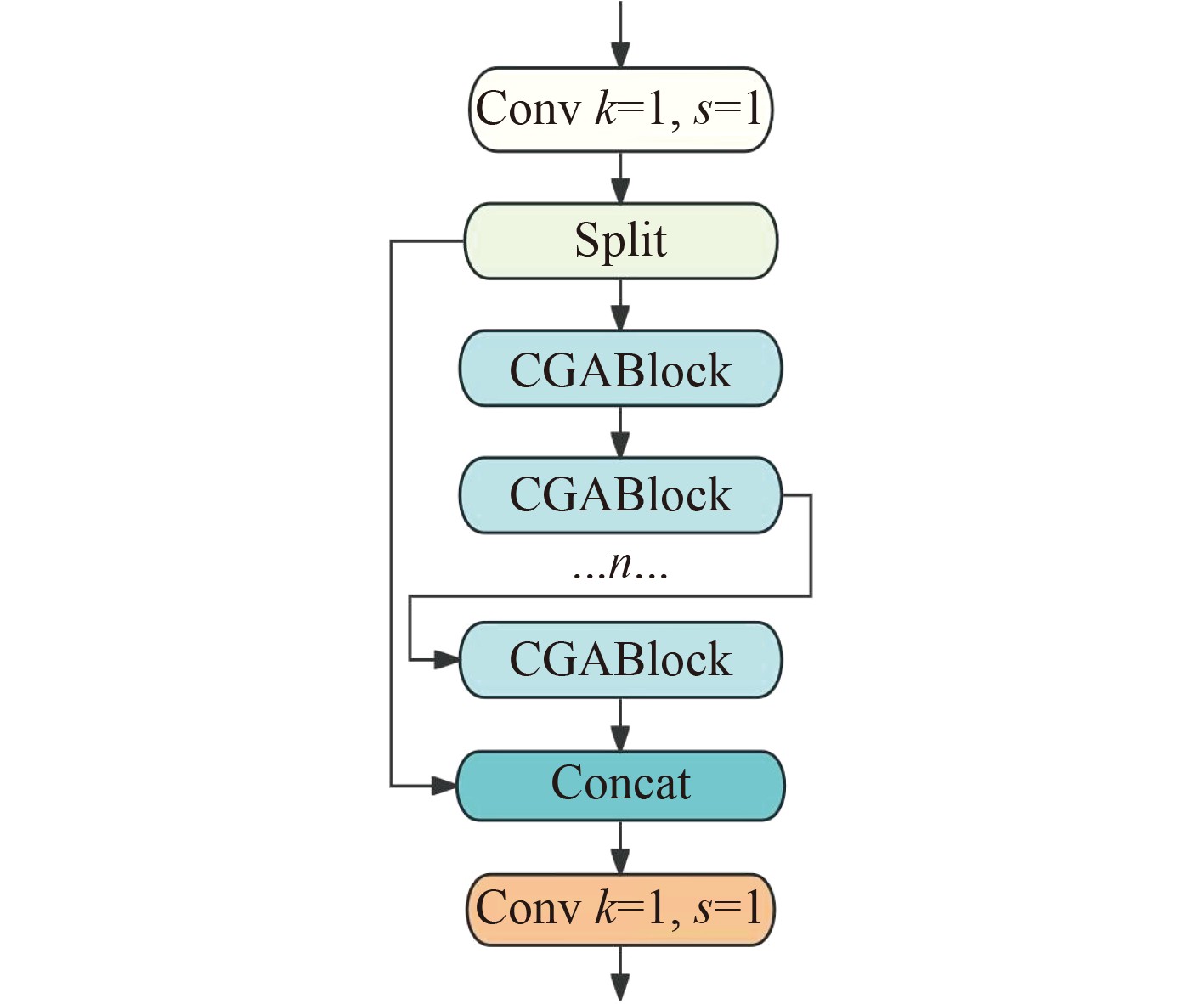

1.3 颈部网络中特征增强模块改进由于船舶区域目标特征尺寸变化大,在可见光图像中具体特征不明显,这导致需要高分辨的特征图才能完成区域部件的精确分割。在YOLO11中,C2PSA模块在高分辨率的船舶图像时会使得训练和推理过程变得较为缓慢。此外,单一的二维空间注意力机制不足以捕捉到图像中多层次的深度空间关系,尤其是在处理不同尺度的小区域船舶区域目标时,空间信息会出现部分丢失。因此,在特征增强过程中嵌入组注意力机制[22],成为新的特征增强模块,即C2CGA模块,结构如图6所示。

|

图 6 C2CGA模块结构图 Fig. 6 Structure of C2CGA module |

C2CGA模块使用组注意力机制,首先通过将特征分组并应用注意力机制在组内进行自适应加权,能够在不同尺度的目标中有效地捕捉空间关系。相比于C2PSA的二维空间注意力,组注意力机制能够更加细粒度地处理不同空间区域的特征。其次延续了级联结构,通过级联多个组注意力层,模型能够在不同层次上捕获到从低级到高级的特征,增强模型对复杂图像场景的处理能力。最后通过对特征进行自适应调整,动态地调节各个区域的关注度,从而更好地应对不同环境下目标的变换,这种方式比传统的固定区域关注更为灵活和高效。

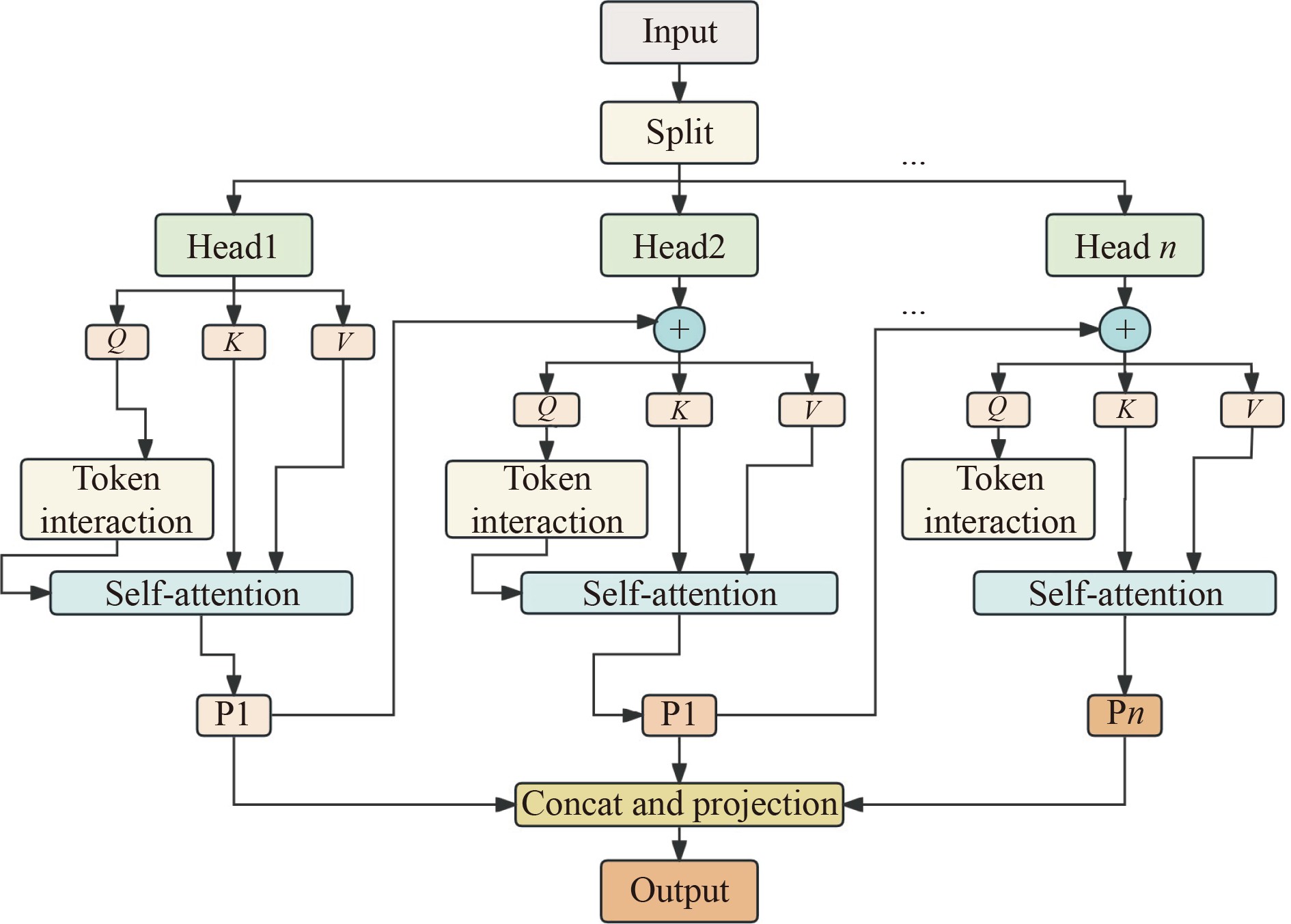

C2CGA模块中的CGABlock具体结构如图7所示。CGA为每个头部提供不同输入的分割,并跨头部级联输出特征,整个过程描述为:

|

图 7 CGABlock结构图 Fig. 7 CGABlock structure |

| $ \left\{\begin{gathered} {{\tilde X}_{_{ij}}} = Attn\left( {{X_{ij}}W_{ij}^Q,{X_{ij}}W_{ij}^K,{X_{ij}}W_{ij}^V} \right), \\ {{\tilde X}_{i + 1}} = Concat{\left[ {{{\tilde X}_{_{ij}}}} \right]_{j = 1:h}}W_i^P。\\ \end{gathered}\right. $ | (3) |

式中:

在船舶区域分割数据集中,由于船舶区域目标大小差异较大,背景相似且存在标注质量不一的问题。YOLO11使用CIoU[23]损失函数,通过减小预测框与真实框的中心距离来加速收敛,但中心距离是归一化到对角线长度上的,在船舶小区域目标特征图上即使中心点偏差较大也会带来很小的惩罚,导致对小目标定位不精准。EIoU[24]损失函数考虑了重叠面积、中心点距离和长宽边长真实差,在CIoU的惩罚项基础上将纵横比的损失项拆分成预测的宽高分别计算与最小外接框宽高的差值,加速了收敛过程,并添加Focal Loss优化边界框回归任务中的样本不平衡问题。

| $ \begin{split} & {L_{EIOU}} ={L_{IOU}} + {L_{dis}} + {L_{asp}} = \\ & 1 - IOU + \frac{{{\rho ^2}\left( {b,{b^{gt}}} \right)}}{{{{\left( {{w^c}} \right)}^2} + {{\left( {{h^c}} \right)}^2}}} + \frac{{{\rho ^2}\left( {w,{w^{gt}}} \right)}}{{{{\left( {{w^c}} \right)}^2}}} + \frac{{{\rho ^2}\left( {h,{h^{gt}}} \right)}}{{{{\left( {{h^c}} \right)}^2}}}。\\[-1pt] \end{split} $ | (4) |

式中:

目前世界上公开的船舶图像数据集大多用于船舶整体的检测与分割,不能满足船舶区域分割的需求。本文主要以各类典型船舶为主要对象构建船舶区域分割数据集,其中包括矿砂船、散货船、集装箱船、渔船、邮轮、游艇、帆船等多类型目标。主要的数据来源包含3个部分:在长江武汉段实地拍摄图像、抽取由武汉大学开源的SeaShip[25]含有船舶的图像和网络下载的船舶图像。使用开源标注工具Labelme对数据集中的船舶区域实例进行标注,数据集图像总数为

|

图 8 数据集图像示例 Fig. 8 Example of dataset image |

实验平台采用CentOS15.3作为操作系统,搭载Intel(R) Xeon(R) Platinum 8280M主频为2.60 GHz。系统内存为32GB,显卡为Nvidia GeForce RTX

根据船舶区域分割实验的需要,选取精度(Precision,P)、查全率(Recall,R)、平均精度(Average Precision,AP)、平均精度均值(Mean of average precision,mAP)、参数量(Parameters)、计算量(GFLOPs)和模型大小等指标来评估模型的性能。其中精度(P)是指模型预测结果为正的样本中真的正样本所占的比例,如式(5)所示;查全率(R)是指所有正例中被模型正确预测出来的比例,如式(6)所示;平均精度(AP)是指精度-召回率曲线下围成的面积,如式(7)所示;均值平均精度(mAP)是平均精度的均值,如式(8)所示;而参数量、计算量和模型权重大小是衡量模型轻量化的重要指标。

| $ P = \frac{{TP}}{{TP + FP}} \times 100{\text{%}},$ | (5) |

| $ R = \frac{{TP}}{{TP + FN}} \times 100{\text{%}},$ | (6) |

| $ AP = \int_0^1 {P\left( R \right){\mathrm{d}}\left( R \right)},$ | (7) |

| $ mAP = \frac{1}{n}\sum\limits_{i = 0}^n {A{P_i}} \times 100{\text{%}}。$ | (8) |

式中:TP为正样本被正确识别的数量;FP为误判的负例数量;FN为漏判的正例数量。

2.4 对比实验YOLO11-seg有5种不同规模大小的模型,分别为:n、s、m、l和x。经过实验表明,YOLO11n-seg在保持较高分割性能的同时具有最小的参数量、计算量和模型体积。因此,选择YOLO11n-seg作为基线模型开展研究。各个规模大小的模型实验数据如表1所示。

|

|

表 1 YOLO11-seg不同规模大小模型的性能比较 Tab.1 Performance comparison of YOLO11-seg models with different scale sizes |

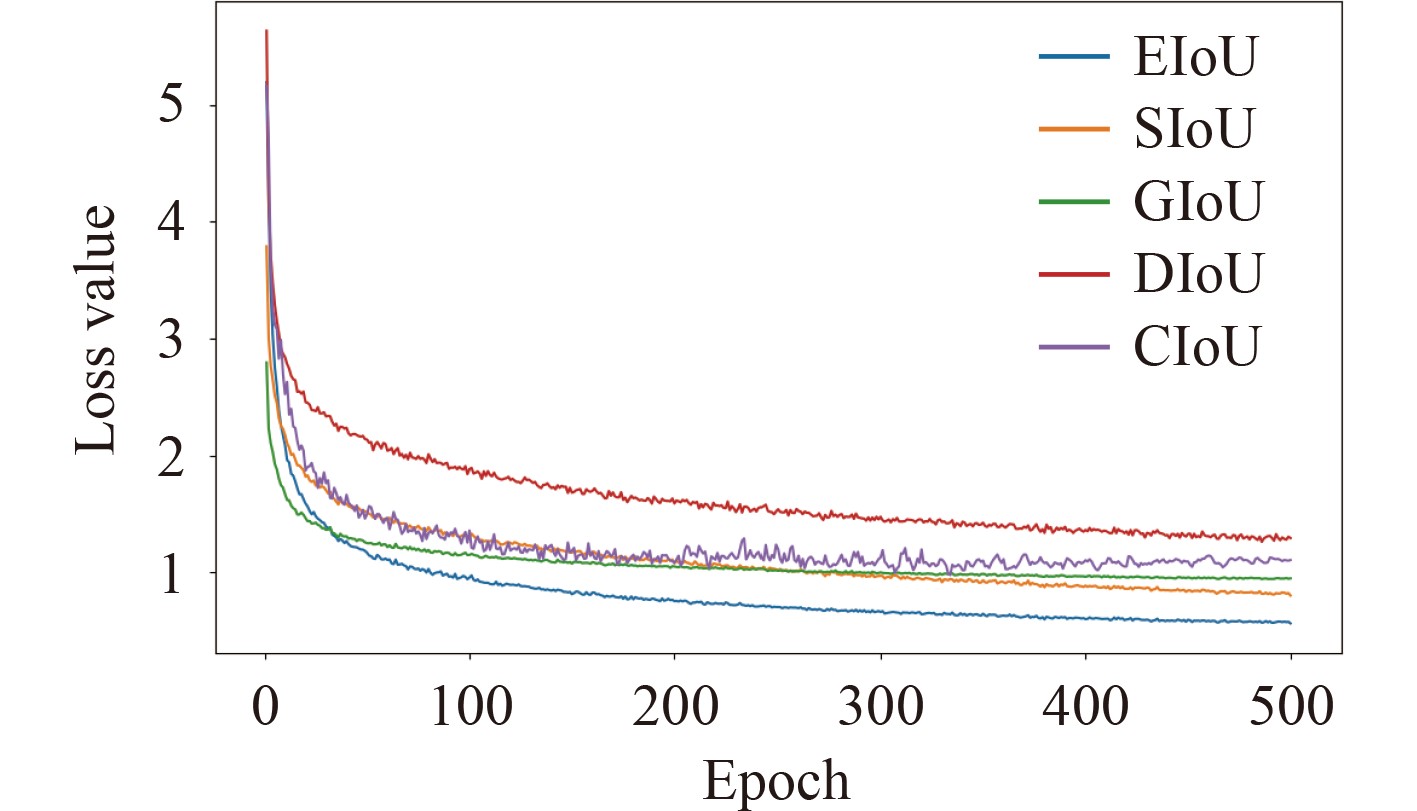

为验证本文所用的损失函数相较于其他的损失函数对船舶区域分割精度提升的有效性,对不同的损失函数进行对比实验,结果如表2所示。可以看出,相对于YOLO11所用的CIoU损失函数,DIoU、GIoU、SIoU、EIoU在mAP50-95指标上变化不大,但在mAP50指标上的提升值分别为−3.3%、0.7%、1.3%和2.4%,EIoU具有最高的精度提升值。YOLO-OACE在不同损失函数上的收敛情况如图9所示,可以看出使用EIoU的模型收敛速度明显加快,且具有更低的损失值。

|

|

表 2 不同损失函数对比 Tab.2 Comparison of different loss functions |

|

图 9 YOLO-OACE的不同损失函数曲线对比 Fig. 9 Comparison of different loss function curves for YOLO-OACE |

为证明本文提出的改进网络模型在提高可见光船舶区域分割效果中的有效性,在自建数据集上,将改进的YOLO-OACE分割模型与其他先进的分割模型进行对比实验,实验结果如表3所示。

|

|

表 3 不同模型的船舶部件分割性能对比 Tab.3 Comparison of segmentation performance of ship components with different models |

可以看出,本文提出的YOLO-OACE分割网络对船舶区域分割的性能均优于其他分割网络。与YOLO11n-seg相比,YOLO-OACE的平均精度提升4.7%,计算量下降21%,参数量减少16%,模型大小缩减0.8 MB,说明本文构建的网络具体更高的分割精度且更轻量化。同时与更大规模的YOLO11s-seg对比,二者整体分割精度相近,但YOLO-OACE的参数量和计算量远小于YOLO11s-seg,说明YOLO-OACE分割网络更适合部署在边缘设备上。

2.5 消融实验为了进一步验证本文设计的全维动态采样C3k2-O模块、Adown下采样操作、特征增强C2CGA模块和EIoU损失函数的有效性,在可见光船舶区域分割数据集上进行消融实验。具体实验步骤为对基线YOLO11n-seg分割网络中依次添加全维动态采样C3k2-O模块、Adown下采样操作、特征增强C2CGA模块和EIoU损失函数,通过对比实验结果中的mAP50值、mAP50−95值、参数量和计算量来验证各个改进模块对分割性能的影响。消融实验具体的实验结果如表4所示。

|

|

表 4 消融实验结果 Tab.4 Results of ablation experiments |

可知,各个结构的改进对船舶区域分割性能的提升均有显著作用且各个模块的组合使用能够帮助模型在保持较高分割精度的同时兼顾轻量化,在精度和速度之间取得平衡。

2.6 泛化实验在MaSTr1325数据集上进行泛化实验,结果如表5所示。在mAP50指标上具有2%的精度提升,说明YOLO-OACE分割网络具有一定的泛化能力,在提升分割精度的同时兼具轻量化的网络结构。

|

|

表 5 MaSTr1325数据集泛化实验结果 Tab.5 Results of generalization experiments on MaSTr1325 dataset |

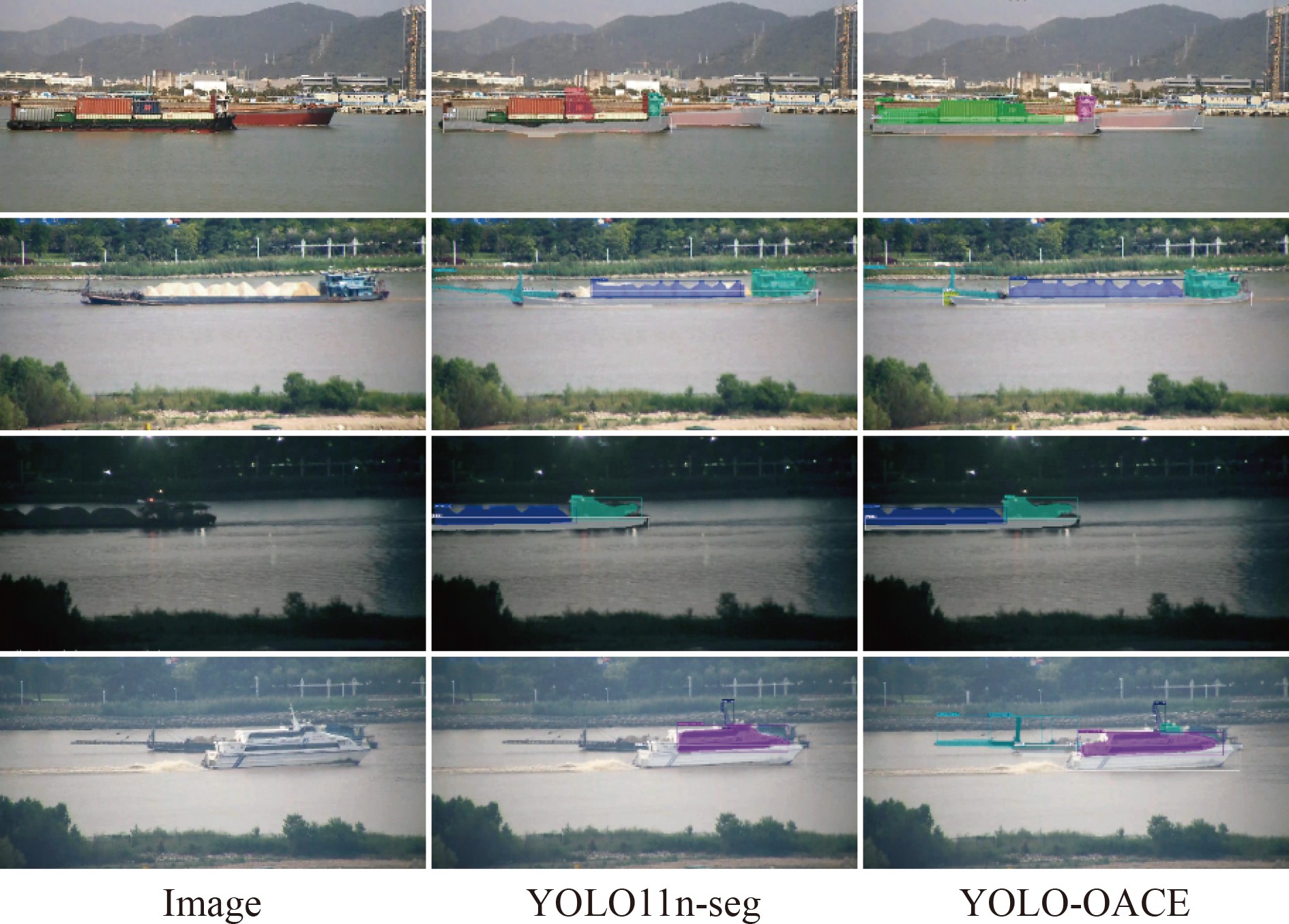

如图10所示,从左至右分别是原始图片、YOLO11n-seg分割结果和YOLO-OACE分割结果,用矩形框表示,并标注了分割类别和置信度。可以看出,相对于YOLO11n-seg,YOLO-OACE对船舶区域部件进行分割时具有更高的分割精度,并且有效改善遗漏分割和错误分割的情况。根据以上实验结果表明本文提出的基于YOLO11n-seg改进模型能够对复杂背景中的船舶区域进行高效分割。

|

图 10 分割效果对比 Fig. 10 Segmentation effect comparison |

针对可见光船舶图像分割领域存在的技术挑战——复杂背景下小目标特征模糊、目标尺寸差异显著导致分割精度受限及计算成本较高,本研究基于YOLO11n-seg框架提出改进型YOLO-OACE分割网络。实现4项关键技术改进:1)构建C3k2-O全维动态特征提取模块,通过多尺度特征融合强化网络对船舶边界与纹理细节的捕捉能力;2)采用ADown轻量化下采样策略替代标准卷积操作,在抑制小目标信息丢失的同时降低特征图冗余度;3)设计C2CGA模块集成组注意力机制,通过动态权重分配增强网络对多尺度船舶目标的特征适应性;4)引入EIoU损失函数优化边界回归机制,通过改进宽高约束项提升分割精度与训练效率。实验验证表明:相较于YOLO11n-seg基准模型,YOLO-OACE的平均分割精度(mAP)提升4.7%,计算量(FLOPs)降低21%,参数量(Params)减少16%,模型体积压缩0.8 MB,在保持高精度分割性能的同时显著降低了硬件部署成本。该研究成果可为海洋环境监测、船舶智能航行和水面纯视觉定位等场景中的实时目标分割提供高效解决方案,具有重要的工程应用价值。

| [1] |

黄琛, 陈德山, 吴兵, 等. 船舶航行交通事件实时检测技术研究现状与展望[J]. 交通信息与安全, 2022, 40(6): 1-11. HUANG Chen, CHEN Deshan, WU Bing, et al. A real-time detection of nautical traffic events: A review and prospect[J]. Journal of Transport Information and Safety, 2022, 40(6): 1-11. DOI:10.3963/j.jssn.1674-4861.2022.06.001 |

| [2] |

HORDIIUK D, OLIINYK I, HNATUSHENKO V, et al. Semantic segmentation for ships detection from satellite imagery[C]//2019 IEEE 39th International Conference on Electronics and Nanotechnology (ELNANO). IEEE, 2019: 454-457.

|

| [3] |

CHATURVEDI S K. Study of synthetic aperture radar and automatic identification system for ship target detection[J]. Journal of Ocean Engineering and Science, 2019, 4(2): 173-182. DOI:10.1016/j.joes.2019.04.002 |

| [4] |

GAO Z, LIU Z, ZHANG T. Infrared ship target segmentation based on adversarial domain adaptation[J]. Data Acquis. Process., 2023, 38(3): 598-607. |

| [5] |

DAI J, HE K, LI Y, et al. Instance-sensitive fully convolutional networks[C] //Computer Vision–ECCV 2016: 14th European Conference, Amsterdam, The Netherlands, October 11-14, 2016, Proceedings, Part VI 14. Springer International Publishing, 2016: 534-549.

|

| [6] |

HARIHARAN B, ARBELÁEZ P, GIRSHICK R, et al. Simultaneous detection and segmentation[C] //Computer Vision–ECCV 2014: 13th European Conference, Zurich, Switzerland, September 6-12, 2014, Proceedings, Part VII 13. Springer International Publishing, 2014: 297-312.

|

| [7] |

REN S, HE K, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE transactions on pattern analysis and machine intelligence, 2016, 39(6): 1137-1149. |

| [8] |

HE K, GKIOXARI G, DOLLÁR P, et al. Mask r-cnn[C]//Proceedings of the IEEE international conference on computer vision. 2017: 2961-2969.

|

| [9] |

张文凯, 余敏, 刘浩煜, 等. 低检测置信度下轻量化水下多目标跟踪算法[J]. 舰船科学技术, 2025, 47(6): 128-133. ZHANG W K, YU M, LIU H Y, et al. A light underwater multi-object tracking algorithm with low detection confidence[J]. Ship Science and Technology, 2025, 47(6): 128-133. DOI:10.3404/j.issn.1672-7649.2025.06.021 |

| [10] |

WANG X, KONG T, SHEN C, et al. Solo: Segmenting objects by locations[C]//Computer Vision–ECCV 2020: 16th European Conference, Glasgow, UK, August 23–28, 2020, Proceedings, Part XVIII 16. Springer International Publishing, 2020: 649-665.

|

| [11] |

WANG X, ZHANG R, KONG T, et al. Solov2: Dynamic and fast instance segmentation[J]. Advances in Neural information processing systems, 2020, 33: 17721-17732. |

| [12] |

BOLYA D, ZHOU C, XIAO F, et al. Yolact: Real-time instance segmentation[C]//Proceedings of the IEEE/CVF international conference on computer vision, 2019: 9157-9166.

|

| [13] |

HUANG M, XU G, LI J, et al. A method for segmenting disease lesions of maize leaves in real time using attention YOLACT++[J]. Agriculture, 2021, 11(12): 1216. DOI:10.3390/agriculture11121216 |

| [14] |

KE X, ZHANG T, SHAO Z. Scale-aware dimension-wise attention network for small ship instance segmentation in synthetic aperture radar images[J]. Journal of Applied Remote Sensing, 2023, 17(4): 046504-046504. |

| [15] |

TAN S, YAN J, JIANG Z, et al. Approach for improving YOLOv5 network with application to remote sensing target detection[J]. Journal of Applied Remote Sensing, 2021, 15(3): 036512-036512. |

| [16] |

孙雨鑫, 苏丽, 陈禹升, 等. 基于注意力机制的 SOLOA 船舶实例分割算法[J]. 智能系统学报, 2023, 18(6): 1197-1204. SUN Y X, SU L, CHEN Y S, et al. SOLOA ship instance segmentation algorithm based on attention[J]. CAAI transactions on intelligent systems, 2023, 18(6): 1197-1204. DOI:10.11992/tis.202210039 |

| [17] |

王磊, 张斌, 吴奇鸿. RCSA-YOLO: 改进 YOLOv8 的 SAR 舰船实例分割[J]. 计算机工程与应用, 2024, 60(18): 1.3−113. WANG L, ZHANG B, WU Q H. RCSA-YOLO: Improved SAR Ship Instance Segmentation of YOLOv8[J]. Journal of Computer Engineering & Applications, 2024, 60(18): 1.3−113. |

| [18] |

HUANG Y, WANG D, WU B, et al. NST-YOLO11: vit merged model with neuron attention for arbitrary-oriented ship detection in SAR images[J]. Remote Sensing, 2024, 16(24): 4760. DOI:10.3390/rs16244760 |

| [19] |

GAN Y, REN X, LIU H, et al. A novel lightweight YOLO11-based framework for precisely locating diverse ship targets in complex optical remote sensing photographs[J]. Measurement Science and Technology, 2025, 36(4): 045409. DOI:10.1088/1361-6501/adc75b |

| [20] |

LI C, ZHOU A, YAO A. Omni-dimensional dynamic convolution[J]. arXiv preprint arXiv: 2209.07947, 2022.

|

| [21] |

WANG C Y, YEH I H, MARK LIAO H Y. Yolov9: Learning what you want to learn using programmable gradient information[C]//European conference on computer vision. Cham: Springer Nature Switzerland, 2024: 1-21.

|

| [22] |

LIU X, PENG H, ZHENG N, et al. Efficientvit: Memory efficient vision transformer with cascaded group attention[C] //Proceedings of the IEEE/CVF conference on computer vision and pattern recognition. 2023: 14420-14430.

|

| [23] |

ZHENG Z, WANG P, REN D, et al. Enhancing geometric factors in model learning and inference for object detection and instance segmentation[J]. IEEE transactions on cybernetics, 2021, 52(8): 8574-8586. |

| [24] |

ZHANG Y F, REN W, ZHANG Z, et al. Focal and efficient IOU loss for accurate bounding box regression[J]. Neurocomputing, 2022, 506: 146-157. DOI:10.1016/j.neucom.2022.07.042 |

| [25] |

SHAO Z, WU W, WANG Z, et al. Seaships: a large-scale precisely annotated dataset for ship detection[J]. IEEE transactions on multimedia, 2018, 20(10): 2593-2604. DOI:10.1109/TMM.2018.2865686 |

2026, Vol. 48

2026, Vol. 48