声呐目标识别是水下声呐探测的难点问题。被动声呐利用目标的辐射噪声进行隐蔽性目标识别[1]。

水下目标识别通常需要经过目标特征提取、目标特征识别2个步骤。在目标特征提取方面,短时傅里叶变换、小波变换等方法将水声信号转换为同时具有时域、频域信息的时频谱图,可极大提高特征提取的效率。近年来,一种模拟人耳听觉特性的梅尔倒谱系数(MFCC)特征在语音识别领域得到广泛运用,针对水声目标识别领域的应用正是当下研究的热点[2]。在目标特征识别方面,随着人工智能技术的发展,越来越多的专家学者致力于数据驱动的智能算法在水声目标识别方面的应用研究。MENG等[3]设计支持向量机(SVM)对两类水声信号进行分类。张少康等[4]首次将长短时记忆网络(LSTM)应用在水声识别领域,分别对水声信号的时间序列、频域频谱和MFCC数据进行训练。王升贵等[5]利用二维卷积神经网络(2D-CNN)提取水声信号的二维时频谱图特征,利用全连接层进行7类信号分类识别。于学洋等[6]采用了一种针对音频检测Visual Geometry Group(VGG)网络模型,结合迁移学习的预训练效果,改善了在小数据集上的过拟合情况。曹赛等[7]提出一种基于水下目标多模态特征的深度学习方法,将信号的一维时域和二维频域特征进行融合,利用长短时记忆网络和卷积神经网络(CNN)对其并行处理。

上述研究方法基本均采用了单网络学习模型,有效提高了目标特征的识别准确率,但尚未达到100%。本文通过对水声信号进行关键特征提取,并基于集成学习方法对神经网络模型进行训练,可进一步提高模型的识别准确率,即针对被动声呐接收的水声信号,提取时频谱图、梅尔语谱图2种特征分别训练VGGNet、ResNet等多种的单网络模型,并按照堆叠法(Stacking)法进行集成,构建多网络集成模型,进一步提高目标识别的准确率,同时提高模型的鲁棒性和泛化能力。

1 时频谱图和梅尔语谱图1)时频谱图

将水声信号进行分帧、加窗,再对每一帧信号进行傅里叶变换,可以得到每帧信号对应的频谱,并将其沿时间维度进行堆叠,可以得到水声信号的二维表现形式,即时频谱图。

2)梅尔语谱图

人的听觉对频率具有选择性,使得人耳不仅可以提取声信号的语义信息,还能提取说话人的个人特征。基于这一原理,研究提出了梅尔倒谱系数,将线性频谱映射到基于听觉感知的梅尔非线性谱上,普通频率转化为梅尔频率的公式为:

| $ mel(f) = 2\ 595 \times {\log _{10}}(1 + f/700) 。$ | (1) |

将梅尔频率作为坐标轴可得到梅尔语谱图。

2 卷积神经网络单网络模型卷积神经网络基本结构包括卷积层、池化层和全连接层。不同的卷积神经网络在训练精度、训练速度等方面存在差异,分别具有不同的学习性能。

VGGNet网络堆叠了多层卷积层,其中使用多个小卷积核来代替大卷积核以加深网络结构,可以提取到更高维度、更丰富的特征信息,进一步提高网络的学习能力[8]。

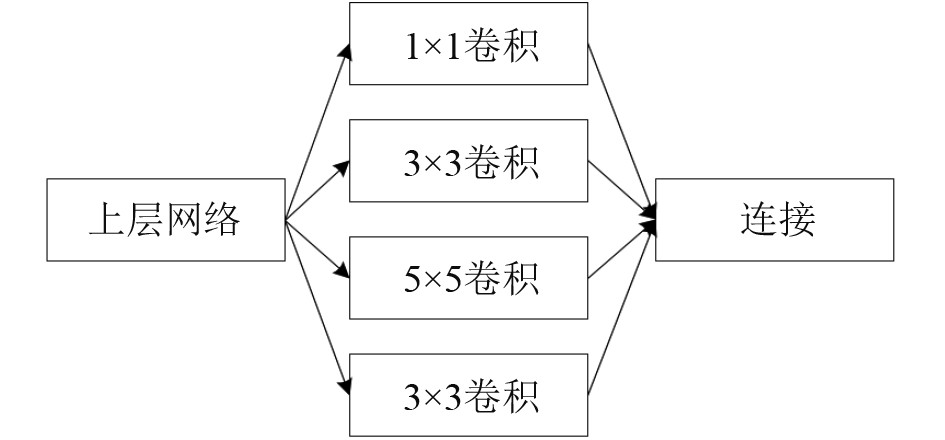

GoogLeNet通过Inception模块将多个卷积层和池化层并联起来,利用不同大小的卷积核来实现对输入特征不同尺度的感知,再将输出进行拼接运算,如图1所示。该方法能够有效提高网络的深度和宽度,可更高效地利用计算资源,在相同计算量下能够提取到更多特征,从而提升训练效果[9]。

|

图 1 Inception模块结构图 Fig. 1 Inception module structure diagram |

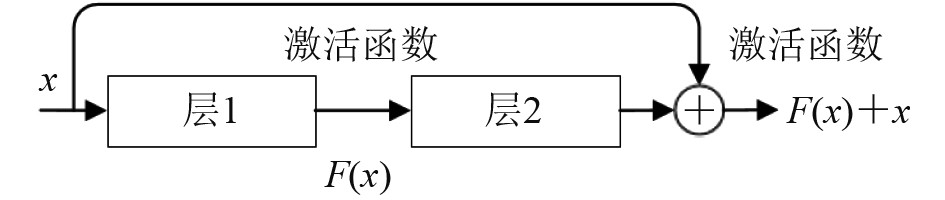

残差网络(ResNet)是用于解决网络退化问题的网络结构,其核心模块残差结构(residual)如图2所示[10]。

|

图 2 residual结构示意图 Fig. 2 Structure diagram of residual |

图2中通过引入residual结构,建立跨层连接,令浅层特征可以通过恒等映射的方式传递到深层,可以有效避免信息的丢失,提高网络结构的学习能力。

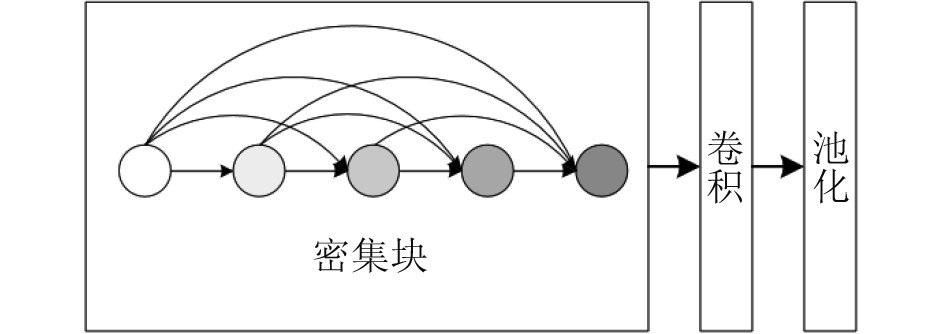

稠密神经网络(DenseNet)的特点是每一层网络都会与之前所有网络层建立连接,也就是每一层网络的输入是之前所有网络层的输出,其基本结构由密集块和后续的卷积层、池化层组成,结构如图3所示[11]。

|

图 3 DenseNet结构示意图 Fig. 3 Structure diagram of DenseNet |

图3中密集块区域堆叠了多个网络层,各个网络层之间会发生密集连接,可以促进特征的复用,实现多尺度融合,区域内的网络层之间特征宽度保持不变,通过后续连接卷积层、池化层来进行特征降维。

EfficientNet是一种标准化网络构建方法。通过网格搜索的方式不断拓展网络结构,并校验更新后网络结构的学习能力,期望在网络学习能力提升和计算资源消耗的关系中找到平衡点,以获取最适合的网络参数[12]。

3 基于多网络集成模型的目标识别方法单网络模型具有模型简单、运算速度快等优点,但同时存在抗干扰能力较弱、泛化能力不足的问题。因此,通过构建多网络集成模型,用于水声目标识别,可进一步提高目标识别准确率、抗干扰能力和泛化能力。

3.1 迁移学习预处理迁移学习是一种将针对某一特定任务预训练的模型通过微调以用于新的相关任务的方法。预训练模型中保留了针对相关任务的权重特征,能够更快地适应新的相关任务,节约了从零构建神经网络模型耗费的算力与时间。同时,预训练模型中包含了更多场景的特征信息,使得模型能够更加灵活地适应未知的预测条件。

训练和拓展EfficientNet需要耗费极大计算资源,本文采取迁移学习的方法减少计算量。具体方法:将预训练的EfficientNet网络移植到本地,将预训练模型的网络层权重进行冻结以保证其在训练过程中维持不变。为预训练模型添加新的全连接层以适应新的任务场景,训练过程仅对新增的全连接层权重进行调整。

迁移学习可以在维持训练效果几乎不变的基础上大幅度减少模型训练时间,达到在保证网络基本功能完善的前提下训练本地数据的目的。

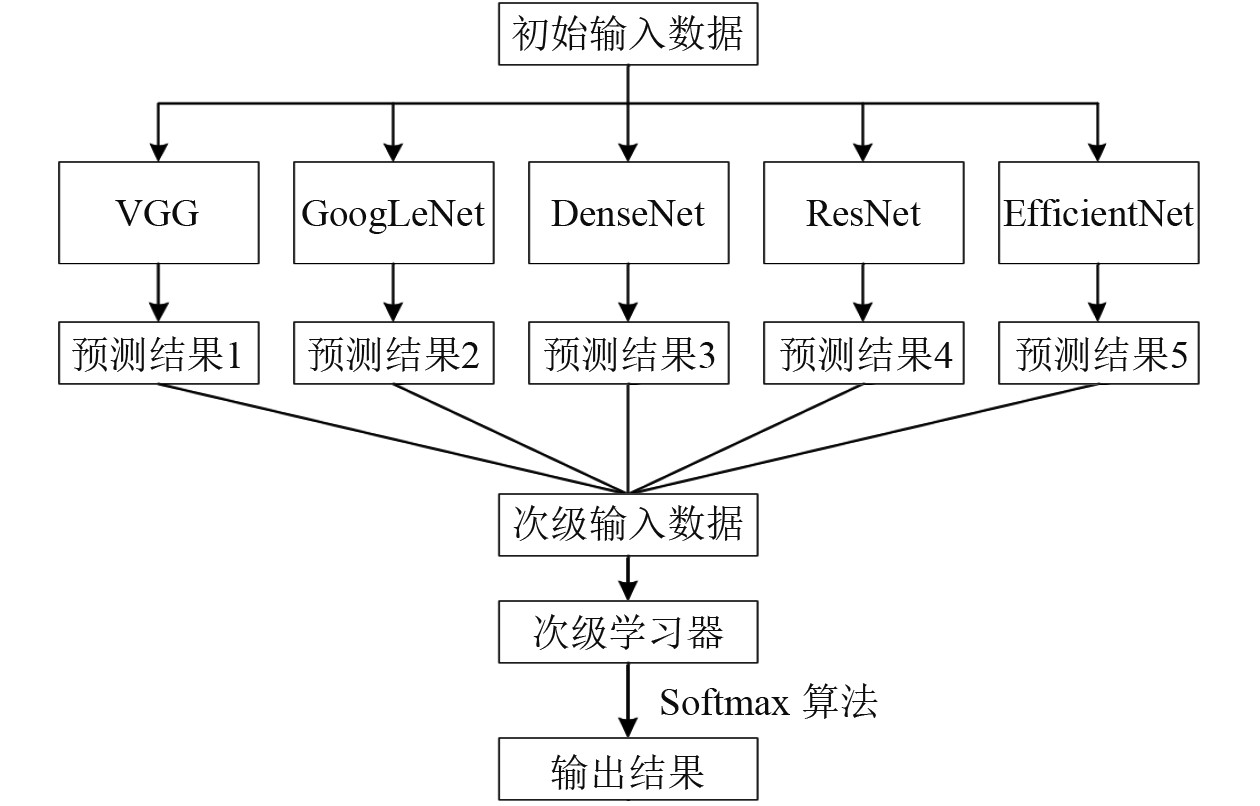

3.2 集成学习方法集成学习是一种结合多分类器的分类结果进行决策的学习方法,将多个网络模型组合起来对输入数据进行判断,可以减少单个网络模型的偏差,有效提高目标识别的准确率。利用Stacking法构建多网络目标识别集成模型,其基本工作流程如图4所示。

|

图 4 基于Stacking的水下目标识别算法流程 Fig. 4 Process of underwater target recognition algorithm based on Stacking |

图4中将多个单网络结构作为初级学习器对初始输入数据进行判别,初次判别的结果作为次级输入数据,经次级学习器再次判别后得到最终的输出结果。本文采用适用于多分类问题机器学习的Softmax回归算法构建次级学习器,将输入的线性组合转换为各类别的概率分布。

其中,Softmax函数可以将一个K维的向量转换为一个概率分布,每个元素表示该类别的概率。表达式为:

| $ \sigma (z) = \frac{{{e^{{z_j}}}}}{{\displaystyle\sum\nolimits_{j = 1}^K {{e^{{z_j}}}} }},j = 1,2 \cdots K 。$ | (2) |

式中:

定义一个模型,该模型接收输入特征并通过权重矩阵

| $ \hat y = {\mathrm{softmax}}({\boldsymbol{W}}x + {{b}}) 。$ | (3) |

式中:

损失函数可以衡量模型预测与实际标签之间的差距。Softmax回归的交叉熵损失函数可表示为:

| $ \mathcal{L}(y,\hat{y})=-{\displaystyle {\sum }_{j=1}^{K}{y}_{j}\mathrm{log}(\hat{y})} 。$ | (4) |

式中:

Softmax回归的目标是最小化损失函数,通常使用梯度下降等优化算法来更新模型的参数W和b,使损失函数达到最小值。

通过Softmax回归算法训练并构建起次级学习器,实现对初级学习器判别结果的集成,可以减小单个网络判别误差,提升总体性能。

初级学习器类型的选择需要保证较强的异构性,网络结构相似度较低的多个模型可以通过不同的方式处理并学习数据特征,达到降低整体识别偏差、增强模型鲁棒性、增强泛化能力的目的,从而在复杂问题中取得更好效果。

本文分别采用VGGNet、GoogLeNet、ResNet、DenseNet、EfficientNet等5种异构性较强的网络结构作为初级学习器。其中,VGGNet采用层数相对较少的VGG-11,特征提取能力强;GoogLeNet通过不同尺寸的卷积核和池化层的组合来提取多尺度特征,且Inception模块特化结构提高了计算效率,降低了计算资源消耗;ResNet采用ResNet-50结构,利用残差块结构解决了深层网络中的梯度消失和梯度爆炸问题,可以训练非常深的网络结构;DenseNet采用DenseNet-121结构,每层都可以直接访问之前所有层的特征图,提高了特征复用和信息流动,同时密集连接也改善了梯度的流动,减少了训练中的梯度消失问题;EfficientNet采用Efficient-b0结构,通过训练、拓展搜寻性能和效率之间的最佳平衡点,在计算资源有限的情况下能提供非常好的性能,并利用迁移学习简化训练过程的计算复杂度。

4 试验验证及结果分析首先对输入数据进行预处理,将其转化为更利于神经网络进行特征提取的模态,再从单网络模型和多网络集成模型2个方面,分别针对输入数据的时频谱图、梅尔语谱图进行训练,对比单网络模型和多网络集成模型的识别准确率。

4.1 数据来源及预处理数据集DeepShip出自文献[13],该数据记录于2016年5月2日至2018年10月4日在格鲁吉亚三角洲节点海峡完成,利用水听器记录了包括客船、拖船、货船和油轮等4类船舶航行通过时的船舶噪声,数据以音频格式保存记录,采样率为

|

|

表 1 DeepShip数据集记录参数 Tab.1 Parameters of DeepShip dataset |

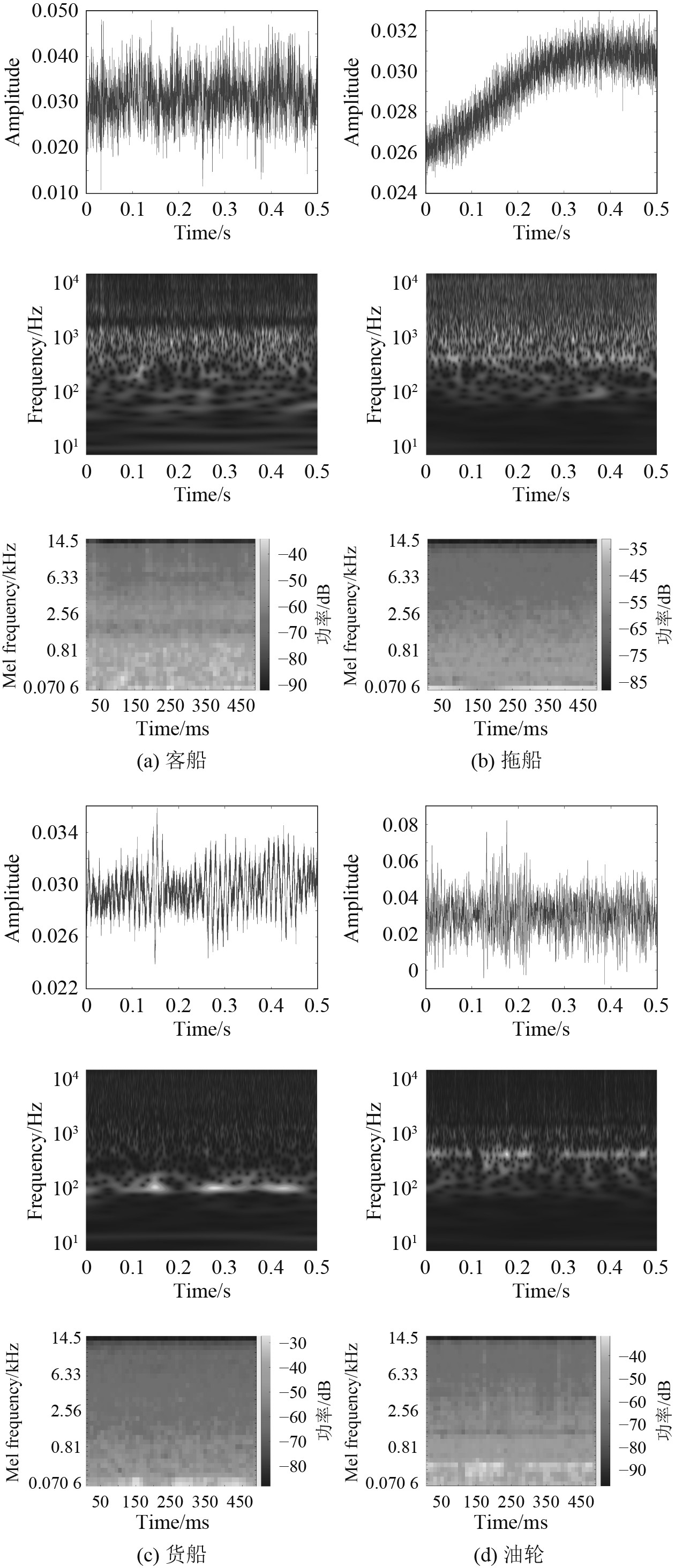

数据集原始数据以时域波形存贮音频信息,将其按照0.5 s的间隔进行截取,并通过分帧、加窗、傅里叶变换等操作将其转化为时频谱图和梅尔语谱图,图5为4类船舶目标的原始波形及预处理后的谱图。

|

图 5 船舶噪声时域波形图、时频谱图、梅尔语谱图 Fig. 5 Time domain waveform, time-frequency spectrum and Mel-spectrum of ship noise |

可见,4种船舶噪声频率、波形均有较大差别,不同船舶噪声之间的时频谱图、梅尔语谱图相似度较低,这与船舶本身的空间结构、动力系统等有较大相关性。

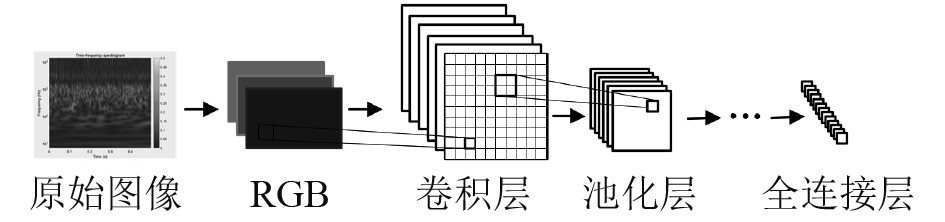

将时频谱图和梅尔语谱图剪裁成224×224×3的三通道RGB图像,传入卷积神经网络,RGB图像以红、绿、蓝三通道存储图片信息,每个像素点的值在[0, 255]的区间上,数值表示像素点的强度,可以将其视为传入卷积神经网络的3个二维矩阵,如图6所示。

|

图 6 卷积神经网络基本结构示意图 Fig. 6 Schematic diagram of the basic structure of convolutional neural network |

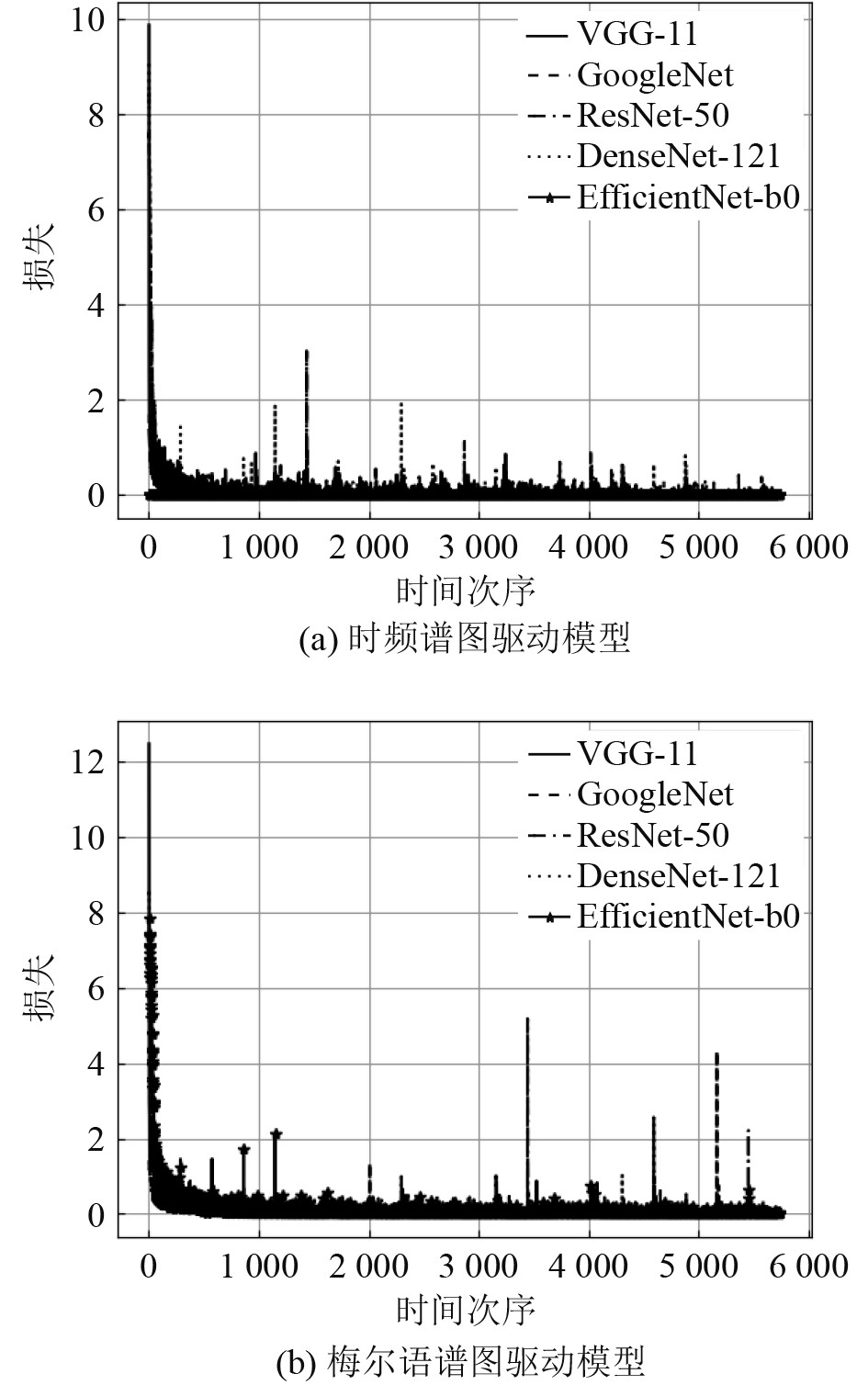

选取VGG-11、GoogLeNet、ResNet-50、DenseNet-121、EfficientNet-b0等5种网络结构为单一网络模型的基本框架,将时频谱图、梅尔语谱图分别作为输入数据,开始模型训练并记录各模型的训练情况。试验采用的设备为搭载了R5-

|

图 7 损失函数变化图 Fig. 7 Loss function variation chart |

对比2种驱动模型训练过程的损失函数变化,2种模型的损失函数均能较快收敛到零值附近。时频谱图驱动模型损失函数整体波动大于梅尔语谱图驱动模型,但随着训练时间增加而波动次数逐渐较少。其中,VGG-11网络结构损失函数全程变化波动较小,其他网络结构均有波动情况发生。梅尔语谱图驱动模型训练过程中前半程损失函数整体起伏较小,但中后程ResNet-50和GoogLeNet网络结构偶有较大波动,其他网络结构损失函数均无明显波动现象。

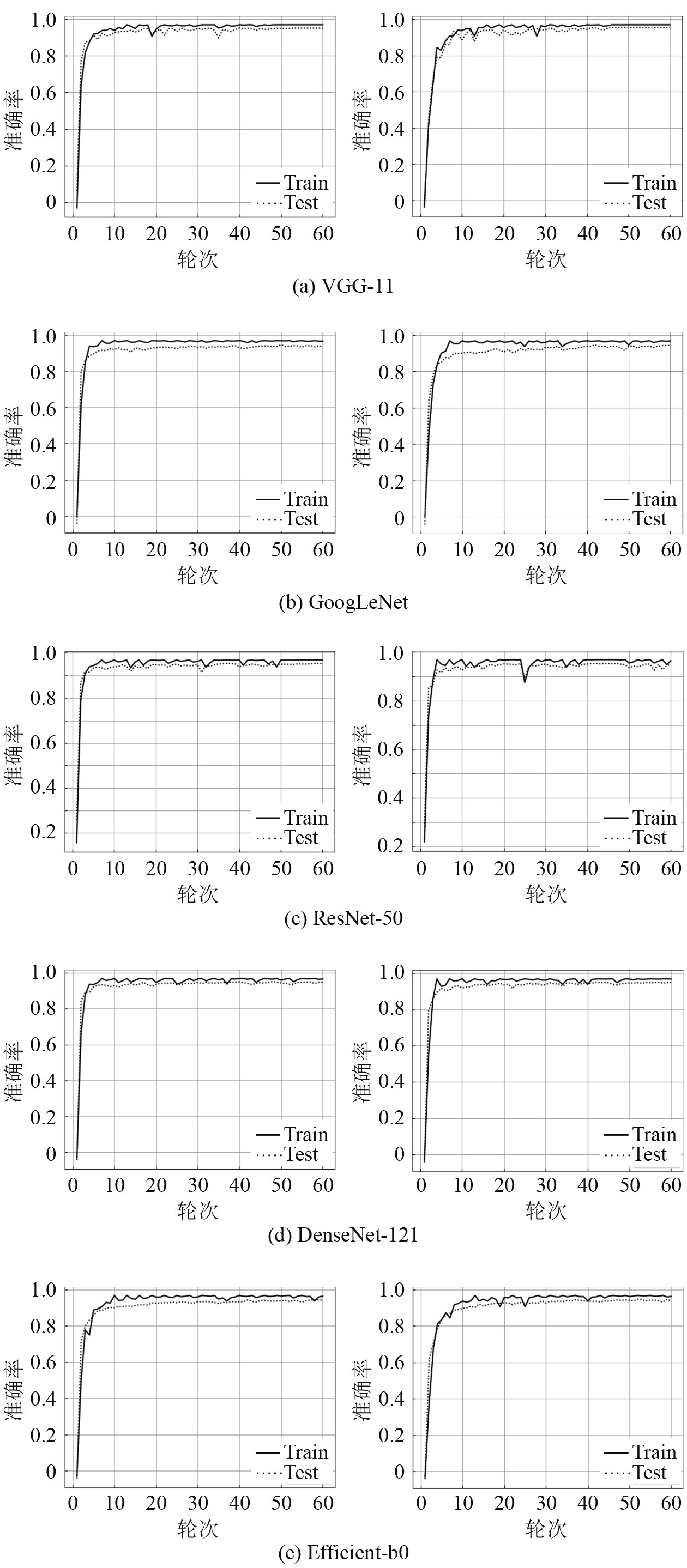

为了更具体地描述2种驱动模型针对不同噪声目标识别的效果,得到2种数据驱动模型的不同网络结构在训练集和测试集上识别准确率变化图,如图8所示。

|

图 8 训练集、测试集准确率变化图 Fig. 8 Accuracy change chart of training set and testing set |

对比可知,不同的输入数据对网络的识别能力影响并不大,识别准确率曲线变化趋势极为相似。

对比不同网络结构的识别结果可见,各网络结构的识别准确率均在93%以上,不同网络结构间准确率相差较小。其中,识别效果最好的是VGG-11和ResNet-50,VGG网络结构能够提取到更深层次、更高维度的目标特征,ResNet网络结构可以在网络层数不断加深时保证浅层特征不丢失,而GoogLeNet和DenseNet更侧重于特征的多尺度融合,EfficientNet由于迁移学习的原因,并不能最优化结构使之适配当前水声数据集。由此可知,提取数据更高维度的特征以及保证浅层特征不丢失更为重要。

但当网络训练到一定程度后,单网络结构的学习能力将达到瓶颈,准确率不再继续提升。

4.3 多网络集成模型基于Stacking法的思想,将训练好的5个单网络结构作为初级学习器,对于每张图像数据,初级学习器会输出对应的5个识别结果,将其看作特征数为5的次级输入数据。

采用Softmax回归算法对次级输入数据进行训练,构建次级学习器。多网络集成模型的学习流程依然采用初次划分的训练集和验证集。表2显示了2种谱图驱动下不同识别方法在测试集上的识别准确率。

|

|

表 2 多方法识别准确率对比 Tab.2 Comparison chart of recognition accuracy of multiple methods |

Stacking多网络集成模型整合了多个单网络结构的学习能力,识别准确率显著高于单网络模型。本文采用的单网络结构之间具有较强的异构性,能够以不同的学习方法对输入数据进行判别,当某个单网络结构模型判别错误时,其他单网络结构可以对错误进行弥补,提高模型整体的识别准确率。

对于输入数据而言,梅尔语谱图驱动网络模型较时频谱图驱动网络模型识别准确率更高,梅尔语谱图能够更好地反映噪声数据的基本特征,更适合应用于深度学习解决水下目标识别的算法。

5 结 语本文提出一种基于集成学习的水下目标被动识别方法,以DeepShips数据集为研究对象,将被动声呐接收的水声信号转化为2种谱图形式,构建多网络集成模型对谱图进行识别。可以得出以下结论:

1)单网络模型具有学习能力,但其性能在训练至一定程度后可达瓶颈而不再提高,判别错误时不能及时纠错调整,具有局限性。多网络集成模型整合了多个单网络结构的学习能力,可进一步提高识别准确率。

2)将水声信号转化为谱图形式并作为输入数据进行学习,是一种可行方案,其中梅尔语谱图能够更好地反映输入数据的基本特征,比时频谱图更适合作为神经网络模型的输入数据。

| [1] |

徐及, 黄兆琼, 李琛, 等. 深度学习在水下目标被动识别中的应用进展[J]. 信号处理, 2019, 35(9): 1460-1475. |

| [2] |

陆晨翔, 王璐, 曾向阳. 水下目标信号的结构化稀疏特征提取方法[J]. 哈尔滨工程大学学报, 2018, 39(8): 1278-1282. DOI:10.11990/jheu.201701046 |

| [3] |

MENG Q, YANG S, PIAO S. The classification of underwater acoustic target signals based on wave structure and support vector machine[J]. The Journal of the Acoustical Society of America, 2014, 136(4): 2265-2275. |

| [4] |

张少康, 王超, 田德艳, 等. 长短时记忆网络水下目标噪声智能识别方法[J]. 舰船科学技术, 2019, 41(12): 181-185. ZHANG S K, WANG C, TIAN D Y, et al. Intelligent recognition of underwater target noise based on long short-term memory networks[J]. Ship Science and Technology, 2019, 41(12): 181-185. DOI:10.3404/j.issn.1672-7649.2019.12.035 |

| [5] |

王升贵, 胡桥, 陈迎亮, 等. 基于深度学习的水下目标识别方法研究[J]. 舰船科学技术, 2020, 42(23): 141-145. WANG S G, HU Q, CHEN Y L, et al. Research on underwater target recognition method base on deep learning[J]. Ship Science and Technology, 2020, 42(23): 141-145. DOI:10.3404/j.issn.1672-7649.2020.12.028 |

| [6] |

于学洋, 李淑秋, 宁江波, 等. 一种基于VGGish神经网络的水声目标识别方法[J]. 声学技术, 2024, 43(1): 30-37. |

| [7] |

曾赛, 杜选民. 水下目标多模态深度学习分类识别研究[J]. 应用声学, 2019, 38(4): 589-595. |

| [8] |

SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[J]. arxiv preprint arxiv, 2014, 14(9): 55−56

|

| [9] |

SZEGEDY C, LIU W, JIA Y, et al. Going deeper with convolutions[C]//ProceeDings of the IEEE Conference on Computer Vision and Pattern Recognition, 2015.

|

| [10] |

HE K, ZHANG X, REN S,et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, NV, USA, 2016.

|

| [11] |

HUANG G, LIU Z, VAN DER MAATEN L,et al. Weinberger, densely connected convolutional networks[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Honolulu, HI, USA, 2017.

|

| [12] |

TAN M, LE Q. Efficientnet: Rethinking model scaling for convolutional neural networks[C]//International conference on machine learning. PMLR, 2019.

|

| [13] |

IRFAN, MUHAMMAD, ZHENG JIANGBIN, et al. DeepShip: An underwater acoustic benchmark dataset and a separable convolution based autoencoder for classification[J]. 2021, 183(11): 115270.1−115270.12.

|

2025, Vol. 47

2025, Vol. 47