A lightweight deep learning-based comprehensive qualitative and quantitative analysis method for lung ultrasound images

-

摘要:

目的 提出一种基于深度学习的轻量化肺超声图像定性与定量综合分析方法,以提升智能化超声对肺部疾病的评估能力。

方法 共收集7 000张来自临床病例的肺超声图像用于模型评价,包括用于定性分析任务的5 000张图像、定量分析任务的1 000张图像,以及用于外部测试的1 000张图像。在定性分析方面,引入ShuffleNet网络中的通道混洗模块,对FastViT网络的Stem结构进行优化,构建出新型Stem模块,提升模型对肺超声图像的分类性能;在定量分析方面,应用仿射变换对凸阵肺超声图像进行归一化校正,以消除图像采集过程中的尺度和角度差异,同时剔除无关的边缘冗余信息,随后引入YOLOv5目标检测算法,实现肺超声图像中B线的自动检测及其数量、间距的量化分析。

结果 轻量化定性分析模型在肺超声图像分类任务中的准确率达到96.7%,参数量仅为3.2×106,优于先前轻量化分类模型在此任务中的分类性能,且在外部测试中达到了95.14%的准确率。定量研究中,YOLOv5模型在B线定位、计数与测距任务中同样取得了优异的表现,检测结果与实际标注高度一致,计数与测距误差均在临床诊断允许范围内。

结论 本研究构建的基于深度学习的轻量化肺超声图像定性与定量综合分析方法在肺部病变的辅助诊断中展现出优异的性能,超声图像评分能够快速评估病情等级,B线检测则实现了关键征象的精准量化,两者协同能为临床上肺超声诊断提供有力支持,具有广阔的临床应用前景。

Abstract:Objective To propose a lightweight deep learning-based comprehensive qualitative and quantitative analysis method for lung ultrasound images, aiming to enhance the capability of intelligent ultrasound in the assessment of pulmonary diseases.

Methods A total of 7 000 lung ultrasound images collected from clinical cases were used for model evaluation, including 5 000 images for qualitative analysis, 1 000 images for quantitative analysis, and 1 000 images for external validation. For qualitative analysis, a channel shuffle module derived from ShuffleNet was introduced to optimize the Stem structure of the FastViT network, leading to the construction of a novel Stem module that improves the classification performance on lung ultrasound images. For quantitative analysis, affine transformation was applied to normalize convex array lung ultrasound images, so as to eliminate scale and angle variations introduced during image acquisition and remove irrelevant peripheral redundant information. Subsequently, the YOLOv5 object detection algorithm was employed to achieve automatic detection of B-lines, as well as quantitative analysis of their number and inter-line spacing.

Results The proposed lightweight qualitative analysis model achieved a classification accuracy of 96.7% on lung ultrasound images, with only 3.2×106 parameters, outperforming previous lightweight classification models on the same task. An accuracy of 95.14% was obtained in external validation. In the quantitative analysis, the YOLOv5 model demonstrated excellent performance in B-line localization, counting, and distance measurement tasks. The detection results showed high consistency with manual annotations, and both counting and distance measurement errors were within clinically acceptable ranges.

Conclusion The proposed lightweight deep learning-based comprehensive qualitative and quantitative analysis method for lung ultrasound images demonstrates excellent performance in assisting the diagnosis of pulmonary diseases. Ultrasound image scoring enables rapid assessment of disease severity, while B-line detection provides precise quantification of key ultrasound signs. The synergistic integration of these 2 analyses offers strong support for clinical lung ultrasound diagnosis and shows significant potential for clinical applications.

-

Keywords:

- lung diseases /

- ultrasonography /

- image scoring /

- B-line analysis /

- image processing /

- deep learning

-

全球范围内,肺部疾病的发病率近年来呈现逐年上升趋势,其中肺炎、间质性肺病及急性呼吸窘迫综合征(acute respiratory distress syndrome,ARDS)等病症的高发给公共卫生管理与临床救治带来了巨大挑战[1]。肺超声检查以其实时、无创、便携等优点逐步成为肺部病变筛查和动态监测的重要工具,但其图像解读存在一定困难。由于不同病灶在超声图像中表现出的特征具有较大重叠性,加上检查结果高度依赖操作者的经验和技术水平,传统的超声图像分析往往带有主观偏差,导致诊断标准不一,从而影响临床判断的准确性和一致性[2-4]。B线是肺超声诊断中的一种重要征象,可反映肺间质液体的增加情况,与肺水肿、间质性肺病及其他肺部炎症密切相关[5-8],量化分析其数量、间距对于肺部疾病的诊断具有重要意义[9-11]。

近年来,随着人工智能(artificial intelligence,AI)技术尤其是深度学习算法在医学影像分析领域中的应用,基于AI的诊断系统已在病灶识别[12-14]、病变分级[15-17]及自动计数[18-20]等方面展现出显著优势。深度学习能够通过多层网络结构自动提取图像中隐含的抽象特征,克服了传统超声图像分析中人为因素导致的主观误差。在肺超声智能分析领域,图像自动评分为当前主要研究方向。例如,Guo等[21]提出了一种名为MeDiVLAD的肺超声图像评分模型,采用了专用的特征提取网络,并结合双重局部聚合描述子向量(vector of locally aggregated descriptors,VLAD)聚合机制,实现了对肺超声图像中肺部病变严重程度的自动评分。Chu等[22]提出了一种基于分量表的自动化肺超声图像评分网络DGF-ResNet,该网络使用混合特征融合模块融合局部细节与全局语义特征,实现了八分制肺超声图像的自动评分。Xing等[23]提出了一种两阶段级联深度学习模型,第一阶段利用ResNet-50筛选高质量图像,第二阶段结合多种卷积神经网络进行特征提取与集成评分,实现了对新型冠状病毒感染肺炎患者肺部超声图像的自动评分。尽管这些模型取得了较好的肺超声图像评分效果,但大多设计复杂、参数量大,影响了其在临床前端设备中的部署与应用。同时,这些基于肺超声图像整体分析的研究缺乏对关键征象如B线的量化分析。

本研究提出了一种基于深度学习的集定性与定量分析于一体的轻量化肺超声图像智能评估方法。在定性分析方面,本方法采用改进后的轻量化快速混合视觉Transformer(fast hybrid vision Transformer,FastViT)网络,通过对图像的预处理和特征提取实现对肺部病变严重程度的自动评分;在定量分析方面,本方法则引入YOLOv5模型,对图像中的B线进行自动检测与计数,提供了一个客观的量化指标以辅助病情判断。

1 资料和方法

1.1 肺超声图像采集

收集了来自三家医院肺炎/ARDS患者的7 000张肺超声图像,包括海军军医大学第二附属医院(2022SL081)、武汉火神山医院(HSSLL030)及复旦大学附属中山医院(B2022-263)。其中,5 000张肺超声图像用于定性分析(评分)任务,1 000张图像用于定量分析(B线量化)任务,1 000张图像作为独立外部测试集。所有图像均采集于标准化临床检查流程中,涵盖了不同性别和年龄段的肺炎或ARDS患者。患者详细分布信息如表 1所示。

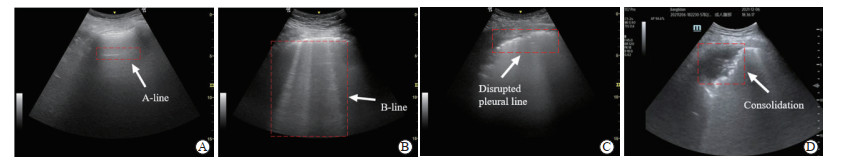

表 1 患者详细分布信息Table 1 Detailed distribution of patientsIndex Wuhan Huoshenshan Hospital N=31 The Second Affiliated Hospital of Naval Medical University N=28 Zhongshan Hospital of Fudan University N=10 Age/year, x±s 55±21 51±29 76±13 Gender, n Male 19 16 8 Female 12 12 2 Disease type Pneumonia Pneumonia/ARDS ARDS Imaging device LOGIQ e (GE HealthCare) M9 (Mindray HealthCare) M9 (Mindray HealthCare) ARDS: Acute respiratory distress syndrome. 用于评分任务的肺超声图像均由3名超声科医生(均具有6年以上超声诊断经验)依据国际肺超声共识[24]和临床诊断经验共同赋予对应的评分标签。评分过程中,先由2名医生独立评估图像,依据图像中的各类征象及典型病灶表现,将图像分为0分、1分、2分和3分4组,0分为正常,1~3分依次为病变程度由轻到重(图 1)。若2位医生的判断存在分歧,则由第3名医生进行最终判定。在此过程中,重叠、不清晰或存在伪影等质量不佳的图像均被剔除,并重新选取质量合格的图像予以补充。最终,从海军军医大学第二附属医院和武汉火神山医院获得5 000张肺超声图像,用于构建内部数据集(每个评分组1 250张)。其中,4 000张图像用于评分模型的训练与验证(每个评分组1 000张),1 000张图像用于内部测试(每个评分组250张)。此外,从复旦大学附属中山医院收集1 000张肺超声图像(0分:300张,1分:300张,2分:300张,3分:100张)作为外部测试集,用于评估模型在跨中心数据上的泛化能力。

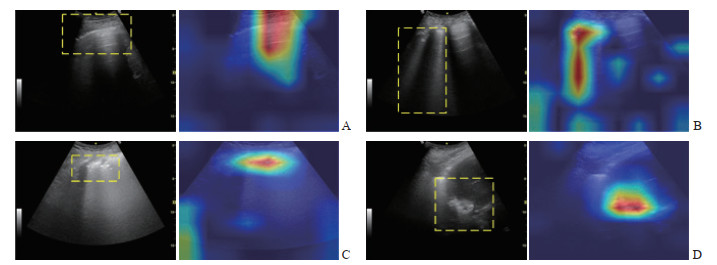

图 1 4种不同评分的肺超声图像示意图Fig. 1 Representative lung ultrasound images with 4 different scoring levelsA: A-line (normal horizontal artifacts) indicating well-aerated lung (score 1); B: B-line (vertical artifacts) indicating interstitial syndrome (score 2); C: Disrupted pleural line indicating pleural discontinuity (score 3); D: Consolidation shows a tissue-like pattern with alveolar filling (score 4).

图 1 4种不同评分的肺超声图像示意图Fig. 1 Representative lung ultrasound images with 4 different scoring levelsA: A-line (normal horizontal artifacts) indicating well-aerated lung (score 1); B: B-line (vertical artifacts) indicating interstitial syndrome (score 2); C: Disrupted pleural line indicating pleural discontinuity (score 3); D: Consolidation shows a tissue-like pattern with alveolar filling (score 4).1.2 轻量化肺超声图像定性评分

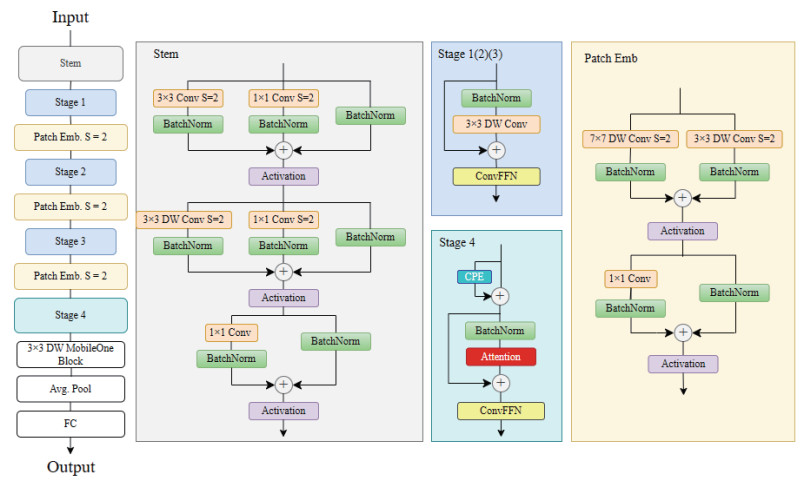

FastViT是Apple公司于2023年提出的一种轻量化高效混合视觉Transformer模型,其网络结构如图 2所示。该网络在图像分类等任务中实现了低延迟、高精度的表现,尤其适合移动端和边缘设备部署,兼具快速推理与强表征能力[25]。针对肺超声图像中多尺度病变特征(如B线伪影、胸膜线异常等)的复杂性,原始FastViT的Stem层在浅层特征提取中存在局部细节信息捕获不足、早期特征通道交互受限等问题。

图 2 FastViT网络结构示意图Fig. 2 Architecture of FastViT networkFastViT: Fast hybrid vision Transformer; Emb: Embedding; DW: Depthwise; Avg. Pool: Average pooling; FC: Fully connected layer; Conv: Convolution; S: Stride; BatchNorm: Batch normalization; ConvFFN: Convolutional feed-forward network; CPE: Conditional positional encoding; ⊕: Element-wise addition.

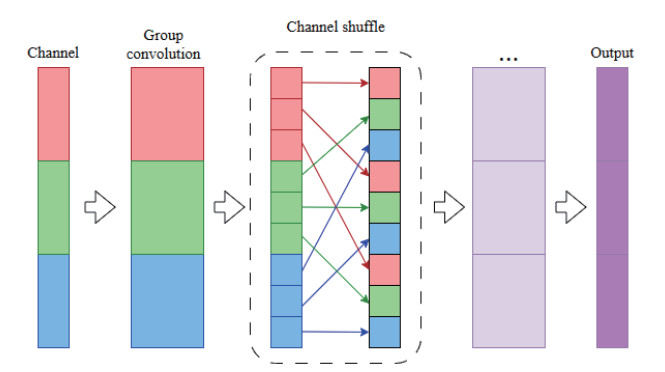

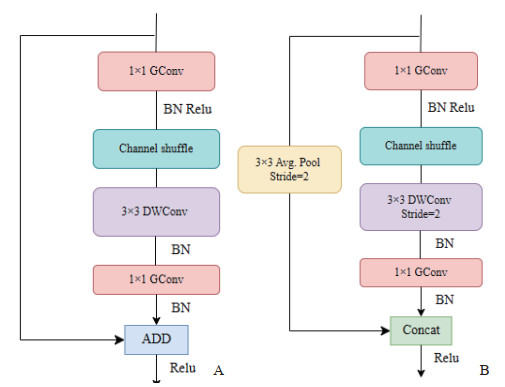

图 2 FastViT网络结构示意图Fig. 2 Architecture of FastViT networkFastViT: Fast hybrid vision Transformer; Emb: Embedding; DW: Depthwise; Avg. Pool: Average pooling; FC: Fully connected layer; Conv: Convolution; S: Stride; BatchNorm: Batch normalization; ConvFFN: Convolutional feed-forward network; CPE: Conditional positional encoding; ⊕: Element-wise addition.ShuffleNet是由北京旷视科技有限公司提出的一种轻量化卷积神经网络,专为移动端和嵌入式设备的高效计算而设计。其核心创新在于通过分组卷积和通道混洗降低计算成本,同时保持较高的分类精度[26]。通道混洗结构如图 3所示,该机制解决了传统分组卷积导致的通道信息隔离问题,通过重新排列通道促进不同组间的特征交互,增强模型表达能力。

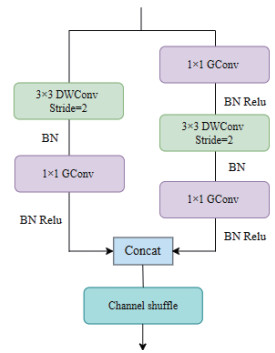

在ShuffleNet网络中,核心构建模块被称为ShuffleNet单元,承担着高效特征提取与信息混洗的关键功能。根据是否改变特征图分辨率,ShuffleNet单元分为2种类型:分辨率保持不变的普通单元(图 4A)和分辨率减半的下采样单元(图 4B)。

图 4 ShuffleNet单元Fig. 4 ShuffleNet unitA: Standard unit with unchanged resolution; B: Downsampling unit with halved resolution. GConv: Group convolution; BN: Batch normalization; Relu: Rectified linear unit; DWConv: Depthwise convolution; ADD: Element-wise addition; Avg. Pool: Average pooling; Concat: Concatenation.

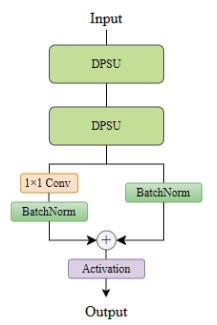

图 4 ShuffleNet单元Fig. 4 ShuffleNet unitA: Standard unit with unchanged resolution; B: Downsampling unit with halved resolution. GConv: Group convolution; BN: Batch normalization; Relu: Rectified linear unit; DWConv: Depthwise convolution; ADD: Element-wise addition; Avg. Pool: Average pooling; Concat: Concatenation.受ShuffleNet网络结构启发,为弥补FastViT的Stem层对肺超声图像局部细节信息捕获不足以及早期特征通道交互受限的缺陷,本研究将ShuffleNetV1网络中的通道混洗机制与FastViT网络中的Stem结构进行融合,通过深度可分离卷积与通道重排增强早期特征交互,同时保持模型轻量化。具体而言,在ShuffleNetV1网络中分辨率减半的下采样单元基础上,设计了一种结构更为对称的新型特征提取单元,该单元在2个分支中均引入了轻量卷积操作,并在特征融合后加入通道混洗,以提升通道间的信息交互与特征表达能力。本研究将该模块命名为“双路径混洗单元”(dual-path shuffle unit)(图 5),而后将该模块融入FastViT网络的Stem结构中,构建出一个新型Stem网络(图 6),由此增强初始特征层的通道交互,从而提升低级特征的表达能力。

因此,该轻量化自动评分模型融合了ShuffleNet网络与FastViT网络的优势,通过通道重组和特征交互机制增强了图像的特征表达能力,有效缓解了原先网络难以充分提取肺超声图像中局部细节信息且在早期阶段特征通道之间交互有限的问题,并保持了网络的高效性与轻量化特性,适用于移动端和边缘计算等资源受限的临床环境。

1.3 B线检测与定量分析

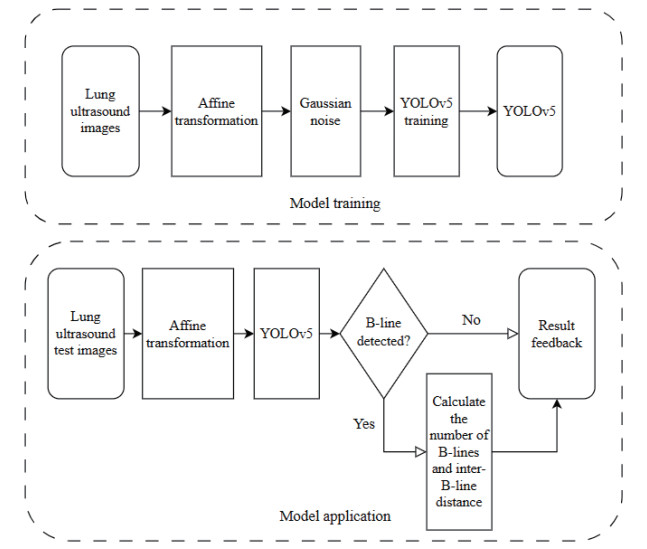

B线作为肺超声图像的重要征象,其检测与量化分析对于评估肺部疾病严重程度十分重要。本研究收集1 000张肺超声图像用于定量分析。在肺超声图像评分的基础上,使用YOLOv5目标检测模型对B线进行自动检测、计数与相邻间距计算,以实现对肺部病变严重程度的量化分析。整体流程如图 7所示。

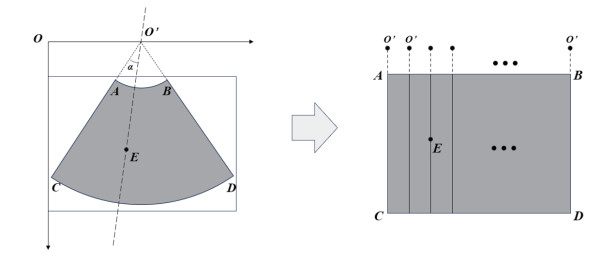

1.3.1 仿射变换

由于临床常用的超声凸阵探头采集的肺超声图像通常为扇形结构,直接处理和分析会受到图像形变的影响。本研究开发了图像仿射变换算法,通过对图像坐标进行非线性映射,将凸阵探头形成的扇形图像转换为线阵探头形成的矩形图像,如图 8所示。该变换操作消除了因探头角度和扇形采集方式导致的边缘模糊和区域拉伸问题,使关键区域特征更加清晰,为后续的特征检测与分析提供了更高的准确性和鲁棒性。具体步骤:

(1)从图像中提取目标区域,即区域A-B-D-C;

(2)提取目标区域的A、B、C、D 4个端点坐标;

(3)通过直线AC和直线BD的斜率计算目标区域的角度,记为∠AO’B;(4)计算相邻像素之间的距离,计算公式为Dp=LAC/(NAC-1),其中Dp、LAC、NAC分别为相邻像素之间的距离、线段AC的长度、线段AC的像素个数;(5)将极坐标下图像中的像素投影到笛卡尔坐标下的像素,转换后像素灰度值的计算涉及双线性插值,因此图像质量保持不变。

1.3.2 图像加噪

为提高YOLOv5模型的泛化能力和鲁棒性,进而提升B线检测的准确率,本研究在训练阶段对数据集中的肺超声图像进行了预处理,即在原始图像上叠加高斯随机噪声,模拟不同成像条件和设备噪声对B线检测的影响。

1.3.3 YOLOv5模型训练及应用

YOLOv5是一种高效的单阶段目标检测模型[27],采用了模块化的结构,主要由Backbone、Neck和Head三部分组成。其中Backbone为CSPDarknet,用于提取图像的基础特征;Neck用于增强特征融合,提升模型对不同尺度目标的检测能力;Head则负责进行分类与定位回归。YOLOv5具备良好的检测精度和实时性,适用于本研究对B线的快速识别任务。在模型应用过程中,本研究主要针对肺超声图像的特性进行了适配与优化,以提升模型的泛化能力,增强其对不同成像条件下B线的检测稳定性。同时在YOLOv5模型训练时,基于实验结果调整了学习率、优化器、数据增强策略等超参数,以提高检测精度和鲁棒性。

基于B线检测结果,为了进一步提升其临床应用价值,本研究设计了B线数量及基于图像垂直中轴线的B线间距量化分析方法,从而为肺部病变程度的评估提供更加直观、可量化的参考指标。

2 结果和讨论

2.1 肺超声评分模型实验结果与讨论

为了验证所提出的轻量化肺超声图像评分模型的性能,本研究设计了消融实验。

2.1.1 消融实验

采用五折交叉验证进行消融实验。将4 000张肺超声图像按4∶1的比例划分为训练集和验证集(采集自同一患者的超声图像不在多个子集中重叠出现),对模型进行多轮训练与验证。训练过程中设置初始学习率为0.001,批次大小为32,优化器采用AdamW,训练轮数为100轮。最后使用1 000张测试集图像进行测试,实验结果见表 2。

表 2 FastViT与改进FastViT模型在五折交叉验证中的准确率对比Table 2 Accuracies of FastViT and improved FastViT models in 5-fold cross-validationModel Trainable parameter Accuracy/% Fold 1 Fold 2 Fold 3 Fold 4 Fold 5 Mean FastViT 3 260 308 92.4 92.2 94.1 95.9 94.1 93.74 Improved FastViT 3 260 857 95.2 96.7 96.6 96.7 94.5 95.94 FastViT: Fast hybrid vision Transformer. 从表 2的数据可知,在五折交叉验证中,引入了新型Stem结构的FastViT模型在测试集的平均准确率达到了95.94%,相较于原始FastViT模型提高了2.2%。这一结果表明,改进后的模型在肺超声图像分类任务中具有更优的分类性能。除了整体准确率的提升,改进模型在所有折上的准确率均保持在94.5%以上,而原始模型的准确率波动较大,最高可达95.9%,但最低仅为92.2%,说明改进模型对不同数据划分的适应能力更强,具有更好的泛化性能。

为进一步验证模型的泛化能力,本研究额外引入来自第三家独立中心(复旦大学附属中山医院)的1 000张肺超声图像作为外部测试集。在该外部测试集上,改进后的FastViT模型依然表现出良好的识别能力,五折交叉验证实验的外部测试集准确率分别为95.2%、94.9%、93.8%、96.4%、95.4%,平均准确率达到95.14%。表明改进后的模型在未见数据上具有较强的泛化能力,适用于多中心、多设备条件下的肺超声图像智能分析任务。

在保证分类准确率提升的同时,改进后的FastViT模型仍然保持了较小的参数量和较快的推理速度。相比其他复杂的深度学习模型,原始FastViT模型本身已经具备较高的计算效率,而本研究在改进过程中充分考虑了模型的轻量化特性,确保模型的计算复杂度不会大幅增加。因此,改进模型在准确率提升的同时,依然具备较好的计算效率和部署优势,使其更加适用于实际的肺超声图像智能分析任务。

2.1.2 对比实验

为了全面评估改进后的FastViT模型在肺超声图像评分任务中的性能,本研究在测试集上对改进FastViT模型与5种主流分类模型进行了精度和参数量的对比实验,包括EfficientViT_M4、EfficientNet_B2、ResNet50、MobileNetV2和RepViT-M1.1。所有模型均在相同训练条件下进行训练,并在相同内部测试集(1 000张肺超声图像)上进行推理评估,以确保各模型间的对比具有合理性。实验结果见表 3。

表 3 改进FastViT与主流深度学习模型对比实验结果Table 3 Comparison of improved FastViT with mainstream deep learning modelsModel Parameter/(×106) Input/(pixel×pixel) FLOPs/(×106) Accuracy/% EfficientViT_M4 8.4 224×224 299 92.9 EfficientNet_B2 8.9 224×224 1 000 96.3 ResNet50 23.6 224×224 4 100 94.7 MobileNetV2 2.2 224×224 600 95.4 RepViT-M1.1 7.8 224×224 2 600 90.1 Improved FastViT 3.2 224×224 700 96.7 FastViT: Fast hybrid vision Transformer; FLOPs: Floating-point operations per second. 从表 3数据可以看出,改进后的FastViT模型具有显著的优势。首先,在参数量方面,改进FastViT仅有3.2×106,远低于ResNet50、EfficientViT_M4和EfficientNet_B2,表明其具有更轻量化的结构,在部署和计算资源受限的环境下更具优势。其次,在计算复杂度每秒浮点运算次数(floating-point operations per second,FLOPs)方面,改进FastViT的FLOPs明显低于ResNet50和RepViT-M1.1,仅略高于MobileNetV2,这说明改进后的FastViT在计算开销上得到了有效优化。更重要的是,在准确率方面,改进FastViT以96.7%的准确率超越了所有对比模型,具有更优的分类性能。

2.1.3 模型可解释性分析

为进一步验证改进后的FastViT模型在肺超声图像评分任务中的有效性及对关键征象区域的关注能力,本研究采用梯度加权类激活映射(gradient-weighted class activation mapping,Grad-CAM)方法对模型的判别依据进行了可视化分析。图 9为部分测试样本在改进FastViT模型中的Grad-CAM特征激活热图。从图中可以看出,改进后的FastViT模型能够较好地聚焦于肺超声图像关键征象所在区域,显示出较强的特征提取和判别能力。这一结果进一步验证了新型Stem结构在增强模型对关键区域感知能力方面的有效性,同时也提升了模型的可解释性。

图 9 改进FastViT模型在不同征象关注情况下的可视化结果Fig. 9 Visualizations of the improved FastViT model focusing on different ultrasound signsA: Continuous pleural line with the presence of A-lines; B: Presence of B-lines; C: Discontinuity of the pleural line; D: Pulmonary consolidation observed. FastViT: Fast hybrid vision Transformer.

图 9 改进FastViT模型在不同征象关注情况下的可视化结果Fig. 9 Visualizations of the improved FastViT model focusing on different ultrasound signsA: Continuous pleural line with the presence of A-lines; B: Presence of B-lines; C: Discontinuity of the pleural line; D: Pulmonary consolidation observed. FastViT: Fast hybrid vision Transformer.2.2 B线检测实验结果与讨论

本研究基于YOLOv5模型对肺超声图像中的B线进行了自动检测与分析,结果表明,该模型不仅能够精确检测B线的数量,还能自动计算相邻B线的间距,从而为肺部疾病的量化分析提供了强有力的支持(表 4)。尤其是在肺水肿的评估中,B线的数量及其分布情况是关键的评判指标,本研究所提出的方法能对这些特征进行精准测量,使超声影像分析更加客观、量化和高效。值得注意的是,在部分肺超声图像中存在一定的B线漏检现象(表 5),主要表现为图像质量较差或增益较低时模型未能准确识别全部B线,根据内部测试集的评估结果漏检率约为2%。

表 4 YOLOv5模型对肺超声图像中B线的自动检测、计数与间距测量Table 4 Automatic detection, counting, and spacing measurement of B-lines in lung ultrasound images using YOLOv5 modelOriginal image Affine-transformed image Detection image Number of B-lines Inter-B-line distance/pixel

2 147

3 186, 110

1 0 表 5 肺超声图像中B线检测典型漏检示例Table 5 Typical examples of missed B-line detections in lung ultrasound imagesLabeled image Detection image Number of missed B-lines

1

1

1 实验整体结果显示了该模型表现稳定,具有强大的适应性和推广能力,能够满足实际临床应用的需求。本研究提出的基于YOLOv5的B线智能检测方法在准确性、稳定性及自动计算能力方面均表现优越,为肺超声影像的智能分析提供了全新的技术方案,有望在肺部疾病的早期筛查、严重程度评估及临床辅助决策中发挥重要作用。

3 结论

本研究结合深度学习方法对肺超声图像进行了定性与定量分析研究,具体包括改进的FastViT图像评分模型和YOLOv5 B线检测模型。实验结果表明,改进FastViT评分模型在准确率、推理速度和参数量方面优于其他主流分类模型,尤其在保障精度的同时显著减少了计算成本,使其更适用于资源受限的临床环境。在B线检测任务中,YOLOv5通过优化参数设置和模型改进,实现了对相邻检测框垂直中线间距的计算与可视化,有助于医生更精确地评估B线数量及其分布情况,从而辅助临床决策。与此同时,本研究所提出的模型具备良好的移植性和轻量化部署潜力,随着便携式超声设备和床旁超声设备的快速发展,可考虑将本研究中的智能分析算法嵌入到便携设备中,以实现实时、无创、高效的肺部病灶检测与监测,拓展其在基层医疗机构、急诊科室以及资源有限地区的应用场景,进一步提升临床实用性与社会推广价值。

本研究仍存在一定的局限性。首先,由于肺超声图像受采集设备、操作者经验以及患者个体差异的影响较大,且数据集对复杂临床场景的覆盖空间有限,罕见病例数据不足,使得本研究提出的轻量化肺超声评分模型的泛化能力仍需在更大规模的数据集上进一步验证。其次,本研究仅采用高斯噪声增强数据以提高模型对图像质量变化的鲁棒性,未来可以尝试结合更多的数据增强策略,如对比度调整、自适应伪射变换等,进一步提升模型的稳健性。最后,本研究主要基于静态图像进行分析,未来可考虑引入时序信息,结合视频序列数据,提高对复杂病变发展的识别能力。

-

图 1 4种不同评分的肺超声图像示意图

Fig. 1 Representative lung ultrasound images with 4 different scoring levels

A: A-line (normal horizontal artifacts) indicating well-aerated lung (score 1); B: B-line (vertical artifacts) indicating interstitial syndrome (score 2); C: Disrupted pleural line indicating pleural discontinuity (score 3); D: Consolidation shows a tissue-like pattern with alveolar filling (score 4).

图 2 FastViT网络结构示意图

Fig. 2 Architecture of FastViT network

FastViT: Fast hybrid vision Transformer; Emb: Embedding; DW: Depthwise; Avg. Pool: Average pooling; FC: Fully connected layer; Conv: Convolution; S: Stride; BatchNorm: Batch normalization; ConvFFN: Convolutional feed-forward network; CPE: Conditional positional encoding; ⊕: Element-wise addition.

图 4 ShuffleNet单元

Fig. 4 ShuffleNet unit

A: Standard unit with unchanged resolution; B: Downsampling unit with halved resolution. GConv: Group convolution; BN: Batch normalization; Relu: Rectified linear unit; DWConv: Depthwise convolution; ADD: Element-wise addition; Avg. Pool: Average pooling; Concat: Concatenation.

图 9 改进FastViT模型在不同征象关注情况下的可视化结果

Fig. 9 Visualizations of the improved FastViT model focusing on different ultrasound signs

A: Continuous pleural line with the presence of A-lines; B: Presence of B-lines; C: Discontinuity of the pleural line; D: Pulmonary consolidation observed. FastViT: Fast hybrid vision Transformer.

表 1 患者详细分布信息

Table 1 Detailed distribution of patients

Index Wuhan Huoshenshan Hospital N=31 The Second Affiliated Hospital of Naval Medical University N=28 Zhongshan Hospital of Fudan University N=10 Age/year, x±s 55±21 51±29 76±13 Gender, n Male 19 16 8 Female 12 12 2 Disease type Pneumonia Pneumonia/ARDS ARDS Imaging device LOGIQ e (GE HealthCare) M9 (Mindray HealthCare) M9 (Mindray HealthCare) ARDS: Acute respiratory distress syndrome. 表 2 FastViT与改进FastViT模型在五折交叉验证中的准确率对比

Table 2 Accuracies of FastViT and improved FastViT models in 5-fold cross-validation

Model Trainable parameter Accuracy/% Fold 1 Fold 2 Fold 3 Fold 4 Fold 5 Mean FastViT 3 260 308 92.4 92.2 94.1 95.9 94.1 93.74 Improved FastViT 3 260 857 95.2 96.7 96.6 96.7 94.5 95.94 FastViT: Fast hybrid vision Transformer. 表 3 改进FastViT与主流深度学习模型对比实验结果

Table 3 Comparison of improved FastViT with mainstream deep learning models

Model Parameter/(×106) Input/(pixel×pixel) FLOPs/(×106) Accuracy/% EfficientViT_M4 8.4 224×224 299 92.9 EfficientNet_B2 8.9 224×224 1 000 96.3 ResNet50 23.6 224×224 4 100 94.7 MobileNetV2 2.2 224×224 600 95.4 RepViT-M1.1 7.8 224×224 2 600 90.1 Improved FastViT 3.2 224×224 700 96.7 FastViT: Fast hybrid vision Transformer; FLOPs: Floating-point operations per second. 表 4 YOLOv5模型对肺超声图像中B线的自动检测、计数与间距测量

Table 4 Automatic detection, counting, and spacing measurement of B-lines in lung ultrasound images using YOLOv5 model

Original image Affine-transformed image Detection image Number of B-lines Inter-B-line distance/pixel

2 147

3 186, 110

1 0 表 5 肺超声图像中B线检测典型漏检示例

Table 5 Typical examples of missed B-line detections in lung ultrasound images

Labeled image Detection image Number of missed B-lines

1

1

1 -

[1] BEHINAEIN P, HUTCHINGS H, KNAPP T, et al. The growing impact of air quality on lung-related illness:a narrative review[J]. J Thorac Dis, 2023, 15(9):5055-5063. DOI: 10.21037/jtd-23-544. [2] BALOESCU C, BAILITZ J, CHEEMA B, et al. Artificial intelligence-guided lung ultrasound by nonexperts[J]. JAMA Cardiol, 2025, 10(3): 245-253. DOI: 10.1001/jamacardio.2024.4991. [3] BLAZIC I, COGLIATI C, FLOR N, et al. The use of lung ultrasound in COVID-19[J]. ERJ Open Res, 2023, 9(1): 196-2022. DOI: 10.1183/23120541.00196-2022. [4] LIU X, SI S, GUO Y, et al. Limitations of bedside lung ultrasound in neonatal lung diseases[J]. Front Pediatr, 2022, 10: 855958. DOI: 10.3389/fped.2022.855958. [5] ZANZA C, SAGLIETTI F, TESAURO M, et al. Cardiogenic pulmonary edema in emergency medicine[J]. Adv Respir Med, 2023, 91(5): 445-463. DOI: 10.3390/arm91050034. [6] 赵浩天, 王晓娜, 刘元琳, 等. 构建肺超声质量管理与控制方案对提高3种B线相关肺疾病诊断准确度的价值[J]. 中国超声医学杂志, 2024, 40(11): 1241-1244. DOI: 10.3969/j.issn.1002-0101.2024.11.013. [7] LAJILI F, TOUMIA M, SEKMA A, et al. Value of lung ultrasound sonography B-lines quantification as a marker of heart failure in COPD exacerbation[J]. Int J Chronic Obstr Pulm Dis, 2024, 19: 1767-1774. DOI: 10.2147/copd.s447819. [8] IENGHONG K, CHEUNG L W, GAYSONSIRI D, et al. The diagnostic performance of automatic B-lines detection for evaluating pulmonary edema in the emergency department among novice point-of-care ultrasound practitioners[J]. Emerg Radiol, 2025, 32(2): 241-246. DOI: 10.1007/s10140-025-02319-4. [9] 李梦迪, 娄君鸽, 张小艳, 等. 肺部超声B线评分联合膈肌功能相关参数对重症机械通气患者撤机成功的预测价值[J]. 西南医科大学学报, 2025, 48(1): 87-91, 96. DOI: 10.3969/j.issn.2096-3351.2025.01.017. [10] HYUN J, KIM A R, LEE S E, et al. B-lines by lung ultrasound as a predictor of re-intubation in mechanically ventilated patients with heart failure[J]. Front Cardiovasc Med, 2024, 11: 1351431. DOI: 10.3389/fcvm.2024.1351431. [11] 王冰冰, 林莉妃, 陈寸, 等. 肺部超声B线评分联合膈肌超声对重症呼吸衰竭患儿机械通气撤机结局的预测价值[J]. 山东医药, 2024, 64(25): 35-39. DOI: 10.3969/j.issn.1002-266X.2024.25.008. [12] ZHAO L, FONG T C, BELL M A L. Detection of COVID-19 features in lung ultrasound images using deep neural networks[J]. Commun Med, 2024, 4(1): 41. DOI: 10.1038/s43856-024-00463-5. [13] 张睿智, 杨冲, 徐栋. 基于轻量化U-Net模型分割乳腺癌超声图像[J]. 中国介入影像与治疗学, 2024, 21(10): 618-623. DOI: 10.13929/j.issn.1672-8475.2024.10.011. [14] 陈唐欣汐, 肖运平, 潘永军. AI深度学习对早期肺腺癌不同病理类型的精准识别[J]. 医学影像学杂志, 2024, 34(5): 56-60. DOI: 10.20258/j.cnki.1006-9011.2024.05.010. [15] BALOESCU C, TOPOREK G, KIM S, et al. Automated lung ultrasound B-line assessment using a deep learning algorithm[J]. IEEE Trans Ultrason Ferroelectr Freq Control, 2020, 67(11): 2312-2320. DOI: 10.1109/TUFFC.2020.3002249. [16] 曹绮雯, 王春晖, 万杰君, 等. 基于EasyDL开发糖尿病眼底病变人工智能分级诊断模型及其验证评价[J]. 新医学, 2022, 53(5): 361-365. DOI: 10.3969/j.issn.0253-9802.2022.05.012. [17] 宋涛, 陆建平, 张倩雯. 人工智能医学影像技术在胰腺神经内分泌肿瘤分级中的应用[J]. 第二军医大学学报, 2020, 41(4): 433-438. DOI: 10.16781/j.0258-879x.2020.04.0433. [18] NI Y, CONG Y, ZHAO C, et al. Active learning based on multi-enhanced views for classification of multiple patterns in lung ultrasound images[J]. Comput Med Imaging Graph, 2024, 118: 102454. DOI: 10.1016/j.compmedimag.2024.102454. [19] 史妹, 周历安, 符叶柳. 床旁肺超声B线计数及外周血嗜酸性粒细胞评估慢性阻塞性肺疾病并发肺炎的价值及其相关因素分析[J]. 海军医学杂志, 2023, 44(12): 1243-1247. DOI: 10.3969/j.issn.1009-0754.2023.12.007. [20] 屈若为, 徐桂芝. 基于改进SLIC与CNN的细胞显微图像分割与计数[J]. 河北工业大学学报, 2022, 51(1): 1-6. DOI: 10.14081/j.cnki.hgdxb.2022.01.001. [21] GUO J, WU Y, KAIMAKAMIS E, et al. Efficient lung ultrasound severity scoring using dedicated feature extractor[J/OL]. arXiv: 2501.12524v1. (2025-01-21)[2025-06-18]. https://arxiv.org/html/2501.12524v1. [22] CHU Y, LUO X, ZHANG J, et al. An 8-point scale lung ultrasound scoring network fusing local detail and global features[J]. Sci Rep, 2025, 15(1): 5687. DOI: 10.1038/s41598-025-90018-y. [23] XING W, HE C, LI J, et al. Automated lung ultrasound scoring for evaluation of coronavirus disease 2019 pneumonia using two-stage cascaded deep learning model[J]. Biomed Signal Process Control, 2022, 75: 103561. DOI: 10.1016/j.bspc.2022.103561. [24] DEMI L, WOLFRAM F, KLERSY C, et al. New international guidelines and consensus on the use of lung ultrasound[J]. J Ultrasound Med, 2023, 42(2): 309-344. DOI: 10.1002/jum.16088. [25] ANASOSALU VASU P K, GABRIEL J, ZHU J, et al. FastViT: a fast hybrid vision Transformer using structural reparameterization[C]//2023 IEEE/CVF International Conference on Computer Vision (ICCV). October 1-6, 2023. Paris, France. IEEE, 2023: 5762-5772. DOI: 10.1109/iccv51070.2023.00532. [26] ZHANG X, ZHOU X, LIN M, et al. ShuffleNet: an extremely efficient convolutional neural network for mobile devices[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. June 18-23, 2018. Salt Lake City, UT, USA. IEEE, 2018: 6848-6856. DOI: 10.1109/CVPR.2018.00716. [27] REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: unified, real-time object detection[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). June 27-30, 2016. Las Vegas, NV, USA. IEEE, 2016: 779-788. DOI: 10.1109/CVPR.2016.91.

下载:

下载: