2. 郑州大学 电气与信息工程学院 河南 郑州 450001;

3. 国网河南省电力供电公司 许昌市建安供电公司 河南 许昌 461000

2. School of Electrical and Information Engineering, Zhengzhou University, Zhengzhou 450001, China;

3. Xuchang City Jian′an Power Supply Company, Henan Electric Power Company of State Grid, Xuchang 461143, China

近年来,红外小目标检测大量应用于遥感、航空、安防等领域,受到了学者们的广泛关注。但是由于场景复杂度不断提高以及目标信号强度弱小等原因,导致了红外小目标检测十分具有挑战性。

目前,主要有基于手工特征提取与基于深度学习的红外弱小目标检测方法。基于手工特征的红外弱小目标检测方法较为典型的有文献[1]中提出的局部对比度测量(local contrast measurement,LCM)方法,该方法通过计算中心像素与其背景上八个方向的对比度之和作为该像素的局部对比度值,然后逐像素遍历整张图像,并根据目标与背景之间的局部对比度差异检测出红外小目标。考虑到LCM算法对噪声点较为敏感,并且计算复杂度较高,文献[2]在LCM基础上提出了三层局部对比度测量(three-layer local contrast measurement,TLLCM)算法,TLLCM算法通过计算中心像素的多层对比度值来抑制噪声点对检测效果的影响,从而进一步提升了检测性能。基于LCM局部对比度思想的方法还有文献[3]中的相关局部对比度测量(relative local contrast measurement,RLCM)方法等,在实际检测中也取得了一定的效果。此外,代表性的基于手工特征的检测方法还包括文献[4-6]中的局部强度和梯度(local intensity and gradient,LIG)方法、非凸秩逼近最小化(non-convex rank approximation minimization,NRAM)方法与张量核范数的部分和(partial sum of the tensor nuclear norm,PSTNN)方法。但是这些传统红外弱小目标检测方法过度依赖于手工特征的选择,虽然取得了不错的检测效果,但是由于没有充分挖掘和利用红外图像中弱小目标的原始特征,导致这些方法的检测性能受到了限制。

基于深度学习的红外弱小目标检测方法近年来大量涌现,例如文献[7]提出的深度卷积神经网络(deep convolutional neural network,Deep-CNN)方法,利用CNN搭建红外弱小目标分割网络实现对小目标的检测,但是由于CNN在网络不断加深的过程中损失了一定的弱小目标特征,导致了该方法的分割结果表现一般。文献[8]提出了注意局部对比网络(attentional local contrast networks,ALC-net),ALC-net将传统的局部对比度测量方法模块化为端到端网络中的无参数非线性特征细化层,并通过特征映射来实现弱小目标的分割检测。此外,文献[9]提出了基于深度学习的红外弱小目标分割网络和文献[10]利用生成对抗网络(generative adversarial networks,GAN)来检测小目标等。这些基于深度学习的方法较为新颖,在背景单一的场景中取得了不错的检测性能,但是在场景较为复杂的检测任务中性能欠佳,主要是由于红外图像中弱小目标的原始特征较少、较弱,使得在复杂场景中仅仅依靠小目标的原始特征来完成检测任务变得极其困难。

本文综合基于手工特征以及基于深度学习检测方法的优势,设计了基于深度学习的红外弱小目标深度特征融合检测网络模型。该网络模型同时提取红外图像中弱小目标的原始特征与平滑度图像中弱小目标的平滑度特征,将两种特征融合以实现目标增强,进一步利用多层级联的特征融合映射网络对目标进行特征映射,实现复杂背景杂波的有效抑制。实验结果表明,同现有的基于深度学习与基于手工特征的检测方法相比,本文所提出的检测方法不仅具有较高的检测性能,而且具备较快的检测速度。

1 红外弱小目标特征融合检测方法 1.1 红外小目标平滑度特征提取在红外图像中,弱小目标像素的灰度分布往往呈现出近似中心对称并向四周辐射的形状,这与二维高斯函数非常相似。因此,许多学者使用二维高斯函数对弱小目标进行建模[11]。小目标模型定义为

| $ f_T(x, y)=A \cdot \exp \left\{-\frac{1}{2}\left[\left(\frac{x-x_c}{\theta_x}\right)^2+\left(\frac{y-y_c}{\theta_y}\right)^2\right]\right\}, $ | (1) |

其中:fT(x, y)为红外弱小目标的空间分布灰度函数;A为目标的灰度幅度;θx和θy分别为水平和垂直尺度参数;xc和yc为目标的坐标参数。

根据红外弱小目标灰度分布特性,文献[12]利用平滑度算子来检测红外弱小目标。平滑度算子定义为

| $ S(x, y)=S_{V 1} \cdot S_{V 2}, $ | (2) |

| $ S_{v 1}=\nabla^2 u(x, y)+\nabla^2 v(x, y), $ | (3) |

| $ S_{v 2}=\|\nabla I(x, y)\|^2, $ | (4) |

| $ \begin{aligned} & \nabla^2 u(x, y)=\left(\frac{\partial u}{\partial x}\right)^2+\left(\frac{\partial u}{\partial y}\right)^2 \nabla^2 v(x, y)= \\ & \left(\frac{\partial v}{\partial x}\right)^2+\left(\frac{\partial v}{\partial y}\right)^2, \end{aligned} $ | (5) |

其中:S(x, y)是每个像素的平滑度值;SV1为平滑度算子的第一项,反映了红外梯度场的方向变化;SV2为平滑度算子的第二项,反映了红外梯度场的振幅变化,这两项分别从两个维度来表征红外图像梯度场的平滑程度;u、v是红外图像中像素灰度梯度的两个分量,即x轴和y轴的两个分量;▽I(x, y)是图像的一阶导数。

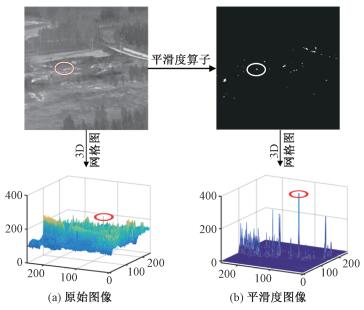

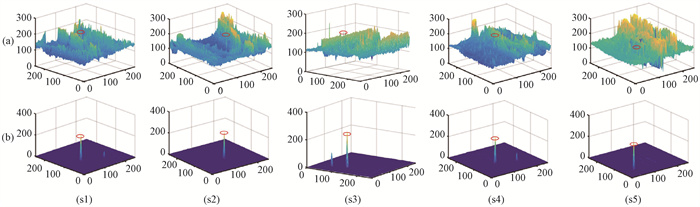

平滑度算子根据小目标与背景杂波的一阶导与二阶导差异来对目标进行增强和对背景进行抑制,最终得到平滑度图像。图 1显示了平滑度图像及其三维显示图像。可以看出,平滑度图像中小目标被极大增强,背景得到一定程度的抑制,并且平滑度图像中目标的结构特性与原始图像中相似,但是平滑度图像仍有一定量背景杂波干扰,直接从中提取目标仍然存在难度。因此,为了获得更好的检测性能,我们设计了一个融合弱小目标原始特征与平滑度特征的融合检测框架。

|

图 1 平滑度图像及其三维显示图像 Fig. 1 Smoothness image and the 3D display |

传统红外弱小目标检测方法大都只能利用红外图像中目标的单一特征来进行检测,因此这些都方法不能充分地利用红外图像的特征对其进行检测,导致检测性能较差。因此本文提出一种深度特征融合检测框架,充分挖掘和利用目标特征,通过融合原始图像与平滑度图像所包含的不同特征实现目标检测。

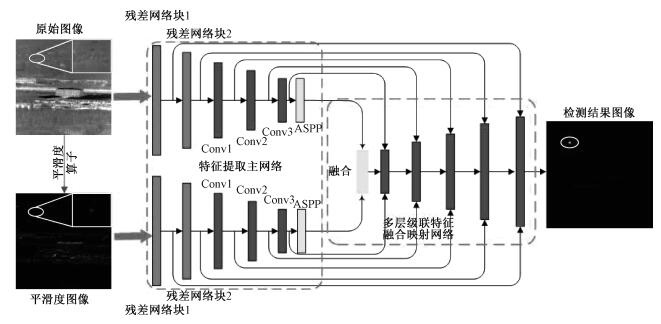

深度特征融合检测框架如图 2所示,该框架由一个特征提取主网络和一个多层级联特征融合映射网络构成。特征提取主网络由两个相同的子网络构成,分别对输入的原始图像与平滑度图像进行特征提取。多层级联特征融合映射网络首先实现提取图像的特征融合任务,然后采样网络对经过特征融合的特征图进行背景抑制与上采样,最终输出检测结果,即背景被极大抑制的小目标特征映射图像。

|

图 2 基于深度特征融合的红外弱小目标检测框架 Fig. 2 Infrared dim small target detection framework based on depth feature fusion |

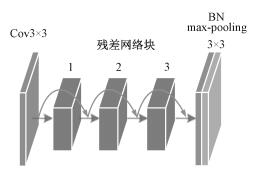

如图 2所示,特征提取主网络为两个相同的分支网络,分支网络包含2个残差网络连接特征提取网络块,3个卷积(convolution,Conv)池化层和一个提升感受野的空洞空间卷积池化金字塔(atrous spatial pyramid pooling, ASPP)模块[14]。由于输入图像在卷积与池化过程中会导致小目标的一些特征损失,为了减少这种损失,在特征提取网络中构建残差网络块,残差网络模块由一个1×1的卷积层、3个残差块(residual block)[13]、一个批标准化层(batch normalization,BN)和一个最大池化层(max-pooling)组成,其结构如图 3所示。残差网络块通过网络中各层的密集连接达到对红外小目标特征的充分利用。

|

图 3 残差网络块 Fig. 3 Residual network block |

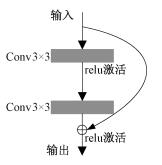

在残差网络块中包含3个残差块,其结构如图 4所示,从图中可以看出残差块将浅层特征图与深层特征图进行了跳跃式的连接,这种连接方式使网络深度在不断增加的过程中避免了一些特征的损失,实现了网络对小目标特征的特征重用。

|

图 4 残差块 Fig. 4 Residual block |

为了使特征提取网络拥有更大的感受野,并且适应不同尺度的目标,我们在特征提取网络中使用了ASPP。ASPP对所给定的输入以不同采样率的空洞卷积并行采样,相当于以多个比例捕捉图像的上下文,这使得网络拥有更大的感受野以适应不同尺度的红外小目标。特征提取主网络各部分的具体参数如表 1所示。

|

|

表 1 特征提取主网络的网络参数 Tab. 1 Network parameters in feature extraction of main network |

经过特征提取主网络后,将得到256通道原始特征图和256通道平滑度特征图。为获得更好的检测效果,对原始特征图与平滑度特征图进行特征融合。如图 2所示,首先,在特征提取网络末尾对两个特征图进行求和操作,得到深度特征融合图像。其次,考虑到特征提取阶段卷积与池化可能造成特征图目标特征的损失,为进一步弥补这些可能的特征损失,在特征融合图像上采样阶段,我们设计了一个多层级联特征融合映射上采样网络来对红外弱小目标进行特征映射以及背景抑制。在进行特征映射上采样的过程中逐层融合了特征提取网络中的浅层特征与深层特征,使得在特征映射过程中减少了目标特征的损失。通过该映射网络将得到背景杂波被极大抑制、小目标特征被极大增强的特征映射图像。

1.2.4 网络训练与损失函数为了使检测网络能够充分地学习红外弱小目标的特征,我们使用了像素级的均方误差损失函数(mean square error, MSE)来约束网络的训练。其定义为

| $ M S E=\frac{\sum\limits_\limits{x=1}^m \sum\limits_\limits{y=1}^n(L(x, y)-P(x, y))^2}{m \times n}, $ | (6) |

其中: MSE是网络训练的损失函数;L(x, y)是标签图像;P(x, y)是网络的预测输出结果图像;m与n分别是图像的长与宽。

通过损失函数约束网络训练,我们的检测模型最终获得检测结果。值得注意的是,所获得的检测结果并不需要阈值进行分割,网络的输出就是弱小目标的特征表达图像,并不包含背景杂波。

2 实验验证为验证所提方法的有效性,同现有的红外弱小目标检测方法在5个(S1~S5)图像序列上进行了对比分析,这5个图像序列全部来自于公共数据集[15],每个图像序列包含500张图片,其中5个图像序列前80张图片组成共400张图片作为训练数据集,其余的2 100张图片作为测试数据,所有图像序列都拥有极其复杂的背景。所对比的算法包括RLCM[3]、IPI[16]、LIG[4]、TLLCM[2]、NRAM[5]、PSTNN[6]、Deep-CNN[7]、U-net3+[17]8种代表性方法。为了公平性,所有基于深度学习的对比方法全部使用与所提出方法相同的训练数据进行重新训练。值得注意的是,我们的对比实验都是在同一台设备上进行的,并且对比方法的源码全部来源于对应文献的官方网站。在NVIDIA 1660ti上训练了0.5 GPU day。卷积由Pytorch后端计算,优化器为Adam,学习率为0.001。训练步骤为20个epochs。

在红外弱小目标检测领域内,信噪比增益(signal to clutter ratio gain, SCRG)与背景抑制比(background suppression factor, BSF)表征了检测算法的背景抑制以及目标增强的能力。我们在5个图像序列上测试了所有对比算法的SCRG与BSF结果,实验结果如表 2所示。从表 2中我们可以看出,所提方法在SCRG与BSF指标上比现有方法有极大的提升。SCRG和BSF的定义为

|

|

表 2 不同方法在5个图像序列中的SCRG与BSF Tab. 2 SCRG and BSF of different methods in five image sequences |

| $ S C R=\left|\mu_{\mathrm{t}}-\mu_{\mathrm{b}}\right| / \sigma_{\mathrm{b}}, $ | (7) |

| $ S C R G=S C R_{\text {out }} / S C R_{\mathrm{in}}, $ | (8) |

| $ B S F=C_{\text {in }} / C_{\text {out }}, $ | (9) |

其中: SCR是图像的信杂比;μt是目标的平均像素值;μb是背景区域的平均像素值;σb是背景区域的标准偏差;SCRin是输入图像的信杂比;SCRout是输出图像的信杂比;Cin和Cout分别为输入图像和检测结果图像的标准偏差。

为直观显示所提方法背景抑制以及目标增强能力,图 5展示了所提方法对5个图像序列的处理结果(上面一行和下面一行分别是原始图像和检测图像的三维显示)。从图中可以看出,5个原始图像序列背景杂波较强,但是所提方法能够有效抑制杂波并提高目标的显著度,证明了所提方法在强杂波场景下的优异性能。

|

图 5 所提出的方法在5个图像序列中的检测结果 Fig. 5 The detection result of our method in five image sequences |

为进一步验证所提检测方法的虚警率Fa以及检测准确率Pd,我们进行了对比实验, Pd与Fa的定义为

| $ F_{\mathrm{a}}=N_{\mathrm{f}} / N_{\mathrm{r}}, $ | (10) |

| $ P_{\mathrm{d}}=N_{\mathrm{d}} / N_{\mathrm{r}}, $ | (11) |

其中: Nr是真实目标的总数;Nf是检测到的错误目标数量;Nd是检测到真实目标的数量。

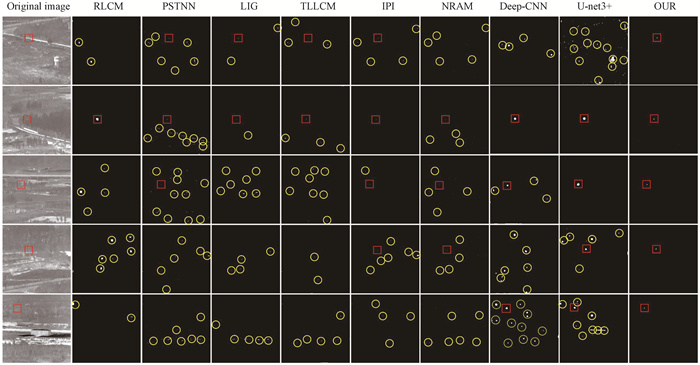

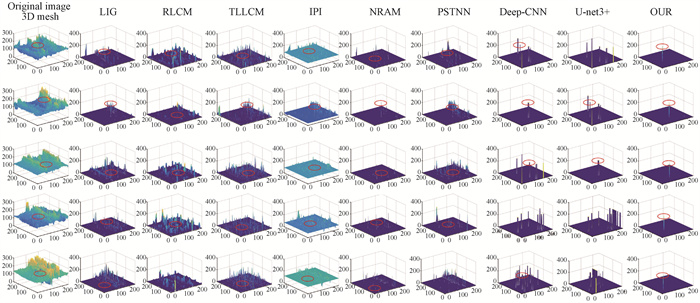

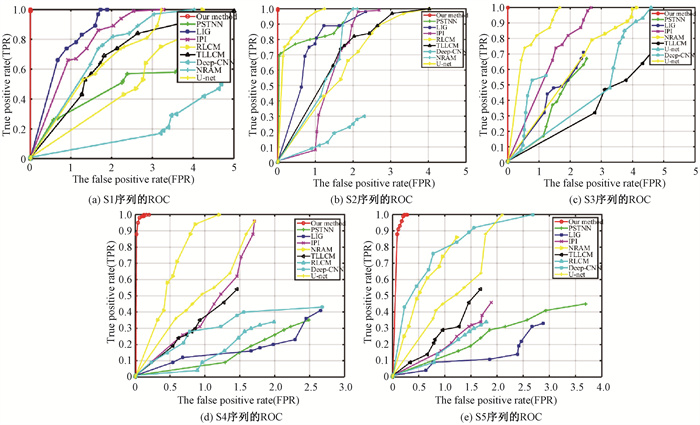

如图 6所示为各对比算法的检测得分图,其中红色方框代表的是检测到的真实目标,黄色方框为虚警。从图中可以看出,所选图像序列背景复杂且强烈,同时目标信号的强度和对比度都很弱,但是所提方法相较于对比方法能够更有效地检测到正确目标,并抑制虚警。图 7展示了不同方法的背景抑制效果,从图中可以看出,我们的方法在复杂背景杂波下的背景抑制效果要优于其他现有的方法。表 3为不同方法在5个图像序列中的Pd与Fa值,从中可以清楚地看出所提方法在检测率和虚警率两个指标上都明显优于对比方法,说明深度特征融合方法同时具备手工特征和深度学习方法的优势,并证明了所提方法在强杂波环境下的优异检测性能。在红外弱小目标检测领域,ROC(receiver operating characteristic, ROC)曲线反映了所提出方法的鲁棒性。图 8展示了所有对比方法的ROC曲线,从图 8中可以清晰地看出我们的检测方法拥有最好的检测表现。此外,为了验证所提出方法的快速性表现,我们进行了检测实时性实验。表 4展示了不同检测方法在5个图像序列中的平均检测时间。从表 4中我们可以看出,与现有先进的方法相比,所提出的方法拥有最好的检测实时性。

|

图 6 不同方法在5个图像序列中的检测得分图 Fig. 6 Detection score diagram of different methods in five image sequences |

|

图 7 不同方法在5个图像序列中的背景抑制结果 Fig. 7 Background suppression results of different methods in five image sequences |

|

|

表 3 不同方法在5个图像序列中的Pd与Fa Tab. 3 Pd and Fa of different methods in five image sequences |

|

图 8 不同方法在5个图像序列中的检测ROC曲线。 Fig. 8 ROC curve detection by different methods in five image sequences |

|

|

表 4 不同方法在5个图像序列上的平均检测时间 Tab. 4 Average detection time of different methods on five image sequences |

本文提出了一种强背景杂波干扰下的深度学习红外弱小目标检测框架。该框架中,针对红外弱小目标特征稀少问题,提出了一种红外弱小目标多特征提取-融合-映射模型,该模型能够在目标特征稀少情况下充分学习红外弱小目标的结构及数据信息,并且能对强背景杂波进行有效抑制。实验结果表明,本文所提出检测方法同现有红外弱小目标检测方法相比,检测性能提升显著。

| [1] |

CHEN C L P, LI H, WEI Y T, et al. A local contrast method for small infrared target detection[J]. IEEE transactions on geoscience and remote sensing, 2014, 52(1): 574-581. DOI:10.1109/TGRS.2013.2242477 (  0) 0) |

| [2] |

HAN J H, MORADI S, FARAMARZI I, et al. A local contrast method for infrared small-target detection utilizing a tri-layer window[J]. IEEE geoscience and remote sensing letters, 2020, 17(10): 1822-1826. DOI:10.1109/LGRS.2019.2954578 (  0) 0) |

| [3] |

HAN J, YONG M, BO Z, et al. A robust IR small target detection algorithm based on human visual system[J]. IEEE geoscience and remote sensing letters, 2014, 11(12): 2168-2172. DOI:10.1109/LGRS.2014.2323236 (  0) 0) |

| [4] |

ZHANG H, ZHANG L, YUAN D, et al. Infrared small target detection based on local intensity and gradient properties[J]. Infrared physics & technology, 2018, 89: 88-96. (  0) 0) |

| [5] |

KONG X, YANG C P, CAO S Y, et al. Infrared small target detection via nonconvex tensor fibered rank approximation[J]. IEEE transactions on geoscience and remote sensing, 2022, 60: 1-21. (  0) 0) |

| [6] |

ZHANG L D, PENG Z M. Infrared small target detection based on partial sum of the tensor nuclear norm[J]. Remote sensing, 2019, 11(4): 382. DOI:10.3390/rs11040382 (  0) 0) |

| [7] |

LIN L K, WANG S Y, TANG Z X. Using deep learning to detect small targets in infrared oversampling images[J]. Journal of systems engineering and electronics, 2018, 29(5): 947-952. DOI:10.21629/JSEE.2018.05.07 (  0) 0) |

| [8] |

DAI Y M, WU Y Q, ZHOU F, et al. Attentional local contrast networks for infrared small target detection[J]. IEEE transactions on geoscience and remote sensing, 2021, 59(11): 9813-9824. DOI:10.1109/TGRS.2020.3044958 (  0) 0) |

| [9] |

HOU Q Y, WANG Z P, TAN F J, et al. RISTDnet: robust infrared small target detection network[J]. IEEE geoscience and remote sensing letters, 2022, 19: 1-5. (  0) 0) |

| [10] |

ZHAO B, WANG C P, FU Q, et al. A novel pattern for infrared small target detection with generative adversarial network[J]. IEEE transactions on geoscience and remote sensing, 2021, 59(5): 4481-4492. DOI:10.1109/TGRS.2020.3012981 (  0) 0) |

| [11] |

XIONG Y, PENG J X, DING M Y, et al. An extended track-before-detect algorithm for infrared target detection[J]. IEEE transactions on aerospace and electronic systems, 1997, 33(3): 1087-1092. DOI:10.1109/7.599339 (  0) 0) |

| [12] |

MA T L, YANG Z, REN X Y, et al. Infrared small target detection based on smoothness measure and thermal diffusion flowmetry[J]. IEEE geoscience and remote sensing letters, 2022, 19: 1-5. (  0) 0) |

| [13] |

HE K M, ZHANG X Y, REN S Q, et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE Press, 2016: 770-778.

(  0) 0) |

| [14] |

CHEN L C, PAPANDREOU G, SCHROFF F, et al. Rethinking atrous convolution for semantic image segmentation[EB/OL]. (2017-12-05)[2022-01-20]. https://arxiv.org/pdf/1706.05587.pdf.

(  0) 0) |

| [15] |

HUI B, SONG Z, FAN H. A dataset for infrared detection and tracking of dim-small aircraft targets underground/air background[J]. China scientific data, 2020, 5(3): 291-302. (  0) 0) |

| [16] |

GAO C, MENG D, YANG Y, et al. Infrared patch-image model for small target detection in a single image[J]. IEEE transactions on image processing, 2013, 22(12): 4996-5009. DOI:10.1109/TIP.2013.2281420 (  0) 0) |

| [17] |

HUANG H M, LIN L F, TONG R F, et al. UNet 3+: a full-scale connected UNet for medical image segmentation[C]//ICASSP 2020 IEEE International Conference on Acoustics, Speech and Signal Processing. Piscataway: IEEE Press, 2020: 1055-1059.

(  0) 0) |

2023, Vol. 55

2023, Vol. 55