2. 浙江农林大学暨阳学院 浙江 诸暨 311800

2. Jiyang College, Zhejiang Agriculture and Forestry University, Zhuji 311800, China

随着全球化和信息化的发展,隐私和数据安全问题日益凸显。信息隐藏技术可将秘密消息隐藏在数字媒体(如图像[1]、文本[2]、视频[3]和语音[4-10])中,在保障信息安全传输的同时,也可能被滥用。因此,研究高效的信息隐藏检测方法变得至关重要。

IP语音(voice over internet protocol,VoIP)信息隐藏是一种将秘密消息隐藏进压缩语音中的技术。基于VoIP的隐写方法主要分为直接调制语音流码元的方法[4-5]和在编码过程中调制参数的方法[6-10]。量化索引调制(quantization index modulation,QIM)方法最早由Chen等[7]提出,该方法在载体失真和容量上做了高效平衡。随后,研究者们提出了多种改进的QIM方法,其中,Xiao等[8]提出了互补邻点对(complementary neighbor vertices QIM,CNV)方法,Liu等[9]提出了最近邻投影替换量化索引调制(nearest-neighbor projection point replacement QIM,NPPR)方法,Tian等[10]提出了安全量化索引调制(security QIM,SEC)方法。

针对基于QIM隐写方法的隐写分析主要包括基于手工特征的机器学习方法[11-12]和基于神经网络的深度学习方法[13-16]。在基于手工特征的机器学习方法中,Li等[11]提出了一种基于索引分布特征的隐写分析方法,该方法通过分析量化索引中的相关性和不平衡性来构造特征,并结合支持向量机完成分类。Yang等[12]提出了基于码元贝叶斯网络(code element Bayesian network,CEBN)的压缩语音信息隐藏检测方法,该方法利用码元间的强相关性构造贝叶斯网络,然后学习网络参数并基于贝叶斯推理完成隐写分析。这类方法计算速度快、结果可解释,但在低嵌入率或短时长情况下检测准确率较低。深度学习方法能自动获取样本特征并完成分类,在多个领域有重要贡献[17-19]。在信息隐藏领域,深度学习方法能够自动学习码元间复杂的关联特征,极大地提升了隐写检查准确率和效率。其中,Lin等[13]提出了基于循环神经网络的相关模型(recurrent neural network steganalysis model,RNN-SM),通过分析码元与帧之间的相关性构建循环神经网络来完成隐写分析。Hu等[14]提出了隐写特征融合模型(steganalysis feature fusion network,SFFN),可以同时检测两类隐写方法,提高了检测的通用性。Yang等[15]提出了多通道卷积滑动窗口(convolutional sliding windows,CSW)隐写分析模型,该模型通过滑动窗口分析给定帧与相邻帧的相关性,并利用卷积神经网络和全连接神经网络实现隐写分类。Zhang等[16]提出了一种名为TENet的隐写分析方法,该方法利用编码码元和位置嵌入来提取包含码元潜在含义及其之间相关性的编码器表示用于样本分类。该类方法仍有提升空间,且可解释性不佳。

传统隐写分析方法在处理复杂的隐写技术和低嵌入率情况下常常表现出检测准确率低的问题。贝叶斯网络作为一种基于概率推理的模型,能够有效处理不确定性和复杂的依赖关系,适用于语音码元相关性的分析。然而,单一的贝叶斯网络模型在面对大规模数据和复杂特征时,其准确性欠佳。为了克服这些局限性,本文提出了一种基于贝叶斯网络群和支持向量机(support vector machine,SVM)的隐写分析方法,本文具体贡献如下。

1) 提出了一种不同于传统手工特征提取(设计特征—特征抽取—样本分类)的新框架,即“整体特征学习—个体特征提取—样本分类”框架,该框架从整体样本入手,学习整体样本特征,并提取个体样本特征,使模型适用大数据量样本,解释性强。

2) 引入贝叶斯网络思想,以码元和帧的角度设计贝叶斯网络群模型,结合语音自身码元、帧内码元和帧间码元相关性设计了多种检测模型。

1 背景及相关工作线性预测编码是低速率编码下实现高质量语音通信的最有效方法之一,其利用线性预测实现对语音信号谱包络压缩表示,能够实现精确的语音参数预测。在线性预测编码中,每帧包含三个8 bit矢量量化(vector quantization,VQ)码元,记作VQ1、VQ2和VQ3。

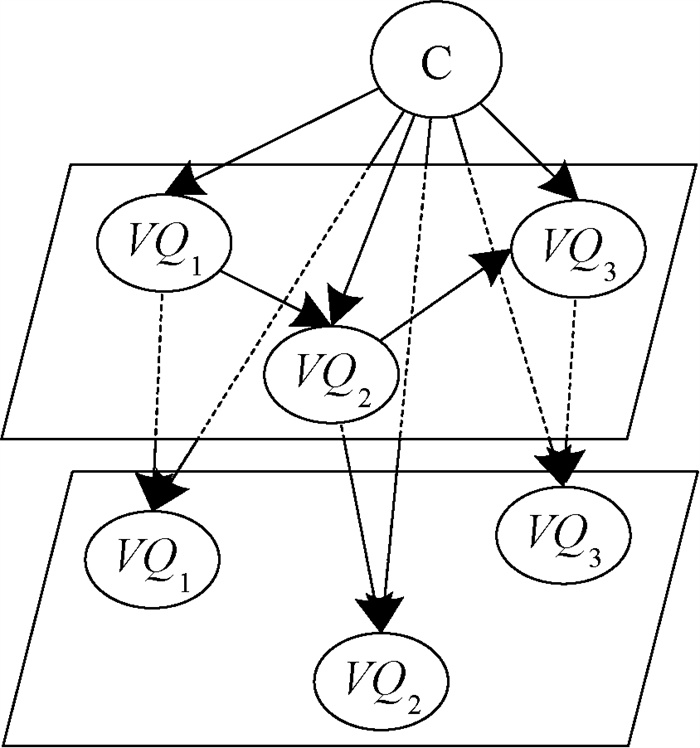

Yang等[12]提出了一种基于CEBN的隐写分析方案,其核心是利用贝叶斯网络推理进行样本分类。该方法首先分析了压缩语音流中的时空相关性;接着,利用时空相关性构建了码元时空相关网络,根据边相关指数进行减枝;然后,利用码元时空相关网络中帧内强相关边和帧间强相关边构建码元贝叶斯网络CEBN进行参数学习;最后,根据样本帧码元推理得到帧所属类别,从而完成分类,CEBN部分结构图如图 1所示。

|

图 1 码元贝叶斯网络 Fig. 1 The code element Bayesian network |

在CEBN中,贝叶斯网络根节点C表示帧类别,其余节点表示VQ码元。检测时对每个相邻帧进行贝叶斯推理,通过码元组合和条件概率表(condition probability table,CPT)推断帧类别。尽管CEBN取得了一定效果,但存在隐写敏感性抵消问题。隐写敏感性指码元节点的条件概率在隐写前后变化的程度。当多个节点的条件概率变化相互抵消时,整体贝叶斯网络的推理结果可能在隐写前后变化很小,不利于隐写分析。例如,节点A的条件概率在隐写后增大,而节点B的条件概率减小,两者相乘后的概率值可能变化很小,导致隐写敏感性抵消。此外,CEBN依赖固定的网络结构,难以灵活调整模型大小。对此,本文提出了一种新的QIM隐写分析方法。该方法结合了手工特征提取和神经网络的整体特征提取思路,使用多个贝叶斯网络来避免单一网络的敏感性抵消问题。同时,根据码元组合关系灵活调整贝叶斯网络数量,构建了七种包含不同码元关系的贝叶斯网络群模型。

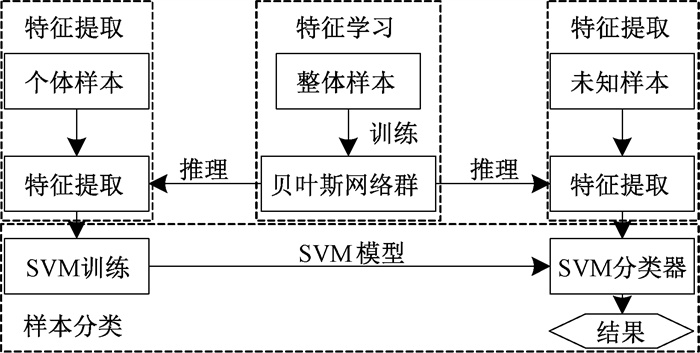

2 基于贝叶斯网络群的隐写分析方法不同于传统机器学习方法直接对每个样本进行特征提取,本文提出的基于手工特征提取的SVM隐写分类框架包含整体特征学习、个体特征提取和样本分类三个步骤,本文提出的基于贝叶斯网络群的隐写分析方法系统框图如图 2所示。本文提出的隐写分析方法结合了贝叶斯网络群和SVM的优势。首先,使用整体样本训练贝叶斯网络群参数,以捕捉数据的复杂相关性,学习整体特征模式。其次,利用训练好的贝叶斯网络群,通过概率推理得到个体样本的隐写和未隐写概率作为其个体特征。最后,训练SVM并进行分类。由于SVM在小样本上效率高、泛化能力强,本文在分类阶段仅使用个体样本特征进行训练和测试。利用大量样本通过贝叶斯网络群提取整体特征,在处理复杂语音码元相关性时显著提升了特征提取质量和准确性,同时在分类阶段采用SVM优化了效率和资源消耗。

|

图 2 本文隐写分析方法系统框图 Fig. 2 System diagram of the steganalysis |

对于G723.1编码而言,每个语音帧长度为30 ms,因此,长度为t ms的压缩语音帧数为n=t/30,并且每帧包含三个VQ码字。令VQ帧码元向量fi=[wi, 1, wi, 2, wi, 3],其中i为帧编号,从1开始,最大为n,wi, j表示压缩语音第i帧的第j个VQ码元。对于整个压缩语音可以得到VQ码元矩阵F,

| $ \boldsymbol{F}=\left[\begin{array}{c} \boldsymbol{f}_1 \\ \boldsymbol{f}_2 \\ \vdots \\ \boldsymbol{f}_n \end{array}\right]=\left[\begin{array}{ccc} w_{1, 1} & \cdots & w_{1, 3} \\ \vdots & & \vdots \\ w_{n, 1} & \cdots & w_{n, 3} \end{array}\right] $ | (1) |

与CEBN不同的是,本文不直接构建复杂的贝叶斯网络,转而使用N个简单的贝叶斯网络构建贝叶斯网络群Ω,Ω可以表示为

| $ \varOmega=\left\{G_1, G_2, \cdots, G_N\right\}, $ | (2) |

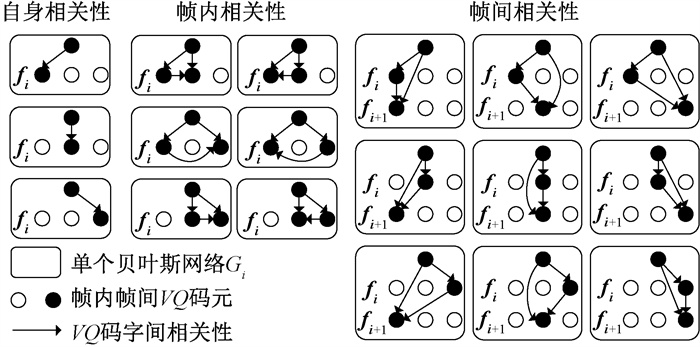

其中:Gi表示单个贝叶斯网络。本文构建的贝叶斯网络群Ω如图 3所示。Ω分为三部分,分别捕获压缩语音码元的自身相关性、帧内相关性和帧间相关性。每个子网络Gi的根节点表示类别C,其余节点代表当前帧或下一帧的VQ码元。黑色节点表示子网络中使用的节点,白色节点表示未使用的节点,有向边表示节点间的关系。

|

图 3 贝叶斯网络群结构设计 Fig. 3 Design of Bayesian network ensembles |

训练贝叶斯网络群Ω是学习Gi中CPT的过程,对于每个子网络Gi而言,包含一个根节点C和vi个VQ码元节点,其节点为随机变量Xi, 0, Xi, 1, …, Xi, vi,随机变量的取值分别记为xi, 0, xi, 1, …, xi, vi,其中xi, 0∈{0, 1}表示当前码元的关系类型,xi, 0=0表示当前码元关系为载体关系,xi, 0=1表示当前码元关系为隐写关系,xi, 1, …, xi, vi∈{0, 1, …, 255}表示该码元具体取值,网络联合分布概率可以表示为

| $ P\left(X_{i, 0}, X_{i, 1}, \cdots, X_{i, v_i}\right)=\prod\limits_{j=0}^{v_i} P\left(X_{i, j} \mid \operatorname{Par}\left(X_{i, j}\right)\right), $ | (3) |

其中:Par(Xi, j)表示随机变量Xi, j的父节点;

对于单个随机变量Xi, j而言,其CPT为在父节点所有可能状态下的条件概率的集合。因此,设Xi, j有K1个取值,Par(Xi, j)有K2个取值,那么当Xi, j取第k1个值,且Par(Xi, j)取第k2个值时,Xi, j的CPT中元素

| $ \phi_{i, j, k_1, k_2}=P\left(X_{i, j}=k_1 \mid \operatorname{Par}\left(X_{x, j}\right)=\operatorname{Par}\left(X_{x, j}\right)_{k_2}\right) 。$ | (4) |

为了更好地描述帧内帧间关系,设帧内帧间向量si表示相邻两帧VQ码元组成的向量,si可以表示为

| $ \boldsymbol{s}_i=\left[w_{i, 1}, w_{i, 2}, w_{i, 3}, w_{i+1, 1}, w_{i+1, 2}, w_{i+1, 3}\right] 。$ | (5) |

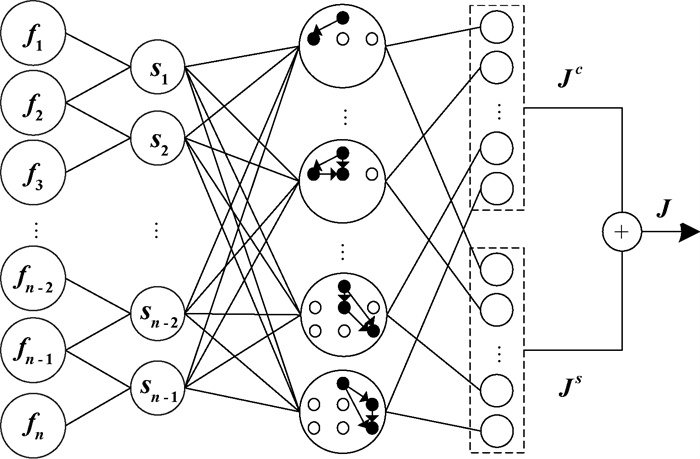

si在推理阶段可分为载体关系和隐写关系。语音流可表示为多个码元关系,进而推理得到多个载体和隐写关系。利用贝叶斯网络群进行概率推理和特征提取,将样本表示为多个码元关系组合得到特征向量J,如图 4所示。

|

图 4 特征提取过程 Fig. 4 Feature extraction process |

本文以压缩语音流VQ码元矩阵F作为模型输入,贝叶斯网络群Ω推理得到特征向量J的过程可形式化为

| $ \boldsymbol{J}=f_{\mathrm{BNE}}(\boldsymbol{F}, \boldsymbol{\varOmega}), $ | (6) |

其中:

| $ \boldsymbol{J}_i^c=\sum\limits_{i=1}^n \sum\limits_{j=1}^{n-1} p_{i, j}^c \text { 。} $ | (7) |

当前子网络的隐写指数

在计算得到样本特征向量J后,使用SVM分类器完成检测,图 2中样本分类过程包含SVM训练得到SVM分类器,对未知样本实现分类可形式化为

| $ C_{\boldsymbol{F}}=f_{\mathrm{SVM}}(\boldsymbol{J}), $ | (8) |

其中:fSVM(·)表示SVM模型的分类函数;

本文设计了一个包含18个贝叶斯网络的贝叶斯网络群,用于提取压缩语音流中的36维特征,包括自身相关性、帧内相关性和帧间相关性。为了避免出现模型可能提取到更多无用特征,从而导致检测精度下降和耗时过长的问题,本文根据码元组合关系的不同,构建了七种贝叶斯网络群模型,分别包括三个单一码元关系模型(M1~M3)、三个多种码元关系模型(M4~M6)和一个全码元关系模型(M7)。具体的码元关系组合情况如表 1所示。

|

|

表 1 多种码元关系组合检测模型 Tab. 1 Models of code element relationship combinations |

原始数据包含41 h中文语音和72 h英文语音[13],将其划分成长度为1~10 s的语音片段,得到15 560个中文和27 845个英文片段。按3∶1∶1比例划分为整体样本、个体样本和未知样本。使用G723.1编码器生成载体文件,并应用CNV、NPPR和SEC隐写方法生成隐写文件。本文实验包含四个部分。1) 评估提出的多种检测模型,分析码元关系组合对准确率的影响。2) 在不同嵌入率数据集上进行对比分析,验证方法的特征可解释性优势。3) 在不同时长数据集上与对比方法进行分析。4) 分析时间复杂度,验证模型的实时性。实验在Intel(R) Xeon(R) Gold 5218R CPU@2.10 GHz工作站上使用Python 3.8编程。

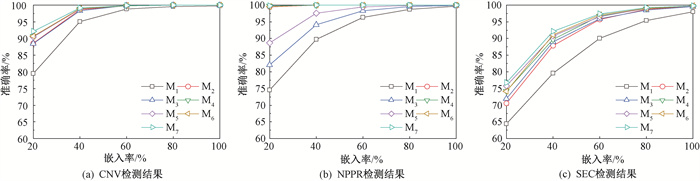

3.2 多种检测模型性能评估从自身码元关系、帧内码元关系和帧间码元关系出发,可以构建出七个不同码元关系组合的贝叶斯网络群检测模型。在10 s中文语音样本上、不同嵌入率下,分别就CNV、NPPR和SEC方法,使用七种不同检测模型分别实验,结果如图 5所示。

|

图 5 中文语音样本上不同嵌入率下、不同码元关系组合模型检测准确率 Fig. 5 Detection accuracy of methods using different models at different embedding rates on Chinese samples |

如图 5(a)所示,随着嵌入率的增加,各模型的检测准确率均有所提高,嵌入率增加导致语音中更多码元相关性被破坏,其中,多种码元关系模型的检测准确率高于单一码元关系模型,例如,包含自身码元关系和帧内码元关系的模型M4在20%嵌入率下检测三种隐写方法的准确率较仅包含帧内码元关系的模型M2高出2.04个百分点。全码元关系模型M7取得了最好的检测效果,因为它包含了三种码元关系,能够捕获更多特征。针对NPPR隐写方法和针对SEC隐写方法分别如图 5(b)和图 5(c)所示,有着和检测CNV隐写方法类似的结论。综上所述,考虑到模型M7在低嵌入率情况下的优越性能,后续实验中本文将使用M7模型与其他方法进行对比分析。

3.3 模型在不同嵌入率下的准确率嵌入率是隐写过程中的重要参数,提高嵌入率可以在载体中隐藏更多的信息,但也不可避免地修改更多码元值。因此,为全面评估本文方案应对不同隐写嵌入率的性能,在10 s中、英文样本上,分别在20%、40%、60%、80%和100%嵌入率下,CEBN、RNN-SM、SFFN、CSW和TENet检测方法分别对CNV、NPPR和SEC隐写方法进行对比实验,其结果如表 2和表 3所示(表中黑体数据为每种隐写方法下检测率最高值)。

|

|

表 2 中文语音样本上不同嵌入率下检测准确率 Tab. 2 Detection accuracy at different embedding rates on Chinese speech samples |

|

|

表 3 英文语音样本上不同嵌入率下检测准确率 Tab. 3 Detection accuracy at different embedding rates on English speech samples |

由表 2和表 3可知,随着嵌入率的增加,所有检测方法的准确率均有所提高。本文提出的方法在所有情况下都表现出最佳的检测性能,特别是在低嵌入率场景下优势更为明显。对于CNV隐写方法,在20%嵌入率时,本文方法在中文和英文样本上的检测准确率分别达到92.13%和92.66%,远高于其他方法。NPPR隐写方法中,本文方法在20%嵌入率下的准确率分别为99.78%和99.71%,同样优于对比方法。对于SEC隐写方法,本文方法在低嵌入率下仍保持领先,20%嵌入率时,准确率分别为76.78%和78.40%。另外,大多数方法在英文语音样本上的检测准确率略高于中文样本。这是因为英文发音由20个元音和28个辅音构成,而汉语有412个音节,导致中文语音的相关性更为复杂,增加了检测难度[15]。

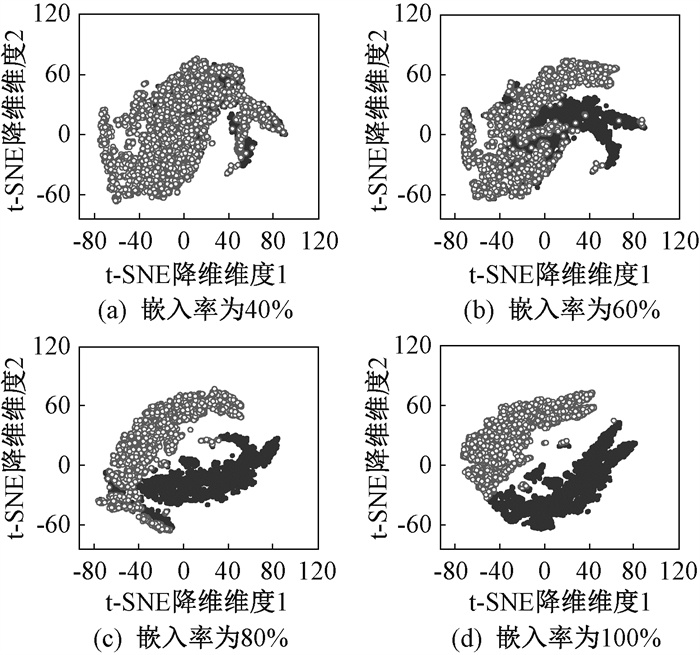

为验证本文方法的优势并增强特征可解释性,采用t-SNE技术[20]可视化CNV中文数据集特征向量J,结果如图 6所示。结果显示,随着嵌入率的提高,载体语音(白点)和隐写语音(黑点)在特征空间中的分布逐渐分离,反映了模型在不同嵌入率下提取隐写语音特征的能力。

|

图 6 CNV中文数据集t-SNE特征可视化图 Fig. 6 t-SNE feature visualization of CNV Chinese dataset |

在实际应用中语音载体可以视作一个无限长的语音流,这意味着在传输过程中任意位置均可嵌入秘密消息。为评估本文方法在不同时长下的性能,在100%嵌入率的中、英文样本中,在2 s至10 s的五种样本长度上进行了实验,在三种隐写方法上的测试结果如表 4和表 5所示(表中黑体数据为最佳数据)。由表 4和表 5可知,随着样本时长增加,各检测方法的准确率均有所上升,这是因为较长样本包含更多被修改的码元,能够获取更多隐写敏感特征。本文方法在大多数时长下的检测准确率优于对比方法。对CNV隐写方法而言,在2 s时长下,本文方法的中、英文准确率分别达到99.82%和99.70%。对NPPR隐写方法而言,2 s时长下中、英文准确率分别达到99.97%和100%。对于隐蔽性更高的SEC隐写方法,本方法在2 s时长下,中、英文准确率均超过95%。实验结果表明,本文方法在不同语音样本长度下均能保持高效的检测性能。

|

|

表 4 中文语音样本上不同时长下检测准确率 Tab. 4 Chinese speech detection accuracy by length |

|

|

表 5 英文语音样本上不同时长下检测准确率 Tab. 5 English speech detection accuracy by length |

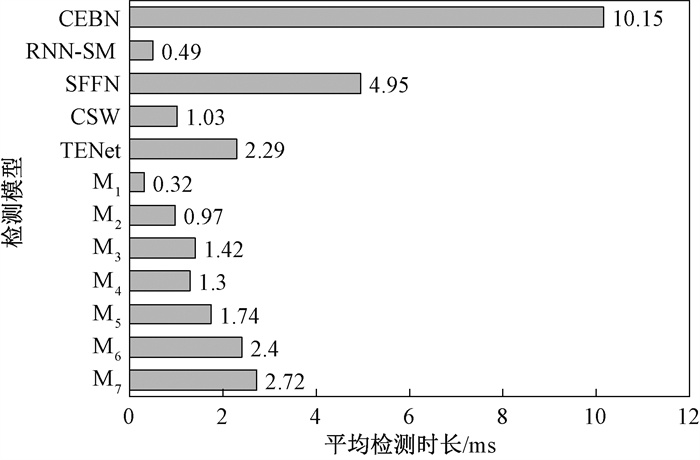

由于网络压缩语音实时传输的特性,检测方法也需具备实时性以避免缓存队列堆积,各方法检测1 s长度语音的平均检测时长如图 7所示,包含码元关系最少的M1模型平均检测时长仅需0.32 ms,优于对比方法。性能最全面的M7模型平均检测时长为2.72 ms,优于CEBN和SFFN方法。本文方法的时间复杂度主要集中在贝叶斯网络的推理过程,由于专门针对VQ码元进行检测并优化了推理过程,减少了查表操作。另外,本文方法的M1~M7模型检测时长呈线性变化,考虑到高嵌入率下各模型检测精度差别不大,可选用较少码元关系的模型以提高检测速度。

|

图 7 不同隐写方法的平均检测时长 Fig. 7 Average detection times of different methods |

本文对深度学习方法的模型大小和推理时间进行了分析。RNN-SM模型最小,仅206 KB,推理时间最短,为0.49 ms,这归因于其简化了结构。SFFN虽然模型相对较小,为483 KB,但由于是多层网络,其推理时间最长,达到4.95 ms。CSW模型大小为639 KB,平均检测时长1.03 ms,而TENet模型最大,达到1 303 KB,推理时间为2.29 ms。结果显示,模型大小与推理时间密切相关,但实际推理时间还受模型结构和层数影响。

4 结语针对压缩语音量化索引调制隐写的高效检测问题,提出了一种基于贝叶斯网络群的新方法。该方法使用多个贝叶斯网络进行概率推理以提取样本码元的自身相关性、帧内相关性和帧间相关性,并给出多种检测模型。实验结果表明,本文提出的检测模型均有较好的检测效果,其中全码元关系模型检测效果最好,优于对比方法,且具有实时性。在接下来的工作中,将进一步研究本文提出的新框架在其他隐写算法中的应用。

| [1] |

KAUR S, SINGH S, KAUR M, et al. A systematic review of computational image steganography approaches[J]. Archives of computational methods in engineering, 2022, 29(7): 4775-4797. (  0) 0) |

| [2] |

THABIT R, UDZIR N I, YASIN S M, et al. CSNTSteg: color spacing normalization text steganography model to improve capacity and invisibility of hidden data[J]. IEEE access, 2022, 10: 65439-65458. (  0) 0) |

| [3] |

HE S H, XU D W, YANG L, et al. Adaptive HEVC video steganography with high performance based on attention-net and PU partition modes[J]. IEEE transactions on multimedia, 2023, 26: 687-700. (  0) 0) |

| [4] |

ELSHOUSH H T, MAHMOUD M M. Ameliorating LSB using piecewise linear chaotic map and one-time pad for superlative capacity, imperceptibility and secure audio steganography[J]. IEEE access, 2023, 11: 33354-33380. (  0) 0) |

| [5] |

BHARTI S S, GUPTA M, AGARWAL S. A novel approach for audio steganography by processing of amplitudes and signs of secret audio separately[J]. Multimedia tools and applications, 2019, 78(16): 23179-23201. (  0) 0) |

| [6] |

MELMAN A, EVSUTIN O. Comparative study of metaheuristic optimization algorithms for image steganography based on discrete Fourier transform domain[J]. Applied soft computing, 2023, 132: 109847. (  0) 0) |

| [7] |

CHEN B, WORNELL G W. Quantization index modulation: a class of provably good methods for digital watermarking and information embedding[J]. IEEE transactions on information theory, 2001, 47(4): 1423-1443. (  0) 0) |

| [8] |

XIAO B, HUANG Y F, TANG S Y. An approach to information hiding in low bit-rate speech stream[C]//IEEE GLOBECOM 2008 IEEE Global Telecommunications Conference. Piscataway: IEEE, 2008: 1-5.

(  0) 0) |

| [9] |

LIU P, LI S B, WANG H Q. Steganography in vector quantization process of linear predictive coding for low-bit-rate speech codec[J]. Multimedia systems, 2017, 23(4): 485-497. (  0) 0) |

| [10] |

TIAN H, LIU J, LI S B. Improving security of quantization-index-modulation steganography in low bit-rate speech streams[J]. Multimedia systems, 2014, 20(2): 143-154. (  0) 0) |

| [11] |

LI S B, TAO H Z, HUANG Y F. Detection of quantization index modulation steganography in G.723.1 bit stream based on quantization index sequence analysis[J]. Journal of Zhejiang university SCIENCE C, 2012, 13(8): 624-634. (  0) 0) |

| [12] |

YANG J, LIU P, LI S B. A common method for detecting multiple steganographies in low-bit-rate compressed speech based on Bayesian inference[J]. IEEE access, 2019, 7: 128313-128324. (  0) 0) |

| [13] |

LIN Z N, HUANG Y F, WANG J L. RNN-SM: fast steganalysis of VoIP streams using recurrent neural network[J]. IEEE transactions on information forensics and security, 2018, 13(7): 1854-1868. (  0) 0) |

| [14] |

HU Y T, HUANG Y H, YANG Z L, et al. Detection of heterogeneous parallel steganography for low bit-rate VoIP speech streams[J]. Neurocomputing, 2021, 419: 70-79. (  0) 0) |

| [15] |

YANG Z L, YANG H, CHANG C C, et al. Real-time steganalysis for streaming media based on multi-channel convolutional sliding windows[J]. Knowledge-based systems, 2022, 237: 107561. (  0) 0) |

| [16] |

ZHANG C, JIANG S J, CHEN Z. TENet: leveraging transformer encoders for steganalysis of QIM steganography in VoIP speech streams[J]. Multimedia tools and applications, 2024, 83(19): 57107-57138. (  0) 0) |

| [17] |

赵文彬, 王佳琦, 吴峰, 等. 基于图神经网络文档相似度的实体与关系层次匹配方法[J]. 郑州大学学报(理学版), 2023, 55(6): 8-14. ZHAO W B, WANG J Q, WU F, et al. A Hierarchical Matching Method of Entity and Relation Based on Graph Neural Network for Document Similarity[J]. Journal of Zhengzhou university(natural science edition), 2023, 55(6): 8-14. DOI:10.13705/j.issn.1671-6841.2022159 (  0) 0) |

| [18] |

彭双, 伍江江, 陈浩, 等. 基于卷积注意力网络的卫星观测任务序贯决策方法[J]. 郑州大学学报(理学版), 2023, 55(5): 47-52. PENG S, WU J J, CHEN H, et al. Satellite Observation Task Sequential Decision-making Method Based on Convolutional Attention Neural Network[J]. Journal of Zhengzhou university(natural science edition), 2023, 55(5): 47-52. DOI:10.13705/j.issn.1671-6841.2022164 (  0) 0) |

| [19] |

KHEDDAR H, HEMIS M, HIMEUR Y, et al. Deep learning for steganalysis of diverse data types: a review of methods, taxonomy, challenges and future directions[J]. Neurocomputing, 2024, 581: 127528. (  0) 0) |

| [20] |

ANOWAR F, SADAOUI S, SELIM B. Conceptual and empirical comparison of dimensionality reduction algorithms (PCA, KPCA, LDA, MDS, SVD, LLE, ISOMAP, LE, ICA, t-SNE)[J]. Computer science review, 2021, 40: 100378. (  0) 0) |

2025, Vol. 57

2025, Vol. 57