2. 现代教学技术教育部重点实验室, 陕西 西安 710062;

3. 上海旅游高等专科学校, 上海 201418

2. Ministry of Education, Key Laboratory of Modern Teaching Technology, Xi′an 710062, China;

3. Shanghai Institute of Tourism, Shanghai 201418, China

随着人工智能和模式识别的不断发展, 情感计算也越来越受到人们的关注, 人脸表情识别是情感计算中的重要组成部分, 提升表情特征提取和分类的精确度是人脸表情识别最重要的突破点, 也是判断各种算法性能好坏的关键点。

1994年, 芬兰科学家T.Ojala[1]提出局部二值模式(Local binary patterns, LBP), 它计算快速并且能进行有效的纹理分析[2-3], 随后因其强大的纹理判别能力, 而被扩展应用到其他领域, 如图像处理[4]、计算机视觉[5]和人脸特征提取[6-9]等; Sumer和Gunes[6]将SIFT与LBP的特征描述效果进行比较, 并分别用这两种算法进行人脸表情识别; Zhong Lin等人[7]根据面部肌肉的运动情况, 求解得到对表情识别贡献最大的表情图像补丁, 并依次加权, 再用LBP提取特征; Yang和Zheng等人[8]将LBP与SVM决策树联合, 利用此方法进行表情识别, 识别率达到92%;Shan[9]将Adaboost与LBP算子结合, 提出Boosted-LBP特征提取方法, 识别率达到90%。

D.G.Lowe在1999年提出尺度不变特征变换(Scale-invariant feature transform, SIFT)思想, 2004年完善总结, 并通过实验证明SIFT是性能鲁棒的局部特征之一[10]。SIFT被广泛应用到物体检测和识别、图像配准与融合、纹理识别等领域[11]。刘仲等人[12]结合SIFT与PCA算法, 用PCA对SIFT特征向量进行降维和去噪, 采用并行方法实现并行的特征提取和特征点匹配; 朱英宏[13]和郑永斌等人[14]将SIFT与LBP算法结合, 得到一种新的图像描述和匹配算法, 匹配点数明显增加, 可达到较好的匹配效果。然而, 陈梦婷等人[15]认为, SIFT算法提取的特征点对尺度变换敏感, 具有“不准确”性, 且消耗内存大, 计算速度慢, 因此单独使用SIFT检测算法标定特征点会造成特征误差。

文中运用LBP算法提取人脸表情特征, 在特征提取之前, 引入SIFT检测算法, 标定表情图像特征点。由上文描述可知, 因SIFT算法并不能准确标定表情图像感兴趣点, 因此, 文中将SIFT算法与Harris角点结合, 以寻找具有显著角点特征的SIFT特征点, 主要通过Harris算法对SIFT特征点过滤和约束, 提高SIFT算法的准确性, 使标定的特征点更能表现表情图像的特征信息。当特征点标定完成后, 设计特征点最大区域选取法和特征点周围邻域选取法得到不同区域特征, 作为LBP特征提取的输入图像, 并将求得的LBP特征直方图送入SVM分类器中进行多种表情分类, 得到每种表情的识别率。

1 相关算法理论 1.1 LBPLBP是一种描述局部空间结构的非参数算子。它最大的特点是计算简便, 对光照的鲁棒性较好。它可以联合一个中心点周边区域内所有的像素点来表示该中心点的灰度信息。

算法的主要思想:将中心像素点与周围8个像素点的灰度值进行比较, 不小于中心像素灰度值的点为1, 小于中心像素灰度值的点为0, 然后按顺序排列成一个8位的二进制数, 再转化为十进制, 便得到该点的LBP算子。

1.2 Harris算子Harris角点检测算子对图像进行一阶差分, 采用自相关函数描述邻域内像素点的灰度变化, 并通过高斯滤波降低图像中的噪声干扰。

Harris角点检测算子的主要步骤如下:

1) 计算图像I中像素点(x, y)在水平和竖直方向上的梯度Ix和Iy, 计算Ixy=Ix×Iy, 即像素点对应位置上的元素积。

2) 图像I与高斯函数

|

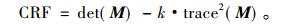

3) 计算该像素点处的角点响应函数得到对应的函数响应值,

|

(1) |

其中, det(M)和trace(M)分别是矩阵M的行列式λ1×λ2和迹λ1+λ2, k为常系数, 一般取0.04。

4) 在以像素点(x, y)为中心的小邻域内, 判断点(x, y)的CRF值是否是该邻域内的极大值, 若是, 则将其标记为角点; 若不是, 则判断下一点。

Harris角点检测算法由于采用了3次高斯滤波, 因此有一定的抗噪能力, 检测结果的稳定性比较高, 但是运算速度较慢。

1.3 SIFT关键点检测SIFT特征点检测关键步骤如下:

1) 尺度空间极值检测

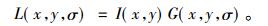

利用高斯卷积核构建图形的尺度空间, 对于一幅图像, 其尺度空间定义为

|

(2) |

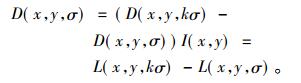

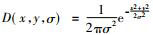

为了提高特征点的稳定性, 提出了高斯差分尺度空间DOG, 其计算公式为

|

(3) |

其中,

2) 特征点位置的确定

对于检测到的所有极值点, 还需要进行以下两步检验才能得到精确定位的特征点:(a)利用尺度空间函数D(x, y, σ)的二阶泰勒展开式进行最小二乘拟合, 计算拟合曲线的极值来定位特征点, 同时设置阈值以剔除对比度较低的点; (b)通过Hessian矩阵剔除不稳定的边缘响应点, 以此来提高抗噪声能力。

2 LBP人脸表情识别算法人脸表情识别的关键步骤为特征点或特征区域的选取和提取特征向量。文中选用日本女性表情图像库(Jaffe)进行实验, 首先对表情图像进行预处理, 构建不包含头发、背景等不相关信息的人脸图像数据库, 基于此数据库进行表情识别。

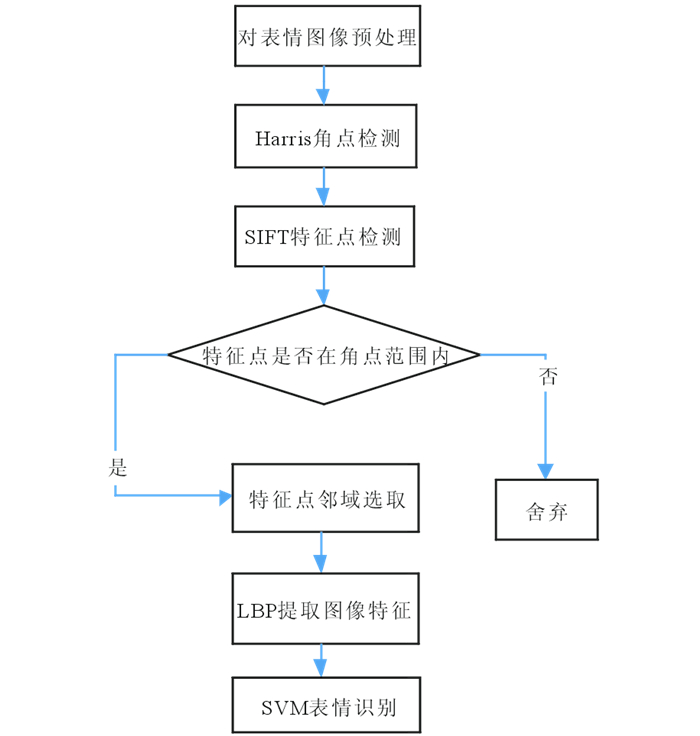

该算法先引入Harris角点得到表情图像的角点特征, 再运用SIFT检测算法得到局部最大值和最小值, 即该图像的SIFT特征点。比较这两类特征点, 最终选取在角点范围内的SIFT特征点, 该特征点即为表情图像的准确感兴趣点。在实验中, 设计了特征点最大区域选取法和特征点周围邻域选取法, 得到不同特征点邻域, 以表现表情图像的不同特征区域, 利用LBP算法提取表情图像特征, 并以直方图形式送入SVM多分类器中进行表情的识别。算法具体流程图如图 1所示。

|

图 1 算法流程图 Fig. 1 Flow process diagram of this algorithm |

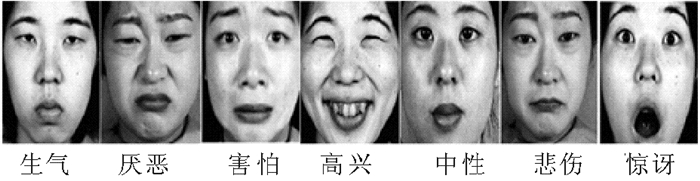

在图像的预处理阶段, 先对Jaffe表情库进行尺度归一化处理。Jaffe数据库中共有7种表情图像, 每个人每种表情大约有3张图像, 一共有10位女性参与, 因此每张表情最多有30张图像, 最少也有28张。

图 2为经过预处理后的人脸表情图像, 经过预处理后, 每幅图像去掉了头发、耳朵、脖子、背景等对表情识别有干扰的信息, 只保留了脸部特征, 这样做使后续提取的特征更具有针对性, 排除不必要的干扰。在实验中首先运用人脸识别经典算法识别出人脸, 再运用尺度归一化进行预处理。此过程规范了待检测的人脸表情数据库, 使其只显示人脸表情部分, 使后续表情识别更具有针对性, 能够更好地凸显特征提取和特征分类算法的效果, 提高表情的识别率。

|

图 2 预处理后的人脸表情图像 Fig. 2 The images of facial expression after preprocessing |

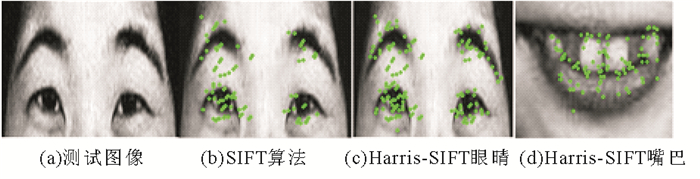

采用基于Harris-SIFT检测算法对人脸表情图像进行特征点标定。首先分别对眼睛和嘴巴进行操作, 确定其Harris角点, 再运用SIFT检测算法得到表情图像的局部最大值和最小值, 舍弃不在角点范围内的SIFT特征点, 得到准确的表情图像感兴趣点, 标定的特征点如图 3所示。

|

图 3 “高兴”图像的特征点标定 Fig. 3 Feature points detection of "happy" |

图 3为特征点标定算法效果比较图, 图 3(a)为原始测试图像, 图 3 (b)为单独使用SIFT算法对特征点进行标定的效果图, 从图中可以看到效果并不好, 因为SIFT算法只是取得局部最大值和最小值; 图 3 (c)和图 3(d)为使用文中特征点标定算法的效果图, 即Harris-SIFT的特征点标定, 从图中可以看出, 采用文中算法, 能准确地标定出表情图像的感兴趣点, 表示图像的表情特征效果良好。

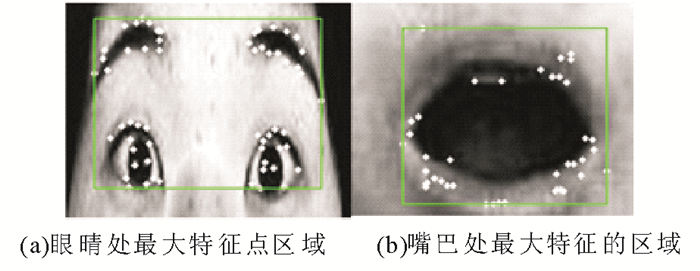

2.3 LBP特征提取得到表情图像的特征点后, 需要对特征点区域提取LBP特征。文中采用两种方法选取特征点区域, 分别为特征点最大区域选取法和特征点周围邻域选取法。特征点最大区域选取法是对眼睛和嘴巴分别选取特征点, 选取所有特征点的最大面积区域。即先取得所有特征点的最大最小坐标, 得到特征点的最小x, 最小y以及最大x和最大y, 组成一个矩形, 分割得到一个特征点区域, 如图 4所示。

|

图 4 面部表情的特征点最大区域 Fig. 4 The largest region selection method of facial expression |

在实验的预处理阶段中已经去掉表情图像的背景、头发等对特征提取有干扰的因素, 因此在特征点标识时, 感兴趣点主要集中在眼睛、嘴巴和眉毛周围。而对于特征点最大区域选取法来说, 选取得到的最大区域包含了眼睛、嘴巴和眉毛部位, 使得后续表情特征的提取主要集中在这3个部位, 其符合眼睛和嘴巴是反映人脸表情的最主要部位, 也具有普遍性。

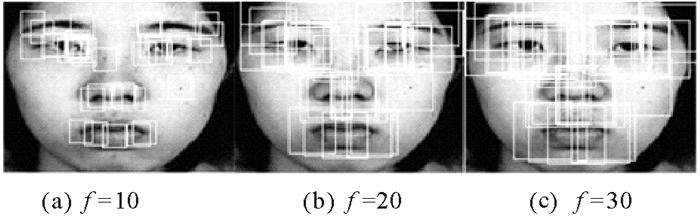

特征点周围邻域选取法是得到整个面部表情的特征点后, 选取特征点周围f*f区域(f=10, 20, 30), 每种表情图像会得到40~50张特征点区域图像, 如图 5所示, 随后提取这些区域图像的LBP特征, 即代表了此表情图像的LBP特征。

|

图 5 面部表情特征点的f*f区域 Fig. 5 Feature point neighborhood f*f region of facial expression |

将得到的LBP特征矩阵用直方图表示, 并对同一张图像的LBP直方图进行合并, 再以直方图的形式送入SVM多分类器中进行表情分类。对比不同表情直方图, 可明显分辨出这些直方图的最高点以及走势的不同, 基于这些不同, 很容易分辨出不同的表情, 但要进行准确的表情识别, 必须借助精确的分类算法。文中使用SVM多分类器, 当得到表情LBP直方图后, 将直方图送入SVM中进行训练和测试, 得到每种表情的识别率。

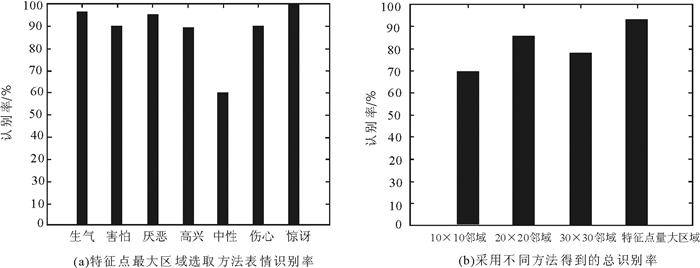

3 实验结果分析在实验中采用了特征点最大区域选取法和特征点周围邻域选取法两种区域划分方法验证文中所采用方法的有效性, 得到表情图像识别率, 分别如图 6(a)和(b)所示。

|

图 6 文中所采用方法实验结果 Fig. 6 The experimental results of this paper |

图 6(a)表示采用特征点最大区域选取方法时每种表情的识别率, 从图中可以看出每种表情都能以较高的识别率识别出来, 证明文中采用方法的有效性。图 6(b)表示采用文中设计的区域选取方法对7种表情图像的总识别率, 在图中, 识别率最高的为特征点最大区域选取法, 此方法根据特征点坐标, 成功标识出眼睛、嘴巴部分, 特征提取时更具有针对性, 从而识别率也更高。对于特征点周围邻域法, 因特征点之间距离较近, 所以选择的特征点邻域会有很大程度的重合, 容易造成数据的冗余, 因此, 其识别率较特征点最大区域选取方法偏低。

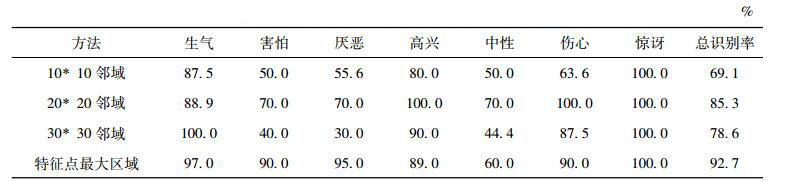

对不同区域选择方法提取的特征进行每种表情识别率的比较, 结果如表 1所示。

|

|

表 1 采用不同区域选择方法每种表情的识别率 Tab. 1 The recognition rate of each facial expression with different region methods |

由表 1可得到, 针对特征点周围邻域法来说, 选择特征点周围的20*20邻域识别率最高, 因其较10*10邻域和30*30邻域来说, 眼睛和嘴巴部分包含更完整和精确, 因此提取的区域更具有针对性, 识别率也相对更准确。由每种表情的识别率可知, 高兴和惊讶表情变化幅度都较明显, 因此识别率较高, 而伤心、恐惧和中性表情因脸部变化幅度都较小, 比如眉毛略微弯曲, 嘴巴会闭合, 因此不易分辨, 识别率较低。

在实验中, 对于不同的区域选择方法, 特征提取和特征分类花费的时间也是不同的。其中, 10*10邻域花费1.96+0.37s, 20×20邻域花费2.86+1.28s。30*30邻域花费14.24+2.18s, 特征点最大区域选取法花费1.28+0.27s。

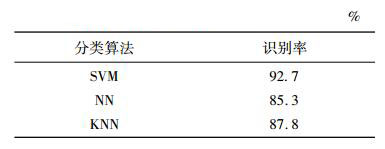

文中又以特征点最大区域作为区域选取方法, 比较不同分类算法的识别率, 得出试验结果如表 2所示。

|

|

表 2 采用不同分类算法的人脸表情总识别率 Tab. 2 The recognition rate of facial expression with different classification methods |

实验分别选用了SVM, NN及KNN分类器, 采用不同分类算法得到的人脸表情识别率如表 2所示, 由实验结果可知, SVM多分类器具有较高的识别率, 与文中方法结合更有效, 其识别率达到92.7%。对于SVM多分类器, 文中使用LIBSVM, 它是SVM的一个标准多表情分类库, 广泛应用于机器学习实验中。

4 结语为提高人脸表情识别的准确率, 文中提出一种基于Harris-SIFT特征点检测的LBP人脸表情识别算法, 该方法弥补了LBP算法在提取全局特征向量时不具有针对性的缺点, 运用Harris-SIFT算法标定特征点, 克服了SIFT只是标定局部最大最小值这一不足, 得到具有角点特性的SIFT特征点。同时设计了有效的特征点区域选取方法, 使得LBP的表情图像特征向量既具有全局特征, 又具有局部特性。通过理论分析和实验仿真表明, 文中提出的方法综合了Harris-SIFT和LBP的优点, 能够快速、有效地识别人脸表情图像。

| [1] |

OJALA T, PIETIKÄINEN M, HARWOOD D. A comparative study of texture measures with classification based on featured distributions[J]. Pattern Recognition, 1996, 29(1): 51-59. DOI:10.1016/0031-3203(95)00067-4 |

| [2] |

TOPI M, MATTI P, TIMO O.Texture classification by multi-predicate local binary pattern operators[C]//International Conference on Pattern Recognition, 2000, 15: 939-942.

|

| [3] |

MÄENPÄÄ T, PIETIKÄINEN M. Texture analysis with local binary patterns[J]. Handbook of Pattern Recognition and Computer Vision, 2005(3): 197-216. |

| [4] |

HADID A, PIETIKÄINEM M, AHONEN T.A discriminative feature space for detecting and recognizing faces[C]//Computer Vision and Pattern Recognition, 2004.Proceedings of the 2004 IEEE Computer Society Conference on.IEEE, 2004, 2: Ⅱ-797-Ⅱ-804.

|

| [5] |

TURTINEN M, PIETIKAINEN M, SILVÉN O. Visual characterization of paper using isomap and local binary patterns[J]. IEICE Transactions on Information and Systems, 2006, 89(7): 2076-2083. |

| [6] |

SUMER O, GUNES E O.LBP and SIFT based facial expression recognition[C]//Seventh International Conference on Machine Vision (ICMV 2014).International Society for Optics and Photonics, 2015: 94450A-94450A-5.

|

| [7] |

ZHONG L, LIU Q, YANG P, et al.Learning active facial patches for expression analysis[C]//Computer Vision and Pattern Recognition (CVPR), 2012 IEEE Conference on.IEEE, 2012: 2562-2569.

|

| [8] |

YANG M, ZHENG S, LI Y.Facial expression recognition based on LBP and SVM decision tree[C]//2015 International Industrial Informatics and Computer Engineering Conference.Atlantis Press, 2015.

|

| [9] |

SHAN C, GONG S, MCOWAN P W. Facial expression recognition based on local binary patterns:A comprehensive study[J]. Image and Vision Computing, 2009, 27(6): 803-816. DOI:10.1016/j.imavis.2008.08.005 |

| [10] |

LOWE D G. Distinctive image features from scale-invariant keypoints[J]. International Journal of Computer Vision, 2004, 60(2): 91-110. DOI:10.1023/B:VISI.0000029664.99615.94 |

| [11] |

姜桂圆, 张桂玲, 张大坤. SIFT特征分布式并行提取算法[J]. 计算机研究与发展, 2015, 49(5): 1130-1141. |

| [12] |

刘仲, 邢彬朝, 陈跃跃. 一种面向多核处理器的高效并行PCA-SIFT算法[J]. 国防科技大学学报, 2012, 34(4): 103-107. DOI:10.3969/j.issn.1001-2486.2012.04.021 |

| [13] |

朱英宏, 李俊山, 郭莉莎, 等. 基于LBP的尺度不变特征的描述和匹配算法[J]. 计算机辅助设计与图形学学报, 2011, 23(10): 1758-1763. |

| [14] |

郑永斌, 黄新生, 丰松江. SIFT和旋转不变LBP相结合的图像匹配算法[J]. 计算机辅助设计与图形学学报, 2010, 22(2): 286-292. |

| [15] |

陈梦婷, 闫冬梅, 王刚. 基于Harris角点和SIFT描述符的高分辨率遥感影像匹配算法[J]. 中国图象图形学报, 2012, 17(11): 1453-1459. DOI:10.11834/jig.20121116 |

2017, Vol. 47

2017, Vol. 47