乒乓球机器人可以通过识别、预测、决策等多方面信息协调工作完成对乒乓球的击打,且可成为一个实时智能的机器人运动伺服平台,因其核心技术的应用前景广泛,日益受到学者们的关注。由于乒乓球具有体积小、质量轻等特点,其运动速度快,故乒乓球机器人欲完成击打任务,必须对快速运动的乒乓球进行识别跟踪。

针对乒乓球运动的跟踪技术,目前常见的算法主要有颜色分割法、光流法、背景减除法和帧差法。如杨华等[1]利用颜色分割法针对特殊的黄色乒乓球进行识别跟踪,但该算法对环境以及摄像机清晰度的要求均较高,虽较为简单却适用性不强。有研究人员[2-4]通过计算位移向量光流场初始化基于轮廓的跟踪算法,经过迭代运算,测出场景中的运动区域。Lampert等[5]利用乒乓球与背景之间的色彩差进行图像分割,计算像素颜色与期望颜色的相似度,将相似度高的连通区域标记为目标区域。张正涛等[6-8]采用帧差法将所采集的前后2幅图像做差,出现2个亮的区域后再根据乒乓球速度方向判断乒乓球位置。

目前,大多数关于乒乓球的跟踪算法都在实验室中进行,需要根据不同的实验环境设计不同的跟踪算法,适用范围受限[9-10]。同时,由于乒乓球的速度快,大部分跟踪乒乓球的视觉系统均会选择高速摄像机,以拍出较为清晰的图片,方便后续识别;但由此产生的数据量较大,对系统的处理速度和传输速度均有较高要求。此外,少有学者使用低速摄像机拍摄乒乓球进行跟踪识别,主要原因是低速下拍摄的图片不清晰,且低速摄影时常伴随低速快门,会造成乒乓球的拖影效应,给识别带来困难。

因此,本文针对不同摄影条件下的难点,分别在高速和低速2种摄影条件下设计完全不同的算法对乒乓球进行跟踪识别,对比2种算法的优势和劣势,并通过实验验证算法的准确性。

1 基于注意力的图像分割在不同摄影条件下拍摄的图片效果不同,计算机识别的图片是一个像素矩阵,需要设计算法对其进行处理,找出乒乓球所在区域像素矩阵的特点,从而完成对乒乓球的识别跟踪。单张图片中的像素矩阵比较混乱,计算机直接处理会出现计算量过大、方法过于复杂等问题,故需要对待处理图片进行预处理,明确图片的特征信息,便于后续处理。

无论在高速还是低速摄影条件下,对图片进行预处理都是必须经过的一个步骤,故本文采用图像分割的方法对图片进行预处理,基于注意力方法将图像中的显著区域分割出来,再针对显著区域进行处理,找出其中与乒乓球特征最符合者记为乒乓球,即可完成乒乓球的识别跟踪任务。

视觉注意机制是人类视觉感知系统的重要部分,当生物体用眼观测一幅图像时,通常会将注意力有选择地集中在某个或某些物体上,进而对所选择的特定物体进行视觉信息处理。本文采用的注意力方法是基于视觉注意机制[11-13],将3层高斯金字塔和多尺度中心周边对比进行有效融合,称之为SMG(saliency map generation)算法[14],可以实现将特征对比明显的区域标定为显著性区域。由于被跟踪的乒乓球是运动物体,并且与周围环境对比度较大,故一般都可被识别为显著性区域。图像分割具体步骤如下:①输入某张图片,将其图像分解为亮度、红色、绿色、蓝色和黄色等一系列单通道图像。将图像的红、绿、蓝和黄色像素分别用R、G、B、Y表示,亮度表示为I,则有

对图片进行预处理之后,便可对分割后的图像进行识别。针对高速和低速这2种不同摄影条件下的特点和难点,分别设计不同的算法对乒乓球进行跟踪识别。

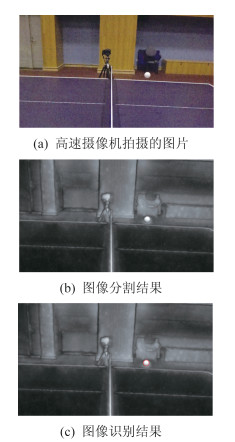

2.1 基于高速摄影条件的乒乓球识别将高速摄像机摆放在距兵乓球台边线1 m处,速度采用250帧/s,快门选择1/2 000 s,对乒乓球的整个运动轨迹进行拍摄。图 1(a)显示的是高速摄像机所拍摄视频中的1帧图片,由于拍摄的速度足够快,快门足够高,故所拍摄的乒乓球整体轮廓较为清晰。对该图片基于注意力系统进行图像分割,结果如图 1(b)所示。由于经预处理后乒乓球的特征依然较为明显,故可利用乒乓球的特征信息对乒乓球进行识别。具体可根据表 1中所列5项特征判定白色像素块是否为乒乓球。

|

| 图 1 高速摄影条件下的乒乓球识别过程 Figure 1 Recognition process of table tennis under high-speed photography |

| 表 1 乒乓球识别的5项特征 Table 1 Identity of the five characteristics of table tennis |

利用兵乒球识别的5项特征设置阈值,具体阈值根据实验值确定,若对象的检测值均在设定的阈值内,则认定该对象为所需识别的乒乓球。识别乒乓球所在区域之后,去除3块红色方框,直接用红框框住乒乓球,即完成乒乓球的识别跟踪,识别结果如图 1(c)所示。

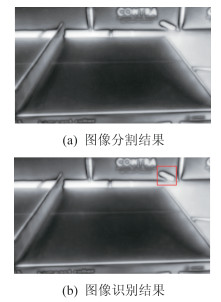

2.2 基于低速摄影条件的乒乓球识别 2.2.1 离线训练及图像匹配在低速摄影条件下拍摄的乒乓球整体轮廓不清晰,有拖影,需要进行机器的离线训练和图像匹配。首先对低速摄影下的图片进行图像分割,结果如图 2(a)所示;再利用图像匹配的方法进行识别,将大量含不同场景、不同方向的拖影球图片加入样本进行学习,利用adaboost算法训练强分类器,将图像分割出的亮点区域加入分类器检测识别,选取相似度最高区域并视为乒乓球所在区域。共收集100张不同拍摄速度、角度和背景的拖影球图片,作为机器学习训练的正样本,同时收集100张从不同乒乓球实地运动场景中任意选取的非拖影球图片,作为训练的负样本。

|

| 图 2 在低速摄影条件下图像分割和识别结果 Figure 2 Results of image segmentation and recognition under low-speed photography |

在训练的正样本中,由于拍摄速度不同,拖影球所形成的拖影长度不同,总体特征区别不大,根据此特征利用机器学习方法可对图片进行训练识别,主要分为以下2个步骤:①将训练样本加入adaboost层级分类器进行离线训练,分类器的训练步骤参考文献[18-19];②将分割后的图像加入分类器检测,只检测图像中的显著区域,选取相似度最高区域为乒乓球所在区域。经过分类器检测后可以获得乒乓球所在位置区域,如图 2(b)所示。

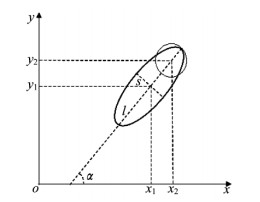

2.2.2 真实球心检测找到乒乓球所在区域后,由于乒乓球的拖影成像形似椭圆,故先对其进行椭圆拟合。通过查找轮廓获得目标轮廓边界点坐标,利用最小二乘法可以拟合椭圆方程[20]。然而,检测出的带拖影乒乓球的中心坐标并非真实的乒乓球所在位置,设计算法根据拟合的椭圆方程找到真实球心坐标。

乒乓球产生拖影的原因是乒乓球运动速度太快,而摄像机的曝光时间过长,导致在曝光时间内乒乓球与摄像机系统之间存在相对运动,从而使芯片上形成的图像一直在变化,各个部位的像元在曝光过程中受到来自物体不同位置成像的影响,最终形成的图片是一个连续变化图像空间内图片的叠加。就单张拖影图片而言,乒乓球实际位置处于运动方向最前端,拖影即曝光时间过长而产生的乒乓球运动轨迹重叠影像,故找出拖影图像中乒乓球实际位置即找到了运动方向最前端圆形目标的中心坐标,如图 3所示。

|

| 图 3 椭圆与实际圆之间关系 Figure 3 Relation between ellipse and real circle |

图 3显示出拟合的椭圆与实际圆之间的关系,椭圆的中心点坐标记为(x1,y1),l代表椭圆的长轴,s代表椭圆的短轴,α代表椭圆长轴与x轴夹角,通过最小二乘法拟合椭圆方程后可获得这些参数的数值。由图 3可知,椭圆的短轴可近似为实际圆的半径,从椭圆中心(x1,y1)沿长轴方向平移长轴与短轴之差(l-s)的函数值即可得到实际圆的圆心坐标(x2,y2),计算公式为

| $ \left\{ {\begin{array}{*{20}{c}} {{x_2} = {x_1} + \left( {l - s} \right){\rm{cos}}\alpha }\\ {{y_2} = {y_1} + \left( {l - s} \right){\rm{sin}}\alpha } \end{array}} \right. $ |

获取真实球心坐标

|

| 图 4 真实球体位置 Figure 4 Position of real ball |

在乒乓球跟踪实验中,需要处理视频中的多帧图片信息,而光照、背景等干扰因素会造成识别误差,且如果对每张图片均进行全图检测会造成计算量巨大、耗费时间长和识别错误多等一系列问题。另外,视频中的图片均按照一定时间序列连续播放,每2帧图像之间有较大关联性。据此提出预测ROI的方法,通过针对前几帧图片的检测结果预测下一帧乒乓球的位置,即提前设置一个ROI,仅对ROI内部进行识别,从而在缩短识别时间的同时提高识别准确率。ROI范围的选取:以经识别(计算)的球心坐标为中心,以乒乓球在图像平面运动的最高速度和采样平均时间间隔的乘积再加长20%为半径,确定一个圆形区域,该区域必定可以包含下一时刻乒乓球运动位置,将这个圆形区域的外接正方形区域定义为移动ROI,即图像下一时刻的搜索范围。如此,利用对移动ROI的预测进行乒乓球的检测识别,可大大缩短识别时间。

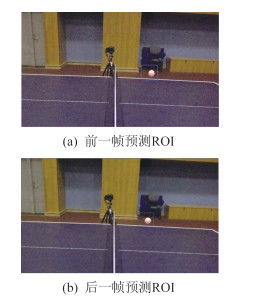

预测ROI的方法对高速摄影和低速摄影条件均适用,区别在于在高速摄影条件下每2帧图片时间间隔很短,乒乓球运动距离不会很长,预测ROI时可适当缩小范围,进一步降低计算量。图 5显示在高速摄影条件下连续2帧图片预测ROI的结果,红色圆框代表识别的乒乓球位置,蓝色方框即为移动ROI范围。可以看出,由于高速相机频率很高,乒乓球运动距离很小,故可将ROI设置为较小的范围,并保证下一帧图像中乒乓球不会移动出ROI范围。另外还可发现后一帧图像亮度比前一帧高,这主要是实验场景中使用的照明灯采用交流供电,从而造成高速视频交替闪动的结果。但此处选择的算法在图像分割时已考虑到环境及灯光变化会导致图片颜色失真的问题,并采用3个通道融合的方法加以解决,故后续识别时较为准确。

|

| 图 5 在高速摄影条件下预测ROI Figure 5 Prediction of ROI area under high-speed photography |

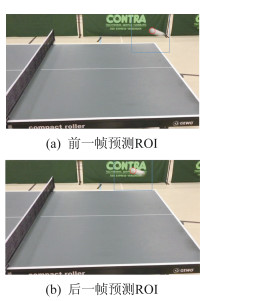

在低速摄影条件下,采样频率较低,每2帧图片间的乒乓球运动距离较长,需要形成的ROI相较于高速摄影范围更大。图 6显示的是在低速摄影条件下连续2帧图片设置移动ROI的结果,红色圆框代表识别的乒乓球位置,蓝色方框即移动ROI范围。可以看出,在低速摄影条件下连续2帧的乒乓球运动距离比高速摄影条件下更远,故设置的ROI范围比在高速摄影条件下大很多,甚至向上的方向已超出摄像机视野范围。这并不影响对球体的检测,因为球在运动过程中以向前的方向为主,在这个方向上不会超出摄像机视野范围,可保证在下一帧图像的移动ROI中检测识别出乒乓球。

|

| 图 6 在低速摄影条件下预测ROI Figure 6 Prediction of ROI area under low-speed photography |

使用高速摄像机(速度为250帧/s,快门为1/2 000 s)共拍摄2段视频,使用低速摄像机(速度为30~50帧/s,快门为1/250~1/30 s)共拍摄10段视频,分别进行验证实验。使用低速摄像机时选择不同的速度和快门进行拍摄,可获得不同的视频进行验证;同时,由于低速摄像机频率低,每段视频长度均较短,增加视频拍摄段数可避免数据量过少而无法验证实验的情况。实验效果用单张图片跟踪准确率和跟踪时间评定:将正确识别乒乓球的单张图片记为跟踪准确图片,单张图片跟踪准确率=跟踪准确图片数量/视频图片总量;单张(正确识别)图片的跟踪时间是指程序中处理一个图片(完成识别)所需要的时间。具体结果如表 2所示。

| 表 2 实验结果 Table 2 Experimental results |

从表 2可以看出,高速摄像机拍摄的跟踪准确率明显高于低速摄像机,且单张图片识别时间更短。结果显示,在高速摄影条件下图片清晰,利用特征信息识别乒乓球比利用图片匹配识别效果好,但此时的问题在于图片数据量较大,不便传输。另外,尽管在低速摄影条件下的不清晰图片给识别带来一定困难,使跟踪准确率受影响(如本文准确率为74.68%,这在一定程度上是因为图片数据集偏小),但当训练样本量足够大时,将可缓步提高识别准确率。另外,在低速摄影条件下单张图片的跟踪时间平均为23 ms,基本可以满足实时跟踪的要求。

5 小结主要针对乒乓球的跟踪识别问题,从高速摄影和低速摄影2个角度展开研究。在高速摄影条件下利用乒乓球的特征信息进行识别,在低速摄影条件下将图像分割、机器学习和图像匹配方面的知识进行整合与利用,从而完成识别。最终用实验进行验证,实现目标跟踪。创新之处有以下几点。

(1)乒乓球识别前利用VOCUS系统对图像进行分割,可在一定程度上解决环境及灯光变化导致图片颜色失真的问题,拓宽方法的适用面。

(2)在高速摄影条件下提出用圆度、周长、面积、X距和Y距等5个特征设置阈值,并据此识别乒乓球。

(3)在低速摄影条件下将机器训练和学习理论引入乒乓球识别中,由于训练和学习都是离线进行的,不占用在线识别时间,可通过多收集训练数据提高识别的准确率。该方法可应用于不同实验环境,只需要提前将新的实验环境加入训练样本即可,突破了受环境干扰的局限性。

(4)针对在低速摄影条件下图像识别的特殊性设计了一种算法,可根据拖影球的位置和球的运动方向计算真实球体的位置。

(5)规划移动ROI算法可在很大程度上降低计算量,缩短计算时间。

虽然通过实验的方法完成了高速及低速摄影条件下的乒乓球跟踪,但仍有一定的局限性和不足之处,主要有以下几点。

(1)在图像处理方法上创新性不够。所使用的方法基本上都是已经成熟的算法,虽起到整合方法的作用,但并未提出新的图像处理算法。

(2)机器学习的样本量不够。主要针对某些特定现实场景进行实验验证,如要应用于其他场景,还需要对训练样本加以更新。

(3)未考虑遮挡下的识别问题。

虽然乒乓球跟踪实验存在一些不足,但针对高速和低速摄影条件提出的不同算法,基本可满足正常的跟踪需要。乒乓球的跟踪问题一旦解决,即可获得乒乓球运动的轨迹,这对乒乓球的旋转反推和落点预测都起到了很大的提示作用。今后将会继续针对乒乓球跟踪问题进行研究,以克服现有不足,争取实现在实时基础上保证最高的准确率,为将乒乓球机器人做成一个完美的视觉系统提供参考。

作者贡献声明:

季云峰:设计论文框架,拍摄图片数据,做实验,撰写、修改论文;

任杰:提出论文选题,修改论文;

施之皓:审核、指导、修改论文。

| [1] |

杨华, 衣燕慧, 刘国东, 等. 拖影情况下快速飞行乒乓球体的实时识别与跟踪[J].

沈阳航空航天大学学报, 2014, 31(1): 47-51 DOI:10.3969/j.issn.2095-1248.2014.01.011 (  0) 0)

|

| [2] |

STAUFFER C, GRIMSON W E L. Adaptive background mixture models for real-time tracking[J].

Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 1999, 2: 246-252 (  0) 0)

|

| [3] |

HORN B K P, SCHUNCK B G. "Determining optical flow":A retrospective[J].

Artificial Intelligence, 1993, 59(1-2): 81-87 DOI:10.1016/0004-3702(93)90173-9 (  0) 0)

|

| [4] |

INCE S, KONRAD J. Occlusion-aware optical flow estimation[J].

IEEE Transactions on Image Processing, 2008, 17(8): 1443-1451 DOI:10.1109/TIP.2008.925381 (  0) 0)

|

| [5] |

LAMPERT C H, PETERS J. Real-time detection of colored objects in multiple camera streams with off-the-shelf hardware components[J].

Journal of Real-Time Image Processing, 2012, 7(1): 31-41 (  0) 0)

|

| [6] |

张正涛.乒乓球机器人视觉测量与控制[D].北京: 中国科学院, 2010: 26-37

http://cdmd.cnki.com.cn/Article/CDMD-80146-2010209108.htm (  0) 0)

|

| [7] |

张正涛, 徐德. 基于智能摄像机的高速视觉系统及其目标跟踪算法研究[J].

机器人, 2009, 31(3): 229-234 DOI:10.3321/j.issn:1002-0446.2009.03.007 (  0) 0)

|

| [8] |

ZHANG Z, XU D, TAN M. Visual measurement and prediction of ball trajectory for table tennis robot[J].

IEEE Transactions on Instrumentation and Measurement, 2010, 59(12): 3195-3205 DOI:10.1109/TIM.2010.2047128 (  0) 0)

|

| [9] |

季云峰, 朱玲, 沈晏妮. 基于OpenCV的比赛图片中的乒乓球球体识别[J].

微型电脑应用, 2016, 32(4): 68-70 (  0) 0)

|

| [10] |

季云峰, 施之皓, 王朝立, 等. 基于视频识别的乒乓球发球裁判系统实验研究:针对抛球高度和抛球角度问题[J].

计算机工程与应用, 2016, 52(10): 207-212 DOI:10.3778/j.issn.1002-8331.1510-0249 (  0) 0)

|

| [11] |

HURVICH L M, JAMESON D. An opponent-process theory of color vision[J].

Psychological Review, 1957, 64(6): 384-404 DOI:10.1037/h0041403 (  0) 0)

|

| [12] |

FRINTROP S, WERNER T, MARTIN GARCIA G. Traditional saliency reloaded: A good old model in new shape[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2015: 82-90

(  0) 0)

|

| [13] |

KLEIN D A, FRINTROP S.Center-surround divergence of feature statistics for salient object detection[C]//2011 IEEE International Conference on Computer Vision (ICCV).Barcelona: IEEE, 2011: 2214-2219

(  0) 0)

|

| [14] |

李青山.基于注意力选择机制的图像分割与场景理解[D].上海: 上海交通大学, 2012: 11-21

http://cdmd.cnki.com.cn/Article/CDMD-10248-1012018441.htm (  0) 0)

|

| [15] |

BORJI A, SIHITE D N, ITTI L. Quantitative analysis of human-model agreement in visual saliency modeling:A comparative study[J].

IEEE Transactions on Image Processing, 2013, 22(1): 55-69 DOI:10.1109/TIP.2012.2210727 (  0) 0)

|

| [16] |

BRUCE N D B, TSOTSOS J K. Saliency, attention, and visual search:An information theoretic approach[J].

Journal of Vision, 2009, 9(3): 13-24 DOI:10.1167/9.3.13 (  0) 0)

|

| [17] |

OLSHAUSEN B A, ANDERSON C H, VAN ESSEN D C. A neurobiological model of visual attention and invariant pattern recognition based on dynamic routing of information[J].

Journal of Neuroscience, 1993, 13(11): 4700-4719 DOI:10.1523/JNEUROSCI.13-11-04700.1993 (  0) 0)

|

| [18] |

XIAO P, ZHAO G, CHEN Y. An algorithm for ellipse detection based on geometry[C]//2009 Chinese Conference on Pattern Recognition. Nanjing: IEEE, 2009: 1-4

(  0) 0)

|

| [19] |

ITTI L, KOCH C, NIEBUR E. A model of saliency-based visual attention for rapid scene analysis[J].

IEEE Transactions on Pattern Analysis and Machine Intelligence, 1998, 20(11): 1254-1259 DOI:10.1109/34.730558 (  0) 0)

|

| [20] |

VIOLA P, JONES M. Fast and robust classification using asymmetric adaboost and a detector cascade[C]//Advances in Neural Information Processing Systems.Lake Tahoe: Neural Information Processing Systems Foundation, Inc. (NIPS), 2002: 1311-1318

(  0) 0)

|

2020, Vol. 44

2020, Vol. 44