| 基于HowNet的图模型词义消歧方法 |

2. 枣庄学院,信息科学与工程学院,枣庄 277160

2. School of Information Science and Engineering, Zaozhuang University, Zaozhuang 277160, China

词义消歧是指根据歧义词所处的特定上下文环境确定其具体词义,是自然语言处理领域的一项基础性研究,对机器翻译、信息抽取、信息检索、文本分类、情感分析等上层应用有着直接影响。

无论是中文还是英文等其他西方语言,一词多义的现象是普遍存在的。据统计[1-2],在中文语料中歧义词出现的频率为42%左右,在英文语料中歧义词出现的频率为30%~43%。显然,歧义词在自然语言文本中是频繁存在的,这使得词义消歧性能严重影响着上层自然语言处理应用的效果。近年来,图模型词义消歧技术受到研究者的广泛关注。本文尝试使用HowNet作为图模型的知识来源,开展中文词义消歧任务的研究工作。

1 相关工作基于图模型的词义消歧方法大多受到了词汇链的启发。词汇链是指给定文本中一些语义相关词语构成一个序列,词语之间通过词汇语义关系链接在一起,例如:eat→apple→fruit→banana。Galley等人提出了一种基于词汇链的词义消歧方法[3]。该方法主要分为两步:首先,在构建图模型时,将目标歧义词可能存在的词义加入到图中,依次顺序地处理文本中的词汇,将每个词语所含词义与已处理的词语进行比较,如果它们之间存在某种语义关系,那么就将该种关系作为图中的一条链接边,并依据语义关系和词语之间的距离为其赋予权重;在消歧阶段,对目标词各词义与上下文链接的词语结点做加权计算,选取权重最大的词义作为目标词的正确词义。该方法在SemCor的名词数据集上取得了62.1%的消歧准确率。

Mihalcea提出了一种基于PageRank算法的消歧方法[4]。该方法将文本中词语所含各个词义作为顶点,将词义间存在的语义关系作为边,构建消歧图;其中的语义关系除了WordNet中存在的,还包括了一种并列关系,用以链接具有相同上位概念的词义;在图中应用PageRank算法,迭代地计算各个词义结点的重要性,歧义词各词义中得分最大的被选中作为其最终词义。Navigli和Velardi提出了结构化语义互联算法(SSI)[5]。该算法借助于WordNet等多种知识资源,对上下文词语各词义进行结构化表示;通过人工的方式构建文法规则,用以描述语义概念图中的互联模式;算法迭代地进行消歧处理。优先处理消歧难度较小的歧义词;依据已确定词义的词语所形成的语义互联模式,对待消歧词进行消歧处理。该方法在国际语义评测Senseval-3和SemEval-2007上获得了最优效果。Agirre和Soroa提出了Personalized PageRank算法进行词义消歧研究[6]。该方法在原理上与Mihalcea的方法类似,不同之处是其在重要度计算处作了一定改进,以此修改了某些词语结点所传递的重要度。这些方法主要针对英文词义消歧任务进行研究,但中文语义计算资源相对匮乏,限制了这些方法在中文词义消歧任务上的推广应用。

杨陟卓等人提出了一种基于词语距离的网络图消歧方法[7]。该方法按照网络图中词语顶点之间的距离远近进行词义消歧。对与歧义词较近的词语顶点进行强化,而对较远的词义顶点进行弱化,即距离近的词语对歧义词有着较强的推荐作用,距离远的词语对其有着较弱的推荐作用。鹿文鹏等人提出了一种基于领域知识的图模型消歧方法[8],其将领域知识应用到图模型中,通过改进多种图评分方法对词义结点进行重要度评分,进而选择出正确的词义。尽管上述方法改善了词义消歧效果,但并未对现有的中文词义计算资源展开深入挖掘与利用。

2 基于HowNet的图模型词义消歧方法知网(HowNet)揭示了概念之间以及概念所具有的属性之间的关系[9],例如上下位关系、同义关系、对义关系、部件整体关系等。传统的基于HowNet的词义消歧方法存在着对知网知识利用不充分的问题,没有充分挖掘知网中的消歧知识,例如知网中的例句就有着较强的词义区分能力。通过深入挖掘知网蕴含的语义知识,可将其作为词义消歧的依据,这将有助于词义消歧性能的提升。

本文提出了基于HowNet的图模型词义消歧方法。该方法通过对歧义句进行依存句法分析,获取上下文依存元组,并得到依存关系图,构建上下文消歧图;在HowNet中获取目标歧义词例句,进行依存句法分析,得到依存元组集合,结合上下文依存元组,构建依存消歧图;利用上下文消歧图和依存消歧图,使用图评分算法对词义概念顶点的重要度进行评分;选取目标歧义词各词义概念中重要度最高的作为正确词义。

2.1 HowNet中的词义HowNet是由董振东教授花费十多年时间组织构建的一个常识性知识系统[9]。它以中文和英文词语概念间、概念所含属性间的关系为基础,构建了一个网状知识系统。HowNet主要是由知识词典、知网管理系统以及说明文件构成。

HowNet中词语的选择是以4亿字的汉语语料库所形成的词语频率词表为参考依据的,而不是仅仅参考具体的某一部现成的语义词典;其注意收集比较流行且固定的词语,但不盲目求新。考虑词语词义在现代的流通情况,如果一个词语有两个词义,其中一个较为常用,另一个少有使用,就只保留前一个词义;同时为词语概念提供相应的英文词语释义。以常用多义词“打”的一个词义为例,其在HowNet中的具体概念定义如下所示:

NO.=023683

W_C=打

G_C=V [da3]

S_C=

E_C=~球,~网球,~篮球,~羽毛球,~牌,~扑克,~麻将,~秋千,~太极拳,球~得很棒

W_E=play

G_E=V

S_E=

E_E=

DEF={exercise|锻炼:domain={sport|体育}}

其中:“NO.”表示概念的编号,唯一标识具体的一条词义;“W_C”表示概念所对应的具体词语词汇形式;“G_C”表示词性和拼音;“S_C”表示概念的情感信息;“E_C”是HowNet为每条词义标注的例句,旨在突出词义的区分能力而不是强调其释义能力,对于词义消歧有一定帮助;“W_E”表示该概念所对应的英文词语;“G_E”表示英文词语的词性;“S_E”表示英文词语的情感信息;“E_E”表示英文词语的例句;“DEF”指的是概念的定义,由义原构成。义原为HowNet中的最小语义单位,定义中的第一个义原为主要义原,代表了该概念的主要语义信息。

此外,HowNet中还提供了概念相似度计算的工具包[10],给定两个词义概念,通过简单调用便可得到概念间的相似度。

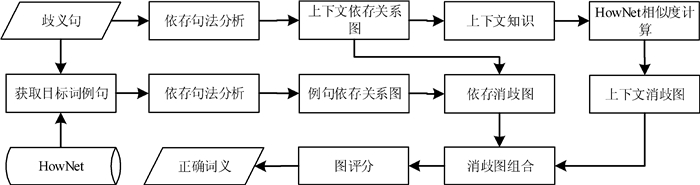

2.2 基于HowNet的图模型词义消歧方法 2.2.1 消歧框架基于HowNet的图模型词义消歧方法的消歧框架如图 1所示。

|

| 图 1 消歧框架图 |

对歧义句进行依存句法分析,获取上下文依存元组,并得到依存关系图,构建上下文消歧图;在HowNet中获取目标歧义词例句,进行依存句法分析,得到依存元组集合,结合上下文依存元组,构建依存消歧图;利用上下文消歧图和依存消歧图,进行词义消歧。具体描述如下:

1) 对歧义句进行依存句法分析,获取上下文依存元组集合,并得到上下文依存关系图;根据依存关系图中上下文词语距目标歧义词的最短路径长度,提取上下文词语作为上下文知识。

2) 利用HowNet对上下文知识与目标歧义词进行词义概念标注,标注其在HowNet中可能存在的词义概念,并进行词义概念相似度计算。

3) 以上下文知识和目标歧义词各词义概念为顶点,概念间的语义关系为边,概念相似度为边的权重,构建上下文消歧图。

4) 在HowNet中获取目标歧义词各词义概念的例句,并进行依存句法分析,以获取例句依存元组集合,结合上下文元组集合构建依存消歧图。

5) 利用上下文消歧图和依存消歧图,并使用图算法对各词义概念顶点的重要度进行评分。

6) 选取目标歧义词各词义概念中得分最高的作为正确词义。

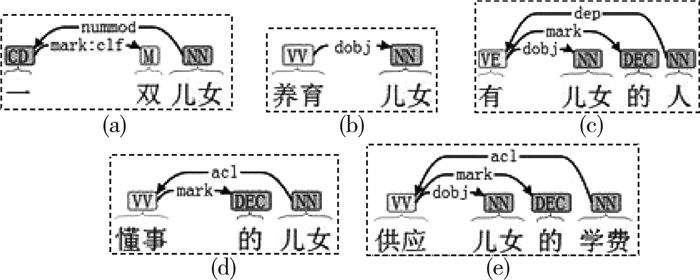

2.2.2 依存句法分析依存句法分析最早由法国语言学家L.Tesniere提出[11]。依存句法分析根据依存语法规则分析句子的结构,从而确定各个词或词组间的依存关系以及在句子中的作用。依存句法分析结果可以使用依存关系图的形式来表示。本文使用的依存句法分析器来自于Stanford CoreNLP自然语言工具包[12],其包含了对多种语言进行句法分析的模型。关于中文处理方面的模型文件有chineseFactored.ser.gz、chinesePCFG.Ser.gz、xinhuaFactored.ser.gz、xinhuaPCFG.ser.gz。本文使用的模型文件是chineseFactored.ser.gz(表 1)。

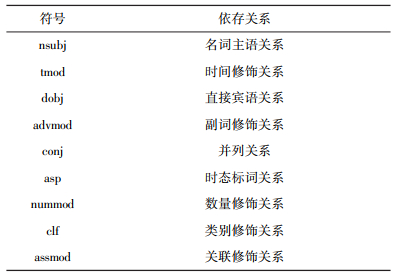

| 表 1 部分依存关系说明符 |

|

本文借助于依存句法分析完成两项工作:一是获得歧义句的上下文依存关系图,二是得到目标歧义词各词义概念对应的例句依存关系图。具体说明如下。

1) 构建上下文依存关系图

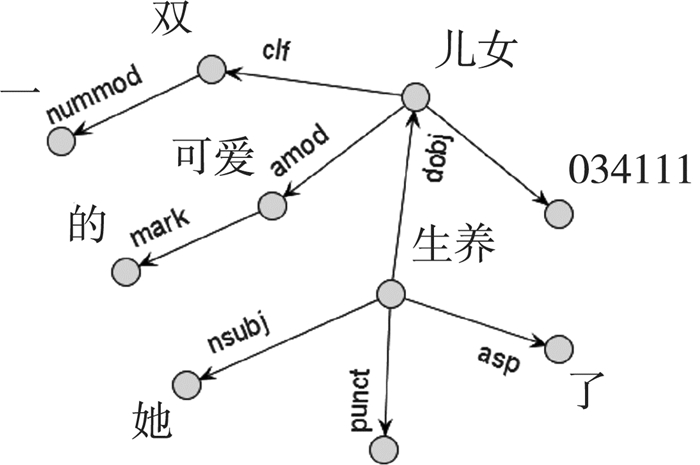

依存句法分析的结果可以使用三元组的形式来表示,具体为:依存关系(支配者,从属者)。部分具体的依存关系如表 1所示。例如:对“她生养了一双可爱的儿女。”进行依存句法分析,可以得到上下文依存元组集合如下:

nsubj(生养-2, 她-1)

root(ROOT-0, 生养-2)

asp(生养-2, 了-3)

nummod(双-5, 一-4)

clf(儿女-8, 双-5)

amod(儿女-8, 可爱-6)

mark(可爱-6, 的-7)

dobj(生养-2, 儿女-8)

punct(生养-2, 。-9)

与之对应的上下文依存关系图如图 2所示。

|

| 图 2 上下文依存关系图 |

首先,对歧义句进行依存句法分析,得到上下文依存关系图;根据依存关系图中上下文词语与目标歧义词的最短路径长度,获取上下文知识。这里的上下文知识是指上下文中的名词、动词、形容词、副词。根据依存关系图可以获取与歧义词在一定最短路径范围内的实词,作为上下文知识。当设定最短路径为1时,对于目标歧义词“儿女”,可得到上下文知识为“生养”“可爱”。

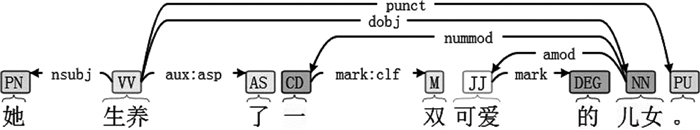

2) 构建例句依存关系图

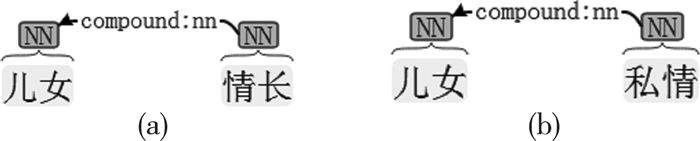

获取目标歧义词“儿女”在HowNet中各词义概念的例句。第一个词义有5个简短的例句:“一双~,养育~,有~的人,懂事的~,供应~的学费”,分别对其进行依存句法分析,得到各例句对应的依存元组集合。例句“一双~”对应的依存元组集合为“nummod(儿女-2,一双-1)”;“养育~”对应于“dobj(养育-1,儿女-2)”;“有~的人”对应于“assmod(人-4,儿女-2),case(儿女-2,的-3),dobj(有-1,人-4)”;“懂事的~”对应于“relcl(儿女-3,懂事-1),mark(懂事-1,的-2)”;“供应~的学费”对应于“assmod(学费-4,儿女-2),case(儿女-2,的-3),dobj(供应-1,学费-4)”。进一步可由依存元组集合转化得到依存关系图,具体如图 3所示。第二个词义有两个例句“~情长,~私情”,分别对其进行依存句法分析,得到依存元组集合“nsubj(情长-2,儿女-1)”“nn(私情-2,儿女-1)”,进一步可得到例句依存关系图,具体如图 4所示。

|

| 图 3 第一个词义各例句依存关系图 |

|

| 图 4 第二个词义各例句依存关系图 |

2.2.3 构建消歧图

本小节的工作有两项:一是利用2.2.2小节得到的上下文依存关系图,进行上下文消歧图的构建;二是利用上下文依存关系图和例句依存关系图(见2.2.2小节),构建依存消歧图。

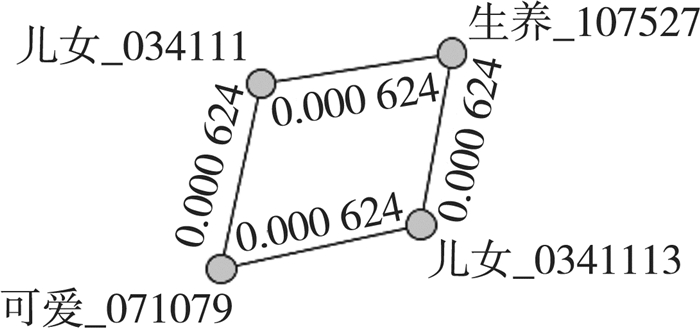

1) 构建上下文消歧图

上下文消歧图为一个无向图,如图 5所示。图中的顶点表示词义概念,采用词语词汇和HowNet概念编号相结合的形式进行表示,边表示语义关系,使用HowNet进行概念相似度计算,其结果作为边的权重。语义关系指的是HowNet中的上下位、整体部分、同义关系等。需要注意的是,这里并没有将其细化为具体的某种语义关系,而是统一采用HowNet概念相似度测度工具包[10]进行语义关系的度量。

|

| 图 5 上下文消歧图 |

2) 构建依存消歧图

依存消歧图是一个有向图,如图 6所示。其中边表示顶点词语间的依存关系,边的方向由支配者指向被支配者。

|

| 图 6 依存消歧图 |

下面继续使用上文中的示例进行说明。如果歧义词在HowNet的词义概念定义中存在一个例句使得它所具有的依存关系都匹配歧义句,即存在例句依存关系图为歧义句依存关系图的子图,此时将歧义句和其各词义例句的依存关系图进行合并,并在图中标注对应的词义信息。上文示例中的歧义句为“她生养了一双可爱的儿女。”,其依存关系图如图 2所示;歧义词“儿女”第一个词义的各例句为“一双~,养育~,有~的人,懂事的~,供应~的学费”,对应的依存关系图如图 3所示。显然,存在例句“一双~”的依存关系图为歧义句依存关系图(见图 2)的子图,此时将两者进行合并,并标注相应的词义信息,具体为HowNet中的词义概念编号“034111”,如图 6所示。

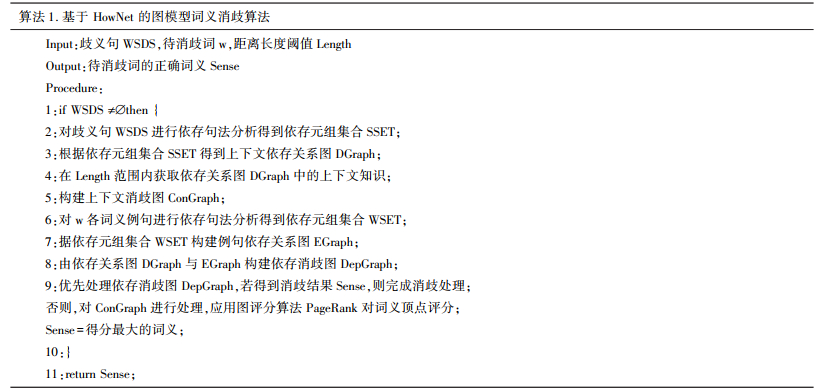

2.2.4 消歧算法为了进一步进行消歧处理,本小节设计了基于HowNet的图模型词义消歧算法,如表 2所示。算法输入为目标歧义词所在的歧义句WSDS、目标歧义词w以及距离长度阈值Length;算法输出为目标歧义词的正确词义。

| 表 2 消歧算法 |

|

行1:进行异常处理,以确保输入数据不为空,是合法有效的。

行2-3:使用斯坦福大学的依存句法分析工具包Stanford CoreNLP[12],对算法输入的歧义句WSDS进行依存句法分析,得到依存元组集合SSET,进而依据依存元组集合SSET得到上下文依存关系图DGraph(见图 2)。

行4-5:在依存关系图Dgraph中,获取最短路径阈值Length范围内的实词(顶点)作为上下文知识,依据HowNet对上下文知识进行处理,为其中每个词语标注其潜在的词义概念ID信息,借助于JUNG工具包构建上下文消歧图ConGraph(见图 5)。

行6-7:利用HowNet获取目标歧义词w各词义概念的例句,使用Stanford CoreNLP对其进行依存句法分析,得到依存元组集合WSET,据此构建例句依存关系图EGraph。

行8:由依存关系图Dgraph与EGraph构建依存消歧图DepGraph(见图 6)。

行9:对上下文消歧图ConGraph和依存消歧图DepGraph进行处理的规则,首先对其尝试使用依存消歧图进行消歧处理,如果得到消歧结果,则返回;否则,使用上下文消歧图ConGraph进行处理。

当对上下文消歧图ConGraph进行处理,调用PageRank算法对图中顶点的重要度进行评分,而后获取目标歧义词的各词义得分,选择得分最大者作为最终的正确词义。

行11:返回正确词义。此外,在消歧处理中无法输出词义时,随机选择目标歧义词的词义作为最终正确词义。

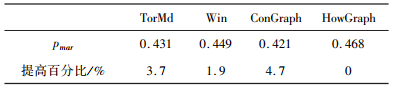

3 实验与分析 3.1 数据集选择与评估方法实验数据集来自国际语义评测SemEval-2007中的中英文词汇任务,采用官方提供的标准评测方法,即宏平均pmar作为评价指标[13]。

3.2 对比方法1) TorMd方法

该方法是多伦多大学参加SemEval-2007 task#5评测的无监督方法,获得评测第一名。

2) 基于窗口的方法(Win)

该方法在选择上下文知识时仅使用基于窗口的方法选择歧义词左右两侧词语,其他设置与本文提出的方法一致。

3) ConGraph方法

该方法是指仅利用上下文消歧图ConGraph进行词义消歧,具体见2.2.4小节。

4) HowGraph方法

该方法是指使用了上下文消歧图ConGraph与依存消歧图DepGraph进行词义消歧,具体见算法1。

3.3 结果与分析1) 消歧效果对比

各方法消歧效果如表 3所示,可以看出ConGraph方法的效果没有超过TorMd方法和Win方法。进一步对实验数据进行分析后,发现依存句法分析所获取的为词语间的依存关系,而这种依存关系很有可能是虚词对实词的修饰关系,如“一名中医”,虚词“名”依存于实词“中医”。很显然,在之后利用HowNet进行词义概念相似度计算时,“名”与“中医”各词义的相似度非常小或不存在,该词没有发挥出应有的指示作用。由此可知,直接过滤掉虚词并不可取,HowGraph方法组合了上下文消歧图和依存消歧图(见2.2.4小节),在一定程度上避免了该问题,其效果优于TorMd和Win方法,分别提升3.7%和1.9%。这表明本文提出的基于HowNet的图模型词义消歧方法能够有效改善词义消歧的效果。

| 表 3 各种方法的消歧效果 |

|

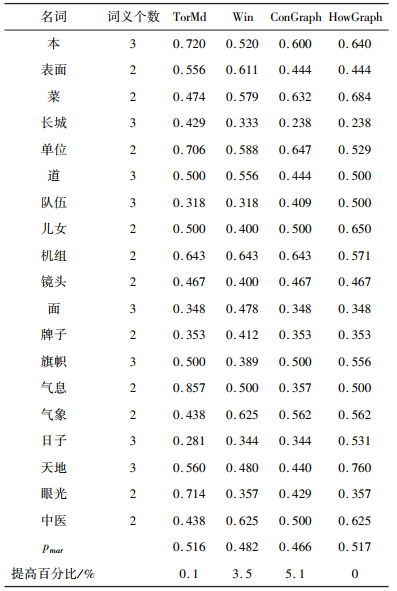

数据集中名词的消歧效果如表 4所示,每种方法在不同的名词上有着不同的消歧效果。TorMd方法在名词“本”“长城”“单位”“镜头”“气息”“眼光”上的取得较好消歧效果。Win方法主要在名词“表面”“道”“机组”“面”“牌子”“气象”“中医”上的消歧效果较优。ConGraph方法仅在名词“机组”“镜头”上有着比较好的消歧效果。HowGraph方法在名词“菜”“队伍”“儿女”“镜头”“旗帜”“日子”“天地”“中医”上有着较高的消歧准确率。从名词整体上的消歧效果来看,HowGraph方法取得了最好的消歧效果0.517,超过TorMd方法,不过提升的幅度较小,在消歧准确率上仅比TorMd方法提高0.1%;其相较于Win方法和ConGraph方法分别提升3.2%和4.8%。

| 表 4 名词消歧效果 |

|

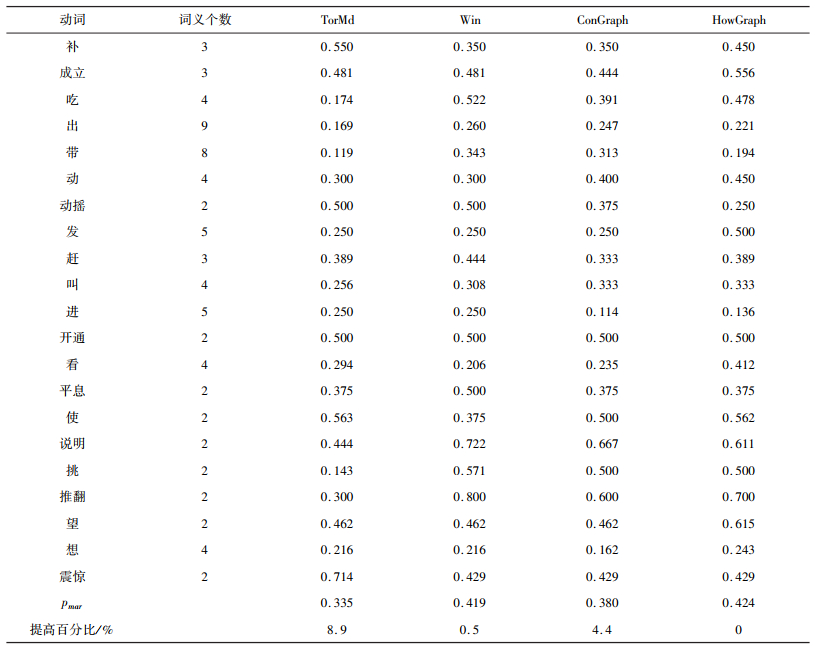

数据集中动词的消歧效果如表 5所示,显然,动词的消歧效果与名词相比有较大差距。动词消歧难度更大,尤其是一些常用动词有着非常多的词义。例如,在表 5中动词“出”具有9个词义,动词“带”具有8个词义,较多的词义给消歧处理带来较大难度。TorMd方法在动词“补”“动摇”“进”“使”“震惊”上有着较好的消歧效果;Win方法在动词“吃”“出”“带”“动摇”“赶”“进”“平息”“说明”“挑”“推翻”上的消歧效果较好;ConGraph方法在动词“叫”上有着较好的消歧效果;HowGraph在动词“成立”“动”“发”“叫”“看”“望”“想”上有着较高的消歧准确率。从动词整体上的消歧效果来看,HowGraph方法取得的消歧效果最好,Win方法稍逊,它们之间有0.5%的差距。

| 表 5 动词消歧效果 |

|

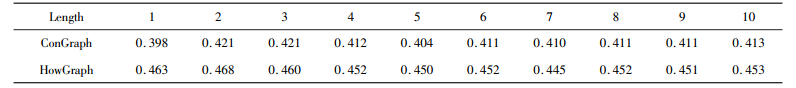

2) 实验参数分析

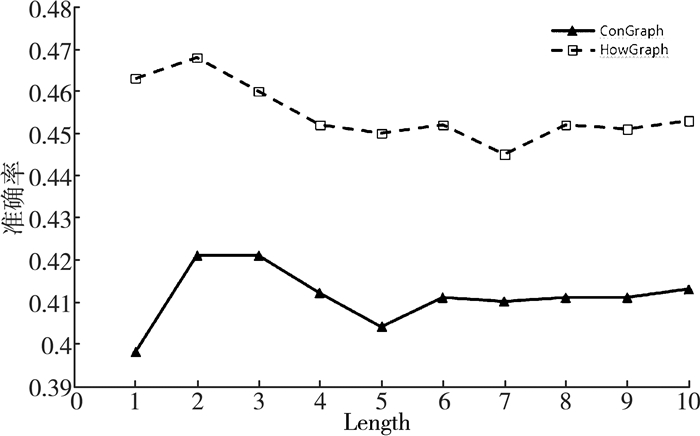

算法1(见2.2.4小节)中最短路径阈值Length对ConGraph方法和HowGraph方法消歧效果的影响如表 6所示。ConGraph方法在Length为2、3时取得最优消歧效果,HowGraph方法在Length为2时取得最好消歧效果。Length对消歧效果的影响,更为直观的展示如图 7所示。ConGraph方法在Length为1时消歧效果较差,在Length取值为2、3时达到峰值,之后虽有波动但整体上是下降趋势。这说明:在Length为1时,该方法获取上下文知识不足,致使消歧效果较差;在Length超过3时,该方法获取上下文知识时引入了较多的干扰因素,致使消歧准确率降低。HowGraph方法在Length取值为2时获得最好效果,之后整体呈下降趋势。这说明,在Length超过2时,该方法获取上下文知识时引入了较多的干扰因素,致使消歧准确率降低。

| 表 6 ConGraph与HowGraph方法消歧效果 |

|

|

| 图 7 最短路径阈值Length对消歧效果的影响 |

4 结论

本文提出了一种基于HowNet的图模型词义消歧方法。通过对歧义句进行依存句法分析得到上下文依存关系图,并获取上下文知识;利用HowNet进行对其进行概念相似度计算,以词义概念为顶点,概念间的语义关系为边,相似度值为边的权重,构建上下文消歧图;对目标歧义词各词义概念在HowNet中的例句,进行依存句法分析,得到例句依存关系图;结合上下文依存关系图与例句依存关系图,构建依存消歧图;利用上下文消歧图和依存消歧图,使用图算法对词义概念顶点的重要度进行评分,选取目标歧义词各词义概念中得分最高者作为正确词义。实验结果表明,本文提出的基于HowNet的图模型词义消歧方法能够有效改善词义消歧的效果。

| [1] |

李涓子.汉语词义消歧方法研究[D].北京: 清华大学, 1999.

|

| [2] |

WU D K, XIA X Y. Large-scale automatic extraction of an English-Chinese translation lexicon[J]. Machine translation, 1994, 9(3-4): 285-313. |

| [3] |

GALLEY M, McKEOWN K.Improving word sense disambiguation in lexical chaining[C].Proceedings of the 18th international joint conference on Artificial intelligence.Morgan Kaufmann Publishers Inc., 2003: 1486-1488. https://www.researchgate.net/publication/220812843_Improving_Word_Sense_Disambiguation_in_Lexical_Chaining

|

| [4] |

MIHALCEA R.Co-training and self-training for word sense disambiguation[C].Proceedings of the 8th Conference on Computational Natural Language Learning (CoNLL), 2004, 2004: 33-40. https://www.researchgate.net/publication/2938452_Co-training_and_Self-training_for_Word_Sense_Disambiguation

|

| [5] |

NAVIGLI R, VELARDI P. Structural semantic interconnections:a knowledge-based approach to word sense disambiguation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2005, 27(7): 1075-1086. |

| [6] |

AGIRRE E, SOROA A.Personalizing pagerank for word sense disambiguation[C].Proceedings of the 12th Conference of the European Chapter of the Association for Computational Linguistics.Association for Computational Linguistics, 2009: 33-41. https://www.researchgate.net/publication/220947007_Personalizing_PageRank_for_Word_Sense_Disambiguation

|

| [7] |

杨陟卓, 黄河燕. 基于词语距离的网络图词义消歧[J]. 软件学报, 2012, 23(4): 776-785. |

| [8] |

鹿文鹏, 黄河燕, 吴昊. 基于领域知识的图模型词义消歧方法[J]. 自动化学报, 2014, 40(12): 2836-2850. |

| [9] |

董振东.HowNet[EB/OL].http://www.keenage.com, 2013.

|

| [10] |

刘群, 李素建. 基于《知网》的词汇语义相似度计算[J]. 中文计算语言学, 2002, 7(2): 59-76. |

| [11] |

TESNIÂRE L. Élãments de Synta Xe Structural[M]. Paris: Klincksieck, 1959.

|

| [12] |

MANNING C D, SURDEANU M, BAUER J, et al.The Stanford coreNLP natural language processing toolkit[C].Association for Computational Linguistics (ACL)System Demonstrations.Association for Computational Linguistics, 2014: 55-60. https://www.researchgate.net/publication/272091377_The_Stanford_CoreNLP_Natural_Language_Processing_Toolkit

|

| [13] |

JIN P, WU Y F, YU S W.SemEval-2007 task 5: Multilingual Chinese-English lexical sample task[C].Proceedings of the 4th International Workshop on the Evaluation of Systems for the Semantic Analysis of Text.Prague: Association for Computational Linguistics, 2007.19-23. https://dl.acm.org/citation.cfm?id=1621478

|

2018, Vol. 32

2018, Vol. 32