扩展功能

文章信息

- 王世杰, 胡庆武

- WANG Shi-jie, HU Qing-wu

- 基于序列影像种子跟踪的道路线自动提取算法

- Road Lane Line Automatic Extraction Algorithm Using Seed Tracking Based on Sequence Images

- 公路交通科技, 2015, Vol. 31 (2): 147-153

- Journal of Highway and Transportation Research and Denelopment, 2015, Vol. 31 (2): 147-153

- 10.3969/j.issn.1002-0268.2015.02.023

-

文章历史

- 收稿日期:2014-01-16

2. 武汉大学 遥感信息工程学院, 湖北 武汉 430079

2. School of Remote Sensing and Information Engineering, Wuhan University, Wuhan Hubei 430079, China

汽车智能辅助驾驶系统在主动安全、防碰、防撞上有非常广阔的应用前景,早在20世纪90年代初期,几个工业发达的国家已相继开始重点研究开发智能运输系统和智能车路系统。车辆智能行驶最关键的就是要实现道路几何模型的检测、识别和跟踪。然而在实际应用中,由于道路路面状况、遮挡、阴影、移动车辆或行人等干扰,很容易将错误干扰线误当作道路线。到目前为止,在道路边线检测和自动提取方面进行了比较多的研究,发展了基于直线或曲线的道路模型,采用了不同的识别技术,如Hough变换、模块匹配、神经网络等。大部分研究都利用了Hough变换来进行线的分割[1, 2, 3, 4],其优点是抗噪性能好,能连接断线,但分辨率和计算时间受角度参数选择的影响很大,一般利用Hough变换时计算时间都比较长,不能满足实效性的要求[5, 6, 7] 。

车载移动测量系统是近年来被广泛应用的一种道路测量技术,通过集成CCD相机、激光扫描、GPS/IMU定位定姿传感器,可以快速获取道路序列影像,为道路边线提取提供了大量序列影像数据。序列影像的前后帧影像重叠信息,可以用于道路边线的预测与跟踪[8, 9, 10, 11, 12, 13]。本文以车载移动道路系统获取的道路序列影像为数据源,提出了一种基于序列影像种子跟踪的道路线自动算法,先确定第一帧影像中的种子直线,以此预测下一帧影像上的道路边线,然后基于边缘检测、感兴趣区域约束、直线跟踪的算法寻找车道边线边缘,实现不同影像质量的道路边线稳健跟踪提取。该算法不仅计算速度快,提取的道路边线精度高,具有很好的鲁棒性。

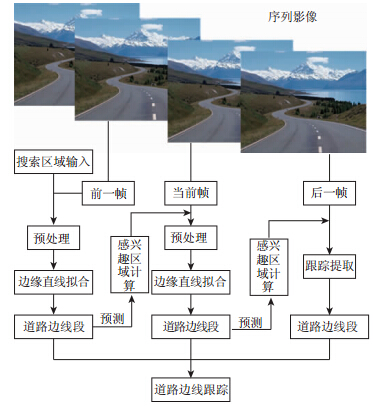

1 算法框架车载移动测量系统可以按照时间或距离触发获取具有严密空间位置坐标的连续道路影像,通常前后帧影像间的间隔在2~10 m,前后帧影像的重叠度可以达到80%以上[13]。本文充分利用了来自车载移动测量系统获取的高密度序列影像特性,根据道路设计常识,可以约定,在2~10 m范围内道路边线通常为直线或者近似直线。因此,可以前一帧影像道路边线提取结果作为种子点对下一帧影像上的边线进行预测,在此基础上进行边线跟踪提取,其算法框架如图 1所示。

|

| 图 1 算法框架Fig. 1 Framework of proposed algorithm |

由图 1可见,在进行边缘直线拟合时,需要对影像进行预处理,得到边线所在位置的边缘特征。通过对边缘特征的直线拟合,得到道路边线。在进行影像预处理和道路边线拟合时,前一帧影像边线提取的结果可以作为一个输入计算后一帧影像跟踪提取的感兴趣区,一方面可以减少边缘分析的范围,提高算法的实时性;另一方面,该约束可以保证边线提取的连续性,提高算法的稳健性。

2 道路边线检测与抗噪处理为减少计算量,提高道路线边缘点提取、跟踪和预测算法的实时性,需要对序列影像进行二值化或边缘检测,提取道路边线特征点。由于不同等级道路序列影像特征不一样,对于影像质量好、对比度高、道路边线特征明显的高速公路序列影像,可直接采用基于灰度信息的动态阈值二值化。对于对比度差城区道路或乡村道路,受周边环境干扰较大,本文提出基于影像梯度信息进行Sobel边缘检测。此外,为了降低边缘噪声对道路边线预测和跟踪的影响,通过引入一种边缘噪声消除算法对序列影像二值化结果进行处理,提高预处理算法的鲁棒性。

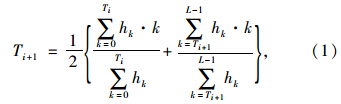

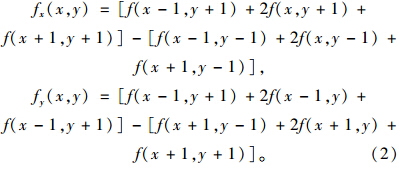

2.1 基于灰度信息的高速公路影像阈值迭代二值化高速公路道路影像对比度高,道路边线特征明显,可直接基于影像灰度信息进行二值化。在对道路序列影像进行二值化时,本文采用了一种迭代阈值法动态计算阈值,选取影像灰度范围的中值T0(设共有L个灰度级,0≤L≤255),按式(1)进行迭代:

对于城区道路或低等级乡村道路,由于没有明显道路标识线,可使用边缘提取算子提取出道路边缘。本文中使用的边缘提取算子为Sobel差分算子,离散的Sobel算子定义如下[14]:

Sobel算子本质是用于求取相邻或相距一定距离的像素点的灰度差异特征。对于道路而言,正常的路面由于物理性质接近,且光照一般均匀,因此获取的影像上临近像素点的灰度值往往比较接近。因此经过Sobel算子边缘增强后,影像位于路面上的梯度接近与0,此时影像仍然存在很多对道路边线探测无用的信息,在此基础上,对梯度影像进行二值化,二值化时也采用迭代阈值法选取阈值。

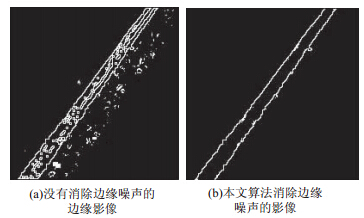

2.3 边缘噪声的消除如果路面有破损和道路标识线褪色时,边缘检测后的影像上就会存在许多非道路边缘的信息(在这里称为边缘噪声——相对与道路边缘信息而言),增加了道路线提取和跟踪的难度。为了提高提取的效率和可靠性,道路线跟踪提取之前必须消除这些噪声。本文分析道路边线的特点,提出了一种根据边缘几何特征消除噪声的方法,具体算法步骤如下。

Step 1:利用种子跟踪法跟踪出连通的边缘点,组成一个边缘点群,种子跟踪采用16邻域。

Step 2:统计每个点群的性质,包括点群长度(像素为单位)、点的个数、长宽比(垂直道路线方向为宽,沿着道路线方向为长)。

Step 3:噪声消除:对于点群长度小于给定阈值或者长宽比小于给定阈值的点群进行去除操作,不将其当做边缘点。通常认为道路边线长度大于0.5 m,长、宽比在5∶1以上,根据实际影像分辨率换算为像素阈值。

图 2给出了边缘检测后消除边缘噪声后的效果。

|

| 图 2 边缘消噪处理结果Fig. 2 Result of lane edge de-noise processing |

从图 2中可以看出,使用本文边缘噪声消除算法后,因道路破损而形成的边缘点被有效地消除,简化了后续的跟踪算法。

3 道路边线拟合与跟踪 3.1 道路边线拟合由于多种原因均能使跟踪到的道路线边缘的点出现断裂、错位甚至伪边缘点,如断断续续和褪色的中心线,各种和中心线标记有关的道路标记种类,噪音标记(停止线、交叉线和方向线),照明条件(阳光、雨水、或云)以及阴影(树木或建筑物),道路类别(高速公路、城市街道、或乡村公路)以及材料(混凝土或沥青),道路形状(直的、光滑的、陡拐弯、相交的),道路覆盖(雪、水、树叶、石头),以及道路质量(无特色、裂开、有洞的)等。必须对跟踪到的道路点进行拟合,但不能利用所有点进行拟合,必须剔除错误的点和误差大的点。

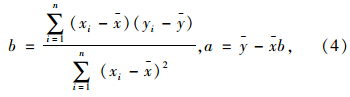

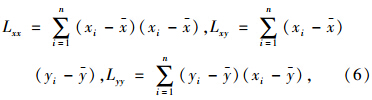

本文用线性回归方法来拟合道路线直线模型。一元线性回归的预测方程为y=ax+b,x为自变量,y为因变量,a为常数项,b为一元回归系数,公式为[15]:

式中,n为样本量(边缘点数);xi,yi,x-,y-分别为两个变量的观测值(像点坐标)和其均值。

样本相关系数γ可以判别一组边缘点线性相关的密切程度:

本文在进行粗差点剔除和建立直线模型时采用了迭代过程,每一步中采用线性回归方法建立直线模型后就计算出相关系数和每个点的残差,如果点的残差大于给定阈值且直线的相关性小于给定阈值,则剔除该点,剔除完该步里的所有粗差点后进行下一轮的迭代计算,直到没有粗差点被剔除或者直线的相关性超过给定阈值为止。通过剔除粗差点和建立起道路线的直线模型后,一些非道路边缘点就被剔除掉。

3.2 序列影像跟踪感兴趣区域的确定在道路影像中,大部分影像信息对于道路边线提取和跟踪是无用的,在整个道路影像中,道路边线部分只占了很小的一部分,这一小部分区域称为感兴趣区域。在进行道路边线跟踪提取事,只需在感兴趣区域进行影像预处理和边线拟合,减少道路线提取与跟踪的计算量和提高可靠性。

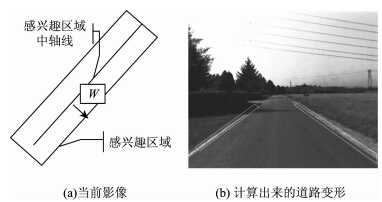

考虑到序列道路影像中,前后两张影像由于成像距离很近,重叠度达到80%以上,道路边线位置变化很小,因此可以利用上一帧影像的道路边线提取结果来定位当前影像的感兴趣区域,见图 3(a)。

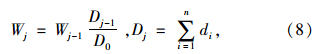

感兴趣区域中,包括边缘点和非边缘点,在计算下一张像片感兴趣区域的宽度时候,可以按照式(8)计算得到:

式中,di为i点到拟合出来直线的距离,i=2,3,…,n; Wj为j张像片上感兴趣区域的宽度;D0为标准宽度像片上感兴趣区域所有点到直线距离之和;Dj为第j张像片感兴趣区域里点到直线距离之和。基于以上模型计算出来的道路变形感兴趣区域见图 3(b)。

|

| 图 3 感兴趣区域预测Fig. 3 Prediction of region of interest |

前一帧影像检测出的车道边缘信息拟合得到道路边线后,当前帧影像上的道路线就可以根据前一帧的道路线的位置确定感兴趣区域,在这个感兴趣区域内可以用扫描的方法来确定道路边缘及特征点。对这些道路边线边缘点按照本文方法进行线性回归直线拟合,去掉误差点,得出道路线的直线模型。而下一帧影像上的道路线则可以根据当前帧影像提取出来的道路线的位置进行提取。依此方法,可以得到序列影像上的完整道路边线。

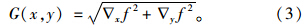

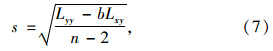

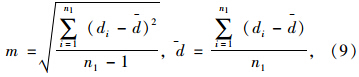

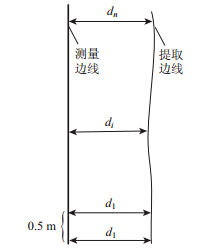

4 试验分析试验数据来自武汉大学985平台车载移动测量系统,该系统有3台Sick扫描仪,1个Ladybug3全景相机、2个双目CCD相机(像幅1 392×1 280,15fps)、一套LDA03 POS组成(图 4),采用该系统获取的高速公路和城市街区道路两组影像开展试验,分别从道路边线提取精度和序列影像道路边线提取跟踪目视效果来进行评价。道路边线提取精度以从序列影像上提取的道路边线点,按照车载移动测量双目立体摄影测量模型计算其空间坐标,得到道路边线的三维坐标,通过与该道路实际GPS RTK测量的道路边线按照5 m的间隔计算两个边线间的距离,按照式(9)统计该距离的中误差作为道路边线自动提取的精度(图 4)。

|

| 图 4 试验平台Fig. 4 Experiment platform |

以G4武汉西段高速公路为试验区域,采用车载移动测量系统采集其序列影像。按照本文方法进行道路边线提取和跟踪。任意选取其中一段道路,先根据本文方法跟踪的道路边线按照车载移动测量系统双目摄影测量模型计算其坐标,同时采用GPS RTK测量其边线坐标,按照式(9)以5 m的间隔统计二者之间的距离,其结果见表 1。

| 桩号 | RTK测量边线坐标 | 拟合道路边线坐标 | 距离差值 | ||

| x | y | x | y | ||

| 1 | 35 721.24 | 4 652.46 | 35 721.32 | 4 652.41 | 0.09 |

| 2 | 35 724.35 | 4 656.38 | 35 724.43 | 4 656.32 | 0.10 |

| 3 | 35 727.46 | 4 660.30 | 35 727.55 | 4 660.22 | 0.12 |

| 4 | 35 730.57 | 4 664.22 | 35 730.66 | 4 664.13 | 0.13 |

| 5 | 35 733.68 | 4 668.14 | 35 733.77 | 4 668.04 | 0.14 |

| 6 | 35 736.79 | 4 672.06 | 35 736.88 | 4 671.95 | 0.15 |

| 7 | 35 739.9 | 4 675.98 | 35 739.99 | 4 675.85 | 0.15 |

| 8 | 35 743.01 | 4 679.9 | 35 743.1 | 4 679.76 | 0.17 |

| 9 | 35 746.12 | 4 683.82 | 35 746.21 | 4 683.67 | 0.17 |

| 10 | 35 749.23 | 4 687.74 | 35 749.32 | 4 687.58 | 0.19 |

| 11 | 35 752.34 | 4 691.66 | 35 752.43 | 4 691.61 | 0.10 |

| 12 | 35 755.45 | 4 695.58 | 35 755.54 | 4 695.52 | 0.10 |

| 13 | 35 758.56 | 4 699.50 | 35 758.64 | 4 699.42 | 0.12 |

| 14 | 35 761.67 | 4 703.42 | 35 761.75 | 4 703.34 | 0.12 |

| 15 | 35 764.78 | 4 707.34 | 35 764.86 | 4 707.24 | 0.13 |

| 均值 | 0.13 | ||||

| 中误差 | 0.028 | ||||

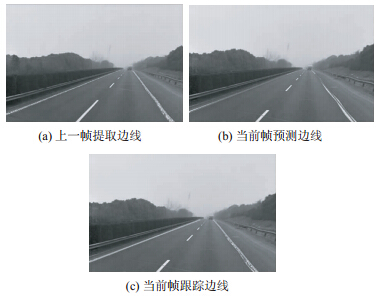

由表 1可见,本文基于序列影像跟踪的道路边线与传统的GPS RTK测量的道路边线具有很好的符合性,平均值为0.13 m,距离差值的中误差为0.028 m,表明本文方法具有较好的稳定性。图 5进一步给出了序列影像边线提取、预测和跟踪的效果。图 6(a)、(b)中,道路两侧白色点为提取的道路边缘点、白色线为基干提取的道路边线边缘拟合的道路边线。图 6(c)中道路两侧白线为预测的道路边线。

|

| 图 5 精度统计计算方法图Fig. 5 Accuracy calculation method |

由图 6可见,基于上一帧提取的道路边线能够很好地预测下一帧上的道路边线,以此作为种子点和约束,能够稳健的对道路边线进行跟踪。

|

| 图 6 高速公路道路边线提取跟踪结果Fig. 6 Extraction and tracking result of expressway boundary line |

以武汉城区某街道为试验区域,采用车载移动测量系统采集其序列影像,按照同样的方法统计本文方法跟踪的道路边线精度,其结果见表 2。

| 桩号 | RTK测量边线坐标 | 拟合道路边线坐标 | 距离差值 | ||

| x | y | x | y | ||

| 1 | 46 624.57 | 5 427.29 | 46 624.48 | 5 427.19 | 0.13 |

| 2 | 46 627.68 | 5 431.21 | 46 627.59 | 5 431.1 | 0.14 |

| 3 | 46 630.79 | 5 435.13 | 46 630.71 | 5 435.01 | 0.15 |

| 4 | 46 633.9 | 5 439.05 | 46 633.82 | 5 438.91 | 0.16 |

| 5 | 46 637.01 | 5 442.97 | 46 636.93 | 5 442.82 | 0.17 |

| 6 | 46 640.12 | 5 446.89 | 46 640.04 | 5 446.73 | 0.18 |

| 7 | 46 643.23 | 5 450.81 | 46 643.15 | 5 450.63 | 0.19 |

| 8 | 46 646.34 | 5 454.73 | 46 646.26 | 5 454.54 | 0.21 |

| 9 | 46 649.45 | 5 458.65 | 46 649.37 | 5 458.45 | 0.21 |

| 10 | 46 652.56 | 5 462.57 | 46 652.48 | 5 462.36 | 0.23 |

| 11 | 46 655.67 | 5 466.49 | 46 655.59 | 5 466.27 | 0.24 |

| 12 | 46 658.78 | 5 470.41 | 46 658.69 | 5 470.18 | 0.25 |

| 13 | 46 661.89 | 5 474.33 | 46 661.81 | 5 474.09 | 0.25 |

| 14 | 46 665 | 5 478.25 | 46 664.92 | 5 478.19 | 0.10 |

| 15 | 46 668.11 | 5 482.17 | 46 668.03 | 5 482.1 | 0.11 |

| 平均值 | 0.18 | ||||

| 中误差 | 0.050 | ||||

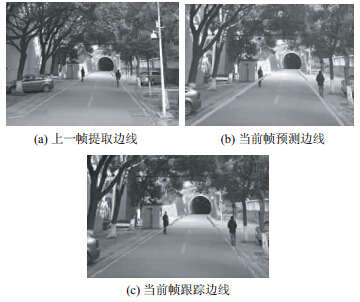

由表 2可见,对于城市街区复杂的道路环境,遮挡、阴影和移动行人、车辆干扰下,本文基于序列影像跟踪的道路边线精度为0.18 m,距离差值的中误差为0.050 m,表明本文方法具有较好的适应性。图 7进一步给出了序列影像边线提取、预测和跟踪的效果,能够很好地克服移动行人、阴影等影响,实现复杂环境下道路边线自动跟踪提取。

|

| 图 7 城市街区道路边线提取跟踪结果Fig. 7 Extraction and tracking result of road boundary lane in city street |

车载移动测量系统获取的高密度序列道路影像为道路边线的自动提取跟踪提供了全新的数据源,各种智能驾驶系统也可以通过CCD相机同样获取道路序列影像。本文提出的基于序列影像可以充分利用道路连续特性进行道路边线的提取、预测与跟踪,提高基于影像分析的道路边线自动提取的精度和鲁棒性,为道路测量和智能驾驶应用道路边线几何模型快速、稳健和高精度建立奠定基础。需要进一步提高算法的计算效率以适应实时道路边线检测应用。

| [1] | PALETTA L, PAAR G, WIMMER A. Mobile Detection of Traffic Infrastructure[C]//IEEE Proceedings of Intelligent Transportation Systems. Oakland:IEEE,2001: 614-619. |

| [2] | PSARIANOS B, PARADISIS D, NAKOS B, et al. A Cost-effective Road Surveying Method for the Assessment of Road Alignments[C]// IV International Symposium Turkish-German Joint Geodetic Days. Berlin:Berlin Technical University, 2001: 235-244. |

| [3] | MC ELHINNEY C P, KUMAR P, CAHALANE C, et al. Initial Results from European Road Safety Inspection (EURSI) Mobile Mapping Project[C]//ISPRS Commission V Technical Symposium. Newcastle: ISPRS, 2010: 440-445. |

| [4] | AGAMENNONI G, NIETO J I, NEBOT E M. Robust Inference of Principal Road Paths for Intelligent Transportation Systems[J]. |

| [5] | 徐友春,王荣本,李克强,等.一种基于直线模型的道路识别算法研究[J].中国图像图形学报,2004,9(7): 858-864. XU You-chun, WANG Rong-ben, LI Ke-qiang, et al. A Linear Model Based Road Identification Algorithm[J]. Journal of Image and Graphics,2004,9(7): 858-864. |

| [6] | 廖传锦,黄席樾,柴毅,等. 基于边缘提取和特征跟踪的道路检测算法[J]. 重庆大学学报:自然科学版, 2002, 25(1):61-64. LIAO Chuan-jin,HUANG Xi-yue,CHAI Yi,et al. A Lane-finding Algorithm Based on Edge Detection and Feature Tracking[J]. Journal of Chongqing University:Natural Science Edition, 2002, 25(1):61-64. |

| [7] | 荣婧, 潘玉利. 基于图像的水泥刻槽路面裂缝识别方法[J].公路交通科技, 2012, 29(3): 45-50. RONG Jing,PAN Yu-li. Digital Image Based Crack Detection of Grooved Cement Concrete Pavement[J]. Journal of Highway and Transportation Research and Development, 2012, 29(3): 45-50. |

| [8] | 王植,贺赛先. 一种基于Canny理论的自适应边缘检测方法[J].中国图像图形学报,2004,9(8): 957-962. WANG Zhi, HE Sai-xian. An Adaptive Edge-detection Method Based on Canny Algorithm[J]. Journal of Image and Graphics,2004,9(8): 957-962. |

| [9] | MURRAY S, HAUGHEY S, BROGAN M, et al. Mobile Mapping System for the Automated Detection and Analysis of Road Delineation[J]. |

| [10] | YANG Bi-sheng, FANG Li-na, LI Qing-quan, et al. Automated Extraction of Road Markings from Mobile Lidar Point Clouds[J]. |

| [11] | SULLIVAN D.BROWN A. High Accuracy Autonomous Image Georeferencing Using a GPS/Inertial-aided Digital Imaging System[C]// Proceedings of the 2002 National Technical Meeting of the Institute of Navigation. San Diego: The Institute of Navigation, 2002:598-603. |

| [12] | HASSAN T,EL-SHEIMY N. Common Adjustment of Land-Based and Airborne Mobile Mapping System Data[J]. International Archives of Photogrammetry, Remote Sensing and Spatial Information Sciences, 2008,37:835-842. |

| [13] | LI De-ren, HU Qing-wu, GUO Sheng, et al. Land-based Mobile Mapping System with Its Applications for The Olympic Games[J]. |

| [14] | VINCENT O R, FOLORUNSO O. A Descriptive Algorithm for Sobel Image Edge Detection[C]//Proceedings of Informing Science & IT Education Conference (InSITE). Santa Rosa: Informing Science Institute,2009: 97-107. |

| [15] | 官云兰,周世健, 张立亭,等. 稳健整体最小二乘直线拟合[J]. 工程勘察, 2012, 40(2): 60-62. GUAN Yun-lan, ZHOU Shi-jian, ZHANG Li-ting, et al. A Robust Method for Fitting a Line to Point Clouds Based on TLS [J].Geotechnical Investigation & Surveying, 2012, 40(2): 60-62. |

2015, Vol. 31

2015, Vol. 31