2. 广东工业大学 集成电路学院, 广东 广州 510006

2. School of Integrated Circuits, Guangdong University of Technology, Guangzhou 510006, China

光刻被认为是芯片制造中最复杂的工艺,光源是芯片曝光过程的关键步骤,常见的DUV光源波长维持在193 nm,EUV光源虽然已缩小至13.5 nm,但研发难度大。随着摩尔定律的发展,集成电路的工艺节点日益缩小,光源波长与高速发展的工艺节点不匹配问题增加了光学临近效应的影响,产生低保真度的“热点”[1]。为保证芯片制造良率,需要高效的热点检测器在光刻阶段检测热点,保证可制造性。

随着深度学习在计算机视觉领域的发展,基于深度学习的热点检测方法能够加快设计周期,同时利用已有数据样本训练模型,快速准确地发现已知热点模式和潜在的未知热点区域,已经成为版图热点检测的重要辅助手段。

然而,版图数据中热点样本数量相较于非热点样本数量较少,数据集存在类别不平衡问题,训练集的质量影响深度学习模型的最终性能。其次,将深度学习应用于热点检测问题时,考虑到基于卷积神经网络(Convolutional Neural Network,CNN)的架构虽然具有线性复杂度,但提取全局上下文信息的能力有限。视觉转换器(Vision Transformers,ViT) 架构相较于CNN虽然缓解了远距离依赖问题,具有全局感受野,但是ViT具有二次复杂度,执行效率有所降低[2]。

针对上述问题,本文设计了一种适用于芯片版图的热点检测器。首先使用主动学习[3]缓解数据集中热点样本和非热点样本量之间的不平衡问题对模型的负面影响。同时基于视觉状态空间模型(Visual State Space Model,VSSM)搭建适用于热点检测问题的线性时间复杂度的热点检测器,实现高效的热点检测问题。

1 相关工作 1.1 现有热点检测技术在先进工艺节点制造中,经过物理设计后得到的版图文件必须经过物理验证流程,使得设计遵循制造工艺和设计规则等约束,保证电路的正常功能。电路中出现的不满足设计规则和制造工艺的违例均称为“热点”。热点检测是物理验证的关键环节,在半导体制造之前检测可能出现违例的区域,可减少资源损耗,缩短设计和制造周期,保证制造良率。

传统的热点检测技术使用光刻模拟[4-5]以及模式匹配[6-8]。光刻模拟通过模拟光刻机的曝光过程预测芯片制造时版图的形成形状,仿真过程消耗大量计算和存储资源,耗时久。模式匹配的方法依赖于模式库中的模板数量,只能检测已存在的热点模式,无法检查未知热点模式。随着深度学习在特征提取中的应用,基于深度学习技术自动学习热点模式特征,能够有效解决传统热点检测技术的不足。

热点检测问题已经结合CNN、二值神经网络(Binary Neural Network,BNN)、图神经网络(Graph Neural Network,GNN)等模型展开研究。文献[9]基于注意力机制设计了一个端到端的热点检测器,虽然注意力机制能够有效捕捉版图中的局部特征信息,但将热点检测的时间复杂度变为二次复杂度,增加训练时间。文献[10]提出将版图转化为二值图像,基于BNN检测热点区域,二值图像只包含黑白两种数值,将限制版图模式的特征表达。文献[11]分析版图中的几何形状信息,将版图文件抽象为图结构,基于GNN搭建版图热点检测器,有效降低热点的误报数量,实现高效热点检测。对于版图中复杂的几何图形结构,仅通过提取图形的长、宽、相对位置等信息将难以准确表达几何图形的特征,例如:角度信息,由于光学临近效应的原因是否存在曲线信息等。

为此,本文设计了一个高效的热点检测器,充分结合全局感受野和线性复杂度的优势,缩减训练时间,提取版图中各种热点的复杂模式特征,实现高效的热点检测性能。

1.2 问题定义版图热点检测定义为准确高效地从版图中分类出热点和非热点两类模式。首先,从版图文件中提取热点和非热点区域,读取GDSII编码,转化为热点和非热点的图像数据集作为模型的训练和测试样本。其次,将训练数据输入至搭建的网络架构中训练热点检测器,实现最高的召回率和最低的误报率。最后,使用测试集评估热点检测器的性能,分析模型的泛化性。

混淆矩阵用于评估分类模型的性能,比较实际样本标签和检测样本标签,具体如表1所示。基于混淆矩阵定义热点检测器的两个性能评估指标:召回率和误报率。

| 表 1 混淆矩阵 Table 1 Confusion matrix |

召回率定义为正确检测热点样本占实际热点样本总数的比例:

| $ \mathrm{召}\mathrm{回}\mathrm{率}=\frac{\mathrm{T}\mathrm{P}}{\mathrm{T}\mathrm{P}+\mathrm{F}\mathrm{N}} $ | (1) |

误报率定义为非热点样本被检测为热点样本占实际非热点样本总数的比例:

| $ \mathrm{误}\mathrm{报}\mathrm{率}=\frac{\mathrm{F}\mathrm{P}}{\mathrm{F}\mathrm{P}+\mathrm{T}\mathrm{N}} $ | (2) |

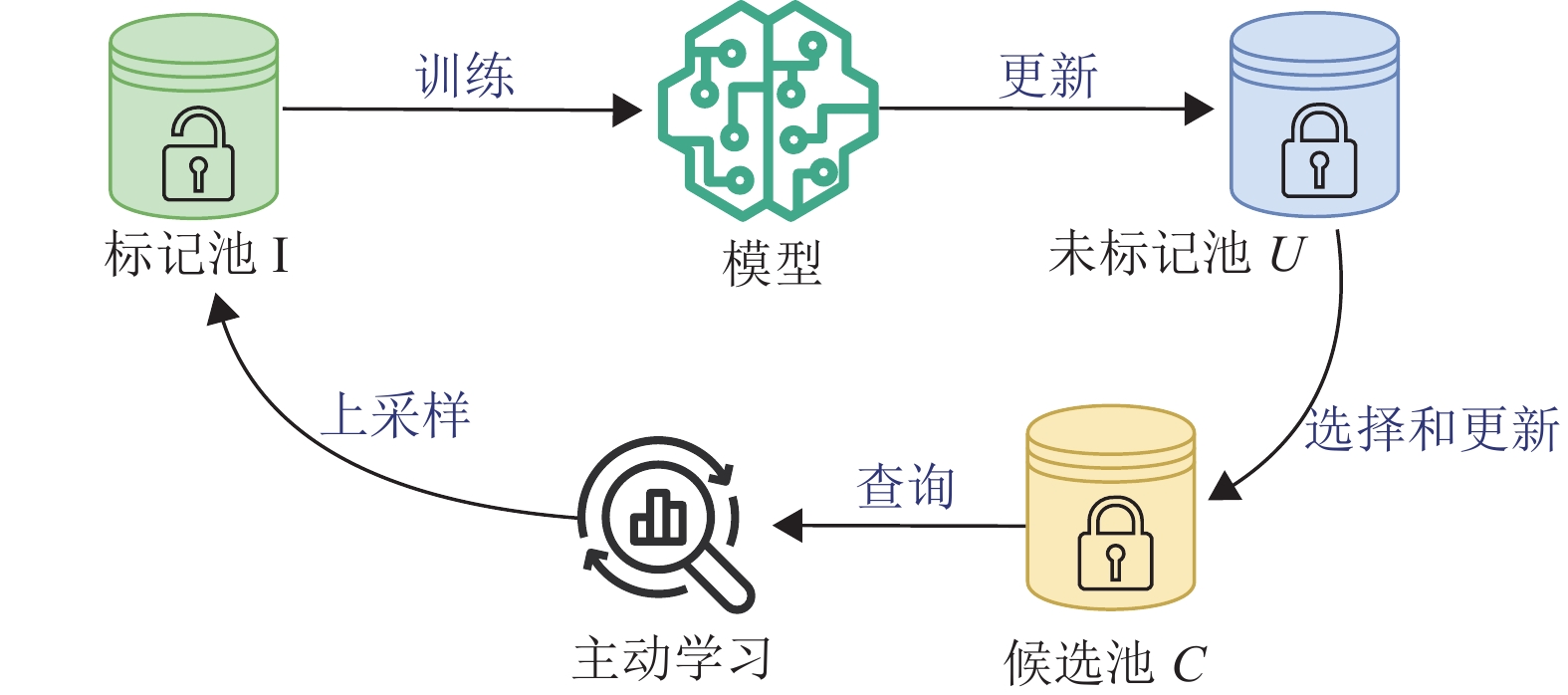

本文设计了一个高效的版图热点检测器(AL-RVSSM),主要由主动学习机制(Active Learning,AL)和残差视觉状态空间模型(Residual Visual State Space Model,RVSSM)两部分组成。残差视觉状态空间模型通过AL的查询策略从无标签的训练集中迭代地学习模式丰富的版图数据样本,缓解了热点检测问题中热点样本和非热点样本数量不平衡的问题,从有限的数据样本中训练模型,实现热点检测器的最优性能,整体的设计和训练思想如图1所示。

|

图 1 热点检测器训练的流程 Figure 1 Training Process of Hotspot Detector |

首先,将原始训练集划分为标签数据池

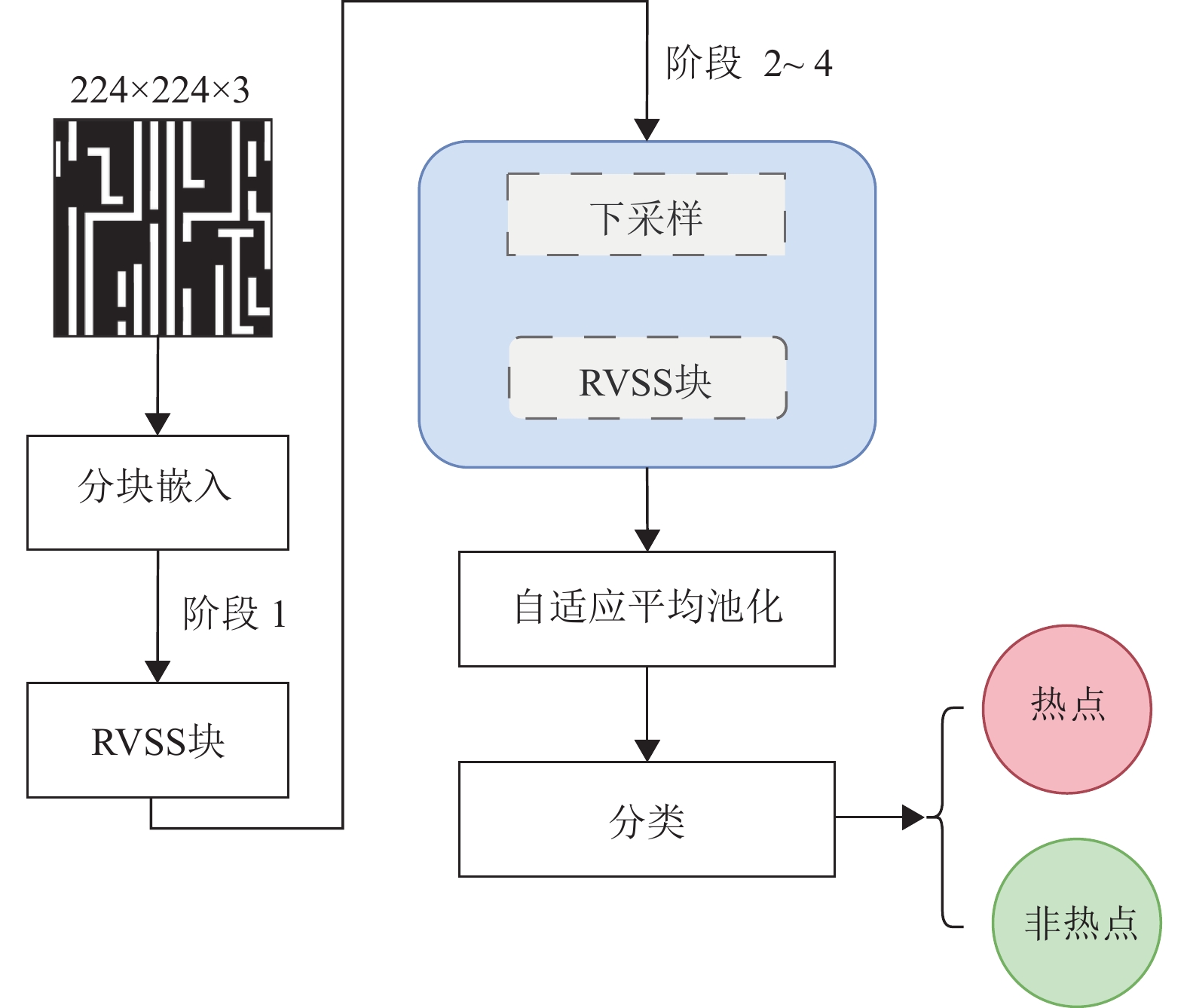

RVSSM具体包括分块嵌入、多阶段堆叠的RVSS模块、自适应平均池化以及二元分类操作。多阶段堆叠的RVSS块中,阶段1的RVSS模块接收输入版图样本划分得到的分块,由于RVSS模块并不改变特征图的尺寸,因此阶段1保持特征维度不变。阶段2~4中均对特征图执行下采样操作,具体如图2所示。

|

图 2 残差视觉状态空间模型的结构 Figure 2 The Structure of Residual State Space Model |

主动学习机制旨在选择有限数量的模式样本最大化模型的性能。主动学习机制主要包括两种类型:基于池(Pool-based)的主动学习和基于流(Stream-based)的主动学习。基于流的主动学习按照顺序扫描数据并单独查询每个样本,适用于数据源是流式并且数据规模大的问题;基于池的主动学习则有选择地从未标记样本池中批次查询,适用于深度学习模型的批次训练。热点检测器是基于池的主动学习机制进行设计。

主动学习中不确定性度量技术提取模型难以区分的样本,使用有限样本训练模型实现性能最大化。不确定性的查询策略分为最低置信度、间隔法以及熵方法等,其中,最低置信度和间隔法分别仅考虑了模型最优的预测结果以及最优的两种预测结果;熵是信息量的度量,反映复杂和多样程度,综合考虑模型所有的预测结果。基于熵的方法对概率分布的变化敏感,敏感性有利于选择模型中不确定性高的版图样本,提高模型的学习效率。热点检测问题中数据集类别严重不平衡,有限的热点样本导致热点检测模型的准确性和泛化性较差,仅使用不确定性度量面临模型过拟合问题。因此,采用蒙特卡罗Dropout(MC Dropout)方法[12],热点检测器模型的参数服从伯努利分布,而不是固定模型参数值,缓解有限的热点数据样本导致模型过拟合问题,进一步评估模型对版图样本的不确定性。基于MC Dropout方法,提出了一种记忆性评估查询的采样策略,提高了模型的泛化性,具体如算法1所示。检测版图样本时,打开Dropout层,在算法迭代过程中,查询函数

| $ p\left(y=c|x,X,Y\right) \approx \frac{1}{T}\sum _{t=1}^{T}\mathrm{S}\mathrm{o}\mathrm{f}\mathrm{t}\mathrm{m}\mathrm{a}\mathrm{x}\left({f}^{{W}_{t}}\left(x\right) \right) $ | (3) |

| $ H\left(p\right) = -\sum _{c=1}^{C}{p}_{c}\mathrm{l}\mathrm{o}\mathrm{g}{p}_{c} $ | (4) |

式中:

算法1 记忆性评估查询的采样策略

1) 输入:初始标签数据池

2) 初始化:使用类别平衡的数据集

3) 使用查询函数

4) 重复:

(a) 计算采样概率

(b) 从候选池

(c) 更新候选池、标签池

(d) 使用标签池

(e) 记忆性地计算样本的不确定性:

5) 直至:总上采样数为S。

6) 输出:模型性能测试结果。

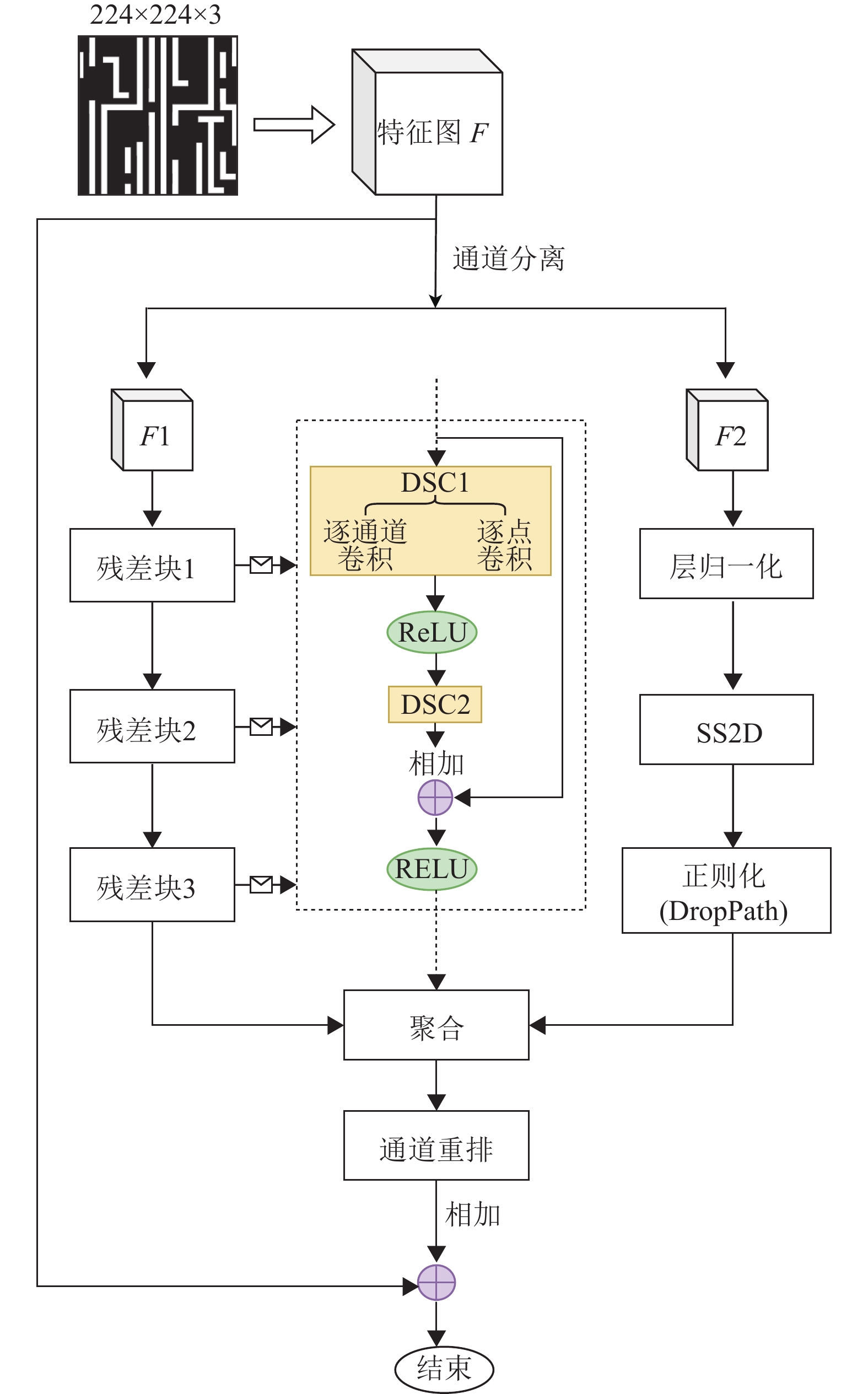

2.3 RVSS模块RVSS模块作为版图热点检测器的主要组件,融合了残差网络结构和视觉状态空间框架,引入洗牌的分组卷积思想,降低网络训练的计算量,实现不同组间的信息融合,提高版图热点检测的准确率,具体设计如图3所示。

|

图 3 RVSS 块 Figure 3 RVSS Block |

残差网络结构通过跳跃连接增加网络深度的同时缓解深度神经网络的梯度消失问题。每个残差块的设计采用深度可分离卷积(Depthwise Separable Convolution,DSC)[14],DSC运算包括逐通道卷积(Depthwise)和逐点卷积(Pointwise)两部分,使用逐通道卷积完成每个通道的卷积,得到与输入通道数相同的特征图

视觉状态空间模块基于VMamaba[2]的设计实现。输入特征图通过层归一化在特征维度上实现标准化,层归一化相较于依赖批次数据的批次归一化,更适用于小批量的样本训练,缓解训练过程中的梯度消失和梯度爆炸问题,加速模型收敛。

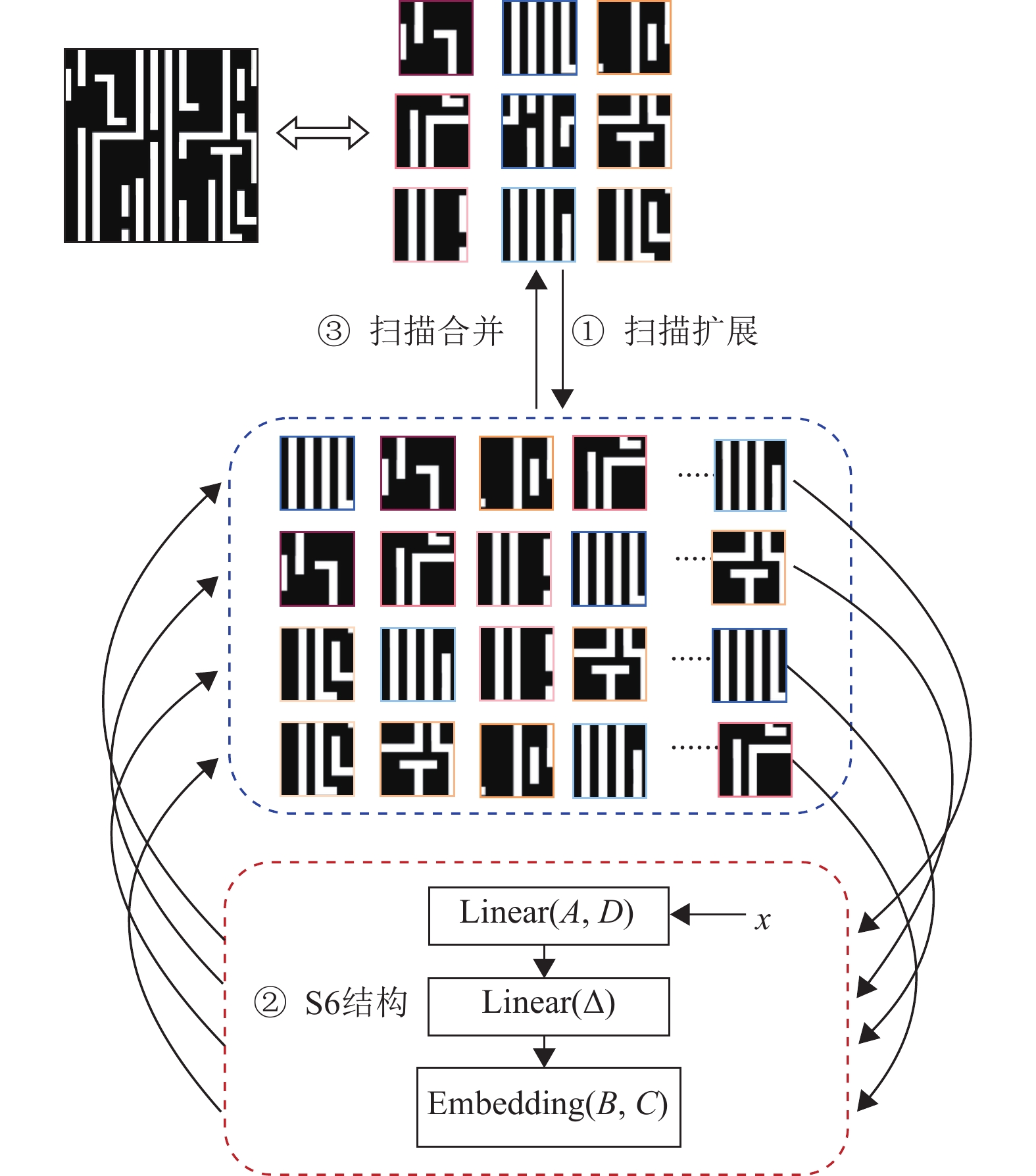

由于版图的热点和非热点的样本图像包含几何形状的大小、形状、相对位置等二维空间信息,2D-Selective-Scan(SS2D)模块由交叉扫描模块(Cross-Scan Module,CSM)和选择性结构化状态空间序列模型(Selective Structured State Space Sequence Models,S6)组成,实现线性复杂度的同时具有全局感受野,适用于处理图像分类问题。其中,S6将数据视为因果问题,由于版图样本数据具有非因果性,因此使用CSM的扫描策略进行改善。具体实现如图4所示。

|

图 4 SS2D块 Figure 4 SS2D Block |

(1) 扫描扩展:将版图样本沿行和列,展开为序列的形式,执行扫描扩展操作,具体为扫描上下左右四个方向的模式特征,保证特征图中每个位置的信息均融合了来自不同方向其他位置的特征,实现全局感受野。

(2) S6结构:S6结构基于结构化状态空间序列模型(Structured State Space Sequence Models,S4)结构进行优化,S4结构通过隐含的状态

| $ {h'}\left(t\right) =Ah\left(t\right) +Bx\left(t\right)$ | (5) |

| $ y\left(t\right) =Ch\left(t\right) +Dx\left(t\right) $ | (6) |

式中:假设状态空间的大小为

| $ \overline{A}=\mathrm{exp}\left(\varDelta A\right)$ | (7) |

| $ \overline{B}={\left(\varDelta A\right) }^{-1}\left(\mathrm{exp}\left(\varDelta A\right) -I\right) \varDelta B$ | (8) |

| $ {h}_{t}=\overline{A}{h}_{t-1}+\overline{B}{x}_{t} $ | (9) |

| $ {y}_{t}=C{h}_{t}+D{x}_{t} $ | (10) |

其中,从输入矩阵

(3) 扫描合并:将每个版图序列合并为单个图像,并将所有序列合并为新序列,实现扫描合并。

传统的注意力机制将样本中的模式特征聚合为中心像素,具有

在Python中使用Pytorch库搭建热点检测器框架,并在一台配备NVIDIA A100 GPU(40 GB)的 Linux 系统上测试实验结果,搭建的残差视觉状态空间模型参数量为8.5 MB,总体评估模型的参数量大小为34.075 MB。模型的参数设置如表2所示。

| 表 2 参数设置 Table 2 Parameter Settings |

使用ICCAD-2012竞赛数据集[15]评估版图热点检测器的性能。数据集中训练集和测试集的情况如表3所示。

| 表 3 ICCAD-2012数据集情况统计 Table 3 Statistics of Datasets of ICCAD-2012 |

鉴于原始数据集中热点样本和非热点样本的数量严重不平衡,模型训练时将初始的标签数据池

|

图 5 总采样数对模型性能的影响 Figure 5 The Impact of Total Sample Size on Model Performance |

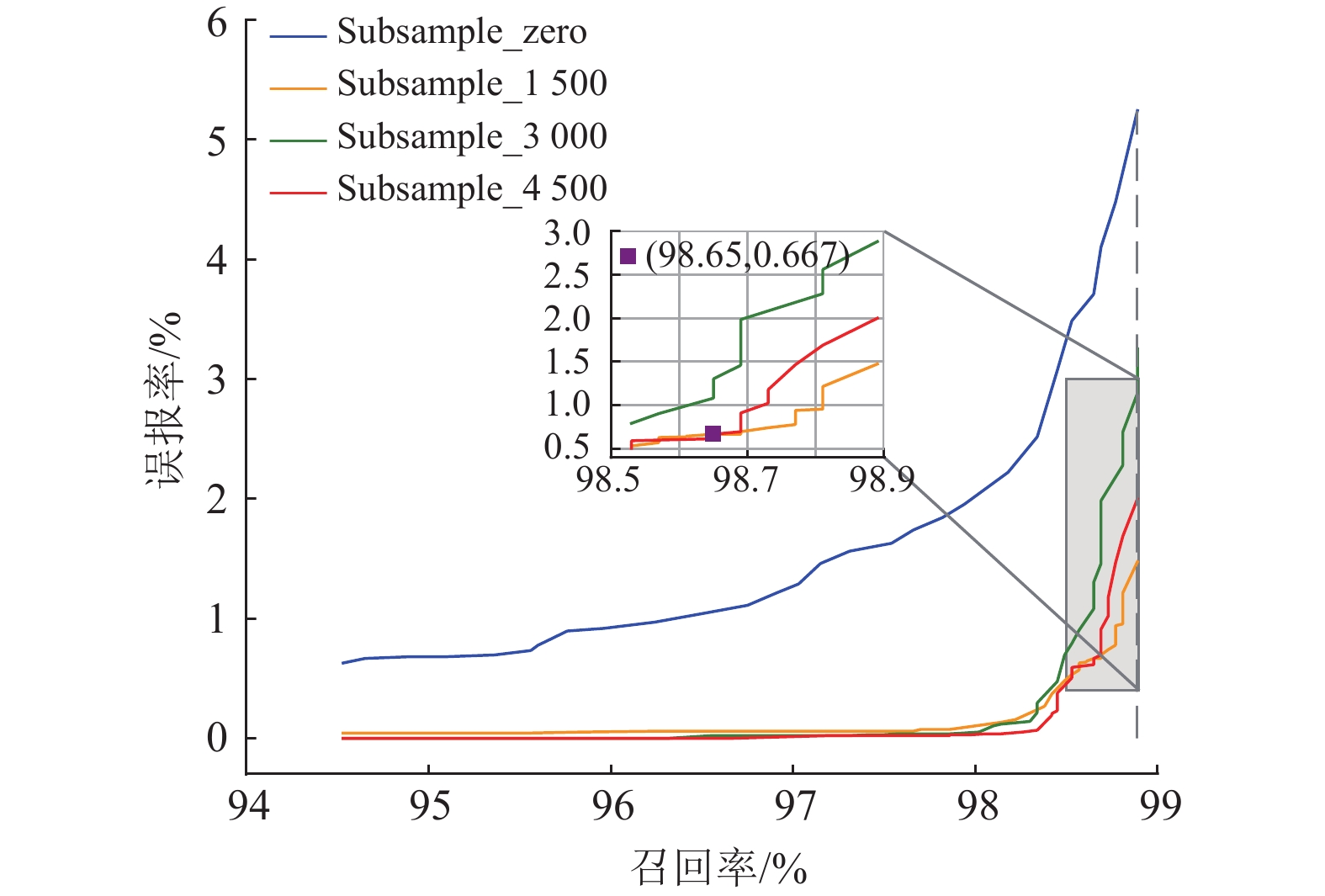

使用本文提出的基于MC Dropout的记忆性评估查询的采样策略的效果明显优于无采样(仅使用初始标签池

分析图5中使用不同的总采样数对模型性能产生的影响,当召回率调整至98.65%时,仅使用

基于

| 表 4 与最新研究的性能比较 Table 4 Performance Comparison with Recent Studies |

AL-RVSSM和文献[16]均使用了类别平衡的数据进行采样和训练,其中AL-RVSSM通过记忆性评估的采样策略,保证每次采样基于先前的模型学习效果,同时采样历史模型不确定性高的样本。文献[16]将训练损失设计到偏置函数中,微调预训练模型。AL-RVSSM相较于文献[16],采样策略提高了模型的泛化性,测试结果表明AL-RVSSM在提高召回率的同时,误报率降低了24.71%。AL-RVSSM框架使用线性复杂度的SS2D模块,相较于二次复杂度的注意力机制[9],RVSSM处理样本图像时融合整个图像序列的特征,具有全局感受野,同时满足大量数据的可扩展性。使用相同的数据集测试,AL-RVSSM框架相较于文献[9]提高了0.5%的召回率同时降低了16.9%的误报率。文献[11]使用抽象图结构,将版图信息抽象为矩形的长、宽、最小距离等特征简洁表示,但存在部分版图信息并未表示的问题。AL-RVSSM为避免版图信息丢失,将版图信息抽象为图像,基于图像的形式采用视觉空间模型检测热点,通过四向扫描和残差块网络获取版图信息,相较于文献[11]误报率减少了11.35%。AL-RVSSM相较于大语言模型[17]的方式,结合数据采样策略与视觉模型学习版图特征信息,改善了大语言模型训练和微调需要大量训练数据的问题,结果表明误报率减少了6.91%。

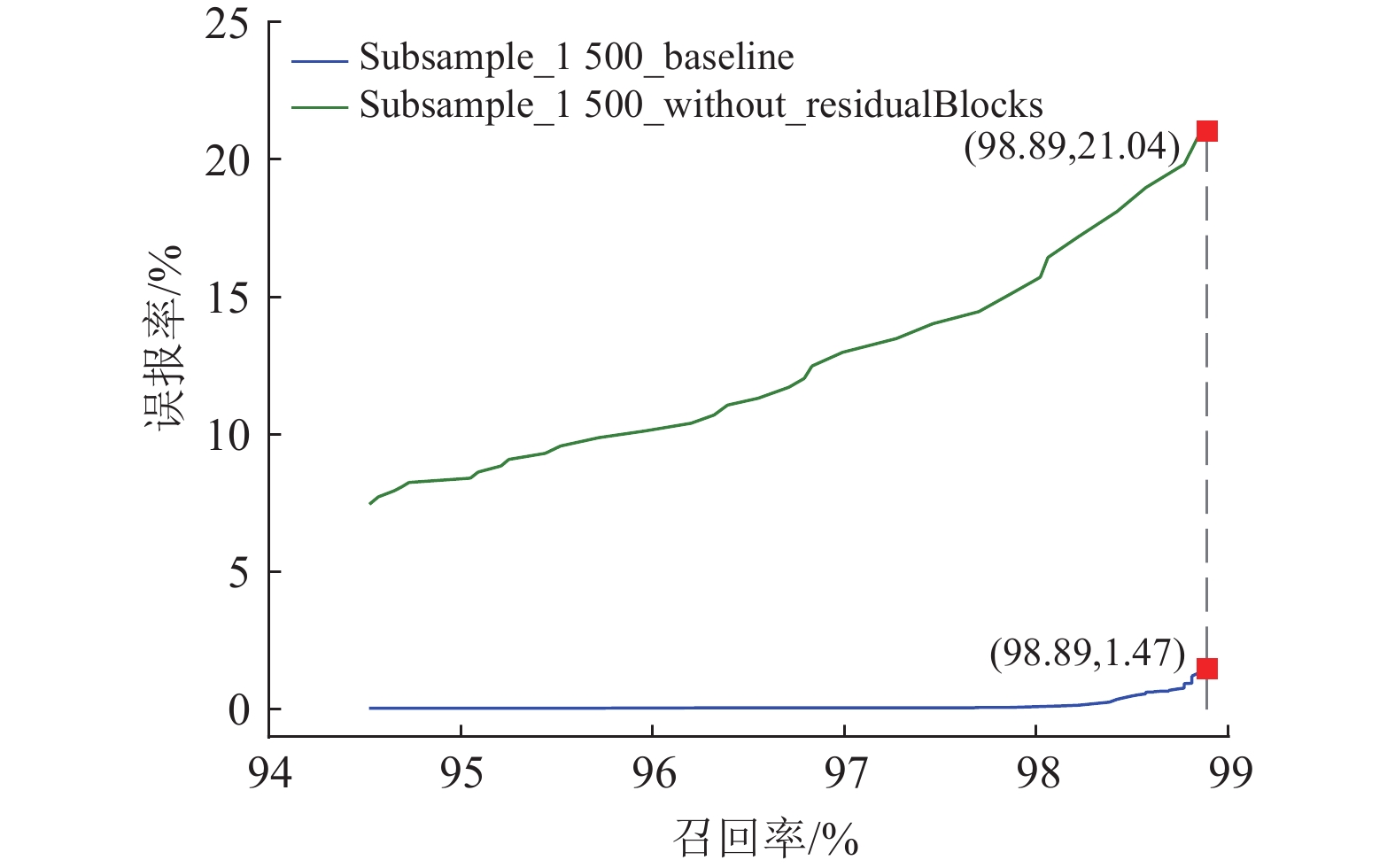

3.3 消融实验 3.3.1 消除残差网络结构块RVSS模块作为版图热点检测器的核心组件,借鉴分组卷积的思想,基于VMamba的网络结构进一步融合残差网络结构块,增加网络深度,提高了检测版图中热点模式的能力。基于

|

图 6 残差网络块对模型性能的影响 Figure 6 The Impact of Residual Network Blocks on Model Performance |

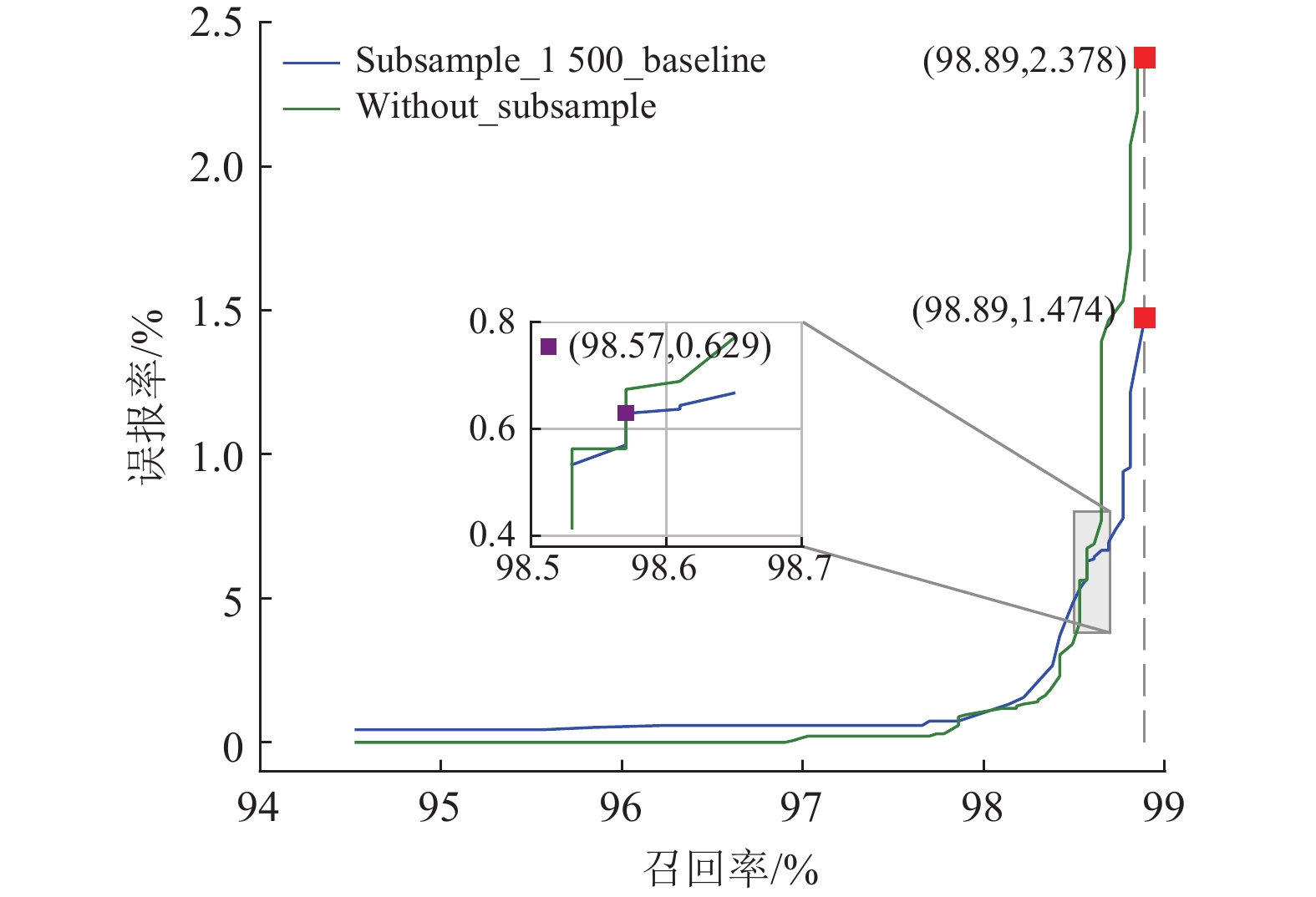

为了进一步评估主动学习机制在AL-RVSSM的作用,使用总采样数

|

图 7 主动学习机制的性能评估 Figure 7 Performance Evaluation of Active Learning |

基线模型中,初始标签池

基于主动学习和视觉状态空间模型设计了版图热点检测器AL-RVSSM,使用主动学习机制查询有限热点样本训练集中的版图特征,缓解热点和非热点样本数据不平衡对模型的影响。此外,基于视觉状态空间模型设计了具有全局感受野和线性时间复杂度的残差视觉状态空间模型,高效检测热点所在区域。ICCAD-2012竞赛数据集的评估结果表明,热点检测器AL-RVSSM显著减少误报率。未来的工作将进一步探索版图热点检测问题的高效模型框架,提供一种通用的热点检测器。

| [1] |

PAN D Z, YU B, GAO J R. Design for manufacturing with emerging nanolithography[J].

IEEE Transactions on Computer-Aided Design of Integrated Circuits and Systems, 2013, 32(10): 1453-1472.

|

| [2] |

LIU Y, TIAN Y J, ZHAO Y Z, et al. VMamba: visual state space model[EB/OL]. arXiv: 2401.10166(2024-01-18) [2024-10-10]. https://doi.org//10.48550/arXiv.2401.10166.

|

| [3] |

REN P Z, XIAO Y, CHANG X J, et al. A survey of deep active learning[J].

Association for Computing Machinery, 2021, 54(9): 1-40.

|

| [4] |

GUPTA P, KAHNG A B, NAKAGAWA S, et al. Lithography simulation-based full-chip design analyses[C] //Design and Process Integration for Microelectronic Manufacturing IV. San Jose: SPIE, 2006: 277-284.

|

| [5] |

KIM J, FAN M. Hotspot detection on post-OPC layout using full-chip simulation-based verification tool: a case study with aerial image simulation[C] //23rd Annual BACUS Symposium on Photomask Technology. Monterey: SPIE, 2003: 919-925.

|

| [6] |

TSENG S S-E, CHANG W C, JIANG I H-R, et al. Efficient search of layout hotspot patterns for matching SEM images using multilevel pixelation[C] //Optical Microlithography XXXII. San Jose: SPIE, 2019: 51-58.

|

| [7] |

WEN W Y, LI J C, LIN S Y, et al. A fuzzy-matching model with grid reduction for lithography hotspot detection[J].

IEEE Transactions on Computer-Aided Design of Integrated Circuits and Systems, 2014, 33(11): 1671-1680.

DOI: 10.1109/TCAD.2014.2351273. |

| [8] |

YU Y T, CHAN Y C, SINHA S, et al. Accurate process-hotspot detection using critical design rule extraction[C] //Proceedings of the 49th Annual Design Automation Conference. New York: ACM, 2012: 1167-1172.

|

| [9] |

GENG H, YANG H Y, ZHANG L, et al. Hotspot detection via attention-based deep layout metric learning[C] //Proceedings of the 39th International Conference on Computer-Aided Design. New York: ACM, 2020: 1-8.

|

| [10] |

JIANG Y Y, YANG F, ZHU H L, et al. Efficient layout hotspot detection via binarized residual neural network[C] //Proceedings of the 56th Annual Design Automation Conference 2019. New York: ACM, 2019: 1-6.

|

| [11] |

SUN S Y, JIANG Y Y, YANG F, et al. Efficient hotspot detection via graph neural network[C] //2022 Design, Automation & Test in Europe Conference & Exhibition (DATE) . Antwerp: IEEE, 2022: 1233-1238.

|

| [12] |

GAL Y, GHAHRAMANI Z. Dropout as a bayesian approximation: representing model uncertainty in deep learning[C] //international conference on machine learning. New York: PMLR, 2016: 1050-1059.

|

| [13] |

LIN J H, Divergence measures based on the Shannon entropy[J]. IEEE Transactions on Information theory, 1991, 37(1): 145-151.

|

| [14] |

HOWARD A G, ZHU M L, CHEN B, et al. Mobilenets: efficient convolutional neural networks for mobile vision applications[EB/OL]. arXiv: 1704.04861(2017-04-17) [2024-10-10]. https://doi.org/10.48550-/arXiv,1704.04861.

|

| [15] |

TORRES J A. ICCAD-2012 CAD contest in fuzzy pattern matching for physical verification and benchmark suite[C] //Proceedings of the International Conference on Computer-Aided Design. New York: ACM, 2012: 349-350.

|

| [16] |

YANG H Y, SU J, ZOU Y, et al. Layout hotspot detection with feature tensor generation and deep biased learning[C] //Proceedings of the 54th Annual Design Automation Conference 2017. New York: ACM, 2017: 1-6.

|

| [17] |

CHEN Y Y, WU Y W, WANG J Y, et al. LLM-HD: layout language model for hotspot detection with GDS semantic encoding[C] //Proceedings of the 61th Annual Design Automation Conference 2024. New York: ACM, 2024: 1-6.

|

2024, Vol. 41

2024, Vol. 41