2. 广州医科大学附属第一医院 肝胆外科,广东 广州 510120

2. Department of Hepatobiliary Surgery, the First Affiliated Hospital of Guangzhou Medical University, Guangzhou 510120, China

近年来,肝胆管结石病的发病率逐年上升,已经成为常见的肝脏疾病之一。该疾病在我国高发于西南、东部沿海、香港及台湾地区,发病率可达6.1%[1-2],已成为我国非肿瘤性胆道疾病死亡的主要原因[3]。当前主流的治疗方法是通过微创手术进行治疗[4],其中术前最重要的环节就是需要通过电子计算机断层扫描(Computed Tomography, CT)患者的腹腔,然后通过专业影像学医生标注CT各层切片中的血管、胆管、结石等各个组织器官来重建其肝脏内部整体的三维信息,制定合适的术前指导方案来提高手术的成功率。然而,对肝脏内各类器官组织的准确判别和标注对医生的经验有着较高的要求,另外这项任务所耗费的时间和人力成本较大,而且可能由于不同螺旋CT设备排数不一样,导致扫描获得的CT切片厚度不同,从而对分割重建的结果产生较大的影响。为了减少低密度螺旋CT扫描设备产生的影响进而帮助临床医生高效地完成术前规划方案,设计一种自动插值CT层间切片来进行肝胆管分割重建算法非常有必要。这项工作的难点在于:

(1) 低密度螺旋CT扫描切片的层间分辨率低,导致分割重建的肝胆管存在断裂、不连续等现象。

(2) CT切片的层间插值与肝胆管分割任务是割裂开来的,不能起到相互监督的作用。

(3) 肝胆管高度形变、尺寸小、形状复杂且分布不均使得准确分割变得困难。

在医学影像分割中,传统分割方法有阈值处理、区域生长、活动轮廓等方法[5-7],此类方法在目标对象和背景图像灰度强度差异不大的情况下分割效果并不好,且肝胆管、肝血管此类组织尺寸小、轮廓边缘分布不均给分割带来更大的难度。近年来,卷积神经网络因为其出色的特征提取和良好的特征表示[8],被广泛应用在医学领域。在肝胆管分割中,Fu等[9]改进 U-Net[10]提出一种多尺度流融合策略,将第一个流中产生的最丰富的语义特征融合到其他流中进行肝胆管的分割。陈芝涛等[11]提出通过引入多尺度上下文特征提取和多尺度特征融合来实现肝胆管的精准分割。而在肝血管分割中,Kitrungrotsakul等[12]提出一种用于肝血管分割的2D多路径网络,该网络由3个单独的DensNet组成,以提取CT扫描的矢状面、冠状面和横向面的特征。Yan等[13]提出一种用于肝血管分割的3D LVSNet网络,该网络提出了一个注意力引导连接模块,该模块基于高维特征信息从低维特征中自适应地选择相关上下文信息。Su等[14]构建一种新的密集型网络DV-Net来分割肝血管,提出了一种双分支密集连接下采样策略以更好地捕捉血管特征。Hao等[15]提出一种分层渐进式多尺度学习网络HPM-Net用于肝血管分割,通过获取不同大小的感受野来学习不同尺度的肝脏血管的语义信息。虽然上述研究在分割上面的效果不错,但是由于从不同病例扫描获得的CT图像之间的切片厚度和间距存在差异,层间分辨率低,产生各向异性,导致分割肝胆管、肝血管等此类树状型组织器官在重建过程中会出现断层、不连续等现象。

因此,研究人员针对此类问题提出了最近邻插值、线性插值、基于轮廓插值等层间插值方法[16]进行插值再分割。这类插值方法通过对相邻图像序列之间的像素值来估计插值,将相邻图像之间的时空运动限制在线性轨迹中,但是忽略了医学器官组织中明显的复杂、非线性运动。而基于深度学习的插值算法目前在医学影像中应用较少[17],大多数见于视频插帧应用中。Niklaus等[18]提出SepConv网络,通过空间自适应卷积核来估计每个像素的运动,Jiang等[19]提出了一种Slomo技术,该技术通过线性组合双向光流来插值帧运动,然后通过端到端CNN进一步细化估计的运动流场。Lu等[20]利用Transformer来模拟视频帧之间的长距离像素相关性,提出一种基于跨尺度窗口的注意机制来扩大感受野,并聚合多尺度信息。Luo等[21]提出一种双向伪三维网络,该网络通过学习共享多尺度时空表征,并将过去和未来方向的估计耦合起来,通过双向伪三维缩放层合成中间帧。

针对CT切片层间分辨率低且肝胆管组织高度形变等特点,本文通过自适应卷积核来插值肝胆管切片,并且为了避免先插值再分割造成的累计误差,导致最终分割重建出来的准确率受到影响,本文设计了一种基于深度关联机制的肝胆管CT层间超分辨率分割的端到端网络,提出将插值网络与分割网络级联成一个整体来插值分割肝胆管,充分利用前后切片的关联性以增强分割性能。与二阶段方法不同,该框架没有任何的中间处理,直接在训练过程中进行端到端的联合训练,同时优化2个子网络,共享不同阶段的信息,并且可以最大程度地抑制前一个子网络产生的累计误差。

本文的贡献:(1) 提出肝胆管超分辨率端到端分割网络,将层间插值和肝胆管分割任务结合起来,使得重建效果更佳。(2) 肝胆管的前后切片具有一定的连续性,通过引入ConvLSTM来深度关联肝胆管高维特征的上下文关联性,提升分割准确率。(3) 提出新的损失函数联合插值网络与分割网络进行联合优化,使得网络在训练过程中达到最优状态。

1 方法 1.1 整体网络为了提高层间分辨率和重建效果,针对肝胆管高度形变等特点,重点突出肝胆管在切片中的特征信息,本文设计了一种基于深度关联机制的肝胆管CT层间超分辨率分割网络,整体网络架构图如图1所示:主要由插值和分割2个子网络级联构成1个端到端网络。2个子网络都是由1个编码器与解码器构成,特别是第1个子网络的解码器后面跟着4个卷积核。网络的输入为2张相邻的序列切片,输出得到的是3张所分割的肝胆管图像。

|

图 1 所提出的端到端网络架构 Figure 1 The proposed end-to-end framework |

在插值子网络中,编码器由5个3×3卷积层和5个2×2最大池化层构成,每个卷积层后面是一个最大池化层。解码器由5个2×2上采样层与编码器中相同大小的特征映射连接,后面跟着5个3×3反卷积层构成,解码器后面跟着4个卷积核。编解码器将提取到的特征交给4个卷积核,接着卷积核与输入切片

| $ \begin{split} {\boldsymbol{I}}\left(x,y\right) =&{{\boldsymbol{K}}}_{1,v}\left(x,y\right) *{{\boldsymbol{P}}}_{1}\left(x,y\right) *{{\boldsymbol{K}}}_{1,h}\left(x,y\right) +\\ &{{\boldsymbol{K}}}_{2,v}\left(x,y\right) *{{\boldsymbol{P}}}_{2}\left(x,y\right) *{{\boldsymbol{K}}}_{2,h}\left(x,y\right) \end{split} $ | (1) |

式中:

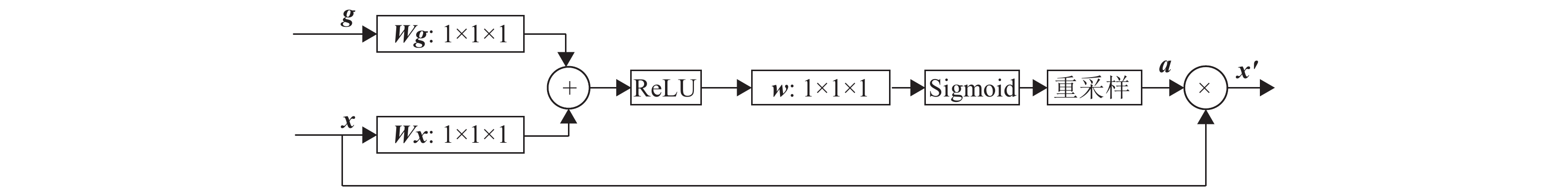

与插值网络类似,分割子网络也采用跳跃连接来实现特征融合,不同的是,编码器与解码器分别只有4个下采样层和上采样层,且在跳跃连接过程中加入门控机制,门控机制如图2所示。

|

图 2 门控机制 Figure 2 Attention gate |

在分割子网络中,编码器将提取到的特征

考虑到肝脏中肝胆管的尺寸小且形状复杂,肝胆管在相邻切片之间存在一定的连续性和关联性,而2D卷积神经网络在进行特征提取的时候仅考虑单张切片的图像信息,忽略了相邻切片的层间信息,因此,在网络下采样的第3层和第4层后面引入ConvLSTM关联机制来加强相邻切片之间肝胆管的特征信息提取和交换,突出肝胆管的上下文信息。ConvLSTM非常擅长处理具有上下文时序信息图像,与处理一维信息的LSTM不同,ConvLSTM用于处理二维图像,且将LSTM中的hadamard乘积替换为卷积来提取空间信息。由于肝胆管在肝脏中与周围组织的灰度值差别不是很大,将ConvLSTM使用在低维特征的信息提取和交换中将会产生冗余信息,对肝胆管的分割产生影响。而高维信息则包含了肝胆管与周围组织不同的全局信息,因此本文将ConvLSTM模块放在分割网络中进行肝胆管高维特征的提取,即下采样的第3层和第4层中来获取切片间肝胆管高维特征的上下文信息。ConvLSTM的表达式为

| $ {{\boldsymbol{i}}}_{t}=\sigma \left({{\boldsymbol{x}}}_{t}*{{\boldsymbol{W}}}_{xi}+{{\boldsymbol{h}}}_{t-1}*{{\boldsymbol{W}}}_{hi}+{{\boldsymbol{c}}}_{t-1}{^\circ} {{\boldsymbol{W}}}_{ci}+{{\boldsymbol{b}}}_{i}\right) $ |

| $ {{\boldsymbol{f}}}_{t}=\sigma \left({{\boldsymbol{x}}}_{t}*{{\boldsymbol{W}}}_{xf}+{{\boldsymbol{h}}}_{t-1}*{{\boldsymbol{W}}}_{hf}+{{\boldsymbol{c}}}_{t-1}{^\circ}{{\boldsymbol{W}}}_{cf}+{{\boldsymbol{b}}}_{f}\right) $ |

| $ {{\boldsymbol{c}}}_{t}={{\boldsymbol{c}}}_{t-1}{^\circ}{{\boldsymbol{f}}}_{t}+{{\boldsymbol{i}}}_{t}{^\circ}\mathrm{tan}\mathrm{h}({{\boldsymbol{x}}}_{t}*{{\boldsymbol{W}}}_{xc}+{{\boldsymbol{h}}}_{t-1}*{{\boldsymbol{W}}}_{hc}+{{\boldsymbol{b}}}_{c}) $ |

| $ {{\boldsymbol{o}}}_{t}=\sigma \left({{\boldsymbol{x}}}_{t}*{{\boldsymbol{W}}}_{xo}+{{\boldsymbol{h}}}_{t-1}*{{\boldsymbol{W}}}_{ho}+{{\boldsymbol{c}}}_{t}{^\circ}{{\boldsymbol{W}}}_{co}+{{\boldsymbol{b}}}_{o}\right) $ |

| $ {{\boldsymbol{h}}}_{t}={{\boldsymbol{o}}}_{t}{^\circ}\mathrm{tan}\mathrm{h}({{\boldsymbol{c}}}_{t}) $ | (2) |

式中:

本文所提的方法将层间切片的插值和肝胆管的分割结合成一个整体的任务,插值得到的切片质量将直接影响到后续肝胆管分割的精度,因此本文将整体损失函数也联合优化,提出总的网络损失函数为

| $ {L}_{\text{total}}=\frac{{L}_{{\rm{c}}}+\dfrac{1}{3}\left({L}_{\text{seg}\left({{\boldsymbol{I}}}_{1}\right) }+{L}_{\text{seg}\left({\boldsymbol{I}}\right) }+{L}_{\text{seg}\left({{\boldsymbol{I}}}_{2}\right) }\right) }{2} $ | (3) |

式中的插值子网络使用到的损失函数是

| $ {L}_{{\rm{c}}}={\sum} _{i=0}^{m}\sqrt{{\left({y}^{\left(i\right) }-{y'}^{\left(i\right) }\right) }^{2}+{\varepsilon }^{2}} $ | (4) |

式中:

在进行肝胆管分割任务时存在前景和背景的样本比例极度不均衡,容易造成肝胆管预测效果不精确。为了缓解该问题,分割子网络采用的损失函数

| $ {L}_{\text{seg}}={L}_{{\rm{CE}}}+{L}_{{\rm{Dice}}} $ | (5) |

| $ {L}_{{\rm{CE}}}=-{\sum} _{i=1}^{N}\stackrel{\wedge }{{y}_{i}}{\rm{log}}{y}_{i}+(1-\stackrel{\wedge }{{y}_{i}}) \mathrm{l}\mathrm{o}\mathrm{g}(1-{y}_{i}) $ | (6) |

| $ {L}_{{\rm{Dice}}}=1-\frac{2{\displaystyle\sum }_{i=1}^{N}{y}_{i}\stackrel{\wedge }{{y}_{i}}}{{\displaystyle\sum }_{i=1}^{N}{y}_{i}+{\displaystyle\sum }_{i=1}^{N}\stackrel{\wedge }{{y}_{i}}} $ | (7) |

式中:

本文所采用的数据集由广州医科大学第一附属医院肝胆外科提供。该数据集由256排螺旋CT采集得到,图像分辨率为512像素×512像素,像素间距为0.56~0.77 mm,切片厚度为0.625~2.5 mm之间。总共收集了24例患者的腹部CT图像,共2 522张符合标注要求的切片,将其随机分为训练集和测试集两部分,其中用来训练切片数为1913张,用来测试的切片数为609张。本文将相邻3张切片作为一个序列整体用于训练和测试,中间切片的真实标注结果与本文重建分割出来的切片结果作比较。肝胆管的标签由经验丰富的肝胆外科医生进行标注。

本文的所有实验都在一台配备Nvidia GeForce RTX 3090 24 GB GPU和Inter Xeon(R) Gold 5218R 2.10 GHz的CPU上面运行。训练和测试代码基于PyTorch 1.6(python3.6)的深度学习框架。在训练期间,本文的Adam优化器,设置初始学习率为0.0001,指数衰减率β1为0.9,β2为0.999。模型的超分辨率分割标准使用DICE相似度系数(Dice Similarity Coefficient)、IOU(Intersection over Union) 作为评价指标进行评估。

2.2 对比实验由于目前没有端到端层间超分辨率分割网络,因此本文所对比的网络是线性插值[16]、SpeConv插值[18]网络分别与Unet[10]、Attention-unet[22]、Unet++[23]、Swin-unet[24]分割网络相结合的二阶段网络。

实验结果如表1和图3所示,由对比实验结果可知,二阶段网络中SpeConv插值+Attention-unet网络的表现最好,因此,将该网络设计成端到端的级联网络,作为本文的实验基准网络。因为肝胆管具有尺寸小、分布不均匀、存在高度形变等插值分割难点,并且由于线性插值其局限性导致其与分割网络相结合的二阶段超分辨率分割效果不如SpeConv插值与分割网络相结合。在分割子网络中,Unet网络针对这些细小肝胆管的分割表现并不好,存在漏分割现象,Unet++通过引入一个内置深度可变的unet集合,提高了对肝胆管等细小组织的分割性能。Attention-unet通过引入注意力机制来突出肝胆管目标的重要特征,使得分割效果稍好。Swin-unet是基于transformer架构的分割网络,善于捕捉全局信息,并具有强大的建模能力,但是该网络需要较大的数据量进行训练,当数据量不足时,分割效果并不好。本文所提出的端到端超分辨率插值分割网络,通过级联2个子网络互相监督进行端到端的训练,在分割子网络中通过引入ConvLSTM来加强相邻切片上下文特征信息的提取,取得了较好的实验效果。

| 表 1 不同深度学习方法的对比 Table 1 Comparisons of different deep learning methods |

|

图 3 不同深度学习方法的3D重建效果 Figure 3 Comparisons of 3D reconstruction via different deep learning methods |

由表2消融实验可以得到,相较于二阶段网络,原始端到端级联网络的DICE相似度系数和IOU分别提升0.0062和0.0094。而将损失函数改进成插值损失+交叉熵结合Dice损失以后,DICE相似度系数和IOU分别提升0.0101和0.0164。通过引入ConvLSTM来关联2张真实切片的肝胆管高维特征信息,使得DICE和IOU分别提升0.0284和0.0315。因此,本文改进的损失函数能够同时优化2个子网络,并缓解肝胆管与背景比例不平衡问题,而且通过在高维特征中引入ConvLSTM来获取相邻切片中肝胆管的关联性和肝胆管与周围组织不同的全局信息来进一步提升分割效果。

| 表 2 消融实验 Table 2 Ablation experiments |

针对低密度螺旋CT扫描设备获取到层间分辨率低的肝胆管影像在后续分割及最终三维重建中出现的断裂不连续现象,本文提出了一种基于深度关联机制的肝胆管CT层间超分辨率分割网络,通过构建一个端到端的级联网络来进行肝胆管CT切片的插值和分割,同时在分割子网络中引入ConvLSTM机制来利用相邻切片的上下文信息进行特征学习。实验结果表明,相比于其他二阶段网络,本文方法可以较好地实现肝胆管超分辨率分割和重建。

未来的工作需要考虑的是:(1) 根据具体扫描获得病例影像的实际情况来设置网络动态调整层间插值的切片数,使得三维重建出来的肝胆管更加符合医学需求。(2) 由于患者隐私等问题,数据集的收集相对有限,标注数据集所涉及的工作量进一步限制了模型的泛化能力。未来,将与合作单位密切沟通,以获取更多数据集,用于本文模型的训练。

| [1] |

PEREIRA-LIMA J C, JAKOBS R, WINTER U H, et al. Long-term results (7 to 10 years) of endoscopic papillotomy for choledocholithiasis. Multivariate analysis of prognostic factors for the recurrence of biliary symptoms[J].

Gastrointestinal Endoscopy, 1998, 48(5): 457-464.

DOI: 10.1016/S0016-5107(98)70085-9. |

| [2] |

UENO N, OZAWA Y, AIZAWA T. Prognostic factors for recurrence of bile duct stones after endoscopic treatment by sphincter dilation[J].

Gastrointestinal Endoscopy, 2003, 58(3): 336-340.

DOI: 10.1067/S0016-5107(03)00004-X. |

| [3] |

李江, 刘斌. 肝胆管结石初始外科治疗的规范化研究[J].

临床肝胆病杂志, 2015, 31(10): 1612-1614.

LI J, LIU B. More attention to initial surgical treatment of hepatolithiasis[J]. Journal of Clinical Hepatol, 2015, 31(10): 1612-1614. |

| [4] |

王平, 刘成成, 陶海粟, 等. 经皮肝Ⅰ期胆道造瘘取石治疗有胆道手术史患者的肝内胆管结石[J].

中华肝胆外科杂志, 2019, 25(2): 106-110.

WANG P, LIU C C, TAO H S, et al. Percutaneous transhepatic one-step biliary fistulation for patients with hepatolithiasis and hepatobiliary surgery history[J]. Chinese Journal of Hepatobiliary Surgery, 2019, 25(2): 106-110. |

| [5] |

NAKAGAWA Y, ROSENFELD A. Some experiments on variable thresholding[J].

Pattern Recognition, 1979, 11(3): 191-204.

DOI: 10.1016/0031-3203(79)90006-2. |

| [6] |

MORE M D, ANDURKAR G K. Edge detection techniques: a comparative approach[J].

World Journal of Science and Technology, 2012, 2(4): 142-145.

|

| [7] |

ZENG Y, LIAO S, TANG P, et al. Automatic liver vessel segmentation using 3D region growing and hybrid active contour model[J].

Computers in Biology and Medicine, 2018, 97: 63-73.

DOI: 10.1016/j.compbiomed.2018.04.014. |

| [8] |

SHEN D, WU G, SUK H I. Deep learning in medical image analysis[J].

Annual Review of Biomedical Engineering, 2017, 19(5): 221-248.

|

| [9] |

FU X, CAI N, HUANG K, et al. M-net: a novel U-net with multi-stream feature fusion and multi-scale dilated convolutions for bile ducts and hepatolith segmentation[J].

IEEE Access, 2019, 7: 148645-148657.

DOI: 10.1109/ACCESS.2019.2946582. |

| [10] |

RONNEBERGER O, FISCHER P, BROX T. U-net: convolutional networks for biomedical image segmentation[C]//Medical Image Computing and Computer-Assisted Intervention. Munich: MICCAI, 2015: 234-241.

|

| [11] |

陈芝涛. 基于多尺度上下文特征学习的胆管及胆结石图像分割[J].

现代计算机, 2021, 27(25): 74-78.

CHEN Z T. Bile ducts and hepatoliths segmentation via multi-scale context feature learning[J]. Modern Computer, 2021, 27(25): 74-78. |

| [12] |

KITRUNGROTSAKUL T, HAN X H, IWAMOTO Y, et al. VesselNet: a deep convolutional neural network with multi pathways for robust hepatic vessel segmentation[J].

Computerized Medical Imaging and Graphics, 2019, 75: 74-83.

DOI: 10.1016/j.compmedimag.2019.05.002. |

| [13] |

YAN Q, WANG B, ZHANG W, et al. Attention-guided deep neural network with multi-scale feature fusion for liver vessel segmentation[J].

IEEE Journal of Biomedical and Health Informatics, 2020, 25(7): 2629-2642.

|

| [14] |

SU J, LIU Z, ZHANG J, et al. DV-Net: accurate liver vessel segmentation via dense connection model with D-BCE loss function[J].

Knowledge-Based Systems, 2021, 232: 107471.

DOI: 10.1016/j.knosys.2021.107471. |

| [15] |

HAO W, ZHANG J, SU J, et al. HPM-Net: hierarchical progressive multiscale network for liver vessel segmentation in CT images[J].

Computer Methods and Programs in Biomedicine, 2022, 224: 107003.

DOI: 10.1016/j.cmpb.2022.107003. |

| [16] |

杨柳, 李德玉, 何爱军, 等. 医学图像多维重建中的插值问题研究进展[J].

生物医学工程学杂志, 2003(4): 728-732.

YANG L, LI D Y, HE A J, et al. A review of interpolation in multi-dimensional reconstruction of medical images[J]. Journal of Biomedical Engineering, 2003(4): 728-732. |

| [17] |

闫芳. 医学影像重建算法研究及应用[D]. 济南: 山东师范大学, 2021.

|

| [18] |

NIKLAUS S, MAI L, LIU F. Video frame interpolation via adaptive separable convolution[C]//IEEE/CVF International Conference on Computer Vision (ICCV) . Venice: IEEE, 2017: 261-270.

|

| [19] |

JIANG H, SUN D, JAMPANI V, et al. Super slomo: high quality estimation of multiple intermediate frames for video interpolation[C]// IEEE Conference on Computer Vision and Pattern Recognition (CVPR) . Salt Lake City: IEEE, 2018: 9000-9008.

|

| [20] |

LU L, WU R, LIN H, et al. Video frame interpolation with transformer[C]//IEEE Conference on Computer Vision and Pattern Recognition (CVPR) . New Orleans: IEEE, 2022: 3532-3542.

|

| [21] |

LUO Y, PAN J, TANG J. Bi-directional pseudo-three-dimensional network for video frame interpolation[J].

IEEE Transactions on Image Processing, 2022, 31: 6773-6788.

DOI: 10.1109/TIP.2022.3215911. |

| [22] |

OKTAY O, SCHLEMPER J, FOLGOC L L, et al. Attention u-net: learning where to look for the pancreas[EB/OL]. (2018-05-20) [2022-12-26].https://doi.org/10.48550/arXiv.1804.03999.

|

| [23] |

ZHOU Z, SIDDIQUEE M M R, TAJBAKHSH N, et al. Unet++: redesigning skip connections to exploit multiscale features in image segmentation[J].

IEEE Transactions on Medical Imaging, 2019, 39(6): 1856-1867.

|

| [24] |

CAO H, WANG Y, CHEN J, et al. Swin-unet: unet-like pure transformer for medical image segmentation[EB/OL]. (2021-05-12) [2022-12-26]. https://doi.org/10.48550/arXiv.2105.05537.

|

2023, Vol. 40

2023, Vol. 40