作为锂电池的关键组成之一,极片在生产过程中受各种因素影响,可能会出现压痕、突起、撕裂和金属材料污染等缺陷,这些缺陷将对电池性能产生极大影响[1]。因此,准确检测出极片表面的缺陷类别并定位是保障锂电池性能和安全性的重要环节。

传统的人工检测方法由于效率低、人为因素影响较大等问题,不能满足现代化企业的生产需求。稳定且迅速的机器视觉检测的出现,很好地解决了人工检测的不足,且不会对产品造成二次损伤,打开了工业智能化检测的大门[2]。但也存在环境因素影响较大、特征提取成本高、难以用一种算法处理全部缺陷等局限性[3]。

深度学习可以自动从图像、视频或文本等样本数据中学习表征,从而调整网络模型的权重参数,实现自动提取目标表征的效果[4]。优秀的学习能力和鲁棒性,使其能够胜任缺陷检测问题。2012年ImageNet竞赛获胜者Hinton和他的学生Alex Krizhevsky设计了深度学习网络AlexNet,让深度学习开发热浪席卷全球[5],在那之后更多的优秀神经网络被提出。周佳禾等[6]先是将卷积神经网络与支持向量机结合,高效准确地对电池电极缺陷进行提取,但仅能识别区域内有无缺陷,属于二分类检测;然后又提出了一种方形卷绕式锂电池电极褶皱的检测方法,但不足的是该方法仅针对一种类型的缺陷[7]。黄梦涛等[8]提出了一种基于改进Canny算子的锂电池极片表面缺陷检测方法,能有效抑制虚假边缘,提取真实目标区域,但仍存在定位精度不足、研究样本类别少的问题。张旭[9]针对铝型材数据集的小缺陷召回率较低的问题,提出了一种改进Yolov3网络,有效提高了召回率。

目前,在锂电池极片表面缺陷检测中运用深度学习的参考资料较少,特别是对缺陷进行语义分割检测的研究更少。因此,本文针对像素分割级检测问题,提出一种对Unet结构进行多步优化以提升其分割精度的方法。首先构建缺陷数据集,然后根据应用领域对Unet网络结构进行相应调整优化,以适应工业级分割检测任务。最后通过实验验证调整优化后的模型,得到适合缺陷检测的Unet分割网络。

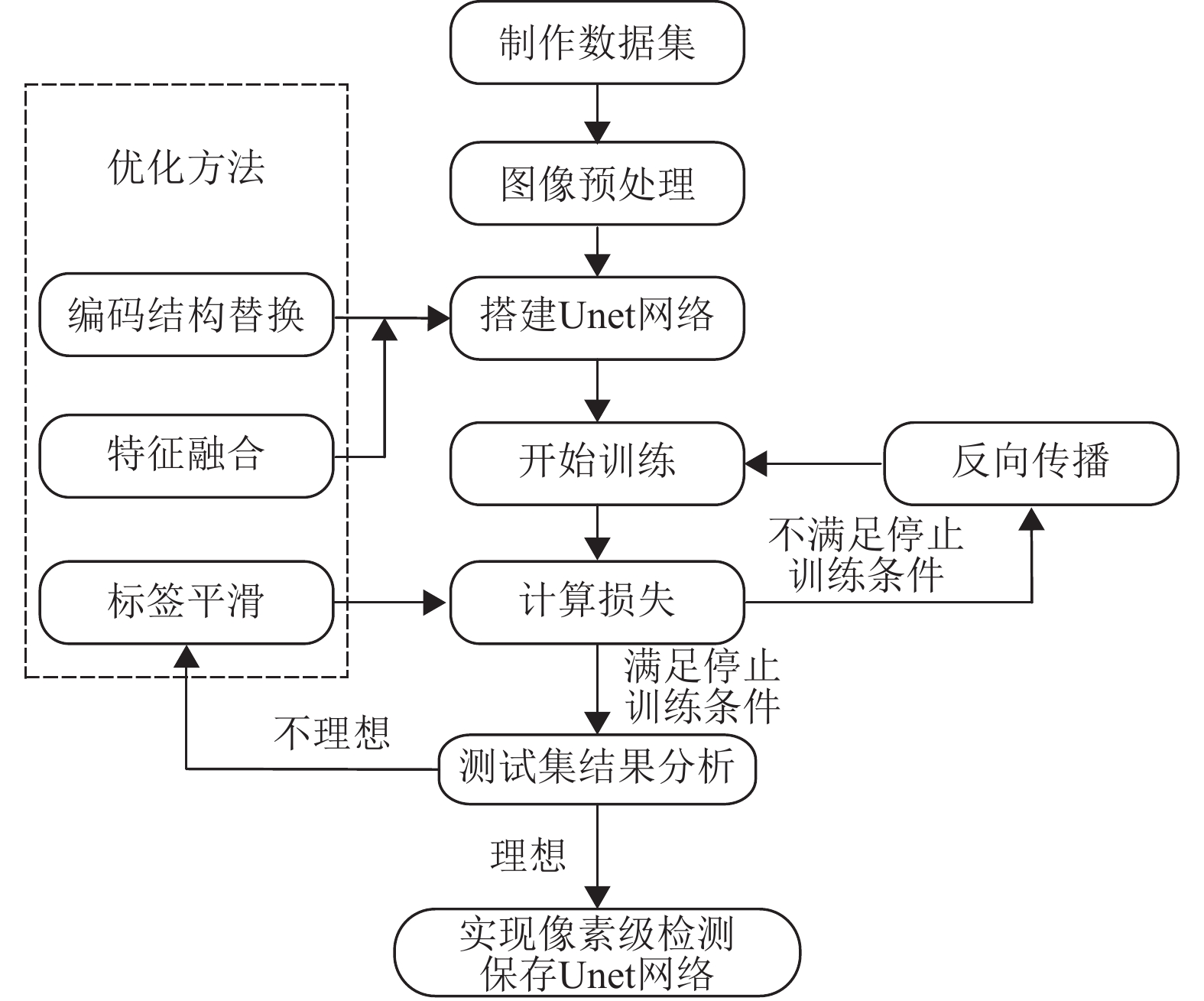

1 技术路线使用原始Unet网络对缺陷进行分割,会出现少量的误分割、分割不连续等现象,为降低上述问题出现的概率,提升分割效果可信度,本文设计了语义分割技术路线流程,如图1所示。

|

图 1 语义分割技术路线流程 Figure 1 Semantic segmentation technology route process |

在图1的技术路线流程中,训练前需要先制作数据集并对数据集图像进行预处理;然后搭建Unet网络。由于Unet网络使用的编码结构缺乏可迁移权重参数且跳跃连接处语义信息差异较大,本文提出采用编码结构替换和特征融合2种方式对网络结构进行优化,并在计算损失函数时采用标签平滑方法进行优化。3个优化阶段均需要经过开始训练、损失计算、反向传播3个步骤的循环过程直至满足停止训练的条件后退出循环。对测试集结果进行分析,得到当前阶段理想的Unet语义分割网络并进入下一阶段优化。对3个优化阶段实验结果进行分析,最终确定最佳优化方案。

2 数据集制作本文数据集的制作过程可分为3步:数据标注、数据增强[10]、数据集划分。在目标检测网络训练中,需要对原始图片进行人为标注以获得检测所需标签。本文采用labelem软件进行标注,标签输出格式为json。深度学习网络训练需要足够的样本,本文所研究的训练集有缺陷的图片只有540张,属于少样本数据集,需先进行数据增强操作增加样本数量。首先将有缺陷图片和无缺陷图片按适当权重相加融合,再把得到的新缺陷图片进行翻转或镜像,最后修改原有标签的坐标信息。经过上述步骤,数据集总量达到2080张。最后将数据集按训练集、验证集和测试集3:1:1的比例分配。

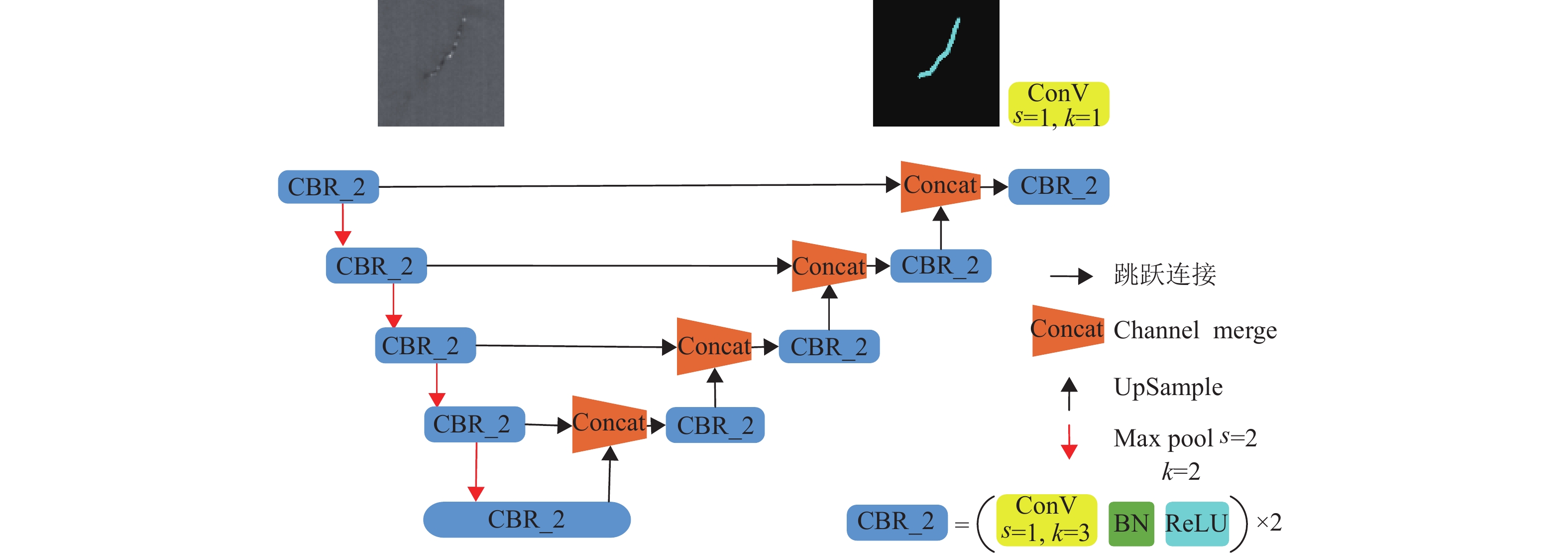

3 Unet语义分割网络结构及优化 3.1 Unet语义分割网络结构Unet网络主要由编码器、解码器以及跳跃连接3部分组成,其结构图如图2所示。Unet网络形状类似U型,左侧部分通过卷积和下采样操作提取一些浅显特征,右侧部分通过卷积和上采样操作提取深层次特征。中间通过Concat的方式,将上述2种特征结合起来获得特征图,并根据特征图进行预测分割。因其结构简单、高效,常被用于小样本数据集的研究。

|

图 2 Unet网络结构 Figure 2 Unet network structure |

Unet发表于2015年,是全卷积神经网络的一种变体。最初用于生物医学图像例如细胞的分割检测,其分割效果很好,被各领域借鉴。但在本文研究中存在如下问题:(1) 在工业缺陷检测领域中,对其优化研究较少,难以对其编码结构的权重参数进行迁移学习;(2) 另外Unet网络的跳跃连接采用Concat方法,在得到一定提升的同时也导致了输入信息之间关联性较弱;(3) 不同缺陷标签之间可能存在相似性,但在网络学习中不同标签之间的关联性经常会被忽略,模型在预测时,目标标签的概率接近1,非目标标签的概率接近0。导致训练出来的模型过于“武断”,泛用性降低。本文针对3点不足,依次对Unet网络结构进行优化。

3.2.1 编码结构的选择为解决上述问题(1),选择表现优异的分类网络如VGG16[11]、MobileNetV2[12]、ResNet34和ResNet50[13],分别用来替换原编码结构,并将相应的预训练模型参数迁移到Unet,可以尽可能加速训练,并且不需要大量数据就能使网络性能提升。

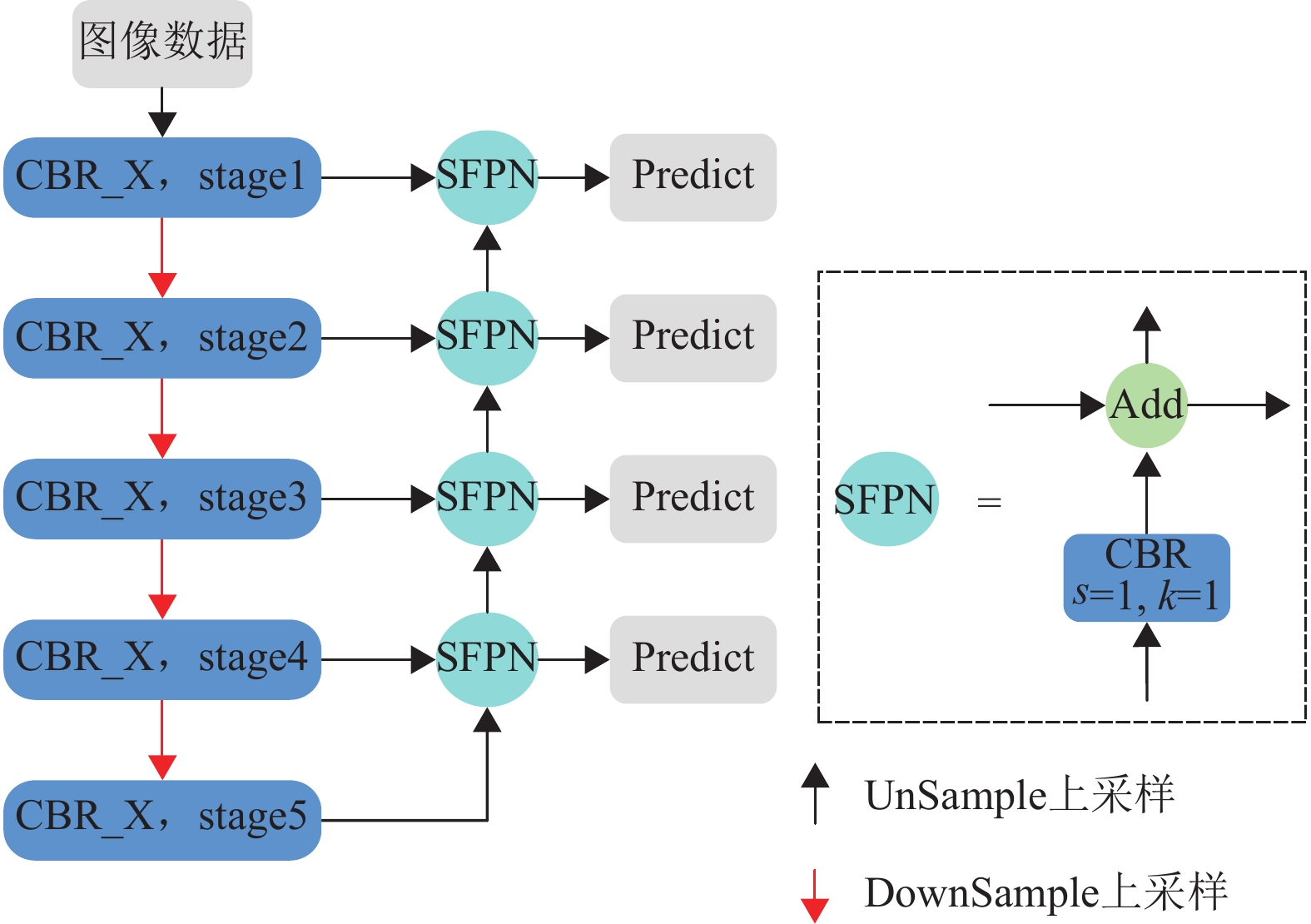

3.2.2 SFPN特征融合针对上述问题(2),在Unet跳跃连接部分加入特征金字塔网络(Feature Pyramid Networks,FPN)对编码结构的多个尺度特征图的信息进行融合[14],降低信息之间差异性,但FPN存在结构复杂、计算量大等问题。针对这点问题,本文参考FPN网络结构,提出一种更加简易的特征融合模块 (Simply Fusion Pyramid Network, SFPN)。如图3所示,SFPN既保留了FPN中适合特征融合的金字塔网络结构,又简化了原有的复杂模块。将SFPN加入网络如图4所示,图中SFPN对跳跃连接输入信息进行处理,以有效获得更多特征图信息,达到优化分割的效果。

|

图 3 SFPN网络结构 Figure 3 SFPN network structure |

|

图 4 VGG_SFPN_Unet网络结构 Figure 4 VGG_SFPN_Unet network structure |

针对上述问题(3),运用标签平滑方法可以有效提升Unet网络模型的泛化能力,标签平滑是损失函数的一种修正,可以提高网络分类准确性。其计算如式(1)所示。

| $ \widehat y_i{'} = (1 - \varepsilon ) \widehat {{y_{{i}}}} + \varepsilon /n $ | (1) |

式中:

本文所进行实验的计算机主要配置如表1所示。实验时使用Pytorch框架,代码使用python3.7编写。

| 表 1 计算机主要配置 Table 1 Computer main configuration |

本文损失函数选用交叉熵损失函数,替换的编码结构的权重迁移参数均为该模型在ImageNet数据集[15]上训练产生的,其余权重参数均源自Kaiming初始化;批参数为4;初始学习率为0.001,每经历一次迭代衰减5%;使用Adam优化算法;最大 Epoch设置200。设置最大冻结Epoch为40。

为防止网络变得过拟合,本文采取提前终止(Early stop)方法来预防,最大忍耐Epoch设为20。即当发现验证集上某个Epoch后20个Epoch内无一mIoU值高于该Epoch时,终止训练。

4.3 评价指标语义分割中,采用召回率(Recall)、准确率(Precision)和平均交并比(mIoU)作为评价指标。其中,平均交并比mIoU越高,说明预测值与真实值越接近,分割效果也就越好。此外还记录了网络模型分割测试集图片所用时间。这3个指标的计算如式(2)所示。

| $ \begin{split} &\qquad {\text{Recall}} =\frac{{{p_{ii}}}}{{\displaystyle\sum\limits_{j = 1}^n {{p_{ij}} + {p_{ii}}} }}, \\ &\qquad \Pr {\text{ecision}} = \frac{{{p_{ii}}}}{{\displaystyle\sum\limits_{j = 1}^n {{p_{ji}} + {p_{ii}}} }} , \\ & {\text{mIoU}} = \frac{1}{n}\displaystyle\sum\limits_{i = 1}^n {\frac{{{p_{ii}}}}{{\displaystyle\sum\limits_{j = 1}^n {{p_{ij}} + } \displaystyle\sum\limits_{j = 1}^n {{p_{ji}} - {p_{ii}}} }}} \\[-15pt] \end{split} $ | (2) |

式中:

当评价指标召回率和准确率出现矛盾现象:即召回率上升而准确率下降或召回率下降而准确率上升,且两者变化幅度相近,无法直接通过召回率和准确率判断是否发生优化时,可采用F1分数来评价分割效果。F1分数是衡量分类模型精确度的一种指标,同时兼顾了分割结果的准确率和召回率,其计算如式(3)所示。

| ${F_1} = \frac{{2PR}}{{P + R}}$ | (3) |

式中:P为准确率,R为召回率。

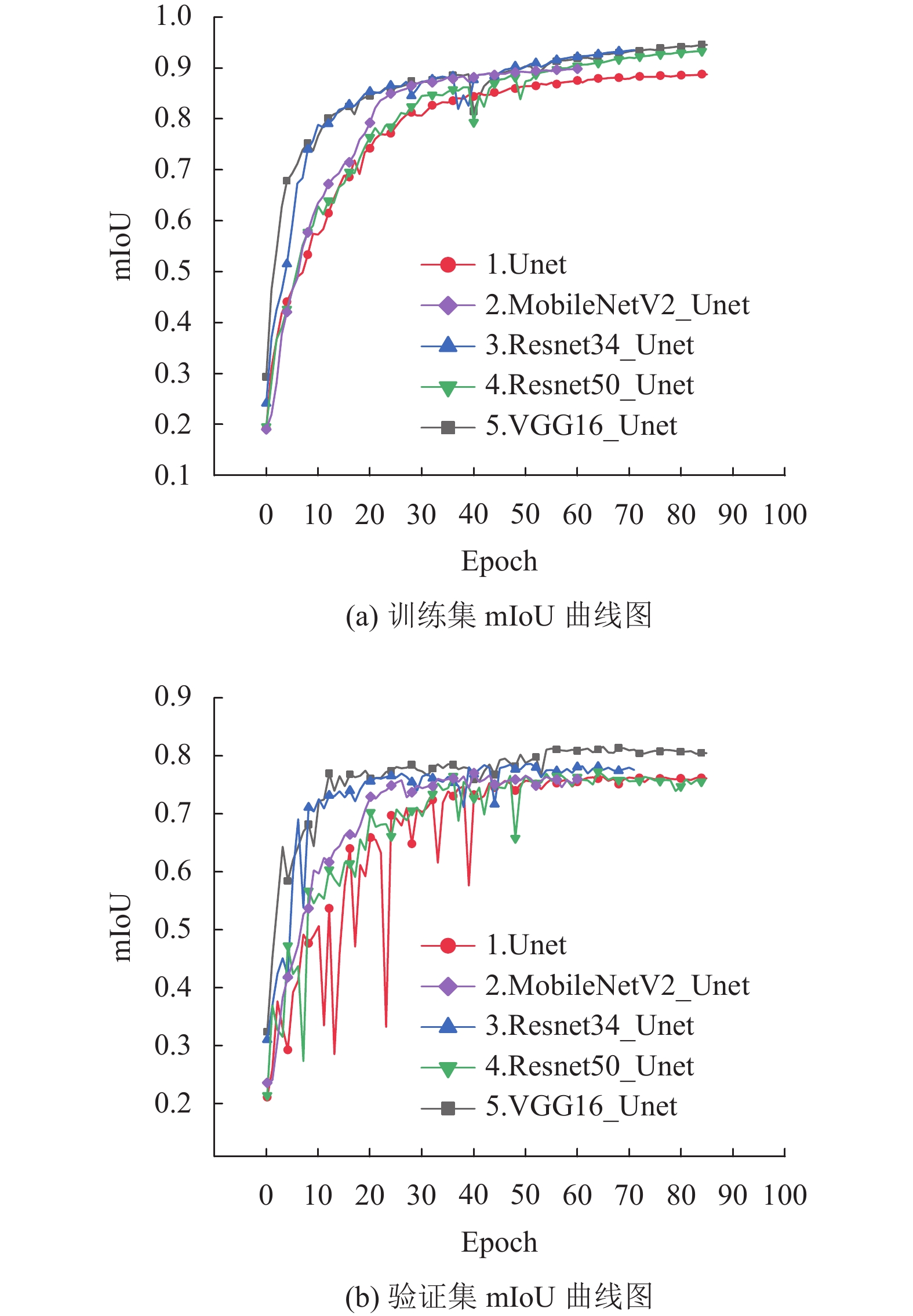

4.4 实验结果分析 4.4.1 编码器网络结构优化第1阶段实验分别用4种不同的编码结构替换Unet编码结构,目的是选出其中分割效果更好的编码结构,共5组实验,分别为Unet、MobileNetV2 _Unet、Resnet34_Unet、Resnet50_ Unet、VGG16_Unet,对应的实验序号为1、2、3、4、5。

实验结果如图5所示。可以看出无论在训练集还是验证集中,实验5的分割效果都是最好的,其mIoU在图5(a)中收敛在93.73%~94.55%,在图5(b)中收敛在80.78%~81.58%,其次分别是实验3、实验4、实验2,实验1效果最差。

|

图 5 编码结构实验mIoU曲线图 Figure 5 Experimental mIoU curve of coding structure |

在测试集上进行精度测试,实验结果如表2所示。综合来看,实验2、3的检测时间有所缩减,但其他指标提升均不如实验5明显,故选择用VGG16_net替换Unet的编码结构。

| 表 2 不同编码结构的实验结果 Table 2 Experimental results of different coding structures |

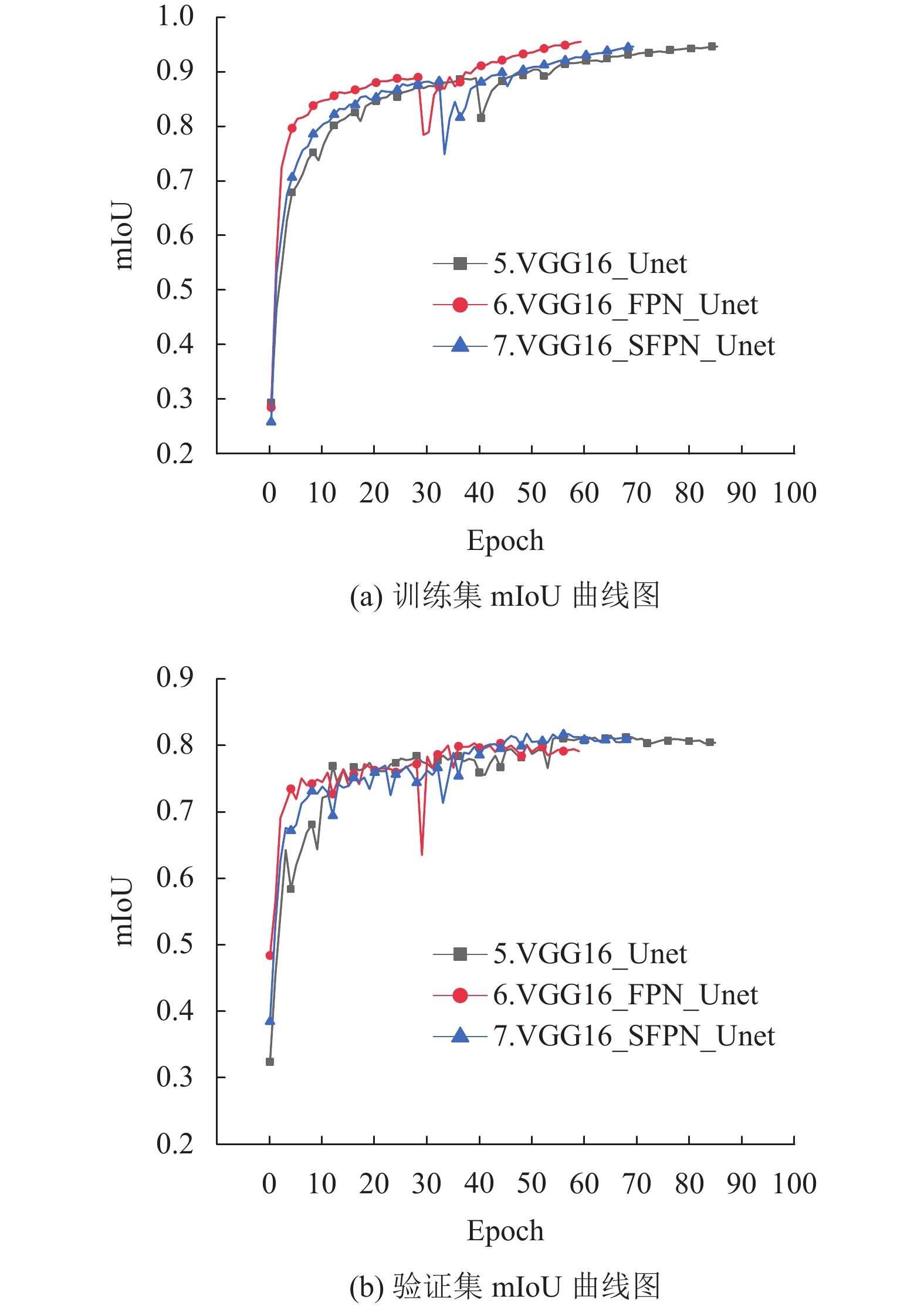

第2阶段实验在实验5上分别加入FPN和SFPN模块来进行优化,为下一阶段试验选出分割性能更好的网络,分别为实验6:VGG16_FPN_Unet和实验7:VGG16_SFPN_Unet。实验结果如图6所示。

|

图 6 特征融合实验mIoU曲线图 Figure 6 Experimental results of feature fusion |

由图6可看出,实验6在训练集中表现最佳,mIoU值相较于实验5有所提升,但幅度不大;但在验证集中,实验6最终的mIoU值相较于实验5反而有所下降,出现过拟合现象。实验7在训练集和验证集中的分割效果均与实验5无明显区别。

现使用测试集测试这3个网络,测试结果如表3所示。由于实验6和实验7的准确率和召回率出现矛盾现象,需要计算它们的F1值,由表3可以看出,实验6的召回率、mIoU检测速度都有所下降,F1值也下降,且精度上升不大,发生了过拟合,故舍弃;实验7在召回率和mIoU值上均有提升,准确率下降,但F1值提高了。说明SFPN在损失一点精度的条件下,预测出目标像素,预测出的缺陷形状也越接近真实,是一种正向提升。

| 表 3 特征融合的实验结果 Table 3 Experimental results of feature fusion |

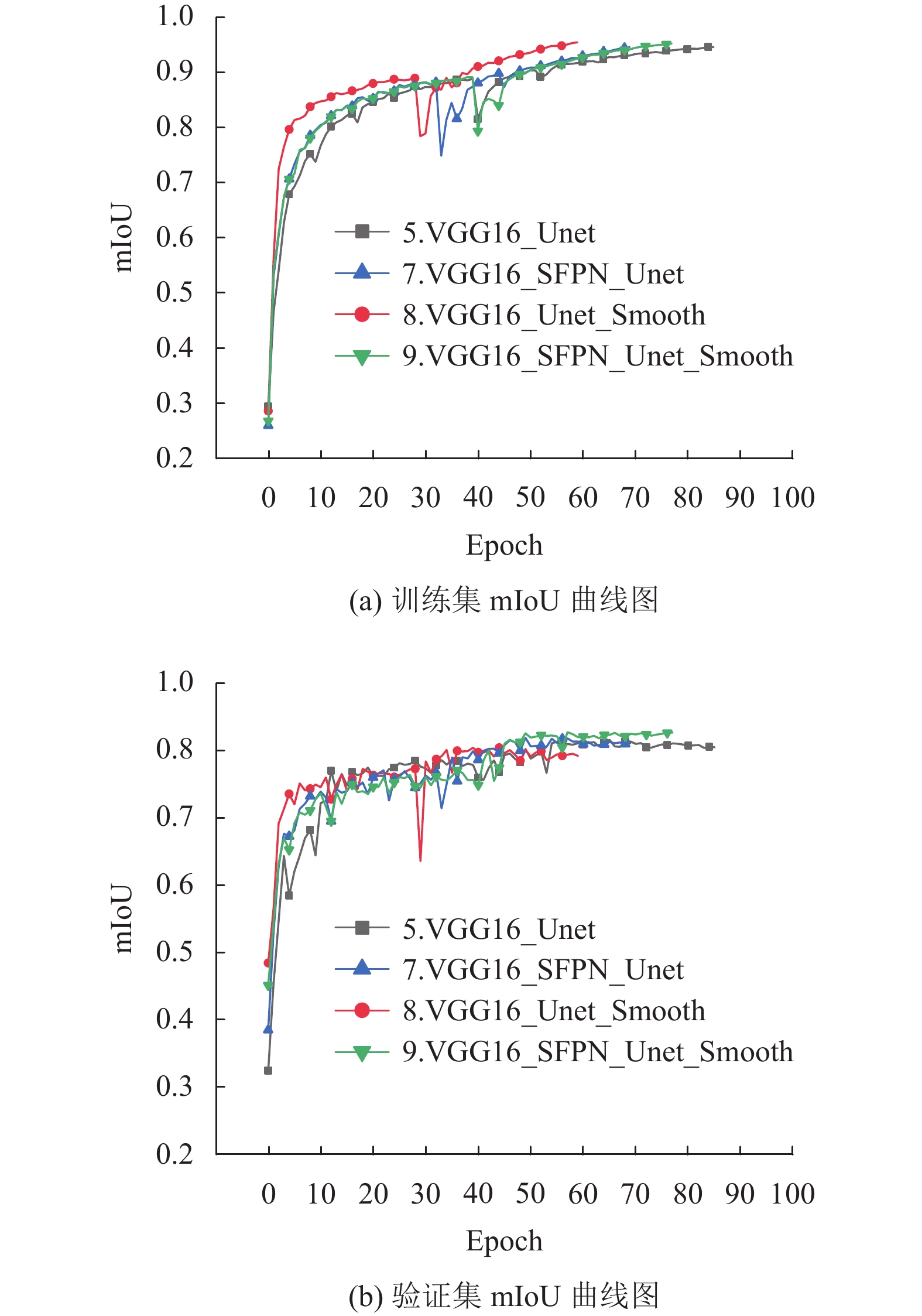

为防止网络泛化性降低,第3阶段实验使用标签平滑方法来修正交叉熵损失函数。在实验5和实验7基础上加入标签平滑操作,共进行了2组实验,分别是实验8:VGG16_Unet_Smooth 和实验9:VGG16_SFPN_Unet_Smooth。实验结果如图7。

|

图 7 标签平滑实验mIoU曲线图 Figure 7 Experimental mIoU curve of label smoothing |

从图7(a)来看,经过标签平滑操作,两组网络的特征提取能力都有所提升。从图7(b)来看,第1组实验泛化能力有所下降,下降了0.86%;第2组实验,泛化能力得到了提高,提升了0.83%。

由图可看出实验9整体效果最佳;实验8在验证集上效果不如实验5。现使用测试集进行测试,如表4所示。与实验5相比,实验8召回率和mIoU都有所下降,准确率略微上升,检测时间两者近似;与实验7相比,实验9全部指标数据均有提升,检测时间两者近似,并且实验9的精度指标均高于实验8。

| 表 4 标签平滑的实验结果 Table 4 Experimental results of label smoothing |

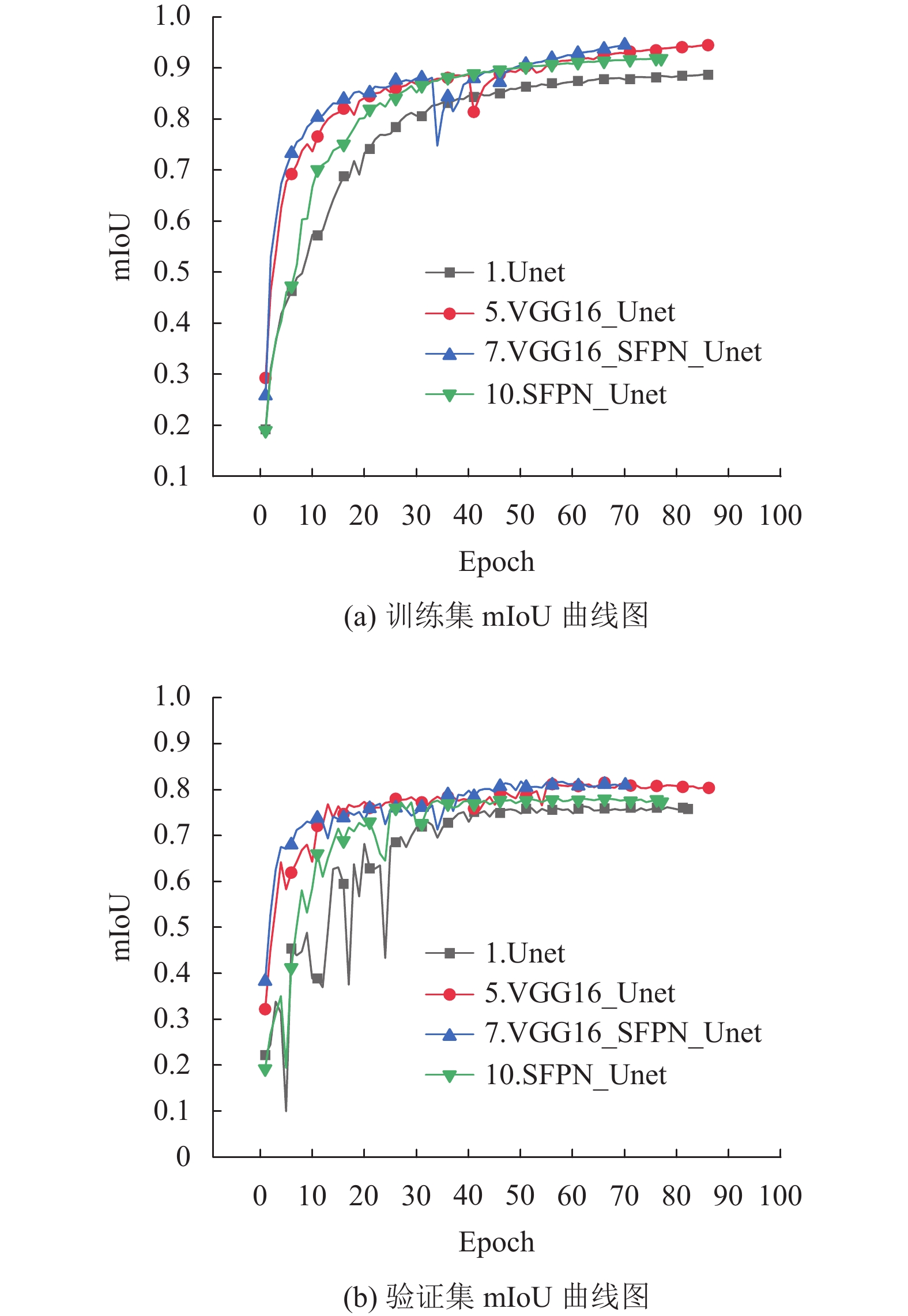

在本节中,对所提出的优化方法进行消融实验。其中,第1阶段用VGG16的编码结构替换原编码结构,第2阶段对跳跃连接处进行SFPN特征融合操作,均为对Unet网络结构的修改,须进行消融实验验证,故设立对照实验10 SFPN_Unet,与实验1、5、7组成消融实验组一。实验结果如图8所示。由图8可以看出,在验证集和训练集中,实验10相较于实验1,mIoU值均有提升;在训练集中,实验7效果最好;在验证集中,实验7的mIoU值高于实验10,同时,在4.4.2小节结论中已经说明实验7相对于实验5有正向提升。得出结论,单独进行前两阶段优化操作均可提高模型分割效果。两者结合优化效果更佳。

|

图 8 消融实验一 Figure 8 Ablation experiment one |

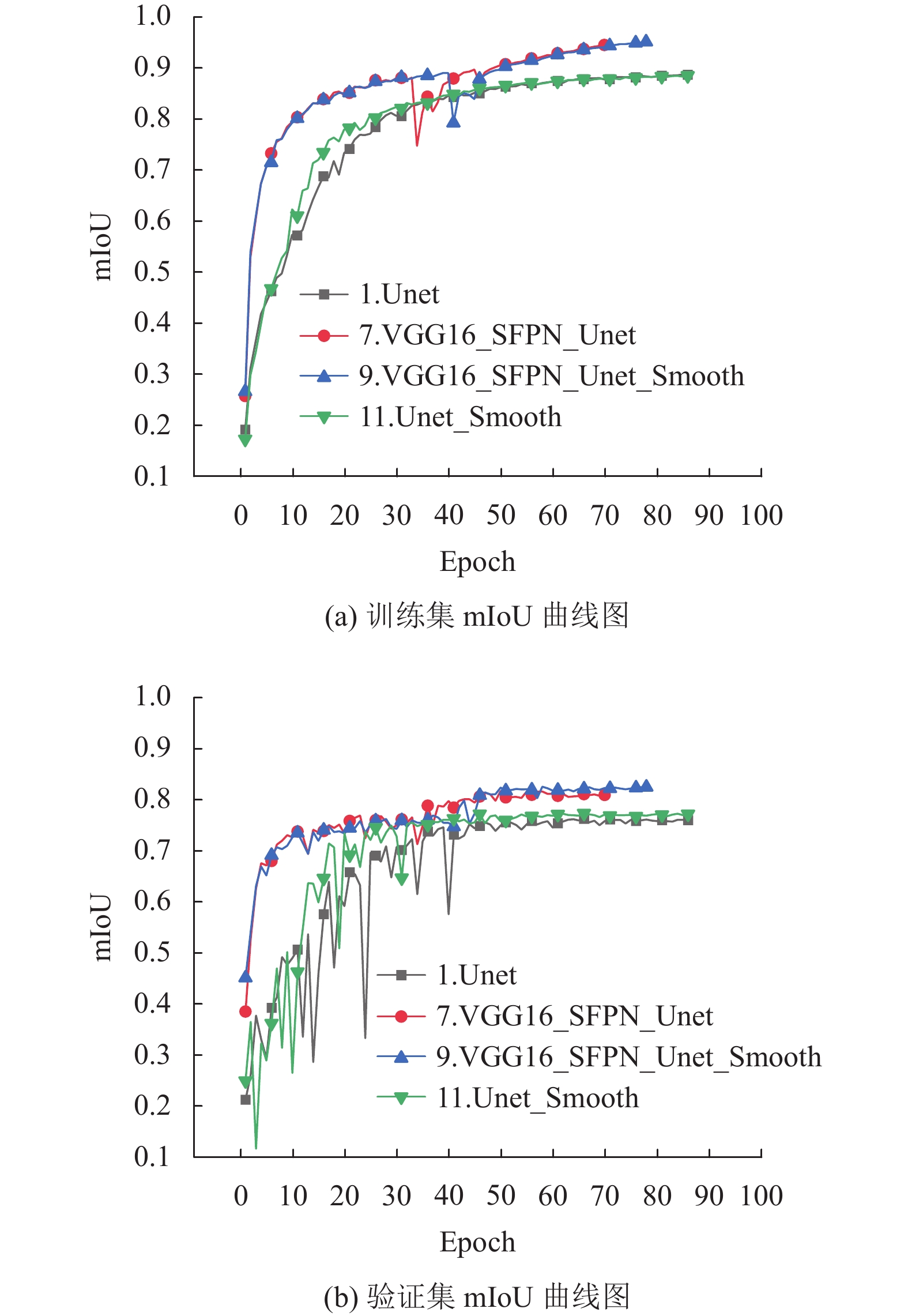

第3阶段优化实验采用标签平滑的方法修正损失函数。设置实验11 Unet_Smooth,与实验1、7、9组成消融实验二。由图9可以看出实验11在训练集中与实验1效果相近,但在验证集中实验11 mIoU值更高,说明标签平滑操作能有效抑制过拟合现象;经过3阶段优化得到的分割网络表现最佳,说明3步优化操作共同作用,分割效果最佳。

|

图 9 消融实验二 Figure 9 Ablation experiment two |

表5展示了各个阶段中表现最好的实验5、实验7和实验9的精度值。与实验1对比,实验5、7、9均有正向提升,实验9检测时间仅增加了0.51 s,3个精度指标数据分别提升了5.46%,4.23%和7.26%,提升效果显著。

| 表 5 各个阶段的实验结果汇总 Table 5 The experimental results of each stage |

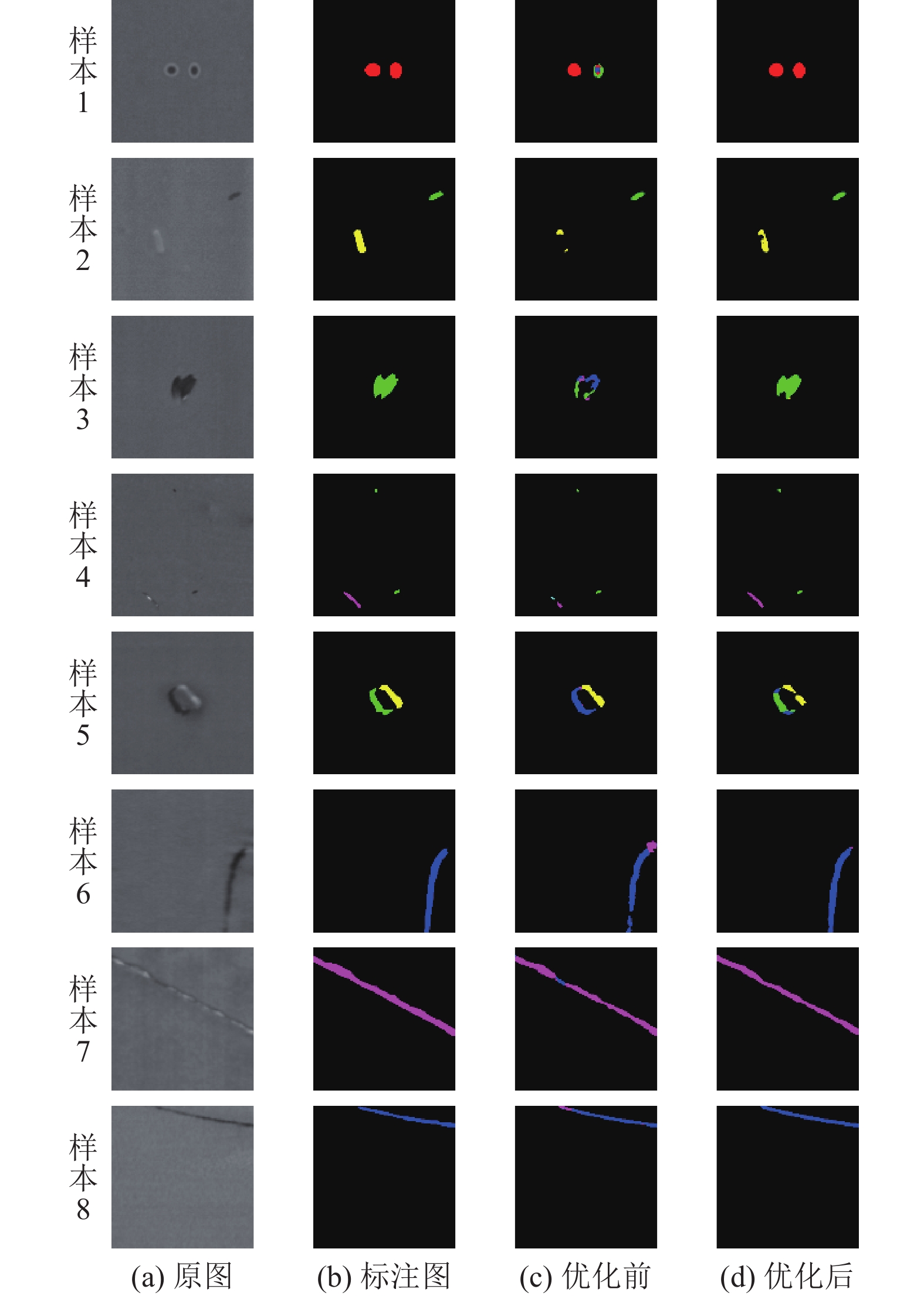

用实验1训练的模型和实验9训练的模型对缺陷样本进行分割,分割效果如图10所示。从图中可看出优化前模型的分割结果存在较为明显漏检、错检现象,优化后模型的分割结果与标注图近似,优化效果显著。

|

图 10 优化前后分割效果对比图 Figure 10 Comparison diagram of segmentation effect before and after optimization |

锂电池极片表面缺陷检测问题长期制约相关产业发展,传统的检测方法无法实现快速、准确的检测,本文提出了一种基于改进Unet网络的锂电池极片表面缺陷检测方法。使用VGG16替换原Unet编码结构;在跳跃连接处增加SFPN特征融合模块;在前两项优化基础上再对语义分割网络的损失函数采用标签平衡来修正平滑。实验结果表明,该方法可以更准确、高效地完成极片表面缺陷的像素级分割检测。

| [1] |

王大为, 罗悦齐. 纯电动汽车发展面临的问题[J].

汽车文摘, 2019(8): 22-31.

WANG D W, LUO Y Q. Problems faced by electric vehicles[J]. Automotive Digest, 2019(8): 22-31. |

| [2] |

汤勃, 孔建益, 伍世虔. 机器视觉表面缺陷检测综述[J].

中国图象图形报, 2017, 22(12): 1640-1663.

TANG B, KONG J Y, WU S Q. Review of surface defect detection based on machine vision[J]. Journal of Image and Graphics, 2017, 22(12): 1640-1663. |

| [3] |

谢永杰, 智贺宁. 基于机器视觉的图像识别技术研究综述[J]. 科学技术创新, 2018 (7) : 74-75

|

| [4] |

吴凯, 杨新志. 浅述人工智能的深度学习[J]. 石河子科技, 2020 (6) : 44-45

|

| [5] |

KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[J].

Communications of the ACM, 2017, 60(6): .84-90.

DOI: 10.1145/3065386. |

| [6] |

周佳禾, 宫元九. 利用卷积神经网络检测锂电池电极缺陷[J]. 电子测量技术, 2019, 42(19) : 182-186.

ZHOU J H, GONG Y J, Detection of electrode defects in lithium batteries based on convolutional neural networks[J]. Electronic Measurement Technology, 2019, 42(19) : 182-186. |

| [7] |

周佳禾, 宫临凡, 王盛瑶. 方形卷绕式锂电池电极褶皱检测方法研究[J].

仪表技术与传感器, 2021(5): 107-111.

ZHOU J H, GONG L F, WANG S Y. Research on detection of electrode fold of spirally wound flattened lithium batteries[J]. Instrument Technique and Sensor, 2021(5): 107-111. |

| [8] |

黄梦涛, 连一鑫. 基于改进 Canny 算子的锂电池极片表面缺陷检测[J].

仪器仪表学报, 2021, 42(10): 199-209.

HUANG M T, LIAN Y X. Lithium battery electrode plate surface defect detection based on improved Canny operator[J]. Chinese Journal of Scientific Instrument, 2021, 42(10): 199-209. |

| [9] |

张旭. 基于深度卷积神经网络的铝材表面缺陷检测[D]. 上海: 华东理工大学, 2020.

|

| [10] |

章云, 王晓东. 基于受限样本的深度学习综述与思考[J].

广东工业大学学报, 2022, 39(5): 1-8.

ZHANG Y, WANG X D. A review and thinking of deep learning with a restricted number of samples[J]. Journal of Guangdong University of Technology, 2022, 39(5): 1-8. DOI: 10.12052/gdutxb.220092. |

| [11] |

ZEILER M D, FERGUS R. Visualizing and understanding convolutional networks[C]//Fleet D. European Conference on Computer Vision. Cham: Springer, 2014: 818-833.

|

| [12] |

SANDLER M, HOWARD A, ZHU M, et al. Mobilenetv2: inverted residuals and linear bottlenecks[C]//The IEEE Conference on Computer Vision and Pattern Recognition. Salt Lake City: IEEE, 2018: 4510-4520.

|

| [13] |

HE K, ZHANG X, REN S, et al. Deep residual learning for image recognition[C]// The IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas: IEEE, 2016: 770-778.

|

| [14] |

黄剑航, 王振友. 基于特征融合的深度学习目标检测算法研究[J].

广东工业大学学报, 2021, 38(4): 52-58.

HUANG J H, WANG Z Y. A research on deep learning object detection algorithm based on feature fusion.[J]. Journal of Guangdong University of Technology, 2021, 38(4): 52-58. |

| [15] |

DENG J, DONG W, SOCHER R, et al. Imagenet: a large-scale hierarchical image database[C]//2009 IEEE Conference On Computer Vision and Pattern Recognition. Miami, FL: IEEE, 2009: 248-255.

|

2023, Vol. 40

2023, Vol. 40