SAR图像有着丰富的纹理特征,同时也包含了大量无用因杂波而产生的噪声, 致使利用Hessian矩阵的方法进行SAR图像目标兴趣点的检测并不理想.目前,针对SAR图像目标检测基于恒虚警率的检测方法较为成熟和有效,其中,基于杂波的CFAR目标检测的方法在确定性分布情况下的CFAR目标检测方法[1-3]的适应性比较差.同时传统的SAR图像目标的匹配算法[4-5],旋转、对尺度缩放、小视角改变、亮度、噪声变化的鲁棒性并不理想,而点特征对这些图像条件的变化有较好的适应性.常用的特征点检测方法如Hessian-Laplace[6]、强角点检测[7]、SUSAN[8]、Harris角点检测[9]等,然而它们有个共同的缺点, 无法适应图像的尺度缩放,而且对于图像不同的尺度无法使特征点建立对应的关系.为此,提出基于改进SURF算法的SAR图像目标匹配,利用高斯混合模型能够平滑拟合任意形状密度分布的特点,对背景杂波的分布进行拟合,并用EM[10] (期望最大)算法进行参数估计,得到拟合后的近似分布模型进行CFAR目标兴趣区域检测,然后运用SURF[11-15]算子对SAR图像目标特征点进行提取,获得特征点后使用改进的多层剔除方法过滤误匹配点,进而能够得到SAR图像目标准确匹配.最后,通过仿真实验,分析了该方法的有效性和鲁棒性.

1 基于高斯混合模型的CFAR目标检测 1.1 CFAR基本原理CFAR检测技术的关键是确定自适应的阈值,假设:p(x)为雷达背景杂波分布模型的概率密度函数, Pfa为虚警率,T为阈值,则计算公式为

| $ {P_{{\rm{fa}}}} = \smallint _T^\infty p\left( x \right){\rm{d}}x, $ | (1) |

当Pfa固定,由阈值T作为判断点判断目标存否.

1.2 高斯混合模型及目标检测设一幅SAR图像中每个像素的幅值为xi,则该幅图像的杂波模型用高斯混合模型拟合为

| $ p\left( {{x_i}|\mathit{\Theta }} \right) = \sum\limits_{k = 1}^K {{w_k}{p_k}} ({x_i}|{\theta _i}), $ | (2) |

式中, wk是第k个混合分量的权值,Θ=(θ1, θ2, …, θk)是各混合分量的参数矢量,pk(xi|θi)是由θi=(ui,

| $ {P_{{\rm{fa}}}} = \smallint _T^\infty \sum\limits_{k = 1}^K {{w_k}{p_k}} \left( {{x_i}|{\theta _i}} \right){\rm{d}}x, $ | (3) |

其中

| $ {p_k}({x_i}|{\theta _i}) = \frac{1}{{\sqrt {2{\rm{ \mathit{ π} }}\delta _k^2} }}{\rm{exp}}\left[ { - \frac{{{{({x_i} - {u_k})}^2}}}{{2{\delta ^2}}}} \right]{\rm{, }} $ |

那么可以推出

| $ \begin{array}{l} N({w_1}{u_1} + {w_2}{u_2} + ... + {w_k}{u_k}, {({w_1}{\delta _1})^2} + {({w_2}{\delta _2})^2} + \\ \ldots + {({w_k}{\delta _k})^2}), \end{array} $ |

由此可得到检测阈值的解析式为

| $ \begin{array}{l} T = \sum\limits_{k = 1}^K {{w_k}{u_k}} + 2\sum\limits_{k = 1}^k {{{\left( {{w_k}{\delta _k}} \right)}^2}} \times \\ {\rm{erf}}{{\rm{c}}^{ - 1}}\left[ {\frac{{2{P_{{\rm{fa}}}}}}{{\sqrt {2\sum\limits_{k = 1}^k {{{\left( {{w_k}{\delta _k}} \right)}^2}} } }}} \right], \end{array} $ | (4) |

其中,

| $ \begin{array}{l} {\rm{erfc}}\left( m \right) = \frac{2}{{\rm{ \mathit{ π} }}}\smallint _m^\infty {{\rm{e}}^{ - y2}}{\rm{d}}(m = {\rm{ }}\frac{{K - \sum\limits_{k = 1}^K {{w_k}{u_k}} }}{{2\sum\limits_{k = 1}^k {{{\left( {{w_k}{\delta _k}} \right)}^2}} }}, 且\\ {y_i} = \frac{{{x_i} - \sum\limits_{k = 1}^K {{w_k}{u_k}} }}{{2\sum\limits_{k = 1}^k {{{\left( {{w_k}{\delta _k}} \right)}^2}} }}{\rm{), }} \end{array} $ |

uk、δk分别为第k个高斯混合模型分量的均值和方差, 可由EM(期望最大)算法对高斯混合模型迭代收敛后得到uk, δk参数估计.

由目标判决条件xi≥T为检测到目标,xi≥T为非目标.

2 改进SURF算子特征点提取及匹配对高斯混合模型CFAR分割得到的目标兴趣区域进行SURF算子特征点的提取与匹配分3步:(1)利用积分图像的SURF兴趣点的检测;(2)SURF兴趣点描述子的生成.(3)采用改进的多层剔除方法获得目标的准确匹配.

2.1 SURF兴趣点检测SURF算法的兴趣点检测利用Hessian矩阵的行列式判断图像上某点是否为极值点.对于图像中任意一点X =(x, y)T,Hessian矩阵H(x, δ)在X处以尺度δ定义:

| $ \pmb{H}\left( {X, \delta } \right) = \left[ \begin{array}{l} {L_{xx}}\left( {X, \delta } \right)\;\;\;\;{L_{xy}}\left( {X, \delta } \right)\\ {L_{xy}}\left( {X, \delta } \right)\;\;\;\;{L_{yy}}\left( {X, \delta } \right) \end{array} \right], $ | (5) |

其中Lxx(X, δ)为图像中点X与高斯二阶滤波

| $ {\rm{det}}\left( \pmb{H} \right) = {D_{xx}}{D_{yy}} - {({D_{xy}})^2}. $ | (6) |

如果det H < 0,即H的特征值异号,则点(x, y)不是局部极值点;若det H >0,即H的特征值同号,则点(x, y)被认为是极值点.

在提取特征点的过程中,对于每个特征点,将该点周围相同尺度的邻域内的8个点和相邻其他尺度的18个点构成一个3×3×3相邻的立体区域.用Hessian得到的极值点, 在这个立体邻域内把每个极值点与其不同和相同尺度邻域的其他26个点进行非极大值拟制, 只有此极值点比其他26个相邻点的值都大或都小时,才把这个极值点当作候选的特征点.然后在图像空间以及尺度空间中进行插值运算,得到比较稳定的尺度值δ和特征点位置,便可以根据邻域信息确定兴趣点的主方向和特征向量.

2.2 SURF兴趣点描述子的生成SURF兴趣点描述子主要是根据兴趣点邻域范围内的灰度统计信息,分为两步:主方向的确定以及描述子向量的构造,而这些都是在特征点所处的尺度δ上进行的.

把检测到的每一个特征点作为圆心, 在其周围建立以半径为6δ(δ为特征点的尺度值)的邻域, 计算邻域里的点在x、y方向上边长为4δ的Haar小波响应,从而得到一系列向量;然后计算π/3范围内的Haar小波响应的矢量的和(x和y两个方向),通过矢量和来选择最长向量的方向为特征点的主方向.

然后,根据主方向选取一个大小为20δ×20δ的窗口,并均匀地将其分成4×4个子区域.对每一个子区域,分别计算其主方向及其垂直方向上的Haar小波响应,记为dx和dy,对子窗口内系数累加构造四维V =(∑dx, ∑dy, ∑|dx|, ∑|dy|)向量,可以反映图像在该子区域的特性.因此,对应所有4×4个子区域共得到64个值,归一化后就构成特征点的SURF描述子.

2.3 多层剔除的特征点匹配多层剔除分为3个层次,首先,利用最大近邻向量匹配获得最原始的第1个层次的粗匹配.其次,利用第1个层次的粗配对,进行主方向角度差衡量,过滤误匹配,获得第2个层次的匹配.最后,使用随机抽样一致性把第2个层次的匹配对进行进一步的过滤,获得第3层次较为精确的匹配.

2.3.1 最大近邻向量匹配经SURF算子每个特征点可以用一个64维的向量表示,设S1、S2分别为两幅图像I1、I2通过SURF方法提取的特征点集合.对S1中的每一个特征点P1计算与S2中各个特征点的欧氏距离,得到最小及次小距离值分别为d1、d2,对应中的特征点分别为P2、P3.若d1/d2≤w (这里w取0.65),则认为P1与P2匹配否则丢弃.

2.3.2 主方向角度差衡量计算每对第1层次匹配对的主方向角度差,统计成直方图,取直方图中的最大值,由于各种因素的影响,每一对相匹,配的特征向量主方向不可能完全相同,存在一些误差,那么,在直方图的最大值处设置一个阀域,作为判别是否匹配的一个标准.这里设定直方图最大位置的15%区域作为判别范围,如果两个配对的特征向量主方向差处于这个范围,那么就认为是匹配对予以保留,否则,予以剔除.

2.3.3 RANSAC(随机抽样一致性)过滤误匹配点假设S是由第2层次获得的N对匹配点组成,在这里使用仿射变换模型,至少需要3对匹配点数据方可求出模型的参数.

第1步从S中随机选取3对不共线的匹配点样本,并由此计算得到变换矩阵H1;第2步对其余的N-3对样本,分别计算它们与模型H1之间的距离,同时记录在误差允许范围内的样本个数X;第3步重复上述两步K次,当X的值最大且大于预设闭值时,对应的内点集合即为最大内点域.(最大迭代次数

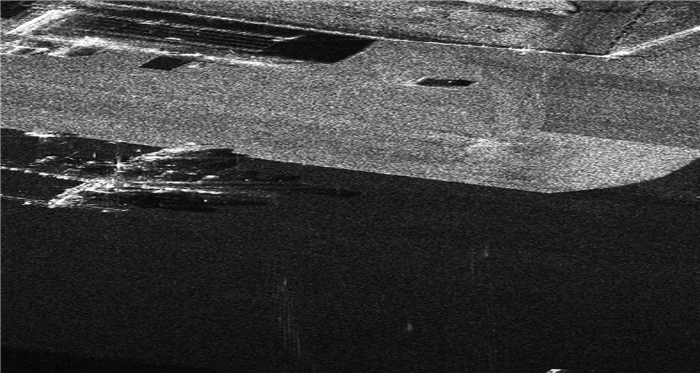

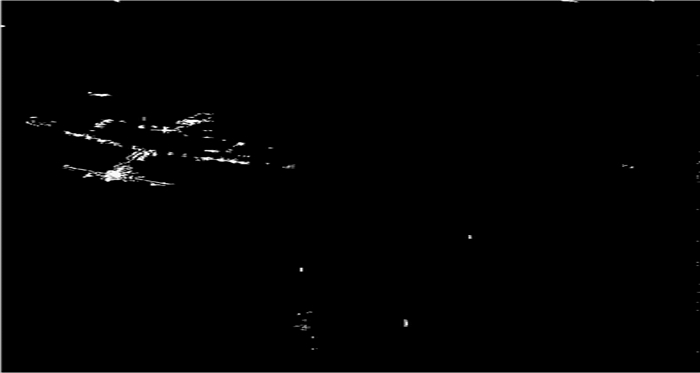

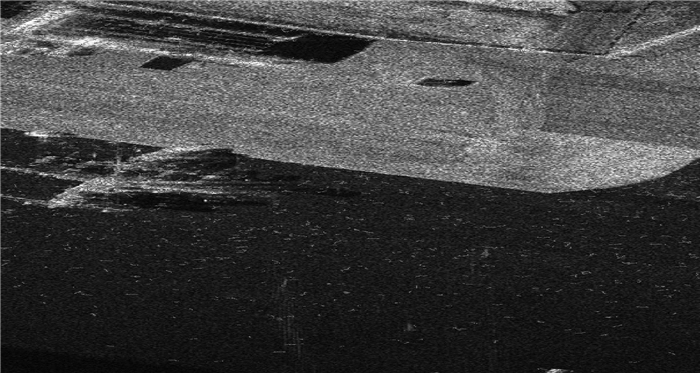

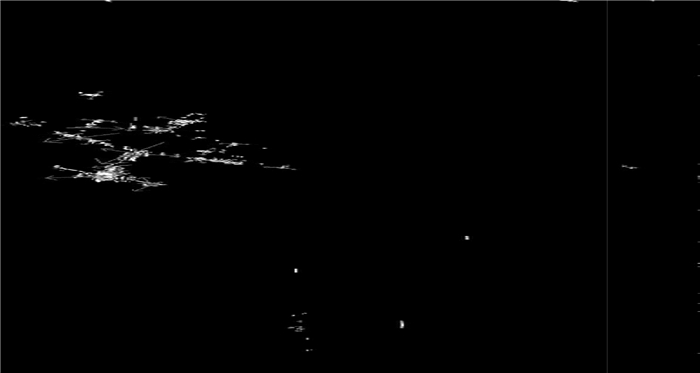

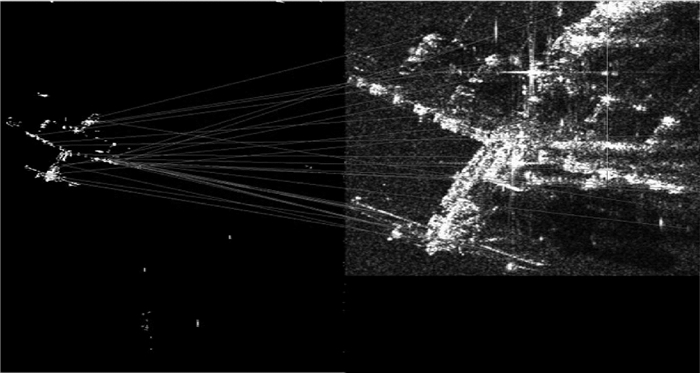

为了验证本文方法的有效性、鲁棒性,在硬件环境为Intel Pentium D 2.80 GHz CPU,1 GB内存的PC机,软件环境为VC+ +6.0和OPENCV下进行仿真实验.使用美国Sandia国家实验室的16.8 GHz机载miniSAR获取的800×800 SAR图像(见图 1),采用对图像取一个滑窗的方法进行遍历处理且用3个混合分量的高斯混合模型对杂波分布进行拟合,得到相应的估计参数后,利用本文方法计算出相应的检测阈值T(虚警概率取0.001).然后,利用二值判决准则对图像进行目标检测(见图 2),获得目标兴趣区域.得到检测的目标后,对其用SURF算子提取特征点(图 3为未改进的SURF特征点提取,图 4箭头的端点为特征点箭头方向,为特征向量主方向),同时截取基准图中的目标也进行SURF提取.再由多层剔除后得到精确匹配(见图 6,图 5为未改进的SURF匹配).

|

图 1 原始SAR图 Figure 1 Original SAR figure |

|

图 2 混合高斯的CFAR检测结果 Figure 2 Gaussian mixture CFAR detection results |

|

图 3 SURF特征点提取 Figure 3 SURF feature point extraction |

|

图 4 改进的SURF特征点提取 Figure 4 Improved SURF feature point extraction |

|

图 5 SURF匹配 Figure 5 SURF matching |

|

图 6 改进的SURF匹配 Figure 6 Improved SURF matching |

对SAR图进行统计实验,实验的条件:斑点噪声方差为0.3,尺度变化为1.5倍,角度旋转在1°~10°均匀选取.表 1为改进前后的性能对比分析结果,从中可以看出误匹配率显著降低,而且极大减少了对兴趣区域的无关SURF特征点的数量,减少了目标匹配时的比较,提高了运算的速度和匹配率.

| 表 1 匹配数据对比 Table 1 Comparison of matching data |

由于SURF算子中采用了Hessian矩阵作为检测子,利用盒滤波器近似代替二阶高斯滤波器,对斑点噪声有较好的鲁棒性,并且SURF描述符采用哈尔小波进行梯度计算,对噪声不敏感,如此更加增强了其对噪声的鲁棒性.由表 2可知,融合CFAR目标检测的改进SURF算法使这一鲁棒性得到了增强, 改进的SURF算法最高抗斑点噪声方差可以达到0.8, 误匹率由11%将至9%.

| 表 2 噪声影响 Table 2 Impact of noise |

上述实验结果表明了此方法的有效性,目标匹配率有所上升,而且具有较好的鲁棒性.

4 结论针对传统基于SURF算法的SAR图像目标匹配方法的不足,提出了改进SURF的SAR图像目标匹配新算法.采用混合高斯模型对杂波进行拟合的CFAR目标兴趣区域检测,并由SURF算子对兴趣区域特征点进行提取,使用多层剔除的特征点匹配获得精确的目标匹配.实验结果表明,该方法在SAR图像的目标匹配上与未改进的SURF相比取得了较好的效果,具有更高匹配精度、更强的鲁棒性等特点.

| [1] |

Rohling H. Radar CFAR thresholding in clutter and multipletarget situations[J].

IEEE Transactions on Aerospace and Electronic Systems, 1983, 19(4): 608-612.

|

| [2] |

Li J, Zelnio E G. Target detection with synthetic aperture radar[J].

IEEE Transactions on Aerospace and Electronic System, 1996, 32(2): 613-627.

DOI: 10.1109/7.489506. |

| [3] |

Oliver C J, Quegans. Understanding Synthetic Apertue Radar Images[M]. Boston, US: Artech House, 1998: 210-230.

|

| [4] |

Pluim J P W, Maintz J B A. Viergever M A.Mutual-lnformation-based registration of medical images:a survey[J].

IEEE Trans on Medical Imaging, 2003, 22(8): 986-1004.

DOI: 10.1109/TMI.2003.815867. |

| [5] |

Candocia F. A similarity measure for stereo featur matching[J].

IEEE Transactions on Image Processing, 1997, 6(10): 1460-1464.

DOI: 10.1109/83.624977. |

| [6] |

Mikolajczyk K, Schmid C. An affine invariant interest point detector[J].

European Conference on Computer Vision, 1993, 11(3): 283-318.

DOI: 10.1007/BF01469346. |

| [7] |

Kitchen L, Rosenfeld A. Gray level corner detector[J].

Pattern Recognition Letters, 1982, 3(1): 95-102.

|

| [8] |

Smith S, Brady J. SUSAN-A new approach to low level image processing[J].

International Journal of Computer Vision, 1997, 23(1): 45-78.

DOI: 10.1023/A:1007963824710. |

| [9] |

杨杨, 张田文. 角点检测算法评价方法的研究[J].

哈尔滨工业大学学报, 1998, 30(2): 7-10.

Yang Y, Zhang T W. Assessing criterion of conner finders[J]. Journal of Harbin Institute of Technology, 1998, 30(2): 7-10. |

| [10] |

Redner R A, Walker H F. Mixture densities, maximum likelihood and the EM algorithm[J].

SIAM Review, 1984, 26(2): 195-239.

DOI: 10.1137/1026034. |

| [11] |

Bay H, Ess A, Tuytelaars T, et al. Speeded-up robust features(SURF)[J].

Computer Vision and Image Understanding, 2008, 110(3): 346-359.

DOI: 10.1016/j.cviu.2007.09.014. |

| [12] |

Kim D, Dahyot R. Face components detection using SURF descriptors and SVMs[C]//The Proceedings of IEEE International Machine Vision and Image Processing Conference. Portrush, U K: IEEE, 2008: 51-56.

https://www.scss.tcd.ie/~dahyotr/pdf/IMVIP2008_Final.pdf

|

| [13] |

Oconaire C, Blighe M, Oconno N. SenseCam image localisation using hierarchical SURF trees[J].

Springer-Verlag Berlin Heidelberg, 2009, 9(1): 15-26.

|

| [14] |

Gossow D, Pellenz J, Paulus D. Danger sign detection using color histograms and SURF matching[C]//IEEE International Workshop on Safety, Security and Rescue Robotics. Tohoku, Japanese: IEEE, 2008: 13-18.

https://ieeexplore.ieee.org/document/4745870/

|

| [15] |

Zhang Z Y, Huang Y L, Li C, et al. Monocular vision simultaneous localization and mapping using SURF[C]//World Congress on Intelligent Control andAutomation. Chongqing. China: [s. n. ], 2008: 1651-1656.

https://ieeexplore.ieee.org/document/4593166/

|

2014, Vol. 31

2014, Vol. 31