2. 中国矿业大学 环境与测绘学院, 江苏 徐州 221116

2. School of Environmental & Spatial Informatics, China University of Mining & Technology, Xuzhou 221116, China

1 引 言

数字图像配准技术作为模式识别和数字图像处理的一种基本手段,在导航、成像制导、地图与地形匹配及变化检测等方面有广泛应用。基于特征的图像配准方法是目前最常用的方法之一。其优点是能够将对整个图像的分析转化为对图像特征的分析,大大减小图像处理过程的运算量,对灰度变化、图像变形以及遮挡等都有较好的适应能力[1, 2]。

基于特征的影像配准方法主要包括特征提取、特征匹配、配准模型选择及其参数估计3个主要步骤[2]。目前的研究主要集中在特征提取与匹配这两个关键步骤上。通常的做法是在两幅图像中检测或选取角点[3, 4, 5]、线段交点[6]、封闭区域[7, 8]及边缘[9, 10]等特征,然后基于灰度相关、链码相关、不变矩之间的距离、动态规划和松弛法等确定这些特征的对应关系[3, 4, 5, 6, 7, 8, 9, 10],以获得遥感影像配准所需的控制点。近年来,源于计算机视觉的以尺度不变特征变换算法(scale invariant feature transform,SIFT)[11, 12]为代表的基于局部不变特征提取与描述的特征匹配方法在影像配准方面得到了较为广泛的研究和应用[13, 14, 15],在一定程度上解决了场景部分遮挡、旋转缩放、视点变化引起的图像变形等问题。

由于影像成像条件的复杂性,现有的影像匹配方法都不可避免地产生误匹配。因此,选择合适的匹配约束条件以获得一定数量的较为可靠的匹配特征是影像配准中的关键问题。一种直接的策略是针对初始匹配结果,采用双向匹配和随机采样一致性(random sample consensus,RANSAC)算法进行匹配验证[13, 14]。另外一种策略是基于较为可靠的初始匹配结果估计影像的粗配准参数,并以此进行几何约束获得更多的匹配特征、提高配准精度。如文献[6]采用基于特征一致的粗配准方法获得影像的初始变换参数,并将其用于直线特征的约束匹配,最终以直线的交点作为最终配准用的控制点;文献[7]基于边界链码相关和区域不变矩匹配策略建立封闭边界的对应,并对对应重心即匹配点对进行一致性检测获得基元控制点,然后估计影像的初始仿射变换参数并对影像进行初始仿射变换,在此基础上进一步通过显著点片的相关系数匹配来增加控制点个数;类似的,文献[5]利用SIFT方法进行初始匹配并对影像进行粗配准变换,在变换后的影像上基于Harris特征点和相关系数匹配获得比初始匹配更多的基元控制点。

基于上述第2种匹配策略,笔者提出一种基于SIFT特征的抗差图像匹配算法。算法首先综合利用SIFT特征匹配方法和基于SIFT特征尺度和方位信息的自适应归一化互相关(normalized cross correlation,NCC)方法建立初始相关,并基于几何关系一致性检测剔除误匹配;然后在初始相关的基础上,利用自适应NCC和局部单应约束进行匹配传播,迭代产生更多的匹配点并采用几何关系一致性检测剔除可能的误匹配。初始单应采用最小二乘匹配(least squares matching,LSM)方法估计得到,并采用自适应NCC为其提供良好的初始值。与现有的基于特征点的图像配准方法相比,算法在抗几何变形和配准精度等方面具有优越性。

2 特征提取采用SIFT算法提取配准特征点。SIFT算法主要包括尺度空间极值点检测、特征点主方位确定、特征描述符生成及特征匹配4个主要步骤[11]。SIFT特征是图像的局部特征,具有多量性、独特性好和信息量丰富的特点,且其对旋转、尺度缩放、亮度变换保持不变性,对视点变化、仿射变换、图像噪声等也保持一定程度的不变性。根据SIFT算法的原理,本文将SIFT特征点表达为f=(x,σ,θ,d),其中,x=[x y]T;σ和θ分别代表特征点的位置、特征尺度(characteristic scale)和主方位(dominant orientation);d代表128维的SIFT特征描述符。

3 特征匹配本文特征匹配方法包括初始匹配和匹配传播两个阶段。除SIFT特征匹配方法外,涉及的匹配方法主要有基于SIFT的LSM和自适应NCC匹配两种。接下来首先给出上述两种匹配方法的基本原理,然后阐述本文特征匹配方法的具体策略。

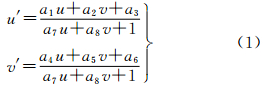

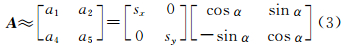

3.1 基于SIFT的最小二乘及自适应NCC匹配假设f=(x,σ,θ,d)和f′=(x′,σ′,θ′,d′)为基准影像和参考影像中检测到的一对同名SIFT特征点,以x和x′为坐标原点(中心)的两个邻域窗口记为N(x)和N(x′),其中N(x)的大小为(2w+1)×(2w+1)。利用平面单应H(二维投影变换)近似两个邻域窗口之间的几何关系,则有下式成立

令 ,则H=

,则H= 。式中,A、t、v分别表示邻域窗口之间的仿射、平移及投影变形参数。进一步令u=[u v]T ∈[-w w],u′=[u′ v′]T为u按式(1)进行投影变换后的坐标,则以x和x′为中心的两个相关窗口W和W′可表达为

。式中,A、t、v分别表示邻域窗口之间的仿射、平移及投影变形参数。进一步令u=[u v]T ∈[-w w],u′=[u′ v′]T为u按式(1)进行投影变换后的坐标,则以x和x′为中心的两个相关窗口W和W′可表达为

基于式(2)并进一步引入亮度补偿参数h0和h1,可建立基于投影变换模型的最小二乘匹配条件方程,线性化后可得最小二乘匹配的误差方程式(限于篇幅,误差方程式各项系数从略)。其中需要迭代估计的参数为ΔX=[Δh0 Δh1 Δa1 … Δa8]T。

LSM需要较为良好的待求参数初始值。相比于仿射变形,亮度、平移和投影变形相对较小,其相应的待求参数初始值可分别设置为h00=0,h10=1,a30=a60=a70=a80=0。因此问题的关键是如何确定仿射变换参数初始值。

将仿射变换矩阵A近似分解为

式中,sx、sy为x、y两个方向上的缩放因子;α为特征点相关窗口的相对旋转角度。

假设σ′ > σ ,并令s=σ′/σ,θ=θ - θ′。由于SIFT检测到的特征点邻域具有尺度和旋转不变性,即当两个相关窗口W、W′间仅存旋转和尺度变化时,式(3)中的sx = sy=s,旋转角度α=θ。当影像间存在仿射变化时,则sx ≠ sy≠ s。但可在s的局部邻域内搜索最佳参数sx、sy,令

基于式(4)以NCC系数最大为准则搜索最佳参数k则可以确定sy,继而根据式(3)确定A并将其作为LSM的迭代初值。此处NCC计算所采用的相关窗口随特征点邻域的尺度和方位自适应调整,对影像几何变形具有较好的适应性。自适应NCC所用的相关窗口W和W′只需将式(2)中的H用A替换即可。

3.2 初始匹配初始匹配采用如下由粗到精的多层(multi-level)匹配策略:

(1) 利用基于K-D树快速搜索和欧氏距离比率的SIFT特征匹配算法[11]建立初始匹配点集Ms;

(2) 利用自适应NCC算法对Ms进行匹配验证,剔除NCC系数小于给定阈值(0.60)的同名点对;

(3) 采用基于投影变换模型的RANSAC算法对匹配点进行几何关系一致性检测,进一步剔除外点(outliers)后获得最终的初始匹配结果,即种子匹配。

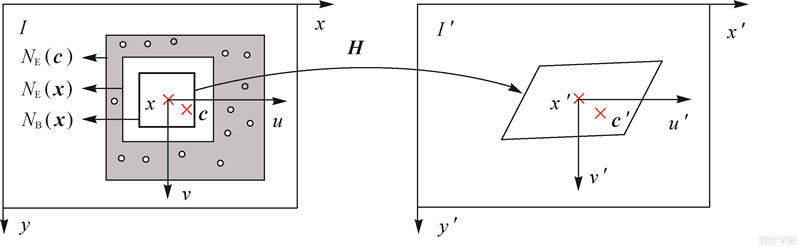

3.3 匹配传播为直观计,首先以一对种子匹配点对为例阐述基本的匹配传播策略,然后给出整体的匹配传播流程。设m=(f,f′)为用于匹配传播的一对种子匹配,则基于该种子匹配的匹配传播策略如下。

3.3.1 种子点的最小二乘匹配对种子匹配m按3.1节的方法进行最小二乘匹配。但需注意的是,3.1节中采用的是固定大小的影像相关窗口(本文设置为35×35像素)。考虑到相对较大的影像窗口对基于局部单应约束的匹配传播有利。为此,对种子匹配m,通过一定的步长扩大其局部邻域N(x)。然后在预先设定的阈值条件下(本文设置为0.85),重复执行LSM算法寻求种子匹配的最大支持区(largest support region,LSR)及其对应邻域的局部单应H。注意,本文算法中,并非所有种子点都用于后续的匹配传播(这一点将在3.3.4节中体现),因而为减少额外计算负担,仅对用于匹配传播的种子点进行最小二乘匹配并寻求其LSR,这也是笔者没有在初始匹配阶段执行此操作的原因。

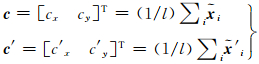

3.3.2 初始匹配传播如图 1所示,将m的LSR定义为基准窗口,记为NB(x)。以x为中心按一定的步长扩大NB(x)获得一新的影像窗口并将其定义为扩展窗口,记为NE(x)。现将NE(x)定义为增长区域并假设NB(x)和NE(x)具有相同的局部单应映射H。则基于局部单应约束的匹配传播可以进行[16]。采用自适应NCC算法进行约束匹配传播,但需注意的是此时仿射参数无需像3.1节阐述的那样迭代搜索,而是直接从H中分解得到,从而在一定程度上降低了匹配传播的计算复杂度。

|

| 图 1 基于局部单应约束的匹配传播 Fig. 1 The matching propagation with local homography constraint |

将初始匹配传播获得的局部匹配点集记为 ={(

={( i,

i, ′i)|i=1,2,…,l},其中l为匹配点的个数。为剔除可能存在的误匹配,采用基于投影变换模型的RANSAC算法对匹配点进行几何关系一致性检测。注意,此处几何关系一致性检测时用的是以x和x′为原点的重心化坐标。

′i)|i=1,2,…,l},其中l为匹配点的个数。为剔除可能存在的误匹配,采用基于投影变换模型的RANSAC算法对匹配点进行几何关系一致性检测。注意,此处几何关系一致性检测时用的是以x和x′为原点的重心化坐标。

基于初始传播匹配集 ,迭代传播步骤如下:

,迭代传播步骤如下:

(1) 计算同名特征点集 i和

i和 ′i的重心c和c′

′i的重心c和c′

并进行重心化

(2) 对重心化后的同名特征点集 i和

i和 ′i,用直接线性变换(direct linear transformation,DLT)算法估计一新的单应矩阵H′。

′i,用直接线性变换(direct linear transformation,DLT)算法估计一新的单应矩阵H′。

(3) 定义NE(x)为新的基准窗口,以c为中心在NE(x)窗口大小的基础上继续扩大影像窗口区域获得一新的扩展窗口,记为NE(c) (如图 2所示)。定义增长区域为NE(c)和NE(x)的交集(图 2中阴影部分),则对于新的增长区域内的点(图 2中圆点),同3.3.2 节相同的假设和方法基于H′进行约束匹配传播并将新增匹配点加入到 。

。

|

| 图 2 基于种子点的匹配传播过程 Fig. 2 The process of matching propagation based on seed points |

(4) 重复步骤(1)~(3),直至没有新增匹配点。

初始匹配传播和迭代匹配传播的主要差异在于增长区域的定义上,前者以扩展窗口作为增长区域,而后者在迭代的过程中以前一扩展窗口和当前扩展窗口的交集作为增长区域。

3.3.4 匹配传播算法总结基于3.2节获得的初始匹配点集Ms及上述基本传播策略,完整的匹配传播算法步骤如下:

(1) 将种子匹配根据NCC系数进行降序排列,选取NCC系数最大的一对种子匹配,记为mi。

(2) 对mi按3.3.1节所述的方法进行最小二乘匹配,获得该对种子的LSR及其相应的Hi。

(3) 按3.3.2节所述的方法进行初始匹配传播,获得的匹配点集记为M。将mi加入到M。此外,对增长区域内的种子点,如用自适应NCC方法能够再次成功匹配,则将其加入到M。否则,将其从种子点集Ms中删除。

(4) 按3.3.3节所述的方法进行迭代匹配传播并将新增匹配点加入到M。对每次迭代产生的增长区域内的种子点,如用自适应NCC方法能够再次成功匹配,则将其加入到M。否则,将其从种子点集Ms中删除。

(5) 重复步骤(1)~(4),直至没有新增匹配点。返回最终匹配点集M。

针对上述算法,这里需要指出的两点是:一是扩展窗口增长步长的确定;二是匹配传播过程中种子点的处理。在没有任何关于影像先验信息的条件下,第1个问题较难确定。经过对不同类型的影像进行多次试验,笔者将增长步长经验设置为50像素。同时在扩展窗口增长的过程中,如果某方向没有新增匹配点,则该方向不再扩展。对于第2个问题的处理,计算机视觉界的密集匹配算法多在匹配传播过程中迭代产生新的种子[17],然而,本文算法的种子点除了特征点位置外,还需要其对应邻域的单应映射关系,如利用LSM算法迭代更新种子点集,则算法的计算复杂度较高,此外,上述步骤(3)和步骤(4)中的种子点处理方式还考虑到了由于重复纹理特征导致的误匹配的存在,而较强的局部单应约束可以有效地识别它们。

图 2示意了本文匹配传播算法的基本过程。图 2(a)为分布在参考影像中的局部区域内的种子点,其中第2号种子点用于匹配传播。图 2(b)和图 2(c)分别示意了基于该对种子的初始传播和第1次迭代传播结果,其中黄色点为经过几何关系一致性检测后的传播匹配点,而红色点为通过自适应NCC方法在匹配传播过程中被再次确认为正确的种子点,绿色点为代表当前匹配点集的重心(初始匹配传播时的重心为第2号种子点)。图 2(b)中白色和绿色矩形框为该种子的LSR和扩展窗口,扩展窗口区域被定义为初始匹配传播时的增长区域。而图 2(c)中较小和较大的绿色矩形框分别为当前迭代的基准窗口和扩展窗口,其交集定义为当前迭代的增长区域。

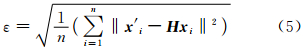

4 配准模型及参数估计以上的SIFT特征点匹配和一致性检测均是建立在投影变换基础上的。相对于仿射变换,投影变换模型可更严格地表达两幅影像间的几何变换关系。因此,本文仍然选用式(1)表达的投影变换模型作为配准模型。为比较,还选用了基于三角网的小面元配准模型来评价配准精度[5]。利用最终的匹配点作为配准控制点,即可利用DLT算法线性化求解式(1)中的8个投影变换参数,完成影像的配准。

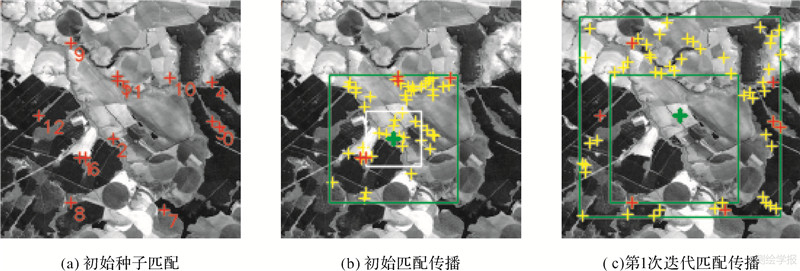

5 试验与分析 5.1 试验数据及评价指标选取如图 3所示的5组测试数据进行算法验证。图 3中每组图像((a)~(e))中按从左至右顺序的第1幅和第2幅分别作为基准图像和待配准图像,相关数据描述见表 1)。其中,测试数据(a)和(b)来源于:http://www.robots.ox.ac.uk/~vgg/data/data-aff.html;数据(c)~(e)的多源、多时相遥感影像数据来源于: http://vision.ece.ucsb.edu/registration/satellite/testimag/index.htm。通过式(5)计算配准精度对算法性能进行客观测试。

|

| 图 3 各组数据的匹配和配准融合结果 Fig. 3 The matching and registration results of each experimental data set |

| 测试 数据 | 参考图 像大小/像素 | 待配准图 像大小/像素 | 数据描述 |

| (a) | 800 × 640 | 800 × 640 | 拍摄视点变化约40°近景数字影像,存在较大透视投影变形 |

| (b) | 850 × 680 | 850 × 680 | 存在显著尺度和旋转变形的近景数字影像 |

| (c) | 256 × 256 | 256 × 256 | 城区多传感器遥感图像,参考图像和待配准图像分别为1995年8月的SPOT波段3数据和1994年7月的TM波段4数据 |

| (d) | 512× 512 | 512× 512 | 农业区多时相TM波段5数据,参考图像和待配准图像分别拍摄于1990年9月和1994年7月 |

| (e) | 306 × 386 | 335× 472 | IKONOS高分辨率遥感影像,存在较大的JPEG压缩和人工旋转 |

式中,n代表配准用的控制点对的个数; 和

和 ′i为控制点对;H代表配准所用的投影变换模型;ε为均方误差(单位:像素)。

′i为控制点对;H代表配准所用的投影变换模型;ε为均方误差(单位:像素)。

图 3给出了5对测试数据的匹配和配准融合结果(融合后的重叠区域高亮显示)。其中红色和黄色点分别为初始匹配点和传播匹配点。绿色点为用于匹配传播的初始匹配点,基准图像和待配准图像中的白色框分别代表绿色点的LSR及其投影变换后的形状。最终匹配点的数量为红色和黄色点的数量总和。表 2给出了本文方法同文献[14]和文献[5]配准方法分别基于投影变换模型和小面元配准模型的相关比较结果,其中ε1和ε2分别代表两种配准模型的均方误差(单位:像素)。表 2中特征点数量是指从基准图像和待配准图像中检测的SIFT特征点的个数。但文献[5]算法先采用SIFT方法对待配准影像进行粗配准变换,然后基于Harris特征点采用相关系数匹配方法建立配准控制点对,因此,表 2中文献[5]算法对应的参数n为最终的Harris匹配点对的个数。

| 测试 数据 | 特征点数量 | 文献[14]算法 | 文献[5]算法 | 本文算法 | ||||||

| n/个 | ε1/像素 | ε2/像素 | n/个 | ε1/像素 | ε2/像素 | n/个 | ε1/像素 | ε2 /像素 | ||

| (a) | (2393,3058) | 21 | 1.504 | 1.496 | 314 | 1.208 | 1.187 | 443 | 0.908 | 0.894 |

| (b) | (5391,5978) | 464 | 0.387 | 0.374 | 702 | 0.421 | 0.411 | 972 | 0.334 | 0.323 |

| (c) | (927,786) | 8 | 1.102 | 1.092 | 61 | 0.844 | 0.832 | 42 | 0.823 | 0.816 |

| (d) | ( 2822,2701 ) | 77 | 0.801 | 0.784 | 257 | 0.725 | 0.710 | 232 | 0.691 | 0.674 |

| (e) | (1284,2129) | 382 | 0.376 | 0.361 | 557 | 0.314 | 0.306 | 638 | 0.224 | 0.212 |

综合上述试验结果,分析如下:

(1) 由表 2可以看出,无论选用何种配准模型,本文方法的配准精度均优于其他方法;此外,针对本文的试验影像,基于投影变换模型和三角网小面元模型的配准精度差别不大,说明本文选用实现较为简单的投影变换模型是合理的。

(2) 同样是基于SIFT的影像配准方法,但本文方法获得的配准控制点的数量和配准精度均优于文献[14]的方法。主要原因在于文献[14]方法仅基于初始匹配结果进行优化。并没有通过合适的途径去获得更多的匹配点。而文献[5]在粗配准变换的基础上,基于Harris特征点采用相关系数匹配方法获得了较多的配准控制点对,在某些情况下多于本文方法所获得的控制点对(如表 2中数据(c)、(d)的试验结果),但最终的配准精度均低于本文方法。

(3) 表 2中针对测试数据(a)的试验结果表明,当影像间存在显著的投影变形时,相比于文献[14]和文献[5]的方法,本文方法的配准精度优势更加明显。在此种情况下,文献[14]的缺陷在于所采用的SIFT特征匹配方法对影像的投影变形较为敏感,因为SIFT特征匹配时所采用的特征描述符不具仿射不变性。而文献[5]的方法对影像进行粗配准变换以更适合Harris特征点的提取与匹配。但当影像间存在较大的投影变形时,影像重采样误差及其导致的信息损失会影响Harris特征点的提取精度,更何况Harris特征点本身的提取精度仅为整像素级。这也是该方法在某些情况下虽然用了较多的控制点对,但配准精度却低于本文方法的可能原因(如表 2中数据(c)、(d)的试验结果)。说明本文的影像配准方法对影像的各类几何变形具有较好的适应性。

(4) 由图 3可以看出,针对本文所采用的测试数据,仅需一对种子匹配即可完成后续的匹配传播过程。这主要得益于SIFT特征检测的多量性及本文局部单应约束的精确性。同时,对辐射差异较大的多传感(测试数据(c))、多时相(测试数据(d)),本文方法也能获得较好的配准结果,因而对辐射差异也有一定程度的抗差性。

6 结 论本文利用SIFT尺度不变特征点的尺度和方位特性,提出了一种基于SIFT特征的两阶段图像配准方法,并同现有的基于特征点的影像配准方法进行了综合对比分析。表明本文算法在配准控制点的数量和配准精度及影像几何变形的适应性等方面具有较大优势。进一步的研究将通过融合与SIFT特征点具有互补特性的特征(如Harris特征点),以提高匹配传播的抗差性。

| [1] | BROWN L. A Survey of Image Registration Techniques[J]. ACM Computing Surveys, 1992, 24(4): 325-376. |

| [2] | ZITOVA B, FLUSSER J. Image Registration Methods: a Survey[J]. Image and Vision Computing, 2003, 21(11), 977-1000. |

| [3] | HONG G, ZHANG Y. Wavelet-based Image Registration Technique for High-resolution Remote Sensing Images[J]. Computer & Geosciences, 2008, 34: 1708-1720. |

| [4] | ZHANG Qian, LIU Zhengkai, PANG Yanwei, et al. Automatic Registration of Aero Photos Based on SUSAN Operator[J]. Acta Geodaetica et Cartographica Sinica, 2003, 32(3): 245-250. (张迁, 刘政凯, 庞彦伟, 等. 基于SUSAN算法的航空影像的自动配准[J]. 测绘学报, 2003, 32(3): 245-250.) |

| [5] | YU L, ZHANG D R, HOLDEN E J. A Fast and Fully Automatic Registration Approach Based on Point Features for Multi-source Remote-sensing Images[J]. Computer & Geosciences, 2008, 34: 838-848. |

| [6] | SU Juan, LIN Xinggang, LIU Daizhi. A Multi-sensor Image Registration Algorithm Based on Structure Feature Edges[J]. Acta Automatica Sinica, 2009, 35(9): 1159-1167. (苏娟, 林行刚, 刘代志. 一种基于结构特征边缘的多传感器图像配准方法[J]. 自动化学报, 2009, 35(3): 251-257.) |

| [7] | WEI Yanfeng, ZHAO Zhongming, YAN Dongmei, et al. Remote Sensing Image Automatic Registration Based on Feature[J]. Acta Electronica Sinica, 2009, 38(3): 161-165. (韦燕凤, 赵忠明, 闫冬梅, 等. 基于特征的遥感图像自动配准算法[J]. 电子学报, 2005, 33(1): 161-165.) |

| [8] | LV Jinjian, WEN Gongjian, LI Deren, et al. A New Method Based on Spatial Relations for Feature Matching[J]. Acta Geodaetica et Cartographica Sinica, 2008, 37(3): 367-374.(吕金建, 文贡坚, 李德仁, 等. 一种新的基于空间关系的特征匹配方法[J]. 测绘学报, 2008, 37(3): 367-374.) |

| [9] | KIM Y S, LEE J H, RA J B. Multi-sensor Image Registration Based on Intensity and Edge Orientation Information[J]. Pattern Recognition, 2008, 41: 3356-3365. |

| [10] | LI H, MANJUNATH B S, MITRA S K. A Contour-based Approach to Multisensor Image Registration[J]. IEEE Transactions on Image Processing, 1995, 4(3): 320-334. |

| [11] | LOWE D. Distinctive Image Features from Scale-invariant Keypoints[J]. International Journal of Computer Vision,2004, 60(2): 91-110. |

| [12] | MIKOLAJCZYK K, TUYTELAARS T, SCHMID C. A Comparison of Affine Region Detectors[J]. International Journal of Computer Vision, 2005, 65(1):43-72. |

| [13] | LI Xiaoming, ZHENG Lian, HU Zhanyi. SIFT Based Automatic Registration of Remotely-sensed Imagery[J]. Journal of Remote Sensing, 2006,10(6): 885-893. (李晓明, 郑链, 胡占义. 基于SIFT特征的遥感影像自动配准[J]. 遥感学报, 2006, 10(6): 885-892.) |

| [14] | LI Fangfang, XIAO Benlin, JIA Yonghong, et al. Improved SIFT Algorithm and Its Application in Automatic Registration of Remotely-sensed Imagery[J]. Geomatics and Information Science of Wuhan University, 2009, 34(10): 1245-1249. (李芳芳, 肖本林, 贾永红, 等. SIFT算法优化及其用于遥感影像的自动配准[J]. 武汉大学学报:信息科学版, 2009, 34(10): 1245-1249.) |

| [15] | CHEN Fang, XIONG Zhi, XU Yunxi, et al. Research on the Fast Scene Matching Algorithm in the Inertial Integrated Navigation System[J]. Journal of Astronautics, 2009, 30(6): 2308-2316. (陈方, 熊智, 许允喜, 等. 惯性组合导航系统中的快速景象匹配算法研究[J]. 宇航学报, 2009, 30(6): 2308-2316.) |

| [16] | SU J B, CHUNG R, JIN L. Homography-based Partitioning of Curved Surface for Stereo Correspondence Establishment[J]. Pattern Recognition Letters, 2007, 28: 1459-1471. |

| [17] | KANNALA J, BRANDT S S. Quasi-dense Wide Baseline Matching Using Match Propagation[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Minneapolis: IEEE, 2007: 1-8. |

| [18] | YANG Huachao. Researching into Extracting and Matching Methods of Point and Line Features for Wide Baseline Stereo Images[D].Xuzhou: China University of Mining & Technology,2010.(杨化超. 宽基线立体影像点、线特征提取与匹配方法研究[D].徐州:中国矿业大学,2010.) |

| [19] | YANG Huachao, ZHANG Shubi, ZHANG Qiuzhao. Least Squares Matching Methods for Wide Base-line Stereo Images Based on SIFT Features[J]. Acta Geodaetica et Cartographica Sinica, 2010,39(2):187-194.( 杨化超,张书毕,张秋昭.基于SIFT的宽基线立体影像最小二乘匹配方法[J]. 测绘学报,2010,39(2):187-194.) |

| [20] | YANG Huachao, YAO Guobiao, WANG Yongbo. Dense Matching for Wide Base-line Stereo Images Based on SIFT[J]. Acta Geodaetica et Cartographica Sinica,2011,40(5):537-543.(杨化超,姚国标,王永波. 基于SIFT的宽基线立体影像密集匹配[J]. 测绘学报,2011,40(5):537-543.) |