| 基于图像校准的多源融合的室内定位方法 |

2. 深圳大学智慧城市研究院,广东 深圳,518060

2. Research Institute for Smart City, Shenzhen University, Shenzhen 518060, China

随着卫星定位技术与算法的逐渐成熟,位置服务迎来了快速发展时期。但卫星定位技术的局限性也因为室内环境的多样化而愈发突显,比如大型综合超市、机场或停车场等相对大型复杂的环境急需更精准的定位技术。而由于建筑物墙体的阻隔,卫星定位技术难以满足室内定位的精度要求,因此多源融合的室内定位方法迎来了发展机遇。

现在较主流的室内定位研究热点有A-GPS、红外线定位、超声波定位、蓝牙定位、射频识别定位、WiFi定位、超宽带定位等[1-2]。其中WiFi定位是当今研究中最热门和成熟的定位技术之一。基于WiFi的室内定位方法通过匹配接收信号强度(received signal strength indicator,RSSI)[3]或信道状态信息(Channel Status Information,CSI)[4]进行定位。首先在离线阶段,对研究区域进行划分并采集WiFi的信号强度,建立指纹库。在线阶段,通过KNN、支持向量机或随机森林等方法对实时数据进行匹配,获得用户所在位置。

图像定位同样分为离线和在线两个阶段。离线阶段采集图像,建立图像库。在线阶段匹配实时图像与库中图像的特征,匹配度最高的图像位置坐标作为目标点坐标[5]。计算特征点的主流方法有SIFT和SURF两种方法。另外,手机内置了集成重力加速度计、线性加速度计及磁力计的传感器,通过测算加速度计可以感知用户是否在行走,或者推算步频。磁力计可以探知用户方位,其变化可以探知用户拐弯的方向与幅度。已有不少研究利用这些内置传感器进行室内定位[6-8]。周瑞等[9]提出使用联邦卡尔曼滤波融合WiFi和PDR的算法。侯松林等[10]提出融合WiFi信号和图像数据,通过双层过滤的方式进行高精度室内定位的算法。刘涛等[11]基于传统图像建库工作量大,耗时长的特点,提出一种融合运动恢复结构和航位推算的视觉定位方法。本文期望创建一种成本低、精度高、能实际应用的算法。故此结合当今手机集成的相机、WiFi接收器及惯性传感器,提出一种基于图像校准的多源融合的室内定位方法。

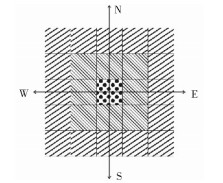

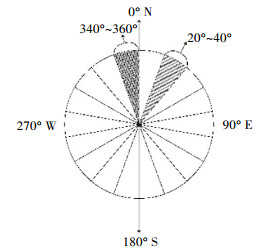

1 多源融合的室内定位方法基于图像校准的多源融合的室内定位方法是利用手机集成的相机、WiFi接收器及惯性传感器,通过设定规则,融合以上三种数据源,实现室内定位。该方法的一大特征是关注了空间的连续性和用户方向连续性。如图 1所示,空间连续性即是中间的点单元格不会在下一时刻跳跃到斜线单元格内。如图 2所示,方向连续性即是本文设定的短时间内,如未侦测到大幅度转向的前提下,由传感器引起的误差不会超过±20°。

|

| 图 1 空间连续性示意图 Fig.1 Schematic of Spatial Continuity |

|

| 图 2 方向连续性示意图 Fig.2 Schematic of Directional Continuity |

1.1 规则的设定和模块的确定

本方法在设定规则前,先明确一些假定:①只有在走动时惯性传感器会超过一定的阈值,否则惯性传感器所侦测数据是相对平稳的;②走动时人的移动是连续的,不会突然横跨2米以上的距离或穿墙而过。③人是不会在快速转弯的同时进行较大的移动。在以上假设基础上,确定几个模块:

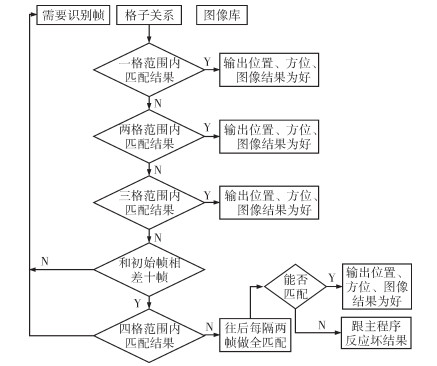

1)图像模块。此模块使用SURF特征点对当前图像与所处位置一格范围内的库中图像进行匹配,当匹配可信度较高时,输出用户当前位置及方位。若未符合条件,则通过“扩散搜索”的方法在图像库中搜索,这种方法能够减少搜索时间,提高效率。图像模块流程图如图 3所示。

|

| 图 3 图像模块流程图 Fig.3 Flow Chart of Image Module |

2)WiFi模块。通过KNN选取指纹库内最可能的5个位置,因为假定②的限制,结合WiFi误差较大的特点,在上一次可能出现的位置的一定范围内搜索。本文结合前人做WiFi检测时的误差结果,设定搜索4米范围内的格子,并且根据图 1所示,图像模块所输出的方位进行判断,若判断的格子与上一确定格方位不同,则被排除,并结合传感器所侦测到的角度,以±20°为标准做筛选,如果符合条件则输出,否则记录,直至达到一定阈值,调用图像模块。

3)惯性传感器模块。负责侦测移动以及转向。图像模块的可信度最高,WiFi模块定位精度较低,但运算速度快。通过图像模块矫正WiFi模块的输出位置。传感器模块主要任务是辅助定位,作为整个系统启动、调用图像及WiFi模块的决策信息。

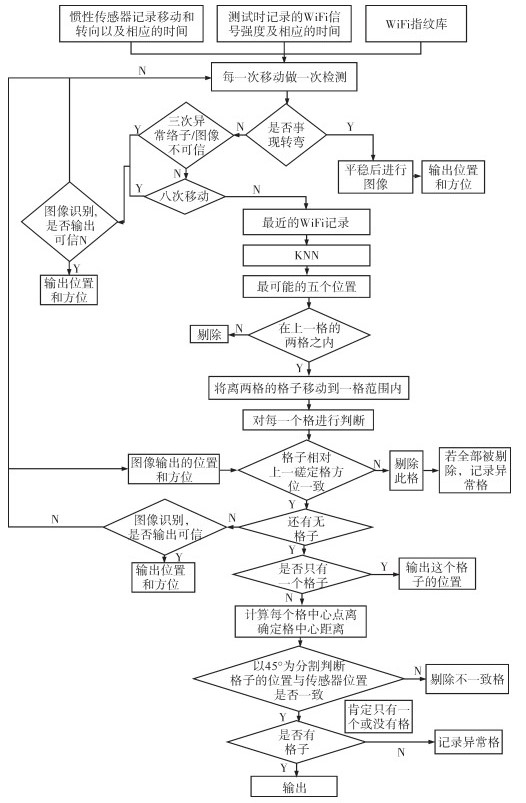

1.2 融合框架和数据融合多源融合的技术脉络为:惯性传感器侦测到运动后,启动定位系统。通过图像模块精确识别当前所在位置。而后在一定的步数范围内WiFi识别模块开始工作,输出可能的位置,如果没有符合条件的位置则记录异常,当异常记录到一定次数后即调用图像模块。传感器模块可以侦测到移动的步数和方向的变换,当达到一定的步数或出现角度大范围改变后,反馈给系统,系统调用图像模块介入定位。因为WiFi定位是结合上一次的定位结果,所以为了防止出现累计误差,当达到一定的步数时调用图像模块;当出现大角度的变换,调用图像模块是为了更好地获取用户所面向的位置,同时进一步进行位置校准。本文设定的大角度变换为一秒钟超过20°的转动。根据假定②和假定③,对KNN推算出的可能方格位置设定规则进一步判断,同时与图像融合,融合框架见图 4。

|

| 图 4 融合框架流程图 Fig.4 Flowchart of Fusion Algorithm |

2 实验和分析 2.1 实验方案及实施

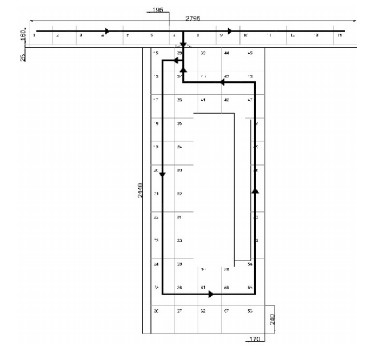

本文实验区为深圳大学科技楼九楼的开放空间。将空间以2 m为标准划分,以此将整个区域划分为62个单元格,如图 5所示。对每一个单元格进行WiFi与图像的建库。WiFi指纹库采集位于每个单元格中心点的WiFi信号,将其作为该单元格的WiFi指纹。每个单元格采集15 s,原则是只要采集到当实测时能接收到的WiFi信号的mac地址与RSSI即可。图像采集流程为:在每个单元格采取东西南北四个方向的图像,剔除白墙或深色玻璃等不含特征信息的图像。为提高运行速度,将照片像素进行压缩,从3 120×4 160像素压缩为240×320像素,由此建立包含位置和方位的图像库。

|

| 图 5 研究区域及测试路线 Fig.5 Study Area and the Test Route |

测试时的线路如图 5所示,测试者手持手机,开启惯性传感器,WiFi和摄像头,如图 5行走形成测试集。离线计算中所用台式计算机配置为:CPU为Intel i7-7700、内存为48G,显卡为NVIDIA GTX1050Ti,运算平台为python。测试阶段为视频从开始到结束,总时长185 s。

2.2 实验结果分析该融合算法计算总时间为153 s,在离线计算阶段识别出203次超过阈值的抖动,其中有91次抖动可以被准确推断出位置,这91次在瞬时确定的方格在一格范围,也即2 m内的精度匹配准确率可达到85%以上,但全部视频185 s中,有130 s的时间是在2 m精度内的,准确率为70%。

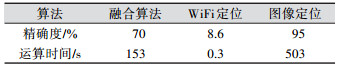

为对比本文提出的融合算法,额外验证了:①仅使用图像识别模块定位;②仅使用WiFi模块识别定位,结果如表 1所示。单纯使用图像,每隔5 s提取一帧图像进行暴力匹配,离线计算用时503 s,2 m精度内准确率95%。单纯使用WiFi定位时,有133次抖动被侦测到,只有26次在两格范围内,占比19.5%,累加时间有16 s,2 m精度内准确率8.6%,离线计算用时0.3 s。通过对比,可以发现,融合算法精确度比WiFi算法大幅提高,而运算时间比图像定位算法减少了70%。

| 表 1 三种算法的对比 Tab.1 Comparison Table of Three Algorithms |

|

3 结束语

本文通过融合传感器、WiFi与图像三种技术的优缺点,实现一种运算速度较快,精度较高的室内定位算法。在空间连续性与方位连续性的基础上,本算法采用一种“扩散搜索”的方法进行图像的检索,以此减少图像模块的使用次数,减少了整套算法的运算时间。总的来说,本融合算法精度较高,运算效率较高且有矫正功能。但该算法在实际场景中的效果还需要进一步验证。

| [1] |

阮陵, 张翎, 许越, 等. 室内定位: 分类、方法与应用综述[J]. 地理信息世界, 2015, 22(2): 8-14. DOI:10.3969/j.issn.1672-1586.2015.02.002 |

| [2] |

汪苑, 林锦国. 几种常用室内定位技术的探讨[J]. 中国仪器仪表, 2011(2): 54-57. DOI:10.3969/j.issn.1005-2852.2011.02.010 |

| [3] |

李奇越, 李伟, 孙伟, 等. 基于RSSI和辅助节点协作的Wi-Fi室内定位方法[J]. 电子测量与仪器学报, 2016, 30(5): 794-802. |

| [4] |

黄赵, 薛卫星, 周宝定. 一种基于CSI的加权K邻近室内定位方法[J]. 测绘地理信息, 2019, 44(4): 83-85. |

| [5] |

Liang J Z, Corso N, Turner E, et al. Image Based Localization in Indoor Environments[C]. 2013 Fourth International Conference on Computing for Geospatial Research and Application, San Jose, CA, USA, 2013

|

| [6] |

Lourenço M, Pedro V, Barreto J P. Localization in Indoor Environments by Querying Omnidirectional Visual Maps Using Perspective Images[C]. 2012 IEEE International Conference on Robotics and Automation, Saint Paul, MN, USA, 2012

|

| [7] |

雷雨伟, 修春娣, 杨威, 等. WiFi与MEMS-IMU融合定位方法在室内定位中的应用[J]. 导航定位学报, 2016, 4(4): 81-87. |

| [8] |

张鹏, 赵齐乐, 李由, 等. 基于PDR、WiFi指纹识别、磁场匹配组合的室内行人导航定位[J]. 测绘地理信息, 2016, 41(3): 29-32. |

| [9] |

周瑞, 袁兴中, 黄一鸣. 基于卡尔曼滤波的WiFi-PDR融合室内定位[J]. 电子科技大学学报, 2016, 45(3): 399-404. DOI:10.3969/j.issn.1001-0548.2016.02.015 |

| [10] |

侯松林, 杨凡, 钟勇. 基于智能手机无线信号和图像距离感知融合的室内定位算法[J]. 计算机应用, 2018, 38(9): 2603-2609. |

| [11] |

刘涛, 张星, 李清泉, 等. 一种运动恢复结构和航位推算结合的室内行人视觉定位方法[J]. 地球信息科学学报, 2017, 19(6): 744-753. DOI:10.3969/j.issn.1560-8999.2017.06.003 |

2021, Vol. 46

2021, Vol. 46