| 基于Worldview影像的植被自动提取研究 |

植被覆盖情况是地理国情普查的重要内容之一,城市生态也与植被覆盖息息相关,植被可以是大片森林,也可能是稀疏的树木,目前采用的技术手段主要是在高分辨率遥感影像上进行面向对象的地物解译或监督分类方法,再结合实地调查完成植被提取。一些研究者对植被提取进行了研究,如采用监督分类的手段通过AdaBoost对局部QuickBird影像上的植被进行了提取[1],该方法需人工选取训练样本。文献[2]中提出的拮抗色特征,通过非监督分类实现了稀疏、大片、不同颜色及阴影下的植被提取,然而该方法的计算量较大。本文基于高分辨率的整幅Worldview影像,提出了一种计算简单的自动化提取植被方法,无需人工选取训练样本就可实现植被的提取,并将结果与主流遥感图像处理软件ENVI、eCognition的分类结果进行了比较。

1 Worldview影像的植被特征与Fuzzy ART 1.1 影像的植被特征由于Worldview影像的辐射分辨率为11 bit,有2 048个灰度级(211=2 048),其信息量丰富,能更好地区分较亮和较暗的地物,因此本文直接利用原始的影像数据来提取植被特征。由于植被在影像上最突出的特征是其在可见光红光(R)波段的强吸收和在近红外(NIR)波段的强反射,因此可见光红波段和近红外波段成为植被提取中最有价值的两个波段。植被生长环境和生长状态不同,产生的光谱效应不同,导致植被指数具有时效性和地域性,由于研究对象及具体应用不同,研究者们提出了多种植被指数。同时,植被在影像上也表现出了一定的纹理特性。本文在尽量减少计算量的指导思想下选择了归一化植被指数特征(normalized difference vegetation index, NDVI)、差值植被指数(difference vegetation index, DVI)和LBP (local binary pattern)纹理特征等植被特征。

1)归一化植被指数特征NDVI是指近红外波段与红光波段数值之差与数值之和的比值,使指数值限定在[-1, 1]范围内,表达式为:

| $ {\rm{NDVI = }}\frac{{{\rm{NIR - R}}}}{{{\rm{NIR + R}}}} $ | (1) |

遥感影像中云、水体等物体在可见光波段的反射率比近红外波段高,NDVI为负值;裸土在两波段的反射率相近,NDVI趋近于零;只有植被区域的NDVI为正,这成为区分植被与非植被信息的重要判别条件,是NDVI成为应用最为广泛的一种植被指数。

2)差值植被指数DVI是通过两个波段的差值来定义的:

| ${\rm{DVI = NIR - R}}$ | (2) |

DVI对土壤背景的变化非常敏感,适用于监测植被的生态环境,但当覆盖率大于80%时灵敏度下降,因此对低、中覆盖率,或者早、中期发育情况下的植被监测更为有效。

3) LBP纹理特征。LBP纹理描述是由Ojala[3]提出的,在纹理区分和计算简单方面显示出巨大的潜力。LBP值能够描述局部纹理的空间结构。公式如下:

| $ {\rm{LBP}}({x_c}, {y_c}) = \sum\limits_{p = 0}^8 {\mathit{S}\left( {{i_p} - {i_c}} \right){2^p}} $ | (3) |

其中,ic是中心像素(xc, yc)的亮度;ip是相邻像素的亮度; S是符号函数,即

| $S(x) = \left\{ \begin{array}{l} 1, \;\;x \ge 0\\ 0, \;\;x < 0 \end{array} \right.$ | (4) |

自适应共振理论(adaptive resonance theory, ART)是一种自组织产生认知编码的神经网络[4], 其最大的特点就是解决一般网络难以解决的适应性和稳定性问题,一般网络在学习新模式时常对以前的学习有影响,而ART网络的自组织反馈功能、增量式学习以及快训练和慢训练使其既能识别那些较少出现的类型,又能在出现噪声时相对稳定,识别出已经学习过的类型[5]。现有的ART神经网络有ART1、ART2、Fuzzy ART和ARTMAP等。

模糊自适应共振网络(fuzzy adaptive resonance theory, FART)[6]是一种无教师、自组织的神经网络。它通过内部单元的相互作用,完成非常复杂的非线性处理和信息交换。Fuzzy ART具有人类视觉的某些特性,可以处理模糊信息、能实时自学习、能自动将注意集中到已学习过的样本、能自动确定样本类别数等。Fuzzy ART结构与ART1基本相似,但增加了对输入向量的归一化处理。其结构可以参见文献[7]。本文利用改进的FART算法[8]对Worldview影像进行植被的提取。

将初始样本的特征值输入到改进FART网络中,设置适当的警戒线参数和学习率。训练完毕后,将得到若干类及其若干修正权值。用其对原始实验图像进行分类,能够将植被分割出来。这是一个监督分类过程。算法流程参见文献[9]。

FART网络有3个主要参数:警戒值ρ、类别选择参数α、学习率参数β。类别选择参数α的值越小, 对分割的结果影响越小,特别是当0 < α < 5时,分割的结果几乎不受影响,在实验中,一般取α=1。学习率参数对学习速度有影响,β越大,则对输入的特征向量学习越快;ρ表示输入向量与权值之间模糊相似度的门限,它反映了各个类别中同类样本之间的最小相似度,影响分类数目和各类样本的数目[10]。

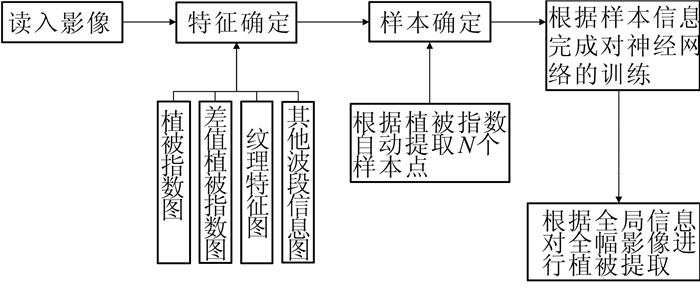

1.3 植被提取流程本文利用影像固有的辐射信息,根据归一化植被指数,自动遴选出样本点,将其归一化植被指数、差值植被指数、LBP纹理特征等输入Fuzzy ART神经网络,获取网络参数,然后完成整幅卫星影像的植被提取。流程图如图 1所示。

|

| 图 1 植被提取流程图 Figure 1 Flow Chart of Vegetation Detection |

2 实验与分析

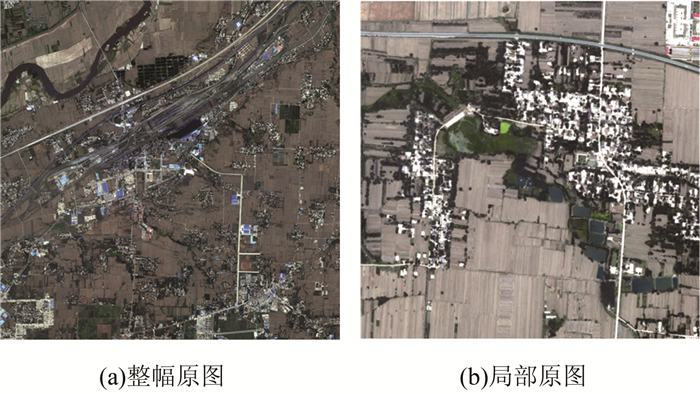

实验数据采用某地区的局部以及整幅Worldview影像,由波段4、3、2三个波段合成的真彩色影像,整幅见图 2(a),局部见图 2(b), 两幅影像当中均包含居民地、植被、池塘、道路、农田等多种地物。

|

| 图 2 Worldview影像原图 Figure 2 Worldview Image |

遥感图像处理主流软件包括eCognition、ENVI等。eCognition以其面向对象的分类方法,可获得比较理想的结果,ENVI软件需要选取样本进行植被提取。本文将植被提取结果与这两个软件的结果进行了比较。

本文根据影像的波段8(近红外)以及波段3(红)的数据,计算归一化植被指数,自动选取其中最大的10 000个点作为样本点,输入FART网络(学习率为0.001 5,警戒值为0.6)进行训练;完成训练之后,将近红外波段、绿波段、归一化植被指数、差值植被指数、LBP等影像特征组成特征向量输入到神经网络中,对全局影像进行分类,提取出植被信息。

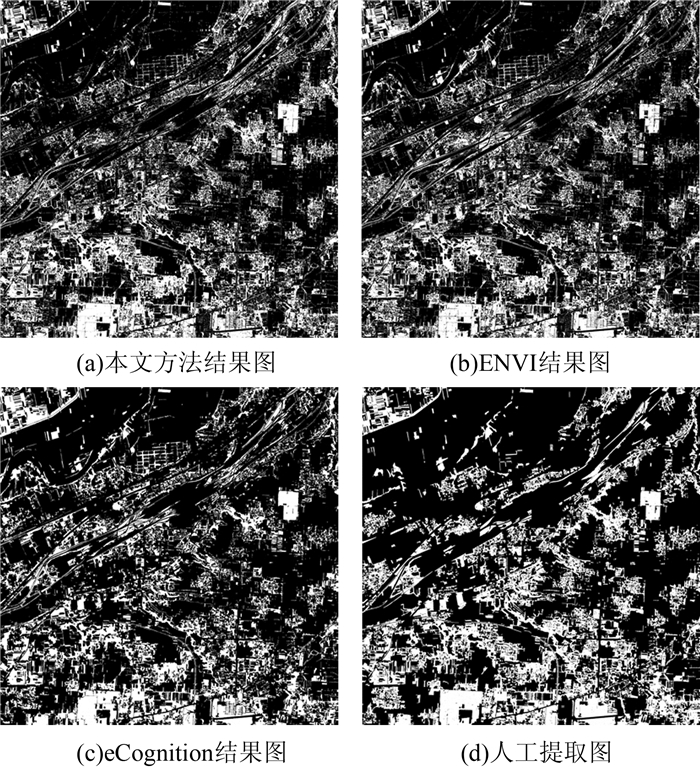

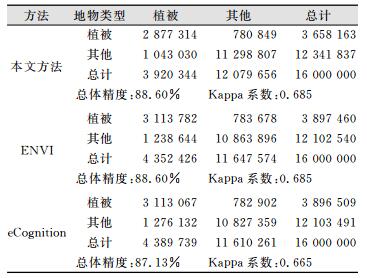

整幅影像的分类结果见图 3(a),图中白色代表植被,黑色代表非植被。ENVI中有平行六面体法、最小距离法、最大似然法、马氏距离法4种监督分类方法,通过实验比较出马氏距离法的精度最高。马氏距离法的分类结果见图 3(b),图中白色代表植被,黑色代表非植被。用eCognition对整幅影像进行植被提取,其分类结果见图 3(c)。将3个结果图皆以人工提取图(图 3(d))为参考计算混淆矩阵,3种分类方法的混淆矩阵见表 1,由3个混淆矩阵对比可知,本文方法提取植被的总体精度为88.60%,优于eCognition的87.13%和ENVI的87.36%,而3种方法的Kappa系数大致相当。

|

| 图 3 Worldview整幅影像植被提取的示意图 Figure 3 Vegetation Extraction on the Whole Worldview Image |

| 表 1 整幅影像分类结果的混淆矩阵 Table 1 The Confusion Matrix of the Whole Image Classification |

|

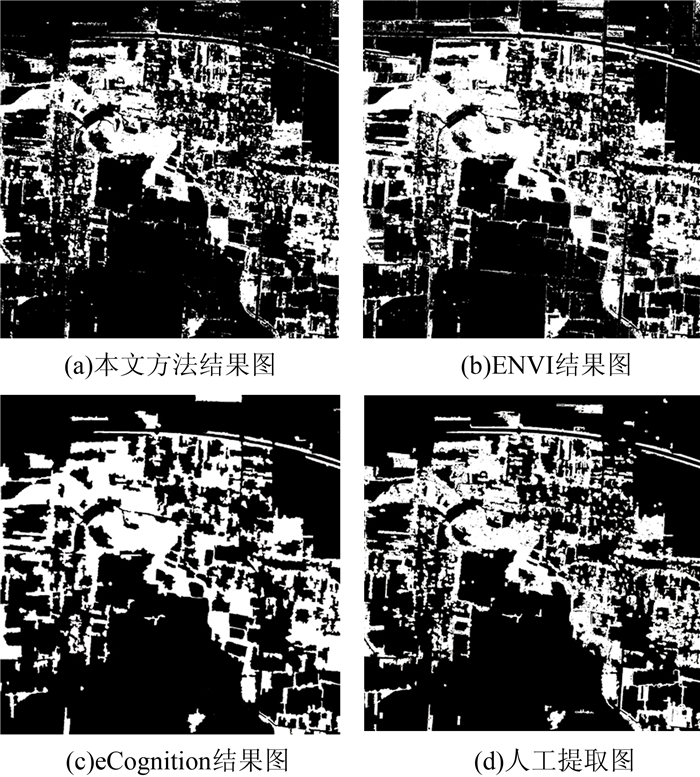

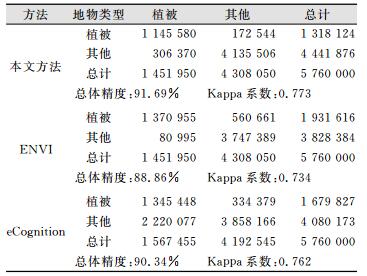

局部影像的分类结果见图 4(a), 马氏距离法的分类结果见图 4(b),图中白色代表植被,黑色代表非植被。用eCognition对局部影像进行植被提取,其分类结果见图 4(c)。将3个结果图皆以人工提取图(图 4(d))为参考计算混淆矩阵,3种分类方法的混淆矩阵见表 2,由3个混淆矩阵对比可知,本文方法提取植被的总体精度为91.69%,优于eCognition的90.34%和ENVI的88.86%,而3种方法的Kappa系数大致相当。

|

| 图 4 Worldview局部影像植被提取的示意图 Figure 4 Vegetation Extraction on the Partial Worldview Image |

| 表 2 局部影像分类结果的混淆矩阵 Table 2 The Confusion Matrix of the Partial Image Classification |

|

由实验结果可以得出,本文法能够较为有效地对Worldview影像的植被进行提取。相比传统的监督分类而言,本文方法实现了样本的自动化提取,而不需通过人机交互来提取样本点。

3 结束语随着卫星影像空间分辨率的提高,影像信息更加丰富,其结构和纹理更加突出,同时,卫星遥感影像的数据量急剧增加,如何快速、有效地从这些大数据中快速获取感兴趣信息已成为当前的研究热点[10]。

本文针对整幅Worldview卫星影像提出了一种利用简单特征进行自动化提取植被的方法。该方法利用卫星影像的11 bit辐射信息,依据归一化植被指数自动遴选样本点,然后利用样本点的NDVI、DVI、LBP等特征完成Fuzzy ART神经网络的训练,获取神经网络参数,最后完成整幅影像的植被提取。该结果与遥感图像处理主流软件eCognition和ENVI进行了比较,植被提取精度有所提高。

| [1] |

许凯, 秦昆, 杜鹚. 基于AdaBoost的高分辨率遥感影像城市绿地提取算法[J].

计算机工程与应用,2009,44(20) : 23–25.

Xu Kai, Qin Kun, Du Yi. New Algorithm of Extraction of Urban Vegetation from High Resolution Image Based on AdaBoost[J]. Computer Engineering and Applications,2009,44(20) : 23–25. |

| [2] | Xu F, Jiang W W. Biological Vision for Urban Vegetation Detection in Color Remote Sensing Imagery[C]. The 3rd International Conference on Remote Sensing, Environment and Transportation Engineering (RSETE 2013), Nanjing, 2013 |

| [3] | Ojala T, Pietikäinen M. A Comparative Study of Texture Measures with Classification Based on Feature Distributions[J]. Pattern Recognition,1996,29(1) : 51–59. DOI:10.1016/0031-3203(95)00067-4 |

| [4] |

骆剑承, 王钦敏, 周成虎, 等. 基于自适应共振模型的遥感影像分类方法研究[J].

测绘学报,2000,31(2) : 145–150.

Luo Jiancheng, Wang Qinmin, Zhou Chenghu, et al. Adaptive Resonance Theory for Classification of Remotely Sensed Image[J]. Acta Geodaetica et Cartographica Sinica,2000,31(2) : 145–150. |

| [5] | Gopal S, Woodcock C E, Stranler A H. Fuzzy Neural Network Classification of Global Land Cover form a LoAVHRR Data Set[J]. Remote Sensing of Environment,1999,(67) : 230–243. |

| [6] | Carpenter G A, Crossberg S, Rosen D B. ART2-A:An Adaptive Resonance Algorithm for Rapid Category Learning and Recognition[J]. Neural Networks,1991,(4) : 493–504. |

| [7] | Carpenter G A, Grossberg S, Rosen D B. Fuzzy ART:Fast Stable Learning and Categorization of Analog Patterns by an Adaptive Resonance System[J]. Neural Networks,1991,(4) : 759–771. |

| [8] |

刘宇红, 刘桥, 任强. 基于改进的模糊ART的语音信号端点检测与切分[J].

系统工程与电子技术,2004,26(8) : 1151–1154.

Liu Yuhong, Liu Qiao, Ren Qiang. Speech Signal Endpoint Detection and Separation Based on Improved Fuzzy ART[J]. Systems Engineering and Electronics,2004,26(8) : 1151–1154. |

| [9] |

武鹏. 增强的Fuzzy ART在苹果图像分割中的应用[J].

微型机与应用,2010,29(14) : 36–39.

Wu Peng. Application of Improved Fuzzy ART Neural Network for Segmentation of Apple Image[J]. Microcomputer & Its Applications,2010,29(14) : 36–39. |

| [10] |

余粉香, 王光霞, 万刚. 大数据量遥感影像的快速调度与显示[J].

海洋测绘,2006,26(2) : 27–30.

Yu Fenxiang, Wang Guangxia, Wan Gang. Rapid Allocation and Display of Massive Remote Sensing Image[J]. Hydrographic Surveying and Charting,2006,26(2) : 27–30. |

2016, Vol. 41

2016, Vol. 41