| 基于非局部生成对抗网络的单张散焦图像去模糊 |

2. 广东开放大学人工智能应用创新研究中心,广东 广州,510091

2. AI Application and Innovation Research Center, The Open University of Guangdong, Guangzhou 510091, China

随着显示设备分辨率的日益提高,人们对图像清晰度的要求也越来越高。但是拍摄过程中为了获得足够的光线需要使用景深浅的宽光圈,会导致景深外的场景区域出现散焦模糊[1],所以通常很难从单次拍摄中获得全焦图像。

对散焦部分进行去模糊处理,复原其细节纹理信息是本文图像增强工作的核心。近年来针对图像去模糊任务有许多研究成果,在深度学习领域,Isola等[2]将生成对抗网络加入模型,得到了快捷且优秀的去模糊框架DeblurGAN。但是散焦模糊区别于其他模糊存在明显的扩散特性[3],即当前景物体清晰对焦背景散焦时,前景物体不受背景散焦的影响,反之当前景物体散焦时,散焦扩散效应会导致模糊物体大于原始聚焦物体,所以单纯的针对边缘特征进行图像重建收效甚微。为了解决上述问题,Lee等[4]利用自己合成的散焦模糊数据集,训练了一个端到端的散焦图估计网络(DMENet),用于空间变化的散焦图估计。Ma等[5]使用光场相机构建了真实数据集DED数据集,以散焦图估计作为辅助任务来进行单张图像的散焦去模糊工作,取得了优于DMENet的成绩。

本文在前人工作的基础上,加入融合注意力机制的由粗到细的非局部[6]模块,提取相似度高、关联性强的细节特征来丰富散焦区域的图像纹理,并引入生成对抗网络[7]模型来生成纹理特征,实现散焦图的去模糊。利用编码器-解码器结构将图像的浅层和深层特征以不同的权重进行融合,得到指导图像融合的预测散焦图。本文提出的DNGAN模型可以在散焦图像去模糊重建的同时,完成散焦图的预测,实现客观评价指标和图像视觉对比效果的明显提升。

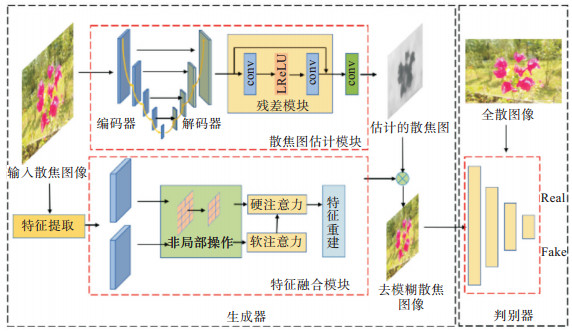

1 非局部生成对抗散焦去模糊模型 1.1 算法网络结构本文使用生成对抗网络,整个DNGAN模型的架构见图 1,其中生成器的设计包括了3个部分:特征提取模块、散焦图估计模块和特征融合模块。判别器采用VGGNet[8]的基本结构,通过训练缩小生成器的生成结果和真实全焦图像之间的差距。

|

| 图 1 散焦图像非局部生成对抗去模糊模型整体架构 Fig.1 The Overall Architecture of a Non-Local Generative Adversarial Deblurring Model for Defocused Images |

特征提取模块将输入散焦图像传入一个3×3卷积层,提取图像的低层特征,之后转换为64通道的特征图输入到多个首尾相连的残差模块中,进一步提取更高层的特征。实现了散焦图像的深浅层特征向量的充分提取。

散焦图估计模块使用附加跳跃连接的编码器- 解码器的结构,解析特征的深浅层信息并赋予不同权重,对散焦图进行预测。之后将预测结果作为权重传入特征融合模块中,使散焦区域更多地获取非局部操作提取的细节纹理信息。该模块采用预先训练的VGG19 [8]初始化编码器,使用上采样卷积代替反卷积[9]构建解码器,通过跳跃连接为每层特征建立信息传递以充分利用深浅层特征。最后通过残差模块和1×1卷积层、批归一化和Leak ReLU激活函数得到估计的散焦图。

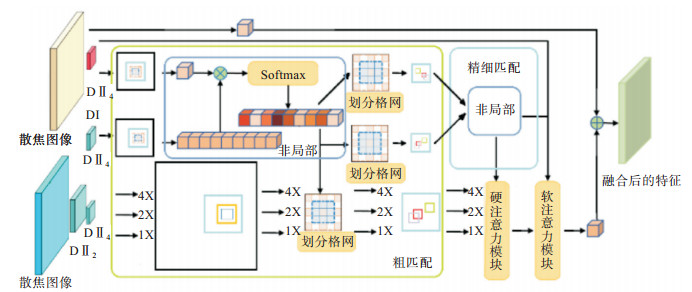

特征融合模块引入了软硬注意力机制,通过由粗到细的非局部相似度计算,最大限度的挖掘相似纹理信息,并结合散焦图估计模块的预测结果,联合指导散焦区域的去模糊重建,模块结构图如图 2所示。模块将输入的散焦图像特征图通过大卷积核Softmax计算得到高相似性特征对应的位置,再在该区域内划分格网进行同样方法的细分相似查找,获得最大相关值和其对应的位置,分别传入软、硬注意力模块。在硬注意力模块中,输入的最相似位置与散焦图像特征进行通道级联,传入卷积层得到融合特征。在软注意力模块中,将融合的特征与最大相关性向量进行点乘,并与不同尺度的散焦图像特征进行交叉融合,使相关性强的纹理信息获得相对更大的权重,相关性弱的纹理信息能够因小权重而得到抑制。最后将计算得到的初步融合后的特征值与散焦估计模块生成的散焦图进行点积,得到兼顾散焦信息的特征融合结果。

|

| 图 2 散焦图像特征融合模块模型架构 Fig.2 The Model Architecture of Defocused Image Feature Fusion Module |

1.2 损失函数

本文采用的损失函数包括了L1损失(L1范数损失)、对抗损失Lg(二分类交叉熵损失)、散焦损失Ld和感知损失Lp。其中较为重要的是散焦损失函数和感知损失函数,具体的公式原理如下。

散焦损失Ld:对预测散焦图像Idb和真实散焦图像IdbGT对、预测散焦图Idm和真实散焦图IdmGT对做差,然后进行2-范数运算,计算所有元素的算术平均值后求和得到散焦损失,具体公式为:

| $ L_{\mathrm{d}}=\operatorname{mean}\left\|I_{\mathrm{db}}^{\mathrm{GT}}-I_{\mathrm{db}}\right\|+\operatorname{mean}\left\|I_{\mathrm{dm}}^{\mathrm{GT}}-I_{\mathrm{dm}}\right\| $ | (1) |

感知损失[10]Lp:将全焦图像I卷积得到的特征与生成器网络输出的去模糊的散焦图像

| $ L_{p}(\hat{I}, I ; \phi, l)=\frac{1}{h_{l} w_{l} c_{l}} \sqrt{\sum\limits_{i, j, k}\left(\phi_{i, j, k}^{(l)}(\hat{I})-\phi_{i, j, k}^{(l)}(I)\right)^{2}} $ | (2) |

其中,ϕ表示预训练好的VGG网络;l表示采用第l层的特征图;hlwlcl中的h、w、c分别对应图像的高、宽和通道。总的损失函数Lall表达式如下:

| $ L_{\text {all }}=L_{1}+L_{\mathrm{g}}+\lambda L_{\mathrm{d}}+L_{\mathrm{p}} $ | (3) |

其中,λ = 1 × 10-1。

2 实验结果与分析本文通过广泛的实验从客观评价指标和图像视觉对比效果两方面论证本文提出的网络DNGAN在散焦图像去模糊和散焦图估计任务中的优势。

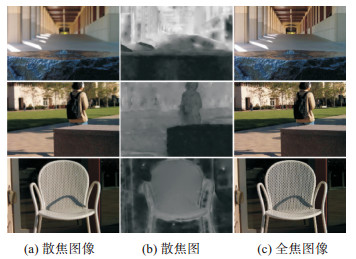

2.1 数据集及实验环境数据集:本文数据集采用DED数据集[5],它是一个小型公开数据集,包含1 012个图像对,分为散焦图像、散焦图和全焦图像3个部分,见图 3。DED数据集中数据来自多视图数据集[11]和由LytroIllum光场相机[12]捕获的图像。本文实验选择其中的48组作为验证集,剩下的964组为训练集,并对图片进行随机翻转、颜色变化等数据增强[13]操作以丰富训练数据内容,提升结果的鲁棒性。另外实验引入了公开数据集SYNDOF [4]来验证DNGAN模型的泛化能力和鲁棒性。

|

| 图 3 训练数据集展示图 Fig.3 Training Dataset Display Diagram |

实验环境:在训练过程中,使用Adam优化器,参数设置为β1 = 0.9,β2 = 0.999 and ε = 10-8,weight_decay = 4 × 10-4,训练150个epoch,在GeForce RTX 3090上面训练40 h完成。

2.2 评价指标本文选用峰值信噪比(peak signal to noise ratio,PSNR)和结构相似性(structural similarity,SSIM)两个评价指标评估模型的去模糊效果,两者均为值越大图像越接近地面真实图像;选用均方误差(mean square error,MSE)和平均绝对误差(mean absolute error,MAE)两个评价指标评估散焦图预测效果,两者均为值越小图像效果越好。

2.3 实验结果分析对比实验分为4大部分,分别是图像去模糊相关模型的效果对比实验、去模糊模型的泛化性实验、散焦图估计相关模型的效果对比实验和DNGAN模型模块的消融实验。

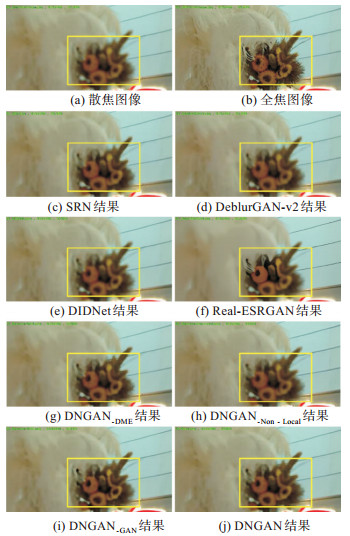

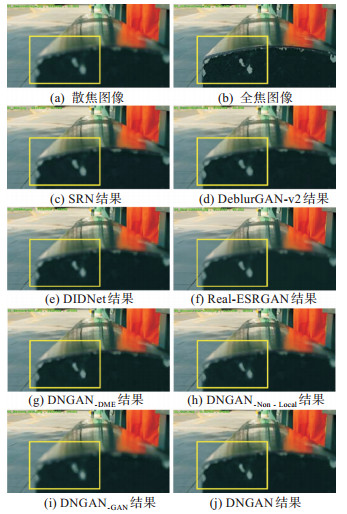

2.3.1 图像去模糊相关模型的效果对比实验对于散焦图像的图像去模糊,实验输出了验证集数据在SRN [14]、DeblurGAN-v2 [15]、DIDNet [5]模型下的视觉效果图,以及进行了降采样Real-ESRGAN [16]模型的结果图,对比图见图 4和图 5。实验计算了各个模型的峰值信噪比和结构相似性的值,见表 1,可以看出均低于本文DNGAN模型结果。对比SRN去模糊模型,输出图像(见图 4(c)、图 5(c))中依旧存在较严重的模糊现象。对于DeblurGAN-v2去模糊模型,图 4(d)较图 4(j)选中区域缺少毛流纹理,图 5(d)较图 5(j)选中区域掉漆处的边缘并不清晰。由图 4(f)和图 5(f)可以看出,经过下采样的Real-ESRGAN [16]模型结果过于平滑,缺少高频纹理信息。对比DIDNet模型(见图 4(e)、图 5(e)),本文模型结果的细节更为丰富且真实。

|

| 图 4 散焦图像去模糊在DED数据集室内场景结果对比图 Fig.4 Comparison of the Results of Deblurring of Defocused Images on Indoor Scenes in the DED Dataset |

|

| 图 5 散焦图像去模糊在DED数据集室外场景结果对比图 Fig.5 Comparison of the Results of Deblurring of Defocused Images on Outdoor Scenes in the DED Dataset |

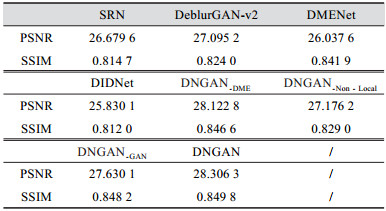

| 表 1 峰值信噪比和结构相似性结果对比 Tab.1 Results of PSNR and SSIM |

|

2.3.2 去模糊模型的泛化性实验

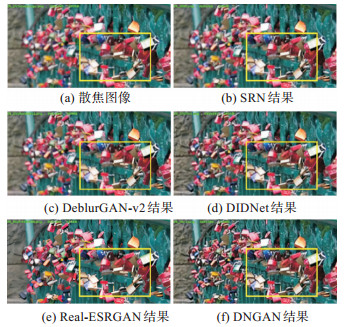

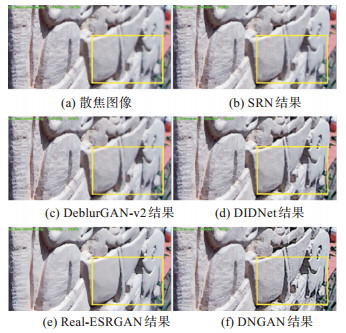

为了验证本文模型在其他数据集上的泛化能力,本文选择SYNDOF [4]数据集进行了测试,结果见图 6、图 7。对比黄色框选中区域可以看出本论文提出的DNGAN模型在复杂场景去模糊任务中,保证了图像的色彩一致性且纹理边缘更为清晰,细节更为丰富;在重复纹理场景下,如图 7(f)所示,DNGAN模型重建出了更多石面凹凸不平的细节纹理,模型结果更为真实。

|

| 图 6 在SYNDOF数据集上复杂场景下的散焦图像实验结果对比图 Fig.6 Comparison of Experimental Results of Defocused Images in Complex Scenes on the SYNDOF Dataset |

|

| 图 7 在SYNDOF数据集上重复纹理场景下的散焦图像实验结果对比图 Fig.7 Comparison of Experimental Results of Defocused Images under Repeated Texture Scenes on the SYNDOF Dataset |

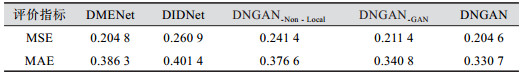

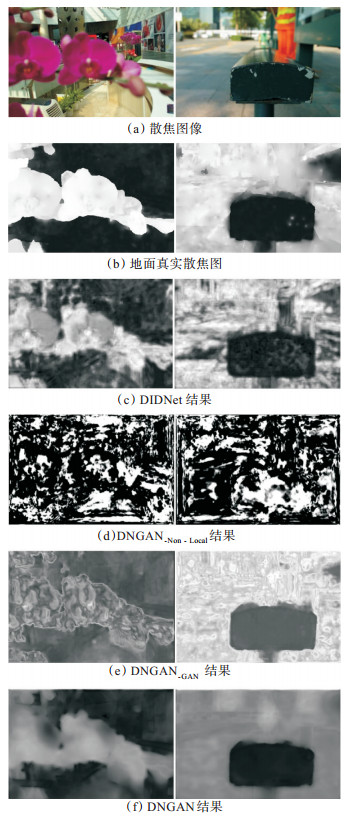

2.3.3 散焦图估计相关模型的效果对比实验

在划分的DED验证数据集上,主要对比了DIDNet [14]模型,评价指标结果见表 2,DNGAN较其他模型MSE和MAE值更低。对比图 8(c)中DIDNet模型的生成结果,本文提出的DNGAN模型预测的散焦图散焦部分标记准确,黑白区域划分规整,且边界更为清晰。

| 表 2 均方误差和平均绝对误差结果对比 Tab.2 Results of MSE and MAE |

|

|

| 图 8 预测的散焦图结果对比图 Fig.8 Comparison of the Predicted Defocus Map Results |

2.3.4 模型模块消融实验

本文的消融实验训练了移除散焦图估计模块的模型DNGAN-DME、移除Non-Local模块的模型DNGAN-Non - Local和移除生成对抗网络模块的模型DNGAN-GAN。在去模糊实验中,散焦图估计模块可以充分学习散焦特征,移除该模块后,图像特征边缘会出现一定程度的扩散现象(见图 4(g)、图 5(g)),评价指标(见表 1)降低;移除非局部模块后(结果见图 4(h)、图 5(h)、表 1),纹理整体模糊,因为非局部模块可以有偏重地汇总相似纹理指导模型去模糊重建;GAN模块可以生成更为丰富的细节纹理特征,移除该模块后,图 4(i)、图 5(i)中黄色区域纹理趋于平滑,表 1中的客观评价指标值均低于本文提出的DNGAN模型。在散焦图估计对比实验中,由图 8(d)、8(e)可以看出预测的散焦图存在不合常理的错误,且客观评价指标MSE、MAE(见表 2)也明显升高。

3 结束语本文针对散焦图像特点提出了非局部生成对抗网络模型DNGAN,在散焦图像去模糊重建和散焦图估计这两个领域都取得了不错的成绩。模型的核心思想是通过计算散焦图像特征的相似度为更相似的区域特征提供更高的权重,结合估计的散焦图中对于散焦区域的预测,有偏重的提取更多细节信息,通过生成对抗网络生成更丰富的纹理特征,更好的完成去模糊任务,提升散焦图像的质量。

因为散焦图像的产生具有一定程度的不可避免性,如何利用好散焦图让散焦图像取得更好的图像重建效果是非常重要的研究领域。本文实验是在小型真实数据集进行的训练,虽较其他模型有一定质量提升,但因为数据集过小且图像来源较为单一,实验结果也存在一定的局限性。后续工作将构建大型的真实数据集,为训练提供更全面的参考数据,实现多种型号设备拍摄的、具有更复杂场景的散焦图像的图像增强,提升模型的泛化性和鲁棒性。

| [1] |

Abuolaim A, Brown M S. Defocus Deblurring Using Dual-Pixel Data[C]. European Conference on Computer Vision, Springer, Cham, 2020: 111-126

|

| [2] |

Isola P, Zhu J Y, Zhou T, et al. Image-to-Image Translation with Conditional Adversarial Networks[C] //Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2017: 1 125-1 134

|

| [3] |

Ma H, Liao Q, Zhang J, et al. An α -matte Boundary Defocus Model-Based Cascaded Network for Multi-focus Image Fusion[J]. IEEE Transactions on Image Processing, 2020, 29: 8 668-8 679. DOI:10.1109/TIP.2020.3018261 |

| [4] |

Lee J, Lee S, Cho S, et al. Deep Defocus Map Estimation Using Domain Adaptation[C] //Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2019: 12 222-12 230

|

| [5] |

Ma H, Liu S, Liao Q, et al. Defocus Image Deblurring Network with Defocus Map Estimation as Auxiliary Task[J]. IEEE Transactions on Image Processing, 2021, 31: 216-226. |

| [6] |

Wang X, Girshick R, Gupta A, et al. Non-local Neural Networks[C] //Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2018: 7 794-7 803

|

| [7] |

梁俊杰, 舰晶, 蒋正锋. 生成对抗网络GAN综述[J]. 计算机科学与探索, 2020, 14(1): 1-17. |

| [8] |

Simonyan K, Zisserman A. Very Deep Convolutional Networks for Large-Scale Image Recognition[J]. arXiv preprint arXiv: 1409. 1556, 2014

|

| [9] |

Odena A, Dumoulin V, Olah C. Deconvolution and Checkerboard Artifacts[J]. Distill, 2016, 1(10): e3. |

| [10] |

吴从中, 陈曦, 季栋, 等. 结合深度残差学习和感知损失的图像去噪[J]. 中国图象图形学报, 2018, 23(10): 1 483-1 491. |

| [11] |

Dansereau D G, Girod B, Wetzstein G. LiFF: Light Field Features in Scale and Depth[C] //Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2019: 8 042-8 051

|

| [12] |

Ng R, Levoy M, Brédif M, et al. Light Field Photography with a Hand-Held Plenoptic Camera[D]. Stanford : Stanford University, 2005

|

| [13] |

朱晓慧, 钱丽萍, 傅伟. 图像数据增强技术研究综述[J]. 软件导刊, 2021, 20(5): 230-236. |

| [14] |

Tao X, Gao H, Shen X, et al. Scale-Recurrent Network for Deep Image Deblurring[C] //Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2018: 8 174-8 182

|

| [15] |

Kupyn O, Martyniuk T, Wu J, et al. Deblurgan-v2: Deblurring(Orders-Of-Magnitude)Faster and Better[C] // Proceedings of the IEEE/CVF International Conference on Computer Vision, 2019: 8 878-8 887

|

| [16] |

Wang X, Xie L, Dong C, et al. Real-Esrgan: Training Real-World Blind Super-Resolution with Pure Synthetic Data[C] //Proceedings of the IEEE/CVF International Conference on Computer Vision, 2021: 1 905-1 914

|

2022, Vol. 47

2022, Vol. 47