2. College of Automation Engineering, Nanjing University of Aeronautics and Astronautics, Nanjing 210016, China

微小型无人机以其结构简单、飞行稳定、易于操控、低噪声、无污染、安全危害性小等优势,在航空摄影、输电线路巡检、灾情考察、军事侦察等多个领域展现出广阔的应用前景[1, 2]。然而,目前微小型无人机的导航定位主要采用惯性测量单元(inertial measurement unit,IMU)和GPS的组合方式,这种方式虽然大多数情况下可以满足导航的要求,但仍具有一定的局限性。这是因为GPS无法在室内使用,且易受干扰产生漂移;IMU价格昂贵且存在温漂,难以实现长时间的精确定位。此外,无人机的航向感知主要依靠磁罗盘,一旦受到干扰将严重影响无人机的悬停及机动飞行的轨迹控制精度,甚至导致严重事故。

基于计算机视觉的无人机导航技术[3, 4, 5]用于从图像中获取导航有效信息,实现对图像中运动或静止目标的提取,具有抗干扰性强、导航精度高的优点。其中,采用人工标志物的方式进行相对位置的判定,具有定位精确、易实现、功耗低、价格便宜等优点,在一些特定建筑设施如输电铁塔的绝缘子检测、从建筑外部对指定房间的监视、化工杆塔类设备指定部件的检查等的应用场合能够取得较好的效果。文献[6]针对具有预设标志点的场景,提出一种基于影像序列的室内视觉导航算法,并通过实验验证了算法的可行性和有效性,然而,其算法相对复杂,计算量较大,不易于工程实现;文献[7]针对航天器地面中性浮力实验的实验体导航问题,研究了利用计算机视觉和捷联惯性导航系统进行实验体组合导航的算法,实验验证了算法的可行性。

基于此,本文提出一种新颖的基于人工标志的无人机的视觉导航方法。该方法首先通过设定人工标志,然后利用无人机机载摄像头实时采集无人机相对标志物的图像,通过无线图像传输装置将图像发回到无人机地面监控设备,地面设备对实时发回的图像进行视觉分析,对图像中的标志物进行识别,从而计算出无人机相对人工标志的偏差,同时,将该偏差发送回机载飞行控制计算机。机载飞行控制计算机收到地面设备发回的偏差,并根据该偏差计算生成相应的修正控制律,控制无人机的姿态,从而进一步修正无人机的位置偏差。

1 无人机视觉导航系统架构

基于人工标志的无人机视觉导航系统架构如图 1所示。

|

| 图 1 无人机视觉导航系统架构 |

系统主要包括机载设备以及地面设备。机载设备包括:接收机、飞行控制计算机、摄像机、无线图像传输设备以及无线数据传输设备;地面设备主要包括:Ground control station(GCS)计算机、无线图像传输设备以及无线数据传输设备。机载设备与地面设备之间存在数据传输链路和图像传输链路。摄像机与无线图像传输设备通过专用接口连接,保证摄像头捕获的视频信息可以实时清晰地发回地面监控设备,以便及时地进行视觉分析,地面监控设备对获取的视频信息进行计算与分析,得到无人机相对标志物的当前位置、姿态及方向信息,并将其发送给飞行控制计算机以控制无人机完成相对标志物的定位与定向飞行操作。同时,该系统还包括人工标志,标志物安装在特定的人工设施或天然物体的外表面上,用作视觉定位定向的参照。

地面站软件系统与机载软件系统的工作流程如图 2所示,主要流程包括:1)机载摄像头将实时采集的无人机相对标志物的图像发回地面站,地面站接收到实时发回的图像,通过对图像序列的视觉分析,识别标志物,从而计算无人机相对标志物的偏差;2)将该偏差数据发送到无人机机载飞行控制计算机;3)飞行控制计算机根据接收到的偏差数据,计算无人机的轨迹控制律,调整无人机的姿态,实现无人机的轨迹控制,从而完成视觉导引的一个工作流程;4)重复整个过程,直到视觉导引结束。

|

| 图 2 系统工作流程 |

2 视觉导航算法设计与实现

本文提出的基于人工标志物的视觉导航方法主要通过具有特定颜色、形状的标志物进行对无人机的视觉导引,这就需要无人机对特征标志物进行跟踪识别。在特征跟踪算法中的Continuously adaptive mean-shift(CamShift)算法[8, 9, 10],对感兴趣目标颜色特征跟踪具有较好的效果,且人工标志物一般具有与背景环境反差较大的颜色,该算法能够通过颜色快速准确地定位到标志物的位置,通过计算无人机与标志物的相对位置偏差,进行对无人机的视觉导引,通过保持无人机与标志物的相对关系,即可实现无人机的相对定位。

除此之外,作者对算法深入研究还发现,如果将标志物做成长、宽差异明显的矩形,算法在搜索目标的迭代过程中会计算出一个长轴的方向角,可将方向角作为标志物的方向,用于对无人机航向的引导。虽然CamShift算法并非首次应用于无人机视觉导航,但是本文所提出的将标志物质心位置与图像中心的偏差以及方向角偏差作为引导无人机视觉导航的控制量的方法尚属首次,对基于视觉的无人机导航方法具有重要的参考价值和补充。

2.1 基于CamShift的特征目标跟踪算法

基于CamShift的特征目标跟踪算法的实现过程如下:

首先,将无人机获取的图像序列从RGB颜色空间转化到HSV颜色空间[11, 12],并选取感兴趣区域,利用感兴趣区域图像的Hue色度分量进行直方图统计,计算感兴趣区域色彩直方图 ,直方图表示了不同H分量出现的概率,

,直方图表示了不同H分量出现的概率, 的计算公式为

的计算公式为

然后,构建颜色概率分布图,根据图像中各个像素点的色度值可以计算出其为目标的概率,该过程也称作反向投影。其中,颜色概率图中第i个像素点的像素值wi为

同时,为了便于直观显示,需将颜色概率分布图转化为8位灰度投影图,可通过相应的比例变换将权值映射到0,255,概率为1的像素值设置为255,概率为0的像素值设置为0,其他像素也转化为相应的灰度值。所以,灰度投影图中各像素点的灰度值实际上就反映了其为目标的概率大小。

为了计算目标的位置,首先需计算概率图的0阶矩和1阶矩,其计算公式为

根据计算所得的0阶矩和1阶矩,可以计算获得目标的质心位置(xc,yc):

同时,为进一步实现对运动物体方向的跟随,需要获取该目标的方向角,这样即可实现对完整运动物体的视觉跟踪。

长轴的方向角可通过颜色概率图的2阶矩获得,其2阶矩为

这样,就完成了运动目标的质心位置以及方向角的计算。

2.2 算法实现流程

基于CamShift的特征目标跟踪算法实现流程为:

1)选择目标区域;2)计算目标区域的色彩直方图;3)将图像转化为色彩概率分布图;4)计算搜索区域的质心;5)将搜索区域中心移到该质心处,判断质心是否收敛;6)重复步骤4),直到质心处收敛;7)计算搜索结果的主轴长度和方向。

算法主要是通过步骤4)、5)、6)的重复,使重新计算的质心位置收敛,从而可得到目标新的质心位置;然后通过图像的2阶矩计算获得搜索结果的主轴长度和方向。

3 实验验证

为验证本文所提方法的正确性和有效性,开展了无人机对带有人工标志的地面小车的跟随实验。无人机选用四旋翼无人机,摄像头安装在四旋翼无人机云台上;实验小车上带有一个红色矩形的人工标志,标志物尺寸为23 cm×12 cm,通过人工牵引来实现小车的低速移动和变向,视觉分析通过标志物的颜色、形状进行识别。

实验1:无人机悬停即摄像头静止,小车运动

实验1情况下跟踪序列中第295、398、532帧的跟踪效果如图 3所示。图中箭头表示识别的目标的长轴的方向角,以进行无人机航向的引导;为便于查看,方向角的数值同时显示在每帧图片的左上角。实验结果表明,无人机在悬停飞行,即摄像头静止时,小车运动的情况下,该算法能实时有效地跟踪安装标志物的小车,算法耗时在4~6 ms之间。

|

| 图 3 实验1情况下的跟踪效果 |

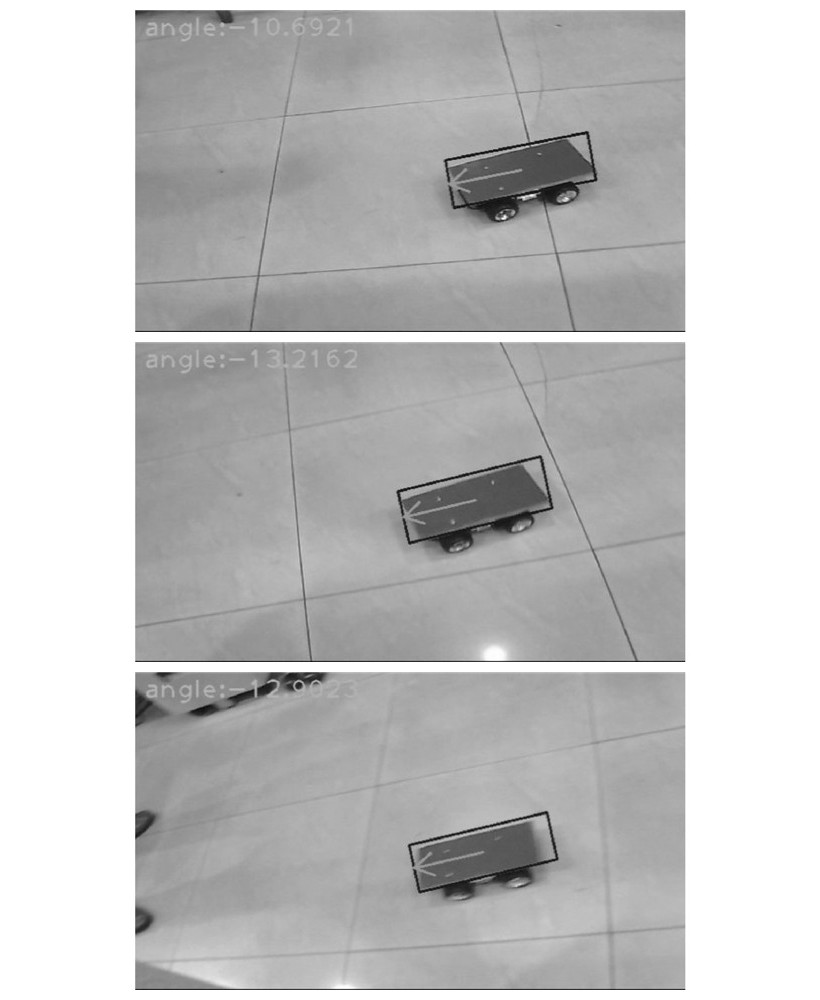

实验2:小车静止,摄像头跟随无人机飞行运动

实验2情况下跟踪序列中第78、110、251帧的跟踪效果如图 4所示。实验结果表明:该算法在小车静止,摄像头跟随无人机运动的情况下,能够有效地跟踪带有标志物的小车,且能够准确地计算获得小车的质心位置以及方向角信息,算法耗时在4~6 ms之间,具有较高的实时性,能够满足无人机视觉导引的需求。

|

| 图 4 实验2情况下的跟踪效果 |

实验3:无人机与小车同时运动

实验3情况下跟踪序列中第109、153、276帧的跟踪效果如图 5所示。实验3实际上是前两种实验的综合,可进一步验证算法的有效性。在实际无人机视觉导航过程中,机载摄像头和地面小车都是会不断地发生运动的,所以,这一组模拟实验更加接近真实的视觉导航过程。

|

| 图 5 实验3情况下的跟踪效果 |

实验结果表明:在摄像头跟随无人机以及地面小车同时运动的情况下,该算法仍能够实时准确地跟踪到标志物,并准确地计算出标志物的质心位置以及相应的方向角。 4 结束语

本文基于CamShift的特征目标跟踪算法对无人机的视觉导航进行了研究,通过理论分析与实验验证得出如下结论:

1)提出一种将标志物质心位置与图像中心的偏差以及方向角偏差作为引导无人机视觉导航的控制量的方法,并通过试验验证了该方法的正确性,这对基于视觉的无人机导航方法具有重要的参考价值。

2)本文所提算法可实现无人机对地面目标的准确跟踪,且具有较好的鲁棒性和实时性。如何将所提算法进一步用于无人机的视觉自主起飞、稳定悬停和着陆将是下一步继续研究的方向。

| [1] | 岳基隆, 张庆杰, 朱华勇. 微小型四旋翼无人机研究进展及关键技术浅析[J]. 电光与控制, 2010, 17(10): 46-52. |

| [2] | 杨成顺, 杨忠, 葛乐, 等. 基于多旋翼无人机的输电线路智能巡检系统[J]. 济南大学学报: 自然科学版, 2013, 27(4): 358-362. |

| [3] | 吴显亮, 石宗英, 钟宜生. 无人机视觉导航研究综述[J]. 系统仿真学报, 2010, 22(S1): 62-65. |

| [4] | COURBON J, MEZOUAR Y, GUÉNARD N, et al. Vision-based navigation of unmanned aerial vehicles[J]. Control Engineering Practice, 2010, 18(7): 789-799. |

| [5] | 张广军, 周富强. 基于双圆特征的无人机着陆位置姿态视觉测量方法[J]. 航空学报, 2005, 26(3): 344-348. |

| [6] | 郝向阳, 张振杰, 刘松林, 等. 一种基于人工标志的室内视觉导航方法[J]. 导航定位学报, 2013, 1(4): 26-30. |

| [7] | 宋琳娜, 方群. 基于人工标志的视觉/SINS组合导航算法研究[J]. 科学技术与工程, 2012, 64(4): 861-866. |

| [8] | ALLEN J G, XU R Y D, JIN J S. Object tracking using CamShift algorithm and multiple quantized feature spaces[C]//Proceedings of the Pan-Sydney Area Workshop on Visual Information Processing. Darlinghurst, Australia, 2004: 3-7. |

| [9] | CHU Hongxia, YE Shujiang, GUO Qingchang, et al. Object tracking algorithm based on CamShift algorithm combinating with difference in frame[C]// 2007 IEEE International Conference on Automation and Logistics. Ji'nan, China, 2007: 51-55. |

| [10] | NOUAR O D, ALI G, RAPHAEL C. Improved object tracking with CamShift algorithm[C]// 2006 IEEE International Conference on Acoustics, Speech and Signal Processing. Toulouse, France, 2006: 11-17. |

| [11] | 符宝鼎, 袁建畅, 郭彩霞. 基于RGB颜色模型棉花杂质的识别算法[J]. 北京纺织, 2005, 26(5): 48-51. |

| [12] | 崔昌华, 朱敏琛. 基于肤色HSV颜色模型下的人脸实时检测与跟踪[J]. 福州大学学报: 自然科学版, 2007, 34(6): 826-830. |