|

收稿日期: 2018-02-10; 预印本: 2018-03-06

基金项目: 高分辨率对地观测系统重大专项(编号:30-Y20A07-9003-17/18);国家自然科学基金(编号:41401399);福建农林大学校杰出青年科研人才计划项目基金(编号:xjq201508)

第一作者简介: 董新宇,1994年生,男,硕士研究生,研究方向为农业资源保护、资源环境遥感。E-mail:dsammy@126.com

通信作者简介: 李家国,1982年生,男,副研究员,研究方向为陆表环境遥感。E-mail:jacoli@126.com

|

摘要

针对无人机遥感技术在提取单株立木信息的限制性问题,提出一种新的自动单株立木信息提取方法。对原始无人机影像进行光谱信息增强处理以突出局部细节特征;通过引入DBI指数自动化确定K-means聚类方法的最优聚类数目,进而对影像像素进行标记;通过利用高斯马尔可夫随机场模型进一步对影像进行分割;使用数学形态学算子等方法对分割结果进行后处理得到单株立木树冠信息,通过图像几何矩原理计算得到单株立木位置以作为其识别的依据。结果表明,应用该提取方法,油松林区和樟子松林区单株立木识别总体精度分别为89.52%和95.65%、单木树冠提取精度分别为81.90%和95.65%,均具有较好地适用性。该方法不需要大量的人工干预和先验知识的输入,大大提高提取方法的自动化程度。

关键词

遥感, 单株立木识别, 单木树冠提取, 樟子松, 油松, 无人机遥感, 高斯马尔可夫随机场

Abstract

Extraction of individual tree information is significant in managing forestry resources and protecting the ecological environment. In addition, this strategy has been extensively applied to forests using high spatial resolution satellite images or Lidar data in recent years. The rapid development of unmanned aerial vehicle remote sensing makes itself play an important role in this field. This study uses high spatial resolution aerial remote sensing images to extract individual tree information automatically. The individual tree information includes individual tree extraction and crown delineation. A novel extraction method of individual tree information was proposed in this study. First, the spectral information of the original images was enhanced through decorrelation stretch. Spectral information enhancement aimed to expand the coupling degree of image information by stretching the principal component information of the bands that are correlated, thus increasing the color saturation of the image. Second, the optimal cluster number of K-means clustering algorithm was obtained by introducing a DBI index, then the image pixels were marked based on the K-means clustering algorithm. On this basis, a GMRF model was constructed for image segmentation. Finally, the segmentation results were post-processed through mathematical morphology to complete individual tree crown delineation, and individual tree detection was based on the position of individual tree calculated by image geometric moment. This study acquired the reference data through visual interpretation to evaluate the result. The verification result showed that the overall accuracies of individual tree detection through this method are 89.52% and 95.65% for medium and low canopy density forests, correspondingly. The accuracies of individual tree crown delineation achieved 81.90% and 95.65% for medium and low canopy density forests, respectively. Therefore, the proposed method is better than the object-oriented method in terms of extraction effect through comparison and analysis. The proposed method can be used to obtain the individual tree information of forestry management rapidly and has high extracting precision based on the verification of results. The proposed method does not require considerable manual intervention and prior knowledge, thus significantly improving the degrees of automation.

Key words

remote sensing, individual tree detection, individual tree crown delineation, Pinus sylvestris, Pinus tabulaeform, Unmanned Aerial Vehicle (UAV) remote sensing, GMRF

1 引 言

林地信息提取是遥感技术应用的重要领域之一。单株立木信息提取主要包括单株立木识别以及单木树冠提取,可为了解林地树种类别、林地密度估计、林地种植成活率估算、林地变化监测和生态资源保护等方面提供切实有效的科学依据。

传统的单株立木信息主要是人工实地测量方式获得,效率缓慢且成本较高,时效性往往也难以达到监测需求。而遥感技术与方法的应用不仅提高单株立木信息提取的效率,而且还提供更加广泛的数据来源,主要包括IKONOS(Gougeon和Leckie,2006)、QuickBird(Ke和Quackenbush,2007)及WorldView系列(Karlson 等,2014)等高空间分辨率卫星影像数据、机载高光谱或多光谱影像数据(Bunting 等,2010)以及机载雷达数据(张齐勇 等,2009;Fang 等,2016;卜帆和石玉立,2017)等。针对特定研究区,往往难以及时获取相应的高空间分辨率卫星遥感影像数据,使得其在监测应用方面具有一定的局限性;而通过机载传感器获取数据方式操作复杂且具有一定的风险性。近年来,无人机遥感技术处于快速发展时期。无人机UAV(Unmanned Aerial Vehicle)具有使用维护便捷、设备体积小、使用成本低、低损耗、低风险、获取影像速度快且分辨率高等特点,使其在区域遥感监测应用方面更具优势(王利民 等,2013)。此外,无人机飞行高度一般较低,使得无人机在获取数据时很少受到云的影响,并且可以灵活规划和设计飞行航线(Rango 等,2009)。

目前,许多学者从不同的角度基于不同种类遥感影像数据开展单株立木信息提取方法研究。Wulder等(2000)基于高空间分辨率卫星影像数据提出局部最大值法用于识别单株立木。局部最大值法通常是以获取影像局部光谱的最大值作为树冠中心点,并将其视为树木位置,其关键是设定符合影像中不同树冠大小的窗口以获取树冠光谱最大值。该方法相对简单且提取速度较快,而当影像亮度值变化大或者影像背景较复杂时,识别效果不理想。Culvenor(2002)基于高空间分辨率卫星影像数据结合该方法对林地树冠进行提取。而Bruce Blundell(2008)将其应用于雷达数据识别林地树木位置。

Pollock(1996)提出适合应用于具有不同树冠大小的林地的树冠模板匹配算法,但一般对较稀疏森林的树冠提取效果较好。Erikson和Olofsson(2005)基于布朗运动原理提出区域生长算法,并与模板匹配算法和基于复杂规则的区域生长算法进行树木识别,提取精度达到80%左右。Hung等(2012)对模板匹配法进行扩展,通过结合树木形状和树木阴影信息,提出基于树冠多级预测模板匹配的自动提取方法,提取精度为75%—80%。此外,面向对象方法也被应用于单株立木识别和单木树冠提取。周艳飞等(2014)采取目视解译法和面向对象法对无人机影像树冠信息进行提取,通过对比实测数据,结果表明两种方法的精度均在85%左右且无显著差异。张凝等(2015)结合航空影像纹理和光谱特征,采用面向对象影像分割方法提取树冠。沈利强等(2017)等结合面向对象方法和水文分析技术提出一种单株立木信息提取方法,并应用于高空间分辨率卫星影像数据。然而,传统面向对象的方法往往需要大量人工干预,难以实现单株立木信息的自动化提取。

本文面向高空间分辨率无人机遥感影像数据提取单株立木信息,并分析其相对其他数据源的缺陷以及应用传统理论方法存在的问题。然后提出一种新的单株立木信息提取方法,通过选取特定研究区进行实验,并对方法精度进行验证与分析。

2 研究区与数据

2.1 研究区概况

研究区位于陕西省榆林市神木县大柳塔镇境内的神东矿区见图1,其中卫星底图为研究区2017年03月08日的高分二号卫星影像。神东矿区位于晋、陕、蒙三省区接壤地带,矿产资源丰富,是中国目前最大的井工煤矿开采地。神东矿区植被稀少,生态环境脆弱,常年多风沙、易干旱,受风力侵蚀严重,是中国水土流失重点监督区与治理区。

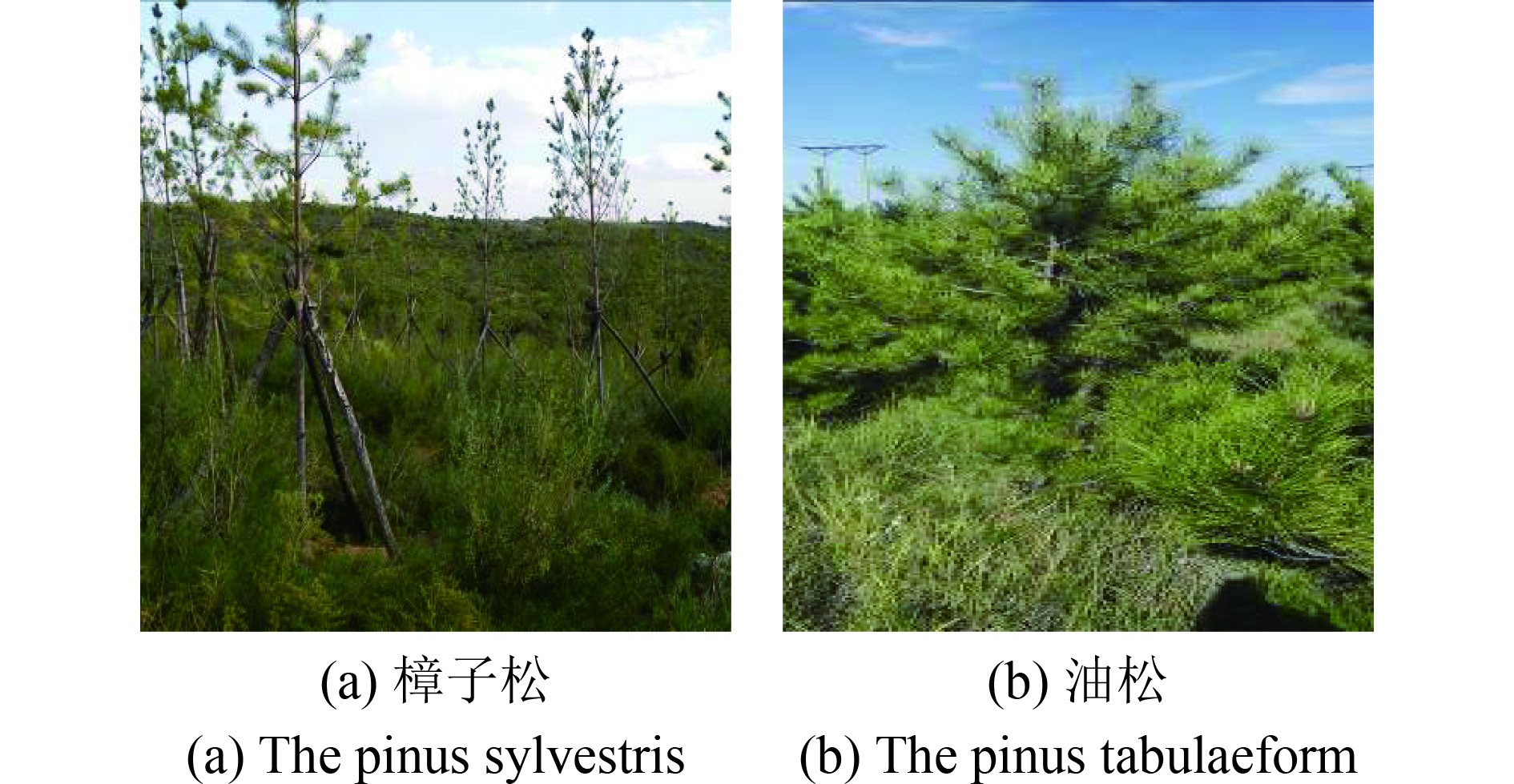

自20世纪80年代开发建设起来,其生态环境保护问题一直备受广泛重视,通过采取水土保持工程和生物措施相结合,以灌草、栽植等治理措施实施生态修复工程。主要以大量种植樟子松和油松等常绿叶树,配栽沙棘等灌木的方式进行人工造林。本文分别选取两个代表性区域作为实验区见图2。其中,实验区1 地理范围约为110°12′15″E—110°12′23″E,39°18′37″N—39°18′43″N,面积约为0.03 km2,平均冠幅约为1.0 m,主要种植樟子松,配栽有沙棘等灌木,并伴生有天然杂草;实验区2 地理范围约为110°13′08″E—110°13′19″E,39°15′31″N—39°15′41″N,面积约为0.08 km2,平均冠幅约为1.5 m,主要种植油松林,配栽有少量沙棘等灌木,夹生有大量杨柴、沙柳等灌草。

2.2 数据获取与处理

本研究使用大疆公司的精灵4专业版(Phantom 4 pro)无人机(图3),属于消费级四旋翼型无人机产品。该无人机具有重量轻、灵活性高、便携以及可垂直起降等优势,并且具有悬停拍摄功能,可提供更加稳定的拍摄平台。此外,该无人机采用电池供电,可持续飞行约30 min。无人机平台搭载有CMOS (Complementary Metal Oxide Semiconductor)数码相机,视场角为84°,录像分辨率为1920像素×1080像素;且该相机仅包含R(红光)、G(绿光)、B(蓝光)3个光谱通道。无人机平台与搭载相机具体参数见表1。

表 1 无人机平台及搭载相机基本参数

Table 1 The basic parameters of UAV and the digital camera

| 设备 | 基本参数 | |

| 无人机平台 | 总重量 | 1388 g |

| 最大飞行海拔高度 | 6000 m | |

| 最大可承受风速 | 10 m/s | |

| 最大水平飞行速度 | 58 km/h | |

| 最大飞行时间 | 约30 min | |

| 工作环境温度 | 0 ℃—40 ℃ | |

| 电池 | 6000 mAh锂充电电池 | |

| 相机 | 有效像素 | 2000万 |

| 视场角(FOV) | 84° | |

| 录像分辨率 | 1920×1080 | |

| 视频格式 | MP4/MOV | |

分别于2017年2月和2017年9月进行两次野外实地无人机航拍实验。实验时天气晴朗、风力较小。采取视频拍摄方式采集数据,无人机航拍时的飞行高度约为50 m,并且相机与地面有一定夹角,非严格垂直角度拍摄。

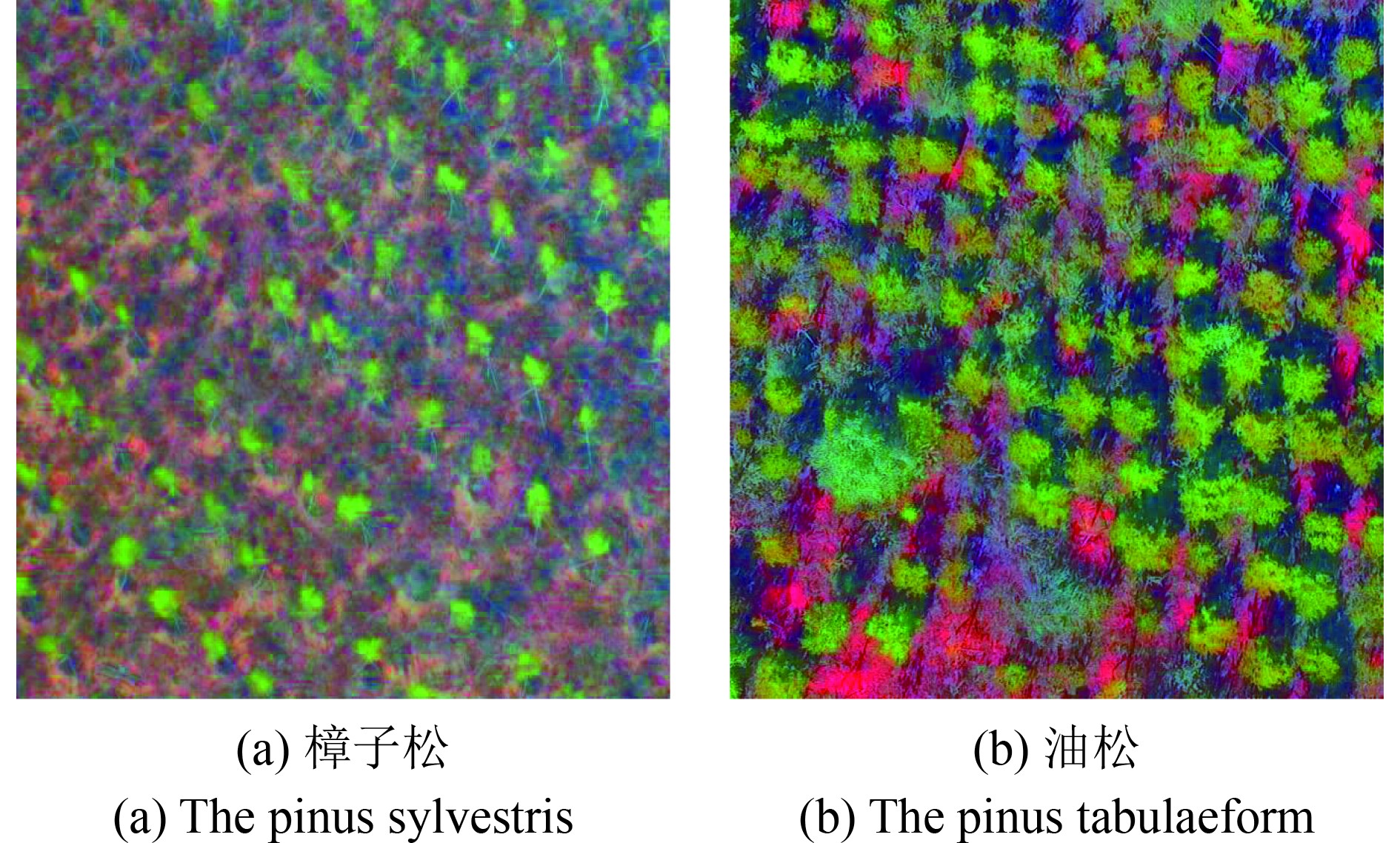

通过基于Matlab R2015a软件平台编写程序,对无人机航拍视频进行视频帧提取,并保存TIFF格式图片文件作为研究用影像数据,数据仅包含R、G、B共3个光谱通道。其中樟子松林区影像空间分辨率约为0.05 m,油松林区影像空间分辨率约为0.03 m。其中,实验获取的典型区域航拍影像见图4,将其作为本文单株立木信息提取用影像数据。

3 研究方法

3.1 单株立木信息提取方法构建

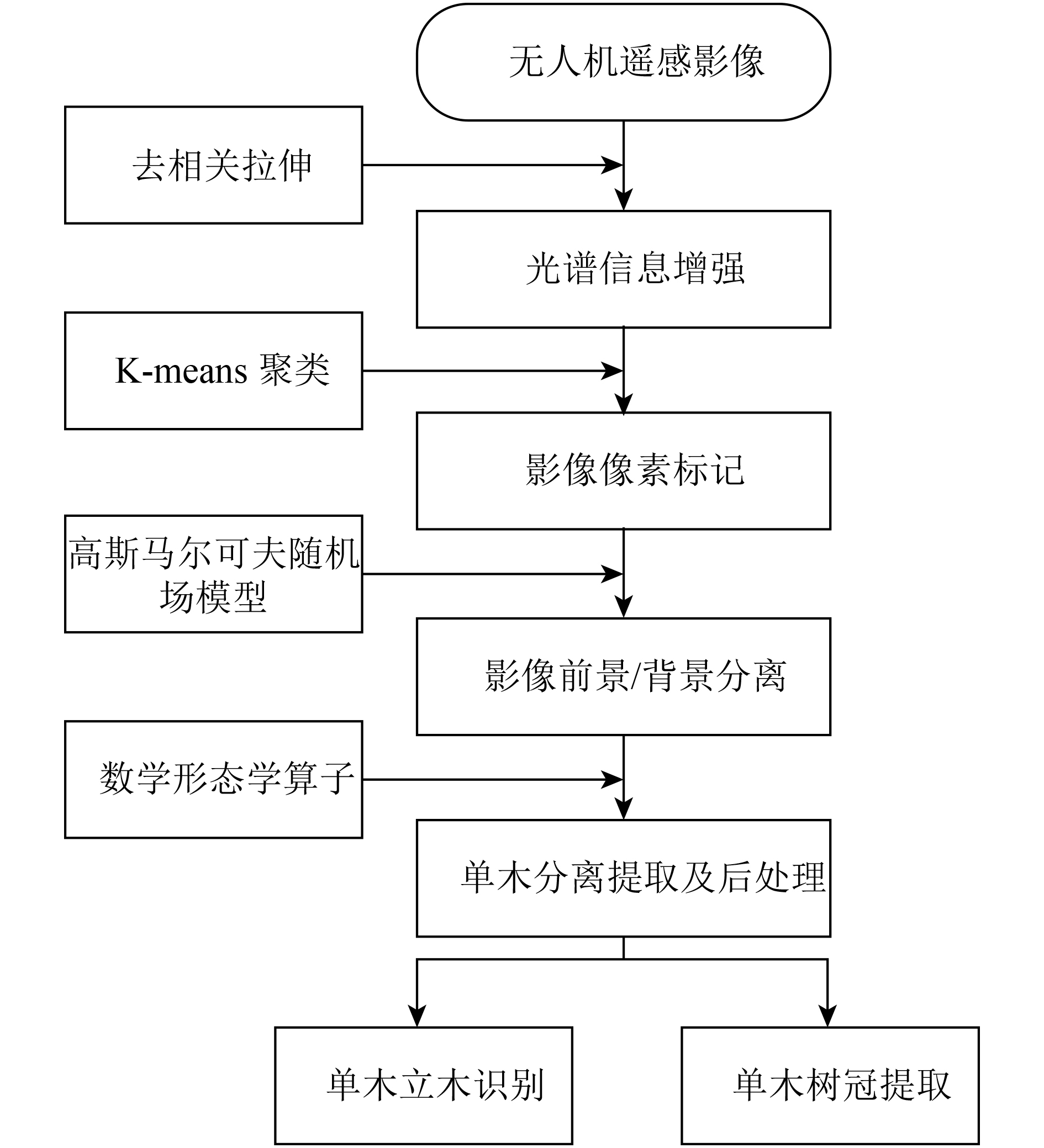

基于高空间分辨率无人机遥感影像数据进行单株立木信息提取技术流程图5。其中,左侧列为主要用到的技术方法,中间列为需实现的操作目标。

3.1.1 影像光谱信息增强

基于遥感影像的单木提取实质上可以看作基于影像进行前景和背景分离的过程,即进行图像分割。本研究中,前景指的是单株立木覆盖区域,而背景则是除去单株立木之外的土壤、草地等区域。而通过图像增强技术在一定程度上有利于影像中前景和背景的分离。

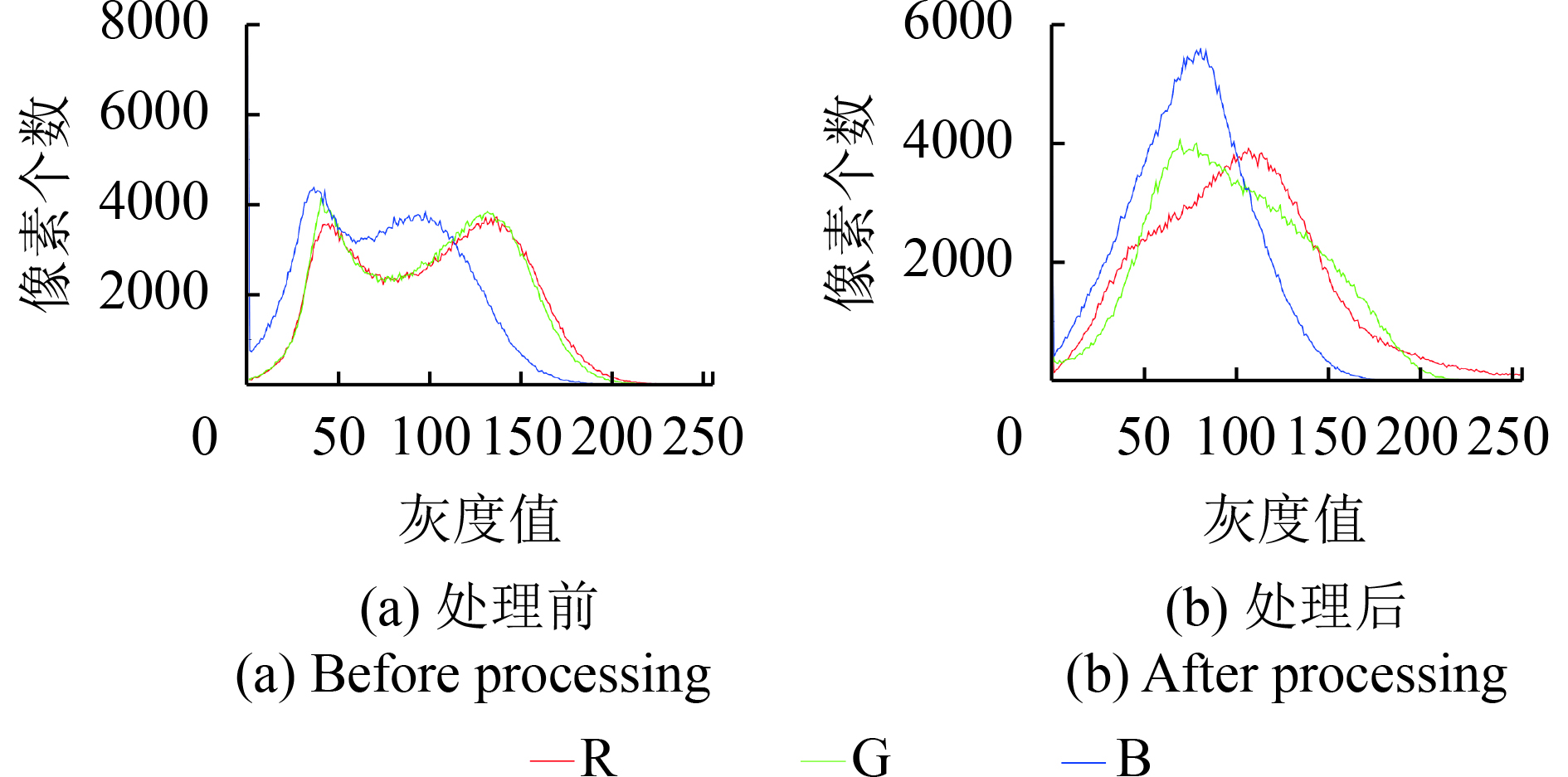

由于本研究使用的是真彩色影像数据,其各波段之间具有高度相关性,当采取传统的对比度拉伸方法对影像进行增强处理时,只能改善影像色度和亮度,无法增强影像色彩饱和度。而去相关拉伸方法的基础在于主成分变换,通过拉伸影像波段的主成分信息,扩大高度波段相关性的影像信息耦合度,从而使影像色彩饱和度增加。此外,影像相关区域的色彩更加鲜明突出,而暗区域部分也会变得更加明亮(邓睿 等,2011)。因此,本文采用去相关拉伸光谱增强方法对原始影像进行增强处理。

影像灰度直方图可以间接反映影像灰度信息分布规律,描述不同灰度级别包含的像素个数。根据直方图形态可作为判断影像质量好坏的依据,假定影像像元灰度值是随机分布的,则影像直方图应符合高斯分布。这是因为图像包含有大量的图像像元,其像元灰度值的分布应满足概率统计分布规律。若图像的直方图轮廓曲线越接近于高斯分布,则说明图像的像元亮度值越接近于随机分布,并且适合使用统计方法进行处理。

以油松林区影像为例,由处理前后灰度直方图对比(图6)可知,去相关拉伸处理后,影像直方图相比更加趋于高斯分布。去相关拉伸后影像的对比度与亮度也更适中,并且影像前景和背景在视觉上也得到有效的区分(图7)。

3.1.2 影像像素标记

为实现影像前景和背景的分离过程,在图像增强处理的基础上,需进一步进行影像像素标记。在此过程中,本研究通过使用K-means聚类方法实现影像像素标记过程。影像像素聚类的目的是将影像中的像素进行分组或分类。

假设影像为一个空间数据集X,则数据集中的元素xi (i = 1, 2, 3,

| $ {{D = }}\sum\limits_{{{i = 1}}}^{{N}} {\sum\limits_{{{k = 1}}}^{{K}} {\left\| {{{{x}}_{{i}}}{{ - }}{{{\mu }}_{{k}}}} \right\|} } $ | (1) |

对于传统的K-means聚类方法,通常需要人为地多次设定初始聚类中心以得到最优结果,这使得其效率降低且一定程度上受人为主观性影响。因此,本研究引入DBI指数可实现自动确定最优聚类数目,避免人为主观判断,提高聚类精度。

DBI是利用数学方法计算出任意两个类别的类内距离及其之间的类间距离之比(冯超,2007)。DBI值越大说明类内距离越小,同时类间距离越大。其计算公式如下

| $ {d_{i,j}} = \left\| {{v_i} - {v_j}} \right\| $ | (2) |

| $ {S_i} = \frac{1}{{\left| {{C_i}} \right|}}\sum\limits_{x \in {C_i}} {\left\| {x - {v_i}} \right\|} $ | (3) |

| $ DBI = \frac{1}{K}\sum\limits_{i,j \in \left[ {1,k} \right]} {\max \left({\frac{{{S_i} + {S_j}}}{{{d_{i,j}}}}} \right)} $ | (4) |

式中,x表示第i个类内的各个数据对象;vi 和vj分别表示第i,j个类的质心;Ci表示第i个类内的数据对象个数;di,j表示第i个类质心与第j个类质心之间的欧氏距离;Si和Sj分别为第i,j个类内各数据对象与质心vi和vj的类内距离;K表示聚类数目。

因此,本研究中影像像素标记方法流程描述如下:

(1)预设K(K∈[Kmin, Kmax]) 值,其中 Kmin 设为 2,Kmax 设为 15。即影像聚类类别至少分为两类,至多分为15类;

(2)初始化聚类中心Ck(k = 1, 2, 3,

(3)根据下式计算得到新的聚类中心

| $ {{\mu }}_k' = \frac{1}{{\left| {{{{C}}_{{k}}}} \right|}}\sum\limits_{{{x}} \in {{{C}}_{{k}}}} {{x}} $ | (5) |

(4)重复步骤(2)和(3),直到聚类中心不再发生变化终止算法迭代。统计相应的DBI数值,并对相应类别影像像素进行标签标记,标记值f∈[1,K];

(5)输出DBI,当DBI最小值所对应的聚类数目即为最优聚类数目Ks,并输出Ks对应的影像像素标记结果。

3.1.3 影像前景/背景分离

使用K-means聚类方法进行图像像素标记时仅考虑影像像元灰度值信息,而没有考虑邻域像元之间存在的统计依赖关系,使得标记结果存在一定误差。因此,本文基于高斯马尔可夫随机场GMRF(Gaussian Markov Random Field)理论,将图像像元的空间特性考虑进来,对已标记影像结果再次进行图像分割操作。

GMRF是建立在图像邻域系统之上的图像分割模型,即通过一个邻域系统,把图像中的像元及其邻域内其他像元联系起来。通过构建标记场和特征场两个随机场来描述待分割影像,标记场用于标记图像像素,描述图像分割结果,记为Y={Y|y1,y2,

| $ P\left({Y = y|X = x} \right) = \frac{{P\left({X = x|Y = y} \right)P\left({Y{{ = }}y} \right)}}{{P\left({X{{ = }}x} \right)}} $ | (6) |

式中,P(Y=y|X=x)是给定图像特征X=x条件下标记场Y=y的后验概率;P(X=x | Y=y)是给定观测数据Y=y条件下特征场X=x的概率分布;P(Y=y)表示先验概率。由于特征场X=x表示的是观测图像,是已知的常量,与求解最大值无关,故P(X=x)可忽略不计。则分割问题可近似求最大后验概率

| $ \mathop y\limits^ \wedge = {{arg}}\max {{P}}({{Y = y}}|{{X = x}}) $ | (7) |

在实际求解参数过程中,图像的概率计算问题可转化为能量求解问题,也就是最小化当前标记场能量与特征场能量之和,即

| $ {{E}}\left({{{y, x}}} \right){{ }} = {{ \min}}\left({{{{E}}_{{Y}}}\left({{y}} \right) + {{{E}}_{{X}}}\left({{{y,x}}} \right)} \right) $ | (8) |

式中,EY(y)是标记场能量,EX(y,x)是特征场能量。

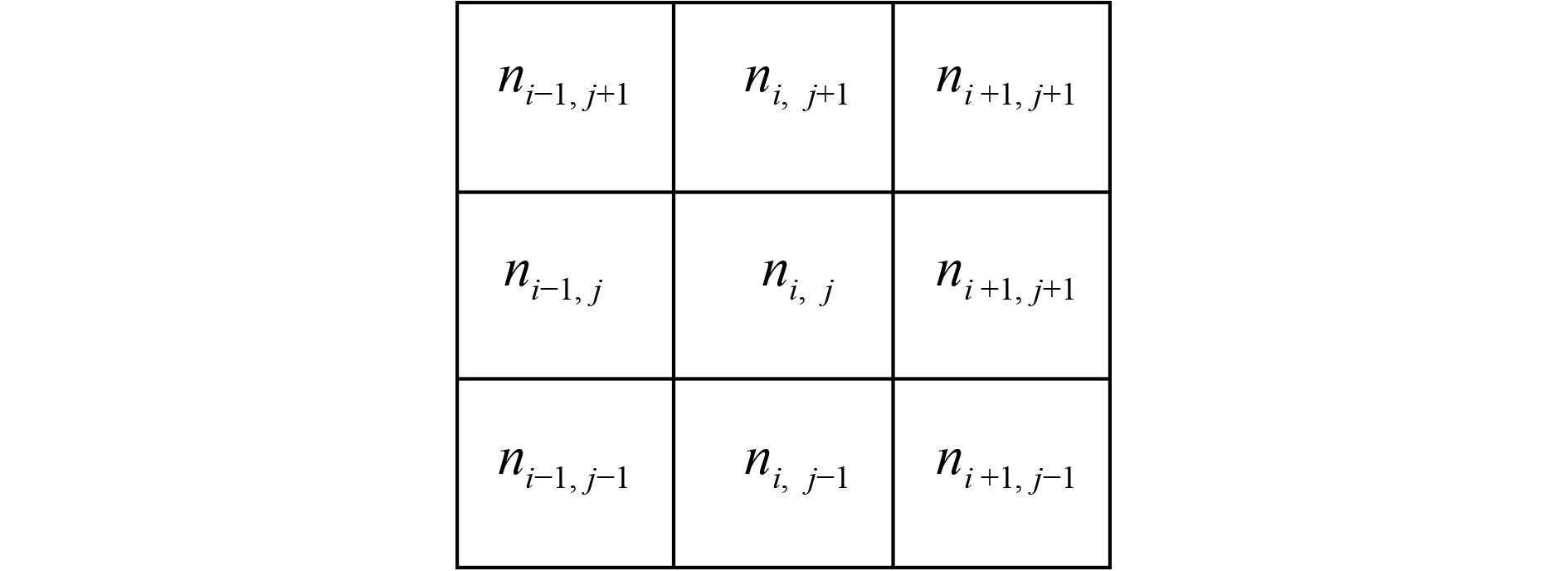

本研究基于2阶邻域系统构建GMRF,其表示形式见图8。

则其标记场能量势函数可定义为

| $ {E_Y}\left({{y_I}} \right) = \sum\limits_{k = 1}^s {v\left({I,k} \right)} $ | (9) |

| $ v\left({I,k} \right) = \left\{ \begin{gathered} f\;\;\;\;\;{y_I} \ne {y_k} \\ 0\;\;\;\;\;{y_I} = {y_k} \\ \end{gathered} \right. $ | (10) |

式中,I表示邻域中心像素点,K表示邻域内包含的像素点。

假设图像的概率分布服从正态分布,记各分类类别k的均值和方差分别为μk和σk,则EX(y,x)可表示为

| $ {E_X}\left({y,x} \right) = \sum {\left({\ln \left({\sqrt {2{\text{π}}} \times{\sigma _k}} \right) + \frac{{{{\left({x - {\mu _k}} \right)}^2}}}{{2\sigma _k^2}}} \right)} $ | (11) |

采用ICM(Iterative Condition Modes)对E(y,x)进行迭代,当满足终止条件时,终止程序运行并输出最终分割结果。

3.1.4 单木分离提取及后处理

为得到分割结果中的树木信息,通过采用数学形态学算子等方法对其进行后处理。主要处理步骤描述如下:

(1) 分割结果区域分离。将包含树木信息的区域从分割结果中分离,并保存为TIFF格式。

(2) 孤点去除。主要目的是去除分割结果中存在孤立的点噪声信息。

(3) 碎斑块剔除。主要对分割结果中非树木区域的零星小碎斑噪声进行剔除。

(4) 孔洞填充。将树木图斑内部存在的孔洞进行填充,使其形成完整的闭合多边形,以便于后续树冠的进一步提取。

(5) 形态学算子处理。本研究中使用的基础形态学算子包括:膨胀算子(用

| $ {{A}} \oplus B{{ = }} \cup \left\{ {{{A}} + {{b}}|{{b}} \in {{B}}} \right\} $ | (12) |

| $ {{A}}\Theta B{{ = }} \cap \left\{ {{{A - b}}|{{b}} \in {{B}}} \right\} $ | (13) |

| $ {{A}} \circ {{B = }}({{A}}\Theta {{B}}) \oplus {{B}} $ | (14) |

| $ {{A}} \bullet {{B = }}({{A}} \oplus {{B}})\Theta {{B}} $ | (15) |

本文采用先腐蚀后膨胀的处理策略,即开算子进行形态学处理。可以平滑图斑的边界轮廓,断开可能存在的狭窄连接,并去掉边缘存在的细小突出部分。

(6) 异常分割斑块处理。由于分割结果中存在两个或多个树木图斑连接在一起的现象,一定程度上会降低提取精度,因此本文通过基于图斑面积和图斑圆度筛选规则对其进行分离处理,以提高结果精度。

通过统计处理结果中图斑的面积,并将面积位于全部斑块面积90%以上的图斑筛选出来,记为A_u,剩余斑块记为A_d;然后计算斑块圆度,再次提取圆度小于0.5的斑块记为C_d,剩余斑块记为C_u。对斑块C_d进行腐蚀操作,然后与C_u、A_d进行合并得到最终分割处理结果。

3.1.5 单株立木信息提取

(1)单株立木识别。依据图像几何矩原理对形态学后处理结果进行计算得到分割图斑的质心位置,并作为对树冠位置的标记,而标记个数则为提取到的树木棵数。

其中,利用图像几何矩原理计算得到图斑质心时,计算公式如下

| $ {{x = }}\frac{{{{{C}}_{10}}}}{{{{{C}}_{00}}}}{{ = }}\frac{{\displaystyle\sum\limits_{{{i = 1}}}^{{M}} {\displaystyle\sum\limits_{{{j = 1}}}^{{N}} {{{i}} \times {{f}}({{i,j}})} } }}{{\displaystyle\sum\limits_{{{i = 1}}}^{{M}} {\displaystyle\sum\limits_{{{j = 1}}}^{{N}} {{{f}}({{i,j}})} } }} $ | (16) |

| $ {{y = }}\frac{{{{{C}}_{01}}}}{{{{{C}}_{00}}}}{{ = }}\frac{{\displaystyle\sum\limits_{{{i = 1}}}^{{M}} {\displaystyle\sum\limits_{{{j = 1}}}^{{N}} {{{j}} \times {{f}}({{i,j}})} } }}{{\displaystyle\sum\limits_{{{i = 1}}}^{{M}} {\displaystyle\sum\limits_{{{j = 1}}}^{{N}} {{{f}}({{i,j}})} } }} $ | (17) |

式中,f(i,j)为图像像素灰度值;C10和C01为图像一阶矩,分别表示图斑区域x坐标值与像素灰度值乘积的累加和以及图斑区域y坐标值与像素灰度值乘积的累加和;C00为图像零阶矩,表示图斑区域像素灰度值的累加和。

(2)单木树冠提取。通过对最终形态学后处理结果进行矢量化,即得到相应的单木树冠范围。

3.2 单株立木信息提取验证与评估

在进行单株立木信息提取方法评估时,应当使用相关参考数据包括单株立木位置和单木树冠范围进行精度评价。由于缺少实测参考数据,本研究采用目视解译代替参考数据进行精度验证。

Gougeon(1995)通过两个解译人员以目视解译确定单株立木位置,并统计影像中包含的树木棵数。Erikson(2003),Lamar等(2005)也采用目视解译方式获取参考数据。Larsen等(2011)通过四位专业解译人员以目视解译方式获取单株立木位置作为验证用参考数据,对四个不同的目视解译结果分别进行验证的同时,也将加权平均后的结果用于精度评价。

3.2.1 单株立木识别精度评估

本研究采用的单株立木识别结果精度评价指标有总体精度、错分误差和漏分误差(Deng 等,2011)。将人工识别得到的树木棵数作为参考树木棵数记为Nr。将提取树木棵数记为Na,其中,正确提取的树木棵数为Nc。总体精度是指正确提取树木棵数占参考树木棵数的百分比,见式(9)。错分误差是指参考树木棵数和正确提取树木棵数的差值占参考树木棵数的百分比,见式(10)。漏分误差是指提取树木棵数与正确提取树木棵数的差值占参考树木棵数的百分比,见式(11)。

(1) 总体精度OA(Overall Accuracy)

| $ {{{\rm{OA}} = }}\frac{{{{{N}}_{\rm{{c}}}}}}{{{{{N}}_{{\rm{r}}}}}} \times 100\text{%} $ | (18) |

(2) 错分误差CE(Commission Error)

| $ {\rm{CE}} = \frac{{{{{N}}_{{\rm{r}}}} - {{{N}}_{{\rm{c}}}}}}{{{{{N}}_{{\rm{r}}}}}} \times 100\text{%} $ | (19) |

(3) 漏分误差OE(Omission Error)

| $ {\rm{OE}} = \frac{{{{{N}}_{{\rm{a}}}} - {{{N}}_{{\rm{c}}}}}}{{{{{N}}_{{\rm{a}}}}}} \times 100\text{%} $ | (20) |

3.2.2 单木树冠提取精度评估

通过专业解译人员以人工勾绘的方式提取树冠范围,作为验证单木树冠提取结果的参考依据。本文基于以下标准对单木树冠提取精度进行定量评价(Jing 等,2012):

(1) 匹配:提取单木树冠与参考树冠重叠超过50%且参考树冠中心点位于提取树冠内;

(2) 合并:提取单木树冠包含两个或以上的参考树冠,且参考树冠中心也被提取树冠所包含;

(3) 分离:参考树冠有超过50%的范围被一个或多个提取的单木树冠占有;

(4) 丢失:参考树冠与提取单木树冠重叠部分少于各自的50%,且参考树冠的中心不属于任何提取单木树冠。

4 结果与分析

4.1 DBI优选结果

基于樟子松林区和油松林区无人机遥感影像数据,针对不同预设分类数目,通过程序计算得到相应的DBI指数,其统计情况见表2。

表 2 DBI计算结果统计

Table 2 Statistics of the results of DBI

| 分类数目 | DBI | |

| 樟子松林区 | 油松林区 | |

| 2 | 1.43537 | 1.44351 |

| 3 | 1.15484 | 1.18965 |

| 4 | 1.13441 | 1.02293 |

| 5 | 1.24226 | 1.08863 |

| 6 | 1.08989 | 1.18318 |

| 7 | 1.12276 | 1.14299 |

| 8 | 1.10650 | 1.23357 |

| 9 | 1.20727 | 1.18306 |

| 10 | 1.13171 | 1.14993 |

| 11 | 1.17526 | 1.11194 |

| 12 | 1.18779 | 1.10884 |

| 13 | 1.14118 | 1.09068 |

| 14 | 1.12798 | 1.07564 |

| 15 | 1.11344 | 1.07782 |

可以看出,樟子松林区无人机遥感影像计算得到的DBI最小值为1.08989,此时分类数目为6个,并将其作为最优分类数目;油松林区无人机遥感影像计算得到的DBI最小值为1.02293,此时分类数目为4个,并将其作为最优分类数目。

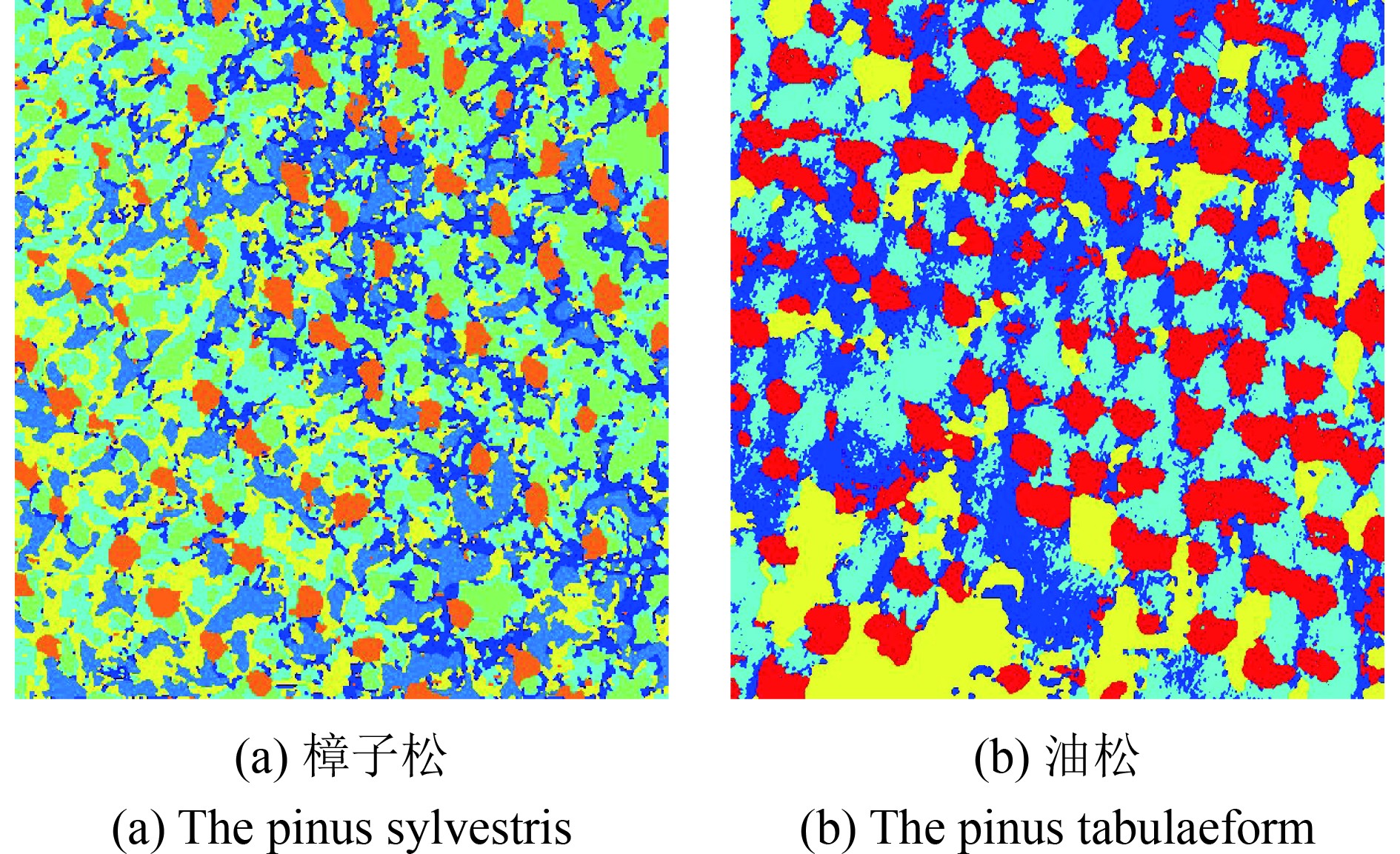

4.2 分割结果对比与分析

针对樟子松林和油松林无人机遥感影像的最终分割结果为灰度图,其中樟子松林无人机遥感影像分为6类,油松林无人机遥感影像分为4类,从灰度图难以对不同分割区域进行目视辨别。因此,为便于观察,分别对不同分割区域进行配色,如图9所示。

由于本文所用无人机遥感影像具有高空间分辨率的特点,从原始影像可以看出存在明显的阴影区域。主要包括两部分,一部分为自身阴影,即由于树冠内部枝条或叶片产生的阴影区域;另一部分为投射阴影,即由于太阳光照导致树木投射到地面上或其他树木上产生的阴影区域。从分割结果可以看出,本文分割算法一定程度上可以抑制或消除树木自身阴影。而对于投射阴影,也能较好的进行区分与分离。说明本文算法对于阴影部分具有较好的鲁棒性。

为进一步对比验证本文分割效果,采用面向对象分割法分别对实验图像进行分割。基于软件平台eCognition Developer 9.2,采取多尺度分割(Multiresolution Segmentation)方法。其中,分割参数包括:波段权重(Image Layer Weights)、分割尺度(Scale)、形状因子(Shape)和紧凑度因子(Compactness)。可根据波段的重要性确定波段权重;分割尺度决定分割对象的大小,分割的质量等;形状因子决定分割时光谱值在整个匀质度中相对于形状所占比重;紧凑度因子决定生成对象的形状特征(李丹 等,2016)。

分割过程中,经过多次实验,分别确定不同无人机遥感影像的最优分割参数见表3。得到的最终分割结果见图10,为对比分割效果,将分割区域中的树木对象突出显示。

表 3 分割参数

Table 3 Segmentation parameters

| 实验区 | 波段权重 | 分割尺度 | 形状因子 | 紧凑度因子 | ||

| 樟子松林区 | 1 | 1 | 1 | 20 | 0.8 | 0.2 |

| 油松林区 | 1 | 1 | 1 | 60 | 0.65 | 0.5 |

通过对比本文算法分割结果与面向对象法分割结果,对于原始树木轮廓的还原度,本文算法效果更好。由于原始影像中地物本身的复杂性,在进行多尺度分割时,采取不同的分割参数时,通常对部分区域分割效果较好,对整体的分割效果难以达到均衡。

4.3 单株立木识别结果与精度评价

樟子松林区和油松林区无人机遥感影像进行单株立木识别结果见图11。其中黄色‘·’为人工目视解译参考树木位置,红色‘+’为自动提取树木位置。为方便目视观察,采用等同于提取树冠面积的红色圆作为拟合树木范围进行标记。本研究采用的判断依据是:若人工目视解译参考树木位置位于拟合树木范围内,则视为正确提取;反之,视为错误提取。

对单株立木识别结果进行精度评价,见表4。对于生长状况较为稀疏的樟子松林区,其单株立木识别总体精度达到95.65%,错分误差为4.35%,漏分误差为2.90%;对于生长状况较为郁密的油松林区,其单株立木识别总体精度达到89.52%,错分误差为10.48%,漏分误差为8.74%。

表 4 单株立木识别精度评价

Table 4 Accuracy of individual tree detection

| 实验区 | Nr | Na | Nc | OA/% | CE/% | OE/% |

| 樟子松林区 | 69 | 67 | 66 | 95.65 | 4.35 | 2.90 |

| 油松林区 | 105 | 103 | 94 | 89.52 | 10.48 | 8.74 |

针对不同实验区,本文方法在进行单株立木识别时均取得较高的精度,并且误差率也控制在较低的水平。

4.4 单木树冠提取结果与精度评价

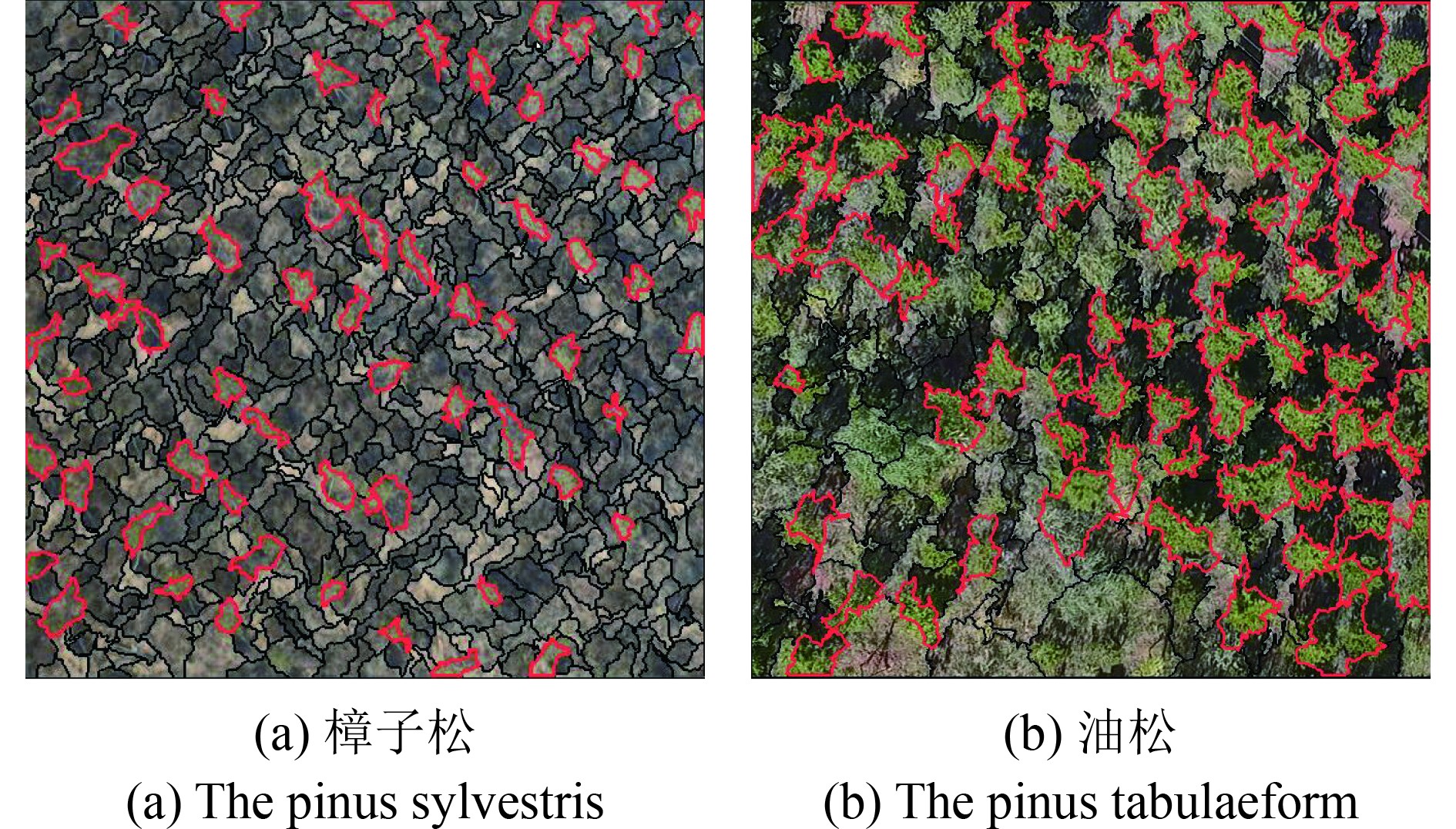

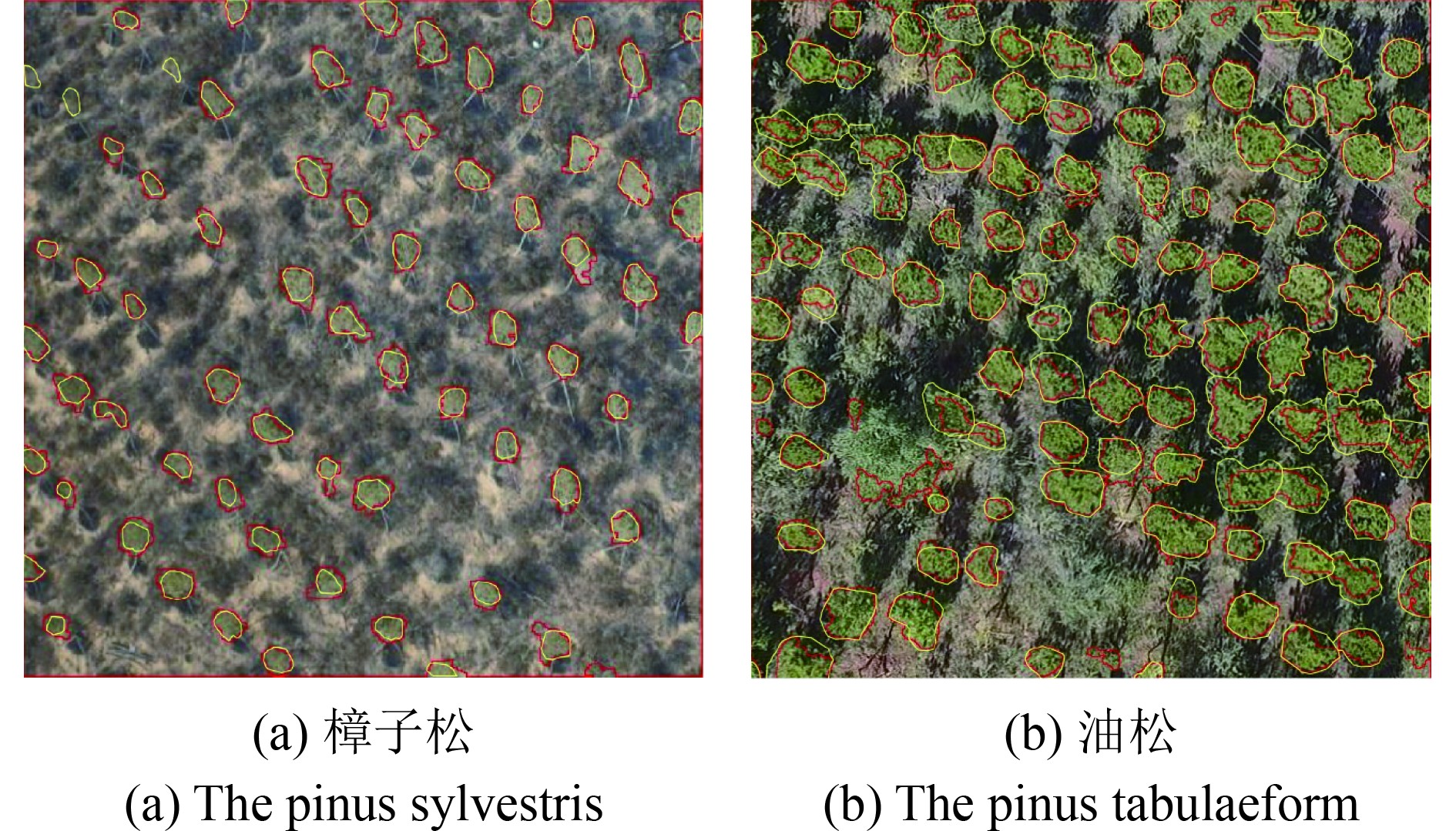

樟子松林区和油松林区的单木树冠提取结果见图12。其中黄色多边形为人工目视解译获得的参考树冠范围,红色多边形为自动提取单木树冠范围。

单木树冠提取精度评价见表5,其中,樟子松林目视解译参考树冠个数为69个,匹配个数66个,分离个数为1个,丢失个数为3个,相应提取精度为95.65%;油松林目视解译参考树冠个数为105个,匹配个数为82个,合并个数为10个,丢失个数为8个,相应提取精度为81.90%。

表 5 单木树冠提取精度评价

Table 5 Accuracy of individual tree crown delineation

| 实验区 | 参考树冠 | 匹配 | 合并 | 分离 | 丢失 | 提取精度/% |

| 樟子松林区 | 69 | 66 | 0 | 1 | 3 | 95.65 |

| 油松林区 | 105 | 86 | 8 | 0 | 9 | 81.90 |

本文方法对于稀疏林区的单木树冠提取精度较高,而对较密集林区提取精度相对偏低。主要是由于选取的油松林实验区林地植被类型复杂多样,大量的灌木与树木混合生长,不易区分。本文方法主要基于地物光谱特征信息与数学几何原理进行单木信息提取,林木之间或林木灌木之间枝条相互重叠生长的现象,未能得到完全消除,一定程度上限制提取效果。

5 讨 论

基于研究内容和现有单株立木信息提取研究进展,从研究用影像数据和传统理论方法应用两个方面,分别进行对比并展开探讨,以进一步说明传统无人机遥感影像在单株立木信息提取应用的瓶颈。

5.1 影像数据特征

(1) 光谱分辨率低。采用无人机遥感影像数据相比卫星遥感影像数据,其光谱分辨率较低。这是由于无人机具有低载荷的特点,使得其在实际应用过程中往往搭载光谱通道较少的传感器获取影像数据,比如大疆公司生产的便携式消费级无人机,一般获取的影像数据仅包含R、G、B共3个通道。

植被叶片中含有的叶绿素在近红外波段NIR(Near Infrared)有强反射特性,该特性被广泛应用于识别或探测影像中包含的植被信息,因此应用卫星遥感影像数据时通常可采用构建植被指数如NDVI (Normalized Differential Vegetation Index)等方式应用到单株立木信息提取中。而无人机遥感影像缺少NIR波段,也导致其在更多方法应用上存在一定的限制性。

(2) 缺少深度信息。无人机遥感影像数据相比激光雷达数据缺少深度信息。激光雷达测量系统通常采用红外线、可见光和紫外光等波段,可以形成地物深度图信息,可直接用于树木识别与定位。

5.2 传统理论方法应用限制

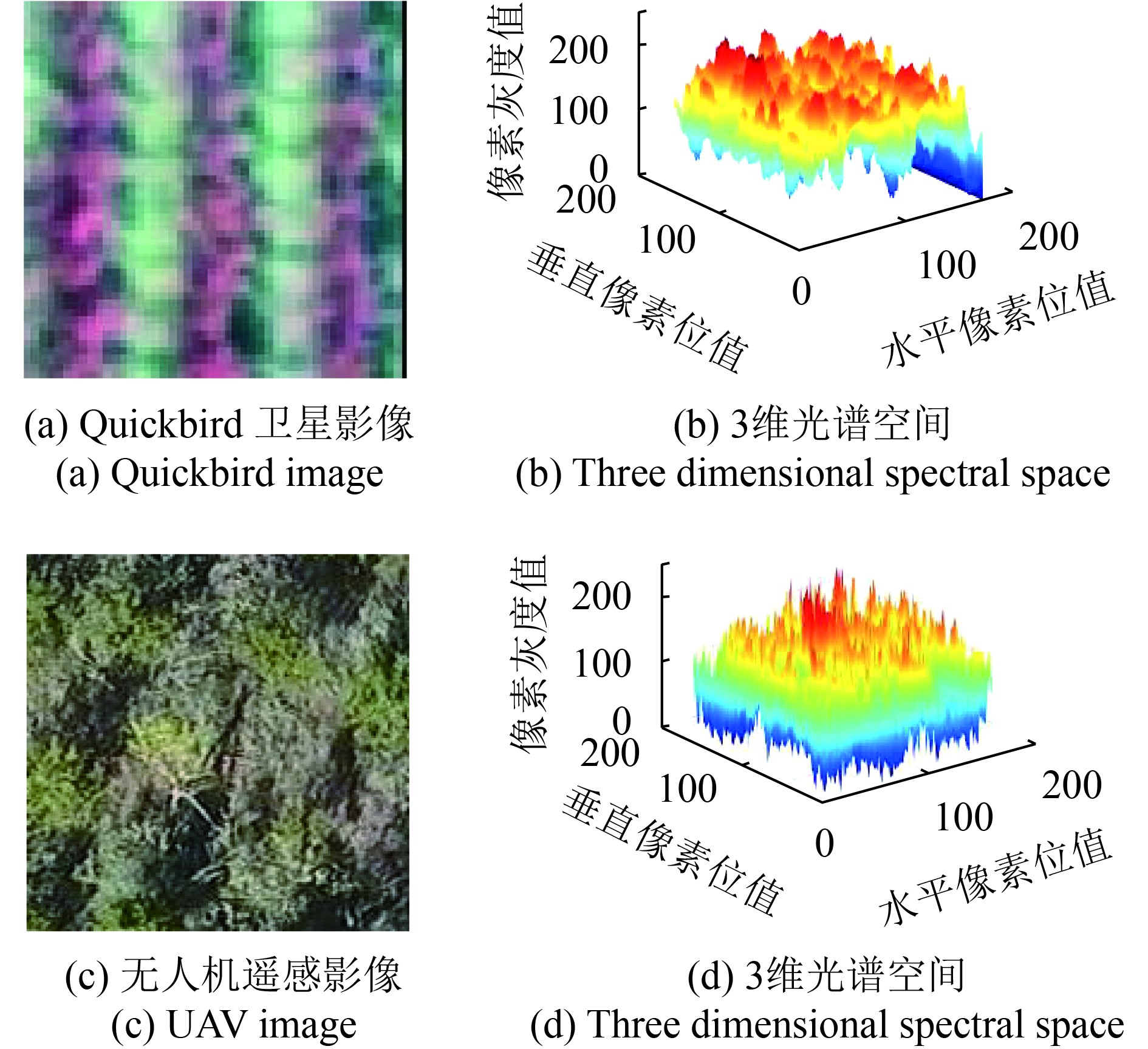

在传统的基于高空间分辨率卫星影像数据进行单株立木信息提取方法中,以3维角度观察树冠的光谱空间时,明显具有山形或倒锥形结构特征如图13(a)(Deng 等,2011)。产生这一现象的主要原因是树梢受到太阳光照强度比树冠周围受到的太阳光照强度大,导致影像中亮度值最大的像素往往位于树梢部位。因此,通过确定树梢周边最大亮度值的像素位置,即可作为确定单株立木位置的依据。目前,很多基于高空间分辨率影像进行单株立木信息提取的研究仍然基于该依据(Lin 等,2015)。

本研究使用的无人机遥感影像数据,其空间分辨率高于传统高分辨率卫星影像数据,因此,可以较清晰地展现树冠内部存在的细节纹理特征,比如树枝阴影等见图13(b),因此导致树冠3维光谱空间山形或倒锥形结构产生偏离,使得基于上述依据进行单株立木信息提取较难实现。

6 结 论

针对高空间分辨率无人机遥感影像数据,提出一种新的林地单株立木信息提取方法。通过与面向对象方法进行对比发现本文方法提取效果更好。通过对提取结果进行精度验证与评价发现,针对樟子松林区和油松林区试验影像均达到较高的精度水平。从而说明本文方法具有可行性和有效性,并且均具有一定的应用价值。

本文方法的优势主要体现在不需要大量人工干预以及先验知识的输入,避免了传统人工提取的低效率问题,大大提高方法的自动化程度以及通用普及性。此外,充分利用图像像素灰度值和像素之间存在的空间关联关系,并在后处理过程中结合基于面积和圆度的筛选规则,提高了提取效果与精度,且对阴影也具有较好的抑制作用。

从研究用影像数据和传统理论方法应用两个方面展开讨论,着重分析了传统高空间分辨率无人机遥感影像数据在实际应用过程中的难点和局限。而本文仅利用高空间分辨率无人机遥感影像数据进行单株立木信息提取,因此,如何结合多源遥感数据,实现数据间优势互补,以弥补无人机影像数据自身缺陷,更进一步提高单木信息提取精度有待进一步研究。

参考文献(References)

-

Bruce Blundell S. 2008. Local gradient and local maximum analysis of lidar data for tree crown identification//Proceedings of ASPRS 2008 Annual Conference. Portland, Oregon: ASPRS: 90-101

-

Bu F and Shi Y L. 2017. The comparison of urban tree crown extraction based on airborne LiDAR elevation difference and high resolution imagery. Remote Sensing Technology and Application, 32 (5): 875–882. ( 卜帆, 石玉立. 2017. 机载LiDAR高差和高分影像的城市树冠提取比较. 遥感技术与应用, 32 (5): 875–882. )

-

Bunting P, Lucas R M, Jones K and Bean A R. 2010. Characterisation and mapping of forest communities by clustering individual tree crowns. Remote Sensing of Environment, 114 (11): 2536–2547. [DOI: 10.1016/j.rse.2010.05.030]

-

Culvenor D S. 2002. TIDA: an algorithm for the delineation of tree crowns in high spatial resolution remotely sensed imagery. Computers and Geosciences, 28 (1): 33–44. [DOI: 10.1016/S0098-3004(00)00110-2]

-

Deng G, Li Z Y, Wu H G and Zhang X. 2011. Automated extracting tree crown from quickbird stand image//Proceedings of the 4th IFIP TC 12 Conference on Computer and Computing Technologies in Agriculture. Nanchang, China: Springer: 304-311 [DOI: 10.1007/978-3-642-18333-1_36]

-

Deng R, Huang J F and Wang F M. 2011. Research on extraction method of water body with DS spectral enhancement based on HJ-1 images. Spectroscopy and Spectral Analysis, 31 (11): 3064–3068. [DOI: 10.3964/j.issn.1000-0593(2011)11-3064-05] ( 邓睿, 黄敬峰, 王福民. 2011. 基于去相关拉伸光谱增强的HJ-1影像水体信息提取方法研究. 光谱学与光谱分析, 31 (11): 3064–3068. [DOI: 10.3964/j.issn.1000-0593(2011)11-3064-05] )

-

Erikson M. 2003. Segmentation of individual tree crowns in colour aerial photographs using region growing supported by fuzzy rules. Canadian Journal of Forest Research, 33 (8): 1557–1563. [DOI: 10.1139/x03-062]

-

Erikson M and Olofsson K. 2005. Comparison of three individual tree crown detection methods. Machine Vision and Applications, 16 (4): 258–265. [DOI: 10.1007/s00138-005-0180-y]

-

Fang F, Im J, Lee J and Kim K. 2016. An improved tree crown delineation method based on live crown ratios from airborne LiDAR data. GIScience and Remote Sensing, 53 (3): 402–419. [DOI: 10.1080/15481603.2016.1158774]

-

Feng C. 2007. Research of K-means Clustering Algorithm[D]. Dalian: Dalian University of Technology (冯超. 2007. K-means聚类算法的研究[D]. 大连: 大连理工大学)

-

Gougeon F A. 1995. A crown-following approach to the automatic delineation of individual tree crowns in high spatial resolution aerial images. Canadian Journal of Remote Sensing, 21 (3): 274–284. [DOI: 10.1080/07038992.1995.10874622]

-

Gougeon F A and Leckie D G. 2006. The individual tree crown approach applied to Ikonos images of a coniferous plantation area. Photogrammetric Engineering and Remote Sensing, 72 (11): 1287–1297. [DOI: 10.14358/PERS.72.11.1287]

-

Hung C, Bryson M and Sukkarieh S. 2012. Multi-class predictive template for tree crown detection. ISPRS Journal of Photogrammetry and Remote Sensing, 68 : 170–183. [DOI: 10.1016/j.isprsjprs.2012.01.009]

-

Jing L H, Hu B X, Noland T and Li J L. 2012. An individual tree crown delineation method based on multi-scale segmentation of imagery. ISPRS Journal of Photogrammetry and Remote Sensing, 70 : 88–98. [DOI: 10.1016/j.isprsjprs.2012.04.003]

-

Karlson M, Reese H and Ostwald M. 2014. Tree crown mapping in managed woodlands (Parklands) of semi-arid West Africa using WorldView-2 imagery and geographic object based image analysis. Sensors (Basel), 14 (12): 22643–22669. [DOI: 10.3390/s141222643]

-

Ke Y H and Quackenbush L J. 2007. Forest species classification and tree crown delineation using quickbird imagery//Proceedings of ASPRS 2007 Annual Conference. Tampa, Florida: ASPRS: 9

-

Lamar W R, McGraw J B and Warner T A. 2005. Multitemporal censusing of a population of eastern hemlock (Tsuga canadensis L.) from remotely sensed imagery using an automated segmentation and reconciliation procedure . Remote Sensing of Environment, 94 (1): 133–143. [DOI: 10.1016/j.rse.2004.09.003]

-

Larsen M, Eriksson M, Descombes X, Perrin G, Brandtberg T and Gougeon F A. 2011. Comparison of six individual tree crown detection algorithms evaluated under varying forest conditions. International Journal of Remote Sensing, 32 (20): 5827–5852. [DOI: 10.1080/01431161.2010.507790]

-

Li D, Ke Y H, Gong H L, Li X J and Deng Z. 2016. Urban tree species classification with machine learning classifier using worldview-2 imagery. Geography and Geo-Information Science, 32 (1): 84–89. [DOI: 10.3969/j.issn.1672-0504.2016.01.016] ( 李丹, 柯樱海, 宫辉力, 李小娟, 邓曾. 2016. 基于高分辨率遥感影像的城市典型乔木树种分类研究. 地理与地理信息科学, 32 (1): 84–89. [DOI: 10.3969/j.issn.1672-0504.2016.01.016] )

-

Lin Y, Jiang M, Yao Y J, Zhang L F and Lin J Y. 2015. Use of UAV oblique imaging for the detection of individual trees in residential environments. Urban Forestry and Urban Greening, 14 (2): 404–412. [DOI: 10.1016/j.ufug.2015.03.003]

-

Pollock R J. 1996. The Automatic Recognition of Individual Trees in Aerial Images of Forests Based on a Synthetic Tree Crown Image Model. Vancouver, Canada: University of British Columbia

-

Rango A, Laliberte A, Herrick J E, Winters C, Havstad K, Steele C and Browning D. 2009. Unmanned aerial vehicle-based remote sensing for rangeland assessment, monitoring, and management. Journal of Applied Remote Sensing, 3 (1): 033542 [DOI: 10.1117/1.3216822]

-

Shen L Q, Jiang R R and Wang P F. 2017. A method for individual tree-crown extraction from high spatial resolution imagery. Remote Sensing Information, 32 (3): 142–148. [DOI: 10.3969/j.issn.1000-3177.2017.03.023] ( 沈利强, 姜仁荣, 王培法. 2017. 一种高分辨率遥感图像单木树冠信息提取方法. 遥感信息, 32 (3): 142–148. [DOI: 10.3969/j.issn.1000-3177.2017.03.023] )

-

Wang L M, Liu J, Yang L B, Chen Z X, Wang X L and Ouyang B. 2013. Applications of unmanned aerial vehicle images on agricultural remote sensing monitoring. Transactions of the Chinese Society of Agricultural Engineering, 29 (18): 136–145. [DOI: 10.3969/j.issn.1002-6819.2013.18.017] ( 王利民, 刘佳, 杨玲波, 陈仲新, 王小龙, 欧阳斌. 2013. 基于无人机影像的农情遥感监测应用. 农业工程学报, 29 (18): 136–145. [DOI: 10.3969/j.issn.1002-6819.2013.18.017] )

-

Wulder M, Niemann K O and Goodenough D G. 2000. Local maximum filtering for the extraction of tree locations and basal area from high spatial resolution imagery. Remote Sensing of Environment, 73 (1): 103–114. [DOI: 10.1016/S0034-4257(00)00101-2]

-

Zhang N, Feng Y W, Zhang X L and Fan J C. 2015. Extracting individual tree crown by combining spectral and texture features from aerial images. Journal of Beijing Forestry University, 37 (3): 13–19. [DOI: 10.13332/j.1000-1522.20140309] ( 张凝, 冯跃文, 张晓丽, 樊江川. 2015. 结合航空影像纹理和光谱特征的单木冠幅提取. 北京林业大学学报, 37 (3): 13–19. [DOI: 10.13332/j.1000-1522.20140309] )

-

Zhang Q Y, Cen M Y, Zhou G Q and Yang X Y. 2009. Extracting trees from LiDAR data in urban region. Acta Geodaetica et Cartographica Sinica, 38 (4): 330–335. [DOI: 10.3321/j.issn:1001-1595.2009.04.008] ( 张齐勇, 岑敏仪, 周国清, 杨晓云. 2009. 城区LiDAR点云数据的树木提取. 测绘学报, 38 (4): 330–335. [DOI: 10.3321/j.issn:1001-1595.2009.04.008] )

-

Zhou Y F, Zhang H F, Li X, Yang F and Ding C F. 2014. Analysis on effects of tree crown information from unmanned aerial vehicle image extraction by different methods. Journal of Xinjiang Agricultural University, 37 (3): 231–235. [DOI: 10.3969/j.issn.1007-8614.2014.03.012] ( 周艳飞, 张绘芳, 李霞, 杨帆, 丁程锋. 2014. 不同方法提取无人机影像树冠信息效果分析. 新疆农业大学学报, 37 (3): 231–235. [DOI: 10.3969/j.issn.1007-8614.2014.03.012] )