|

收稿日期: 2016-06-13; 修改日期: 2016-06-07;

优先数字出版日期: 2016-09-25

基金项目: 国家自然科学基金重点项目(编号:41431175);国家自然科学基金项目(优青)(编号:41422108)

第一作者简介:

张良培(1962-), 男, 教授, 研究方向为测绘、遥感图像处理、人工智能、模式识别等。E-mail:zlp62@whu.edu.cn

中图分类号: TP75

文献标识码: A

文章编号: 1007-4619(2016)05-1050-12

|

摘要

数据融合是提升遥感影像应用能力的重要手段,一直是遥感信息处理与应用领域的研究热点。本文系统综述了遥感数据融合的进展与前瞻:首先对数据融合的层次与分类进行了总结和归纳,将遥感数据融合划分为同质遥感数据融合、异质遥感数据融合、遥感-站点数据融合、遥感-非观测数据融合4大类;在此基础上,重点针对时-空-谱光学遥感数据的融合,从多视超分辨率融合、多尺度融合、空-谱融合、时-空融合、时-空-谱一体化融合等方面进行了详细阐述;最后总结了遥感数据融合的前瞻研究方向,包括时-空-谱一体化融合的拓展、空天地观测数据的跨尺度融合、传感网环境下的在线融合、面向应用的融合方法等。

关键词

遥感影像 , 数据融合 , 时-空-谱一体化 , 多源 , 传感网

Abstract

Data fusion is an important means of improving the applicability of remote sensing images, and has long been a hot research topic in the remote sensing field. This paper reviews the progress and future of remote sensing data fusion. First, the hierarchy and category of data fusion are summarized, and remote sensing data fusion methods are classified into four categories, namely, homogeneous data fusion, heterogeneous data fusion, fusion for remote sensing observation and station data, and fusion for remote sensing observation and non-observed data. Second, this paper discusses spatio-temporal-spectral fusion of optical remote sensing data, including multi-view spatial fusion, multi-scale fusion, spatio-spectral fusion, spatio-temporal fusion, and integrated spatio-temporal-spectral fusion. Third, this paper discusses the prospective direction of remote sensing data fusion literature, including the extension of integrated spatio-temporal-spectral fusion, across-scale fusion from aerospace to ground observations, online fusion in sensor web environment, and application-oriented fusion.

Key words

remote sensing image , data fusion , spatio-temporal-spectral integration , multi source , sensor

1 引言

随着对地观测技术的发展,大量遥感卫星源源不断地发射,对地遥感已经进入了多平台、多传感器、多角度观测的发展阶段。新型传感器以及对地观测传感网等新技术的发展,使得高空间分辨率、高时间分辨率、高光谱分辨率的遥感获取能力进一步提升,为资源调查、环境监测、建设规划、军事侦查等应用提供了十分丰富的数据源。然而,由于成像指标之间相互制约,单一遥感系统观测的地表信息往往并不全面。例如,遥感系统的空间、时间和光谱分辨率,分别代表了对地球表面的细节表征能力、重访观测能力和光谱探测能力,都是十分重要的成像指标。但是,受光学衍射极限、调制传递函数、信噪比等因素的影响,同时获得时间、空间与光谱的高分辨率十分困难(赵书河,2008),从而限制了其在诸多领域的应用能力。

多传感器数据融合能够突破单一传感器的性能桎梏,有效发挥多平台互补观测的优势,实现更加精准、全面的陆表监测。数据融合的概念产生于20世纪70年代初期,但其理论方法研究则是20世纪80年代以后才开始(张永生 等,2005),并取得了快速发展,迄今仍是各应用领域的研究热点。为了增强军事研究人员之间的交流,美国国防部门JPL (Joint Directors of Laboratories)于1986年成立数据融合工作组,并编纂完成数据融合词典(Lexicon,1991;Kessler等,1992)。在学术领域,尽管在20世纪80年代初期就已经开始了数据融合的研究,但到90年代初才开始有相对正式的定义。

Mangolini(1994)、Hall和Llinas(1997)、Pohl和Van Genderen等人(1998)分别对数据融合给出了不同的定义。其中,Pohl和Genderen的定义比较典型,他们认为影像融合就是利用某种算法,将两幅或多幅影像组合成一幅新影像的技术。该定义十分贴近人们对数据融合的传统认识,但属于狭义的数据融合,因为生成新影像并不是影像融合的唯一目标,也可能是为了获取更精确的特征信息、更高的地物识别精度等。Wald(1999)在遥感领域顶级期刊IEEE地学与遥感汇刊,以批判的态度专门对数据融合的定义进行了讨论,并给出了所推崇的新定义,但也并没有得到学术界积极响应。中国学者李军(1999)、贾永红(2005)、赵书河(2008)等人也分别对遥感数据融合给出了不同的诠释。著名数据融合专家Alparone等人(2015)在最新出版的融合专著中,认为遥感数据融合的目标是针对某种调查现象,协同组合两个或更多影像数据,以获取比单一影像更多的知识。

不同学者对数据融合之所以有不同的见解,最根本原因是其涵盖内容广泛,界限确定比较困难,从不同的角度出发就会得出不同的诠释。本文在综合已有研究的基础上,将遥感数据融合定义为:针对同一场景并具有互补信息的多幅遥感数据或其它观测数据,通过对它们的综合处理、分析与决策,获取更高质量数据、更优化特征、更可靠知识的技术和框架系统。本定义首先在输入端强调了数据之间的互补性,并包含了遥感数据与非遥感观测数据之间的融合;在输出端,融合的结果可能是一幅高质量的影像,也可能是更优化的特征,还可能是经过某种决策获得的知识,这与下文介绍的数据融合3个层次相对应。此外,遥感数据融合也不一定限制为多个传感器的数据,同一传感器在不同成像条件下获取的数据,只要包含互补信息,就可以进行数据融合。

2 遥感数据融合的层次与分类

2.1 数据融合的层次

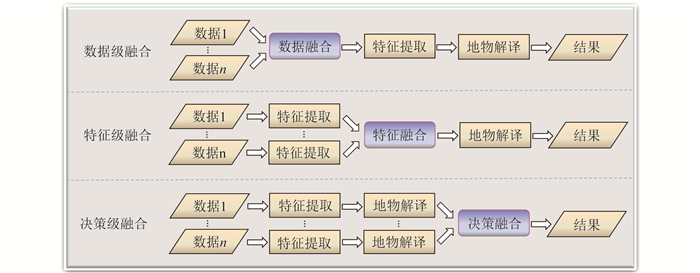

数据融合一般可以分为3个层级,分别为数据级、特征级和决策级(Hall和Llinas,1997)。如图 1所示,数据级融合主要是对传感器原始观测数据或经过预处理的数据进行融合,生成新数据,其主要目的就是为了提升数据的质量,如分辨率、对比度、完整度等指标;特征级融合首先对不同数据分别进行相关特征的提取,然后再对提取的特征进行融合处理,生成新的特征或特征矢量,以便于后续的地物解译;决策级融合首先利用不同传感器数据分别进行地物解译,获得地物类别或属性的初步确定,然后再利用一定的决策规则加以融合,主要解决不同数据产生结果的不一致性,从而获取更可靠的决策知识。

在具体应用中,如果可以分别进行数据层、特征层与决策层融合,哪层更优呢?其实并没有确切的答案,要视应用的实际情况而定。通常情况下,数据级融合所输入的数据必须是相称的(Hall和Llinas,1997),即数据需要是对同一物理现象观测所得,不然就只能进行特征级或决策级融合。即使数据是相称的,数据层融合也更适合于同质的遥感数据,如具有不同时间、空间、光谱尺度的光学数据。对于异质数据融合,如光学数据与雷达、热红外数据的融合,由于其成像机理差异太大,则更适合进行特征级、决策级的融合。值得注意的是,这3种融合策略并不是完全不兼容的,而是可以联合使用,多层联合的融合也是一个前沿的研究方向。

2.2 遥感融合的分类

根据融合的数据类型,本文将遥感数据融合归为4大类,分别是同质遥感数据融合、异质遥感数据融合、遥感—站点数据融合、遥感—非观测数据融合。

(1) 同质遥感数据融合。同质遥感数据融合指同一成像手段观测数据之间的融合,其中,以可见光—近红外波段成像的光学数据之间的数据级融合最为常见。该类技术的主要目的是为了缓解空间分辨率、时间分辨率、光谱分辨率之间的固有矛盾,获得最优的时、空、谱分辨率;最早出现和发展最为成熟的是全色—多光谱数据融合,还包括多时相融合(Merino和Nunez,2007;Shen等,2009)、全色—高光谱融合(Hardie等,2004;Cetin和Musaoglu,2009)、多光谱—高光谱融合(Chen等,2014;Wei等,2015)、时—空融合(Gao等,2006;Wu等,2015)、时—空—谱一体化融合(Shen,2012;Huang等,2013;Meng等,2015b)等。

(2) 异质遥感数据融合。异质遥感数据融合指不同成像手段观测数据之间的融合,如光学—红外数据融合(Laurs和Michael,1990;Moser等,2014;Eslami和Mohammadzadeh,2016;Li等,2015)、光学—雷达数据融合(Bilgin和Ustuner,2015;Gianinetto等,2015;Idol等,2015)等。如前所述,一般来说,异质数据更适合于进行特征级、决策级的融合,如利用不同传感器数据进行地物分类、参量反演等。另外,异质数据也可以被用于数据级的融合,但由于其成像机理差异太大,很难将它们融合成一幅满足物理属性(如没有光谱畸变)的数据,往往是满足视觉判读和一些特定的应用需求。

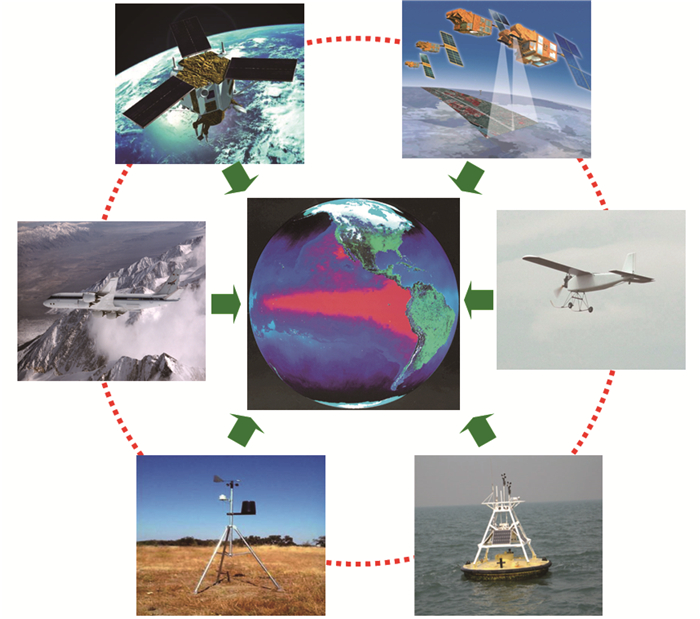

(3) 遥感—站点数据融合。遥感和地基观测,是获得资源环境特征数据的两个重要手段,它们各有优势与不足。遥感能够提供大范围的面域观测,但由于其成像过程复杂,观测精度经常难以保证;地基观测精度高,但观测站点比较稀疏,只能以“点”代“面”。因此,融合遥感与地基观测数据(Beyer等,1997;Chatterjee等,2010;Corona等,2014),是获得高精度、空间连续地表数据的重要手段,空天地一体化协同观测与融合应用是当前的重要发展趋势(图 2)。

(4) 遥感—非观测数据融合。遥感数据还可以与一些非观测数据进行融合处理与协同应用。遥感数据与陆面、大气、水文动力学模式进行融合,一般被称为数据同化(黄春林和李新,2004;李新和黄春林,2004;李新 等,2007),遥感数据可以为模式提供更精确的初始场与边界条件,使模式不断地依靠观测自动调整模式轨迹,从而减小模拟误差;遥感数据可以与代用数据(如树轮重建数据)进行融合,进行水文气象与植被信息的协同分析(Babst等,2010);此外,遥感数据还可以与地图、统计数据等进行典型领域的综合应用。

3 时—空—谱遥感数据融合

在上述4类遥感数据融合中,针对时—空—谱光学遥感数据的融合,理论发展和技术应用最为成熟,其主要目的是提升影像的分辨率,缓解空间分辨率、时间分辨率与光谱分辨率之间的矛盾,本节将对其进行详细阐述。

3.1 多视超分辨率融合

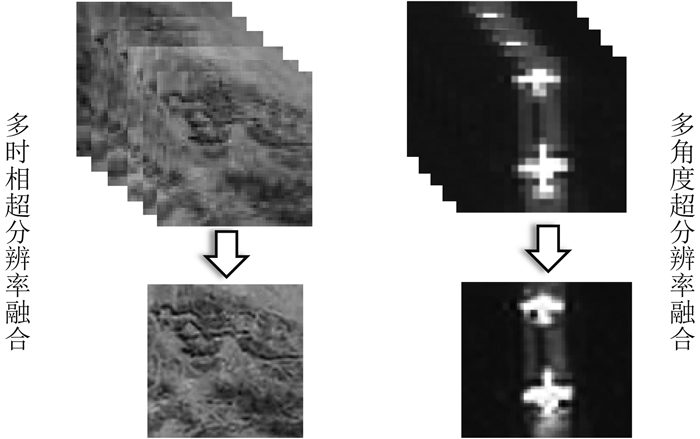

多视超分辨率融合也被称为超分辨率技术,主要通过对具有亚像素位移的多视场(多时相、多角度)遥感影像进行处理,融合出一幅或多幅高空间分辨率的影像(Park等,2003;张良培 等,2012)。Tsai和Huang于1984年就提出对同一遥感器的不同时相影像进行融合,生成一幅具有更高空间分辨率影像的设想(Tsai和Huang,1984),由此催生了影像融合的一个重要研究分支—超分辨率技术。之后,该技术在近景影像处理、视频影像处理、医学影像处理等领域得到了非常深入的发展和广泛的应用。SPOT 5卫星通过硬件与软件相结合的方式,将两幅相互错位的5 m分辨率影像融合出2.5 m的高分辨率影像(Latry和Rougé,2003),成为遥感领域的成功应用典范。然而,由于遥感成像的复杂性与时空多变性,通过最经典的纯“软件”方式进行遥感影像超分辨率的研究一直未见报道。

Shen等人(2009)率先实现了真实观测条件下多时相遥感影像的超分辨率处理,在不改变观测系统的条件下有效提升了影像空间分辨率,证明了Tsai和Huang的原始假设。Merino和Nunez(2007)同期也开展了相关研究,提出了一个针对Landsat影像的超分辨率融合方法,之后该方向陆续发表多篇论文(Li等,2010;Ma等,2012)。值得注意的是,如果成像重访周期较长,在不同时相的遥感影像中地面目标就可能会发生变化,这对超分辨率处理的影响较大,是一个重要的限制因素。而多角度遥感成像传感器可以获得几乎同一时间不同角度的影像,比多时相更加具备超分辨率的前提条件(Pacifici等,2011),目前学者们已经进行了有益探索,并已发展了多个可行的处理方法(Ma等,2012, 2014;Zhang等,2014;Ma等,2014)。另外,最近凝视卫星、视频卫星的出现,将给遥感影像超分辨率研究带来更快的发展(Murthy等,2014;Yue等,2016),是具有重要研究价值和应用潜力的研究方向。图 3为多时相超分辨率融合和多角度超分辨率融合的实例,可以明显看出,融合影像的空间分辨率得到了较大提升。

3.2 多尺度遥感影像融合

在遥感成像中,空间分辨率、光谱分辨率与成像幅宽也存在相互制约的关系。例如,高分一号卫星8 m多光谱影像的幅宽是60 km,而16 m多光谱影像的幅宽可以达到800 km;EO-1中Hyperion和ALI传感器的光谱波段数分别是242和9,而它们的幅宽则分别是7.5 km和37 km。多尺度融合主要是缓解空间/光谱分辨率与成像幅宽之间的矛盾,通过对不同空间或光谱尺度的遥感数据进行处理,以获得最优的空间/光谱分辨率与影像幅宽(张良培 等,2012)。

受光学变焦影像融合的启发(Joshi和Chaudhuri,2004;Ng等,2007),沈焕锋(2007)利用模拟实验,验证了对遥感影像进行多尺度融合的优势。Song等人(2015)进一步提出了一种基于学习的多尺度融合方法,利用SPOT 5卫星影像的高空间分辨率和Landsat TM/ETM+影像具有较大幅宽的互补优势,融合得到宽幅高空间分辨率影像数据。Sun等人(2015)提出基于光谱分辨率增强技术的遥感影像多尺度融合方法,通过对EO-1 Hyperion高光谱影像和ALI宽幅多光谱影像的融合,得到了宽幅Hyperion高光谱影像数据。需要说明的是,在以上多尺度遥感影像融合中,如果输入影像的尺度差异过大,往往难以获得理想的处理效果。此外,以上两个研究中还仅利用了两个尺度的遥感数据,随着可用卫星资源的增加,对更多尺度的多源数据进行融合,其应用效果值得期待。多尺度遥感影像融合如图 4显示,融合影像同时具备了最大幅宽和较高的空间分辨率。

3.3 空—谱遥感信息融合

空—谱融合主要解决空间分辨率与光谱分辨率之间的制约问题,利用同一区域两幅或多幅具有不同空间、光谱分辨率的遥感影像进行融合,获得同时具有高空间分辨率和高光谱分辨率的遥感影像。常见的空—谱融合方法包括:全色—多光谱融合(Thomas等,2008;Alparone等,2015)、全色—高光谱融合(Cetin和Musaoglu,2009;Loncan等,2015)、多光谱—高光谱融合(Yokoya等,2012;Loncan等,2015)等。

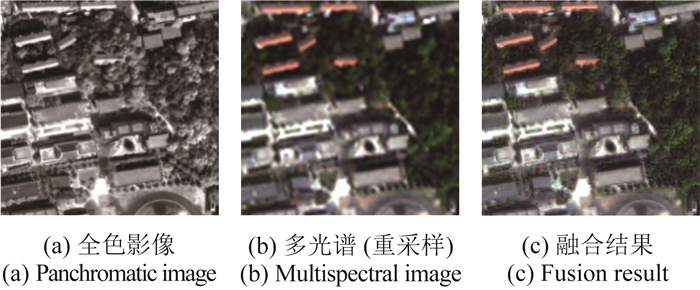

全色—多光谱融合是最经典的遥感融合技术(图 5)。该融合技术起源于20世纪80年代(Schowengerdt,1980;Hallada和Cox,1983;Cliche等,1985),自1986年SPOT 1卫星系统可同时提供全色和多光谱影像以来,全色—多光谱融合技术得到了快速发展,并提出了大量方法(Wang等,2005;Alparone等,2007;Thomas等,2008;Aiazzi等,2012;Alparone等,2015;Vivone等,2015)。总体来说,现有主流的全色/多光谱融合方法可分为4类:基于成分替换的融合方法(Gillespie等,1987;Tu等,2001)、基于多分辨率分析的融合方法(Aiazzi等,2002;Otazu等,2005)、基于模型优化的融合方法(Zhang等,2012;孟祥超 等,2014)和基于稀疏表达的融合方法(Li和Yang,2011;Jiang等,2012)。其中,基于成份替换的融合方法和基于多分辨率分析的融合方法发展较早,多种方法已引入ENVI、ERDAS IMAGING、PCI Geomatica等专业遥感软件,最近仍然有一些改进的算法出现,也有学者们将这两类方法统一到同一个融合框架中(Tu等,2001;Wang等,2005)。基于模型优化融合方法(Zhang等,2012;孟祥超 等,2014)的核心思想是把融合看做一个逆问题,建立待融合影像与全色/多光谱观测影像之间的关系模型,并构建最优化能量函数,通过模型的优化求解得到融合影像。由于在模型上更加严谨,相比于传统方法,基于模型优化的融合方法具有较高的融合精度,特别是在光谱保真度方面性能更优,但模型求解较为复杂、效率较低。基于稀疏表达的融合方法(Li和Yang,2011;Jiang等,2012)是在基于模型优化方法上的进一步发展,近年来备受关注,被认为是新一代融合方法(Carlà等,2015),其基本思想是假定待求融合影像满足稀疏特性,通过字典学习建立全色与多光谱影像之间的映射关系,并以此重建融合影像,其优缺点和基于模型优化的方法相近。

在全色—多光谱影像融合基础上,近年来全色—高光谱融合(Cetin和Musaoglu,2009;Loncan等,2015)和多光谱—高光谱融合(Yokoya等,2012;Loncan等,2015)也逐渐受到关注,许多全色—多光谱融合方法已应用扩展到这两类融合方法之中(Cetin和Musaoglu,2009;Chen等,2014;Loncan等,2015)。除此之外,学者们已提出基于模型和基于混合像元分解的全色—高光谱融合(Winter和Winter,2002;Hardie等,2004)和多光谱—高光谱融合方法(Eismann和Hardie,2005;Yokoya等,2012)。相比于全色/多光谱融合方法,高光谱影像的融合更具挑战性,特别是当全色、多光谱影像与高光谱影像的波谱范围不一致时,如何在保持光谱特性的同时,实现空间分辨率的提升,仍然是一个难点。

鉴于空—谱融合受到的极大关注,已有多篇文献对全色—多光谱融合(Wang等,2005;Alparone等,2007;Thomas等,2008;Aiazzi等,2012;Alparone等,2015)以及全色/高光谱融合、多光谱/高光谱融合方法(Loncan等,2015)的研究进展进行了全面总结。评价空—谱融合主要有两个方面,一个是空间信息融入度,主要表达影像空间分辨率的提高程度;另一个是光谱信息的保真度,指的是对原有光谱信息的损伤程度。本文认为二者是不可以兼得的,即没有任何一种方法能够在融入度和保真度两个方面同时达到最优,只能在一定程度上进行某种折中。以上问题在评价融合方法时应尤为注意,例如,IEEE 2006年举办过一次融合大赛(Alparone等,2007),对一些融合方法进行了比较,但在国际上也产生了一些争议,主要问题就是在空间和光谱的侧重上面。因此,在融合方法选择上,也要根据实际应用目的而定。为了提高融合方法的实用性,发展空间—光谱可调的融合方法将是一个重要的发展趋势(Zhang等,2012)。

3.4 时—空遥感信息融合

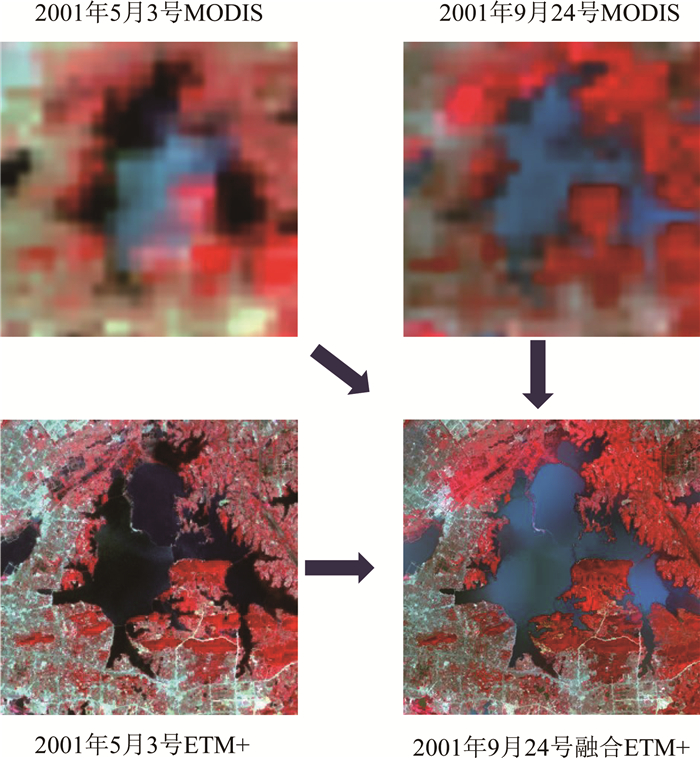

时—空融合是为了缓解时间分辨率和空间分辨率相互制约的问题,通过融合多源遥感数据的高空间分辨率和高时间分辨率特征,以实现高空间分辨率数据在时间上的连续。如图 6所示,通过融合2001年5月3号ETM+、MODIS影像和2001年9月24号MODIS影像,可得到2001年9月24号的ETM+影像数据。

常见的遥感数据时—空融合方法大体分为3类:基于混合像元分解的融合方法、基于时空滤波的融合方法、基于稀疏表达的融合方法。其中,基于混合像元分解的融合方法由Zhukov等人(1999)首次提出,后经Minghelli-Roman等人(2001)、Zurita-Milla等人(2008)、Gevaert和García-Haro(2015)多次论证和改进,已发展成为一种较为成熟的时—空融合模型,该类方法主要适用于地物空间信息无明显变化、属性信息存在变化的情况。基于时空滤波的融合方法最为流行、应用范围也较广(Gao等,2006;Zhu等,2010;Shen等,2013;Wu等,2013,2015),该类方法框架简单,一般通过辅助多源、多时相遥感数据进行算术运算,并利用移动窗口内相似像元预测融合影像。代表性方法有时空自适应反射率影像融合方法(Gao等,2006)、增强时空自适应反射率的影像融合方法(Zhu等,2010)、非局部滤波方法(刘慧琴,2016)等。基于稀疏表达的时—空融合方法(Huang和Song,2012;Song和Huang,2013)正引起国内外学者的广泛关注,该类方法基于稀疏表达理论,通过学习不同时相影像数据之间的变化规律,预测未知影像,其被证明能很好地预测出地物类型的变化,但该类方法于近年才兴起,其普适性仍待进一步验证。总的来说,遥感数据时—空融合技术已经取得较大的进展,并有望得到更广泛的应用。然而,针对时间序列地物影像变化较大或数据缺失严重等问题,至今还没有完全解决,仍然值得进一步深入研究。

3.5 时—空—谱一体化融合

上述各种遥感影像融合技术相对独立发展,由于缺乏统一的处理框架,它们仅能对特定的影像进行处理,不能适应当前多传感器组网对地观测的发展趋势。主要问题包括:(1)大多数融合方法只针对两个传感器数据,不能充分利用多传感器数据包含的冗余、互补信息;(2)主要针对一个或两个分辨率指标之间的融合,无法同时融合空间、时间和光谱特性,以得到空间、时间、光谱分辨率兼优的融合影像。因此,有必要发展时—空—谱遥感信息的一体化融合方法,建立统一的融合框架,实现对多时相、多谱段、多尺度数据的联合建模与处理。

在一体化融合理论方法发展中,国内学者做出了较大贡献。从2010年开始,武汉大学在国家自然科学基金的资助下开始相关研究,首次提出了时—空—谱一体化融合的概念与基于最大后验概率理论的融合框架,并发表了相关的研究成果(Shen,2012)。香港中文大学对遥感数据的时、空、谱关联模型进行了进一步探索,同样基于最大后验估计理论,提出了一种新的时—空—谱一体融合方法(Huang等,2013),但仍然是针对两个传感器(Landsat和MODIS)数据的融合方面。Meng等人(2015a)、Wu等人(2015)在3个传感器融合方面取得了重要进展,但没有全面考虑时、空、谱特征。并在此基础上,Meng等人(2015b)进一步提出了一个统一的融合框架,既能够有效融合时、空、谱互补信息,同时消除了传感器数量的限制。

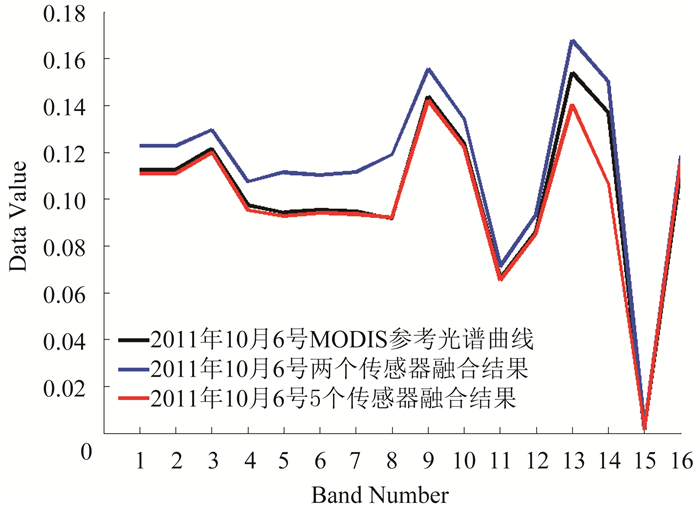

图 7为时—空—谱一体化融合示例。输入数据包括2011年9月4号MODIS影像、ETM+多光谱影像、ETM+全色影像;9月22号MODIS影像、SPOT 5多光谱影像、SPOT 5全色影像;以及10月6号MODIS影像。融合目标是得到10月6号高空间、高光谱分辨率影像数据。图中包括两组融合实验:一是两个传感器融合,即具有最高光谱分辨率的MODIS和最高空间分辨率的SPOT全色数据之间的融合;二是5个传感器的一体化融合。可以看出,和重采样的ETM+数据相比,两个传感器融合结果在空间细节和光谱波段上已经有了较大提升,这是因为最高空间、光谱分辨率的数据参与了融合处理,但其色彩发生了较大偏差;而5个传感器一体化融合结果,在空间分辨率提升的同时,影像的色彩信息保持良好。图 8为融合结果光谱曲线对比展示,同样可以明显看出,两个传感器融合结果具有较大光谱损失,而5个传感器的一体化融合的光谱保真度更优,充分体现了一体化融合的处理优势。然而,这不一定意味着传感器数量就是越多越好,还与其提供的互补信息量、信噪比等因素密切相关。

4 结语

经过几十年的发展,遥感数据融合研究已经取得了长足的进展,一些融合技术如全色—多光谱融合,已经进入数据应用的标准处理流程,并被广泛应用。然而,遥感数据融合的发展还远未成熟,目前仍然是国内外的研究热点,具有前瞻性方向包括:

(1) 时—空—谱一体化融合的拓展。随着具有不同时、空、谱特征卫星资源的增加,时—空—谱一体化融合将具有更加重要的应用前景。目前时—空—谱一体化融合主要在理论框架的构建上取得了突破,但在一些技术细节如时—空—谱关联模型、影像自适应加权、优化求解等方面仍需进一步研究和发展。此外,现有模型主要侧重于光学扫描传感器数据的处理,而对视频卫星、凝视卫星等新型传感器数据以及雷达、红外等异质数据的一体化处理能力还有待提升。

(2) 空天地观测数据的跨尺度融合。航天、航空、地基观测具有天然的互补优势,空天地耦合观测是对地观测技术的热点与前沿。然而,空天地传感器设计与观测机制迥异,获取的点—线—面数据在观测尺度上差异巨大,对它们进行融合存在较大的不确定性。如何顾及空天地观测数据的空间代表性差异,挖掘它们之间的相关性与映射关系,并实现跨尺度的数据融合,是一个重要的发展趋势。

(3) 传感网环境下的在线融合。实现多传感器优势互补的最优方式是构建对地观测传感网,它将具有感知、计算和通信能力的传感器与万维网进行有机结合,使分布式资源整合为一个独立、自主、任务可定制、动态适应并可重新配置的协同观测系统。传感网环境下数据多源、海量,但对数据处理的效率又有更高的要求,因此,基于并行计算、云计算等框架建立高性能计算方法,实现数据的在线融合与协同分析,是一个十分重要的新挑战。

参考文献(References)

-

Aiazzi B, Alparone L, Baronti S, Garzelli A.2002.Context-driven fusion of high spatial and spectral resolution images based on oversampled multiresolution analysis. IEEE Transactions on Geoscience and Remote Sensing, 40 (10): 2300–2312. DOI: 10.1109/TGRS.2002.803623.

-

Aiazzi B, Alparone L, Baronti S, Garzelli A and Selva M.2012.Twenty-five years of pansharpening:a critical review and new developments//Chen C H, ed.Signal and Image Processing for Remote Sensing, 2nd ed.Boca Raton, FL, USA:CRC Press:533-548

-

Alparone L, Aiazzi B, Baronti S and Garzelli A.2015.Remote Sensing Image Fusion.Boca Raton, Florida, USA:CRC Press

-

Vivone G, Alparone L, Chanussot J, Dalla Mura M, Garzelli A, Licciardi G A, Restaino R, Wald L.2015.A critical comparison among pansharpening algorithms. IEEE Transactions on Geoscience and Remote Sensing, 53 (5): 2565–2586. DOI: 10.1109/TGRS.2014.2361734.

-

Alparone L, Wald L, Chanussot J, Thomas C, Gamba P, Bruce L M.2007.Comparison of pansharpening algorithms:outcome of the 2006 GRS-S data-fusion contest. IEEE Transactions on Geoscience and Remote Sensing, 45 (10): 3012–3021. DOI: 10.1109/TGRS.2007.904923.

-

Babst F, Esper J, Parlow E.2010.Landsat Tm/Etm+and tree-ring based assessment of spatiotemporal patterns of the autumnal moth (Epirrita autumnata) in northernmost Fennoscandia. Remote Sensing of Environment, 114 (3): 637–646. DOI: 10.1016/j.rse.2009.11.005.

-

Beyer H G, Czeplak G, Terzenbach U, Wald L.1997.Assessment of the method used to construct clearness index maps for the new European Solar Radiation Atlas (ESRA). Solar Energy, 61 (6): 389–397. DOI: 10.1016/S0038-092X(97)00084-4.

-

Bilgin G, Ustuner M.2015.Enhancing land use classification with fusing dual-polarized TerraSAR-X and multispectral RapidEye data. Journal of Applied Remote Sensing, 9 (1): 096054 DOI: 10.1117/1.JRS.9.096054.

-

Carlà R, Santurri L, Aiazzi B, Baronti S.2015.Full-scale assessment of pansharpening through polynomial fitting of multiscale measurements. IEEE Transactions on Geoscience and Remote Sensing, 53 (12): 6344–6355. DOI: 10.1109/TGRS.2015.2436699.

-

Cetin M, Musaoglu N.2009.Merging hyperspectral and panchromatic image data:qualitative and quantitative analysis. International Journal of Remote Sensing, 30 (7): 1779–1804. DOI: 10.1080/01431160802639525.

-

Chatterjee A, Michalak A M, Kahn R A, Paradise S R, Braverman A J, Miller C E.2010.A geostatistical data fusion technique for merging remote sensing and ground-based observations of aerosol optical thickness. Journal of Geophysical Research:Atmospheres, 115 (D20): DOI: 10.1029/2009JD013765.

-

Chen Z, Pu H Y, Wang B, Jiang G-M.2014.Fusion of hyperspectral and multispectral images:a novel framework based on generalization of pan-sharpening methods. IEEE Geoscience and Remote Sensing Letters, 11 (8): 1418–1422. DOI: 10.1109/LGRS.2013.2294476.

-

Cliche G, Bonn F, Teillet P.1985.Integration of the spot panchromatic channel into its multispectral mode for image sharpness enhancement. Photogrammetric Engineering and Remote Sensing, 51 (3): 311–316.

-

Corona P, Fattorini L, Franceschi S, Chirici G, Maselli F, Secondi L.2014.Mapping by spatial predictors exploiting remotely sensed and ground data:a comparative design-based perspective. Remote Sensing of Environment, 152 : 29–37. DOI: 10.1016/j.rse.2014.05.011.

-

Eismann M T, Hardie R C.2005.Hyperspectral resolution enhancement using high-resolution multispectral imagery with arbitrary response functions. IEEE Transactions on Geoscience and Remote Sensing, 43 (3): 455–465. DOI: 10.1109/TGRS.2004.837324.

-

Eslami M, Mohammadzadeh A.2016.Developing a spectral-based strategy for urban object detection from airborne hyperspectral TIR and visible data. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 9 (5): 1808–1816. DOI: 10.1109/JSTARS.2015.2489838.

-

Gao F, Masek J, Schwaller M, Hall F.2006.On the blending of the Landsat and MODIS surface reflectance:predicting daily Landsat surface reflectance. IEEE Transactions on Geoscience and Remote Sensing, 44 (8): 2207–2218. DOI: 10.1109/TGRS.2006.872081.

-

Gevaert C M, García-Haro F J.2015.A comparison of STARFM and an unmixing-based algorithm for Landsat and MODIS data fusion. Remote Sensing of Environment, 156 : 34–44. DOI: 10.1016/j.rse.2014.09.012.

-

Gianinetto M, Rusmini M, Marchesi A, Maianti P, Frassy F, Dalla Via G, Dini L, Rota Nodari F.2015.Integration of COSMO-SkyMed and GeoEye-1 data with object-based image analysis. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 8 (5): 2282–2293. DOI: 10.1109/JSTARS.2015.2425211.

-

Gillespie A R, Kahle A B, Walker R E.1987.Color enhancement of highly correlated images. Ⅱ.Channel ratio and ""chromaticity"" transformation techniques.Remote Sensing of Environment, 22 (3): 343–365. DOI: 10.1016/0034-4257(87)90088-5.

-

Hall D L, Llinas J.1997.An introduction to multisensor data fusion. Proceedings of the IEEE, 85 (1): 6–23. DOI: 10.1109/5.554205.

-

Hallada W A and Cox S.1983.Image sharpening for mixed spatial and spectral resolution satellite systems//International Symposium on Remote Sensing of Environment.Ann Arbor:Environmental Research Institute of Michigan:1023-1032

-

Hardie R C, Eismann M T, Wilson G L.2004.MAP estimation for hyperspectral image resolution enhancement using an auxiliary sensor. IEEE Transactions on Image Processing, 13 (9): 1174–1184. DOI: 10.1109/TIP.2004.829779.

-

Huang B, Song H H.2012.Spatiotemporal reflectance fusion via sparse representation. IEEE Transactions on Geoscience and Remote Sensing, 50 (10): 3707–3716. DOI: 10.1109/TGRS.2012.2186638.

-

Huang B, Zhang H K, Song H H, Wang J, Song C Q.2013.Unified fusion of remote-sensing imagery:generating simultaneously high-resolution synthetic spatial-temporal-spectral earth observations. Remote Sensing Letters, 4 (6): 561–569. DOI: 10.1080/2150704X.2013.769283.

-

Huang C L, Li X.2004.A review of land data assimilation system. Remote Sensing Technology and Application, 19 (5): 424–430.

-

( 黄春林, 李新. 2004. 陆面数据同化系统的研究综述. 遥感技术与应用, 19 (5): 424–430. )

-

Idol T, Haack B, Mahabir R.2015.Comparison and integration of spaceborne optical and radar data for mapping in sudan. International Journal of Remote Sensing, 36 (6): 1551–1569. DOI: 10.1080/01431161.2015.1015659.

-

Jia Y H. Multi-source Remote Sensing Data Fusion Technology. Multi-source Remote Sensing Data Fusion Technology. Beijing: Surveying and Mapping Press 2005 . ( 贾永红. 2005. 多源遥感影像数据融合技术. 北京: 测绘出版社 . )

-

Jiang C, Zhang H Y, Shen H F, Zhang L P.2012.A practical compressed sensing-based pan-sharpening method. IEEE Geoscience and Remote Sensing Letters, 9 (4): 629–633. DOI: 10.1109/LGRS.2011.2177063.

-

Joshi M V and Chaudhuri S.2004.Zoom based super-resolution through sar model fitting//International Conference on Image Processing.Singapore:IEEE:1775-1778 [DOI:10.1109/ICIP.2004.1421418].

-

Kessler O, Askin K, Beck N, Lynch J, White F, Buede D, Hall D and Llinas J.1992.Functional description of the data fusion process.Office of Naval Technology, Naval Air Development Center, Warminster, PA

-

Latry C and Rougé B.2003.Super resolution:quincunx sampling and fusion processing//2003 IEEE International Geoscience and Remote Sensing Symposium (IGARSS).Toulouse, France:IEEE:315-317[DOI:10.1109/IGARSS.2003.1293761].

-

Laurs P C F, Michael R.1990.Variability of the columbia river plume observed in visible and infrared satellite imagery. International Journal of Remote Sensing, 11 (6): 999–1010. DOI: 10.1080/01431169008955072.

-

Lexicon D F.1991.Data Fusion Subpanel of the Joint Directors of Laboratories.Technical Panel for 3.San Diego, CA

-

Li F, Jia X P, Fraser D, Lambert A.2010.Super resolution for remote sensing images based on a universal hidden markov tree model. IEEE Transactions on Geoscience and Remote Sensing, 48 (3): 1270–1278. DOI: 10.1109/TGRS.2009.2031636.

-

Li J.1999.The Theory, Algorithm, and Pratice of Multi-source Remote Sensing Image Fusion.Wuhan:Wuhan Technical University of Surveying and Mapping (李军.1999.多源遥感影象融合的理论、算法与实践.武汉:武汉测绘科技大学)

-

Li J Y, Zhang H Y, Guo M, Zhang L P, Shen H F, Du Q.2015.Urban classification by the fusion of thermal infrared hyperspectral and visible data. Photogrammetric Engineering and Remote Sensing, 81 (12): 901–911. DOI: 10.14358/PERS.81.12.901.

-

Li S T, Yang B.2011.A new pan-sharpening method using a compressed sensing technique. IEEE Transactions on Geoscience and Remote Sensing, 49 (2): 738–746. DOI: 10.1109/TGRS.2010.2067219.

-

Li X, Huang C L.2004.Data assimilation:a new means for multi-source geospatial data integration. Science and Technology Review (12): 13–16. ( 李新, 黄春林. 2004. 数据同化——一种集成多源地理空间数据的新思路. 科技导报 (12): 13–16. )

-

Li X, Huang C L, Che T, Jin R, Wang S G, Wang J M, Gao F, Zhang S W, Qiu C J, Wang C H.2007.The progress and future of land surface data assimilation system in China. Progress in Natural Science, 17 (2): 163–173. DOI: 10.1080/10020070612331343241. ( 李新, 黄春林, 车涛, 晋锐, 王书功, 王介民, 高峰, 张述文, 邱崇践, 王澄海. 2007. 中国陆面数据同化系统研究的进展与前瞻. 自然科学进展, 17 (2): 163–173. DOI: 10.1080/10020070612331343241. )

-

Liu H Q.2016.A Remote Sensing Spatial and Temporal Information Fusion Method based on Non-local Means Algorithm.Wuhan:Wuhan University (刘慧琴.2016.基于非局部滤波的遥感时空信息融合方法.武汉:武汉大学)

-

Loncan L, de Almeida L B, Bioucas-Dias J M, Briottet X, Chanussot J, Dobigeon N, Fabre S, Liao W Z, Licciardi G A, Simoes M, Tourneret J Y, Veganzones M A, Vivone G, Wei Q, Yokoya N.2015.Hyperspectral pansharpening:a review. IEEE Geoscience and Remote Sensing Magazine, 3 (3): 27–46. DOI: 10.1109/MGRS.2015.2440094.

-

Ma J L, Chan J C W, Canters F.2014.Robust locally weighted regression for superresolution enhancement of multi-angle remote sensing imagery. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 7 (4): 1357–1371. DOI: 10.1109/JSTARS.2014.2312887.

-

Ma J L, Chan J C W, Canters F.2012.An operational superresolution approach for multi-temporal and multi-angle remotely sensed imagery. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 5 (1): 110–124. DOI: 10.1109/JSTARS.2011.2182505.

-

Mangolini M.1994.Apport De La Fusion D'images Satellitaires Multicapteurs Au Niveau Pixel En Télédétection Et Photo-Interprétation.Université de Nice Sophia-Antipolis.

-

Meng X, Shen H, Li H, Yuan Q, Zhang H and Zhang L.2015a.Improving the spatial resolution of hyperspectral image using panchromatic and multispectral images:an integrated method//The 7th Workshop on Hyperspectral Image and Signal Processing:Evolution in Remote Sensing.Tokyo, Japan

-

Meng X C, Shen H F, Zhang H Y, Zhang L P, Li H F.2014.Maximum a posteriori fusion method based on gradient consistency constraint for multispectral/panchromatic remote sensing images. Spectroscopy and Spectral Analysis, 34 (5): 1332–1337. ( 孟祥超, 沈焕锋, 张洪艳, 张良培, 李慧芳. 2014. 基于梯度一致性约束的多光谱/全色影像最大后验融合方法. 光谱学与光谱分析, 34 (5): 1332–1337. )

-

Meng X C, Shen H F, Zhang L P, Yuan Q Q and Li H F.2015b.A unified framework for spatio-temporal-spectral fusion of remote sensing images//2015 IEEE International Geoscience and Remote Sensing Symposium (IGARSS).Milan, Italy:IEEE:2584-2587 [DOI:10.1109/IGARSS.2015.7326340].

-

Merino M T, Nunez J.2007.Super-resolution of remotely sensed images with variable-pixel linear reconstruction. IEEE Transactions on Geoscience and Remote Sensing, 45 (5): 1446–1457. DOI: 10.1109/TGRS.2007.893271.

-

Minghelli-Roman A, Mangolini M, Petit M, Polidori L.2001.Spatial resolution improvement of meris images by fusion with TM images:analysis of hyperspectral image data. IEEE Transactions on Geoscience and Remote Sensing, 39 (7): 1533–1536. DOI: 10.1109/36.934083.

-

Moser G, Tuia D, Shimoni M.2014.2014 IEEE GRSS data fusion contest:multiresolution fusion of thermal hyperspectral and VIS data. IEEE Geoscience and Remote Sensing Magazine, 2 (1): 21–22. DOI: 10.1109/MGRS.2014.2303201.

-

Murthy K, Shearn M, Smiley B D, Chau A H, Levine J and Robinson D.2014.Skysat-1:very high-resolution imagery from a small satellite//Proceedings of SPIE 9241, Sensors, Systems, and Next-Generation Satellites XVⅢ.Amsterdam, Netherlands:SPIE[DOI:10.1117/12.2074163].

-

Ng M K P, Shen H F, Chaudhuri S, Yau A C.2007.Zoom-based super-resolution reconstruction approach using prior total variation. Optical Engineering, 46 (12): 127003 DOI: 10.1117/1.2818797.

-

Otazu X, González-Audícana M, Fors O, Núñez J.2005.Introduction of sensor spectral response into image fusion methods. Application to wavelet-based methods.IEEE Transactions on Geoscience and Remote Sensing, 43 (10): 2376–2385. DOI: 10.1109/TGRS.2005.856106.

-

Pacifici F, Chanussot J and Du Q.2011.2011 GRSS data fusion contest:exploiting WorldView-2 multi-angular acquisitions//2011 IEEE International Geoscience and Remote Sensing Symposium (IGARSS).Vancouver, BC:IEEE:1163-1166[DOI:10.1109/IGARSS.2011.6049404].

-

Park S C, Park M K, Kang M G.2003.Super-resolution image reconstruction:a technical overview. IEEE Signal Processing Magazine, 20 (3): 21–36. DOI: 10.1109/MSP.2003.1203207.

-

Pohl C, Van Genderen J L.1998.Review article multisensor image fusion in remote sensing:concepts, methods and applications. International Journal of Remote Sensing, 19 (5): 823–854. DOI: 10.1080/014311698215748.

-

Schowengerdt R A.1980.Reconstruction of multispatial, multispectral image data using spatial frequency content. Photogrammetric Engineering and Remote Sensing, 46 : 1325–1334.

-

(Shen H F.2007.Super Resolution Image Reconstruction Under Scene-change Conditions.Wuhan:Wuhan University)

-

Shen H.2012.Integrated fusion method for multiple temporal-spatial-spectral images//The XXⅡ Congress of International Society for Photogrammetry and Remote Sensing (ISPRS). Melbourne, Australia : 407–410.

-

Shen H F, Ng M K, Li P X, Zhang L P.2009.Super-resolution reconstruction algorithm to modis remote sensing images. Computer Journal, 52 (1): 90–100. DOI: 10.1093/comjnl/bxm028.

-

Shen H F, Wu P H, Liu Y L, Ai T H, Wang Y, Liu X P.2013.A spatial and temporal reflectance fusion model considering sensor observation differences. International Journal of Remote Sensing, 34 (12): 4367–4383. DOI: 10.1080/01431161.2013.777488.

-

Song H H, Huang B.2013.Spatiotemporal satellite image fusion through one-pair image learning. IEEE Transactions on Geoscience and Remote Sensing, 51 (4): 1883–1896. DOI: 10.1109/TGRS.2012.2213095.

-

Song H, Huang B, Liu Q, Zhang K.2015.Improving the spatial resolution of Landsat TM/ETM+through fusion with SPOT5 images via learning-based super-resolution. IEEE Transactions on Geoscience and Remote Sensing, 53 (3): 1195–1204. DOI: 10.1109/TGRS.2014.2335818.

-

Sun X J, Zhang L F, Yang H, Wu T X, Cen Y, Guo Y.2015.Enhancement of spectral resolution for remotely sensed multispectral image. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 8 (5): 2198–2211. DOI: 10.1109/JSTARS.2014.2356512.

-

Thomas C, Ranchin T, Wald L, Chanussot J.2008.Synthesis of multispectral images to high spatial resolution:a critical review of fusion methods based on remote sensing physics. IEEE Transactions on Geoscience and Remote Sensing, 46 (5): 1301–1312. DOI: 10.1109/TGRS.2007.912448.

-

Tsai R Y, Huang T S.1984.Multiframe image restoration and registration. Advances in Computer Vision and Image Processing, 1 : 317–339.

-

Tu T M, Su S C, Shyu H C, Huang P S.2001.A new look at ihs-like image fusion methods. Information Fusion, 2 (3): 177–186. DOI: 10.1016/S1566-2535(01)00036-7.

-

Wald L.1999.Some terms of reference in data fusion. IEEE Transactions on Geoscience and Remote Sensing, 37 (3): 1190–1193. DOI: 10.1109/36.763269.

-

Wang Z J, Ziou D, Armenakis C, Li D, Li Q Q.2005.A comparative analysis of image fusion methods. IEEE Transactions on Geoscience and Remote Sensing, 43 (6): 1391–1402. DOI: 10.1109/TGRS.2005.846874.

-

Wei Q, Bioucas-Dias J, Dobigeon N, Tourneret J-Y.2015.Hyperspectral and multispectral image fusion based on a sparse representation. IEEE Transactions on Geoscience and Remote Sensing, 53 (7): 3658–3668. DOI: 10.1109/TGRS.2014.2381272.

-

Winter M E and Winter E M.2002.Physics-based resolution enhancement of hyperspectral data//Proceedings of SPIE 4725, Algorithms and Technologies for Multispectral, Hyperspectral, and Ultraspectral Imagery VⅢ.Orlando, FL:SPIE:580-587 [DOI:10.1117/12.478792].

-

Wu P H, Shen H F, Ai T H, Liu Y L.2013.Land-surface temperature retrieval at high spatial and temporal resolutions based on multi-sensor fusion. International Journal of Digital Earth, 6 : DOI: 10.1080/17538947.2013.783131.

-

Wu P H, Shen H F, Zhang L P, Göttsche F-M.2015.Integrated fusion of multi-scale polar-orbiting and geostationary satellite observations for the mapping of high spatial and temporal resolution land surface temperature. Remote Sensing of Environment, 156 : 169–181. DOI: 10.1016/j.rse.2014.09.013.

-

Yokoya N, Yairi T, Iwasaki A.2012.Coupled nonnegative matrix factorization unmixing for hyperspectral and multispectral data fusion. IEEE Transactions on Geoscience and Remote Sensing, 50 (2): 528–537. DOI: 10.1109/TGRS.2011.2161320.

-

Yue L W, Shen H F, Li J, Yuan Q Q, Zhang H Y, Zhang L P.2016.Image super-resolution:the techniques, applications, and future. Signal Processing, 128 : 389–408. DOI: 10.1016/j.sigpro.2016.05.002.

-

Zhang H Y, Yang Z Y, Zhang L P, Shen H F.2014.Super-resolution reconstruction for multi-angle remote sensing images considering resolution differences. Remote Sensing, 6 (1): 637–657. DOI: 10.3390/rs6010637.

-

Zhang L P, Shen H F, Gong W, Zhang H Y.2012.Adjustable model-based fusion method for multispectral and panchromatic images. IEEE Transactions on Systems, Man, and Cybernetics, Part B:Cybernetics, 42 (6): 1693–1704. DOI: 10.1109/TSMCB.2012.2198810.

-

Zhang L P, Shen H F, Zhang H Y, Yuan Q Q. Image Super-resolution Reconstruction. Beijing: Science Press 2012 . ( 张良培, 沈焕锋, 张洪艳, 袁强强. 2012. 图像超分辨率重建. 图像超分辨率重建. 北京: 科学出版社 . )

-

Zhang Y S, Dai C G, Zhang Y B, Dong G J, Liu J, Huang X B. Space-based Multi-source Remote Sensing Information Fusion:Theory, Algorithm and Application System. Beijing: Science Press 2005 . ( 张永生, 戴晨光, 张云彬, 董广军, 刘军, 黄小波. 2005. 天基多源遥感信息融合:理论、算法与应用系统. 北京: 科学出版社 . )

-

Zhao S H. The Technology and Application of Multi-source Remote Sensing Image Fusion. Nanjing: Nanjing University Press 2008 . ( 赵书河. 2008. 多源遥感影像融合技术与应用. 南京: 南京大学出版社 . )

-

Zhu X L, Chen J, Gao F, Chen X H, Masek J G.2010.An enhanced spatial and temporal adaptive reflectance fusion model for complex heterogeneous regions. Remote Sensing of Environment, 114 (11): 2610–2623. DOI: 10.1016/j.rse.2010.05.032.

-

Zhukov B, Oertel D, Lanzl F, Reinhackel G.1999.Unmixing-based multisensor multiresolution image fusion. IEEE Transactions on Geoscience and Remote Sensing, 37 (3): 1212–1226. DOI: 10.1109/36.763276.

-

Zurita-Milla R, Clevers J G P W, Schaepman M E.2008.Unmixing-based landsat TM, MERIS FR data fusion. IEEE Geoscience and Remote Sensing Letters, 5 (3): 453–457. DOI: 10.1109/LGRS.2008.919685.