|

收稿日期: 2016-06-13; 修改日期: 2016-06-22;

优先数字出版日期: 2016-09-25

基金项目: 中国科学院“十三五”突破项目(编号:Y3ZZ07101A)

第一作者简介:

刘建波(1962-), 男, 研究员, 中国科学院遥感与数字地球研究所副所长, 研究方向为遥感图像处理及发布。E-mail:liujb@radi.ac.cn

通讯作者简介: 马勇(1987-), 男, 助理研究员, 研究方向为遥感图像处理与信息提取。E-mail:mayong@radi.ac.cn

中图分类号: TP75

文献标识码: A

文章编号: 1007-4619(2016)05-1038-12

|

摘要

针对遥感图像的“时空矛盾”,评述了当前解决这一问题最主要的方法即遥感时空信息融合的方法,包括基于变化模型的融合、基于重建模型的融合以及基于学习模型的融合。通过分析各个模型的研究现状,指出了每种模型方法的优劣,特别重点介绍了影响较大的自适应时空融合方法的理论以及对其的改进算法。同时本文总结了当前时空融合模型在长时间序列模拟以及大区域数据集生成等方面的实际应用的效果,以及分析了影响时空融合结果的主要因素。最后基于这些问题和影响因素提出了今后时空融合模型发展的目标和方向。

关键词

多源数据 , 遥感 , 时空矛盾 , 高时空融合 , 模型

Abstract

Remote sensing images can provide important and abundant information about the Earth at a global or local scale. Thus, many applications often require remote sensing data with high acquisition frequency and high spatial resolution. However, meeting this requirement is a considerable challenge given satellite limitations. The spatiotemporal fusion method provides a feasible way to solve these "spatialtemporal" contradictions. In the last 10 years, spatiotemporal fusion has elicited wide interest in various applications because it integrates the superiority of multisource satellite data in fine spatial resolution or frequent temporal coverage and it can generate fused images with high spatial and temporal resolution. In this study, we reviewed the advantages and limitations of three types of method for spatiotemporal fusion, namely, transformation-based, reconstruction-based, and learning-based methods. First, the transformation-based method consistently filters and processes transformed data and then accesses high-spatiotemporal resolution data via inverse transform. It mainly focuses on the spatial and spectral information of multi-source satellite image enhancement or fusion. The spatial resolution of the results obtained with this method remains low, and the accuracy is relatively poor because the temporal change information is not used in this method. Second, the reconstruction-based method has elicited much attention since the proposal of a semi-physical fusion model and STARFM. This method integrates the information of temporal change, spatial change, and spectral change among multi-source satellite images acquired in different times and generates high-spatiotemporal resolution data by calculating the weight of different changes. This method provides an excellent fusion approach for spatiotemporal fusion because the results show high accuracy. However, the results would be poor when the type of land cover changes or the cover area is heterogeneous. Third, the learning-based method is based on the development of compressed sensing and sparse representation technology. This method represents a recent development that relies on learning the relationship and difference of multi-source satellite images by training samples and constructing an image dictionary. Although the learning-based method could obtain good results, the processing efficiency is lower than that of other methods, and it requires the training of sample selection. Recently, the result of spatiotemporal fusion has been used in various applications, especially in the reconstruction-based method. This method is mainly used in time series data analysis as well as in retrieval and regional data set generation. For time series data analysis and retrieval, many researchers have used the results in developing the missing images of time series, detecting phenology, inversing urban environment parameters, estimating gross primary production, evaluating biomass, calculating land surface temperature, and so on. Given that the covered area of a low spatial resolution is large and the spectrum continuity of spatiotemporal fusion results is high, these results could be applied to the generation of regional data sets. Although the spatiotemporal fusion method has seen considerable development, certain problems remain. The uncertainties are attributed to the complexity of land cover change, the errors of sensor calibration, and the data pretreatment process. The five potential aspects of the spatiotemporal fusion method that require further study are the consistency of data from different sensors, introduction of nonlinear mixed models, addition of prior knowledge, introduction of deep learning theory, and expansion into other satellites.

Key words

multi-source data , remote sensing , spatial-temporal contradictions , high spatiotemporal fusion , model

1 引言

随着遥感技术的进步与发展以及各国对地观测计划战略的实施推进,一个多层次、多角度、全方位的初级全球遥感对地观测网络正在形成高、中、低轨道的相互结合,大、中、小卫星的彼此协同,可以获得粗、细、精分辨率互补的遥感数据。通过全球对地观测遥感网络,人类得以借助遥感技术对大气圈、水圈、岩石圈、生物圈、土壤圈、冰冻圈和人类圈7大圈层进行综合观测,以全球性的整体观、系统观和多时空尺度来研究地球整体与局部行为,遥感领域进入了一个更大范围、更高精度、更深层次的应用阶段。遥感应用的深入和细化也对遥感数据提出了更高的需求,主要表现为:

(1) 高精度的遥感数据。高精度不仅仅指遥感数据高的空间分辨率,还指遥感数据具有更高的质量,如更加精准的几何位置,水平更高的辐射标定以及要尽量减少噪声等其他的干扰。高精度的遥感数据对城市覆盖的精细监测(Kolanuvada等,2016;Yadav等,2015)、对森林及生态环境的有效评估(Pisek等,2015;Li等,2011),对土地覆盖利用以及变化的精准监控等(Cao等,2016;Li等,2015;Sun等,2012)都有重要的意义。以监测城市中渣土堆放点信息为例,如果能够获得空间分辨率优于2 m的高精度数据,就可以准确监控渣土堆的轮廓、大小和高度等信息,便于更好地预估其风险,避免灾害的发生。

(2) 快重访的遥感数据。快重访主要是遥感卫星对同一地区的重复采集数据要具有较高的频率。目前遥感在减灾救灾中的应用对数据的时间分辨率要求较高,如火灾火情的获取、地震灾区的评估、水域面源污染的监测等(Shi和Hao,2013;Ma等,2016;Alaguraja等,2010)。以监测秸秆燃烧的火点为例,如果能够获取每天至少一次的区域遥感数据,就能有效地监测秸秆燃烧的情况,以便更好地控制其状况,防止火灾或者污染等的进一步扩散。

但是由于遥感卫星自身物理性能的限制,获取的单一遥感数据中其空间分辨率和时间分辨率是一对矛盾体,往往不可兼得。表 1统计了目前比较常见的光学卫星传感器其空间分辨率和时间分辨率的属性。从表 1中可以看出,随着遥感卫星数据空间分辨率的提高,其时间分辨率在不断地降低。以GF-2号卫星为例,在不侧摆的情况,要想获得重复地区的同样卫星数据基本需要两个月的时间,再加上卫星过境期间受到当地云层或大气等影响,进一步加大了重复获取同一地区有效数据的时间。

表 1 主要光学卫星传感器空间分辨率和时间分辨率的对比

Table 1 Spatial and temporal resolution comparison of representative optical sensors

| 卫星/传感器 | 波段类型 | 空间分辨率/m | 时间分辨率/d | 获取方式 |

| AVHRR | 多光谱 | 1100 | 0.5 | 免费 |

| MODIS | 多光谱 | 500 | 0.5(双星) | 免费 |

| HJ-A/B | 多光谱 | 30 | 4(双星) | 免费 |

| Landsat | 多光谱/全色 | 30/15 | 16 | 免费 |

| CBERS-04 | 多光谱 | 20 | 26 | 免费 |

| Sentinel-2 | 多光谱/全色 | 20/10 | 10 | 免费 |

| GF-1 | 多光谱/全色 | 8/2 | 41(不侧摆) | 免费/商业 |

| SPOT6/7 | 多光谱/全色 | 6/1.5 | 26 | 商业 |

| ZY-03 | 多光谱 | 6 | 59(不侧摆) | 商业 |

| IKONOS | 多光谱/全色 | 4/1 | >30(不侧摆) | 商业 |

| GF-2 | 多光谱/全色 | 4/1 | 69(不侧摆) | 免费/商业 |

| Worldview-3 | 多光谱/全色 | 1.2/0.3 | >30(不侧摆) | 商业 |

| Geoeye-1 | 多光谱/全色 | 1.65/0.41 | >30(不侧摆) | 商业 |

为了缓解遥感数据的“时空矛盾”,国内外学者做了大量的研究,其中遥感时空信息融合技术受到很大的关注。遥感时空信息融合技术即通过对高空间分辨率、低时间分辨率的遥感传感器影像与高时间分辨率、低空间分辨率的传感器影像进行有效处理,综合高空间分辨率卫星数据的空间优势以及低空间分辨率卫星数据的时间优势,进而生成时间相对连续的高时空分辨率影像。该技术方法可以在不改变现有观测系统的条件下一定程度上提高遥感影像的空间分辨率和时间分辨率,已经在诸多领域进行了有效的应用。本文回顾了遥感影像时空融合方法的发展以及应用,并对其影响因素做了总结和分析,为今后相关研究提供参考价值。

2 遥感时空融合的方法

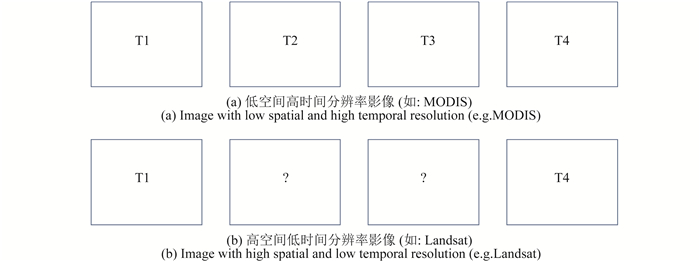

遥感时空融合技术是基于应用领域对遥感数据时间维以及空间维的巨大需求而产生的,是基于多源数据对其空间信息和时间信息的综合融合分析技术。其概念图如1所示,即利用已知时刻的低空间分辨率高时间分辨率数据(如MODIS卫星的T1—T4时刻的数据),和与低空间分辨率数据时刻相对应的高空间分辨率低时间分辨率数据(如Landsat卫星的T1和T4时刻的数据),进行空间和时间信息的分析,利用一定的方法和模型将这些信息进行融合,进而得到未知的高空间分辨率数据(如:Landsat卫星的T2和T3时刻的数据)。

目前国内外基于已有的数据资源,针对多源遥感时空融合技术做了大量的研究。基于时空融合技术中应用模型的不同,可以将目前所用的方法大体分为3类,即基于变换模型的融合、基于重建模型的融合、基于学习模型的融合。

2.1 基于变换模型的融合

基于变换模型的融合主要是以数据变换模型为基础,对变换后的数据进行信息的筛选和加工,最后再经过反变换,获得未知时刻的高分辨率数据。其中用的最多的是小波变换模型。(Malenovsk & #253;等人2007)等人在借鉴小波融合进行光谱—空间融合的基础上,对MODIS和Landsat进行时空的融合。首先对MODIS影像(250 m,500 m)和Landsat TM(30 m)影像所对应波段分别采样到480 m和240 m,然后利用小波变换进行融合,利用MODIS影像的低频信息和Landsat影像的高频信息进行融合,结果继承了MODIS影像的大部分特征和Landsat影像的细节信息,证明了将高时间分辨率的MODIS和TM影像进行融合是可行的,通过影像融合也大大提高MODIS时间序列影像的空间分辨率,其结果可以用做分类和定性分析。尽管该方法在一定程度上提高了MODIS影像的空间分辨率,但是总体其结果的空间分辨率还是比较低(其结果的分辨率为240 m),并且由于融合时用到的是前一时相的Landsat数据的纹理信息,其结果与真实的结果相比会具有较大的差异性,特别是在有地物变化的区域。

2.2 基于重建模型的融合

国内外大部分重建模型融合的研究都是基于像元分解的方法进行的,其主要的思想是,对多幅低空间高时间分辨率(如MODIS数据)的像元进行分解并计算其不同时相间的变化关系,然后与已知的高空间低时间分辨率的数据进行对应,同时求出高、低分辨率影像间的变化关系,进而插值计算求出未知的另一时刻高空间分辨率数据。这类方法都基于低空间分辨率遥感数据的像元反射率可以看做高空间分辨率遥感数据像元反射率的线性组合这一假设。Zhukov等人(1999)为了使同类地物的像元在空间上的变化具有连续性,引入了窗口技术,即假设中心目标像元只和周边像元具有相关性,从而避免了整景影像中同地物类别值相同的假设;Maselli(2001)进一步考虑了像元反射率的空间可变性,利用欧几里德距离计算相关性,其理论依据是周边像元距离目标像元越远,对目标像元产生的影响越小;Busetto等人(2008)在前两者研究的基础上,考虑了周边像元与目标像元间的光谱差异,减少了空间距离近但光谱相差较大的像元,使得预测结果在同类地物的空间变化上具有良好的连续性,但是该方法对于单个低分辨率像元中同时存在春季、冬季两种季节作物时,其融合的NDVI值有一定的偏差;Zurita-Milla等人(2009)利用混合像元分解的方式,基于已知的低分辨数据(MODIS)和高分辨数据(Landsat)的分类图和目标像元邻域信息,来重建出具有高时空分辨率的数据。但是该方法的精度不高。

Roy等人(2008)于2008年提出一种基于半物理模型的时空数据融合模型,该方法是利用Landsat ETM+数据以及MODIS BRDF/Albedo地表特性产品(MCA43 A1和A2)来合成高分辨率数据的算法。其理论依据为,基于几何光学模型,MODIS的地表反射率可以写为

| $ \begin{split}\\[-13pt] \rho ({\lambda _{\rm MODIS}}{, } & {\boldsymbol \varOmega} {, }{{\boldsymbol \varOmega} ^\prime })= {f_{\rm iso}}({\lambda _{\rm MODIS}}) + {f_{\rm vol}}({\lambda _{\rm MODIS}})\times\\ & {K_{\rm vol}}({\boldsymbol \varOmega}{\rm{, }}{\boldsymbol \varOmega}^\prime) + {f_{\rm geo}}({\lambda _{\rm MODIS}}){K_{\rm geo}}({\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime }) \end{split} $ | (1) |

式中,

| $ \rho ({\lambda _{\rm MODIS}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime }) \approx kA({\lambda _{\rm MODIS}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime }) $ | (2) |

式中,

| $ \frac{{{\rho _{_{\rm T1}}}({\lambda _{\rm MODIS}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime })}}{{{\rho _{_{\rm T2}}}({\lambda _{\rm MODIS}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime })}} \approx \frac{{{k_{_{\rm T1}}}A({\lambda _{\rm MODIS}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime })}}{{{k_{_{\rm T2}}}A({\lambda _{\rm MODIS}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime })}} = c $ | (3) |

式中,

| $ \begin{split}\\[-13pt] {\rho _{_{{\rm T}2}}}({\lambda _{\rm Landsat}}, & {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime }) = \frac{{{\rho _{_{{\rm T}1}}}({\lambda _{\rm MODIS}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime })}}{{{\rho _{_{{\rm T}2}}}({\lambda _{\rm MODIS}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime })}} \times \\ & {\rho _{_{{\rm T}1}}}({\lambda _{\rm Landsat}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime }) =\\ & c \times {\rho _{_{{\rm T}1}}}({\lambda _{\rm Landsat}}, {\boldsymbol \varOmega}, {{\boldsymbol \varOmega} ^\prime }) \end{split} $ | (4) |

利用式(4)就可以得出未知时刻(即T2时刻)的影像反射率。该方法的优势在于能够捕捉到更为准确的季相变化信息,对植被覆盖区域的融合效果较好,但是由于该方法基于几何光学模型,在前期预处理的过程中效率较低,同时由于该方法没有考虑到待处理像元的邻域光谱信息,因此其融合结果中出现了不同程度的斑块效应,整体预测结果的一致性也较差。

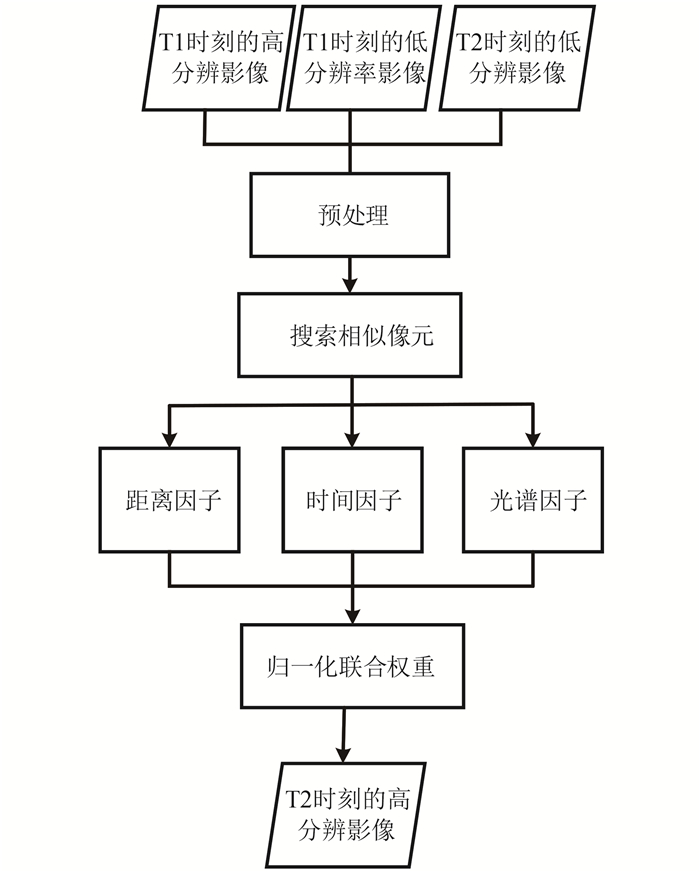

基于重建模型的融合方法中影响最大且运用最多的是Gao等人提出的时空自适应融合模型STARFM(Spatial and Temporal Adaptive Reflectance Fusion Model),该算法利用空间分辨率较高的Landsat ETM+多光谱数据和时序信息丰富的MODIS数据进行融合,不仅考虑了与目标像元的距离和光谱相似性,还考虑了时间上的差异,同时利用临近光谱相似像元值计算中心像元值,来产生高动态时相且具有Landsat ETM+数据高空间分辨率特性的合成多光谱图像(Gao等,2006)。由于Landsat重访周期(16 d)造成的观测缺失影像,而MODIS传感器是每天进行2次全球覆盖观测,所以利用STARFM可以获得具有MODIS时间分辨率的Landsat合成影像。其理论依据是在忽略几何误差和大气误差的情况,假设低空间分辨率的像元反射率可以用高空间分辨率对应的像元反射率的线性和,即

| $ L\left({i, t} \right) = \sum {\left({\mathop f\nolimits_t^i \times H(i, t)} \right)} $ | (5) |

式中,L(i,t)为低分辨率图像在t时刻的像素值,H(i,t)为高分辨率图像在t时刻的像素值,fti为高分辨率图像的这类像素在低分辨率图像范围内所占的百分比,通常可以看为是丰度矩阵。如果将低空间分辨率影像重采样到高空间分辨率影像的分辨率,使得低空间分辨率影像和高空间分辨率影像具有相同的空间分辨率和坐标系统,那么对于低分辨率的同质像元(即MODIS纯像元),其反射率可以用高空间分辨率数据(即Landsat数据)的反射率来表达,即

| $ L\left({{x_i}, {y_j}, {t_k}} \right){\rm{ }} = {\rm{ }}H\left({{x_i}, {y_j}, {t_k}} \right)+ {\varepsilon _k} $ | (6) |

式中,L(xi,yj,tk)和H(xi,yj,tk)分别是在(xi,yj)点处低空间分辨率和高空间分辨率在tk时刻的反射率值,εk是两者的反射率差异(由传感器差异、几何畸变以及大气等引起)。假设地表覆盖类型和系统误差εk不随时间发生变化,即从时间t0到tk,ε0=εk,那么tk时刻的Landsat反射率为

| $ \begin{split}\\[-13pt] H\left({{x_i}, {y_j}, {t_k}} \right)= & H\left({{x_i}, {y_j}, {t_0}} \right)+\\ & {\rm{ }}L\left({{x_i}, {y_j}, {t_k}} \right)- L\left({{x_i}, {y_j}, {t_0}} \right) \end{split} $ | (7) |

但是实际情况却是由于MODIS数据的扫描视场很大,其像元的混合现象相当严重,很少有同质像元的存在,同时同一区域的地表覆盖类型在两个不同时刻可能会发生改变,且地表覆盖状态随时可能由光照几何或者大气改变而发生变化,因此STARFM模型引入了邻近像元信息,来构建了一个带权重的低空间分辨率像元反射率与高空间分辨率像元反射率的关系模型,即

| $ \begin{split}\\[-13pt] H\left({{x_i}, {y_j}, {t_k}} \right) = & \sum\limits_{i = 1}^w {\sum\limits_{j = 1}^w {\sum\limits_{k = 1}^n {\left({{{\boldsymbol W}_{ijk}}} \right.} } } \left({H\left({{x_i}, {y_j}, {t_0}} \right) + } \right.\\ & \left. {\left. {L\left({{x_i}, {y_j}, {t_k}} \right) - L\left({{x_i}, {y_j}, {t_0}} \right)} \right)} \right) \end{split} $ | (8) |

式中,w是搜索窗口的大小;(x,y)是窗口中心像元的位置;Wijk是联合权重矩阵。

在STARFM融合模型中,最重要的是相似像元的探索。一般来说,判断光谱相似有两种方式:非监督分类和阈值法。非监督分类主要是对高分辨率影像进行非监督分类,和中心像元类型相同的像元即被认为是相似像元。阈值法主要是以窗口内其他像元与中心像元之间反射率差值的大小来判断是否属于同类地物。如果窗口内某像元的所有波段都满足式(9)的条件,则该像元就被认为是与待处理中心像元是光谱相似的。其判断的条件为

| $ \left| {{f_{(i,j)}} - {f_{(\omega /2,\omega /2)}}} \right| < {L_{{\rm stdev}}} \times 2/m $ | (9) |

式中,f(i,j)为窗口内某一波段的相似性检测的候选像元;f(w/2,w/2)为窗口的中心像元(即算法需处理的像元);Lstdev为已知的高分辨影像输入图像的标准方差;m是预先估计的地物类别总数。但是在利用上述规则选择了相似像元后,还需要利用一些规则去除一些相对劣质的像元,以提高所选的相似像元的精度。主要筛选规则为

| $ {S_{ijk}} < |H({x_{\omega /2,}},{y_{\omega /2,}},{t_0})- L({x_{\omega /2,}},{y_{\omega /2,}},{t_0})| \pm {\delta _{HL}} $ | (10) |

| $ {T_{ijk}} < |L({x_{\omega /2,}},{y_{\omega /2,}},{t_k})- L({x_{\omega /2,}},{y_{\omega /2,}},{t_0})| \pm {\delta _{LL}} $ | (11) |

式中,低分辨和高分辨率地表反射率数据的标准差为δL和δH,则MODIS和Landsat地表反射率数据之间的标准差为

| $ {S_{ijk}} = \left| {H\left({{x_i},{y_j},{t_1}} \right)- L\left({{x_i},{y_j},{t_1}} \right)} \right| $ | (12) |

| $ {T_{ijk}} = \left| {L\left({{x_i},{y_j},{t_2}} \right)- { L}\left({{x_i},{y_j},{t_1}} \right)} \right| $ | (13) |

| $ {D_{ijk}} = \sqrt {{{(x - {x_i})}^2} + {{(y - {y_i})}^2}} $ | (14) |

提取出中心像元的相似像元集后,对每一个相似像元求其权重,最后对其权重进行归一化处理,即

| $ {C_{ijk}} = {S_{ijk}} \times {T_{ijk}} \times {D_{ijk}} $ | (15) |

| $ {W_{ijk}} =(1/{C_{ijk}})/\sum\limits_{i = 1}^w {\sum\limits_{j = 1}^w {\sum\limits_{k = 1}^n {(1/{C_{ijk}})} } } $ | (16) |

式中,

尽管STARFM融合模型能够获得较好的融合效果,但是在最终结果中该算法还会出现一些斑块效应以及对异质地物变化不敏感,针对这些问题,大量学者提出了一些解决方法,以提高STARFM的融合精度。在STARFM算法的基础上,可以借助于多幅Landsat和MODIS辅助时间序列数据,分别得到地表变化的区域,然后在一系列MODIS图像中,利用缨帽变换(tasseled cap transform)计算每个时刻的扰动指数DI(Disturbance Index),并根据已得到的变化掩膜确定扰动发生的时刻,生成DOD(Date of Disturb)图像。最后根据扰动发生的时刻选择最优的Landsat影像来参与融合过程,进而得到较优的地表反射率数据产品(Hilker等,2009)。结果表明该算法不仅提高了STARFM算法的预测精度,并且可以很好地处理由扰动造成的空间变化。

Zhu等人(2010)在2010年提出增强型时空自适应反射率融合模型ESTARFM(Enhanced Spatial and Temporal Adaptive Reflectance Fusion Model),该算法在STARFM的基础之上,假设Landsat数据在不同时相上的差异值与时间变化呈线性关系,利用研究区的两幅不同时相的Landsat数据以及3个时相MODIS数据来求取各个权重和增量系数,最后加入时间关系系数以得到待预测的图像。ESTARFM由于增加了额外的中分辨率Landsat数据,因而其精度也得到了一定程度的提高。但由于该融合模型需要同时借助于覆盖相同研究区的两幅清晰的高分辨率影像(Landsat ETM+),因此其应用条件较高,不易进行大区域的实际应用。

Michishita等人(2015)在基于ESTARFM的基础上,提出了定制混合模型,即在有多对数据的情况,综合利用预测日期前后MODIS和Landsat数据进行插值,形成4组MODIS数据进行数据融合,获得比ESTARFM更好的结果。Huang和Song(2012)基于STARFM思想,结合稀疏表达的方法,在利用超分辨率方法增强MODIS的空间分辨率的基础上,通过已知Landsat的信息的高通调制进行最后的融合分析,生成所需时间的Landsat影像。谢登峰等人(2016)利用像元分解降尺度方法对参与融合的MODIS数据进行降尺度分解处理,然后利用降尺度分解后的MODIS数据替代STARFM模型中直接重采样的MODIS数据进行数据融合,较好地消除了像元分解降尺度影像中的“图斑”以及STARFM模型融合影像中的“MODIS像元边界”现象,更真实地反应了地标情况。但是,该算法精度在一定程度上依赖MODIS降尺度数据的精度,当地表聚类数量较多,普通的混合像元分解模型较难取得很好的分解结果,会影响该算法的效果。王昆等人(2013)利用半方差函数对STARFM进行改进,通过半方差函数分析Landsat影像的空间特性,以确定其空间相关距离,利用距离的2倍来改变STARFM模型的滑动窗口,提高了预测图像的精度。付东杰在STARFM模型的基础上增加了土地覆盖类型数据,这在一定程度上提高了相似像元的选取,因而提高了模型的精度。但是土地覆盖类型数据不易获取,这在一定程度上限制了该方法的应用(Fu等,2013)。邬明权等人(2012b)提出了一种改进的时空融合方法STDFA(Spatial and Temporal Data Fusion Approach),该方法利用类别反射率的时间变化特征与类内像元反射率的时间变化特征进行时空融合,并将该方法应用到了水稻种植面积提取,取得了较好的精度。以上方法很好地改进STARFM的不足,但是由于STARFM利用的是线性模型,其根本是基于光谱信息和空间信息进行插值,所以融合结果的精度与真实结果还有一定的差距。

2.3 基于学习模型的融合

该模型的融合主要运用了压缩感知和稀疏表达的方法进行图像的处理。机器学习技术的深入发展促进了图像的超分辨率算法的进步。Yang等人(2010)首先对高低分辨率图像进行联合训练,产生各自对应的字典,然后利用相对应的字典寻找高低分辨率之间的相似性,最后利用这种相似性增强低分辨率图像的分辨率。Zeyde等人(2010)利用Yang算法的思想,首先利用K-SVD算法仅对低分辨影像进行字典的训练学习,然后结合高分辨样本与其对应的低分率字典算出高分辨率字典,进而有效地增强图像的分辨率。由于该方法采用了K-SVD算法仅对一幅低分辨率图像进行处理,因此大大降低了算法的复杂度,提高了算法的运行效率。总体来说基于学习模型的算法较之其他模型算法,复杂度较高,且高低分辨率之间相差的分辨率不宜过大,一般在4倍左右。Song和Huang(2013)在Zeyde的方法上进一步提出了基于图像对学习的时空融合模型。首先基于先验数据集,通过稀疏表达方法提高原始MODIS数据的空间分辨率,即超分辨率重建;其次将Landsat数据和重建后的MODIS数据进行高通滤波后再进行融合。这种方法采用了双层时空融合模型,充分考虑了不同分辨率数据(MODIS和Landsat)间的时间差异,包括物候变化(如植被的季节性变化)和土地覆盖类别的变化(如耕地和居民地的变化),能较好地捕捉到不同类型图像上的地表反射率变化。同时由于该方法在融合之前对分辨率提高后的MODIS数据和Landsat数据间进行了高通滤波调制,进一步保留了原始图像对间的差异信息,取得了较好的融合结果。但是此方法在对MODIS数据进行稀疏表达时,需要选取多组训练数据进行字典的学习,因此其运行效率较慢,目前尚不适宜大区域的数据进行融合,需要对方法进行进一步的并行化改造,以便今后更好地对大区域的海量数据进行处理。

3 引言

时空融合的目的是生成空缺时刻的高分辨率数据,以弥补数据的不足,形成较为连续的可用于定量反演的有效数据。目前国内外基于时空融合的结果,已经应用于很多领域,取得了较好的结果,主要用于长时间序列数据的补充、定量反演分析以及大区域数据集的生成等方面。

3.1 长时间序列的分析

Walker等人(2014)使用时空融合模型STARFM,结合2005年4月到2009年11月的Landsat和MODIS数据,生成了30 m分辨率的类Landsat长时间序列旱地植被物候变化数据集,并从数据集中提取增强植被指数(EVI)和归一化植被指数(NDVI)来检验不同时间分布中旱地植被绿度峰值间的差异性。结果表明Landsat和MODIS融合后的高时空分辨率数据集能够提供很好地反映植被物候的变化与植被生长期的降雨量,为物候变化研究提供更多的信息。Liu等人(2012)利用时空融合模型,通过MODIS和部分ASTER数据,生成了2007年7月到9月的连续数据,并基于这些连续的数据反演出的城市环境变量,如NDVI、归一化水指数(NDWI)和土地表面温度(LST)等参数。利用这些参数分析与西尼罗病毒的传播的关系。结果表明城市环境与西尼罗病毒的传播呈负相关,与LST呈正相关。Singh等人(2011)基于Landsat ETM+影像和MODIS发射率产品MOD09Q1,利用时空融合模型融合得到印度德里密拉特地区2002年—2009年这8年间的30 m地表反射率数据集,通过该数据集提取的NDVI长时间序列变化曲线能很好地反映植物生长时物候的变化趋势,如植物返青期和叶片衰老期的季节性变化,也探讨了NDVI长时间序列数据的潜在用途,如NDVI曲线与地表降水和蒸发量变化间的关系等。Bhandari等人(2012)利用时空融合模型,结合2003年到2008年澳大利亚昆士兰州Barakula森林地区Landsat TM影像MODIS NBAR数据产品,生成长时间序列Landsat数据集LITS(Landsat Image Time Series)。Barakula森林位于澳大利亚东北部,该地区原始的Landsat TM影像由于受到云的干扰,很难用来进行植被的长时间序列观测。如该地区2003年—2008年5年间共77景Landsat影像中只有38景是无云影像,仅占全部影像中的一半。而通过时空融合模型结合相邻时相的MODIS数据,可以得到完整的77景无云Landsat TM影像,最终生成从2003年7月3日到2008年7月16日的16d间隔LITS数据集。该数据集可用来模拟长时间序列下植被物候的变化情况,用来监测植被结构和生理的季节性变化和趋势,而且可以生成澳大利亚生态系统中植被群落的物候信息,为今后研究提供更多的帮助。

此外Chen等人(2010)利用涡度通量数据和ESTARFM所生产的高时空分辨率数据来计算常绿针叶林的生物量,提高了景观尺度和区域尺度生物量的估算精度,为碳汇计算提供了可靠的依据。Liu等人(2011)将时空融合模型预测的结果整合到ETwatch中去,融合形成了不同尺度的蒸散量数据。Coop等人(2012)利用时空融合所生成的数据,得出物候活动3个关键指标,以此来确定物候的变化。Schmidt和Udelhoven(2012)研究了草原地区降水与NDVI的关系,发现降水和NDVI具有很强的滞后关系,得到的分布滞后模型可以在30 m空间分辨率上进行短期的NDVI和生物量预测。Weng等人(2014)基于时空融合模型,结合年内平均温度的变化以及城市地区热图像的异质性生成了每日的LST。Wu等人(2015)基于自适应融合模型STARFM的思想提出了时空一体化温度融合模型(STITFM),通过整合多尺度极轨卫星和静止卫星的数据,来生成高分辨的地表温度数据。万华伟等人(2007)利用高分辨率图像的分类图像,基于像元分解提出了一种融合MODIS与ASTER数据生成高空间分辨率时间序列LAI方法。蔡德文等人(2012)将时空融合模型的结果在石河子地区进行农业区的适用性验证,得到的融合影像与真实影像之间有着较强的相关性,能够较好地应用于农业区的估产等。

这种基于时空融合的结果能够很好地弥补高分辨率数据的不足,与已有的数据共同形成连续可靠的数据,可以广泛地应用于长时间序列数据的分析、监控和反演等。

3.2 大区域数据集的生成

在时空融合方法中,由于所用的低分辨数据往往覆盖的区域都较大,因此借助于时空融合的方法,得到某一区域的高时空分辨率产品具有一定的连续性。李大成等人(2014)基于所提出了改进的自适应融合算法,即乘性调制融合算法,借助2006年 & #8212;2010年的MODIS和Landsat数据,最后经镶嵌后得到了覆盖整个吉林省的6月到8月Landsat 5 TM地表反射率数据集。该数据集的影像具有良好的光谱一致性,能够较好地应用于大范围的应用和监测。

4 结语

目前时空融合模型已经得到了长足的发展,在很大程度上能够解决“时空矛盾”的问题,可以获得较好的预测时刻的融合结果,但是其融合结果仍会受到以下因素的影响:

(1) 模型参数的影响。不管是基于变换模型的融合,还是基于重建和基于学习模型的融合,都有一些预先的设定参数,这些参数设定大小会影响到最终的融合结果。以自适应融合模型为例,其最重要的输入参数之一是滑动窗口的大小。Wu等人(2012a)基于改进的自适应融合模型,利用MODIS和Landsat数据,分析了不同滑动窗口的融合结果与真实结果之间的相关系数、均方根误差等,发现了当滑动窗口的大小为40或者50时,其相关系数最大,而均方根误差最小,是最适宜的窗口大小,过大或者过小都会影响到最终结果的精度。因此模型参数设定对融合结果具有较大的影响,在进行融合实验中需根据实际情况选定合适的参数。

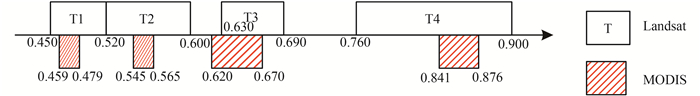

(2) 多源遥感数据本身的差异。不同的传感器在光谱设置上通常都会有差异,并且由于传感器本身器件性能的原因,即便在同一光谱上的不同传感器的光谱响应也会有所不同。如图 3所示,尽管MODIS和Landsat在光谱上很接近,但是其光谱的范围还是有差距,从图 3中明显可以看出Landsat的波谱普遍比MODIS宽,这就会造成两种传感器即使对同一均匀地物其反射率也会有所不同。这种差异通过融合处理过程必然会传入最终的融合结果,影响结果的精度。

(3) 预处理的差异。在进行时空融合的过程,需要对高低分辨率影像进行图像配准和大气校正等预处理操作,使得处理数据保持一致性。但由于图像配准精度的不足以及对Landsat进行大气校正所用的方法和MODIS产品的大气校正方法有所不同,也会造成一定的差异,这种差异同样最终能够造成结果的偏差。

(4)线性混合模型。在时空融合模型中,特别是基于重建模型的融合方法中,所采用的假设主要是低空间分辨率的像元反射率被认为是高空间分辨率像元反射率的线性加权和。这是对不同分辨率影像数据进行处理的一种简化模型,但实际情况下,地物的辐射只有一部分被直接反射到传感器,另一部分则通过散射等方式影响到其他目标再反射到传感器,因此一般来说,传感器所获得的能量是周围地物多次反射的非线性混合结果。而仅仅利用线性来求解,会造成所获得的结果与真实结果相比有一定的偏差。

(5)时相的差异。在时空融合模型中,理论上如果有相应的低分和高分影像数据,就可以预测融合出相应时间的影像。但是在实际融合处理中,两组数据采集时间间隔不宜过长,最好不超过一个季相,如果超过一个季相,很多实验结果已经验证其得到的结果与实际的结果会有很大的偏差,很难再用于后续的定量反演等应用。

由于时空融合方法所牵扯的问题众多且复杂度高,上述因素仅仅考虑到的是一般情况下的影响因素,并未充分考虑实际应用中某些复杂甚至极端情况下可能出现的问题以及影响因素。在实际的处理过程中,需要充分考虑多源数据间的差异以及实际应用的情况,进行参数的合理设定以及有效的预处理,避免一些不可知的因素对结果的影响。

当前时空融合模型的结果已经成功实践于很多实际应用中,并获得了良好的效果。但是时空融合模型依然存在着精度不足以及对变化地物不敏感等问题,需要进行深入的探索和研究,提高其融合的精度和应用的广度,以便更好地满足实际应用的需求。具体来说,可以从以下几个方面进行深入的研究:

(1) 由于高低分辨率卫星传感器的差距,以及在预处理过程中特别是配准和大气校正等,都不可避免地存在误差,这些误差会经过传递级联,最终给融合结果带来很大的偏差,如何能最大限度地减少误差,提高图像间的配准精度,提高不同传感器数据的一致性,是需要认真分析、深入研究的重要问题。

(2) 在多源时空融合模型中,利用的是混合像元的线性模型,如何有效地使用非线性混合模型替代线性模型,是提高最终融合精度的重要手段。

(3) 在遥感处理过程中往往已经拥有了处理区域的许多先验知识,如何充分利用这些先验知识和已知的地面信息,融入到最后的预测结果中去,是时空融合模型研究的一个重要突破口。

(4) 随着深度学习研究的不断深入和发展,如何将深度学习进一步引入到遥感数据处理中,通过进一步优化选择样本以及完备字典的设计,在学习高低分辨率影像上的光谱、空间、时间、结构和纹理特征的同时,最大限度地捕捉其细节信息,以便更好地进行预测融合,是今后时空融合模型发展的重要方向。

(5) 目前时空融合模型都大多仅仅局限于MODIS和Landsat两个卫星传感器上,虽然理论上模型算法对其他卫星同样有效,但是当前还没有任何研究对其他卫星进行深入的研究和对比,因此可以在深入分析模型参数敏感性问题的前提下,将时空融合模型拓展到其他卫星中去,这是扩大时空融合模型应用范围的途径。

时空融合模型是在不增加或者改变卫星状态情况下,针对“时空矛盾”提出的一种有效的解决手段。其方法不仅满足了许多应用对高时空数据需求,而且其有效利用多源数据各自优势的思想也能为其他领域综合利用多源数据进行应用分析提供良好的依据和借鉴。

参考文献(References)

-

Alaguraja P, Yuvaraj D, Sekar D, Muthuveerran P, Manivel M.2010.Remote sensing and GIS approach for the water pollution and management in Tiruchirappli Taluk, Tamil Nadu, India. International Journal of Environmental Sciences, 1 : 66–70.

-

Bhandari S, Phinn S, Gill T.2012.Preparing Landsat Image Time Series (LITS) for monitoring changes in vegetation phenology in Queensland, Australia. Remote Sensing, 4 : 1856–1886. DOI: 10.3390/rs4061856.

-

Busetto L, Meroni M, Colombo R.2008.Combining medium and coarse spatial resolution satellite data to improve the estimation of sub-pixel NDVI time series. Remote Sensing of Environment, 112 (1): 118–131. DOI: 10.1016/j.rse.2007.04.004.

-

Cai D W, Niu Z, Wang L.2012.Adaptability Research of Spatial and Temporal Remote Sensing Data Fusion Technology in Crop Monitoring. Remote Sensing Technology and Application, 27 (6): 927–932. ( 蔡德文, 牛铮, 王力. 2012. 遥感数据时空融合技术在农作物监测中的适应性研究. 遥感技术与应用, 27 (6): 927–932. )

-

Cao G, Zhou L C, Li Y P.2016.A new change-detection method in high-resolution remote sensing images based on a conditional random field model. International Journal of Remote Sensing, 37 (5): 1173–1189. DOI: 10.1080/01431161.2016.1148284.

-

Chen B, Ge Q, Fu D, Yu G, Sun X, Wang S, Wang H.2010.A data-model fusion approach for upscaling gross ecosystem productivity to the landscape scale based on remote sensing and flux footprint modelling. Biogeosciences, 7 (9): 2943–2958. DOI: 10.5194/bg-7-2943-2010.

-

Coops N C, Hilker T, Bater C W, Wulder M A, Nielsen S E, McDermid G, Stenhouse G.2012.Linking ground-based to satellite-derived phenological metrics in support of habitat assessment. Remote Sensing Letters, 3 (3): 191–200. DOI: 10.1080/01431161.2010.550330.

-

Fu D J, Chen B Z, Wang J, Zhu X L, Hilker T.2013.An Improved Image Fusion Approach Based on Enhanced Spatial and Temporal the Adaptive Reflectance Fusion Model. Remote Sensing, 5 (12): 6346–6360. DOI: 10.3390/rs5126346.

-

Gao F, Masek J, Schwaller M, Hall F.2006.On the blending of the Landsat and MODIS surface reflectance:predicting daily Landsat surface reflectance. IEEE Transactions on Geoscience & Remote Sensing, 44 (8): 2207–2218. DOI: 10.1109/tgrs.2006.872081.

-

Hilker T, Wulder M A, Coops N C, Linke J, McDermid G, Masek J G, Gao F, White J C.2009.A new data fusion model for high spatial-and temporal-resolution mapping of forest disturbance based on Landsat and MODIS. Remote Sensing of Environment, 113 (8): 1613–1627. DOI: 10.1016/j.rse.2009.03.007.

-

Huang B, Song H H.2012.Spatiotemporal reflectance fusion via sparse representation. IEEE Transactions on Geoscience & Remote Sensing, 50 (10): 3707–3716. DOI: 10.1109/tgrs.2012.2186638.

-

Kolanuvada S R, Mariappan M and Krishnan V.2016.Demand-based urban forest planning using high-resolution remote sensing and AHP//Proceedings of the SPIE 9879, Lidar Remote Sensing for Environmental Monitoring XV.New Delhi, India:SPIE[DOI:10.1117/12.2223832].

-

Li C, Wu Y, Niu L and Ma N.2015.Land Cover of Erhai Area Based on High-Resolution Remote Sensing Image Spatial Distribution and Its Changes (2000-2010).Paper presented at:2015 Sixth International Conference on Intelligent Systems Design and Engineering Applications (ISDEA).

-

Li D C, Tang P, Hu C M, Zheng K.2014.Spatial-temporal fusion algorithm based on an extended semi-physical model and its preliminary application. Journal of Remote Sensing, 18 (2): 307–319. ( 李大成, 唐娉, 胡昌苗, 郑柯. 2014. 一种拓展的半物理时空融合算法及其初步应用. 遥感学报, 18 (2): 307–319. )

-

Li Y H, Huang C D and Ye X Y.2011.Rural ecosystem planning in high-resolution remote sensing and GIS environment:case study of beautiful countryside planning of Wuyi County, China//Proceedings of the 2011 19th International Conference on Geoinformatics.Shanghai, China:IEEE:1-5 [DOI:10.1109/geoinformatics.2011.5980827].

-

Liu H, Weng Q H.2012.Enhancing temporal resolution of satellite imagery for public health studies:A case study of West Nile Virus outbreak in Los Angeles in 2007. Remote Sensing of Environment, 117 : 57–71. DOI: 10.1016/j.rse.2011.06.023.

-

Liu S F, Xiong J, Wu B F.2011.ETWatch:a method of multi-resolution ET data fusion. Journal of Remote Sensing, 15 (2): 255–269.

-

Ma Y, Chen F, Liu J B, He Y, Duan J B, Li X P.2016.An automatic procedure for early disaster change mapping based on optical remote sensing. Remote Sensing, 8 (4): 272 DOI: 10.3390/rs8040272.

-

Malenovský Z, Bartholomeus H M, Acerbi-Junior F W, Schopfer J T, Painter T H, Epema G F, Bregt A K.2007.Scaling dimensions in spectroscopy of soil and vegetation. International Journal of Applied Earth Observation & Geoinformation, 9 (2): 137–164. DOI: 10.1016/j.jag.2006.08.003.

-

Maselli F.2001.Definition of spatially variable spectral endmembers by locally calibrated multivariate regression analyses. Remote Sensing and Environment, 75 (1): 29–38. DOI: 10.1016/s0034-4257(00)00153-x.

-

Michishita R, Chen L F, Chen J, Zhu X L, Xu B.2015.Spatiotemporal reflectance blending in a wetland environment. International Journal of Digital Earth, 8 (5): 364–382. DOI: 10.1080/17538947.2014.894146.

-

Pisek J, Lang M, Kuusk J.2015.A note on suitable viewing configuration for retrieval of forest understory reflectance from multi-angle remote sensing data. Remote Sensing of Environment, 156 : 242–246. DOI: 10.1016/j.rse.2014.09.033.

-

Roy D P, Ju J C, Lewis P, Schaaf C, Gao F, Hansen M, Lindquist E.2008.Multi-temporal MODIS-Landsat data fusion for relative radiometric normalization, gap filling, and prediction of Landsat data. Remote Sensing of Environment, 112 (6): 3112–3130. DOI: 10.1016/j.rse.2008.03.009.

-

Schmidt M and Udelhoven T.2012.Analysing and quantifying vegetation responses to rainfall with high resolution Spatio-temporal time series data for different ecosystems and ecotones in Queensland//International Archives of the Photogrammetry, Remote Sensing and Spatial Information Sciences.345-349[DOI:10.5194/isprsarchives-xxxix-b8-345-2012].

-

Shi W Z, Hao M.2013.A method to detect earthquake-collapsed buildings from high-resolution satellite images. Remote Sensing Letters, 4 (12): 1166–1175. DOI: 10.1080/2150704x.2013.858839.

-

Singh D.2011.Generation and evaluation of gross primary productivity using Landsat data through blending with MODIS data. International Journal of Applied Earth Observation & Geoinformation, 13 (1): 59–69. DOI: 10.1016/j.jag.2010.06.007.

-

Song H H, Huang B.2013.Spatiotemporal satellite image fusion through one-pair image learning. IEEE Transactions on Geoscience & Remote Sensing, 51 (4): 1883–1896. DOI: 10.1109/tgrs.2012.2213095.

-

Sun K, Li D, Sui H, Liu J and Ma G.2012.Object-level change detection based on high-resolution remote-sensing images and its application in Japanese earthquake on March 11, 2011.ISPRS Annals of Photogrammetry, Remote Sensing and Spatial Information Sciences, I-7:249-256[DOI:10.5194/isprsannals-i-7-249-2012].

-

Walker J J, de Beurs K M, Wynne R H.2014.Dryland vegetation phenology across an elevation gradient in Arizona, USA, investigated with fused MODIS, Landsat data. Remote Sensing of Environment, 144 : 85–97. DOI: 10.1016/j.rse.2014.01.007.

-

Wan H W, Wang J D, Xiao Z Q, and Li L.2007.Generating The High Spatial And Temporal Resolution Lai By Fusing Modis And Aster. Journal Of Beijing Normal University (Natural Science), 43 (3): 303–308. ( 万华伟, 王锦地, 肖志强, 李丽. 2007. 融合MODIS与ASTER数据生成高空间分辨率时间序列LAI方法研究. 北京师范大学学报(自然科学版), 43 (3): 303–308. )

-

Wang K, Zhang L, Wang Z y, Tian F.2013.Research of improved STARFM based on spatial structure variation. Science of Surveying and Mapping, 38 (3): 140–142. ( 王昆, 张丽, 王志勇, 田丰. 2013. 基于半方差函数的STARFM改进模型. 测绘科学, 38 (3): 140–142. )

-

Weng Q H, Gao F, Fu P.2014.Generating daily land surface temperature at Landsat resolution by fusing Landsat and MODIS data. Remote Sensing of Environment, 145 : 55–67. DOI: 10.1016/j.rse.2014.02.003.

-

Wu M Q, Niu Z, Wang C Y, Wu C Y, Wang L.2012a.Use of MODIS, Landsat time series data to generate high-resolution temporal synthetic Landsat data using a spatial and temporal reflectance fusion model. Journal of Applied Remote Sensing, 6 (1): 063507 DOI: 10.1117/1.jrs.6.063507.

-

Wu M Q, Wang J, Niu Z, Zhao Y Q, Wang C Y.2012b.A model for spatial and temporal data fusion. Journal of Infrared and Millimeter Waves, 31 (1): 80–84. DOI: 10.3724/sp.j.1010.2012.00080.

-

Wu P H, Shen H F, Zhang L P, Göttsche F M.2015.Integrated fusion of multi-scale polar-orbiting and geostationary satellite observations for the mapping of high spatial and temporal resolution land surface temperature. Remote Sensing of Environment, 156 : 169–181. DOI: 10.1016/j.rse.2014.09.013.

-

Xie D X, Zhang J S, Zhu X F, Pan Y Z, Liu H L, Yuan Z, Yun Y.2016.An improved STARFM with help of an Unmixing-based method to generate high spatial and temporal resolution remote sensing data in complex heterogeneous regions. Sensors, 16 (2): 207 DOI: 10.3390/s16020207.

-

Yadav S, Rizvi I and Kadam S.2015.Urban tree canopy detection using object-based image analysis for very high resolution satellite images:a literature review//Proceedings of the 2015 International Conference on Technologies for Sustainable Development.Mumbai:IEEE:1-6[DOI:10.1109/ictsd.2015.7095889].

-

Yang J C, Wright J, Huang T S, Ma Y.2010.Image super-resolution via sparse representation. IEEE Transactions on Image Processing, 19 (11): 2861–2873. DOI: 10.1109/TIP.2010.2050625.

-

Zeyde R, Elad M and Protter M.2012.On single image scale-up using sparse-representations//Proceedings of the 7th International Conference on Curves and Surfaces.Avignon, France:Springer:711-730[DOI:10.1007/978-3-642-27413-8_47] .

-

Zhu X L, Chen J, Gao F, Chen X H, Masek J G.2010.An enhanced spatial and temporal adaptive reflectance fusion model for complex heterogeneous regions. Remote Sensing of Environment, 114 (11): 2610–2623. DOI: 10.1013/j.rse.2010.05.032.

-

Zhukov B, Oertel D, Lanzl F, Reinhackel G.1999.Unmixing-based multisensor multiresolution image fusion. IEEE Transactions on Geoscience & Remote Sensing, 37 (3): 1212–1226. DOI: 10.1109/36.763276.

-

Zurita-Milla R, Kaiser G, Clevers J G P W, Schneider W, Schaepman M E.2009.Downscaling time series of MERIS full resolution data to monitor vegetation seasonal dynamics. Remote Sensing of Environment, 113 (9): 1874–1885. DOI: 10.1016/j.rse.2009.04.011.