External defect detection of transformer substation equipment based on improved Faster R-CNN

-

摘要: 针对变电站设备外部缺陷目标检测任务中目标形状多样,周围环境复杂,当前代表性算法识别准确度低,错检漏检严重的问题,对比了众多目标检测算法在变电站设备缺陷数据集上的检测结果,检测精度较高的是添加了特征融合金字塔结构的Faster R-CNN(faster region-based convolutional network)算法,但其对小目标物体和设备渗漏油的检测精度仍有提升空间,为此设计一种基于Faster R-CNN的改进算法。改进算法通过对输入图像进行数据增强,在网络中添加SPP(spatial pyramid pooling)结构以及改进特征融合方式,对分类以及边界框回归损失函数进行改进的方式来提高缺陷的检测精度。与原Faster R-CNN算法进行对比,改进算法在变电站设备缺陷目标检测数据集的检测结果中AP(average precision)(0.5∶0.95)提高了2.7个百分点,AP(0.5)提高了4.3个百分点,对小目标物体的检测精度也提高了1.8个百分点,试验结果验证了该方法的有效性。Abstract: There are challenges in object detection on external defects of transformer substation equipment, such as various target shapes, complex surrounding environment, low recognition accuracy of current representative algorithms, and severe false or missed detection. By comparing the detection results of different object detection algorithms on the transformer substation equipment defect data set, it is revealed that the faster R-CNN algorithm with the feature fusion pyramid structure has higher detection accuracy. However, there are still opportunities to improve the detection accuracy of small target objects and equipment leakage. Thus, in this study, an enhanced, faster R-CNN-based algorithm is developed. It improves the detection accuracy of defects by enhancing the input image data, adding the spatial pyramid pooling structure to the network to improve the feature fusion method, and thereby boosting the classification and bounding box regression loss function. Compared with the original faster R-CNN, the experimental findings demonstrate that the improved algorithm has increased AP (0.5 : 0.95) (average precision) by 2.7% and AP (0.5) by 4.3% in the detection results of the transformer substation equipment with respect to the defect object detection data set and the detection accuracy of small target objects has also been improved by 1.8%. This work confirms the effectiveness of the method proposed here.

-

变电站在电网中承担着电压转换和电能分配的重要作用,其安全可靠运行是电网安全稳定的基础,变电设备的正常运行对变电站安全生产有着重要意义。变电设备可被发现的外部缺陷包括金属锈蚀、设备渗漏油、悬挂物(异物等)、呼吸器硅胶变色和呼吸器渗漏油等,及时地发现并排除这些影响变电设备正常运行的安全隐患对保障变电站的安全可靠运行有着重大意义。目前,依靠人力到现场对缺陷进行人工排查是变电设备缺陷检测的主要方式,但这种人工检测方法虽然对典型的变电设备外部缺陷检测精度高,但需要技术人员定期到现场进行排查,极大地浪费了人力物力资源,尤其是对于恶劣天气或复杂环境下的缺陷检测更是加重了技术人员的工作负担和危险性。随着深度学习技术的发展,目标检测技术已经大量的应用于维护电网安全中,利用基于深度学习的目标检测算法根据变电设备红外图像对变电设备进行缺陷检测[1-3],利用无人机巡检技术对高压线缆[4]、绝缘子缺陷[5-7]、悬挂异物[8]和输电线路多金具缺陷[9-11]等进行检测等技术的应用极大地减少了对人工的依赖并提高了检测效率,在保障电网安全工作中发挥了重大作用。针对变电站的外部缺陷可以利用巡检机器人和固定位置摄像头对变电设备进行定时拍照并及时上传到服务器,在服务器端使用训练好的检测模型对图片进行检测,就可以及时检测出相应的缺陷和隐患[12-14]。

近些年,随着深度学习技术的不断发展,利用卷积神经网络来提取图片特征实现目标检测的算法性能得到了迅速的提高。目前,主流的目标检测算法可以分为两大类:两阶段目标检测算法和单阶段目标检测算法。两阶段目标检测算法将检测过程分为2个阶段,即先生成候选区域(region pro-posals),再将候选区域的特征图(feature map)送入分类器和边界框回归器中进行分类和边界框(bounding boxes)回归参数的预测。单阶段目标检测算法将目标检测任务看作目标区域预测和类别预测的回归问题,其采用单个神经网络直接预测物品边界和类别概率,实现了端到端的目标检测,因此单阶段目标检测算法检测速度非常快,基本达到了实时检测任务的需求。

两阶段目标检测算法中的代表算法是R-CNN系列算法[15-17],其中Faster R-CNN算法[17]使用区域生成网络(region proposal networks,RPN)代替选择性搜索生成候选区域,并在后续的改进中引入特征金字塔(feature pyramid networks,FPN)结构[18],在增加少量模型计算量的情况下,将高层次特征经过上采样与低层次特征融合获得了更强的语义特征,极大地提高了算法的检测精度。

单阶段目标检测代表算法是YOLO(You Only Look Once)系列算法[19-22]、SSD(single shot multiBox detector)算法[23]和RetinaNet算法[24]等 ,因为其将候选区域的生成和目标的分类看作一个统一的回归问题,不像两阶段算法一样要先生成候选区域然后再进行预测,这极大地提高了算法的检测速度,但相应的检测精度也大多低于使用了特征金字塔进行特征融合的Faster R-CNN算法。

针对变电站设备外部缺陷进行检测,在实际应用中并不需要将算法的检测速度放在第一位,而是更关注目标检测算法的精度。对比了SSD[23]、YOLOv3[21]、YOLOv4[22]和Faster R-CNN[17](添加了FPN结构)等算法的检测精度,发现Faster R-CNN算法对变电站设备外部缺陷的检测精度最高,但仍有提升空间。因此本研究选择在Faster R-CNN算法的基础上对算法进行改进以求提高算法对变电站设备外部缺陷的检测精度。

1. Faster R-CNN算法

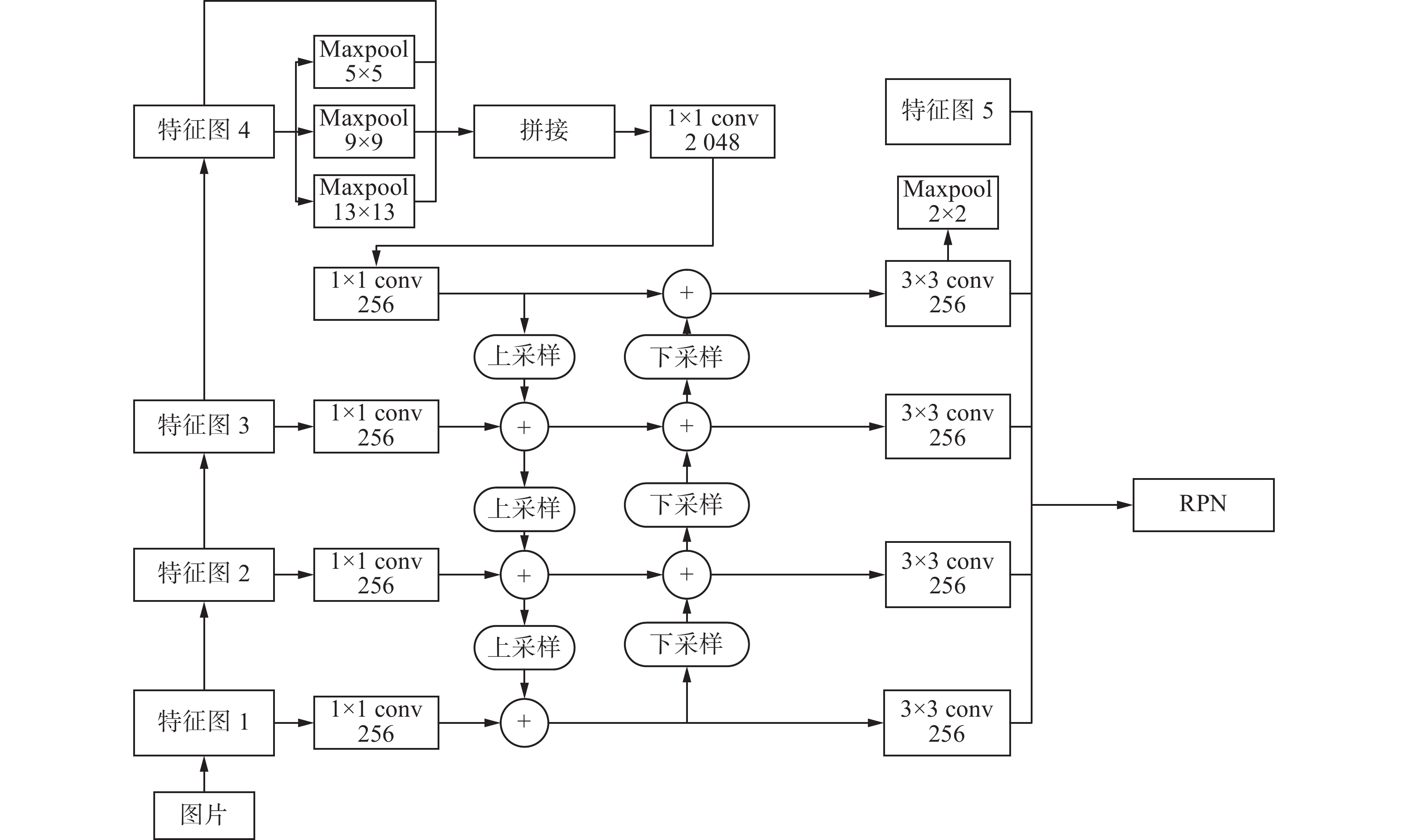

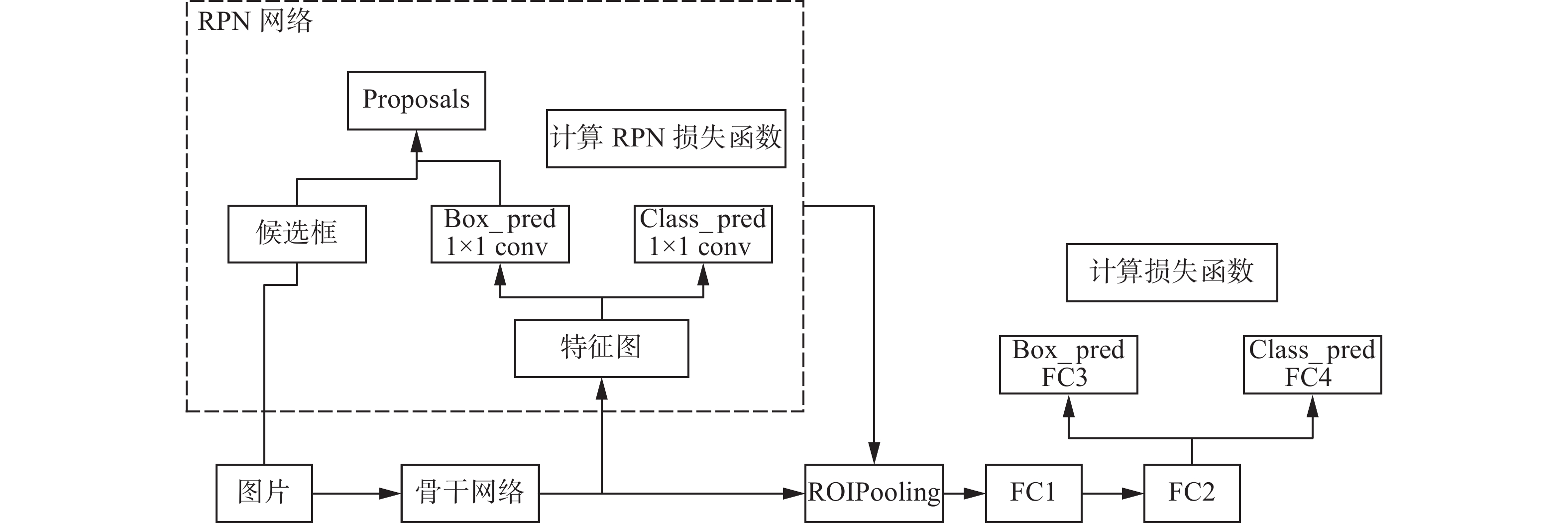

Faster R-CNN是具备较高检测精度的两阶段目标检测算法,在R-CNN系列算法中其首次提出了使用区域提议网络(region proposal network, RPN)代替选择性搜索的方法在骨干网络生成的特征图上生成检测框,这极大地提高了算法的检测速度。后续提出的根据特征金字塔结构(FPN)对生成的多个特征层进行特征融合的方法又进一步提高了Faster R-CNN算法的检测精度。Faster R-CNN算法的整体结构图如图1所示。

Faster R-CNN算法主要分为以下4个步骤:

1) 输入原始图像,对图像进行等比例缩放为长边小于1024像素、短边小于768像素的图像,在对缩放后的图片进行相应处理后送入特征提取网络。

2) 本研究采用的是ResNet50作为特征提取网络,提取后的特征图送入RPN网络,RPN网络为输入特征图的每个位置生成不同比例及大小的预选框,并通过分类器和边界框回归参数预测器进行预测,得到每个预选框可能为真实目标的分数,再根据得分和计算的IoU值进行非极大值抑制(non maximum suppression,NMS)处理,将最终选取的预选框送入ROIPooling层进行处理。

3) ROIPooling层会将输入的预选框进行池化处理,将所有预选框区域特征图处理为7像素×7像素大小的特征图后送入最终的预测结构。

4) 预测结构对处理后的相同大小的特征图分别进行类别预测和边界框回归参数预测,并将边界框回归参数和送入的预测框结合。

5) 计算得到最后的预测框,输出预测结果。

2. 改进的Faster R-CNN算法

对Faster R-CNN算法的改进主要包括添加数据增强方法、结合检测数据集改变固定框的生成尺寸、对基于网络中的特征金字塔结构进行改进和对损失函数的改动。

2.1 数据增强方法

考虑到呼吸器硅胶变色、渗漏油和金属锈蚀等缺陷的检测都与色彩存在一定的相关性,改进的算法在图片数据增强方面添加了图片亮度、对比度和饱和度等进行随机变换的方法,同时使用了马赛克(mosaic)数据增强方法来增加图片多变性以求弥补数据集数量不如公开数据集数量丰富的缺陷,马赛克(mosaic)数据增强方法提高了模型对小物体的检测精度,但同时对大目标检测精度会有所下降,在试验中对算法训练的初始20个批次和最后20个批次不添加马赛克(mosaic)数据增强,对中间的训练批次随机添加马赛克(mosaic)数据增强。

马赛克(mosaic)数据增强的操作如图2所示,在训练过程中,除训练图片外,另外从数据集中随机选取3张图片,以中间某点为中心,将4张图片组合成一张图片并随机缩放进行训练,经过mosaic处理,送入算法训练的图片是由4张图片组合而成,图片所包含的检测物体数量增多,并且因为另外3张图片是随机挑选的,增加了图片的多样性,一定程度上避免了数据集数量相对较少的弊端,同时对图片随机缩放,还增强了对小目标物体的检测效果,提高了算法的检测精度。

2.2 FPN结构的改进

在FPN结构中,添加了自上向下的特征融合的过程,将上层经过充分卷积得到的特征图进行上采样依次与下层的特征层相融合,底层特征融合了经过更多层卷积操作的特征层后获得更为丰富的特征信息,增加了底层特征层对小目标物体的检测精度。而上层特征层经过更多的卷积操作,虽然特征对应的感受野更大,但同样也丢失了很多的细节。因此,为了改善这一情况,仿照PANet网络[25]的思想,为特征层又添加了一条自下向上的特征融合过程,这样就可以弥补因多层卷积而丢失的特征。同时,为了增加特征层的感受野,在最上层特征层向下层上采样融合之前添加了空间金字塔池化结构[26](spatial pyramid pooling ,SPP)来丰富特征图的表达能力。

改进后的FPN结构如图3所示,SPP结构对在骨干网络经过最深层卷积得到的特征图分别以5×5、9×9、13×13的池化核大小进行最大池化操作,再将3次池化后得到的特征图和未经池化的原特征图进行维度的拼接,经过SPP结构这一操作,特征图维度变为原来的4倍,再经过1×1的卷积核降维到原维度后进行自上而下的特征融合过程。经过SPP结构,扩大了特征图的感受野,增强了特征图的表达能力。

在原来FPN的基础上,又添加了自底向上的特征融合,先对融合上层特征后的首个特征层进行两倍下采样,然后将下采样后的特征层与上一特征层进行同纬度相加,通过这一操作,高层可以获得经过太多层卷积后消失的一些特征从而具备更为丰富的特征信息,对后面特征层依次进行上述操作,再用3×3的卷积核进行处理后和对最后一个特征图进行池化核大小为2的最大池化操作得到的共计5个新特征层送入RPN网络获得提议区域。

2.3 RPN网络

根据数据集中需要检测设备金属锈蚀和滴落到地面的设备渗漏油等一些呈长条状的缺陷,在原本生成的固定框比例中添加1∶3的宽高比例,即在融合后的4个特征层以及最后经池化层生成的特征图上都会根据高宽比{1∶1,1∶2,1∶3,2∶1,3∶1}的比例分别生成尺寸大小为24、48、96、192、384的固定框,每层特征图的每个网格会生成5个面积相同、宽高尺寸不同的固定框。

由图4可知,RPN网络分别使用大小为3×3的卷积核扫描特征图来进行类别和边界框回归参数的预测,每个网格生成的每个固定框会分别得到1个类别预测值和4个边界框回归参数预测值,将边界框回归参数和生成的固定框进行计算就得到预测的区域。

具体的计算方法如下式所示。

$$ \begin{gathered} {G_x} = {P_x}{d_x}(p) + {P_x} \\ {G_y} = {P_y}{d_y}(p) + {P_y} \\ {G_w} = {P_w}\exp ({d_w}(p)) \\ {G_h} = {P_h}\exp ({d_h}(p)) \\ \end{gathered} $$ (1) 式中:

${G_x}、{G_y}、{G_w}、{G_h}$ 表示计算后得到的预测框的中心点坐标和预测框的宽高;$ {P_x}、{P_y}、{P_w}、{P_h} $ 表示固定框的中心点坐标和预测框的宽高;$ {d_x}\left( p \right)、 {d_y}\left( p \right)、{d_w}\left( p \right)、 {d_h}\left( p \right) $ 表示对应固定框预测的边界框回归参数。对于最后的预测过程,回归框的处理方式与RPN网络相同,是将经过RPN网络筛选出来的预测框,与在这个预测过程中得到的边界框回归参数按照式(1)结合,得到最终的预测框。

2.4 损失函数的改进

在RPN网络中,只有当预测框与真实目标框的IoU值大于0.7,或者与真实目标框的IoU值最大的预测框被认定为正样本,预测框与真实目标框的IoU值小于0.3的被认定为负样本。在算法的训练过程中可以发现,正负样本的比例差距较大,且对于设备金属锈蚀和设备渗漏油的预测结果相比其他缺陷检测来说精度较低,在算法损失函数的设计中参考Focal loss损失函数的设计,给不同类别根据数据集和预测结果添加损失权重来提高预测结果较差类别的预测精度。

对于RPN网络,在类别预测中,对每个框只会产生一个类别预测值来判断当前区域是背景或真实目标,原算法对于类别预测损失函数采用的是二分类损失,计算公式为

$$ {L_{{\rm{cls}}}} = - [p_i^t\log ({p_i}) + (1 - p_i^t)\log (1 - {p_i})] $$ (2) 式中:

$p_i$ 表示第i个固定框预测为真实目标的概率;$p_i^t$ 表示第i个固定框对应的真实类别值,当固定框与对应真实目标框IoU值大于指定正样本阈值时,$p_i^t$ 为1,当固定框与对应真实目标框IoU值小于指定负样本阈值时,$p_i^t$ 为0。根据正样本数远小于负样本数,对损失函数添加权重修改后的公式为

$$ \begin{gathered} {L_{{\rm{cls}}}} = - [p_i^t\alpha {(1 - {p_i})^\gamma }\log ({p_i}) + \alpha {p_i}^\gamma (1 - p_i^t)\log (1 - {p_i})] \end{gathered} $$ (3) 在公式中添加的权重

$ \alpha $ 用来平衡不同类别损失值,$ {(1 - {p_i})^\gamma } $ 和${p_i}^\gamma $ 用来减少易分类损失在损失函数中的权重,使损失函数更多地关注容易分类错误的类别。经过试验,对于RPN网络,将背景和真实目标的权重设为

$\alpha = \{ 0.5,2\} $ 时效果较好。对于经RPN网络得到提议区域后进行的最终预测过程的类别,原损失函数和改进后的损失函数分别为

$$ {L_{{\rm{cls}}}} = - \frac{1}{{{N_{\rm{cls}}}}}\sum\limits_i {p_i^t} \log (p_i^t) $$ (4) $$ {L_{{\rm{cls}}}} = - \frac{1}{{{N_{\rm{cls}}}}}\sum\limits_i {p_i^t} \alpha {(1 - {p_i})^\gamma }\log (p_i^t) $$ (5) 式中:

${N_{\rm{cls}}}$ 是计算损失采样的总样本数;其他参数和式(3)等同,在没加权重之前,对于设备金属锈蚀和设备渗漏油检测效果较差,加大这两类的损失权重分别设置为3和6,令算法在训练过程中对这两类更加关注,背景和各类别预测对应的损失权重为$\alpha = \{ 0.5,3,1,1,6,1,1\} $ 。对于边界框回归损失函数,原算法采用绝对损失函数(Smoooh L1 Loss),计算如公式为

$$ \begin{gathered} {L_{{\rm{reg}}}} = \frac{\lambda }{{{N_{{\rm{reg}}}}}}\sum\limits_i {p_i^t {\rm{smooth}}({{\boldsymbol{G}}_i}^t - {{\boldsymbol{G}}_i})} \\ {{\boldsymbol{G}}_i}^t = [G_x^t、G_y^t、G_w^t、G_h^t],{{\boldsymbol{G}}_i} = [{G_x}\quad{G_y}\quad{G_w}\quad{G_h}] \\ {\rm{smooth}}(x) = \left\{ {\begin{array}{*{20}{l}} {0.5{x^2}},&{|x| < 1} \\ {|x| - 0.5},&{其他} \end{array}} \right. \end{gathered} $$ (6) 当预测框为正样本时,式(6)中

$p_i^t$ 为1,否则为0,即计算边界框损失时只考虑正样本。${\boldsymbol{G}}_i^t$ 是当前样本与对应真实目标边界框的真实回归参数,${{\boldsymbol{G}}_i}$ 是对当前样本预测的边界框回归参数;${N_{{\rm{reg}}}}$ 表示固定框位置的个数;$\lambda $ 是权重参数,可简单地将$\lambda /{N_{{\rm{reg}}}}$ 看为$1/{N_{\rm{cls}}}$ 。绝对损失函数在计算目标检测的边界框损失时是独立地求出4个坐标之间的损失,然后再相加得到最终的损失,这种独立计算的方式没有考虑到4个坐标的关联性。在后面针对YOLO等一系列算法边界框损失的改进相继提出了IoU(intersection over union)损失函数[27]、GIoU(generalized intersection over union)损失函数[28]、DIoU(distance-IoU)损失函数[29]、CIoU(complete intersection over union)损失函数[29]。本研究对应的试验过程选择参照CIoU损失函数来进行损失函数的修改,CIoU损失函数考虑到了预测框与真实框之间的距离、交并比、尺度大小和长宽比等因素,更充分地利用了预测框和真实框的信息,加快了算法的训练过程,提高了训练效果。

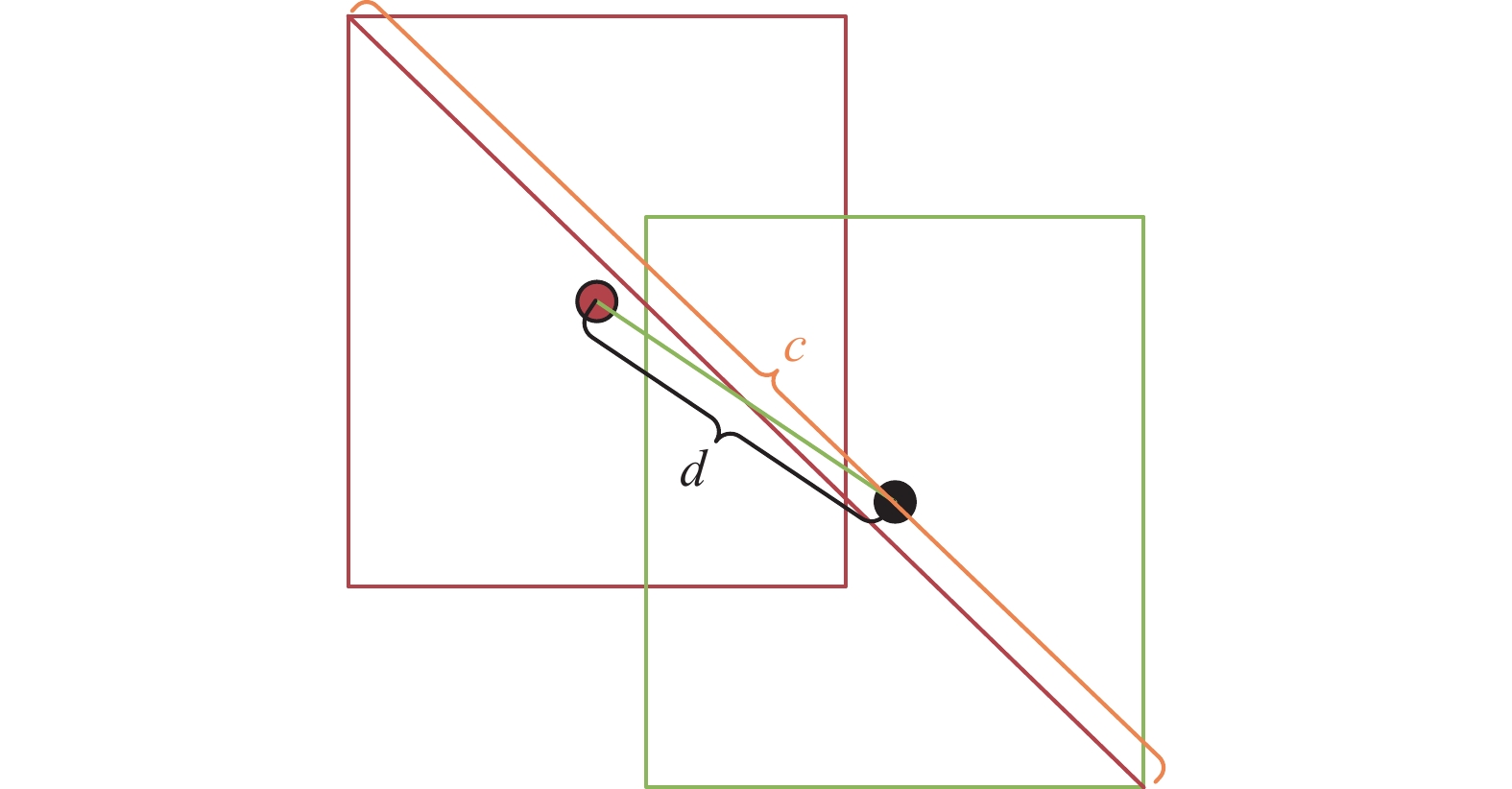

对于CIoU损失函数计算的示意图如图5所示,图5中,距离d表示预测框和真实框中心点之间的距离,距离c表示两框相距最远点间的距离。

对于CIoU损失函数的计算公式为

$$ \begin{gathered} {L_{{\rm{CIoU}}}} = 1 - {\rm{IoU}} + \frac{{{\rho ^2}(b,{b^{gt}})}}{{{c^2}}} + \alpha v \\ {\rm{IoU}} = \frac{{|A \cap B|}}{{|AUB|}} \\ v = \frac{4}{{{\Pi ^2}}}{\left(\arctan \frac{{{w^{gt}}}}{{{h^{gt}}}} - \arctan \frac{w}{h}\right)^2} \end{gathered} $$ (7) 式中:

$b$ 表示预测框的中心点坐标;${b^{gt}}$ 表示对应真实框的中心点坐标;$ {\,\rho ^2}(b,{b^{gt}}) $ 表示2个中心点之间距离的平方;即图5中的${d^2}$ ;${w^{gt}}、{h^{gt}}、w、h$ 分别表示真实框和预测框的宽高尺寸;$\alpha $ 是权重系数;$v$ 用来度量长宽比的相似性。$\alpha v$ 的引入是CIoU损失函数相对于DIoU损失函数的改进 。在实际的试验中发现,CIoU损失函数相较于DIoU损失函数的精度提升并不明显,但算法的训练收敛速度相对提高了。

3. 模型训练与结果分析

3.1 试验数据与模型训练

选取某变电站的1574张带有外部缺陷的图片进行标注作为试验数据集,每张图片的图像分辨率为1024×768,为了提高数据集利用率,对数据集采用了随机翻转、色彩变化、mosaics数据增强等方式来对图片进行处理。在数据集中随机挑选其中的2/3作为训练集,剩下的1/3作为测试集来进行模型的训练和验证。

算法模型中RPN网络的正样本选取IoU阈值设为0.7,负样本阈值为0.3,计算RPN损失时正负样本共计选取256个,比例为1∶1,正样本数据不足时用负样本进行填充;RPN网络选取的样本经过非极大值抑制处理后,选取2000个候选框送入最后的预测过程,预测中正负样本划分阈值为0.5,计算损失时采样512个样本,正样本选取比例为0.25。

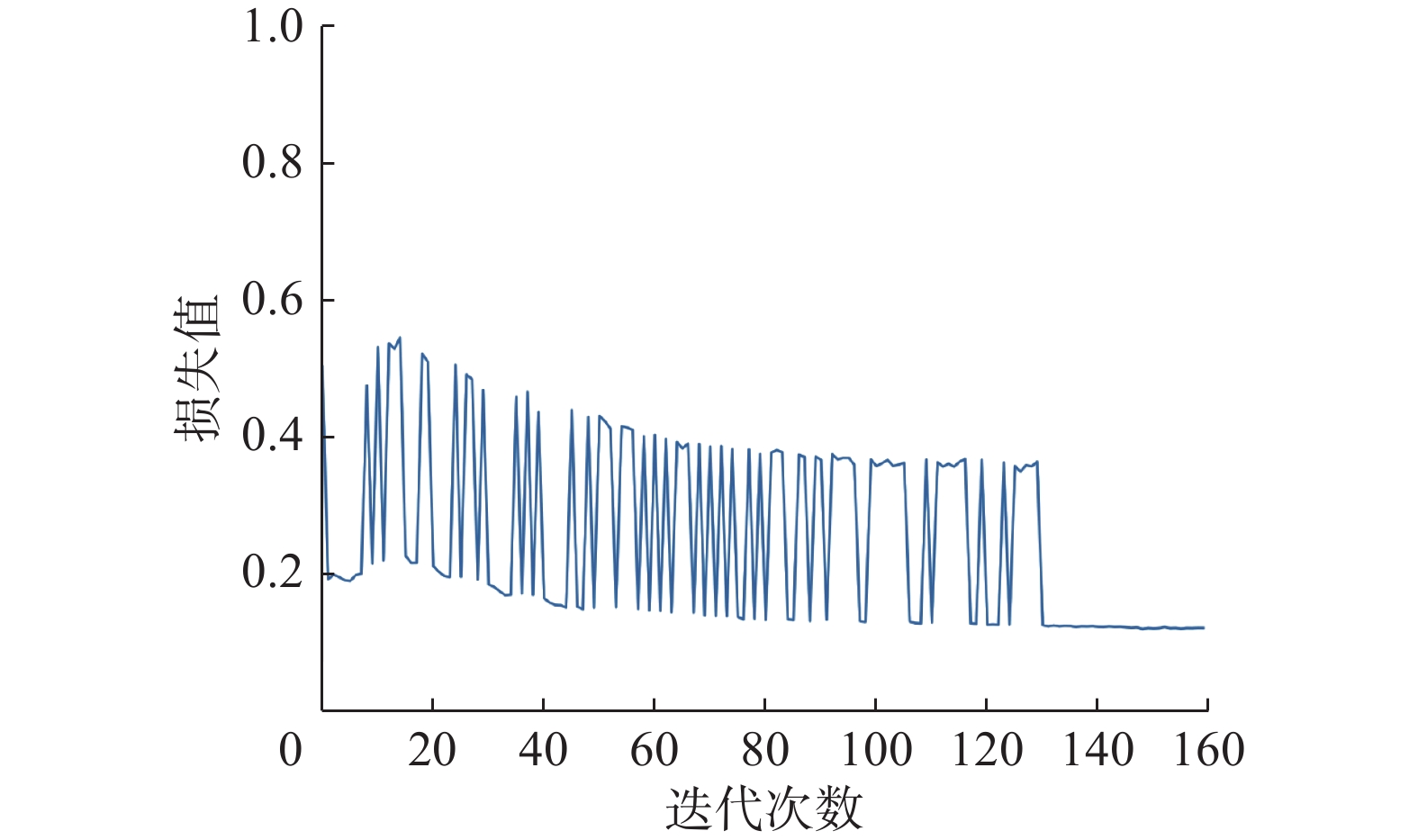

利用COCO数据集来获得模型的预训练模型,然后在预训练模型的基础上对变电站设备外部缺陷数据集进行训练,训练过程中动量参数设为0.9,权重衰减参数设为0.005,初始学习率为0.005,每迭代训练4次,学习率×0.8,迭代训练160轮后得到稳定的模型,模型损失变化如图6所示。

3.2 不同改进结构算法的检测结果

在本文的第2章介绍了对Faster R-CNN算法做的各类改进,在本节分别对使用特征金字塔结构(FPN)改进和损失函数改进后的算法与原算法进行了检测效果的对比。

根据COCO数据集[30]检测评价标准,在不改变其他算法结构的前提下,不同的改进FPN结构的检测结果如表1所示,改进FPN结构后的算法,AP(0.5)的值提高了1.8%,AP (0.5∶0.95)提高了0.7%,对小目标物体检测的精度也提高了2.6%。

表 1 不同改进FPN结构的试验结果对比Table 1 Comparison of experimental results of different improved FPN structures% 评价指标 原FPN 改进FPN SPP+改进FPN AP (0.5∶0.95) 50.8 51.4 51.5 AP (0.5) 73.7 74.0 75.5 AP (0.75) 57.1 59.0 58.7 AP(small) 30.9 31.3 33.5 AP(medium) 44.7 43.8 45.4 AP(large) 54.8 55.5 54.7 设备金属锈蚀 58.3 57.8 59.5 呼吸器正常 91.1 91.4 95.4 续表 1 评价指标 原FPN 改进FPN SPP+改进FPN 呼吸器硅胶变色 93.7 93.4 94.8 呼吸器渗漏油 84.5 85.3 87.0 悬挂物 83.5 84.0 83.6 设备渗漏油 30.8 32.1 32.4 不同损失函数的改进后算法的检测精度提高如表2所示,使用Focal Loss和CIoU Loss损失函数改进后的算法,AP(0.5∶0.95)相对原算法提高了1.3%,AP(0.5)提高了2%。

表 2 改进损失函数的试验结果对比Table 2 Comparison of experimental results of improved loss function% 评价指标 原算法 Focal+DIoU

LossFocal+CIoU

LossAP (0.5∶0.95) 50.8 51.8 52.1 AP (0.5) 73.7 75.4 75.7 AP (0.75) 57.1 57.7 58.3 AP(small) 30.9 33.7 32.1 AP(medium) 44.7 44.2 44.2 AP(large) 54.8 55.7 56.1 设备金属锈蚀 58.3 57.1 56.5 呼吸器正常 91.1 94.6 94.7 呼吸器硅胶变色 93.7 94.2 94.5 呼吸器渗漏油 84.5 87.2 89.7 悬挂物 83.5 87.1 85.2 设备渗漏油 30.8 32.7 33.8 根据2个表格中的对比结果,可以看出使用FPN结构和损失函数改进后的算法,对变电站设备外部缺陷数据集的检测精度都有了提高,2种改进是行之有效的。

3.3 试验结果与分析

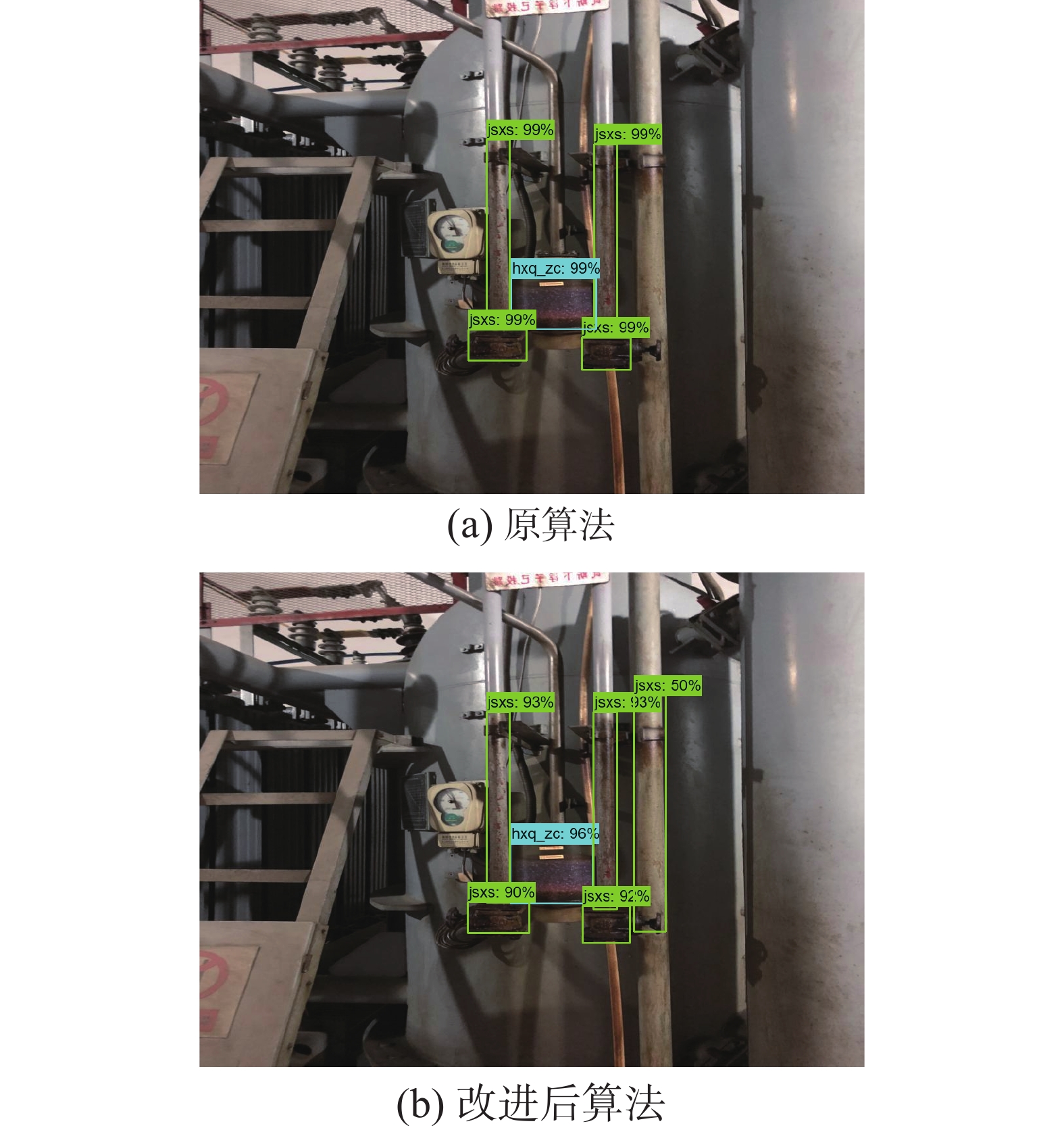

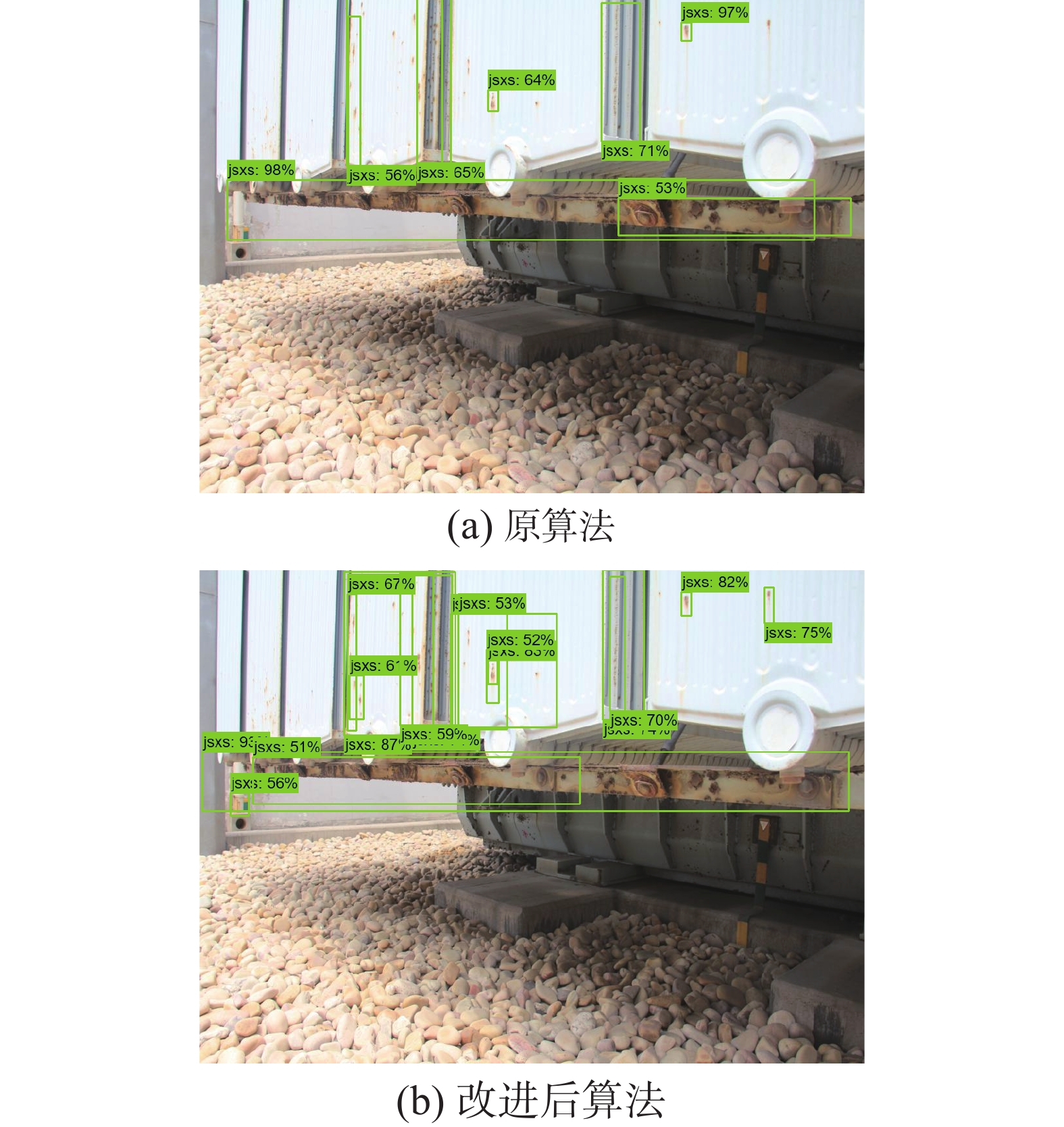

原算法和经过改进后的算法对图片的检测效果对比如图7、图8所示,根据图7和图8中的对比检测结果可以看出相比原算法,改进后的算法可以检测出原本算法未检测出的特征不太明显的金属锈蚀等的缺陷,检测效果更加全面,改进后的算法对小目标物体的检测效果更好,能够识别出原算法未发现的微小的缺陷,对缺陷的框选效果也更准确。

在试验中对比了Faster R-CNN原算法与经过一系列改进后的算法的检测精度,同时还与SSD算法、YOLOv4算法的检测精度进行了对比,总体的检测精度和对各类别缺陷的检测精度分别如表3、表4所示,改进后的算法根据COCO数据集检测评价标准在该数据集下检测精度最高, AP(0.5∶0.95)相对原算法提高了2.7个百分点,AP(0.5)提高了4.3个百分点;对小目标物体的检测精度也提高了1.8个百分点。

表 3 不同算法的试验结果对比Table 3 Comparison of experimental results of different algorithms% 算法 AP(0.5∶0.95) AP(0.5) AP(0.75) AP(small) AP(medium) AP(large) Faster R-CNN 50.8 73.7 57.1 30.9 44.7 54.8 SSD 49.6 73.6 56.0 27.0 41.8 53.3 YOLOv4 48.5 72.5 54.4 25.6 40.8 52.6 改进后算法 53.5 78.0 59.1 32.7 47.3 57.6 表 4 不同算法对缺陷类别的检测精度对比Table 4 Comparison of detection accuracy of defect categories by different algorithms% 算法 设备金属锈蚀 呼吸器正常 呼吸器硅胶变色 呼吸器渗漏油 悬挂物 设备渗漏油 Faster R-CNN 56.3 91.1 93.7 84.5 83.5 30.8 SSD 46.7 94.8 93.6 88.1 87.7 32.9 YOLOv4 48.8 91.7 93.4 85.8 84.7 30.4 改进后算法 57.0 95.5 95.2 86.3 87.7 33.6 根据试验结果的对比可以看出改进后的算法相对原算法的检测精度的提高比较明显,对设备渗漏油的检测精度以及对细小类型的金属锈蚀的检测精度也有了不小的进步,但相对其他缺陷,检测精度依然有待提高。

4. 结束语

本研究针对变电站的外部缺陷的目标检测问题设计了一种基于改进Faster R-CNN的检测算法,有效提高了对变电站设备外部缺陷的检测精度。该算法能够实现针对拍摄的变电站外部图片精准识别出其中的缺陷,能够满足变电站对外部缺陷检测的需要。算法具有以下优点:

1)使用了包括mosaic数据增强方法在内的一系列增强方法,使算法模型的迁移性比原算法更强。

2)经过对算法特征提取融合网络的改进,本算法模型对小目标物体的检测精度更高。

3)对损失函数的改进,有效地提高了对金属锈蚀、渗漏油等难检测物体检测精度,提高了算法的收敛速度,进一步增强了算法的检测精度。

-

表 1 不同改进FPN结构的试验结果对比

Table 1 Comparison of experimental results of different improved FPN structures

% 评价指标 原FPN 改进FPN SPP+改进FPN AP (0.5∶0.95) 50.8 51.4 51.5 AP (0.5) 73.7 74.0 75.5 AP (0.75) 57.1 59.0 58.7 AP(small) 30.9 31.3 33.5 AP(medium) 44.7 43.8 45.4 AP(large) 54.8 55.5 54.7 设备金属锈蚀 58.3 57.8 59.5 呼吸器正常 91.1 91.4 95.4 续表 1 评价指标 原FPN 改进FPN SPP+改进FPN 呼吸器硅胶变色 93.7 93.4 94.8 呼吸器渗漏油 84.5 85.3 87.0 悬挂物 83.5 84.0 83.6 设备渗漏油 30.8 32.1 32.4 表 2 改进损失函数的试验结果对比

Table 2 Comparison of experimental results of improved loss function

% 评价指标 原算法 Focal+DIoU

LossFocal+CIoU

LossAP (0.5∶0.95) 50.8 51.8 52.1 AP (0.5) 73.7 75.4 75.7 AP (0.75) 57.1 57.7 58.3 AP(small) 30.9 33.7 32.1 AP(medium) 44.7 44.2 44.2 AP(large) 54.8 55.7 56.1 设备金属锈蚀 58.3 57.1 56.5 呼吸器正常 91.1 94.6 94.7 呼吸器硅胶变色 93.7 94.2 94.5 呼吸器渗漏油 84.5 87.2 89.7 悬挂物 83.5 87.1 85.2 设备渗漏油 30.8 32.7 33.8 表 3 不同算法的试验结果对比

Table 3 Comparison of experimental results of different algorithms

% 算法 AP(0.5∶0.95) AP(0.5) AP(0.75) AP(small) AP(medium) AP(large) Faster R-CNN 50.8 73.7 57.1 30.9 44.7 54.8 SSD 49.6 73.6 56.0 27.0 41.8 53.3 YOLOv4 48.5 72.5 54.4 25.6 40.8 52.6 改进后算法 53.5 78.0 59.1 32.7 47.3 57.6 表 4 不同算法对缺陷类别的检测精度对比

Table 4 Comparison of detection accuracy of defect categories by different algorithms

% 算法 设备金属锈蚀 呼吸器正常 呼吸器硅胶变色 呼吸器渗漏油 悬挂物 设备渗漏油 Faster R-CNN 56.3 91.1 93.7 84.5 83.5 30.8 SSD 46.7 94.8 93.6 88.1 87.7 32.9 YOLOv4 48.8 91.7 93.4 85.8 84.7 30.4 改进后算法 57.0 95.5 95.2 86.3 87.7 33.6 -

[1] 薛艺为, 孙奇珍, 党卫军. 基于Faster RCNN的配网设备红外图像缺陷识别方法[J]. 信息技术, 2020, 44(7): 79–83,91. XUE Yiwei, SUN Qizhen, DANG Weijun. Infrared image defect recognition method of distribution network equipment based on Faster RCNN[J]. Information technology, 2020, 44(7): 79–83,91. [2] 黄锐勇, 戴美胜, 郑跃斌, 等. 电力设备红外图像缺陷检测[J]. 中国电力, 2021, 54(2): 147–155. HUANG ruiyong, DAI meisheng, ZHENG yuebin, et al. Infrared image defect detection of power equipment[J]. Electric power, 2021, 54(2): 147–155. [3] 徐小冰, 袁婧, 廖雁群, 等. 基于Faster RCNN与Mean-Shift的电缆附件缺陷红外图像自动诊断方法[J]. 高电压技术, 2020, 46(9): 3070–3080. XU Xiaobing YUAN Jing LIAO Yanqun, et al. Autonomous diagnosis method for defects of cable accessories based on Faster RCNN and mean-shift algorithm by infrared images[J]. High voltage engineering, 2020, 46(9): 3070–3080. [4] 刘召, 张黎明, 耿美晓, 等. 基于改进的Faster R-CNN高压线缆目标检测方法[J]. 智能系统学报, 2019, 14(4): 627–634. LIU Zhao, ZHANG Liming, GENG Meixiao, et al. Object detection of high-voltage cable based on improved Faster R-CNN[J]. CAAI transactions on intelligent systems, 2019, 14(4): 627–634. [5] 赵文清, 程幸福, 赵振兵, 等. 注意力机制和Faster RCNN相结合的绝缘子识别[J]. 智能系统学报, 2020, 15(1): 92–98. doi: 10.11992/tis.201907023 ZHAO Wenqing, CHENG Xingfu, ZHAO Zhenbing, et al. Insulator recognition based on attention mechanism and Faster RCNN[J]. CAAI transactions on intelligent systems, 2020, 15(1): 92–98. doi: 10.11992/tis.201907023 [6] 冯晗, 姜勇. 使用改进 Yolov5 的变电站绝缘子串检测方法[J]. 智能系统学报, 2022, 18(2): 325–332. FENG Han JIANG Yong. A substation insulator string detection method based on an improved Yolov5[J]. CAAI transactions on intelligent systems, 2022, 18(2): 325–332. [7] 刘开培, 李博强, 秦亮, 等. 深度学习目标检测算法在架空输电线路绝缘子缺陷检测中的应用研究综述[J]. 高电压技术, 2023, 49(9): 3584–3595. LIU Kaipei, LI Boqiang, QIN Liang, et al. Review of application research of deep learning object detection algorithms in insulator defect detection of overhead transmission lines[J]. High voltage engineering, 2023, 49(9): 3584–3595. [8] 刘黎, 韩睿, 韩译锋, 等. 改进的Faster-RCNN目标检测方法在变电站悬挂异物检测中的应用[J]. 电测与仪表, 2021, 58(1): 142–146. doi: 10.19753/j.issn1001-1390.2021.01.021 LIU Li, HAN Rui, HAN Yifeng, et al. Application of an improved Faster-RCNN object detection method in the detection of suspended foreign matters in substation[J]. Electrical measurement & instrumentation, 2021, 58(1): 142–146. doi: 10.19753/j.issn1001-1390.2021.01.021 [9] 戚银城, 赵席彬, 耿劭锋, 等. 基于遮挡关系推理的输电线路图像金具检测[J]. 智能系统学报, 2022, 17(6): 1154–1162. QI Yincheng, ZHAO Xibin, GENG Shaofeng, et al. Fittings detection in transmission line images with occlusion relation inference[J]. CAAI transactions on intelligent systems, 2022, 17(6): 1154–1162. [10] 赵振兵, 江爱雪, 戚银城, 等. 嵌入遮挡关系模块的SSD模型的输电线路图像金具检测[J]. 智能系统学报, 2020, 15(4): 656–662. ZHAO Zhenbing, JIANG Aixue, QI Yincheng, et al. Fittings detection in transmission line images with SSD model embedded occlusion relation module[J]. CAAI transactions on intelligent systems, 2020, 15(4): 656–662. [11] 翟永杰, 王乾铭, 杨旭, 等. 融合外部知识的输电线路多金具解耦检测方法[J]. 智能系统学报, 2022, 17(5): 980–989. ZHAI Yongjie, WANG Qianming, YANG Xu, et al. A multi-fitting decoupling detection method for transmission lines based on external knowledge[J]. CAAI transactions on intelligent systems, 2022, 17(5): 980–989. [12] 琚泽立, 邢伟, 金鸿鹏, 等. 基于轻量化网络的变电站缺陷图片检测算法[J]. 电网与清洁能源, 2020, 36(8): 43–49. JU Zeli, XING Wei, JIN Hongpeng, et al. Detection of substation faults image based on lightweight network[J]. Power system and clean energy, 2020, 36(8): 43–49. [13] 万吉林, 吴国强, 管敏渊, 等. 基于RetinaNet的变压器图像小部件智能识别方法[J]. 电力系统保护与控制, 2021, 49(12): 166–173. doi: 10.19783/j.cnki.pspc.201012 WAN Jilin, WU Guoqiang, GUAN Minyuan, et al. Intelligent recognition method for transformer small components based on RetinaNet[J]. Power system protection and control, 2021, 49(12): 166–173. doi: 10.19783/j.cnki.pspc.201012 [14] 尹子会, 孟荣, 范晓丹, 等. 融合边缘计算和改进Faster R-CNN的变电站设备典型视觉缺陷检测系统[J]. 中国科技论文, 2021, 16(3): 343–348. YIN Zihui, MENG Rong, FAN Xiaodan, et al. Typical visual defect detection system of substation equipment based on edge computing and improved Faster R-CNN[J]. China sciencepaper, 2021, 16(3): 343–348. [15] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]//2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus: IEEE, 2014: 580−587. [16] GIRSHICK R. Fast R-CNN[C]//2015 IEEE International Conference on Computer Vision . Santiago: IEEE, 2016: 1440−1448. [17] REN S, HE K, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE transactions on pattern analysis and machine intelligence, 2017, 39(6): 1137–1149. doi: 10.1109/TPAMI.2016.2577031 [18] LIN T Y, DOLLÁR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition . Honolulu: IEEE, 2017: 936−944. [19] REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: unified, real-time object detection[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition . Las Vegas: IEEE, 2016: 779−788. [20] REDMON J, FARHADI A. YOLO9000: better, faster, stronger[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition . Honolulu: IEEE, 2017: 6517−6525. [21] REDMON J, FARHADI A. YOLOv3: an incremental improvement[EB/OL]. (2018−04−08)[2020−01−01]. https://arxiv.org/abs/1804.02767. [22] BOCHKOVSKIY A, WANG C Y, LIAO H Y M. YOLOv4: optimal speed and accuracy of object detection[EB/OL]. (2020−04−23)[2022−01−01]. https://arxiv.org/abs/2004.10934.pdf. [23] LIU W, ANGUELOV D, ERHAN D, et al. (2016). Ssd: Single shot multibox detector[EB/OL]. (2016−03−30)[2022−01−01]. https://arxiv.org/abs/1512.02325. [24] LIN T Y, GOYAL P, GIRSHICK R, et al. Focal loss for dense object detection[C]//2017 IEEE International Conference on Computer Vision . Venice: IEEE, 2017: 2999−3007. [25] LIU Shu, QI Lu, QIN Haifang, et al. Path aggregation network for instance segmentation[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Salt Lake City: IEEE, 2018: 8759−8768. [26] HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al. Spatial pyramid pooling in deep convolutional networks for visual recognition[J]. IEEE transactions on pattern analysis and machine intelligence, 2015, 37(9): 1904–1916. doi: 10.1109/TPAMI.2015.2389824 [27] YU Jiahui, JIANG Yuning, WANG Zhangyang, et al. UnitBox: an advanced object detection network[C]//Proceedings of the 24th ACM International Conference on Multimedia. Amsterdam The Netherlands. New York: ACM, 2016: 516−520. [28] REZATOFIGHI H, TSOI N, GWAK J, et al. Generalized intersection over union: a metric and a loss for bounding box regression[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition . Long Beach: IEEE, 2020: 658−666. [29] ZHENG Zhaohui, WANG Ping, LIU Wei, et al. Distance-IoU loss: faster and better learning for bounding box regression[J]. Proceedings of the AAAI conference on artificial intelligence, 2020, 34(7): 12993–13000. doi: 10.1609/aaai.v34i07.6999 [30] LIN T Y, MAIRE M, BELONGIE S, et al. Microsoft COCO: common objects in context[C]//European Conference on Computer Vision. Cham: Springer, 2014: 740−755.

下载:

下载: