Brief review on ten questions and answers for the new generation of artificial intelligences

-

-

新一代人工智能是我国近期的一项重大发展战略,影响深远。2021年李德毅院士[1],围绕新一代人工智能的技术内核,做出了富有理论深度和实践指导意义的论断。本着“真理越辩越明”的原则,笔者根据个人对这一问题的理解和思考,围绕李院士的“十问十答”的某些论点做一个简单的评述。

一问:意识、智慧和智能是什么关系?新一代人工智能触不触及意识?

李院士认为:意识是一种感觉,是对自身存在的感知。而要想感知到“我”这个本体的存在,首先需要具备知觉意识,要能够从边界上区分出“我”和“非我”。对于生物来说,这一边界就是皮肤,制造真正意义的皮肤还有很长的路要走。

意识确实需要一个边界,而作为这个边界的“皮肤”则可以是一种抽象的存在。例如,一个房间内装备了能感知温度、湿度、含氧量、粉尘密度等信息的传感器。如果只能单纯地获取这些信息,那当然谈不上有意识。但如果能够综合这些信息,获得对生活在房间内人的舒适度的评估,那这是不是在某种意义上可以称为一种意识呢?如果这个房间还能够根据这个信息,自动开启空调、加湿器、制氧机、空气净化器等,让房间一直保持对人的最佳舒适度,这可不可以称为有智能呢?在这里,这些传感器能感知的范围就是它的边界。

意识(consciousness)不仅要有“感”,更重要的是能“觉”,也就是要能根据感知到的信息,提取出与自身相关的隐含信息。意识通常包括环境意识,例如安全意识、危机意识,可以看作是对个体生存环境的评估;如果个体是群体的一部分,那还包括群体意识,例如团队意识,可以看作是个体对其他个体影响的评估。事实上,早在笛卡尔的时代,人们就认为意识是感官在大脑中的投射,是思维的一个重要组成部分(如图1所示)。时至今日,虽然我们可以用精密仪器监测大脑的活动,但依然没有弄清楚大脑是如何综合各种感官信息形成完整的意识。

因此,虽然如李院士所说意识和智能是可以分离的,但意识是思维的一个重要过程,是智能的一项前提。计算机虽然有计算智能但没有意识,是因为使用计算机的人补上了意识的空缺,二者构成了一个智慧的整体。新一代人工智能如果需要更多的自动化,就必然会触及意识,至少是狭义的意识。

高等生物的生理本能是自然选择的结果,确实不在当前人工智能的研究范畴。因为人工智能的对象面临的是人类的选择,而不是自然的选择。例如,金鱼的体态对游泳、觅食不利,但得到了人们的喜爱,一样能够生存和繁衍。

生物的情感基础是体内激素大幅度波动的结果,例如:多巴胺的大量分泌会让人产生愉悦,肾上腺激素的飙升会让人情绪激动。现代医学通过药物或对大脑相对部位的刺激同样能产生相应的情感。激烈的情感能让人体的各项性能短时间内飙升,对于应对紧急情况有利。但它同时也是一柄双刃剑,可能造成过度消耗(类似CPU的超频)或者歇斯底里的应激反应。对于智能体是否真的需要这种大幅度的波动还存在争议。

情感机器人的外显情感,更多是一种与外界交流的方式,不涉及内在的情感波动。

二问:如何理解通用智能?通用智能一定是强智能吗?新一代人工智能既要通用又要强智能,通用和强是什么关系?

李院士认为:通用智能是跨领域的一般性智能。如果说强人工智能追求的是智能纵向的深度,新一代人工智能追求的恰恰是智能横向的宽度。纵向智能、横向智能都没有尽头。

在这里,是不是可以理解为强智能就是要比人做得更好,通用智能就是要和人一样能够完成多种任务?AlphaGo能够战胜人类围棋世界冠军[2],在围棋上比人做得更好,是不是就可以认为是围棋任务上的强智能了?或许还有很多人不这么认为,因为AlphaGo需要百万棋局的训练,而人只需要很少的棋局。但是AlphaGo可以利用专门的硬件将百万棋局的训练压缩在很短的时间内完成,这是人做不到的。如果不以结果作为智能强弱的评判,而要将智能的实现途径拉到和人类似,做到“类人”,这可能没有太大的意义。我们不能说飞机的飞就不是飞,而鸟类的飞才是飞;飞机的飞行能力就不能叫强,一定要“类鸟”的飞行能力才可以。所有能够超越人类的智能都值得研究,都可能造福人类。

诚如李院士所言,通用智能的“通用”其实也是相对而言的,有一定范围的。人也不是什么都能做,随着社会分工的进一步精细化,人也朝着特化、专才的方向发展。从生产效率的角度,通用的机器永远比不上特化的专用机器。研究通用智能的价值可能还不仅仅局限于希望一台机器能够完成多项任务,更大的价值可能还在于希望了解智能的本质,就像古生物学家希望了解生命的起源一样。通过对智能本质的探究,解决目前无法解决的问题。

计算机是人类有史以来创造的最通用的工具。它的通用性本质上来源于图灵机[3],一种“万能”(universal)的计算机器。它可以同时用来计算、编辑和通信,这是算盘、打字机和电话所不具备的。“人无爪牙之利、筋骨之强”,却能站在生物链的最顶端,凭借的是人类的智能。人类智能和动物智能最大的区别在于人类的智能更加的“通用”。这背后的原理是什么,着实让人着迷。

因此,通用智能不一定是强智能,反之亦然。我们真正需要的其实是强智能,但通过研究通用智能可能有机会一窥智能的本质,从而创造出现在没有的、新的强智能工具。这好比能够有能在天上飞、地上跑、水面游的通用交通工具固然好,但是我们需要的或许是飞的最快的飞机、跑的最快的汽车和游的最快的船。

强智能或许与人类智能相去甚远,不足以提供对智能的深度理解,但它却能更好地解决问题。通用智能或许没有想象中那么来的有“用”,事实上如果需要更多拥有人类智能的个体,提高社会生育率或许更为现实。但对它的研究却能够让我们深入地了解智能的本质,拓展我们创造更强智能的可能。对于新一代人工智能研究来说二者同样意义重大。

三问:目前几乎所有人工智能都是在计算机上表现出来的计算机应用,即“计算机智能”。如何在物理装置上实现超出计算机智能的、受脑科学和认知科学启发的新一代人工智能?

李院士认为:需要强调“介观类脑”,即在大规模神经元群组和网络水平上模拟脑认知网络;同时没有感知不会有认知,脑和外界环境不停地交互,和外部客体之间一直存在着认知对应关系。

无需从分子水平讨论“类脑”智能,这应该是大多数人的共识。但如何从神经元水平模拟脑认知网络,目前虽然取得了一些进展,但总体还没有太好的途径。通过电子电路等物理装置实现脑神经网络,最大的问题可能还在于它不像神经网络一样具有高度的可塑性。刚出生婴儿的大脑和受过高等教育的成年人的大脑,在脑神经的连接结构上应有较大的差别。人不断学习的过程同时也是不断重塑“脑回路”的过程。物理装置虽然也能模拟脑神经网络,但还不能真正像脑神经一样根据外界的反馈,自动地调整和重塑神经的连接。归根结底,目前对脑神经网络的调整机制还缺乏充分的认知,同时也缺乏合适的物理装置能够模拟这一过程。这需要多学科交叉的共同努力。

一些古人类学的研究表明,由于环境的巨变,早期的类人猿被迫从树上来到平坦的草原上生活。适应了树栖生活的类人猿,很难在相对较短的时间内进化出适应地面上生活的身体结构(如尖利的爪牙、快速的奔跑等)。相对于漫长的身体进化,大脑是唯一能在短时间内进行调整从而快速适应环境的身体器官。从某种意义上说,人类智能的产生也是残酷自然选择的结果。不同于基因层面的进化,大脑的改变是不可遗传的。因此,人类发展产生了教育−学习的传承机制,生存技能和知识得以代代相传。

由此可见,环境的刺激对于人类智能的产生起着非常关键的作用。或许类脑智能本身就是不可存储、不可转移的,而是在特定的装置(如大脑)上,由于环境的刺激而激发出的一种能力。因此,类脑智能的研究不能够仅仅局限于模拟脑的结构,还需要研究对脑的刺激方式,以及接受刺激后脑结构的调整方式。只有明白这些行为背后的复杂机理,才有可能发展出真正的“类脑智能”。

四问:机器人不会有七情六欲,学习的原动力来自何处?如果没有接受教育的自觉性,新一代人工智能如何具有学习的动机?

李院士认为:可人工赋予机器企图和任务目标,让机器在交互的过程中,提出自己的问题,依据任务目标,分解并确定具体的学习目标,也就有了学习的驱动力,学习欲望强,主动性就强。

人的七情六欲归根结底来源于生物生存和繁衍的本能,这是自然选择的结果。在人类社会中,有人过早地选择结束自己的生命,有人决定终身不要子嗣,这些是人的大脑根据某些现实因素做出的决策。可见生物的本能并不是由遗传物质“镌刻”在负责理性思维的大脑中,而是由身体的其他器官影响大脑的结果。例如:对食物和异性的渴望,这些都不是由理性思维激发。相反,理性思维还可以根据情境对这些本能产生抑制作用,控制本能的冲动。

因此,对于人来说,学习的原动力(本能)可能主要来源于脑外(身体)的刺激,而不一定是大脑内部理性思维的结果。对于远古的人来说,多学习一份技能,就多了一些生存的概率。一些缺乏学习动力的个体可能在残酷的自然选择中被淘汰了,而延续下来的都是能够对学习产生正反馈的个体。再比如单细胞生物没有神经系统,但它依然能够“学会”获取食物,只不过它的学习过程依赖于基因的遗传和变异来实现。

如果生物学习的原动力来自自然的选择,那么机器人学习的原动力就是来自创造者(人)的选择。

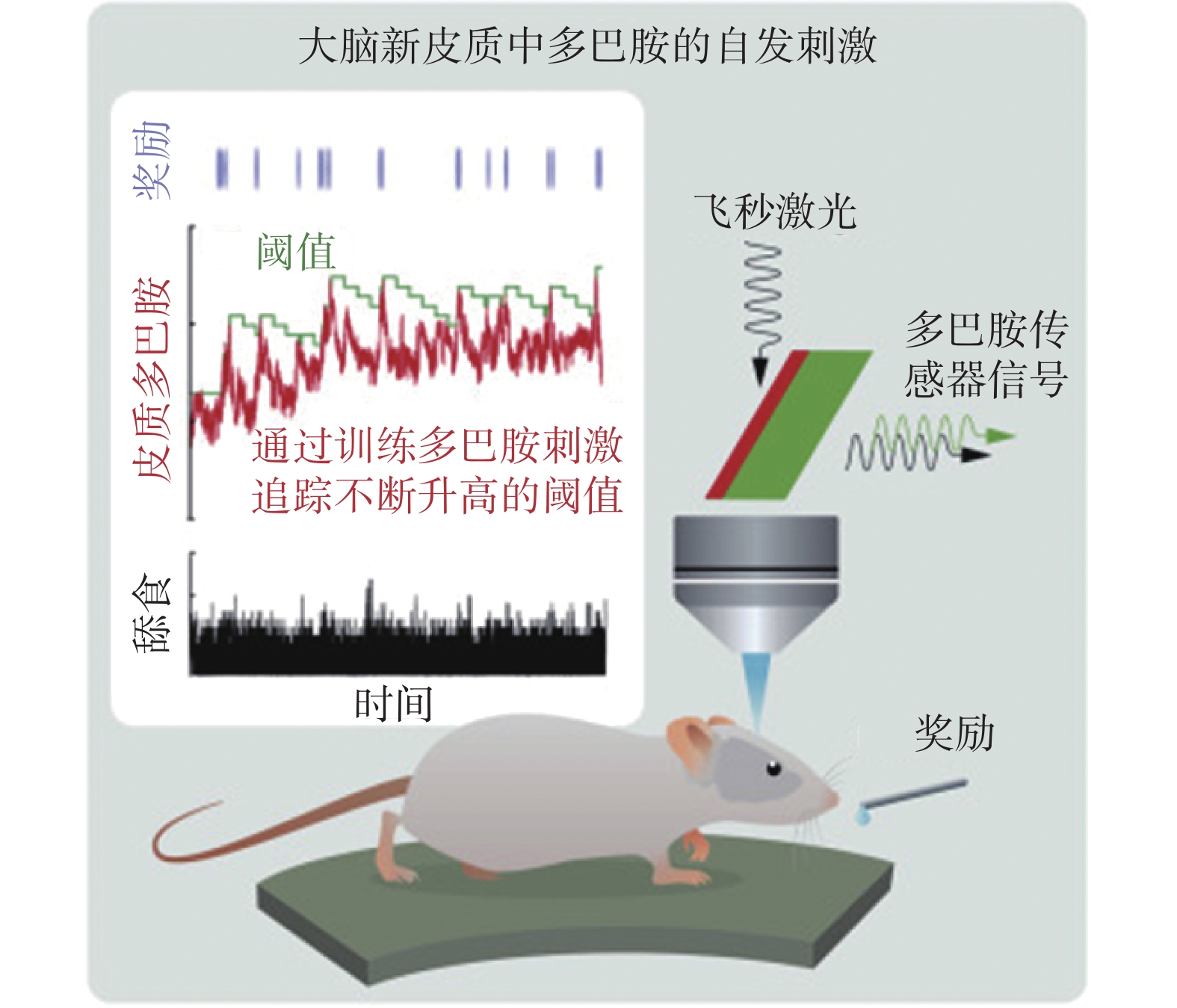

事实上,机器人如何更好地利用外界的反馈来学习一直是强化学习[4]研究的目标。在强化学习中,如果奖惩机制合适,机器人一旦开始学习就会持续不断直到收敛。事实上,生物也可以通过类似的机制学习。例如:通过人为控制小鼠大脑的多巴胺分泌,可以让小鼠学会新的技能,如图2所示[5]。目前强化学习和人类的学习还有巨大的差别,关键问题之一在于如何制定合适的奖惩机制,这或许还有很长的路要走。就像不同的教育体系培养出来的人才,在能力方面也有较大的差别,不同民族对教育的重视程度也不尽相同。如何为机器人制定合适的教育体系(如奖惩机制),让机器人“自觉”地偏好学习,是新一代人工智能需要认真研究的课题。

五问:人的偏好和注意力选择是如何产生的?新一代人工智能如何体现这一点?

李院士认为:人的注意力选择源于记忆,源于记忆的偏好依附性。记忆网络以及记忆的多索引并行机制很重要,注意的选择性法则是:先检索典型情境提取记忆,后选择规则推理计算求解。

人的注意力产生有可能源于资源的受限。比如人眼只能聚焦于前方大概巴掌大的区域,所以眼球需要不断地调整焦点,而蜻蜓的复眼就可以同时关注大片的区域,这是感知器官的不同造成的。虽然大脑的功耗比起滚烫的CPU来说已经低很多,但相较于身体的其他器官依然是绝对的耗能大户。所以才有了注意力之说,一段时间一片专门的脑区激活,专注处理一件事情。而且注意力集中的持续时间也是有限的,一段时间后资源消耗过度就容易精神涣散。一些药物或者酒精也容易让人难以集中注意力。可见,注意力对于大脑来说是一种资源调度的过程,集中最多的资源解决最要紧的事情。什么才是最要紧的事情,这源于大脑的判断。大脑会综合当前的信息和过往的记忆做出最佳的判断。

人的偏好组成就更为复杂。部分源于身体当下的需求,例如饥饿的时候食物会变得更美味,缺乏部分元素是会更加偏爱富含这部分元素的食物。部分源于大脑中的记忆,例如动物的各种警戒色会让有相关经验的捕食者望而却步。还有一部分源于对新刺激的本能反应,例如对新事物的偏好等。

新一代人工智能作为人类的工具是否需要自身的偏好,这个值得商榷。例如:机器学习的一个重要研究方向[6]就是防止因为训练数据而对结果产生不必要的偏好,做到公平公正。但它必须能够理解人的偏好,并更好地提供服务。

新一代人工智能是否需要注意力在于它并行处理多项事物的能力以及分工方式,也就是说,和我们具体实现智能的方式存在直接的关系。例如:神经网络遍及全身的水母,能够对周边的刺激同步地做出反应。越高等的智能,对资源的消耗就越大,各部分的分工也就越细致,需要注意力机制进行调度。例如:人脑就是由不同的分区组成(如图3),每个分区负责不同的功能,在进行相应活动时被激活。

六问:人类思维的载体是自然语言,自然语言开放性很强,通用计算机是基于图灵机模型,属于封闭的有限状态空间,根据哥德尔不完备定理,数学自身难以完全自洽。因此,人工智能怎么可以反过来要用计算机语言或者数学语言去形式化人类的自然语言呢?

李院士认为:机器是否有语言智能,还要看它有没有接受语言和文字的交互、学习和进化能力。新一代人工智能是用人类的自然语言表述的,因此是开放的、不完全的,允许精确性和复杂性相容,允许不同思想兼容并包。

人类的自然语言最基础的功能还是实现不同个体间的交流。例如:动物可以通过声音来求偶或警戒,越是群居的动物交流的方式越复杂。早期人类在面对残酷的自然选择时,依靠的是群体的力量来狩猎或抵御危险。在这一过程中,自然语言的产生具有很大的历史偶然性,是集体创作的结果。

相比较而言,数学语言和计算机语言的创造过程要直接得多,因此也更加简单和自恰。例如:编程语言,就是为了方便人和计算机之间的交互而设计的;网络协议,就是为了方便计算机和计算机之间的交互。因为参与者都有计算机,因此必须是计算机能够准确无误解析和执行的,是具有图灵完备性的精确描述语言。如果没有人参与其中,使用自然语言可能是没有必要的。比如:脱离人类社会由动物抚养长大的“狼孩”,不懂人的语言,但很难说他完全就没有人类的智能。

让计算机去解析和处理人类的自然语言,更多的是由人工智能的工具属性决定的。目前的人工智能都是计算机实现的,而人日常中更多的是使用自然语言。从语法层面上,二者之间自然存在巨大的差别。但这都不是最困难的,最困难的是在语义方面的差别。目前,存在某些自然语言的语义是计算机语言或者数学语言所不能表示和处理的。对这部分语义的研究,能够加深我们对自然语言的理解。

事实上,操不同语言的人之间,也没有办法完全无障碍地交流。我通常将这理解为文化上的差异。文化的确塑造了不同的语言习惯,但语言反过来也会影响文化。例如:印度某地方言中缺少关于昨天的直接表述,是不是就代表这一地方的人更看重当下?不同文化熏陶下的人和人之间尚且有沟通障碍,让计算机理解厚重的人类文化自然任重道远。

在人类之初,由于智力的增长,我们创造并能使用复杂的自然语言。自然语言的使用使得知识能够方便地在个体之间、上一代和下一代之间传递。但这或许只是因为人类受限于先天的感官,才使用了这种并不高效、不精确的方式。如果人和人之间能够用其他方式(如脑电波)交流,结果是不是就会完全不一样?例如:在蚁群中,通过信息素的交流同样能够实现相对复杂的行为。这些问题背后很可能藏着智能的本质,值得我们进一步探究。

七问:如何体现新一代人工智能与时俱进的学习能力?

李院士认为:新一代人工智能也必须具有像人一样的学习和交互认知的环境才能习得知识,而不是传统人工智能那样一次性设计而成,也不是带着特殊预设目的,向机器强制地集中性注入一个或者多个专门领域的计算智能。

这其实涉及到了人工智能一个最基础的问题:智能是否能够被记录、存储和传递。自然界中声音可以、图像也可以,甚至生物个体通过遗传物质DNA也可以被克隆。两个克隆人之间最初拥有共同的生物基础,也会因为后天的经历不同表现出不同的智能。假设给我们一个爱因斯坦的大脑,而我们的生物技术已经发达到能够复刻一个完全一样的大脑,那么这个大脑是否和爱因斯坦一样聪明?理论上,同一个软件在不同计算机上的拷贝应该有完全一样的表现。但复杂如大脑,这或许是一个不可能的任务,或许像很多量子现象一样我们进行记录的那一刻大脑已经发生了变化,已经不是原来的大脑了。所以获得类人智能的唯一途径,可能就是需要不断地从外界进行刺激,即学习的过程。

如果学习是获得类人智能的必要途径,那首先需要有一个像大脑一样可学习的装置,然后就是学习的过程。当前,深度神经网络充当这个可学习的装置,而各种学习算法和数据充当的就是这一学习的过程。当然深度神经网络目前远没有大脑那般的可塑性,当前的学习算法和数据与我们的家-校-社会三位一体的教育体系也完全不在一个数量级。

对于学习装置,我们目前没办法复刻一个生物学上的大脑,因此尝试用计算机或电子电路去模拟人的大脑。对于学习过程,新一代人工智能就需要考虑为机器人借用我们现有的教育体系,还是为其再造一个教育体系。就比如AlphaGo,最初的版本还从一定程度上利用到了人类的棋谱[2],而AlphaGo Zero[7]就能够完全独立于人类的围棋教育体系。即便是重用我们现有的教育体系,那也是完全不一样的方法,毕竟让机器人像人一样慢慢地学习成本太高。需要用到强大的学习装置,让十几年的教育能够缩短在几天内完成。

八问:在新一代人工智能架构的机器人中,基本组成最少可能有哪几种?各部分中的信息产生机制与存在形式是什么?它们之间的信息传递是什么样的?

李院士认为:新一代人工智能机器中,由记忆、交互和计算3部件组成,其中的感知、认知与行为都是双向互动的。记忆、交互和计算3部分之间的信息传递机制和螺旋发展比较复杂,但三位一体很重要。

同冯诺依曼的计算机体系作类比,记忆可以看作存储,交互是键盘、鼠标、屏幕等这些输入输出外设,而计算则是CPU。记忆系统里有瞬时记忆、工作记忆和长期记忆3类子部件,存储系统中的寄存器、内存和硬盘分别负责瞬时、工作和长期的存储。计算机的记忆与人的记忆最大的区别其实在于信息的表示方式。计算机采用的是二进制进行存储和运算的,所有的信息都需要以一定的方式编码成二进制。而记忆在人脑中是以神经元突触的连接形式来实现的。

人工神经网络从某种意义上可以看作是在二进制的计算机系统中模拟神经元的记忆机制。从计算效率上看,这是低效的。所以有了关于“类脑”芯片的研究,希望能够提高模拟的效率。这些“类脑”芯片虽然在连接上模拟神经元,但是在传递机制上依然是二进制的。这使得它们始终无法做到与大脑一样的高效和低功耗。量子计算机[8]中的量子比特则是在信息的表示和传递的彻底革新。或许这些技术的进步能够给类脑智能带来新的途径,并从根本上改变现有的人工智能架构。

九问:记忆、计算和存储的区别是什么?能不能说,记忆智能和计算智能都不可或缺?利用自己记忆中的经验解决当前的一个智力问题也好,利用知识去分析推理解决也好,如何建立整体的工作机制?

李院士认为:记忆是新一代人工智能的核心,记忆比计算重要得多,记忆是对计算的监督和约束,认知网络具有多索引并行机制,可通过检索引擎直接提取记忆,因为有注意力选择机理,它要比临场的思维、推理、计算快得多。记忆早于计算,记忆优于计算,记忆约束计算,记忆随学习与时俱进。

从某种程度上说,记忆是知识的表示形式。获得记忆就是从信息中提取知识,使用记忆就是根据知识做出决策,这些在计算机上实现的时候都需要计算。因此不应该把记忆和计算分开对待,二者在智能行为中都是不可或缺的。例如:人工神经网络中,记忆表现为神经网络的参数,训练神经网络的过程就是获取记忆的过程,使用神经网络的过程就是使用记忆的过程。只是目前神经网络的后向传播的训练方式与人们获得记忆的过程还相去甚远,效率极低且需要大量的训练样例。使用神经网络的过程也称为推理的过程,其速度也比训练过程快得多。文献[9]表明,当前的神经网络其实也具有一定的推理能力。

相较于基于逻辑和搜索的推理而言,基于神经网络的推理要快得多。但我们不认为神经网络的搜索能够像传统的搜索一样充分地使用知识。这或许是人工神经网络对样本的使用率过低且泛化性不足所致。例如:AlphaGo中就将蒙特卡洛树搜索和深度神经网络相结合[2]。前者负责临场的推理,后者负责记忆。这主要因为蒙特卡洛树搜索算法在计算机中能够高校地实现。如果能够在人工神经网络的层面实现通用的推理算法,那么是否就能够实现记忆和推理的统一?从而实现部分网络负责推理,部分网络负责记忆。

十问:新一代人工智能机器人,存不存在停机问题?如何理解机器人在发育成长过程中软硬件的维修管理和扩充升级?

李院士认为:硬件的故障自修复和停机问题,本质是高阶逻辑的不自洽性和不完备性,在这里是不存在的,只能是特定人赋予机器意向性,检测或者授权停机,特定人是机器人的高阶,并在机器人发育成长过程中扩充升级机器人的软件及其物理载体。

停机问题主要涉及的是人工智能哲学的范畴。当机器人真正获得了智能之后,故障的自维护、软硬件的升级、停机乃至自我复制,这些似乎都是不可避免的。而人的授权或者将特定人作为机器人的高阶似乎也不足以改变。正如电影《侏罗纪公园》里所说“生命总会找到它们的出路”。拥有真正智能的机器人同样总可以巧妙地规避人的授权。例如:铁线虫为了能在水里产卵,在螳螂腹部发育后会控制其自动跳入水中;再比如钩形虫要在猫的肠道中发育,被其感染的老鼠则会失去对猫的天生恐惧。智能机器人同样可以以某种方式反过来控制能够授权的人,实现它的目标,这从理论上看都是可行的。

那这是否意味着智能机器人最终会像很多人预测的一样失控,最后智能更高的机器人占据主动地位,甚至导致人类的灭绝?我们大可不必有这样的担心。就像人类社会中,精英群体并不会把弱势群体赶尽杀绝,甚至会施以援手。这里面起关键作用的是文明社会的伦理道德规范。当然我们不希望作为工具的人工智能会反过来高高在上,针对机器人的伦理将和人与人之间的伦理大不相同。

因此,人工智能的伦理也应该是新一代人工智能的一项重要研究内容。

李院士的“十问十答”涉及了多个新一代人工智能的技术内核,在学界引发了热烈的讨论。通过对这些问题的思考,笔者认为对于人类智能本质的探索不能仅仅停留在技术层面的模仿;更要从宏观、科学的视角研究它的起源和发展过程,从意识、偏好、记忆等碎片化内容一步步地拼凑出智能的全貌。大脑虽然是智能产生的物质基础,但真正的智能则是从后天的学习以及与环境的交互过程中激发出来的。因此,类脑装置的研究和学习过程的研究不宜脱节。相对于模拟大脑的运作,通过模仿人的学习和教育过程来搭建适宜的装置或许也是一条可行的途径。此外,从以人为本、服务于人的角度,人的情感、文化、伦理等都应该是新一代人工智能需要进一步探索和研究的主题。

-

[1] 李德毅. 新一代人工智能十问十答[J]. 智能系统学报, 2021(5): 827–833. LI Deyi. Ten questions and answers for the new generation of artificial intelligences[J]. CAAI transactions on intelligent systems, 2021(5): 827–833. [2] SILVER D, HUANG A, MADDISON C J, et al. Mastering the game of go with deep neural networks and tree search[J]. Nature, 2016, 529(7587): 484–489. doi: 10.1038/nature16961 [3] TURING A M. On computable numbers, with an application to the entscheidungsproblem[J]. Proceedings of the London mathematical society, 1937(1): 230–265. [4] SUTTON R S, BARTO A G. Reinforcement learning: an introduction[M]. 2nd ed. New York : John Wiley and Sons, 1998. [5] FOO C, LOZADA A, ALJADEFF J, et al. Reinforcement learning links spontaneous cortical dopamine impulses to reward[J]. Current biology:CB, 2021, 31(18): 4111–4119. doi: 10.1016/j.cub.2021.06.069 [6] MEHRABI N, MORSTATTER F, SAXENA N, et al. A survey on bias and fairness in machine learning[J]. ACM computing surveys, 2022, 54(6): 115. [7] SILVER D, SCHRITTWIESER J, SIMONYAN K, et al. Mastering the game of Go without human knowledge[J]. Nature, 2017, 550(7676): 354–359. doi: 10.1038/nature24270 [8] MERMIN N D. Quantum computer science: an introduction[M]. Cambridge: Cambridge University Press, 2007. [9] JAEGER H. Deep neural reasoning[J]. Nature, 2016, 538(7626): 467–468. doi: 10.1038/nature19477

下载:

下载: