Design of an intelligent identification and sorting system used for classification of multiobjective medical waste

-

摘要: 医疗垃圾中存在大量的病毒和细菌,为解决医疗垃圾源头智能分类问题,开发了基于机器视觉和Delta机构的智能分拣平台样机,并提出一种三阶段的多目标医疗垃圾识别分拣(medical waste recognition- indexes-sorting,MWRIS)算法。第1阶段提出数据增强扩容的IE-YOLOv4算法建立起医疗垃圾识别模型,与Faster R-CNN、RetinaNet、CenterNet等5种模型比较;第2阶段索引分类模型用于管理分类规则;第3阶段定位分拣算法指导目标定位分拣。在集成了MWRIS算法的分拣样机上,采集14种,2 217张医疗样本图像,完成医疗垃圾分拣实验。结果表明,使用IE-YOLOv4的MWRIS算法对医疗垃圾识别准确率显著提升至99.30%,分拣实验对目标定位准确率达到96.17%,最终分类正确率为86.67%,验证了多目标医疗垃圾识别分拣系统的有效性。Abstract: Medical waste contains lots of viruses and bacteria. To intelligently sort medical waste from the source, an intelligent sorting platform based on machine vision and the Delta mechanism was developed, and a three-stage multiobjective recognition-indexes-sorting (MWRIS) algorithm was proposed. In the first stage, the IE-YOLOv4 algorithm of data enhancement and expansion was proposed to establish a medical waste identification model, which was compared with five models, including Faster R-CNN, RetinaNet, and CenterNet. In the second stage, the index classification model was used to manage the classification rules. In the third stage, the positioning sorting algorithm was used to guide target positioning and grabbing. For the sorting prototype integrated with the MWRIS algorithm, 2217 medical sample images of 14 kinds were collected, and the medical waste sorting experiment was completed. The results showed that the MWRIS algorithm using IE-YOLOv4 can significantly improve the accuracy of medical waste identification to 99.30%, the accuracy rate of target positioning in the sorting experiment reaches 96.17%, and the final classification accuracy reaches 86.67%, verifying the effectiveness of the proposed medical waste identification and sorting system.

-

我国医疗卫生事业的进步与发展,带来了医疗防护系统提升,随着大量一次性医疗用品投入使用,医疗垃圾数量快速增长[1]。在疾病防控、治疗、康复等各个环节产生的医疗垃圾是一种危害性大且影响广泛的特殊废弃物。医疗垃圾中存在的病毒和细菌,如处理不当,不仅会污染环境,还将成为疾病传播的源头[2]。尤其在发展中国家及全球欠发达地区,目前医疗垃圾分类普遍不规范[3],分类、打包及运输都由人工完成,人员分拣接触过程中存在极大的感染传播风险[4]。医疗废弃物尖锐且极具感染性,又增加了后期垃圾处理难度,也加大了疾病的二次传播机率。在此背景下,亟待一种更加智能、高效的医疗垃圾分类处理办法,以有效解决全球医疗垃圾处理难题,阻断疾病二次传播。

为解决医疗垃圾源头智能化分类问题,本文进行了多目标医疗垃圾智能识别分拣系统设计,主要贡献在以下4个方面:1)提出一种三阶段的多目标医疗垃圾识别分拣算法(medical waste recognition-indexes-sorting,MWRIS),搭建了基于机器视觉和Delta机械臂的分拣平台,实现了完整的医疗垃圾智能识别分拣系统设计。2)建立基于IE-YOLOv4的医疗垃圾识别模型(medical waste recognition,MWR),针对性地提出图像数据增强(image enhancement,EI)扩容算法,使医疗垃圾针头、安瓿瓶等的漏检率降低,被遮挡目标识别能力提升,数据集翻倍,将医疗垃圾识别准确率提升至99.30%;3)提出医疗垃圾索引分类模型(medical waste indexes,MWI), 针对后期处理方式变更,由语义网络调节前期分类规则,使模型具备可调节性;4)提出含“7字型”避障、抓取顺序及路径规划在内的定位分拣算法(medical waste sorting,MWS),分拣平台上完成了多目标医疗垃圾的分拣实验,目标定位准确率为96.17%,分类正确率为86.67%。

1. 相关工作

1.1 医疗废弃物处理研究现状

目前针对医疗垃圾的研究多集中于后期无公害处理方式研究,提出了高压灭菌、热解等一系列环境友好型医疗垃圾后期处理方式。Dharmaraj等[5]提出热解降解医疗垃圾生成生物炭和生物油资源的有效技术;Purnomo等[6]提出了医疗废物热化学转化技术,降低塑料垃圾对环境的破坏;Nema等[7] 提出医疗废物的等离子体热解技术,低碳高效处理医疗垃圾。但以上后期处理需依赖医疗垃圾源头分类的准确性,这推动了医疗垃圾智能分类的研究,Kumar等[8]提出了使用人工神经网络、支持向量机和k-最近邻作为分类器来识别医疗垃圾和生活垃圾图片的图像分类算法,但研究中每张图片只存在一种类型的垃圾,最终仅论述了图片分类准确率为96.5%,未提出具体的垃圾分类处理方法。

1.2 基于图像分类的垃圾分类研究现状

现有的垃圾源头智能分类多使用图像分类算法,MobileNet v2、VGG16、GoogleNet、ResNet50、ResNet101等,配合传送带等投递装置使用。如Oscar与BIN-E[9]智能垃圾桶使用图像分类识别,通过传送带投递单个垃圾实现二分类。TrashBot[10]智能垃圾箱,图像分类后由左右摇摆的分拣箱投递。2019FPGA大赛智慧资源回收桶,实现垃圾四分类,但拍摄倾角不利于小目标识别。张凇[11]的智能垃圾箱利用VGG16图像分类与轨道投递实现,结构具有可扩展性,但运输耗时较长。在本团队前期的工作中也提出生活垃圾智能垃圾桶[12] ,但以上基于图像分类算法的智能垃圾箱,存在共同问题为单次仅能识别并分类一个垃圾,无法满足一次多个垃圾连续投递分拣的实际要求。

1.3 基于目标检测的垃圾分拣研究现状

目标检测多用于垃圾后期分拣设备,以R-CNN、Faster R-CNN为代表的Two-stage算法精度高速度慢;以YOLO、RetinaNet为代表的One-stage,速度精度均衡[13]。芬兰Zen Robotics公司的固体垃圾分拣设备Recycler识别准确率为90%,由单臂机器人实现分拣;广东弓叶公司提出的大型垃圾分选设备PiCKING∙AiTM [14],识别准确率为95%,由Delta机器人完成分拣。马雯等[15]提出基于Faster R⁃CNN 的垃圾检测加入Soft-NMS 算法,识别准确率仅为81.77%,未提出垃圾分拣方案。王文胜等[16]使用YOLOv5算法和Mosaic增强搭建的垃圾分类箱,识别准确率为93%,虽然使用目标检测算法,但仍采用翻斗机构分类,每张图中仅有一个垃圾,无法实现多目标垃圾分拣,相比图像分类垃圾箱无突破进展。因此,多目标医疗垃圾的智能分拣,需要目标检测算法配合定位分拣机构实现。

1.4 数据增强扩容算法

图像数据增强是通过对图片进行亮度、颜色、gama、仿射变换、噪点、模糊、翻转等图像变化,突出图像的特征,弱化模型对环境角度的依赖[17],提高模型泛化能力的手段。针对不同的数据集中的难识别目标,合理使用不同的图像数据增强手段,如Mixup、Cutout、Random Erasing、CutMix、Mosaic等,配合上述图像变化、数据集扩容等算法使用,可进一步提升对于特定目标的识别准确率。

2. 平台设计

2.1 结构设计

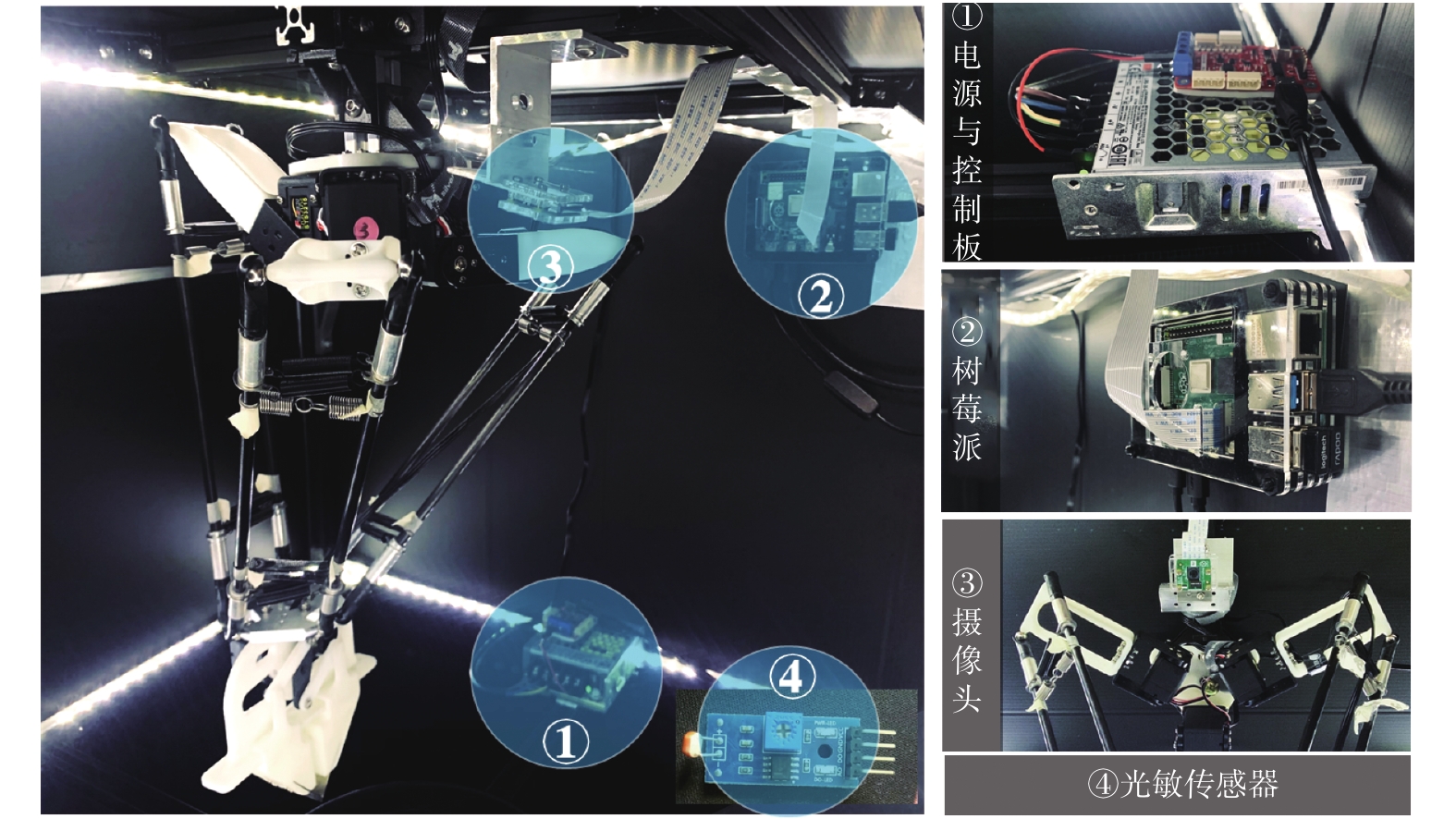

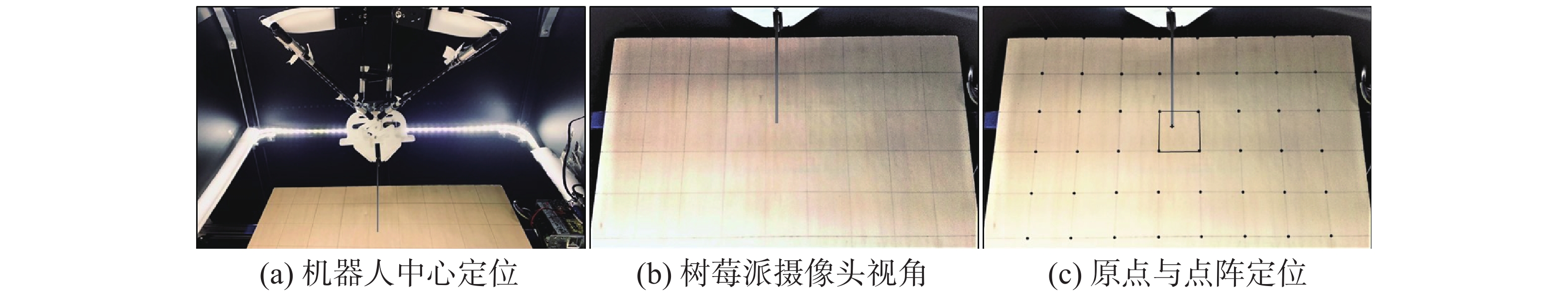

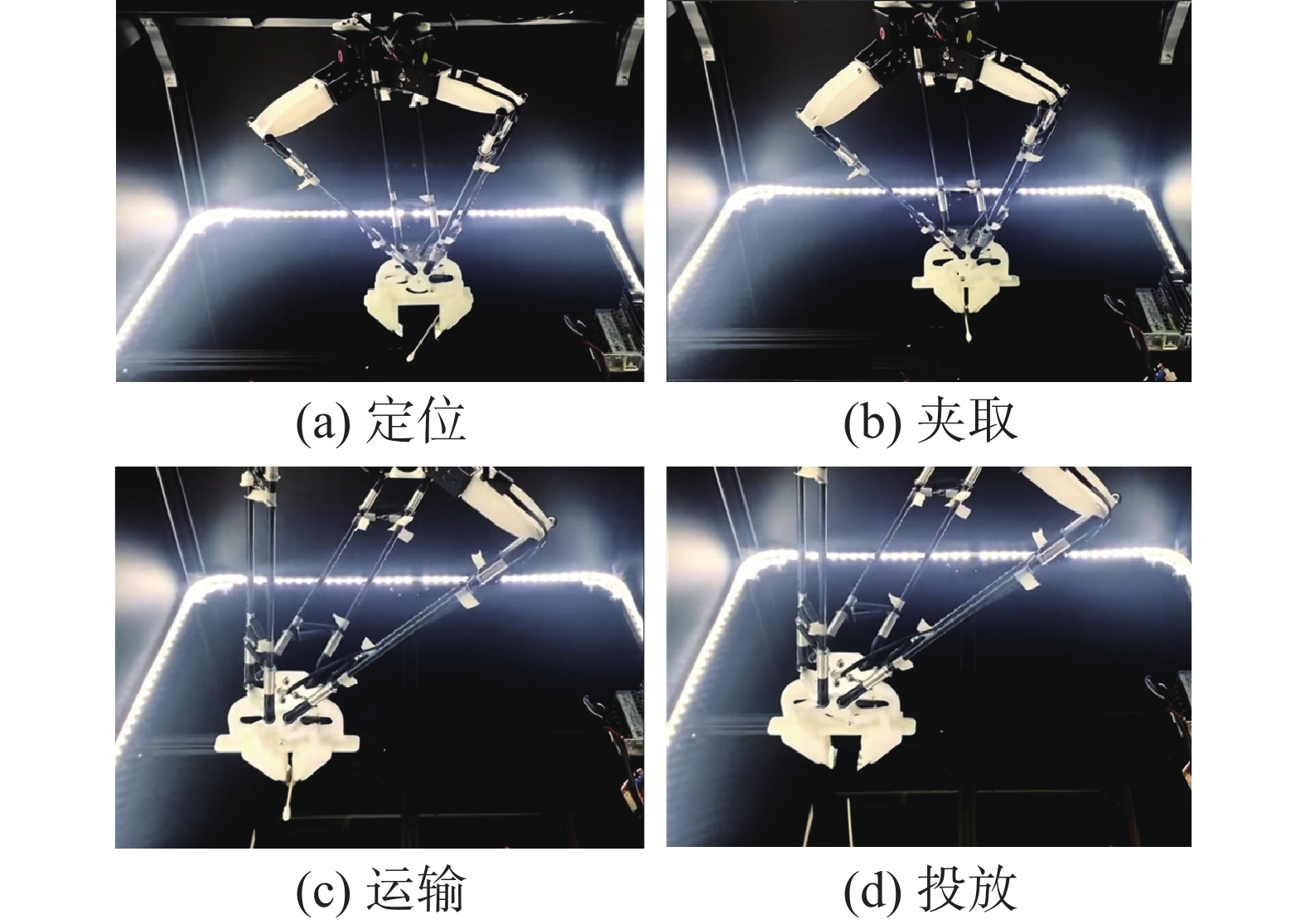

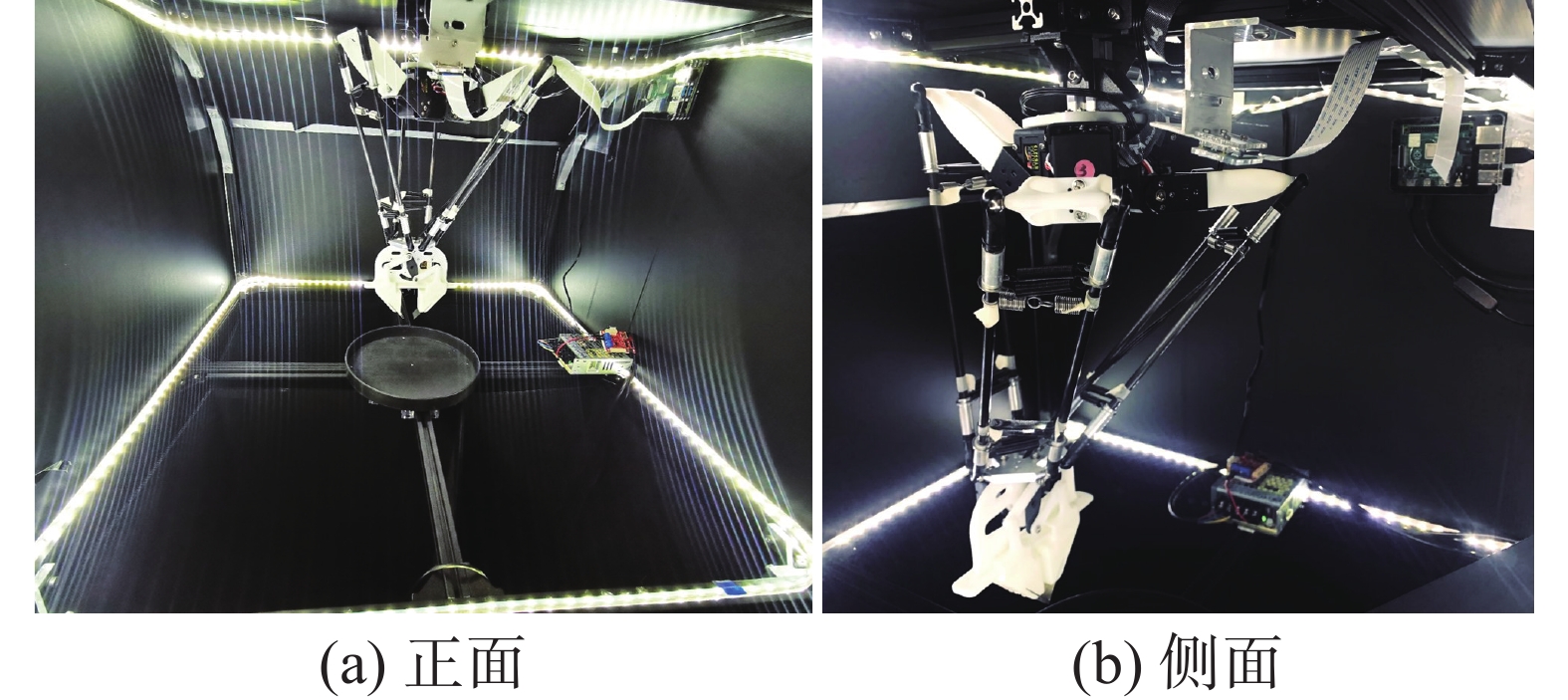

为验证本文医疗垃圾识别分拣算法(MWRIS)的可靠性,搭建了医疗垃圾分拣平台样机[18],主要由机器视觉模块、分拣机构、垃圾收集储存模块及控制供电系统4部分组成,分拣平台如图1所示。从投递口投掷的医疗垃圾将由滑道滑向中心识别盘,在机器视觉模块采集图像完成识别后,分拣机构将按照目标的类别和位置将垃圾依次分拣到4个箱体。

2.2 机器视觉模块

机器视觉模块采用第4代树莓派(Raspberry 4 Pi model B)作为控制终端,控制树莓派摄像头拍照,完成图片处理及目标识别工作,机器视觉模块的构成如图2所示。在垃圾投掷口设置光敏传感器给拍照动作设定触发机制,投掷门打开时禁止拍照,关门光线变暗时,控制摄像头执行拍照程序;为避免机构误触目标位置改变,在单次分拣完成后即向树莓派发出二次拍照指令,确定新目标坐标点。

2.3 分拣机构

现有垃圾分类设备无法分拣多个垃圾,Delta机器人作为经典并联机器人,每分钟多达300次动作定位精准,适宜作分拣机构[19]。平台作为第一代的开发原型机,考虑产品空间限制,Delta机器人采用球型关节,经运动仿真主动臂长设为10.5 cm,从动臂长为25 cm,3D打印获得基座、主动臂等零件,与FEETECH双轴STS3215舵机装配。

考虑医疗垃圾中针管、针头、棉签的细长形态,设计具有弹性金属片的铲形夹爪,解决了细长圆柱的抓取滑脱问题,采用冗余设计[20],解决垂直高度的定位精度问题。铲面碰到分拣盘时,产生弹性形变后将目标夹起,最后Delta机械臂与改良平动夹爪的抓取机构设计如图3所示。

3. 算法设计

3.1 MWRIS模型框架

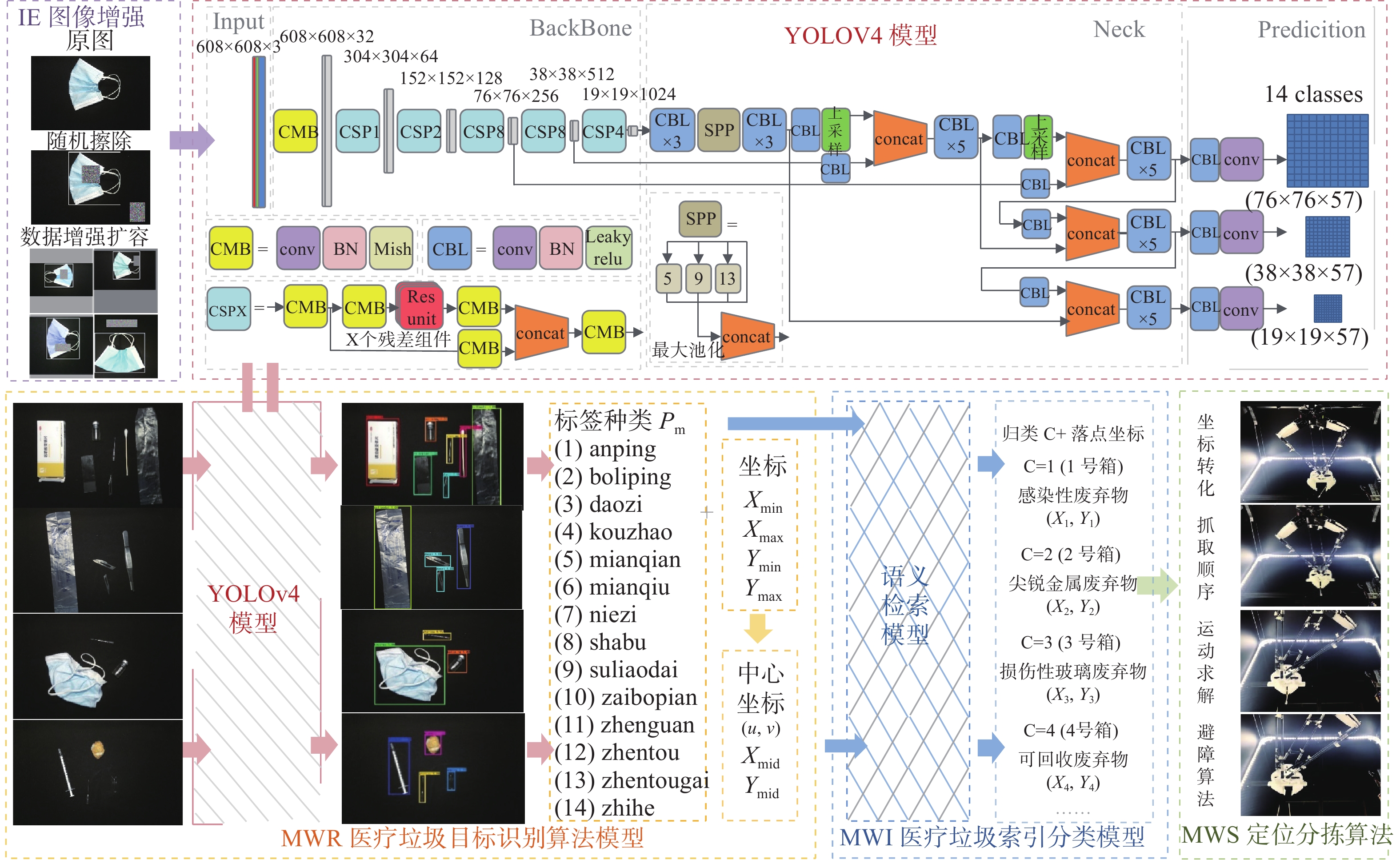

本文提出一种三阶段的多目标医疗垃圾识别分拣算法(MWRIS),框架如图4所示。第1阶段,针对医疗垃圾设计目标检测算法实验,经对比选用YOLOv4[21]算法,加入图像数据增强扩容算法,构建医疗垃圾识别算法模型(MWR),完成医疗垃圾的目标检测,通过非极大值抑制算法,输出医疗目标最大概率种类Pm和图像选框坐标点。第2阶段,设计医疗垃圾索引分类模型(MWI),确定Pm和分类C一一对应的语义网络,MWI模型作为MWR模型和定位分拣模型(MWS)间的信息接口,将MWR模型提供的种类Pm、选框坐标对应输出分类C、落点坐标信息。第3阶段,在MWS算法模型下实现医疗垃圾选框中心点坐标到物理坐标的转化,进行Delta机器人逆运动学求解并规划抓取路径,指导分拣机构抓取目标并投入对应箱体。

3.2 IE图像数据增强扩容算法

针对医疗垃圾针头、安瓿瓶等细小透明物及垃圾丢弃过程目标遮挡重叠的难识别问题,提出IE图像数据增强扩容算法,引入Random Erasing随机擦除[22],产生局部遮挡,提高模型泛化能力。加入扩容算法,生成多张局部遮挡图片,结合随机缩放Random scaling、随机翻转Random flipping、色域扭曲等达到很好的增强效果,并将训练集扩大4倍。

3.3 基于YOLOv4的MWR识别模型

针对医疗垃圾设计目标检测算法对比实验,选择YOLOv4算法优化,搭建基于IE-YOLOv4的MWR医疗垃圾识别模型,框架中需要注意3点:

1)尺寸1280像素×800像素的原图输入IE数据增强扩容算法,增强扩容后,输出4张608像素×608像素的不同增强遮挡效果图片,将训练集扩大了4倍。

2)608×608×3图片输入YOLOv4的 CSPDarkNet53网络,经卷积处理和 5 次残差下采样输出19×19×1024特征层,进入空间金字塔池化(SPP),加入FPN(feature pyramid network)特征融合[23]算法,提取不同路径的重要特征,经两个上采样与主干特征层进行特征融合,最终输出76×76 、38×38、19×19 3种尺度检测单元。

3)进入 Head 部分,利用提取特征对结果进行预测,生成多个锚框类别和边界框,利用IOU非极大值抑制,筛除无效预测框。加入余弦退火衰减Cosine annealing,使损失(Loss)值“跳出”局部最小值通向全局最小值,原理为

$$ {n}_{t}={n}_{\mathrm{m}\mathrm{i}\mathrm{n}}^{i}+\frac{1}{2}\left({n}_{\mathrm{m}\mathrm{a}\mathrm{x}}^{i}-{n}_{\mathrm{m}\mathrm{i}\mathrm{n}}^{i}\right)\left(1+\mathrm{cos}\left(\frac{{T}_{\mathrm{c}\mathrm{u}\mathrm{r}}}{{T}_{i}}{\text{π}}\right)\right) $$ (1) 式中: n max 和n min分别表示最大和最小学习率,T cur表示第几个epoch,Ti表示当前的总epoch数。

最终IE-YOLOv4-MWR模型使用1 596×4张训练集,177张验证集训练完成后,将医疗垃圾识别分类为14个子类,输出选框坐标及中心点坐标。

3.4 MWI医疗垃圾索引模型

提出医疗垃圾索引分类模型MWI,使用给定的4个类别C = {1, 2, 3, 4},对MWR识别模型输出的标签种类Pm进行建模,通过语义检索确定Pm和C一一对应的语义网络[24],索引分类模型MWI(C∣Pm)为

$$ {M}_{\mathrm{W}\mathrm{I}}\left(C∣{P}_{m}\right)=\frac{1}{S}{\prod }_{m\in M}{\psi }_{m}(C\mid {P}_{m}) $$ (2) $$ S=\sum {\prod }_{m\in M}{\psi }_{m}(C\mid {P}_{m}) $$ (3) 其中,总类别M =1,2,…,14,分区函数S用于规范化

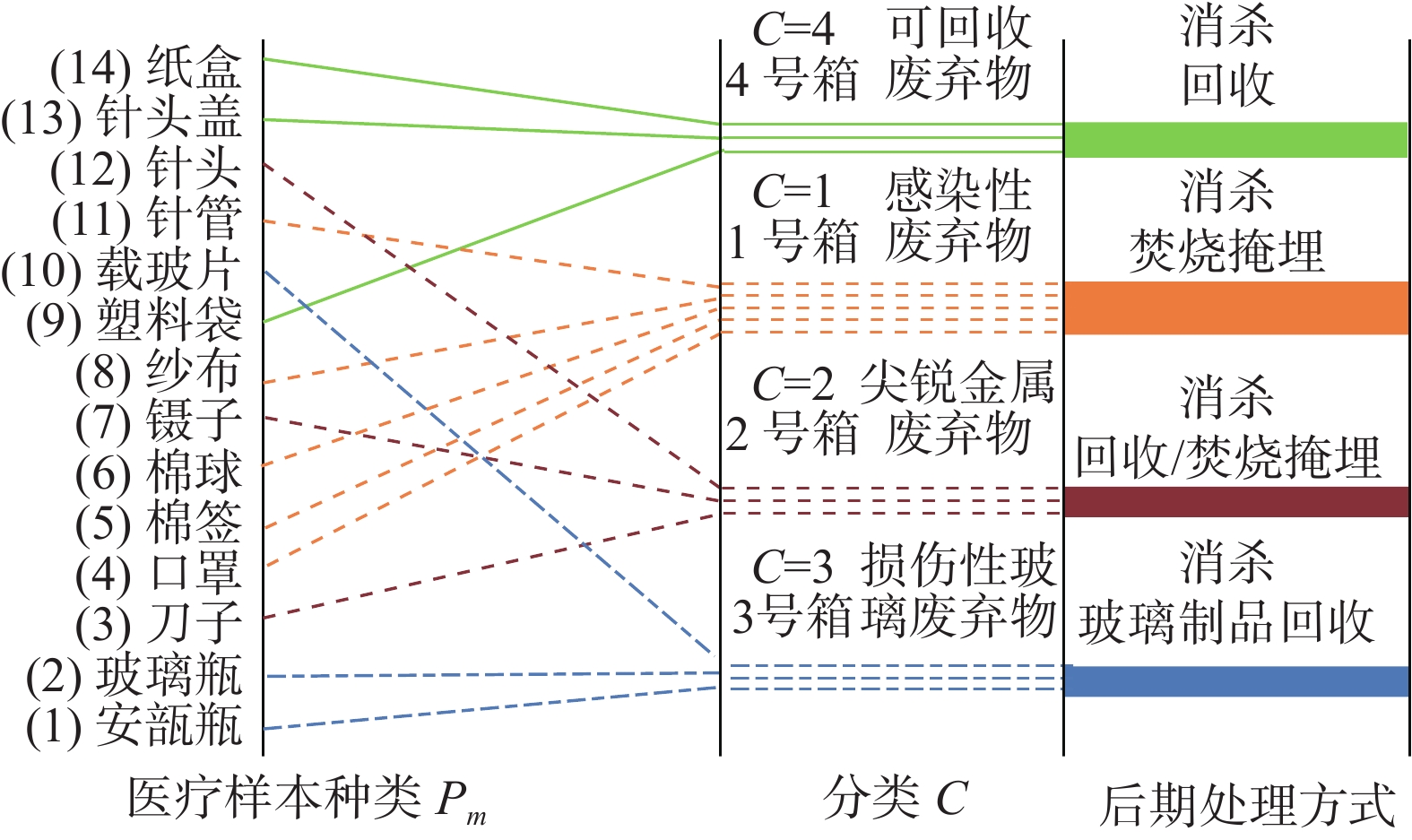

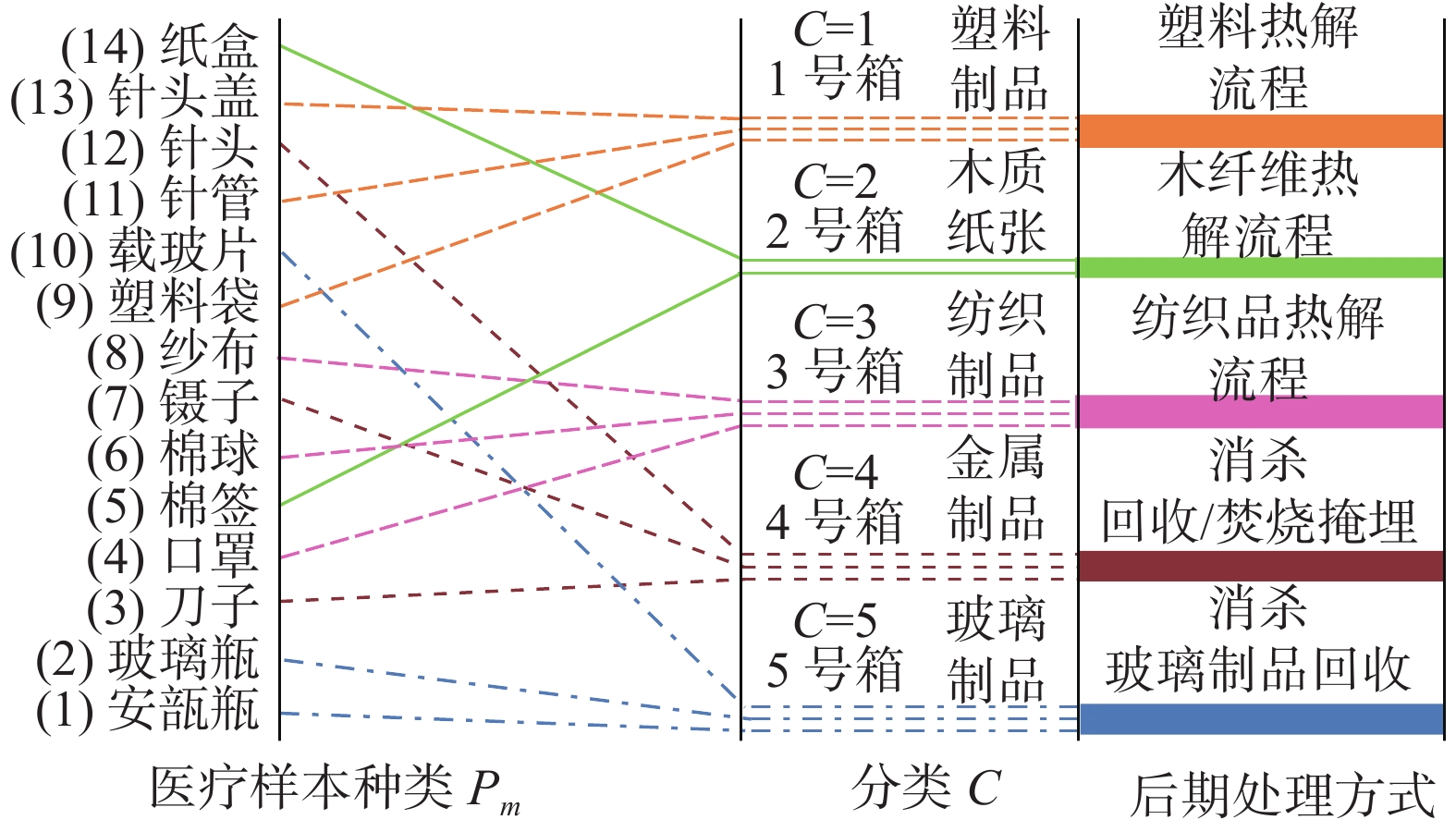

$ {\prod }_{m\in M}{\psi }_{m}(C\mid {P}_{m}) $ ,$ {\psi }_{m}(C\mid {P}_{m} $ )表示具有最大子类别和对应大类别的变量集。在焚烧掩埋后期处理方式下,医疗垃圾识别索引分类方案C=1∣Pm={4,5,6,8,11},C=2∣Pm= {3,7,12},C =3∣Pm= {1,2,10},C =4∣Pm= {9,13,14},可视化归类方法如图5所示。在热解技术后期处理方式下,C =1∣Pm= {9,11,13},C =2∣Pm= {5,14},C =3∣Pm= {4,6,8},C=4∣Pm= {3,7,12},C=5∣Pm={1,2,10},可视化归类方法如图6所示。

本团队提出将识别和归类分开的二阶段识别分类方法,相比一步分类准确率大幅提升且方便调整[14],在后期分类处理方式改变时,只需调整MWI中类Pm和分类C之间的语义网络即可实现转化。

3.5 MWS医疗垃圾定位分拣模型

由于机械臂位于托盘正上方,摄像头拍摄存在倾角,医疗垃圾定位分拣算法MWS被提出,用于坐标转化,完成Delta机器人逆运动学求解,并指导抓取顺序和路径。采用先目标检测,再影射变换的方法节约计算资源[12],坐标变换原理与矩阵如下:

$$ \left[{{x}'}\;\;\;{y}{'}\;\;\;{w}{'}\right]=\left[{u}\;\;\;{v}\;\;\;{w}\right]\left[\begin{array}{c}{a}_{11}\;\;\;{a}_{12}\;\;\;{a}_{13}\\ {a}_{21}\;\;\;{a}_{22}\;\;\;{a}_{23}\\ {a}_{31}\;\;\;{a}_{32}\;\;\;{a}_{33}\end{array}\right] $$ (4) $$ x=\frac{{x}'}{{w}'}=\frac{{a}_{11}\times u+{a}_{21}\times v+{a}_{31}\times 1}{{a}_{13}\times u+{a}_{23}\times v+1\times 1} $$ (5) $$ y=\frac{{y}'}{{w}'}=\frac{{a}_{12}\times u+{a}_{22}\times v+{a}_{32}\times 1}{{a}_{13}\times u+{a}_{23}\times v+1\times 1} $$ (6) 式中:u、v为图片坐标,x、y为真实坐标,w = 1,a33 = 1。标定拍摄如图7,两点间距50 mm,采集8组每组4点坐标数据导入方程,得到均值矩阵为

$$ \left[\begin{array}{c}{a}_{11}\;\;\;{a}_{12}\;\;\;{a}_{13}\\ {a}_{21}\;\;\;{a}_{22}\;\;\;{a}_{23}\\ {a}_{31}\;\;\;{a}_{32}\;\;\;{a}_{33}\end{array}\right]=\left[\begin{array}{r}0.116\;4 \;\;\; -0.000\;8 \;\;\; 0.000\;0\\ -0.000\;2 \;\;\; -0.118\;7 \;\;\; 0.000\;1\\ -261.808\;2 \;\;\; 165.683\;5 \;\;\; 1.000\;0\end{array}\right] $$ 因此,MWR识别目标后,预测框中心点(u, v),经MWS转为实际抓取点坐标(x, y),转化公式为

$$ x=(0.016\;4u-0.000\;2v-261.808\;2)/(0.000\;1v+1) $$ (7) $$ y=(-0.000\;8u-0.118\;7\mathrm{v}–165.683\;5)/(0.000\;1v+1) $$ (8) 抓取顺序依照目标面积Sm从大到小顺序抓取:

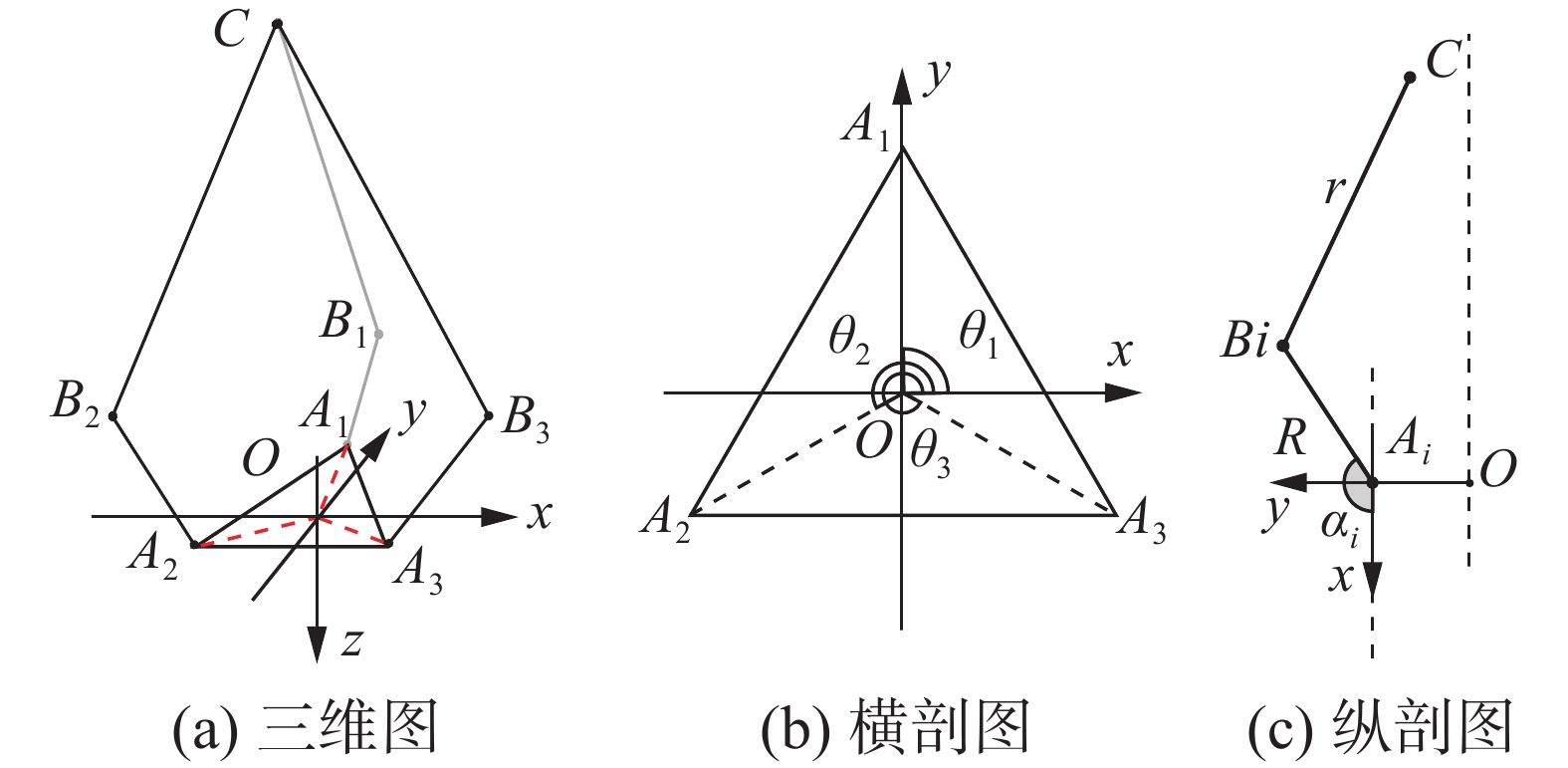

$$ {S}_{m}=({x}_{\mathrm{m}\mathrm{a}\mathrm{x}}-{x}_{\mathrm{m}\mathrm{i}\mathrm{n}})\times ({y}_{\mathrm{m}\mathrm{a}\mathrm{x}}-{y}_{\mathrm{m}\mathrm{i}\mathrm{n}}) $$ (9) MWS算法指导Delta机构运动,涉及主动臂转角逆运动学求解问题,在基座建立坐标系O-XYZ,如图8所示,静平台中心为O,动平台中心为C( x,y,z )。OAi = L,主动臂长AiBi=R,从动臂长BiC=r。

$ {\alpha }_{i} $ 为主动臂与基座夹角,Bi为主动臂末端点。$$ \theta _{i } = ( 2i/3 - 1/6 ) π\text{,}(i = 1\text{,}2\text{,}3) $$ (10) $$ A_{i }=_{ }( L \cos \theta_{i} , L \sin \theta_{i} , 0 ) $$ (11) $$ B_{i}=( \cos \theta_{i} (L+R \sin {\alpha }_{i} ) ,\sin \theta_{i }(L+R \sin {\alpha }_{i} ) ,R \cos {\alpha }_{i} ) $$ (12) 则由r2 = [x − cos θi (L+R sin

$ {\alpha }_{i} $ )] 2 + [y − sin θi·(L+R sin$ {\alpha }_{i} $ )] 2 + ( z – R cos$ {\alpha }_{i} $ ) 2推导机械臂夹角:$$ \mathrm{t}\mathrm{a}\mathrm{n}({\alpha }_{i}/2)=\frac{-{B}_{i}\pm \sqrt{{B}_{i}^{2}-4{A}_{i}{C}_{i}}}{2{A}_{i}} \;\;(i =1,2,3) $$ (13) 目标抓取点坐标确认后,Ai , Bi , Ci 均为已知量,选择小角度

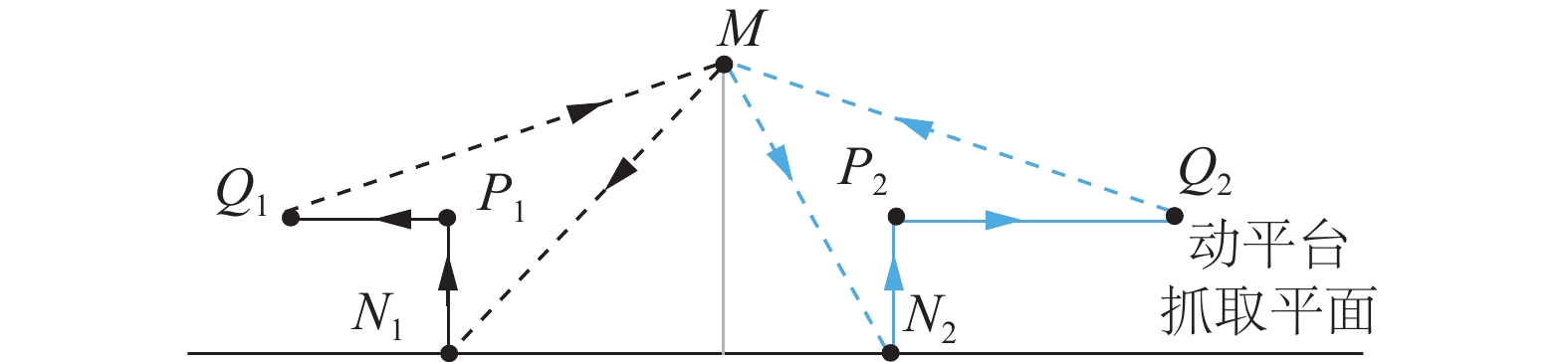

$ \alpha $ 计算电机步数。此外设计“7字型”避障路径如图9,N是抓取点,Q是抛弃点,P是避障点,避障高度45 mm。两点间路径规划分n步走完,分步坐标求取公式为$$\begin{gathered} x = x_{1}+ ( x_{2}-x_{1} ) i/n,y = y_{1}+ ( y_{2} - y_{1}) i/n, \\ {\textit{z}} = {\textit{z}}_{1}+ ( {\textit{z}}_{2 } - {\textit{z}}_{1}) i/n ( i = 1,2, \cdots ,n ) \end{gathered}$$ (14) 3.6 评价指标

目标检测训练结果,从精确度(Precision,P)、召回率(Recall,R)、F1值、AP值(

$ {L}_{\mathrm{A}\mathrm{P}} $ )、mAP值($ {L}_{\mathrm{m}\mathrm{A}\mathrm{P}} $ )5方面评价考核:$$ P=\frac{{T}_{P}}{{T}_{P}+{F}_{P}} $$ (15) $$ R=\frac{{T}_{P}}{{T}_{P}+{F}_{N}} $$ (16) $$ {F}_{1}=\frac{2{T}_{P}}{2{T}_{P}+{F}_{N}+{F}_{P}} $$ (17) $$ {L}_{\mathrm{A}\mathrm{P}}={\int }_{0}^{1}P\left(R\right)\mathrm{d}R $$ (18) $$ {L}_{\mathrm{m}\mathrm{A}\mathrm{P}}=\frac{\displaystyle\sum_{i=1}^{k}{L}_{{\mathrm{A}\mathrm{P}}_{i}}}{k} $$ (19) 其中:TP为正确检测框,FP为误检框,FN为漏检框。分拣实验以目标定位准确率

$ {P}_{\mathrm{A}\mathrm{C}} $ 和最终分类的正确率$ {C}_{\mathrm{A}\mathrm{C}} $ 来衡量,计算公式为$$ {P}_{\mathrm{A}\mathrm{C}}=\frac{\displaystyle\sum _{i=1}^{4}{S}_{i}}{\displaystyle\sum _{i=1}^{4}{W}_{i}} $$ (20) $$ {C}_{\mathrm{A}\mathrm{C}}=\frac{\displaystyle\sum _{i=1}^{4}{T}_{i}}{\displaystyle\sum _{i=1}^{4}{W}_{i}} $$ (21) 其中:Wi为各类医疗垃圾总数,Si为正确定位个数,Ti为正确分类个数,此处i = C = {1, 2, 3, 4}。

4. 目标检测实验及结果

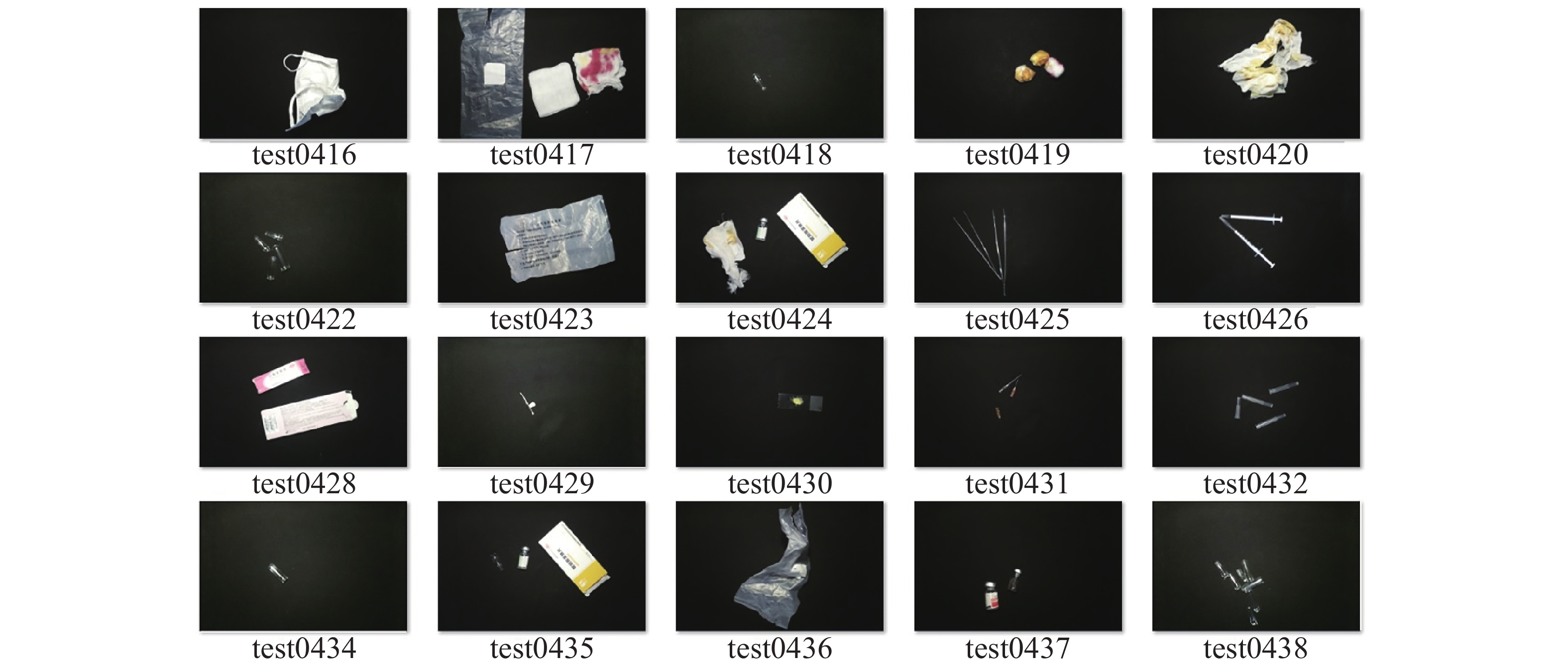

4.1 医疗垃圾图像数据集

在搭建的医疗垃圾分拣平台上,使用树莓派摄像头拍摄并筛选获得2 217张图片,医疗垃圾示例如图10所示,种类与数量统计见表1所示。

表 1 医疗垃圾实验样本种类与数量Table 1 Types and quantity of medical wastes废弃物种类 废弃物名称 样本数量/种 图像数量/张 感染性

废弃物针管 9 377 棉球 14 524 棉签 13 556 纱布 10 450 口罩 9 363 尖锐金属

废弃物针头 12 431 镊子 6 439 刀子 11 478 损伤性玻璃

废弃物玻璃瓶 6 439 安瓿瓶 16 593 载玻片 18 474 可回收

废弃物纸盒 11 404 塑料袋 13 572 针头盖 10 415 4.2 目标检测实验模型构建

针对医疗垃圾中安瓿瓶、针头盖、玻璃片、针头等透明细小难识别目标,在Keras深度学习框架下对Faster R-CNN、RFB Net、RetinaNet、CenterNet、YOLOv4共5种目标检测算法进行对比训练实验。YOLOv3-v5系列中选用性能最强的YOLOv4,本文将2 217张样图像分层抽取出20%,共444张图留作测试集,(训练集+验证集)∶测试集=8∶2;训练集∶验证集为 9∶1。目标检测算法训练所用的平台硬件配置Intel(R) Core(TM) i5-7500CPU,GTX1060 8 GB内存GPU,受电脑性能限制,Batch size 统一采用8、4、2;训练结束后均在IOU=0.3,Score-threhold=0.5, MINOVERLAP = 0.5,Confidence=0.5的阈值指标下对444张测试集进行的结果验证,从精确度、召回率、F1、AP、mAP等5个方面进行评价考核。6种目标检测算法实验使用的算法及环境条件信息如表2所示。

表 2 目标检测算法及实验环境条件Table 2 Experimental environment of target detection algorithm算法 骨干网络 输入尺寸/像素×像素 Epoch Batch size 学习率 FasterR-CNN VGG-16ResNet-101 800×800 0~50 4 1×10−4 50~100 2 1×10−5 RFB Net VGG-16 512×512 0~50 8 5×10−4 50~100 4 1×10−4 RetinaNet ResNeXt-100FPN 600×600 0~50 8 1×10−4 50~100 2 1×10−5 CenterNet ResNet50 515×512 0~50 8 1×10−3 50~100 4 1×10−4 YOLOv4 CSPDarknet-53 608×608 0~50 8 1×10−3 50~100 2 1×10−4 IE-YOLOv4 CSPDarknet-53 608×608 0~50 8 1×10−3 50~100 2 1×10−4 4.3 IE-YOLOv4-MWR训练过程与结果

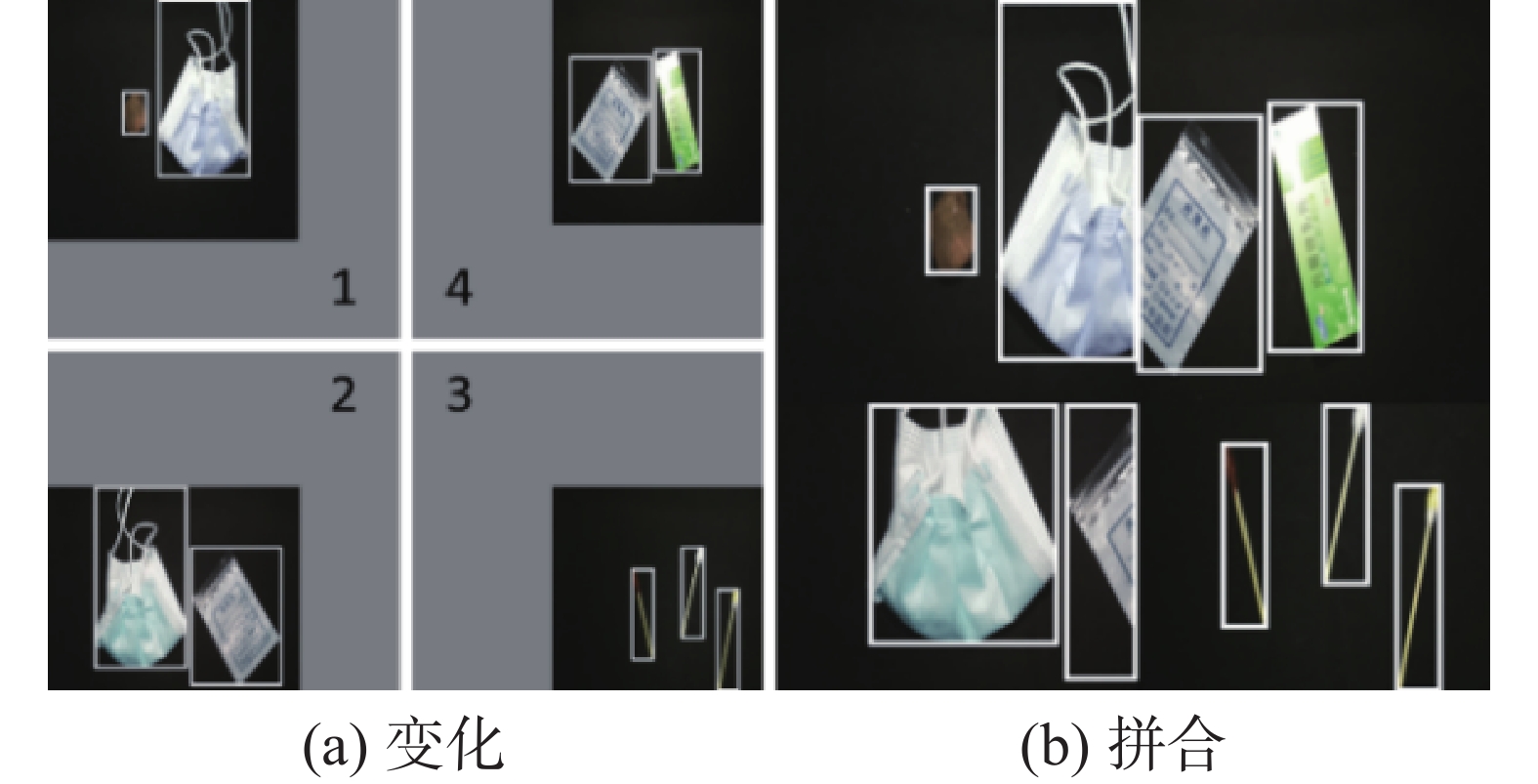

在IE-YOLOv4-MWR识别模型训练中,尝试使用Mosaic数据增强[25],4张图片随机翻转、缩放、色域变换如图11(a),裁剪、拼接为如图11(b)组合图像输入模型。进行Batch Normalization(BN)时将计算4张图片数据,相当于变现提高了 BatchSize。训练后 mAP 值为96.24%,未明显提升。分析Mosaic增强并不适合医疗垃圾中针头、安瓿瓶等透明细小目标。

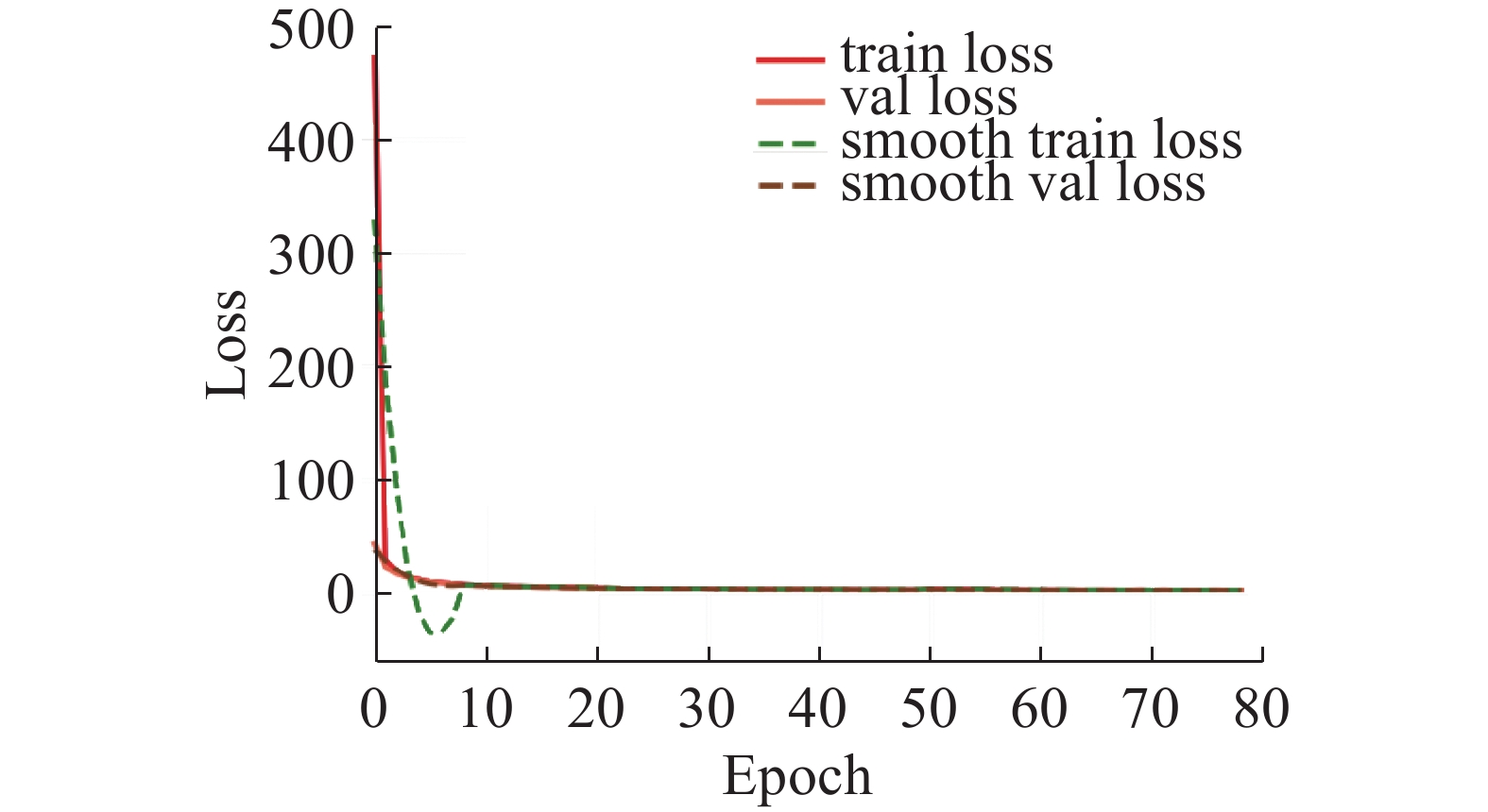

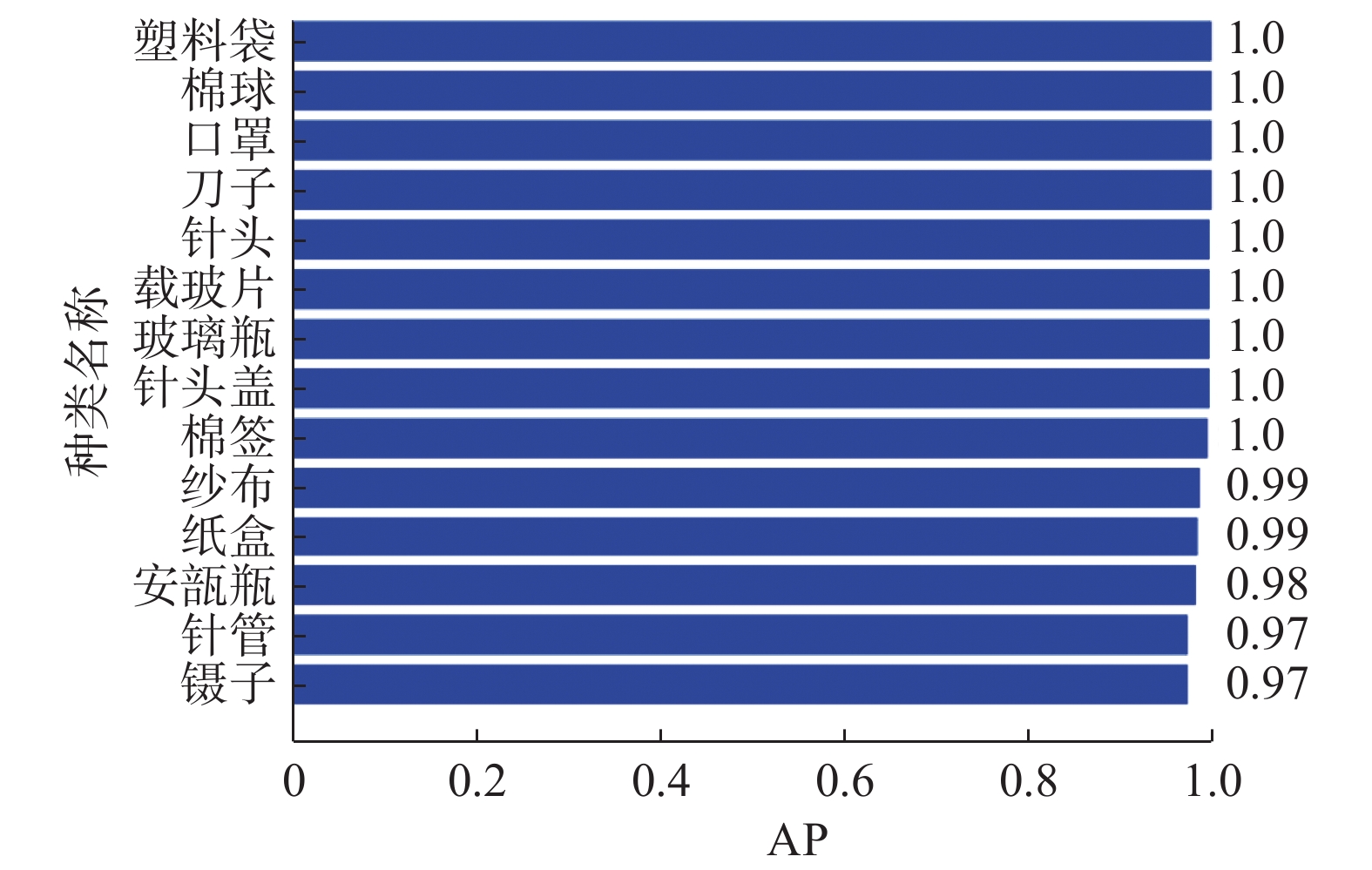

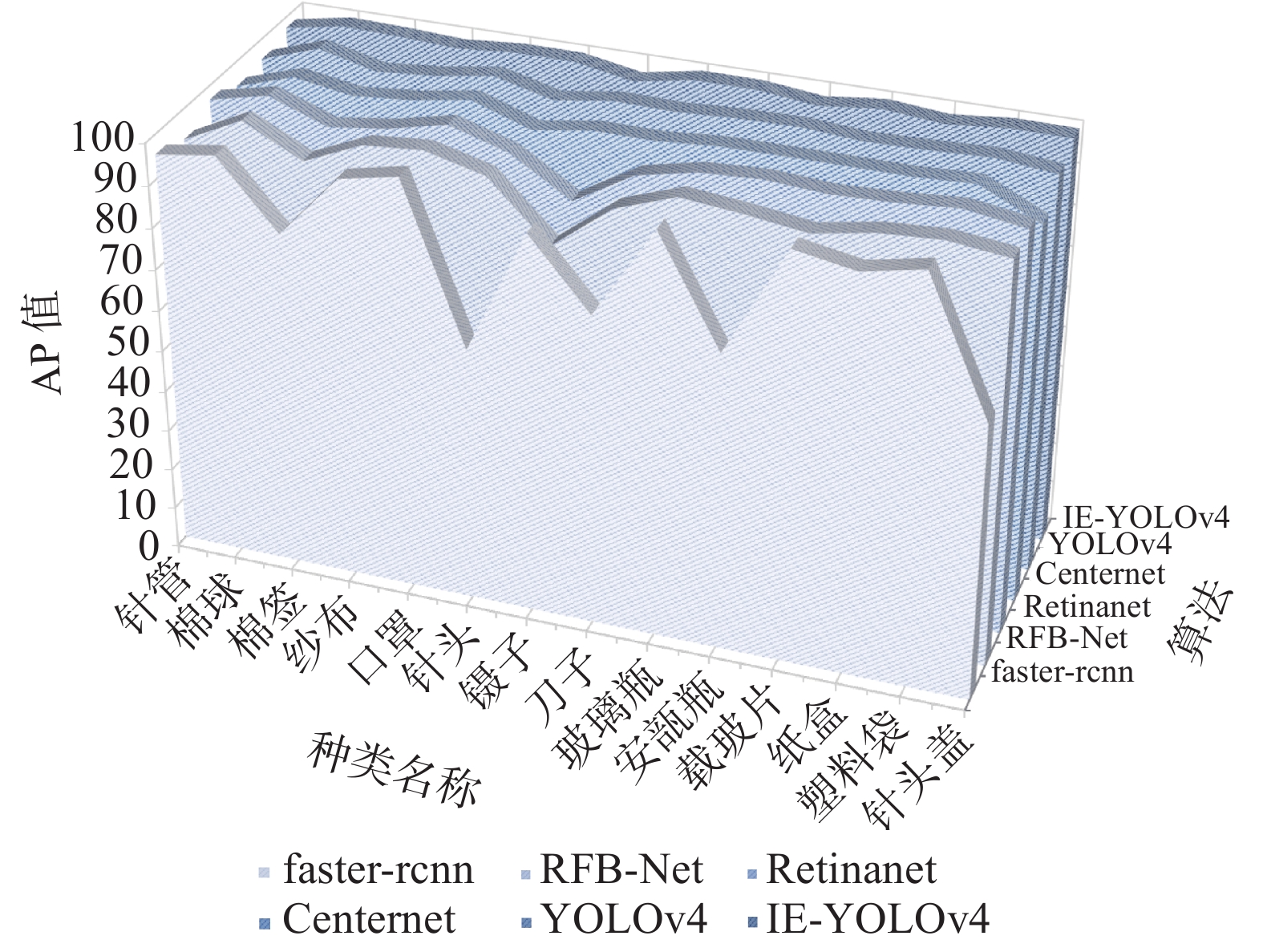

引入随机擦除(Random Erasing)[22],在训练中生成局部遮挡框,模拟物体遮挡效果,图12第1行,矩形面积上下阈值Sl=0.1,Sh=0.4遮挡面积过大;调整为第2行所示Sl=0.02,Sh=0.04,长宽比re=0.3; 最终IE数据增强如图12第3行,训练集扩容4倍。经IE数据增强扩容和特征融合、Cosine annealing应用,训练得到IE-YOLOv4-MWR模型Loss值收敛如图13,各类目标识别准确率AP值见图14。

4.4 目标检测实验结果对比与分析

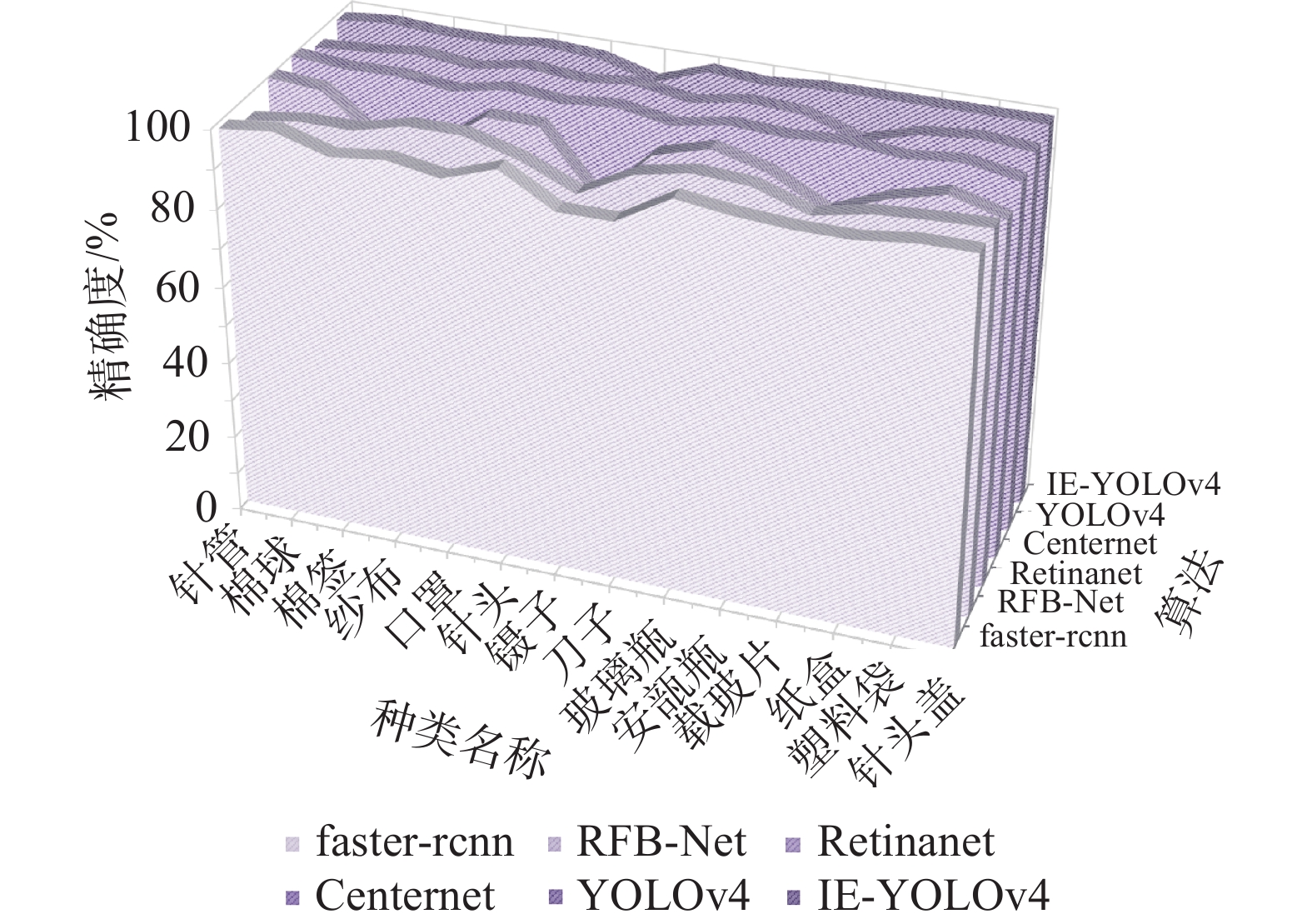

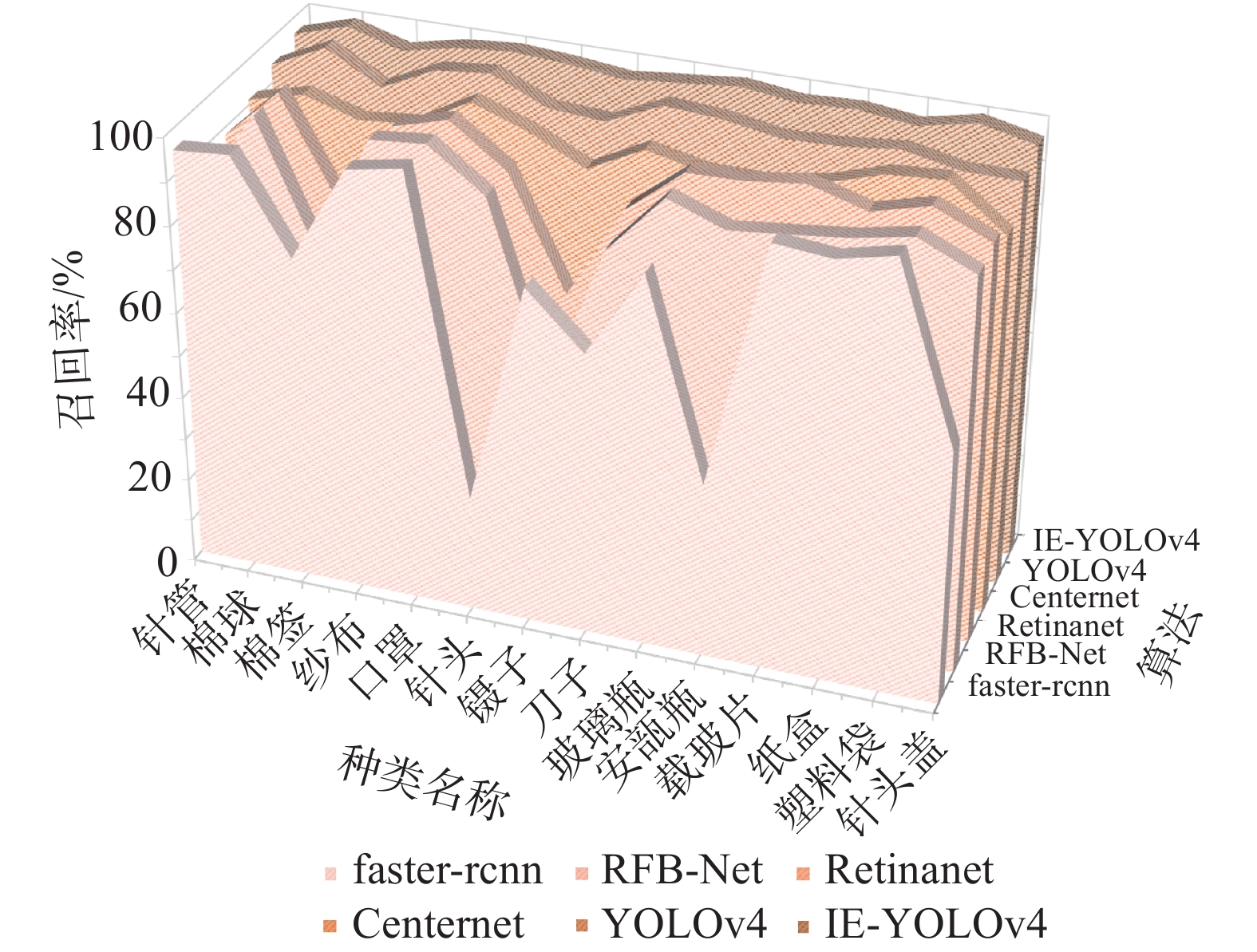

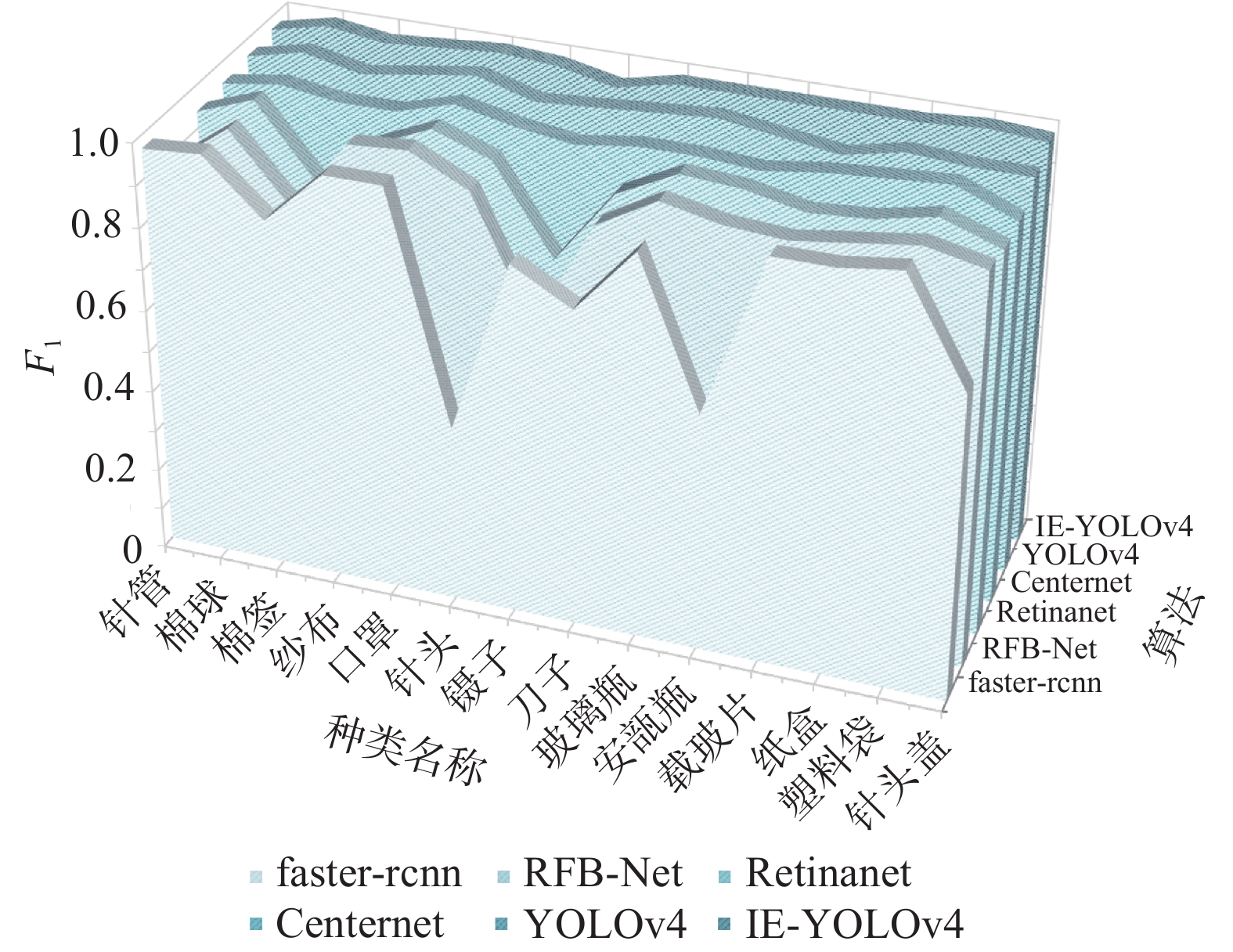

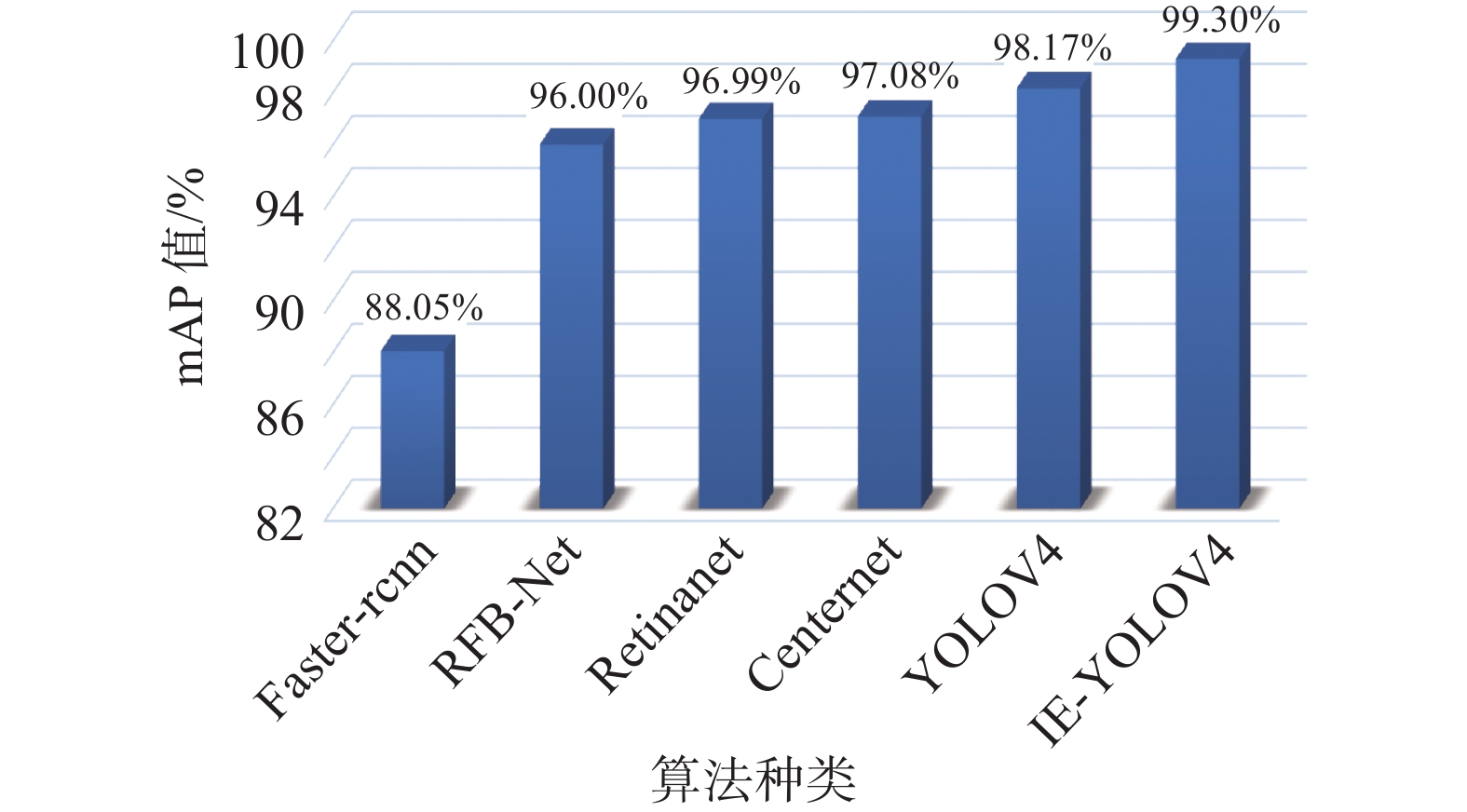

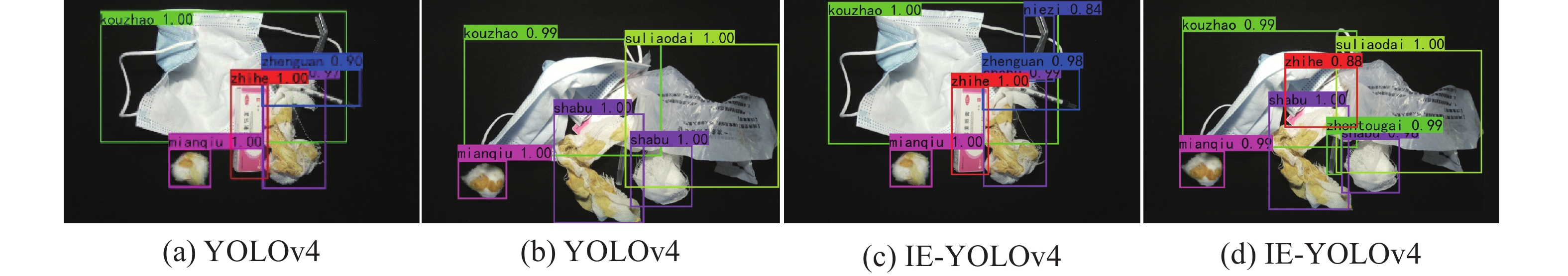

对Faster R-CNN、RFB Net、RetinaNet、CenterNet、YOLOv4、IE-YOLOv4,6种目标检测算法,从精确度、召回率、F1值、AP值、mAP值等5方面进行评价,训练结果可视化对比如图15~20所示。

6种算法漏检率对照如图19所示,发现在医疗垃圾目标检测实验中,透明安瓿瓶、玻璃片、针头、针头盖等目标漏检率较高。Faster R-CNN漏检率(lamr)较高,安瓿瓶lamr为0.4,针头lamr为0.39,针头盖lamr为0.36。经过本文数据增强改善的IE-YOLOv4模型漏检丢失率明显降低,镊子lamr为0.03,安瓿瓶lamr为0.02,棉签、针头等多项样本漏检率为零。

以mAP值为综合评价指标见图20所示, IE-YOLOV4模型识别准确度mAP值达99.30%,与原YOLOv4算法相比明显提升;且从图19也能看出,对安瓿瓶、针头等透明、细小目标的漏检率也大大降低;从图21的预测图来看,IE-YOLOv4目标识别置信度均大于0.95,与其余5种目标检测算法相比优势明显;对复杂环境重叠遮挡目标进行识别测试,如图22所示,YOLOv4对多个被遮挡目标无法识别,IE-YOLOv4识别出全部被遮挡目标且置信度大于0.84。综上所述,本文提出的IE-YOLOv4-MWR识别模型对医疗垃圾透明细小目标及被遮挡目标的识别能力明显提升。

详细评价指标数据见表3~6所示。由表3~6的精确度、召回率、F1、AP实验数据可知,在本实验较为纯净的黑色背景下,CenterNet在识别精准度上表现十分优秀,在召回率上存在部分损失;Faster R-CNN识别精准度高但严重损失召回率,RFB Net、RetinaNet几种算法在识别精准度上尚可,针头、镊子、棉签召回率损失较多。与上述算法相比,IE-YOLOv4算法在对医疗垃圾识别的精率度、召回率 、F1、AP等指标值均优于其他的5种目标检测算法。

表 3 6种目标检测算法精确度统计Table 3 Precision statistics of six target detection algorithms% 种类名称 Faster R-CNN RFB-Net RetinaNet CenterNet YOLOv4 IE-YOLOv4 针管 98.48 94.92 100.00 100.00 96.97 98.73 棉球 100.00 96.74 98.89 98.82 97.80 100.00 棉签 96.00 96.81 88.29 99.14 99.16 99.04 纱布 97.65 100.00 89.13 97.50 97.67 98.91 口罩 95.35 100.00 98.80 100.00 100.00 100.00 针头 100.00 96.25 98.72 98.77 98.77 99.07 镊子 92.06 90.24 82.76 100.00 100.00 95.29 刀子 92.06 97.33 96.20 97.65 97.75 100.00 玻璃瓶 100.00 100.00 100.00 100.00 100.00 98.89 安瓿瓶 98.25 99.21 96.38 99.21 99.24 100.00 载玻片 97.33 94.59 89.16 100.00 94.74 100.00 纸盒 97.37 97.33 94.81 98.68 98.68 100.00 塑料袋 99.12 98.23 98.25 100.00 100.00 100.00 针头盖 99.21 98.84 94.51 97.62 98.88 100.00 表 4 6种目标检测算法召回率统计Table 4 Recall statistics of six target detection algorithms% 种类名称 Faster R-CNN RFB-Net RetinaNet CenterNet YOLOv4 IE-YOLOv4 针管 95.59 82.35 88.24 91.18 94.12 96.30 棉球 96.63 100.00 100.00 94.38 100.00 100.00 棉签 75.59 71.65 77.17 90.55 92.91 96.26 纱布 97.65 98.82 96.47 91.76 98.82 98.91 口罩 100.00 100.00 100.00 98.78 100.00 100.00 针头 27.06 90.59 90.59 94.12 94.12 99.07 镊子 78.38 50.00 64.86 87.84 93.24 97.59 刀子 65.91 82.95 86.36 94.32 98.86 98.80 玻璃瓶 86.17 96.81 96.81 91.49 97.87 100.00 安瓿瓶 40.88 91.97 97.08 91.24 95.62 98.36 载玻片 97.33 93.33 98.67 93.33 96.00 98.89 纸盒 96.10 94.81 94.81 97.40 97.40 97.30 塑料袋 99.12 97.37 98.25 98.25 94.74 100.00 针头盖 59.14 91.40 92.47 88.17 94.62 97.09 表 5 6种目标检测算法F1值统计Table 5 F1 statistics of six target detection algorithms种类名称 Faster R-CNN RFB-Net RetinaNet CenterNet YOLOv4 IE-YOLOv4 针管 0.97 0.88 0.94 0.95 0.96 0.97 棉球 0.98 0.98 0.99 0.97 0.99 1.00 棉签 0.85 0.82 0.82 0.95 0.96 0.98 纱布 0.98 0.99 0.93 0.95 0.98 0.99 口罩 0.98 1.00 0.99 0.99 1.00 1.00 针头 0.43 0.93 0.94 0.96 0.96 0.99 镊子 0.85 0.64 0.73 0.94 0.97 0.96 刀子 0.77 0.90 0.91 0.96 0.98 0.99 玻璃瓶 0.93 0.98 0.98 0.96 0.99 0.99 安瓿瓶 0.58 0.95 0.97 0.95 0.97 0.99 载玻片 0.97 0.94 0.94 0.97 0.95 0.99 纸盒 0.97 0.96 0.95 0.98 0.98 0.99 塑料袋 0.99 0.98 0.98 0.99 0.97 1.00 针头盖 0.74 0.95 0.93 0.93 0.97 0.99 表 6 6种目标检测算法AP值统计Table 6 AP statistics of six target detection algorithms% 种类名称 Faster R-CNN RFB-Net RetinaNet CenterNet YOLOv4 IE-YOLOv4 针管 95.59 93.13 96.82 94.31 95.32 97.47 棉球 97.75 99.91 100.00 98.72 100.00 100.00 棉签 81.74 92.73 94.86 96.46 96.62 99.60 纱布 97.04 98.82 96.76 97.70 97.83 98.87 口罩 100.00 100.00 100.00 99.99 100.00 100.00 针头 62.07 96.35 95.69 95.13 96.41 99.97 镊子 92.06 82.55 86.81 97.34 98.49 97.43 刀子 75.65 93.76 95.22 97.25 98.19 100.00 玻璃瓶 97.87 98.88 98.33 98.37 98.94 99.95 安瓿瓶 72.22 97.46 99.12 98.46 99.19 98.36 载玻片 98.58 95.58 98.17 98.48 98.16 99.96 纸盒 96.07 98.20 98.70 98.45 98.50 98.65 塑料袋 99.12 99.08 99.81 99.12 99.11 100.00 5. 平台系统测试及结果

在搭载了IE-YOLOv4-MWRIS算法的分拣平台样机上,进行了医疗垃圾的分拣抓取测试,实验场景如图23所示,医疗废弃物数量统计见表7所示。

表 7 抓取实验医疗垃圾数量统计Table 7 List of waste quantity and types尖锐金属

废弃物/件损伤性玻璃

废弃物/件感染性

废弃物/件可回收

废弃物/件针头21 玻璃瓶19 针管22 纸盒20 镊子20 安瓿瓶21 棉球25 塑料袋22 刀子16 载玻片15 棉签21 针头盖18 纱布24 口罩23 抓取实验经过5位测试者每人20次,一次2至3件,共计287件医疗垃圾的投递,统计数据如表8所示。可见在IE-YOLOv4-MWRIS指导下,抓取机构对目标定位精准,有276件样本被Delta机器臂及改进平动夹爪的中心点准确定位,定位准确率(

$ {P}_{\mathrm{A}\mathrm{C}} $ )为96.17%,对细小医疗样本“棉签”的定位抓取过程,如图24所示。最终,有249件医疗垃圾样本被分拣机构正确的识别、归类、抓取并投递,抓取分类总正确率($ {C}_{\mathrm{A}\mathrm{C}} $ )为86.76%。表 8 医疗垃圾抓取实验结果统计Table 8 Experimental results of target grabbing医疗垃圾

样本类别总数Wi 正确定

位数Si正确分

类数Ti定位准确

$\dfrac{{{{\rm{S}}_i}}}{{{{\rm{W}}_i}}} $/%分类准确

$\dfrac{{{{\rm{T}}_i}}}{{{{\rm{W}}_i}}} $/%尖锐金属

废弃物57 54 51 94.73 89.47 损伤性玻

璃废弃物55 53 49 96.36 89.09 感染性

废弃物115 110 101 95.65 87.83 可回收

废弃物60 59 48 98.33 80.00 分析抓取过程中存在目标识别率高、物理坐标定位精准,但实际抓取失败的问题,在38件失败样本中,有12件因未滑入托盘或靠近边缘,机构运动受阻失败;有11件因尺寸超过夹爪最大口径未能成功夹取;8件样本抓取过程反复滑落,经三次滑落被计为抓取失败;有7件样本因分布密集,被夹带抓取投入错误箱体。而目标定位失败的主要原因,为7件被错误夹带和4件垃圾未进入抓取范围。现阶段分拣平台及夹爪机构有待改良,针对目标的定位抓取,还有深入研究价值和提升空间。

6. 结束语

1)本文提出医疗垃圾识别分拣算法(MWRIS)搭建了基于机器视觉和Delta机构的智能分拣平台,完成了多目标医疗垃圾识别分拣测试,初步验证了多目标医疗垃圾智能识别分拣系统的可行性,解决了图像分类垃圾箱一次分类一个垃圾的弊端。

2)本文提出的IE数据增强扩容算法加入MWR识别模型,相比原YOLOv4算法降低了透明细小目标的漏检率,对复杂环境下重叠遮挡目标的识别效果显著提升,将医疗垃圾的识别准确率mAP提升到99.30%的较高水平。今后将尝试使用YOLOv7、Swin Transformer等算法深入研究。

3)目前医疗垃圾分拣平台处于原型开发阶段,MWI索引算法和MWS分拣算法能有效发挥作用,在IE-YOLOv4-MWRIS算法模型指导下,平台定位准确率96.17%,但抓取分类正确率仅为86.76%。未来将进一步改良分拣平台和夹爪机构,改进抓取算法来提升目标定位抓取的准确率,并针对研究发现的目标重叠和避障抓取问题进行深入研究。

-

表 1 医疗垃圾实验样本种类与数量

Table 1 Types and quantity of medical wastes

废弃物种类 废弃物名称 样本数量/种 图像数量/张 感染性

废弃物针管 9 377 棉球 14 524 棉签 13 556 纱布 10 450 口罩 9 363 尖锐金属

废弃物针头 12 431 镊子 6 439 刀子 11 478 损伤性玻璃

废弃物玻璃瓶 6 439 安瓿瓶 16 593 载玻片 18 474 可回收

废弃物纸盒 11 404 塑料袋 13 572 针头盖 10 415 表 2 目标检测算法及实验环境条件

Table 2 Experimental environment of target detection algorithm

算法 骨干网络 输入尺寸/像素×像素 Epoch Batch size 学习率 FasterR-CNN VGG-16ResNet-101 800×800 0~50 4 1×10−4 50~100 2 1×10−5 RFB Net VGG-16 512×512 0~50 8 5×10−4 50~100 4 1×10−4 RetinaNet ResNeXt-100FPN 600×600 0~50 8 1×10−4 50~100 2 1×10−5 CenterNet ResNet50 515×512 0~50 8 1×10−3 50~100 4 1×10−4 YOLOv4 CSPDarknet-53 608×608 0~50 8 1×10−3 50~100 2 1×10−4 IE-YOLOv4 CSPDarknet-53 608×608 0~50 8 1×10−3 50~100 2 1×10−4 表 3 6种目标检测算法精确度统计

Table 3 Precision statistics of six target detection algorithms

% 种类名称 Faster R-CNN RFB-Net RetinaNet CenterNet YOLOv4 IE-YOLOv4 针管 98.48 94.92 100.00 100.00 96.97 98.73 棉球 100.00 96.74 98.89 98.82 97.80 100.00 棉签 96.00 96.81 88.29 99.14 99.16 99.04 纱布 97.65 100.00 89.13 97.50 97.67 98.91 口罩 95.35 100.00 98.80 100.00 100.00 100.00 针头 100.00 96.25 98.72 98.77 98.77 99.07 镊子 92.06 90.24 82.76 100.00 100.00 95.29 刀子 92.06 97.33 96.20 97.65 97.75 100.00 玻璃瓶 100.00 100.00 100.00 100.00 100.00 98.89 安瓿瓶 98.25 99.21 96.38 99.21 99.24 100.00 载玻片 97.33 94.59 89.16 100.00 94.74 100.00 纸盒 97.37 97.33 94.81 98.68 98.68 100.00 塑料袋 99.12 98.23 98.25 100.00 100.00 100.00 针头盖 99.21 98.84 94.51 97.62 98.88 100.00 表 4 6种目标检测算法召回率统计

Table 4 Recall statistics of six target detection algorithms

% 种类名称 Faster R-CNN RFB-Net RetinaNet CenterNet YOLOv4 IE-YOLOv4 针管 95.59 82.35 88.24 91.18 94.12 96.30 棉球 96.63 100.00 100.00 94.38 100.00 100.00 棉签 75.59 71.65 77.17 90.55 92.91 96.26 纱布 97.65 98.82 96.47 91.76 98.82 98.91 口罩 100.00 100.00 100.00 98.78 100.00 100.00 针头 27.06 90.59 90.59 94.12 94.12 99.07 镊子 78.38 50.00 64.86 87.84 93.24 97.59 刀子 65.91 82.95 86.36 94.32 98.86 98.80 玻璃瓶 86.17 96.81 96.81 91.49 97.87 100.00 安瓿瓶 40.88 91.97 97.08 91.24 95.62 98.36 载玻片 97.33 93.33 98.67 93.33 96.00 98.89 纸盒 96.10 94.81 94.81 97.40 97.40 97.30 塑料袋 99.12 97.37 98.25 98.25 94.74 100.00 针头盖 59.14 91.40 92.47 88.17 94.62 97.09 表 5 6种目标检测算法F1值统计

Table 5 F1 statistics of six target detection algorithms

种类名称 Faster R-CNN RFB-Net RetinaNet CenterNet YOLOv4 IE-YOLOv4 针管 0.97 0.88 0.94 0.95 0.96 0.97 棉球 0.98 0.98 0.99 0.97 0.99 1.00 棉签 0.85 0.82 0.82 0.95 0.96 0.98 纱布 0.98 0.99 0.93 0.95 0.98 0.99 口罩 0.98 1.00 0.99 0.99 1.00 1.00 针头 0.43 0.93 0.94 0.96 0.96 0.99 镊子 0.85 0.64 0.73 0.94 0.97 0.96 刀子 0.77 0.90 0.91 0.96 0.98 0.99 玻璃瓶 0.93 0.98 0.98 0.96 0.99 0.99 安瓿瓶 0.58 0.95 0.97 0.95 0.97 0.99 载玻片 0.97 0.94 0.94 0.97 0.95 0.99 纸盒 0.97 0.96 0.95 0.98 0.98 0.99 塑料袋 0.99 0.98 0.98 0.99 0.97 1.00 针头盖 0.74 0.95 0.93 0.93 0.97 0.99 表 6 6种目标检测算法AP值统计

Table 6 AP statistics of six target detection algorithms

% 种类名称 Faster R-CNN RFB-Net RetinaNet CenterNet YOLOv4 IE-YOLOv4 针管 95.59 93.13 96.82 94.31 95.32 97.47 棉球 97.75 99.91 100.00 98.72 100.00 100.00 棉签 81.74 92.73 94.86 96.46 96.62 99.60 纱布 97.04 98.82 96.76 97.70 97.83 98.87 口罩 100.00 100.00 100.00 99.99 100.00 100.00 针头 62.07 96.35 95.69 95.13 96.41 99.97 镊子 92.06 82.55 86.81 97.34 98.49 97.43 刀子 75.65 93.76 95.22 97.25 98.19 100.00 玻璃瓶 97.87 98.88 98.33 98.37 98.94 99.95 安瓿瓶 72.22 97.46 99.12 98.46 99.19 98.36 载玻片 98.58 95.58 98.17 98.48 98.16 99.96 纸盒 96.07 98.20 98.70 98.45 98.50 98.65 塑料袋 99.12 99.08 99.81 99.12 99.11 100.00 表 7 抓取实验医疗垃圾数量统计

Table 7 List of waste quantity and types

尖锐金属

废弃物/件损伤性玻璃

废弃物/件感染性

废弃物/件可回收

废弃物/件针头21 玻璃瓶19 针管22 纸盒20 镊子20 安瓿瓶21 棉球25 塑料袋22 刀子16 载玻片15 棉签21 针头盖18 纱布24 口罩23 表 8 医疗垃圾抓取实验结果统计

Table 8 Experimental results of target grabbing

医疗垃圾

样本类别总数Wi 正确定

位数Si正确分

类数Ti定位准确

$\dfrac{{{{\rm{S}}_i}}}{{{{\rm{W}}_i}}} $/%分类准确

$\dfrac{{{{\rm{T}}_i}}}{{{{\rm{W}}_i}}} $/%尖锐金属

废弃物57 54 51 94.73 89.47 损伤性玻

璃废弃物55 53 49 96.36 89.09 感染性

废弃物115 110 101 95.65 87.83 可回收

废弃物60 59 48 98.33 80.00 -

[1] WEI Yujun, CUI Meng, YE Zhonghua, et al. Environmental challenges from the increasing medical waste since SARS outbreak[J]. Journal of cleaner production, 2021, 291: 125246. doi: 10.1016/j.jclepro.2020.125246 [2] FABIANO B, HAILWOOD M, THOMAS P. Safety, environmental and risk management related to Covid-19[J]. Process safety and environmental protection:transactions of the institution of chemical engineers, Part B, 2022, 160: 397–399. doi: 10.1016/j.psep.2022.02.035 [3] XU Linping, KONG Yan, WEI Mingxue, et al. Combatting medical plastic waste through visual elicitation: insights from healthcare professionals[J]. Journal of cleaner production, 2021, 329: 129650. doi: 10.1016/j.jclepro.2021.129650 [4] EREN E, TUZKAYA U R. Safe distance-based vehicle routing problem: medical waste collection case study in COVID-19 pandemic[J]. Computers & industrial engineering, 2021, 157: 107328. [5] DHARMARAJ S, ASHOKKUMAR V, PANDIYAN R, et al. Pyrolysis: an effective technique for degradation of COVID-19 medical wastes[J]. Chemosphere, 2021, 275: 130092. doi: 10.1016/j.chemosphere.2021.130092 [6] PURNOMO C W, KURNIAWAN W, AZIZ M. Technological review on thermochemical conversion of COVID-19-related medical wastes[J]. Resources, conservation, and recycling, 2021, 167: 105429. doi: 10.1016/j.resconrec.2021.105429 [7] NEMA S K, GANESHPRASAD K S. Plasma pyrolysis of medical waste[J]. Current science, 2002, 83(3): 271–278. [8] KUMAR N M, ABED MOHAMMED M, ABDULKAREEM K H, et al. Artificial intelligence-based solution for sorting COVID related medical waste streams and supporting data-driven decisions for smart circular economy practice[J]. Process safety and environmental protection, 2021, 152: 482–494. doi: 10.1016/j.psep.2021.06.026 [9] AWAWDEH M, BASHIR A, FAISAL T, et al. IoT-based intelligent waste bin[C]//2019 Advances in Science and Engineering Technology International Conferences. Dubai: IEEE, 2019: 1–6. [10] MEGHNA A, IMMANUEL M, SUBHAGAN P, et al. Trash bot[J]. International journal of research in engineering, science and management, 2019, 2(7): 301–304. [11] 张凇. 智能垃圾分类产品的模块化设计与开发[D]. 上海: 东华大学, 2020. ZHANG Song. Modular design and development of intelligent waste sorting products[D]. Shanghai: Donghua University, 2020. [12] ZHANG Song, CHEN Yumiao, YANG Zhongliang, et al. Computer vision based two-stage waste recognition-retrieval algorithm for waste classification[J]. Resources conservation and recycling, 2021, 169: 105543. doi: 10.1016/j.resconrec.2021.105543 [13] 苏丽, 孙雨鑫, 苑守正. 基于深度学习的实例分割研究综述[J]. 智能系统学报, 2022, 17(1): 16–31. SU Li, SUN Yuxin, YUAN Shouzheng. A survey of instance segmentation research based on deep learning[J]. CAAI transactions on intelligent systems, 2022, 17(1): 16–31. [14] 莫卓亚, 彭创权. 基于深度学习的垃圾分类识别技术[J]. 现代工业经济和信息化, 2020, 10(10): 60–61. MO Zhuoya, PENG Chuangquan. Garbage classification and recognition technology based on deep learning[J]. Modern industrial economy and informationization, 2020, 10(10): 60–61. [15] 马雯, 于炯, 王潇, 等. 基于改进Faster R-CNN的垃圾检测与分类方法[J]. 计算机工程, 2021, 47(8): 294–300. MA Wen, YU Jiong, WANG Xiao, et al. Garbage detection and classification method based on improved faster R-CNN[J]. Computer engineering, 2021, 47(8): 294–300. [16] 王文胜, 年诚旭, 张超, 等. 基于YOLO v5模型的非住宅区自动垃圾分类箱设计[J]. 环境工程, 2022, 40(3): 159–165. WANG Wensheng, NIAN Chengxu, ZHANG Chao, et al. Design of automatic garbage sorting bin for non-residential area based on yolo v5[J]. Environmental engineering, 2022, 40(3): 159–165. [17] 何锐波, 狄岚, 梁久祯. 一种改进的深度学习的道路交通标识识别算法[J]. 智能系统学报, 2020, 15(6): 1121–1130. doi: 10.11992/tis.201811009 HE Ruibo, DI Lan, LIANG Jiuzhen. An improved deep learning algorithm for road traffic identification[J]. CAAI transactions on intelligent systems, 2020, 15(6): 1121–1130. doi: 10.11992/tis.201811009 [18] 周哲画. 医疗废弃物识别与分拣垃圾箱设计[D]. 上海: 东华大学, 2021. ZHOU Zhehua. Design of medical waste identification and Sorting bin[D]. Shanghai: Donghua University, 2021. [19] STOCK M, MILLER K. Optimal kinematic design of spatial parallel manipulators: application to linear delta robot[J]. Journal of mechanical design, 2003, 125(2): 292–301. doi: 10.1115/1.1563632 [20] MATS I, CLÉMENT G, KRISTAN M. An introduction to utilising the redundancy of a kinematically redundant parallel manipulator to operate a gripper[J]. Mechanism and machine theory, 2016, 101: 50–59. doi: 10.1016/j.mechmachtheory.2016.03.006 [21] YU Zhenwei, SHEN Yonggang, SHEN Chenkai. A real-time detection approach for bridge cracks based on YOLOv4-FPM[J]. Automation in construction, 2021, 122: 103514. doi: 10.1016/j.autcon.2020.103514 [22] ZHONG Zhun, ZHENG Liang, KANG Guoliang, et al. Random erasing data augmentation[C]//Proceedings of the AAAI Conference on Artificial Intelligence. Washington: AAAI, 2020, 34(7): 13001–13008. [23] BOCHKOVSKIY A, WANG C Y, LIAO H. YOLOv4: optimal speed and accuracy of object detection[EB/OL]. (2020–04–23)[2022–04–23]. https://api.semanticscholar.org/CorpusID:216080778. [24] NIE Yixin, WANG Songhe, BANSAL M. Revealing the importance of semantic retrieval for machine reading at scale[EB/OL]. (2019–09–01)[2022–04–23]. https://api.semanticscholar.org/CorpusID:202660724. [25] ZENG Guangmiao, YU Wanneng, WANG Rongjie, et al. Research on mosaic image data enhancement for overlapping ship targets[EB/OL]. (2021–05–11)[2022–04–23]. http://arxiv.org/abs/2105.05090.

下载:

下载: