Improved R2CNN ocean eddy automatic detection with a dense feature pyramid

-

摘要: 海洋涡旋演变过程认识的不足是制约当前物理海洋研究水平的关键因素,海洋涡旋自动检测是掌握其产生、发展、变异过程机理及其与多尺度海洋过程相互作用的基础。然而,由于海洋涡旋尺度多样性、形状不规则、分布密集的特点,现有水平检测方法导致检测区域存在显著的冗余、重叠与嵌套。为解决上述问题,提出多尺度旋转密集特征金字塔网络。具体地,通过密集连接(dense feature pyramid network, DFPN)改进特征金字塔网络实现多尺度高层语义特征提取与融合,增强特征传播与特征重用;此外,针对海洋涡旋密集分布的特点,改进旋转区域卷积神经网络(rotational region convolutional neural network, R2CNN),提出多尺度RoI Align机制,实现特征的语义保持和空间信息的完整性,提升模型检测性能。最后,采用海平面异常值数据构建海洋涡旋数据集,并预处理成VOC格式进行训练,调整相应参数得到检测模型。实验结果表明,提出的检测模型最优检测精度可达96.4%,并对太平洋、大西洋海域的海洋涡旋进行自动检测,验证了模型具有较好的泛化能力。Abstract: The lack of understanding of the evolution process of ocean eddies is the main obstacle to current physical ocean research. To gain a better understanding of the mechanism of its generation, development, and variation process, as well as its interaction with multi-scale ocean processes, the automatic detection of ocean eddies is crucial. However, existing horizontal detection methods struggle to accurately detect ocean eddies due to their scale diversity, irregular shape, and dense distribution, leading to significant redundancy and overlap in the detection area. To address this issue, we propose a multi-scale rotation-dense feature pyramid network. The feature pyramid network is enhanced through dense connection (DFPN) for multi-scale high-level semantic feature extraction and fusion, improving feature propagation and reuse. To accommodate the dense distribution of ocean eddies, the R2CNN network is improved, and a multi-scale RoI Align mechanism is introduced to preserve feature semantics and spatial information integrity, thus improving model detection performance. We construct the ocean eddy dataset using sea-level anomaly data, which is preprocessed into VOC format for training. The parameters are adjusted to obtain the optimal detection model, and experimental results show that the model's detection accuracy can reach 96.4%. The proposed model demonstrates good generalisability through the automatic detection of ocean eddies in the Pacific and Atlantic Oceans.

-

海洋涡旋自动检测是研究其产生、演进、变异过程机理及其与多尺度海洋过程相互作用的基础。当前,海洋中小尺度过程演变机理认识的不足是制约海洋学研究的关键因素,海洋涡旋是典型的中尺度过程,普遍存在于世界大洋和边缘海中[1]。海洋涡旋携带极大的动能,其海水运动速度比洋流平均流速快几倍甚至一个量级,对海水有显著的搬运与混合作用。如可将海洋深层的冷水和营养盐带到表面,或将海表暖水压到较深的海洋中,使其在全球海洋物质[2]、能量、热量和淡水等的输运和分配中起着不可忽视的作用。因此,海洋中广泛存在的高能量、强穿透性的海洋涡旋对海洋环流、全球气候变化、海洋生物化学过程以及海洋环境变化都起着重要作用[3]。

目前海洋涡旋检测已有丰富的研究,主要可以分为以下4类:基于流场几何特征的方法[4-5]、基于物理参数的方法[6-7]、基于手工标注特征[8-9]以及混合方法[10-11]。基于流场几何特征的方法采用几何形状模板无法很好检测到非规则结构、形态持续变化海洋涡旋,缺乏通用性;基于物理参数的方法需要针对特定的兴趣区域设置一组合适的阈值,引入由于专家主观经验不确定性导致的对噪声敏感、误判率高的问题。基于手工标注特征的方法比较耗时费力,需要人工目视标记低级特征,检测效率和精度受专家主观影响严重。尽管混合方法具有上述方法的优点,但仍然需要人工通过知识进行视检决定和无噪声历史数据才能正确执行检测[1]。

随着深度卷积神经网络在目标检测取得的巨大成功,计算机视觉领域已经提出了许多基于深度学习的目标检测框架。Lin 等提出将残差网络(residual network, ResNet)[12]和特征金字塔网络(feature pyramid network, FPN)[13]作为主干网络的RetinaNet[14]。Ren 等[15]提出了Faster R-CNN(region-convolutional neural network),使用RPN(region proposal network)[15]来生成候选框的网络。上述这些方法已在涡旋检测中得到了一定的应用,Duo等[16]提出了一个基于深度学习的中尺度涡旋自动识别定位网络(ocean eddy detection net, OEDNet),利用深度学习方法RetinaNet,但是由于产生的是水平候选框,对于长宽比较大的涡旋,一旦倾斜角度过大,冗余区域会比较大,不利于非最大化操作抑制,通常会导致涡旋漏检,导致精度降低。

针对上述问题,提出了一种端到端的多尺度目标旋转检测模型R2-DCNN(rotational region-dense feature pyramid network convolutional neural network),该框架基于旋转检测网络R2CNN(rotational region convolutional neural network)[17],融合DFPN(dense feature pyramid network)[18]增强特征传播与重用,并将原网络的RoI Pooling机制改进为多尺度RoI Align。与当前经典自动检测网络如Faster R-CNN相比,该网络在海洋涡旋检测取得的精度最优。本文的主要贡献包括:

1)改进了特征金字塔网络,通过密集连接,融合底层空间信息和高层语义信息多尺度特征,增强特征传播和特征重用,提升网络多尺度目标检测的性能。

2)构建了一种基于旋转区域的海洋涡旋检测模型,并采用多尺度RoI Align改进传统的RoI Pooling解决特征图不一致问题,获取固定长度的特征和回归候选框,充分保持语义和空间信息的完整性,尤其在目标密集分布区域表现较好的检测性能。

1. 多尺度目标旋转检测网络

针对海洋涡旋尺度多样性、结构非规则、分布密集的特点,构建了如图1所示的多尺度目标旋转检测网络框架。该框架主要由两部分组成:多尺度特征融合的密集特征金字塔模块和旋转区域检测模块。密集特征金字塔基于FPN改进为每层输入图像生成由多尺度特征融合的特征映射,旋转区域检测网络主要是基于Faster R-CNN的R2CNN算法,提出多尺度RoI Align机制对其进行改进。

本文所提算法首先通过ResNet-101进行特征提取,之后DFPN进行多尺度的特征融合,把DFPN提取到的P2、P3、P4、P5和对P5进行2倍降采样得到的P6作为RPN网络的输入,对于RPN生成的每一个候选框,分别使用了3个池化大小 (7×7,11×3,3×11) 的RoI Aligns,然后将RoI Aligns的结果合并在一起,经过全连接层得到进行目标分类的分数,生成水平框和倾斜最小面积框。对于水平框表示是通常目标检测所用的方法,即中心点坐标和矩形的宽高(x,y,w,h)。倾斜最小面积框用矩形的两个坐标点和矩形的高(x1,y1,x2,y2,h)来表示。最后对倾斜框进行倾斜非极大值抑制(inclined non-maximum suppression)[17]得到最终结果。

1.1 密集特征金字塔网络

海洋涡旋具有显著的多尺度特点(空间尺度10~100 km),尤其在密集分布区域,存在大量小尺度海洋涡旋。Faster R-CNN的主干网络VGG Net[19]在提取目标的点、边缘等基础特征方面表现较好,但对于小尺度目标检测性能不佳。因此选择ResNet-101作为主干网,ResNet相对于VGG Net网络更深,能够更好地学习目标特征。并且,在后向传播过程中,将下一层网络的梯度直接传递给上一层网络,可以解决深层网络的梯度消失问题。

同时融合密集特征金字塔,实现海洋涡旋多尺度特征的融合。获取更多底层空间信息有助于提升多尺度目标检测性能,并利于提升目标定位的准确性。基于特征金字塔(FPN)在多尺度特征融合方面的优势,考虑到海洋涡旋密集分布区域小目标多的问题,改进了FPN,通过使用密集连接,不仅实现了底层空间信息与高层语义信息的特征融合,同时增强了特征传播,并鼓励特征重用。

具体地,基于主干网ResNet构建DFPN网络(如图2所示),选取conv2、conv3、conv4、conv5层的最后一个残差块层特征作为DFPN的输入,记为{C2、C3、C4、C5},即DFPN网络的4个层级,相对于原图的步长分别为4、8、16、32。FPN在自顶向下网络中,采用上采样进行,而横向连接则是将上采样的结果和自底向上生成的相同大小的特征图进行融合。DFPN通过横向连接和密集连接得到更高分辨率的特征图,如{P2, P3, P4, P5}。例如,为了得到P3,首先通过使用1×1卷积层来减少C3信道的数量,然后对前面的所有特征映射使用上采样,然后通过连接进行多层级特征图的合并。最后,采用3×3卷积层消除上采样的混叠效应,同时减少通道数。经过上述迭代,得到最终的特征映射{P2, P3, P4, P5}。

1.2 传统R2CNN模型

R2CNN网络框架主要是基于Faster R-CNN进行的改进,图3为该算法流程。

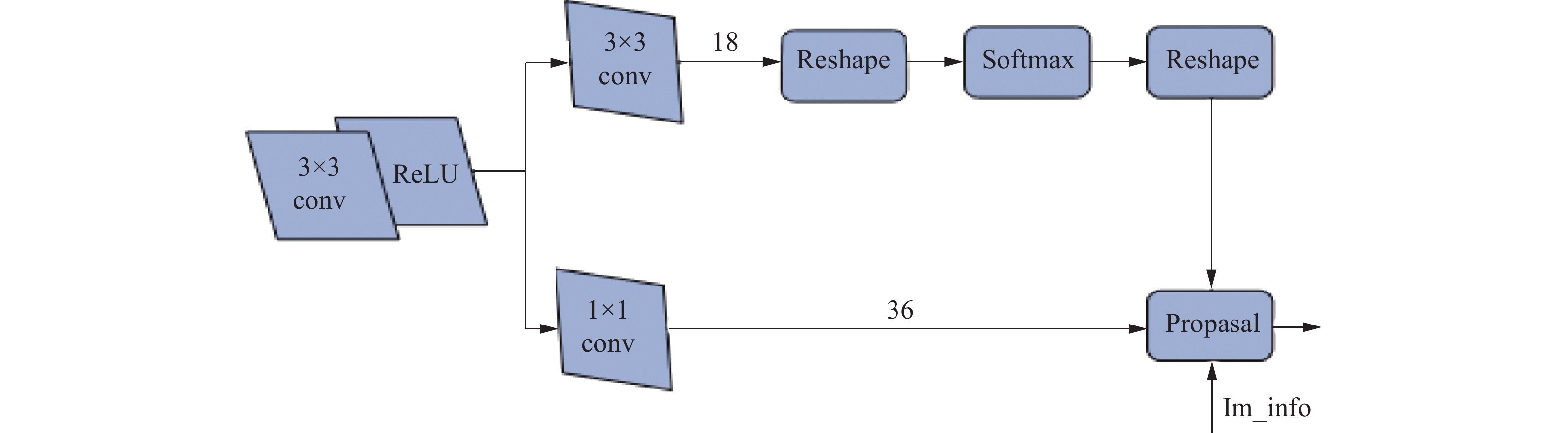

1)RPN[15]主要是依靠在图片特征图上的滑动窗口,如图3可以看出,首先把图像通过特征提取网络生成的特征图输入到RPN网络结构中,通过3×3卷积和ReLu层后分成两个1×1卷积部分,一部分通过Softmax预测分类概率,分析是目标本身还是图片背景从而获得最有可能存在物体的先验框anchor;另一部分通过对原图坐标的偏移量来选取准确的区域。最后综合正先验框和对应的边框回归偏移量来提取候选框[20](图4(b))。

RPN网络的运行机制:图像的卷积特征图上的每个像素点都有k个先验框,然后判断这个框有没有覆盖到物体,对于含有物体的先验框进行坐标调整。检测目标和背景分为两类属于二分类,所以分类层得到2k个分数[20]。而坐标修正是x、y、w和h,所以回归层得到4k个坐标。

2)然后针对每个候选框,做了几个不同池化大小 (7×7,11×3,3×11) 的RoI Poolings。

3)将池化层内的特征串联起来,进行进一步的分类和回归。使用两个全连接层来预测进行分类的分数、水平框和倾斜的最小面积框(图4(c)中每个倾斜框与一个水平的框关联,关联的框对用相同的颜色表示)。

4)最后对倾斜框进行倾斜非极大值抑制处理,得到检测结果(图4(d))。

1.2.1 斜框检测

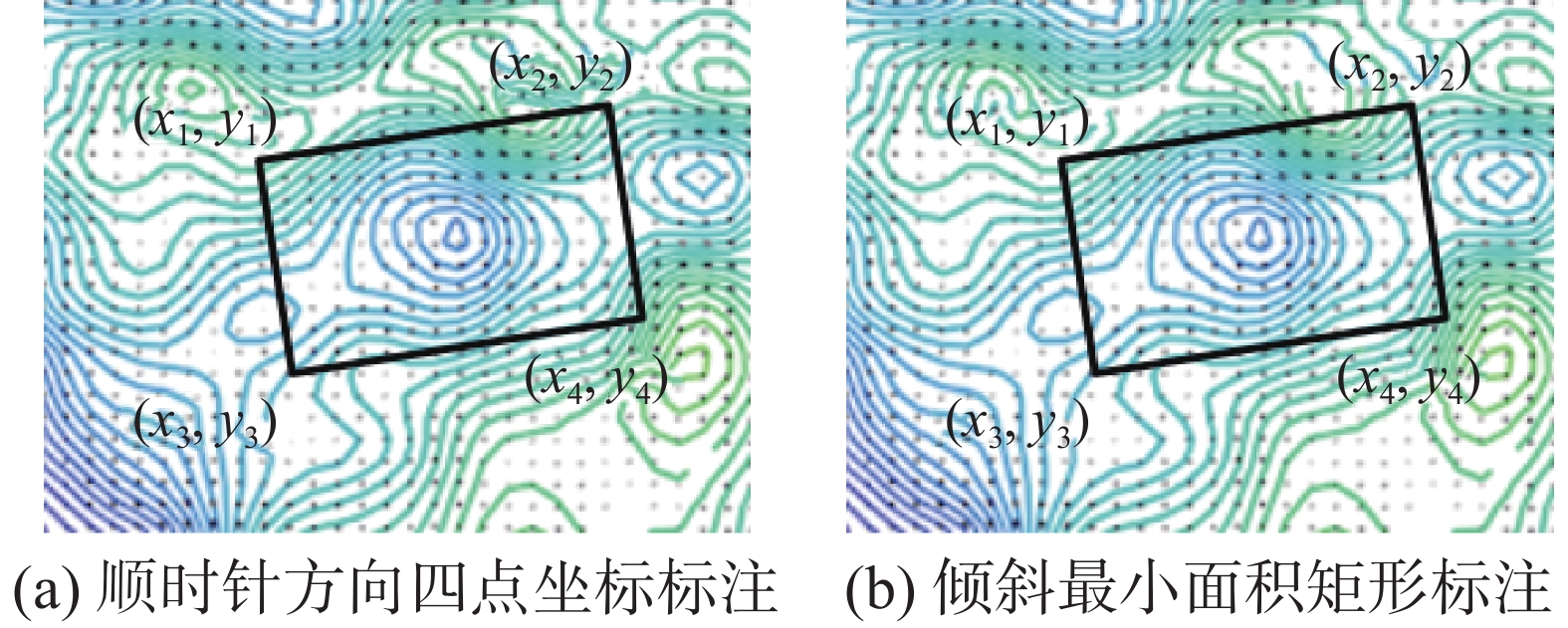

本文采用斜框检测实现海洋涡旋的旋转检测,真值框由4个坐标点(x1, y1, x2, y2, x3, y3, x4, y4)表示,4个坐标点以顺时针方向排列,虽然倾斜矩形的直接表示方法是用一个角度来表示其方向,例如RRPN(rotation region proposal networks)[21]等。但由于角度目标在某些特殊点上表现不稳定,所以本文不使用角度来表示方向信息。如图5(a)所示,直接预测旋转框的4个坐标点复杂性较高。为了降低计算的复杂性,采用矩形的两个坐标点和矩形的高(x1, y1, x2, y2, h)来表示实现斜矩形的预测。这里的第1个点指的是左上角的点,第2个点是顺时针方向的第二个点,h是倾斜最小面积矩形的高度,具体如图5(b)所示。

1.2.2 倾斜非极大值抑制

非极大值抑制目的是提取置信度高的目标检测框,抑制置信度低的误检框。一般来说,当解析模型输出到目标框时,目标框非常多,存在很多重复的框定位到同一个目标,通过非极大值抑制去除重复的框,获得最终的目标框。通常非极大值抑制都是在正候选框上进行,轴对齐交叉比(IoU)[22]计算可能会导致偏差交互的IoU不准确[23],从而存在一些正候选框被抑制的现象。如图6(a)所示,如果两个正候选框的IoU很大,根据非极大值抑制的规则,会将其中一个框舍去,进而导致漏检,本文采用如图6(b)所示的斜非极大值抑制。计算倾斜IoU方法如下:1)计算出两个矩形交点,然后补充一个矩形在另一个矩形内的顶点,2)计算出两个矩形的并集,再减去每个矩形中非交集的部分,如图7(a)、7(b)中的黄色部分和阴影部分,即可得IoU的值[22]。

为更好地对密集分布区域的海洋涡旋进行精准检测,该模型在考虑IoU的基础上,兼顾考虑了角度因素。即倾斜非极大值抑制在原有的基础上增加了如下信息:1)保留IoU大于0.7的最大的候选框;2)如果所有的候选框IoU均位于 [0.3−0.7] ,保留小于 π/12 的最小候选框。对于一些密集排列的海洋涡旋,传统的非极大值抑制可能会导致漏检,而倾斜非极大值抑制可以解决这个问题,因为倾斜IoU值很低且角度差很小。

1.3 旋转区域检测网络

海洋涡旋的非规则螺旋状结构普遍存在大长宽比的特点,尤其处于衰退期的涡旋随着能量的耗散,其形态结构呈现趋于松散加剧了大长宽比的问题,特别是分布密集区域海洋涡旋目标,现有水平检测导致检测区域冗余、重叠和嵌套导致检测精度低的问题显著。采用R2CNN的机制可以有效解决上述问题,但是R2CNN采用RoI Pooling来获得固定长度的特征向量。而对于小尺度海洋涡旋检测,该方法像素的丢失可能会导致特征的丢失,以至于检测不到目标对象。

1.3.1 池化层改进

针对上述问题,本文采用Mask R-CNN[24]算法中提出的思想,引入RoI Align方法进行池化,利用双线性插值法进行插值,保留浮点数,避免取整带来的精度损失,以提高空间对称性[25]保持了特征信息的完整性。RoI Pooling、RoI Align 结构如图8所示。

两者具体实现过程如下:

1)第1次量化。假设图像中目标尺寸为800像素×800像素,候选框为665像素×665像素。经过特征提取网络后,图像缩小为原图的1/32。对于候选框,RoI Align第1次量化(保留浮点数)后映射到特征图中的大小:665/32=20.78,即20.78像素×20.78像素,而RoI Pooling第1次量化(取整)后尺寸变为20像素×20像素。

2)第2次量化。候选框经过池化固定为7×7尺寸,将划分为49(7×7)个等子区域,RoI Align 第2次量化(保留浮点数)每个子区域取20.78/7=2.97,即2.97像素×2.97像素;RoI Pooling第2次量化(取整)子区域取2像素×2像素。

3)最大值池化。每个子区域取最大值作为该区域的“代表”值,输出的49个值组成7×7大小的特征图。

由上可知,RoI Pooling经过2次取整量化产生的像素偏差对后续的回归定位会产生影响。RoI Align利用双线性插值法保留浮点数,有效解决了像素映射偏差带来的定位误差问题。

对于上述提到的双线插值算法定义如下:

沿x方向的线性插值为

$$ f(x,{y_1}) \approx \frac{{{x_2} - x}}{{{x_2} - {x_1}}}f({Q_{11}}) + \frac{{x - {x_1}}}{{{x_2} - {x_1}}}f({Q_{21}}) $$ (1) $$ f(x,{y_2}) \approx \frac{{{x_2} - x}}{{{x_2} - {x_1}}}f({Q_{12}}) + \frac{{x - {x_1}}}{{{x_2} - {x_1}}}f({Q_{22}}) $$ (2) 式中:

${Q_{ab}} = ({x_a},{y_b})(a = 1,2;b = 1,2)$ ,表示已知的4个坐标;$f(x,{y_1})$ 、$f(x,{y_2})$ 表示沿x方向进行线性插值。沿y方向的进行线性插值为

$$ f(x,y) \approx \frac{{{y_2} - y}}{{{y_2} - {y_1}}}f(x,{y_1}) + \frac{{y - {y_1}}}{{{y_2} - {y_1}}}f(x,{y_2}) $$ (3) 目标的线性插值结果为

$$\begin{gathered} f(x,y) \approx \frac{{{y_2} - y}}{{{y_2} - {y_1}}}\left( {\frac{{{x_2} - x}}{{{x_2} - {x_1}}}f({Q_{11}}) + \frac{{x - {x_1}}}{{{x_2} - {x_1}}}f({Q_{21}})} \right) + \\ \frac{{y - {y_1}}}{{{y_2} - {y_1}}}\left( {\frac{{{x_2} - x}}{{{x_2} - {x_1}}}f({Q_{12}}) + \frac{{x - {x_1}}}{{{x_2} - {x_1}}}f({Q_{22}})} \right) \end{gathered}$$ (4) 2. 实验结果与分析

本文实验基于TensorFlow框架来构建和训练模型,模型训练过程在一台GPU(Tesla P100-PCIE)服务器环境下进行。为减少模型训练量,使用ResNet主干网在ImageNet数据集上预训练的模型参数。训练及测试过程中相关参数如下:输入图像大小为1240像素×968像素,网络的学习率为0.001。RPN网络阶段相关参数设置如下:IoU正样本阈值为0.7,负样本阈值为0.3;NMS(non maximum suppression)的IoU阈值为0.7;anchor scale为(4,8,16,32),ratios为{1∶1,1∶2,2∶1,1∶3,3∶1}。Fast R-CNN网络阶段参数设置如下:NMS的IoU阈值为0.7;IoU正样本阈值为0.5。

2.1 样本采样和数据扩充

采用的数据集为TOPEX/Poseidon、Jason-1/2、ERS-1/2和ENVISAT等卫星高度计测高数据的融合产品,由法国空间局的AVISO(archiving, validation and interpretation of satellite oceanographic data)数据分发中心提供,包括网格化地转流场和海平面异常数据(sea level anomaly, SLA),该数据下载服务由欧洲哥白尼海洋环境监测中心(CMEMS)提供,并通过网站(http://marine.copernicus.eu/)下载。数据的空间分辨率为0.25°×0.25°,时间分辨率为逐日,时间跨度为自1993至今,数据以网格化格式呈现,以NetCDF文件形式保存。

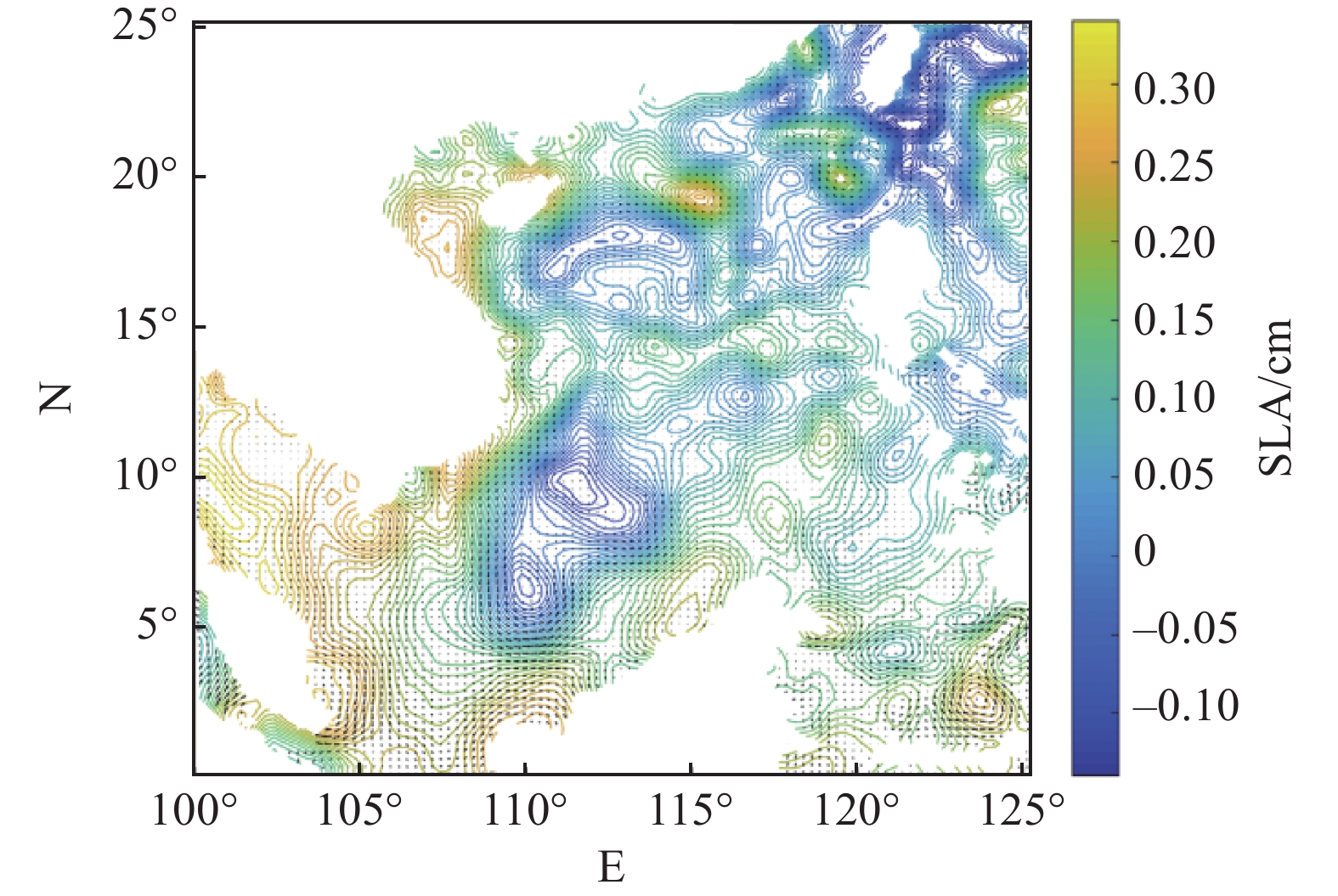

本文选取中国南海(0°−25°N,100°−125°E)5年(2011−2015)的海平面异常(SLA)数据进行海洋中尺度涡的研究。为了确保数据的多样性和丰富性,以1月的1号、11号、21号SLA数据作为该月的代表,2月的2号、12号、22号SLA数据作为该月的代表,以此类推,每月以等差数列的形式选取数据,共采集180个SLA数据。其中,选取2011−2013年的数据作为训练集,2014−2015年的数据作为测试集。SLA数据可视化后的图像,即向专家提供的信息如图9所示,包括海平面高度异常、矢量场速度、地转流流速。其中,地转流流速是这样计算的:

$$ u = \frac{g}{f}\frac{{\partial \xi }}{{\partial x}},v = \frac{g}{f}\frac{{\partial \xi }}{{\partial y}} \text{,} $$ (5) $$ {\rm{speed}} = \sqrt {{u^2} + {v^2}} $$ (6) 式中:u和v为地转流速度经向和纬向分量,g为重力加速度,f为科里奥利参数,ξ为海平面高度异常场。SLA数据以等高线、矢量线和彩色图可视化在图像上,等高线的间距单位为cm,陆地部分在nc文件中SLA值显示为空值,这样可以避免可视化异常和干扰检测。

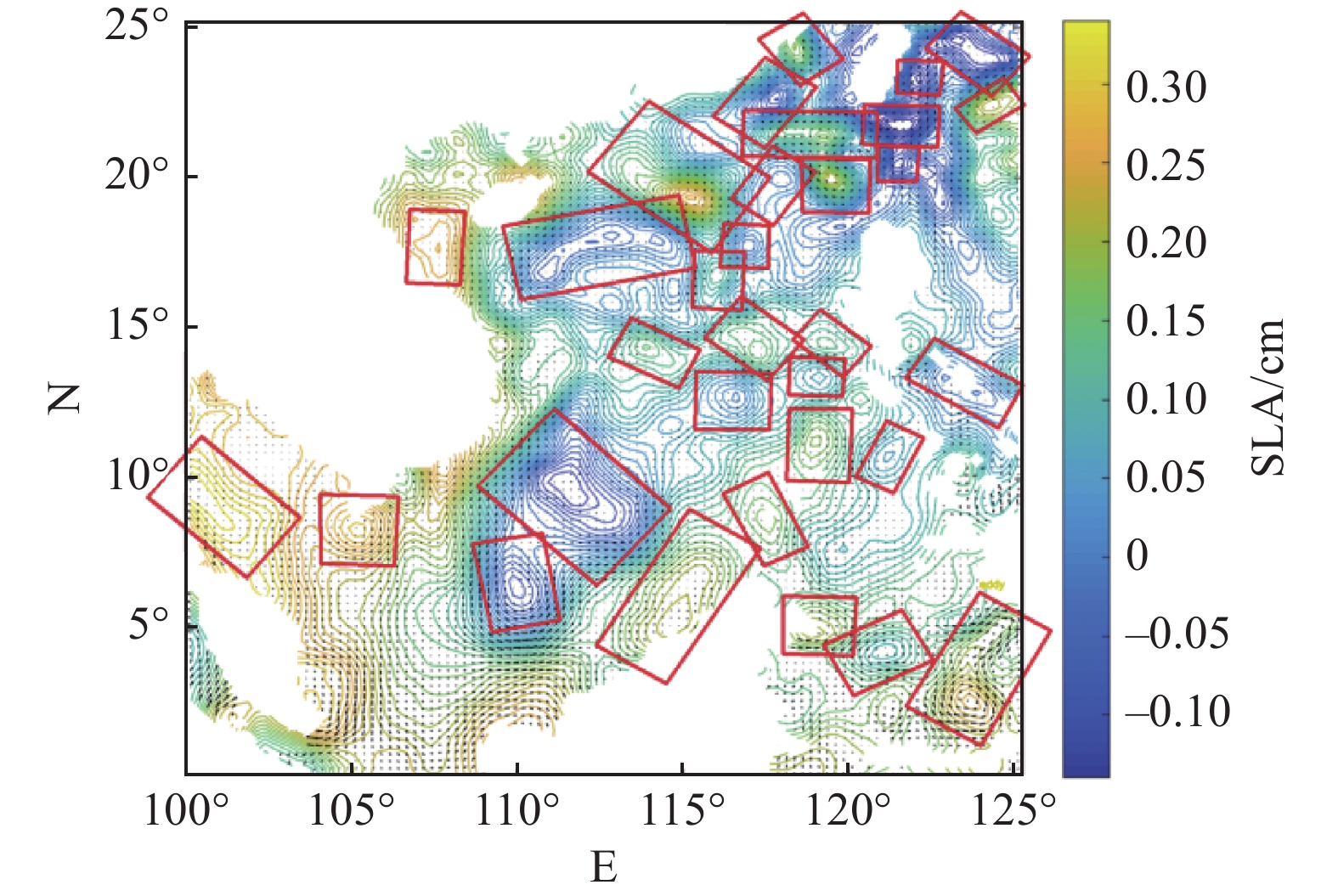

可视化后的图像由3名专业人员手工标注,2名专业人员负责初始标注,另1名专业人员负责纠正错误标注和添加遗漏标注。在中尺度涡图像标注过程中,专家一方面依靠对海洋中尺度涡的理解和认识,另一方面参考每日全球中尺度海洋涡旋卫星高度计数据集,使用数据标注平台Labelme对可视化的SLA图像进行中尺度涡标注如图10。我们参考中尺度涡的生成依据下面3个条件进行中尺度涡的真值框标注:1)图像中尺度在0~4像素的海洋涡旋不进行标注;2)等高线呈现仅有一个闭合环的不进行标注;3)多核涡采用两个框标注,专家标注过的图像将以json文件形式保存,然后再将其转换为模型可以识别的XML文件格式,每幅图像将对应一个唯一的标注文件,文件中包含对象的标签和位置信息,以保证对原始图像执行扩充操作的同时,标注数据也进行相同的扩充操作,避免了数据扩充后重新标注的问题。

训练集构建包括3个步骤:1)利用等高线、矢量线和彩色图可视化海平面高度异常数据生成海洋中尺度涡图像,形成闭合环的等高线即为海洋涡旋;2)基于第一步的可视化结果由专家进行标注;3)采用二维图像处理技术对以上两步产生的数据集进行扩充操作。具体操作为:使用双线性插值算法将训练集每张图像按30°、60°、90°、120°、150°、180°、210°、240°、270°、300°、330°旋转获得11张新的图像;同时也用常规的数据增强方法将原始图像进行水平、垂直、对角的镜像变换获得3张新的图片;再将这些图片同一裁剪成1480像素×1150像素。并以相同的方式旋转了标记xml文件,对于每张图片获得14个新的xml文件。因此,108张训练图像被扩充到了1512张图像。之后添加均值为0,方差为0.0055的高斯噪声,在保证中尺度涡基本特征的同时引入了信噪比因素,这一操作完成后数据集扩充到3024张图像。

2.2 检测结果对比

利用构建的网络在南海区域海洋涡旋数据集上进行测试。选取召回率(Pression)、精确率(Recall)及 F1值(F1-measure)作为评价指标。为了说明提出模型的有效性,与当前经典的深度学习目标检测网络进行了对比分析,结果如表1所示。

表 1 不同方法在涡旋目标检测结果Table 1 Experimental results of different methods for eddy objects% 检测方法 召回率 精确率 F1值 Faster 65.6 86.2 74.5 RRPN 81.9 83.1 82.5 R2CNN 78.0 84.7 81.2 R2-DCNN 90.1 96.4 93.1 如表1所示,与Faster R-CNN、RRPN、 R2CNN相比,提出的网络取得了最先进的性能,召回率90.1%,精确率96.4%,F1值93.1%。相对于传统的R2CNN,3个评价指标都有明显提升。Faster R-CNN的召回率最低,主要是由于在其进行非最大抑制过程中,当涡旋排列密集时,水平区域检测通常将两个海洋涡旋检测成一个,发生漏检问题。基于R2CNN斜框检测和及改进的倾斜非极大值抑制,可以有效解决漏检问题,如图11所示。

为了验证提出检测网络中各模块的有效性, 进行了一系列对比实验. 表2给出了所提网络在南海海域的海洋涡旋数据集上不同模块分离的检测结果。可以看出与RoI Pooling方法比,RoI Align池化方法准确率有明显提高。因为数据集中小尺度海洋涡旋比较多,尤其是在分布密集区域。RoI Align池化方法减少了池化过程中的像素偏差,对模型检测精度提升有较好的效果。如图12所示(红色虚线框代表漏检),对比分析了DFPN模块对检测网络模型性能的影响,通过检测结果的可视化发现,DFPN模块可以提高对小尺度海洋涡旋的检测能力,对于尺度变化大的海洋涡旋也表现出较好的检测效果。

表 2 R2-DCNN模块分离检测实验结果Table 2 R2-DCNN module separates detection results% 检测方法 密集特征金字塔 RoI Align 召回率 精确率 F1值 R2-DCNN1 × √ 85.2 90.1 87.6 R2-DCNN2 √ × 86.6 94.2 90.2 R2-DCNN3 √ √ 90.1 96.4 93.1 图13是4种经典模型的海洋涡旋检测结果图以及局部区域放大图。海洋涡旋空间尺度变化大,且在密集分布区域小尺度海洋涡旋普遍存在。可以看出所提检测网络模型对于密集分布、尺度变化大且带有方向的海洋涡旋,表现了较好的检测能力,并且检测精度高。实验对比分析发现,所提出的检测模型可以有效解决由于尺度变化大、分布密集以及小尺度海洋涡旋广泛存在导致的检测精度低的问题。

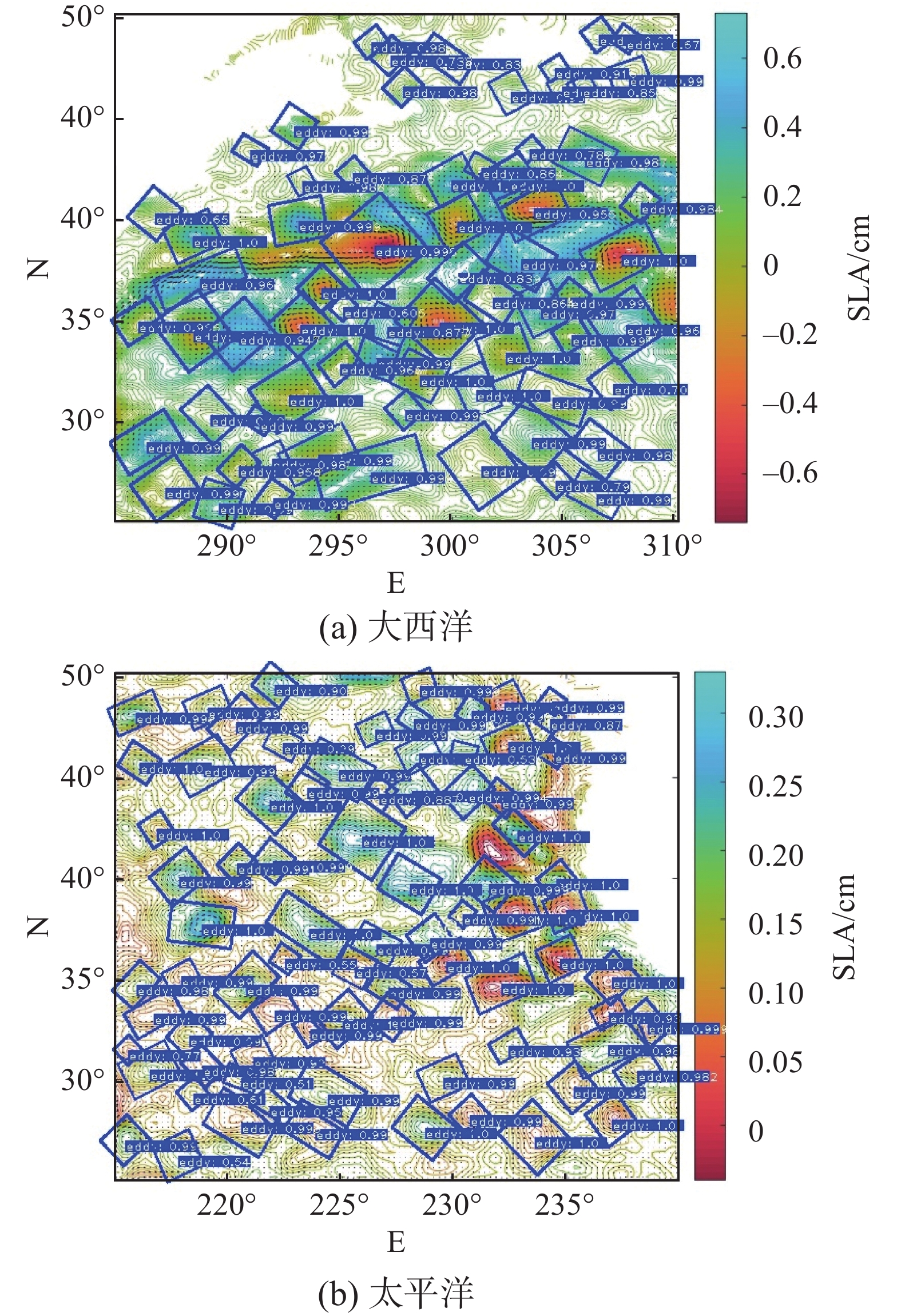

为了验证该方法的泛化能力,选择2015年多个海域的SLA数据进行了实验。其中,选取中尺度涡数量较多的海洋区域进行测试,包括太平洋(25°−50°N, 145°−120°W)和大西洋(25°−50°N, 75°−50°W)两个海域,以每月的15号代表该月。使用训练好的模型进行评估测试,如表3所示是不同海域评测结果,如图14所示是不同海域采用本文所提算法的测试效果图。可以看出本文算法对于密集排列,并且尺度变化较大的目标群体十分有效。

表 3 不同海域在涡旋目标的实验结果Table 3 Experimental results of different sea areas for eddy objects% 海洋区域 召回率 精确率 F1值 大西洋 91.2 93.0 92.1 太平洋 93.3 94.5 93.9 3. 结束语

本文研究了深度学习在海洋遥感数据处理与分析中的应用,在实际应用中,通过人工判别涡旋任务繁重、不仅效率过低而且难度过大。同时针对海洋涡旋存在的尺度变化大、分布密集和小尺度海洋涡旋广泛存在的特点,提出了一种多尺度目标旋转检测网络,对海洋涡旋进行旋转检测,通过减少检测区域的冗余,显著提升了海洋涡旋的检测精度,并获取了更加贴合海洋涡旋目标的检测框。该网络模型主要通过融合特征金字塔,并进行密集连接增强特征的传播和重用;其次 ,改进了旋转检测R2CNN网络,采用多尺度RoI Align对传统RoI Pooling进行替换,达到空间信息和语义信息的完整性,获取更加丰富的特征表达。实验结果表明,提出的网络模型在海洋涡旋数据集上表现出较好的检测性能,最优检测精度可达96.4% 。然而所提出方法存在检测速度较慢、GPU资源消耗较大等缺点, 因此在后续的工作中也将针对网络的轻量化展开进一步研究。

-

表 1 不同方法在涡旋目标检测结果

Table 1 Experimental results of different methods for eddy objects

% 检测方法 召回率 精确率 F1值 Faster 65.6 86.2 74.5 RRPN 81.9 83.1 82.5 R2CNN 78.0 84.7 81.2 R2-DCNN 90.1 96.4 93.1 表 2 R2-DCNN模块分离检测实验结果

Table 2 R2-DCNN module separates detection results

% 检测方法 密集特征金字塔 RoI Align 召回率 精确率 F1值 R2-DCNN1 × √ 85.2 90.1 87.6 R2-DCNN2 √ × 86.6 94.2 90.2 R2-DCNN3 √ √ 90.1 96.4 93.1 表 3 不同海域在涡旋目标的实验结果

Table 3 Experimental results of different sea areas for eddy objects

% 海洋区域 召回率 精确率 F1值 大西洋 91.2 93.0 92.1 太平洋 93.3 94.5 93.9 -

[1] 张盟, 杨玉婷, 孙鑫, 等. 基于深度卷积网络的海洋涡旋检测模型[J]. 南京航空航天大学学报, 2020, 52(5): 708–713. doi: 10.16356/j.1005-2615.2020.05.005 ZHANG Meng, YANG Yuting, SUN Xin, et al. Ocean eddy detection model based on deep convolution neural network[J]. Journal of Nanjing University of aeronautics & astronautics, 2020, 52(5): 708–713. doi: 10.16356/j.1005-2615.2020.05.005 [2] 沈飙, 陈扬, 杨琛, 等. 海洋科学中尺度涡的计算机视觉检测和分析方法[J]. 数据与计算发展前沿, 2020, 2(6): 30–41. SHEN Biao, CHEN Yang, YANG Chen, et al. Computer vision detection and analysis of mesoscale eddies in marine science[J]. Frontiers of data & computing, 2020, 2(6): 30–41. [3] 董昌明, 蒋星亮, 徐广珺, 等. 海洋涡旋自动探测几何方法、涡旋数据库及其应用[J]. 海洋科学进展, 2017, 35(4): 439–453. DONG Changming, JIANG Xingliang, XU Guangjun, et al. Automated eddy detection using geometric approach, eddy datasets and their application[J]. Advances in marine science, 2017, 35(4): 439–453. [4] NENCIOLI F, DONG Changming, DICKEY T, et al. A vector geometry-based eddy detection algorithm and its application to a high-resolution numerical model product and high-frequency radar surface velocities in the southern California bight[J]. Journal of atmospheric and oceanic technology, 2010, 27(3): 564–579. doi: 10.1175/2009JTECHO725.1 [5] CHELTON D B, SCHLAX M G, SAMELSON R M. Global observations of nonlinear mesoscale eddies[J]. Progress in oceanography, 2011, 91(2): 167–216. doi: 10.1016/j.pocean.2011.01.002 [6] ALPERS W, BRANDT P, LAZAR A, et al. A small-scale oceanic eddy off the coast of West Africa studied by multi-sensor satellite and surface drifter data[J]. Remote sensing of environment, 2013, 129: 132–143. doi: 10.1016/j.rse.2012.10.032 [7] FAGHMOUS J H, CHAMBER Y, BORIAH S, et al. A novel and scalable spatio-temporal technique for ocean eddy monitoring[C]//AAAI’12: Proceedings of the Twenty-Sixth AAAI Conference on Artificial Intelligence. New York: ACM, 2012: 281−287. [8] ASHKEZARI M D, HILL C N, FOLLETT C N, et al. Oceanic eddy detection and lifetime forecast using machine learning methods[J]. Geophysical research letters, 2016, 43(23): 12234–12241. doi: 10.1002/2016GL071269 [9] KARIMOVA S. Spiral eddies in the Baltic, Black and Caspian Seas as seen by satellite radar data[J]. Advances in space research, 2012, 50(8): 1107–1124. doi: 10.1016/j.asr.2011.10.027 [10] ISERN-FONTANET J, GARCÍA-LADONA E, FONT J. Identification of marine eddies from altimetric maps[J]. Journal of atmospheric and oceanic technology, 2003, 20(5): 772–778. doi: 10.1175/1520-0426(2003)20<772:IOMEFA>2.0.CO;2 [11] YI J, DU Y, HE Z, et al. Enhancing the accuracy of automatic eddy detection and the capability of recognizing the multi-core structures from maps of sea level anomaly[J]. Ocean science, 2014, 10(1): 39–48. doi: 10.5194/os-10-39-2014 [12] HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al. Deep residual learning for image recognition[C]//IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas: IEEE, 2016: 770−778. [13] LIN T Y, DOLLÁR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]//IEEE Conference on Computer Vision and Pattern Recognition. Honolulu: IEEE, 2017: 936−944. [14] LIN T Y, GOYAL P, GIRSHICK R, et al. Focal loss for dense object detection[C]//IEEE International Conference on Computer Vision. Venice: IEEE, 2017: 2999−3007. [15] REN Shaoqing, HE Kaiming, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE transactions on pattern analysis and machine intelligence, 2017, 39(6): 1137–1149. doi: 10.1109/TPAMI.2016.2577031 [16] DUO Zijun, WANG Wenke, WANG Huizan. Oceanic mesoscale eddy detection method based on deep learning[J]. Remote sensing, 2019, 11(16): 1921. doi: 10.3390/rs11161921 [17] JIANG Yingying, ZHU Xiangyu, WANG Xiaobing, et al. R2CNN: rotational region CNN for orientation robust scene text detection[EB/OL]. (2017−06−30)[2020−01−01].https://arxiv.org/abs/1706.09579. [18] YANG Xue, SUN Hao, FU K, et al. Automatic ship detection in remote sensing images from google earth of complex scenes based on multiscale rotation dense feature pyramid networks[J]. Remote sens, 2018, 10: 132. doi: 10.3390/rs10010132 [19] SIMONYAN K , ZISSERMAN A . Very deep convolutional networks for large-scale image recognition[EB/OL]. (2014−10−04)[2020−01−01].https://www.semanticscholar.org/paper/Very-Deep-Convolutional-Networks-for-Large-Scale-Simonyan-Zisserman/eb42cf88027de515750f230b23b1a057dc782108. [20] 单志勇, 张鐘月. 基于改进Faster R-CNN算法的行人检测[J]. 现代计算机, 2021, 27(23): 124–128. SHAN Zhiyong, ZHANG Zhongyue. Pedestrian detection based on improved faster R-CNN algorithm[J]. Modern computer, 2021, 27(23): 124–128. [21] MA Jianqi, SHAO Weiyuan, YE Hao, et al. Arbitrary-oriented scene text detection via rotation proposals[J]. IEEE transactions on multimedia, 2018, 20(11): 3111–3122. doi: 10.1109/TMM.2018.2818020 [22] 戴媛, 易本顺, 肖进胜, 等. 基于改进旋转区域生成网络的遥感图像目标检测[J]. 光学学报, 2020, 40(1): 270–280. DAI Yuan, YI Benshun, XIAO Jinsheng, et al. Object detection of remote sensing image based on improved rotation region proposal network[J]. Acta optica sinica, 2020, 40(1): 270–280. [23] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]//2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus: IEEE, 2014: 580−587. [24] HE Kaiming, GKIOXARI G, DOLLÁR P, et al. Mask R-CNN[C]//IEEE International Conference on Computer Vision. Venice: IEEE, 2017: 2980−2988. [25] 李广帅, 苏娟, 李义红. 基于改进Faster R-CNN的SAR图像飞机检测算法[J]. 北京航空航天大学学报, 2021, 47(1): 159–168. LI Guangshuai, SU Juan, LI Yihong. An aircraft detection algorithm in SAR image based on improved Faster R-CNN[J]. Journal of Beijing University of aeronautics and astronautics, 2021, 47(1): 159–168.

下载:

下载: