互联网技术的迅猛发展给汽车工业带来了革命性的变化,高精度地图的进步与普及使得车辆实时精准定位成为可能,与此同时,智能驾驶技术的广泛应用使汽车驾驶变得更简单更智能。互联网、高精度地图与智能驾驶技术相结合,共同推动了无人驾驶汽车技术的发展。

1 无人驾驶汽车发展现状近年来,随着市场对汽车主动安全和智能化需求的不断提高,无人驾驶巨大的社会和经济价值越发凸显,越来越多的企业与科研机构积极参与并推动无人驾驶领域的发展。目前,能够实现完全无人驾驶的车辆还没有正式批量生产销售,但已经有相当一部分实验车型可以通过环境感知实现高度自主驾驶行为,如起步、加速、制动、车道线跟踪、换道、避撞、停车等。表1给出了NHTSA (national highway traffic safety administration)对无人驾驶的定义[1],它将无人驾驶分为5个等级,分别是高级辅助驾驶(advanced driver assistance systems)、特定功能辅助、组合功能辅助、高度自动驾驶以及完全无人驾驶。如表1所示,目前大部分车型都还停留在组合功能辅助阶段(Level 2级),要实现完全无人驾驶车的量产化,还有很长一段路要走。

1.1 国外无人驾驶汽车发展现状20世纪70年代初,许多发达国家(如美国、英国、德国等)开始研究无人驾驶汽车,经过长时间的发展,无人驾驶汽车在可行性和实用化方面都取得了突破性的进展[2]。1995年,美国卡纳基梅隆大学研制的无人驾驶汽车Navllab-V,完成了横穿美国东西部的无人驾驶实验[3]。2005年,在美国国防部组织的“大挑战”比赛中,由美国斯坦福大学改造的无人汽车,经过沙漠、隧道、泥泞的河床以及崎岖陡峭的山道最终获得成功[4]。近年来由于谷歌、特斯拉、奔驰、宝马等纷纷加入无人驾驶汽车的研究,无人驾驶技术有了突飞猛进的发展。

| 表 1 NHTSA对无人驾驶的定义 Tab.1 NHTSA definition of driverless |

作为当前无人驾驶的领跑者,Google X实验室从2007年初就开始筹备无人驾驶汽车的各项研究工作,并于2010年正式宣布相关工作的进展。2012年5月,美国内华达州的机动车驾驶管理处为谷歌的无人驾驶汽车颁发了美国首例自动驾驶汽车的路测许可[5]。2015年6月,2辆谷歌无人驾驶原型车开始上路测试,如图1所示。为了完成对车子在X,Y,Z这3个方向上的数据测量(加速度等),谷歌公司在汽车底部安装了一个动力系统,利用GPS技术对过往的其他车辆位置进行确认,最后利用智能算法对车辆下一步的行动进行预测。截至2016年8月,谷歌共有58辆无人驾驶汽车,这些车在加州、内华达州、德州、山景城、菲尼克斯和奥斯汀等允许自动驾驶汽车路测的地区进行实际路测,据Google发布的自动驾驶项目月报显示,截至2016年8月30日,累计行驶距离已经超过约2.9×106 km,平均每周1.5~1.7万英里[6-11]。

|

Download:

|

| 图 1 Google无人驾驶汽车 Fig. 1 Google self-driving car | |

紧随其后的特斯拉ModelS系列汽车,其“Autopilot”技术近年来已经取得重大突破,为了让车子能够实时地感知外部环境,该公司还在车身上安装了一些设备,比如摄像头、雷达等,无人汽车主要利用传感器反馈的信息来实现自动并道、自动停车等辅助驾驶功能,该功能获得了众多试驾者的一致好评。据2016年5月份的数据,特斯拉旗下的电动汽车已通过Autopilot自驾功能累计行驶大约1.6×108 km。虽然目前特斯拉的Autopilot技术仅被美国国家公路交通安全管理局(NHTSA)认定为Level 2阶段,但是作为迄今为止量产车型中自动驾驶系统应用最成功的企业,特斯拉向我们展示了在某些特定路况下,汽车已经基本实现自动驾驶[12]。

在2013年9月奔驰汽车公司宣布他们生产的S级轿车完成了从德国曼海姆到达普福尔茨海姆的自动驾驶,这段自动驾驶的总长度为100 km。2015年1月,在国际消费电子展(CES)上奔驰发布旗下F015 Luxury in Motion自动驾驶概念级豪华轿车,在美国旧金山通过路试[13]。

2006年,宝马公司开始在赛道上尝试对汽车的自动驾驶进行测试,其中包括自动启动和停车等。2011年,宝马公司的无人汽车首次在德国进行路试,测试它对其他汽车进行自动躲避障碍等功能。宝马汽车公司在2014年5月公布了研发的辅助驾驶系统 “Urban Roads:BAN research”。该辅助驾驶系统可以提供异常预警和驾驶线路的选择,还可以调整发动机的动力配置。2014年7月,百度公司和宝马公司合作进行了无人驾驶车的研发和制造。其中,数据分析和技术服务由百度负责,硬件设计和制造由宝马承担。此系统的城市路况和高速公路路况的测试工作于2015年底成功完成。2016年7月1日晚,宝马、英特尔及Mobileye联合举行发布会,宣布三方合作,协同开发无人驾驶电动车iNext,同时声明宝马将于2021年与两家合作伙伴共同推出无人驾驶汽车[14]。

据英国汽车杂志Autocar报道,全新一代奥迪A8将于2017年上市,奥迪A8如图2所示。该车率先采用全自动无人驾驶系统“TrafficJam Assist”,该系统能够在无需任何人类干涉的情况下自动控制汽车,以速度80 km/h运行[15-16]。

|

Download:

|

| 图 2 奥迪无人驾驶汽车 Fig. 2 Audiautonomous vehicle | |

丰田于2015年对自动驾驶项目拨款10亿美元,同时与斯坦福、MIT和密歇根大学合作,特别值得一提的是,丰田是目前自动驾驶专利最多的车企,拥有1 400多项专利技术[17]。

2013年9月,日产公司取得了对研发的自动驾驶汽车进行公路测试的资格牌照,并于2015年10月起进行搭载了Piloted Drive 1.0自动驾驶系统的Leaf(聆风)电动车的原型车测试工作,测试地点为日本首都圈。为了能够获得周围360°的全方位信息,该车配备的240个传感器,包括12个摄像头,5个雷达,4个激光扫描仪及超声波传感器。2016年7月,日产于总部横滨发布了第5代Serena车型,该车型配有最新的自动驾驶系统ProPILOT,能够满足在单向车道中自动行驶的需求[18]。

2014年4月,本田公司在5条指定公路上进行了辅助驾驶系统的测试,并在2014年9月在美国底特律召开的智能交通系统大会上进行了展示发布,该系统能够进行自动转向、变道及超车的操作。2016年5月,本田在GoMentum Station测试基地对第二代无人驾驶版讴歌RLX测试车开展了实地测试工作。

美国大众汽车公司的无人驾驶技术研发始于参加DARPA(美国国防部高级研究计划局)无人驾驶汽车挑战赛。与美国斯坦福大学合作改装的大众途锐(Touareg)TDI R5在 2005年的越野赛中取得了第一名的成绩;2007年参加的城市赛中车型为帕萨特运动款(Passat SportWagen),取得了第二名的成绩。2015年10月,大众汽车与美国内华达大学合作进行了无人驾驶测试,测试地点为美国亚利桑那州的诺加莱斯(Nogales)和墨西哥首都墨西哥城之间,测试距离长达2400 km,创造了墨西哥境内完成的最长测试距离的无人驾驶纪录[19-21]。

福特公司的无人驾驶团队于2015年成立,该团队由在公司工作近30年的资深专家Randy Visintainer担任负责人。福特公司在2016年入股了云计算方面的公司Pivotal Software,总共费用高达83亿美元,其目的在于增强自己在自动驾驶中的云计算能力。2016年7月,福特与麻省理工学院发起了一项关于机器学习和自动驾驶系统的研究计划,该计划旨在解决车辆碰撞问题以及改进自主路线规划[22]。

博世公司作为全球汽车零件供应和技术的巨头,早在2011年开始就对无人驾驶进行研究,同时持续在加州帕洛阿尔帕托技术中心进行自动驾驶测试。博世在2015年的CES展会上,展示了该公司最新的辅助驾驶系统,并在JEEEP的切诺基车型上进行了实际演示。该辅助系统由4个模块组成:摄像头、雷达、智能预刹车以及距离传感器。这些模块可以帮助驾驶人员更好地处理各种紧急事件提高车辆的安全性能。2016年4月和6月,博世分别在北京国际车展和位于美国密歇根州Flat Rock的试验场地上展示了最新产品,其中包括驾驶员辅助系统、第六代超声波雷达和互联汽车等[23-25]。

2016年5月25日,Uber宣布获得丰田公司的战略投资,丰田除了帮Uber开拓现有的车辆租赁业务外,双方还计划在无人驾驶研发方面进行合作。2016年8月19日Uber宣布与沃尔沃合作,预计2021年推出无人驾驶出租车,原型车于当月起在匹兹堡上路测试[26]。

Delphi(德尔福)汽车于2015年3月完成了大约5 600 km的无人驾驶测试。该无人驾驶汽车是根据奥迪SQ5改装而成的。2016年8月23日,Delphi Automotive和Mobileye宣布,将合作开发一款符合SAE(美国汽车工程协会)规定的4级自动驾驶全套解决方案,该方案为端对端、可量产、高性能和安全操作的全自动驾驶解决方案(市场上首个一站式4/5级自动驾驶解决方案)[27]。

2015年,Drive.ai公司从斯坦福大学人工智能实验室分出来。该公司的核心成员都具有丰富的深度学习研究背景,因此公司利用深度学习算法解决了车辆的自动驾驶问题。2016年4月底,该公司获得了美国加利福尼亚州测试无人驾驶汽车的许可[28]。

2016年8月25日,NuTonomy公司利用NASA+MIT技术,让无人驾驶出租车(见图3)在新加坡率先完成试运营载客。该公司的无人驾驶出租车装有6套激光雷达检测系统,同时仪表盘上还有两个摄像头,用来扫描障碍和检测红绿灯变化。NuTonomy使用激光雷达数据能提供更准确的定位,不仅能检测道路上的物体,还能检测出汽车周围的静态物体。为了更好地发展无人驾驶汽车的经济价值,该公司还开发调配和指挥无人驾驶出租车的云计算软件,指挥无人驾驶出租车队[29]。

|

Download:

|

| 图 3 NuTonomy无人驾驶汽车 Fig. 3 NuTonomy driverless car | |

无人驾驶技术在国内的发展较晚,1992年国防科技大学成功研制出中国第一辆红旗系列无人驾驶汽车[30];经过一系列的努力和研制,直到2011年7月14日,首次在高速上实现长沙到武汉约286 km的全程无人驾驶实验,成为了首个中国自主研制的无人驾驶车辆,突破了在复杂交通状况下的自主驾驶的新纪录,这次成功标志着中国无人驾驶技术在复杂环境识别、智能行为决策和控制等方面的技术突破,达到世界先进水平[31]。

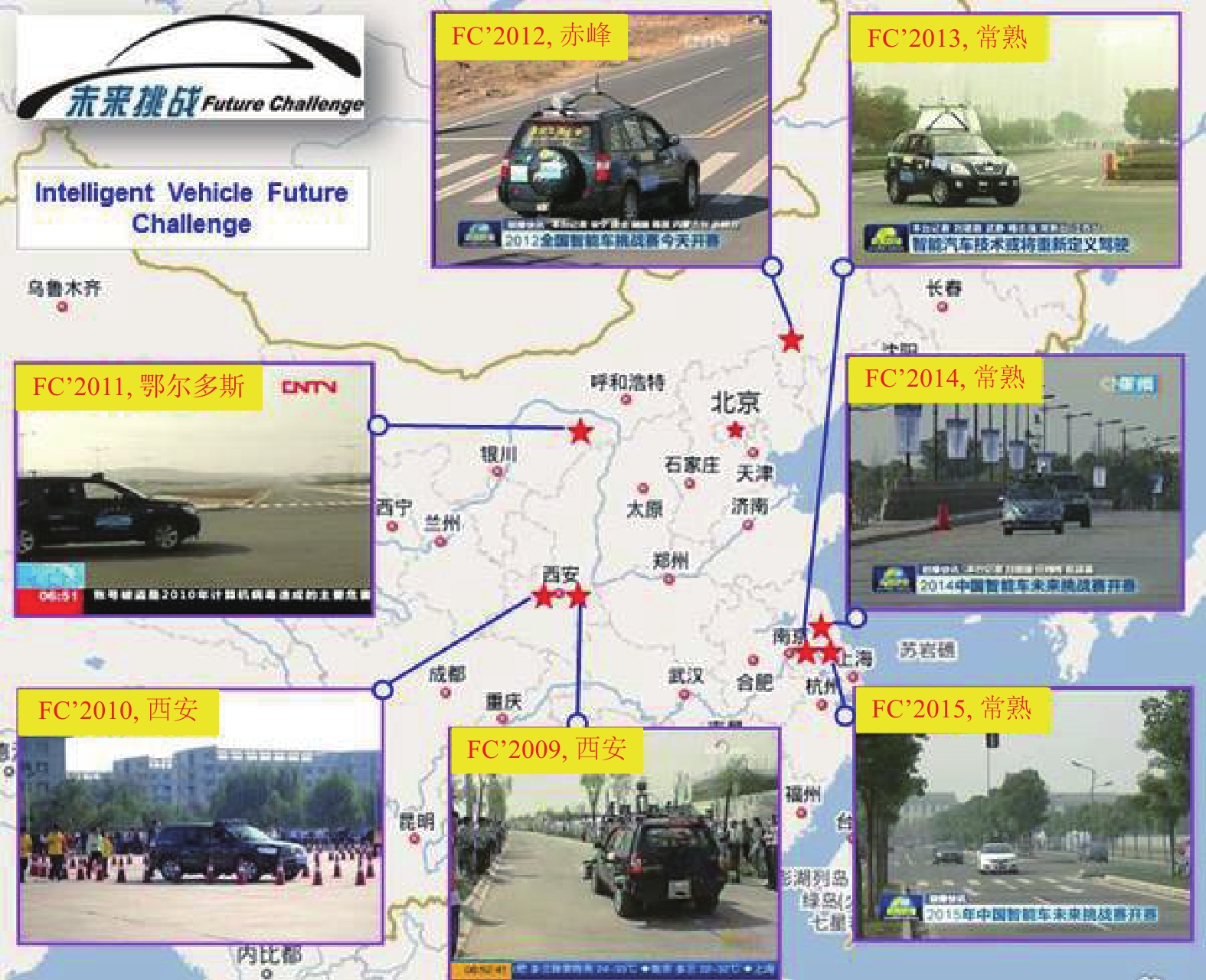

2005年,首辆城市无人驾驶汽车在上海交通大学研制成功[32]。从2009年开始,在国家自然科学基金委“视听觉信息的认知计算”重大研究计划支持下,分别在西安、鄂尔多斯、赤峰、常熟等地举办了七届“中国智能车未来挑战赛(见图4)”。该比赛是现有的国内外唯一面向无人驾驶的赛事,极大地推动了中国无人驾驶车辆的研究工作[33]。

|

Download:

|

| 图 4 2009—2015年中国智能车未来挑战赛 Fig. 4 Future challenge 2009—2015 | |

由于技术有限,在前几届比赛中参赛的无人汽车需要较多的人为干预。随着科技的不断进步,自2013年之后,参赛的无人车辆可以在真实交通环境中完成驾驶任务。目前研发无人驾驶汽车的知名团队有清华大学、国防科技大学等,这些团队与一汽集团、上汽集团等国内知名车企已相互合作,共同研发使用感更好、性能更加稳定的无人驾驶车辆[34]。2009年与2015年中国无人驾驶车辆差异对比如图5所示。

|

Download:

|

| 图 5 2009年与2015年的无人车 Fig. 5 Driverless cars in 2009 and 2015 | |

由图5可以看出,2009年参赛无人车辆是经过简单的外置传感器和控制器改装的,而2015年参赛的部分无人车辆是内置传感器与车载相结合车载,这些参赛车辆都是研究团队与车企之间的合作结果。

近年来,国内IT企业和各大自主车企也开始将研究方向投入到无人驾驶领域。2013年,百度深度学习研究院主导研发无人驾驶汽车项目。2014年,百度成立了车联网事业部,陆续推出CarLife、MyCar、CoDriver等产品。2015年底,百度深度学习研究院与宝马合作,在北京五环上展示全自动驾驶原型车。2016年,百度与乌镇旅游举行战略签约仪式,宣布将在该景区实现Level4的无人驾驶(见图6)[35]。

百度与福特在2016年8月达成共识,为了降低无人驾驶汽车激光雷达的生产成本,两公司共同投资激光雷达厂商Velodyne。2016年9月1日,在百度世界大会上,李彦宏与NVIDIA创始人黄仁勋宣布合作,共同创建自动驾驶云平台,并向中国乃至全球的汽车制造商开放。与此同时,百度高级副总裁、自动驾驶事业部负责人王劲表示成立NHTSA Level 3等级自动驾驶技术的L3事业部[36],与此同时,美国加州机动车辆管理局(Department of Motor Vehicles)已向百度美国(Baidu USA)发放第15张自动驾驶汽车上路测试牌照。目前获得DMV发放自动驾驶汽车路测牌照的公司如表2所示。

|

Download:

|

| 图 6 百度无人驾驶汽车 Fig. 6 Baidu self-driving car | |

| 表 2 截至2016年8月29日获得DMV发放自动驾驶汽车路测牌照的公司 Tab.2 Entities to which the DMV has issued autonomous vehicle testing permits as of august 29, 2016 |

2013年9月,上汽集团与中国航天科工三院在上海宣布签署合作协议,开始实施无人驾驶计划;不久之后,奇瑞宣布与武汉大学合作开发无人驾驶汽车,北京现代则选择与军事交通学院展开合作。2015年宇通汽车公司研发了一辆无人驾驶公交车,实现从郑州到开封城际快速路的演示[37]。同年,在江苏常熟成功举办的“中国智能车未来挑战赛”上,由军事交通学院代表队研制的“军交猛狮号”获得第一名[38]。2016年4月13日,长安汽车公司生产的无人驾驶汽车(见图7)从重庆出发,途经西安、郑州、石家庄抵达北京,穿越了大巴山、秦岭、终南山,跨过了华北平原、黄河,行程近2 000 km。这是我国首次无人驾驶汽车超长距离行驶实测[39]。2016年7月6日,北汽集团新技术研究院与盘锦市大洼区人民政府签署无人驾驶汽车的战略合作协议,共同开发无人驾驶体验项目[40]。

|

Download:

|

| 图 7 百度无人驾驶汽车与长安无人驾驶汽车 Fig. 7 Baidu self-driving car and Changan automobile | |

2016年9月1日京东集团对外宣布,由其自主研发的中国首辆无人配送车已经进入道路测试阶段,10月份即将开始试运营,2017年有望进行大规模商用[41]。最近,乐视宣布在多处开展无人驾驶汽车研发工作,滴滴CTO张博宣布将无人车作为重大战略布局,并很快实现无人车上路[42]。综上所述,尽管国内车企和各大IT公司进入无人驾驶领域较晚,但是随着越来越多的企业和单位积极投入到其中,中国智能汽车发展迅速,已接近国际先进水平。

2 无人驾驶汽车产业化瓶颈目前,无人驾驶汽车产业化的瓶颈问题主要有两点:1)如何更高效快速实现多传感器信息融合;2)在保证自动驾驶性能的前提下如何最大限度降低设备成本。

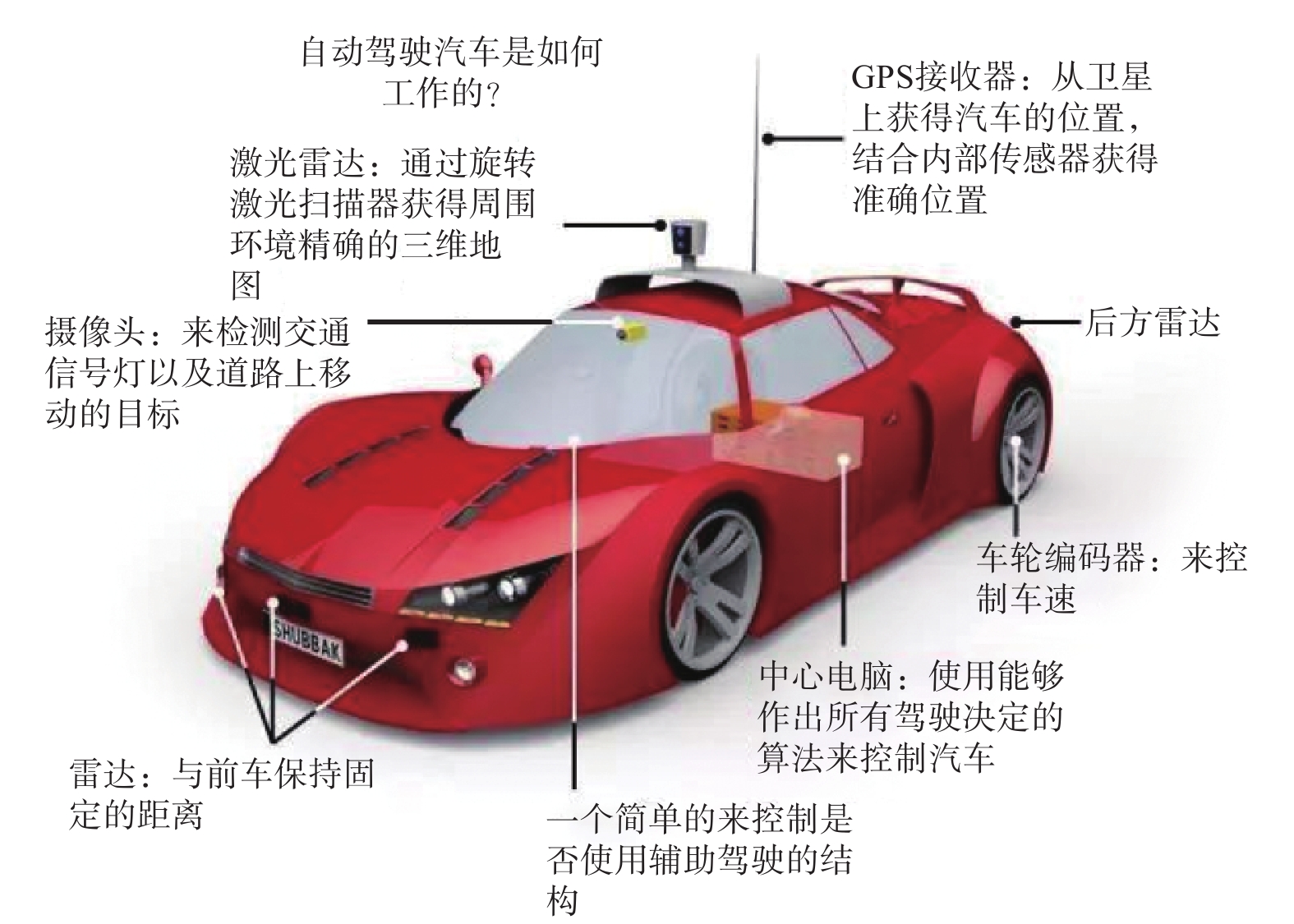

2.1 更高效快速实现多传感器信息融合研发人员当前面临的最棘手的难题是如何提高汽车的视觉能力,目前所研发的计算机视觉系统还非常的低端和原始,如何赋予计算机系统接近甚至达到人类的视觉能力是一项非常巨大的挑战。无人驾驶汽车需要随时注意周边车辆和行人,而且能够实时检测到周围的车道、地面上的画线,认识交通标识、交通灯的含义,应对风霜雨露以及强光、弱光等一系列复杂的环境因素的影响。此外,由于某些原因无法“看清”道路标志甚至在一些根本没有道路标志的环境时,为了实现完全无人驾驶,目前唯一可行的办法是通过多传感器实现信息融合进行决策,综合利用各类传感器的优势从而达到理想的效果,如图8所示。例如,毫米波雷达适用于近程、高分辨力的目标监视和目标截获,由于其较强的穿透能力,可以用于视觉系统捕获车道线、交通灯颜色等信息。但是其视觉系统不足之处在于,其测距能力没有激光雷达准确。因此将激光雷达、毫米波雷达与视觉传感器相融合,可以有效解决单独使用的不足之处,在进行物体检测的同时,也可以进行空间测距和图像识别。

|

Download:

|

| 图 8 无人驾驶实现示意 Fig. 8 Interpretation of unmanned vehicle | |

车载传感器是研发无人驾驶汽车时,需要多方面综合考虑的对象,其包括传感器的精度、灵敏度、主动与被动传感器等。表3为各类车载传感器性能指标对比,表4详细分析实现不同自动驾驶功能所需传感器及感知参数。

| 表 3 车载传感器指标对比 Tab.3 Vehicle sensor comparison |

| 表 4 实现不同自动驾驶功能所需传感器及感知参数分析[43] Tab.4 Sensors required to achieve different automatic driving functions |

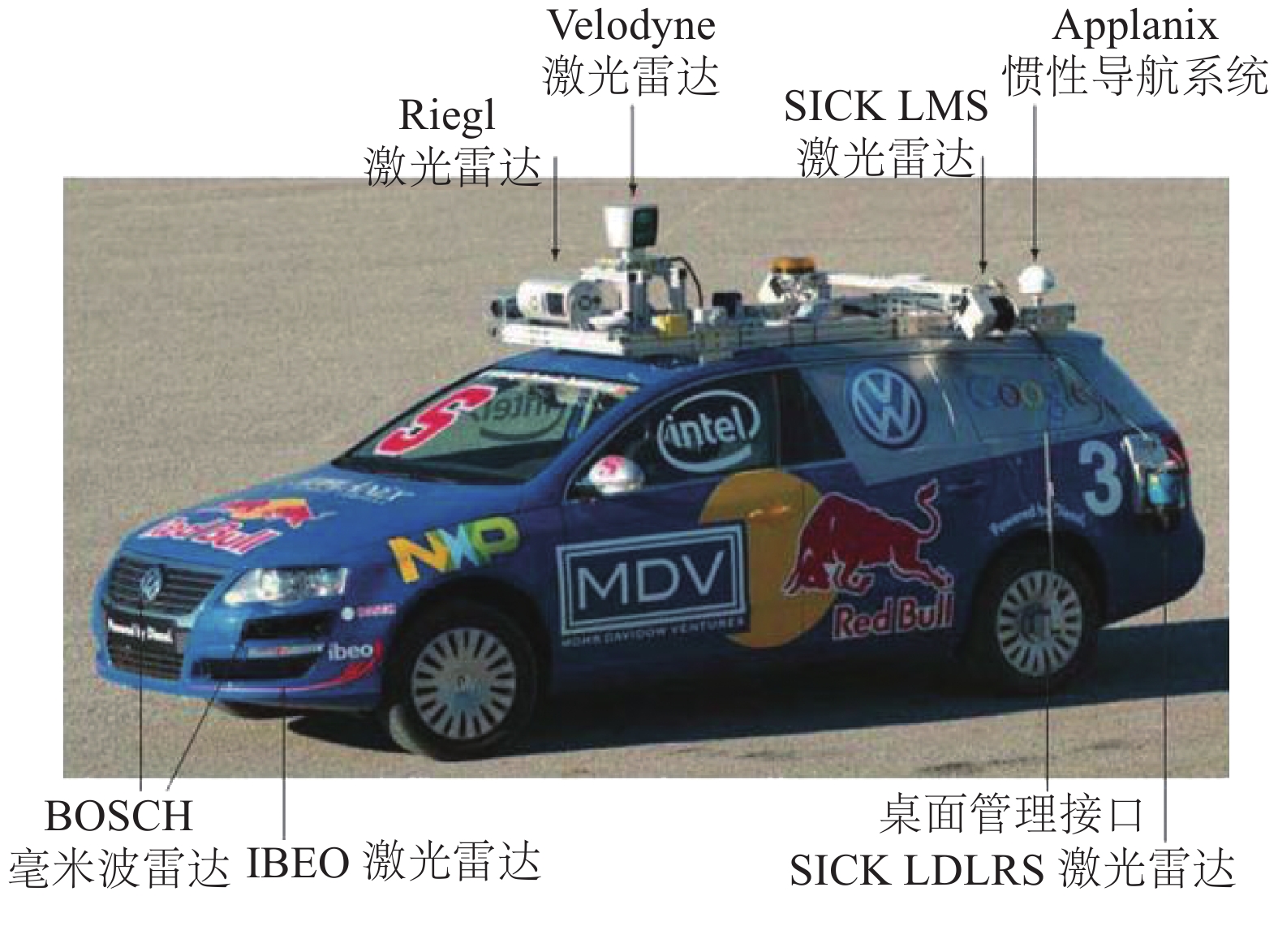

除了上述各类传感器之外,还需要选配高精度GPS定位系统及高精度测距传感器。如图9所示,该图中的汽车是Stanford 大学研发的Junior无人车,该车配备4个激光雷达(IBEO、Riegl、SICK LMS和Velodyne),1个Applanix GPS惯性导航系统,5个BOSCH毫米波雷达,以及前向相机系统[44]。

由于需要种类繁多的传感器,如何将上述各种设备采集到的信息实现高效快速的融合,形成一个稳定而智能的系统从而应对各种突发事件和挑战,是目前实现无人驾驶的关键[45]。

2.2 如何降低制造成本目前无人驾驶汽车所使用的设备主要包括激光雷达、车载摄像头、车载雷达、超声波设备以及GPS等。利用激光雷达生成的点云,对反射障碍物的远近、高低能较为准确地估计,从而大大提高障碍物检测的准确度,谷歌、Uber等科技公司都将这种设备应用在原型汽车上[46]。图10为目前常用激光雷达LiDAR示意图,其中Velodyne HDL-64E LiDAR预售价在10万美元以上,Velodyne VLP-16 LiDAR官网报价为税前7 999美元,过高的成本大大阻碍无人车的商业化。

|

Download:

|

| 图 9 Junior无人驾驶车辆及其传感器配置 Fig. 9 Junior unmanned vehicle and sensor configuration | |

|

Download:

|

| 图 10 LIDAR图例 Fig. 10 Examples of LIDARs | |

由于激光雷达售价过高导致无法量产,因此自动驾驶系统的传感器主要还是毫米波和摄像头。全球汽车毫米波目前主要生产供应商为博世、大陆、海拉、富士通、电装、天合、德尔福、奥托立夫和法雷奥等,国内主要有湖南纳雷科技、厦门意行、华域汽车、杭州智波、芜湖森思泰克等,用于车企量产车上的ADAS预警类应用[47]。目前利用摄像头实现量产无人驾驶系统,最具代表性的厂商为Mobileye,此外Omni、PointGrey、大恒和微视等公司近年来也取得很大进展。众所周知,单一摄像头捕获的图像会产生距离误差,多摄像头捕获的图像却提高了计算成本,这两种方法都不能满足无人车的实时性。另外,光照条件也会对光学摄像头产生影响从而产生识别的不稳定。上述两点一直是利用摄像头实现无人驾驶的重要阻碍,伴随着近年深度学习技术在图像和声音领域不断取得突破性进展,越来越多的公司和企业开始研究利用双/多摄像头来应对复杂的道路环境从而实现无人驾驶,包括中科慧眼、地平线、东软和Minieye等[48]。与此同时,通过利用GPU强大的并行运算能力,在运算速度、效率不断提高的同时大幅度降低计算成本,更是为深度学习在自动驾驶领域的应用铺平了道路[49]。

3 深度学习在无人驾驶领域的应用深度学习[50]在计算机视觉获得了巨大成功,彻底颠覆了传统的计算机模式识别方法[51]。在深度学习出现以前,大多数识别任务要经过手工特征提取和分类器判断两个基本步骤,而深度学习可以自动地从训练样本中学习特征。深度学习的快速应用主要有两点原因:1)更容易获得大量的人工标注数据集,如ImageNet大规模视觉识别挑战(ILSVRC)[52];2) 深度学习算法可以在GPUs上并行处理图形,提高了学习效率和预测能力。利用深度神经网络自主学习的特性,先通过高性能GPUs将庞大复杂的神经网络模型训练好,然后移植到嵌入式开发平台,就可以实现对图像、视频信息实时高效的处理[53]。近年来,从自动驾驶初创企业、互联网公司到各大OEM厂商,都在积极探索利用GPUs构建神经网络实现最终的无人驾驶。

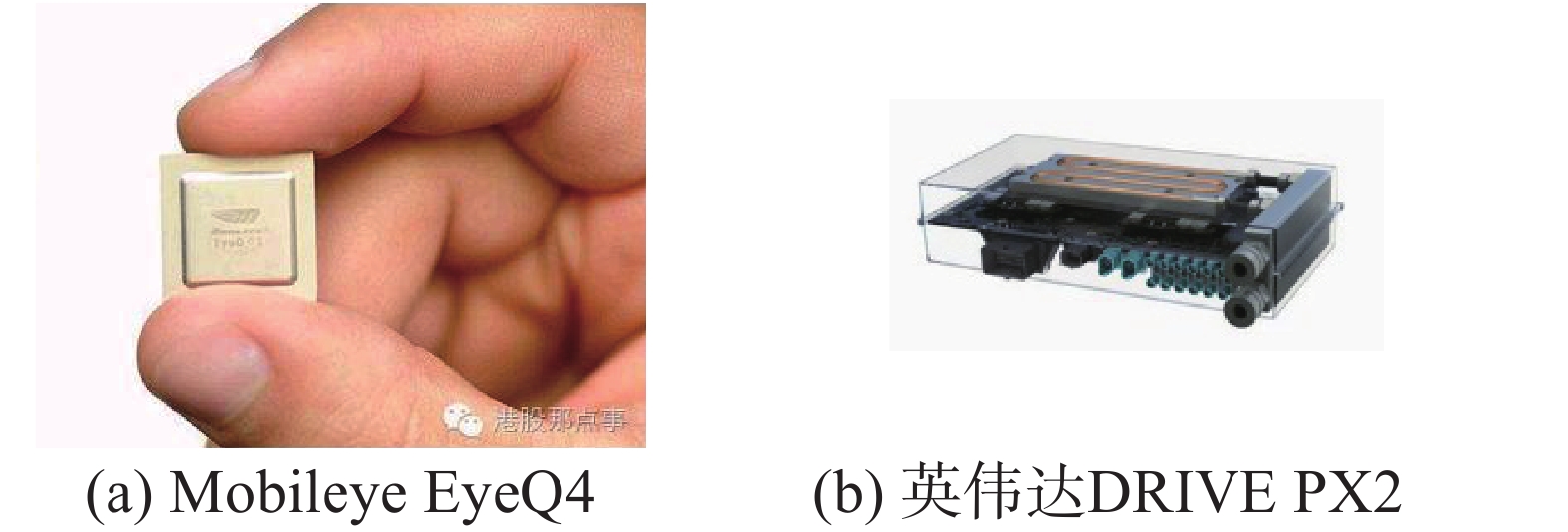

3.1 无人驾驶硬件实现将深度学习应用于无人驾驶领域的代表公司有Mobileye及NVIDIA公司,他们把基于深度卷积神经网络的方法用于汽车的视觉系统中,取得了非常理想的效果。其中Mobileye公司生产的基于多核架构芯片EyeQ4(见图11(a)),使用了4颗核心处理器、6颗VMP芯片、2颗MPC核心和2颗PMA核心,每秒浮点运算可达2.5万亿次,而功耗仅有3 W。通过一系列的算法,EyeQ4可以同时处理8部摄像头(最高36f/s)产生的图像数据[54-56]。

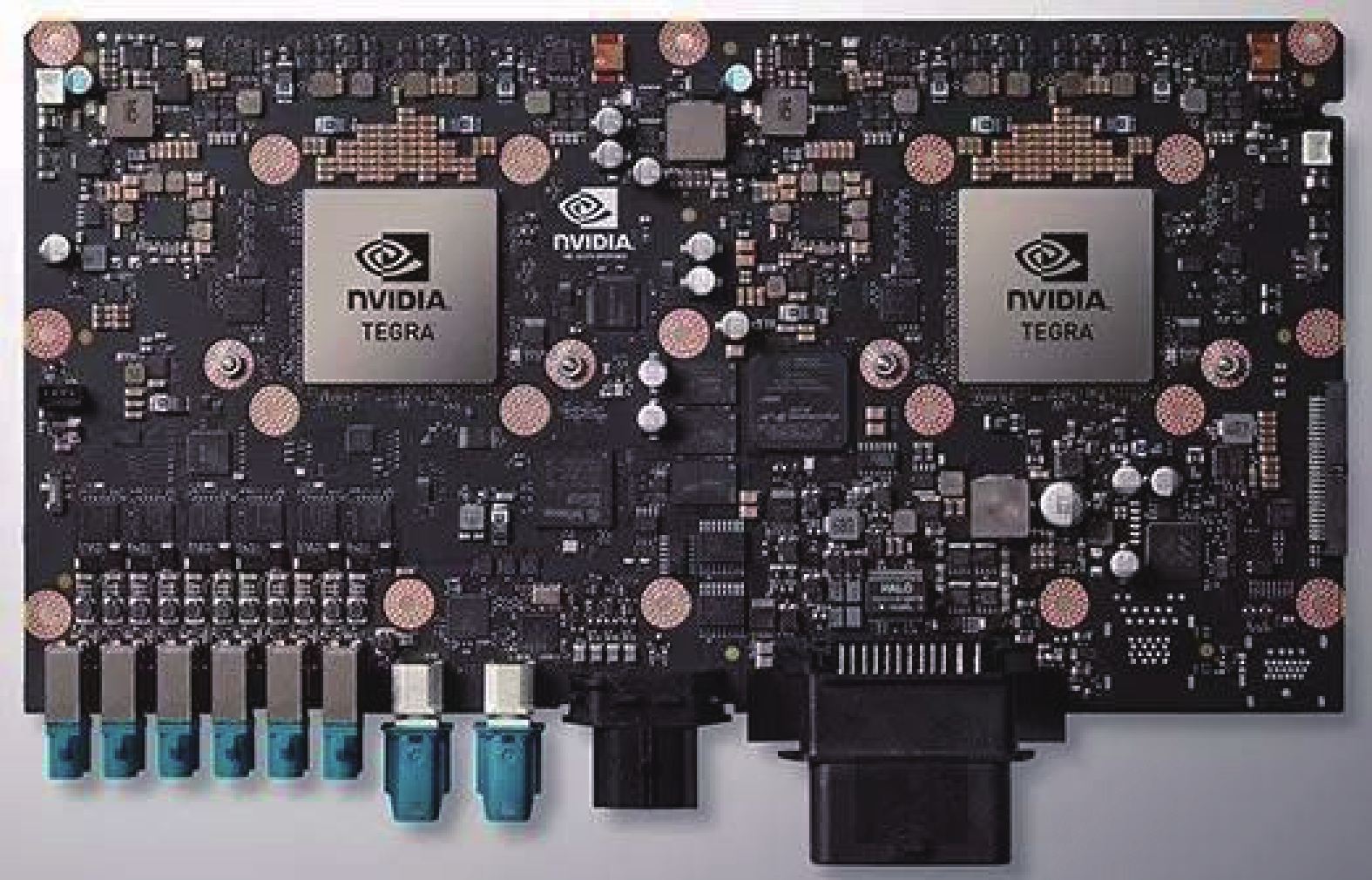

英伟达DRIVE PX2无人驾驶汽车平台(见图11(b)),支持12路摄像头输入、激光定位、雷达和超声波传感器;包括两颗新一代NVIDIA Tegra处理器,其中每个处理器包括8个A57核心和4个Denver核心;基于NVIDIA(见图12)的新一代GPU架构Pascal设计,单精度计算能力达到8 T/S,超越TITAN X的10倍以上的深度学习计算能力[57]。

|

Download:

|

| 图 11 Mobileye EyeQ4与 英伟达DRIVE PX2 Fig. 11 Mobileye EyeQ4 and NVIDIA DRIVE PX2 | |

数据科学家利用NVDIADGX-1训练深度神经网络结构,然后把训练好的网络模型与车辆配备,在NVIDIA DRIVE PX2上无缝运行。与此同时,NVIDIA利用NVIDIA DRIVE PX2构建的Drivenet平台(见图13)提供算法库支持,实现无人驾驶汽车无线更新功能[58]。

|

Download:

|

| 图 12 英伟达自动驾驶开发平台 Fig. 12 NVIDIA DRIVE PX 2 | |

|

Download:

|

| 图 13 NVIDIA深度学习无人驾驶平台解决方案 Fig. 13 NVIDIA deep learning unmanned platform solutions | |

2016年9月13日,NVIDIA在GPU技术大会上推出了体积更小的节能型车载深度学习计算平台NVIDIA DRIVETM PX 2 AUTOCRUISE,该平台采用了新型单处理器配置,功耗仅为10 W。此外许多移动终端产品芯片供应商已经开始为自动驾驶技术提供带有GPU单元的嵌入式处理器。一些大公司(例如高通、三星)也推出了各自带有GPU单元的嵌入式处理器。三星处理器芯片目前主要研发汽车智能硬件,车机互联系统来拓展面向汽车的产品组合,实现多系统支持的感知功能。

由于深度学习方法对图像处理的高效性,使得无人驾驶汽车可以利用单/双摄像头初步实现对自动控制的需求,减轻了传统方法中对用昂贵的激光扫描仪来建立3-D全景地图的依赖性。虽然相比于激光扫描仪,利用摄像头采集的信息精度稍低,但完全可以满足日常无人驾驶的需要,而改进的深度学习算法通过对多摄像头信息融合处理,模拟人的双眼生成立体空间图像,从而轻松判断距离,实现更好的自动控制功能[59-67]。

3.2 无人驾驶算法实现Pomerleau在1989年用神经网络搭建了一套自动驾驶系统(autonomous land vehicle in a neural network,ALVINN)[68]。ALVINN首次证实了端到端训练的神经网络模型实现无人驾驶的可行性。

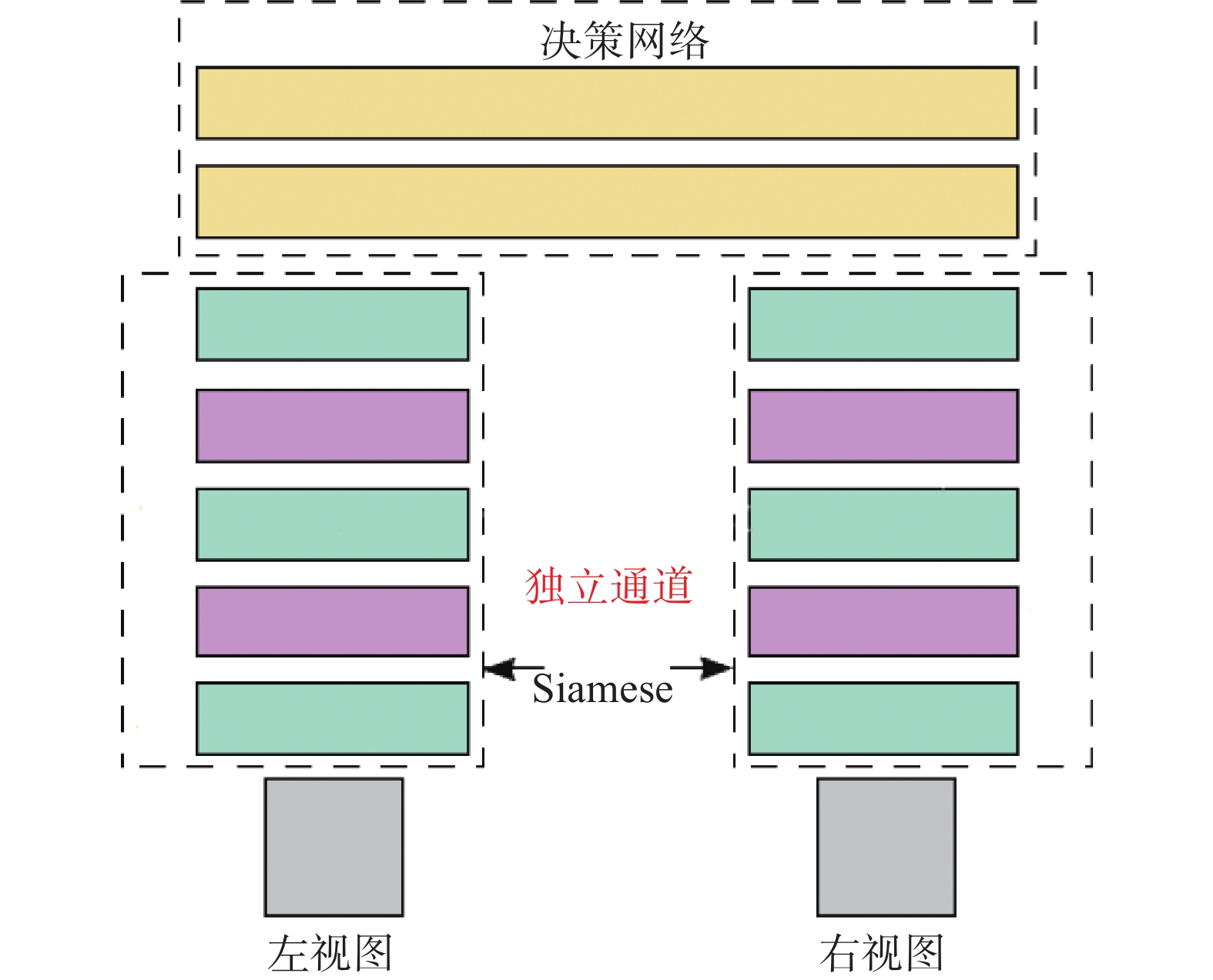

近年来,随着深度学习的快速发展,利用深度学习实现图像识别的文章数不胜数。2016年5月18日,Y. Lecun等发表Stereo Matching by Training a Convolutional NeuralNetwork to Compare Image Patches,首次提出利用Siamese网络(见图14),同时输入左视图和右视图两幅图像,利用网络计算出两幅图像的视差图像,从而控制车辆的前进方向[69]。

|

Download:

|

| 图 14 双通道网络示意图 Fig. 14 Diagram of Siamese network | |

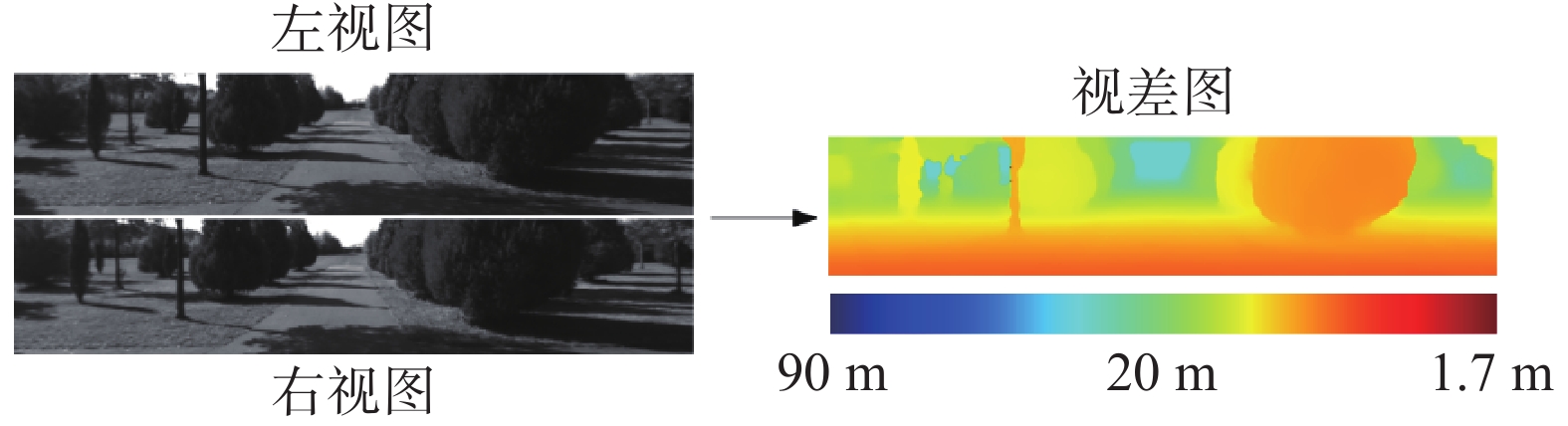

将Siamese网络的双通道输入结构应用于深度神经网络,在传统深度学习的优势之上,还可以通过两幅图像之间的差异从而判断周围物体的远近(见图15),从而合理操控汽车实现无人驾驶[70]。

|

Download:

|

| 图 15 训练图片示例 Fig. 15 Example of training photos | |

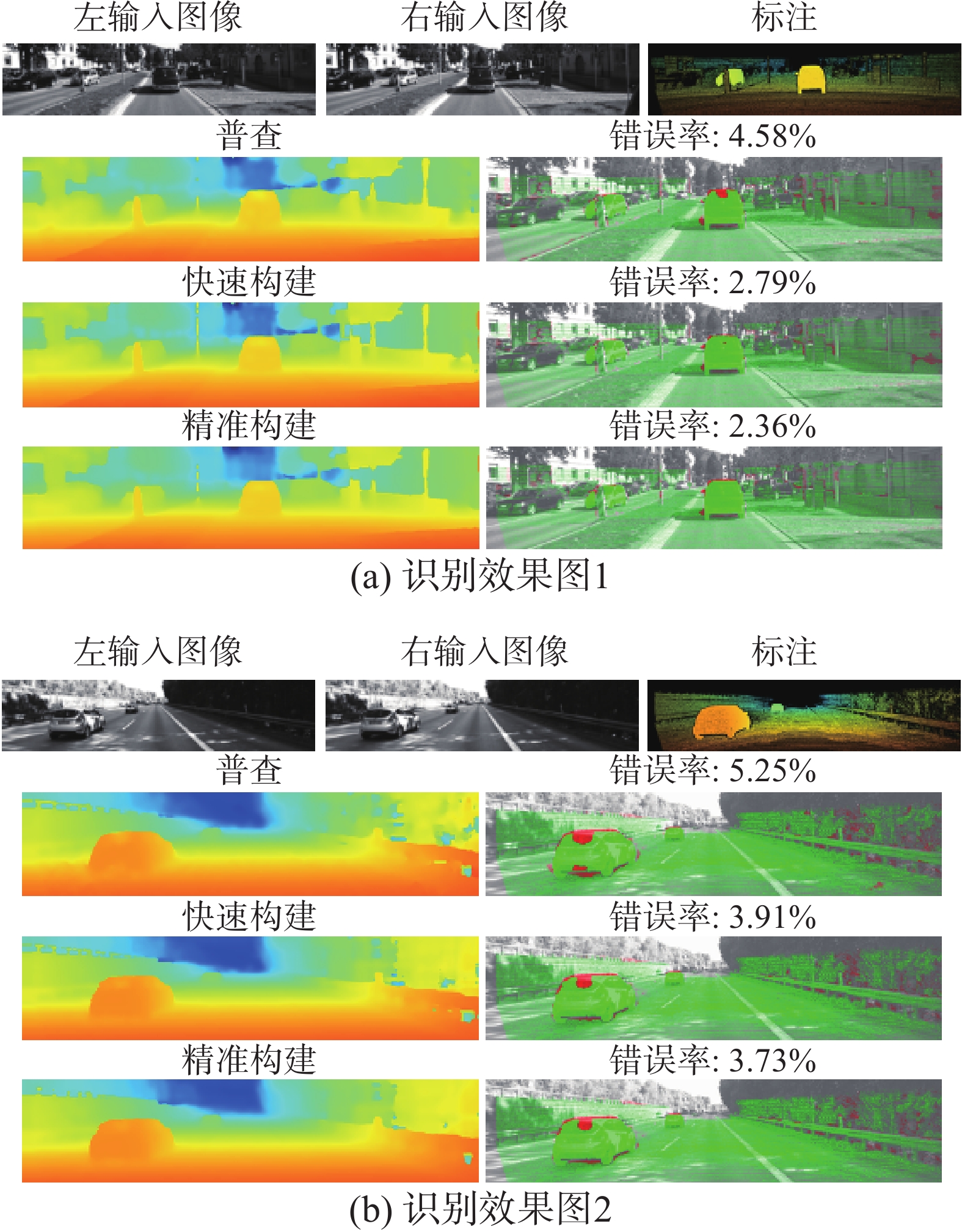

利用式(1)计算视差,其中IL(P)和IR(P)为左右图像在P点处的灰度值,NP是一组固定位置在以P为中心的矩形窗口。通过不断调节网络的隐层数和进行海量训练最终达到的效果见图16。

| ${C_{{\rm{SAD}}\left( {P,d} \right)}} = \sum\limits_{q \in {N_P}} {\left| {\left. {{I^L}\left( P \right) - {I^R}\left( {P - d} \right)} \right|} \right.} $ | (1) |

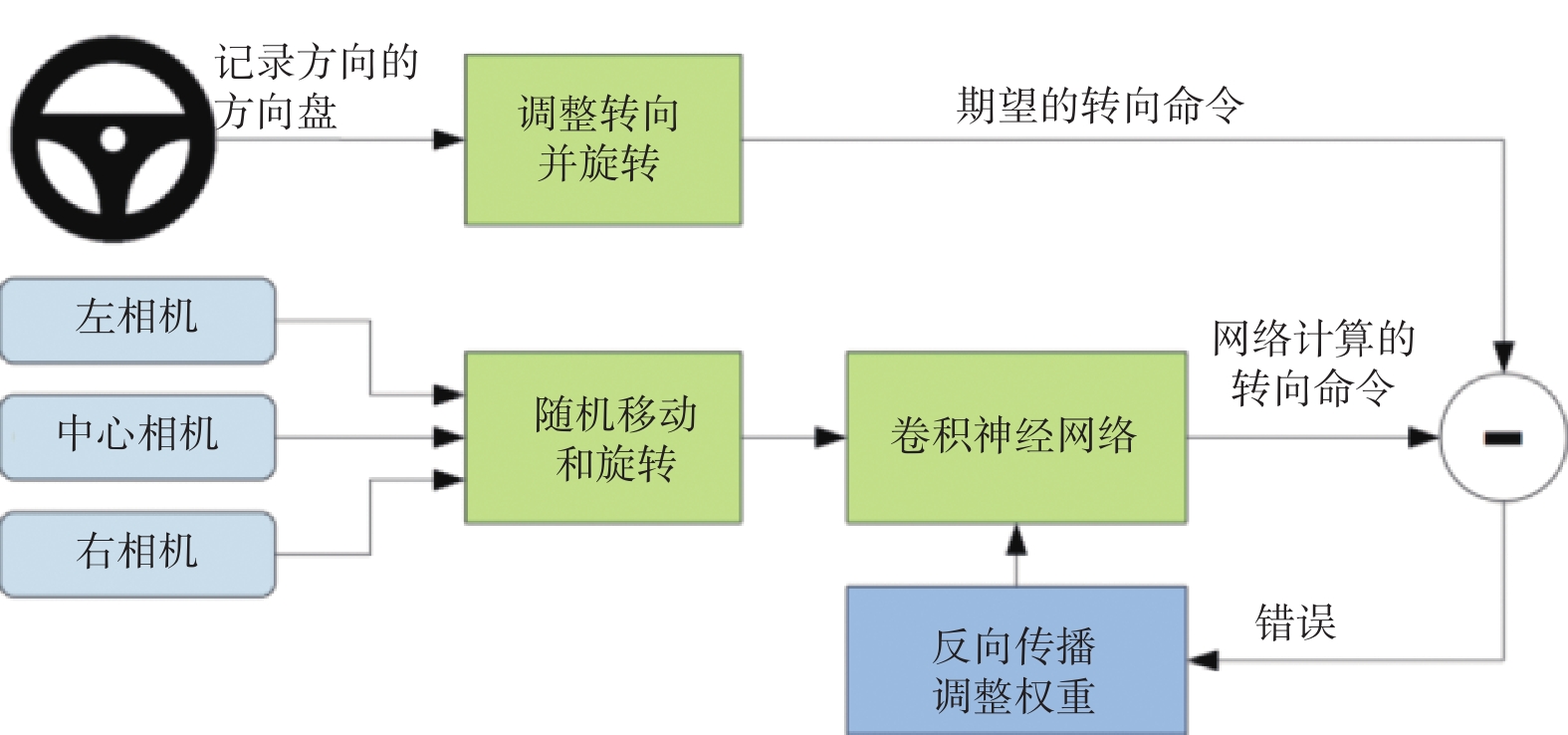

近年来,NVIDIA公司通过采用卷积神经网络(CNNs)实现无人驾驶取得很大突破。该公司研究人员将摄像头捕捉到的原始图片通过CNNs映射为汽车的方向操控命令,只需提供少量的训练数据,系统就能自动学会驾驶技术,甚至可以工作在视线不清晰以及无车道标志线等区域,例如停车场或者崎岖的山路上。图17为该系统的训练数据采集模块的块状示意图,数据采集车通过3台摄像机采集视频信息,同步记录驾驶员操控方向盘的偏转角度,利用汽车控制网络(controller area network,CAN)总线获取下一个方向的控制命令。系统采用1/r来表示控制方向的命令,其中r代表以米为单位的转弯半径。

|

Download:

|

| 图 16 识别效果图 Fig. 16 Photo of recognition result | |

|

Download:

|

| 图 17 数据采集系统结构 Fig. 17 Structure diagram of data acquisition system | |

图像输入到CNNS控制命令中,将预测方向控制命令与理性控制命令相比产生误差,利用误差值不断训练调整CNNs模型的权值,使得网络模型输出的方向控制命令与人工驾驶或者调整后的控制命令的均方误差最小,图18为训练系统示意图。

训练完成后,模型通过采用中间摄像机数据生成方向控制命令,具体过程如图19所示。

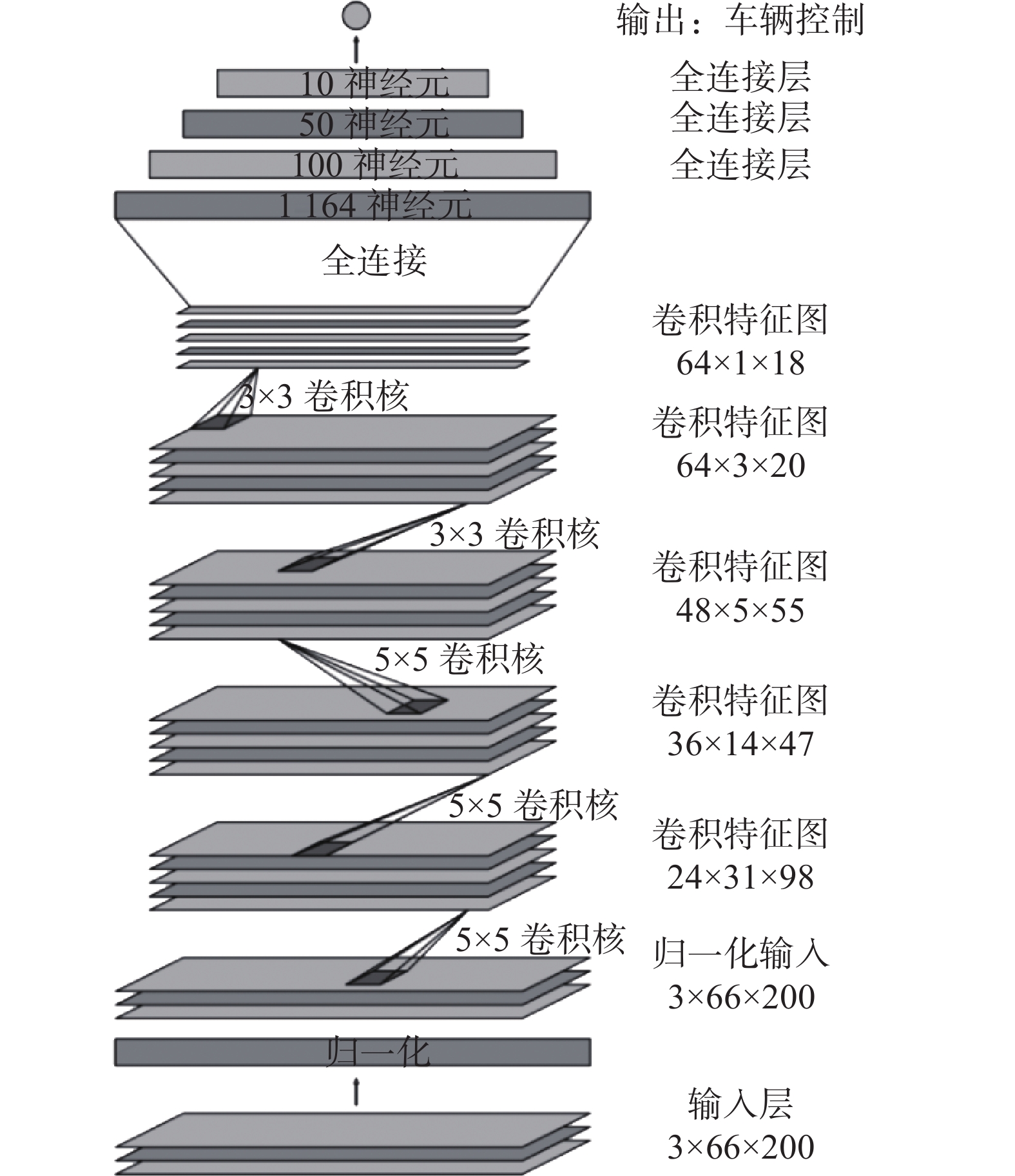

该CNNs一共包含9层网络(1个归一化层,5个卷积层和3个全连接层),输入图像被映射到YUV平面[71],然后传入网络进行逐层训练,详细网络结构如图20所示。

|

Download:

|

| 图 18 训练神经网络模型 Fig. 18 Training a neural network model | |

|

Download:

|

| 图 19 中间摄像机的数据输入模型生成方向控制命令 Fig. 19 Control command is generated by the data input model of the intermediate camera. | |

|

Download:

|

| 图 20 CNNs结构(该网络约有2 700万个连接和25万个参数) Fig. 20 CNNs structure (the network has about 27 million connections and 250 thousand parameters) | |

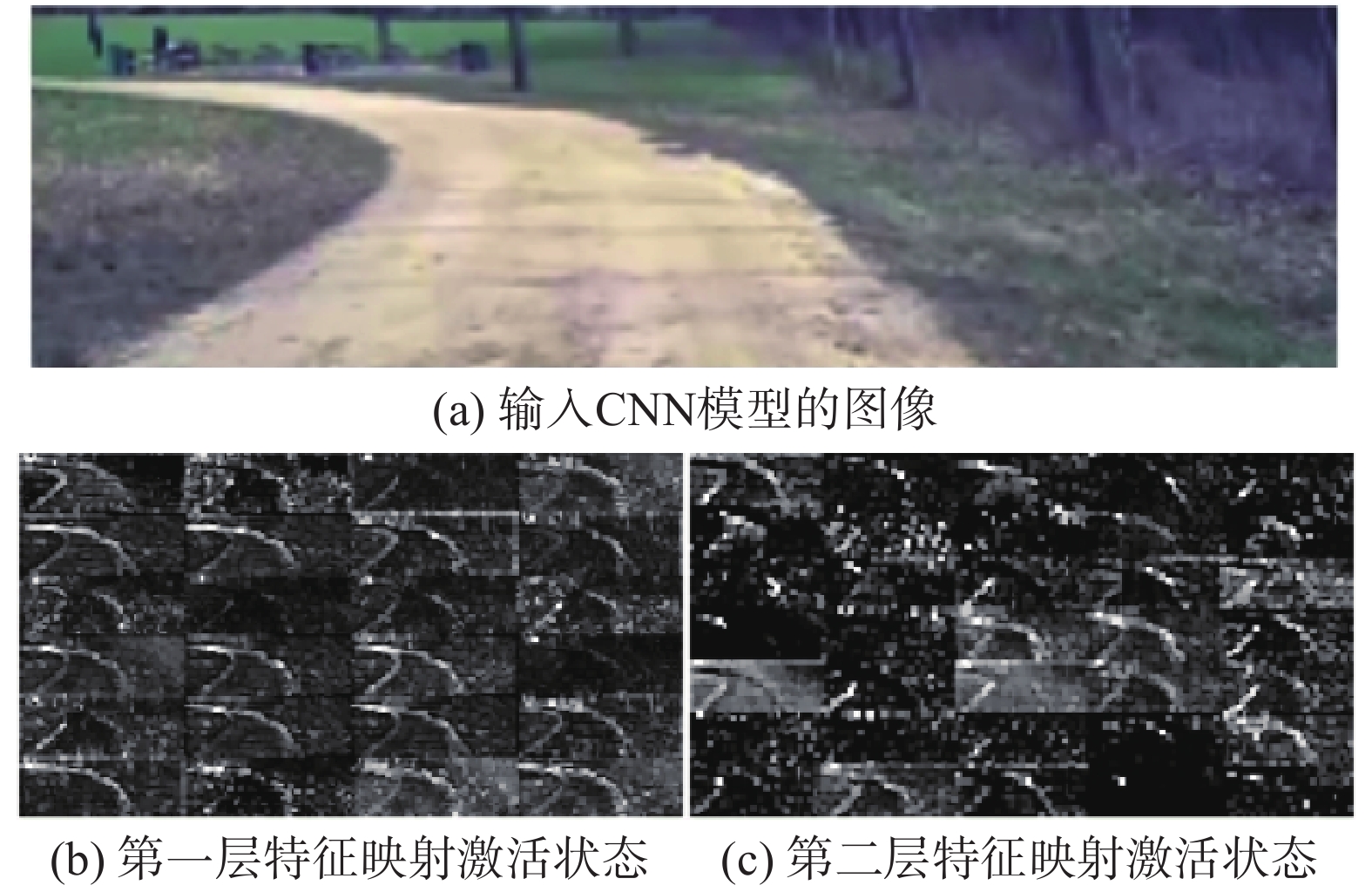

网络的第一层采用硬编码技术对输入图像进行归一化[72],网络前3个卷积层使用了strided卷积,其中strided为2×2,卷积核大小为5×5,后2个卷积层选用unstrided卷积,卷积核大小为3×3。在5个卷积层之后添加3个全连接层,最后输出为一个控制数字,即转弯半径的倒数。此外,在训练过程中通过人为添加了一些偏移和旋转去补充数据集,按正态分布随机选取调整幅度。图21和图22分别展示了两张不同输入图片在前两层网络的激活状态,在图21中,特征图片清晰地勾画出路的边界,而在图22中夹杂了大量噪音,表示网络模型从图中找不到有用的特征(道路信息)。

|

Download:

|

| 图 21 CNN模型处理土路 Fig. 21 CNN model formanagingdirt road | |

|

Download:

|

| 图 22 没有路的图片示例 Fig. 22 Wasteland image sample | |

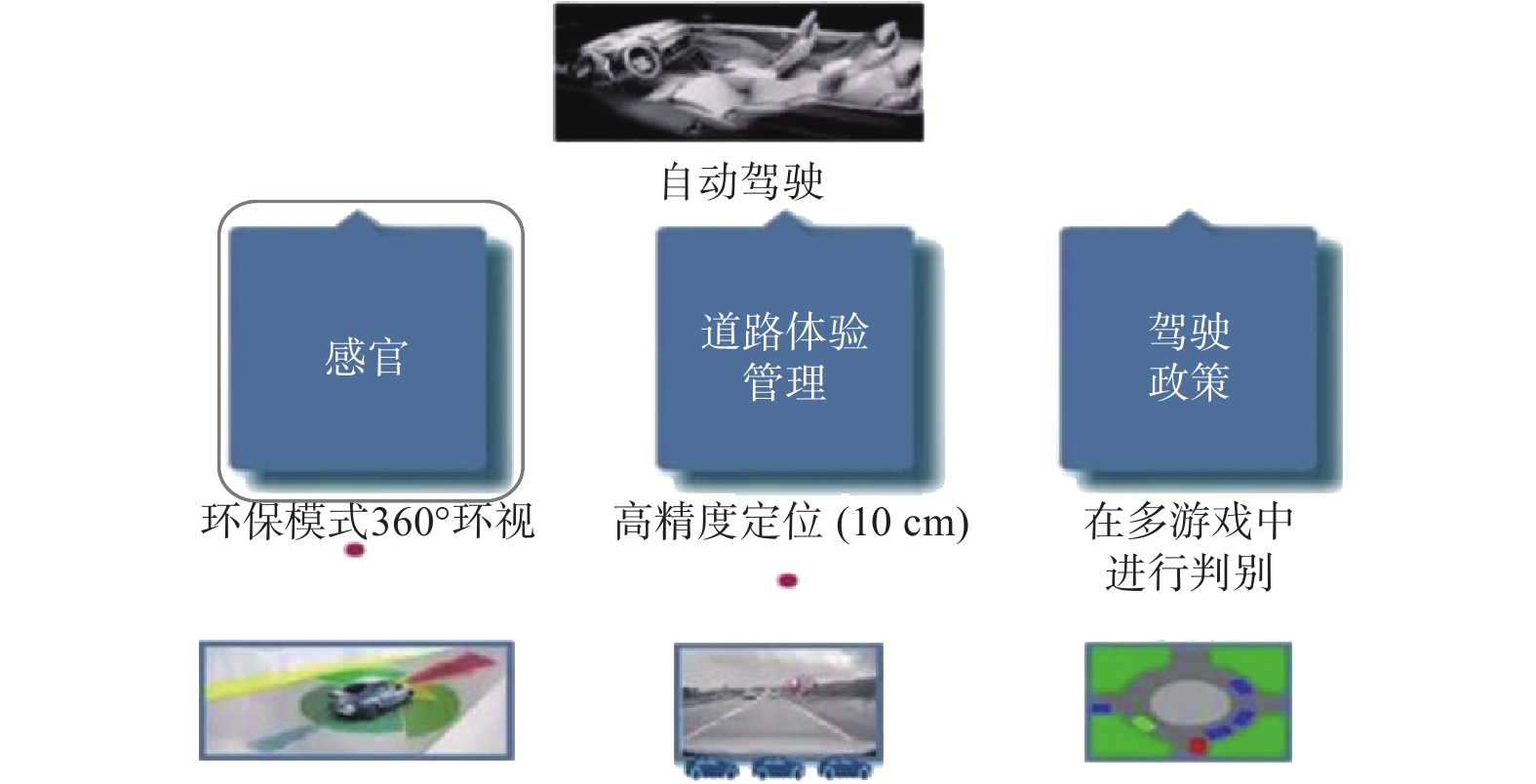

与NVIDIA无人驾驶解决方案稍有不同,Mobileye在自动驾驶的布局分为3个部分,即感知、高精地图和驾驶决策(见图23)。

|

Download:

|

| 图 23 Mobileye自动驾驶布局 Fig. 23 Layout of Mobileye | |

Mobileye在自动驾驶领域的感知技术比较成熟,已经大量运用在已有产品中,该技术主要提供一个环境模型(environmental model),包括运动和静止的物体、车道线、可行驶区域和交通标志等。通过多年的技术积累,让Mobileye在环境模型方面能够提供的内容远超竞争对手,在其他车企还在尝试提高单一车道线的检测精度时,Mobileye已经可以提供道路的语义级特征描述,例如当前行驶车道的左右车道线、左右车道的左右线以及道路分叉等,均通过深度神经网络识别。

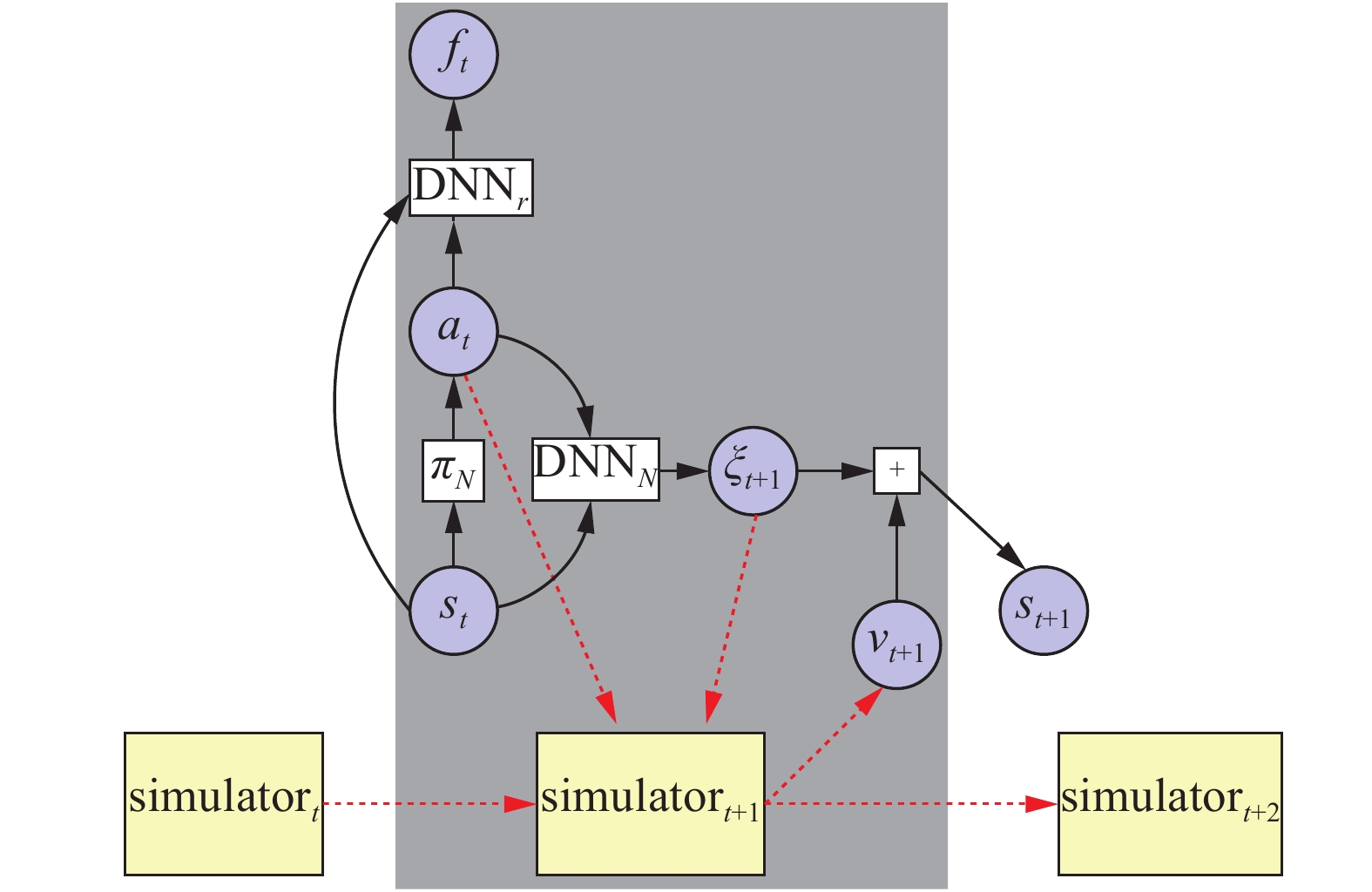

Mobileye将感知任务划分成多个模块,每个对应一个人工监督的神经网络,所得出的效果已经可以产品化。目前Mobileye利用深度学习进行训练,训练过程中考虑了驾驶过程中的时序性(见图24),最终实现短时预测[73-75]。

|

Download:

|

| 图 24 Mobileye无人驾驶时序性原理图 Fig. 24 Sequential schematic of unmanned Mobileye | |

2016年2月18日,加州大学圣地亚哥分校(UCSD)的工程师们开发了一个非常便宜、有效的行人检测系统,该系统是基于视觉信号进行实时探测(见图25)。加州大学圣地亚哥分校中一位电气工程教授表示,他们的算法可以通过2~4 f/s的速度检测出行人变化,可以有效避免行人的突然变化造成汽车突然刹车的事故,该算法成功地将当时错误率降了一半。

|

Download:

|

| 图 25 UCSD行人检测效果图 Fig. 25 Demo of UCSD | |

此外,剑桥大学研发团队利用图像识别和深度学习技术研发的SegNet系统(见图26),可以将街景照片内容分割成12个类型的物体,其中包括道路、建筑、路标、行人等,并在不同光照条件下进行实时的语义分割。在夜间环境该系统可以保持实时工作状态并可以在较短时间内对各种新图像进行评估,标记像素的准确度达到90%以上。过去的系统使用的传感器都是以昂贵的雷达或激光技术为基础,无法达到SegNet的精度和实时性。在GPS失效的地方,SegNet系统可以帮助无人驾驶汽车确定位置和方向,实时识别出各种不同的路况[76]。

|

Download:

|

| 图 26 SegNet示意图 Fig. 26 Examples of SegNet | |

剑桥大学研发团队运用深度学习方法实现SegNet系统,使其在复杂背景和气候环境下仍然具备良好的鲁棒性。通过剑桥大学的一组本科生手工标记5 000张图片中的所有像素,研究人员利用这5 000张图片训练SegNet并进行测试,最终达到理想的效果[77]。汽车安全系统需要满足快速性和准确性。计算机视觉中的“梯级检测”算法可以检测特定图像,但在复杂环境下的检测效果会降低。团队创造的SegNet系统结合了两者的优势,既保证了实时性,又有很高的识别精度。

与此同时,comma.ai的创始人GeoHot不但把公司的自动驾驶技术和代码开源,同时开源了驾驶采集数据。其中前视摄像头采集的图像大小为160×320,数据时长为7.25 h,包括了11个视频。数据集包含了汽车的转向信息、制动信息、速度信息和惯导信息,以及输出控制和输入图像之间的同步时间数据。最后利用深度学习模型进行End-to-End训练(见图27),将摄像头的原始图像作为输入,直接输出车辆的速度和方向,来拟合逼近最优驾驶策略。

4 无人驾驶汽车行业发展前景预测随着市场对汽车主动安全技术、智能化等技术需求不断增加,越来越多的企业投入其中,共同推动无人驾驶汽车的发展。与此同时,随着计算机性能的逐步提高,成本降低,无人驾驶汽车使用的各种传感器取得了很大的进步,研发技术的门槛随之降低,前景十分明朗。近年来深度学习在图像识别方面取得了突破性的进展,更是为无人驾驶技术的成熟增添了强劲的活力,利用GPU高效的图像处理性能,实现了实时图像处理。智能车辆的国内外研究成果已经取得了重大的进展,但是从近期发生的自动驾驶汽车事故可以看出,智能车辆投入实际使用还需要解决多种问题。因此未来无人驾驶将需要在以下几个方面取得进步。

|

Download:

|

| 图 27 深度学习端到端模型介绍 Fig. 27 End-to-end deeplearning model | |

首先,需要采用更好的传感器和优化配置改善自动驾驶功能。高精度的传感器才能在复杂交通下检测车辆周围的环境信息。现阶段传感器无法克服车辆运动、环境气候和工作范围的信号干扰,从而无法保证准确检测出所有的行车驾驶要素。而激光雷达传感器的高昂价格也限制了该技术的实际应用。未来激光雷达会变得更小更轻便,集成度更高,价格更低以及变成固态。面向复杂环境感知需求,通过融合多种传感器的数据来实现感知、定位、决策和规划,这是无人车近期的发展方向。

其次,为了实现自动驾驶,需要将集成化控制系统、新型总线分布和自动驾驶架构结合。通过多种感知和决策算法的车载软件,提高自动驾驶技术的安全性和鲁棒性。采用车联网络可以实现车辆之间的信息共享,有效提高了传感范围。高精度的地图和GPS定位可以通过减少车辆传感器的需求,进而降低自动驾驶技术的难度。另外,结合深度学习技术,集成高性能的车载计算平台,可以提高车辆自动驾驶的水平。

此外,无人汽车技术需要高性能计算平台的支持。将车载计算平台与深度学习技术相结合,增强无人车辆的智能水平,将人工智能技术的新突破应用于无人驾驶。

无人驾驶汽车发展的终极目标,就是建立一个车辆网络化、信息化、人车合一的自动平台,能够实时、全天候、高效的无人驾驶系统。无人驾驶技术可以极大地提高社会生产力,产生巨大的社会效益,同时改善人们的出行方式,让我们的生活环境更美好。

| [1] |

倪暖. 自动驾驶也分三六九等?[EB/OL].(2016-8-07)[2016-09-27] http://www.ednchina.com/news/article/201608170801.

( 0) 0)

|

| [2] |

佚名. 无人驾驶汽车[EB/OL]. (2016-06-10)[2016-09-27] http://baike.baidu.com/link?url=iObG6G1U5wmuVNCdgm7wXDpV8418yWtKAlBAVjC4xyVEL7Lgy3fgfkpsda4qiABZHCsxtQ9J9xqqcsZdTu_vF6kAT6xwu7zedQw2ggyuqa.

( 0) 0)

|

| [3] |

腾讯汽车. 国外无人驾驶技术发展调研报告[EB/OL]. (2015-05-23)[2016-09-27] https://wenku.baidu.com/view/472fa34458f5f61fb636664d.html.

( 0) 0)

|

| [4] |

张翔. 2013年全球汽车技术发展趋势[J]. 汽车工程师, 2013(3): 19-21, 52. ZHANG Xiang. The development trend of global automotive technology at 2013[J]. Tianjin auto, 2013(3): 19-21, 52. (  0) 0)

|

| [5] |

林靖东. 美国内华达州批准谷歌无人驾驶汽车上路测[EB/OL].(2012-05-08)[2016-09-27] http://tech.qq.com/a/20120508/000235.htm.

( 0) 0)

|

| [6] |

GREENBLATT N A. Self-driving cars and the law[J]. IEEE spectrum, 2016, 53(2): 46-51. DOI:10.1109/MSPEC.2016.7419800 ( 0) 0)

|

| [7] |

欧阳. 谷歌的" 笑脸”GoogleSelf-DrivingCar[J]. 计算机应用文摘, 2014(12): 72. OU Yang. Google's " smiling face” Google Self-Driving Car[J]. PCDigest, 2014(12): 72. (  0) 0)

|

| [8] |

BIRDSALL M. Google and ITE: The road ahead for self-driving cars[J]. Institute of Transportation Engineers. Ite Journal, 2014, 84(5): 36. ( 0) 0)

|

| [9] |

GUIZZO E. How Google’s Self-driving Car Works[J]. IEEE Spectrum Online, 2011(8): 18

( 0) 0)

|

| [10] |

JAFFE E. The first look at how google’s self-driving car handles city streets[J]. The atlantic, 2014: 431-443.

( 0) 0)

|

| [11] |

TAO Yuping. The construction and intelligent management of self-driving car campsite under the visual field of low-carbon environmental protection[J]. Advanced materials research, 2012, 573-574: 841-847. DOI:10.4028/www.scientific.net/AMR.573-574 ( 0) 0)

|

| [12] |

张桂林, 赵宇飞, 黎华玲. " 无人驾驶”如何驶进现实[J]. 瞭望, 2016(19): 20-21. ZHANG Guilin, ZHAO Yufei, LI Hualing. " Unmanned” how to enter the reality[J]. Outlook Weekly, 2016(19): 20-21. (  0) 0)

|

| [13] |

恒亮. 百度获得加州第15张无人驾驶测试牌照,另外14张在哪? [EB/OL]. (2016-09-02) [2016-09-27] http://www.sohu.com/a/113368428114877

( 0) 0)

|

| [14] |

腾讯汽车. 宝马因特合作2021年前生产驾驶无人汽车[EB/OL]. (2016-07-02)[2017-0-20]http://auto.qq.com/a/20160702/005058.htm.

( 0) 0)

|

| [15] |

SURDEN H, WILLIAMSM A. How self-driving cars work[EB/OL]. (2016-05-25)[2017-09-20] https:// ssrn.com/abstract=2784465.

( 0) 0)

|

| [16] |

PATIDAR A, KUMAR S. A review paper on self-driving car’s and its applications[J/OL]. International journal for innovative research in science and technolog, 2016: 33-35. http://www.ijirst.org/articles/IMPACTP015.pdf.

( 0) 0)

|

| [17] |

BRETT J A. Thinking local about self-driving cars: a local framework for autonomous vehicle development in the united states[D]. Washington DC: University of Washington, 2016.

( 0) 0)

|

| [18] |

MICULESCU D, KARAMAN S. Polling-systems-based autonomous vehicle coordination in traffic intersections with no traffic signals[J]. arXiv preprint arXiv: 1607. 07896, 2016.

( 0) 0)

|

| [19] |

CORNICK M, KOECHLING J, STANLEY B, et al. Localizing ground penetrating RADAR: a step toward robust autonomous ground vehicle localization[J]. Journal of field robotics, 2016, 33(1): 82-102. DOI:10.1002/rob.21605 ( 0) 0)

|

| [20] |

MACHT J. Automatic for the People[J]. Tennis, 2000, 2010(6): 28-29. ( 0) 0)

|

| [21] |

CHEN Gang, ZHANG Weigong. Design of prototype simulation system for driving performance of electromagnetic unmanned robot applied to automotive test[J]. Industrial robot: an international journal, 2015, 42(1): 74-82. DOI:10.1108/IR-06-2014-0353 ( 0) 0)

|

| [22] |

ZHANG Xuemei, PEN Qiyuan. A study on tourism information and self-driving tour traffic[C]//Proceedings of 1st International Conference on Transportation Engineering. Chengdu, China, 2007: 3884–3889.

( 0) 0)

|

| [23] |

DIELS C, BOS J E. Self-driving carsickness[J]. Applied ergonomics, 2016, 53: 374-382. DOI:10.1016/j.apergo.2015.09.009 ( 0) 0)

|

| [24] |

BERGER C, DUKACZEWSKI M. Comparison of architectural design decisions for resource-constrained self-driving cars-A multiple case-study[C]//Proceedings of the informatik. Bonn, Germany, 2014: 2157–2168.

( 0) 0)

|

| [25] |

SCHELLEKENS M. Self-driving cars and the chilling effect of liability law[J]. Computer law and security review, 2015, 31(4): 506-517. DOI:10.1016/j.clsr.2015.05.012 ( 0) 0)

|

| [26] |

KIM J, KIM H, LAKSHMANAN K, et al. Parallel scheduling for cyber-physical systems: analysis and case study on a self-driving car[C]//Proceedings of the ACM/IEEE 4th International Conference on Cyber-Physical Systems. Philadelphia, Pennsylvania, 2013: 31–40.

( 0) 0)

|

| [27] |

LEE G H, FAUNDORFER F, POLLEFEYS M. Motion estimation for self-driving cars with a generalized camera[C]//Proceedings of 2013 IEEE Conference on Computer Vision and Pattern Recognition. Washington DC, USA, 2013: 2746–2753.

( 0) 0)

|

| [28] |

HE Baohong, CHEN Jun, WANG Wei. Behavioral characteristics of self-driving tourists: a case study in Kunming[C]//Proceedings of the 7th International Conference onTraffic and Transportation Studies 2010. Kunming, China, 2010: 577–586.

( 0) 0)

|

| [29] |

段建民, 石慧, 战宇辰. 基于机器视觉筛选GPS卫星信号的无人驾驶汽车组合导航方法[J]. 电子技术应用, 2016, 42(1): 111-114. DUAN Jianmin, SHI Hui, ZHAN Yuchen. Integrated navigation system for unmanned intelligent vehicle based on vision[J]. Application of electronic technique, 2016, 42(1): 111-114. (  0) 0)

|

| [30] |

戴斌, 聂一呜, 孙振平, 等. 地面无人驾驶技术现状及应用[J]. 汽车与安全, 2012(3): 46-49. DAI Bin, NIE Yiming, SUN Zhenping, et al. The present situation and application of ground unmanned Technology[J]. Auto and safe, 2012(3): 46-49. (  0) 0)

|

| [31] |

杨帆. 无人驾驶汽车的发展现状和展望[J]. 上海汽车, 2014(3): 35-40. YANG Fan. Development Status and Prospects of Driverless Vehicles[J]. Shanghai automotive, 2014(3): 35-40. (  0) 0)

|

| [32] |

W.KJ. 教机器学会" 看路”的新系统助力无人驾驶汽车研发[J]. 军民两用技术与产品, 2016(1): 23. W. KJ. Teach the machine learn " to see the road” of the new system to help driverless car research and development[J]. Dual use technology and product, 2016(1): 23. (  0) 0)

|

| [33] |

王雪玉. 无人驾驶驶入现实[J]. 金融科技时代, 2016, 24(7): 87. WANG Xueyu. Autonomous vehicles into the reality[J]. Financial technology time, 2016, 24(7): 87. (  0) 0)

|

| [34] |

王雪玉. 百度无人驾驶汽车: 符号意义大于实际意义[J]. 金融科技时代, 2016, 24(1): 77. WANG Xueyu. Baidu driverless car: Symbolic meaning is greater than the actual meaning[J]. Financial technology time, 2016, 24(1): 77. (  0) 0)

|

| [35] |

王丽娜. 蓄势待发的无人驾驶汽车[J]. 科技导报, 2016, 34(6): 8. WANG Lina. Autonomous vehicles begins[J]. Science and technology review, 2016, 34(6): 8. (  0) 0)

|

| [36] |

张伟.读懂百度L3事业部|中国智能汽车国际论坛[EB/OL].(2016-11-07)[2017-01-06] https://www.leiphone.com/news/201611/DkiMOUA3c8wcD7Mz.html.

( 0) 0)

|

| [37] |

Roberto Baldwin.2018年自动驾驶汽车如何发展?看看国外都做了啥[EB/OL]. (2017-12-26)[2017-01-06]http://tech.163.com/17/1226/08/D6IOKV2F00098IEO.html.

( 0) 0)

|

| [38] |

郭永辉. 宇通公司研发的无人汽车驾驶大客车在全开放道路测试陈宫[EB/OL].(2015-09-08)[2016-09-20] http://www.cheyun.com/content/19995.

( 0) 0)

|

| [39] |

姜红德. IT助跑长安智能汽车[J]. 中国信息化, 2016(5): 49-51. JIANG Hongde. Changan smart car run by IT[J]. China information technology, 2016(5): 49-51. (  0) 0)

|

| [40] |

宋杰. 国家首个无人驾驶汽车测试基地正式开园中国未来智能汽车" 摇篮”选址上海嘉定[J]. 中国经济周刊, 2016(24): 74-75. SONG Jie. The country’s first unmanned vehicle test base open officially. China’s future mart car sites Jiading, Shanghai[J]. China economic weekly, 2016(24): 74-75. (  0) 0)

|

| [41] |

王晨曦. 争夺无人驾驶测试场[J]. 经营者, 2016(3): 69-70. WANG Chenxi. Competition for pilotless test field[J]. Operators, 2016(3): 69-70. (  0) 0)

|

| [42] |

NAMIK H, INAMURA T, STOL K. Development of a robotic driver for vehicle dynamometer testing[C]//Proceedings of 2006 Australasian Conference on Robotics and Automation. Auckland, New Zealand, 2006: 1–9.

( 0) 0)

|

| [43] |

王艺帆. 自动驾驶汽车感知系统关键技术综述[J]. 汽车电器, 2016(12): 12-16. WANG YIFAN. A review of key technologies of autonomous Vehicle Perception system[J]. Automotive, 2016(12): 12-16. (  0) 0)

|

| [44] |

陈诚. 无人驾驶汽车市场应用研究[J]. 现代制造技术与装备, 2016(1): 167-168. CHEN Cheng. Application research of unmanned vehicle market[J]. Modern manufacturing technology and equipment, 2016(1): 167-168. (  0) 0)

|

| [45] |

小猴机器人. 一张图看清自动驾驶产业[EB/OL].(2016-06-23)[2016-09-20] http://chuansong.me/n/374839151851.2016-07-20.

( 0) 0)

|

| [46] |

黄如林, 梁华为, 陈佳佳, 等. 基于激光雷达的无人驾驶汽车动态障碍物检测、跟踪与识别方法[J]. 机器人, 2016, 38(4): 437-443. HUANG Rulin, LIANG Huawei, CHEN Jiajia, et al. Lidar based dynamic obstacle detection, tracking and recognition method for driverless cars[J]. Robot, 2016, 38(4): 437-443. (  0) 0)

|

| [47] |

丁日智. 浅谈无人驾驶汽车技术原理[J]. 科学中国人, 2016(15): 31. DING Rizhi. About the principle of driverless car[J]. Chinese journal of ecology, 2016(15): 31. (  0) 0)

|

| [48] |

思慕. 一颗摄像头, 就能实现无人驾驶[EB/OL]. (2015-08-03)[2016-07-20] https://www.Leiphone.com/news/201508/tolnlbcnTwv6RhwQ.htmlTOMÈ.

( 0) 0)

|

| [49] |

TOMÈ D, MONTI F, BAROFFIO L, et al. Deep convolutional neural networks for pedestrian detection[J]. Signal processing: image communication, 2016, 47: 482-489. DOI:10.1016/j.image.2016.05.007 ( 0) 0)

|

| [50] |

KRIZHEVSKY, et al. ImageNet classification with deep convolutional neural networks[J]. Communications of the ACM, 2012, 60(2): 1097-1105. ( 0) 0)

|

| [51] |

JACKEL L D, SHARMAN D, STENARD C E, et al. Optical character recognition for self-service banking[J]. AT and T technical journal, 1995, 74(4): 16-24. DOI:10.1002/bltj.1995.74.issue-4 ( 0) 0)

|

| [52] |

RUSSAKOVSKY O, DENG J, SU H, et al. ImageNet large scale visual recognition challenge[J]. International journal of computer vision, 2015, 115(3): 211-252. DOI:10.1007/s11263-015-0816-y ( 0) 0)

|

| [53] |

WONG N, CHAMBERS C, STOL K, et al. Autonomous vehicle following using a robotic driver[C]//Proceedings of the 15th International Conference on Mechatronics and Machine Vision in Practice. Auckland, New Zealand, 2008: 115–120.

( 0) 0)

|

| [54] |

YESHODARA N S, NAGOJAPPA N S, KISHORE N. Cloud based self driving cars[C]//Proceedings of 2014 IEEE International Conference on Cloud Computing in Emerging Markets. Bangalore, India, 2014: 1–7.

( 0) 0)

|

| [55] |

LOKHMOTOV A, FURSIN G. Optimizing convolutional neural networks on embedded platforms with OpenCL[C]//Proceedings of the 4th International Workshop on OpenCL. Vienna, Austria, 2016: 10.

( 0) 0)

|

| [56] |

NVIDIA. 自动驾驶汽车的人工智能车辆计算机[EB/OL]. (2016-3-15) [2016-09-20] www.nvidia.com/object/drive-px.html.

( 0) 0)

|

| [57] |

CHO. 神秘不再 NVIDIA下一代GPU架构Pascal初探[EB/OL]. (2016-04-08)[2016-09-20] https://www.evolife.cn/html/2016/86937.html.

( 0) 0)

|

| [58] |

FLORENTINE E, ANDERSEN H, ANG M A, et al. Self-driving vehicle acknowledgement of pedestrian presence conveyed via Light-Emitting Diodes[C]//Proceedings of 2015 International Conference on Humanoid, Nanotechnology, Information Technology, Communication and Control, Environment and Management. Cebu City, Philippines, 2015: 1–6.

( 0) 0)

|

| [59] |

中国投资咨询网. 无人驾驶汽车产业链报告: 东方既白, 关键环节日渐成熟[EB/OL].(2016-04-26)[2016-08-29] http://www.ocn.com.cn/chanye/201604/zzyoh26084645.shtml.

( 0) 0)

|

| [60] |

BADRINARAYANAN V, HANDA A, CIPOLLA R. SegNet: a deep convolutional encoder-decoder architecture for robust semantic pixel-wise labelling[J]. Computer Science, 2015: 13–23

( 0) 0)

|

| [61] |

KENDALL A, CIPOLLA R. Modelling uncertainty in deep learning for camera relocalization[C]//Proceedings of 2016 IEEE International Conference on Robotics and Automation. Stockholm, Sweden, 2015(31): 4762–4769.

( 0) 0)

|

| [62] |

JAYCIL Z. VARGHESE. Overview of autonomous vehicle sensors and systems[C]//Proceedings of the 2015 International Conference on Operations Excellence and Service Engineering Orlando, Florida, 2015(9): 178–191.

( 0) 0)

|

| [63] |

HUANG Wuling, WEN Ding, et al. Task-Specific performanceevaluationof UGVs: case studies at the IVFC[J]. IEEE transactions on intelligent transportation systems, 2014, 15(5): 1969-1979. DOI:10.1109/TITS.2014.2308540 ( 0) 0)

|

| [64] |

CHEN Xiang, QIAO Yu. Road segmentation via iterative deep analysis[C]//Proceedings of 2015 IEEE International Conference on Robotics and Biomimetics. Zhuhai, China, 2015: 2640–2645.

( 0) 0)

|

| [65] |

MONTEMERLOM S, et al. Junior: the Stanford entry in the urban challenge[J]. Journal of field robotics, 2008, 25(9): 569-597. DOI:10.1002/rob.v25:9 ( 0) 0)

|

| [66] |

ŽBONTARJ, LECUNY. Stereo matching by training a convolutional neural network to compare image patches[J]. The journal of machine learning research, 2016, 17(1): 2287-2318. ( 0) 0)

|

| [67] |

POMERLEAU D A. Alvinn: an autonomous land vehicle in a neural network[R]. Pittsburgh:Carnegie-Mellon University, 1989.

( 0) 0)

|

| [68] |

ŽBONTAR J, LECUN Y. Computing the stereo matching cost with a convolutional neural network[C]//Proceedings of 2015 IEEE Conference on Computer Vision and Pattern Recognition. Boston, USA,2015: 1592-1599.

( 0) 0)

|

| [69] |

POMERLEAU D A. Alvinn: an autonomous land vehicle in a neural network[R]. Pittsburgh:Carnegie-Mellon University, 1989.

( 0) 0)

|

| [70] |

SANTANA E, HOTZ G. Learning a driving simulator[J]. arXiv preprint arXiv: 1608.01230, 2016.

( 0) 0)

|

| [71] |

SHALEV-SHWARTZ S, BEN-ZRIHEM N, COHEN A, et al. Long-term planning by short-term prediction[J]. arXiv preprint arXiv: 1602.01580, 2016.

( 0) 0)

|

| [72] |

BOJARSKI M, DEL TESTA D, DWORAKOWSKI D, et al. End to end learning for self-driving cars[J]. arXiv preprint arXiv: 1604.07316, 2016.

( 0) 0)

|

| [73] |

KENDALL A, GRIMES M, CIPOLLA R. PoseNet: a convolutional network for real-time 6-DOF camera relocalization[J]. arXiv preprint arXiv: 1505 .07427, 2016.

( 0) 0)

|

| [74] |

孙皓天. 深度学习在无人驾驶汽车中的应用[J]. 电脑知识与技术, 2015, 11(24): 121-123. SUN Haotian. Deep learning on the application of the driverless cars[J]. Computer knowledge and technology, 2015, 11(24): 121-123. (  0) 0)

|

| [75] |

徐彬, 李明喜, 周晶晶, 等. 洞察无人车辆技术发展[J]. 机器人产业, 2016(1): 67-74. XU Bin, LI Mingxi, ZHOU Jingjing, et al. Annual insight into the technical development of unmanned vehicles[J]. Botman Industry, 2016(1): 67-74. (  0) 0)

|

| [76] |

HE U, CHEN H, PAN I, et al. Using edit distance and junction feature to detect and recognize arrow road marking[C]//Proceedings of the 17th International IEEE Conference on Intelligent Transportation Systems. Qingdao, China, 2014.

( 0) 0)

|

| [77] |

DIELS C, BOS J E. User interface considerations to prevent self-driving carsickness[C]//Adjunct Proceedings of the 7th International Conference on Automotive User Interfaces and Interactive Vehicular Applications. Nottingham, United Kingdom, 2015: 14–19.

( 0) 0)

|

2018, Vol. 13

2018, Vol. 13