2. 北京国电通网络技术有限公司, 北京 100070

2. Beijing GuoDianTong Network Technology Co. Ltd, Beijing 100070, China

随着遥感技术和模式识别技术的不断发展,遥感图像目标分类识别,尤其是光学遥感图像中的目标分类识别,已经成为了遥感图像处理和分析领域备受关注的重要方向[1]。

光学遥感图像目标识别算法的准确性很大程度上取决于所提取特征的适应性。文献[2]提出了基于自组织特征映射(self-organizing feature map,SOFM)网络模型的纹理分类算法,该算法仅对飞机目标得到了较好的识别效果;文献[3]提出了一种能同时检测多个半径不一的圆形目标的Hough改进算法;文献[4]采用模板匹配方法对提取了边缘特征的目标进行粗检测,然后利用形状模型完成细匹配进行飞机的识别,这一过程中采用PCA(principal component analysis)降维方法增强样本空间的可描述性,但耗时较长,通用性不强。以上研究表明:单一特征的识别性能有限,将单一特征应用在多类目标分类识别上容易造成某一类目标的显著特征丢失而降低识别的准确性。因此多特征融合是提高多目标分类识别性能的一个有效方案。

在多特征融合领域包含特征级和决策级融合2个方面,特征级融合保留了目标的有效信息且分类精度较高,但该类方法不宜实现多种异构特征的融合;决策级融合整体上降低了误判率,计算复杂度低且易于实现异构特征的融合。文献[5]对高分辨率遥感图像多个场景分别提取图像的视觉词袋局部特征、颜色直方图特征以及Gabor纹理特征,并对SVM(support vector machine)分类结果进行自适应加权综合获得了较高的识别率。该算法在决策级融合过程中较合理地解决了不同目标的显著特征差异性问题,但所选择的数据库存在一定的偶然因素;文献[6]采用多核学习的决策级融合算法实现对飞机、油罐和舰船的分类。该方法融合了目标的形状核、点核以及外观核,得到了较理想的识别结果,然而耗时较长,分析其所用数据库可知目标的旋转差异性小,特征适应性不强。尽管多特征决策级融合在解决分类问题上表现出了一定的优势,但计算复杂度较高是该类方法发展的最大瓶颈。

综上所述,本文提出了一种新的多特征决策级融合的多类目标识别算法,在特征提取阶段提出了一种对目标的全局和局部特性描述充分的分层的BoF-SIFT(bag of feature-scale invariant feature transform)特征,并对传统的形状SC(shape context)特征做了多方面的改进使其具有较强旋转适应性,在分类识别阶段设计了多特征决策级融合策略,该融合方法易于实现,最终取得令人满意的识别结果。

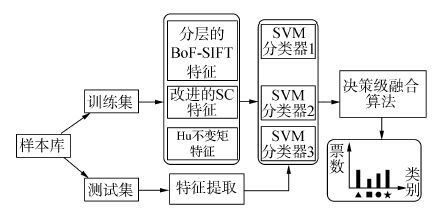

1 算法整体框架本文算法的整体框架如图 1所示。

|

| 图 1 算法的整体框架 Fig. 1 The framework of the algorithm |

算法大致分为4个步骤。

1) 特征提取:将光学遥感图像中的4类目标分为训练集和测试集,分别提取分层的BoF-SIFT特征、改进的SC特征和Hu不变矩特征,以上选取的3种特征共性是都能满足目标的平移、缩放和旋转不变性;

2) 分类器的训练:利用3种特征,采用交叉验证的方法训练基于径向基核函数的一对一支持向量机,得到多个一对一的支持向量机分类器;

3) 根据所设计的决策级概率融合策略,确定最优的概率融合权值;

4) 将测试集特征分别送入已训练好的相对应的支持向量机分类器得到单一特征的输出概率,在最优权值组合的基础上得到决策级融合结果。

2 多特征提取特征提取是目标分类识别中至关重要的一步,本文选取了能够适应光学遥感图像平移、缩放和旋转差异性的分层的BoF-SIFT特征、改进的SC特征和Hu不变矩特征。

2.1 分层的BoF-SIFT特征鉴于遥感图像目标在尺度、缩放和旋转等方面均具有较大的差异性,且在外界环境中受到光照强度、背景复杂及阴影的干扰,对目标的准确分类识别带来了极大的难度。由于SIFT(scale invariant feature transform)特征在多种特征描述算子中拥有较优的鲁棒性,广泛应用在各个领域,因此本文在传统的SIFT特征基础上提出了一种分层的BoF-SIFT特征对遥感图像进行表示。

首先针对每个目标所能检测到的特征点数量和位置不同,导致SIFT特征维数不唯一的问题,本文采用固定目标的特征点数及位置的方法给予处理;其次BoF思想能直观地表示目标的特征,既能体现同一目标的相似度,又能体现不同目标的差异性;图像金字塔思想能更细致地表示目标特征的分布特性,以上3点结合就得到了分层的BoF-SIFT特征表示。

生成分层的BoF-SIFT特征的过程如图 2所示。

|

| 图 2 分层的BoF-SIFT特征提取算法示意图 Fig. 2 The processing of hierarchical features extraction |

1) 生成SIFT描述子:样本总数为m,目标的像素大小为100×100,为了能充分表示目标的局部特征及统一特征维数,除去边缘2个像素的边缘效应将剩余区域均匀划分为11×11=121个特征点,每两个特征点相隔8个像素,然后以特征点为中心的16×16邻域窗口采样,之后将其划分为4×4的子区域,对16个子区域进行平滑处理,在每个子区域内提取8个方向的幅值和梯度信息,即每个特征点的SIFT描述子由4×4×8=128维的特征进行表示,最终得到所有样本中m×121个特征点的SIFT描述子;

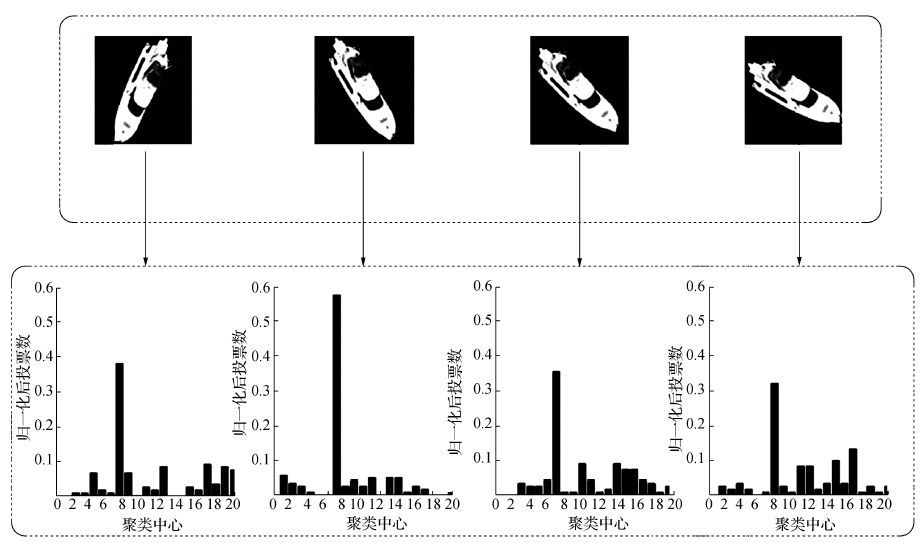

2) 生成BoF-SIFT[7]特征:将所有样本中提取的m×121个特征点的SIFT描述进行K-means++聚类[8],该聚类方法弥补了传统的K-means聚类种子点随机选取的不足,图 3和图 4分别为不同目标的BoF-SIFT描述子和同一目标在不同旋转角度下的BoF-SIFT特征表示,显然不同目标之间呈现了一定的差异性及同一目标之间具有一定的相似性,表明BoF-SIFT具有较好的旋转鲁棒性;

|

| 图 3 不同目标的BoF-SIFT描述子 Fig. 3 The BoF-SIFT descriptors of different targets |

|

| 图 4 同一目标的在不同旋转角度下的BoF-SIFT特征表示 Fig. 4 The BoF-SIFT feature representation of the same target with different rotation angle |

3) 构造图像金字塔[9]:将样本分成3层,第3层为整个样本,第2层划分为2×2个子块,第3层划分为4×4个子块,共有21个子块;

4) 生成分层的BoF-SIFT特征:将金字塔中21个子块的特征分别向K个聚类中心投影,得到21个K维特征向量直方图。

2.2 改进的SC特征SC特征[10]又称为形状上下文,它是一种直观的特征表示,描述了所提取特征点到所有特征点的矢量关系。对于具有目标大小和角度差异性的遥感图像,SC特征是不能很好地完成分类识别的本文在传统SC特征算法基础上做了以下4点改进:

1) 本文仅对采样点的中心生成描述符,这样能够很好地去除大量冗余信息,也能节省运行时间;

2) 对半径均匀划分,减弱传统对数极坐标半径的不均匀划分对采样点的密集度带来的影响;

3) 统计所有采样点到中心点的距离,自动从中选取最大的距离为极坐标的最大圆环半径,克服了SC特征不具有缩放不变性的不足;

4) 通过采样点到中心的距离找到目标的对称轴,并统一将其旋转到竖直方向,这一改进使提出的SC特征具备了旋转适应性。图 5为改进的SC特征与传统的SC特征表示对比。 从图 5分析表明对原图预处理后提取改进的SC特征,信息分布克服了大量冗余信息的存在,缩短了运行时间,对于光学遥感图像的目标识别具备了较好的平移、旋转和缩放不变性。

|

| 图 5 改进前后的SC特征对比 Fig. 5 The comparison between improved SC features and the traditional SC feature |

Hu不变矩[11]是通过计算图像的低阶(二阶和三阶)归一化中心矩进行非线性组合得到7个量值,该特征满足平移、缩放和旋转不变性、计算速度快、对图像中较大目标识别较好。表 1为本文4类遥感图像提取的Hu不变矩特征部分特征值表示。

| 目标图像 | Hu不变矩特征 | ||||||

| 数据1 | 数据2 | 数据3 | 数据4 | 数据5 | 数据6 | 数据7 | |

| 船舰 | 2.82×10-3 | 3.94×10-6 | 6.79×10-9 | 6.43×10-9 | 4.24×10-17 | 1.27×10-11 | 2.61×10-18 |

| 飞机 | 1.88×10-3 | 7.14×10-7 | 1.88×10-9 | 2.82×10-10 | 2.04×10-19 | 2.05×10-13 | 1.74×10-20 |

| 汽车 | 1.16×10-3 | 5.25×10-7 | 1.56×10-10 | 200×10-11 | 1.02×10-21 | 7.78×10-15 | 4.61×10-22 |

| 油罐 | 2.19×10-3 | 1.50×10-8 | 1.64×10-11 | 3.07×10-10 | 2.11×10-20 | 2.02×10-14 | 5.01×10-21 |

本文算法选取的3个特征在具有平移、缩放和旋转不变性这一共同的性质下利用各自的优势弥补了互相的不足,分层的BoF -SIFT特征相比后2种对图像背景的适应性强,不依赖于图像的预处理,并且对细节分布描述充分,改进之后的SC特征对形状的描述体现了一定的优势,Hu不变矩特征提取简单且快速。

3 识别算法支持向量机(support vector machine, SVM)[12] 在解决小样本、非线性及高维模式识别中表现出了许多特有的优势,具有通用性、鲁棒性、有效性、计算简单和理论完善等优点。

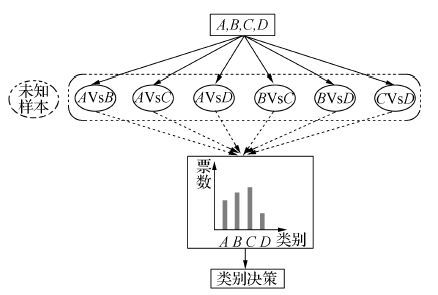

3.1 多类支持向量机分类算法支持向量机本身是个两类问题的判别方法,本文采用最常用的一对一分类法[13],该方法是在每两类间训练一个分类器,即将训练集(k个不同类别)构造为P=k(k-1) /2个分类器,分别对每一个组合采用求解两类问题的SVM进行分类,最终求得P个判别函数,当对测试集中的未知样本进行分类时,每个分类器都会根据判别函数对其类别进行判断,并为相应的类别投上一票,最后得票最多的类别即作为该未知样本的类别,当两个类别具有同样多的票数时则选择类别标签较小的一类作为样本的类别,这种策略称为“投票法”。

图 6为4类样本情况下一对一分类法的结构示意图,4类样本可以构造6个分类器,同时获得6个判别函数,当对未知样本测试时,每一个判别函数会给出一个结果,将6个结果投票,投票最多的即为该未知样本的测试类别。

|

| 图 6 一对一分类法结构示意图 Fig. 6 The schematic of OVO SVM |

由于本文所提取的3种特征的维数相差较大,不利于在特征级进行融合。为了解决异构特征的融合问题,提出了一种新的多特征决策级融合策略(本文数据库中含有4类样本),该策略通过对训练集样本的分类准确率交叉验证可以训练得到每种特征对应的6个基于径向基核函数的一对一SVM分类器。 通过上述的投票法可以分别获得3种特征对于训练样本的目标识别概率。以一定步长遍历所有可能选择的权值,使训练样本的识别准确率最高来确定最优融合权值。该识别方法实现简单,识别率较单一特征有了较大的提高,达到了预期效果。其中决策级融合及最优权值确定过程如图 7所示。

|

| 图 7 决策级融合实现过程 Fig. 7 The process of decision fusion strategy |

其中i=1, 2, 3, 4表示4类目标,每一类目标含有k个样本;j=1, 2, 3表示3种特征,决策级融合及最优权值的确定由以下3步实现:

1) 对所有训练样本分别计算3种特征对应的Pij、Pij表示每一个样本提取第j个特征后属于第i类目标的概率;

2) 设αj表示第j个特征的权重,αj的选取要求满足

3) 统计每一类样本的正确分类数ni,即计算每一个样本的i=max{P1, P2, P3, P4},将该样本预测类别定义为第i类,比较预测类别和真实类别,相同则置为1,不同则置为0。对应所有训练样本的总识别率P定义为

重复2) 、3) ,遍历所有可能的αj组合,得到对应不同权值时的训练样本的总识别率。选取训练样本识别率最高时的权值组合作为最优权值,用于对测试样本的最终加权融合识别。

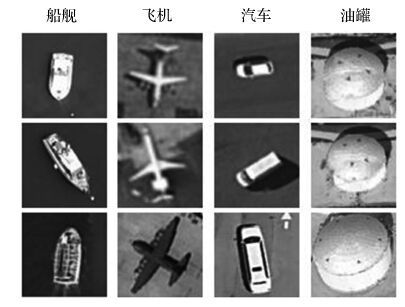

4 实验结果本文在自行建立的遥感图像库对提出算法进行了测试。数据库包含舰船、飞机、汽车和油罐,数据库总共包含74×4幅图像,部分图例如图 8所示。

|

| 图 8 数据库的部分目标样本图像 Fig. 8 The target samples in the dataset |

多次实验表明特征提取时的最优参数为:训练样本数为47×4=188幅图像,测试样本数为27×4=108幅图像。提取分层的BoF-SIFT特征时聚类中心数为20类,图像金字塔层数为3层;提取改进的SC特征时将对数极坐标划分为5个不同半径,12个不同角度即5×12=60个小区域,采样点数为50个点。3种特征对应的识别结果如表 2所示。

| 实验序号 | 特征 | 识别率/% | 耗时/s |

| 实验一 | 分层的BoF-SIFT特征 | 88.89 | 0.100 236 |

| 实验二 | 改进的SC特征 | 65.74 | 0.065 927 |

| 实验三 | Hu不变矩特征 | 65.74 | 0.029 048 |

| 实验四 | 决策级融合算法 | 93.52 | 0.005 432 |

表 2表明分层的BoF-SIFT特征性能远远好于其余2种特征,原因在于后面2种特征不能很好地处理复杂背景,预处理的好坏对结果的影响很大,由于特征维数依次减少运行速度相应提高。

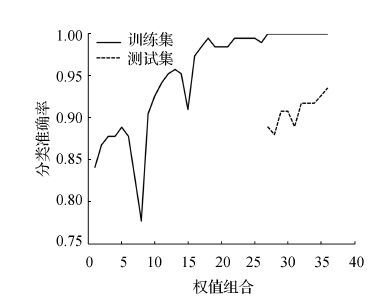

4.2 多特征决策级融合结果最优权值的选取及测试集实验结果如图 9所示。图 9实线表示训练集不同权值组合下的分类准确率,观察可知在最后10个权值组合下分类准确率达到了100%,是在分层的BoF-SIFT特征比例远大于其余两种特征比例的情况下取得的,图 9虚线为测试集样本在决策级融合得出的10个权值组合下的识别结果,总体均高于单特征的识别结果,在第10组权值组合即5:4:1下,测试集的分类准确率达到了93.52%,其中分层的BoF-SIFT特征对目标的分布信息描述详细, 因此比例最大;改进的SC特征对目标的形状信息表示充分, 因此比例次之;Hu不变矩描述目标的7维矩特征相比之下对决策级融合起到了辅助作用, 因此比例最小。综上所述93.52%的识别率达到了预期效果,而且每一个测试样本的识别时间为0.005 432s,在时间上体现了一定的优越性,验证了本文所提算法的高效性和有效性。

|

| 图 9 不同权值组合下的分类准确率 Fig. 9 Classification accuracy representation of different weights |

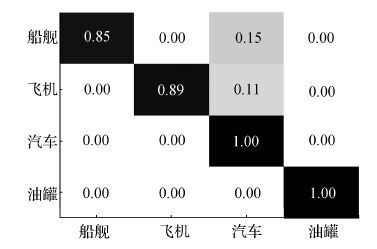

图 10为最优权值组合5:4:1下的决策级融合识别结果。

图 10中混淆矩阵中的数字表示该位置纵向目标被识别为横向目标的概率,且每个概率通过不同程度的渐变灰色形象地表示在混淆矩阵中。图 10的多特征决策级融合结果表明汽车和油罐的识别结果较舰船和飞机好,舰船和飞机都和汽车容易混淆,原因可能是舰船的形状与汽车相似度高,飞机背景在4类目标中相对复杂,由于阴影的干扰导致错误识别为汽车。

|

| 图 10 5:4:1组合下的纵向决策级融合结果 Fig. 10 Confusion matrix representation of decision fusion recognition under the weight 5:4:1 |

本文提出了一种基于多特征决策级融合的光学遥感图像多目标识别算法,特征提取中选取了各有优缺点的分层的BoF-SIFT特征、改进的SC特征和Hu不变矩特征,然后采用一对一支持向量机算法在最优参数下对每一种特征进行识别,最后提出一种决策级融合策略,实验表明决策级融合算法实现简单,结果优于单特征识别结果。下一步的工作将考虑针对不同特征的特点选择不同类型的分类器进行识别,并尝试研究不同类型分类器决策级融合的策略来进一步提高识别的准确性。

| [1] | 姬晓飞, 秦宁丽. 基于光学遥感图像的目标检测与分类识别方法[J]. 沈阳航空航天大学学报 , 2015, 32 (1) : 23-31 JI Xiaofei, QIN Ningli. Target detection and classified recognition method based on optical remote sensing image[J]. Journal of Shenyang aerospace university , 2015, 32 (1) : 23-31 |

| [2] | 杨斌, 赵红漫, 赵宗涛, 等. 一个改进的遥感图像目标纹理分类识别算法[J]. 微电子学与计算机 , 2004, 21 (9) : 111-113 YANG Bin, ZHAO Hongman, ZHAO Zongtao, et al. A removed texture classification and distinction algorithm of remoted sensing martial object[J]. Microelectronics & computer , 2004, 21 (9) : 111-113 |

| [3] | CHEN Zhong, LIU Jianguo, WANG Guoyou. A new circle targets extraction method from high resolution remote sensing imagery[C]//Proceedings of the 2011 Fourth International Workshop on Advanced Computational Intelligence. Wuhan, 2011:529-533. |

| [4] | LIU Ge, SUN Xian, FU Kun, et al. Aircraft recognition in high-resolution satellite images using coarse-to-fine shape prior[J]. IEEE geoscience and remote sensing letters , 2013, 10 (3) : 573-577 DOI:10.1109/LGRS.2012.2214022 |

| [5] | 刘帅, 李士进, 冯钧. 多特征融合的遥感图像分类[J]. 数据采集与处理 , 2014, 29 (1) : 108-115 LIU Shuai, LI Shijin, FENG Jun. Remote sensing image classification based on adaptive fusion of multiple features[J]. Journal of data acquisition and processing , 2014, 29 (1) : 108-115 |

| [6] | LI Xiangjuan, SUN Xian, SUN Hao, et al. Generalized multiple kernel framework for multiclass geospatial objects detection in high-resolution remote sensing images[J]. Optical engineering , 2012, 51 (1) : 1-10 |

| [7] | SHARMA G, CHAUDHURY S, SRIVASTAVA J B. Bag-of-features kernel eigen spaces for classification[C]//Proceedings of the 19th International Conference on Pattern Recognition. Tampa, FL, 2008:1-4. |

| [8] | ARTHUR D, VASSILVITSKⅡ S. K-means++:the advantages of careful seeding[C]//Proceedings of the eighteenth annual ACM-SIAM symposium on Discrete algorithms. Philadelphia, PA, 2007:1027-1035. |

| [9] | LAZEBNIK S, SCHMID C, PONCE J. Beyond bags of features:spatial pyramid matching for recognizing natural scene categories[C]//Proceedings of IEEE Computer Society Conference on Computer Vision and Pattern Recognition. New York, NY, USA, 2006:2169-2178. |

| [10] | BELONGIE S, MALIK J, PUZICHA J. Matching shapes[C]//Proceedings of the Eighth International Conference on Computer Vision. Vancouver, BC, 2001, 1:454-461. |

| [11] | 张儒良, 席泓, 王林. 一种基于Hu不变矩的匹配演化算法[J]. 西南师范大学学报:自然科学版 , 2012, 37 (5) : 11-15 ZHANG Ruliang, XI Hong, WANG Lin. An image matching evolutionary algorithm based on Hu invariant moments[J]. Journal of southwest China normal university:natural science edition , 2012, 37 (5) : 11-15 |

| [12] | HUANG Qirui, WU Guangmin, CHEN Jianming, et al. Automated remote sensing image classification method based on FCM and SVM[C]//Proceedings of the 20122nd International Conference on Remote Sensing, Environment and Transportation Engineering. Nanjing, 2012:1-4. |

| [13] | 薛宁静. 多类支持向量机分类器对比研究[J]. 计算机工程与设计 , 2011, 32 (5) : 1792-1795 XUE Ningjing. Comparison of multi-class support vector machines[J]. Computer engineering and design , 2011, 32 (5) : 1792-1795 |