2. 济南大学 山东省网络环境智能计算技术重点实验室, 山东 济南 250022;

3. 山东建筑大学 信息与电气工程学院, 山东 济南 250101;

4. 山东建筑大学 山东省智能建筑重点实验室, 山东 济南 250101;

5. 山东省电力科学研究院, 山东 济南 250002

2. Shandong Provincial Key Laboratory of Network Based Intelligent Computing, University of Jinan, Jinan 250022, China;

3. School of Information and Electrical Engineering, Shandong Jianzhu University, Jinan 250101, China;

4. Shandong Province Key Laboratory of Intelligent Building, Shandong Jianzhu University, Jinan 250101, China;

5. Shandong Electric Power Research Institute, Jinan 250002, China

利用视觉伺服的机器人机械手自动抓取和安放物体,需要精确实时定位所抓取物体的空间位置,双目视觉是机器人视觉伺服一种常用的有效工具。双目视觉可实现目标的近距离精确定位,即利用目标在双目图像中的位置信息计算目标的空间三维坐标。根据实际应用选择一种可靠、有效的跟踪算法是实现目标精确定位的前提,基于双目视觉的目标跟踪具有重要的研究价值及应用前景。

背景差分法[1]与帧间差分法[2]是2种简单常用的目标检测方法,建立一个良好的背景模型是背景差分法能有效检测目标的前提,稳定的背景是帧间差分法能有效检测移动目标的基础。CamShit[3]算法是一种经典、有效的跟踪算法,主要运用目标的色彩信息在图像中检测并跟踪目标。然而,CamShift算法过度依赖色彩信息,且没有参考目标的结构、纹理等其他可区分与背景的目标,在应用方面具有一定的局限性。当目标的色彩信息较弱或背景中出现大量与目标色彩相近的区域时,CamShift跟踪算法往往失效。高斯混合模型是一种背景建模方式,主要适用于有规律变化的背景,难以在多变的环境中泛化使用。然而,电力机器人的工作环境是多变的,往往很难建立一种泛化能力极强的背景模型,因此以上方法均不能满足设计需要。文献[4]将稀疏表示应用于目标,根据建立的目标字典实现固定目标的跟踪。稀疏方程的求解是一个NP-hard问题,其最优值的搜索具有较高的运算复杂度。基于稀疏表示的目标跟踪算法的理论及程序设计较为复杂,难以在工程应用中进行推广及维护。基于主动轮廓模型 [5]、主动形状模型[6]的跟踪方法易受到背景的干扰,并且理论及算法复杂,同样不适用于在工程中推广及维护。因此,需要研究一种简单、高效、可满足需求的目标跟踪算法。

基于双目视觉系统的目标跟踪又有其自身的特殊性,对目标跟踪精度有较高的要求,需要在重建三维信息前完成配准工作。针对不同的应用背景,一些研究人员进行了相关研究并确定较好的效果。例如,在序贯测机制下,利用粒子滤波、稀疏场主动轮廓和CamShift等方法在双目视觉中跟踪目标 [7];在机器人的双目视觉中,针对机器人静止-目标运动和机器人运动-目标运动2种模式,利用不同的特征提取方法跟踪运动目标,如颜色直方图、CamShift算法、Hu矩等特征[8],目标的颜色、纹理等信息[9];不管运用双目视觉实现自动空中加油导航功能[10],还是实现运动物体的实时跟踪与测距[11]、道路交通预警[12]、多目标跟踪[13],目标的跟踪与配准是基础工作。双目视觉系统中的目标跟踪与配准的精度决定了视觉伺服系统的性能,研究一种简单、高效的基于双目视觉系统的目标跟踪算法具有重要的价值。

本文研究了一种基于双目视觉系统的目标跟踪算法。该算法利用了极线几何及运动一致性原则引导搜索方向,以投影直方图匹配为目标检测手段,实现了双目视觉系统的目标精确跟踪。目标在一个双目视觉结构固定的双目图像中的位置满足极线几何关系,目标具有运动一致性的原则,即目标的运动状态不会发生较大突变。运用这2个关系,可有效限制目标的搜索范围和搜索方向,提高目标跟踪算法的运算效率,且在双目视觉中跟踪到的是已经完成配准的目标。投影直方图是常用的一种图像分析工具,它反映一定方向上的能量累积效应,同时又保留了一定的位置分布信息。结合多颜色空间信息融合技术 [14],根据不同的应用环境及跟踪目标,动态选择一组可有效表征跟踪目标颜色分量组合,以更加全面的信息保证跟踪的稳定性。

本文所提跟踪算法主要由3个基本模块组成:目标特征提取、目标检测和模板更新。经实验对比及验证,本文所提算法可满足设计要求。依据目标投影直方图特征搜索目标,背景的动态变化对搜索无影响。与其他算法相比,具有原理简单、高效、实用的优点。并且将双目视觉的目标跟踪与配准工作合二为一,以配准的方法引导目标搜索,得到已配准的跟踪目标。

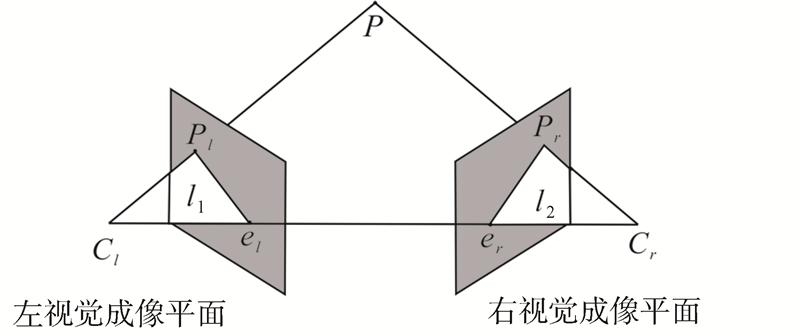

1 基本原理 1.1 极线几何原理在结构固定的双目视觉系统中,空间点P在双目图像中的成像位置(pl,pr)满足极线几何的约束准则,如图 1所示。假设双目摄像机满足针孔成像模型,Cl、Cr分别为左、右视觉的光心。光心连线ClCr与左右成像平面的2个交点el、er称为极点,空间点与2个光心的连线PCl、PCr,和双目成像平面的交点pl、pr即是空间点P在双目图像中的成像。若已知左视觉图像中的一点pl,则相应的实际空间点P可存在于直线Clpl上的任意点,故点P在右视觉中的成像点位于erpr直线上。因此,若已知左视觉中的成像点pl,可推导出左视觉中对应的一条极线l2,则右视觉中的成像点必在直线l2上。同理,pr与l1相对应,其对应关系满足固定基础矩阵F的约束[13],如式(1)、(2)所示。

|

| 图 1 极线几何结构Fig. 1 Stucture of epipolar geometry |

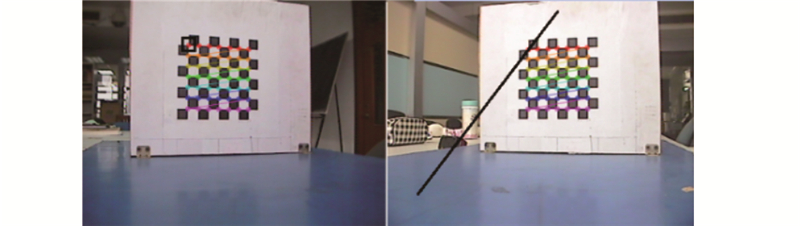

利用RANSAC算法或LMedS算法均可求解双目视觉系统的基础矩阵F [15]。已知右视觉中的一点,利用式(1)计算出的左视觉图像中的极线如图 2所示。利用双目视觉中的极线几何性质,有利于引导左右视觉中的目标配准。

|

| 图 2 极线几何示例Fig. 2 The experiment of epipolar geometry |

选择目标的投影直方图作为匹配特征,在图像序列中检测目标。以运动一致性原则作为约束,引导目标的搜索方向,加快跟踪算法运算速度。为了确保投影直方图能有效表达目标的特征,利用多颜色空间信息融合技术选择可最佳区分背景与目标的颜色分量,以多颜色分量的投影直方图匹配目标。

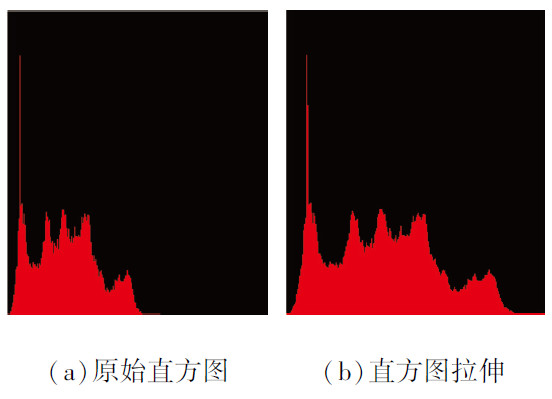

1.2.1 投影直方图匹配直方图是一种常用的特征,体现了图像的能量累计效应,可用于图像匹配[16]、图像增强 [17]等。投影直方图是一种常用的直方图计算方式,反映了沿一定方向上的能量累积和数据的分布特性。2个相互垂直方向上的投影直方图,即包含了统计信息又体现了结构信息。与其他特征提取方式相比,投影直方图具有原理简单、运算量小、易于维护的优点,实用价值高。以一个人工绘制的简单模型作为演示,如图 3所示,体现了投影直方图包含统计信息和结构信息的特点。

|

| 图 3 投影直方图示例Fig. 3 Projection histogram |

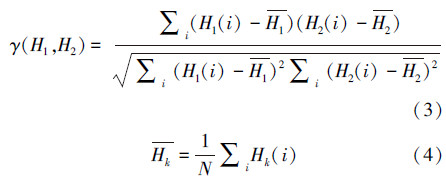

在每帧图像中,以当前检测区域的投影直方图与目标模板直方图的相关性为参考准则,判断当前检测区域是否为目标。文献[18]中,2个维数相等的直方图相关性计算如下:

在实际应用中,目标的运动或姿态的变化会引起目标在图像中大小或方向发生改变。在跟踪过程中需要适当地调整检测窗口的尺寸会引起投影直方图维数的改变。在计算2个直方图的相关性之前,需要对检测区域生成的投影直方图维数向模板对齐,即对直方图的维数进行缩放,如式(5)所示:

|

| 图 4 直方图缩放示例Fig. 4 Projection histogram resizing |

为了克服直方图毛刺对匹配精度的影响,需对直方图进行平滑处理。

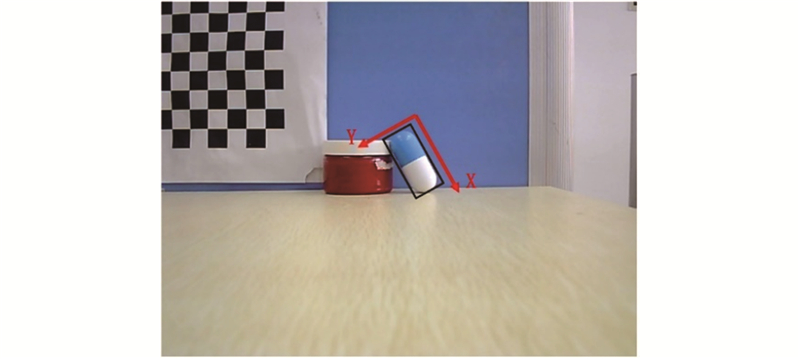

1.2.2 算法实现目标的投影直方图特征是一个集合,由多个颜色分量的投影直方图组成,每个变量的投影直方图包括2个方向: X方向和Y方向,它们分别与矩形检测窗口长、宽方向平行,如图 5所示。将这2个方向的直方图分别记为 HX和HY。

|

| 图 5 投影方向示例Fig. 5 Sample of projection orientation |

目标的正常运动状态是连续一致的,这一特点可有效引导搜索目标的方向和范围。目标在视频序列中的运动方式分为:平面运动vp、深度运动vD和旋转运动(θ)。平面运动引起目标位置的改变,深度运动引起目标大小的改变,旋转运动引起目标倾斜方向的变化。vp用来引导搜索窗口的移动距离,vD用来引导搜索窗口的长宽改变程度,θ用来引导搜索窗口方向的旋转。目标在上一帧和当前帧预测位置分别记为p1和p2,窗口尺寸(长、宽)为W=(WX,WY),上一帧和当前帧预测尺寸大小分别记为W1和W2。

为了有效适应目标的变化,并防止目标丢失,算法定义了2个模板:可更新模HC和固定模板HM。

在运动一致性的约束下,基于直方图匹配的目标跟踪算法实现如下:

1)人工辅助选定跟踪目标,并提取目标的投影直方图作为目标特征。投影直方图特征记为HXM= {HX1,HX2,…,HXN},HYM={HY1,HY2,…,HYN},p1为当前目标所在位置。

2)初始化可更新模板HC=HM,vp= 0,vD = 0 。

3)获取新一帧图像,根据vp 、vD大小预测目标在当前帧可能位置及搜索窗口的大小、方向,其中p2=p1+vp,W2=(W1+vD)θ。

4)在预测位置p2及其邻域内,并根据预测搜索窗口W2,在一定范围内连续改变窗口的尺寸及方向生成一个窗口检测序列,计算相应检测区域的投影直方图H。利用式(3)计算H与HC相关性,将满足相关系数大于设定阈值的位置及其投影直方图H记录到目标候选区域集合OC中。

5)若4)未检测到相关性满足条件的区域,则扩大搜索范围,执行4)继续检测目标。若第2次调整搜索范围后仍未检测目标,系统提示目标丢失,请求再次人工辅助选择目标。若检测到相关性满足条件的区域,则继续执行6)。

6)计算OC中各投影直方图与HM的相关性,提取相关系数最大的位置p、其投影直方图HM和检测窗口WM。更新vp=p-p1,vD=WM-W1, θ=θ(WM)-θ(W1),p1 =p,HC=HM。若相关系数均不能满足设定的参考阈值,说明目标丢失,系统请求再次人工辅助选择目标。

7)一次目标跟踪完成,从3)开始在新的一帧中检测并跟踪目标。

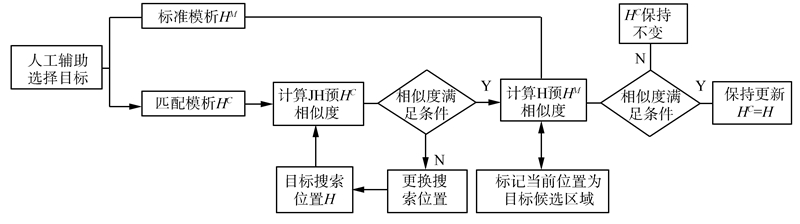

其中,模板更新是算法的重要组成部分,决定了算法跟踪性能。算法流程图如图 6所示。

|

| 图 6 模板更新流程图Fig. 6 Flow chart for template updating |

人工标注是为了操作人员灵活选择目标,然后利用直方图匹配算术根据直方图特征检测和跟踪目标,最终实现利用机械手任意抓取、移动和安放目标的目的。1.2部分所述实验结果如图 7所示。

|

| 图 7 基于投影直方图匹配的目标跟踪算法Fig. 7 Experiments of object tracking based on projection histogram matching |

双目视觉跟踪除了要在双目视频序列中同步、实时和准确跟踪目标外,还应完成双目图像中的目标配准工作。传统的方式是在同时获取的双目图像中独立检测和跟踪目标,而后再根据目标的自身特征及双目视觉的结构关系完成目标的配准工作。然而,目标在双目图像中的稳定几何关系,可用来引导双目视觉中目标的搜索范围,将目标的跟踪与配准2个工作合二为一。假设,当在一个右视觉中准确跟踪到目标,利用双目视觉的极线几何原理,将目标在左视觉中的位置限定在一条直线上。再结合目标运动的一致性约束,目标在左视觉中的位置限定在一个很小的范围内。在左视觉中检测出的图像即是已经与右视觉配准后的目标,提高了双目视觉系统中目标跟踪和配准的运算速度。另外,当目标在其中的任意一个视觉中跟踪失败时,根据另一个视觉中的目标位置,利用极线几何原理可计算出目标必会存在的直线位置,即可重新搜索到目标。如此以来,既提高了双目视觉系统中目标跟踪的运算速度,又提高了跟踪的准确性和可靠性。

双目视觉系统中,在极线几何与运动一致性准则引导下,利用直方图匹配的目标跟踪算法实现步骤如下:

1)在双目图像中人工辅助标定跟踪目标,并分别提取双目图像中的目标投影直方图。

2)初始化右视觉为主视觉,则左视觉为在副视觉。主视觉踪利用1.2.2 所述算法检测并跟踪目标。若主视觉中目标丢失,则将主副视觉相切换,重新执行此步骤。

3)根据2)跟踪到的目标位置,利用极线几何原理,计算目标在副视觉中对应的极线,同时根据运动一致性约束,将目标限制到极线很小的范围内。利用1.2.2所述算法精确检测并跟踪目标。

双目视觉跟踪算法实现流程图如图 8所示。

|

| 图 8 双目视觉跟踪算法实现流程Fig. 8 The flow chart of object tracking in binocular vision |

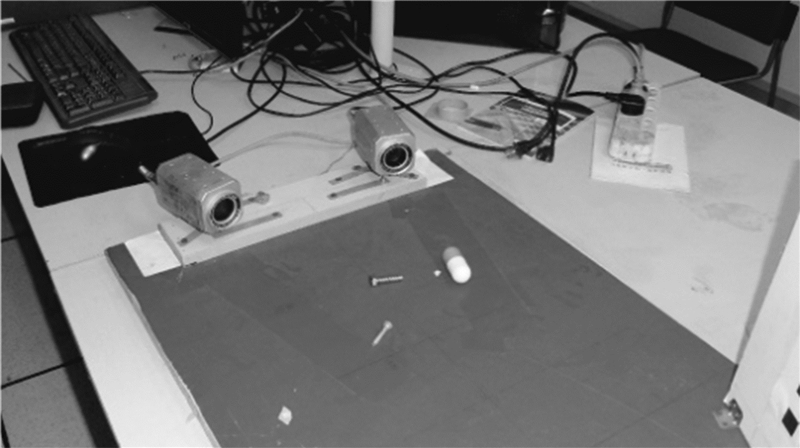

在实验室环境手工搭建的双目视觉平台上进行了相关测试,实验平台如图 9所示。硬件配置为:2台相同型号普通摄像机,普通4通道图像采集卡,计算机一台( Core i7-4770 3.40 GHz 8 GB内存)。

|

| 图 9 双目视觉实验平台Fig. 9 Testing platform of binocular vision |

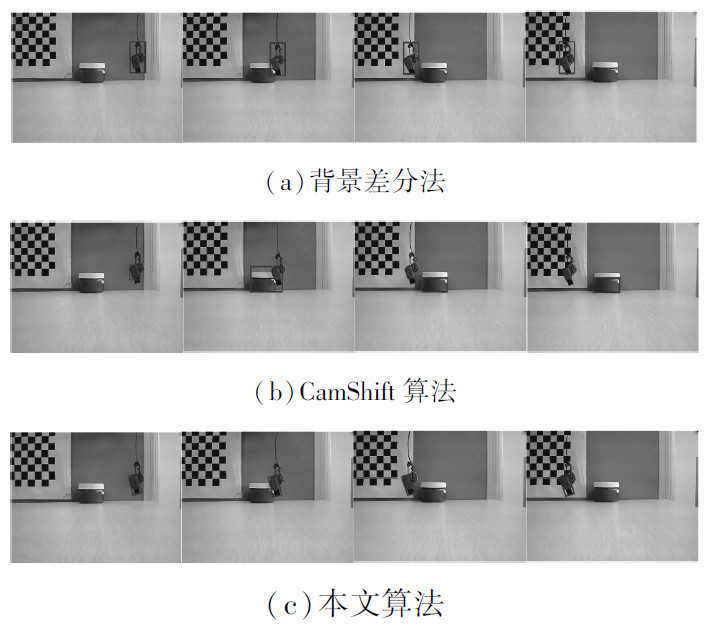

在测试双目视觉的目标跟踪性能之前,需要先确定在单目视觉中基于直方图匹配的目标跟踪算法性能。为定性比较目标跟踪算法的性能,本文选择了 CamSift算法和背景差分法进行实验比较。手持目标移动进行跟踪测试,实验结果如图 10所示。

|

| 图 10 目标跟踪实验对比Fig. 10 Comparative experiments for object tracking |

背景差分法分割了所有的与背景相差较大的区域,无法精准定位目标。然而在实际应用中夹取目标的机械臂也会移动,并且背景差分法需建立在良好的背景模型基础上,应用具有较大局限性。CamShift算法利用了图像的色彩信息,然而当背景中存在大面积与目标色彩信息相同的物体时,将不能准确跟踪目标。另外,背景差分法和Camshift算法不能估计物体的倾斜方向,无法计算目标的位姿。本文所提算法采用了多颜色空间投影直方图,利用直方图所体现的统计信息与结构信息成功跟踪移动目标,并且可以匹配目标的倾斜方向,利于在双目视觉系统中计算目标位姿。

3.2 算法跟踪精度分析为了测试本文所提目标跟踪算法的跟踪精度,利用实验室自行搭建的双目视觉平台及三维坐标重建算法进行测试。选择背景稳定的室内环境,在0.4~1.5 m的范围中,并且场景中没有与目标色彩相同或相近的干扰区域。利用CamShift算法与本文所提算法分别在双目图像中跟踪目标,并直接利用跟踪目标的原始图像坐标值计算三维坐标,并将重建后的三维坐标值与真实值的距离作为误差衡量标准,其平均误差及每帧平均跟踪运算时间如表 1。

| 算法 | 平均误差/mm | 平均时间消耗/ms |

| CamShift | 11.7 | 12.8 |

| 本文 | 4.3 | 38.2 |

表 1实验结果表明,本文所提算法的跟踪精度明显高于CamShift算法。CamShift的误差高是因为目标未进行配准,为了体现本文算法的优势,将CamShift算法的跟踪目标配准后再次计算其平均误差及消耗时间,如表 2所示。

| 算法 | 平均误差/mm | 平均时间消耗/ms |

| CamShift | 3.8 | 76.8 |

| 本文 | 4.3 | 38.2 |

表 2实验结果表明,配准CamShift算法跟踪结果后,跟踪的平均误差大幅度降低。然而,与本文算法相比,跟踪精度与本文相当,但时间消耗大幅度增加。

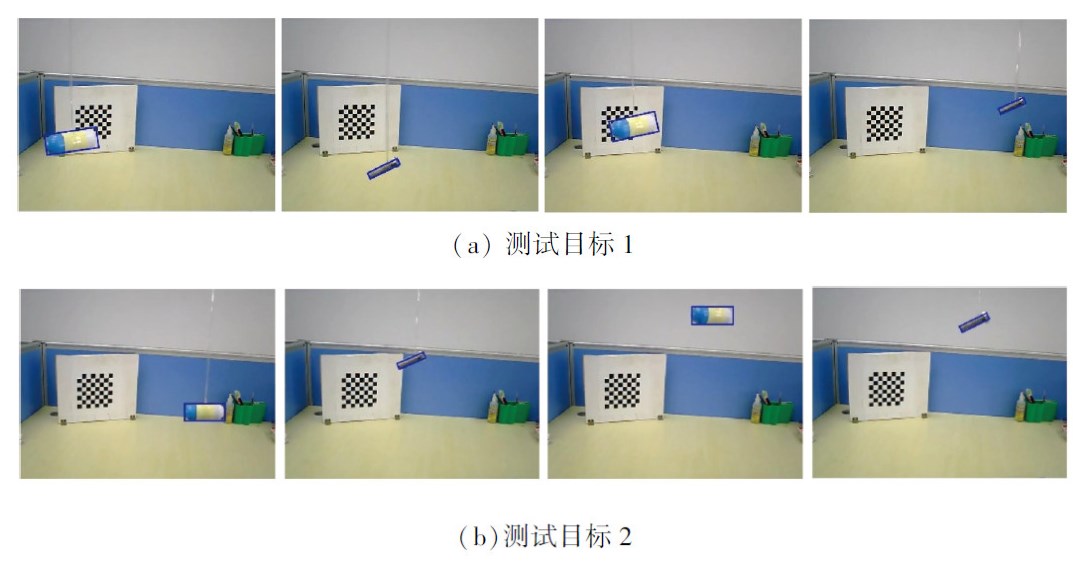

3.3 实验结果选择有颜色信息和无颜色信息2种目标测试本文跟踪算法。有色彩信息的目标相对容易跟踪,无色彩信息的目标主要利用其灰度的统计信息及结果信息进行跟踪,如图 11所示。

|

| 图 11 本文所提算法双目跟踪结果Fig. 11 Experiments of our proposed method 注:每组实验第1行为左视觉,第2行为右视觉,每组上下对齐位置为同一时刻左右视觉跟踪结果 |

本文依据双目视觉极线几何与运动一致性,提出了一种利用投影直方图匹配方法检测并跟踪目标的方法。首先,人工辅助选择跟踪目标;其次,在主视觉中结合目标运动一致性约束,利用投影直方图匹配算法检测并跟踪目标;最后,根据目标在主视觉中的目标位置,利用极线几何原理和运动一致性原则得到一个很小的目标搜索范围,并利用投影直方图匹配算法检测并跟踪目标,完成双目视觉系统的目标跟踪任务。本文算法的优势在于,当目标在一个视觉中跟踪失败时,可利用目标在另一个视觉中的位置,在其对应的极线上重新搜索目标,提高了双目视觉系统目标跟踪的可靠性。

本文所提算法同样具有局限性,当目标的整个成像平面是纯色或相近灰度,并且与背景相近,进而不存在结构信息时,提取的目标区域的投影直方图将不再具有表征目标结构特征的功能,算法的跟踪精度将会明显降低,甚至跟踪失败。此时,文中所使用的对比算法也将失效,背景差分法将检测不出背景与目标的差别,CamShift算法也检测不到目标的色彩局域。因此,可以在一些电力设备上添加一些具有明显结构特征的图案或色彩,如黑白间隔或各种色彩相互隔的条纹,实现目标的准确跟踪定位。

| [1] | HOSEINNEZHAD R, VO B N, VO B T. Visual tracking in background subtracted image sequences via multi-Bernoulli filtering[J]. IEEE Transactions on Signal Processing,2013, 61(2):392-397. |

| [2] | 王乐东, 王江安, 康圣, 等. 相邻帧间匹配的迎头点目标跟踪算法[J]. 光学学报, 2009, 29(11):3004-3009. WANG Ledong, WANG Jiang'an, KANG Sheng, et al. An algorithm of adjacent frame matching used for head-on point targets tracking[J]. Acta Optica Sinica, 2009, 29(11):3004-3009. |

| [3] | ALLEN J G, XU R Y D, JIN J S. Object tracking using camshift algorithm and multiple quantized feature spaces[C]//Proceedings of the Pan-Sydney Area Workshop on Visual Information Processing. Darlinghurst, Australia, 2004:3-7. |

| [4] | ZHANG Shengping, YAO Hongxun, SUN Xin, et al. Sparse coding based visual tracking:review and experimental comparison[J]. Pattern Recognition, 2013, 46(7):1772-1788. |

| [5] | TSECHPENAKIS G, RAPANTZIKOS K, TSAPATSOULIS N, et al. A snake model for object tracking in natural sequences[J]. Signal Processing:Image Communication, 2004, 19(3):219-238. |

| [6] | KOSCHAN A, KANG S, PAIK J, et al. Color active shape models for tracking non-rigid objects[J]. Pattern Recognition Letters, 2003, 24(11):1751-1765. |

| [7] | 邱雪娜, 刘士荣. 基于序贯检测机制的双目视觉运动目标跟踪与定位方法[J]. 机器人, 2011, 33(2):181-190. QIU Xuena, LIU Shirong. Moving objects tracking and localization with binocular vision based on sequential detection mechanism[J]. Robot, 2011, 33(2):181-190. |

| [8] | 王丽佳, 贾松敏, 李秀智, 等. 多特征提取的双目机器人目标跟踪[J]. 控制与决策, 2013, 28(10):1568-1572. WANG Lijia, JIA Songmin, LI Xiuzhi, et al. Person following of binocular robot by extracting multiple features[J]. Control and Decision, 2013, 28(10):1568-1572. |

| [9] | ZOIDI O, NIKOLAIDIS N, TEFAS A, et al. Stereo object tracking with fusion of texture, color and disparity information[J]. Signal Processing:Image Communication, 2014, 29(5):573-589. |

| [10] | 解洪文, 王宏伦. 基于双目视觉的自动空中加油近距导航方法[J]. 北京航空航天大学学报, 2011, 37(2):206-209. XIE Hongwen, WANG Honglun. Binocular vision-based short-range navigation method for autonomous aerial refueling[J]. Journal of Beijing University of Aeronautics and Astronautics, 2011, 37(2):206-209. |

| [11] | 祝琨, 杨唐文, 阮秋琦, 等. 基于双目视觉的运动物体实时跟踪与测距[J]. 机器人, 2009, 31(4):327-334. ZHU Kun, YANG Tangwen, RUAN Qiuqi, et al. Real-time tracking and measuring of moving objects based on binocular vision[J]. Robot, 2009, 31(4):327-334. |

| [12] | MUFFERT M, PFEIFFER D, FRANKE U. A stereo-vision based object tracking approach at roundabouts[J]. IEEE Intelligent Transportation Systems Magazine, 2013, 5(2):22-32. |

| [13] | CAI Ling, HE Lei, XU Yiren, et al. Multi-object detection and tracking by stereo vision[J]. Pattern Recognition, 2010, 43(12):4028-4041. |

| [14] | LI Jinping, QIN Min, XIA Yingjie, et al. Remarks on a novel statistical histogram-average scene cumulative histogram[C]//2012 IEEE International Conference on Granular Computing. Hangzhou, China, 2012:253-257. |

| [15] | 张广军. 视觉测量[M]. 北京:科学出版社, 2008:134-174. ZHANG Guangjun. Vision measurement[M]. Beijing:Science Press, 2008:134-174. |

| [16] | 吴成茂. 直方图均衡化的数学模型研究[J]. 电子学报, 2013, 41(3):598-602. WU Chenmao. Studies on mathematical model of histogram equalization[J]. Acta Electronica Sinica, 2013, 41(3):598-602. |

| [17] | 余旺盛, 侯志强, 田孝华. 基于旋转不变直方图的快速匹配穷搜索[J]. 电子学报, 2012, 40(11):2177-2182. YU Wangsheng, HOU Zhiqiang, TIAN Xiaohua. Swift matching exhaustive search based on rotation invariant histogram[J]. Acta Electronica Sinica, 2012, 40(11):2177-2182. |

| [18] | BRADSKI G, KAEHLER A. Learning OpenCV:Computer vision with the OpenCV library[M].[S.l.]:O'Reilly Media, Inc., 2008:405-458, 193-219. |