人脸识别是利用计算机技术通过人脸的图像信息辨别不同身份的技术,迄今已有近50年的历史。人脸识别的一般步骤是采集图像数据、图像预处理、人脸定位、人脸图像规格化、人脸特征提取、特征匹配。在单人脸识别或者人脸注册等过程中,为了保证人脸特征库和用于识别的人脸图像特征的统一性,必须保证规格化后的人脸图像在眼睛、鼻子、嘴巴等部位的相对位置与标准人脸精确配准。人脸配准问题首先是由山世光等提出[1],是指在人脸识别过程中,测试图片与训练图片的关键部位的位置是否匹配。文献[1]指出:大多数被错误识别的样本完全可以通过精确调整眼睛的位置得到正确的识别结果,也就是说,识别性能的下降很大程度上是由于自动定位的眼睛位置不够准确造成的。在实际应用中,由人脸误配准问题引起的识别率的下降时有发生。因此,在人脸识别系统中,保证规格化后用于识别的人脸图像的正确配准变得越来越重要。

1 相关工作误配准对于人脸识别系统的不同阶段有着不同的影响,对于人脸特征库建模阶段,误配准将导致人脸特征库的信息不准确,直接造成系统拒绝识别或者识别为他人,对于识别阶段,误配准将导致识别率严重下降。文献[2]讨论了DAGR对误配准程度的鲁棒性虽比Fisher face方法强,但还是一定程度的造成了“误配准灾难”。

解决“误配准灾难”问题有2条技术途径:1)提高人脸图像配准的精确度及采用鲁棒性强的特征,文献[3, 4, 5]从精确人脸定位的方法入手,很大程度地改善了人脸配准,文献[6]通过构建多层次人脸配准算法,矫正了人脸图像,文献[7]比较分析了3种不同的技术ASM(active shape model)、CLM(constrained local model)、 AAM(active appearance model)用于自动高密集度标记的人脸配准方法,得到了较好的配准效果,尽管如此,人脸定位仍然存在一定概率的错误,目前还不存在理想的人脸定位算法;2)在人脸识别系统的“特征提取”步骤之前,对规格化人脸图像进行配准判断,去除错误配准的图像,防止误配准图像进入后续流程而造成识别性能的下降。

本文从消除误配准的思路出发,提出一种人脸配准的判断方法,根据SIFT的关键点定位理论[9, 14, 15, 16],使用一种基于关键点邻域分块梯度方向直方图统计的图像特征提取方法提取待检测图像和标准人脸的特征,依据待检测图像与标准人脸图像的特征匹配相似度来判断人脸图像是否正确配准。

2 算法流程 2.1 算法框架针对人脸识别中规格化完成后的人脸图像,本算法通过比较待测图像与标准人脸的特征相似度来实现配准判断,以筛选用于识别的定位正确的人脸图像。算法步骤为:1)通过现有的人脸定位程序,对人脸库中图像进行定位,经过图像分割规格化后选出500张正确配准的人脸图片,求平均人脸图像作为标准人脸(此处选取定位正确的图片是在统一光照条件下,去除了表情等因素影响的图片,作为算法的先验知识);2)用SIFT关键点定位算法在标准人脸上确定关键点 K ( K 的信息包含位置 KL,个数 P ),并用本文基于关键点邻域梯度方向直方图统计的方法提取标准人脸图像特征,将该特征作为标准矢量模板(记为 ST );3)将标准人脸的关键点应用为待测试人脸图像的定位点,同样由本文基于关键点邻域梯度方向直方图统计的方法提取待测试人脸定位点的图像特征(记为 MT );4)求标准人脸特征 ST 与待测试人脸特征 MT的余弦相似度,标记大于设定阈值的图像为正确配准的图像,否则,标记为错误配准的图像。算法流程如图 1所示。

|

| 图 1 本文算法流程Fig. 1 Algorithm flow chart |

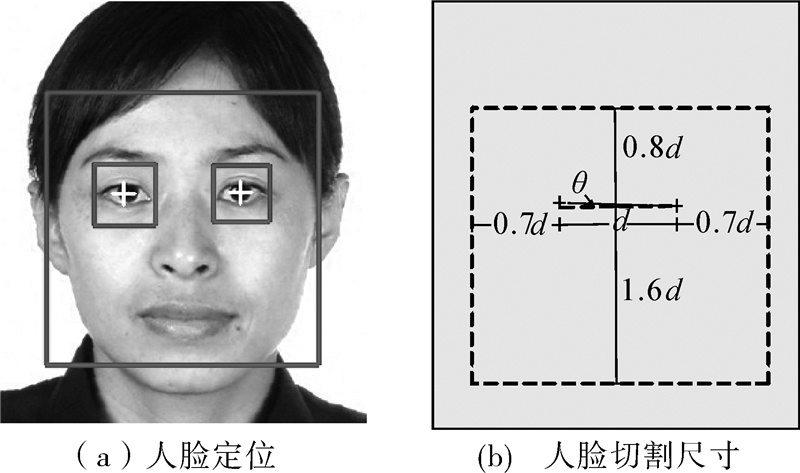

本算法中用到的标准人脸是定位正确人脸图像的参考图像,这决定了本算法的操作对象是预处理完成后与标准人脸具有相同规格的规格化人脸图像。下面介绍一种人脸识别中关于人脸定位、切割及规格化的实现方法,也是本文实验部分所使用的人脸预处理方法。

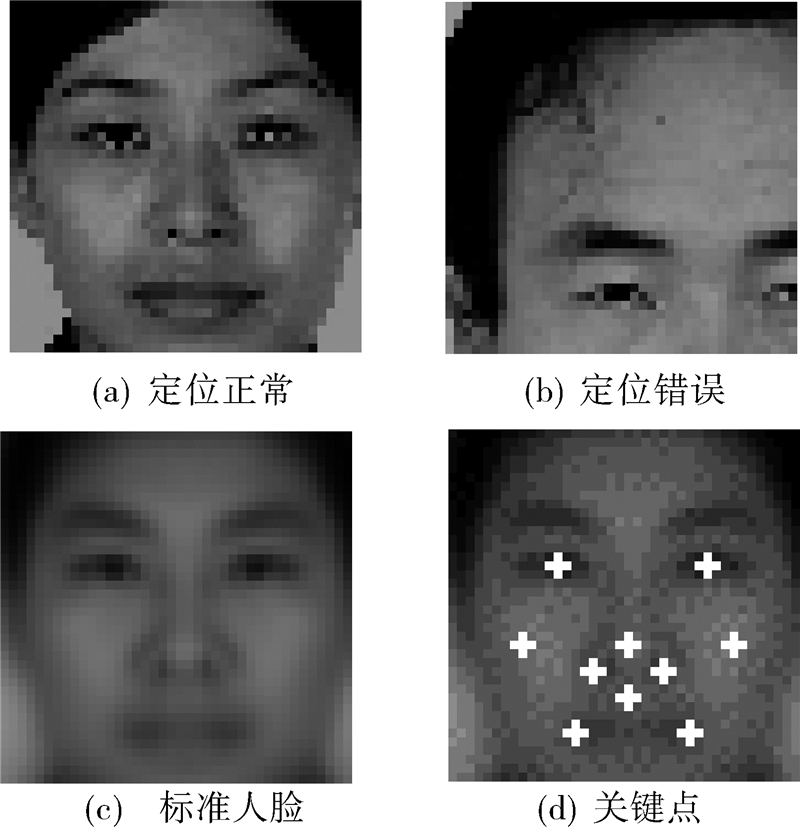

对于初步预处理完成的人脸图像,采用文献[17]中给出的基于图像几何复杂度的方法进行人脸定位,获得人脸的双眼坐标位置和脸部区域如图 2(a)所示。根据两眼连线与图像水平线的角度 θ 确定人脸是否为正面人脸,并旋转有偏斜的人脸图像使之成为正面人脸。根据文献[5]中的人脸切分尺寸结合实验修正,对旋转完成后的人脸图像按图 2(b)所示的尺寸对图像做切割,其中 d 为眼矩(即双眼之间的距离),图像左右边缘到眼睛的距离均为 0.7d,上边缘到两眼中间距离为 0.8d,下边缘到两眼中间距离为 1.6d,切割完成的图像如图 2(c)。对切割完成的人脸图像规格化为 40×40,如图 2(d)所示。

|

|

| 图 2 人脸切割Fig. 2 Face segmentation |

应用上述方法,选择500张定位正确的规格化后的图像求得平均人脸,将该平均人脸设定为标准人脸。需要注意的是,当使用不同的定位、切割及规格化方法时,标准人脸需要使用新的规格化图像重新产生。

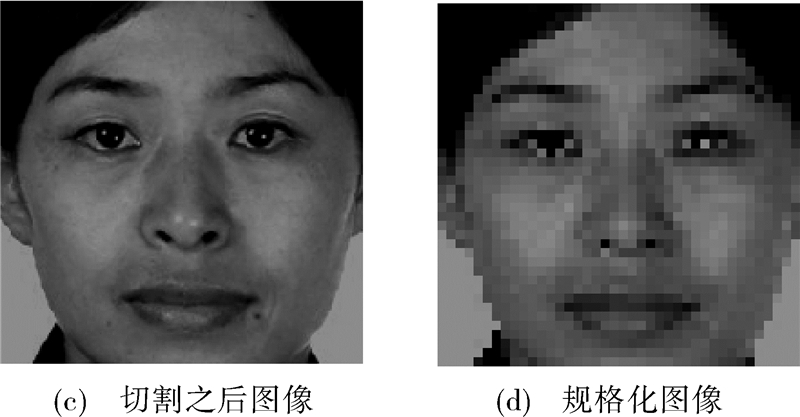

2.2.2 选取关键点本文人脸定位配准检测的关键点采用标准人脸图像的SIFT关键点。图像的SIFT关键点由如下步骤得到,对图像 I,1)由式(1)构建图像的尺度空间 L,即

|

| 图 3 DOG空间极值点检测Fig. 3 Extreme points detection of DOG space |

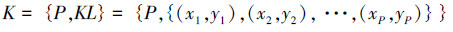

用2.2.1节得到的标准人脸经过以上SIFT关键点提取得到关键点 K,表示为

为关键点的位置,P 为关键点个数。

为关键点的位置,P 为关键点个数。

关键点的选取基于这样一个事实:对于定位正确的人脸,按统一的人脸切割方法得到的人脸图像在眼睛、鼻子、嘴巴等关键部位必定有着相同的相对位置,相应地,如果人脸定位超过一定偏差,剪切后的人脸图像在上述关键部位与标准人脸必定无法配准。需要注意的是,在不同的算法应用中,标准人脸的SIFT关键点位置和数目可能不同 。但是,选取标准人脸的SIFT关键点作为产生标准矢量模板的关键点,并对所有被检测人脸图像统一使用该关键点,在配准判断中具有统一性和可比性。同时,这种关键点的选择具有SIFT关键点定位的理论依据,也符合一定的观察经验。对于定位正确的人脸图像,这些关键点位置总是特征信息最丰富的点。

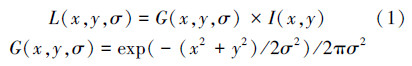

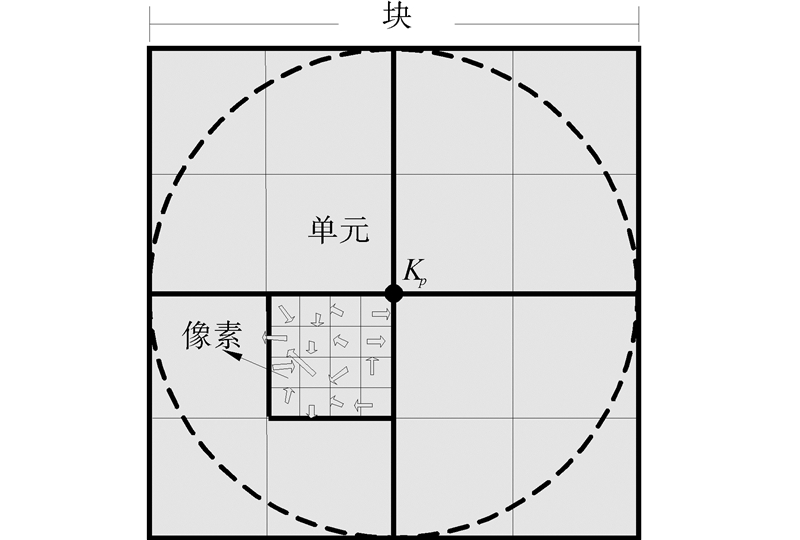

2.2.3 提取特征向量本文采用基于关键点邻域梯度方向直方图统计的特征提取方法提取人脸图像特征。对图像 I 和某一个关键点 Kp,以关键点为中心取 w × w 的窗口(记为 W )作为一个块(Block),再将该窗口 W 划分为 m × m 个单元(Cell),如图 4所示。

|

| 图 4 关键点块和单元划分Fig. 4 Block and cell division for the key points |

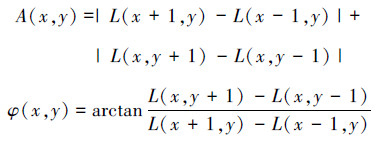

在图像 F 中,像素点 L(x,y) 的梯度幅值和方向的计算公式为

计算各单元中像素点的梯度幅值 A 和方向 O,将方向值量化到 n 个方向:

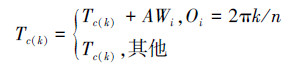

对单元 c,统计 n 个方向的加权梯度幅值 AW 形成方向梯度直方图 Tc 。在单元 c 中扫描每个像素点梯度方向,则 Tc 为

最后,将所有关键点的特征向量组合起来即得到标准矢量模板 ST :

考虑算法不同的应用,可以根据图像的复杂程度和处理目标的要求选取窗口大小 w 和方向个数 n,需要突出细节信息时,选取较小的窗口 w 和较大的方向个数 n,一般来说,块、单元及方向划分个数可以分别选择 w=16,m=4,n=8 。

2.3 人脸图像配准判断对待测试图像,配准判断是通过待检测图像特征矢量 MT 与标准矢量模板 ST 的匹配相似度来度量,该相似度也表示了待测试图像与标准人脸图像的相似性(文中图像间的相似度均由对应图像的特征矢量间的相似度来表示),判断时,该相似度达到设定阈值即判定为正确配准人脸图像,否则,即是误配准人脸图像。待检测图像特征矢量 MT 的求取统一采用2.2节中产生标准矢量模板时用到的关键点 K 和特征向量的求取方法,得到 P 个关键点的特征向量 Ttest,表示为

求出待检测图像特征矢量 MT 与标准矢量模板 ST 中各关键点对应特征向量的余弦相似度 Sp :

再根据各关键点对最终判决的贡献大小 γ 对各相似度加权,得到待检测图像特征矢量 MT 与标准矢量模板 ST 的匹配相似度 S :

在试验中,可以发现对 P 个关键点的相似度求平均作为总体相似性时,S 的值可以很好的实现分类,即对 γ 取值为 γp=1/P(式中,p=1,2,···,P) 。设判定阈值为 Sthreshold,对于 S≥Sthreshold 的待测试图像,判断其为正确配准人脸图像,否则判断为定位错误人脸图像,实验中,Sthreshold 取值范围为0.68~0.74。

2.4 算法分析和讨论人脸配准判断应该引起足够的重视,但是,该步骤的算法复杂度不应大于人脸特征提取和识别等更重要的步骤,这一点限定了配准判断算法所允许的复杂度。

SIFT特征提取在图像匹配方面表现出了优良的性质,例如:对旋转、尺度、亮度变化的稳定性、图像特征描述的准确性等。但是,关键点的寻找和方向的分配需要很大的计算开销,很难进行实时应用。本文要解决的人脸配准判断,是针对正常人脸图像通过定位剪切并规格化后的人脸图片,通常规格为40×40。这些图片的匹配有一些特点:对实时性有较高要求,需要高效的特征描述,图像相对固定,不需要考虑旋转、尺度和亮度等因子的变化。因此,本文算法基于SIFT关键点定位理论,对所有图像都采用标准人脸的关键点,使用标准人脸特征作为比较模板,方便图像的配准判断。图像匹配过程中关键点位置的先验性,大大降低了算法复杂度。在不存在旋转和尺度变化而又有较高实时性要求的图像匹配应用中,这种改进表现出了良好应用效果。

图像特征提取方法运用了SIFT在关键点选择上的合理性,汲取方向梯度直方图(histogram of oriented gradient,HOG)描述子的优点[18],将关键点的位置信息转换成先验知识,采用关键点邻域梯度方向直方图统计的图像特征进行配准检测,很好地实现了配准判断,这是本文算法应用上的创新和特色。同时,舍弃SIFT尺度空间的建立和关键点方向的分配,极大降低了算法的复杂度,该复杂度可以表示为 O(nwP),其中,n 为方向个数,w 为窗口大小,P 为关键点个数,本文算法中 n=8,w=16,P=10 。

实验证明,该算法花费了很小的计算开销(约为一张人脸图像识别过程总时间的1%,此处,一张人脸图像的识别时间为图像预处理,图像特征提取及特征匹配和识别的总时间,实验采用的相关算法是Local Gobar和主成分分析法(principal components analysis,PCA)结合的方法),保证了用于人脸注册和识别的人脸图像的配准正确性。

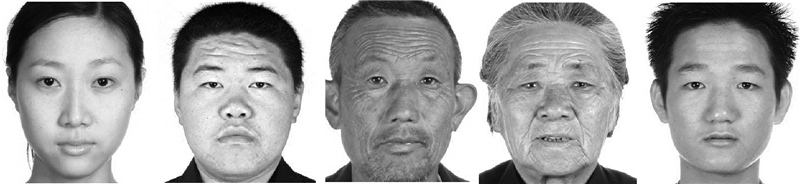

3 实验分析 3.1 人脸配准判断实验采用的人脸数据库来自于我国深圳地区采集的不同人的正面人脸照片总共1 863张,人群为普通亚洲人,年龄段为16~80周岁。该数据库图片采用单色位图格式,图片尺寸为292×336,人脸面部细节清晰,姿态、表情单一,固定光照条件,示例如图 5。

|

| 图 5 实验用人脸数据库样本Fig. 5 The face database for experiments |

在实际人脸识别系统中,人脸经过定位以后,需要进行人脸剪切使得用于识别的图片只包含人脸信息,如图 6(a)所示。但是由于定位算法的缺陷,人脸可能被错误定位,使剪切后的图片与正确定位的人脸图像存在偏离,出现错误配准现象,如图 6(b)所示,因此,需要对定位剪切后的人脸图像进行配准判断和筛选。本实验的目的是判断人脸图像是否配准。实验采用文献[17]中给出的基于图像几何复杂度的方法定位人脸和眼睛,经过统一的图像分割和规格化处理,定位正确的图像可以生成正确配准图像,否则,生成的图像为错误配准图像。选取500张正确配准图像用于生成标准人脸,如图 6(c)所示,由2.2.2节方法得到的关键点位置和个数如图 6(d)所示。

|

| 图 6 规格化后的图像Fig. 6 Normalized face image |

用数据库中剩下的图像重复试验得到1175张正确配准人脸图像和约170张错误配准人脸图像,并对图像做标准人脸同样的规格化和剪切处理。为了更全面地考虑错误配准的情况,试验中使用的错误配准的人脸图像除了程序自动定位时产生的错误配准图像,还加入了正确定位的图像通过人为制造各个方向偏移、旋转后的图片,甚至包含少量不含人脸的图片,并对实验图片做相同的亮度和尺寸规格化。最终错误配准人脸图像数量为350张。用第2节的方法提取标准矢量模板和各待测试图像特征向量,计算1 175张正确配准的人脸图像特征向量与标准矢量模板的相似度,以及350张错误配准的人脸图像特征向量与标准矢量模板的相似度,用该相似度表示待测试图像和标准人脸图像的相似度。此处,定位正确(即正确配准)的人脸图像是指定位脸和眼睛位置偏差不大于图片尺寸的5%,脸部区域偏转角度小于5°的图片,否则,就是定位错误的图像。分析实验数据,得到的结果如图 7所示,图中纵坐标表示相似度,对于正确配准图像与标准人脸图像相似度曲线,横坐标表示大于曲线表示的相似度的图像占所有正确配准图像的百分比,对于错误配准图像与标准人脸图像相似度曲线,横坐标表示小于曲线表示的相似度的图像占所有错误配准图像的百分比。

|

| 图 7 关键点平均相似性曲线Fig. 7 The mean similarity curve of key-points |

从图中可以看出,采用关键点相似度平均值作为总体相似性,应用于人脸数据库的建模阶段时,在全部排除错误配准人脸图片的情况下(对应阈值为0.74),对正确配准的人脸图片的筛选率为 95.5%,即几乎可以保留全部的正确配准图片。若应用于人脸识别阶段,在保证正确配准图像全部通过的情况下(对应阈值为0.68),对错误配准图像的排除率为95.7%,即可以排除绝大部分错误配准图像。对图 7中处于曲线末端的数据(即与标准人脸相似度较低的正确配准的人脸图像和与标准人脸相似度较高的错误配准的人脸图像)进行边缘情况分析,发现在正确配准的图像中存在如图 8(a)所示的图片,在错误配准的人脸图像中存在如图 8(b)所示的图像。

|

| 图 8 边缘情况分析Fig. 8 Marginal data analysis |

图 8(a)中的图像虽然根据眼睛和脸判别为正确配准图像,但定位还是存在少量偏差,导致其相似度相对较低,只是这种偏差在允许的范围之内;相应地,图 8(b)为定位偏差超出设定阈值的图像,但是,由于偏差接近阈值,这些图像与标准人脸的相似度相对较高。同时,一些图像中的噪声也可能导致其与标准人脸相似度的下降(例如:图 8(a)和图 8(b)中第3幅图像),所以,该方法还可以排除被噪声污染的图像。

图 8(a)中的图像虽然根据眼睛和脸判别为正确配准图像,但定位还是存在少量偏差,导致其相似度相对较低,只是这种偏差在允许的范围之内;相应地,图 8(b)为定位偏差超出设定阈值的图像,但是,由于偏差接近阈值,这些图像与标准人脸的相似度相对较高。同时,一些图像中的噪声也可能导致其与标准人脸相似度的下降(例如:图 8(a)和图 8(b)中第3幅图像),所以,该方法还可以排除被噪声污染的图像。

实验中,正确配准的人脸图像与标准人脸的高相似性及错误配准的人脸图像与标准人脸的低相似性表明了该人脸配准判断方法的有效性。

同时,实验在特征提取的速度方面也进行了测试,对相同大小的人脸图片,分别用SIFT特征提取方法和本文算法提取图像特征,在选用同样的关键点时,SIFT算法和本文算法的耗时情况如表 1。

| 算法 | 关键点个数 | 特征向量维度 | 耗时/s |

| SIFT | 10 | 128 | 0.125 |

| 本文算法 | 10 | 128 | 0.005 |

从以上结果看出,本文提取算法相对于SIFT来说,极大地降低了耗时,由此验证了本文特征提取算法的高效性。

3.2 判别辨识度分析实验得到正确配准的人脸图像与标准人脸图像的相似度(记为 SR ),可接受的最大定位偏移或最大偏转角度下的人脸图像与标准人脸图像的相似度(记为 SM ),则定义人脸配准判断的辨识度(记为 SD )为

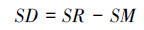

辨识度越大表明越容易判别出错误配准的图像。人脸定位偏移距离和偏转角度定义为理论上正确人脸定位的位置和方向与实际人脸定位位置和方向间的距离和角度,可以接受的最大定位偏移和偏转角度的图像是指在不影响后续识别的情况下允许的最大定位偏差(偏移距离和偏转角度),通常情况下,该偏移距离不大于图像尺寸的5%[1],而偏转角度不大于 5° 。为了研究该人脸配准判别方法的辨识度,该实验分别将人脸定位偏移距离和图像旋转角度作为自变量,人为地偏移正确配准的人脸图像,如图 9所示,其中,图 9(a)为正确配准的人脸图像,图 9(b)~ (e)各组图像中,第一张图像均为最大允许偏移量,即偏移为2个像素,后续图像偏移量分别为5个像素、10个像素;图 9(f)~(g)各组图像中,第一张均为最大允许偏转角度,即偏转 5°,其余图像偏转量分别为 30°、55°。

|

| 图 9 各偏移量对应的图像Fig. 9 Corresponding images under the offsets |

分析各偏移量下图像与标准人脸图像的相似度变化,得到曲线如图 10所示。

|

|

| 图 10 各偏移量下的相似度Fig. 10 The similarities under the related offsets |

对各定位偏移的最大允许偏移量进行讨论,得到各定位偏移下的人脸配准判断辨识度如表 2。

| 定位偏移 | SM | SD |

| 注:SR 为正确配准图像与标准人脸图像相似度, SM 为可接受的最大偏移量图像与标准人脸图像相似度,SD 为辨识度 | ||

| 偏左 | 0.7845 | 0.1030 |

| 偏右 | 0.7873 | 0.1002 |

| 偏上 | 0.7725 | 0.1150 |

| 偏下 | 0.7725 | 0.1150 |

| 顺时针偏转 | 0.7800 | 0.1075 |

| 逆时针偏转 | 0.7773 | 0.1102 |

通过以上各偏移距离和偏转角度下的相似度走势及表 2数据,可以看出,该方法的辨识度对每种偏移量均在0.1以上,可以很好地实现配准判断。从各相似度与偏移量的变化趋势也可以看出本文方法判断人脸配准的有效性。

3.3 实验结果分析对人脸定位切分归一化后的人脸图像进行分析,没有加入本文方法的判断筛选之前,这些图像中包含一些错误配准的图像如图 11所示。用本文的算法进行筛选,在选定合适阈值时,这些错误配准的图像均被剔除。通过实验验证,可以采用Local Gobar和主成分分析法相结合的算法,在3.1节用到的人脸数据库上测试,加入该人脸筛选判断后,识别率由96.5%提高到98.5%。

|

| 图 11 排除的错误配准人脸图像Fig. 11 Mis-alignment face image that been excluded |

以上试验验证了本文提出的判断人脸配准方法的有效性,同时,运用基于梯度方向直方图统计的图像特征提取及匹配方法也是一种新的尝试。在图像匹配中,这种特征提取方法得到的图像特征能准确地表达图像信息,以向量相似性作为度量工具,可以在保持高匹配准确性的同时极大地提高算法的效率。

4 结论本文主要做了两方面的工作:1)通过待检测图像与正确配准的标准人脸的比较,解决了人脸配准的判断问题,这有利于提高人脸识别的识别率,增强算法的鲁棒性;2)运用基于关键点邻域梯度方向直方图统计的图像特征提取方法,分别提取待测试图像和标准人脸特征,在该特征空间进行相似度计算,提出了一种新的图像匹配思路。

考虑算法的应用条件,本文方法有以下有待改进的方面:1)本文的方法需要一定数量正确配准人脸图像做训练样本(得到标准人脸)才能进行后续的人脸配准判断;2)图像匹配选取的关键点为标准图像的SIFT关键点,这决定了本算法只适用于人脸识别步骤中经过人脸定位、剪切、规格化后的图像,筛选正面人脸图像,而对于多姿态多表情的人脸图像配准判断,算法还需要做一定改进。此外,对于人脸识别中人脸的“误配准灾难问题”,除了对规格化后的人脸图像进行判断筛选操作外,研究能够克服配准偏差的识别算法是另一个途径。

| [1] | 山世光,高文,唱轶钲,等. 人脸识别中的“误配准灾难”问题研究[J]. 计算机学报,2005,28(5):782-791.SHAN Shiguang, GAO Wen, CHANG Yizheng, et al. "Curse of mis-alignment" problem in face recognition[J]. Chinese Journal of Computers, 2005, 28 (5): 782-791. |

| [2] | 唱轶钲,山世光,高文,等. Gabor 特征判别分析人脸识别方法的误配准鲁棒性分析[J]. 计算机工程与运用,2005(5):56-59.CHANG Yizheng, SHAN Shiguang, GAO Wen, et al. Evaluation of gabor features for face recognition from the angle of robustness to mis-alignment[J]. Computer Engineering and Applications, 2005 (5):56-59. |

| [3] | JUNG C, SUN Tian, JIAO Licheng, et al. Eye detection under varying illumination using the retinex theory[J]. Elsevier Science, 2013, 113: 130-137. |

| [4] | GU Jiayu, LIU Chengjun. Feature local binary patterns with application to eye detection[J]. Neurocomputing, 2013, 113: 138-152. |

| [5] | WANG Shangfei, LIU Zhilei, SHEN Peijia, et al. Eye localization from thermal infrared images[J]. Pattern Recognition, 2013, 46:2613-2621. |

| [6] | 翟倩茹. 不同姿态人脸配准方法研究[D]. 大连:大连海事大学,2012:1-12.ZHAI Qianru. Research on various poses face image registration[D]. Dalian:Dalian Maritime University, 2012:1-12. |

| [7] | SETHURAM A, SARAGIH J, RICANEK K, et al. Extremely dense face registration: comparing automatic landmarking algorithms for general and ethno-gender models[C]//IEEE Fifth International Conference. Arlington VA, 2012:135-142. |

| [8] | LIN H, LIANG L, DU P, et al. Image registration based on Fourier-Mellin transform[J]. Geomatics and Information Science of Wuhan University, 2012, 37(6): 649-652. |

| [9] | 刘小军,杨杰,孙坚伟,等. 基于SIFT的图像配准方法[J]. 红外与激光工程,2008,37(1):156-160.LIU Xiaojun, YANG Jie, SUN Jianwei, et al. Image registration approach based on SIFT[J]. Infrared and Laser Engineering, 2008, 37(1): 156-160. |

| [10] | FUMIHIKO S. Image matching based on relation between pixels located on the maximum and minimum gray-levels in local area[J]. IEEE Transactions on Electrical and Electronic Engineering, 2007, 12(2): 169-178. |

| [11] | TRAJKOCIC M, HEDLEY M. Fast corner detection[J]. Image and Vision Computing, 1998, 16(2): 75-87. |

| [12] | 苏延超,艾海舟,劳世竑,等. 基于非线性Boosting回归的多视角人脸配准[J]. 自动化学报, 2010, 36(4): 522-527.SU Yanchao, AI Haizhou, LAO Shihong, et al. Non-linear boosting regression for multi-view face alignment[J]. Acta Automatica Sinica, 2010, 36(4): 522-527. |

| [13] | 彭地.图像配准技术与优化算法研究[D]. 上海:复旦大学, 2011:8-25.PENG Di. Image alignment technology and optimization algorithm research[D]. Shanghai:Fudan University, 2011: 8-25. |

| [14] | LOWE D. Distinctive image features from scale-invariant keypoints[J]. International Journal of Computer Vision, 2004, 60(2): 91-110. |

| [15] | LOWE D. Object recognition from local scale invariant features[C]//International Conference on Computer Vision. Corfu, Greece, 1999: 1150-1157. |

| [16] | LINDEBERG T. Scale-space theory: A basic tool for analysing structures at different scales[J]. Journal of Applied Statistics, 1994, 21(2): 224-270. |

| [17] | LI Weijun, XU Jian, WANG Shoujue. A fast eye location algorithm based on geometric complexity[C]//Proceedings of the 5th World Congress on Intelligent Control and Automation. Hangzhou, China, 2004: 4105-4107. |

| [18] | DALAL N, TRIGGS B. Histograms of oriented gradients for human detection[C]//IEEE Computer Society Conference on Computer Vision and Pattern Recognition. San Diego, CA, USA, 2005, 1: 886-893. |