2. 上海市智能制造及机器人重点实验室,上海 200072

2. Shanghai Key Laboratory of Intelligent Manufacturing and Robotics, Shanghai 200072, China

人机协作(human-robot collaboration,HRC)具有极其广阔的研究价值[1-2]。随着人口老龄化以及各种原因导致的肢残人士及运动、语言患者的大量出现,其基本需求是在家居、康复医院、养老院等室内环境下实现自由移动作业,因此,发展先进的助老助残服务机器人成为社会发展和进步的迫切需要。在这一应用中,除了机器人本身要具有局部的机器智能之外,还必需解决的一个重要问题是人机协作问题,包括人机交互、人机一体化、人机协同、人机智能融合等。在人机交互方面,近年来,随着增强现实技术的发展,使得人机交互的本质发生了根本性的变化。研究者模拟出与真实世界同步对应的三维智能空间[3-5],并在虚拟世界中提供用户关于视觉、听觉、触觉等感官模拟,用户与空间中虚拟对象进行交互,实现人机间自然互通与无缝耦合。目前,增强现实已广泛应用于远程医疗、遥操作机器人、外骨骼机器人等研究[6-8]。

在人机一体化与人机智能方面,20世纪90年代初,著名学者钱学森、戴汝为、路甬祥、陈鹰等从认知科学、人工智能、人机合作等不同角度提出了开放的复杂巨系统、大成智慧工程、人机一体化系统等概念[9-10]。人机一体化系统强调人与机器组成“新型伙伴”,共同感知、协同决策、平等合作,实现达到甚至超过人的能力乃至智力的系统[11]。Y.Gu等设计出一套基于增强学习的人机协作机械手[12],用户与Nao拟人机器人协作完成搬运桌子作业。

从老、障、残这类特殊服务对象自身的认知特点及其需求出发,构建了助老助残服务机器人人机一体化导航系统,并提出了基于智能空间的人机一体化导航工作机制。用户与服务机器人一道,共同感知、自由对话、平等协作实现室内环境下人机一体化导航。

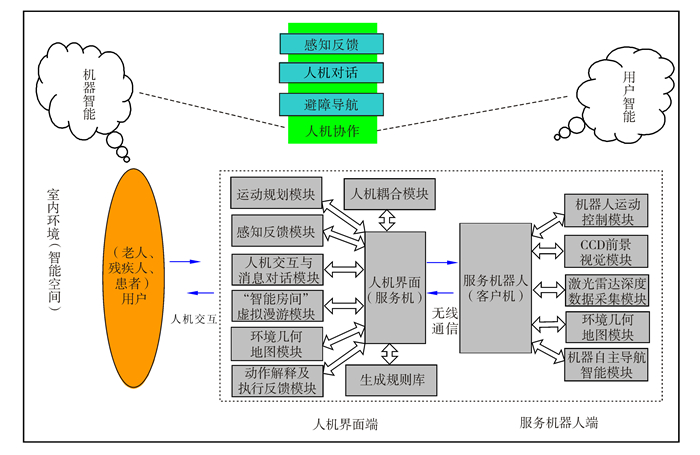

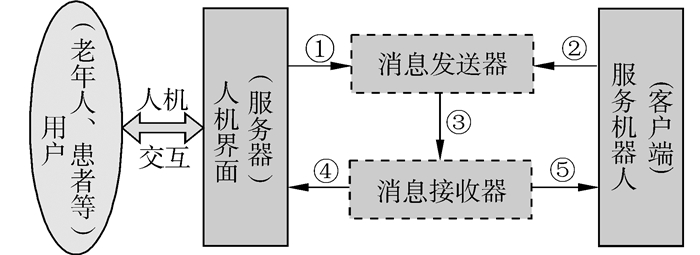

1 人机一体化导航系统基本框架 1.1 人机一体化导航系统基本框架图 1为助老助残服务机器人人机一体化导航系统基本框架。

|

| 图 1 助老助残服务机器人人机一体化导航系统基本框架 Fig. 1 Basic conception of the human-robot integrated navigation system of service robots for elderly and disabled assistance |

用户与机器(计算机或机器人)一道,共同感知、协同决策、平等协作完成感知反馈、人机对话和避障导航等一系列动作或任务,实现室内半结构化环境人机协作导航。人机界面(服务机)与服务机器人(客户机)之间通过组建基于C/S架构的无线局域网进行通信。

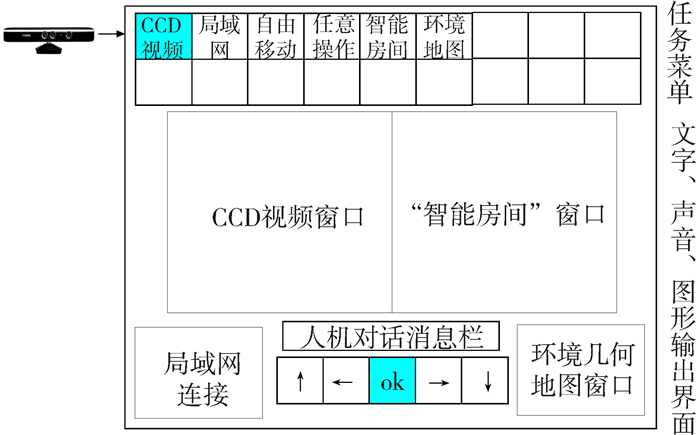

1.2 人机界面对于正常人而言,鼠标、键盘、触摸屏等是方便、常用的人机交互装置,但老、障、残人士需要专门的人机效应通道和人机界面。本文基于Microsoft Kinect for windows开发出“眼动-视觉”、“语音-听觉”和简单手势等3种实现人机间自然互通的人机效应通道,并配有相应的输入/输出人机界面[13],如图 2所示。通过选择/激活菜单中4个方向键和激活键来选择和确认任务菜单中相应的任务栏,任务菜单提示并引导用户输入意愿或命令,人机界面输出文字、声音、图形等多媒体信息。图 3为该人机一体化导航系统的树形任务菜单结构图。

|

| 图 2 人机效应通道及输入/输出人机界面 Fig. 2 HRI channels and its I/O interface |

|

| 图 3 树形任务菜单 Fig. 3 The tree tasks menu |

在“眼动-视觉”人机效应通道中,用Microsoft Kinect for windows捕捉用户眼睛“开闭”和注视视线的停留状态。当用户左眼闭、右眼开(或左眼开、右眼闭)时,选择/激活菜单中当前功能键往左(或右)移动一格。当用户眼睛注视当前功能键并停留一段时间,则该功能键被激活并连续“闪”2下,实现对任务菜单中的任务栏进行选择与执行。“上”、“下”、“左”和“右”4个功能键激活分别对应任务菜单当前任务栏往上、下、左和右跳动一格,同时发出“嘀”的一声提示音;“OK”功能键激活对应任务菜单当前任务栏激活,并连续“闪”2下给用户以提示。“语音-听觉”通道是基于Microsoft Speech Platform SDK 11.0语音识别与语音合成开发包来开发的。为了提高语音识别的准确率,克服用户发音不标准、环境嘈杂等因素,系统只需识别特定简单词汇“左”、“右”对选择/激活菜单中当前功能键进行选择,用户发出“是”激活当前功能键实现对任务菜单当前任务栏进行选择与执行。

简单手势通道是指为双手尚具有活动能力的患者提供的,设置“伸左手”、“伸右手”和“握拳头”3种简单自然的手势,用户“伸左手”或“伸右手”用于对选择/激活菜单中当前功能键进行选择,用户任一只手“握拳头”激活当前功能键实现对任务菜单当前任务栏进行选择与执行。

在上述人机效应通道的基础上,为营造虚拟作业的“临场感”,在人机界面上开发出CCD视频窗口、环境几何地图窗口、“智能房间”窗口、人机对话消息栏等模块。其中CCD视频窗口显示机器人前方作业环境,环境地图窗口显示室内环境电子地图,“智能房间”窗口显示与实际机器人同步运动的三维图像,人机对话消息栏显示人机一体化导航过程中人机对话所发送的消息。

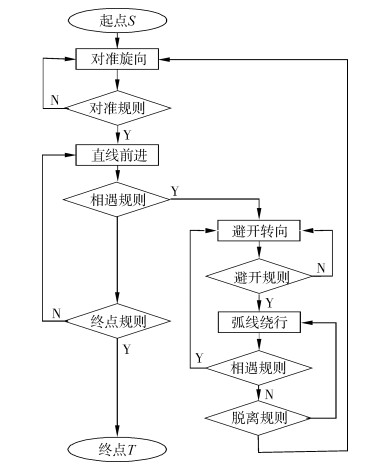

1.3 服务机器人对于该人机协作导航系统而言,服务机器人具有基于生物触角的仿生条件反射导航智能。机器人依靠生物触角实时感知外部环境而产生适当的运动反应,其原理参考文献[14],本文仅对该算法作一简单介绍。定义以下符号:机器人起点S,目标点T,当前位置X,用相遇点H表示碰到障碍物时所处的位置点,用脱离点L表示绕行障碍物边缘结束时所处的位置点。该算法的4种机器人行走行为如下:

1)对准转向:指在S和L处执行的旨在对准T的原地转向动作,直到对准为止。

2)直线前进:指在对准目标点T后所执行的沿XT方向的直线行走动作,直到到达目标点T或者遇到障碍物为止。

3)避开转向:指在障碍物边缘绕行过程中所执行的为远离障碍物而实施的原地转向动作,直至检测不到障碍物为止。

4)弧线绕行:指在障碍物边缘所执行的沿一定曲率半径圆弧绕行行走动作,直至再次遇到障碍物或满足脱离条件为止。

该算法提出对准规则、相遇规则、避开规则、脱离规则和终点规则5种触发规则用于确定机器人行走行为的触发时机,其导航原理如图 4所示。该算法容易忽视环境中障碍物之间的间隙,避障效率低,环境适应性差,存在“局部死区”问题。本文试图从人机协作的角度来解决这一问题。

|

| 图 4 基于生物触角的机器人导航算法 Fig. 4 Navigation algorithm for mobile robots based on biological antennas |

对于该人机一体化系统而言,人与机器之间的信息交流是立体的、多媒介的、双向的。本文基于增强现实技术实现了语音、文字、图像等多媒介信息的人机交互,并通过多窗口设计将用户意愿、机器感知、机器执行、环境信息等都耦合到人机界面上来。

基于OpenGL三维图形库构建出“智能房间”三维模型,包含室内环境模型和服务机器人模型,如图 5所示。

|

| 图 5 “智能房间”模型 Fig. 5 Intelligent room model |

需注意以下2点:一是所建模型与真实环境保持一致,需特别注意房间、门、室内固定物的位置和尺寸,以及用户位置、机器人初始位置等;二是设置服务机器人运动学参数,包括机器人位姿、角速度和角加速度以及各关节的关节角、角速度以及角加速度等。

利用实际机器人左右驱动轮电机编码器和数字罗盘获得机器人在环境中的实时位姿,并经激光雷达依据固定的墙和门框的位置实现同步定位,将经过自定位修正的机器人的初始位姿数据通过无线局域网传到人机界面实现模型机器人初始定位。同理,将经过标定修正的服务机器人各关节初始关节角也传到人机界面上来,实现模型机器人手臂末端的初定位。

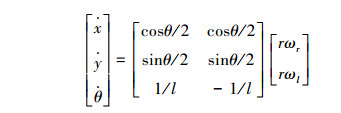

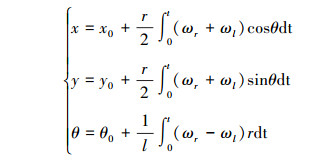

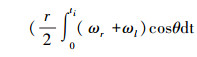

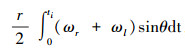

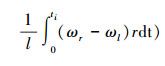

2.2 人机耦合人机耦合是指通过人与机器之间的信息传递与反馈来实现人机同步映射与无缝衔接,达到人机间自然互通,主要包括机器人前方作业视频传输、人机消息对话的发送和“智能房间”同步运动三维模型等。下面仅对同步运动原理作一简单介绍。假设该服务机器人采用两轮差动驱动,其两主动轮角速度分别为ωl及ωr,车轮半径为r,轮距为l。相对于世界坐标系,用2个车轮中点P的坐标x、y及θ来描述机器人的位姿,则其正运动学模型为

|

(1) |

因而相对于世界坐标系机器人位姿为

|

(2) |

式中:(x0, y0, θ0)为机器人的初始位姿,

将人与机器(计算机或机器人)看成是平等协作的“新型伙伴”,提出人机消息对话机制如图 6。

|

| 图 6 人机消息对话工作机制 Fig. 6 The mechanism of HRI in message dialogues |

表 1列出了人机对话消息库中用户意愿—机器提示、机器请求—用户协助、机器引导—用户确认和机器自主—机器提示4种类型的人机对话消息,并给出对应的人机对话消息流向及格式。

| 人机对话消息类型 | 人机对话消息流向 | 人机对话消息格式 |

| 用户意愿—机器提示 | ①③④—①③④、①③⑤—②③④ | 用户向机器下达意愿命令,机器向用户发出相应提示信息。 |

| 机器请求—用户协助 | ①③④—①③④、②③④—①③⑤ | 机器向用户发出请求信息,用户给出相应的协助信息。 |

| 机器引导—用户确认 | ①③④—①③④、②③④—①③⑤ | 机器向用户发出引导信息,用户发出选择与确认信息。 |

| 机器自主—机器提示 | ④—①③④、②③⑤—②③④ | 机器自主执行任务,并向用户发出相应的提示信息。 |

1)用户意愿—机器提示是指用户向机器下达意愿命令,机器予以执行并向用户发送提示消息。例如当用户通过人机界面向服务机器人发出“用户发出前进命令!”,机器人对其进行判断可行则执行前进运动,并向用户发出“机器人正处于前进运动中!”消息,否则保持当前运动状态并向用户发出“机器人无法执行前进运动!”消息。

2)机器请求—用户协助是指机器执行过程中遇到困难向用户发出请求给予必要的协助。例如当机器人陷入“局部死区”,则向用户发出“机器人陷入局部死区!”,用户发挥自身智能发送相应的协助消息来帮助机器人脱离“局部死区”。

3)机器引导—用户确认是指机器向用户发出的默认提示、意图识别等引导信息,用户向机器发出相应的选择与确认信息。例如当机器人导航运动道路上存在多个房间选择,而用户并未指定目标房间,则向用户发出“请问进入哪一房间?”,并在人机界面上依据概率大小列出所有房间号,用户发出选择与确认房间号的消息。

4)机器自主—机器提示是指机器局部自主执行过程中根据现场环境条件变化实时切换相应的行为动作,并同时向用户和机器本身发出相应的提示消息。当机器人接收到提示消息时,则立即切换相应的行为动作,用户实时感知这一变化。此类型人机消息对话主要体现在机器局部自主导航中。

3.2 人机条件响应生成规则人机协作导航包括随机行走和自主导航2种运动模式。随机行走是指在不指定目标点情形下的人机协作导航过程。自主导航是指在指定目标点情形下的机器人局部自主导航过程。2种运动模式既相互独立,根据用户需要自由进行切换;又相互补充,根据现实环境需求进行配合,取长补短。

表 2为建立的人机条件响应生成规则库(4种行走行为和5种判断规则见1.3节)。在随机行走中,机器人在用户的意愿命令下随机行走,只有当特定的条件成立时才停止运动,否则继续保持当前运动状态。在自主导航中,机器人依靠生物触角感知外界环境,激励触发产生相应的行走行为来实现定目标点自主导航。整个导航过程中机器人通过人机消息对话给用户以提示。

| IF〈条件〉 | THEN〈条件〉 |

| 1)处于随机行走直线前进中,相遇规则成立; | 直线前进停止,提示用户前方遇到障碍物及障碍物方位。 |

| 2)处于随机行走弧线绕行中,相遇规则成立; | 弧线绕行停止,提示用户绕行遇到障碍物及障碍物方位。 |

| 3)处于随机行走弧线绕行中,脱离规则成立; | 弧线绕行停止,提示用户到达脱离点。 |

| 4)处于随机行走避开转向中,避开规则成立; | 避开转向停止,提示用户机器人避开障碍物。 |

| 5)处于随机行走中,弧线绕行或避开转向一周; | 随机行走停止,提示用户机器人陷入“局部死区”。 |

| 6)处于随机行走中,机器人检测到其附近存在多个房间; | 随机行走停止,提示用户“请选择进入哪一个房间!”。 |

| 7)处于随机行走中,用户指定需要到达的目标点; | 随机行走终止,切换成自主导航模式。 |

| 8)处于随机行走中,用户下达停止命令; | 随机行走停止,提示用户机器人停止运动。 |

| 9)处于自主导航中,弧线绕行或避开转向一周; | 自主导航停止,提示用户机器人陷入“局部死区”。 |

| 10)处于自主导航直线前进中,相遇规则成立; | 直线前进结束,避开转向触发。 |

| 11)处于自主导航直线前进中,终点规则成立; | 直线前进结束,终点登陆程序启动。 |

| 12)处于自主导航弧线绕行中,相遇规则成立; | 弧线绕行结束,避开转向触发。 |

| 13)处于自主导航弧线绕行中,脱离规则成立; | 弧线绕行结束,对准转向触发。 |

| 14)处于自主导航避开转向中,避开规则成立; | 避开转向结束,弧线绕行触发。 |

| 15)处于自主导航对准转向中,对准规则成立; | 对准转向结束,直线前进触发。 |

| 16)处于自主导航终点登陆中,终点登陆程序结束; | 自主导航结束,提示用户成功到达目标点。 |

| 17)处于自主导航中,用户取消需要到达的目标点; | 自主导航终止,切换成随机行走模式。 |

由生成规则7和17看出,用户根据自身需要自由切换运动模式,充分满足用户在真实环境中自由移动的需要。随机行走模式适合工作在障碍物稀少、空间开阔的环境;自主导航模式适合工作在障碍物密集、空间较为狭小的环境。

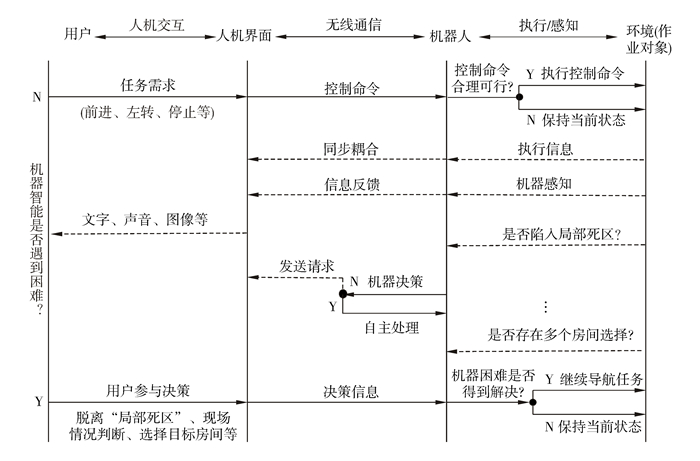

3.3 人机一体化导航工作机制图 7为构建的助老助残服务机器人人机协作导航工作机制,主要体现在以下3个层面。

|

| 图 7 人机一体化导航工作机制 Fig. 7 Human-robot collaboration navigation mechanism |

1)人机共知:通过人机耦合实现用户与机器(计算机或机器人)间信息的同步映射与无缝衔接,达到共同感知、认知的目的。在人机协作过程中,通过增强现实将用户意图、机器感知、执行信息及环境对象信息等耦合到人机界面,给人以“临境感”。

2)人机协商:通过人机对话来实现用户与机器(计算机或机器人)之间进行平等协商,达到人机协同决策的目的。人的智能主要体现在定性分析判断决策上,如目标识别、路径规划等;机器智能主要体现在定量计算推理上,如弧线绕行半径的选择、生成规则的触发等。通过人机消息对话来进行人机协同决策,提高了人机系统的冗余度和稳定性。

3)人机执行:通过人机条件响应生成规则的不断触发过程来实现室内半结构化环境人机协作导航。在人机一体化执行中,以人为本,用户是整个人机系统的领导者,负责整体的控制和协助,充分享有机器(计算机或机器人)提供的服务;机器是整个人机系统的执行者,在用户的意愿和指导下最大限度地去完成作业任务。

4 人机一体化导航实验 4.1 人机一体化导航系统助老助残服务机器人人机一体化导航系统由用户、人机界面(服务端)、服务机器人(客户端)组成,助老助残服务机器人人机一体化导航系统如图 8所示。用户基于Microsoft Kinect for windows通过“视觉-眼动”、“听觉-语音”、自然手势等3种简单自然的人机效应通道与人机界面进行交互。人机界面与服务机器人通过组建基于C/S架构的局域网实现无线通信。该服务机器人安装了2个六自由度轻量化手臂,移动平台采用独立两轮差动驱动,并配备各种传感器,包括激光雷达、双目视觉传感器、顶部CCD摄像机、驱动电机编码器、GPS等。

|

| 图 8 助老助残服务机器人人机一体化导航系统 Fig. 8 The human-robot integrated navigation system of a service robot for elderly and disabled assistance |

实验现场如图 9所示。

|

| 图 9 实验现场环境 Fig. 9 Scene environments of experiments |

用户位于其中一个房间内,机器人位于走廊内,走廊和房间中随机分布多种障碍物,包括箱柜、桌椅、室内物品等。用户智能正常却行动不便,需要借助服务机器人进行人机协作自由移动。该服务机器人具有基于生物触角的机器人导航智能。

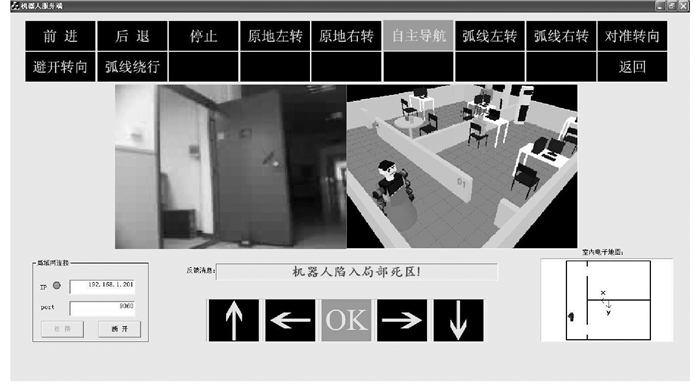

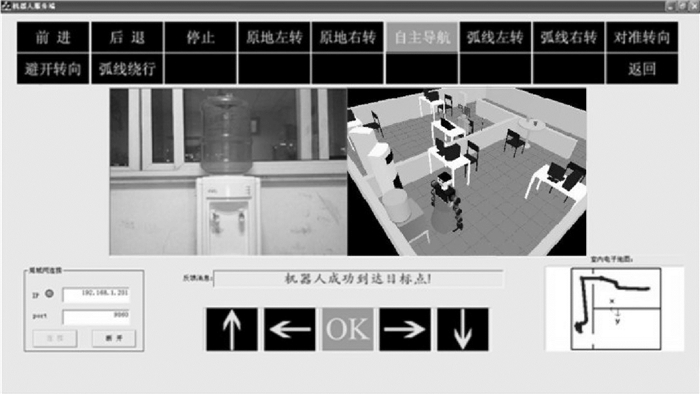

4.2 实验过程及结果分析图 10显示机器人在走廊内检测到障碍物,在其自主智能无法解决避障问题的情况下,向人发出“机器人陷入局部死区!”消息。用户查看CCD摄像机获取的绕行障碍物边缘过程现场视频图像(见图 9),发现机器人陷入室内走廊环境一侧的“局部死区”,凭借自身认知智能向机器人发出“弧线左转”指令调整机器人位姿至走廊另一侧的S1′处。紧接着用户发出“自主导航”指令,机器人依靠自身导航智能运动至目标点T1。机器人在进入房间2过程中检测到房门处存在障碍物,在其自主智能不能判断障碍物方位而无法进行下一步操作的情况下,立即启动制动操作于S2′处停止下来,并向人发出“机器人无法进入房间2!”的消息。

|

| 图 10 机器人陷入局部死区时的人机界面 Fig. 10 The HRI whils the robot is trapped into a blind area |

用户根据机载CCD摄像机获取的现场视频图像,发现房间2的门是关着的,向机器人发出“开门”指令,机器人伸展手臂打开房门。紧接着,用户发出“自主导航”指令,机器人进入房间2运动至目标点T2。机器人进入房间2后,凭借自身导航智能绕开房间内障碍物顺利到达目标点T3。图 11显示机器人到达房间2指定位置,向用户发出“机器人成功到达目标点!”的消息。图 12为整个人机一体化导航过程机器人的运动轨迹。图 12中用矩形方框表示障碍物,其中虚线表示了机器人路径规划的理论轨迹,实线表示机器人人机协同导航运动的实际轨迹。机器人沿着轨迹S1-S1′-T1(S2)-S2′-T2(S3)-T3成功到达目标点。从图 12中可以看出,机器人人机协同导航实际运动的轨迹与理论轨迹基本保持一致,具有良好的鲁棒性和冗余性。

|

| 图 11 机器人完成导航任务作业时的人机界面 Fig. 11 The HRI whils the navigation task is completed |

|

| 图 12 人机一体化导航运动轨迹 Fig. 12 Trajectory of human-robot collaboration roaming |

表 3中给出了整个人机一体化导航过程的运动情况统计。从表 3中看出,整个人机一体化导航过程中机器执行的运动次数远大于用户参与的次数。因此,在机器适当智能化的情况下,通过发挥人机协同的优势将人的智能融合到机器执行之中,顺利、高效地完成了室内半结构化环境人机一体化导航作业任务。

| 类型 | S1~T1 | S2~T2 | S3~T3 | |

| 机器执行 | 对准转向 | 3 | 1 | 2 |

| 直线前进 | 3 | 2 | 2 | |

| 避开转向 | 4 | 0 | 1 | |

| 弧线绕行 | 4 | 0 | 1 | |

| 用户参与 | 1 | 1 | 0 | |

5 结论

1)从老、障、残这类特殊服务群体自身需求出发,构建了助老助残服务机器人人机一体化导航系统,并且提出了人机一体化导航工作机制。用户与机器一道,共同感知、协同决策、平等合作完成导航作业,人机界面上同步呈现虚实结合、实时交互的智能空间,实现室内半结构化环境下人机一体化导航作业。

2)该人机一体化导航系统开发出随机行走和自主导航2种导航运动模式,增加了人机协作导航的冗余度,提升了用户参与的灵活性和舒适性。

3)从机器智能的提高上看,除机器人具有局部导航智能外,人机界面上基于增强现实开发出CCD二维视频、“智能房间”、环境地图、人机对话消息等模块,增强“临场感”,提升了人机协作的真实性和趣味性。

4)人机协作导航集中体现在人机共知、人机协商与人机执行3个层面,通过人机耦合、人机消息对话和人机条件响应生成规则实现人机一体化感知、决策与执行,达到了人机智能融合的目的。

| [1] | AHMED N R, SAMPLE E M, CAMPBELL M. Bayesian multicategorical soft data fusion for human-robot collaboration[J]. IEEE Transactions on Robotics , 2013, 29 (1) : 189-206 DOI:10.1109/TRO.2012.2214556 |

| [2] | WEISS A, WURHOFER D, LANKES M, et al. Autonomous vs. teleoperated: how people perceive human-robot collaboration with hrp-2[C]//IEEE International Conference on Human Robot Interaction. La Jolla, CA, 2009: 257-258. |

| [3] | MINATO T, SHIMADA M, ISHIGURO H, et al. Development of an android robot for studying human-robot interaction[J]. Innovations in Applied Artificial Intelligence , 2004 : 424-434 |

| [4] | GREEN S A, CHASE J G, CHEN X Q, et al. Evaluating the augmented reality human-robot collaboration system[J]. International Journal of Intelligent Systems Technologies and Applications , 2010, 8 (1) : 130-143 |

| [5] | DAUTENHAHN K. Socially intelligent robots: dimensions of human-robot interaction[J]. Philosophical Transactions of the Royal Society B:Biological Sciences , 2007, 362 : 679-704 DOI:10.1098/rstb.2006.2004 |

| [6] | 赵泽, 崔莉. 一种基于无线传感器网络的远程医疗监护系统[J]. 信息与控制 , 2006, 35 (2) : 265-269 ZHAO Ze, CUI Li. A remote health care system based on wireless sensor networks[J]. Information and Control , 2006, 35 (2) : 265-269 |

| [7] | 赵迪, 李世其, 朱文革, 等. 基于虚拟现实的空间机器人遥操作在维护作业中的应用[J]. 航天器工程 , 2010, 4 : 92-98 ZHAO Di, LI Shiqi, ZHU Wenge, et al. Application of VR-based space robot teleoperation in maintenance work[J]. Spacecraft Engineering , 2010, 4 : 92-98 |

| [8] | 郭朝.基于分子马达的骨骼肌生物力学原理及其在外骨骼机器人人机力交互中应用[D].上海:上海交通大学, 2012: 45-53. GUO CHAO. Myosin II-based biomechanics principle of skeletal muscle and its application in human-machine interaction for exoskeleton [D]. Shanghai: Shanghai Jiaotong University, 2012: 45-53. |

| [9] | 戴汝为. 人-机结合的智能科学和智能工程[J][J]. 中国工程科学 , 2004, 6 (5) : 24-27 DAI Ruwei. Man-computer cooperative intelligent science and intelligent technology[J]. Engineering Science , 2004, 6 (5) : 24-27 |

| [10] | 路甬祥, 陈鹰. 人机一体化系统与技术——21世纪机械科学的重要发展方向[J]. 机械工程学报 , 1994, 30 (5) : 1-7 LU Yongxiang, CHEN Ying. HUMACHINE—A new word for the 21th century[J]. Chinese Journal of Mechanical Engineering , 1994, 30 (5) : 1-7 |

| [11] | 杨灿军, 陈鹰, 路甬祥. 人机一体化智能系统理论及应用研究探索[J]. 机械工程学报 , 2000, 36 (6) : 42-47 |

| [12] | GU Y, THOBBI A, SHENG W. Human-robot collaborative manipulation through imitation and reinforcement learning[C]. IEEE ICIA International Conference. [s.n.], 2011: 151-156. |

| [13] | 赵其杰, 服务机器人多通道人机交互感知反馈工作机制及关键技术[D].上海:上海大学, 2005:18-36. ZHAO Qijie, Information perception and feedback mechanism and key techniques of multi-modality human-robot interaction for service robots [D]. Shanghai: Shanghai University, 2005:18-36. |

| [14] | 江济良, 屠大维, 许烁, 等. 基于生物触角的仿生条件反射机器人导航算法[J]. 电子学报 , 2013, 41 (3) : 388-394 JIANG Jiliang, TU Dawei, XU Shuo. Mobile robot navigation algorithm of biomimetic conditioned reflex based on biological antennas[J]. Acta Electronica Sinica , 2013, 41 (3) : 388-394 |