文章信息

- 陆静, 王家亮, 朱赛华, 何瑞银

- LU Jing, WANG Jialiang, ZHU Saihua, HE Rinyin

- 基于特征优化的稻飞虱图像分类

- Classification of rice planthoppers image based on feature optimition

- 南京农业大学学报, 2019, 42(4): 767-774

- Journal of Nanjing Agricultural University, 2019, 42(4): 767-774.

- http://dx.doi.org/10.7685/jnau.201810012

-

文章历史

- 收稿日期: 2018-10-13

水稻是我国最重要的粮食作物之一, 种植范围广、面积大。在水稻的整个生产周期中, 害虫种类繁多, 繁殖速度快、周期短, 症状各异。其中, 稻飞虱是危害水稻的主要害虫, 并常伴随多种稻飞虱混合发生。近年来由于异常天气频发, 导致稻飞虱更加猖獗[1-2]。同时, 稻飞虱种群的发展和危害往往不易被及时觉察, 一旦错过防治, 就会导致水稻严重减产或绝收[3]。

因此, 为了保障水稻的稳产与高产, 需要对其虫情信息进行实时准确监测, 从而能够根据不同的稻飞虱及时采取相应防治措施, 控制稻飞虱暴发, 有效减少稻飞虱危害。虫情信息检测方法主要分为昆虫雷达监测[4]、声学检测[5]以及图像识别监测[6]。其中, 昆虫雷达设备造价昂贵, 且对于田间害虫种类的分布情况监测还需借助其他手段进行判断; 同时野外环境嘈杂, 噪声过多, 通过声音监测害虫仍有待改进。因此, 图像识别监测成为稻飞虱虫情监测的研究热点, 如Yu等[7]以二维频谱窗口数据作为稻飞虱特征参数, 并建立Fisher判别函数来识别稻飞虱图像, 分类准确率达到90%以上; 刘德营等[8]利用卷积神经网络对白背飞虱图像进行分类, 经过多次卷积与池化操作最终获得96.17%的白背飞虱识别精度; 谢堂胜等[9]通过对白背飞虱的大小统计分析的方法, 剔去明显非白背飞虱的单个昆虫图像, 运用不变矩和二维傅里叶频谱数据提取昆虫几何形态, 建立了基于支持向量机的白背飞虱识别模型。

为了保证分类的准确性, 需提取足够的稻飞虱特征参数, 但提取的特征越多, 图像的识别效率越低, 无法满足稻飞虱实时监测的要求。因此, 本研究从稻飞虱图像特征的提取与优化方面着手, 分别提取稻飞虱图像的形态特征13个、颜色特征18个、纹理特征35个来全方位描述稻飞虱图像, 并且通过F-score特征评价方法, 进一步筛选优化该特征集以获得最优特征子集, 在确保稻飞虱图像分类准确的前提下, 减少特征参数维度, 加快分类速度, 以满足基于图像识别的虫情测报系统的技术要求。

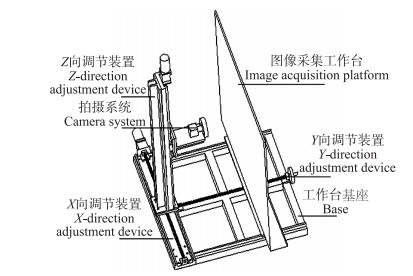

1 材料与方法 1.1 稻飞虱图像采集与图像处理 1.1.1 稻飞虱图像采集稻飞虱图像采集于南京市溧水区白马国家农业科技园内的水稻田, 采集时间为2017年8月至10月。图像采集设备为本团队自主研发的野外昆虫图像采集装置, 如图 1所示。采样期间, 天气炎热潮湿, 各类害虫大量繁殖, 因此稻飞虱数量较多, 方便获取大量昆虫图像样本。每天于16:30提前启动装置, 利用昆虫的趋光性, 选用高压汞灯作为诱虫灯, 并将诱虫灯放置于水稻害虫图像采集装置旁边吸引昆虫; 至傍晚时分, 大量昆虫聚集于装置附近, 并趴伏在采集工作台的白色幕布上。拍摄开始时间设置为每天的18:30, 到达拍摄时间点后装置开始自动循环拍摄整个白色幕布上的昆虫图像, 夜间试验现场如图 2所示。

|

图 1 图像采集装置结构 Fig. 1 Image acquisition device structure |

|

图 2 夜间试验现场 Fig. 2 Night experiment site |

试验期间, 采集到的昆虫种类较多, 但限于试验地点, 在本试验中获取的稻飞虱图像以白背飞虱、褐飞虱和灰飞虱为主, 其余昆虫包括蠼螋、蚂蚁、苍蝇、叶蝉等。采集照片保存格式为BMP, 像素大小为768×576。

1.1.2 稻飞虱图像预处理图像预处理是昆虫识别的一个重要步骤。在试验中, 由于在野外进行拍摄, 拍摄时间、区域的不同, 导致成像特性如光照均匀度、对比度等存在一定差异, 这些差异直接影响后续提取的图像特征参数是否准确。因此, 对稻飞虱图像进行灰度化、二值化、去噪等预处理操作, 最终将获取的图像分割成标准统一的昆虫图像。

昆虫图像经过阈值化分割[10], 将图像灰度分成不同等级, 通过设定阈值, 用以分割目标区域的边界, 去除不固定拍摄产生的差异性。分割后的二值图像外部存在孤立的噪声点, 同时昆虫的触角、四肢等部位的存在也对后续的形态特征提取造成干扰。因此, 使用形态学滤波[11]去除噪声, 通过腐蚀[12]对二值图像目标边界进行消除, 使昆虫图像收缩; 通过膨胀[12]对二值图像目标边界向外进行扩张, 使昆虫图像扩张。

得到去噪的二值昆虫图后, 利用边界跟踪算法[13]获取昆虫背部图像。在确定中心点像素坐标后, 通过8方向链码顺序表示其周围像素点坐标, 依次搜索边界点, 来跟踪昆虫背部边缘图像, 得到稻飞虱背部边界图, 为后续提取特征参数提供保障。

1.2 稻飞虱图像特征选取通过提取图像特征参数, 对图像进行量化表示。特征参数作为分类器的输入, 直接影响后续识别的准确率与效率, 因此特征参数的选取至关重要。根据稻飞虱的形态、颜色、纹理不同, 选取以下特征:

1) 形态特征:形态是识别稻飞虱的关键特征, 不同飞虱具有明显不同的形态特征。白背飞虱体长3.8~4.6 mm, 褐飞虱体长2.5~3.2 mm, 灰飞虱体长3.5~4.0 mm。通过形状参数和矩函数来提取昆虫的形态特征参数, 包括狭长度、矩形度、球状性、紧凑度、圆形度、长宽比以及7个不变矩[14]。其中不变矩因其平移、伸缩、旋转不变性可描述稻飞虱图像形状的全局特征。

2) 颜色特征:白背飞虱大部分为黑褐及灰黄褐色, 前中胸背板为黄白色; 褐飞虱有颜色深、浅2种; 灰飞虱则偏黄褐色。颜色特征对方向和大小不敏感[15], 能够较好地描述稻飞虱图像的特征。在RGB和HSV颜色空间下, 通过计算R、G、B、H、S、V各个颜色通道下的均值和标准差, 共12个特征, 进而再提取HSV颜色空间下的均值、方差、偏度、峰度、能量和熵, 共6个特征[16]。

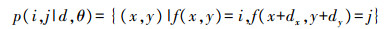

3) 纹理特征:纹理是一种区域特征, 与物体尺寸、形状等相关联, 对稻飞虱纹理特征进行分析, 可以得到重要的图像信息[17-18]。基于灰度共生矩阵可以提取描述昆虫纹理特征的参数, 设一幅M×N的灰度图像f(x, y), 如图 3所示, d=(dx, dy)为位移矢量, dx、dy分别为x轴、y轴方向上的位移, Level表示图像的最大灰度级数。以图像f(x, y)中灰度值为i的像素点为起点, 统计灰度值为j且与其相距为δ=(dx2+dy2)1/2的像素点出现的概率p(i, j|d, θ), 可以表示为:

|

(1) |

|

图 3 灰度共生矩阵像素对 Fig. 3 Gray level co-occurrence matrix pixel pair |

式中:i, j∈[0, Level-1];θ∈{0°, 45°, 90°, 135°}。

分别提取稻飞虱的形态、颜色和纹理各13、18和35个特征, 共66个。为了方便表示, 将提取的13个形态特征记作S1—S13, 18个颜色特征记作C1—C18, 35个纹理特征记作V1—V35, 如表 1所示。

| 特征编号 Feature number |

特征 Features |

| S1 | 狭长度Narrow degree |

| S2 | 矩形度Similarity of rectangle |

| S3 | 球状性Similarity of sphere |

| S4 | 紧凑度Compact ratio |

| S5 | 圆形度Similarity of circularity |

| S6 | 长宽比Aspect ratio |

| S7—S13 | Hu不变矩Φ1—Φ7 Hu moment Φ1-Φ7 |

| C1—C3 | R、G、B分量均值R, G, B component mean |

| C4—C6 | R、G、B分量标准差R, G, B component standard deviation |

| C7—C9 | H、S、V分量均值H, S, V component mean |

| C10—C12 | H、S、V分量标准差H, S, V component standard deviation |

| C13 | HSV均值HSV mean |

| C14 | HSV方差HSV variance |

| C15 | HSV偏度HSV skewness |

| C16 | HSV峰度HSV kurtosis |

| C17 | HSV能量HSV energy |

| C18 | HSV熵HSV entropy |

| V1—V4 | 0°~135°各方向对比度Contrast from 0° to 135° |

| V5—V8 | 0°~135°各方向能量Energy from 0° to 135° |

| V9—V12 | 0°~135°各方向相关Relevance from 0° to 135° |

| V13—V16 | 0°~135°各方向熵Entropy from 0° to 135° |

| V17—V20 | 0°~135°各方向逆差矩Inverse difference moment from 0° to 135° |

| V21—V23 | 对比度均值、方差、标准差Mean, variance, standard deviation of contrast |

| V24—V26 | 能量均值、方差、标准差Mean, variance, standard deviation of energy |

| V27—V29 | 相关性均值、方差、标准差Mean, variance, standard deviation of relevance |

| V30—V32 | 熵均值、方差、标准差Mean, variance, standard deviation of entropy |

| V33—V35 | 逆差矩均值、方差、标准差Mean, variance, standard deviation of inverse difference moment |

BP神经网络是一种按误差反向传播的多层前馈网络[19], 在图像的识别与分类中应用广泛。利用BP神经网络算法[20]进行稻飞虱图像分类步骤为:

1) 随机选取稻飞虱特征值权重系数阵W;

2)计算稻飞虱样本特征值经过BP神经网络获得的预测值Yprediction;

3) 由样本实际值Y和预测值Yprediction计算误差Err;

4) 由误差Err调整稻飞虱特征值权重系数矩阵W;

5) 对所有样本重复上述步骤, 直至达到规定的迭代次数。

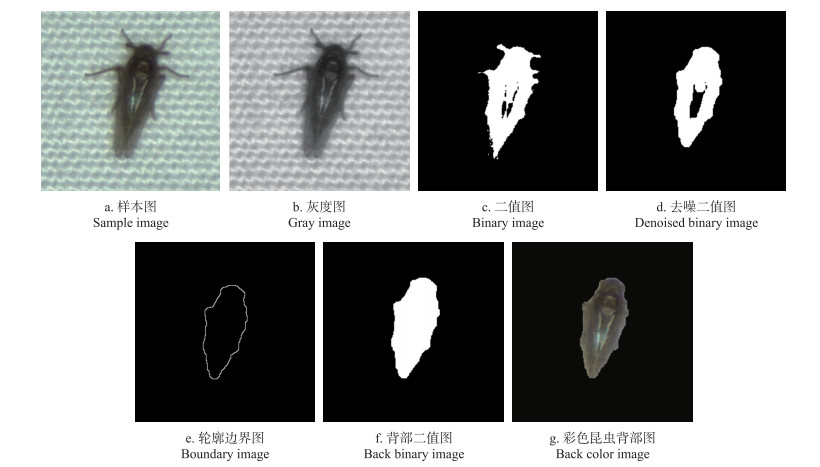

2 结果与分析 2.1 稻飞虱试验图像与特征参数获取图 4为昆虫彩色背部图像获取过程。对原图(图 4-a)进行灰度和二值化处理, 得到灰度图(图 4-b)和二值图(图 4-c), 经过阈值分割后的昆虫二值图像, 其周围存在尖刺、凹坑, 内部存在孔洞, 通过构建的3×3圆盘型形态学滤波器, 对其进行去噪、平滑处理, 效果如图 4-d所示。利用边界跟踪算法检测形态学滤波后的目标昆虫区域的外轮廓边界, 效果如图 4-e所示。对昆虫轮廓内部进行白色区域填充获得昆虫背部完整区域, 此时获得的图像为边界光滑、内部无孔洞的昆虫背部二值图像(图 4-f)。再将此图像与昆虫原图逻辑相加, 即对背景区域进行黑色填充, 保留原昆虫的背部区域不变, 最终得到完整的彩色昆虫背部图像(图 4-g)。

|

图 4 昆虫背部图像获取过程 Fig. 4 Insect back image acquisition process |

基于上述稻飞虱背部图像和特征提取算法, 提取的各类特征如表 2所示。

| 特征编号 Features number |

特征参数Parameters |

| S1 | 0.497 9 |

| S2 | 0.666 5 |

| S3 | 0.105 6 |

| S4 | 0.385 3 |

| S5 | 2.703 9 |

| S6 | 2.008 2 |

| S7 | 1.371 4 |

| S8 | 3.328 3 |

| S9 | 6.523 7 |

| S10 | 7.537 2 |

| S11 | 14.567 8 |

| S12 | 9.210 9 |

| S13 | 19.037 6 |

| C1 | 9.976 9 |

| C2 | 9.323 1 |

| C3 | 8.287 9 |

| C4 | 26.600 8 |

| C5 | 25.330 1 |

| C6 | 22.657 5 |

| C7 | 0.021 5 |

| C8 | 0.026 1 |

| C9 | 0.039 5 |

| C10 | 0.090 4 |

| C11 | 0.072 5 |

| C12 | 0.105 8 |

| C13 | 1.082 1 |

| C14 | 3.012 7 |

| C15 | 8.784 0 |

| C16 | 5.959 1 |

| C17 | 1.015 8 |

| C18 | 1.342 7 |

| V1 | 1.142 9 |

| V2 | 0.734 7 |

| V3 | 1.000 0 |

| V4 | 2.367 3 |

| V5 | 0.517 9 |

| V6 | 0.492 7 |

| V7 | 0.545 3 |

| V8 | 0.391 1 |

| V9 | 0.432 5 |

| V10 | 0.592 4 |

| V11 | 0.499 5 |

| V12 | -0.027 2 |

| V13 | 1.291 4 |

| V14 | 1.310 4 |

| V15 | 1.148 6 |

| V16 | 1.561 7 |

| V17 | 0.512 8 |

| V18 | 0.486 0 |

| V19 | 0.539 3 |

| V20 | 0.378 9 |

| V21 | 1.311 2 |

| V22 | 0.724 1 |

| V23 | 0.524 3 |

| V24 | 0.486 7 |

| V25 | 0.067 3 |

| V26 | 0.004 5 |

| V27 | 0.374 3 |

| V28 | 0.275 6 |

| V29 | 0.075 9 |

| V30 | 1.328 1 |

| V31 | 0.171 7 |

| V32 | 0.029 5 |

| V33 | 0.479 2 |

| V34 | 0.070 4 |

| V35 | 0.005 0 |

试验共选取210张稻飞虱图像与140张非稻飞虱图像, 随机选取70%, 即147张稻飞虱和98张非稻飞虱共245张昆虫图像作为训练集样本, 剩余的图像作为测试样本。以上述66个特征参数作为BP神经网络输入值, 分类结果(表 3)显示:利用上述提取的昆虫形态、颜色和纹理特征能够作为稻飞虱图像分类的有效特征参数, 且分类准确率达到96.19%。

| 参数名称 Parameter name |

参数值 Parameter values |

| 输入集样本数量Sample size of input set | 245 |

| 验证集样本数量Sample size of validation set | 105 |

| 图像特征数Number of image feature | 66 |

| 分类准确率/% Classification accuracy rate | 96.19 |

为了减少前期对图像处理的工作量, 提高稻飞虱图片分类效率, 需要通过对特征参数进行选择, 降低特征维数, 减少过拟合, 筛选出一个最优特征子集, 以尽可能少的特征参数来描述目标昆虫并保证原有的分类准确率。

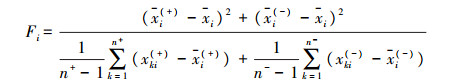

F-score特征评价方法[21]能够很好地衡量特征参数在2类之间的识别作用, 因此本文选取F-score特征评价方法来筛选最优特征子集。假设样本训练集为xk∈Rm, k=1, 2, …, n, 其中n+和n-分别表示正、负样本总数, 则编号为i的特征参数的F-score值为:

|

(2) |

式中: xi、xi(+)、xi(-)分别表示编号为i的特征参数在总样本、正样本以及负样本上的平均值; xki(+)和xki(-)分别表示第k个正、负样本中编号为i的特征参数的特征值。

F-score值也可以解释为正、负样本的类间距离与类内距离的比值。实际分类中, 两者比值越大, 越有利于分类。本文首先通过计算66个特征参数的F-score值, 来对它们进行特征评价, 计算结果如表 4所示。

| 特征编号 Feature number |

F-score值 Value of F-score |

| S1 | 0.004 6 |

| S2 | 1.114 8 |

| S3 | 1.217 3 |

| S4 | 0.176 4 |

| S5 | 0.094 1 |

| S6 | 0.021 3 |

| S7 | 0.016 2 |

| S8 | 0.050 3 |

| S9 | 0.769 2 |

| S10 | 0.726 9 |

| S11 | 0.770 4 |

| S12 | 0.692 1 |

| S13 | 0.396 8 |

| C1 | 0.525 2 |

| C2 | 0.542 2 |

| C3 | 0.498 5 |

| C4 | 0.340 8 |

| C5 | 0.346 3 |

| C6 | 0.306 8 |

| C7 | 0.023 9 |

| C8 | 0.271 4 |

| C9 | 0.520 4 |

| C10 | 0.090 1 |

| C11 | 0.170 1 |

| C12 | 0.337 0 |

| C13 | 0.509 7 |

| C14 | 0.168 7 |

| C15 | 1.184 5 |

| C16 | 0.604 8 |

| C17 | 0.951 2 |

| C18 | 1.205 1 |

| V1 | 0.095 8 |

| V2 | 0.083 8 |

| V3 | 0.059 9 |

| V4 | 0.073 1 |

| V5 | 0.665 5 |

| V6 | 0.625 6 |

| V7 | 0.630 4 |

| V8 | 0.694 7 |

| V9 | 0.112 8 |

| V10 | 0.001 4 |

| V11 | 0.140 7 |

| V12 | 0.027 7 |

| V13 | 0.703 7 |

| V14 | 0.671 1 |

| V15 | 0.680 8 |

| V16 | 0.712 5 |

| V17 | 0.663 1 |

| V18 | 0.615 9 |

| V19 | 0.626 5 |

| V20 | 0.693 7 |

| V21 | 0.105 9 |

| V22 | 0.150 9 |

| V23 | 0.017 1 |

| V24 | 0.699 1 |

| V25 | 0.586 4 |

| V26 | 0.594 5 |

| V27 | 0.247 8 |

| V28 | 0.192 1 |

| V29 | 0.052 2 |

| V30 | 0.729 7 |

| V31 | 0.524 0 |

| V32 | 0.449 7 |

| V33 | 0.698 3 |

| V34 | 0.599 3 |

| V35 | 0.600 4 |

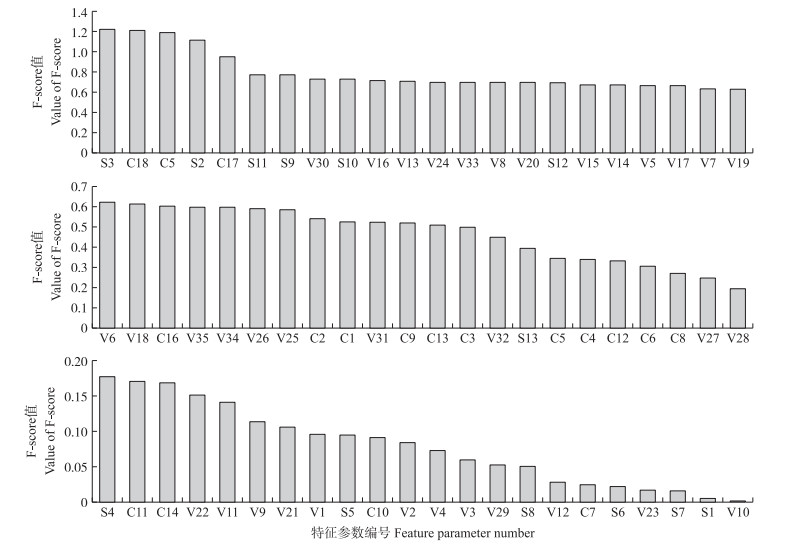

将66个特征参数按照F-score值从大到小进行排序, 结果(图 5)显示:提取的66个特征参数的F-score值以特征C13为分界线, F-score值大于0.5与小于0.5的数量几乎相当。求取66个特征参数F-score值的平均值, 约为0.446 6, 与0.5接近。考虑到F-score值过低对于分类效果不明显, 因此本文以66个特征参数的平均值作为初步筛选特征子集的标准, 并剔除F-score值低于均值的特征参数。由图 5可知:66个特征参数中, 低于平均值的特征包括S13至V10, 共30个。

|

图 5 特征参数F-score值排序图 Fig. 5 F-score value of feature parameter sorting graph |

为了考察剔除的特征参数对分类准确率是否有影响, 构建4组特征子集对稻飞虱图像进行识别, 得出分类准确率并与原特征子集作对比。为了方便表示, 以1代表F-score值最大的特征, 即S3, 依次类推, F-score值最低的特征V10编号为66。构建的4组特征子集为:1~36单独为1组; 其余3组为1~36加上选取的5个低F-score值的特征(表 5)。从表 5可以看出:当特征子集由大于均值的特征参数构成时, 与原66个特征参数构成的初始特征子集相比, 分类准确率几乎没有改变。而其余3组加入低F-score值平均值的特征参数的特征子集, 分类器的分类准确率均呈下降趋势。

| 特征子集 Feature subset |

分类准确率/% Classification accuracy rate |

| 1~36 | 95.24 |

| 1~36, 37, 38, 39, 40, 41 | 93.33 |

| 1~36, 46, 47, 48, 49, 50 | 92.38 |

| 1~36, 55, 56, 57, 58, 59 | 93.33 |

| 1~66 | 96.19 |

因此, 以低于F-score值平均值作为初步剔除特征参数的标准是可行的。初步筛选后的特征子集并非最优特征子集, 仍有部分对于提高分类准确率无用的特征参数在其中, 为此, 进一步对特征参数进行精选。方法如下:

1) 将特征参数1~36按照F-score值从大到小依次排列, 记作特征1—特征36;

2) 将特征1作为一个特征子集, 训练分类器, 并测试其准确率;

3) 依次将特征加入特征子集, 构成新的特征子集, 训练得到分类器, 并测试其准确率。若准确率提高, 则保留该特征参数; 否则剔除, 并得到一个新的特征子集;

4) 重复步骤3, 直至36个特征参数都添加进特征子集中1次为止。最终对比36个特征子集的准确率, 从而得出最优子集。

按照上述方法得到的分类准确率, 结果如表 6所示。

| 特征子集 Feature subset |

分类准确率/% Classification accuracy rate |

| 1 | 67.62 |

| 1, 2 | 76.19 |

| 1, 2, 3 | 84.76 |

| 1, 2, 3, 4 | 84.76 |

| 1, 2, 3, 5 | 86.67 |

| 1, 2, 3, 5, 6 | 89.52 |

| 1, 2, 3, 5, 6, 7 | 92.38 |

| 1, 2, 3, 5, 6, 7, 8 | 92.38 |

| 1, 2, 3, 5, 6, 7, 9 | 92.38 |

| 1, 2, 3, 5, 6, 7, 10 | 92.38 |

| 1, 2, 3, 5, 6, 7, 11 | 93.33 |

| 1, 2, 3, 5, 6, 7, 11, 12 | 94.29 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13 | 95.24 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 14 | 94.29 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 15 | 95.24 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 16 | 93.27 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 17 | 95.24 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18 | 96.19 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 19 | 96.19 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 20 | 92.38 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 21 | 92.38 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 22 | 93.33 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 23 | 94.29 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 24 | 95.24 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 25 | 94.29 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 26 | 95.24 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 27 | 93.27 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 28 | 95.24 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 29 | 96.19 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 30 | 94.29 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 31 | 95.24 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 32 | 93.27 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 33 | 94.29 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 34 | 95.24 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 35 | 93.27 |

| 1, 2, 3, 5, 6, 7, 11, 12, 13, 18, 36 | 93.27 |

从表 6可以看出:BP神经网络能够较好地识别目标昆虫, 准确率都在90%以上, 且当部分特征作为输入参数时, 不仅不会提高分类准确率反而会降低分类准确率。当选择1, 2, 3, 5, 6, 7, 11, 12, 13, 18作为最优特征子集时, 即颜色特征中HSV空间下的偏度、能量和熵, 形态特征中的球状性和Hu不变矩, 纹理特征中的能量、逆差矩和熵, 分类准确率达到96.19%, 与使用全部66组特征作为BP神经网络输入参数的分类效果相同。因此, 选用该最优特征子集作为分类器输入参数能够提高分类器识别稻飞虱图像的效率, 并能够保持原有的分类准确率。

3 结论1) 通过图像采集装置获取大量昆虫图像, 选取210张稻飞虱图像和140张非稻飞虱图像作为试验样本图像。根据获取的图像特点, 利用阈值分割、形态学滤波器以及边缘跟踪算法获取昆虫彩色背部。

2) 通过分析稻飞虱形态特点, 利用形状参数法和Hu不变矩共提取13个形态特征参数; 基于分割后的昆虫图像的颜色直方图, 提取18个颜色特征参数; 利用灰度共生矩阵提取昆虫图像纹理特征, 共35个。最终获得66个能够描述昆虫特征的特征参数。

3) 采用BP神经网络作为分类器, 提取的66个特征参数作为输入参数, 稻飞虱图像的分类准确率达到96.19%;对提取的66个特征参数, 以特征参数F-score值作为初步筛选特征的标准, 并通过与分类器结合, 对特征参数进行精选, 最终针对分类准确率, 选择出最优特征子集。结果表明:利用最优特征子集进行稻飞虱图像分类, 既能提高稻飞虱图像分类效率, 也能保持原有的分类准确率。

| [1] |

包云轩, 蒋蓉, 谢晓金, 等. 近30年气候异常对江苏省褐飞虱灾变性迁入的影响[J]. 生态学报, 2014, 34(23): 7078-7092. Bao Y X, Jiang R, Xie X J, et al. Impact of climate anomalies on catastrophic immigrations of Nilaparvata lugens in Jiangsu Province[J]. Acta Ecologica Sinica, 2014, 34(23): 7078-7092 (in Chinese with English abstract). |

| [2] |

程家安, 祝增荣. 2005年长江流域稻区褐飞虱暴发成灾原因分析[J]. 植物保护, 2006, 32(4): 1-4. Cheng J A, Zhu Z R. Analysis on the key factors causing the outbreak of brown planthopper in Yangtze Area, China in 2005[J]. Plant Protection, 2006, 32(4): 1-4 (in Chinese with English abstract). DOI:10.3969/j.issn.0529-1542.2006.04.001 |

| [3] |

徐磊, 谭晔, 刘向东. 水稻冠层反射光谱监测褐飞虱种群密度及水稻穗粒质量的可能性[J]. 南京农业大学学报, 2016, 39(6): 954-959. Xu L, Tan Y, Liu X D. Possibility of monitoring population density of brown planthoppers and grain weight of rice using spectral reflectance from rice canopy[J]. Journal of Nanjing Agricultural University, 2016, 39(6): 954-959 (in Chinese with English abstract). DOI:10.7685/jnau.201601046 |

| [4] |

张智, 张云慧, 姜玉英, 等. 雷达昆虫学研究进展及应用前景[J]. 植物保护, 2017, 43(5): 18-26. Zhang Z, Zhang Y H, Jiang Y Y, et al. Development of radar entomological and related prospects for future application[J]. Plant Protection, 2017, 43(5): 18-26 (in Chinese with English abstract). DOI:10.3969/j.issn.0529-1542.2017.05.003 |

| [5] |

祁骁杰, 卜宇飞, 许志春, 等. 杨树木段内光肩星天牛幼虫数量的声学检测[J]. 环境昆虫学报, 2016, 38(3): 529-534. Qi X J, Bu Y F, Xu Z C, et al. Using acoustic technology detect the different numbers of Anoplophora glabripennis larvae in poplar[J]. Journal of Environmental Entomology, 2016, 38(3): 529-534 (in Chinese with English abstract). |

| [6] |

潘鹏亮, 张方梅, 尹健, 等. 菊方翅网蝽雌雄成虫图像识别技术的初步研究[J]. 植物保护, 2017, 43(3): 70-75. Pan P L, Zhang F M, Yin J, et al. Preliminary studies on image recognition technology for female and male adults of Corythucha marmorata(Uhler)(Hemiptera:Tingidae)[J]. Plant Protection, 2017, 43(3): 70-75 (in Chinese with English abstract). DOI:10.3969/j.issn.0529-1542.2017.03.012 |

| [7] |

Yu H M, Wang J L, Kang R, et al. Automatic identification of Asian rice plant-hopper based on image processing[J]. Applied Engineering in Agriculture, 2017, 33(5): 591-602. DOI:10.13031/aea.11605 |

| [8] |

刘德营, 王家亮, 林相泽, 等. 基于卷积神经网络的白背飞虱识别方法[J]. 农业机械学报, 2018, 49(5): 51-56. Liu D Y, Wang J L, Lin X Z, et al. Automatic identification method for Sogatella furcifera based on convolutional neural network[J]. Transactions of the Chinese Society for Agricultural Machinery, 2018, 49(5): 51-56 (in Chinese with English abstract). |

| [9] |

谢堂胜, 刘德营, 陈京, 等. 白背飞虱智能识别技术研究[J]. 南京农业大学学报, 2016, 39(3): 519-526. Xie T S, Liu D Y, Chen J, et al. Automatic identification of Sogatella furcifera[J]. Journal of Nanjing Agricultural University, 2016, 39(3): 519-526 (in Chinese with English abstract). DOI:10.7685/jnau.201508026 |

| [10] |

Mala C, Sridevi M. Multilevel threshold selection for image segmentation using soft computing techniques[J]. Soft Computing, 2016, 20: 1793-1810. DOI:10.1007/s00500-015-1677-6 |

| [11] |

Treece G. The bitonic filter:linear filtering in an edge-preserving morphological framework[J]. IEEE Transactions on Image Processing, 2016, 25(11): 5199-5211. DOI:10.1109/TIP.2016.2605302 |

| [12] |

岳安志, 杨建宇, 张超, 等. 基于多尺度形态学滤波的高分辨率遥感影像分割[J]. 农业工程学报, 2013, 29(增刊1): 89-95. Yue A Z, Yang J Y, Zhang C, et al. Multi-scale morphological filter for image segmentation of very high resolution satellite imagery[J]. Transactions of the Chinese Society of Agricultural Engineering, 2013, 29(Suppl 1): 89-95 (in Chinese with English abstract). |

| [13] |

Medeiros H, Holguín G, Shin P J, et al. A parallel histogram-based particle filter for object tracking on SIMD-based smart cameras[J]. Computer Vision & Image Understanding, 2010, 114(11): 1264-1272. |

| [14] |

Andalo F A, Miranda P A V, da Torres S. Shape feature extraction and description based on tensor scale[J]. Pattern Recognition, 2010, 43(1): 26-36. |

| [15] |

Martineau M, Conte D, Raveaux R, et al. A survey on image-based insect classification[J]. Pattern Recognition, 2017, 65: 273-284. DOI:10.1016/j.patcog.2016.12.020 |

| [16] |

Chen W T, Liu W C, Chen M S. Adaptive color feature extraction based on image color distributions[J]. IEEE Transactions on Image Processing, 2010, 19(8): 2005-2016. DOI:10.1109/TIP.2010.2051753 |

| [17] |

Mohanaiah P, Sathyanarayana P, Gurukumar L. Image texture feature extraction using GLCM approach[J]. International Journal of Scientific and Research Publications, 2013, 3(5): 1-5. |

| [18] |

Hubara I, Courbariaux M, Soudry D, et al. Quantized neural networks:training neural networks with low precision weights and activations[J]. Journal of Machine Learning Research, 2017, 18: 1-30. |

| [19] |

秦立峰, 何东健, 宋怀波. 词袋特征PCA多子空间自适应融合的黄瓜病害识别[J]. 农业工程学报, 2018, 34(8): 200-205. Qin L F, He D J, Song H B. Bag of words feature multi-PCA subspace adaptive fusion for cucumber diseases identification[J]. Transactions of the Chinese Society of Agricultural Engineering, 2018, 34(8): 200-205 (in Chinese with English abstract). |

| [20] |

Kemal P, Salih G. A new feature selection method on classification of medical datasets:kernel F-score feature selection[J]. Expert Systems with Applications, 2009, 36: 10367-10373. DOI:10.1016/j.eswa.2009.01.041 |

| [21] |

Hu S C, Zhu C, Xie F L, et al. A recommendation algorithm for two-sided matching problems based on F-Score[C]//IEEE International Conference on Computer and Communications, 2016: 25-29.

|