船舶在海上航行作业,在进行导航需要考虑的因素很多,如海域、天气、水深、周边目标态势等。随着船舶智能化的提升,基于船舶自动识别系统(AIS)、导航雷达、电子海图的传统导航方式只能通过二维视角,以图像和文本等形式展现导航和碍航物信息,需要船员瞭望窗外结合实景进行综合研判。特别是在雨雾天气低能见度、夜晚低照度视野受限场景和繁忙水域、狭水道等复杂环境场景,传统导航方式逐渐无法满足当前智能化船舶和航运的需求。增强现实技术提供了一种全新的导航方式,通过构建三维场景并在真实场景叠加显示周边目标态势、海域情况和航行计划,使船舶操控更加便捷、高效,适应智能化船舶的发展。

辅助导航系统主要支持包括全方位实时的周围碍航物信息、导航信息包括艏向罗盘和航线、地理环境信息的3种类型信息同时显示[1-3]。Hong[4]提出了将地图和雷达信息叠加到单目摄像头图像上的增强现实导航方法,实现了前后双视角的增强。孙晓雪等[5]提出了一种利用虚拟现实技术显示船舶周边相对于本船航行的危险关系的方法,虚拟现实方法丢失了真实场景细节。Templin等[6]提出适用于内河水域的AR、VR辅助导航方法,该方法缺少辅助导航信息。Liu等[7]使用AR技术将视觉和AIS识别结果进行图像增强叠加,单传感器对小目标的探测能力较弱。Aaron等[8]研究了使用穿戴设备解决船舶增强视觉现实问题,但穿戴设备与船员日常习惯差异过大。

本文针对航行避碰和离靠泊典型场景,利用AIS、导航雷达、激光雷达、光电跟踪仪等传感器,基于机器人操作系统(ROS)设计了一种船舶辅助导航系统。借助安全等深线等地理信息知识库,通过模糊多因素关联匹配各传感器实时感知信息,利用交互式多模型预测本船和目标轨迹进行危险评估。构建坐标变换树利用增强现实技术全方位展现船舶航行环境、周边态势、航行计划和碰撞风险信息,实现辅助导航和辅助靠离泊。为智能化遥控和自主船舶辅助导航系统设计奠定技术基础。

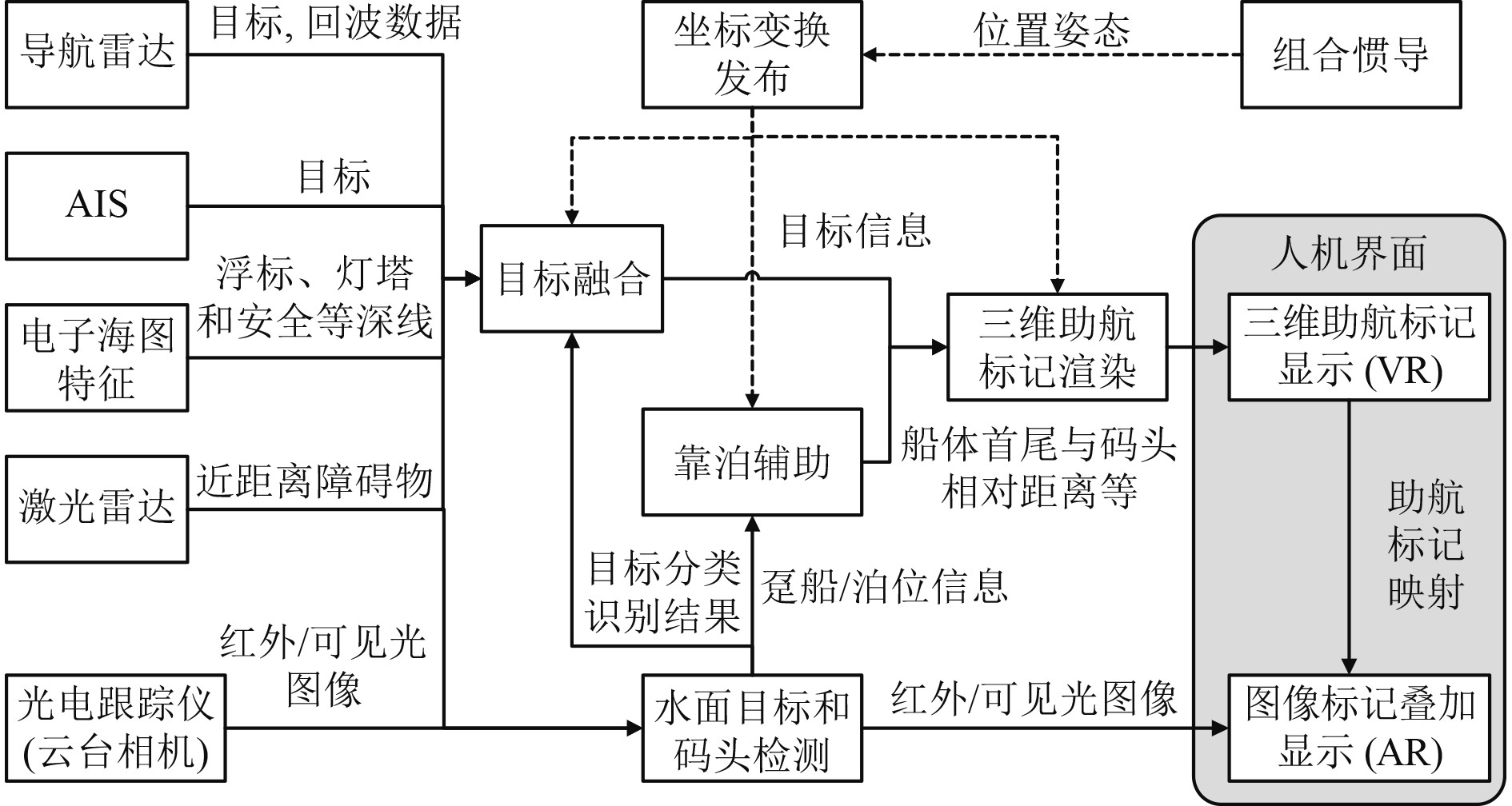

1 系统设计 1.1 架构设计增强现实辅助导航系统通过收集本船导航信息和本船周围动静态障碍物融合处理,实现导航、目标态势和预测信息可视化。在航渡过程中,通过多传感器融合探测目标并根据本船航速航向变化预测本船和目标轨迹并计算航行碰撞危险度给出碰撞预警,辅助船员结合碰撞风险和避碰效能进行避碰决策。在离靠泊时,通过激光雷达和前后光电摄像机探测并实现船舶离岸距离可视化,辅助靠离泊观察操控。增强现实辅助导航系统整体架构如图1所示。

|

图 1 系统架构图 Fig. 1 Structure of system framework |

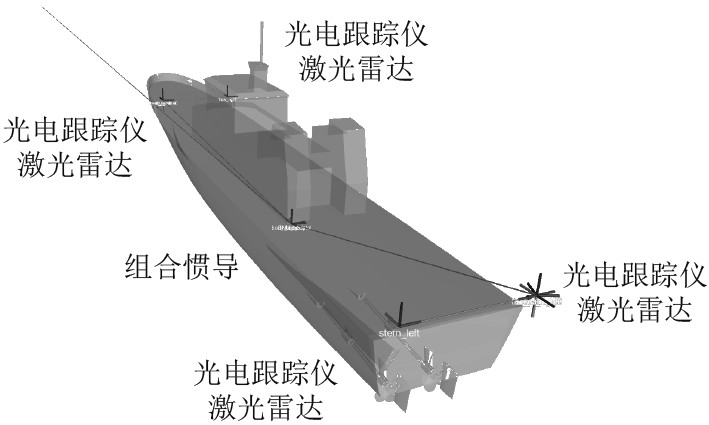

在船舶载体平台部署组合导航系统、AIS、导航雷达、根据载体平台大小部署多个激光雷达和光电跟踪仪,本方案中激光雷达与光电跟踪仪部署于左右舷前后4个位置。所有传感器均固定连接在船体上。

软件基于开源的ROS框架,包括传感器数据处理模块、目标融合及预测模块、辅助靠离泊模块与信息显示界面模块。其中,传感器数据处理模块包括导航雷达和AIS可直接接收目标信息,电子海图通过提取进行目标提取。显示模块包括空间坐标系变换节点与AR助航信息渲染显示节点。在OGRE开源三维渲染引擎库上开发的标准C++组件库,采用类接口的开发模式分离感知算法逻辑和三维渲染模块,通过三维标绘系统进行可视化的生成管理以及事件响应机制,并利用三维引擎进行显示交互实现实时态势生成并提供辅助导航。

2 系统关键技术 2.1 坐标树建立及转换三维场景构建通常需要维护多个随时间变化的坐标系。本船导航定位系统获取的位置信息和AIS提供的目标信息为WGS84世界坐标系下的经纬度信息;航海雷达、激光雷达等传感器为以传感器位置为原点的三维笛卡尔坐标系,光电跟踪系统云台为球坐标系,可见光摄像机和红外热像仪为图像像素坐标系。主要坐标系定义如表1所示。

|

|

表 1 坐标树主要坐标系列表 Tab.1 Main coordinate system in coordinate tree |

其中,东北天坐标原点为根据100 km为边长的经纬度网格,取船舶当前所在栅格中心点为原点进行大圆计算得出。所有传感器任意两者之间的空间变换矩阵可通过物理安装参数或联合标定获得,将传感器转换为组合导航载体坐标系下。载体坐标系根据船舶上GPS天线位置为原点构建船舶固定坐标系O,船首方向为Y轴,右舷方向为X轴,垂直甲板向上为Z轴。光电系统相机像素坐标系与光电云台坐标系标定采用针孔模型为相机模型,根据张氏标定法获得光电摄像机的内参,根据安装光电云台相对于北斗天线的位置计算光电外参的平移矩阵,根据组合导航观测本船的横揺角、纵摇角、首向角获得光电云台外参的基础旋转矩阵。

在对图像数据进行增强现实虚拟符号叠加显示前,首先根据所述径向畸变修正参数

| $ {{\boldsymbol{K}}_{\boldsymbol{i}} = \left[ {\begin{array}{*{20}{c}} {2{f_x}/w}&0&{(w - 2{c_x})/w}&0 \\ 0&{ - 2{f_y}/h}&{(h - 2{c_y})/h}&0 \\ 0&0&{( - {Z_f} - {Z_n})/({Z_f} - {Z_n})}&{ - 2{Z_f}{Z_n}({Z_f} - {Z_n})} \\ 0&0&{ - 1}&0 \end{array}} \right] }。$ | (1) |

通过渲染投影矩阵,结合通过坐标树发布的旋转矩阵

| $ {{\boldsymbol{K}}_{\boldsymbol{e}}} = \left[ {\begin{array}{*{20}{c}} {{{\boldsymbol{R}}_{{\mathbf{3}} \times {\mathbf{3}}}}}&{{{\boldsymbol{T}}_{{\mathbf{3}} \times {\mathbf{1}}}}} \\ {{{\mathbf{0}}_{{\mathbf{3}} \times {\mathbf{3}}}}}&1 \end{array}} \right]。$ | (2) |

可获得东北天坐标

| $ {\left[ {\begin{array}{*{20}{c}} {{p_x}}&{{p_y}}&1 \end{array}} \right]^{\rm T}} = \frac{1}{{{z_c}}}{{\boldsymbol{K}}_{\boldsymbol{i}}}{{\boldsymbol{K}}_{\boldsymbol{e}}}{\left[ {\begin{array}{*{20}{c}} x&y&z&1 \end{array}} \right]^{\rm T}}。$ | (3) |

式中:

通过在ROS中建立坐标变换(TF)发布节点[9]发布坐标系变换矩阵,实现异构多传感器数据的空间同步。

2.2 避碰预警在航行避碰对动静态目标处理过程中,采用对单传感器探测结果的决策级融合方法,动态融合目标流程如下:每当传感器感知更新目标的最新观测信息后,根据障碍物信息与电子海图水面静态物标信息通过相对本船距离、方位、航向、航速计算每次感知信息与融合目标的欧式距离,建立模糊多因素集和评判矩阵。

| $ {\boldsymbol{R}} = {\left[ {\begin{array}{*{20}{c}} {{r_d}(k)}&{{r_{\theta}}(k)}&{{r_{cog}}(k)}&{{r_{sog}}(k)} \end{array}} \right]^{\rm T}} 。$ | (4) |

式中,

| $ r(k) = exp( - {\tau _q}(u_q^2(k)/\sigma _q^2))。$ | (5) |

根据关联矩阵

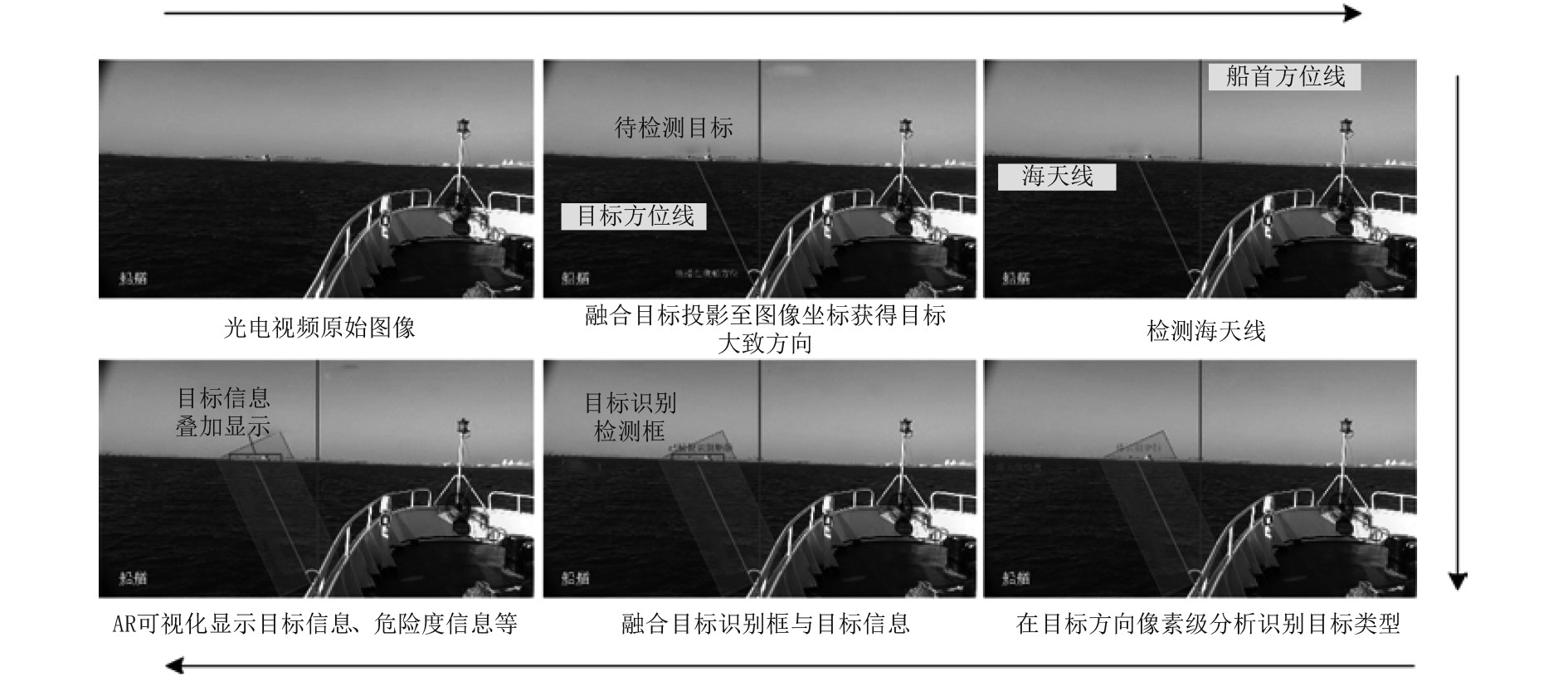

由于图像缺少距离维度信息,只能获得船舶在图像中的像素范围。通过检测海天线将该船舶图像分割并将经YOLO算法得出的图像识别目标像素范围与融合目标在经坐标转换后的像素包围框基于重合度(IOU)匹配关联,获得光电图像与融合目标的关联匹配信息。坐标变换与关联匹配流程图如图2所示。

|

图 2 视频识别信息与目标信息融合示意图 Fig. 2 A diagram detailing the video detection and target fusion |

准确的船舶碰撞危险预警是保障船舶安全航行和有效避让的前提。通过计算碰撞危险度(CRI)进行避碰预警。碰撞危险度是以来船的初始会遇距离(DCPA)、初始最近会遇点(CPA)的方位、安全通过距离和最低安全会遇距离,基于模糊数学的评价方法,为主要指标确定的两船发生碰撞可能性大小的度量。当目标CRI达到了设定的阈值

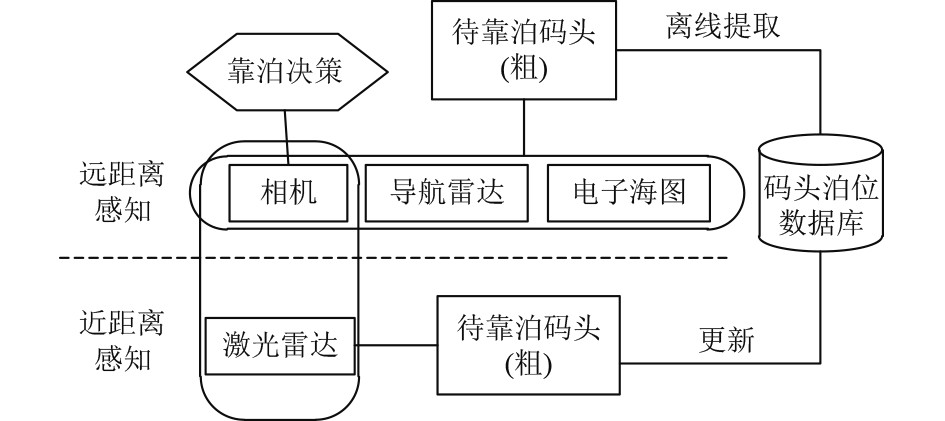

自动离靠泊关键是对泊位和本船相对位置和朝向的精确探测。在船舶离岸较远距离时,根据S57格式电子海图提取港区码头海岸构造物线(SLCON-L)和海岸构造物面(SLCON-A)物标信息,根据泊位线长度初步划分可能的码头范围。

在近距离时,通过相机和激光雷达的融合检测算法分为激光雷达与相机联合标定、图像检测、点云检测和数据融合4个部分。通过2种传感器空间姿态变换信息结合最近点迭代(ICP)点云配准将激光雷达与相机传感器联合标定。在点云对应码头区域激光雷达点云做鸟瞰投影,并对投影后降维的点云做随机采样一致(RANSAC)拟合,将拟合直线与海图提取的障碍物线进行关联匹配,获取更精确的码头泊位线位置和朝向。根据本船位置和艏向信息,计算船体侧弦船首船尾离岸距离。根据计算结果在载体坐标系下,绘制泊位参考线和船岸距离参考线,实现辅助靠泊感知。靠离泊辅助码头检测算法流程如图3所示。

|

图 3 靠离泊辅助码头检测算法示意图 Fig. 3 A diagram detailing the wharf detection algorithm for berthing aid |

增强现实叠加现实分为虚拟现实三维场景构建,虚拟现实场景物标至相机视角的坐标转换投影,相机图像三维图像显示3个步骤。

航行态势增强现实显示主要包括目标态势显示、航行环境数据显示、助航信息显示等。目标态势通过在三维场景中按照实际位置绘制三维模型。对于目标船数据以AIS或激光雷达提取的长宽信息,在三维场景中以1:1比例显示,同时显示目标的速度矢量线和目标的船舶领域。对于静态的浮标、小型灯塔采用较大缩放比例,使目标显示更直观;航行环境数据显示根据电子海图数据中安全等深线和航道区域物标进行建模,通过多边形形式显示航道信息和可航行水域;助航信息的显示,包括本船周边的距离圆和航速航向航线等,通过线段在虚拟现实场景中展现。

在完成虚拟现实场景重建后,通过设置包括最小可见距离、最大可见距离等数据源参数,通过2.1节构建的坐标树将虚拟现实三维物标和场景在摄像头像素坐标进行叠加绘制,进行增强现实显示。

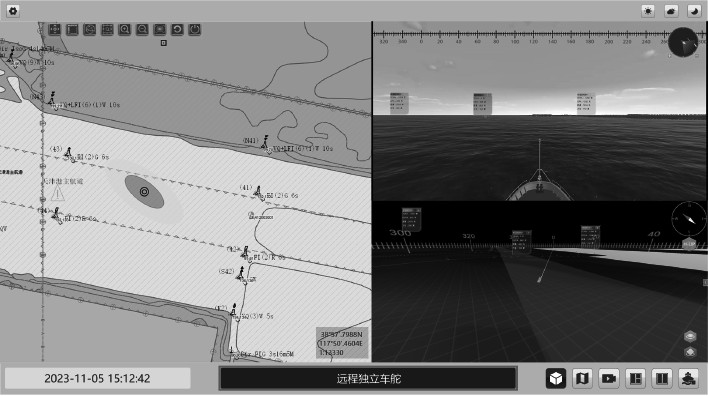

增强现实辅助导航软件通过上述数据可以支持海图态势、三维重构态势、增强现实态势等显示方式进行切换,支持避碰预警、靠泊辅助等应用场景,支持3种功能分屏显示,软件界面设计如图4所示。

|

图 4 增强现实辅助导航系统软件界面示意图 Fig. 4 A diagram detailing the user interface of AR decision aid system |

以双桨欠驱动船靠泊为例,在天津东疆港进行实船验证,试验在良好天气,三级海况下完成。船端传感器包括:电子海图、组合惯导、连续波雷达、光电跟踪仪、固态激光雷达等。激光雷达和光电跟踪仪布放在船艏左右舷和船艉左右舷,传感器部署位置和坐标系如图5所示。

|

图 5 试验用传感器部署示意图 Fig. 5 A diagram detailing the sensor deployed on vessel |

通过可展开的标签对船舶和浮标等碍航物信息在虚拟现实界面和船舶模型进行跟随标识,颜色跟随计算的风险值变化,直观显示在增强现实态势和场景中,如图6所示。

|

图 6 避碰预警增强现实显示实船验证结果 Fig. 6 The result of collision warning alarm AR display test on real vessel |

实验过程中,增强现实场景可以真实呈现包括陆地、航道、浮标等的船舶航行场景和包括艏向、航速、航向等本船运动状态,包括规划航路、航路点在内的任务规划信息。通过鼠标切换视角可以从不同视角和比例尺观测周边态势信息;界面运动流畅,交互响应时长低于0.05 s,基本可实现本地和岸基远程辅助导航支持功能。

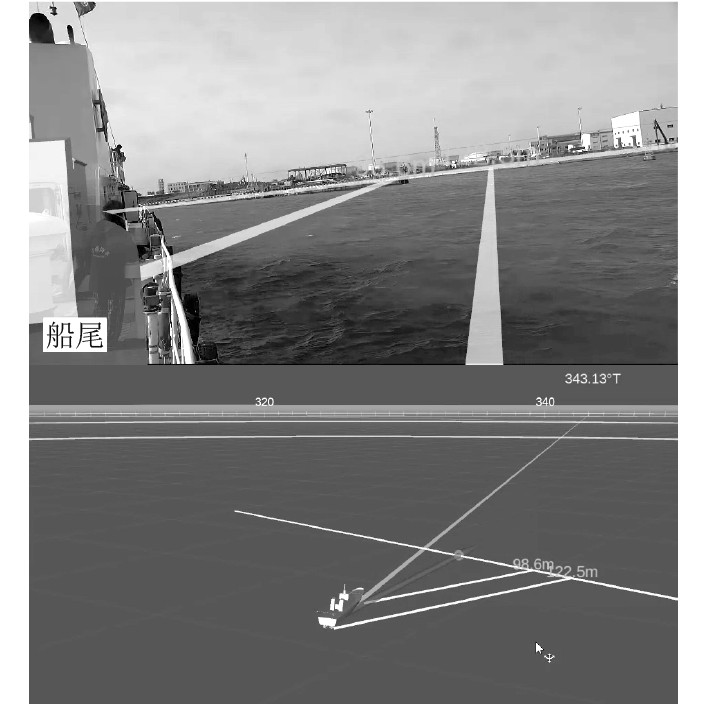

以误差差分北斗为基准,测试增强现实辅助导航系统在辅助靠泊时对船侧舷和泊位线的距离测量精度。在本船与泊位距离200 m以内时,通过异构多传感器融合,本系统可以给出精度小于0.1 m的船首和船艉离岸距离,如图7所示。

|

图 7 辅助靠泊增强现实和虚拟现实实船验证结果 Fig. 7 The result of assisted berthing AR & VR display test on real vessel |

基于增强现实的船舶辅助导航系统,以VR、AR虚实结合的多种手段,全方位、多角度地构建了船舶航行的态势、目标态势和任务信息,分级显示了不同威胁度的目标并显著标识了靠泊辅助信息。本系统可应用于对有人船舶,进行包括避碰预警和辅助靠泊的辅助导航,可有效降低船员的认知负荷,也可通过移动通信网络和卫通数据传输,应用于岸基远程监控船舶航行情况并提供辅助驾驶决策。本系统对船舶辅助驾驶和自主船舶的发展有重要参考意义。

| [1] |

LAERA F, FIORENTINO M. et al. Augmented reality for maritime navigation data visualisation: a systematic review, issues and perspectives[J]. The Journal of Navigation, 2021, 74(5): 1073-1090. DOI:10.1017/S0373463321000412 |

| [2] |

任群. 船舶智能导航系统界面的交互设计研究[J]. 舰船科学技术, 2022, 44(8): 135-138. REN Qun. Research on interactive design of ship intelligent navigation system interface[J]. Ship Science and Technology, 2022, 44(8): 135-138. DOI:10.3404/j.issn.1672-7649.2022.08.028 |

| [3] |

吴蔷薇, 曲蕾. 船舶增强现实导航系统中计算机视觉技术的应用[J]. 舰船科学技术, 2023, 45(11): 135-138. WU Qiangwei, QU Lei. Application of computer vision technology in ship augmented reality navigation system[J]. Ship Science and Technology, 2023, 45(11): 135-138. |

| [4] |

HONG T C, ANDREW H S Y, KENNY C W L. Assessing the situation awareness of operators using maritime augmented reality system (MARS)[C]//Proceedings of the Human Factors and Ergonomics Society, Groningen, the Netherlands, 2015: 1722–1726.

|

| [5] |

孙晓雪, 王胜正, 殷非, 等. 智能船舶远程辅助驾驶3D场景构建关键技术研究[J]. 中国舰船研究, 2020, 15(S1): 173–179. SUN Xiaoxue, WANG Shengzheng, YIN Fei, et al. Key technologies of 3D scene construction for remote assisted driving of intelligent ships[J]. Chinese Journal of Ship Research, 2020, 15(S1): 173–179. |

| [6] |

TEMPLIN T, POPIELARCZYK D, GRYSZKO M. Using augmented and virtual reality (AR/VR) to support safe navigation on inland and coastal water zones[J]. Remote Sensing, 2022, 14. 1–23.

|

| [7] |

LIU W, GUO Y, NIE J, et al. Intelligent edge-enabled efficient multi-source data fusion for autonomous surface vehicles in maritime internet of things[C]//IEEE Transactions on Green Communications and Networking. New York: IEEE Press, 2022, 6: 1574–1587.

|

| [8] |

AARON R, MARTHA G, JEAN-PHILIPPE R, et al. Impacts of wearable augmented reality displays on operator performance, situation awareness, and communication in safety-critical systems[J]. Applied Ergonomics, 2019, 80: 17-27. DOI:10.1016/j.apergo.2019.04.013 |

| [9] |

FOOTE T. TF: The transform library[C]// IEEE Conference on Technologies for Practical Robot Applications (TePRA). New York: IEEE Press , 2013: 1−6.

|

2024, Vol. 46

2024, Vol. 46