船舶在复杂的海洋环境中移动时,移动路径受到多种因素的影响,这些因素使得船舶的移动轨迹变得复杂多变,难以用简单的二维平面信息来描述。船舶在航行过程中需要实时感知周围的环境,因此研究船舶移动路径三维动态场景重建方法具有重要的理论价值和实践意义[1]。

国内外相关领域学者对于三维场景重建方法进行了大量研究。Karami等[2]提出基于光定向性的三维场景重建方法,该方法实际应用过程中,动态场景中的物体移动和光源变化会给重建带来额外的挑战,可能导致重建误差。李翔宇等[3]提出基于ORBTSDF-SCNet的三维场景重建方法,该方法实际应用过程中ORB特征点检测对图像纹理丰富程度敏感,纹理贫乏的场景可能导致特征点不足,影响重建质量。江瑞祥等[4]提出基于多尺度聚焦网络的三维场景重建方法,该方法实际应用过程中高度依赖于输入数据的质量和数量。如果输入图像存在噪声、模糊或视角不足等问题,将直接影响重建结果的准确性和完整性。许少秋等[5]提出基于大场景三维点云的三维场景重建方法,该方法中将多个视角的点云数据进行精确配准是一个挑战,特别是对于大规模场景。

针对当前方法存在一些不足,提出船舶移动路径三维动态场景重建方法,为船舶的航行安全和任务执行提供有力支持。

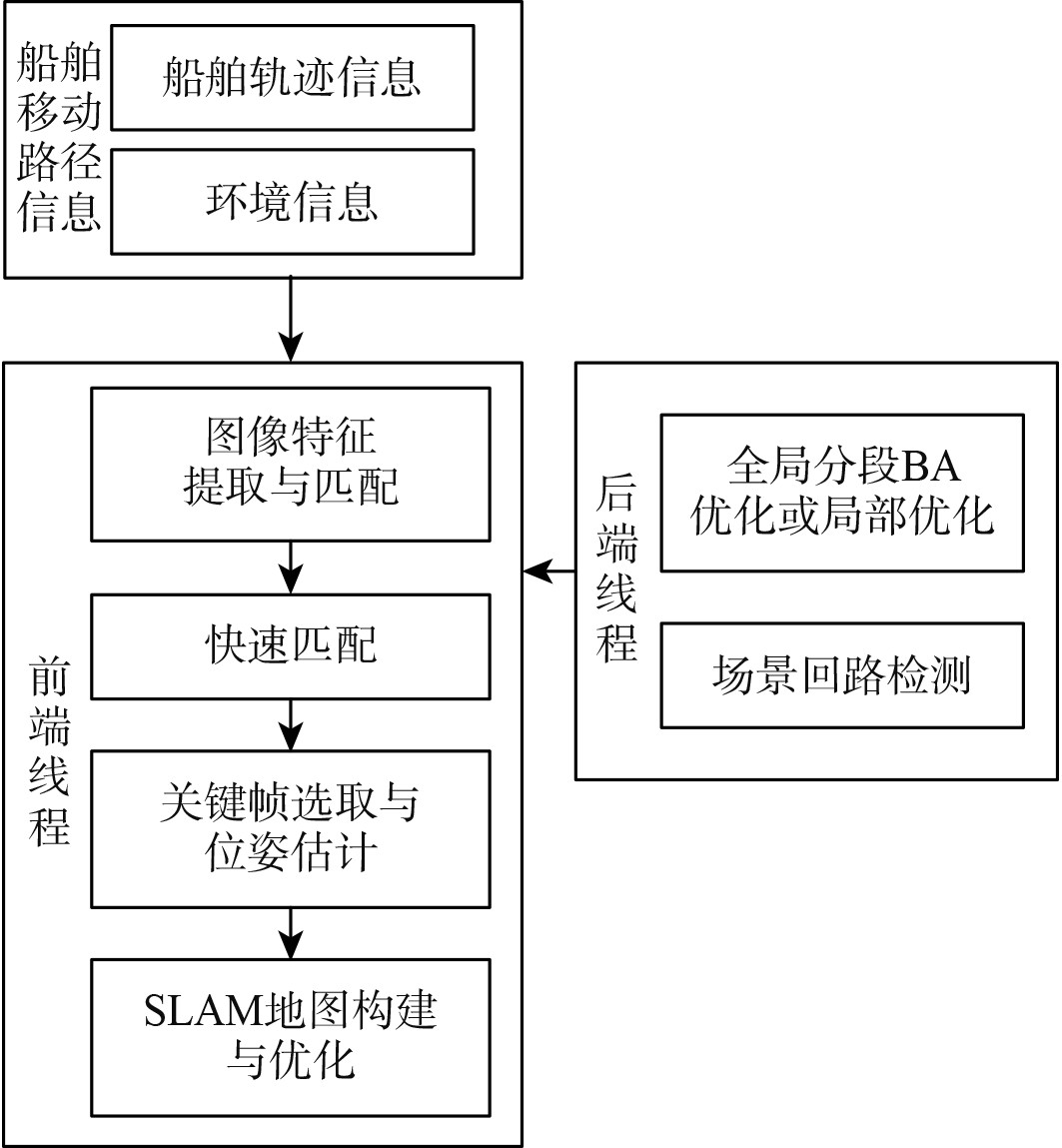

1 船舶移动路径三维动态场景重建方法 1.1 基于V-SLAM的三维动态场景重建流程基于V-SLAM(基于视觉的同时定位和映射)的船舶移动路径三维动态场景重建过程主要包括前端线程与后端线程2个部分,如图1所示。前端线程的工作内容为利用雷达或相机等视觉传感器获取船舶航行过程中的路径信息,其中包括轨迹信息与环境信息。所采集的船舶移动路径信息传输至SLAM系统内实施初始化处理,令SLAM系统处于跟踪状态,由此输出相机位姿与场景点云信息,以此为基础,构建SLAM地图并进行优化。船舶移动路径信息采集过程中有一定概率出现位姿偏移问题,同时在场景切换过程中也有一定概率产生尺度偏移现象,由此造成误差累计问题产生,若误差累积达到相应值后将造成场景重建过程终止。因此后端线程的工作内容主要为优化,基于场景回路检测纠正相机运行过程中形成的漂移问题,通过局部或全局优化抑制误差累积问题。

|

图 1 基于V-SLAM的船舶移动路径三维动态场景重建过程 Fig. 1 3D dynamic scene reconstruction process of ship movement path based on V-SLAM |

前端线程是船舶移动路径三维动态场景重建过程的核心,因此在后续研究过程中主要对前端线程进行深度研究。

1.2.1 船舶移动路径图像特征提取与匹配船舶航行过程中,相机等视觉传感器在未知环境下,通过连续获取船舶移动路径图像实现周边环境感知,并以此为基础构建三维稀疏点云场景构建。以获取准确的相机路径与场景感知结果为目的,需采用基于ORB特征提取的算法对大量船舶移动路径图像实施连续帧间的特征点匹配[6]。ORB特征提取算法由FAST关键点检测算法和BRIEF描述子计算两部分组成。

1)FAST关键点检测。以

| $ {S _{px}} = \left\{ \begin{gathered} d,{I_{px}} \leqslant {I_p} - t ,\\ s,{I_p} - t \leqslant {I_{px}} + t,\\ b,{I_{px}} \geqslant {I_p} + t 。\\ \end{gathered} \right. $ | (1) |

式中:

考虑FAST关键点不具备方向性,ORB算法计算图像块

| $ {m_{pq}} = \sum\limits_{x,y \in B} {{x^p}{y^q}} I\left( {x,y} \right) 。$ | (2) |

式中:

| $ C = \left( {\frac{{{m_{10}}}}{{{m_{00}}}},\frac{{{m_{01}}}}{{{m_{00}}}}} \right) ,$ | (3) |

| $ \theta = {\rm arc}\tan \left( {{m_{01}},{m_{10}}} \right) 。$ | (4) |

式中:

2)BRIEF描述子计算。利用二进制字符串编码描述关键点。通过生成BRIEF查询表与训练集构建进行二值编码,基于关键点与均值0.5的距离生成向量T,利用贪婪搜索算法选取具备较高鲁棒性的BRIEF描述子,由此提升船舶移动路径图像特征点的旋转固定性。在确定船舶移动路径图像特征点后,通过汉明距离对不同位姿条件下的船舶移动路径图像实施特征点匹配,构建不同位姿下船舶移动路径图像信息关联,在此基础上实现后续的姿态估计与位姿优化。船舶移动路径图像

| $ {d_h}\left( {\gamma ,\lambda } \right) = \sum\limits_{i = 1}^n {\sum\limits_{j = 1}^m {\left[ {{D_\gamma }\left( {{p_i}} \right) \otimes {D_\lambda }( {{p_j}} )} \right]} } 。$ | (5) |

式中:

完成相邻船舶移动路径图像特征匹配后,利用3D-2D点估计法对相机位姿进行估计。作为3D-2D点估计法的求解算法,PnP(对极几何)针对已知的相邻两帧船舶移动路径图像

| $ \forall i,{D_A}\left( {{p_i}} \right) = R{D_\lambda }\left( {{p_j}} \right) + t 。$ | (6) |

式中:

在SLAM运行过程中,若船舶移动路径图像位移达到一定值后,即可设定一个关键帧,采用基于特征相关性筛选的关键帧选取机制获取全部关键帧,通过关键帧的点云拼接能够实现船舶移动路径三维动态场景重建。船舶移动路径图像关键帧点云图拼接以点云变换为基础,利用式(7)描述变换矩阵

| $ {\boldsymbol{T}} = \left[ \begin{gathered} {R_{3 \times 3}}\mathop {}\nolimits_{} {t_{3 \times 1}} \\ {{\boldsymbol{O}}_{1 \times 3}}\mathop {}\nolimits_{} 1 \\ \end{gathered} \right] \in {R^{4 \times 4}} 。$ | (7) |

式中:

以

| $ \left[ \begin{gathered} {y_1} \\ {y_2} \\ {y_3} \\ 1 \\ \end{gathered} \right] = T \cdot \left[ \begin{gathered} {x_1} \\ {x_2} \\ {x_3} \\ 1 \\ \end{gathered} \right] 。$ | (8) |

点云图实际应用过程中数据量较大,且较为稀疏,在实际船舶移动路径三维动态场景重建过程中需消耗大量存储资源,且无法应用于导航与路径规划问题中。3D Octo Map可直观地反映场景内的占用与空闲,有利于船舶导航与路径规划。因此船舶移动路径图像关键帧点云图变换后,需采用3D栅格化处理方法将点云图准换位3D Octo Map地图,最终实现船舶移动路径三维动态场景重建。

2 仿真实验本文研究船舶移动路径三维动态场景重建方法,为验证本文方法在实际动态场景重建中的应用效果,选取某型号船舶为研究对象,在免费开源的Meshroom软件中进行仿真实验。

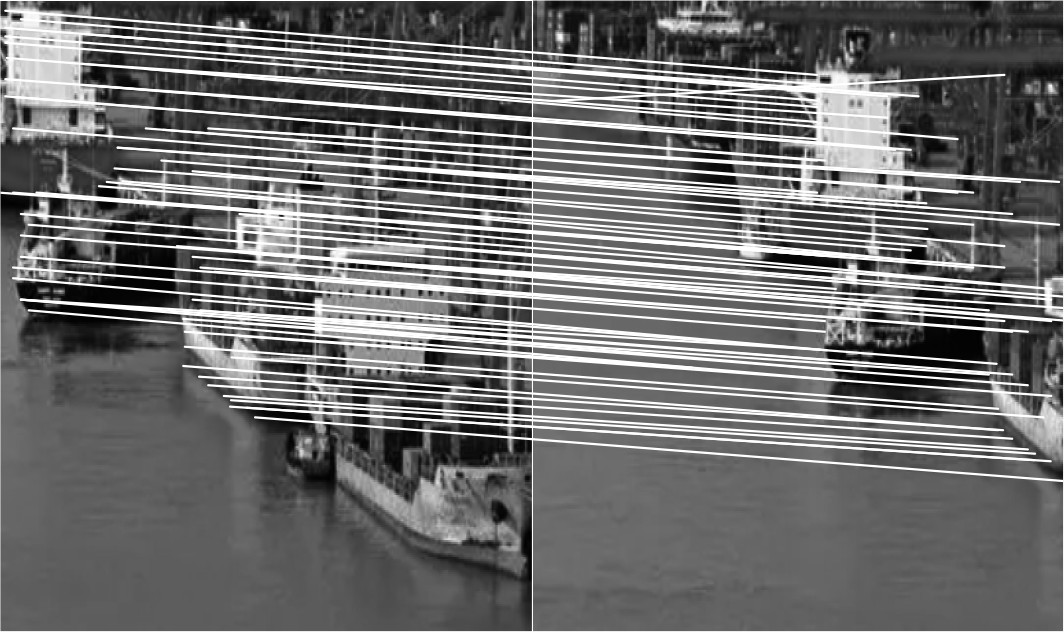

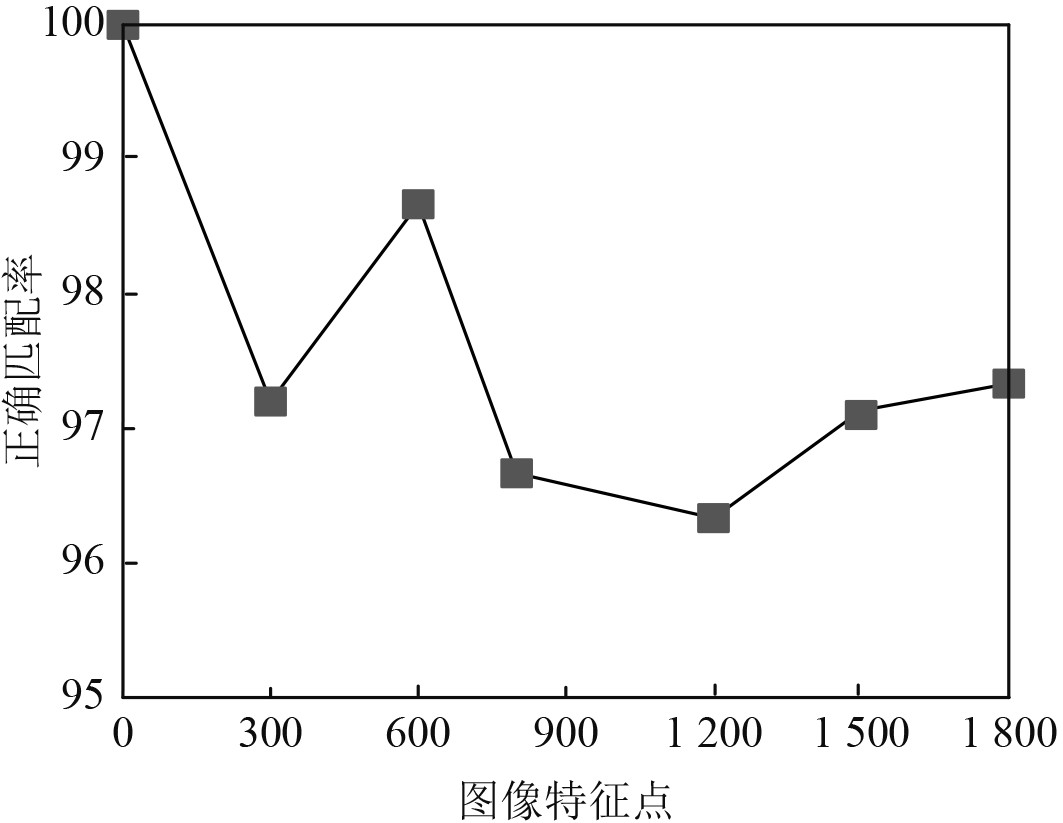

2.1 图像特征点匹配仿真特征点匹配是船舶移动路径三维动态场景重建的基础,为验证本文方法图像特征点匹配的质量,在研究对象移动环境图像集合中,随机选取2幅相邻帧图像,采用本文方法提取其ORB特征点,并计算关键点与描述子,获取特征点匹配结果,如图2所示。统计本文方法特征点匹配过程中,特征点正确匹配率,结果如图3所示。分析可知,采用本文方法进行特征点匹配,随着特征点数量的提升,匹配准确率整体表现出下降的趋势。但当图像特征点达到

|

图 2 本文方法特征点匹配结果 Fig. 2 feature point matching results of this article's method |

|

图 3 本文方法特征点正确匹配率 Fig. 3 Correct matching rate of feature points in this article's method |

在研究对象移动环境图像集合选取结构复杂度有所差异的图像,采用本文方法进行三维场景重建。选取均方误差和结构相似性评估本文方法的重建性能,结果如表1所示。分析可知,在研究对象移动环境图像内目标结构复杂度逐渐提升的条件下,本文方法三维场景重建结果的均方误差呈现逐渐提升的趋势,但始终未高于0.2;而本文方法三维场景重建结果的结构相似性呈现出逐渐下降的趋势,但始终高于95%。以上结果充分表明本文方法在三维场景重建应用过程中具有较好的应用效果。

|

|

表 1 本文方法三维场景重建性能 Tab.1 The performance of the method for 3D scene reconstruction in this article |

在研究对象移动环境图像集合内选取5幅图像,图像分辨率均为960×540,采用本文方法、文献[2]中基于光定向性的三维场景重建方法和文献[3]中基于ORBTSDF-SCNet的三维场景重建方法分别进行三维重建,对比3种方法重建后图像分辨率,结果如表2所示。分析表2得到,本文方法重建后的图像分辨率均达到

|

|

表 2 不同方法图像重建的分辨率对比结果 Tab.2 Comparison of resolution results of image reconstruction using different methods |

本研究旨在提出基于深度学习技术的船舶移动路径三维动态场景重建方法,该方法能够实现对船舶移动轨迹的全面、准确描述以及对周围环境的实时感知,为船舶的航行安全和任务执行提供有力支持。同时,该研究还具有重要的理论价值和实践意义,为三维动态场景重建技术的发展和应用提供了新的思路和方法。

| [1] |

孙凌宇, 秦红亮, 师瑞卓, 等. 基于激光雷达的移动剖面式三维形貌重建方法研究[J]. 应用激光, 2023, 43(10): 136-147. SUN Lingyu, QIN Hongliang, SHI Ruizhuo, et al. Research on moving profile 3D shape reconstruction method based on lidar[J]. Applied Laser, 2023, 43(10): 136-147. |

| [2] |

KARAMI A , MENNA F , REMONDINO F , et al. Exploiting light directionality for image-based 3D reconstruction of non-collaborative surfaces[J]. Photogrammetric Record, 2022, 37(5): 111−138.

|

| [3] |

李翔宇, 张雪芹. ORBTSDF-SCNet: 一种动态场景在线三维重建方法[J]. 华东理工大学学报(自然科学版), 2023, 49(2): 284-294. LI Xiangyu, ZHANG Xueqin. ORBTSDF-SCNet: An online 3d reconstruction method for dynamic scene[J]. Journal of East China University of Science and Technology(Natural Science Edition), 2023, 49(2): 284-294. |

| [4] |

江瑞祥, 缪君, 储珺, 等. 基于多尺度聚焦网络的单图像城市场景3D平面重建[J]. 小型微型计算机系统, 2022, 43(8): 1718-1724. JIANG Ruixiang, MIAO Jun, CHU Jun, et al. 3D planar reconstruction of urban scene from single image based on multi-scale focusing network[J]. Journal of Chinese Computer Systems, 2022, 43(8): 1718-1724. |

| [5] |

许少秋, 余扬帆, 郭俊林, 等. 基于大场景三维点云的集装箱船关键绑扎特征识别与重建[J]. 船舶工程, 2022, 44(6): 127-133. XU Shaoqiu, YU Yangfan, GUO Junlin, et al. Identification and reconstruction of key lashing features of container ships based on large scene 3D point cloud[J]. Ship Engineering, 2022, 44(6): 127-133. |

| [6] |

王超, 杨龙, 吴雪峰, 等. 场景目标的稀疏序列融合三维扫描重建[J]. 计算机辅助设计与图形学学报, 2023, 35(6): 819-829. WANG Chao, YANG Long, WU Xuefeng, et al. 3D scanning of scene-level targets based on the sparse sequence fusion[J]. Journal of Computer-Aided Design & Computer Graphics, 2023, 35(6): 819-829. |

2024, Vol. 46

2024, Vol. 46