2. 河南工业大学 人工智能与大数据学院,河南 郑州 450001

2. School of Artificial Intelligence and Big Data, Henan University of Technology, Zhengzhou 450001, China

船舶吃水深度是反映船舶装载状态的关键指标。通过实时监测船舶吃水深度,可以及时了解船舶的载重情况,从而避免超载或轻载航行带来的安全隐患。同时,准确的吃水深度信息还可以为船舶调度和航线规划提供有力支持,有助于提高运输效率,降低运营成本。因此检测船舶吃水深度有助于保障船舶的安全[1]。目前已经有大量学者提出了对船舶吃水深度的检测方法。

陈轩等[2]通过周期性实验验证了水文、自然条件、检测频率与船舶吃水深度数据检测精度的关系,研发了基于复杂水域环境的动态船舶吃水检测系统,实现了船舶吃水深度的自动检测与采集。然而,由于船舶在航行过程中会受到多种因素的影响,如风向、水流等,需要设计出能够准确推演船舶实时位置的算法,以确保吃水深度数据的准确性。佟世琪等[3]提出一种基于超声相控技术的船舶吃水测量方法,通过搭建实验系统验证了该方法的可靠性,实现了船舶吃水深度的精确测量。该研究利用双曲交汇法计算扫描点的空间坐标时,应精确处理多个扫描点的数据。如果数据处理不当或算法存在缺陷,会导致计算出的空间坐标不准确,影响船舶吃水深度的分析。饶本顺等[4]通过Excel结合VBA程序,实现散装谷物专运船在单一谷物装卸过程中的自动配载方案生成,以满足稳性、浮态等要求,从而提高配载工作的效率与准确性。但在填制散装谷物运输稳性计算专用表格时,如果填制错误或遗漏了关键信息,可能会导致后续对船舶吃水深度的分析和评估出现偏差。

通过利用机器视觉技术,可以实现对船舶吃水深度的快速、准确检测,提高检测效率和精度,减少人为因素的干扰。此外,机器视觉技术还可以结合深度学习算法,对船舶吃水深度进行实时动态监测,为船舶的安全航行提供有力保障。因此,提出基于机器视觉技术的船舶吃水深度动态检测。

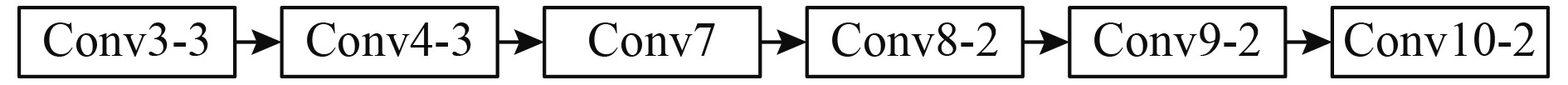

1 船舶特征提取合成孔径雷达(SAR)图像分析属于机器视觉的一种,通过飞行器携带的雷达系统发送和接收无线电波生成船舶在SAR图像上的表示[5 − 6]。然而采集到的船舶SAR图像可能受到大气条件、风浪、海杂波等因素的影响,导致图像中出现各种噪声和杂散信号,使得目标的识别和定位更加困难。I-VGGNet是一种经典的深度卷积神经网络,I-VGGNet网络通过多个卷积层的叠加和非线性激活函数的作用,可以有效地提取出图像中的纹理和形状特征。特别是通过较深的卷积层,网络可以更好地捕捉到目标的细节和局部特征,从而增强目标识别的能力。因此通过I-VGGNet网络的6个卷积层提取船舶SAR图像中的特征。I-VGGNet网络卷积层结构如图1所示。

|

图 1 I-VGGNet网络卷积层结构 Fig. 1 Convolutional layer structure of I-VGGNet network |

I-VGGNet网络不同卷积层的作用分别为:通过Conv3-3提取更底层的旋转船舶特征,主要包括低级纹理、边缘和局部特征等;通过Conv4-3、Conv7和Conv8-2从不同尺度中提取船舶特征,可以捕捉到船舶目标在不同大小和分辨率上的形状、纹理以及局部特征;Conv9-2、Conv10-2是由Conv8-2对2个1×1的卷积核卷积运算得到,主要用于将高维的特征映射空间降维到低维,并提供更抽象和语义丰富的特征表示。

由于船舶目标通常具有不同大小和不同旋转角度,在SAR图像中呈现出多样性和复杂性。为了准确地提取船舶的特征,需要考虑到不同尺度下目标的细节和整体结构。通过连续的下采样操作,降低特征图的分辨率,扩大感受野,进而捕捉到多个尺度下的船舶目标的特征信息。尤其是在底层卷积层进行下采样时,会更加注重在较小的感受野内提取目标的细节特征。因此在I-VGGNet网络中,从Conv4-3层开始进行连续的下采样,逐渐降低特征图的分辨率,扩大感受野,以提供多尺度和多层次的特征信息供船舶目标的检测和识别使用。由此,I-VGGNet网络可以从底层到高层逐渐提取船舶目标所需的边缘、纹理、形状和大小特征,为船舶目标的检测和识别提供全面而丰富的信息。

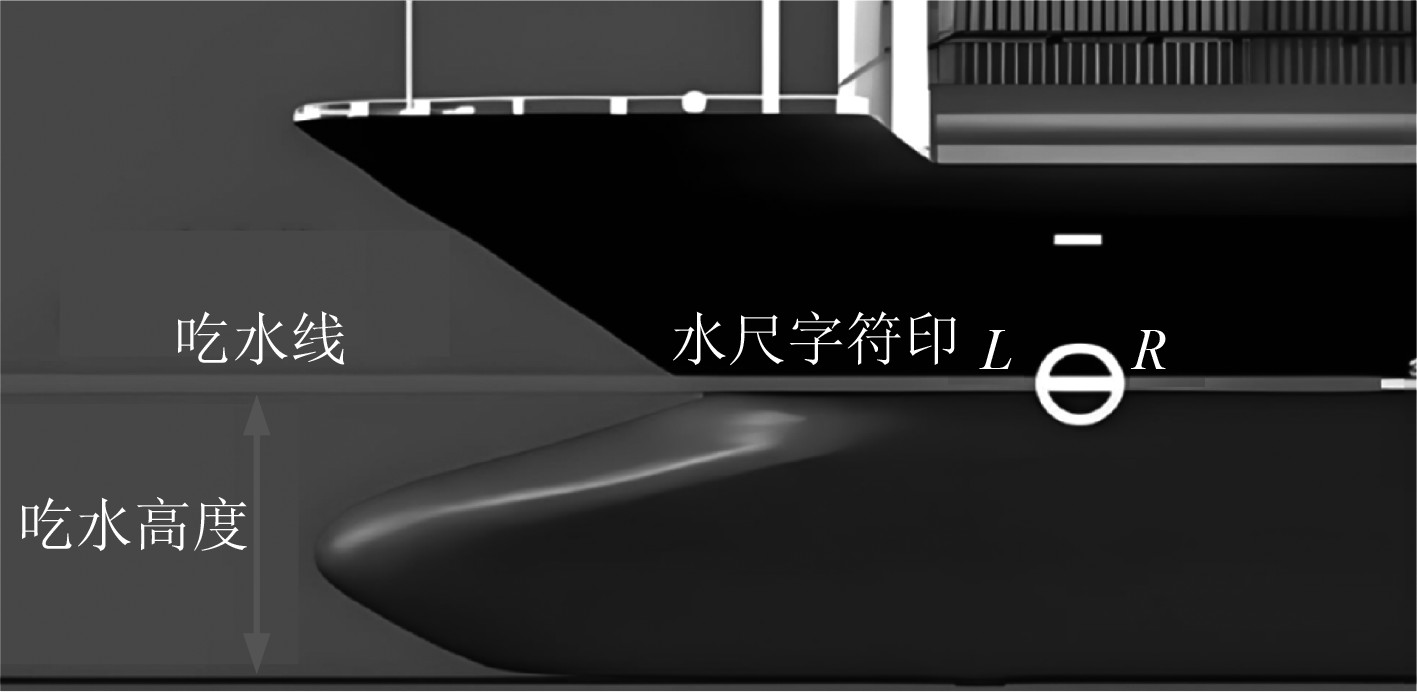

2 船舶吃水深度检测由于船舶特殊的形态,在实现船舶吃水深度检测的过程中,船舶的吃水深度会随着装载货物、航行速度、风浪条件等因素的变化而动态变化。且船舶通常不是垂直于水平面的,导致船舶图像中的水尺字符印可能会出现倾斜或变形,存在不同尺度的变化,造成特征提取的不一致性和目标定位的困难[7]。通过旋转目标框识别船舶可以更准确地捕捉船舶的实际轮廓和姿态,从而提供更准确的数据作为校正基准。一旦识别到船舶并确定了其旋转角度和位置,可以根据这些信息对船舶的水尺字符印进行校正。通过与船舶设计规格进行比较,可以及时发现并调整船舶吃水深度的偏差,以确保船舶在安全范围内运行。因此在I-VGGNet船舶特征提取网络进行船舶特征提取之后,使用FCOS网络构建旋转目标框进行船舶的水尺字符印校正。

FCOS网络以I-VGGNet网络为基础,经该网络的6个卷积层进行特征的卷积处理后输出的特征进行尺度划分,进而得到原始图片1/8、1/16、1/32、1/64、1/128尺度大小的特征图。设第

| $ \left\{ \begin{gathered} {a^ * } = x - {x_0}^i ,\\ {b^ * } = y - {y_0}^i ,\\ {c^ * } = {x_1}^i - x ,\\ {d^ * } = {y_1}^i - y 。\\ \end{gathered} \right. $ | (1) |

分别将中心点

船舶目标预测框和真实框中心距离

| $ {s_{dt}} = {\left( {{x_t} - {x_d}} \right)^2} + {\left( {{y_t} - {y_d}} \right)^2}。$ | (2) |

其中,

将式(2)结合预测框和真实框的外接圆直径进行评估,当预测框和真实框的中心点距离较小且外接圆直径较接近,则认为是一次较好的预测结果。由此可以得到边界框损失函数公式为:

| $ {S_{IoU}} = 1 - \omega \left( {{s_{dt}}^2/{d^2}} \right)。$ | (3) |

式中:

在此基础上考虑到船舶的形状和外观在不同角度下可能会有所变化,因此在损失函数中增加对角度参数的计算,使得FCOS网络可以更精确地预测旋转目标的方向和角度,并根据这些信息对船舶的水尺字符印进行校正。

设

| $ {S}_{RCIoU}={S}_{IoU}-\frac{{\chi }^{2}\left[\left(x,y\right)\text{,}\left({x}^{\prime },{y}^{\prime }\right)\right]}{\zeta }-\lambda \phi 。$ | (4) |

式中:

实验数据以公开的SSDD数据集为实验数据集,包含分辨率及航行状态不同的的

先验框设置:将先验框分配给FCOS网络,将旋转框划分为:−90°、−80°、−70°、−60°、−50°、−40°、−30°、−20°、−10°、0°等10种角度,为每个先验框进行10种角度的分配。实验过程中的参数设置如表1所示。

|

|

表 1 实验参数设置 Tab.1 Setting of the experimental parameters |

在上述实验设置的基础上,所提方法得到的船体的水尺字符印校正结果如图2所示。

|

图 2 水尺字符印校正结果 Fig. 2 Correction results of water gauge character prints |

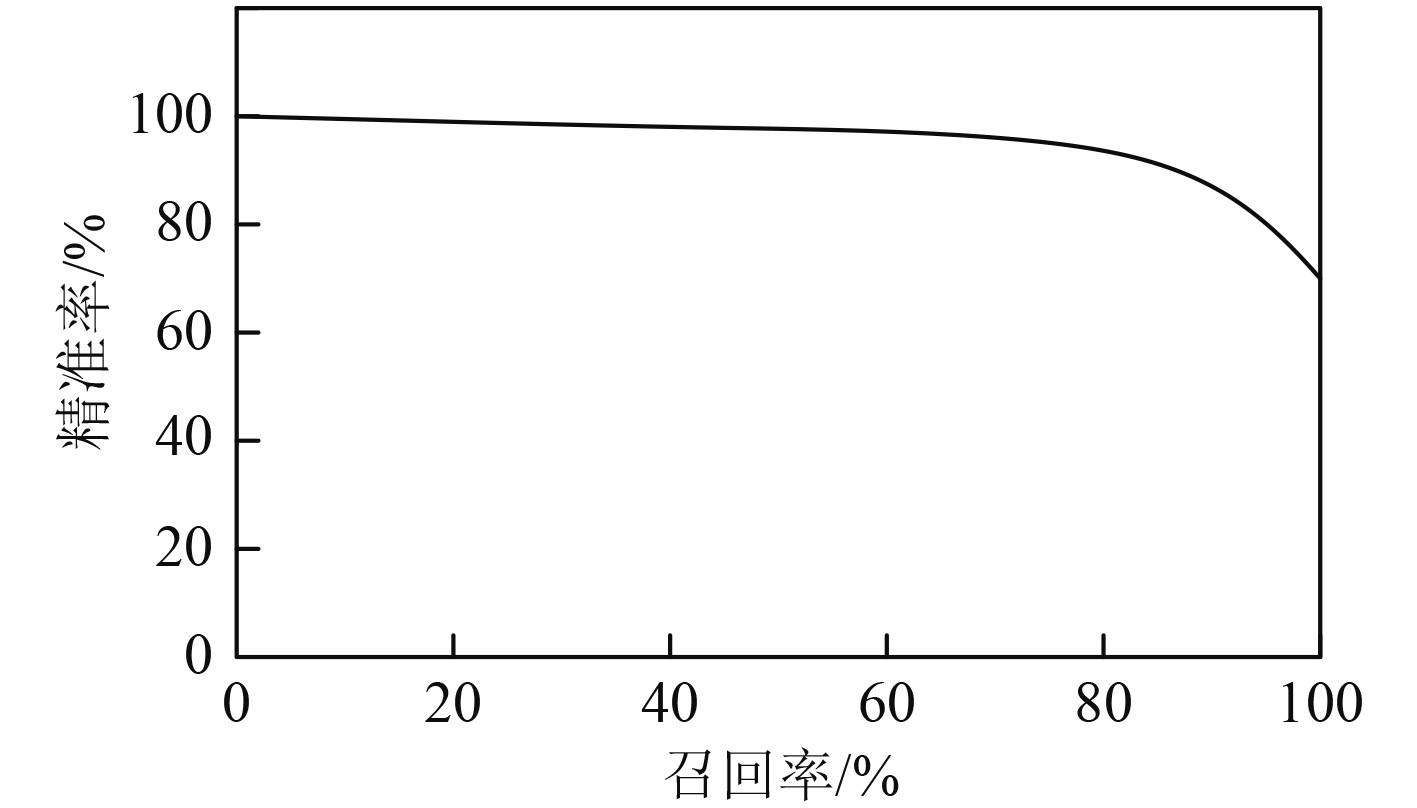

为了验证船舶目标识别的精度,引入P-R曲线对方法的识别精度进行评价。P-R曲线所包含的面积表示了该方法的识别平均精度,综合评判了船舶目标识别方法的精准率、召回率以及单位时间内检测图像的数量情况,结果如图3所示。

|

图 3 应用不同损失函数的识别P-R曲线图 Fig. 3 Identification P-R curve diagram using different loss functions |

可以看出,本文方法对船舶目标识别得到的P-R曲线下降趋势较于平缓,表明本文方法应用RCIoU损失函数对船舶目标的识别精准率较高,且在召回率为80%时得到的船舶识别的精准率仍高于召回率。这是由于本文方法将IoU损失函数和RCIoU损失函数的结合使用,既考虑了预测框与真实框的重叠程度,又考虑了它们之间的旋转和中心距离关系,从而提高了识别的准确性和鲁棒性。

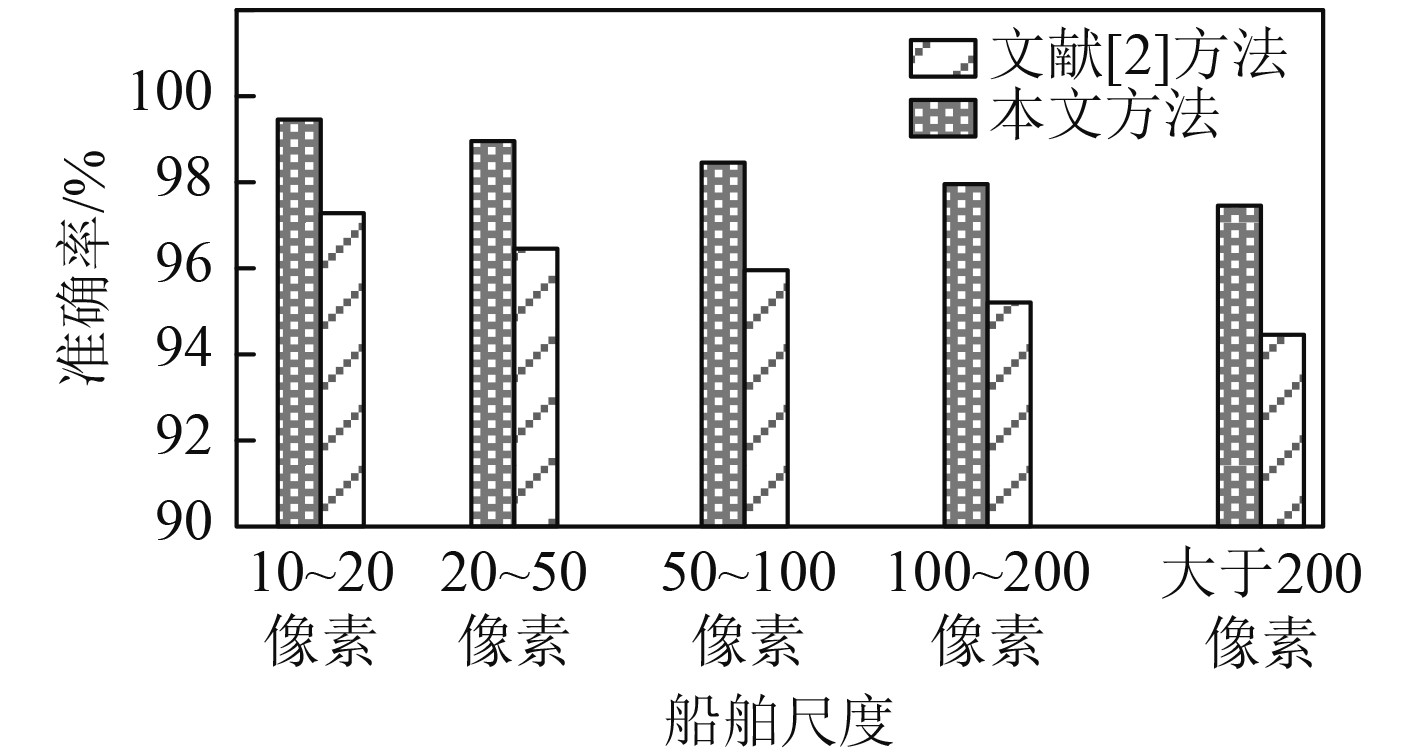

为进一步验证本文方法在进行船舶目标识别中的能力,将本文方法对比文献[2]方法进行实际船舶的SAR图像中船舶的识别,识别准确率如图4所示。

|

图 4 识别准确率 Fig. 4 Identification accuracy |

可知,本文方法能够精准识别不同尺度的船舶,识别准确率在98%以上。这是由于本文方法利用FCOS网络对船舶SAR图像特征进行尺度划分,使得模型能够在不同尺度的特征图上进行目标检测。这种多尺度处理机制使得模型能够适应不同大小的船舶目标,无论是大型货船还是小型渔船,都能得到准确的检测结果。

为进一步证明本文方法的识别能力,将本文方法对比文献[3]方法和文献[4]方法,针对IoU取不同值情况下进行船舶吃水深度检测平均精度的计算。其中,

|

|

表 2 船舶吃水深度检测的平均精度(%) Tab.2 Average accuracy of ship draft depth detection |

可知,文献[3]方法和文献[4]方法检测得到的各平均精度基本一致。而本文方法则在相同条件下拥有更高的精度。这是因为本文方法采用I-VGGNet网络进行特征提取,该网络通过其卷积层结构能够更有效地捕获船舶SAR图像中的多层次特征。在特征提取和融合方面更为精细,能够更全面地提取和利用船舶目标的特征信息。对于总体AP值,本文方法从文献[3]方法的92.1%提升到95.8%。因此证明了本文方法能够提升船舶吃水深度的检测准确性。

4 结 语为了保证船舶的航运安全,提出了一种基于机器视觉技术的船舶吃水深度动态检测方法,通过结合I-VGGNet网络和FCOS网络,成功实现了水尺字符印校正,完成船舶吃水深度动态检测。实验结果表明,该方法不仅能够准确校正船舶的水尺字符印,还能精准识别不同尺度下的船舶目标。总体AP值达到95.8%,展现了较高的检测精度,有效保障了船舶的航行安全。这一方法的应用,为船舶吃水深度的动态监测提供了新的技术手段,对于预防搁浅、触底等事故,确保航道畅通和船舶安全具有重要意义。

| [1] |

贾程澄, 王军, 邱峰. 多特征提取和多核SVM的舰船目标识别方法[J]. 电光与控制, 2021, 28(11): 106-111. |

| [2] |

陈轩, 周家海. 船舶吃水深度数据检测关键技术及应用[J]. 舰船科学技术, 2022, 44(8): 182-185. CHEN Xuan, ZHOU Jiahai. Key technology and application of ship draft depth data detection[J]. Ship Science and Technology, 2022, 44(8): 182-185. |

| [3] |

佟世琪, 赵鹏, 王月兵, 等. 基于超声相控技术的船舶吃水测量方法[J]. 声学技术, 2023, 42(2): 192-198. |

| [4] |

饶本顺, 郑云峰, 周校彬, 等. 散装谷物船自动配载方案分析[J]. 船海工程, 2022, 15(5): 113-116+125. |

| [5] |

CHAKRABORTY S , AMRITA, CHOUDHURY T , et al. Multi-view deep cnn for automated target recognition and classification of synthetic aperture radar image[J]. Journal of Advances in Information Technology, 2022, 13(5): 413−422.

|

| [6] |

马剑英, 朱迪. 基于星载宽刈幅散射计的海面舰船目标检测方法与识别[J]. 遥感技术与应用, 2021, 36(3): 663-672. |

| [7] |

陈瑾龙, 徐哲壮, 黄平, 等. 基于机器视觉的四足机器人目标识别与跟随系统设计[J]. 实验技术与管理, 2022, 39(10): 135-139+167. |

| [8] |

雷禹, 冷祥光, 周晓艳, 等. 基于改进ResNet网络的复数SAR图像舰船目标识别方法[J]. 系统工程与电子技术, 2022, 44(12): 3652-3660. DOI:10.12305/j.issn.1001-506X.2022.12.08 |

2024, Vol. 46

2024, Vol. 46