水下目标检测是近年来研究比较多的领域之一,可用于海底管道探测、检修和维护,海洋环境学调查和海底特征检测,也可在军事上用于无人平台自主探测识别水雷、岸基声呐等水下威胁目标。水下目标检测可通过不同的成像技术实现,常用的声呐设备主要包括前视声呐、侧扫声呐和合成孔径声呐。

成像声呐接收到的回波信号主要受3种干扰影响,分别为环境噪声、混响和自噪声[1]。环境噪声是普遍存在于水中任意时空范围内无规则可叠加的背景噪声,该噪声可视作一个遵从高斯分布的随机信号。混响定义为水听器接收到的来自水中边界或非均匀体的部分散射声能,混响强度随散射体的距离和发射信号的强度而变化,是限制主动声呐对近距离目标探测的主要因素。自噪声包括声呐的机械噪声、电噪声,干扰信号在声呐图像中形成斑点噪声,降低目标边缘的清晰度。相比于光学图像,声呐图像分辨率低,噪声干扰严重,目标边缘模糊,声呐图像复杂背景的特点给后续的目标检测等工作带来了很大的难度。

声呐图像的目标检测算法有很多,比如传统方法中,利用人工设计的特征进行模板匹配来实现目标的定位与分类[2 - 3],通过比较声呐图像的像素灰度是否超过设定的检测阈值来实现目标检测的恒虚警率算法[4]。Williams[5]针对大尺度合成孔径声呐图像设计了一种无监督快速目标检测算法,通过采用级联架构和利用积分图像来加快检测速度,实现了近似实时检测。Valdenegro等[6]利用卷积神经网络对前视声呐图像进行端到端的训练,并利用支持向量机进行分类网络的微调,提升了目标检测的精度。张元科等[7]针对声呐图像的噪声分布特点,提出了基于马尔可夫随机场的非监督声呐图像分割方法,有效提高了分割的效率和准确性。凡志邈等[8]利用inception_v3和SSD模型实现了声呐图像中目标的分类和检测。王非等[9]提出一种水下物体检测模型YOLOv3F,将声呐图像中提取的纹理特征和深度图中提取的空间几何特征相融合用于目标检测,在识别精度方面有明显提升。盛子旗等[10]通过样本仿真扩增了数据集,对深度卷积神经网络模型进行微调从而实现了水下水雷声呐图像的检测。

基于深度学习的目标检测方法大都依赖于大量的含标注数据,对图像数据进行标注费时费力,且实际试验中无法获得足够多的声呐图像用于模型的训练。小样本学习在图像分类领域取得了不错的效果,在目标检测领域主要分为基于微调[11]、基于模型[12]和基于度量学习[13]三类。本文结合小样本学习和经典的Faster R-CNN目标检测框架,将在大量标注数据上训练得到的模型进行微调,然后用于少量的声呐图像来实现目标检测,从而解决了声呐图像数据不足的问题。同时,通过改善训练样本的质量,实现了在复杂情况如低信噪比条件下的目标检测。

1 基本原理 1.1 声呐图像噪声模型分析混响是声呐图像中的主要干扰,声呐回波由分辨率单元对应的散射体层内所有散射体产生的散射声波在接收点叠加形成。在散射模型中,通常作以下假设:

1) 声线沿直线传播;

2) 每个散射体对混响的贡献程度相同;

3)只考虑散射体的单次散射,不考虑散射体间的多次散射;

4) 入射脉冲时间足够短。

忽略所有二次以上的散射,根据Middleton提出的海底混响模型[14],设声源发射的脉冲信号为

| $ \begin{split} X\left( t \right) =& \sum\limits_{n = 1}^N g\left( {{r_n}} \right)f\left( {{r_n}} \right)\left| {{\alpha _n}} \right|\left| {{s_0}\left( {t - {t_n}} \right)} \right|\times\\ & \exp \left[ {j\left( {{\omega _0}\left( {t - {t_n}} \right) + \psi \left( {t - {t_n}} \right) + {\psi _n}} \right)} \right] 。\end{split} $ | (1) |

式中:

| $ X\left( t \right) = {{\mathrm{Re}}} \left( t \right) + j{{\mathrm{Im}}} \left( t \right)。$ | (2) |

令

| $ {{\mathrm{Re}}} \left( t \right) = \sum\limits_{n = 1}^N {{V_n}\left( t \right)\cos {\varphi _n}\left( t \right)},$ | (3) |

| $ {{\mathrm{Im}}} \left( t \right) = \sum\limits_{n = 1}^N {{V_n}\left( t \right)\sin {\varphi _n}\left( t \right)} 。$ | (4) |

根据中心极限定理,当

| $ \begin{split} \langle \mathrm{Re}\left(t\right)\rangle =\; & {\displaystyle \sum _{n=1}^{N}\langle {V}_{n}\left(t\right)\mathrm{cos}{\phi }_{n}\left(t\right)\rangle }=\\ & {\displaystyle \sum _{n=1}^{N}\left[\langle {V}_{n}\left(t\right)\rangle · \frac{1}{2{\text{π}} }{\displaystyle {\int }_{0}^{2{\text{π}} }\mathrm{cos}{\phi }_{n}\left(t\right){\rm{d}}\left({\phi }_{n}\left(t\right)\right)}\right]} = 0。\end{split} $ | (5) |

| $ \begin{split} \langle \mathrm{Im}\left(t\right)\rangle =\;&{\displaystyle \sum _{n=1}^{N}\langle {V}_{n}\left(t\right)\mathrm{sin}{\phi }_{n}\left(t\right)\rangle }=\\ & {\displaystyle \sum _{n=1}^{N}\left[\langle {V}_{n}\left(t\right)\rangle · \frac{1}{2{\text{π}} }{\displaystyle {\int }_{0}^{2{\text{π}} }\mathrm{sin}{\phi }_{n}\left(t\right){\rm{d}}\left({\phi }_{n}\left(t\right)\right)}\right]} = 0。\end{split} $ | (6) |

其中,

| $ {p_X}\left( x \right) = \left\{ {\begin{array}{*{20}{l}} {0,}&{x < 0},\\ {\dfrac{x}{{{\alpha ^2}}}\exp \left( { - \dfrac{{{x^2}}}{{2{\alpha ^2}}}} \right),}&{x \geqslant 0} 。\end{array}} \right. $ | (7) |

式中,

迁移学习是机器学习领域的一个重要研究方向,基于迁移学习的模型算法在多个领域均有成功应用。迁移学习的基本思想是将从源数据集学到的知识迁移应用到目标数据集上,而微调(Fine-tuning)是迁移学习的一种技术实现手段[15]。

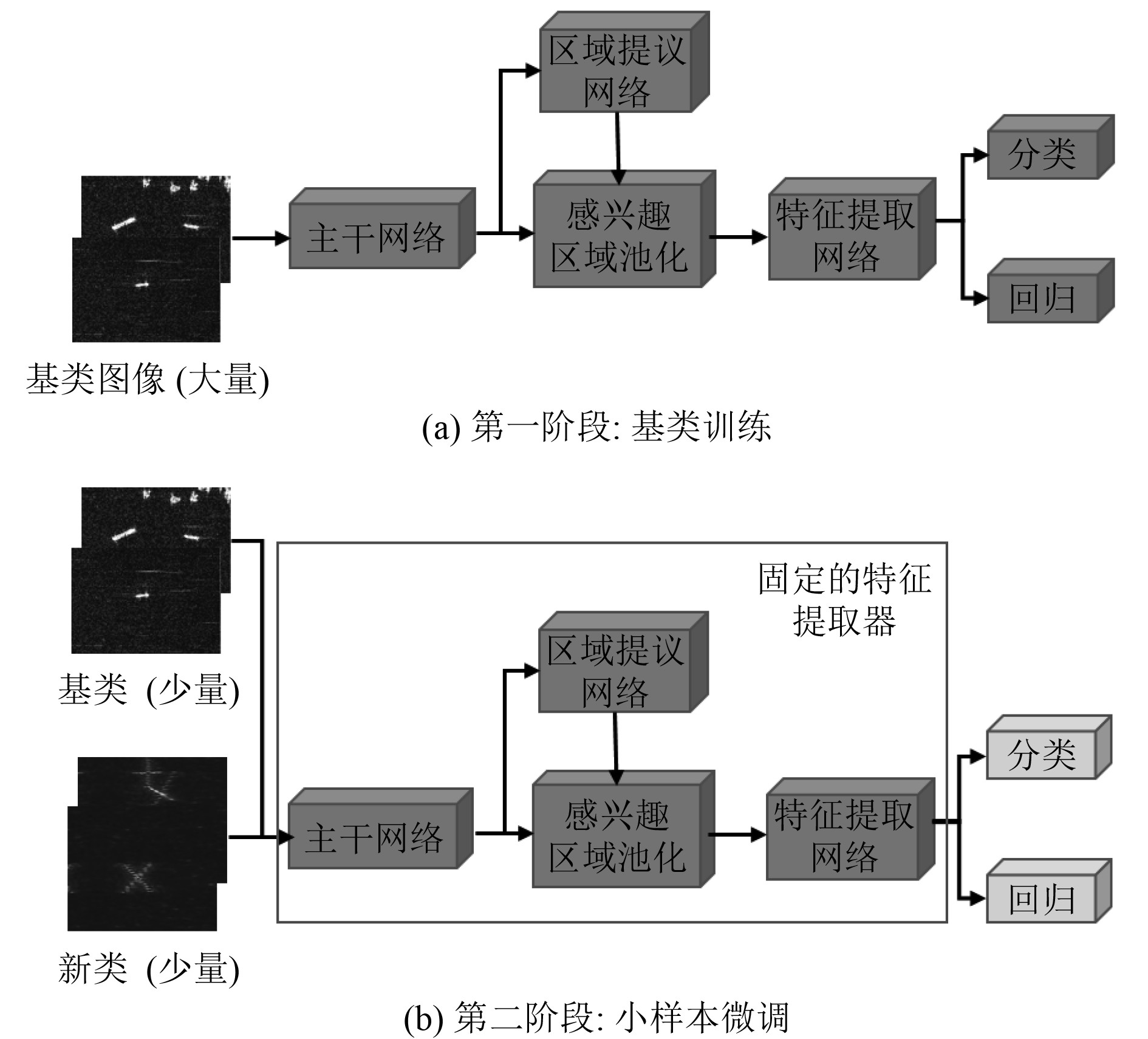

基于模型微调的方法是利用大量的基类数据对现有的模型结构进行预训练,然后利用少量的新类数据对得到模型的参数进行微调,从而实现小样本条件下的目标检测。两阶段微调方法是基于Faster R-CNN算法的改进,整个过程分为基训练和微调2个阶段,如图1所示。第一阶段,整个模型在有大量标注数据的基类上训练;第二阶段,冻结网络模型的部分参数,在少量基类和新类数据上对模型进行微调。本文实验中冻结的是主干网络参数。

|

图 1 小样本目标检测框架图 Fig. 1 Few-shot target detection framework diagram |

实验中使用的数据集由引入的开源数据SSDD[16]和仿真数据组成,其中SSDD为SAR舰船数据集,含舰船(ship)一个类别,共1160张。仿真数据由数据集A、B组成,生成过程如下:

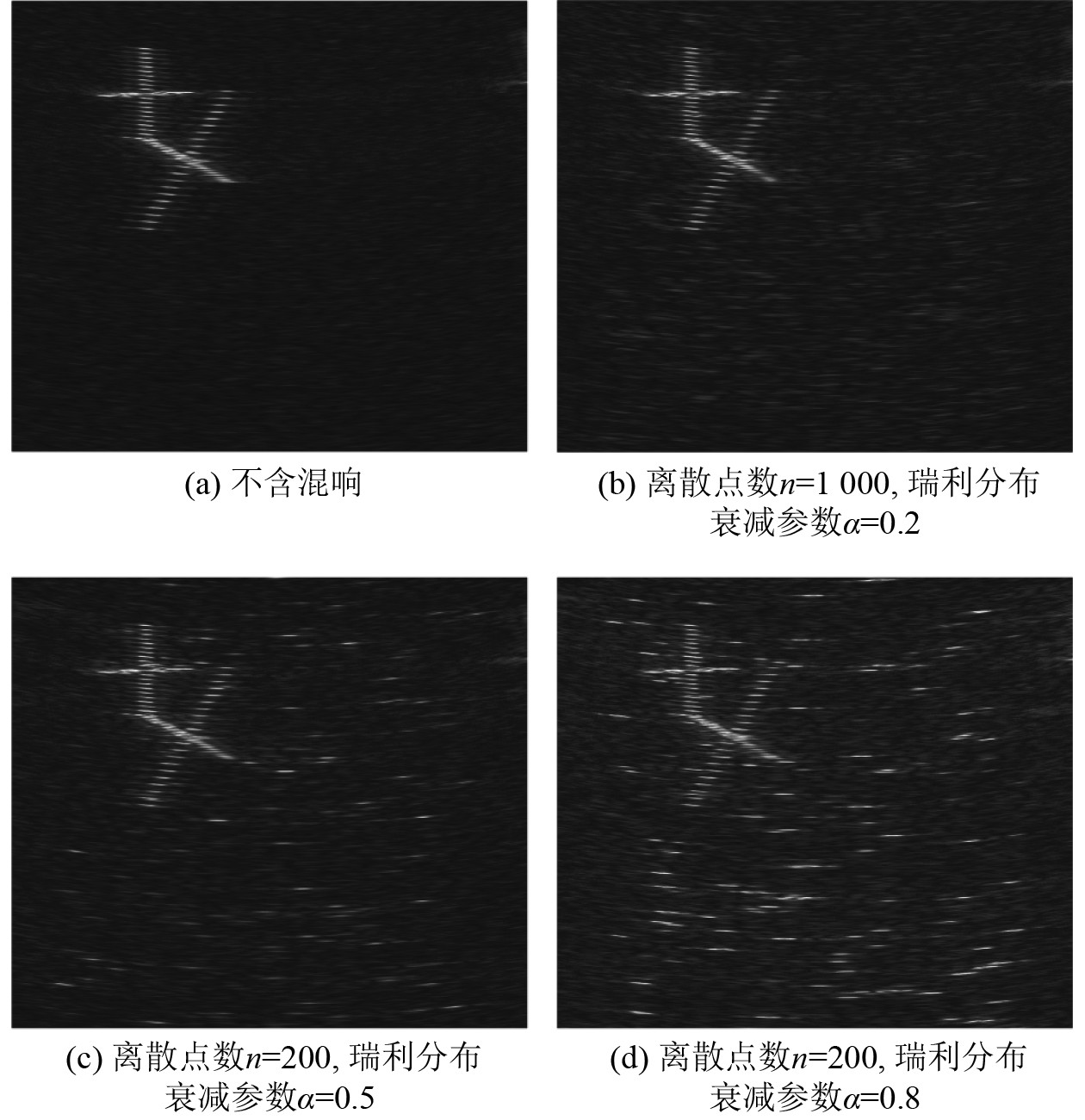

仿真目标包括十字架(cross)、框(box)两类,在仅输入目标信号时进行仿真得到高信噪比的声呐图像,记为数据集A,如图2(a)所示。为了研究复杂背景下目标检测的效果,结合噪声模型,输入信号中除了包含目标信号以外,还加入一定数目

|

图 2 仿真声呐图像示意图 Fig. 2 Schematic of the simulated sonar images |

SSDD数据作为网络模型训练的基类图像,仿真数据作为新类图像对模型进行微调。实验中分别构建了数据集Ⅰ(由SSDD和A组成)和数据集Ⅱ(由SSDD、A和B组成)。数据集Ⅰ、Ⅱ均采用COCO格式。

2.2 实验设置实验基于开源的小样本目标检测框架MMFewShot[17]来开展研究,实验代码在Python3.8和Pytorch1.10.0下完成。参数的具体设置为:使用随机梯度下降(Stochastic Gradient Descent, SGD)算法进行参数优化,设置初始学习率为0.0002,动量为0.9,权重衰减为0.0001,最大迭代次数为30000。分类、回归损失函数分别选择交叉熵损失函数(Cross Entropy Loss)和L1范数损失(L1 Loss)。

2.3 评价指标为了评估检测器的性能,首先要对是否成功检测到目标进行定义,因此引入目标检测领域重要的衡量指标交并比(Intersection over Union, IoU)。由每张图像产生的预测框和真值框计算IoU,并根据IoU值是否大于阈值来判断该预测是正例(True Positives, TP)还是负例(False Positives, FP),具体计算公式如下:

| $ IoU\left( {A,B} \right) = \frac{{\left| {\left( {A \cap B} \right)} \right|}}{{\left| {\left( {A \cup B} \right)} \right|}}。$ | (8) |

式中,

精确度(precision)和召回率(recall)是目标检测任务中常用的评价指标。精确度描述了模型检出为正样本的目标中真实正样本的比例,也称为查准率;召回率描述了所有真实正样本中被模型成功检出的比例,又称为查全率。一般来说精确度与召回率成反比,精确度越高召回率越低。因此为了从综合的角度来描述模型性能,提出了AP(Average Precision)概念,其在数值上等于以召回率为横坐标,精确度为纵坐标的P-R曲线下的面积。mAP(mean Average Precision)为多类别下各类别AP的平均值。

2.4 优化策略1)优化算法的选择

随机梯度下降(SGD)是每次从训练集中随机采样一个样本计算损失的梯度,然后更新参数,即:

| $ \theta \left( k \right) = \theta \left( {k - 1} \right) - \eta \frac{{\partial {\rm{Loss}}\left( {{y_n},{{\mathop y\limits^ \wedge }_n}} \right)}}{{\partial \theta \left( k \right)}},$ | (9) |

| $ {\rm{Loss}}\left( {y,\mathop y\limits^ \wedge } \right) = \frac{1}{{2N}}\sum\limits_{n = 1}^N {{{\left[ {{y_n} - f\left( {\sum\limits_{m = 1}^N {{w_{nm}}{x_m} + {b_n}} } \right)} \right]}^2}} 。$ | (10) |

式中:

但SGD的问题是,由于频繁更新和波动,最终将收敛到最小限度,并会因波动频繁存在超调量。

Adam(Adaptive Moment Estimation Algorithm)算法与传统的随机梯度下降不同。随机梯度下降保持单一的学习率更新所有的权重,学习率在训练过程中并不会改变。Adam算法可以看作动量法和RMSProp算法的结合,不但使用动量作为参数更新方向,而且可以自适应调整学习率。

2)损失函数的选择

L1范数损失函数定义式如下:

| $ {L_1}\left( {{d_ * },{t_ * }} \right) = \sum\limits_{i \in \left\{ {x,y,w,h} \right\}} {\left| {{d_i} - {t_i}} \right|} 。$ | (11) |

式中:

L1范数损失函数对于任意的输入都有着稳定的梯度,不会导致梯度爆炸问题,具有稳健的解。但是在预测框与真实框重叠时不能求导,不方便求解。

预测框与真值框的交并比IoU被设定为优化预测框的损失函数,但是当两框无重叠面积时无法进行梯度回传,为此Rezatofighi等[18]提出了GIoU损失函数,在IoU损失函数上增加了一个惩罚项,在边框不重叠部分也可以提供梯度,并可以对网络进行优化,GIoU损失函数定义为:

| $ GIoU = IoU - \frac{{\left| {C|\left( {A \cup B} \right)} \right|}}{{\left| C \right|}} 。$ | (12) |

式中,

GIoU损失函数解决了IoU损失函数在预测框和真值框不重叠情况下无法收敛的问题,在提高模型检测精度的同时避免了出现L1范数损失函数中存在的各参数无关性的缺点。

3)改善训练样本

为了提高在低信噪比条件下的目标检测精度,本文采取的优化策略是进一步丰富用于模型训练的样本数据,即仿真时加入若干离散点来模拟混响并使混响幅值服从瑞利分布,得到更接近真实场景的低信噪比声呐图像。

3 分析与讨论本文进行了2组实验,分别在仅包含高信噪比仿真声呐图像的数据集Ⅰ和包含所有仿真声呐图像的数据集Ⅱ上进行。

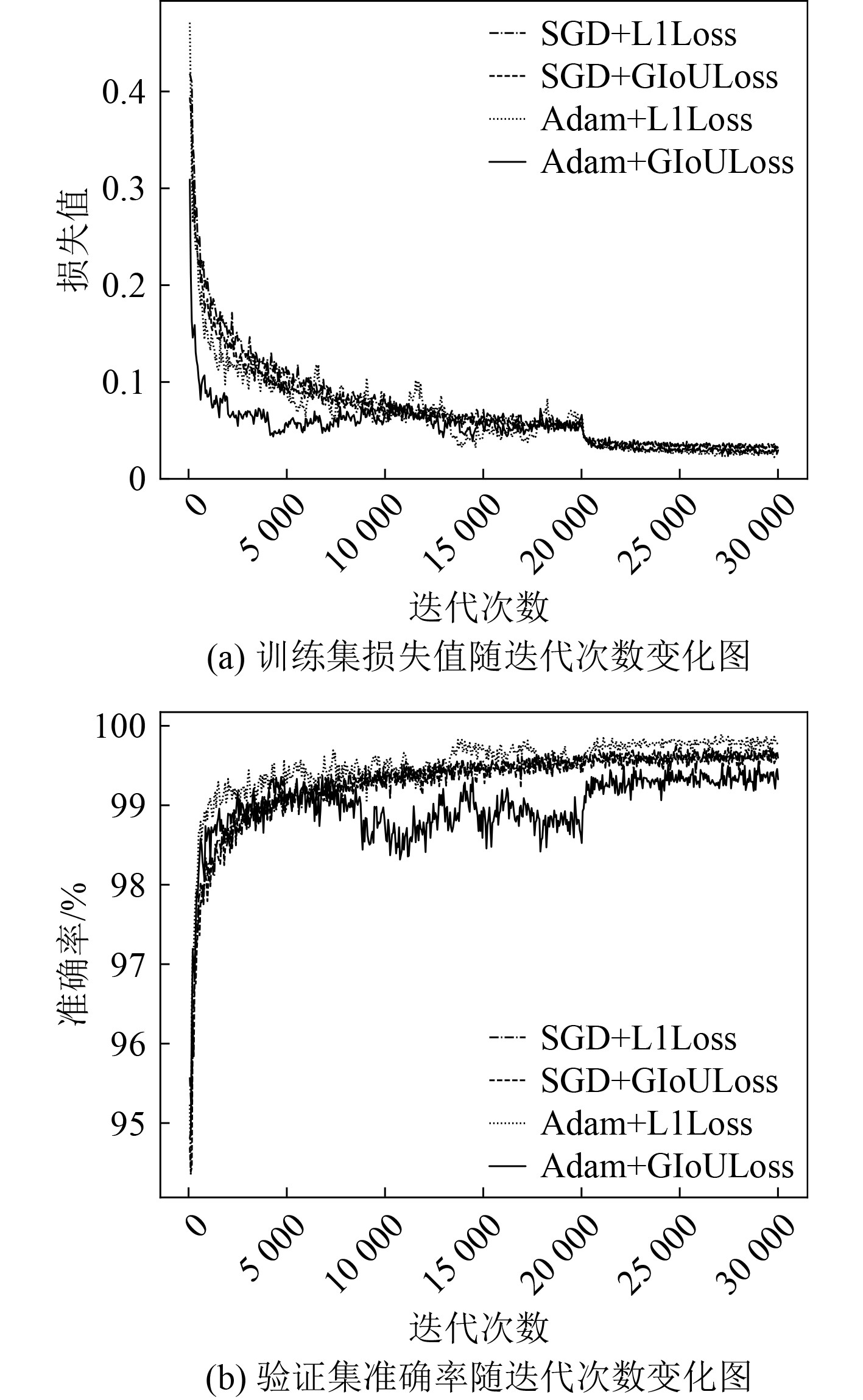

实验1是在数据集Ⅰ上进行的,验证了几种训练策略下模型的性能。图3为训练集损失值和验证集准确率的变化情况,得出如下结论:

|

图 3 训练过程中不同优化策略下训练集损失值和验证集准确率随迭代次数变化曲线图 Fig. 3 Variation of the loss value of the training set and the accuracy of the validation set with the number of iterations under different optimization strategies in the training process |

1)以SGD和L1Loss共同作用的训练结果作为基线指标,可以发现 GIoULoss、Adam在训练过程中损失函数值都相对较快地收敛,且对目标预测的准确率都较高。

2)当GIoULoss和Adam共同作用时,训练集损失值是下降最快且最低的,但在迭代次数较高时,验证集准确率曲线出现了波动降低的变化趋势。

表1为在数据集Ⅰ上采取不同训练条件的各类别(cross、box、ship)AP值,以及新类(novel)和所有类的mAP值。结合本文的研究目的,为了说明小样本条件下的目标检测性能,因此特别关注对新类目标的预测情况。根据mAP_novel可以计算得出GIoULoss、Adam和GIoULoss+Adam在目标检测精度上分别有2.4%、3.6%、8.9%的提高。

|

|

表 1 基于数据集Ⅰ的目标检测AP值 Tab.1 AP values for target detection based on datasetⅠ |

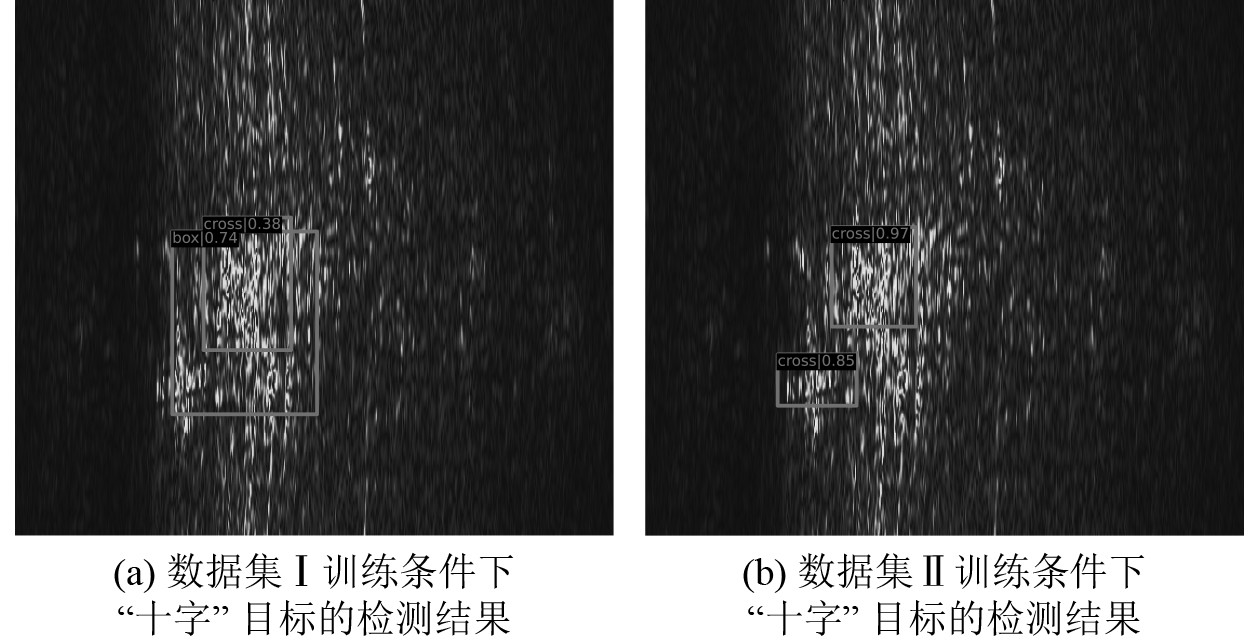

根据实验1对模型的评估结果,选择Adam和GIoULoss共同作用的优化策略来训练模型,以实际场景得到的真实声呐图像做测试。综合实验1和实验2的检测情况,可得以下结论:

1)在数据集Ⅰ上进行训练得到的模型只能检测高信噪比条件下图像中的目标,如图4(a)所示。对于低信噪比条件下的图像5(a),检测时会出现漏检或者错误分类。

|

图 4 真实声呐图像中单目标检测结果 Fig. 4 Single target detection results in real sonar images |

2)如图4(b)和图5(b)所示,在数据集Ⅱ上进行训练得到的模型可以较好地检测出图像中的所有目标,并且能够对目标进行正确分类。

|

图 5 真实声呐图像中多目标检测结果 Fig. 5 Multi-target detection results in real sonar images |

3)由图4(b)和图5(b)可知,在数据集Ⅱ上进行训练得到的模型能够解决单目标和多目标的检测问题。

综上可知,在小样本声呐图像训练条件下,当未采用低信噪比仿真声呐图像作为训练样本来检测时,不能准确得到目标的检测结果。而当添加了含有混响干扰的声呐图像训练样本后,可以准确地检测出图像中的所有目标。因此,可以看出训练样本的选取对于模型的检测性能有一定影响。

4 结 语本文将小样本目标检测应用到声呐图像领域,基于迁移学习的思想,对准备的数据集进行训练和微调,并在真实声呐图像上进行测试,验证了该模型在小样本条件下进行声呐图像目标检测的有效性。在模型训练过程中,采取不同的损失函数和优化算法,对模型的检测能力做了进一步分析。在针对低信噪比声呐图像中的目标检测问题时,通过仿真混响得到更接近真实声呐图像的训练样本,实现了较好的检测效果。未来的研究将考虑把领域自适应技术和小样本目标检测相结合,提高算法的泛化能力,研究解决不同域不同类目标在小样本条件下的检测问题。

| [1] |

李庆武, 霍冠英, 周妍. 声呐图像处理[M]. 北京: 科学出版社, 2015: 98.

|

| [2] |

HURTÓS N, PALOMERAS N, NAGAPPA S, et al. Automatic detection of underwater chain links using a forward-looking sonar[C]//2013 MTS/IEEE OCEANS-Bergen. IEEE, 2013: 1−7.

|

| [3] |

MYERS V, FAWCETT J. A template matching procedure for automatic target recognition in synthetic aperture sonar imagery[J]. IEEE Signal Processing Letters, 2010, 17(7): 683-686. DOI:10.1109/LSP.2010.2051574 |

| [4] |

KALYAN B, BALASURIYA A. Sonar based automatic target detection scheme for underwater environments using CFAR techniques: a comparative study[C]//Proceedings of the 2004 International Symposium on Underwater Technology (IEEE Cat. No. 04EX869). IEEE, 2004: 33−37.

|

| [5] |

WILLIAMS D P. Fast target detection in synthetic aperture sonar imagery: A new algorithm and large-scale performance analysis[J]. IEEE Journal of Oceanic Engineering, 2014, 40(1): 71-92. |

| [6] |

VALDENEGRO-TORO M. End-to-end object detection and recognition in forward-looking sonar images with convolutional neural networks[C]//2016 IEEE/OES Autonomous Underwater Vehicles (AUV). IEEE, 2016: 144−150.

|

| [7] |

张元科. 水下声纳图像目标检测技术研究[D]. 哈尔滨: 哈尔滨工程大学, 2013.

|

| [8] |

凡志邈, 李海林, 夏伟杰, 等. 基于深度学习的成像声纳水下目标的检测与分类[C]// 中国声学学会水声学分会2019年学术会议, 2019: 266−268. FAN Z M, LI H L, XIA W J, et al. Detection and classification of underwater objects based on deep learning[C]// 2019 Academic Conference of the Hydroacoustics Branch of the Chinese Society of Acoustics, 2019: 266−268. |

| [9] |

王非, 王欣宇, 周景春, 等. 一种基于YOLOv3的水下声呐图像目标检测方法[J]. 电子与信息学报, 2022, 44(10): 3419-3426. WANG F, WANG X Y, ZHOU J C, et al. An underwater object detection method for sonar image based on YOLOv3 model[J]. Journal of Electronics & Information Technology, 2022, 44(10): 3419-3426. |

| [10] |

盛子旗, 霍冠英. 样本仿真结合迁移学习的声呐图像水雷检测[J]. 智能系统学报, 2021, 16(2): 385-392. SHENG Z Q, HUO G Y. Detection of underwater mine target in sidescan sonar image based on sample simulation and transfer learning[J]. CAAI transactions on intelligent systems, 2021, 16(2): 385-392. DOI:10.11992/tis.202101030 |

| [11] |

SUN B, LI B, CAI S, et al. Fsce: Few-shot object detection via contrastive proposal encoding[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2021: 7352−7362.

|

| [12] |

FAN Q, ZHUO W, TANG C K, et al. Few-shot object detection with attention-RPN and multi-relation detector[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2020: 4013−4022.

|

| [13] |

KANG B, LIU Z, WANG X, et al. Few-shot object detection via feature reweighting[C]//Proceedings of the IEEE/CVF International Conference on Computer Vision, 2019: 8420-8429.

|

| [14] |

MIDDLETON D. A statistical theory of reverberation and similar first order scattered fields[J]. IEEE Transactions on Information Theory, 1967, 13(3): 372-414. DOI:10.1109/TIT.1967.1054044 |

| [15] |

阿斯顿·张, 李沐, 扎卡里·C. 立顿, 等. 动手学深度学习[M]. 北京: 人民邮电出版社, 2019: 250−251.

|

| [16] |

ZHANG Tianwen0825 (2022) Official-SSDD. https://github.com/TianwenZhang0825/Official-SSDD [EB/OL

|

| [17] |

Mmfewshot Contributors (2021) OpenMMLab Few Shot Learning Toolbox and Benchmark [EB/OL]. https://github.com/open-mmlab/mmfewshot.

|

| [18] |

REZATOFIGHI H, TSOI N, GWAK J Y, et al. Generalized intersection over union: A metric and a loss for bounding box regression[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2019: 658−666.

|

2024, Vol. 46

2024, Vol. 46