为充分掌握舰船航行轨迹,通常采用采集动态舰船图像并对其进行分析的方式识别目标或对目标进行跟踪[1-2],但受到舰船移动性影响为舰船目标识别和跟踪带来了一定的难度。现在也有很多学者从颜色特征角度出发,研究三维动态舰船图像颜色特征提取和应用方法。向涛[3]提出显著区域提取的舰船图像目标检测方法,该方法通过采集舰船红外图像后,利用图论方法获得舰船红外图像的颜色特征,再依据颜色特征划分舰船的显著性区域,然后利用图像分割方式实现舰船目标检测。但该方法在应用时,提取舰船图像颜色特征精度不足,导致其最终应用效果不佳。王春静等[4]提出基于模糊颜色特征的检索方法,该方法利用模糊算法获得三维动态舰船图像的模糊颜色特征后,依据模糊颜色特征向量之间的相似度以检索的方式获得舰船当前位置,实现舰船目标识别。但该方法提取的图像颜色特征具有模糊性,导致舰船目标识别精度不足。面对上述情况,本文研究三维动态舰船图像颜色特征自动提取和应用方法,为舰船目标识别和跟踪提供一种有效的途径。

1 舰船图像颜色特征自动提取和应用 1.1 基于PCA-K-means的动态舰船图像颜色特征提取三维动态舰船图像颜色特征提取是其应用的基础,在此将主成分分析(PCA)算法与K-means聚类算法相结合提取三维动态舰船图像颜色特征。以三维动态舰船图像为基础,先利用PCA算法获得三维动态舰船图像的颜色特征子空间。xi为三维动态舰船图像,i=1, 2,…, n,n为图像总数,将xi作为训练样本,再将xi像素点的

| $ avg = \frac{{\displaystyle\sum\limits_{i = 1}^n {{x_i}} }}{n}。$ | (1) |

式中,avg为样本xi的均值。

分别计算每个颜色类的样本均值,表达式如下:

| $ {{ avg}_k} = \frac{{\displaystyle\sum\limits_{{x_i} \in k}^{} {{x_i}} }}{{{n_k}}}。$ | (2) |

式中:avgk为属于

对三维动态舰船图像样本进行规范化,其表达公式如下:

| $ x{x_i} = {x_i} - avg 。$ | (3) |

式中,xxi为规范化后的三维动态舰船图像样本。

将规范化后的三维动态舰船图像样本组成矩阵

| $ C = X{X^{\rm{T}}} 。$ | (4) |

式中,上角标

计算式(4)的颜色特征值和特征向量矩阵,并将特征值按照降序排列后[5],建立颜色特征向量矩阵,该特征向量矩阵的转置矩阵即为三维动态舰船图像的颜色特征子空间由Wpca表示。将三维动态图像样本xi映射到颜色特征子空间内,其表达式如下:

| $ Y = W_{pca}^{\rm{T}}X 。$ | (5) |

利用式(5)获取到所有样本颜色特征后,采用K-means算法对颜色特征进行聚类分析,其步骤如下:

步骤1 选择

步骤2 对任意一个三维动人舰船图像样本进行

步骤3 通过均值方法更新

步骤4 利用步骤2和步骤3进行迭代更新,当聚类中心值保持不变,则停止迭代,反之继续。

步骤5

| $ {\tau _{k1}} > {\tau _{k2}} > \cdots > {\tau _{ki}},$ | (6) |

式中,

将属于每个颜色类别的像素数量进行排序处理,将前

| $ {k_{new}} = \mathop {\arg }\limits_{1 \leqslant i \leqslant n} (\min ({\rm{dis}}{t_{{k_i}}}))。$ | (7) |

式中:knew为重新分配的中心像素类别;

利用式(7)得到若干个三维动态舰船图像颜色特征

提取到三维动态舰船图像颜色特征后,将其应用于舰船目标识别和跟踪,为舰船安全管理提供相关数据。

1.2.1 舰船目标识别将n个三维动态舰船图像颜色特征作为样本训练集,由

| $ \mathop {\min }\limits_{w,b} (\frac{1}{2}{\left\| w \right\|^2} + h\sum\limits_{i = 1}^n {{\zeta _i}} ) $ | (8) |

式中:

式(8)约束条件如下:

| $ \left\{ \begin{gathered} {Y_i}({w^{\rm{T}}}{u_i} + b) \geqslant 1 - {\zeta _i},\\ {\zeta _i} \geqslant 0 。\\ \end{gathered} \right. $ | (9) |

式中,Yi为第

假设求解三维动态舰船图像舰船目标识别时,支持向量机最大化问题是寻找到最优超平面,则其分量识别的决策函数表达式如下:

| $ f(u) = {\rm{sign}}(w\times u + b) 。$ | (10) |

式中:

通过式(10)即可依据三维动态舰船图像颜色特征识别当前舰船。

1.2.2 舰船轨迹跟踪依据三维动态舰船图像的颜色特征不仅可以实现舰船目标识别,还可以对舰船轨迹进行跟踪。对于三维动态舰船图像来说,其相邻的2个图像帧之间舰船运动的机动性不大,可以使用二阶常速模型描述舰船的运动规律。令舰船状态为

| $ {E_t} = \left( \begin{gathered} 1\mathop {}\limits^{} \Delta T\mathop {}\limits^{} \mathop {}\limits^{} 0\mathop {}\limits^{} \mathop {}\limits^{} 0 \\ 1\mathop {}\limits^{} \mathop {}\limits^{} 0\mathop {}\limits^{} \mathop {}\limits^{} 0\mathop {}\limits^{} \mathop {}\limits^{} 1 \\ 0\mathop {}\limits^{} \mathop {}\limits^{} 0\mathop {}\limits^{} \mathop {}\limits^{} 1\mathop {}\limits^{} \Delta T \\ 0\mathop {}\limits^{} \mathop {}\limits^{} 0\mathop {}\limits^{} \mathop {}\limits^{} 0\mathop {}\limits^{} \mathop {}\limits^{} 1 \\ \end{gathered} \right)U{X_{t - 1}} + \left( \begin{gathered} \frac{{\Delta {T^2}}}{2}\mathop {}\limits^{} 0 \\ \Delta T\mathop {}\limits^{} 0 \\ 0\mathop {}\limits^{} \frac{{\Delta {T^2}}}{2} \\ 0\mathop {}\limits^{} \Delta T \\ \end{gathered} \right){W_t}。$ | (11) |

式中:Et为高斯噪声;

| $ \tilde \omega _t^i = \frac{{\omega _{t - 1}^i}}{{\sqrt {2{\text{π}} \sigma } }}\exp ( - \frac{{v_i^2}}{{2{\sigma ^2}}})。$ | (12) |

式中:vi为系统噪声;

| $ \omega _t^i = \tilde \omega _t^i/\sum\limits_{i = 1}^n {\tilde \omega _t^i},$ | (13) |

以式(13)为基础,则最终舰船位置状态为:

| $ {\hat \omega _t} = \sum\limits_{i = 1}^n {\omega _t^i} x_t^i。$ | (14) |

通过式(14)计算不同时刻的舰船位置状态,将其连接后即可得到该舰船航行轨迹。

2 结果与分析以某港口舰船作为实验对象,使用本文方法对该港口舰船进行动态图像颜色特征提取其颜色特征,并对颜色特征加以应用,对舰船进行识别和轨迹跟踪。采用HVR-Z7C相机采集三维动态舰船图像,HVR-Z7C相机参数如表1所示。

|

|

表 1 HVR-Z7C相机参数 Tab.1 HVR-Z7C camera parameters |

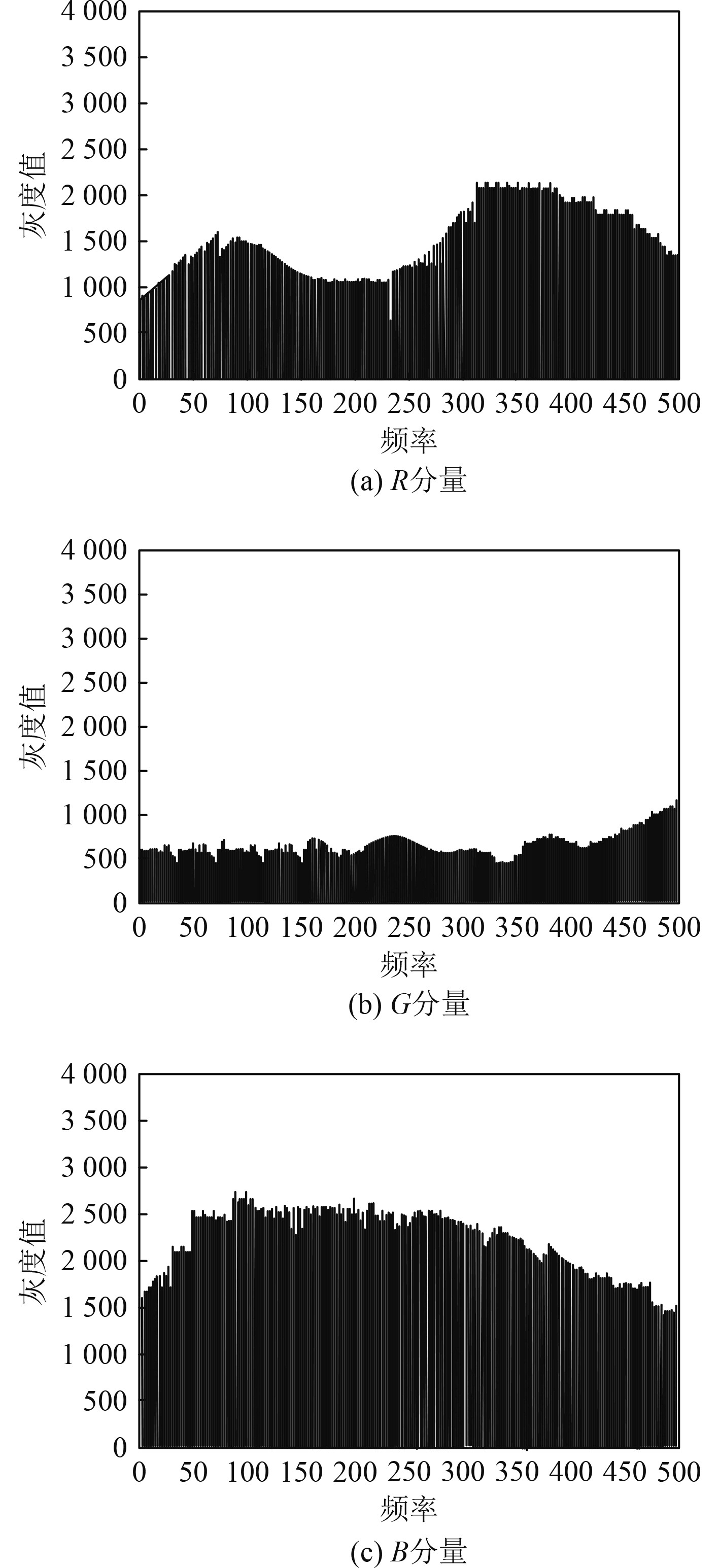

利用HVR-Z7C相机采集舰船三维动态图像后,以任意一幅三维动态舰船图像作为实验对象,使用本文方法提取该图像的颜色特征,以直方图形式呈现颜色特征提取结果,如图1所示。分析可知,利用本文方法可有效从三维动态舰船图像内提取其不同颜色特征分量,说明本文方法在提取三维动态舰船图像颜色特征方面具备较强能力。

|

图 1 三维动态舰船图像颜色特征提取结果 Fig. 1 Color feature extraction results of 3D dynamic ship image |

以像素点作为衡量指标,以某一幅三维动态舰船图像的R分量作为实验对象,在该复三维动态舰船图像上选取8个标记点,使用本文方法提取该图像标记点位置的R分量,设置像素点提取最大偏差为100个像素,测试结果如表2所示。分析可知,利用本文方法提取三维动态舰船图像颜色特征的R分量时,提取像素数值与实际像素数值之间最大差值仅为36个,说明本文方法提取三维动态舰船图像颜色特征较为准确。

|

|

表 2 R分量像素点提取测试结果(个) Tab.2 R component pixel extraction test results (pieces) |

以提取到的三维动态舰船图像颜色特征作为基础,使用本文方法识别某航行区域内的补给船,识别结果如图2所示。分析可知,应用本文方法可有效在舰船航行区域内识别补给船舶,并使用框线对识别结果进行标记,说明本文方法可有效对提取到的三维动态舰船颜色特征进行应用,本文方法应用效果较佳。

|

图 2 补给船识别结果 Fig. 2 Supply ship identification results |

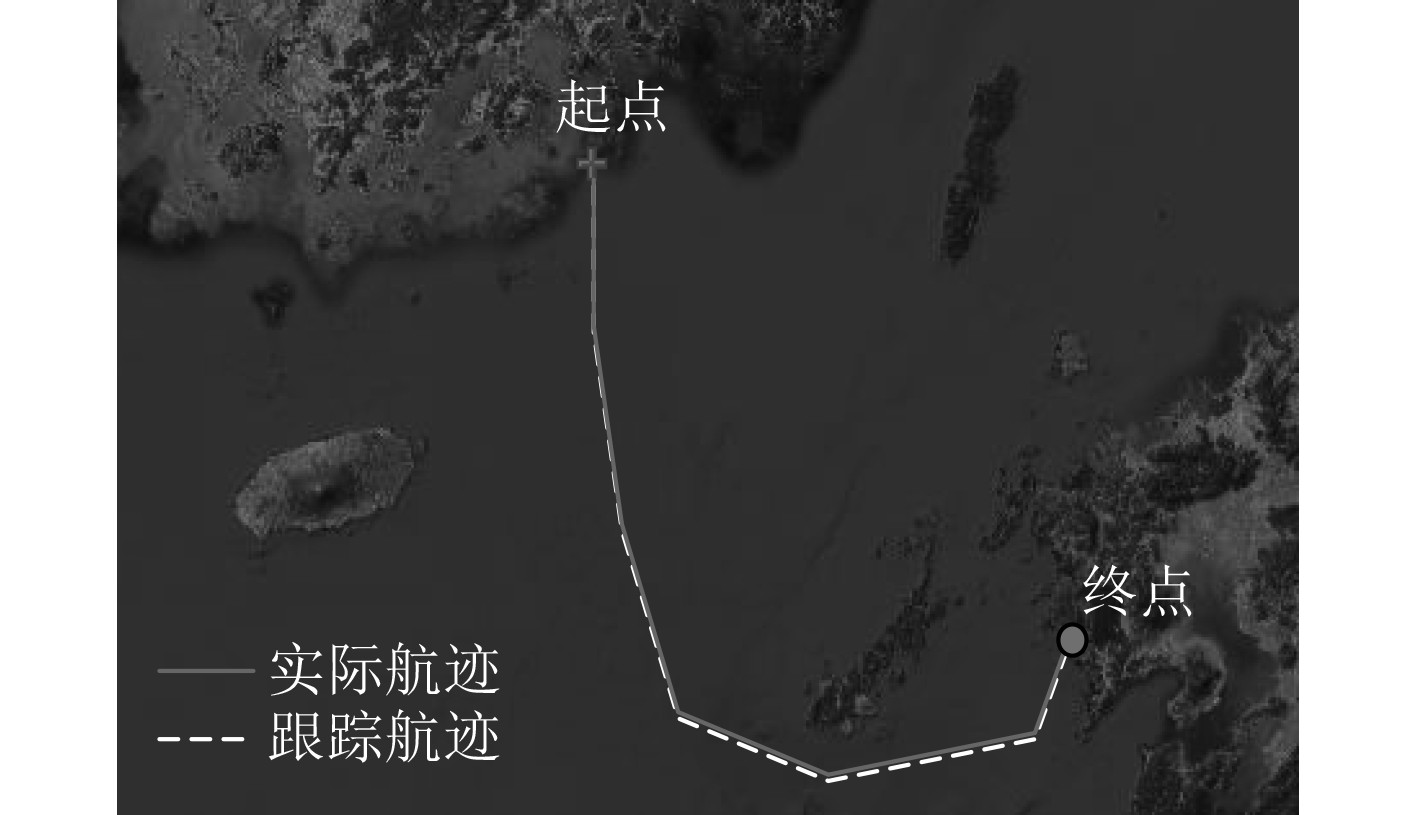

将本文方法提取到的三维动态舰船航行颜色特征应用到舰船航迹跟踪,以某舰船作为实验对象,采集其三维动态图像并提取颜色特征后,对其进行航迹跟踪,跟踪结果如图3所示。分析可知,应用本文方法对该舰船航迹进行跟踪后,跟踪航迹与该舰船实际航行的航迹完全吻合,说明本文方法不仅可有效提取三维动态舰船图像颜色特征,还可应用于舰船航迹跟踪,应用效果较好。

|

图 3 舰船航迹跟踪结果 Fig. 3 Ship track tracking results |

本文研究三维动态舰船图像颜色特征自动提取和应用方法。该方法将提取到的三维动态舰船图像颜色特征应用到舰船目标识别和航迹跟踪2个方面,经过实验验证,本文方法在这2个领域具有较为显著的应用效果。

| [1] |

雷禹, 冷祥光, 计科峰. 基于Google Earth Engine的海量舰船目标SAR图像处理应用研究[J]. 信号处理, 2021, 37(6): 1075-1085. |

| [2] |

刘万军, 高健康, 曲海成, 等. 多尺度特征增强的遥感图像舰船目标检测[J]. 自然资源遥感, 2021, 33(3): 97-106. |

| [3] |

向涛. 基于显著区域提取的红外图像舰船目标检测[J]. 电讯技术, 2020, 60(7): 785-790. DOI:10.3969/j.issn.1001-893x.2020.07.008 |

| [4] |

王春静, 刘丽, 谭艳艳, 等. 基于模糊颜色特征和模糊相似度的图像检索方法[J]. 计算机科学, 2021, 48(8): 191-199.

|

| [5] |

刘凯, 汪兴海, 张杰. 基于深度玻尔兹曼机的图像多特征融合[J]. 舰船电子工程, 2020, 40(1): 32-36. DOI:10.3969/j.issn.1672-9730.2020.01.009 |

| [6] |

马健, 史文旭, 鲍胜利. 基于特征融合SSD的遥感图像舰船目标检测[J]. 计算机应用, 2019, 39(z2): 253-256. |

| [7] |

刘洁瑜, 赵彤, 刘敏. 基于RetinaNet的SAR图像舰船目标检测[J]. 湖南大学学报(自然科学版), 2020, 47(2): 85-91. DOI:10.16339/j.cnki.hdxbzkb.2020.02.012 |

| [8] |

严春满, 王铖. 基于特征增强的SAR图像舰船小目标检测算法[J]. 控制与决策, 2023, 38(1): 239-247.

|

2023, Vol. 45

2023, Vol. 45