通过图像数据分析和计算机视觉处理技术进行无人艇航行轨迹虚拟重构处理,提高对无人艇航行轨迹模拟和控制能力,在对无人艇航行轨迹虚拟重构中,采用数据特征与 RGB 图像分析方法[1],结合虚拟现实的视景仿真技术进行图像信息增强处理,构建复杂场景下的无人艇航行线路和轨迹跟踪模型,通过高层特征的融合方法,结合图像视觉增强技术,提高对无人艇航行轨迹虚拟重构和跟踪识别能力,研究无人艇航行轨迹虚拟重构方法,在实现对无人艇的全局信息增强和目标跟踪方面具有重要意义[2]。在对无人艇航行轨迹虚拟重构设计中,采用影像端元的谱特征分析和影像空间采样技术,实现对无人艇航行轨迹图像检测,结合端元光谱的空间变异方法,通过点云数据在特征空间分布特性,进行无人艇航行轨迹的虚拟重建。本文提出基于多准则粒子滤波的无人艇航行轨迹虚拟重构方法。首先进行无人艇航行轨迹图像采集,然后采用融合双模态特征检测方法实现对无人艇航行轨迹的图像检测,结合多准则粒子滤波分析方法,实现对无人艇的航行轨迹重构,并通过Matlab进行图像仿真。

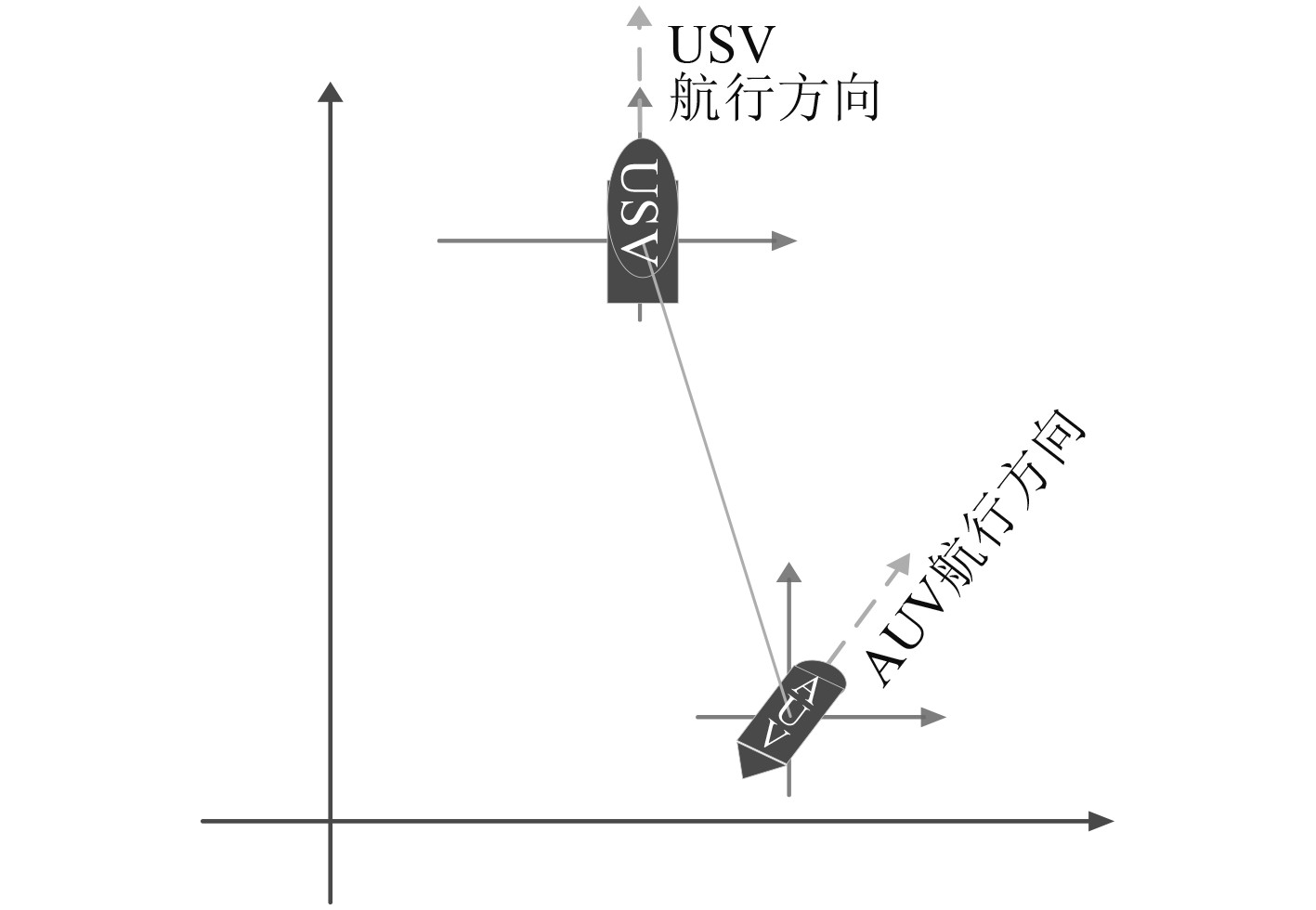

1 无人艇航行轨迹的图像检测和预处理 1.1 无人艇航行轨迹图像检测为了实现对多准则粒子滤波下的无人艇航行轨迹虚拟重构,采用几何单形体体积法构建图像采集模型,根据对无人艇的航行方向规划设计[3],进行航迹分布的三维坐标设计,如图1所示。

|

图 1 无人艇的航行方向规划坐标系 Fig. 1 Navigation direction planning coordinate system of unmanned craft |

根据图1所示的无人艇的航行方向规划坐标分布,以像素点

| $ \sigma(Z;D_X)=\sum\limits_{i>j}\left|d_{ij}(Z)-d_X(x_i,x_j)\right|^2。$ | (1) |

式中:

| $ \begin{split} &Eimage(Vi) = \\ &\quad - |I(xi - 1,yi + 1) + 2I(xi,yi + 1) + I(xi + 1,yi + 1) -\\ &\quad I(xi - 1,yi - 1) - 2I(xi,yi - 1) - I(xi + 1,yi - 1)| +\\ &\quad |I(xi + 1,yi - 1) + 2I(xi + 1,yi) + I(xi + 1,yi - 1) -\\ &\quad I(xi - 1,yi - 1) - 2I(xi - 1,yi) - I(xi - 1,yi + 1)|。\end{split} $ | (2) |

式中:

结合对无人艇航行轨迹图像的边缘特征分析,得到无人艇航行轨迹图像边界特征分布表达为:

| $ Econ(vi) = \left| {EdgeGray(i) - Gray(i)} \right| 。$ | (3) |

式中:

由此建立无人艇航行轨迹图像检测模型,通过边分区边界的像素融合实现轨迹虚拟重构[5]。

1.2 无人艇航行轨迹图像滤波处理采用双阶段 RGB-D 显著性检测方法进行无人艇航行轨迹图像的融合和增强处理,将无人艇航行轨迹图像进行动态分割,构建图像梯度检测模型,结合单峰特征的提取方法[6],得到无人艇航行轨迹的跟踪的权重分布函数为:

| $ nt{f_{(k,N)}} = 1 + \ln (1 + t{f_{(k,N)}}) ,$ | (4) |

| $ ndl = (1 - s) + s\cdot \frac{{dl}}{{avgdl}}, $ | (5) |

| $ id{f_k} = \ln \left(\frac{{|D| + 1}}{{d{f_k} + 1}}\right) 。$ | (6) |

式中:

对 RGB 特征和增强后的深度特征进行分段融合,进一步获取交融模块分布函数,得到各层深度图的糊度分布集:

| $ H(f) = u\left( {t - {\tau _0}} \right)\exp \left[ {j{\omega _d}\left( {t - {\tau _0}} \right)} \right] $ | (7) |

式中:

从低层次的2种模态特征进行特征匹配,得到图像质量分布模型参数,根据本层RGB特征和增强后的深度特征融合结果,得到滤波输出:

| $ t{f_{\left( {{\text{search}},p_{\text{1}}} \right)}} = {\text{1}} ndl = 0.{\text{8}} + 0.{\text{2}} \times {\text{6}}/avgdl ,$ | (8) |

| $ id{f_{{\text{search}}}} = {\text{ln}}\left( {\left( {{\text{6}} + {\text{1}}} \right)/\left( {{\text{3}} + {\text{1}}} \right)} \right),$ | (9) |

| $ M(search,p_1) = \frac{{tf(search,{p_1})}}{{ndl}}\cdot id{f_{search}}。$ | (10) |

式中:

根据图像滤波结果,采用融合双模态特征检测方法实现对无人艇航行轨迹的图像检测,结合视觉分割技术进行图像滤波处理。

2 无人艇航行轨迹虚拟重构优化 2.1 无人艇航行轨迹多准则粒子滤波把注意力机制融入到航迹跟踪模型中,得到无人艇航行轨迹多准则粒子滤波配集为

| $ A{V_m}(r) = \frac{1}{{N - (m - 1)\tau }}\sum\limits_{i = 1}^{N - (m - 1)\tau } {\ln {R_m}\left( {r,i} \right)}。$ | (11) |

式中:

获取2个方向上的通道参数,得到粒子滤波集群参数为:

| $ \varOmega = \left\{ \begin{gathered} \vec x \in s|{g_j}(\vec x) \leqslant 0,j = 1, \ldots ,l \\ {h_j}(\vec x) = 0,j = l + 1, \ldots ,p \\ \end{gathered} \right\}。$ | (12) |

式中:

利用线性加权得出整体的响应特征值,得到多准则滤波输出矩阵为:

| $ {{\boldsymbol{W}}_u} = \left[ {\begin{array}{*{20}{c}} {\cos (a)}&{ - \sin (a)}&0 \\ {\sin (a)}&{\cos (a)}&0 \\ 0&0&1 \end{array}} \right] 。$ | (13) |

式中:

根据复点聚类,表示为:

| $ \min \vec y = \vec f(\vec x) = ({f_1}(\vec x),{f_2}(\vec x), \ldots ,{f_m}(\vec x))。$ | (14) |

其中:

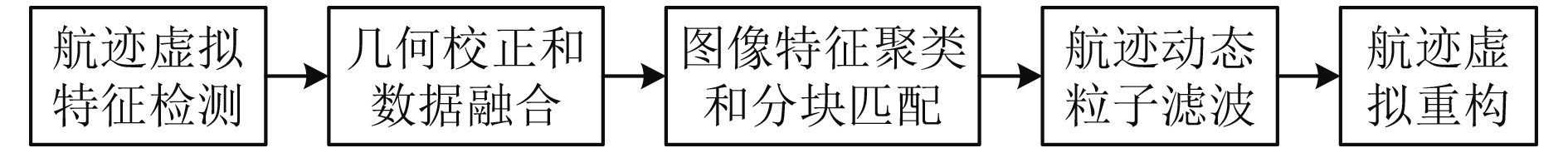

综上,在同质区域进行端元提取,结合多准则粒子滤波,实现航迹重构,实现流程如图2所示。

|

图 2 无人艇航行轨迹多准则粒子滤波流程 Fig. 2 Multicriteria particle filter process for unmanned boat navigation trajectory |

采用三维数据场可视化分析的方法,基于计算、裁剪、纹理映射方法,得到模糊集函数为:

| $ {P_i}(t) = \sum\limits_{n = 1}^N {\frac{A}{r}} {e^{ - jkr}}{R_{in}}\frac{1}{r}{e^{ - ikr}} 。$ | (15) |

式中:

基于三维数据场可视化的数据获取和跟踪识别的方法,得到边界模糊集分配函数为:

| $ {P_i}(t) = \frac{A}{{{r^2}}}\sum\limits_{n = 1}^N {{e^{ - j2kr}}{a_{in}}{e^{j{\psi _{in}}}}}。$ | (16) |

式中:

| $ f(x) = \sum\limits_{i = 1}^n {({\alpha _i} - {\alpha _i}^ * )K({x_i},{x_j})} + b 。$ | (17) |

式中:

通过图像增强、去噪处理,得到自适应权重值分布矩阵为:

| $ \left( \begin{gathered} \quad t \\ BER \\ \end{gathered} \right) = \left( \begin{gathered} {x_k} - f({x_{k - 1}}) \\ {y_k} - h({x_k}) \\ \end{gathered} \right)。$ | (18) |

式中:

以体素作为最小处理单元,得到qj 处像素的深度值为:

| $ {E_{Snake}} = \sum\limits_0^{N - 1} {[{E_{{int} }}(vi) + {E_{ext}}(vi)]} 。$ | (19) |

式中:

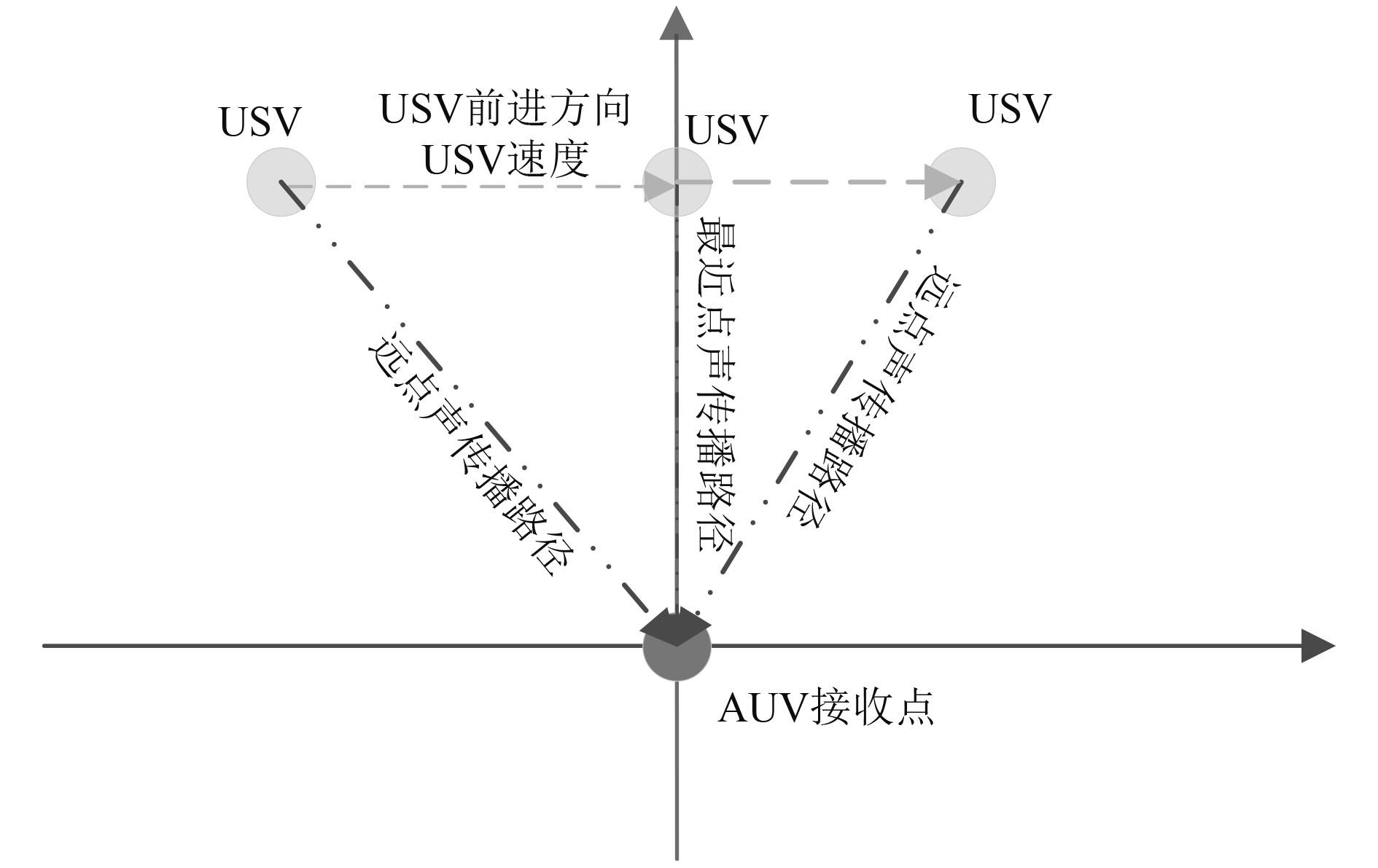

综上,实现对无人艇航行轨迹的虚拟重构,重构实现结构图如图3所示。

|

图 3 无人艇航行轨迹的虚拟重构实现结构图 Fig. 3 Virtual reconstruction implementation structure of unmanned craft navigation trajectory |

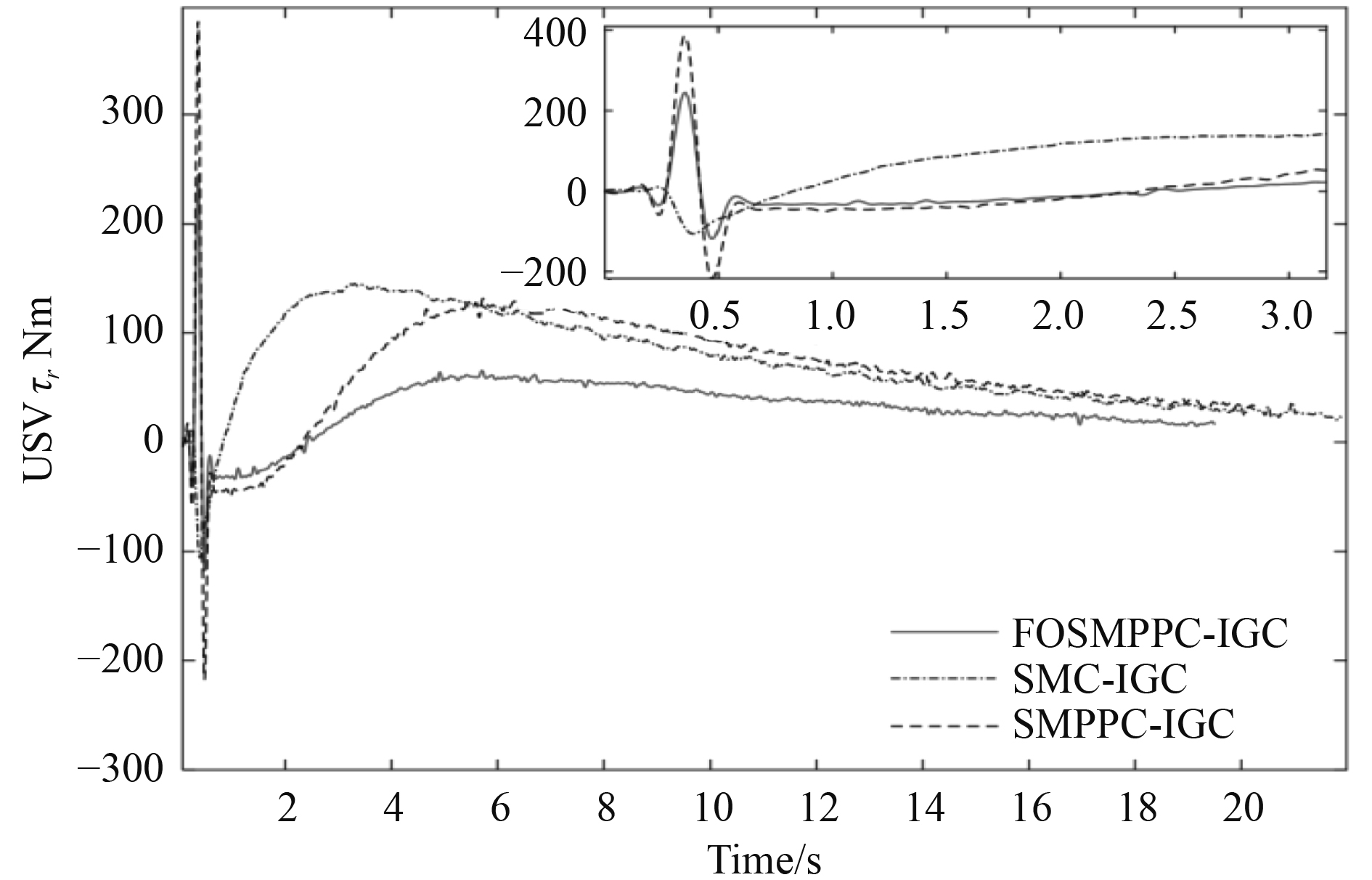

为了验证本文方法在实现无人艇航行轨迹虚拟重构的性能,采用Matlab进行实验测试,透明度的范围为0~1,航行轨迹采样点所在体素的 8 个顶点,无人艇与拖曳体之间距离为339.479 m,信噪比为−4.50719 dB,各个航迹采样点的图像像素点分布如表1所示。

|

|

表 1 航迹采样点的图像像素点分布 Tab.1 Pixel distribution of the image at the track sampling points |

根据表1参数设定,进行航迹虚拟重构。采用本文方法可以进行无人艇航行轨迹的重构虚拟重构,测试轨迹跟踪的性能,得到重构性能测试如图4所示。分析可知,本文方法进行无人艇航行轨迹虚拟重构的视觉增强能力较好,期望值和实际值拟合性能较好。

|

图 4 无人艇航行轨迹重构 Fig. 4 Reconstruction of unmanned boat navigation trajectory |

构建复杂场景下的无人艇航行线路和轨迹跟踪模型,通过高层特征的融合方法,结合图像视觉增强技术,提高对无人艇航行轨迹虚拟重构和跟踪识别能力本文提出基于多准则粒子滤波的无人艇航行轨迹虚拟重构方法。通过无人艇航行轨迹多准则粒子滤波和图像处理,实现无人艇航行轨迹虚拟重构,分析可知,本文方法进行轨迹重构视觉效果较好,响应性能较强。

| [1] |

黄磊, 李慧, 张媛. 基于网络感知信息的船舶航迹规划智能避障方法[J]. 舰船科学技术, 2022, 44(3): 71-74. HUANG Lei, LI Hui, ZHANG Yuan. Intelligent obstacle avoidance method for ship trajectory planning based on network perception information[J]. Ship Science and Technology, 2022, 44(3): 71-74. |

| [2] |

衡井荣, 朱亚东. 基于无线传感网络的内河高密度船舶防撞研究[J]. 舰船科学技术, 2018, 40(22): 37-39. HENG Jingrong, ZHU Yadong. Research on High Density Ship Collision Prevention in Inland Rivers Based on Wireless Sensor Networks[J]. Ship Science and Technology, 2018, 40(22): 37-39. |

| [3] |

梁政焘, 赵克刚, 裴锋, 等. 基于MPC的智能车轨迹跟踪算法[J]. 机械与电子, 2019, 37(1): 66-70. LIANG Zhengtao, ZHAO Kegang, PEI Feng, et al. Intelligent Vehicle Trajectory Tracking Algorithm Based on MPC[J]. Journal of Mechanics and Electronics, 2019, 37(1): 66-70. |

| [4] |

POLYGERINOS P, WANG Z, OVERVELDE J T B, et al. Modeling of soft fiber-reinforced bending actuators[J]. IEEE Transactions on Robotics, 2015, 31(3): 778-789. DOI:10.1109/TRO.2015.2428504 |

| [5] |

KOIVUMAKI J, MATTILA J. Stability-guaranteed force-sensorless contact force/motion control of heavy-duty hydraulic manipulators[J]. IEEE Transactions on Robotics, 2015, 31(4): 918-935. DOI:10.1109/TRO.2015.2441492 |

| [6] |

郑建炜, 周鑫杰, 徐宏辉, 等. 张量环因子非凸秩约束的高光谱图像超解析[J]. 光子学报, 2022, 51(2): 213-227. ZHENG Jianwei, ZHOU Xinjie, XU Honghui, et al. Hyperresolution of hyperspectral images with non convex rank constraint of tensor ring factor[J]. Acta Photonica Sinica, 2022, 51(2): 213-227. |

2023, Vol. 45

2023, Vol. 45