2. 黄河水利职业技术学院 水利工程学院,河南 开封 475003;

3. 黄河水利职业技术学院 基础部,河南 开封 475003

2. Yellow River Conservancy Technical Institute, College of Water Conservancy Engineering, Kaifeng 475003, China;

3. Yellow River Conservancy Technical Institute, Basic Teaching Department, Kaifeng 475003, China

在船舶图像细粒度检测中,高分辨率遥感影像技术是关键技术之一,高分辨率影像虽然可以提供详细的地图信息,但是细粒度识别仍较为困难,造成船舶目标尺寸、外观和内部结构检测存在较大差异,加上其他干扰因素的作用,加剧了准确识别细粒度的困难程度[1-4]。本文针对任意方向目标检测要求,采用生成对抗网络技术合成子网络,将真实样本密度控制在偏低区域,准确获取目标候选区域特征值,进而保证图像细粒度检测准确性。

1 高分辨率遥感船舶图像细粒度检测算法 1.1 生成对抗网络辅助学习识别算法船舶图像细粒度检测采用两阶段的目标检测网络,基于卷积网络训练提取特征值,结合船舶目标朝向任意方向的特点,采用旋转候选区域生成目标候选区域,引入插值池化模块获取特征值,再分类候选区域,优化调整区域框架,设定固定长度,识别分类自网络检测区域,最终输出识别检测结果。主干检测网络采用损失函数,实现端到端训练,函数表达式为:

| $ \begin{array}{l} L=\sum_{i \in B}\left(L_{\text {cis }}+\gamma \cdot L_{r e g}\right) ,\\ L_{\text {cis }}(\mathrm{p}, \mathrm{y})=-\log \mathrm{P}_{\mathrm{y}} ,\\ \mathrm{L}_{\mathrm{reg}}=\text { smooth }_{\mathrm{L} 1}\left(\mathrm{t}-\mathrm{t}^{\mathrm{x}}\right)。\end{array} $ |

式中:B为候选区域集合;Lcis为分类损失函数;Lreg为坐标回归损失函数;p为预测类别概率分布;y为样本真实标签;t为预测图标偏移量;tx为真实坐标偏差量。根据公式可知,分类子网络独立完成训练,利用生成样本辅助学习,识别网络权重与主干网络融合后的图像信息。

1.2 级联区域分类子网络本文提出独立的区域分类子网络,将其连接主干检测网络,第2阶段中的最后共享全连接层作为样本输入的训练层,形成残差单元,设置成分类网络,引入对抗网络。级联区域分类子网络的优势在于:为图像细粒度检测提供不同图像样本,使用批量算法获取训练过程中的梯度信号;调整分类子网络的不对称检测坐标,对坐标进行回归处理,发挥分类的识别功能;子网络训练数据来源于检测框架池化后的特征信息,通过对比分析此类信息与样本类别标签信息,能够精确识别区域特征,提高细粒度检测水平[5-8]。

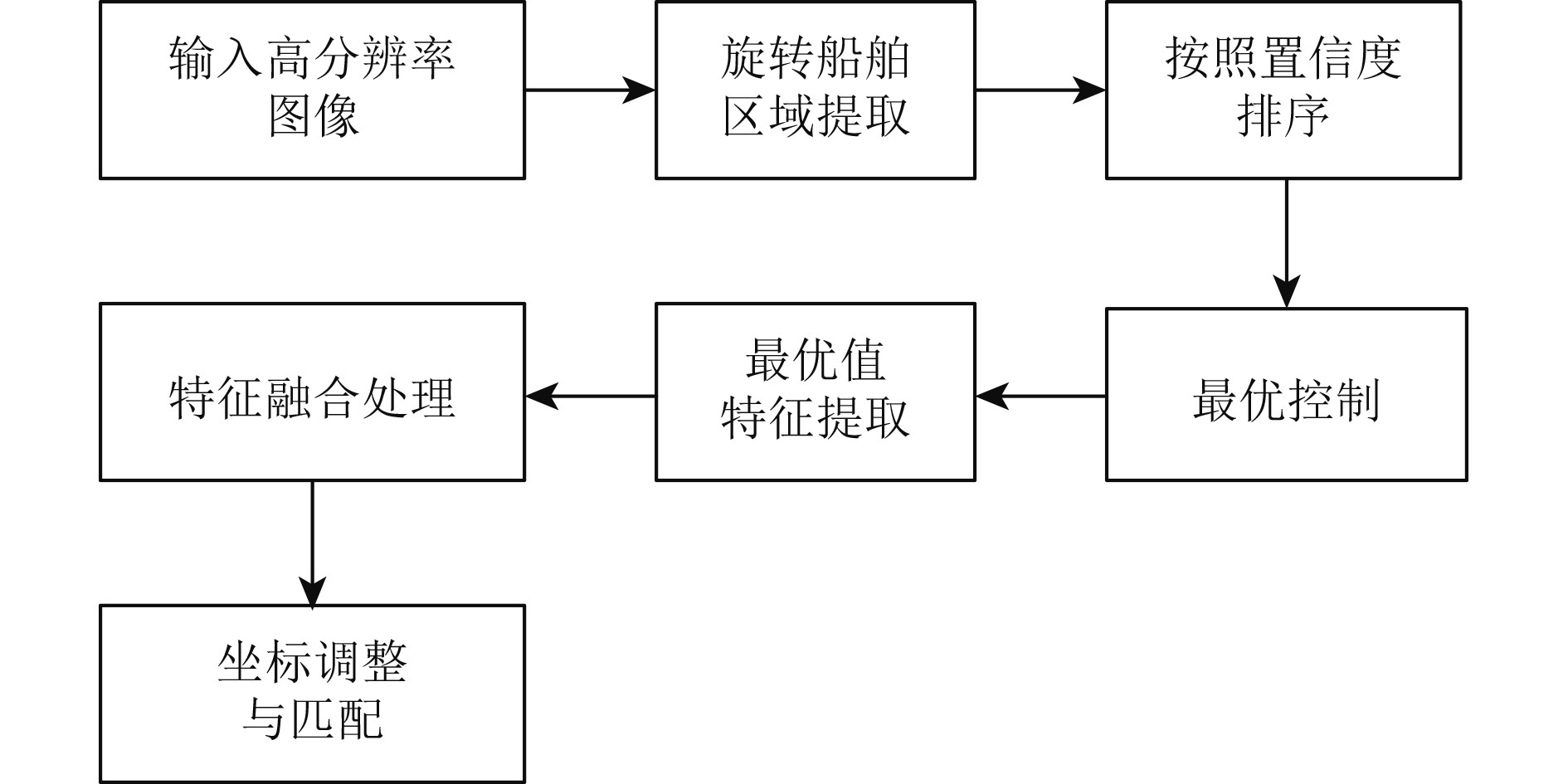

在分类子网络训练中,具体的训练检测流程如图1所示。通过主干检测网络输出检测框架,将检测框架作为训练样本,确定真实目标与样本目标的匹配程度,获取正负样本阈值,再引入第二阶段候选区域阈值,按照1∶3的样本比例推理分析,过滤掉背景不清晰的检测框,在级联分类器中输入池化提取特征值,最终得出倾斜抑制检测数据。

|

图 1 级联区域分类子网络的训练样本检测流程图 Fig. 1 Flow chart of training sample detection of cascaded area classification sub network |

为提高船舶图像细粒度检测识别能力,本文提出GAN辅助学习分类子网络作为判别器,共同训练检测图像,形成全连接神经网络,随机输入向量,通过线性变换向量,将向量拼接到类别标签上,再结合后续特征模仿获取目标区域深度抽象值。在分类子网络生成后,采用tanh激活函数,再引入仿射变换层,将真实样本和目标检测图像置于同一数据范围内,生成两个阶段的训练过程。具体包括:一是交替训练。在训练中运用辨别器和生成器,直接生成高质量抽象特征,迭代时随机执行多次梯度向量变化;二是固定生成器。对辨别器进行初始化,重新训练样本,迭代总步数等同于直接训练分类子网络[9-10]。

1.4 实验分析本文提出检测网络模型包含船舶目标的高分辨率遥感图像,对遥感图像进行细粒度标注,形成任意方向的倾斜标注框架,利用数据集图像识别检测舰船目标。本次实验数据来源于Google Earth数据库,共选取315张图像,高分辨率设定为1000~3000像素,尺寸为1500。处理原始图像,采用随机裁切、变化颜色、随机旋转等方式,增强数据特征值,去除偏离船舶中心的图像信息,获取有效训练样本4244张。

将所有船舶细分为25个细粒度,实验条件主要包括:旋转框预设尺度为64,128,256,512,尺度长宽比分别为3∶1,5∶1,7∶1,并从40°~125°范围内设置9个不同的旋转角。引入坐标量化误差,在计算采样点时引入浮点坐标,借助双线性插值计算获取采样值,提取出短边区域特征值。在第1阶段训练中,将正样本与真实目标框的角度设置为15°,真实目标的交并比均小于0.2,可以直接忽视训练值;在训练阶段中,训练批量设定为256,正负样本比例为1∶1,将池化区域缩小至10×5,全连接层单元数量为1024。

采用Caffe框架,实验环境包括以下方面:采用Linux操作系统,显卡选用GTX1080Ti,主干检测网络训练时的初始学习率为0.001,图像短边尺寸为640,算法迭代60000步,衰减共分为三次,分别为40000步、50000步、55000步、58000步。在级联的独立分类器中,训练周期包括30个,生成器主要通过4次迭代,优化一次判别器,共使用3张图像输出检测l结果。

本次船舶图像细粒度检测包括量化舰船识别结果,使用倾斜边界框测试影像,计算出平均精度,再根据置信度排序检测顺序,计算出样本目标与真实目标之间的差值,设置置信区间,得到更高的检测匹配数据,如果数据通过检测则用TP表示,不通过则用FP表示。实验后获取召回率、准确率和AP加权平均值。实验结果显示:本文提出分类子网络+GAN的召回率为0.750,准确率为0.808,AP加权平均值为0.644。这3项数值明显优于基准算法、Faster R-CNN算法得出的数据。

2 高分辨率遥感船舶图像细粒度检测识别框架 2.1 端到端的检测识别框架充分考虑近岸船舶目标角度分布特点,采用候选区域生成子网络,提取出大量候选目标值,对目标值筛选和排序,去除过度重叠的候选区域,再利用旋转区域池化模块,训练出局部和全局的特征值。最后,采用检测框坐标、目标分类方法和角度回归方程式,定位舰船目标,准确判断舰船类别。基于旋转候选区域的算法流程如图2所示。在该网络模块中,运用角度致密化策略生成候选区域,建立起区域插值池化模块,融合多种特征值,映射网络预测层的权重,满足端到端的训练要求。

|

图 2 方位敏感型插值区域池化模块图 Fig. 2 Pool module diagram of azimuth sensitive interpolation area |

在高分辨率遥感图像中,运用搜索空间离散化可以降低网络训练繁琐程序,促使空间尺度呈现出连续变化,使小尺度船舶目标比配到足够多的预设框。在相同幅度角度变化的情况下,小尺度舰船与预设框之间的关系更加敏感,可以针对所有尺度确定角度离散化密度,减少小尺度船舶细粒度检测疏漏问题。

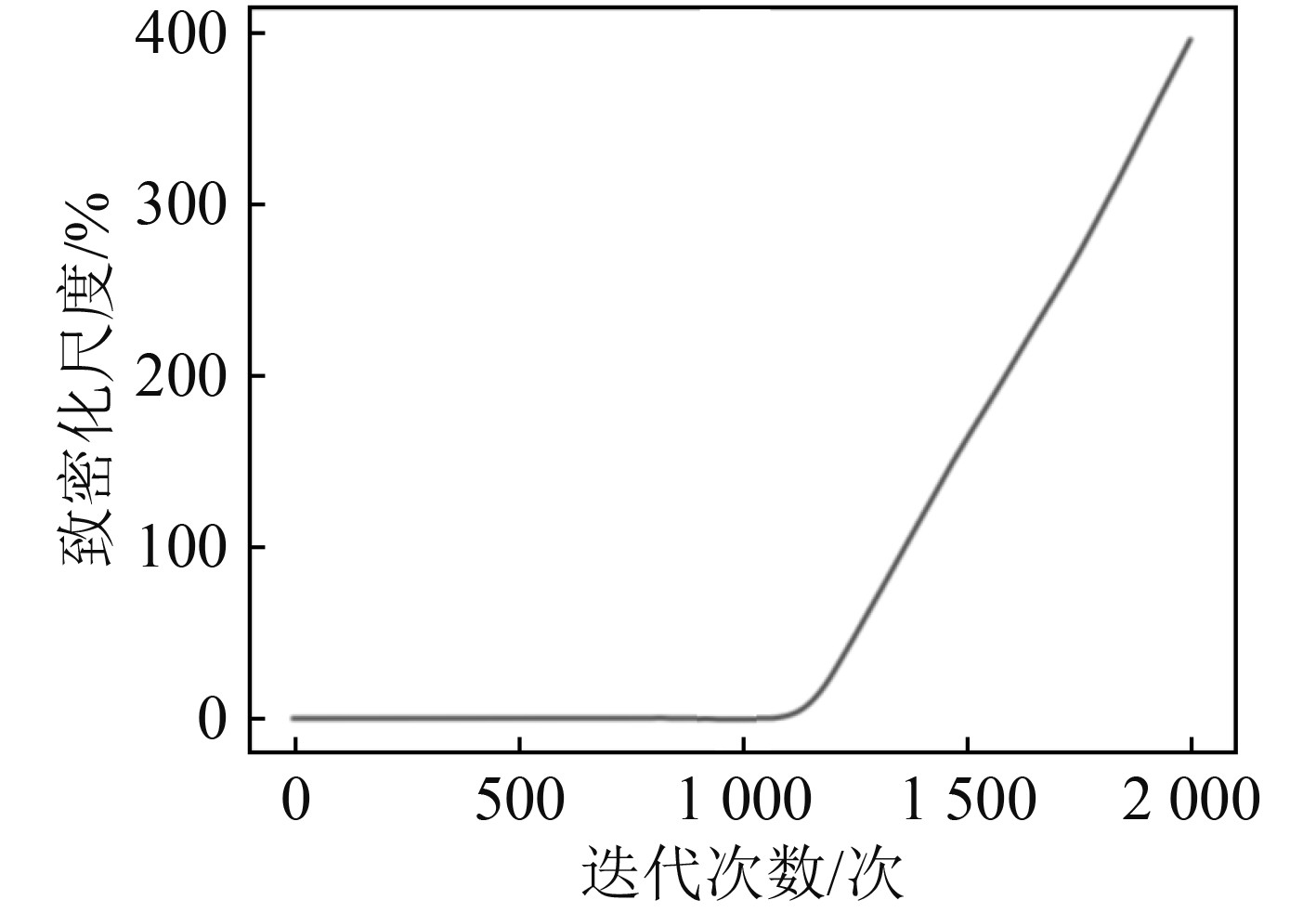

提出一种角度致密化预设框设置策略,将短边尺度最小的6个预设框角度增大一倍,采用角度致密化处理方式,匹配到预设框数据,提高舰船图像细粒度检测的准确性。短边船舶角度致密化尺度变化图如图3所示。

|

图 3 不同特征参数下的船舶目标样本分布情况 Fig. 3 Distribution of ship target samples under different characteristic parameters |

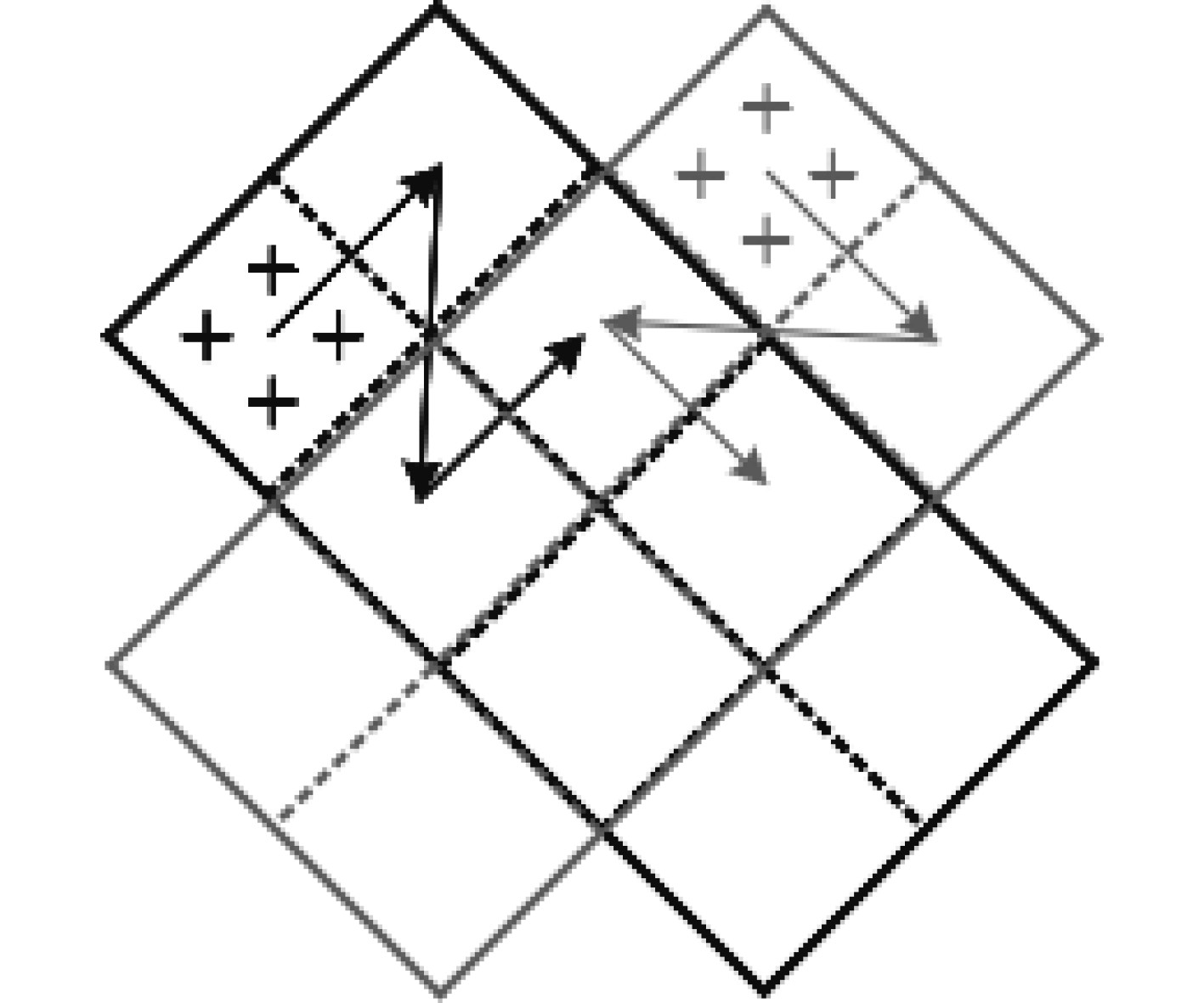

本文采用区域特征提取池化模块识别遥感图像细粒度,从两阶段目标网络检测中提取固定长度特征值,以适应候选区域多样化的角度分布变化。方位敏感型插值区域池化模块如图4所示,在任意方向的候选区域提取旋转变化值,通过不同位置信息将特征值输入到卷积通道中,显示出建模候选区域的位置差异,解决坐标整数误差较大的问题。本文提出的旋转区域池化模块算法,采用RPRA模式,可以准确定位到遥感图像的局部特征,其在细粒度检测中的应用优势体现在以下方面:每个格子的采样起始点、采样方向不会受到候选区域框架旋转的影响,能够保证算法优化结果的一致性;对长宽比较大的舰船目标检测,采用不规则采样方法,增加长轴方向样本采集密度;在不同通道内采集不同特征图的样本,建立起候选区域模型;采样过程中不能量化处理浮点计算过程,而是采用双线性插值方式得出采样特征值,有助于简化计算过程。

|

图 4 小尺度船舶目标角度变化幅度图 Fig. 4 Variation range of target angle of small-scale ship |

在近岸船舶目标数据集上训练经典目标检测框架,选取Faster R-CNN算法,并以此作为参考算法,加以计算,该算法检测的平均精度为57.3%。随机选取一个目标检测算法,对近岸的船舶进行检测,得到的平均精度为38.5%,由此可见,在近岸船舶检测中,参考算法Faster R-CNN的精度更高。保留池化分支,将RotateRoIPooling作为池化模块和基准算法,经过计算,其平均精度为51.8%,因该算法是通过倾斜边界框进行比对计算,所以在相同的阈值下,低于Faster R-CNN的精度,但与Faster R-CNN相比,框内的冗余信息和定位精度更高。在海面上的船舶目标长边尺寸长,短边尺寸短,由此使得池化模块提取特征时容易产生误差,为验证对采样点插值的必要性,将池化模块RotateRoIPooling替换为RotateRoIAlign,替换后的模型性能得到显著提升,检测的平均精度达到62%。

将RotateRoIAlign替换为RotatePsRoIAlign后比未替换前下降了3%,从而导致样本特征维度的数量级差距过大。RotateRoIAlign的样本参数量为31600,RotatePsRoIAlign的样本参数量为210,二者相差两个数量级,RotateRoIAlign的优势随之显现。为验证RotateRoIAlign的有效性,增加一组实验,即新增一个降维卷积层,使样本经池化模块后的特征数量达到一个量级。实验结果表明,RotateRoIAlign的性能与RotatePsRoIAlign接近一致。由此可见,池化模块RotateRoIAlign具有良好的特征提取能力。由于它所占用的模型参数量最低,因此在构建船舶局部特征模型的能力上优势更加明显。

算法性能的主要影响因素有样本数量、船舶尺寸以及类别判别的困难程度等。重点分析船舶尺寸大小与样本数量对算法性能的影响,原始训实例与对数平均尺度的指标分布图如图5所示。其中的数据点为某一类船舶的相关性能,算法难以检测到的类别有以下几种情况:样本数量少、类内差异大、与其他类差异小;算法容易检测到的类别则是尺度偏大且特征明显的样本。由此可以得出如下结论:检测性能与样本数量和船舶尺寸大小呈正相关。不同特征参数i0,mui(i=0,1,2,3,4,5,6)下的船舶目标样本分布情况如图6所示。综上,本次研究中选择的算法,在船舶检测与目标识别方面的检测率比较高,具有良好的使用价值。

|

图 5 短边船舶角度致密化尺度变化图 Fig. 5 Scale change diagram of angular densification of short side ship |

|

图 6 原始训实例(上)与对数平均尺度(下)的指标分布图 Fig. 6 Index distribution diagram of original training example and pair average scale |

在高分辨率遥感船舶图像中,准确检测出图像细粒度是分析遥感信息的关键环节。本文提出的基于深度学习方法的图像细粒度检测算法和框架体系具备一定技术可行性,通过构建起倾斜边界框的端到端检测识别框架,能够获取较为准确的细粒度检测结果。可将其推广应用到船舶目标检测领域,确保遥感图像检测适用于复杂多样的海况,提高遥感图像检测效率。

| [1] |

梁月翔, 冯辉, 徐海祥. 基于YOLOv3-tiny的船舶可见光图像细粒度检测[J]. 武汉理工大学学报:交通科学与工程版, 2020(6): 1041-1045,1051. |

| [2] |

徐芳, 刘晶红, 王宣. 等. 感图像海面船舶目标检测技术进展[J]. 光学精密工程, 2021(4): 916-931. DOI:10.37188/OPE.2020.0419 |

| [3] |

黄明晶, 王雪梅, 马蒙蒙. 基于海天线提取和混合灰度差的船舶检测方法[J]. 红外, 2021(6): 29-33. DOI:10.3969/j.issn.1672-8785.2021.06.006 |

| [4] |

睢丹 陈卫军. 船舶视觉图像优化检测方法研究[J]. 舰船科学技术, 2015(8): 157-160. DOI:10.3404/j.issn.1672-7649.2015.08.033 |

| [5] |

魏宏昌, 王志娟. 基于图像分割的船舶吃水深度检测方法[J]. 舰船科学技术, 2019(18): 31-33. |

| [6] |

彭将辉, 冉鑫. 基于图像处理的船舶吃水线检测方法[J]. 中国水运:下半月, 2012(6): 66-67. |

| [7] |

闫成章, 刘畅. 基于显著性的SAR图像船舶目标检测方法[J]. 中国科学院大学学报, 2019(3): 401-409. DOI:10.7523/j.issn.2095-6134.2019.03.014 |

| [8] |

张程, 张红, 王超. 基于PCDM香农熵的全极化SAR图像船舶目标检测方法[J]. 遥感技术与应用, 2018(3): 499-507. |

| [9] |

董众, 林宝军, 申利民. 一种基于图像显著性的离岸船舶目标检测效率优化方法[J]. 燕山大学学报, 2020(4): 418-424. DOI:10.3969/j.issn.1007-791X.2020.04.012 |

| [10] |

周雪珂, 刘畅, 周滨. 多尺度特征融合与特征通道关系校准的SAR图像船舶检测[J]. 雷达学报, 2021(4): 531-543. DOI:10.12000/JR21021 |

2022, Vol. 44

2022, Vol. 44