随着我国船舶产业规模逐渐扩大,随之而来的是对大量船舶的维护工作。由于船体长期工作会逐渐被海水腐蚀生锈,为了增加船舶使用的寿命,必须定期对船舶开展维护清污工作,以避免危险状况发生[1–2]。目前,修船时需要停航进入船坞,并对船体实施检测,由此会耽搁大量时间并耗费大量资金。

随着科技水平的进步,爬壁机器人已成为一种常用的自动化程度较高的装置[3– 4],已应用在高空作业的环境中,越来越受到人们的重视。从爬壁机器人的吸附方式上来看,主要有负压吸附和磁吸附2种,由于磁吸附式爬壁机器人具有适用于导磁性壁面、产生巨大的吸附力、不会受到壁面凸凹或裂痕的限制等特点,因此非常适合在船舶上被使用[5 – 6]。然而,目前爬壁机器人都是通过摄像头人工判别来对船壁进行监测,这会造成监测不全面和操作不灵活的弊端,不仅不能够保证船舶的航行安全,而且浪费了许多时间[7 – 10]。

针对上述问题,本文通过在视觉识别、图像处理和传输以及对机器人的控制优化等若干关键问题进行研究,研发出新一代具有自主知识产权且能够适应市场化应用的船用爬壁监测机器人。实验验证结果表明,该机器人可以实现对船身的受损处的实时监测,不仅提高了船舶的寿命和安全性,而且大大缩减了监测成本和时间。

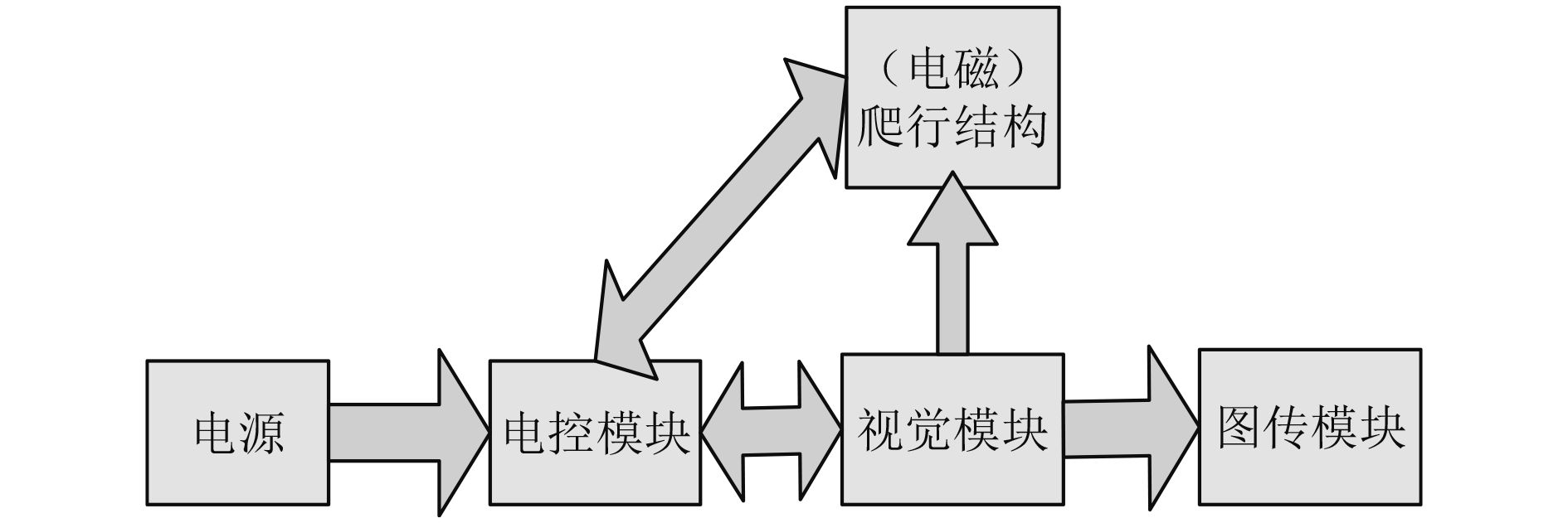

1 总体方案设计船用爬壁监测机器人主要由爬行机构、电控模块、视觉模块、图像处理与传输模块(图传模块)等几部分构成。爬行机构采用了自主设计的电控模块来控制机器人的爬行动作,电控模块采用了PWM脉宽调制技术来控制爬壁机器人的爬行速度和方向。视觉模块采用了双目视觉系统实现对机器人的运动轨迹和船体进行识别,并通过视觉识别技术对船舶进行自动监测。图像处理与传输模块是通过视觉摄像头对船体结构物进行识别和处理,也可以将图像信息传送到地面的上位机中,实现人工控制和监测。机器人总体系统结构图如图1所示。

|

图 1 系统结构图 Fig. 1 System structure diagram |

1)爬行机构

爬壁监测机器人需要满足2个必要条件:一是实现壁面吸附,二是实现移动动作。机器人常用的吸附方式有磁吸附、负压吸附和螺旋桨推压等方式。然而,船用爬壁监测机器人的吸附方式具有一定的特殊性,这就需要对各种吸附方式进行具体分析:负压吸附方式虽不受壁面材料的限制,但在凹凸不平的船体壁面,吸盘容易漏气,从而使吸盘的吸附力下降,载重能力降低;磁吸附主要有电磁体式和永磁体式2种吸附方式,虽然永磁体式吸附不会因断电而脱离船壁,但其控制方式较为复杂;相比较而言电磁体吸附方式不仅能够适应凹凸不平的壁面,其吸附力比负压吸附方式产生的吸附力大,不会存在吸附时漏气的问题,而且对其的控制较为简单,电磁体式吸附只需要借助电力来维持吸附力。因此,针对于船舶工业壁面材料都是带有导磁性的特定环境,最佳的选择使用方式是电磁体式吸附。本文研究的爬壁监测机器人在4个轮子中间被放置了6个磁铁,但与一般的磁吸附式爬壁机器人的不同之处是磁铁与船壁之间保持非接触状态,这样可以大大降低与壁面的摩擦力,使机器人减少了机械损耗和电损耗,并可通过实验设定磁铁距离壁面的最佳距离。

2)电控模块

船用爬壁监测机器人电控模块采用了STM32单片机作为主控芯片,实现对爬壁机器人的爬行控制;采用PWM脉宽调制技术来控制爬壁机器人的爬行速度和方向;使用L298N驱动模块分别控制大功率电机和控制电磁机构中吸附力的大小,通过产生足够的动力和相应的磁场来使机器人有足够的吸附力和动力,实现在船壁上运动。通过设置引脚控制机器人前进、后退,调节左右轮之间的速度差来实现转向功能以及电磁机构的吸附和释放的功能。除此之外,通过视觉模块将图像采集信息上传到上位机中,在完成路径规划后,控制电机实现机器人的运动和监测。

3)图像处理与传输模块

船用爬壁监测机器人图像处理与传输模块通过视觉摄像头对物体进行识别,再通过视觉系统进行图像采集,并将船体外部结构物的位置信息、形状和尺寸大小等信息进行处理,通过信息反馈通道送到主控板,主控板根据图像采集的位置信息进行定位操作,根据结构物的形状和尺寸大小进行相应的监测操作。另外,视觉模块采集的信息也可以传送到地面的上位机系统中,由地面人员根据图像进行相应的操作。

4)视觉模块

船用爬壁监测机器人采用了双目视觉系统,通过模拟人类视觉来实现计算机被动感知距离功能[11 – 12]。为了获取在不同视角下点的船体结构物图像,机器人从两点或者多点的角度观察一个物体状态。根据不同视角间的物体图像像素的匹配关系,运用三角测量原理计算出像素之间的偏移,来获取物体的三维信息。依据三维信息获取物体与相机之间的实际距离及实物三维形状和物体两点实际距离。机器人系统中通过物体三维识别算法,不仅可以获得物体被遮挡处的图像以及姿态变化,而且可以大大提高物体的识别率。

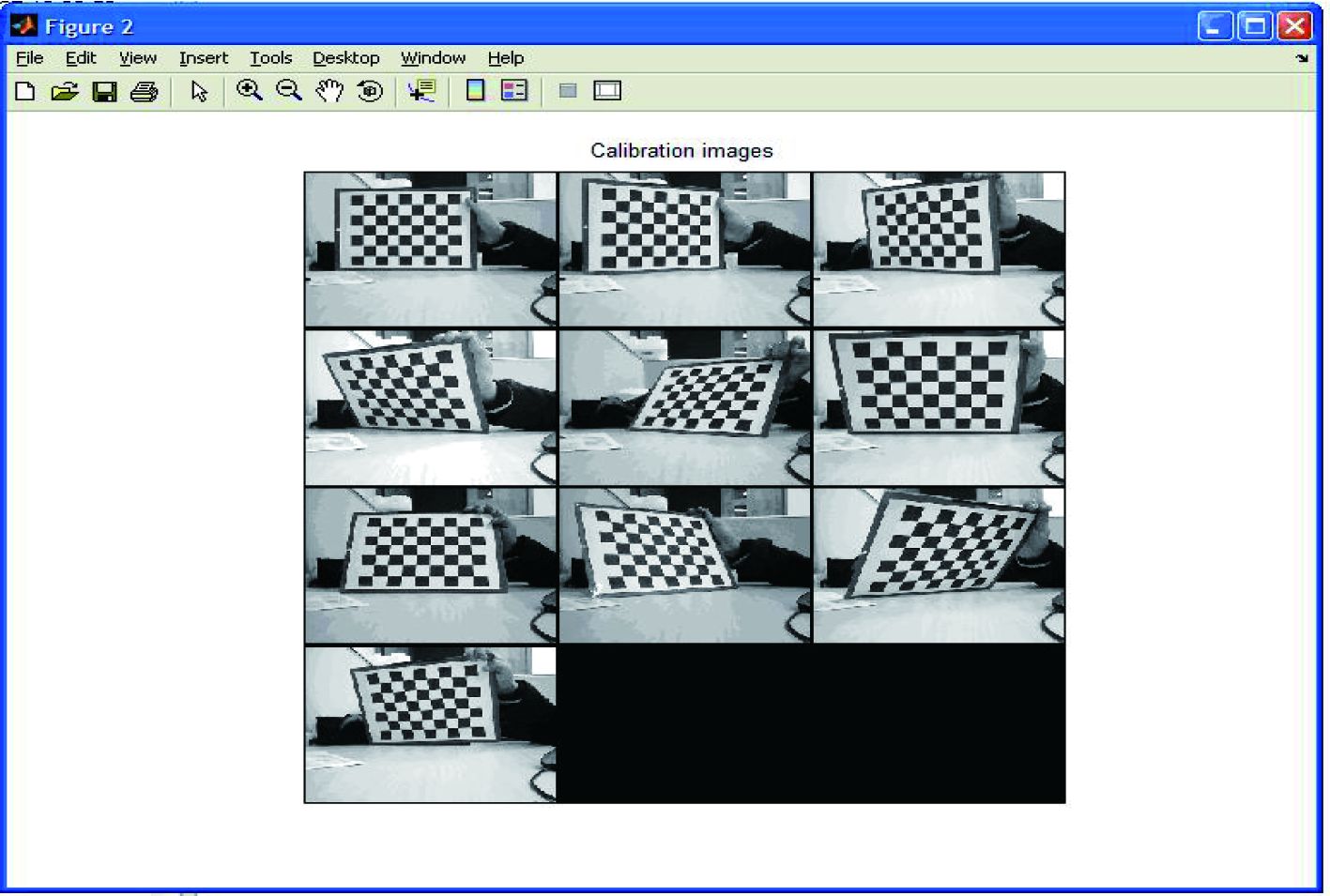

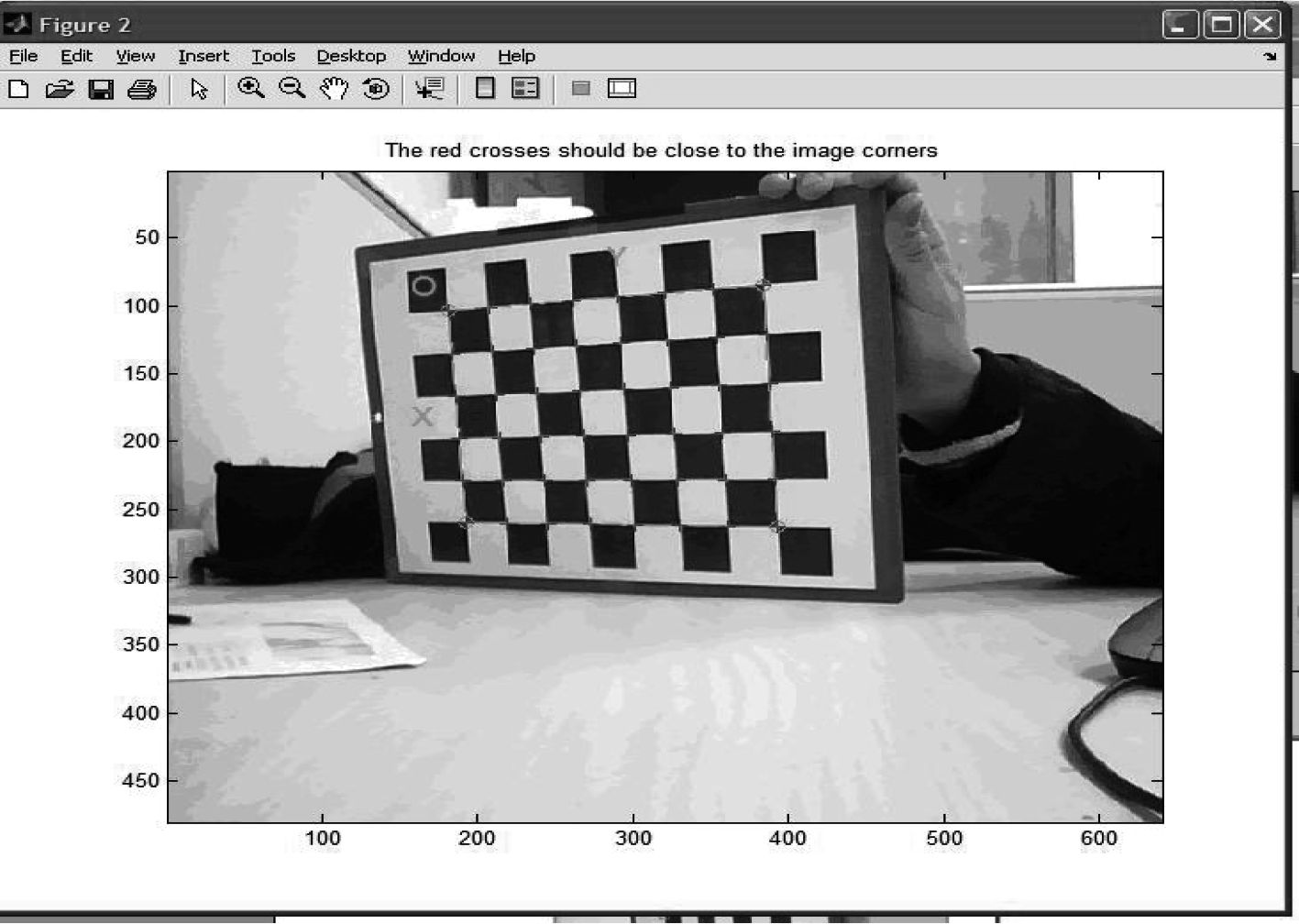

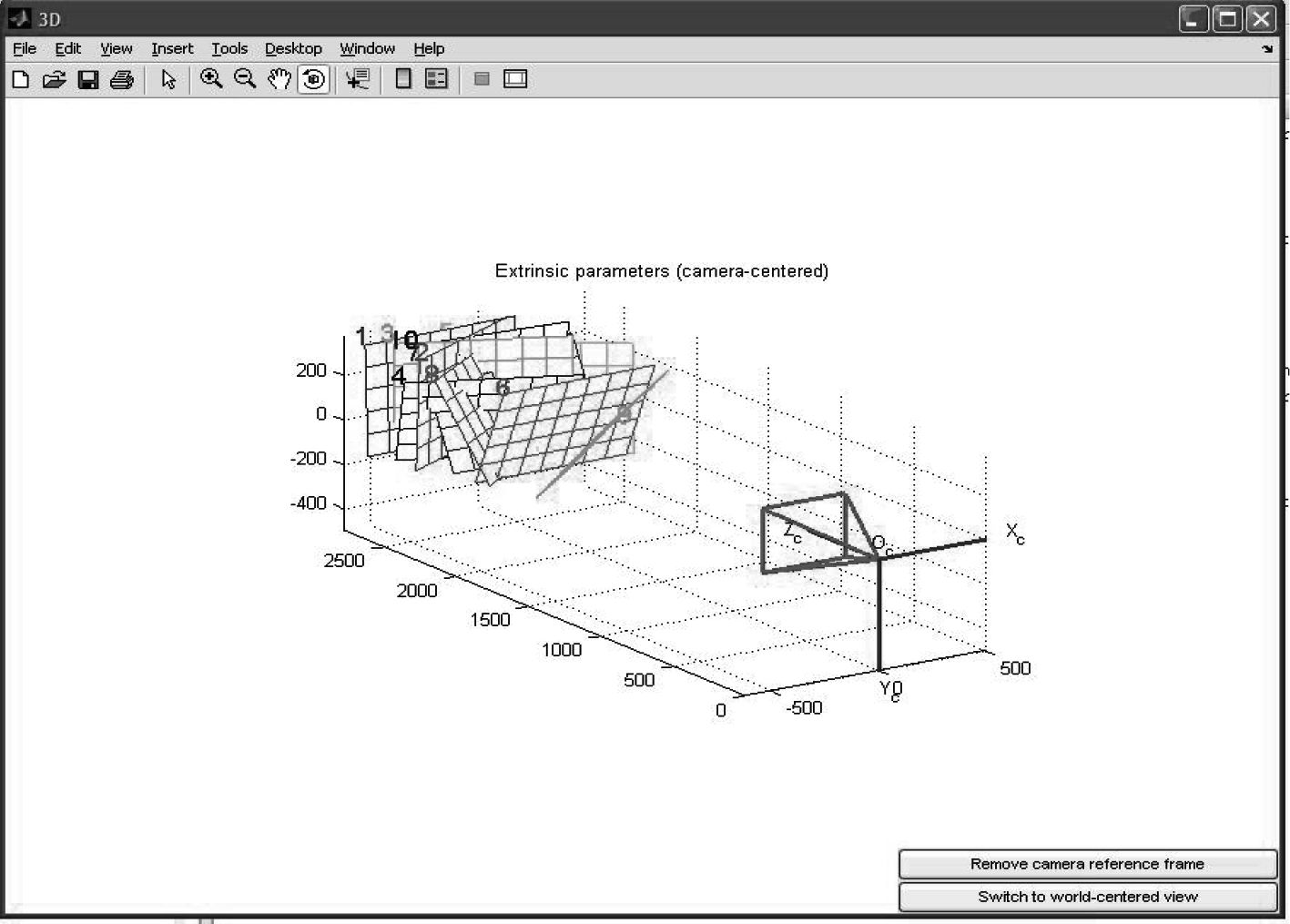

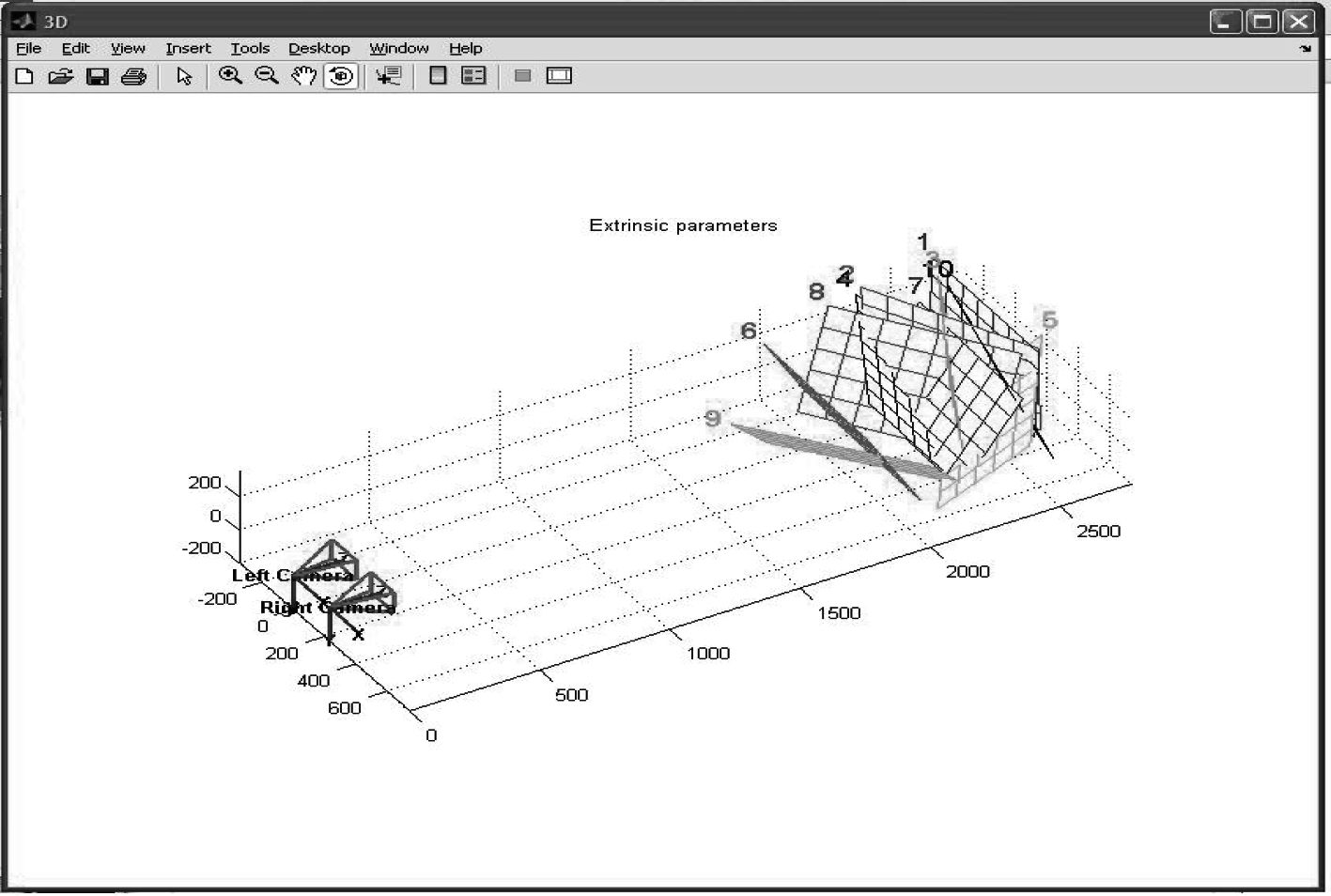

3 视觉系统测试系统图像采集使用双目摄像头通过使用Bouguet极线校正的Matlab标定工具箱进行立体标定,然后把标定后的数据读入OpenCV中,为后续的图像校准和匹配做准备。测试实验中通过右摄像头对棋盘图进行采集,将采集的结果复制到工具箱中。如图2所示,测试过程中读入了10幅棋盘图。再对棋盘最边上的点进行一定顺序的提取,通过程序自动找到所有对应的角点,如图3所示。最后通过摄像头对提取完10幅图提取的点进行标定,以此来验证标定外参数的结果,如图4所示。

|

图 2 棋盘图 Fig. 2 Chessboard image |

|

图 3 提取的角点 Fig. 3 Extraction of corner points |

|

图 4 标定结果的验证 Fig. 4 Verification of calibration results |

当验证标定结果没有错误存在时,按照上文同样的方法对左摄像头进行标定。当左右摄像头都标定完成之后,开始对其进行立体标定。图5所示为双摄像头立体标定图。

|

图 5 立体的标定 Fig. 5 Stereo calibration |

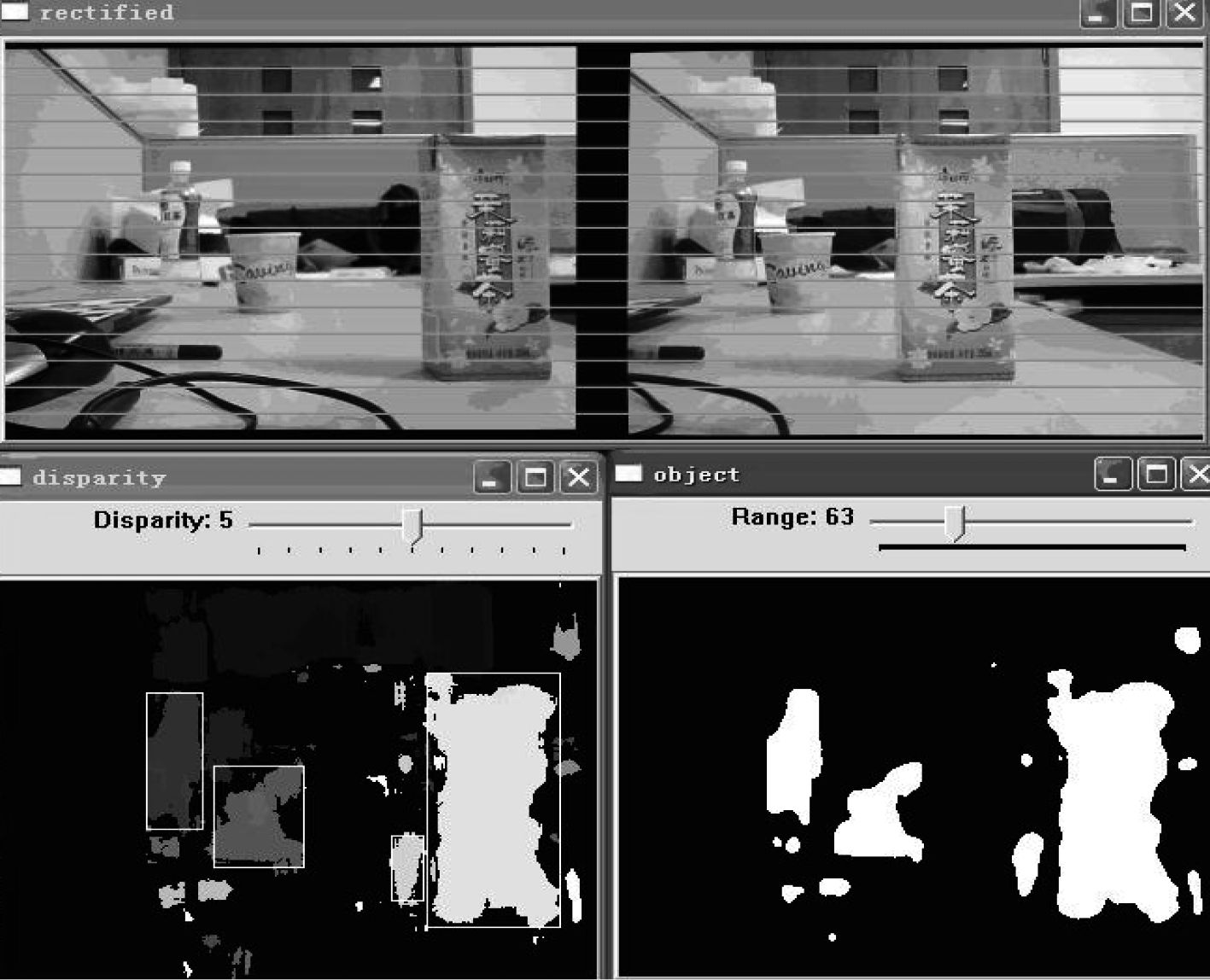

在通过以上操作获得立体标定参数之后,把立体标定的参数结果读入到OpenCV中,使用获得的校准参数来校准输入的左右图像。完成校准之后,还需要进行立体匹配。立体匹配OpenCV里面有2种方法,一种是Block Matching,一种是Graph Cut。由于Block Matching速度比较快,因此选择BM方法。由于2个摄像头是前向平行放置的,因此对同一物体的采集在左图中图像一定比在右图中图像偏右,如图6所示。

|

图 6 左右摄像头实物图 Fig. 6 Around the camera physical map |

为了测得实际距离,需要通过函数将单通道视差图转换成三通道的实际坐标矩阵。如图7和图8所示,可以测得数据如下:(267, 158)利乐包装盒的坐标是(13, 12, –156),(136, 142)纸杯的坐标是(77, 30, –314),(95, 116)塑料瓶的坐标是(143, 63, –481)。

|

图 7 实物距离测量实验 Fig. 7 Material object distance measurement experiment |

|

图 8 实物测量视觉处理 Fig. 8 Visual processing of real object measurement |

根据以上3个特征点的z坐标可以大致看出这3个物体的距离差大概是1:2:3,基本符合在实际场景中实物位置。因此,可以通过这种方法确定出物体的大致距离信息。

4 爬行实验船用爬壁监测机器人实物如图9所示。为了验证船用爬壁监测机器人主要功能,本文在船体模型上进行了爬壁监测机器人的监测实验。在船体模型的船壁上喷涂锈漆,然后进行机器人自动监测实验。通过爬壁监测机器人上摄像头的视觉识别,判断污损处的位置和形状大小。再通过图传模块将图像信息传送到上位机中,显示污损处的情况并记录污损处的位置信息和形状尺寸信息;通过射频技术控制爬壁监测机器人进行姿态调整和图像信息的传输。

|

图 9 爬壁监测机器人 Fig. 9 The wall-climbing and monitoring robot |

船用爬壁监测机器人监测路径图如图10所示。由图10实验监测路径可知,爬壁机器人通过左右移动来监测船体,以Z字形向下移动。由于船体一般是白色或者黑色的且铁锈和船身有颜色差,因此当船身由于腐蚀而产生的铁锈时,可由视觉系统判断出铁锈的位置。又由于视觉识别范围比较大,因此机器人在移动的过程中不会出现有污损处被遗漏识别的情况。当发现船体有被污损时,机器人将图像传到上位机并报警,等待操作人员进行处理。实验结果表明,爬壁监测机器人可以灵活地在船身上移动和进行图像的采集及处理,完全满足船舶监测的所需要求。

|

图 10 爬壁机器人监测路径 Fig. 10 Monitoring path of wall climbing robot |

本文研究了一种具有自主知识产权且能够适应市场化应用的船用爬壁监测机器人,设计了机器人爬行机构、电控模块、视觉模块、图像处理和传输等硬件模块,再对机器人双目视觉系统进行了测试和标定,并得到了实物测量物体的坐标值。实验结果表明,爬壁监测机器人能够有效实现船体的损伤监测功能。爬壁监测机器人的控制和监测方法也可以扩展到其他应用,如城市玻璃墙清洁和巡检机器人、喷涂清洁机器人无损检测等。

| [1] | 郭佳. 一种小型船检水下机器人控制系统[J]. 舰船科学技术, 2015, (4): 177–181. http://www.wanfangdata.com.cn/details/detail.do?_type=perio&id=jckxjs201504039 |

| [2] | 陈伟, 赵德安, 李发忠. 复杂曲面的喷涂机器人喷枪轨迹优化与试验[J]. 农业机械学报, 2011, (1): 204–208. http://www.cnki.com.cn/Article/CJFDTOTAL-NYJX201101042.htm |

| [3] | 周志琨, 杨淞. 壁面粘贴质量检测系统设计[J]. 上海交通大学学报, 2014, 48(11): 21–24. http://www.cnki.com.cn/Article/CJFDTOTAL-GZXB200909026.htm |

| [4] | 曾超, 蔡振雄. 船体遥控清污器方案研究[J]. 机器人技术与应用, 2012: 14–17. http://www.wanfangdata.com.cn/details/detail.do?_type=perio&id=jqrjsyyy201201005 |

| [5] | 岳荣刚, 王少萍. 基于混合整数线性规划的爬壁机器人路径规划[J]. 北京航空航天大学学报, 2013, 39(6): 792–797. http://www.wanfangdata.com.cn/details/detail.do?_type=perio&id=bjhkhtdxxb201306016 |

| [6] | 衣正尧, 弓永军, 王祖温, 等. 新型除锈爬壁机器人附壁建模与仿真[J]. 四川大学学报(工程科学版), 2011, 43(2): 211–216. http://www.cqvip.com/QK/90462B/201102/37227855.html |

| [7] | 李宝全, 方勇纯, 张雪波. 基于2D三焦点张量的移动机器人视觉伺服镇定控制[J]. 自动化学报, 2014, (12): 2706–2715. |

| [8] | LIU Yun-hui, WANG He-sheng, CHEN Wei-dong, et al. Adaptive visual servoing using common image features with unknown geometric parameters[J]. Automatica. 2013 (8): 2453–2460. |

| [9] | N. R. GANS, G. HU, J. SHEN, Y. ZHANG, W. E. DIXON. Adaptive visual servo control to simultaneously stabilize image and pose error[J]. Mechatronics. 2011 (4): 410–422. |

| [10] | HUANG C H, C S HSU, P C TSAI, et al. Vision based 3-DPosition control for a robot arm[C]//Systems, Man, and Cy-bernetics(SMC), 2011 IEEE International Conference: 1699–1703. |

| [11] | 刘美莲, 李爽. 远距离弱小目标视觉测量系统探测能力模型研究[J]. 科技通报, 2012, (08): 177–180. http://www.cnki.com.cn/Article/CJFDTOTAL-KJTB201208060.htm |

| [12] | 邱雪娜, 刘士荣. 基于序贯检测机制的双目视觉运动目标跟踪与定位方法[J]. 机器人, 2011, (02): 181–190. http://www.cnki.com.cn/Article/CJFDTOTAL-JQRR201102010.htm |

2018, Vol. 40

2018, Vol. 40