2. 上海中医药大学中医智能康复教育部工程研究中心,上海 201203;

3. 同济大学附属上海市肺科医院超声科,上海 200092;

4. 海军军医大学(第二军医大学)海军医学系医工交叉协同创新中心,上海 200433

2. Engineering Research Center of Intelligent Rehabilitation of Traditional Chinese Medicine, Ministry of Education, Shanghai University of Traditional Chinese Medicine, Shanghai 201203, China;

3. Department of Ultrasound, Shanghai Pulmonary Hospital, Tongji University, Shanghai 200092, China;

4. Medical and Industry Collaborative Innovation Center, Faculty of Naval Medicine, Naval Medical University (Second Military Medical University), Shanghai 200433, China

急性呼吸窘迫综合征(acute respiratory distress syndrome,ARDS)是ICU最常见的急危重疾病,病死率高达27%~45%[1]。目前,ARDS的诊断主要依靠影像学检查,但作为金标准的肺部CT检查并不能满足重症患者避免转运和辐射损伤的临床需求[2-3]。近年来,肺部超声已被证明是ICU最具革命性的诊断工具之一,其根据肺内不同病变组织气液比例的不同而显示不同的征象,包括A线、B线、肺实变、胸腔积液等[4]。基于以上连续征象谱及胸膜滑动,可以明确一系列临床表现,包括正常形态、间质综合征、胸腔积液、肺实变及气胸[5]。此外,肺部超声检查不仅可由超声医师进行,也可由ICU医师在床边常规进行,不仅提供了可用于诊断和治疗的肺部信息,还能满足急危重症患者的就地操作需求[6],对ARDS有明显的诊断优势。然而,肺部超声非常依赖医师的操作和经验,开展肺部超声前需进行图像获取和图像解释的技术培训[7]。目前在临床实践中,对肺部超声征象的图像解释基本依赖于超声医师对肺部超声影像的主观认识[8],超声图像的分类对临床医师的经验依赖性较高,存在医师间的解释差异性,不具有通用性,无法自动完成[9]。因此,如何让临床医师通过超声结果快速判断患者病情是亟待解决的临床问题。

近几十年,用于医学图像分类识别的图像处理技术得到了快速发展,借助计算机辅助方法可以提高医师的诊断效率。目前医学超声图像的分类方法大致分为2类:一类是基于传统的机器学习算法,即对超声图像中的病理区域进行形态、纹理等特征提取,然后使用随机森林、支持向量机等分类器进行分类[10]。Marosán-Vilimszky等[11]首先对超声图像进行了分割,然后从分割区域提取的93个特征中选择62个特征用以训练支持向量机分类器进行多分类。Sohail等[12]将直方图与灰度共生矩阵的统计纹理相结合作为超声图像分类的特征,然后应用k-最近邻分类技术对图像进行分类。以上机器学习方法虽然取得了良好结果,但需要人为地进行特征提取和特征选择,这一过程耗时、费力。另一类是借助深度学习方法。近年,将深度学习等计算机辅助方法应用于肺部超声图像处理受到了很多学者和医师的关注,有学者分别采用监督和弱监督的方法对肺部超声图像和视频中是否有胸腔积液进行分类[13],或借助深度学习算法对超声图像中的B线是否存在进行分类评估[14]。使用深度学习方法和肺部超声技术对新型冠状病毒肺炎的检测和等级分类也取得了显著成果[15]。以上方法大多针对肺部超声的单一征象进行分类,而在临床上肺部征象往往相伴出现。因此,本研究使用深度学习方法对肺部超声图像的4种常见征象(A线、B线、肺实变、胸腔积液)进行分类,并与专业医师的人工分类诊断结果进行比较。

1 资料和方法 1.1 数据采集前瞻性收集2020年6月至9月在同济大学附属上海市肺科医院超声科行超声检查的3 966例患者的超声图像,分别采集A线、B线、胸腔积液、肺实变的肺部超声图像各1 500张。图像排除标准:(1)1张图像中同时存在2个或2个以上肺征象; (2)因骨骼遮挡导致图像不完整或有缺失者。最终入选A线图像1 388张、B线图像1 375张、胸腔积液图像1 384张、肺实变图像1 398张。使用LOGIQ E9型彩色多普勒超声诊断系统(美国GE公司)进行肺部超声检查,配备凸阵探头,频率为2.8~5.0 MHz,调整焦点和深度(8~10 cm),选择最佳声窗显示目标图像。由2位有5年以上肺部超声经验的超声医师进行超声检查及图像采集。患者取平卧位或坐位,以腋前线、腋后线和脊柱旁线为界,将患者每侧肺分为前胸、腋下和背部3个区域,两侧肺脏即被分为6个区域。超声探头垂直于患者胸壁,平行肋间隙横切,同一部位做连续性扫查。每例患者扫查6个肺区,观察每个肺区是否存在典型的A线、B线、肺实变、胸腔积液超声征象(图 1),若有则采集1张该区的最典型图片。将经过筛选的5 545张图像作为数据集输入卷积神经网络,图像事先由3名有5年临床超声工作经验的超声医师进行标注。数据集按6∶2∶2比例划分为训练集、验证集和测试集,测试集是完全独立于训练集和验证集的数据样本,仅用于对模型泛化能力进行测试,不参与模型的训练过程。

|

图 1 4种常见肺征象的超声图像 Fig 1 Ultrasound images of 4 common lung signs A: A lines (arrows). High echo artifact parallel to the pleural line, transverse, equidistant, with decreasing echo intensity. B: B lines (arrows). A laser beam from the pleural line that extends vertically to the edge of the screen without attenuation and moves back and forth with breath. C: Pleural effusion (arrow). Separation of visceral and parietal pleura, anechoic area between them, enhanced echo behind. There is a large effusion of compressed lung tissue floating in the effusion. D: Lung consolidation (arrow). When large areas of lung are consolidated, the consolidated lung tissue presents soft tissue echoes resembling liver parenchyma. The consolidation of small pieces of lung is characterized by irregular fragmentary strong echo, or "fragmentary sign". |

1.2 图像预处理

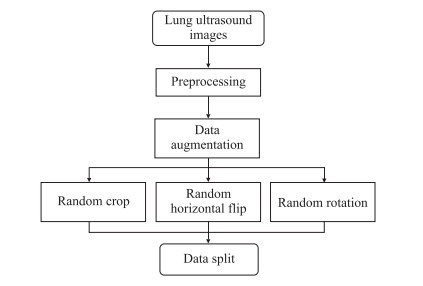

图像预处理流程见图 2,主要有3个步骤:(1)对原始图像进行预处理,裁剪掉一些无用信息。(2)进行数据增强处理,扩充数据集。(3)为了保证数据样本之间的相对独立性和数据集之间的独立性,对数据集进行随机划分。

|

图 2 肺部超声图像预处理流程图 Fig 2 Preprocessing procedure of lung ultrasound images |

医院采集的肺部超声图像包含有采集日期、时间、机器型号等信息,这些信息对于网络学习而言属于无用信息。为了避免模型学习到无用特征,因此首先对图像进行预处理。原始图像被统一裁剪,只保留图片中的有用信息。对裁剪完成的图像在送入模型训练之前进行数据增强和数据划分。本研究使用的数据增强方法包括填充后裁剪、概率水平翻转和随机旋转。图像被随机划分为60%的训练集(3 433张)、20%的验证集(1 056张)和20%的测试集(1 056张)。

基于端到端的深度残差网络ResNet152对肺部超声4种征象图进行分类。为了提高分类模型的泛化能力、防止过拟合,通过图像预处理、数据增强、归一化处理等方式对实验数据进行处理。模型开始训练之前,为了防止过拟合及提高模型的鲁棒性,进行了数据增强:(1)图像四周填充后随机裁剪; (2)图像以50%的概率水平翻转; (3)图像随机旋转一定角度。

在数据采集保存过程中,前后相邻的2张图像相似性很高。为了避免将大量相似度很高的图像分别作为训练集和验证集而导致模型训练过程中在验证集上取得很高分数的情况,本研究使用了随机划分数据集验证的方法,按照一定比例从整个数据集中随机挑选出验证集。从裁剪完成的图像集中随机采样出20%的图像作为验证集,20%作为测试集,其余作为训练集。

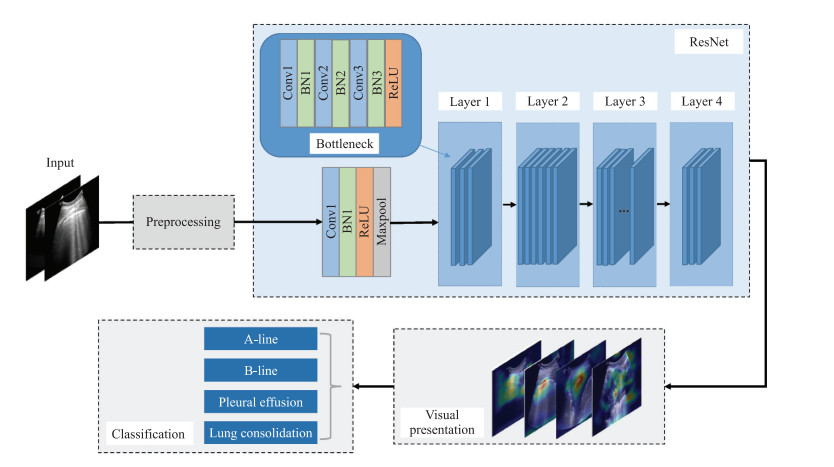

1.3 卷积神经网络本研究提出的基于深度残差网络ResNet152[16]的肺部超声4种征象分类方法步骤如下:(1)对肺部超声图像进行预处理,进行数据增强以防止过拟合; (2)完成基于图像对残差网络的设计; (3)网络中各层权重累加,实现分类。深度学习网络主要分为连接模式、非线性模块、优化器、损失函数及超参数。连接模式包括卷积、池化、残差、全连接等,这些结构相互连接构成了神经网络的基本框架。原始图像经过卷积、池化、全连接等一系列操作后,可以将图像中的语义信息逐层提取出来[17]。非线性模块的存在使多层神经网络可以无限逼近最终函数,常见的非线性模块有tanh、sigmoid、ReLU。本研究使用的ReLU是目前应用最广的激活函数之一。优化器、损失函数和超参数是为了提高学习性能和效果而对网络进行的设置。本模型是使用Python 3.6软件通过PyTorch环境在内存为12 GB的计算机上训练得到。基于Adam优化器进行训练,采用ReLU激活函数和交叉熵损失函数,学习率参数设置为0.01。

本研究应用了深度残差网络ResNet152[16],它借助残差设计,打破了深度神经网络的深度限制。残差设计是指跳过多层进行连接,简单执行恒等映射,将输出添加到残差函数的输出。这样可以有效避免因为神经网络层数加深而引起的梯度消失和梯度爆炸问题,在保证网络深度的同时,不会增加额外的参数和网络的计算复杂度。深度学习因其端到端的特征且学习过程不可现而被称为“黑匣子”,本研究为了提高模型的可解释性,对模型进行了可视化展示,其中ResNet部分是深度残差网络ResNet152的基本网络结构(图 3)。每种残差网络ResNet(如ResNet18、ResNet50、ResNet152)都有4个layer,ResNet152作为深层网络由“Bottleneck”组建而成,其中每个layer都由若干个块搭建而成。池化层采用的平均池化将自适应平均池化层改成平均池化层,可以实现在改变输入大小的同时保证输出特征大小相同。原始自适应平均池化操作事先定义了输出的大小,而更改后的版本只是将输入特征根据核大小及步幅进行池化操作。通过获取各个网络层中特征图对应的权重并将其加权求和,最后在原图上进行叠加。热力图可以直观地展示网络识别该类图片的关注区域,彩色的区域即为类别相关的区域,颜色越深表明对应区域权重被激活的越多。

|

图 3 整体网络架构示意图 Fig 3 Diagram of overall network architecture Conv: Convolution; BN: Batch normalization; ReLU: Rectified linear unit. |

1.4 分类评价标准

以超声医师的分类结果为金标准,计算精确率、准确度、特异度、召回率和F1指数,评估分类模型的分类性能。精确率(%)=真阳性图像数/(真阳性图像数+假阳性图像数)×100%;准确度(%)=(真阳性图像数+真阴性图像数)/总图像数×100%;特异度(%)=真阴性图像数/(真阴性图像数+假阳性图像数)×100%;召回率(%)=真阳性图像数/(真阳性图像数+假阴性图像数)×100%;F1指数(%)=2×精确率×召回率/(精确率+召回率)。

精确率等指标多用于二分类,多分类是基于二分类针对每个类别分别计算相应的值,然后进行加权平均得到的计算结果。除了上述传统统计学计算分类模型分类性能外,还计算了以下直接定义和衡量多分类效果的指标。

(1) Kappa系数。Kappa系数是基于混淆矩阵计算得到的模型评价参数,是一种一致性检验指标。通常Kappa系数取值为0~1,取值越接近1表明一致性越高,其中Kappa系数为0.00~0.20表示一致性极低,0.21~0.40表示一致性一般,0.41~0.60表示一致性中等,0.61~0.80表示高度一致性,≥0.81表示几乎完全一致。Kappa系数值越高,模型的分类准确度越高。计算公式如下:

|

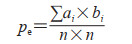

其中,p0是4个类别中每一类正确分类的样本个数除以总样本个数的值,即总体分类精度。pe是每个类的真实样本个数和预测出的该类样本个数的乘积和与总样本个数乘积的比值,计算公式如下:

|

其中a是每一类的真实样本个数; b是预测出的每一类的样本个数; n是总样本个数; i是类别数,本研究中i的值为4。

(2) 混淆矩阵。混淆矩阵作为一种可视化的工具,可以直观反映模型的分类结果。混淆矩阵的每一列代表了该类的预测情况,每一行代表了实际的类别标签; 每一行的加和表示该类别的真实样本个数,每一列的加和代表被预测为该类别的样本个数; 对角线上的颜色越深说明对应的类预测正确的样本个数越多。

2 结果为了评价深度学习模型并反映分类性能,本研究记录了真实标签和模型实际预测的结果,并以矩阵的形式进行汇总。该深度分类模型分类A线、B线、胸腔积液和肺实变的准确度、特异度、F1指数及Kappa系数见表 1。其中,该深度分类模型分类A线、B线、胸腔积液和肺实变4种征象的精确率分别为97.51%、87.31%、85.42%、93.70%,召回率分别为90.38%、86.97%、94.25%、91.18%。经过训练,模型的最终准确度为90.70%,其中A线、B线、胸腔积液和肺实变的分类准确度分别为96.97%、93.66%、94.41%和96.02%。该深度分类模型的Kappa系数为0.873 7,说明训练的模型与人工分类具有很好的一致性。

|

|

表 1 深度学习模型对肺部超声4种征象的分类性能 Tab 1 Classification performance of deep learning model for 4 signs on lung ultrasound images |

该深度学习模型分类肺部超声4种征象的混淆矩阵如图 4所示,第1行中有237张图片被模型预测成A线,有16张A线被错误预测成了B线,有11张A线被错误预测成了胸腔积液。如混淆矩阵所示,B线的预测效果与其他3个类别相比较差,即B线类可能会被预测为其他3个类别。但A线不会被预测为肺实变,胸腔积液和肺实变不会被预测为A线,即A线、胸腔积液、肺实变3个类别独立可分性更高。

|

图 4 深度学习模型分类肺部超声4种征象的混淆矩阵 Fig 4 Confusion matrix of deep learning model for classification of signs of lung ultrasound A: A line; B: B line; PE: Pleural effusion; LC: Lung consolidation. |

3 讨论

肺是一个富含气体的器官,可以阻挡超声波传播,既往曾一直被认为是超声检查的禁区。然而研究发现超声在正常肺和病理肺之间可产生不同的征象[4],这种现象被认为是不同病理条件下肺内气液比变化的结果。肺部超声的4种常见征象A线、B线、肺实变和胸腔积液已被广泛用于各种肺部疾病的临床诊断,包括气胸、心源性肺水肿、肺部感染、肺部肿瘤、创伤后血胸及急性大面积肺栓塞等,并且具有良好的灵敏度和特异度[18]。目前对肺部超声征象的图像分类和解释主要依赖超声医师的主观认识[8]。本研究提出了一种新颖、有效的方法,可以根据肺部超声图像自动解读特征,并取得了较高的特征分类准确度。这能够有效降低对医师经验的依赖,减小不同医师间的解释差异性。本研究提出的方法结合BLUE协议[19]可以帮助临床医师快速、准确地筛查急性呼吸困难的病因。

本研究将深度学习应用于肺部超声图像分类,通过数据分析发现借助深度学习方法建立的模型具有很高的准确度和特异度,深度学习模型可以辅助超声医师做出诊断。本研究以医师分类结果作为标签,供深度学习模型进行学习。与专业医师的读图分类相比,深度学习方法的整体分类准确度较高。同时,深度学习模型可以通过卷积、池化等操作从训练数据中学习像素级的特征信息,且无须手动选择特征[20]。借助深度学习辅助技术可以避免超声医师经验对诊断结果的影响,为临床医师的分类诊断提供参考; 有助于将专业影像医师从重复繁杂的工作中拯救出来,优化工作流程,提高工作效率。本研究使用了ResNet152网络结构,该结构采用残差结构设计,获得很深网络层数的同时取得了很好的网络效果。残差设计在神经网络进行特征提取的过程中可一定程度起到信息补充的作用,同时不会增加额外的参数和网络的计算复杂度,该网络在很多图像分类领域中得到应用。

本研究存在以下局限性:(1)本研究为单中心设计,超声仪器和扫查方式不同可能会导致图像质量有所差异,未来还需要在不同中心、不同质量的图像数据集上验证深度学习方法的性能。(2)本研究评估的每张图像只包含单个肺部超声特征,并没有涵盖多个常见特征的情况,今后仍需进一步完善。(3)虽然本研究中的4种肺部超声征象代表了大部分肺部超声征象,但其他征象在诊断特定疾病时仍可能发挥重要作用。(4)本研究使用的是单张静态超声图像,而超声视频序列可能会反映更多的信息。(5)本研究仅对肺部超声4种常见征象的图像进行了初步分类,并未将患者临床资料纳入研究,未来需要设计更详实的研究方案以解决临床问题。在深度学习算法方面,未来可以使用迁移学习策略或改进网络参数(如使用其他损失函数)提高模型的创新性。借助3D卷积神经网络捕获视频中的时间和空间特征信息。同时在多个超声仪器采集的数据上进行学习训练,使模型的泛化能力得到进一步提升。

综上所述,本研究探究了深度学习在肺部超声图像应用中的可能性和价值,基于神经网络的深度学习模型在肺部超声4种征象分类任务中取得了良好的预测精度和令人满意的分类结果。借助计算机辅助技术可以缩小临床医师对肺部疾病诊断能力的差异,提高诊断效率,为实现均质化的高质量诊断提供了一种新方法。

| [1] |

王行行, 王导新. NETs与急性呼吸窘迫综合征的研究进展[J]. 基础医学与临床, 2021, 41: 1047-1051. DOI:10.3969/j.issn.1001-6325.2021.07.022 |

| [2] |

胡泊, 李晓东, 李甜, 刘敬禹. 功能残气量与肺部超声评分的相关性及其对急性呼吸窘迫综合征俯卧位通气治疗的预测价值[J]. 中国急救医学, 2021, 41: 46-51. DOI:10.3969/j.issn.1002-1949.2021.01.009 |

| [3] |

MAZZEI M A, GUERRINI S, CIOFFI SQUITIERI N, FRANCHI F, VOLTERRANI L, GENOVESE E A, et al. Role of computed tomography in the diagnosis of acute lung injury/acute respiratory distress syndrome[J]. Recenti Prog Med, 2012, 103: 459-464. |

| [4] |

MOJOLI F, BOUHEMAD B, MONGODI S, LICHTENSTEIN D. Lung ultrasound for critically ill patients[J]. Am J Respir Crit Care Med, 2019, 199: 701-714. DOI:10.1164/rccm.201802-0236CI |

| [5] |

CHIUMELLO D, UMBRELLO M, SFERRAZZA PAPA G F, ANGILERI A, GURGITANO M, FORMENTI P, et al. Global and regional diagnostic accuracy of lung ultrasound compared to CT in patients with acute respiratory distress syndrome[J]. Crit Care Med, 2019, 47: 1599-1606. DOI:10.1097/CCM.0000000000003971 |

| [6] |

BOUHEMAD B, ZHANG M, LU Q, ROUBY J J. Clinical review: bedside lung ultrasound in critical care practice[J/OL]. Crit Care, 2007, 11: 205. DOI: 10.1186/cc5668.

|

| [7] |

ROUBY J J, ARBELOT C, GAO Y Z, ZHANG M, LV J, AN Y Z, et al. Training for lung ultrasound score measurement in critically ill patients[J]. Am J Respir Crit Care Med, 2018, 198: 398-401. DOI:10.1164/rccm.201802-0227LE |

| [8] |

李鹏, 张金会, 吴珊珊, 栗建辉, 龙晓雪, 申文增. 危急重症患者的肺超声检查[J]. 国际呼吸杂志, 2020, 40: 1354-1360. DOI:10.3760/cma.j.cn131368-20200624-00543 |

| [9] |

冷丽丽, 王珍, 吴碧君, 崔楠, 邱含飞. 肺超声检查在评估急性呼吸窘迫综合征患者严重程度及预后中作用[J]. 中国超声医学杂志, 2020, 36: 785-788. DOI:10.3969/j.issn.1002-0101.2020.09.005 |

| [10] |

任丽, 刘洋洋, 童莹, 曹雪虹, 吴意贇. 乳腺肿瘤超声图像的多特征提取及分类研究[J]. 中国医疗器械杂志, 2020, 44: 294-301. DOI:10.3969/j.issn.1671-7104.2020.04.003 |

| [11] |

MAROSÁN-VILIMSZKY P, SZALAI K, HORVÁTH A, CSABAI D, FÜZESI K, CSÁNY G, et al. Automated skin lesion classification on ultrasound images[J/OL]. Diagnostics (Basel), 2021, 11: 1207. DOI: 10.3390/diagnostics11071207.

|

| [12] |

SOHAIL A S M, BHATTACHARYA P, MUDUR S P, KRISHNAMURTHY S, GILBERT L. Content-based retrieval and classification of ultrasound medical images of ovarian cysts[C]//Artificial Neural Networks in Pattern Recognition, 4th IAPR TC3 Workshop, ANNPR 2010, Cairo, Egypt, April 11-13, 2010. Proceedings. Berlin Heidelberg: Springer-Verlag, 2010: 173-184.

|

| [13] |

TSAI C H, VAN DER BURGT J, VUKOVIC D, KAUR N, DEMI L, CANTY D, et al. Automatic deep learning-based pleural effusion classification in lung ultrasound images for respiratory pathology diagnosis[J]. Phys Med, 2021, 83: 38-45. DOI:10.1016/j.ejmp.2021.02.023 |

| [14] |

CRISTIANA B, GRZEGORZ T, SEUNGSOO K, KATELYN M, RACHEL L, MELISSA M S, et al. Automated lung ultrasound B-line assessment using a deep learning algorithm[J]. IEEE Trans Ultrason Ferroelectr Freq Control, 2020, 67: 2312-2320. DOI:10.1109/TUFFC.2020.3002249 |

| [15] |

LA SALVIA M, SECCO G, TORTI E, FLORIMBI G, GUIDO L, LAGO P, et al. Deep learning and lung ultrasound for COVID-19 pneumonia detection and severity classification[J/OL]. Comput Biol Med, 2021, 136: 104742. DOI: 10.1016/j.compbiomed.2021.104742.

|

| [16] |

HE K M, ZHANG X Y, REN S Q, SUN J. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas, Nevada: IEEE, 2016: 770-778.

|

| [17] |

周涛, 霍兵强, 陆惠玲, 任海玲. 残差神经网络及其在医学图像处理中的应用研究[J]. 电子学报, 2020, 48: 1436-1447. DOI:10.3969/j.issn.0372-2112.2020.07.024 |

| [18] |

SEKIGUCHI H, SCHENCK L A, HORIE R, SUZUKI J, LEE E H, MCMENOMY B P, et al. Critical care ultrasonography differentiates ARDS, pulmonary edema, and other causes in the early course of acute hypoxemic respiratory failure[J]. Chest, 2015, 148: 912-918. DOI:10.1378/chest.15-0341 |

| [19] |

LICHTENSTEIN D A, MEZIÈRE G A. Relevance of lung ultrasound in the diagnosis of acute respiratory failure: the BLUE protocol[J]. Chest, 2008, 134: 117-125. DOI:10.1378/chest.07-2800 |

| [20] |

LITJENS G, KOOI T, BEJNORDI B E, SETIO A A A, CIOMPI F, GHAFOORIAN M, et al. A survey on deep learning in medical image analysis[J]. Med Image Anal, 2017, 42: 60-88. DOI:10.1016/j.media.2017.07.005 |

2022, Vol. 43

2022, Vol. 43